Τα μοντέλα γλώσσας είναι στατιστικές μέθοδοι που προβλέπουν τη διαδοχή των διακριτικών σε ακολουθίες, χρησιμοποιώντας φυσικό κείμενο. Τα μεγάλα γλωσσικά μοντέλα (LLM) είναι μοντέλα γλώσσας που βασίζονται σε νευρωνικά δίκτυα με εκατοντάδες εκατομμύρια (ΜΠΕΡΤ) σε πάνω από ένα τρισεκατομμύριο παραμέτρους (MiCS), και του οποίου το μέγεθος καθιστά την εκπαίδευση με μία GPU μη πρακτική. Οι παραγωγικές ικανότητες των LLM τα καθιστούν δημοφιλή για σύνθεση κειμένου, περίληψη, μηχανική μετάφραση και πολλά άλλα.

Το μέγεθος ενός LLM και τα δεδομένα εκπαίδευσής του είναι ένα δίκοπο μαχαίρι: φέρνει ποιότητα μοντελοποίησης, αλλά συνεπάγεται προκλήσεις υποδομής. Το ίδιο το μοντέλο είναι συχνά πολύ μεγάλο για να χωράει στη μνήμη μιας συσκευής GPU ή στις πολλαπλές συσκευές μιας παρουσίας πολλαπλών GPU. Αυτοί οι παράγοντες απαιτούν εκπαίδευση ενός LLM σε μεγάλες ομάδες περιπτώσεων ταχείας μηχανικής μάθησης (ML). Τα τελευταία χρόνια, πολλοί πελάτες χρησιμοποιούν το AWS Cloud για εκπαίδευση LLM.

Σε αυτήν την ανάρτηση, εξετάζουμε συμβουλές και βέλτιστες πρακτικές για επιτυχημένη εκπαίδευση LLM Εκπαίδευση Amazon SageMaker. Το SageMaker Training είναι μια διαχειριζόμενη υπηρεσία υπολογιστών δέσμης ML που μειώνει τον χρόνο και το κόστος για την εκπαίδευση και τον συντονισμό μοντέλων σε κλίμακα χωρίς την ανάγκη διαχείρισης υποδομής. Μέσα σε μία εντολή εκκίνησης, Amazon Sage Maker λανσάρει ένα πλήρως λειτουργικό, εφήμερο σύμπλεγμα υπολογιστών που εκτελεί την εργασία της επιλογής σας και με βελτιωμένες δυνατότητες ML, όπως η μετατόπιση, η διαχείριση εισόδου/εξόδου και η διανομή. Η ανάρτηση καλύπτει όλες τις φάσεις ενός φόρτου εργασίας εκπαίδευσης LLM και περιγράφει τα σχετικά χαρακτηριστικά υποδομής και τις βέλτιστες πρακτικές. Μερικές από τις βέλτιστες πρακτικές σε αυτήν την ανάρτηση αναφέρονται συγκεκριμένα σε στιγμιότυπα ml.p4d.24xlarge, αλλά οι περισσότερες ισχύουν για οποιονδήποτε τύπο παρουσίας. Αυτές οι βέλτιστες πρακτικές σάς επιτρέπουν να εκπαιδεύετε LLM στο SageMaker σε κλίμακα από δεκάδες έως εκατοντάδες εκατομμύρια παραμέτρους.

Σχετικά με το εύρος αυτής της ανάρτησης, σημειώστε τα εξής:

- Δεν καλύπτουμε τον επιστημονικό σχεδιασμό νευρωνικών δικτύων και τις σχετικές βελτιστοποιήσεις. Amazon. Επιστήμη διαθέτει πολυάριθμες επιστημονικές δημοσιεύσεις, συμπεριλαμβανομένων και δεν περιορίζονται σε αυτές LLMs.

- Παρόλο που αυτή η ανάρτηση εστιάζει σε LLM, οι περισσότερες από τις βέλτιστες πρακτικές της είναι σχετικές για κάθε είδους εκπαίδευση μεγάλου μοντέλου, συμπεριλαμβανομένης της όρασης υπολογιστών και μοντέλων πολλαπλών τρόπων, όπως το Stable Diffusion.

Βέλτιστες πρακτικές

Συζητάμε τις ακόλουθες βέλτιστες πρακτικές σε αυτήν την ανάρτηση:

- Υπολογίστε – Το SageMaker Training είναι ένα εξαιρετικό API για την εκκίνηση εργασιών προετοιμασίας δεδομένων CPU και εργασιών GPU χιλιάδων κλίμακας.

- Αποθηκευτικός χώρος – Βλέπουμε τη φόρτωση δεδομένων και το σημείο ελέγχου να γίνονται με δύο τρόπους, ανάλογα με τις δεξιότητες και τις προτιμήσεις: με Amazon FSx Luster σύστημα αρχείων ή Απλή υπηρεσία αποθήκευσης Amazon (Amazon S3) μόνο.

- Παραλληλισμός – Η επιλογή της κατανεμημένης βιβλιοθήκης εκπαίδευσης είναι ζωτικής σημασίας για την κατάλληλη χρήση των GPU. Συνιστάται η χρήση μιας βιβλιοθήκης βελτιστοποιημένης για το cloud, όπως ο κοινός παραλληλισμός δεδομένων του SageMaker, αλλά οι αυτοδιαχειριζόμενες βιβλιοθήκες και οι βιβλιοθήκες ανοιχτού κώδικα μπορούν επίσης να λειτουργήσουν.

- Δικτύωση – Βεβαιωθείτε ότι τα EFA και NVIDIA GPUDirectRDMA είναι ενεργοποιημένα, για γρήγορη επικοινωνία μεταξύ του υπολογιστή.

- Ανθεκτικότητα – Σε μεγάλη κλίμακα, μπορεί να συμβούν αστοχίες υλικού. Συνιστούμε να κάνετε τακτικά σημεία ελέγχου. Κάθε λίγες ώρες είναι συνηθισμένο.

Επιλογή περιοχής

Ο τύπος του στιγμιότυπου και η επιθυμητή χωρητικότητα είναι καθοριστικός παράγοντας για την επιλογή Περιοχής. Για τις Περιφέρειες που υποστηρίζονται από το SageMaker και το Amazon Elastic Compute Cloud τύπους παρουσιών (Amazon EC2) που είναι διαθέσιμοι σε κάθε Περιοχή, βλ Τιμολόγηση του Amazon SageMaker. Σε αυτήν την ανάρτηση, υποθέτουμε ότι ο τύπος παρουσίας εκπαίδευσης είναι ένα ml.p4d.24xlarge που διαχειρίζεται το SageMaker.

Συνιστούμε να συνεργαστείτε με την ομάδα του λογαριασμού σας AWS ή να επικοινωνήσετε Πωλήσεις AWS για να προσδιορίσετε την κατάλληλη Περιοχή για τον φόρτο εργασίας σας για το LLM.

Προετοιμασία δεδομένων

Οι προγραμματιστές LLM εκπαιδεύουν τα μοντέλα τους σε μεγάλα σύνολα δεδομένων φυσικού κειμένου. Τα δημοφιλή παραδείγματα τέτοιων πηγών δεδομένων περιλαμβάνουν Κοινή ανίχνευση και Ο σωρός. Το κείμενο που εμφανίζεται στη φύση μπορεί να περιέχει προκαταλήψεις, ανακρίβειες, γραμματικά λάθη και συντακτικές παραλλαγές. Η τελική ποιότητα ενός LLM εξαρτάται σημαντικά από την επιλογή και την επιμέλεια των δεδομένων εκπαίδευσης. Η προετοιμασία δεδομένων κατάρτισης LLM είναι ένας ενεργός τομέας έρευνας και καινοτομίας στον κλάδο του LLM. Η προετοιμασία ενός συνόλου δεδομένων επεξεργασίας φυσικής γλώσσας (NLP) αφθονεί με ευκαιρίες παραλληλισμού μοιράσματος-τίποτα. Με άλλα λόγια, υπάρχουν βήματα που μπορούν να εφαρμοστούν σε μονάδες έργων—αρχεία πηγής, παραγράφους, προτάσεις, λέξεις—χωρίς να απαιτείται συγχρονισμός μεταξύ εργαζομένων.

Τα API εργασιών SageMaker, συγκεκριμένα το SageMaker Training και το SageMaker Processing, υπερέχουν για αυτόν τον τύπο εργασιών. Επιτρέπουν στους προγραμματιστές να εκτελούν ένα αυθαίρετο κοντέινερ Docker σε έναν στόλο πολλαπλών μηχανημάτων. Στην περίπτωση του SageMaker Training API, ο στόλος υπολογιστών μπορεί να είναι ετερογενής. Πολλά κατανεμημένα υπολογιστικά πλαίσια έχουν χρησιμοποιηθεί στο SageMaker, μεταξύ των οποίων Ντάσκ, ακτίνα, και επίσης PySpark, τα οποία έχουν ένα αφιερωμένο Δοχείο διαχείρισης AWS και SDK στο SageMaker Processing.

Όταν ξεκινάτε μια εργασία με πολλά μηχανήματα, το SageMaker Training and Processing εκτελεί τον κώδικά σας μία φορά ανά μηχάνημα. Δεν χρειάζεται να χρησιμοποιήσετε ένα συγκεκριμένο κατανεμημένο υπολογιστικό πλαίσιο για να γράψετε μια κατανεμημένη εφαρμογή: μπορείτε να γράψετε τον κώδικα της επιλογής σας, ο οποίος θα εκτελείται μία φορά ανά μηχάνημα, για να πραγματοποιήσετε παραλληλισμό κοινής χρήσης. Μπορείτε επίσης να γράψετε ή να εγκαταστήσετε τη λογική επικοινωνίας μεταξύ κόμβων της επιλογής σας.

Φόρτωση δεδομένων

Υπάρχουν πολλοί τρόποι αποθήκευσης των δεδομένων εκπαίδευσης και μεταφοράς τους από την αποθήκευσή τους στους επιταχυνόμενους κόμβους υπολογισμού. Σε αυτήν την ενότητα, συζητάμε τις επιλογές και τις βέλτιστες πρακτικές για τη φόρτωση δεδομένων.

Επιλογές αποθήκευσης και φόρτωσης του SageMaker

Ένα τυπικό μέγεθος δεδομένων LLM είναι σε εκατοντάδες εκατομμύρια διακριτικά κειμένου, που αντιπροσωπεύουν μερικές εκατοντάδες gigabyte. Τα συμπλέγματα που διαχειρίζεται το SageMaker με στιγμιότυπα ml.p4d.24xlarge προτείνουν διάφορες επιλογές για αποθήκευση και φόρτωση δεδομένων:

- On-node NVMe SSD – Τα ml.P4d.24xlarge στιγμιότυπα είναι εξοπλισμένα με 8TB NVMe, διαθέσιμο κάτω από

/opt/ml/input/data/<channel>αν χρησιμοποιείτε Λειτουργία αρχείου SageMaker, και στο/tmp. Εάν αναζητάτε την απλότητα και την απόδοση μιας τοπικής ανάγνωσης, μπορείτε να αντιγράψετε τα δεδομένα σας στον NVMe SSD. Η αντιγραφή μπορεί να γίνει είτε με τη λειτουργία αρχείου SageMaker είτε με τον δικό σας κωδικό, για παράδειγμα με χρήση πολλαπλών επεξεργασιών Boto3 or S5cmd. - FSx για Luster – Οι On-node NVMe SSD έχουν περιορισμένο μέγεθος και απαιτούν απορρόφηση από το Amazon S3 σε κάθε εργασία ή δημιουργία ζεστού συμπλέγματος. Αν θέλετε να κλιμακώσετε σε μεγαλύτερα σύνολα δεδομένων, διατηρώντας παράλληλα τυχαία πρόσβαση σε χαμηλή καθυστέρηση, μπορείτε να χρησιμοποιήσετε το FSx για Lustre. Το Amazon FSx είναι ένα σύστημα παράλληλων αρχείων ανοιχτού κώδικα, δημοφιλές στους υπολογιστές υψηλής απόδοσης (HPC). FSx για χρήσεις Luster κατανεμημένη αποθήκευση αρχείων (απογύμνωση) και διαχωρίζει φυσικά τα μεταδεδομένα του αρχείου από το περιεχόμενο του αρχείου για την επίτευξη ανάγνωσης/εγγραφής υψηλής απόδοσης.

- Λειτουργία FastFile SageMaker – Λειτουργία FastFile (ΓΓΑ) είναι μια δυνατότητα μόνο για το SageMaker που παρουσιάζει απομακρυσμένα αντικείμενα S3 σε παρουσίες υπολογισμού που διαχειρίζονται το SageMaker κάτω από μια διεπαφή συμβατή με το POSIX και τα μεταφέρει μόνο κατά την ανάγνωση, χρησιμοποιώντας FUSE. Το FFM διαβάζει αποτελέσματα σε κλήσεις S3 που μεταδίδουν ροή απομακρυσμένων αρχείων μπλοκ προς μπλοκ. Ως βέλτιστη πρακτική για την αποφυγή σφαλμάτων που σχετίζονται με την επισκεψιμότητα του Amazon S3, οι προγραμματιστές του FFM θα πρέπει να επιδιώκουν να διατηρήσουν λογικό τον υποκείμενο αριθμό κλήσεων S3, για παράδειγμα διαβάζοντας αρχεία διαδοχικά και με ελεγχόμενη ποσότητα παραλληλισμού.

- Αυτοδιαχειριζόμενη φόρτωση δεδομένων – Φυσικά, μπορείτε επίσης να αποφασίσετε να εφαρμόσετε τη δική σας, πλήρως προσαρμοσμένη λογική φόρτωσης δεδομένων, χρησιμοποιώντας ιδιόκτητο κώδικα ή κώδικα ανοιχτού κώδικα. Μερικοί λόγοι για τη χρήση αυτοδιαχειριζόμενης φόρτωσης δεδομένων είναι για τη διευκόλυνση μιας μετεγκατάστασης με την επαναχρησιμοποίηση ήδη ανεπτυγμένου κώδικα, την εφαρμογή προσαρμοσμένης λογικής διαχείρισης σφαλμάτων ή για να έχετε περισσότερο έλεγχο στην υποκείμενη απόδοση και την κοινή χρήση. Παραδείγματα βιβλιοθηκών που μπορείτε να χρησιμοποιήσετε για αυτοδιαχειριζόμενη φόρτωση δεδομένων περιλαμβάνουν torchdata.datapipes (προηγουμένως Πρόσθετο AWS PyTorch S3) Και Σύνολο δεδομένων ιστού. Το AWS Python SDK Boto3 μπορεί επίσης να συνδυαστεί με Σετ δεδομένων φακού κλάσεις για τη δημιουργία προσαρμοσμένου κώδικα φόρτωσης δεδομένων. Οι προσαρμοσμένες τάξεις φόρτωσης δεδομένων επιτρέπουν επίσης τη δημιουργική χρήση ετερογενών συμπλεγμάτων SageMaker Training, για να προσαρμόσουν με ακρίβεια την ισορροπία της CPU και της GPU σε ένα δεδομένο φόρτο εργασίας.

Για περισσότερες πληροφορίες σχετικά με αυτές τις επιλογές και τον τρόπο επιλογής τους, ανατρέξτε στο Επιλέξτε την καλύτερη πηγή δεδομένων για την εργασία εκπαίδευσης στο Amazon SageMaker.

Βέλτιστες πρακτικές για αλληλεπίδραση μεγάλης κλίμακας με το Amazon S3

Το Amazon S3 είναι σε θέση να χειρίζεται φόρτους εργασίας LLM, τόσο για ανάγνωση δεδομένων όσο και για σημεία ελέγχου. Υποστηρίζει α ποσοστό αιτήματος από 3,500 PUT/COPY/POST/DELETE ή 5,500 GET/HEAD αιτήματα ανά δευτερόλεπτο ανά πρόθεμα σε έναν κάδο. Ωστόσο, αυτό το ποσοστό δεν είναι απαραίτητα διαθέσιμο από προεπιλογή. Αντίθετα, καθώς αυξάνεται το ποσοστό αιτημάτων για ένα πρόθεμα, το Amazon S3 κλιμακώνεται αυτόματα για να χειριστεί τον αυξημένο ρυθμό. Για περισσότερες πληροφορίες, ανατρέξτε στο Γιατί λαμβάνω σφάλματα 503 Slow Down από το Amazon S3 όταν τα αιτήματα είναι εντός του υποστηριζόμενου ποσοστού αιτημάτων ανά πρόθεμα.

Εάν περιμένετε αλληλεπίδραση υψηλής συχνότητας Amazon S3, σας προτείνουμε τις ακόλουθες βέλτιστες πρακτικές:

- Προσπαθήστε να διαβάζετε και να γράφετε από πολλαπλούς κάδους S3 και προθέματα. Για παράδειγμα, μπορείτε να χωρίσετε τα δεδομένα εκπαίδευσης και τα σημεία ελέγχου σε διαφορετικά προθέματα.

- Ελέγξτε τις μετρήσεις του Amazon S3 amazoncloudwatch για να παρακολουθείτε τα ποσοστά αιτημάτων.

- Προσπαθήστε να ελαχιστοποιήσετε την ποσότητα του ταυτόχρονου PUT/GET:

- Έχετε λιγότερες διεργασίες χρησιμοποιώντας το Amazon S3 ταυτόχρονα. Για παράδειγμα, εάν οκτώ διεργασίες ανά κόμβο πρέπει να περάσουν από το σημείο ελέγχου στο Amazon S3, μπορείτε να μειώσετε την επισκεψιμότητα PUT κατά 8 με το σημείο ελέγχου ιεραρχικά: πρώτα εντός του κόμβου και μετά από τον κόμβο στο Amazon S3.

- Διαβάστε πολλαπλές εγγραφές εκπαίδευσης από ένα μόνο αρχείο ή S3 GET, αντί να χρησιμοποιείτε ένα S3 GET για κάθε εγγραφή προπόνησης.

- Εάν χρησιμοποιείτε το Amazon S3 μέσω του SageMaker FFM, το SageMaker FFM πραγματοποιεί κλήσεις S3 για ανάκτηση αρχείων ανά κομμάτι. Για να περιορίσετε την επισκεψιμότητα του Amazon S3 που δημιουργείται από το FFM, σας συνιστούμε να διαβάζετε αρχεία διαδοχικά και να περιορίζετε τον αριθμό των αρχείων που ανοίγονται παράλληλα.

Εάν έχετε ένα Πρόγραμμα υποστήριξης προγραμματιστών, επιχειρήσεων ή επιχειρήσεων, μπορείτε να ανοίξετε μια θήκη τεχνικής υποστήριξης σχετικά με σφάλματα Slow Down S3 503. Αλλά πρώτα βεβαιωθείτε ότι έχετε ακολουθήσει τις βέλτιστες πρακτικές και λάβετε τα αναγνωριστικά αιτημάτων για τα αποτυχημένα αιτήματα.

Προπονητικός παραλληλισμός

Τα LLM έχουν συνήθως δεκάδες έως εκατοντάδες δισεκατομμύρια παραμέτρους, γεγονός που τις καθιστά πολύ μεγάλες για να χωρέσουν σε μία κάρτα GPU NVIDIA. Οι επαγγελματίες LLM έχουν αναπτύξει αρκετές βιβλιοθήκες ανοιχτού κώδικα που διευκολύνουν τον κατανεμημένο υπολογισμό της εκπαίδευσης LLM, συμπεριλαμβανομένων FSDP, Βαθιά ταχύτητα και Megatron. Μπορείτε να εκτελέσετε αυτές τις βιβλιοθήκες στο SageMaker Training, αλλά μπορείτε επίσης να χρησιμοποιήσετε κατανεμημένες εκπαιδευτικές βιβλιοθήκες SageMaker, οι οποίες έχουν βελτιστοποιηθεί για το AWS Cloud και παρέχουν μια απλούστερη εμπειρία προγραμματιστή. Οι προγραμματιστές έχουν δύο επιλογές για την κατανεμημένη εκπαίδευση του LLM τους στο SageMaker: κατανεμημένες βιβλιοθήκες ή αυτοδιαχειριζόμενες.

Το SageMaker διένειμε βιβλιοθήκες

Για να σας παρέχει βελτιωμένη απόδοση και χρηστικότητα κατανεμημένης προπόνησης, το SageMaker Training προτείνει αρκετές ιδιόκτητες επεκτάσεις για την κλίμακα του εκπαιδευτικού κώδικα TensorFlow και PyTorch. Η εκπαίδευση LLM διεξάγεται συχνά με τρισδιάστατο τρόπο παραλληλισμού:

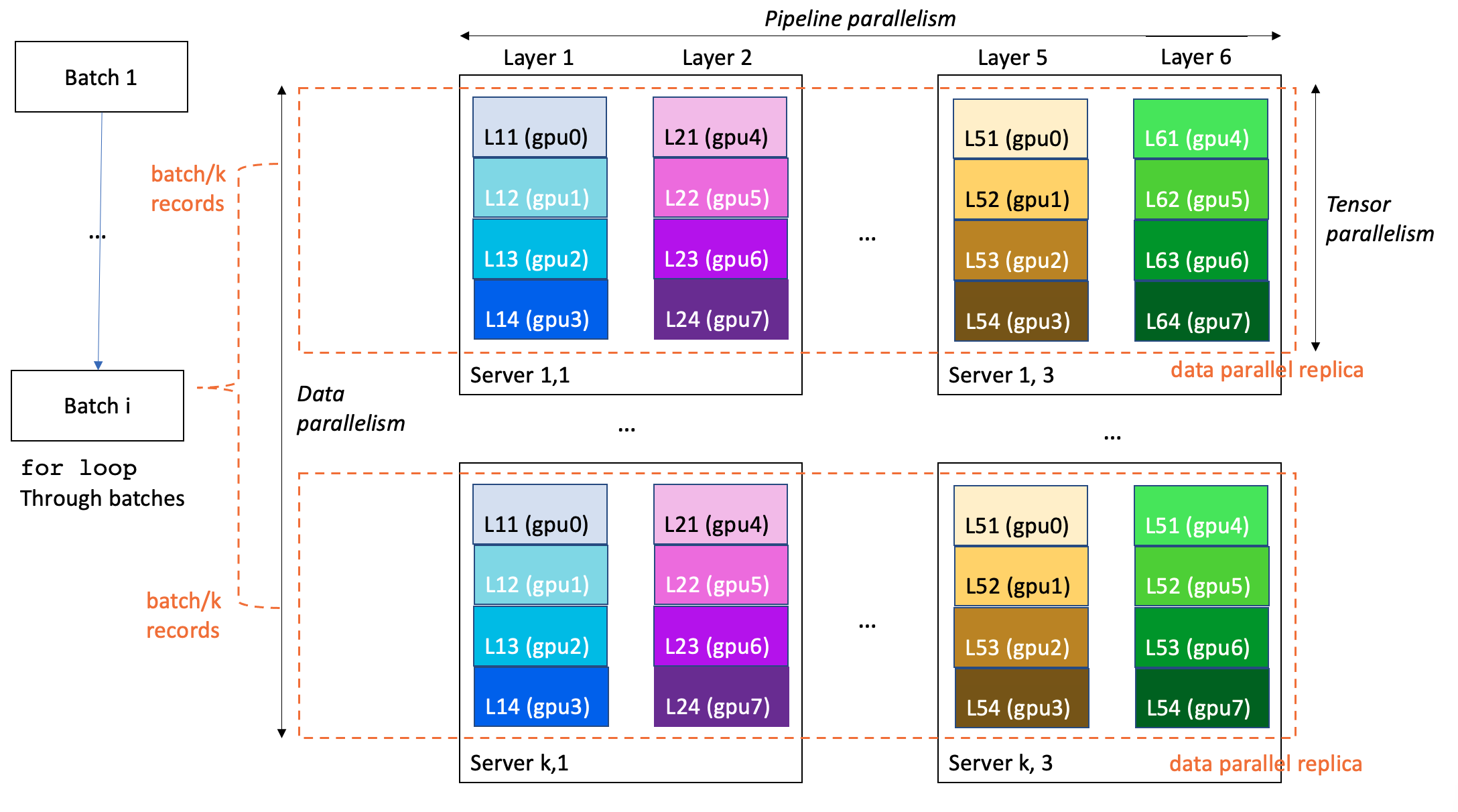

- Παραλληλισμός δεδομένων χωρίζει και τροφοδοτεί τις μίνι παρτίδες εκπαίδευσης σε πολλαπλά πανομοιότυπα αντίγραφα του μοντέλου, για να αυξήσει την ταχύτητα επεξεργασίας

- Παραλληλισμός αγωγών αποδίδει διάφορα επίπεδα του μοντέλου σε διαφορετικές GPU ή ακόμα και στιγμιότυπα, προκειμένου να κλιμακώσει το μέγεθος του μοντέλου πέρα από μια μεμονωμένη GPU και έναν μόνο διακομιστή

- Παραλληλισμός τανυστών χωρίζει ένα επίπεδο σε πολλαπλές GPU, συνήθως μέσα στον ίδιο διακομιστή, για να κλιμακώσει μεμονωμένα επίπεδα σε μεγέθη που υπερβαίνουν μια μεμονωμένη GPU

Στο ακόλουθο παράδειγμα, ένα μοντέλο 6 επιπέδων εκπαιδεύεται σε ένα σύμπλεγμα διακομιστών k*3 με 8*k*3 GPU (8 GPU ανά διακομιστή). Ο βαθμός παραλληλισμού δεδομένων είναι k, ο παραλληλισμός αγωγών 6 και ο παραλληλισμός τανυστών 4. Κάθε GPU στο σύμπλεγμα περιέχει το ένα τέταρτο ενός επιπέδου μοντέλου και ένα πλήρες μοντέλο κατατμείται σε τρεις διακομιστές (24 GPU συνολικά).

Τα ακόλουθα είναι ειδικά σχετικά με τα LLM:

- Το SageMaker διένειμε το μοντέλο παράλληλα – Αυτή η βιβλιοθήκη χρησιμοποιεί διαμέριση γραφημάτων για την παραγωγή έξυπνων διαμερισμάτων μοντέλων βελτιστοποιημένη για ταχύτητα ή μνήμη. Το παράλληλο κατανεμημένο μοντέλου του SageMaker εκθέτει την πιο πρόσφατη και μεγαλύτερη βελτιστοποίηση εκπαίδευσης μεγάλου μοντέλου, συμπεριλαμβανομένου του παραλληλισμού δεδομένων, του παραλληλισμού αγωγών, του παραλληλισμού τανυστών, του διαμοιρασμού κατάστασης βελτιστοποίησης, του σημείου ελέγχου ενεργοποίησης και της εκφόρτωσης. Με την κατανεμημένη παράλληλη βιβλιοθήκη μοντέλων του SageMaker, τεκμηριώσαμε μια εκπαίδευση μοντέλων 175 δισεκατομμυρίων παραμέτρων σε 920 GPU NVIDIA A100. Για περισσότερες πληροφορίες, ανατρέξτε στο Εκπαιδεύστε 175+ δισεκατομμύρια μοντέλα NLP παραμέτρων με παράλληλες προσθήκες μοντέλων και Hugging Face στο Amazon SageMaker.

- Το SageMaker μοιράστηκε παράλληλα δεδομένα - Σε MiCS: Σχεδόν γραμμική κλιμάκωση για εκπαίδευση γιγαντιαίο μοντέλο σε δημόσιο σύννεφο, Zhang et al. εισαγάγετε μια παράλληλη στρατηγική μοντέλου χαμηλής επικοινωνίας που χωρίζει τα μοντέλα μόνο σε μια παράλληλη ομάδα δεδομένων, αντί για ολόκληρο το σύμπλεγμα. Με το MiCS, οι επιστήμονες του AWS μπόρεσαν να επιτύχουν 176 teraflops ανά GPU (56.4% της θεωρητικής κορυφής) για την εκπαίδευση ενός μοντέλου 210 επιπέδων 1.06 τρισεκατομμυρίων παραμέτρων σε περιπτώσεις EC2 P4de. Το MiCS είναι πλέον διαθέσιμο για πελάτες του SageMaker Training ως Το SageMaker μοιράστηκε παράλληλα δεδομένα.

Οι κατανεμημένες βιβλιοθήκες εκπαίδευσης SageMaker παρέχουν υψηλή απόδοση και απλούστερη εμπειρία προγραμματιστή. Συγκεκριμένα, οι προγραμματιστές δεν χρειάζεται να γράφουν και να διατηρούν μια προσαρμοσμένη παράλληλη εκκίνηση διεργασιών ή να χρησιμοποιούν ένα εργαλείο εκκίνησης συγκεκριμένου πλαισίου, επειδή η παράλληλη εκκίνηση είναι ενσωματωμένη στο SDK εκκίνησης εργασιών.

Αυτοδιαχειριζόμενο

Με το SageMaker Training, έχετε την ελευθερία να χρησιμοποιήσετε το πλαίσιο και το επιστημονικό παράδειγμα της επιλογής σας. Συγκεκριμένα, εάν θέλετε να διαχειριστείτε μόνοι σας την κατανεμημένη εκπαίδευση, έχετε δύο επιλογές για να γράψετε τον προσαρμοσμένο κωδικό σας:

- Χρησιμοποιήστε ένα AWS Deep Learning Container (DLC) – Το AWS αναπτύσσει και διατηρεί DLCs, παρέχοντας περιβάλλοντα που βασίζονται σε Docker βελτιστοποιημένα για AWS για κορυφαία πλαίσια ML ανοιχτού κώδικα. Το SageMaker Training έχει μια μοναδική ενσωμάτωση που σας επιτρέπει να τραβάτε και να τρέχετε AWS DLC με εξωτερικό σημείο εισόδου που ορίζεται από το χρήστη. Ειδικά για την εκπαίδευση LLM, τα DLC AWS για TensorFlow, PyTorch, Hugging Face και MXNet είναι ιδιαίτερα σχετικά. Η χρήση ενός DLC πλαισίου σάς επιτρέπει να χρησιμοποιείτε τον εγγενή παραλληλισμό πλαισίου, όπως το PyTorch Distributed, χωρίς να χρειάζεται να αναπτύξετε και να διαχειριστείτε τις δικές σας εικόνες Docker. Επιπλέον, τα DLC μας διαθέτουν ένα Ενσωμάτωση MPI, που σας επιτρέπει να εκκινήσετε εύκολα παράλληλο κώδικα.

- Γράψτε μια προσαρμοσμένη εικόνα Docker συμβατή με το SageMaker – Μπορείτε να φέρετε τη δική σας (BYO) εικόνα (βλ Χρησιμοποιήστε τους δικούς σας αλγόριθμους εκπαίδευσης και Κοντέινερ προσαρμοσμένης εκπαίδευσης Amazon SageMaker), είτε ξεκινώντας από την αρχή είτε επεκτείνοντας μια υπάρχουσα εικόνα DLC. Όταν χρησιμοποιείτε μια προσαρμοσμένη εικόνα για εκπαίδευση LLM στο SageMaker, είναι ιδιαίτερα σημαντικό να επαληθεύσετε τα ακόλουθα:

- Η εικόνα σας περιέχει EFA με κατάλληλες ρυθμίσεις (θα συζητηθεί περισσότερο αργότερα σε αυτήν την ανάρτηση)

- Η εικόνα σας περιέχει μια βιβλιοθήκη επικοινωνίας NVIDIA NCCL, ενεργοποιημένη με GPUDirectRDMA

Οι πελάτες μπόρεσαν να χρησιμοποιήσουν μια σειρά από αυτοδιαχειριζόμενες κατανεμημένες βιβλιοθήκες εκπαίδευσης, συμπεριλαμβανομένου του DeepSpeed.

Διαβιβάσεις

Δεδομένης της κατανεμημένης φύσης μιας εργασίας εκπαίδευσης LLM, η επικοινωνία μεταξύ των μηχανών είναι κρίσιμη για τη σκοπιμότητα, την απόδοση και το κόστος του φόρτου εργασίας. Σε αυτήν την ενότητα, παρουσιάζουμε βασικά χαρακτηριστικά για την επικοινωνία μεταξύ των μηχανών και καταλήγουμε με συμβουλές για εγκατάσταση και ρύθμιση.

Ελαστικός προσαρμογέας υφάσματος

Για να επιταχύνετε τις εφαρμογές ML και να βελτιώσετε τις επιδόσεις επιτυγχάνοντας ευελιξία, επεκτασιμότητα και ελαστικότητα που παρέχει το cloud, μπορείτε να επωφεληθείτε από Ελαστικός προσαρμογέας υφάσματος (EFA) με το SageMaker. Σύμφωνα με την εμπειρία μας, η χρήση EFA είναι μια απαίτηση για να έχετε ικανοποιητική απόδοση εκπαίδευσης LLM σε πολλούς κόμβους.

Μια συσκευή EFA είναι μια διεπαφή δικτύου συνδεδεμένη σε περιπτώσεις EC2 που διαχειρίζεται το SageMaker κατά τη διάρκεια της εκτέλεσης των εργασιών εκπαίδευσης. Το EFA είναι διαθέσιμο σε συγκεκριμένες οικογένειες παρουσιών, συμπεριλαμβανομένου του P4d. Τα δίκτυα EFA είναι ικανά να επιτύχουν απόδοση πολλών εκατοντάδων Gbps.

Σε σχέση με την EFA, η AWS παρουσίασε το Scalable Αξιόπιστο Datagram (SRD), μια μεταφορά βασισμένη σε ethernet εμπνευσμένη από το InfiniBand Αξιόπιστο Datagram, εξελίχθηκε με χαλαρό περιορισμό παραγγελίας πακέτων. Για περισσότερες πληροφορίες σχετικά με το EFA και το SRD, ανατρέξτε στο Στην αναζήτηση απόδοσης, υπάρχουν περισσότεροι από ένας τρόποι για τη δημιουργία ενός δικτύου, το βίντεο Πώς λειτουργεί το EFA και γιατί δεν χρησιμοποιούμε το infiniband στο cloudκαι την ερευνητική εργασία Ένα πρωτόκολλο μεταφοράς βελτιστοποιημένο για το νέφος για ελαστικό και κλιμακούμενο HPC από τους Shalev et al.

Μπορείτε να προσθέσετε ενσωμάτωση EFA σε συμβατές παρουσίες σε υπάρχοντα κοντέινερ Docker του SageMaker ή προσαρμοσμένα κοντέινερ που μπορούν να χρησιμοποιηθούν για την εκπαίδευση μοντέλων ML χρησιμοποιώντας εργασίες SageMaker. Για περισσότερες πληροφορίες, ανατρέξτε στο Εκτέλεση προπόνησης με EFA. Το EFA εκτίθεται μέσω του ανοιχτού κώδικα Libfabric πακέτο επικοινωνίας. Ωστόσο, οι προγραμματιστές LLM σπάνια το προγραμματίζουν απευθείας με το Libfabric και συνήθως βασίζονται στη Συλλογική Βιβλιοθήκη Επικοινωνιών NVIDIA (NCCL).

Πρόσθετο AWS-OFI-NCCL

Στο κατανεμημένο ML, το EFA χρησιμοποιείται συχνότερα με τη NVIDIA Collective Communications Library (NCCL). Το NCCL είναι μια βιβλιοθήκη ανοιχτού κώδικα που αναπτύχθηκε από την NVIDIA και εφαρμόζει αλγόριθμους επικοινωνίας μεταξύ GPU. Η επικοινωνία μεταξύ GPU είναι ο ακρογωνιαίος λίθος της εκπαίδευσης LLM που καταλύει την επεκτασιμότητα και την απόδοση. Είναι τόσο κρίσιμο για την εκπαίδευση DL που το NCCL συχνά ενσωματώνεται απευθείας ως υποστήριξη επικοινωνίας σε βιβλιοθήκες εκπαίδευσης βαθιάς μάθησης, έτσι ώστε οι προγραμματιστές LLM να το χρησιμοποιούν - μερικές φορές χωρίς να το καταλάβουν - από το προτιμώμενο πλαίσιο ανάπτυξης Python DL. Για να χρησιμοποιήσουν το NCCL στο EFA, οι προγραμματιστές LLM χρησιμοποιούν το AWS που αναπτύχθηκε Πρόσθετο AWS OFI NCCL, το οποίο αντιστοιχίζει τις κλήσεις NCCL στη διεπαφή Libfabric που χρησιμοποιείται από την EFA. Συνιστούμε να χρησιμοποιήσετε την πιο πρόσφατη έκδοση του AWS OFI NCCL για να επωφεληθείτε από τις πρόσφατες βελτιώσεις.

Για να επαληθεύσετε ότι το NCCL χρησιμοποιεί EFA, θα πρέπει να ορίσετε τη μεταβλητή περιβάλλοντος NCCL_DEBUG προς την INFOκαι ελέγξτε στα αρχεία καταγραφής ότι το EFA φορτώνεται από το NCCL:

Για περισσότερες πληροφορίες σχετικά με τη διαμόρφωση NCCL και EFA, ανατρέξτε στο Δοκιμάστε τη διαμόρφωση EFA και NCCL. Μπορείτε να προσαρμόσετε περαιτέρω το NCCL με πολλά μεταβλητές περιβάλλοντος. Σημειώστε ότι αποτελεσματικό στο NCCL 2.12 και νεότερο, το AWS συνεισέφερε μια λογική επιλογής αυτοματοποιημένου αλγορίθμου επικοινωνίας για δίκτυα EFA (NCCL_ALGO μπορεί να μείνει χωρίς ρύθμιση).

NVIDIA GPUDirect RDMA μέσω EFA

Με τον τύπο παρουσίας P4d, εμείς εισήγαγε GPUDirect RDMA (GDR) πάνω από ύφασμα EFA. Επιτρέπει στις κάρτες διασύνδεσης δικτύου (NIC) να έχουν άμεση πρόσβαση στη μνήμη GPU, καθιστώντας την απομακρυσμένη επικοινωνία GPU-to-GPU σε παρουσίες EC2 που βασίζονται σε GPU NVIDIA ταχύτερη, μειώνοντας την επιβάρυνση της ενορχήστρωσης σε CPU και εφαρμογές χρηστών. Το GDR χρησιμοποιείται κάτω από την κουκούλα από το NCCL, όταν είναι εφικτό.

Η χρήση GDR εμφανίζεται στην επικοινωνία μεταξύ GPU όταν το επίπεδο καταγραφής έχει οριστεί σε INFO, όπως στον ακόλουθο κώδικα:

Χρήση EFA σε κοντέινερ AWS Deep Learning

Η AWS διατηρεί Deep Learning Containers (DLC), πολλά από τα οποία συνοδεύονται από Dockerfiles που διαχειρίζονται AWS και ενσωματώνονται που περιέχουν EFA, AWS OFI NCCL και NCCL. Τα ακόλουθα repos GitHub προσφέρουν παραδείγματα με PyTorch και TensorFlow. Δεν χρειάζεται να εγκαταστήσετε αυτές τις βιβλιοθήκες μόνοι σας.

Χρήση EFA στο δικό σας κοντέινερ SageMaker Training

Εάν δημιουργήσετε το δικό σας κοντέινερ SageMaker Training και θέλετε να χρησιμοποιήσετε το NCCL μέσω EFA για ταχεία επικοινωνία μεταξύ κόμβων, πρέπει να εγκαταστήσετε τα EFA, NCCL και AWS OFI NCCL. Για περισσότερες πληροφορίες, ανατρέξτε στο Εκτέλεση προπόνησης με EFA. Επιπλέον, θα πρέπει να ορίσετε τις ακόλουθες μεταβλητές περιβάλλοντος στο κοντέινερ ή στον κωδικό του σημείου εισόδου:

FI_PROVIDER="efa"καθορίζει τον πάροχο διασύνδεσης υφάσματοςNCCL_PROTO=simpleκαθοδηγεί το NCCL να χρησιμοποιήσει ένα απλό πρωτόκολλο για επικοινωνία (προς το παρόν, ο πάροχος EFA δεν υποστηρίζει πρωτόκολλα LL· η ενεργοποίησή τους θα μπορούσε να οδηγήσει σε καταστροφή δεδομένων)FI_EFA_USE_DEVICE_RDMA=1χρησιμοποιεί τη λειτουργία RDMA της συσκευής για μεταφορά μονής και διπλής όψηςNCCL_LAUNCH_MODE="PARALLEL"NCCL_NET_SHARED_COMMS="0"

Ορχήστρα

Η διαχείριση του κύκλου ζωής και του φόρτου εργασίας δεκάδων έως εκατοντάδων περιπτώσεων υπολογισμού απαιτεί λογισμικό ενορχήστρωσης. Σε αυτήν την ενότητα, προσφέρουμε βέλτιστες πρακτικές για την ενορχήστρωση LLM

Ενορχήστρωση εντός της εργασίας

Οι προγραμματιστές πρέπει να γράφουν τόσο κώδικα εκπαίδευσης από την πλευρά του διακομιστή όσο και κώδικα εκκίνησης από την πλευρά του πελάτη στα περισσότερα κατανεμημένα πλαίσια. Ο κώδικας εκπαίδευσης εκτελείται σε μηχανήματα εκπαίδευσης, ενώ ο κώδικας εκκίνησης από την πλευρά του πελάτη εκκινεί τον κατανεμημένο φόρτο εργασίας από ένα μηχάνημα πελάτη. Υπάρχει μικρή τυποποίηση σήμερα, για παράδειγμα:

- Στο PyTorch, οι προγραμματιστές μπορούν να ξεκινήσουν εργασίες πολλαπλών μηχανών χρησιμοποιώντας

torchrun,torchx,torch.distributed.launch(διαδρομή κατάργησης) ήtorch.multiprocessing.spawn - Η DeepSpeed προτείνει το δικό της πρόγραμμα εκκίνησης CLI βαθιάς ταχύτητας και υποστηρίζει επίσης την εκκίνηση MPI

- Το MPI είναι ένα δημοφιλές πλαίσιο παράλληλων υπολογιστών που έχει το πλεονέκτημα ότι είναι ML-agnostic και εύλογα διατηρημένο, και επομένως σταθερό και τεκμηριωμένο, και εμφανίζεται όλο και περισσότερο σε κατανεμημένους φόρτους εργασίας ML

Σε ένα σύμπλεγμα SageMaker Training, το κοντέινερ εκπαίδευσης εκκινείται μία φορά σε κάθε μηχάνημα. Κατά συνέπεια, έχετε τρεις επιλογές:

- Εγγενής εκτοξευτής – Μπορείτε να χρησιμοποιήσετε ως σημείο εισόδου την εγγενή εκκίνηση ενός συγκεκριμένου πλαισίου DL, για παράδειγμα α

torchrunκλήση, η οποία θα δημιουργήσει πολλές τοπικές διαδικασίες και θα δημιουργήσει επικοινωνίες μεταξύ των περιπτώσεων. - Ενσωμάτωση SageMaker MPI – Μπορείτε να χρησιμοποιήσετε την ενσωμάτωση SageMaker MPI, διαθέσιμη στο AWS DLC μας ή με δυνατότητα αυτόματης εγκατάστασης μέσω κιτ εργαλείων εκπαίδευσης, για να εκτελέσετε απευθείας τον κωδικό σημείου εισόδου σας N φορές ανά μηχάνημα. Αυτό έχει το πλεονέκτημα της αποφυγής της χρήσης ενδιάμεσων σεναρίων εκκίνησης για συγκεκριμένο πλαίσιο στον δικό σας κώδικα.

- Το SageMaker διένειμε βιβλιοθήκες – Εάν χρησιμοποιείτε τις κατανεμημένες βιβλιοθήκες του SageMaker, μπορείτε να εστιάσετε στον εκπαιδευτικό κώδικα και να μην χρειάζεται να γράψετε καθόλου κώδικα εκκίνησης! Ο κατανεμημένος κώδικας εκκίνησης του SageMaker είναι ενσωματωμένος στο SageMaker SDK.

Ενορχηστρώσεις μεταξύ εργασιών

Τα έργα LLM αποτελούνται συχνά από πολλαπλές εργασίες: αναζήτηση παραμέτρων, πειράματα κλιμάκωσης, ανάκτηση από σφάλματα και πολλά άλλα. Για να ξεκινήσετε, να σταματήσετε και να παραλληλίσετε τις εκπαιδευτικές εργασίες, είναι σημαντικό να χρησιμοποιήσετε έναν ενορχηστρωτή εργασίας. Το SageMaker Training είναι ένας ενορχηστρωτής εργασιών ML χωρίς διακομιστές που παρέχει παροδικές παρουσίες υπολογισμού αμέσως κατόπιν αιτήματος. Πληρώνετε μόνο για ό,τι χρησιμοποιείτε και τα συμπλέγματα παροπλίζονται μόλις λήξει ο κωδικός σας. Με SageMaker Training Warm Pools, έχετε την επιλογή να ορίσετε ένα time-to-live σε ομάδες κατάρτισης, προκειμένου να επαναχρησιμοποιήσετε την ίδια υποδομή σε όλες τις θέσεις εργασίας. Αυτό μειώνει τον χρόνο επανάληψης και τη μεταβλητότητα της τοποθέτησης μεταξύ εργασιών. Οι εργασίες SageMaker μπορούν να ξεκινήσουν από διάφορες γλώσσες προγραμματισμού, μεταξύ των οποίων Python και CLI.

Υπάρχει ένα Python SDK για το SageMaker που ονομάζεται SDK SageMaker Python και υλοποιείται μέσω του σοφός Βιβλιοθήκη Python, αλλά η χρήση της είναι προαιρετική.

Αύξηση ποσοστώσεων για θέσεις εργασίας κατάρτισης με μεγάλο και μακροχρόνιο σύμπλεγμα κατάρτισης

Το SageMaker έχει προεπιλεγμένες ποσοστώσεις στους πόρους, σχεδιασμένες να αποτρέπουν την ακούσια χρήση και το κόστος. Για να εκπαιδεύσετε ένα LLM χρησιμοποιώντας ένα μεγάλο σύμπλεγμα εμφανίσεων προηγμένης τεχνολογίας που τρέχουν για μεγάλο χρονικό διάστημα, πιθανότατα θα χρειαστεί να αυξήσετε τα ποσοστά στον παρακάτω πίνακα.

| Όνομα ποσόστωσης | Προεπιλεγμένη τιμή |

| Ο μεγαλύτερος χρόνος εκτέλεσης για εργασία εκπαίδευσης | 432,000 δευτερόλεπτα |

| Αριθμός περιπτώσεων σε όλες τις εργασίες κατάρτισης | 4 |

| Μέγιστος αριθμός περιπτώσεων ανά εργασία κατάρτισης | 20 |

| ml.p4d.24xlarge για χρήση εργασίας εκπαίδευσης | 0 |

| ml.p4d.24xlarge για προπόνηση ζεστή χρήση πισίνας | 0 |

Βλέπω ποσοστώσεις υπηρεσιών AWS πώς να δείτε τις τιμές του ορίου σας και να ζητήσετε αύξηση ορίου. Οι ποσοστώσεις κατ' απαίτηση, Spot Instance και προπόνηση ζεστών πισινών παρακολουθούνται και τροποποιούνται ξεχωριστά.

Εάν αποφασίσετε να διατηρήσετε ενεργοποιημένο το SageMaker Profiler, να γνωρίζετε ότι κάθε εργασία εκπαίδευσης ξεκινά μια εργασία Επεξεργασίας SageMaker, καθεμία από τις οποίες καταναλώνει ένα ml.m5.2xlarge παράδειγμα. Επιβεβαιώστε ότι τα ποσοστά σας στο SageMaker Processing είναι αρκετά υψηλά ώστε να καλύπτουν την αναμενόμενη ταυτόχρονη εργασία εκπαίδευσης. Για παράδειγμα, εάν θέλετε να εκκινήσετε 50 εργασίες εκπαίδευσης με δυνατότητα Profiler που εκτελούνται ταυτόχρονα, θα πρέπει να αυξήσετε το όριο ml.m5.2xlarge για την επεξεργασία του ορίου χρήσης εργασίας σε 50.

Επιπλέον, για να ξεκινήσετε μια μακροχρόνια εργασία, θα πρέπει να ορίσετε ρητά το Εκτιμητής max_run παράμετρος στην επιθυμητή μέγιστη διάρκεια για την εργασία εκπαίδευσης σε δευτερόλεπτα, μέχρι την τιμή ποσόστωσης του μεγαλύτερου χρόνου εκτέλεσης για μια εργασία εκπαίδευσης.

Παρακολούθηση και ανθεκτικότητα

Η αστοχία υλικού είναι εξαιρετικά σπάνια στην κλίμακα μιας μόνο παρουσίας και γίνεται ολοένα και πιο συχνή όσο αυξάνεται ο αριθμός των περιπτώσεων που χρησιμοποιούνται ταυτόχρονα. Σε τυπική κλίμακα LLM - εκατοντάδες έως χιλιάδες GPU που χρησιμοποιούνται 24 ώρες το 7ωρο για εβδομάδες έως μήνες - είναι σχεδόν βέβαιο ότι θα συμβούν αστοχίες υλικού. Επομένως, ένας φόρτος εργασίας LLM πρέπει να εφαρμόζει κατάλληλους μηχανισμούς παρακολούθησης και ανθεκτικότητας. Πρώτον, είναι σημαντικό να παρακολουθείτε στενά την υποδομή LLM, να περιορίσετε τον αντίκτυπο των αστοχιών και να βελτιστοποιήσετε τη χρήση των υπολογιστικών πόρων. Το SageMaker Training προτείνει διάφορες δυνατότητες για αυτόν τον σκοπό:

- Τα αρχεία καταγραφής αποστέλλονται αυτόματα στα αρχεία καταγραφής CloudWatch. Τα αρχεία καταγραφής περιλαμβάνουν το σενάριο εκπαίδευσης

stdoutκαιstderr. Στην κατανεμημένη εκπαίδευση που βασίζεται σε MPI, όλοι οι εργαζόμενοι στο MPI στέλνουν τα αρχεία καταγραφής τους στη διαδικασία του ηγέτη. - Οι μετρήσεις χρήσης πόρων συστήματος, όπως η μνήμη, η χρήση CPU και η χρήση GPU, αποστέλλονται αυτόματα στο CloudWatch.

- Μπορείς να ορίστε προσαρμοσμένες μετρήσεις εκπαίδευσης που θα σταλεί στο CloudWatch. Οι μετρήσεις καταγράφονται από αρχεία καταγραφής με βάση τις κανονικές εκφράσεις που έχετε ορίσει. Πακέτα πειραμάτων τρίτων όπως το Συνεργάτης AWS Η προσφορά Weights & Biases μπορεί να χρησιμοποιηθεί με το SageMaker Training (για παράδειγμα, βλ Βελτιστοποίηση υπερπαραμέτρων CIFAR-10 με W&B και SageMaker).

- SageMaker Profiler σας επιτρέπει να επιθεωρείτε τη χρήση της υποδομής και να λαμβάνετε συστάσεις βελτιστοποίησης.

- Amazon EventBridge και AWS Lambda σας επιτρέπουν να δημιουργήσετε αυτοματοποιημένη λογική πελάτη που αντιδρά σε γεγονότα όπως αποτυχίες εργασιών, επιτυχίες, μεταφορτώσεις αρχείων S3 και άλλα.

- SageMaker SSH Helper είναι μια βιβλιοθήκη ανοιχτού κώδικα που διατηρείται από την κοινότητα που σας επιτρέπει να συνδεθείτε με οικοδεσπότες εργασίας εκπαίδευσης μέσω SSH. Μπορεί να είναι χρήσιμο να επιθεωρήσετε και να αντιμετωπίσετε προβλήματα που εκτελούνται κώδικα σε συγκεκριμένους κόμβους.

Εκτός από την παρακολούθηση, το SageMaker φέρνει επίσης εξοπλισμό για ανθεκτικότητα στην εργασία:

- Έλεγχοι υγείας συστάδων – Πριν ξεκινήσει η εργασία σας, το SageMaker εκτελεί ελέγχους υγείας GPU και επαληθεύει την επικοινωνία NCCL σε παρουσίες GPU, αντικαθιστώντας τυχόν ελαττωματικά στιγμιότυπα εάν είναι απαραίτητο, προκειμένου να διασφαλίσει ότι το σενάριο εκπαίδευσής σας θα ξεκινήσει να εκτελείται σε ένα υγιές σύμπλεγμα παρουσιών. Οι έλεγχοι υγείας είναι επί του παρόντος ενεργοποιημένοι για τύπους παρουσιών που βασίζονται σε GPU P και G.

- Ενσωματωμένες επαναλήψεις και ενημέρωση συμπλέγματος – Μπορείτε να διαμορφώσετε αυτόματα το SageMaker δοκιμάζω πάλι εργασίες εκπαίδευσης που αποτυγχάνουν με σφάλμα εσωτερικού διακομιστή SageMaker (ISE). Στο πλαίσιο της επανάληψης μιας εργασίας, το SageMaker θα αντικαταστήσει τυχόν παρουσίες που αντιμετώπισαν μη ανακτήσιμα σφάλματα GPU με νέες παρουσίες, θα επανεκκινήσει όλες τις υγιείς παρουσίες και θα ξεκινήσει ξανά την εργασία. Αυτό έχει ως αποτέλεσμα ταχύτερες επανεκκινήσεις και ολοκλήρωση του φόρτου εργασίας. Η ενημέρωση συμπλέγματος είναι επί του παρόντος ενεργοποιημένη για τύπους παρουσιών που βασίζονται σε GPU P και G. Μπορείτε να προσθέσετε το δικό σας εφαρμοστικός μηχανισμός επανάληψης γύρω από τον κωδικό πελάτη που υποβάλλει την εργασία, για να χειριστείτε άλλους τύπους σφαλμάτων εκκίνησης, όπως υπέρβαση του ορίου του λογαριασμού σας.

- Αυτοματοποιημένη Σημείο ελέγχου στο Amazon S3 – Αυτό σας βοηθά οδοφράγματος την πρόοδό σας και φορτώστε ξανά μια προηγούμενη κατάσταση σε νέες θέσεις εργασίας.

Για να επωφεληθείτε από την αντικατάσταση σε επίπεδο κόμβου, ο κώδικάς σας πρέπει να έχει σφάλμα. Τα συλλογικά μπορεί να κολλάνε, αντί να κάνουν λάθος, όταν ένας κόμβος αποτυγχάνει. Επομένως, για να έχετε άμεση αποκατάσταση, ορίστε σωστά ένα χρονικό όριο για τις συλλογικότητες σας και ζητήστε από τον κωδικό να εκτελεί ένα σφάλμα όταν επιτευχθεί.

Ορισμένοι πελάτες ρυθμίζουν ένα πρόγραμμα-πελάτη παρακολούθησης για να παρακολουθεί και να ενεργεί σε περίπτωση διακοπής της εργασίας ή εφαρμοστικής διακοπής σύγκλισης, παρακολουθώντας τα αρχεία καταγραφής και τις μετρήσεις του CloudWatch για μη κανονικά μοτίβα, όπως μη εγγραφή αρχείων καταγραφής ή χρήση 0% GPU, για να υποδείξει ότι υπάρχει διακοπή, διακοπή σύγκλισης και αυτόματη σταματήστε/δοκιμάστε ξανά την εργασία.

Βαθιά βουτιά στο σημείο ελέγχου

Η Σημείο ελέγχου SageMaker η δυνατότητα αντιγράφει όλα όσα γράφετε /opt/ml/checkpoints πίσω στο Amazon S3 όπως το URI καθορίζεται στο checkpoint_s3_uri Παράμετρος SDK. Όταν μια εργασία ξεκινά ή επανεκκινείται, όλα όσα γράφονται σε αυτό το URI αποστέλλονται πίσω σε όλα τα μηχανήματα, στο /opt/ml/checkpoints. Αυτό είναι βολικό εάν θέλετε όλοι οι κόμβοι να έχουν πρόσβαση σε όλα τα σημεία ελέγχου, αλλά σε κλίμακα—όταν έχετε πολλά μηχανήματα ή πολλά ιστορικά σημεία ελέγχου, μπορεί να οδηγήσει σε μεγάλους χρόνους λήψης και πολύ υψηλή επισκεψιμότητα στο Amazon S3. Επιπλέον, στον παραλληλισμό τανυστών και αγωγών, οι εργαζόμενοι χρειάζονται μόνο ένα κλάσμα του μοντέλου με σημεία ελέγχου, όχι όλο. Εάν αντιμετωπίζετε αυτούς τους περιορισμούς, προτείνουμε τις ακόλουθες επιλογές:

- Σημείο ελέγχου στο FSx για Luster – Χάρη στην τυχαία I/O υψηλής απόδοσης, μπορείτε να ορίσετε το σύστημα κατανομής και απόδοσης αρχείων της επιλογής σας

- Αυτοδιαχειριζόμενο σημείο ελέγχου Amazon S3 – Για παραδείγματα συναρτήσεων Python που μπορούν να χρησιμοποιηθούν για την αποθήκευση και την ανάγνωση σημείων ελέγχου με μη αποκλειστικό τρόπο, ανατρέξτε στο Αποθήκευση σημείων ελέγχου

Συνιστούμε ανεπιφύλακτα να ελέγχετε το μοντέλο σας κάθε λίγες ώρες, για παράδειγμα 1–3 ώρες, ανάλογα με τα σχετικά γενικά έξοδα και το κόστος.

Front end και διαχείριση χρηστών

Η διαχείριση χρηστών είναι ένα βασικό πλεονέκτημα χρηστικότητας του SageMaker σε σύγκριση με την κοινή υποδομή HPC παλαιού τύπου. Οι άδειες SageMaker Training διέπονται από πολλούς Διαχείριση ταυτότητας και πρόσβασης AWS (IAM) αφαιρέσεις:

- Οι κύριοι - χρήστες και συστήματα - λαμβάνουν άδεια εκκίνησης πόρων

- Οι εργασίες εκπαίδευσης φέρουν ρόλους, οι οποίοι τους επιτρέπουν να έχουν δικά τους δικαιώματα, για παράδειγμα σχετικά με την πρόσβαση σε δεδομένα και την επίκληση υπηρεσίας

Επιπλέον, το 2022 προσθέσαμε SageMaker Role Manager για τη διευκόλυνση της δημιουργίας αδειών που βασίζονται σε άτομα.

Συμπέρασμα

Με το SageMaker Training, μπορείτε να μειώσετε το κόστος και να αυξήσετε την ταχύτητα επανάληψης στον φόρτο εργασίας προπόνησης μεγάλου μοντέλου. Έχουμε τεκμηριώσει ιστορίες επιτυχίας σε πολλές αναρτήσεις και μελέτες περιπτώσεων, όπως:

Αν θέλετε να βελτιώσετε το χρόνο για το LLM σας στην αγορά, μειώνοντας ταυτόχρονα το κόστος σας, ρίξτε μια ματιά στο SageMaker Training API και ενημερώστε μας τι δημιουργείτε!

Ιδιαίτερες ευχαριστίες στους Amr Ragab, Rashika Kheria, Zmnako Awrahman, Arun Nagarajan, Gal Oshri για τις χρήσιμες κριτικές και τις διδασκαλίες τους.

Σχετικά με τους Συγγραφείς

Αναστασία Τζεβελέκα είναι Αρχιτέκτονας Μηχανικής Μάθησης και Ειδικών Λύσεων AI στην AWS. Συνεργάζεται με πελάτες στην EMEA και τους βοηθά να αρχιτεκτονήσουν λύσεις μηχανικής εκμάθησης σε κλίμακα χρησιμοποιώντας υπηρεσίες AWS. Έχει εργαστεί σε έργα σε διαφορετικούς τομείς, συμπεριλαμβανομένων των εργαλείων επεξεργασίας φυσικής γλώσσας (NLP), MLOps και εργαλείων Low Code No Code.

Αναστασία Τζεβελέκα είναι Αρχιτέκτονας Μηχανικής Μάθησης και Ειδικών Λύσεων AI στην AWS. Συνεργάζεται με πελάτες στην EMEA και τους βοηθά να αρχιτεκτονήσουν λύσεις μηχανικής εκμάθησης σε κλίμακα χρησιμοποιώντας υπηρεσίες AWS. Έχει εργαστεί σε έργα σε διαφορετικούς τομείς, συμπεριλαμβανομένων των εργαλείων επεξεργασίας φυσικής γλώσσας (NLP), MLOps και εργαλείων Low Code No Code.

Gili Nachum είναι ανώτερος αρχιτέκτονας εξειδικευμένων λύσεων AI/ML που εργάζεται ως μέλος της ομάδας EMEA Amazon Machine Learning. Η Gili είναι παθιασμένη με τις προκλήσεις της εκπαίδευσης μοντέλων βαθιάς μάθησης και το πώς η μηχανική μάθηση αλλάζει τον κόσμο όπως τον ξέρουμε. Στον ελεύθερο χρόνο του, ο Τζίλι απολαμβάνει να παίζει πινγκ πονγκ.

Gili Nachum είναι ανώτερος αρχιτέκτονας εξειδικευμένων λύσεων AI/ML που εργάζεται ως μέλος της ομάδας EMEA Amazon Machine Learning. Η Gili είναι παθιασμένη με τις προκλήσεις της εκπαίδευσης μοντέλων βαθιάς μάθησης και το πώς η μηχανική μάθηση αλλάζει τον κόσμο όπως τον ξέρουμε. Στον ελεύθερο χρόνο του, ο Τζίλι απολαμβάνει να παίζει πινγκ πονγκ.

Ολιβιέ Κρουκάντ είναι Κύριος Αρχιτέκτονας Λύσεων Specialist Machine Learning στην AWS, με έδρα τη Γαλλία. Ο Olivier βοηθά τους πελάτες της AWS – από μικρές νεοφυείς επιχειρήσεις έως μεγάλες επιχειρήσεις – να αναπτύξουν και να αναπτύξουν εφαρμογές μηχανικής εκμάθησης ποιότητας παραγωγής. Στον ελεύθερο χρόνο του, του αρέσει να διαβάζει ερευνητικές εργασίες και να εξερευνά την έρημο με φίλους και οικογένεια.

Ολιβιέ Κρουκάντ είναι Κύριος Αρχιτέκτονας Λύσεων Specialist Machine Learning στην AWS, με έδρα τη Γαλλία. Ο Olivier βοηθά τους πελάτες της AWS – από μικρές νεοφυείς επιχειρήσεις έως μεγάλες επιχειρήσεις – να αναπτύξουν και να αναπτύξουν εφαρμογές μηχανικής εκμάθησης ποιότητας παραγωγής. Στον ελεύθερο χρόνο του, του αρέσει να διαβάζει ερευνητικές εργασίες και να εξερευνά την έρημο με φίλους και οικογένεια.

Μπρούνο Πίστον είναι AI/ML Specialist Solutions Architect για την AWS με έδρα το Μιλάνο. Συνεργάζεται με πελάτες οποιουδήποτε μεγέθους για να τους βοηθήσει να κατανοήσουν σε βάθος τις τεχνικές τους ανάγκες και να σχεδιάσουν λύσεις AI και Machine Learning που κάνουν την καλύτερη χρήση του AWS Cloud και της στοίβας Machine Learning Amazon. Το πεδίο εξειδίκευσής του είναι η μηχανική μάθηση από άκρο σε άκρο, η μηχανική μάθηση βιομηχανοποίηση και τα MLOps. Του αρέσει να περνά χρόνο με τους φίλους του και να εξερευνά νέα μέρη, καθώς και να ταξιδεύει σε νέους προορισμούς.

Μπρούνο Πίστον είναι AI/ML Specialist Solutions Architect για την AWS με έδρα το Μιλάνο. Συνεργάζεται με πελάτες οποιουδήποτε μεγέθους για να τους βοηθήσει να κατανοήσουν σε βάθος τις τεχνικές τους ανάγκες και να σχεδιάσουν λύσεις AI και Machine Learning που κάνουν την καλύτερη χρήση του AWS Cloud και της στοίβας Machine Learning Amazon. Το πεδίο εξειδίκευσής του είναι η μηχανική μάθηση από άκρο σε άκρο, η μηχανική μάθηση βιομηχανοποίηση και τα MLOps. Του αρέσει να περνά χρόνο με τους φίλους του και να εξερευνά νέα μέρη, καθώς και να ταξιδεύει σε νέους προορισμούς.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- Platoblockchain. Web3 Metaverse Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- πηγή: https://aws.amazon.com/blogs/machine-learning/training-large-language-models-on-amazon-sagemaker-best-practices/

- :είναι

- ][Π

- $UP

- 000

- 1

- 100

- 2022

- 7

- 8

- a

- ικανότητες

- Ικανός

- Σχετικα

- πάνω από

- επιταχύνουν

- επιτάχυνση

- πρόσβαση

- φιλοξενώ

- Λογαριασμός

- Κατορθώνω

- την επίτευξη

- απέναντι

- Πράξη

- Δραστηριοποίηση

- ενεργός

- προσαρμόσει

- προστιθέμενη

- Επιπλέον

- Επιπλέον

- προσθήκες

- Πλεονέκτημα

- AI

- AI / ML

- AL

- αλγόριθμος

- αλγόριθμοι

- Όλα

- Επιτρέποντας

- επιτρέπει

- Amazon

- Amazon EC2

- Amazon FSx

- Εκμάθηση μηχανών του Αμαζονίου

- Amazon Sage Maker

- ποσό

- και

- api

- APIs

- εφαρμόσιμος

- Εφαρμογή

- εφαρμογές

- εφαρμοσμένος

- κατάλληλος

- ΕΙΝΑΙ

- ΠΕΡΙΟΧΗ

- γύρω

- AS

- συσχετισμένη

- At

- γνωρίσματα

- αυτόματη

- Αυτοματοποιημένη

- αυτομάτως

- διαθέσιμος

- αποφεύγοντας

- AWS

- πίσω

- Backend

- Υπόλοιπο

- βασίζονται

- BE

- επειδή

- γίνεται

- πριν

- είναι

- όφελος

- ΚΑΛΎΤΕΡΟΣ

- βέλτιστες πρακτικές

- Πέρα

- Μεγάλος

- Δισεκατομμύριο

- δισεκατομμύρια

- Αποκλεισμός

- φέρω

- Φέρνει

- χτίζω

- χτισμένο

- επιχείρηση

- by

- κλήση

- που ονομάζεται

- κλήσεις

- CAN

- ικανός

- Χωρητικότητα

- κάρτα

- Κάρτες

- κουβαλάω

- περίπτωση

- Μελέτες Περιπτώσεων

- καταλύει

- προκλήσεις

- αλλαγή

- Κανάλι

- έλεγχος

- έλεγχοι

- επιλογή

- επιλογές

- Επιλέξτε

- τάξεις

- πελάτης

- στενά

- Backup

- συστάδα

- κωδικός

- Συλλογική

- σε συνδυασμό

- Ελάτε

- Κοινός

- συνήθως

- Επικοινωνία

- Διαβιβάσεις

- σύγκριση

- σύμφωνος

- ολοκλήρωση

- υπολογισμός

- Υπολογίστε

- υπολογιστή

- Computer Vision

- χρήση υπολογιστή

- καταλήγω

- διενεργούνται

- διαμόρφωση

- Επιβεβαιώνω

- Connect

- συνεπώς

- περιέχουν

- Δοχείο

- Εμπορευματοκιβώτια

- Περιέχει

- περιεχόμενο

- συνέβαλε

- έλεγχος

- ελέγχεται

- Βολικός

- Σύγκλιση

- Διαφθορά

- Κόστος

- Δικαστικά έξοδα

- θα μπορούσε να

- Πορεία

- κάλυμμα

- Καλύμματα

- δημιουργία

- δημιουργία

- Δημιουργικός

- κρίσιμης

- κρίσιμος

- επιμέλεια

- Τη στιγμή

- έθιμο

- Πελάτες

- προσαρμόσετε

- ημερομηνία

- πρόσβαση δεδομένων

- Προετοιμασία δεδομένων

- σύνολα δεδομένων

- αποφασίζει

- αφιερωμένο

- βαθύς

- βαθιά μάθηση

- Προεπιλογή

- Πτυχίο

- Σε συνάρτηση

- εξαρτάται

- παρατάσσω

- Υπηρεσίες

- σχεδιασμένα

- επιθυμητή

- προορισμοί

- Προσδιορίστε

- καθορίζοντας

- ανάπτυξη

- αναπτύχθηκε

- Εργολάβος

- προγραμματιστές

- Ανάπτυξη

- αναπτύσσεται

- συσκευή

- Συσκευές

- διαφορετικές

- Διάχυση

- κατευθείαν

- συζητήσουν

- συζήτηση

- διανέμονται

- κατανεμημένων υπολογιστών

- κατανεμημένη εκπαίδευση

- διανομή

- Λιμενεργάτης

- Όχι

- domains

- Μην

- κάτω

- κατεβάσετε

- δεκάδες

- κατά την διάρκεια

- κάθε

- εύκολα

- Αποτελεσματικός

- είτε

- ΕΜΕΑ

- ενεργοποιήσετε

- ενεργοποιημένη

- δίνει τη δυνατότητα

- ενεργοποίηση

- ενθαρρύνει

- τελειώνει

- ενισχυμένη

- απολαύσετε

- αρκετά

- εξασφαλίζω

- Εταιρεία

- επιχειρήσεις

- καταχώριση

- Περιβάλλον

- περιβάλλοντα

- εξοπλισμός

- εξοπλισμένο

- σφάλμα

- λάθη

- εγκαθιδρύω

- Even

- εκδηλώσεις

- ενδεχόμενος

- Κάθε

- πάντα

- εξελίχθηκε

- παράδειγμα

- παραδείγματα

- Excel

- υφιστάμενα

- αναμένω

- αναμένεται

- εμπειρία

- πείραμα

- Εξερευνώντας

- εκτεθειμένος

- εκφράσεις

- επέκταση

- επεκτάσεις

- εξωτερικός

- εξαιρετικά

- ύφασμα

- Πρόσωπο

- διευκολύνω

- διευκολύνοντας

- παράγοντες

- Απέτυχε

- αποτυγχάνει

- Αποτυχία

- οικογένειες

- οικογένεια

- Μόδα

- FAST

- γρηγορότερα

- ελαττωματικός

- εφικτός

- Χαρακτηριστικό

- Χαρακτηριστικά

- λίγοι

- πεδίο

- Αρχεία

- Αρχεία

- Όνομα

- ταιριάζουν

- ΣΤΟΛΟΣ

- Ευελιξία

- Συγκέντρωση

- εστιάζει

- ακολουθείται

- Εξής

- Για

- κλάσμα

- Πλαίσιο

- πλαισίων

- Γαλλία

- Ελευθερία

- συχνάζω

- φρέσκο

- φίλους

- από

- πλήρη

- πλήρως

- λειτουργικός

- λειτουργικότητα

- λειτουργίες

- περαιτέρω

- GAL

- παράγεται

- γενετική

- παίρνω

- να πάρει

- GitHub

- δεδομένου

- GPU

- GPU

- γραφική παράσταση

- εξαιρετική

- μεγαλύτερη

- Group

- μεγαλώνει

- λαβή

- Χειρισμός

- Κρεμώ

- συμβαίνω

- υλικού

- Έχω

- που έχει

- Υγεία

- διαιτιτικο

- χρήσιμο

- βοήθεια

- βοηθά

- Ψηλά

- Υψηλή συχνότητα

- υψηλή απόδοση

- ιστορικών

- κουκούλα

- οικοδεσπότες

- ΩΡΕΣ

- Πως

- Πώς να

- Ωστόσο

- hpc

- HTML

- http

- HTTPS

- Εκατοντάδες

- εκατοντάδες εκατομμύρια

- i

- identiques

- Ταυτότητα

- εικόνα

- εικόνες

- αμέσως

- Επίπτωση

- εφαρμογή

- εφαρμοστεί

- εκτελεστικών

- σημαντικό

- βελτίωση

- βελτιωθεί

- βελτιώσεις

- in

- Σε άλλες

- περιλαμβάνουν

- Συμπεριλαμβανομένου

- Αυξάνουν

- αυξημένη

- Αυξήσεις

- όλο και περισσότερο

- ατομικές

- βιομηχανία

- πληροφορίες

- πληροφορίες

- Υποδομή

- Καινοτομία

- εμπνευσμένος

- εγκαθιστώ

- παράδειγμα

- αντί

- ενσωματωθεί

- ολοκλήρωση

- Έξυπνος

- αλληλεπίδραση

- περιβάλλον λειτουργίας

- μεσολαβητής

- εσωτερικός

- εισαγάγει

- εισήγαγε

- IT

- επανάληψη

- ΤΟΥ

- εαυτό

- Δουλειά

- Θέσεις εργασίας

- jpg

- Διατήρηση

- Κλειδί

- Είδος

- Ξέρω

- Γλώσσα

- Γλώσσες

- large

- μεγάλης κλίμακας

- μεγαλύτερος

- αργότερο

- ξεκινήσει

- ξεκίνησε

- ξεκινάει

- στρώμα

- στρώματα

- οδηγήσει

- ηγέτης

- μάθηση

- Κληροδότημα

- Επίπεδο

- βιβλιοθήκες

- Βιβλιοθήκη

- κύκλος ζωής

- Μου αρέσει

- Πιθανός

- LIMIT

- περιορισμούς

- Περιωρισμένος

- λίγο

- LLM

- φόρτωση

- τοπικός

- Μακριά

- πολύς καιρός

- ματιά

- κοιτάζοντας

- Χαμηλός

- μηχανή

- μάθηση μηχανής

- μηχανήματα

- διατηρήσουν

- Η διατήρηση

- διατηρεί

- κάνω

- ΚΑΝΕΙ

- Κατασκευή

- διαχείριση

- διαχειρίζεται

- διαχείριση

- πολοί

- χάρτες

- ανώτατο όριο

- Μνήμη

- Μεταδεδομένα

- μέθοδοι

- Metrics

- μετανάστευση

- MILAN

- εκατομμύρια

- ML

- MLOps

- Τρόπος

- μοντέλο

- μοντέλα

- τροποποιημένο

- Παρακολούθηση

- παρακολούθηση

- περισσότερο

- πλέον

- μετακινήσετε

- πολλαπλούς

- και συγκεκριμένα

- ντόπιος

- Φυσικό

- Επεξεργασία φυσικής γλώσσας

- Φύση

- αναγκαίως

- απαραίτητος

- Ανάγκη

- ανάγκες

- δίκτυο

- με βάση το δίκτυο

- δίκτυα

- νευρικό σύστημα

- Νέα

- nlp

- κόμβος

- κόμβων

- αριθμός

- πολυάριθμες

- Nvidia

- αντικειμένων

- of

- προσφορά

- προσφορά

- Olivier

- on

- Κατα παραγγελια

- ONE

- ανοίξτε

- ανοικτού κώδικα

- κώδικα ανοιχτού κώδικα

- άνοιξε

- Ευκαιρίες

- βελτιστοποίηση

- Βελτιστοποίηση

- βελτιστοποιημένη

- Επιλογή

- Επιλογές

- ενορχήστρωση

- τάξη

- ΑΛΛΑ

- δική

- πακέτο

- Packages

- Χαρτί

- χαρτιά

- παράδειγμα

- Παράλληλο

- παράμετρος

- παράμετροι

- μέρος

- Ειδικότερα

- ιδιαίτερα

- παθιασμένος

- Το παρελθόν

- μονοπάτι

- πρότυπα

- Πληρωμή

- Κορυφή

- επίδοση

- παραστάσεις

- άδεια

- δικαιώματα

- Φυσικώς

- αγωγού

- Μέρη

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- παιχνίδι

- Σημείο

- πισίνα

- Πισίνες

- Δημοφιλής

- Θέση

- Δημοσιεύσεις

- πρακτική

- πρακτικές

- προβλέποντας

- προτιμήσεις

- προτιμάται

- παρόν

- δώρα

- πρόληψη

- προηγουμένως

- Κύριος

- διαδικασια μας

- Διεργασίες

- μεταποίηση

- παράγει

- Πρόγραμμα

- Προγραμματισμός

- γλώσσες προγραμματισμού

- Πρόοδος

- έργα

- δεόντως

- προτείνω

- προτείνει

- ιδιόκτητο

- πρωτόκολλο

- πρωτόκολλα

- παρέχουν

- παρέχεται

- προμηθευτής

- χορήγηση

- δημόσιο

- δημοσιεύσεις

- σκοπός

- βάζω

- Python

- pytorch

- ποιότητα

- αύξηση

- τυχαίος

- ΣΠΑΝΙΟΣ

- Τιμή

- Τιμές

- φθάσει

- Διάβασε

- Ανάγνωση

- συνειδητοποιήσουν

- λογικός

- λόγους

- λαμβάνω

- πρόσφατος

- συνιστώ

- συστάσεις

- ρεκόρ

- αρχεία

- ανάκτηση

- μείωση

- μειώνει

- μείωση

- σχετικά με

- περιοχή

- περιοχές

- τακτικός

- τακτικά

- σχετίζεται με

- αξιόπιστος

- μακρινός

- αντικαθιστώ

- εκπροσωπούν

- ζητήσει

- αιτήματα

- απαιτούν

- απαίτηση

- Απαιτεί

- έρευνα

- την έρευνα και την καινοτομία

- πόρος

- Υποστηρικτικό υλικό

- Αποτελέσματα

- Κριτικές

- Ρόλος

- ρόλους

- τρέξιμο

- τρέξιμο

- σοφός

- ίδιο

- Αποθήκευση

- Απεριόριστες δυνατότητες

- επεκτάσιμη

- Κλίμακα

- Ζυγός

- απολέπιση

- σχέδιο

- επιστημονικός

- επιστήμονες

- έκταση

- Εφαρμογές

- SDK

- Αναζήτηση

- Δεύτερος

- δευτερόλεπτα

- Τμήμα

- αναζήτηση

- επιλέγονται

- επιλογή

- αρχαιότερος

- Χωρίς διακομιστή

- Διακομιστές

- υπηρεσία

- Υπηρεσίες

- σειρά

- ρυθμίσεις

- διάφοροι

- θραύσμα

- κοπής

- Shared

- θα πρέπει να

- σημαντικά

- Απλούς

- απλότητα

- ταυτοχρόνως

- ενιαίας

- Μέγεθος

- μεγέθη

- δεξιότητες

- επιβραδύνουν

- small

- So

- λογισμικό

- Λύσεις

- μερικοί

- Πηγή

- Πηγές

- ειδικός

- συγκεκριμένες

- ειδικά

- καθορίζεται

- ταχύτητα

- Δαπάνες

- Διαχωρίστε

- Spot

- σταθερός

- σωρός

- Εκκίνηση

- Ξεκινήστε

- ξεκινά

- Startups

- Κατάσταση

- στατιστικός

- Βήματα

- στάση

- στάθμευση

- χώρος στο δίσκο

- κατάστημα

- ιστορίες

- Στρατηγική

- μετάδοση

- ροές

- δύναμη

- απογύμνωση

- δυνατά

- μελέτες

- επιτυχία

- Ιστορίες επιτυχίας

- επιτυχής

- τέτοιος

- υποστήριξη

- υποστηριζόνται!

- Υποστηρίζει

- συγχρονισμός

- σύνταξη

- σύστημα

- τραπέζι

- Πάρτε

- Έργο

- εργασίες

- Τεχνικός

- tensorflow

- Ευχαριστώ

- ότι

- Η

- ο κόσμος

- τους

- Τους

- τους

- θεωρητικός

- επομένως

- Αυτοί

- τρίτους

- χιλιάδες

- τρία

- Μέσω

- διακίνηση

- ώρα

- φορές

- συμβουλές

- προς την

- σήμερα

- κουπόνια

- πολύ

- εργαλείο

- εργαλεία

- κορυφή

- Σύνολο

- τροχιά

- ΚΙΝΗΣΗ στους ΔΡΟΜΟΥΣ

- Τρένο

- εκπαιδευμένο

- Εκπαίδευση

- Μετάφραση

- μεταφορά

- Τρισεκατομμύριο

- τύποι

- τυπικός

- υπό

- υποκείμενες

- καταλαβαίνω

- μοναδικός

- μονάδες

- Ενημέρωση

- us

- χρηστικότητα

- Χρήση

- χρήση

- Χρήστες

- συνήθως

- αξία

- Αξίες

- ποικιλία

- διάφορα

- επαληθεύει

- εκδοχή

- μέσω

- Βίντεο

- Δες

- όραμα

- ζεστός

- Τρόπος..

- τρόπους

- Εβδ.

- ΛΟΙΠΌΝ

- Τι

- Ποιό

- ενώ

- Ο ΟΠΟΊΟΣ

- ολόκληρο

- θα

- με

- εντός

- χωρίς

- λόγια

- Εργασία

- εργάστηκαν

- εργαζομένων

- εργαζόμενος

- λειτουργεί

- κόσμος

- γράφω

- γραπτή

- χρόνια

- Εσείς

- Σας

- τον εαυτό σας

- YouTube

- zephyrnet