Los grandes modelos de lenguaje (LLM), con su amplio conocimiento, pueden generar texto similar al humano sobre casi cualquier tema. Sin embargo, su formación en conjuntos de datos masivos también limita su utilidad para tareas especializadas. Sin un aprendizaje continuo, estos modelos permanecen ajenos a los nuevos datos y tendencias que surgen después de su formación inicial. Además, el costo de formar nuevos LLM puede resultar prohibitivo para muchos entornos empresariales. Sin embargo, es posible hacer una referencia cruzada de una respuesta modelo con el contenido especializado original, evitando así la necesidad de entrenar un nuevo modelo LLM, utilizando Recuperación-Generación Aumentada (RAG).

RAG empodera a los LLM brindándoles la capacidad de recuperar e incorporar conocimientos externos. En lugar de depender únicamente de sus conocimientos previos, RAG permite que los modelos extraigan datos de documentos, bases de datos y más. Luego, el modelo integra hábilmente esta información externa en el texto generado. Al obtener datos relevantes para el contexto, el modelo puede proporcionar respuestas informadas y actualizadas adaptadas a su caso de uso. El aumento del conocimiento también reduce la probabilidad de sufrir alucinaciones y textos inexactos o sin sentido. Con RAG, los modelos básicos se convierten en expertos adaptables que evolucionan a medida que crece su base de conocimientos.

Hoy, nos complace presentar tres demostraciones de IA generativa, con licencia de licencia MIT-0:

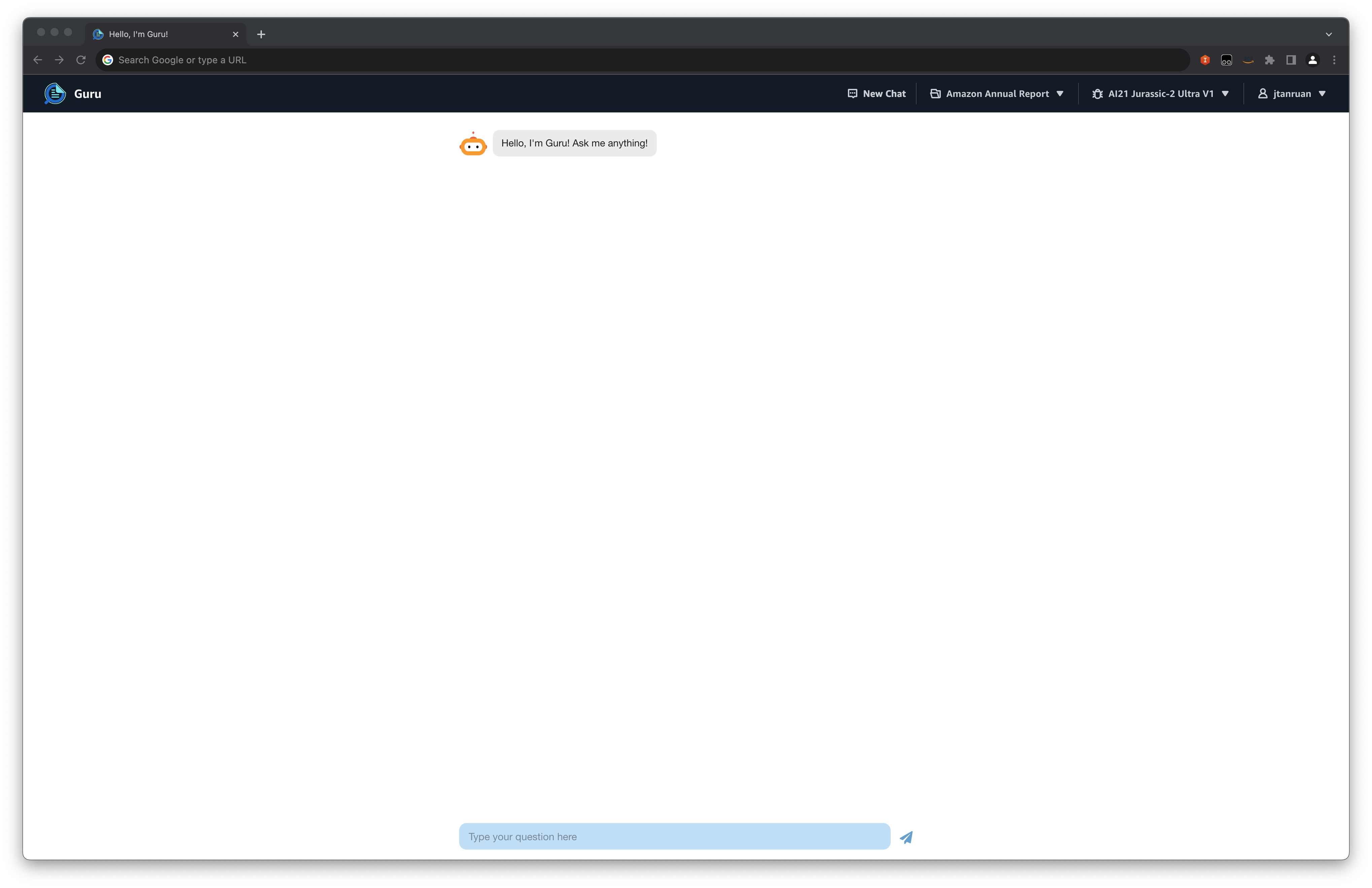

- Amazon Kendra con LLM fundamental – Utiliza las capacidades de búsqueda profunda de amazona kendra combinado con el amplio conocimiento de los LLM. Esta integración proporciona respuestas precisas y contextuales a consultas complejas a partir de una amplia gama de fuentes.

- Modelo de incrustaciones con LLM fundacional. – Combina el poder de las incrustaciones (una técnica para capturar significados semánticos de palabras y frases) con la amplia base de conocimientos de los LLM. Esta sinergia permite un modelado de temas, una recomendación de contenido y capacidades de búsqueda semántica más precisos.

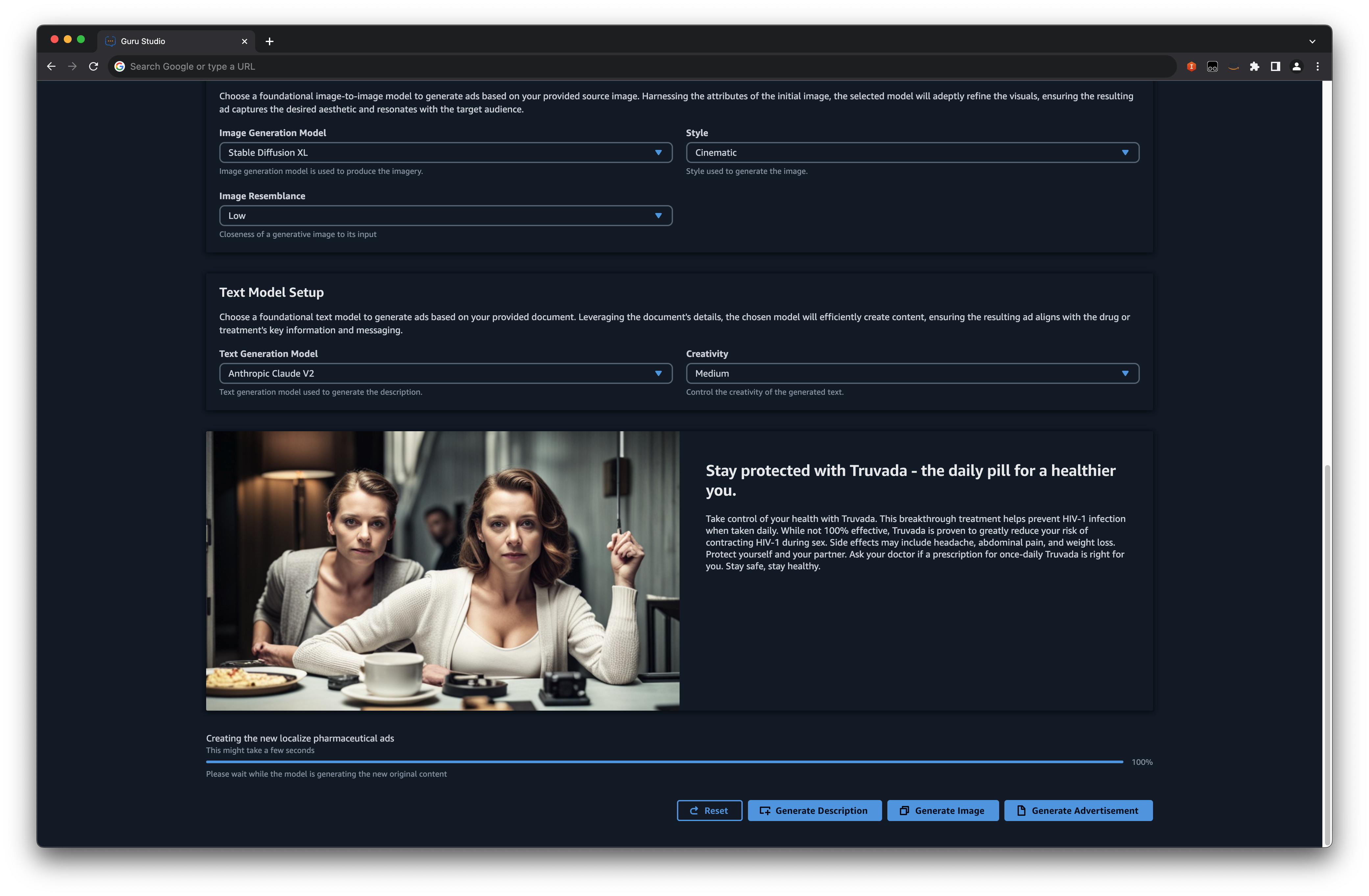

- Generador de anuncios farmacéuticos de Foundation Models - Una aplicación especializada adaptada a la industria farmacéutica. Aprovechando las capacidades generativas de los modelos fundamentales, esta herramienta crea anuncios farmacéuticos convincentes y conformes, garantizando que el contenido cumpla con los estándares y regulaciones de la industria.

Estas demostraciones se pueden implementar sin problemas en su cuenta de AWS y ofrecen información fundamental y orientación sobre el uso de los servicios de AWS para crear un bot de preguntas y respuestas de IA generativa de LLM y generación de contenido de última generación.

En esta publicación, exploramos cómo RAG combinado con Amazon Kendra o incorporaciones personalizadas pueden superar estos desafíos y brindar respuestas refinadas a consultas en lenguaje natural.

Resumen de la solución

Al adoptar esta solución, puede obtener los siguientes beneficios:

- Acceso mejorado a la información – RAG permite que los modelos obtengan información de amplias fuentes externas, lo que puede resultar especialmente útil cuando el conocimiento del modelo previamente entrenado está desactualizado o incompleto.

- Escalabilidad – En lugar de entrenar un modelo con todos los datos disponibles, RAG permite que los modelos recuperen información relevante sobre la marcha. Esto significa que a medida que haya nuevos datos disponibles, se pueden agregar a la base de datos de recuperación sin necesidad de volver a entrenar todo el modelo.

- Eficiencia de la memoria – Los LLM requieren una cantidad significativa de memoria para almacenar parámetros. Con RAG, el modelo puede ser más pequeño porque no necesita memorizar todos los detalles; puede recuperarlos cuando sea necesario.

- Actualización dinámica de conocimientos. – A diferencia de los modelos convencionales con un punto final de conocimiento establecido, la base de datos externa de RAG puede someterse a actualizaciones periódicas, lo que otorga al modelo acceso a información actualizada. La función de recuperación se puede ajustar para distintas tareas. Por ejemplo, una tarea de diagnóstico médico puede obtener datos de revistas médicas, lo que garantiza que el modelo obtenga conocimientos expertos y pertinentes.

- Mitigación de sesgos – La capacidad de aprovechar una base de datos bien seleccionada ofrece el potencial de minimizar los sesgos al garantizar fuentes externas equilibradas e imparciales.

Antes de sumergirse en la integración de Amazon Kendra con los LLM fundamentales, es fundamental equiparse con las herramientas y los requisitos del sistema necesarios. Tener la configuración correcta es el primer paso hacia una implementación perfecta de las demostraciones.

Requisitos previos

Debes tener los siguientes requisitos previos:

Aunque es posible configurar e implementar la infraestructura detallada en este tutorial desde su computadora local, Nube de AWS9 ofrece una alternativa conveniente. AWS Cloud9, preequipado con herramientas como AWS CLI, AWS CDK y Docker, puede funcionar como su estación de trabajo de implementación. Para utilizar este servicio, simplemente configurar el medio ambiente mediante el Consola de AWS Cloud9.

Una vez resueltos los requisitos previos, profundicemos en las características y capacidades de Amazon Kendra con LLM fundamentales.

Amazon Kendra con LLM fundamental

Amazon Kendra es un servicio de búsqueda empresarial avanzado mejorado mediante aprendizaje automático (ML) que proporciona capacidades de búsqueda semántica listas para usar. Al utilizar el procesamiento del lenguaje natural (NLP), Amazon Kendra comprende tanto el contenido de los documentos como la intención subyacente de las consultas de los usuarios, posicionándolo como una herramienta de recuperación de contenido para soluciones basadas en RAG. Al utilizar el contenido de búsqueda de alta precisión de Kendra como carga útil de RAG, puede obtener mejores respuestas de LLM. El uso de Amazon Kendra en esta solución también permite la búsqueda personalizada al filtrar las respuestas según los permisos de acceso al contenido del usuario final.

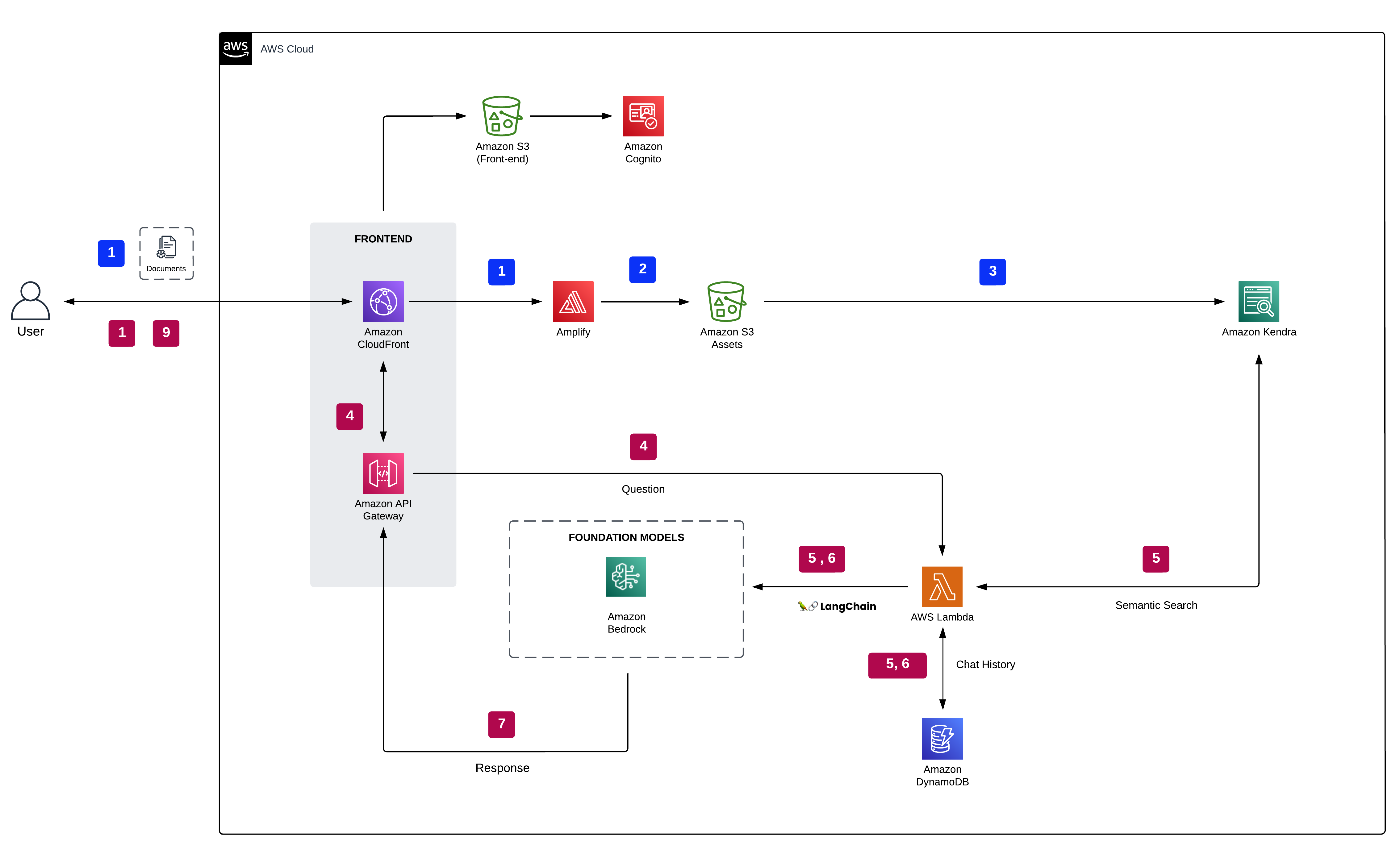

El siguiente diagrama muestra la arquitectura de una aplicación de IA generativa que utiliza el enfoque RAG.

Amazon Kendra procesa e indexa los documentos a través del Servicio de almacenamiento simple de Amazon (Amazon S3) conector. Las solicitudes de los clientes y los datos contextuales de Amazon Kendra se dirigen a un lecho rocoso del amazonas modelo de cimentación. La demostración le permite elegir entre los modelos Titan de Amazon, Jurassic de AI21 y Claude de Anthropic compatibles con Amazon Bedrock. El historial de conversaciones se guarda en Amazon DynamoDB, ofreciendo contexto adicional para que el LLM genere respuestas.

Hemos proporcionado esta demostración en el Repositorio GitHub. Consulte las instrucciones de implementación en el archivo Léame para implementarlo en su cuenta de AWS.

Los siguientes pasos describen el proceso cuando un usuario interactúa con la aplicación de IA generativa:

- El usuario inicia sesión en la aplicación web autenticada por Cognito Amazonas.

- El usuario carga uno o más documentos en Amazon S3.

- El usuario ejecuta un trabajo de sincronización de Amazon Kendra para incorporar documentos de S3 al índice de Amazon Kendra.

- La pregunta del usuario se dirige a través de una API WebSocket segura alojada en Puerta de enlace API de Amazon respaldado por un AWS Lambda función.

- La función Lambda, potenciada por el LangChain framework, una herramienta versátil diseñada para crear aplicaciones impulsadas por modelos de lenguaje de IA, se conecta al punto final de Amazon Bedrock para reformular la pregunta del usuario según el historial de chat. Después de reformularla, la pregunta se envía a Amazon Kendra mediante la API de recuperación. En respuesta, el índice de Amazon Kendra muestra resultados de búsqueda y proporciona extractos de documentos pertinentes obtenidos de los datos ingeridos por la empresa.

- La pregunta del usuario junto con los datos recuperados del índice se envían como contexto en el mensaje de LLM. La respuesta del LLM se almacena como historial de chat dentro de DynamoDB.

- Finalmente, la respuesta del LLM se envía al usuario.

Flujo de trabajo de indexación de documentos

El siguiente es el procedimiento para el procesamiento e indexación de documentos:

- Los usuarios envían documentos a través de la interfaz de usuario (UI).

- Los documentos se transfieren a un depósito S3 utilizando el AWS amplificar API.

- Amazon Kendra indexa documentos nuevos en el depósito S3 a través del conector Amazon Kendra S3.

Beneficios

La siguiente lista destaca las ventajas de esta solución:

- Recuperación a nivel empresarial – Amazon Kendra está diseñado para la búsqueda empresarial, lo que lo hace adecuado para organizaciones con grandes cantidades de datos estructurados y no estructurados.

- Comprensión semántica – Las capacidades de aprendizaje automático de Amazon Kendra garantizan que la recuperación se base en una comprensión semántica profunda y no solo en coincidencias de palabras clave.

- Escalabilidad – Amazon Kendra puede manejar fuentes de datos a gran escala y proporciona resultados de búsqueda rápidos y relevantes.

- Flexibilidad – El modelo fundamental puede generar respuestas basadas en una amplia gama de contextos, lo que garantiza que el sistema siga siendo versátil.

- Capacidades de integración – Amazon Kendra se puede integrar con varios servicios y fuentes de datos de AWS, lo que lo hace adaptable a diferentes necesidades organizacionales.

Modelo de incrustaciones con LLM fundacional.

An incrustación es un vector numérico que representa la esencia central de diversos tipos de datos, incluidos texto, imágenes, audio y documentos. Esta representación no sólo captura el significado intrínseco de los datos, sino que también los adapta a una amplia gama de aplicaciones prácticas. Los modelos integrados, una rama del ML, transforman datos complejos, como palabras o frases, en espacios vectoriales continuos. Estos vectores captan inherentemente las conexiones semánticas entre los datos, lo que permite comparaciones más profundas y reveladoras.

RAG combina a la perfección las fortalezas de los modelos fundamentales, como los transformadores, con la precisión de las incorporaciones para examinar vastas bases de datos en busca de información pertinente. Al recibir una consulta, el sistema utiliza incrustaciones para identificar y extraer secciones relevantes de un extenso conjunto de datos. Luego, el modelo fundamental formula una respuesta contextualmente precisa basada en esta información extraída. Esta sinergia perfecta entre la recuperación de datos y la generación de respuestas permite que el sistema proporcione respuestas exhaustivas, aprovechando el vasto conocimiento almacenado en amplias bases de datos.

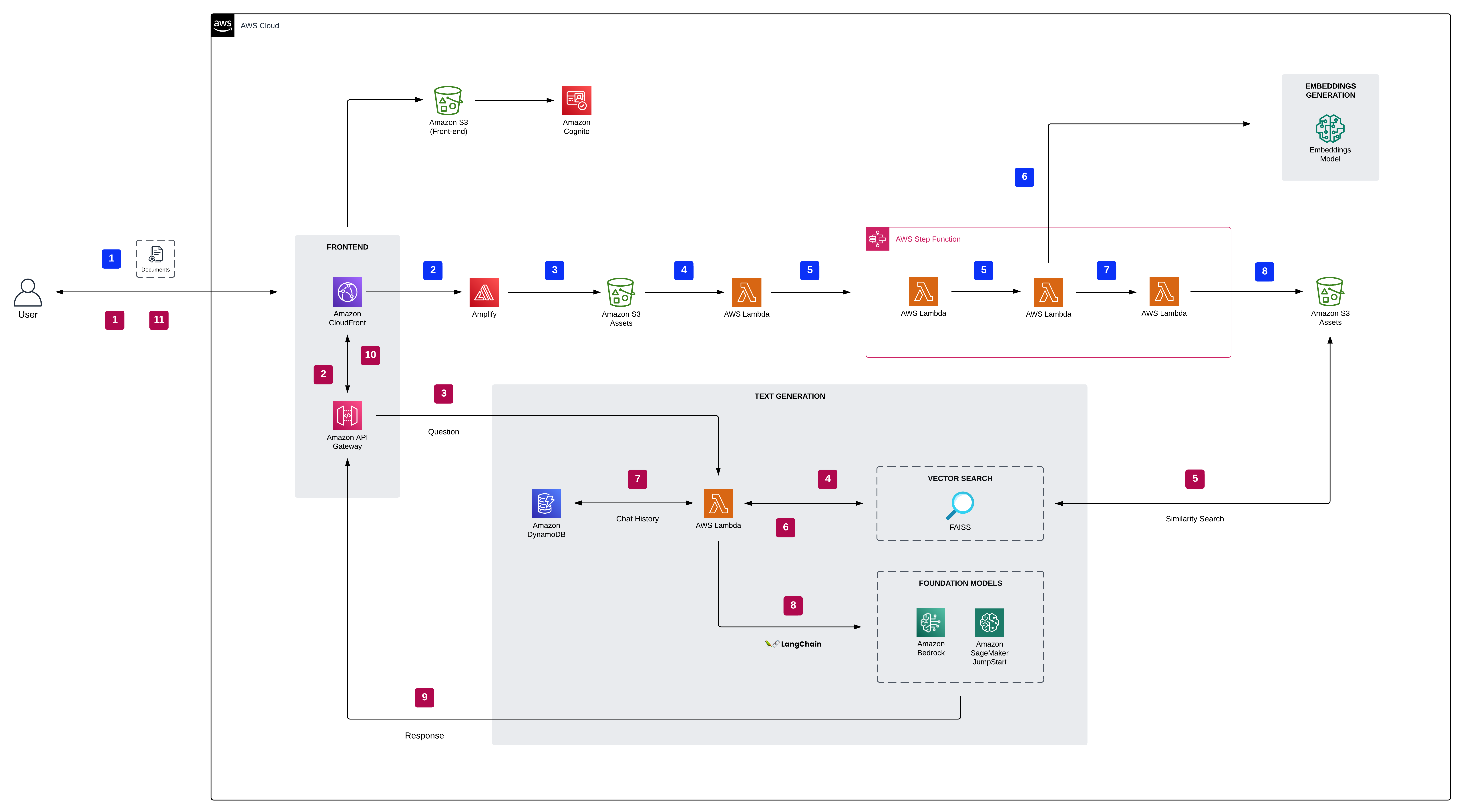

En el diseño arquitectónico, según su selección de interfaz de usuario, los usuarios son guiados a Amazon Bedrock o JumpStart de Amazon SageMaker modelos de fundaciones. Los documentos se procesan y el modelo de incrustaciones produce incrustaciones de vectores. Estas incrustaciones luego se indexan usando FAISS para permitir una búsqueda semántica eficiente. Los historiales de conversaciones se conservan en DynamoDB, lo que enriquece el contexto para que el LLM elabore respuestas.

El siguiente diagrama ilustra la arquitectura y el flujo de trabajo de la solución.

Hemos proporcionado esta demostración en el Repositorio GitHub. Consulte las instrucciones de implementación en el archivo Léame para implementarlo en su cuenta de AWS.

Modelo de incrustaciones

Las responsabilidades del modelo de incrustaciones son las siguientes:

- Este modelo es responsable de convertir texto (como documentos o pasajes) en representaciones vectoriales densas, comúnmente conocidas como incrustaciones.

- Estas incorporaciones capturan el significado semántico del texto, lo que permite comparaciones eficientes y semánticamente significativas entre diferentes fragmentos de texto.

- El modelo de incorporación se puede entrenar en el mismo corpus vasto que el modelo fundamental o se puede especializar en dominios específicos.

Flujo de trabajo de preguntas y respuestas

Los siguientes pasos describen el flujo de trabajo de la respuesta a preguntas sobre documentos:

- El usuario inicia sesión en la aplicación web autenticada por Amazon Cognito.

- El usuario carga uno o más documentos en Amazon S3.

- Tras la transferencia del documento, una notificación de evento de S3 activa una función Lambda, que luego llama al punto final del modelo de incrustación de SageMaker para generar incrustaciones para el nuevo documento. El modelo de incrustación convierte la pregunta en una representación vectorial densa (incrustación). El archivo vectorial resultante se almacena de forma segura en el depósito de S3.

- El recuperador FAISS compara esta incrustación de preguntas con las incrustaciones de todos los documentos o pasajes en la base de datos para encontrar los pasajes más relevantes.

- Los pasajes, junto con la pregunta del usuario, se proporcionan como contexto del modelo fundamental. La función Lambda utiliza la biblioteca LangChain y se conecta al punto final de Amazon Bedrock o SageMaker JumpStart con una consulta llena de contexto.

- La respuesta del LLM se almacena en DynamoDB junto con la consulta del usuario, la marca de tiempo, un identificador único y otros identificadores arbitrarios para el elemento, como la categoría de pregunta. Almacenar la pregunta y la respuesta como elementos discretos permite que la función Lambda recree fácilmente el historial de conversaciones de un usuario en función del momento en que se formularon las preguntas.

- Finalmente, la respuesta se envía de vuelta al usuario a través de una solicitud HTTP a través de la respuesta de integración de API WebSocket de API Gateway.

Beneficios

La siguiente lista describe los beneficios de esta solución:

- Comprensión semántica – El modelo de incrustaciones garantiza que el recuperador seleccione pasajes basándose en una comprensión semántica profunda, no solo en coincidencias de palabras clave.

- Escalabilidad – Las incrustaciones permiten comparaciones de similitudes eficientes, lo que hace posible buscar rápidamente en vastas bases de datos de documentos.

- Flexibilidad – El modelo fundamental puede generar respuestas basadas en una amplia gama de contextos, lo que garantiza que el sistema siga siendo versátil.

- Adaptabilidad del dominio – El modelo de incorporación se puede entrenar o ajustar para dominios específicos, lo que permite adaptar el sistema a diversas aplicaciones.

Generador de anuncios farmacéuticos de Foundation Models

En la acelerada industria farmacéutica actual, la publicidad eficiente y localizada es más crucial que nunca. Aquí es donde entra en juego una solución innovadora que utiliza el poder de la IA generativa para crear anuncios farmacéuticos localizados a partir de imágenes originales y archivos PDF. Más allá de simplemente acelerar el proceso de generación de anuncios, este enfoque agiliza el proceso de Revisión Médica Legal (MLR). MLR es un mecanismo de revisión riguroso en el que los equipos médicos, legales y regulatorios evalúan meticulosamente los materiales promocionales para garantizar su precisión, respaldo científico y cumplimiento normativo. Los métodos tradicionales de creación de contenido pueden ser engorrosos y a menudo requieren ajustes manuales y revisiones exhaustivas para garantizar la alineación con el cumplimiento y la relevancia regional. Sin embargo, con la llegada de la IA generativa, ahora podemos automatizar la elaboración de anuncios que realmente resuenan en las audiencias locales, manteniendo al mismo tiempo estándares y directrices estrictos.

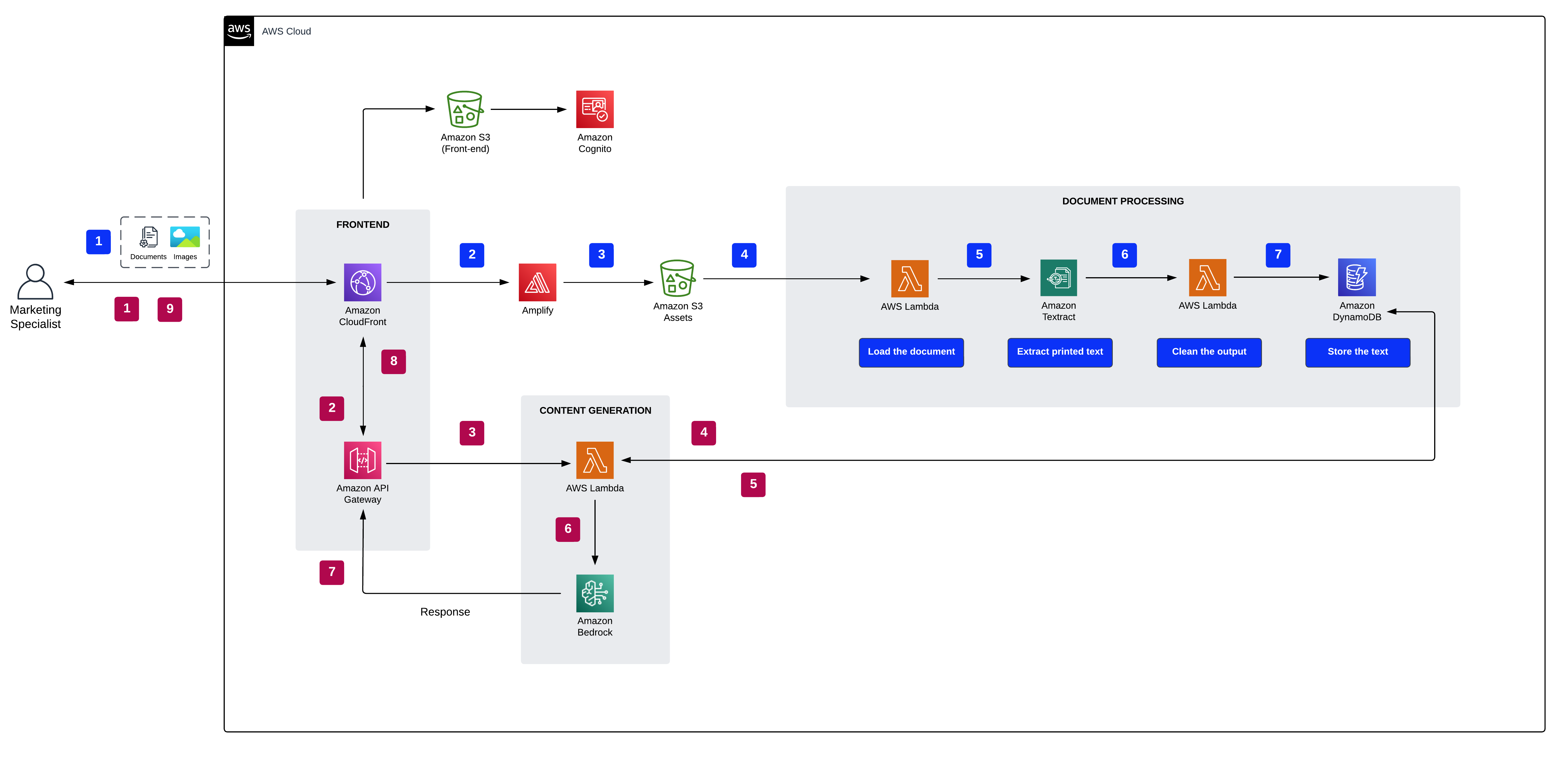

El siguiente diagrama ilustra la arquitectura de la solución.

En el diseño arquitectónico, según el modelo seleccionado y las preferencias de anuncios, los usuarios son guiados sin problemas a los modelos de base de Amazon Bedrock. Este enfoque simplificado garantiza que los nuevos anuncios se generen precisamente de acuerdo con la configuración deseada. Como parte del proceso, los documentos son manejados eficientemente por Amazon Textil, con el texto resultante almacenado de forma segura en DynamoDB. Una característica destacada es el diseño modular para la generación de imágenes y texto, lo que le otorga la flexibilidad de regenerar de forma independiente cualquier componente según sea necesario.

Hemos proporcionado esta demostración en el Repositorio GitHub. Consulte las instrucciones de implementación en el archivo Léame para implementarlo en su cuenta de AWS.

Flujo de trabajo de generación de contenido

Los siguientes pasos describen el proceso de generación de contenido:

- El usuario elige su documento, imagen de origen, ubicación del anuncio, idioma y estilo de imagen.

- El acceso seguro a la aplicación web se garantiza mediante la autenticación de Amazon Cognito.

- La interfaz de la aplicación web está alojada a través de Amplify.

- Una API WebSocket, administrada por API Gateway, facilita las solicitudes de los usuarios. Estas solicitudes se autentican a través de Gestión de identidades y accesos de AWS (SOY).

- La integración con Amazon Bedrock incluye los siguientes pasos:

- Una función Lambda emplea la biblioteca LangChain para conectarse al punto final de Amazon Bedrock mediante una consulta rica en contexto.

- El modelo fundamental de texto a texto crea un anuncio contextualmente apropiado según el contexto y la configuración dados.

- El modelo fundamental de texto a imagen crea una imagen personalizada, influenciada por la imagen de origen, el estilo elegido y la ubicación.

- El usuario recibe la respuesta a través de una solicitud HTTPS a través de la API WebSocket API Gateway integrada.

Flujo de trabajo de procesamiento de documentos e imágenes.

El siguiente es el procedimiento para la tramitación de documentos e imágenes:

- El usuario carga activos a través de la interfaz de usuario especificada.

- La API de Amplify transfiere los documentos a un depósito de S3.

- Después de que el activo se transfiere a Amazon S3, se lleva a cabo una de las siguientes acciones:

- Si se trata de un documento, una función Lambda utiliza Amazon Textract para procesar y extraer texto para la generación de anuncios.

- Si es una imagen, la función Lambda la convierte al formato base64, adecuado para que el modelo Stable Diffusion cree una nueva imagen a partir de la fuente.

- El texto extraído o la cadena de imagen base64 se guarda de forma segura en DynamoDB.

Beneficios

La siguiente lista describe los beneficios de esta solución:

- Eficiencia – El uso de IA generativa acelera significativamente el proceso de generación de anuncios, eliminando la necesidad de ajustes manuales.

- Cumplimiento del cumplimiento – La solución garantiza que los anuncios generados cumplan con directrices y regulaciones específicas, como las directrices de marketing de la FDA.

- Económico – Al automatizar la creación de anuncios personalizados, las empresas pueden reducir significativamente los costos asociados con la producción y las revisiones de los anuncios.

- Proceso simplificado de MLR – La solución simplifica el proceso de MLR, reduciendo los puntos de fricción y garantizando revisiones más fluidas.

- resonancia localizada – La IA generativa produce anuncios que resuenan en las audiencias locales, asegurando relevancia e impacto en diferentes regiones.

- Normalización – La solución mantiene los estándares y directrices necesarios, garantizando la coherencia en todos los anuncios generados.

- Escalabilidad – El enfoque basado en IA puede manejar vastas bases de datos de imágenes de origen y archivos PDF, lo que lo hace factible para la generación de anuncios a gran escala.

- Reducción de la intervención manual – La automatización reduce la necesidad de intervención humana, minimizando errores y garantizando coherencia.

Puede implementar la infraestructura en este tutorial desde su computadora local o puede usar AWS Cloud9 como su estación de trabajo de implementación. AWS Cloud9 viene precargado con AWS CLI, AWS CDK y Docker. Si opta por AWS Cloud9, crear el medio ambiente del desplegable Consola de AWS Cloud9.

Limpiar

Para evitar costos innecesarios, limpie toda la infraestructura creada a través de la consola de AWS CloudFormation o ejecutando el siguiente comando en su estación de trabajo:

Además, recuerde detener cualquier punto final de SageMaker que haya iniciado a través de la consola de SageMaker. Recuerde, eliminar un índice de Amazon Kendra no elimina los documentos originales de su almacenamiento.

Conclusión

La IA generativa, personificada en los LLM, presagia un cambio de paradigma en la forma en que accedemos y generamos información. Estos modelos, aunque potentes, suelen estar limitados por los límites de sus datos de entrenamiento. RAG aborda este desafío, garantizando que el vasto conocimiento dentro de estos modelos esté constantemente infundido con conocimientos relevantes y actuales.

Nuestras demostraciones basadas en RAG son un testimonio tangible de ello. Muestran la sinergia perfecta entre Amazon Kendra, las incorporaciones de vectores y los LLM, creando un sistema donde la información no solo es amplia sino también precisa y oportuna. A medida que se sumerge en estas demostraciones, explorará de primera mano el potencial transformador de fusionar el conocimiento previamente capacitado con las capacidades dinámicas de RAG, lo que da como resultado resultados confiables y adaptados al contenido empresarial.

Aunque la IA generativa impulsada por LLM abre una nueva forma de obtener conocimientos de información, estos conocimientos deben ser confiables y limitarse al contenido empresarial utilizando el enfoque RAG. Estas demostraciones basadas en RAG le permiten disponer de información precisa y actualizada. La calidad de estos conocimientos depende de la relevancia semántica, que se habilita mediante el uso de Amazon Kendra e incrustaciones de vectores.

Si está listo para explorar más a fondo y aprovechar el poder de la IA generativa, estos son sus próximos pasos:

- Participa con nuestras demostraciones – La experiencia práctica es invaluable. Explore las funcionalidades, comprenda las integraciones y familiarícese con la interfaz.

- Profundiza tu conocimiento – Aprovechar los recursos disponibles. AWS ofrece documentación detallada, tutoriales y soporte comunitario para ayudarle en su viaje hacia la IA.

- Iniciar un proyecto piloto – Considere comenzar con una implementación a pequeña escala de IA generativa en su empresa. Esto proporcionará información sobre la practicidad y adaptabilidad del sistema dentro de su contexto específico.

Para obtener más información sobre las aplicaciones de IA generativa en AWS, consulte lo siguiente:

Recuerde, el panorama de la IA está en constante evolución. Manténgase actualizado, mantenga la curiosidad y esté siempre preparado para adaptarse e innovar.

Acerca de los Autores

Jin Tan Ruan es desarrollador de prototipos dentro del equipo de ingeniería de clientes y prototipos de industrias de AWS (PACE), y se especializa en PNL e IA generativa. Con experiencia en desarrollo de software y nueve certificaciones de AWS, Jin aporta una gran experiencia para ayudar a los clientes de AWS a materializar sus visiones de IA/ML e IA generativa utilizando la plataforma AWS. Tiene una maestría en Ciencias de la Computación e Ingeniería de Software de la Universidad de Syracuse. Fuera del trabajo, a Jin le gusta jugar videojuegos y sumergirse en el apasionante mundo de las películas de terror.

Jin Tan Ruan es desarrollador de prototipos dentro del equipo de ingeniería de clientes y prototipos de industrias de AWS (PACE), y se especializa en PNL e IA generativa. Con experiencia en desarrollo de software y nueve certificaciones de AWS, Jin aporta una gran experiencia para ayudar a los clientes de AWS a materializar sus visiones de IA/ML e IA generativa utilizando la plataforma AWS. Tiene una maestría en Ciencias de la Computación e Ingeniería de Software de la Universidad de Syracuse. Fuera del trabajo, a Jin le gusta jugar videojuegos y sumergirse en el apasionante mundo de las películas de terror.

Aravind Kodandaramaiah es un creador senior de soluciones de pila completa de prototipos dentro del equipo de ingeniería de clientes y prototipos de industrias de AWS (PACE). Se centra en ayudar a los clientes de AWS a convertir ideas innovadoras en soluciones con resultados agradables y mensurables. Le apasionan una variedad de temas, incluida la seguridad en la nube, DevOps y AI/ML, y generalmente se le puede encontrar jugando con estas tecnologías.

Aravind Kodandaramaiah es un creador senior de soluciones de pila completa de prototipos dentro del equipo de ingeniería de clientes y prototipos de industrias de AWS (PACE). Se centra en ayudar a los clientes de AWS a convertir ideas innovadoras en soluciones con resultados agradables y mensurables. Le apasionan una variedad de temas, incluida la seguridad en la nube, DevOps y AI/ML, y generalmente se le puede encontrar jugando con estas tecnologías.

Arjun Shakdher es un desarrollador del equipo de AWS Industries Prototyping (PACE) y le apasiona integrar la tecnología en el tejido de la vida. Con una maestría de la Universidad Purdue, el rol actual de Arjun gira en torno a la arquitectura y la construcción de prototipos de vanguardia que abarcan una variedad de dominios, entre los que actualmente destacan los ámbitos de AI/ML e IoT. Cuando no esté inmerso en el código y los paisajes digitales, encontrará a Arjun disfrutando del mundo del café, explorando la intrincada mecánica de la relojería o deleitándose con el arte de los automóviles.

Arjun Shakdher es un desarrollador del equipo de AWS Industries Prototyping (PACE) y le apasiona integrar la tecnología en el tejido de la vida. Con una maestría de la Universidad Purdue, el rol actual de Arjun gira en torno a la arquitectura y la construcción de prototipos de vanguardia que abarcan una variedad de dominios, entre los que actualmente destacan los ámbitos de AI/ML e IoT. Cuando no esté inmerso en el código y los paisajes digitales, encontrará a Arjun disfrutando del mundo del café, explorando la intrincada mecánica de la relojería o deleitándose con el arte de los automóviles.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :es

- :no

- :dónde

- $ UP

- 100

- 150

- 7

- a

- capacidad

- Nuestra Empresa

- acelera

- de la máquina

- Conforme

- Mi Cuenta

- la exactitud

- preciso

- a través de

- acciones

- Ad

- adaptar

- se adapta

- adicional

- direcciones

- adherirse

- ajustes

- Adopción

- Anuncios

- avanzado

- Ventaja

- ventajas

- adviento

- Publicidad

- Después

- AI

- AI / ML

- Ayudar

- alineación

- Todos

- permitir

- Permitir

- permite

- casi

- a lo largo de

- también

- alternativa

- hacerlo

- Amazon

- Cognito Amazonas

- amazona kendra

- Amazon Textil

- Amazon Web Services

- cantidades

- amplian

- an

- y

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- respuestas

- cualquier

- abejas

- applicación

- Aplicación

- aplicaciones

- enfoque

- adecuado

- arquitectónico

- arquitectura

- somos

- en torno a

- Formación

- arte

- AS

- activo

- Activos

- ayudar

- asociado

- audiencias

- audio

- autenticado

- Autenticación

- automatizado

- automatizar

- Automatización

- Hoy Disponibles

- evitar

- evitar

- AWS

- Nube de AWS9

- Formación en la nube de AWS

- Atrás

- Respaldados

- fondo

- apoyo

- bases

- basado

- BE

- porque

- a las que has recomendado

- se convierte en

- beneficios

- mejores

- entre

- Más allá de

- los prejuicios

- mezcla

- cuerpo

- Bot

- ambas

- Rama

- Trae

- general

- constructor

- Construir la

- pero

- by

- Calls

- PUEDEN

- Puede conseguir

- capacidades

- capturar

- capturas

- case

- Categoría

- certificaciones

- Reto

- retos

- Elige

- elegido

- limpia

- Soluciones

- Cloud Security

- Cloud9

- código

- CAFÉ

- combinado

- combina

- proviene

- comúnmente

- vibrante e inclusiva

- Empresas

- comparaciones

- integraciones

- compliance

- obediente

- componente

- comprende

- computadora

- Ciencias de la Computación

- Configuración

- Contacto

- Conexiones

- conecta

- Considerar

- consecuentemente

- Consola

- constantemente

- contenido

- Generación de contenido

- creación de contenido

- contexto

- contextos

- contextual

- continuado

- continuo

- Conveniente

- convencional

- Conversación

- la conversión de

- Core

- Cost

- Precio

- arte

- Para crear

- creado

- crea

- Creamos

- creación

- crucial

- incómodo

- curioso

- Current

- personalizado

- cliente

- Clientes

- innovador

- datos

- Base de datos

- bases de datos

- conjuntos de datos

- Fecha

- profundo

- más profundo

- Grado

- encantador

- manifestación

- Demos

- dependiente

- desplegar

- desplegado

- Desplegando

- despliegue

- describir

- Diseño

- diseñado

- deseado

- destruir

- detallado

- detalles

- Developer

- Desarrollo

- diagnóstico

- una experiencia diferente

- Difusión

- digital

- que dirigieron

- distinto

- inmersión

- diverso

- Cursos de Buceo

- Docker

- documento

- documentación

- documentos

- No

- dominios

- dibujar

- dibujo

- impulsados

- lugar de trabajo dinámico

- pasan fácilmente

- eficiencia

- eficiente

- eficiente.

- ya sea

- eliminando

- incrustación

- surgir

- emplea

- poder

- empodera

- habilitar

- facilita

- permite

- permitiendo

- final

- Punto final

- Ingeniería

- mejorado

- enriquecedor

- garantizar

- asegurado

- asegura

- asegurando que

- Empresa

- Todo

- equipado

- Errores

- especialmente

- esencia

- evaluar

- Evento

- NUNCA

- evoluciona

- evolución

- ejemplo

- excitado

- expansivo

- experience

- experto

- expertos

- explorar

- Explorar

- en los detalles

- externo

- extraerlos

- material

- facilita

- familiarizar

- de ritmo rápido

- FB

- factible

- Feature

- Caracteristicas

- Con la participación de:

- Archive

- filtración

- Encuentre

- Nombre

- Flexibilidad

- se centra

- siguiendo

- siguiente

- formato

- encontrado

- Fundación

- fricción

- Desde

- frontal o trasero

- Interfaz

- ser completados

- Completa pila

- función

- funcionalidades

- promover

- Además

- Obtén

- ganando

- Juegos

- puerta

- generar

- generado

- generación de AHSS

- generativo

- IA generativa

- generador

- obtener

- dado

- Diezmos y Ofrendas

- concesión

- agarrar

- crece

- garantizamos

- guía

- guiado

- orientaciones

- encargarse de

- emprendedor

- aprovechar

- Aprovechamiento

- Tienen

- es

- he

- ayudando

- heraldos

- esta página

- destacados

- él mismo

- historias

- historia

- tenencia

- mantiene

- horror

- organizado

- Cómo

- Sin embargo

- HTML

- http

- HTTPS

- humana

- ideas

- identificador

- Identificadores

- Identifique

- Identidad

- if

- ilustra

- imagen

- imágenes

- inmerso

- Impacto

- implementación

- in

- a fondo

- incorrecto

- incluye

- Incluye

- incorporar

- independientemente

- índice

- indexado

- índices

- industrias

- energético

- estándares de la industria

- influenciado

- información

- informó

- EN LA MINA

- inherentemente

- inicial

- iniciado

- innovar

- originales

- perspicaz

- Insights

- Instrucciones

- COMPLETAMENTE

- Integra

- integración

- integraciones

- intención

- interactúa

- Interfaz

- intervención

- dentro

- intrínseco

- inestimable

- IOT

- IT

- artículos

- SUS

- Trabajos

- jpg

- solo

- especialistas

- conocido

- paisaje

- idioma

- large

- Gran escala

- Disposición

- aprendizaje

- Legal

- Permíteme

- Biblioteca

- Con licencia

- Vida

- como

- probabilidad

- Limitada

- límites

- Lista

- LLM

- local

- Ubicación

- máquina

- máquina de aprendizaje

- mantiene

- Realizar

- gestionado

- manual

- muchos

- Marketing

- masivo

- Máster

- cerillas

- materiales

- sentido

- significativo

- significados

- significa

- mecánica

- mecanismo

- servicios

- Salud Cerebral

- simplemente

- se fusiona

- la fusión de

- métodos

- meticulosamente

- minimizando

- mitigación

- ML

- modelo

- modelado

- modelos

- modulares

- más,

- MEJOR DE TU

- Películas

- debe

- Natural

- Procesamiento natural del lenguaje

- necesario

- ¿ Necesita ayuda

- necesidad

- Nuevo

- Next

- nueve

- nlp

- .

- ahora

- of

- que ofrece

- Ofertas

- a menudo

- on

- ONE

- , solamente

- abre

- or

- organizativo

- para las fiestas.

- reconocida por

- Otro

- nuestros

- salir

- resultados

- contorno

- salidas

- afuera

- Más de

- Superar

- Paz

- paradigma

- parámetros

- parte

- apasionado

- perfecto

- permisos

- Personalizado

- Farma

- Farmacéutica

- frases

- piezas

- piloto

- proyecto piloto

- Colocar

- colocación

- plataforma

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Jugar

- jugando

- puntos

- posicionamiento

- posible

- Publicación

- posible

- industria

- alimentado

- poderoso

- Metodología

- necesidad

- precisamente

- Precisión

- preferencias

- requisitos previos

- ahora

- procedimientos

- Procesado

- tratamiento

- producido

- produce

- Producción

- proyecto

- promocional

- prototipos

- prototipado

- Demostrar.

- proporcionar

- previsto

- proporciona un

- proporcionando

- calidad

- consultas

- pregunta

- Preguntas

- Búsqueda

- con rapidez

- distancia

- ready

- reinos

- recibe

- aprovecha

- Recomendación

- reducir

- reduce

- la reducción de

- remitir

- refinado

- regional

- regiones

- regular

- reglamentos

- regulador

- Cumplimiento Regulatorio

- la relevancia

- confiando

- permanecer

- permanece

- recordarlo

- remove

- expresar de otro modo

- representación

- representa

- solicita

- solicitudes

- exigir

- Requisitos

- Requisitos

- Resonar

- Recursos

- respuesta

- respuestas

- responsabilidades

- responsable

- resultante

- resultante

- Resultados

- una estrategia SEO para aparecer en las búsquedas de Google.

- Reseñas

- las revisiones

- gira

- Derecho

- riguroso

- Función

- correr

- corre

- sabio

- mismo

- salvado

- Ciencia:

- científico

- sin costura

- sin problemas

- Buscar

- (secciones)

- seguro

- segura

- EN LINEA

- seleccionado

- selección

- mayor

- expedido

- de coches

- Servicios

- set

- ajustes

- Configure

- Turno

- mostrar

- Shows

- Tamizar

- importante

- significativamente

- sencillos

- simplemente

- menores

- más suave

- Software

- Desarrollo de software ad-hoc

- Ingeniería de software

- únicamente

- a medida

- Soluciones

- Fuente

- originario

- Fuentes

- Sourcing

- espacios

- lapso

- especializado

- especializada

- soluciones y

- especificado

- estable

- montón

- estándares de salud

- Comience a

- el estado de la técnica

- quedarse

- paso

- pasos

- Detener

- STORAGE

- tienda

- almacenados

- almacenamiento

- racionalizado

- fortalezas

- Cordón

- riguroso

- estructurado

- papa

- enviar

- tal

- adecuado

- SOPORTE

- Soportado

- sinergia

- te

- adaptado

- ¡Prepárate!

- toma

- tangible

- Tarea

- tareas

- equipo

- equipos

- la técnica

- Tecnologías

- Tecnología

- testamento

- texto

- que

- esa

- La

- El paisaje

- La Fuente

- el mundo

- su

- Les

- luego

- de este modo

- Estas

- ellos

- así

- Tres

- emocionante

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- oportuno

- fecha y hora

- titán

- a

- de hoy

- del IRS

- tema

- Temas

- hacia

- tradicional

- Entrenar

- entrenado

- Formación

- transferir

- transferido

- transferencias

- Transformar

- transformacional

- transformers

- Tendencias

- verdaderamente

- digno de confianza

- GIRO

- tutoriales

- Tutoriales

- tipos

- ui

- someterse

- subyacente

- entender

- comprensión

- único

- universidad

- diferente a

- innecesario

- quitar el velo

- hasta a la fecha

- Actualizar

- actualizado

- Actualizaciones

- defensa

- a

- utilizan el

- caso de uso

- Usuario

- Interfaz de usuario

- usuarios

- usos

- usando

- generalmente

- utiliza

- Utilizando

- diversos

- Vasto

- versátil

- vía

- Video

- videojuegos

- visiones

- Camino..

- we

- Gestión de Patrimonio

- web

- Aplicación web

- servicios web

- websocket

- tuvieron

- cuando

- que

- mientras

- QUIENES

- amplio

- Amplia gama

- seguirá

- dentro de

- sin

- palabras

- Actividades:

- flujo de trabajo

- puesto de trabajo

- mundo

- Usted

- tú

- a ti mismo

- zephyrnet