El mundo de la inteligencia artificial (IA) y el aprendizaje automático (ML) ha sido testigo de un cambio de paradigma con el surgimiento de modelos generativos de IA que pueden crear texto, imágenes, código y audio similares a los humanos. En comparación con los modelos clásicos de ML, los modelos generativos de IA son significativamente más grandes y complejos. Sin embargo, su creciente complejidad también conlleva altos costos de inferencia y una creciente necesidad de potentes recursos informáticos. El alto costo de la inferencia para los modelos de IA generativa puede ser una barrera de entrada para las empresas y los investigadores con recursos limitados, lo que exige la necesidad de soluciones más eficientes y rentables. Además, la mayoría de los casos de uso de IA generativa involucran interacción humana o escenarios del mundo real, lo que requiere hardware que pueda ofrecer un rendimiento de baja latencia. AWS ha estado innovando con chips especialmente diseñados para abordar la creciente necesidad de hardware informático potente, eficiente y rentable.

Hoy, nos complace anunciar que Amazon SageMaker apoya Inferencia de AWS2 (ml.inf2) y tren de AWS (ml.trn1) basadas en instancias de SageMaker para alojar modelos generativos de IA para inferencia asíncrona y en tiempo real. Las instancias ml.inf2 están disponibles para la implementación de modelos en SageMaker en el este de EE. UU. (Ohio) y las instancias ml.trn1 en el este de EE. UU. (Norte de Virginia).

Puede usar estas instancias en SageMaker para lograr un alto rendimiento a un bajo costo para los modelos de IA generativos, incluidos los modelos de lenguaje extenso (LLM), la difusión estable y los transformadores de visión. Además, puede utilizar Recomendador de inferencia de Amazon SageMaker para ayudarlo a ejecutar pruebas de carga y evaluar los beneficios de precio-rendimiento de implementar su modelo en estas instancias.

Puede usar las instancias ml.inf2 y ml.trn1 para ejecutar sus aplicaciones de ML en SageMaker para resumen de texto, generación de código, generación de videos e imágenes, reconocimiento de voz, personalización, detección de fraude y más. Puede comenzar fácilmente especificando instancias ml.trn1 o ml.inf2 al configurar su terminal de SageMaker. Puede utilizar contenedores de aprendizaje profundo (DLC) de AWS compatibles con ml.trn1 y ml.inf2 para PyTorch, TensorFlow, Hugging Face e inferencia de modelos grandes (LMI) para comenzar fácilmente. Para obtener la lista completa con versiones, consulte Imágenes de contenedores de aprendizaje profundo disponibles.

En esta publicación, mostramos el proceso de implementación de un modelo de lenguaje grande en AWS Inferentia2 utilizando SageMaker, sin necesidad de codificación adicional, aprovechando el contenedor LMI. usamos el GPT4ALL-J, un modelo GPT-J 7B perfeccionado que proporciona una interacción estilo chatbot.

Descripción general de las instancias ml.trn1 y ml.inf2

Las instancias ml.trn1 funcionan con el acelerador Trainium, que está especialmente diseñado para el entrenamiento de aprendizaje profundo de alto rendimiento de modelos de IA generativos, incluidos los LLM. Sin embargo, estas instancias también admiten cargas de trabajo de inferencia para modelos que son incluso más grandes de lo que cabe en Inf2. El tamaño de instancia más grande, instancias trn1.32xlarge, cuenta con 16 Aceleradores de trenio con 512 GB de memoria aceleradora en una sola instancia que ofrece hasta 3.4 petaflops de potencia informática FP16/BF16. 16 aceleradores Trainium están conectados con NeuronLinkv2 de ultra alta velocidad para comunicaciones colectivas optimizadas.

Las instancias ml.Inf2 funcionan con la Acelerador AWS Inferentia2, un acelerador especialmente diseñado para la inferencia. Ofrece un rendimiento informático tres veces mayor, un rendimiento hasta cuatro veces mayor y una latencia hasta 10 veces menor en comparación con AWS Inferentia de primera generación. El tamaño de instancia más grande, Inf2.48xlarge, cuenta con 12 aceleradores AWS Inferentia2 con 384 GB de memoria de acelerador en una sola instancia para una potencia de cómputo combinada de 2.3 petaflops para BF16/FP16. Le permite implementar hasta un modelo de 175 mil millones de parámetros en una sola instancia. Inf2 es la única instancia optimizada para inferencia que ofrece esta interconexión, una función que solo está disponible en instancias de capacitación más costosas. Para los modelos ultragrandes que no caben en un solo acelerador, los datos fluyen directamente entre los aceleradores con NeuronLink, sin pasar por la CPU por completo. Con NeuronLink, Inf2 admite una inferencia distribuida más rápida y mejora el rendimiento y la latencia.

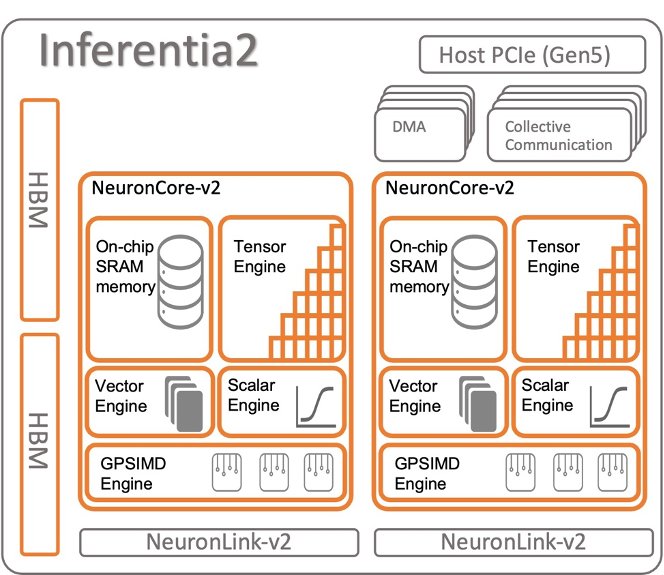

Los aceleradores AWS Inferentia2 y Trainium tienen dos NeuronCores-v2, pilas de memoria HBM de 32 GB y motores de cómputo colectivo dedicados, que optimizan automáticamente el tiempo de ejecución al superponer el cómputo y la comunicación cuando se realiza una inferencia de múltiples aceleradores. Para obtener más detalles sobre la arquitectura, consulte Dispositivos Trainium e Inferentia.

El siguiente diagrama muestra una arquitectura de ejemplo con AWS Inferentia2.

SDK de AWS Neuron

AWS neurona es el SDK que se utiliza para ejecutar cargas de trabajo de aprendizaje profundo en instancias basadas en AWS Inferentia y Trainium. AWS Neuron incluye un compilador de aprendizaje profundo, tiempo de ejecución y herramientas que se integran de forma nativa en TensorFlow y PyTorch. Con Neuron, puede desarrollar, perfilar e implementar cargas de trabajo de ML de alto rendimiento en ml.trn1 y ml.inf2.

La Compilador de neuronas acepta modelos ML en varios formatos (TensorFlow, PyTorch, XLA HLO) y los optimiza para ejecutarse en dispositivos Neuron. El compilador Neuron se invoca dentro del marco ML, donde los modelos ML se envían al compilador mediante el complemento del marco Neuron. El artefacto del compilador resultante se denomina archivo NEFF (formato de archivo ejecutable de Neuron) que, a su vez, el tiempo de ejecución de Neuron carga en el dispositivo de Neuron.

La tiempo de ejecución de la neurona consta de un controlador de kernel y bibliotecas C/C++, que proporcionan API para acceder a los dispositivos AWS Inferentia y Trainium Neuron. Los complementos de marcos de Neuron ML para TensorFlow y PyTorch usan el tiempo de ejecución de Neuron para cargar y ejecutar modelos en NeuronCores. El tiempo de ejecución de Neuron carga modelos de aprendizaje profundo compilados (NEFF) en los dispositivos de Neuron y está optimizado para un alto rendimiento y baja latencia.

Aloje modelos de NLP utilizando instancias de SageMaker ml.inf2

Antes de profundizar en el servicio de LLM con transformadores-neuronx, que es una biblioteca de código abierto para fragmentar las matrices de gran peso del modelo en varios NeuronCore, repasemos brevemente el flujo de implementación típico para un modelo que puede caber en un solo NeuronCore.

Asegúrate de leer lista de modelos soportados para garantizar que el modelo sea compatible con AWS Inferencea2. A continuación, el modelo debe ser precompilado por Neuron Compiler. Puede utilizar un bloc de notas de SageMaker o un Nube informática elástica de Amazon (Amazon EC2) instancia para compilar el modelo. Puede usar SageMaker Python SDK para implementar modelos usando marcos de trabajo de aprendizaje profundo populares como PyTorch, como se muestra en el siguiente código. Puede implementar su modelo en los servicios de alojamiento de SageMaker y obtener un punto final que se puede usar para la inferencia. Estos puntos finales están totalmente administrados y admiten el escalado automático.

Consulte Flujos de desarrollador para obtener más detalles sobre los flujos de desarrollo típicos de Inf2 en SageMaker con scripts de muestra.

Aloje LLM con instancias de SageMaker ml.inf2

Los modelos de lenguaje grandes con miles de millones de parámetros a menudo son demasiado grandes para caber en un solo acelerador. Esto requiere el uso de técnicas paralelas de modelos para alojar LLM en múltiples aceleradores. Otro requisito crucial para alojar LLM es la implementación de una solución de servicio de modelos de alto rendimiento. Esta solución debería cargar el modelo de manera eficiente, administrar la partición y atender solicitudes sin problemas a través de puntos finales HTTP.

SageMaker incluye contenedores especializados de aprendizaje profundo (DLC), bibliotecas y herramientas para el paralelismo de modelos y la inferencia de modelos grandes. Para obtener recursos para comenzar con LMI en SageMaker, consulte Paralelismo de modelos e inferencia de modelos grandes. SageMaker mantiene DLC con bibliotecas populares de código abierto para alojar modelos grandes como GPT, T5, OPT, BLOOM y Stable Diffusion en la infraestructura de AWS. Estos DLC especializados se conocen como contenedores LMI de SageMaker.

Contenedores LMI de SageMaker use DJLServing, un servidor modelo que está integrado con la biblioteca transformers-neuronx para admitir el paralelismo tensorial en NeuronCores. Para obtener más información sobre cómo funciona DJLServing, consulte Implemente modelos grandes en Amazon SageMaker mediante la inferencia paralela de modelos DJLServing y DeepSpeed. El servidor modelo DJL y la biblioteca transformers-neuronx sirven como componentes centrales del contenedor, que también incluye Neuron SDK. Esta configuración facilita la carga de modelos en los aceleradores de AWS Inferentia2, paraleliza el modelo en varios NeuronCores y permite el servicio a través de puntos de enlace HTTP.

El contenedor LMI admite la carga de modelos desde un Servicio de almacenamiento simple de Amazon (Amazon S3) cubeta o Hugging Face Hub. El script del controlador predeterminado carga el modelo, lo compila, lo convierte a un formato optimizado para Neuron y lo carga. Para utilizar el contenedor LMI para alojar LLM, tenemos dos opciones:

- Un sin código (preferido) – Esta es la forma más fácil de implementar un LLM usando un contenedor LMI. En este método, puede utilizar el proporcionado controlador predeterminado y simplemente pase el nombre del modelo y los parámetros requeridos en

serving.propertiesarchivo para cargar y alojar el modelo. Para usar el controlador predeterminado, proporcionamos elentryPointparámetro comodjl_python.transformers-neuronx. - Trae tu propio guión – En este enfoque, tiene la opción de crear su propio archivo model.py, que contiene el código necesario para cargar y servir el modelo. Este archivo actúa como intermediario entre el

DJLServingAPI y eltransformers-neuronxAPI. Para personalizar el proceso de carga del modelo, puede proporcionarserving.propertiescon parámetros configurables. Para obtener una lista completa de los parámetros configurables disponibles, consulte Todas las opciones de configuración de DJL. A continuación se muestra un ejemplo de modelo.py archivo.

Arquitectura de tiempo de ejecución

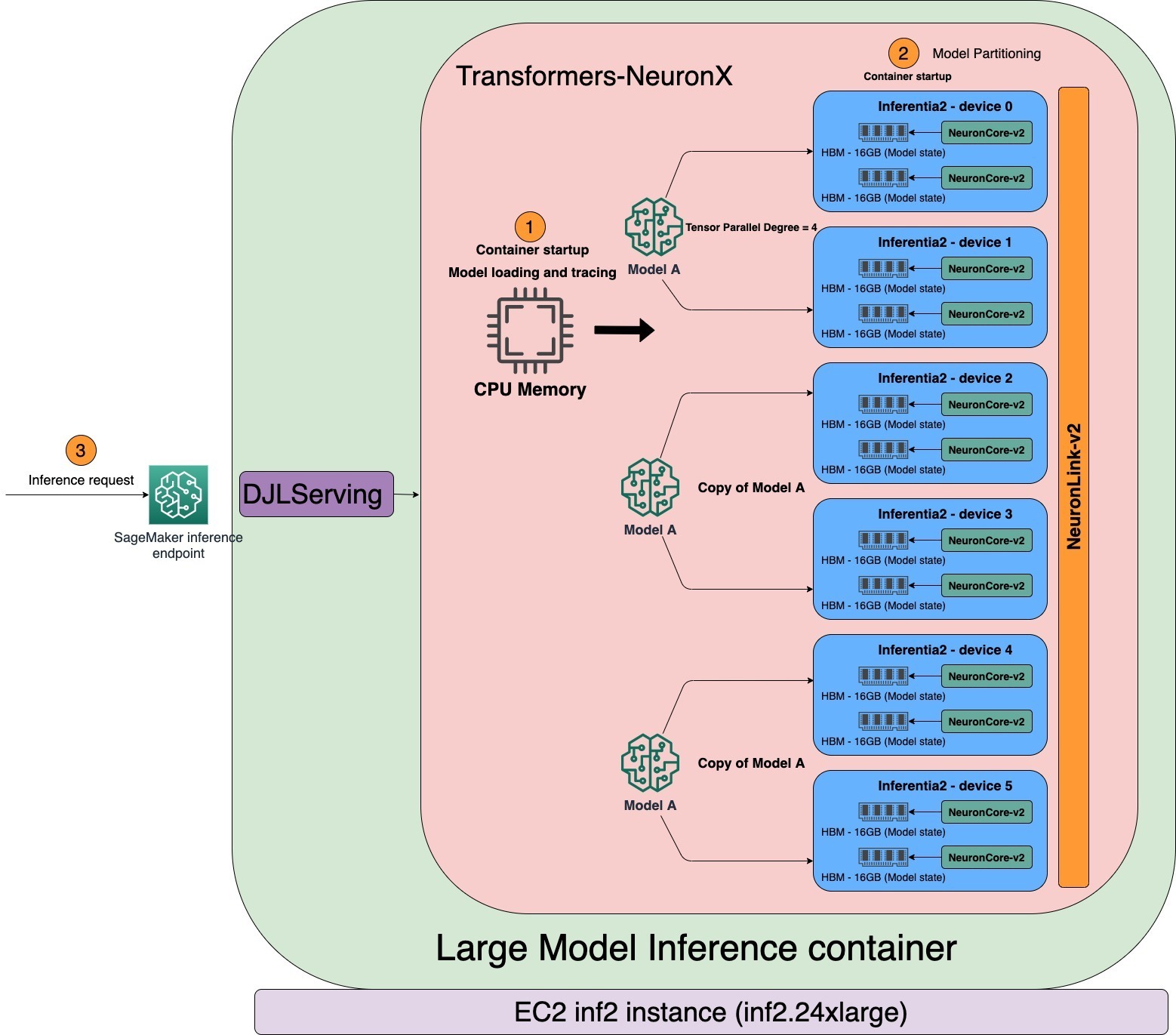

La tensor_parallel_degree El valor de la propiedad determina la distribución de los módulos paralelos de tensor en múltiples NeuronCores. Por ejemplo, inf2.24xlarge tiene seis aceleradores AWS Inferentia2. Cada acelerador de AWS Inferentia2 tiene dos NeuronCores. Cada NeuronCore tiene una memoria dedicada de alto ancho de banda (HBM) de 16 GB que almacena módulos tensor paralelos. Con un grado de tensor paralelo de 4, el LMI asignará tres copias modelo del mismo modelo, cada una con cuatro NeuronCores. Como se muestra en el siguiente diagrama, cuando se inicia el contenedor LMI, el modelo se cargará y rastreará primero en la memoria direccionable de la CPU. Cuando se completa el rastreo, el modelo se divide en los NeuronCores en función del grado paralelo del tensor.

LMI usa DJLServing como su pila de servicio modelo. Una vez que pasa la verificación de estado del contenedor en SageMaker, el contenedor está listo para atender la solicitud de inferencia. DJLServing lanza múltiples procesos de Python equivalentes al TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. Cada proceso de Python contiene subprocesos en C++ equivalentes a TENSOR_PARALLEL_DEGREE. Cada subproceso de C++ contiene un fragmento del modelo en un NeuronCore.

Muchos practicantes (proceso de Python) tienden a ejecutar la inferencia secuencialmente cuando se invoca el servidor con múltiples solicitudes independientes. Aunque es más fácil de configurar, generalmente no es la mejor práctica utilizar la potencia de cómputo del acelerador. Para abordar esto, DJLServing ofrece optimizaciones integradas de procesamiento por lotes dinámico para combinar estas solicitudes de inferencia independientes en el lado del servidor para formar un lote más grande dinámicamente para aumentar el rendimiento. Todas las solicitudes llegan primero al dosificador dinámico antes de ingresar a las colas de trabajo reales para esperar la inferencia. Puede establecer sus tamaños de lote preferidos para el procesamiento por lotes dinámico utilizando el batch_size ajustes en serving.properties. También puede configurar max_batch_delay para especificar el tiempo de demora máximo en el procesador por lotes para esperar otras solicitudes para unirse al lote en función de sus requisitos de latencia. El rendimiento también depende de la cantidad de copias del modelo y de los grupos de procesos de Python lanzados en el contenedor. Como se muestra en el siguiente diagrama, con el grado paralelo del tensor establecido en 4, el contenedor LMI lanza tres grupos de procesos de Python, cada uno con la copia completa del modelo. Esto le permite aumentar el tamaño del lote y obtener un mayor rendimiento.

Bloc de notas de SageMaker para implementar LLM

En esta sección, proporcionamos un tutorial paso a paso de la implementación de GPT4All-J, un modelo de 6 mil millones de parámetros que tiene 24 GB en FP32. GPT4All-J es un chatbot popular que ha sido entrenado en una gran variedad de contenido de interacción como problemas de palabras, diálogos, código, poemas, canciones e historias. GPT4all-J es un modelo GPT-J perfeccionado que genera respuestas similares a las interacciones humanas.

El cuaderno completo para este ejemplo se proporciona en GitHub. Podemos usar SageMaker Python SDK para implementar el modelo en una instancia de Inf2. Usamos lo provisto controlador predeterminado para cargar el modelo. Con esto, solo tenemos que proporcionar un porciones.propiedades archivo. Este archivo tiene las configuraciones necesarias para que el servidor del modelo DJL descargue y aloje el modelo. Podemos especificar el nombre del modelo Hugging Face usando el model_id parámetro para descargar el modelo directamente desde el repositorio de Hugging Face. Alternativamente, puede descargar el modelo de Amazon S3 proporcionando el s3url parámetro. los entryPoint El parámetro está configurado para apuntar a la biblioteca para cargar el modelo. Para más detalles sobre djl_python.fastertransformer, referirse a Código de GitHub.

La tensor_parallel_degree El valor de la propiedad determina la distribución de los módulos paralelos tensoriales en varios dispositivos. Por ejemplo, con 12 NeuronCores y un grado de tensor paralelo de 4, LMI asignará tres copias modelo, cada una con cuatro NeuronCores. También puede definir el tipo de precisión usando la propiedad dtype. n_position El parámetro define la suma de la longitud máxima de secuencia de entrada y salida para el modelo. Ver el siguiente código:

Construir el tarball que contiene serving.properties y cárguelo en un depósito S3. Aunque en este ejemplo se utiliza el controlador predeterminado, puede desarrollar un model.py archivo para personalizar el proceso de carga y servicio. Si hay paquetes que necesitan instalación, inclúyalos en el requirements.txt archivo. Ver el siguiente código:

Recupere la imagen del contenedor DJL y cree el modelo de SageMaker:

A continuación, creamos el extremo de SageMaker con la configuración del modelo definida anteriormente. El contenedor descarga el modelo en el /tmp espacio porque SageMaker mapea el /tmp a Tienda de bloques elásticos de Amazon (Amazon EBS). Necesitamos agregar un volume_size parámetro para garantizar la /tmp El directorio tiene suficiente espacio para descargar y compilar el modelo. Establecimos container_startup_health_check_timeout a 3,600 segundos para garantizar que la verificación de estado comience después de que el modelo esté listo. Usamos la instancia ml.inf2.8xlarge. Ver el siguiente código:

Una vez que se ha creado el punto final de SageMaker, podemos hacer predicciones en tiempo real contra los puntos finales de SageMaker usando el Predictor :

Limpiar

Elimine los puntos finales para ahorrar costos después de terminar sus pruebas:

Conclusión

En esta publicación, mostramos la capacidad recién lanzada de SageMaker, que ahora es compatible con las instancias ml.inf2 y ml.trn1 para hospedar modelos generativos de IA. Demostramos cómo implementar GPT4ALL-J, un modelo de IA generativa, en AWS Inferentia2 usando SageMaker y el contenedor LMI, sin escribir ningún código. También mostramos cómo puede usar DJLServing y transformers-neuronx para cargar un modelo, particionarlo y servir.

Las instancias de Inf2 brindan la forma más rentable de ejecutar modelos generativos de IA en AWS. Para obtener detalles sobre el rendimiento, consulte Rendimiento Inf2.

Primero eche un vistazo al sitio web de la página GitHub repositorio para un cuaderno de ejemplo. ¡Pruébelo y háganos saber si tiene alguna pregunta!

Acerca de los autores

Vivek Gangasani es arquitecto sénior de soluciones de aprendizaje automático en Amazon Web Services. Trabaja con empresas emergentes de aprendizaje automático para crear e implementar aplicaciones de IA/ML en AWS. Actualmente se enfoca en brindar soluciones para MLOps, ML Inference y low-code ML. Ha trabajado en proyectos en diferentes dominios, incluidos el procesamiento del lenguaje natural y la visión artificial.

Vivek Gangasani es arquitecto sénior de soluciones de aprendizaje automático en Amazon Web Services. Trabaja con empresas emergentes de aprendizaje automático para crear e implementar aplicaciones de IA/ML en AWS. Actualmente se enfoca en brindar soluciones para MLOps, ML Inference y low-code ML. Ha trabajado en proyectos en diferentes dominios, incluidos el procesamiento del lenguaje natural y la visión artificial.

hiroshi tokoyo es arquitecto de soluciones en AWS Annapurna Labs. Con base en Japón, se unió a Annapurna Labs incluso antes de la adquisición por parte de AWS y ha ayudado constantemente a los clientes con la tecnología de Annapurna Labs. Su enfoque reciente está en las soluciones de aprendizaje automático basadas en silicio especialmente diseñado, AWS Inferentia y Trainium.

hiroshi tokoyo es arquitecto de soluciones en AWS Annapurna Labs. Con base en Japón, se unió a Annapurna Labs incluso antes de la adquisición por parte de AWS y ha ayudado constantemente a los clientes con la tecnología de Annapurna Labs. Su enfoque reciente está en las soluciones de aprendizaje automático basadas en silicio especialmente diseñado, AWS Inferentia y Trainium.

Patel Dhawal es Arquitecto Principal de Aprendizaje Automático en AWS. Ha trabajado con organizaciones que van desde grandes empresas hasta empresas emergentes medianas en problemas relacionados con la computación distribuida y la inteligencia artificial. Se enfoca en el aprendizaje profundo, incluidos los dominios de NLP y Computer Vision. Ayuda a los clientes a lograr una inferencia de modelos de alto rendimiento en SageMaker.

Patel Dhawal es Arquitecto Principal de Aprendizaje Automático en AWS. Ha trabajado con organizaciones que van desde grandes empresas hasta empresas emergentes medianas en problemas relacionados con la computación distribuida y la inteligencia artificial. Se enfoca en el aprendizaje profundo, incluidos los dominios de NLP y Computer Vision. Ayuda a los clientes a lograr una inferencia de modelos de alto rendimiento en SageMaker.

qing-lan es ingeniero de desarrollo de software en AWS. Ha estado trabajando en varios productos desafiantes en Amazon, incluidas soluciones de inferencia ML de alto rendimiento y un sistema de registro de alto rendimiento. El equipo de Qing lanzó con éxito el primer modelo de mil millones de parámetros en Amazon Advertising con una latencia muy baja requerida. Qing tiene un conocimiento profundo sobre la optimización de la infraestructura y la aceleración del aprendizaje profundo.

qing-lan es ingeniero de desarrollo de software en AWS. Ha estado trabajando en varios productos desafiantes en Amazon, incluidas soluciones de inferencia ML de alto rendimiento y un sistema de registro de alto rendimiento. El equipo de Qing lanzó con éxito el primer modelo de mil millones de parámetros en Amazon Advertising con una latencia muy baja requerida. Qing tiene un conocimiento profundo sobre la optimización de la infraestructura y la aceleración del aprendizaje profundo.

qingweili es un especialista en aprendizaje automático en Amazon Web Services. Recibió su Ph.D. en Investigación de Operaciones después de que rompió la cuenta de subvenciones de investigación de su asesor y no pudo entregar el Premio Nobel que prometió. Actualmente, ayuda a los clientes de la industria de seguros y servicios financieros a crear soluciones de aprendizaje automático en AWS. En su tiempo libre le gusta leer y enseñar.

qingweili es un especialista en aprendizaje automático en Amazon Web Services. Recibió su Ph.D. en Investigación de Operaciones después de que rompió la cuenta de subvenciones de investigación de su asesor y no pudo entregar el Premio Nobel que prometió. Actualmente, ayuda a los clientes de la industria de seguros y servicios financieros a crear soluciones de aprendizaje automático en AWS. En su tiempo libre le gusta leer y enseñar.

alan bronceado es gerente sénior de productos en SageMaker y lidera los esfuerzos en la inferencia de modelos grandes. Le apasiona aplicar Machine Learning al área de Analytics. Fuera del trabajo, disfruta del aire libre.

alan bronceado es gerente sénior de productos en SageMaker y lidera los esfuerzos en la inferencia de modelos grandes. Le apasiona aplicar Machine Learning al área de Analytics. Fuera del trabajo, disfruta del aire libre.

Varun Syal es un ingeniero de desarrollo de software con AWS Sagemaker que trabaja en funciones críticas para el cliente para la plataforma de inferencia de ML. Le apasiona trabajar en el espacio de sistemas distribuidos e IA. En su tiempo libre le gusta leer y la jardinería.

Varun Syal es un ingeniero de desarrollo de software con AWS Sagemaker que trabaja en funciones críticas para el cliente para la plataforma de inferencia de ML. Le apasiona trabajar en el espacio de sistemas distribuidos e IA. En su tiempo libre le gusta leer y la jardinería.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoAiStream. Inteligencia de datos Web3. Conocimiento amplificado. Accede Aquí.

- Acuñando el futuro con Adryenn Ashley. Accede Aquí.

- Compra y Vende Acciones en Empresas PRE-IPO con PREIPO®. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :posee

- :es

- :no

- :dónde

- $ UP

- 10

- 100

- 12

- 13

- 14

- 15%

- 22

- 24

- 7

- 8

- 9

- a

- Nuestra Empresa

- acelerador

- aceleradores

- Acepta

- de la máquina

- Mi Cuenta

- Lograr

- adquisición

- a través de

- hechos

- add

- adición

- dirección

- direccionable

- Ventaja

- Publicidad

- Después

- en contra

- AI

- casos de uso de ia

- AI / ML

- Todos

- permite

- también

- Aunque

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- an

- Analytics

- y

- Anunciar

- Otra

- cualquier

- API

- aplicaciones

- La aplicación de

- enfoque

- arquitectura

- somos

- Reservada

- artificial

- inteligencia artificial

- Inteligencia Artificial (AI)

- AS

- At

- audio

- auto

- automáticamente

- Hoy Disponibles

- AWS

- Inferencia de AWS

- pelota

- Ancho de banda

- barrera

- basado

- BE

- porque

- esto

- antes

- beneficios

- MEJOR

- entre

- Big

- más grande

- miles de millones

- Bloquear

- Blog

- Florecer (bloom)

- brevemente

- Rompió

- build

- construido

- incorporado

- negocios

- by

- C + +

- , que son

- PUEDEN

- cases

- desafiante

- chatterbot

- comprobar

- Papas fritas

- código

- Codificación

- Colectivo

- combinar

- combinado

- proviene

- Comunicación

- Comunicaciónes

- en comparación con

- compatible

- completar

- completamente

- integraciones

- complejidad

- componentes

- exhaustivo

- cálculo

- Calcular

- computadora

- Visión por computador

- informática

- Configuración

- conectado

- Envase

- Contenedores

- contiene

- contenido

- Core

- Cost

- rentable

- Precio

- Para crear

- creado

- crítico

- crucial

- En la actualidad

- cliente

- Clientes

- personalizan

- datos

- a dedicados

- profundo

- deep learning

- Predeterminado

- se define

- Define

- Grado

- retrasar

- entregamos

- entregar

- entrega

- demostrado

- depende

- desplegar

- Desplegando

- despliegue

- detalles

- Detección

- determina

- desarrollar

- Desarrollo

- dispositivo

- Dispositivos

- una experiencia diferente

- Difusión

- directamente

- distribuidos

- Computación distribuída

- sistemas distribuidos

- "Hacer"

- dominios

- No

- descargar

- Descargas

- conductor

- lugar de trabajo dinámico

- dinamicamente

- cada una

- Más temprano

- más fácil

- fácil

- pasan fácilmente

- Este

- eficiente

- eficiente.

- esfuerzos

- permite

- final

- Punto final

- ingeniero

- motores

- suficientes

- garantizar

- que entran a los

- empresas

- entrada

- Equivalente a

- evaluar

- Incluso

- ejemplo

- excitado

- costoso

- extra

- Cara

- facilita

- tener problemas con

- Fallidos

- más rápida

- Feature

- Caracteristicas

- Archive

- financiero

- servicios financieros

- acabado

- Nombre

- cómodo

- de tus señales

- Flujos

- Focus

- centrado

- se centra

- siguiendo

- formulario

- formato

- Digital XNUMXk

- Marco conceptual

- marcos

- fraude

- detección de fraude

- Desde

- ser completados

- completamente

- Además

- genera

- generación de AHSS

- generativo

- IA generativa

- obtener

- Go

- conceder

- Grupo

- Creciendo

- Materiales

- Tienen

- he

- Salud

- ayuda

- ayudado

- ayuda

- esta página

- Alta

- Alto rendimiento

- más alto

- su

- tenencia

- mantiene

- fortaleza

- hosting

- servicios de alojamiento

- Hogar

- Cómo

- Como Hacer

- Sin embargo

- HTML

- http

- HTTPS

- Bujes

- humana

- if

- imagen

- imágenes

- implementación

- importar

- in

- a fondo

- incluir

- incluye

- Incluye

- aumente

- creciente

- independientes

- energético

- EN LA MINA

- innovando

- Las opciones de entrada

- entradas

- instalación

- ejemplo

- aseguradora

- COMPLETAMENTE

- Intelligence

- interacción

- interacciones

- intermediario

- dentro

- invocado

- involucrar

- IT

- SUS

- Japón

- Trabajos

- únete

- se unió a

- jpg

- json

- solo

- Saber

- especialistas

- labs

- idioma

- large

- Grandes empresas

- mayores

- mayor

- Estado latente

- lanzado

- pone en marcha

- líder

- APRENDE:

- aprendizaje

- Longitud Mínima

- dejar

- bibliotecas

- Biblioteca

- como

- Me gusta

- Limitada

- Lista

- LLM

- carga

- carga

- cargas

- registro

- Baja

- inferior

- más bajo

- máquina

- máquina de aprendizaje

- principalmente

- mantiene

- Mayoría

- para lograr

- gestionan

- gestionado

- gerente

- Mapas

- max

- máximas

- Salud Cerebral

- Método

- ML

- MLOps

- modelo

- modelos

- Módulos

- más,

- más eficiente

- MEJOR DE TU

- múltiples

- nombre

- Natural

- Procesamiento natural del lenguaje

- necesario

- ¿ Necesita ayuda

- Nuevo

- New York

- Next

- nlp

- premio Nobel

- cuaderno

- ahora

- número

- objeto

- of

- LANZAMIENTO

- Ofertas

- a menudo

- Ohio

- on

- ONE

- , solamente

- de código abierto

- Operaciones

- optimización

- Optimización

- optimizado

- Optimiza

- Optión

- Opciones

- or

- para las fiestas.

- Otro

- nuestros

- salir

- al exterior

- salida

- afuera

- EL DESARROLLADOR

- paquetes

- paradigma

- Paralelo

- parámetro

- parámetros

- pass

- pasa

- apasionado

- actuación

- personalización

- plataforma

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- plugin

- plugins

- punto

- Popular

- Publicación

- industria

- alimentado

- poderoso

- Precisión

- Predicciones

- Predictor

- preferido

- Director de la escuela

- premio

- problemas

- en costes

- tratamiento

- Producto

- gerente de producto

- Productos

- Mi Perfil

- proyecta

- prometido

- propiedades

- perfecta

- proporcionar

- previsto

- proporciona un

- proporcionando

- propósito

- Python

- piñón

- que van

- en comunicarse

- Reading

- ready

- mundo real

- en tiempo real

- recibido

- reciente

- reconocimiento

- referido

- relacionado

- solicita

- solicitudes

- Requisitos

- requisito

- Requisitos

- la investigación

- investigadores

- Recursos

- respuestas

- resultante

- Subir

- Ejecutar

- sabio

- Inferencia de SageMaker

- mismo

- Guardar

- la ampliación

- escenarios

- guiones

- Sdk

- sin problemas

- segundos

- Sección

- ver

- mayor

- Secuencia

- ayudar

- de coches

- Servicios

- servicio

- set

- ajustes

- Configure

- Varios

- Turno

- tienes

- Mostrar

- exhibido

- mostrado

- Shows

- lado

- significativamente

- Silicio

- similares

- sencillos

- soltero

- SEIS

- Tamaño

- tamaños

- So

- Software

- Desarrollo de software ad-hoc

- a medida

- Soluciones

- Espacio

- especialista

- especializado

- habla

- Reconocimiento de voz

- estable

- montón

- Stacks

- comienzo

- fundó

- comienza

- Startups

- STORAGE

- Historias

- almacenamiento

- racionalizado

- papa

- Con éxito

- tal

- SOPORTE

- Soportado

- soportes

- te

- Todas las funciones a su disposición

- toma

- Educación

- equipo

- técnicas

- Tecnología

- tensorflow

- pruebas

- que

- esa

- La

- El Área

- su

- Les

- Ahí.

- Estas

- así

- Tres

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- rendimiento

- equipo

- veces

- a

- demasiado

- Rastreo

- entrenado

- Formación

- transformers

- GIRO

- dos

- tipo

- principiante

- subido

- us

- utilizan el

- usado

- usando

- generalmente

- utilizar

- Utilizando

- propuesta de

- variedad

- diversos

- Vasto

- muy

- vía

- Video

- Virginia

- visión

- esperar

- tutorial

- Camino..

- we

- web

- servicios web

- peso

- ¿

- cuando

- que

- seguirá

- dentro de

- sin

- presenciando

- Palabra

- Actividades:

- trabajado

- trabajando

- funciona

- mundo

- escribir

- la escritura

- york

- Usted

- tú

- zephyrnet