Después de crear, entrenar y evaluar su modelo de aprendizaje automático (ML) para asegurarse de que está resolviendo el problema comercial propuesto, desea implementar ese modelo para permitir la toma de decisiones en las operaciones comerciales. Los modelos que admiten funciones críticas para el negocio se implementan en un entorno de producción donde se implementa una estrategia de lanzamiento de modelos. Dada la naturaleza de los modelos de ML, donde los datos cambian continuamente, también desea asegurarse de que un modelo implementado siga siendo relevante para los nuevos datos y que el modelo se actualice cuando este no sea el caso. Esto incluye elegir una estrategia de implementación que minimice los riesgos y el tiempo de inactividad. Esta estrategia de implementación óptima debe mantener una alta disponibilidad del modelo, considerar el costo comercial de implementar un modelo inferior al que ya está en producción y contener funcionalidad para volver fácilmente a una versión anterior del modelo. Muchas de estas consideraciones recomendadas y patrones de implementación también se tratan en el Marco de buena arquitectura de AWS: lente de aprendizaje automático.

Además de elegir la estrategia de implementación correcta, esa estrategia debe implementarse mediante un mecanismo confiable que incluya prácticas de MLOps. MLOps incluye prácticas que integran cargas de trabajo de ML en la gestión de versiones, CI/CD y operaciones, lo que da cuenta de los aspectos únicos de los proyectos de ML, incluidas las consideraciones para implementar y monitorear modelos. Amazon SageMaker para MLOps proporciona herramientas especialmente diseñadas para automatizar y estandarizar pasos a lo largo del ciclo de vida de ML, incluidas capacidades para implementar y administrar nuevos modelos utilizando patrones de implementación avanzados.

En esta publicación, discutimos cómo implementar modelos ML con Amazon SageMaker de forma repetible y automatizada, integrando la variantes de producción y barandillas de despliegue capacidades de SageMaker con soluciones MLOps. Le brindamos una introducción sobre cómo integrar las herramientas MLOps de SageMaker con los patrones de implementación de modelos de SageMaker, centrándonos en puntos finales de un solo modelo en tiempo real.

Resumen de la solución

Exploramos las siguientes pruebas de modelo y patrones de protección y su integración con las herramientas de SageMaker MLOps:

- Pruebas de modelos – Comparamos diferentes versiones de modelos en producción antes de reemplazar la versión actual del modelo. Esta publicación compara las siguientes capacidades de prueba de modelos:

- pruebas A/B – Con las pruebas A/B, compara diferentes versiones de su modelo en producción al distribuir el tráfico de punto final entre las variantes de su modelo. Las pruebas A/B se utilizan en escenarios en los que la retroalimentación de circuito cerrado puede vincular directamente los resultados del modelo con las métricas comerciales posteriores. Estos comentarios se utilizan luego para determinar la importancia estadística de cambiar de un modelo a otro, lo que le ayuda a seleccionar el mejor modelo a través de pruebas de producción en vivo.

- Pruebas de sombra – Con las pruebas paralelas, prueba una nueva versión de su modelo en producción enviando solicitudes al modelo de producción y al nuevo modelo en paralelo. Los datos de respuesta de predicción del modelo de producción se entregan a la aplicación, mientras que las predicciones de la nueva versión del modelo se almacenan para realizar pruebas, pero no se entregan a la aplicación de producción. Las pruebas de sombra se utilizan en situaciones en las que no hay retroalimentación de circuito cerrado que mapee una métrica comercial de nuevo a las predicciones de un modelo. En este escenario, utiliza la calidad del modelo y las métricas operativas para comparar varios modelos en lugar de cualquier impacto en las métricas comerciales posteriores.

- Cambiando el tráfico – Una vez que haya probado la nueva versión del modelo y esté satisfecho con su rendimiento, el siguiente paso es cambiar el tráfico del modelo actual al nuevo. El barandillas de despliegue azul/verde en SageMaker le permite cambiar fácilmente del modelo actual en producción (flota azul) a uno nuevo (flota verde) de forma controlada. Las implementaciones azules/verdes evitan el tiempo de inactividad durante las actualizaciones de su modelo, como lo que tendría en un escenario de implementación en el lugar. Para maximizar la disponibilidad del modelo, a partir de este escrito, las implementaciones azul/verde son la opción predeterminada para las actualizaciones del modelo en SageMaker. Discutimos los siguientes métodos de cambio de tráfico en esta publicación:

- Todo a la vez cambiando el tráfico – El 100 % del tráfico de su terminal se transfiere de su flota azul a su flota verde después de que la flota verde esté disponible. Usamos alarmas in Reloj en la nube de Amazon que controlan su flota verde durante un tiempo determinado (el período de horneado) y, si no se activa ninguna alarma, SageMaker elimina la flota azul después del período de cocción.

- Cambio de tráfico canario – Su flota verde está expuesta primero a una proporción más pequeña de su tráfico (un canario) y validado por cualquier problema al usar las alarmas de CloudWatch durante un período de cocción mientras la flota azul sigue recibiendo la mayor parte del tráfico de punto final. Una vez que se valida la flota verde, todo el tráfico se transfiere a la nueva flota y SageMaker elimina la flota azul.

- Cambio de tráfico lineal azul/verde barandilla – Cambia gradualmente el tráfico de su flota azul a su flota verde en un enfoque escalonado. Luego, su modelo se monitorea con alarmas de CloudWatch durante un período de cocción en cada paso antes de que la flota azul se reemplace por completo.

Esta publicación se enfoca en describir arquitecturas que utilizan las características de SageMaker MLOps para realizar implementaciones controladas de modelos a través de las medidas de seguridad de implementación y las estrategias de prueba de modelado que hemos enumerado. Para obtener información general sobre estos patrones, consulte Aproveche las estrategias de implementación avanzadas con las medidas de seguridad de implementación de Amazon SageMaker y Barandillas de despliegue.

Implementar un modelo con SageMaker

SageMaker ofrece una amplia gama de opciones de despliegue que varían desde baja latencia y alto rendimiento hasta trabajos de inferencia de larga duración. Estas opciones incluyen consideraciones para procesamiento por lotes, en tiempo real o inferencia casi en tiempo real. Cada opción ofrece diferentes funciones avanzadas, como la capacidad de ejecutar varios modelos en un solo punto final. Sin embargo, como se mencionó anteriormente, para esta publicación, solo cubrimos los patrones de implementación de MLOps utilizando puntos finales de modelo único. Para profundizar en las funciones de implementación de SageMaker más avanzadas para la inferencia en tiempo real, consulte Patrones de hospedaje de modelos en Amazon SageMaker, Parte 2: Introducción a la implementación de modelos en tiempo real en SageMaker.

Para comprender la implementación de patrones de implementación avanzados mediante canalizaciones de entrega continua (CD), analicemos primero un concepto clave dentro de SageMaker llamado variantes de modelo.

Variantes del modelo de SageMaker

Las variantes del modelo le permiten implementar varias versiones de su modelo en el mismo punto final para probar su modelo. Las variantes del modelo se implementan en instancias separadas, por lo que no hay impacto en otras variantes cuando se actualiza una. En SageMaker, las variantes del modelo se implementan como variantes de producción y sombra.

Variantes de producción le permite realizar pruebas A/B de varias versiones de su modelo para comparar su rendimiento. En este escenario, todas las versiones de su modelo devuelven respuestas a las solicitudes del modelo. El tráfico de su punto final se distribuye entre las variantes existentes, ya sea por distribución de tráfico, donde asigna un peso para cada variante, o por variante de destino, donde un determinado parámetro (por ejemplo, región o mercado) decide qué modelo se debe invocar.

Variantes de sombra le permite probar una nueva versión de su modelo. En este escenario, su modelo tiene una variante de producción y una variante de sombra implementadas en paralelo al mismo punto final. La variante oculta recibe el tráfico de datos completo (o muestreado) desde su terminal. Sin embargo, solo las predicciones de las variantes de producción se devuelven a los usuarios de su aplicación y las predicciones de las variantes ocultas se registran para su análisis. Debido a que las variantes ocultas se lanzan en instancias separadas de la variante de producción, no hay impacto en el rendimiento de su variante de producción en esta prueba. Con esta opción, está probando el nuevo modelo y minimizando los riesgos de un modelo de bajo rendimiento, y puede comparar el rendimiento de ambos modelos con los mismos datos.

Barandillas de implementación de SageMaker

Los guardarraíles son una parte esencial del desarrollo de software. Protegen su aplicación y minimizan el riesgo de implementación de una nueva versión de su aplicación. Del mismo modo, las medidas de seguridad de implementación de SageMaker le permiten cambiar de una versión de modelo a otra de forma controlada. A partir de diciembre de 2022, las medidas de seguridad de SageMaker ofrecen opciones de implementación de cambio de tráfico azul/verde, canario y lineal. Cuando se combinan con las variantes del modelo, las barreras de protección de despliegue se pueden aplicar tanto a las variantes de producción como a las sombras de su modelo, lo que garantiza que no haya tiempo de inactividad durante la actualización de una nueva variante, con el control de los cambios de tráfico de acuerdo con la opción seleccionada.

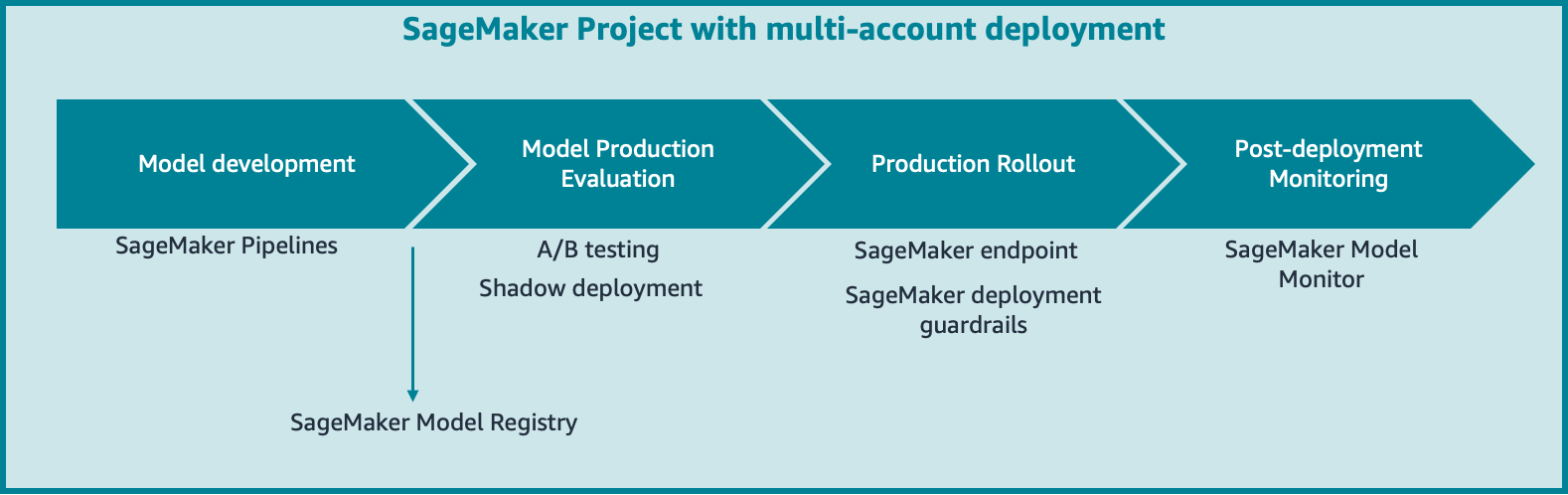

Fundamentos de MLOps para la implementación de modelos

En el contexto más amplio de un flujo de trabajo de creación e implementación de modelos de ML, queremos emplear prácticas de CI/CD diseñadas específicamente para el flujo de trabajo de ML. Al igual que los sistemas CI/CD tradicionales, queremos automatizar las pruebas de software, las pruebas de integración y las implementaciones de producción. Sin embargo, también debemos incluir operaciones específicas en torno al ciclo de vida de ML que no están presentes en el ciclo de vida de desarrollo de software tradicional, como el entrenamiento de modelos, la experimentación de modelos, las pruebas de modelos y la supervisión de modelos.

Para lograr esas capacidades específicas de ML, se agregan al proceso de implementación de modelos bases de MLOps, como pruebas de modelo automatizadas, medidas de seguridad de implementación, implementaciones de múltiples cuentas y reversión de modelo automatizada. Esto garantiza que las capacidades ya descritas permitan la prueba del modelo y eviten el tiempo de inactividad durante el proceso de actualización del modelo. También proporciona la confiabilidad y la trazabilidad necesarias para la mejora continua de un modelo listo para producción. Además, capacidades como la capacidad de empaquetar soluciones existentes en plantillas reutilizables e implementar modelos en una configuración de múltiples cuentas aseguran la escalabilidad de los patrones de implementación de modelos discutidos en la publicación a varios modelos en una organización.

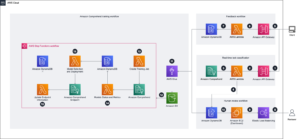

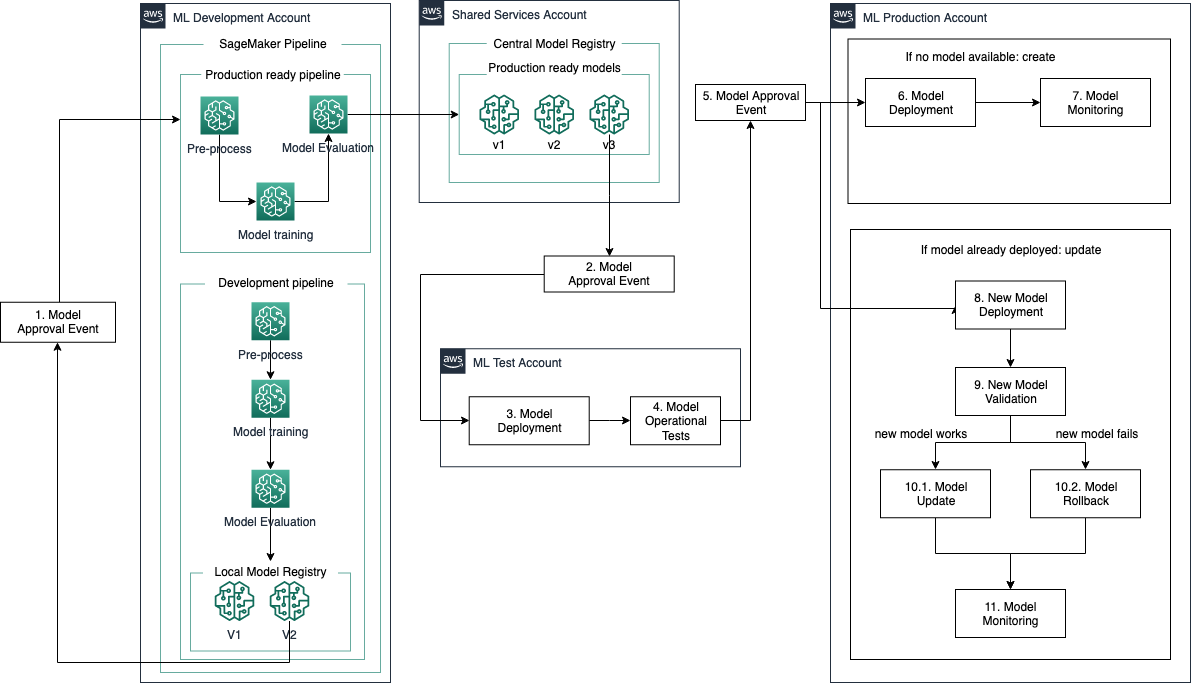

La siguiente figura muestra un patrón común para la conexión de las capacidades de SageMaker para crear una canalización de desarrollo e implementación de modelos de un extremo a otro. En este ejemplo, se desarrolla un modelo en SageMaker utilizando Empleos de Procesamiento de SageMaker para ejecutar código de procesamiento de datos que se utiliza para preparar datos para un algoritmo de ML. Empleos de Capacitación de SageMaker luego se usan para entrenar un modelo de ML en los datos producidos por el trabajo de procesamiento. Los artefactos del modelo y los metadatos asociados se almacenan en el Registro de modelos de SageMaker como último paso del proceso de formación. Esto es orquestado por Tuberías de SageMaker, que es un servicio de CI/CD especialmente diseñado para ML que ayuda a automatizar y administrar los flujos de trabajo de ML a escala.

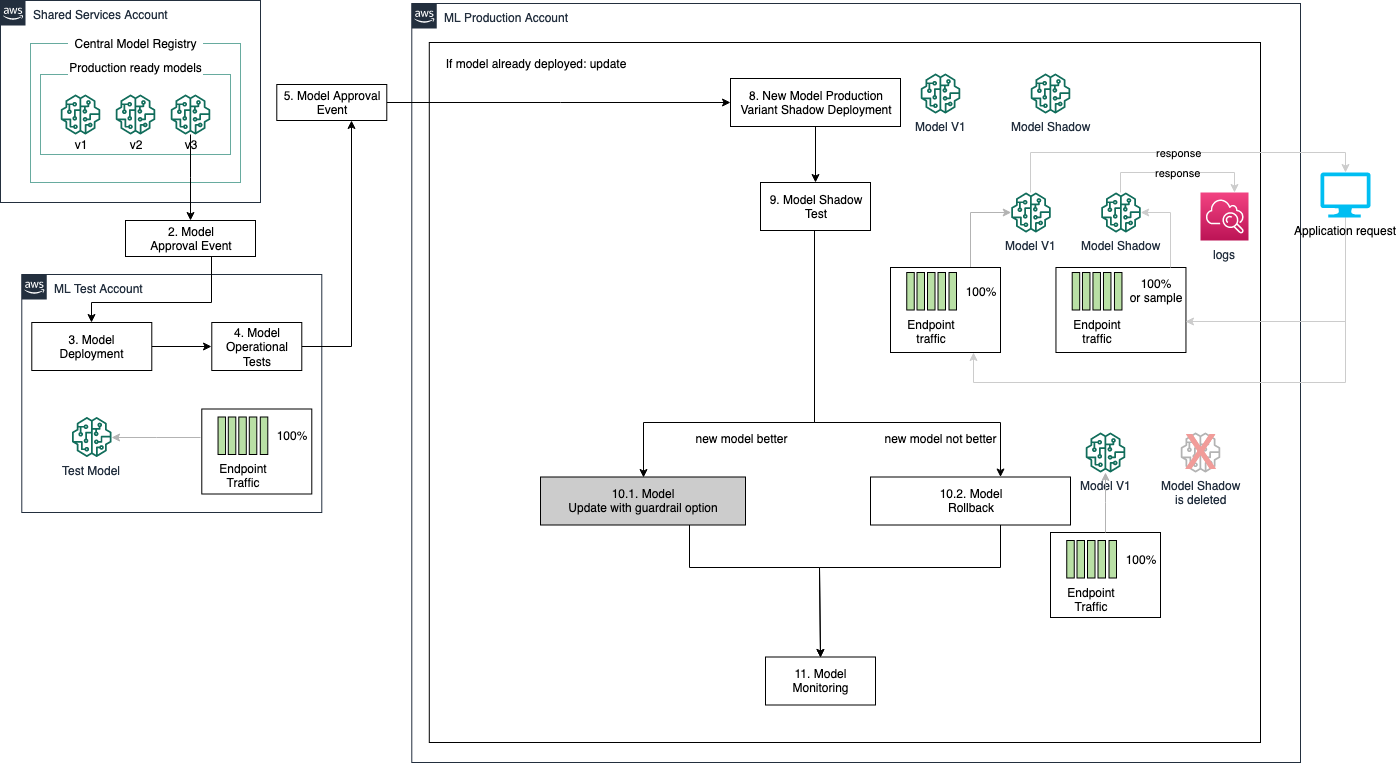

Una vez que se aprueba el modelo, se prueba en producción con una prueba A/B o una implementación en la sombra. Una vez que el modelo se valida en producción, usamos el registro del modelo para aprobar el modelo para la implementación de producción en un extremo de SageMaker mediante una de las opciones de medidas de seguridad de implementación.

Cuando se completa el proceso de actualización del modelo, Monitor modelo SageMaker supervisa continuamente el rendimiento del modelo en busca de desviaciones en el modelo y la calidad de los datos. Este proceso está automatizado para múltiples casos de uso utilizando Proyecto SageMaker plantillas que asignan la implementación de la infraestructura a una configuración de varias cuentas para garantizar el aislamiento completo de los recursos y un control de costos más sencillo.

Patrones de implementación de punto final de modelo único

Al implementar modelos en un entorno de producción por primera vez, no tiene un modelo en ejecución con el que comparar, y el modelo implementado será el que usará su aplicación comercial. Después de implementar y monitorear el modelo en un entorno de producción, es posible que desee actualizar el modelo, ya sea de forma regular o bajo demanda, cuando haya nuevos datos disponibles o cuando se detecte una brecha de rendimiento en su modelo. Al actualizar un modelo existente, desea asegurarse de que el nuevo modelo funcione mejor que el actual y pueda manejar el tráfico de solicitudes de predicción de sus aplicaciones comerciales. Durante este período de validación, desea que el modelo actual siga estando disponible para una posible reversión a fin de minimizar el riesgo de tiempo de inactividad de sus aplicaciones.

En una imagen de desarrollo de modelos más amplia, los modelos generalmente se entrenan en una cuenta de desarrollo de ciencia de datos. Esto incluye flujos de trabajo de experimentación que se usan a menudo en el desarrollo de modelos, así como flujos de trabajo de reentrenamiento que se usan en canalizaciones listas para producción. Todos los metadatos de estos experimentos se pueden rastrear usando Experimentos de Amazon SageMaker durante el desarrollo. Una vez que el flujo de trabajo se incorpora a una canalización para su uso en producción, los metadatos se rastrean automáticamente a través de SageMaker Pipelines. Para realizar un seguimiento de los modelos de producción viables en un solo lugar, después de que la experimentación haya llevado las métricas de rendimiento de un modelo (precisión, recuperación, etc.) a un nivel aceptable para la producción, un paso de condición en la canalización de SageMaker permite que el modelo se registre en el registro de modelos.

El registro de modelo le permite desencadenar la implementación de este modelo con un proceso de aprobación manual o automatizado. Esta implementación se lleva a cabo en una cuenta de prueba de ML donde se pueden realizar pruebas operativas, como pruebas de integración, pruebas unitarias, latencia del modelo y cualquier validación de modelo adicional con respecto a la nueva versión del modelo. Tenga en cuenta que las pruebas A/B y shadow testing no se realizan en la cuenta de prueba de ML, sino en la cuenta de producción de ML.

Una vez que el modelo supera todas las validaciones en la cuenta de prueba, está listo para implementarse en un entorno de producción. Un nuevo proceso de aprobación desencadena esta implementación, y las medidas de seguridad de la implementación de SageMaker permiten una liberación controlada y un proceso transparente de actualización del modelo de acuerdo con el modo de cambio de tráfico seleccionado.

El siguiente diagrama ilustra la arquitectura de esta solución.

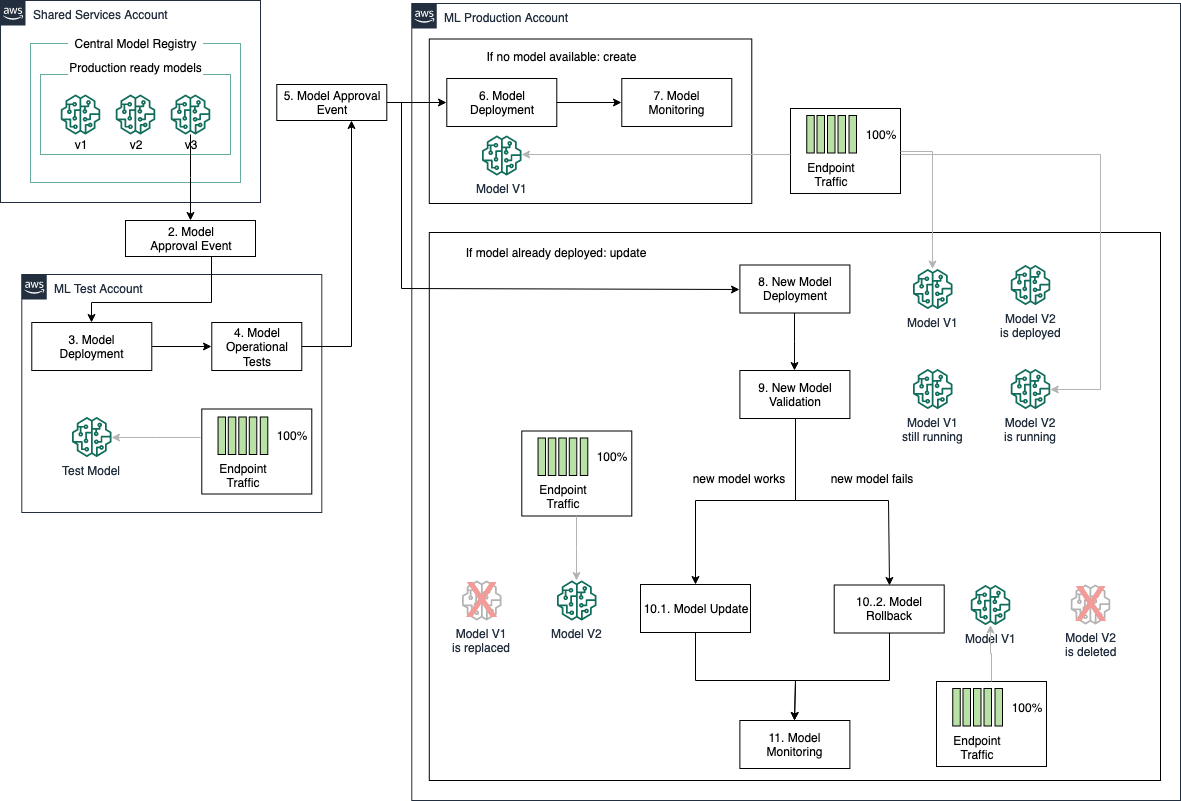

Todo a la vez cambiando el tráfico

La todo a la vez modo de cambio de tráfico le permite actualizar una nueva versión del modelo (flota verde) cambiando completamente el 100% del tráfico de su modelo actual (flota azul) a su nuevo modelo. Con esta opción, puede configurar un período de cocción durante el cual ambas versiones de su modelo aún se están ejecutando, y puede retroceder rápida y automáticamente a la versión actual si su nuevo modelo no funciona como se esperaba. La desventaja de esta opción es que todo su tráfico de datos se ve afectado a la vez, por lo que si hay un problema con la implementación de su modelo, todos los usuarios que usan la aplicación durante el proceso de implementación se ven afectados. La siguiente arquitectura muestra cómo la opción de cambio de tráfico todo a la vez maneja las actualizaciones del modelo.

El cambio de tráfico de una sola vez se puede incorporar a sus herramientas de MLOps definiendo una configuración de implementación de punto final con AzulVerdeActualizarPolítica establecido en ALL_AT_ONCE. En su canalización de MLOps, después de que se aprueba un nuevo modelo para su implementación en la cuenta de producción de ML, SageMaker verifica si el extremo de su modelo ya existe. Si es así, el ALL_AT_ONCE La configuración activa una actualización de punto final que sigue la arquitectura. La reversión de su punto final se controla en función de Alarmas de CloudWatch definido por su punto final AutoRollbackConfiguration, que, cuando se activa, inicia automáticamente la reversión del modelo a la versión actual del modelo.

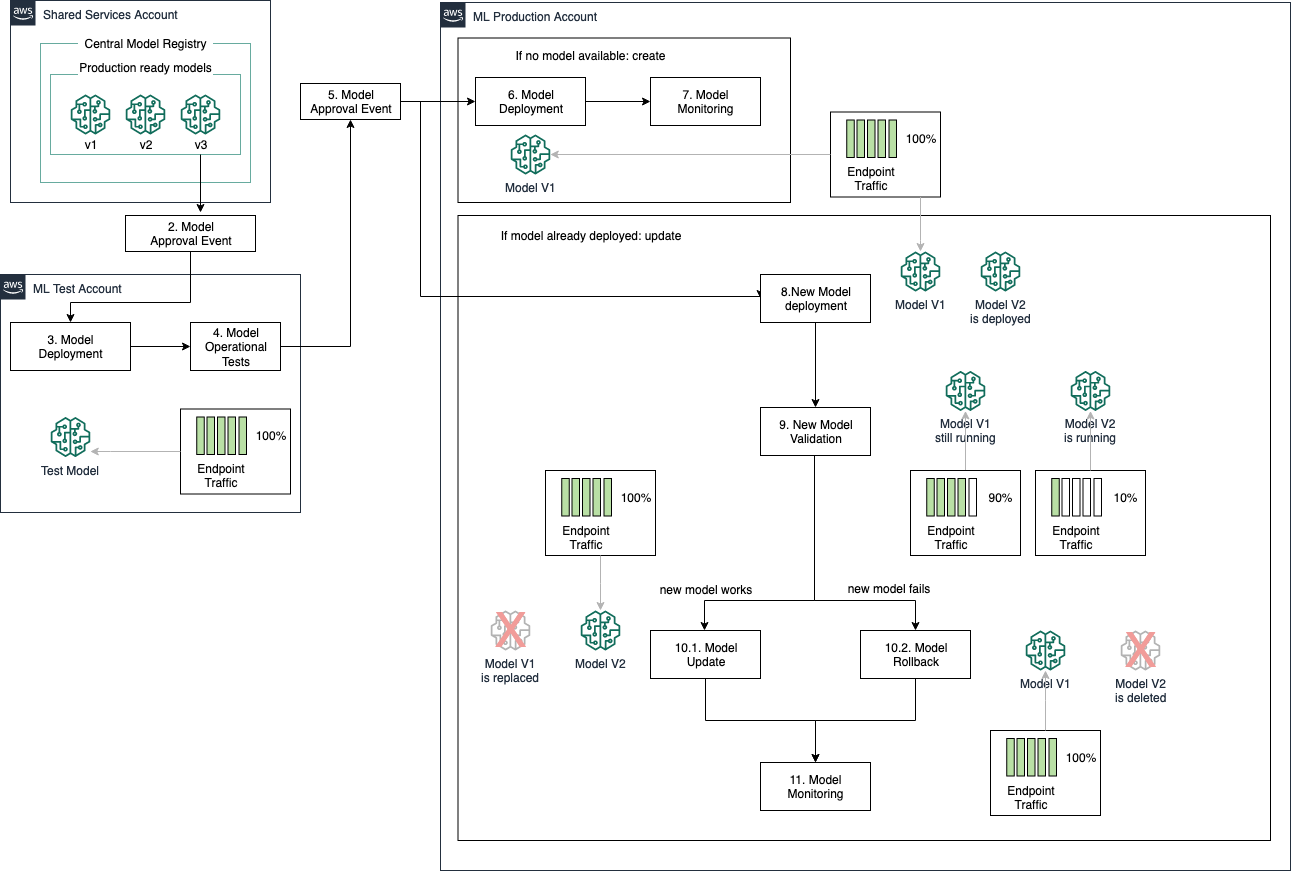

Cambio de tráfico canario

La cambio de tráfico canario El modo le permite probar su nuevo modelo (flota verde) con una pequeña porción del tráfico de datos antes de actualizar el modelo en ejecución (flota azul) a la nueva versión o revertir la nueva versión, según el resultado de las pruebas canarias. La parte del tráfico que se utiliza para probar el nuevo modelo se denomina canario y, en esta opción, el riesgo de un nuevo modelo problemático se minimiza en el tráfico canario, mientras que el tiempo de actualización aún se minimiza.

Las implementaciones Canary le permiten minimizar el riesgo de implementar una nueva versión del modelo al exponer la nueva versión del modelo a un grupo más pequeño de usuarios para monitorear la efectividad durante un período de tiempo. La desventaja es administrar varias versiones durante un período de tiempo que permite recopilar métricas de rendimiento lo suficientemente significativas como para determinar el impacto en el rendimiento. El beneficio es la capacidad de aislar el riesgo a un grupo más pequeño de usuarios.

El cambio de tráfico canario se puede incorporar a sus herramientas de MLOps definiendo una configuración de implementación de punto final con un AzulVerdeActualizarPolítica establecido en CANARY y definiendo el CanarySize para determinar qué parte del tráfico de su terminal debe redirigirse a una nueva versión del modelo. De manera similar a la opción de todo a la vez, en su canalización de MLOps, después de que se aprueba un nuevo modelo para su implementación en la cuenta de producción de ML, SageMaker verifica si el extremo de su modelo ya existe. Si es así, el CANARY La configuración activa una actualización de punto final que sigue la arquitectura descrita en el siguiente diagrama. La reversión de su punto final se controla en función de las alarmas de CloudWatch definidas por su punto final AutoRollbackConfiguration que, cuando se activa, inicia automáticamente la reversión del modelo a la versión actual del modelo. Los tipos de alarma útiles para implementar aquí son 500 códigos de estado y latencia del modelo; sin embargo, esta configuración de alarma debe personalizarse para su caso de uso comercial específico y tecnología ML.

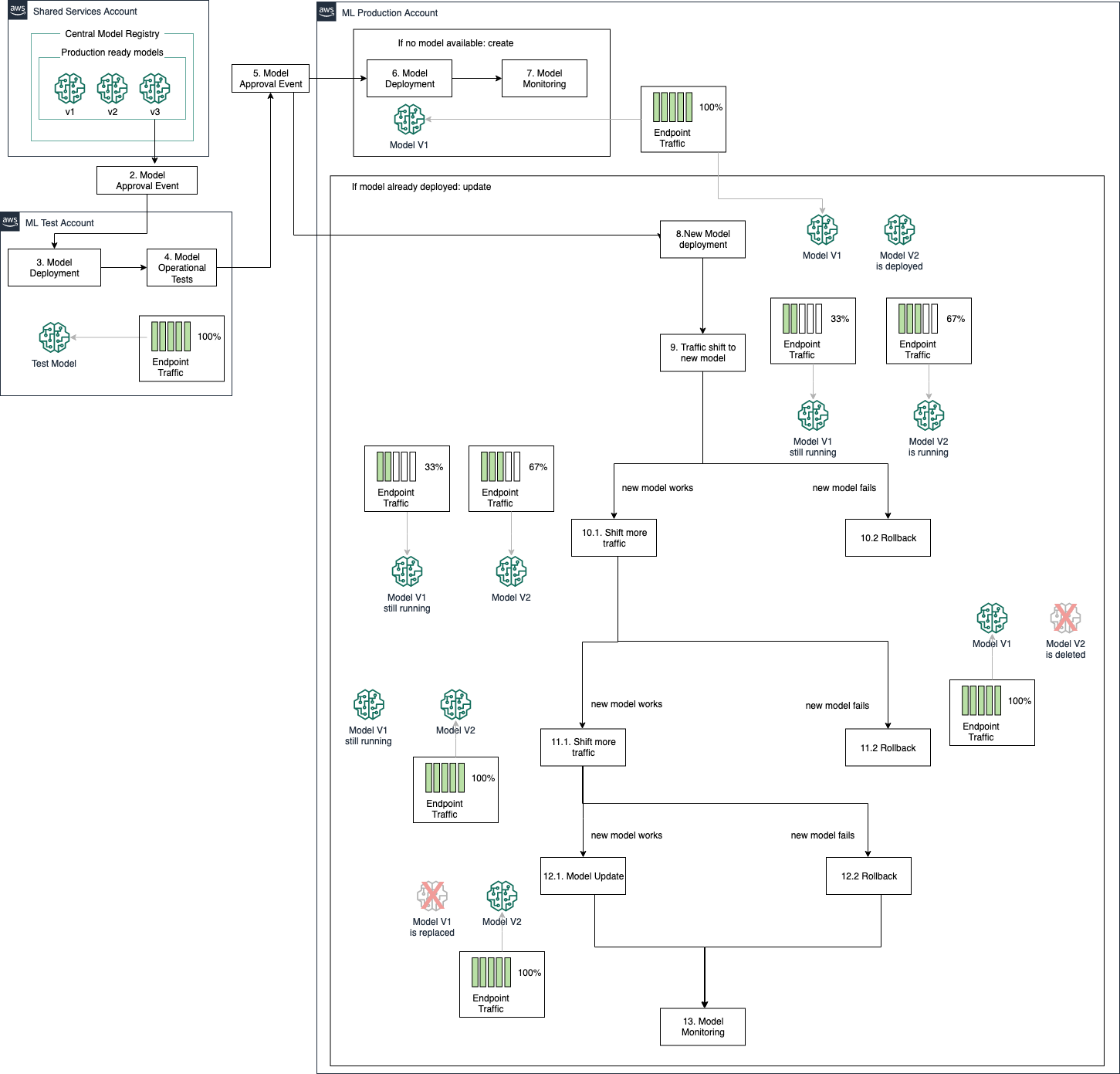

Cambio de tráfico lineal

En cambio de tráfico lineal modelo, cambia gradualmente el tráfico de su modelo actual (flota azul) a su nueva versión del modelo (flota verde) aumentando el tráfico de datos enviado al nuevo modelo en pasos. De esta forma, la proporción de tráfico utilizada para probar la nueva versión de su modelo aumenta gradualmente con cada paso, y un tiempo de cocción para cada paso garantiza que su modelo siga operativo con el nuevo tráfico. Con esta opción, minimiza el riesgo de implementar un modelo de bajo rendimiento y expone gradualmente el nuevo modelo a más tráfico de datos. La desventaja de este enfoque es que su tiempo de actualización es más largo y aumentan los costos de ejecutar ambos modelos en paralelo.

El cambio de tráfico lineal se puede incorporar a sus herramientas de MLOps definiendo una configuración de implementación de punto final con BlueGreenUpdatePolicy establecido en LINEAR y definiendo el LinearStepSize para determinar cuánto de su tráfico debe redirigirse a un nuevo modelo en cada paso. De manera similar a la opción de todo a la vez, en su canalización de MLOps, después de que se aprueba un nuevo modelo para su implementación en la cuenta de producción de ML, SageMaker verifica si el extremo de su modelo ya existe. Si es así, el LINEAR La configuración activa una actualización de punto final que sigue la arquitectura indicada en el siguiente diagrama. La reversión de su punto final se controla en función de las alarmas de CloudWatch definidas por su punto final AutoRollbackConfiguration que, cuando se activa, inicia automáticamente la reversión del modelo a la versión actual del modelo.

Patrones de implementación con variantes de producción de modelos

Independientemente del patrón de implementación que elija para su aplicación, también puede utilizar variantes de producción para validar el rendimiento de su modelo antes de actualizar su punto final o implementar patrones de implementación adicionales, como implementaciones ocultas. En este caso, desea agregar un proceso manual o automatizado para seleccionar el mejor modelo que se implementará antes de actualizar su punto final. La siguiente arquitectura muestra cómo se comportan el tráfico y la respuesta de su terminal en un escenario de implementación en la sombra. En este escenario, cada solicitud de predicción se envía tanto a los modelos nuevos como a los implementados; sin embargo, solo el modelo implementado actualmente proporciona la respuesta de predicción a la aplicación comercial, mientras que la predicción proporcionada desde el nuevo modelo se mantiene solo para el análisis del rendimiento en comparación con el modelo implementado actualmente. Después de evaluar el rendimiento del modelo, la nueva versión del modelo se puede implementar para dar servicio al tráfico de respuesta de predicción a las aplicaciones comerciales.

Rollback

Independientemente de la estrategia de implementación que elija para la implementación de su modelo, desea poder retroceder a la versión anterior del modelo si el rendimiento de su nuevo modelo es inferior al rendimiento de su modelo actual. Para hacerlo y minimizar el tiempo de inactividad de su aplicación, debe mantener su modelo actual ejecutándose en paralelo con el nuevo hasta que esté seguro de que su nuevo modelo funciona mejor que el actual.

Las medidas de seguridad de implementación de SageMaker le permiten configurar alarmas y retroceder automáticamente a versiones anteriores del modelo durante el período de validación del modelo. Una vez que finaliza el período de validación, es posible que aún deba volver a una versión anterior del modelo para resolver un nuevo problema que se descubre después de que se completa la actualización del modelo. Para hacerlo, puede aprovechar el registro modelo de SageMaker para modelos rechazados y aprobados y desencadenar un proceso de reversión.

Conclusión

En esta publicación, aprendió a combinar las variantes del modelo de punto final de SageMaker y las medidas de seguridad de implementación con las capacidades de MLOps para crear patrones integrales para el desarrollo del modelo. Brindamos una implementación de ejemplo para las medidas de seguridad de implementación de cambio canario y lineal conectadas con las canalizaciones de SageMaker y el registro modelo a través de un proyecto personalizado de SageMaker. Como siguiente paso, intente adaptar el siguiente plantilla para implementar la estrategia de despliegue de su organización.

Referencias

Sobre los autores

Maira Ladeira Tanke es un arquitecto de soluciones especialista en ML en AWS. Con experiencia en ciencia de datos, tiene 9 años de experiencia en la arquitectura y creación de aplicaciones ML con clientes de todas las industrias. Como líder técnica, ayuda a los clientes a acelerar su logro de valor comercial a través de tecnologías emergentes y soluciones innovadoras. En su tiempo libre, a Maira le gusta viajar y pasar tiempo con su familia en un lugar cálido.

Maira Ladeira Tanke es un arquitecto de soluciones especialista en ML en AWS. Con experiencia en ciencia de datos, tiene 9 años de experiencia en la arquitectura y creación de aplicaciones ML con clientes de todas las industrias. Como líder técnica, ayuda a los clientes a acelerar su logro de valor comercial a través de tecnologías emergentes y soluciones innovadoras. En su tiempo libre, a Maira le gusta viajar y pasar tiempo con su familia en un lugar cálido.

arcilla elmore es un arquitecto de soluciones especializado en IA/ML en AWS. Después de pasar muchas horas en un laboratorio de investigación de materiales, su experiencia en ingeniería química rápidamente quedó atrás para dedicarse a su interés en el aprendizaje automático. Ha trabajado en aplicaciones ML en muchas industrias diferentes, desde el comercio de energía hasta el marketing hotelero. Clay tiene un interés especial en llevar las prácticas de desarrollo de software a ML y guiar a los clientes hacia soluciones repetibles y escalables mediante el uso de estos principios. En su tiempo libre, a Clay le gusta esquiar, resolver cubos de Rubik, leer y cocinar.

arcilla elmore es un arquitecto de soluciones especializado en IA/ML en AWS. Después de pasar muchas horas en un laboratorio de investigación de materiales, su experiencia en ingeniería química rápidamente quedó atrás para dedicarse a su interés en el aprendizaje automático. Ha trabajado en aplicaciones ML en muchas industrias diferentes, desde el comercio de energía hasta el marketing hotelero. Clay tiene un interés especial en llevar las prácticas de desarrollo de software a ML y guiar a los clientes hacia soluciones repetibles y escalables mediante el uso de estos principios. En su tiempo libre, a Clay le gusta esquiar, resolver cubos de Rubik, leer y cocinar.

Shelbee Eigen Brode es Arquitecto Principal de Soluciones Especializado en Inteligencia Artificial y Aprendizaje Automático en AWS. Ha estado en tecnología durante 24 años, abarcando múltiples industrias, tecnologías y roles. Actualmente se está enfocando en combinar su experiencia en DevOps y ML en el dominio de MLOps para ayudar a los clientes a entregar y administrar cargas de trabajo de ML a escala. Con más de 35 patentes otorgadas en varios dominios tecnológicos, le apasiona la innovación continua y el uso de datos para impulsar los resultados comerciales. Shelbee es cocreadora e instructora de la especialización en Ciencias prácticas de datos en Coursera. También es codirectora de Women In Big Data (WiBD), capítulo de Denver. En su tiempo libre, le gusta pasar tiempo con su familia, amigos y perros hiperactivos.

Shelbee Eigen Brode es Arquitecto Principal de Soluciones Especializado en Inteligencia Artificial y Aprendizaje Automático en AWS. Ha estado en tecnología durante 24 años, abarcando múltiples industrias, tecnologías y roles. Actualmente se está enfocando en combinar su experiencia en DevOps y ML en el dominio de MLOps para ayudar a los clientes a entregar y administrar cargas de trabajo de ML a escala. Con más de 35 patentes otorgadas en varios dominios tecnológicos, le apasiona la innovación continua y el uso de datos para impulsar los resultados comerciales. Shelbee es cocreadora e instructora de la especialización en Ciencias prácticas de datos en Coursera. También es codirectora de Women In Big Data (WiBD), capítulo de Denver. En su tiempo libre, le gusta pasar tiempo con su familia, amigos y perros hiperactivos.

qiyun zhao es ingeniero sénior de desarrollo de software en el equipo de la plataforma de inferencia de Amazon SageMaker. Es el desarrollador principal de las medidas de protección de implementación y las implementaciones ocultas, y se enfoca en ayudar a los clientes a administrar cargas de trabajo e implementaciones de ML a escala con alta disponibilidad. También trabaja en la evolución de la arquitectura de la plataforma para la implementación rápida y segura de trabajos de ML y la ejecución de experimentos en línea de ML con facilidad. En su tiempo libre, le gusta leer, jugar y viajar.

qiyun zhao es ingeniero sénior de desarrollo de software en el equipo de la plataforma de inferencia de Amazon SageMaker. Es el desarrollador principal de las medidas de protección de implementación y las implementaciones ocultas, y se enfoca en ayudar a los clientes a administrar cargas de trabajo e implementaciones de ML a escala con alta disponibilidad. También trabaja en la evolución de la arquitectura de la plataforma para la implementación rápida y segura de trabajos de ML y la ejecución de experimentos en línea de ML con facilidad. En su tiempo libre, le gusta leer, jugar y viajar.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- Platoblockchain. Inteligencia del Metaverso Web3. Conocimiento amplificado. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/mlops-deployment-best-practices-for-real-time-inference-model-serving-endpoints-with-amazon-sagemaker/

- 100

- 2022

- 7

- 9

- a

- capacidad

- Poder

- acelerar

- aceptable

- Conforme

- Mi Cuenta

- Contabilidad

- Lograr

- logro

- a través de

- adicional

- adición

- Adicionales

- Adicionalmente

- avanzado

- Ventaja

- Después

- en contra

- AI

- AI / ML

- alarma

- algoritmo

- Todos

- permite

- ya haya utilizado

- Amazon

- Amazon SageMaker

- cantidad

- análisis

- y

- Otra

- Aplicación

- aplicaciones

- aplicada

- enfoque

- aprobación

- aprobar

- aprobado

- arquitectura

- en torno a

- aspectos

- asociado

- automatizado

- Confirmación de Viaje

- automáticamente

- disponibilidad

- Hoy Disponibles

- AWS

- Atrás

- fondo

- basado

- base

- porque

- se convierte en

- antes

- detrás de

- "Ser"

- es el beneficio

- MEJOR

- y las mejores prácticas

- mejores

- entre

- Big

- Big Data

- Azul

- Trayendo

- general

- más amplio

- Traído

- build

- Construir la

- construido

- Aplicaciones empresariales

- , que son

- capacidades

- case

- cases

- CD

- a ciertos

- el cambio

- cambio

- Capítulo

- Cheques

- químico

- la elección de

- eligió

- cerrado

- código

- combinar

- combinado

- combinar

- Algunos

- comparar

- completar

- completamente

- concepto

- seguros

- Configuración

- conectado

- conexión

- Considerar

- consideraciones

- que no contengo

- contexto

- continuamente

- continuo

- continuamente

- control

- controlado

- Cost

- Precio

- Protectora

- cubierto

- Para crear

- Current

- En la actualidad

- personalizado

- Clientes

- se adaptan

- datos

- proceso de datos

- Ciencia de los datos

- Diciembre

- Toma de Decisiones

- Predeterminado

- se define

- definir

- entregamos

- entrega

- Demanda

- demuestra

- Denver

- Dependiente

- desplegar

- desplegado

- Desplegando

- despliegue

- Despliegues

- descrito

- detectado

- Determinar

- desarrollado

- Developer

- Desarrollo

- una experiencia diferente

- directamente

- descubierto CRISPR

- discutir

- discutido

- distribuidos

- distribuido

- No

- dominio

- dominios

- No

- Abajo

- el tiempo de inactividad

- el lado de la transmisión

- durante

- cada una

- más fácil

- pasan fácilmente

- eficacia

- ya sea

- emergentes

- habilitar

- de extremo a extremo

- Punto final

- energía

- ingeniero

- Ingeniería

- suficientes

- garantizar

- asegura

- asegurando que

- Entorno

- esencial

- evaluar

- evaluado

- evoluciones

- ejemplo

- existente

- existe

- esperado

- experience

- explorar

- expuesto

- familia

- RÁPIDO

- Caracteristicas

- realimentación

- Figura

- Nombre

- primer vez

- FLOTA

- se centra

- enfoque

- siguiendo

- siguiente

- Fundamentos

- Marco conceptual

- Gratis

- amigos

- Desde

- ser completados

- a la fatiga

- funciones

- promover

- juego de azar

- brecha

- reunión

- General

- conseguir

- Donar

- dado

- gradualmente

- concedido

- Verde

- Grupo procesos

- encargarse de

- Manijas

- ayuda

- ayudando

- ayuda

- esta página

- Alta

- hospitalidad

- hosting

- HORAS

- Cómo

- Como Hacer

- Sin embargo

- HTML

- HTTPS

- Impacto

- implementar

- implementación

- implementado

- implementación

- es la mejora continua

- in

- incluir

- incluye

- Incluye

- Incorporado

- aumentado

- Los aumentos

- creciente

- industrias

- información

- EN LA MINA

- Innovation

- originales

- ejemplo

- integrar

- Integración

- integración

- intereses

- Introducción

- solo

- cuestiones

- IT

- Trabajos

- Empleo

- Guardar

- Clave

- el lab

- Apellidos

- Estado latente

- lanzado

- Lead

- aprendido

- aprendizaje

- Nivel

- ciclo de vida

- Listado

- para vivir

- por más tiempo

- Baja

- máquina

- máquina de aprendizaje

- mantener

- gestionan

- Management

- administrar

- manual

- muchos

- cartografía

- Mercado

- Marketing

- materiales

- Maximizar

- significativo

- mecanismo

- mencionado

- metadatos

- métodos

- métrico

- Métrica

- podría

- minimizando

- ML

- MLOps

- Moda

- modelo

- Pruebas de modelo

- modelos

- Monitorear

- monitoreado

- monitoreo

- monitores

- más,

- MEJOR DE TU

- múltiples

- Naturaleza

- necesario

- ¿ Necesita ayuda

- Nuevo

- Next

- Ofertas

- ONE

- en línea

- operativos.

- Operaciones

- óptimo

- Optión

- Opciones

- solicite

- organización

- Otro

- Resultado

- esbozado

- paquete

- Paralelo

- parámetro

- parte

- pasa

- pasión

- Okeanos

- Patrón de Costura

- .

- Realizar

- actuación

- realiza

- período

- imagen

- industrial

- Colocar

- plataforma

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- posible

- Publicación

- Metodología

- prácticas

- Precisión

- predicción

- Predicciones

- Preparar

- presente

- anterior

- previamente

- Director de la escuela

- principios

- Problema

- tratamiento

- producido

- Producción

- proyecto

- proyecta

- propuesto

- proteger

- proporcionar

- previsto

- proporciona un

- propósito

- poner

- calidad

- con rapidez

- distancia

- que van

- Reading

- ready

- real

- en tiempo real

- recibe

- aprovecha

- recomendado

- región

- registrado

- registro

- regular

- ,

- fiabilidad

- confianza

- repetible

- reemplazados

- solicita

- solicitudes

- la investigación

- Recurso

- respuesta

- volvemos

- reutilizables

- Riesgo

- riesgos

- También soy miembro del cuerpo docente de World Extreme Medicine (WEM) y embajadora europea de igualdad para The Transformational Travel Council (TTC). En mi tiempo libre, soy una incansable aventurera, escaladora, patrona de día, buceadora y defensora de la igualdad de género en el deporte y la aventura. En XNUMX, fundé Almas Libres, una ONG nacida para involucrar, educar y empoderar a mujeres y niñas a través del deporte urbano, la cultura y la tecnología.

- Rodar

- Rolling

- Ejecutar

- correr

- sabio

- Inferencia de SageMaker

- Tuberías de SageMaker

- mismo

- satisfecho

- Satisfecho con

- Escalabilidad

- escalable

- Escala

- guión

- escenarios

- Ciencia:

- seguro

- seleccionado

- enviando

- mayor

- separado

- sirve

- de coches

- servicio

- set

- ajustes

- Configure

- Varios

- Shadow

- Prueba de sombra

- Turno

- CAMBIANDO

- tienes

- Shows

- significado

- similares

- Del mismo modo

- soltero

- circunstancias

- chica

- menores

- So

- Software

- Desarrollo de software ad-hoc

- a medida

- Soluciones

- RESOLVER

- Resolver

- especial

- especialista

- soluciones y

- pasar

- Gastos

- fundó

- comienza

- estadístico

- Estado

- paso

- pasos

- Sin embargo

- almacenados

- estrategias

- Estrategia

- Subido

- tal

- SOPORTE

- Switch

- Todas las funciones a su disposición

- ¡Prepárate!

- toma

- Target

- equipo

- Técnico

- Tecnologías

- Tecnología

- plantillas

- test

- Pruebas

- pruebas

- La

- su

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- rendimiento

- CORBATA

- equipo

- a

- hacia

- Trazabilidad

- seguir

- Plataforma de

- tradicional

- tráfico

- Entrenar

- entrenado

- Formación

- transparente

- Viajar

- detonante

- desencadenados

- tipos

- típicamente

- entender

- único

- unidad

- Actualizar

- actualizado

- Actualizaciones

- actualización

- utilizan el

- caso de uso

- usuarios

- utilizar

- VALIDAR

- validado

- validación

- propuesta de

- Variante

- diversos

- versión

- vía

- y

- caliente

- peso

- ¿

- Que es

- que

- mientras

- seguirá

- dentro de

- Mujeres

- trabajado

- flujos de trabajo

- funciona

- se

- la escritura

- años

- Usted

- tú

- zephyrnet