Introducción

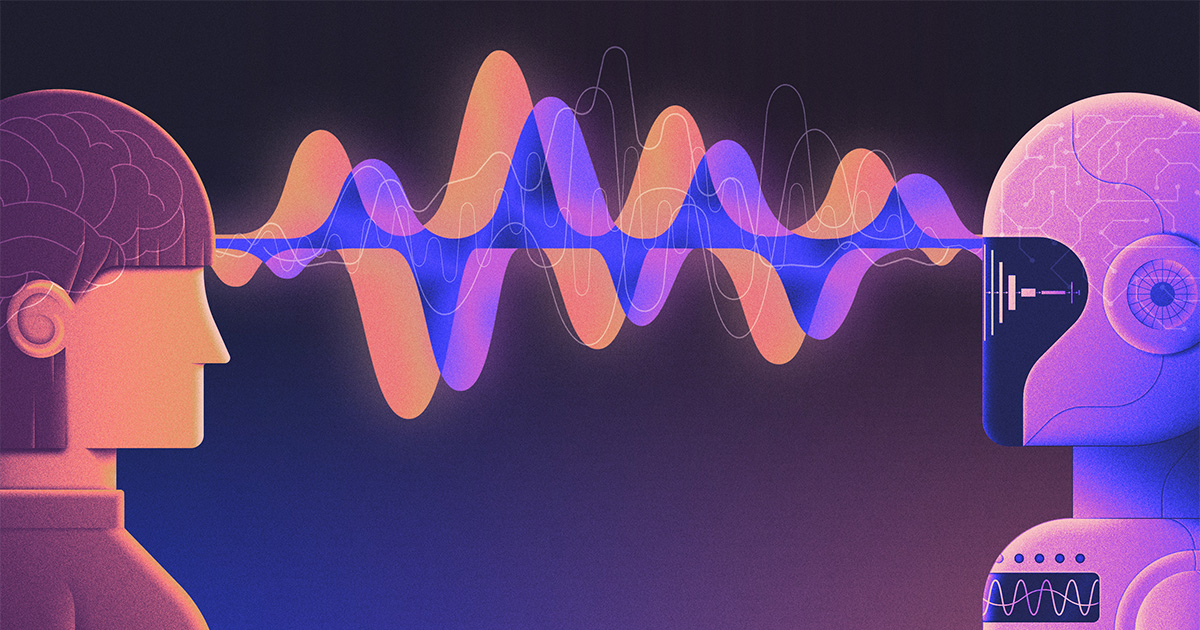

¿Cómo aprenden los cerebros? Es un misterio, que se aplica tanto a los órganos esponjosos de nuestros cráneos como a sus contrapartes digitales en nuestras máquinas. Aunque las redes neuronales artificiales (ANN) se construyen a partir de redes elaboradas de neuronas artificiales, que aparentemente imitan la forma en que nuestros cerebros procesan la información, no sabemos si procesan la entrada de manera similar.

"Ha habido un debate de larga data sobre si las redes neuronales aprenden de la misma manera que lo hacen los humanos", dijo Vsévolod Kapatsinski, lingüista de la Universidad de Oregón.

Ahora, un estudio publicado el mes pasado sugiere que las redes naturales y artificiales aprenden de manera similar, al menos en lo que respecta al lenguaje. Los investigadores, dirigidos por Gasper Beguš, un lingüista computacional de la Universidad de California, Berkeley, comparó las ondas cerebrales de los humanos que escuchan un sonido simple con la señal producida por una red neuronal que analiza el mismo sonido. Los resultados fueron asombrosamente parecidos. "Hasta donde sabemos", escribieron Beguš y sus colegas, las respuestas observadas al mismo estímulo "son las señales cerebrales y ANN más similares reportadas hasta ahora".

Lo más significativo es que los investigadores probaron redes formadas por neuronas de propósito general que son adecuadas para una variedad de tareas. "Muestran que incluso redes muy, muy generales, que no tienen ningún sesgo evolucionado para el habla o cualquier otro sonido, sin embargo muestran una correspondencia con la codificación neuronal humana", dijo. gary lupyan, un psicólogo de la Universidad de Wisconsin, Madison, que no participó en el trabajo. Los resultados no solo ayudan a desmitificar cómo aprenden las ANN, sino que también sugieren que es posible que los cerebros humanos no estén equipados con hardware y software especialmente diseñados para el lenguaje.

Para establecer una línea de base para el lado humano de la comparación, los investigadores tocaron una sola sílaba, "bah", repetidamente en dos bloques de ocho minutos para 14 angloparlantes y 15 hispanohablantes. Mientras se reproducía, los investigadores registraron las fluctuaciones en la actividad eléctrica promedio de las neuronas en el tronco encefálico de cada oyente, la parte del cerebro donde se procesan los sonidos por primera vez.

Además, los investigadores alimentaron los mismos sonidos "bah" a dos conjuntos diferentes de redes neuronales: una entrenada en sonidos en inglés y la otra en español. Luego, los investigadores registraron la actividad de procesamiento de la red neuronal, enfocándose en las neuronas artificiales en la capa de la red donde primero se analizan los sonidos (para reflejar las lecturas del tronco encefálico). Fueron estas señales las que coincidieron estrechamente con las ondas cerebrales humanas.

Los investigadores eligieron un tipo de arquitectura de red neuronal conocida como red antagónica generativa (GAN), inventada originalmente en 2014 para generar imágenes. Una GAN se compone de dos redes neuronales, un discriminador y un generador, que compiten entre sí. El generador crea una muestra, que puede ser una imagen o un sonido. El discriminador determina qué tan cerca está de una muestra de entrenamiento y ofrece retroalimentación, lo que resulta en otro intento del generador, y así sucesivamente hasta que la GAN pueda entregar la salida deseada..

En este estudio, el discriminador fue entrenado inicialmente en una colección de sonidos en inglés o español. Luego, el generador, que nunca escuchó esos sonidos, tuvo que encontrar una manera de producirlos. Comenzó emitiendo sonidos aleatorios, pero después de unas 40,000 rondas de interacciones con el discriminador, el generador mejoró y finalmente produjo los sonidos adecuados. Como resultado de este entrenamiento, el discriminador también mejoró en distinguir entre los reales y los generados.

Fue en este punto, después de que el discriminador estuvo completamente entrenado, que los investigadores tocaron los sonidos "bah". El equipo midió las fluctuaciones en los niveles de actividad promedio de las neuronas artificiales del discriminador, que produjeron la señal tan similar a las ondas cerebrales humanas.

Esta similitud entre los niveles de actividad humana y de la máquina sugirió que los dos sistemas están realizando actividades similares. “Así como la investigación ha demostrado que la retroalimentación de los cuidadores da forma a las producciones de sonidos de los bebés, la retroalimentación de la red discriminadora da forma a las producciones de sonido de la red generadora”, dijo Kapatsinski, quien no participó en el estudio.

El experimento también reveló otro paralelismo interesante entre humanos y máquinas. Las ondas cerebrales mostraron que los participantes de habla inglesa y española escucharon el sonido "bah" de manera diferente (los hispanohablantes escucharon más un "pah"), y las señales de la GAN también mostraron que la red capacitada en inglés procesó los sonidos de manera algo diferente que el de formación española.

“Y esas diferencias funcionan en la misma dirección”, explicó Beguš. El tronco encefálico de los angloparlantes responde al sonido “bah” un poco antes que el tronco encefálico de los hispanohablantes, y el GAN entrenado en inglés respondió al mismo sonido un poco antes que el modelo entrenado en español. Tanto en humanos como en máquinas, la diferencia en el tiempo era casi idéntica, aproximadamente una milésima de segundo. Esto proporcionó evidencia adicional, dijo Beguš, de que los humanos y las redes artificiales "probablemente procesan las cosas de manera similar".

Introducción

Si bien aún no está claro exactamente cómo el cerebro procesa y aprende el lenguaje, el lingüista Noam Chomsky propuso en la década de 1950 que los humanos nacen con una capacidad innata y única para comprender el lenguaje. Esa capacidad, argumentó Chomsky, está literalmente integrada en el cerebro humano.

El nuevo trabajo, que utiliza neuronas de propósito general no diseñadas para el lenguaje, sugiere lo contrario. “El documento definitivamente proporciona evidencia en contra de la noción de que el habla requiere una maquinaria especial incorporada y otras características distintivas”, dijo Kapatsinski.

Beguš reconoce que este debate aún no está zanjado. Mientras tanto, sigue explorando los paralelismos entre el cerebro humano y las redes neuronales probando, por ejemplo, si las ondas cerebrales que provienen de la corteza cerebral (que lleva a cabo el procesamiento auditivo después de que el tronco del encéfalo ha hecho su parte) corresponden a las señales producidas por señales más profundas. capas del GAN.

En última instancia, Beguš y su equipo esperan desarrollar un modelo confiable de adquisición de idiomas que describa cómo las máquinas y los humanos aprenden idiomas, lo que permite experimentos que serían imposibles con sujetos humanos. “Podríamos, por ejemplo, crear un entorno adverso [como el que se ve con los bebés desatendidos] y ver si eso conduce a algo parecido a los trastornos del lenguaje”, dijo. Christina Zhao, neurocientífico de la Universidad de Washington, coautor del nuevo artículo con Beguš y alan zhou, estudiante de doctorado en la Universidad Johns Hopkins.

“Ahora estamos tratando de ver qué tan lejos podemos llegar, qué tan cerca del lenguaje humano podemos estar con las neuronas de propósito general”, dijo Beguš. “¿Podemos llegar a niveles humanos de rendimiento con las arquitecturas computacionales que tenemos, simplemente haciendo que nuestros sistemas sean más grandes y más potentes, o eso nunca será posible?” Si bien se necesita más trabajo antes de que podamos saberlo con certeza, dijo, "estamos sorprendidos, incluso en esta etapa relativamente temprana, por lo similar que parece ser el funcionamiento interno de estos sistemas, humanos y ANN".

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoAiStream. Inteligencia de datos Web3. Conocimiento amplificado. Accede Aquí.

- Acuñando el futuro con Adryenn Ashley. Accede Aquí.

- Compra y Vende Acciones en Empresas PRE-IPO con PREIPO®. Accede Aquí.

- Fuente: https://www.quantamagazine.org/some-neural-networks-learn-language-like-humans-20230522/

- :posee

- :es

- :no

- :dónde

- ][pag

- $ UP

- 000

- 14

- 15%

- 2014

- 40

- a

- capacidad

- actividades

- actividad

- adición

- Adicionales

- adversario

- adverso

- Después

- en contra

- igual

- Permitir

- ya haya utilizado

- también

- an

- el análisis de

- y

- Otra

- cualquier

- Aparecer

- arquitectura

- somos

- argumentó

- artificial

- AS

- At

- promedio

- Base

- BE

- esto

- antes

- Berkeley

- mejores

- entre

- los prejuicios

- más grande

- Bloques

- nacido

- ambas

- Cerebro

- construido

- incorporado

- pero

- by

- California

- PUEDEN

- Puede conseguir

- Capacidad

- eligió

- Cerrar

- de cerca

- Codificación

- personal

- --

- cómo

- proviene

- viniendo

- en comparación con

- comparación

- competir

- compuesto

- podría

- Para crear

- crea

- debate

- más profundo

- que probar definitivamente

- entregamos

- desmitificar

- diseñado

- deseado

- determina

- desarrollar

- HIZO

- un cambio

- diferencias

- una experiencia diferente

- digital

- dirección

- trastornos

- do

- hecho

- No

- cada una

- Más temprano

- Temprano en la

- Etapa temprana

- ya sea

- Elaborar

- interactuando

- Inglés

- Entorno

- equipado

- establecer

- Incluso

- finalmente

- evidencia sólida

- evolucionado

- exactamente

- ejemplo

- experimento

- experimentos

- explicado

- Explorar

- muchos

- Moda

- Caracteristicas

- Fed

- realimentación

- Encuentre

- Nombre

- fluctuaciones del mercado.

- enfoque

- Desde

- completamente

- promover

- General

- propósito general

- generar

- generado

- generativo

- generador

- obtener

- Go

- tenido

- Materiales

- Tienen

- he

- oído

- ayuda

- su

- esperanza

- Cómo

- HTTPS

- humana

- Humanos

- idéntico

- if

- imagen

- imágenes

- imposible

- in

- información

- posiblemente

- innatas

- Las opciones de entrada

- ejemplo

- interacciones

- interesante

- dentro

- inventado

- involucra

- IT

- SUS

- La Universidad Johns Hopkins

- jpg

- solo

- Tipo

- Saber

- especialistas

- conocido

- idioma

- Idiomas

- Apellido

- .

- ponedoras

- Prospectos

- APRENDE:

- menos

- LED

- como

- Escucha Activa

- de larga data

- máquina

- maquinaria

- Máquinas

- hecho

- revista

- Realizar

- emparejado

- Puede..

- Mientras tanto

- espejo

- modelo

- Mes

- más,

- MEJOR DE TU

- Mystery

- Natural

- Naturaleza

- necesario

- del sistema,

- telecomunicaciones

- red neural

- redes neuronales

- Neuronas

- nunca

- sin embargo

- Nuevo

- Noción

- ahora

- of

- Ofertas

- on

- ONE

- las

- , solamente

- or

- Oregón

- originalmente

- Otro

- de otra manera

- nuestros

- salir

- Papel

- Paralelo

- Parallels

- parte

- Participantes

- actuación

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- jugado

- punto

- posible

- poderoso

- Procesado

- en costes

- tratamiento

- producido

- producciones

- apropiado

- propuesto

- previsto

- proporciona un

- azar

- real

- grabado

- relativamente

- confianza

- REPETIDAMENTE

- reportado

- requiere

- la investigación

- investigadores

- parecido a

- respuestas

- resultado

- resultante

- Resultados

- Revelado

- aproximadamente

- rondas

- Said

- mismo

- Segundo

- ver

- visto

- Sets

- Establecido

- formas

- Mostrar

- mostró

- mostrado

- lado

- Signal

- señales

- significativamente

- similares

- sencillos

- soltero

- So

- Software

- algo

- algo

- algo

- Aislamiento de Sonido

- Español

- altavoces

- especial

- especialmente

- habla

- Etapa

- fundó

- Sin embargo

- estímulo

- Estudiante

- ESTUDIO

- sugieren

- Sugiere

- adecuado

- sorprendido

- Todas las funciones a su disposición

- ¡Prepárate!

- tareas

- equipo

- Pruebas

- que

- esa

- La

- su

- Les

- luego

- Estas

- ellos

- cosas

- así

- aquellos

- ¿aunque?

- sincronización

- a

- entrenado

- Formación

- try

- dos

- entender

- único

- universidad

- equipo de Manejo Integrado de Plagas de la Universidad de California

- hasta

- variedad

- muy

- fue

- Washington

- olas

- Camino..

- formas

- we

- tuvieron

- cuando

- sean

- que

- mientras

- QUIENES

- seguirá

- Actividades:

- labores

- se

- aún

- zephyrnet