Esta publicación está coescrita por Ramdev Wudali y Kiran Mantripragada de Thomson Reuters.

En 1992, Thomson Reuters (TR) lanzó su primer servicio de investigación legal de IA, WIN (Westlaw Is Natural), una innovación en ese momento, ya que la mayoría de los motores de búsqueda solo admitían términos y conectores booleanos. Desde entonces, TR ha logrado muchos más hitos a medida que sus productos y servicios de IA crecen continuamente en número y variedad, apoyando a los profesionales de servicios legales, fiscales, contables, de cumplimiento y de noticias en todo el mundo, con miles de millones de conocimientos de aprendizaje automático (ML) generados cada año. .

Con este tremendo aumento de los servicios de IA, el próximo hito para TR fue agilizar la innovación y facilitar la colaboración. Estandarice la creación y reutilización de soluciones de IA en todas las funciones comerciales y las personas de los profesionales de IA, al tiempo que garantiza el cumplimiento de las mejores prácticas empresariales:

- Automatice y estandarice el esfuerzo de ingeniería repetitivo e indiferenciado

- Garantice el aislamiento y el control necesarios de los datos confidenciales de acuerdo con los estándares comunes de gobernanza

- Proporcione fácil acceso a recursos informáticos escalables

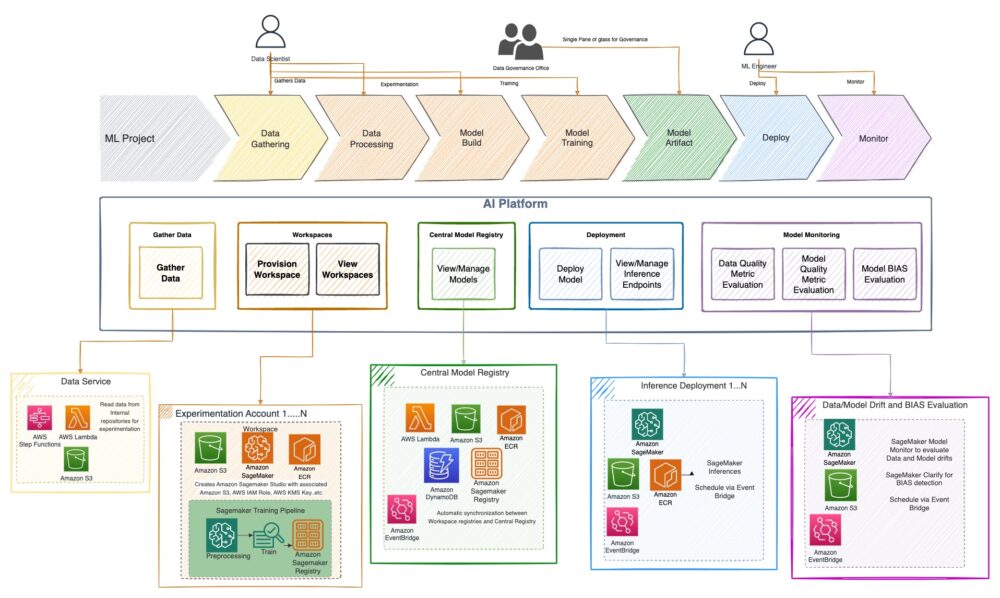

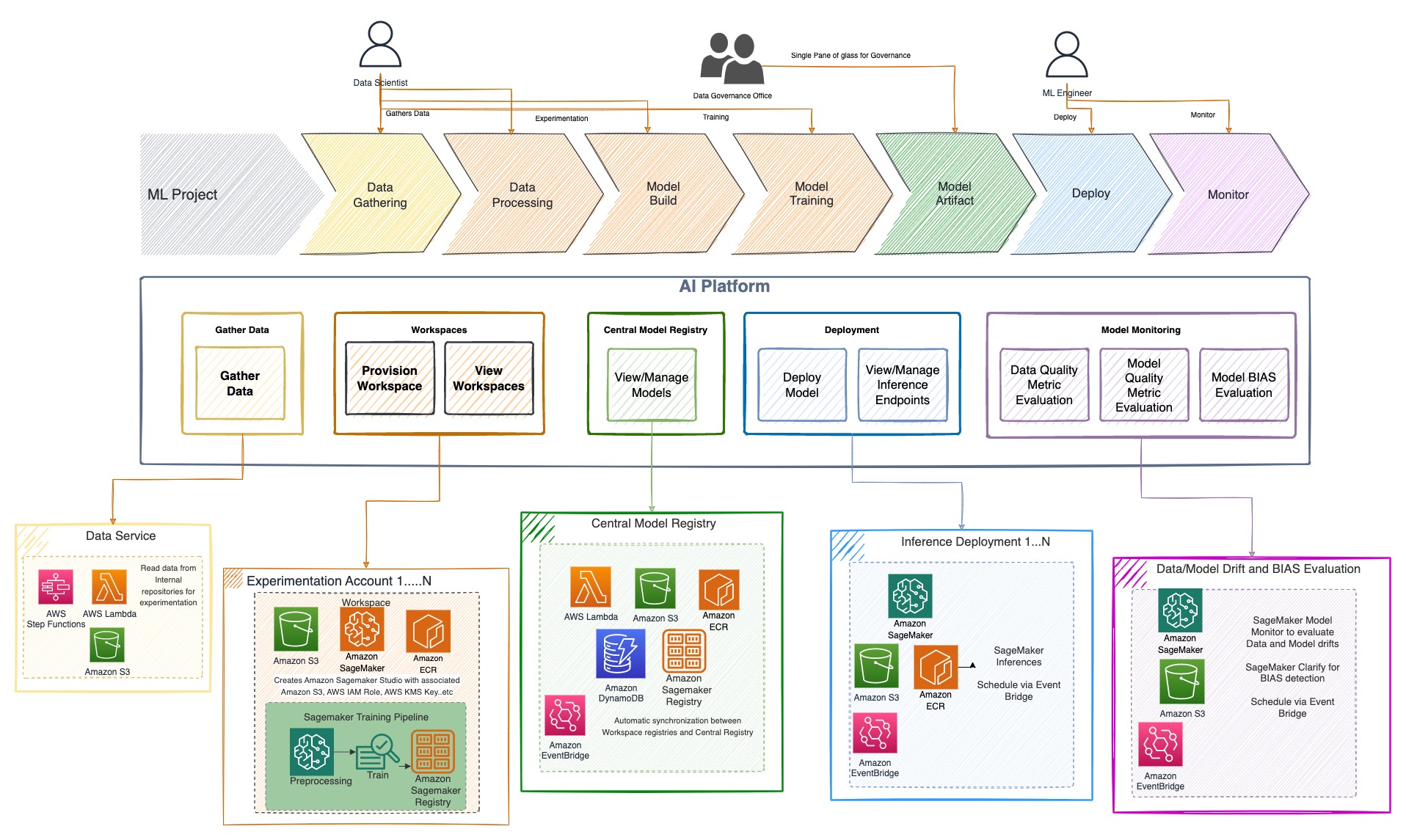

Para cumplir con estos requisitos, TR creó la plataforma Enterprise AI en torno a los siguientes cinco pilares: un servicio de datos, un espacio de trabajo de experimentación, un registro central de modelos, un servicio de implementación de modelos y un monitoreo de modelos.

En esta publicación, analizamos cómo TR y AWS colaboraron para desarrollar la primera Enterprise AI Platform de TR, una herramienta basada en la web que proporcionaría capacidades que van desde la experimentación de ML, la capacitación, un registro central de modelos, la implementación de modelos y el monitoreo de modelos. Todas estas capacidades están diseñadas para abordar los estándares de seguridad en constante evolución de TR y brindar servicios simples, seguros y compatibles a los usuarios finales. También compartimos cómo TR habilitó el monitoreo y la gobernanza para los modelos de ML creados en diferentes unidades comerciales con un solo panel de vidrio.

Los desafíos

Históricamente en TR, ML ha sido una capacidad para equipos con ingenieros y científicos de datos avanzados. Los equipos con recursos altamente calificados pudieron implementar procesos de ML complejos según sus necesidades, pero rápidamente se volvieron muy aislados. Los enfoques en silos no proporcionaron ninguna visibilidad para proporcionar gobernanza en las predicciones de toma de decisiones extremadamente críticas.

Los equipos comerciales de TR tienen un amplio conocimiento del dominio; sin embargo, las habilidades técnicas y el gran esfuerzo de ingeniería requeridos en ML dificultan el uso de su profunda experiencia para resolver problemas comerciales con el poder de ML. TR quiere democratizar las habilidades, haciéndolas accesibles a más personas dentro de la organización.

Diferentes equipos en TR siguen sus propias prácticas y metodologías. TR quiere desarrollar las capacidades que abarcan todo el ciclo de vida de ML para sus usuarios para acelerar la entrega de proyectos de ML al permitir que los equipos se centren en los objetivos comerciales y no en el esfuerzo de ingeniería repetitivo e indiferenciado.

Además, las regulaciones sobre datos e inteligencia artificial ética continúan evolucionando, lo que exige estándares de gobernanza comunes en todas las soluciones de inteligencia artificial de TR.

Resumen de la solución

La Enterprise AI Platform de TR se concibió para brindar servicios simples y estandarizados a diferentes personas, ofreciendo capacidades para cada etapa del ciclo de vida de ML. TR ha identificado cinco categorías principales que modularizan todos los requisitos de TR:

- El servicio de datos – Para permitir un acceso fácil y seguro a los activos de datos de la empresa

- Espacio de trabajo de experimentación – Proporcionar capacidades para experimentar y entrenar modelos ML

- registro modelo central – Un catálogo empresarial para modelos construidos a través de diferentes unidades de negocio

- Servicio de implementación de modelos – Proporcionar varias opciones de implementación de inferencia siguiendo las prácticas empresariales de CI/CD de TR

- Servicios de seguimiento de modelos – Proporcionar capacidades para monitorear datos y modelar sesgos y desviaciones

Como se muestra en el siguiente diagrama, estos microservicios se crean teniendo en cuenta algunos principios clave:

- Elimine el esfuerzo de ingeniería no diferenciado de los usuarios

- Proporcione las capacidades requeridas con solo hacer clic en un botón

- Asegure y gobierne todas las capacidades según los estándares empresariales de TR

- Traiga un solo panel de vidrio para las actividades de ML

Los microservicios de AI Platform de TR están construidos con Amazon SageMaker como motor central, componentes sin servidor de AWS para flujos de trabajo y servicios DevOps de AWS para prácticas de CI/CD. Estudio SageMaker se usa para experimentación y capacitación, y el registro de modelos de SageMaker se usa para registrar modelos. El registro de modelos central está compuesto por el registro de modelos de SageMaker y un Amazon DynamoDB mesa. Servicios de alojamiento de SageMaker se utilizan para implementar modelos, mientras que Monitor modelo SageMaker y SageMaker aclarar se utilizan para monitorear modelos en busca de deriva, sesgo, calculadoras métricas personalizadas y explicabilidad.

Las siguientes secciones describen estos servicios en detalle.

El servicio de datos

El ciclo de vida de un proyecto de ML tradicional comienza con la búsqueda de datos. En general, los científicos de datos dedican el 60 % o más de su tiempo a encontrar los datos correctos cuando los necesitan. Al igual que todas las organizaciones, TR tiene múltiples almacenes de datos que sirven como un único punto de verdad para diferentes dominios de datos. TR identificó dos almacenes de datos empresariales clave que proporcionan datos para la mayoría de sus casos de uso de ML: un almacén de objetos y un almacén de datos relacionales. TR creó un servicio de datos de AI Platform para brindar acceso sin problemas a ambos almacenes de datos desde los espacios de trabajo de experimentación de los usuarios y eliminar la carga de los usuarios de navegar procesos complejos para adquirir datos por su cuenta. La plataforma AI de TR sigue todos los cumplimientos y las mejores prácticas definidas por el equipo de Data and Model Governance. Esto incluye una evaluación de impacto de datos obligatoria que ayuda a los profesionales de ML a comprender y seguir el uso ético y apropiado de los datos, con procesos de aprobación formales para garantizar el acceso adecuado a los datos. El núcleo de este servicio, así como de todos los servicios de la plataforma, es la seguridad y el cumplimiento de acuerdo con las mejores prácticas determinadas por TR y la industria.

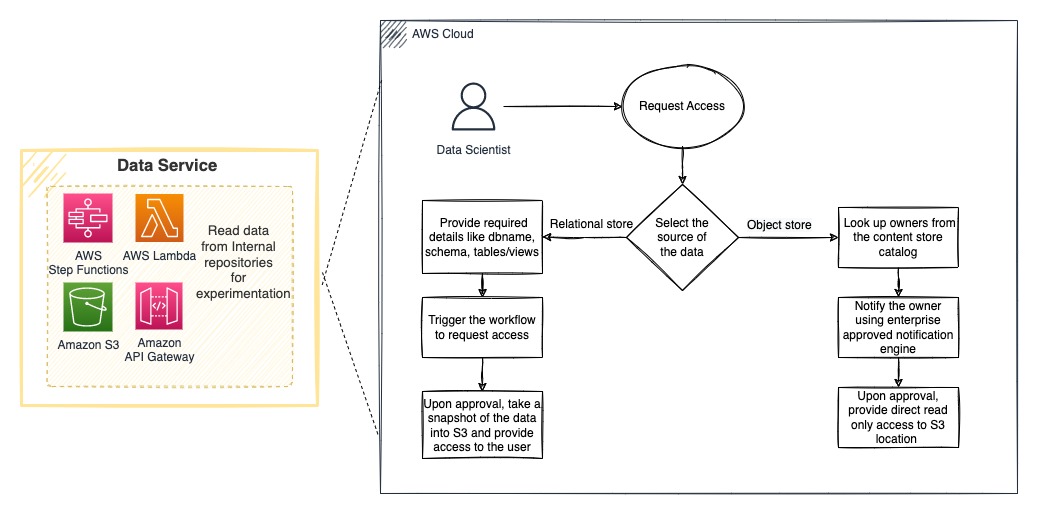

Servicio de almacenamiento simple de Amazon (Amazon S3) el almacenamiento de objetos actúa como un lago de datos de contenido. TR creó procesos para acceder de forma segura a los datos del lago de datos de contenido a los espacios de trabajo de experimentación de los usuarios, manteniendo la autorización y la auditabilidad necesarias. Snowflake se utiliza como el almacén de datos principal relacional de la empresa. A solicitud del usuario y en función de la aprobación del propietario de los datos, el servicio de datos de AI Platform proporciona una instantánea de los datos para que el usuario esté disponible en su espacio de trabajo de experimentación.

Acceder a datos de varias fuentes es un problema técnico que se puede resolver fácilmente. Pero la complejidad que TR ha resuelto es crear flujos de trabajo de aprobación que automaticen la identificación del propietario de los datos, el envío de una solicitud de acceso, la garantía de que se notifique al propietario de los datos que tiene una solicitud de acceso pendiente y, en función del estado de aprobación, tomar medidas para proporcionar datos a el solicitante Todos los eventos a lo largo de este proceso se rastrean y registran para su auditabilidad y cumplimiento.

Como se muestra en el siguiente diagrama, TR utiliza Funciones de paso de AWS para orquestar el flujo de trabajo y AWS Lambda para ejecutar la funcionalidad. Puerta de enlace API de Amazon se utiliza para exponer la funcionalidad con un punto final de API para ser consumido desde su portal web.

Modelo de experimentación y desarrollo.

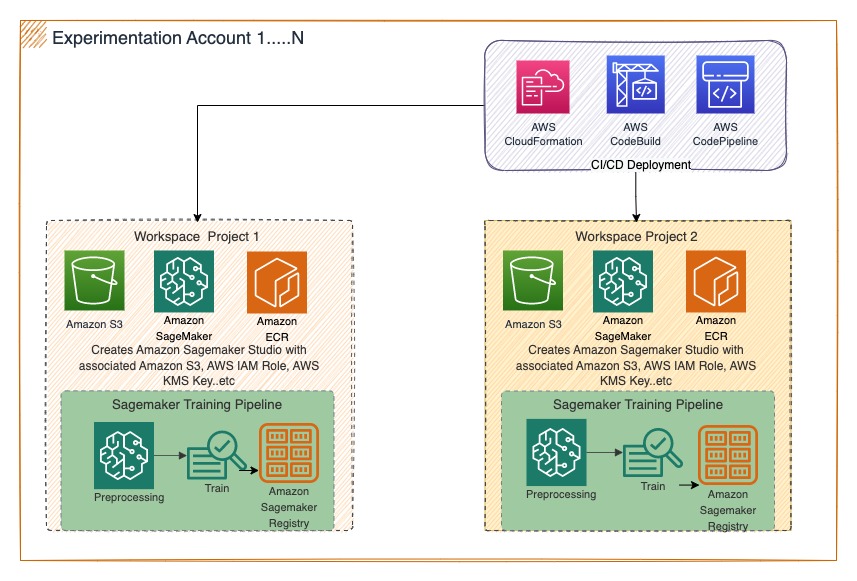

Una capacidad esencial para estandarizar el ciclo de vida de ML es un entorno que permita a los científicos de datos experimentar con diferentes marcos de ML y tamaños de datos. Habilitar un entorno tan seguro y compatible en la nube en cuestión de minutos alivia a los científicos de datos de la carga de manejar la infraestructura de la nube, los requisitos de red y las medidas de estándares de seguridad, para centrarse en cambio en el problema de la ciencia de datos.

TR crea un espacio de trabajo de experimentación que ofrece acceso a servicios como Pegamento AWS, EMR de Amazony SageMaker Studio para habilitar el procesamiento de datos y las capacidades de ML que cumplen con los estándares de seguridad de la nube empresarial y el aislamiento de cuenta requerido para cada unidad comercial. TR se ha enfrentado a los siguientes desafíos al implementar la solución:

- Al principio, la orquestación no estaba totalmente automatizada e implicaba varios pasos manuales. Rastrear dónde estaban ocurriendo los problemas no fue fácil. TR superó este error orquestando los flujos de trabajo usando Step Functions. Con el uso de Step Functions, la creación de flujos de trabajo complejos, la gestión de estados y el manejo de errores se volvió mucho más fácil.

- Apropiado Gestión de identidades y accesos de AWS (IAM) la definición de roles para el espacio de trabajo de experimentación fue difícil de definir. Para cumplir con los estándares de seguridad interna de TR y el modelo de privilegios mínimos, originalmente, el rol del espacio de trabajo se definió con políticas en línea. En consecuencia, la política en línea creció con el tiempo y se volvió detallada, superando el límite de tamaño de la política permitido para el rol de IAM. Para mitigar esto, TR pasó a usar más políticas administradas por el cliente y hacer referencia a ellas en la definición de roles del espacio de trabajo.

- TR ocasionalmente alcanzó los límites de recursos predeterminados aplicados en el nivel de cuenta de AWS. Esto provocó fallas ocasionales al iniciar trabajos de SageMaker (por ejemplo, trabajos de capacitación) debido a que se alcanzó el límite del tipo de recurso deseado. TR trabajó en estrecha colaboración con el equipo de servicio de SageMaker en este problema. Este problema se resolvió después de que el equipo de AWS lanzara SageMaker como un servicio compatible en Cuotas de servicio en junio de 2022.

Hoy, los científicos de datos de TR pueden lanzar un proyecto de ML creando un espacio de trabajo independiente y agregando los miembros del equipo necesarios para colaborar. La escala ilimitada que ofrece SageMaker está al alcance de sus manos al proporcionarles imágenes de kernel personalizadas con tamaños variados. SageMaker Studio se convirtió rápidamente en un componente crucial en AI Platform de TR y ha cambiado el comportamiento de los usuarios de usar aplicaciones de escritorio restringidas a motores escalables y efímeros especialmente diseñados. El siguiente diagrama ilustra esta arquitectura.

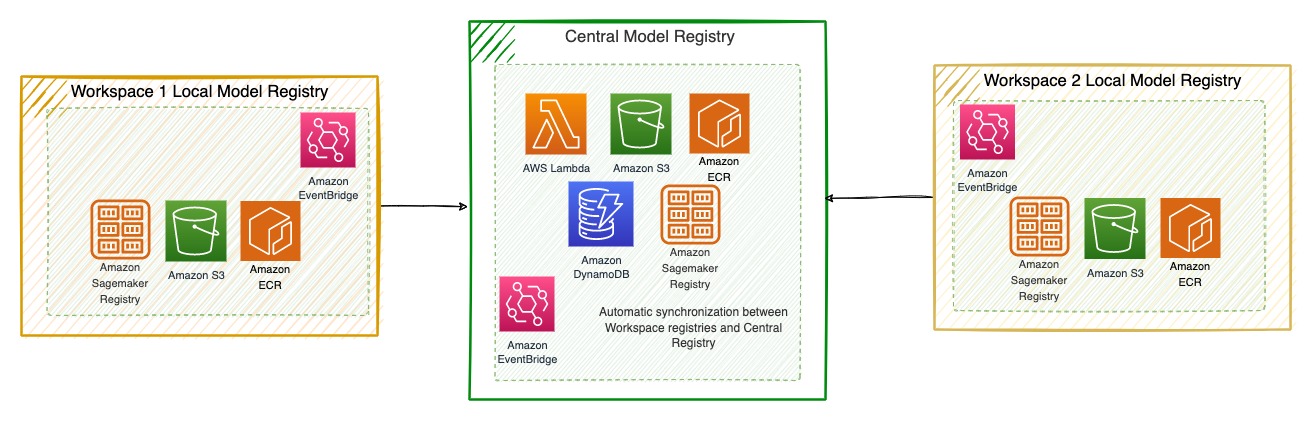

registro modelo central

El registro de modelos proporciona un repositorio central para todos los modelos de aprendizaje automático de TR, permite la gestión de riesgos y salud de aquellos de manera estandarizada en todas las funciones comerciales y agiliza la reutilización de modelos potenciales. Por lo tanto, el servicio necesitaba hacer lo siguiente:

- Proporcione la capacidad de registrar modelos nuevos y heredados, ya sea que se hayan desarrollado dentro o fuera de SageMaker.

- Implemente flujos de trabajo de gobernanza, lo que permite a los científicos de datos, desarrolladores y partes interesadas ver y gestionar colectivamente el ciclo de vida de los modelos.

- Aumente la transparencia y la colaboración mediante la creación de una vista centralizada de todos los modelos en TR junto con metadatos y métricas de salud

TR comenzó el diseño solo con el registro de modelos de SageMaker, pero uno de los requisitos clave de TR es brindar la capacidad de registrar modelos creados fuera de SageMaker. TR evaluó diferentes bases de datos relacionales pero terminó eligiendo DynamoDB porque el esquema de metadatos para los modelos provenientes de fuentes heredadas será muy diferente. TR tampoco quería imponer ningún trabajo adicional a los usuarios, por lo que implementaron una sincronización automática transparente entre los registros de SageMaker del espacio de trabajo de AI Platform con el registro central de SageMaker mediante Puente de eventos de Amazon reglas y roles de IAM requeridos. TR mejoró el registro central con DynamoDB para ampliar las capacidades para registrar modelos heredados que se crearon en los escritorios de los usuarios.

El registro de modelo central de AI Platform de TR está integrado en el portal de AI Platform y proporciona una interfaz visual para buscar modelos, actualizar los metadatos del modelo y comprender las métricas de línea de base del modelo y las métricas de monitoreo personalizadas periódicas. El siguiente diagrama ilustra esta arquitectura.

Despliegue del modelo

TR identificó dos patrones principales para automatizar la implementación:

- Modelos desarrollados usando SageMaker a través de trabajos de transformación por lotes de SageMaker para obtener inferencias en un horario preferido

- Modelos desarrollados fuera de SageMaker en escritorios locales usando bibliotecas de código abierto, a través del enfoque de traiga su propio contenedor usando trabajos de procesamiento de SageMaker para ejecutar código de inferencia personalizado, como una forma eficiente de migrar esos modelos sin refactorizar el código

Con el servicio de implementación de AI Platform, los usuarios de TR (científicos de datos e ingenieros de ML) pueden identificar un modelo del catálogo e implementar un trabajo de inferencia en su cuenta de AWS elegida al proporcionar los parámetros necesarios a través de un flujo de trabajo basado en la interfaz de usuario.

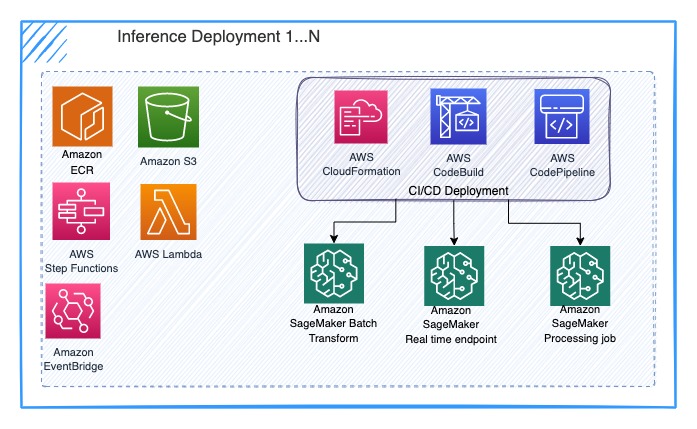

TR automatizó esta implementación utilizando servicios de AWS DevOps como AWS CodePipeline y Construcción de código AWS. TR usa Step Functions para orquestar el flujo de trabajo de lectura y preprocesamiento de datos para crear trabajos de inferencia de SageMaker. TR despliega los componentes requeridos como código usando Formación en la nube de AWS plantillas. El siguiente diagrama ilustra esta arquitectura.

Monitoreo de modelos

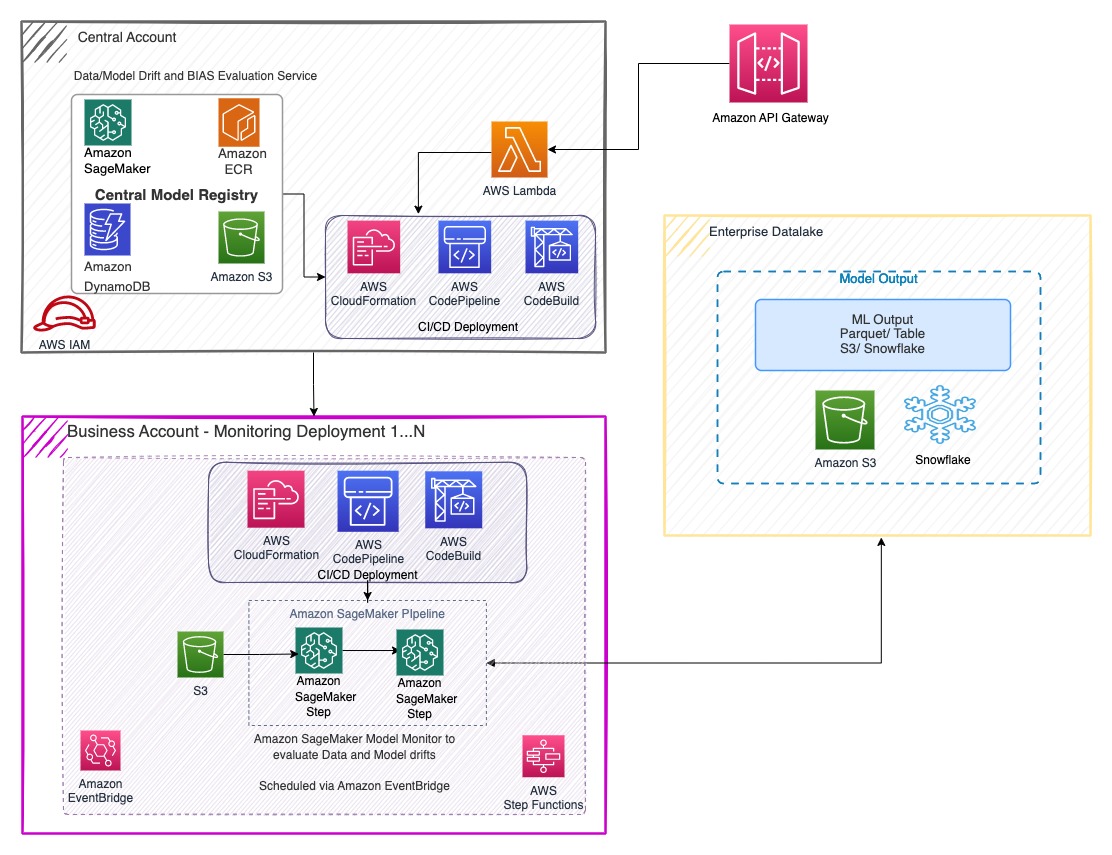

El ciclo de vida de ML no está completo sin poder monitorear modelos. El equipo de gobierno empresarial de TR también exige y alienta a los equipos comerciales a monitorear el desempeño de su modelo a lo largo del tiempo para abordar cualquier desafío regulatorio. TR comenzó con el seguimiento de modelos y datos de deriva. TR usó SageMaker Model Monitor para proporcionar una línea de base de datos y una verdad de campo de inferencia para monitorear periódicamente cómo se desvían los datos y las inferencias de TR. Junto con las métricas de monitoreo de modelos de SageMaker, TR mejoró la capacidad de monitoreo mediante el desarrollo de métricas personalizadas específicas para sus modelos. Esto ayudará a los científicos de datos de TR a comprender cuándo volver a entrenar su modelo.

Junto con el monitoreo de deriva, TR también quiere comprender el sesgo en los modelos. Las capacidades listas para usar de SageMaker Clarify se utilizan para crear el servicio de sesgo de TR. TR monitorea tanto los datos como el sesgo del modelo y pone esas métricas a disposición de sus usuarios a través del portal de AI Platform.

Para ayudar a todos los equipos a adoptar estos estándares empresariales, TR ha hecho que estos servicios sean independientes y estén fácilmente disponibles a través del portal de AI Platform. Los equipos comerciales de TR pueden ingresar al portal e implementar un trabajo de monitoreo de modelo o un trabajo de monitoreo de sesgo por su cuenta y ejecutarlos en su horario preferido. Se les notifica sobre el estado del trabajo y las métricas de cada ejecución.

TR usó los servicios de AWS para la implementación de CI/CD, la orquestación de flujos de trabajo, los marcos sin servidor y los puntos de enlace de API para crear microservicios que se pueden activar de forma independiente, como se muestra en la siguiente arquitectura.

Resultados y futuras mejoras

AI Platform de TR se lanzó en el tercer trimestre de 3 con los cinco componentes principales: un servicio de datos, un espacio de trabajo de experimentación, un registro central de modelos, implementación de modelos y monitoreo de modelos. TR llevó a cabo sesiones de capacitación internas para que sus unidades comerciales incorporaran la plataforma y les ofreció videos de capacitación autoguiados.

AI Platform ha brindado capacidades a los equipos de TR que nunca antes existían; ha abierto una amplia gama de posibilidades para que el equipo de gobierno empresarial de TR mejore los estándares de cumplimiento y centralice el registro, brindando una vista de panel único en todos los modelos de ML dentro de TR.

TR reconoce que ningún producto está en su mejor momento en el lanzamiento inicial. Todos los componentes de TR se encuentran en diferentes niveles de madurez, y el equipo de Enterprise AI Platform de TR se encuentra en una fase de mejora continua para mejorar iterativamente las características del producto. El canal de avance actual de TR incluye la adición de opciones adicionales de inferencia de SageMaker, como puntos finales en tiempo real, asíncronos y multimodelo. TR también planea agregar la explicabilidad del modelo como una característica de su servicio de monitoreo de modelos. TR planea utilizar las capacidades de explicabilidad de SageMaker Clarify para desarrollar su servicio de explicabilidad interno.

Conclusión

TR ahora puede procesar grandes cantidades de datos de forma segura y usar capacidades avanzadas de AWS para llevar un proyecto de ML desde la ideación hasta la producción en el lapso de semanas, en comparación con los meses que tomaba antes. Con las capacidades listas para usar de los servicios de AWS, los equipos dentro de TR pueden registrar y monitorear modelos ML por primera vez, logrando el cumplimiento de sus estándares de gobernanza de modelos en evolución. TR empoderó a los científicos de datos y los equipos de productos para que den rienda suelta a su creatividad de manera efectiva y resuelvan los problemas más complejos.

Para obtener más información sobre Enterprise AI Platform de TR en AWS, consulte el Sesión de AWS re:Invent 2022. Si desea saber cómo TR aceleró el uso del aprendizaje automático utilizando el Laboratorio de datos de AWS programa, consulte el ejemplo.

Acerca de los autores

ramdev wudali es un arquitecto de datos que ayuda a diseñar y construir la plataforma AI/ML para permitir que los científicos e investigadores de datos desarrollen soluciones de aprendizaje automático centrándose en la ciencia de datos y no en las necesidades de infraestructura. En su tiempo libre, le encanta doblar papel para crear mosaicos de origami y usar camisetas irreverentes.

ramdev wudali es un arquitecto de datos que ayuda a diseñar y construir la plataforma AI/ML para permitir que los científicos e investigadores de datos desarrollen soluciones de aprendizaje automático centrándose en la ciencia de datos y no en las necesidades de infraestructura. En su tiempo libre, le encanta doblar papel para crear mosaicos de origami y usar camisetas irreverentes.

Kiran Mantripragada es el director sénior de AI Platform en Thomson Reuters. El equipo de AI Platform es responsable de habilitar aplicaciones de software de IA de grado de producción y permitir el trabajo de científicos de datos e investigadores de aprendizaje automático. Con una pasión por la ciencia, la IA y la ingeniería, a Kiran le gusta cerrar la brecha entre la investigación y la producción para llevar la verdadera innovación de la IA a los consumidores finales.

Kiran Mantripragada es el director sénior de AI Platform en Thomson Reuters. El equipo de AI Platform es responsable de habilitar aplicaciones de software de IA de grado de producción y permitir el trabajo de científicos de datos e investigadores de aprendizaje automático. Con una pasión por la ciencia, la IA y la ingeniería, a Kiran le gusta cerrar la brecha entre la investigación y la producción para llevar la verdadera innovación de la IA a los consumidores finales.

Bhavana Chirumamilla es arquitecto residente sénior en AWS. Le apasionan las operaciones de datos y ML, y aporta mucho entusiasmo para ayudar a las empresas a crear estrategias de datos y ML. En su tiempo libre, disfruta del tiempo con su familia viajando, haciendo caminatas, haciendo jardinería y viendo documentales.

Bhavana Chirumamilla es arquitecto residente sénior en AWS. Le apasionan las operaciones de datos y ML, y aporta mucho entusiasmo para ayudar a las empresas a crear estrategias de datos y ML. En su tiempo libre, disfruta del tiempo con su familia viajando, haciendo caminatas, haciendo jardinería y viendo documentales.

Srinivasa Shaik es arquitecto de soluciones en AWS con sede en Boston. Ayuda a los clientes empresariales a acelerar su viaje a la nube. Le apasionan los contenedores y las tecnologías de aprendizaje automático. En su tiempo libre, disfruta pasar tiempo con su familia, cocinar y viajar.

Srinivasa Shaik es arquitecto de soluciones en AWS con sede en Boston. Ayuda a los clientes empresariales a acelerar su viaje a la nube. Le apasionan los contenedores y las tecnologías de aprendizaje automático. En su tiempo libre, disfruta pasar tiempo con su familia, cocinar y viajar.

qingweili es un especialista en aprendizaje automático en Amazon Web Services. Recibió su doctorado en Investigación de Operaciones después de que rompió la cuenta de subvenciones de investigación de su asesor y no pudo entregar el Premio Nobel que prometió. Actualmente, ayuda a los clientes de la industria de seguros y servicios financieros a crear soluciones de aprendizaje automático en AWS. En su tiempo libre le gusta leer y enseñar.

qingweili es un especialista en aprendizaje automático en Amazon Web Services. Recibió su doctorado en Investigación de Operaciones después de que rompió la cuenta de subvenciones de investigación de su asesor y no pudo entregar el Premio Nobel que prometió. Actualmente, ayuda a los clientes de la industria de seguros y servicios financieros a crear soluciones de aprendizaje automático en AWS. En su tiempo libre le gusta leer y enseñar.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- Platoblockchain. Inteligencia del Metaverso Web3. Conocimiento amplificado. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/how-thomson-reuters-built-an-ai-platform-using-amazon-sagemaker-to-accelerate-delivery-of-ml-projects/

- 100

- 2022

- 7

- a

- Poder

- Nuestra Empresa

- acelerar

- acelerado

- de la máquina

- accesible

- Conforme

- Mi Cuenta

- Contabilidad

- alcanzado

- el logro de

- adquirir

- a través de

- la columna Acción

- hechos

- Adicionales

- dirección

- adoptar

- avanzado

- Después

- AI

- Plataforma de IA

- Servicios de IA

- AI / ML

- Todos

- permite

- junto al

- Amazon

- Amazon SageMaker

- Amazon Web Services

- cantidades

- y

- abejas

- aplicaciones

- aplicada

- enfoque

- enfoques

- aprobación

- arquitectura

- en torno a

- autorización

- automatizado

- Confirmación de Viaje

- Automático

- Hoy Disponibles

- AWS

- basado

- Base

- porque

- antes

- "Ser"

- MEJOR

- y las mejores prácticas

- entre

- parcialidad

- miles de millones

- Boston

- PUENTE

- llevar

- Trae

- Rompió

- build

- Construir la

- construye

- construido

- carga

- funciones de negocios

- capacidades

- cases

- catalogar

- categoría

- causado

- central

- centralizado

- retos

- comprobar

- la elección de

- elegido

- de cerca

- Soluciones

- infraestructura de nube

- Cloud Security

- código

- colaboran

- colaborado

- colaboración

- colectivamente

- viniendo

- Algunos

- en comparación con

- completar

- integraciones

- complejidad

- compliance

- obediente

- componente

- componentes

- Compuesto

- informática

- consumido

- Clientes

- Envase

- Contenedores

- contenido

- continue

- continuo

- control

- Core

- Para crear

- creado

- Creamos

- creatividad

- crítico

- crucial

- Current

- En la actualidad

- personalizado

- Clientes

- datos

- Lago de datos

- proceso de datos

- Ciencia de los datos

- bases de datos

- Toma de Decisiones

- profundo

- profunda experiencia

- Predeterminado

- entregamos

- entrega

- democratizar

- desplegar

- despliegue

- despliega

- describir

- Diseño

- computadora de escritorio

- detalle

- determina

- desarrollar

- desarrollado

- desarrolladores

- el desarrollo

- Desarrollo

- una experiencia diferente

- difícil

- Director

- discutir

- documentales

- dominio

- dominios

- DE INSCRIPCIÓN

- Temprano en la

- más fácil

- pasan fácilmente

- de manera eficaz

- eficiente

- esfuerzo

- poder

- habilitar

- facilita

- permite

- permitiendo

- anima

- Punto final

- Motor

- Ingeniería

- certificados

- motores

- mejorado

- garantizar

- asegurando que

- Empresa

- empresas

- entusiasmo

- Entorno

- error

- esencial

- ético

- evaluado

- Eventos

- NUNCA

- evoluciona

- evolución

- ejemplo

- experimento

- Experiencia

- ampliar

- extremadamente

- facilitar

- Fallidos

- familia

- Feature

- Caracteristicas

- pocos

- final

- financiero

- servicios financieros

- Encuentre

- la búsqueda de

- Nombre

- primer vez

- Focus

- enfoque

- seguir

- siguiendo

- siguiente

- formal

- marcos

- Desde

- Cumplir

- completamente

- a la fatiga

- funciones

- futuras

- brecha

- General

- generado

- obtener

- vaso

- Go

- Goals

- gobierno

- conceder

- Polo a Tierra

- Creciendo

- Manejo

- Difícil

- Salud

- ayuda

- ayudando

- ayuda

- altamente

- hosting

- Cómo

- Sin embargo

- HTML

- HTTPS

- no haber aun identificado una solucion para el problema

- Identifique

- identificar

- Identidad

- imágenes

- Impacto

- implementar

- implementado

- implementación

- impuesta

- mejorar

- in

- incluye

- aumente

- independientes

- independientemente

- energético

- EN LA MINA

- inicial

- Innovation

- Insights

- aseguradora

- COMPLETAMENTE

- Interfaz

- interno

- involucra

- solo

- IT

- Trabajos

- Empleo

- Clave

- Saber

- especialistas

- lago

- lanzamiento

- lanzado

- lanzamiento

- APRENDE:

- aprendizaje

- Legado

- Legal

- Nivel

- bibliotecas

- LIMITE LAS

- límites

- para vivir

- local

- máquina

- máquina de aprendizaje

- hecho

- gran

- HACE

- Realizar

- gestionan

- Management

- administrar

- mandatos

- manera

- manual

- muchos

- madurez

- medidas

- Miembros

- metadatos

- metodologías

- métrico

- Métrica

- microservicios

- migrado

- hito

- Hitos

- mente

- Min

- Mitigar las

- ML

- modelo

- modelos

- Monitorear

- monitoreo

- monitores

- meses

- más,

- MEJOR DE TU

- múltiples

- Natural

- Navegar

- ¿ Necesita ayuda

- red

- Nuevo

- noticias

- Next

- premio Nobel

- número

- objeto

- ocasional

- Ofrecido

- que ofrece

- Ofertas

- A bordo

- ONE

- de código abierto

- abierto

- Operaciones

- Opciones

- orquestación

- organización

- originalmente

- afuera

- EL DESARROLLADOR

- propietario

- cristal

- Papel

- parámetros

- pasión

- apasionado

- .

- Personas

- actuación

- periódico

- fase

- industrial

- planificar

- jubilación

- plataforma

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- punto

- políticas

- política

- Portal

- POSIBILIDADES

- Publicación

- posible

- industria

- prácticas

- Predicciones

- preferido

- primario

- principios

- premio

- Problema

- problemas

- en costes

- tratamiento

- Producto

- Producción

- Productos

- profesionales

- Programa

- proyecto

- proyecta

- prometido

- proporcionar

- previsto

- proporciona un

- proporcionando

- Q3

- q3 2022

- con rapidez

- distancia

- que van

- RE

- alcanzado

- Reading

- real

- en tiempo real

- recibido

- registrarte

- registro

- reglamentos

- regulador

- ,

- liberado

- remove

- repositorio

- solicita

- Requisitos

- Requisitos

- la investigación

- investigadores

- Recurso

- Recursos

- responsable

- Reuters

- Riesgo

- Función

- También soy miembro del cuerpo docente de World Extreme Medicine (WEM) y embajadora europea de igualdad para The Transformational Travel Council (TTC). En mi tiempo libre, soy una incansable aventurera, escaladora, patrona de día, buceadora y defensora de la igualdad de género en el deporte y la aventura. En XNUMX, fundé Almas Libres, una ONG nacida para involucrar, educar y empoderar a mujeres y niñas a través del deporte urbano, la cultura y la tecnología.

- reglas

- Ejecutar

- sabio

- Inferencia de SageMaker

- escalable

- Escala

- programa

- Ciencia:

- los científicos

- sin costura

- sin problemas

- Buscar

- Los motores de búsqueda

- (secciones)

- seguro

- asegurado

- segura

- EN LINEA

- enviando

- mayor

- sensible

- ayudar

- Sin servidor

- de coches

- Servicios

- sesiones

- Varios

- Compartir

- mostrado

- sencillos

- desde

- soltero

- Tamaño

- tamaños

- experto

- habilidades

- Instantánea

- So

- Software

- a medida

- Soluciones

- RESOLVER

- Fuentes

- especialista

- soluciones y

- pasar

- Gastos

- Etapa

- las partes interesadas

- estandarizando

- estándares de salud

- fundó

- comienza

- Zonas

- Estado

- paso

- pasos

- STORAGE

- tienda

- tiendas

- estrategias

- aerodinamizar

- estudio

- tal

- Soportado

- Apoyar

- conmutada

- sincronización

- mesa

- ¡Prepárate!

- deuda

- Educación

- equipo

- equipos

- Técnico

- habilidades técnicas

- Tecnologías

- plantillas

- términos

- La

- su

- por lo tanto

- Thomson Reuters

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- a lo largo de

- equipo

- a

- del IRS

- Seguimiento

- tradicional

- Entrenar

- Formación

- Transformar

- Transparencia

- Viajar

- tremendo

- desencadenados

- entender

- unidad

- unidades que

- desatraillar

- ilimitado

- Actualizar

- utilizan el

- Usuario

- usuarios

- variedad

- diversos

- Vasto

- vía

- Videos

- Ver

- la visibilidad

- ver

- web

- servicios web

- Basado en la Web

- Semanas

- sean

- mientras

- amplio

- Amplia gama

- seguirá

- ganar

- dentro de

- sin

- Actividades:

- trabajado

- flujos de trabajo

- en todo el mundo

- se

- año

- tú

- zephyrnet