La estimación de pose es una técnica de visión por computadora que detecta un conjunto de puntos en objetos (como personas o vehículos) dentro de imágenes o videos. La estimación de pose tiene aplicaciones del mundo real en deportes, robótica, seguridad, realidad aumentada, medios y entretenimiento, aplicaciones médicas y más. Los modelos de estimación de pose se entrenan en imágenes o videos anotados con un conjunto consistente de puntos (coordenadas) definidos por una plataforma. Para entrenar modelos de estimación de pose precisos, primero debe adquirir un gran conjunto de datos de imágenes anotadas; Muchos conjuntos de datos tienen decenas o cientos de miles de imágenes anotadas y su construcción requiere importantes recursos. Es importante identificar y prevenir los errores de etiquetado porque el rendimiento del modelo para los modelos de estimación de pose está fuertemente influenciado por la calidad y el volumen de los datos etiquetados.

En esta publicación, mostramos cómo puede utilizar un flujo de trabajo de etiquetado personalizado en Verdad fundamental de Amazon SageMaker Diseñado específicamente para el etiquetado de puntos clave. Este flujo de trabajo personalizado ayuda a agilizar el proceso de etiquetado y minimizar los errores de etiquetado, reduciendo así el costo de obtener etiquetas de pose de alta calidad.

Importancia de datos de alta calidad y reducción de errores de etiquetado

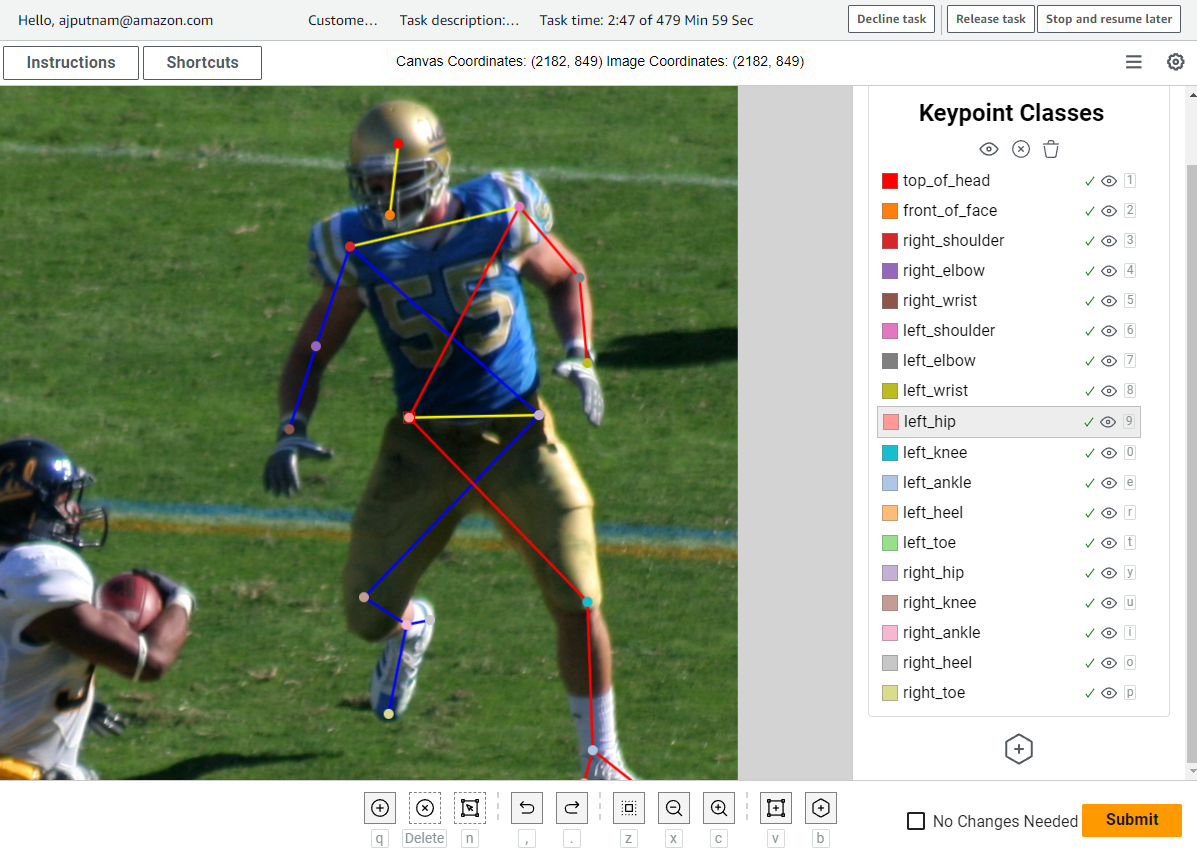

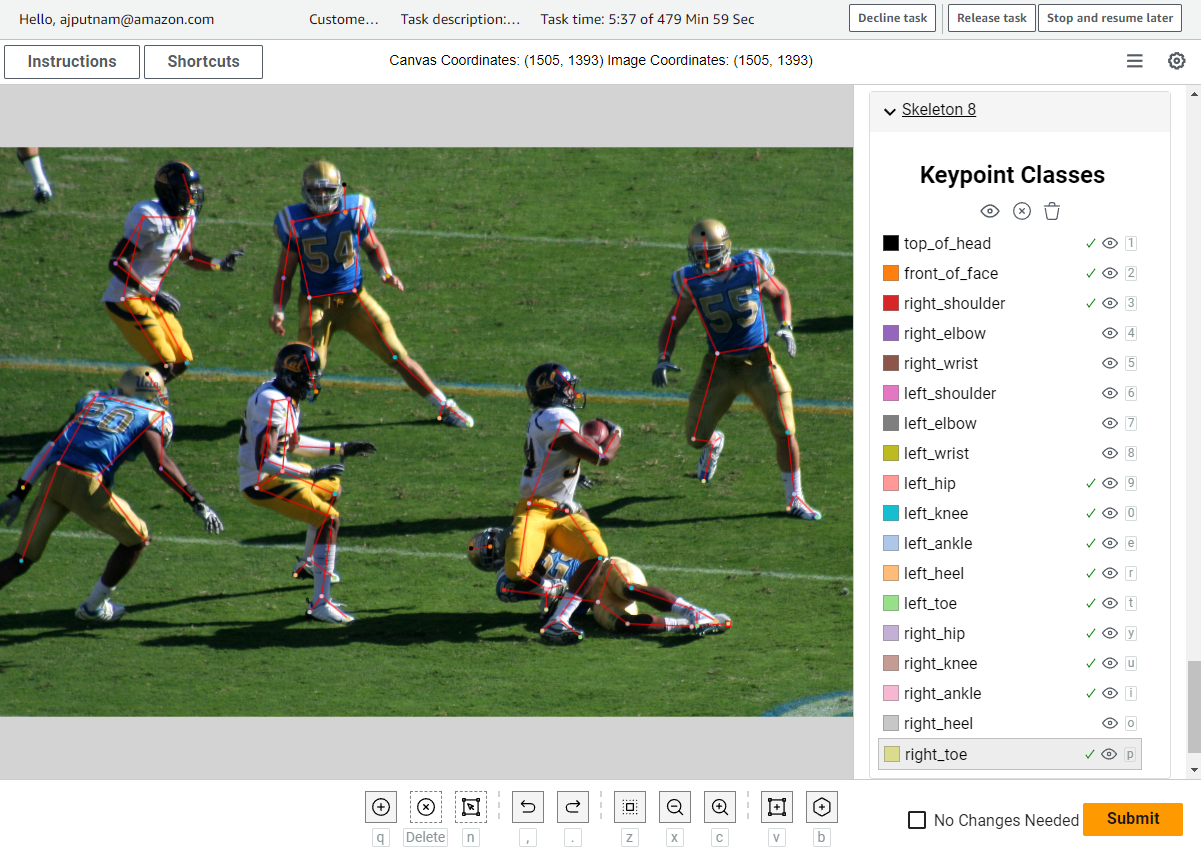

Los datos de alta calidad son fundamentales para entrenar modelos de estimación de pose robustos y confiables. La precisión de estos modelos está directamente ligada a la exactitud y precisión de las etiquetas asignadas a cada punto clave de pose, lo que, a su vez, depende de la eficacia del proceso de anotación. Además, tener un volumen sustancial de datos diversos y bien anotados garantiza que el modelo pueda aprender una amplia gama de poses, variaciones y escenarios, lo que lleva a una mejor generalización y rendimiento en diferentes aplicaciones del mundo real. La adquisición de estos grandes conjuntos de datos anotados implica anotadores humanos que etiquetan cuidadosamente las imágenes con información de pose. Al etiquetar puntos de interés dentro de la imagen, es útil ver la estructura esquelética del objeto mientras se etiqueta para proporcionar una guía visual al anotador. Esto es útil para identificar errores de etiquetado antes de que se incorporen al conjunto de datos, como intercambios de izquierda a derecha o etiquetas incorrectas (como marcar un pie como un hombro). Por ejemplo, un error de etiquetado como el intercambio de izquierda a derecha realizado en el siguiente ejemplo se puede identificar fácilmente por el cruce de las líneas del esqueleto del equipo y la falta de coincidencia de los colores. Estas señales visuales ayudan a los etiquetadores a reconocer errores y darán como resultado un conjunto de etiquetas más limpio.

Debido a la naturaleza manual del etiquetado, obtener conjuntos de datos etiquetados grandes y precisos puede tener un costo prohibitivo y más aún con un sistema de etiquetado ineficiente. Por lo tanto, la eficiencia y precisión del etiquetado son fundamentales al diseñar su flujo de trabajo de etiquetado. En esta publicación, demostramos cómo utilizar un flujo de trabajo de etiquetado personalizado de SageMaker Ground Truth para anotar imágenes de forma rápida y precisa, reduciendo la carga de desarrollar grandes conjuntos de datos para flujos de trabajo de estimación de pose.

Resumen de la solución

Esta solución proporciona un portal web en línea donde el personal de etiquetado puede utilizar un navegador web para iniciar sesión, acceder a trabajos de etiquetado y anotar imágenes mediante la interfaz de usuario (UI) crowd-2d-skeleton, una interfaz de usuario personalizada diseñada para etiquetado de puntos clave y poses mediante Verdad fundamental de SageMaker. Las anotaciones o etiquetas creadas por el personal de etiquetado luego se exportan a un Servicio de almacenamiento simple de Amazon (Amazon S3), donde se pueden utilizar para procesos posteriores, como el entrenamiento de modelos de visión por computadora de aprendizaje profundo. Esta solución le explica cómo configurar e implementar los componentes necesarios para crear un portal web, así como también cómo crear trabajos de etiquetado para este flujo de trabajo de etiquetado.

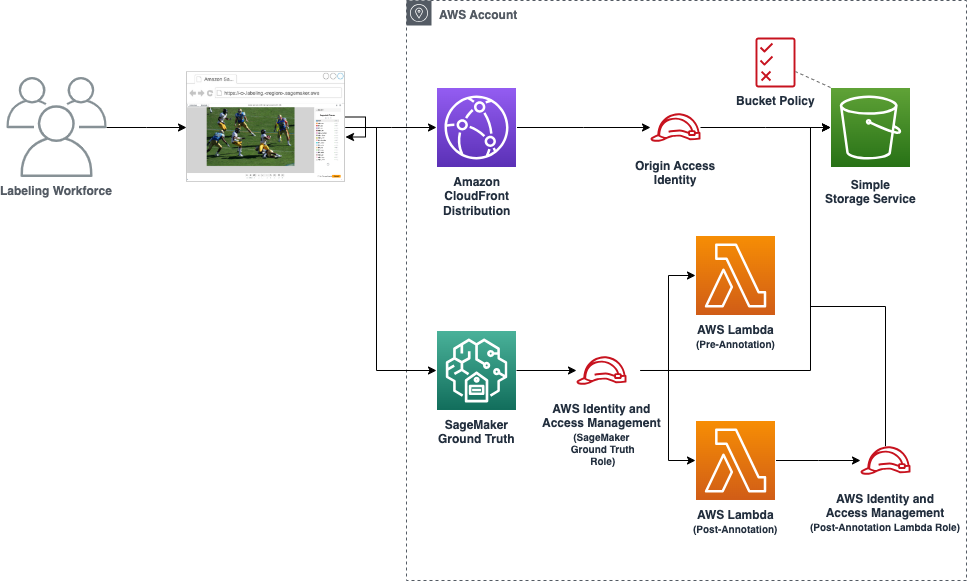

El siguiente es un diagrama de la arquitectura general.

Esta arquitectura se compone de varios componentes clave, cada uno de los cuales explicamos con más detalle en las siguientes secciones. Esta arquitectura proporciona al personal de etiquetado un portal web en línea alojado por SageMaker Ground Truth. Este portal permite que cada etiquetador inicie sesión y vea sus trabajos de etiquetado. Una vez que hayan iniciado sesión, el etiquetador puede seleccionar un trabajo de etiquetado y comenzar a anotar imágenes utilizando la interfaz de usuario personalizada alojada por Amazon CloudFront. Usamos AWS Lambda funciones para el procesamiento de datos previos y posteriores a la anotación.

La siguiente captura de pantalla es un ejemplo de la interfaz de usuario.

El etiquetador puede marcar puntos clave específicos en la imagen mediante la interfaz de usuario. Las líneas entre los puntos clave se dibujarán automáticamente para el usuario en función de una definición de plataforma esquelética que utiliza la interfaz de usuario. La interfaz de usuario permite muchas personalizaciones, como las siguientes:

- Nombres de puntos clave personalizados

- Colores de puntos clave configurables

- Colores de línea de aparejo configurables

- Estructuras de esqueleto y plataforma configurables

Cada una de estas son características específicas para mejorar la facilidad y flexibilidad del etiquetado. Los detalles específicos de personalización de la interfaz de usuario se pueden encontrar en la Repositorio GitHub y se resumen más adelante en esta publicación. Tenga en cuenta que en esta publicación utilizamos la estimación de la pose humana como tarea básica, pero puede expandirla para etiquetar la pose del objeto con una plataforma predefinida para otros objetos también, como animales o vehículos. En el siguiente ejemplo, mostramos cómo se puede aplicar esto para etiquetar los puntos de un camión.

Verdad fundamental de SageMaker

En esta solución, utilizamos SageMaker Ground Truth para proporcionar al personal de etiquetado un portal en línea y una forma de gestionar los trabajos de etiquetado. Esta publicación asume que está familiarizado con SageMaker Ground Truth. Para obtener más información, consulte Verdad fundamental de Amazon SageMaker.

Distribución de CloudFront

Para esta solución, la interfaz de usuario de etiquetado requiere un componente JavaScript personalizado llamado componente crowd-2d-skeleton. Este componente se puede encontrar en GitHub como parte de las iniciativas de código abierto de Amazon. La distribución de CloudFront se utilizará para alojar el multitud-2d-esqueleto.js, que es necesario para la interfaz de usuario de SageMaker Ground Truth. A la distribución de CloudFront se le asignará una identidad de acceso de origen, lo que permitirá que la distribución de CloudFront acceda al crowd-2d-skeleton.js que reside en el depósito S3. El depósito de S3 permanecerá privado y ningún otro objeto en este depósito estará disponible a través de la distribución de CloudFront debido a las restricciones que imponemos a la identidad de acceso de origen a través de una política de depósito. Esta es una práctica recomendada para seguir el principio de privilegios mínimos.

Cubo Amazon S3

Usamos el depósito S3 para almacenar los archivos de manifiesto de entrada y salida de SageMaker Ground Truth, la plantilla de interfaz de usuario personalizada, imágenes para los trabajos de etiquetado y el código JavaScript necesario para la interfaz de usuario personalizada. Este depósito será privado y no será accesible al público. El depósito también tendrá una política de depósito que restringe la distribución de CloudFront para que solo pueda acceder al código JavaScript necesario para la interfaz de usuario. Esto evita que la distribución de CloudFront aloje cualquier otro objeto en el depósito de S3.

Función Lambda previa a la anotación

Los trabajos de etiquetado de SageMaker Ground Truth normalmente utilizan un archivo de manifiesto de entrada, que está en formato de líneas JSON. Este archivo de manifiesto de entrada contiene metadatos para un trabajo de etiquetado, actúa como referencia a los datos que deben etiquetarse y ayuda a configurar cómo se deben presentar los datos a los anotadores. La función Lambda previa a la anotación procesa elementos del archivo de manifiesto de entrada antes de que los datos del manifiesto se ingresen en la plantilla de interfaz de usuario personalizada. Aquí es donde se puede realizar cualquier formato o modificación especial de los elementos antes de presentar los datos a los anotadores en la interfaz de usuario. Para obtener más información sobre las funciones Lambda previas a la anotación, consulte Lambda previa a la anotación.

Función Lambda posterior a la anotación

De manera similar a la función Lambda previa a la anotación, la función posterior a la anotación maneja el procesamiento de datos adicional que quizás desee realizar después de que todos los etiquetadores hayan terminado de etiquetar, pero antes de escribir los resultados finales de la anotación. Este procesamiento lo realiza una función Lambda, que es responsable de formatear los datos para los resultados de salida del trabajo de etiquetado. En esta solución, simplemente la usamos para devolver los datos en el formato de salida deseado. Para obtener más información sobre las funciones Lambda posteriores a la anotación, consulte Lambda posterior a la anotación.

Rol de función Lambda posterior a la anotación

Usamos un Gestión de identidades y accesos de AWS (IAM) para otorgar acceso a la función Lambda posterior a la anotación al depósito de S3. Esto es necesario para leer los resultados de las anotaciones y realizar modificaciones antes de escribir los resultados finales en el archivo de manifiesto de salida.

Rol de SageMaker Ground Truth

Usamos esta función de IAM para brindarle al trabajo de etiquetado de SageMaker Ground Truth la capacidad de invocar las funciones Lambda y leer las imágenes, los archivos de manifiesto y la plantilla de interfaz de usuario personalizada en el depósito de S3.

Requisitos previos

Para este tutorial, debe tener los siguientes requisitos previos:

Para esta solución, utilizamos AWS CDK para implementar la arquitectura. Luego creamos un trabajo de etiquetado de muestra, utilizamos el portal de anotaciones para etiquetar las imágenes en el trabajo de etiquetado y examinamos los resultados del etiquetado.

Cree la pila de AWS CDK

Después de completar todos los requisitos previos, estará listo para implementar la solución.

Configura tus recursos

Complete los siguientes pasos para configurar sus recursos:

- Descargue la pila de ejemplo desde Repositorio GitHub.

- Utilice el comando cd para cambiar al repositorio.

- Cree su entorno Python e instale los paquetes necesarios (consulte el repositorio README.md para obtener más detalles).

- Con su entorno Python activado, ejecute el siguiente comando:

- Ejecute el siguiente comando para implementar AWS CDK:

- Ejecute el siguiente comando para ejecutar el script posterior a la implementación:

Crear un trabajo de etiquetado

Una vez que haya configurado sus recursos, estará listo para crear un trabajo de etiquetado. Para los propósitos de esta publicación, creamos un trabajo de etiquetado utilizando los scripts de ejemplo y las imágenes proporcionadas en el repositorio.

- CD en el

scriptsdirectorio en el repositorio. - Descargue las imágenes de ejemplo de Internet ejecutando el siguiente código:

Este script descarga un conjunto de 10 imágenes, que usamos en nuestro trabajo de etiquetado de ejemplo. Revisaremos cómo utilizar sus propios datos de entrada personalizados más adelante en esta publicación.

- Cree un trabajo de etiquetado ejecutando el siguiente código:

Este script toma como argumento un ARN de fuerza laboral privada de SageMaker Ground Truth, que debería ser el ARN de una fuerza laboral que tiene en la misma cuenta en la que implementó esta arquitectura. El script creará el archivo de manifiesto de entrada para nuestro trabajo de etiquetado, lo cargará en Amazon S3 y creará un trabajo de etiquetado personalizado de SageMaker Ground Truth. Profundizaremos en los detalles de este script más adelante en esta publicación.

Etiquetar el conjunto de datos

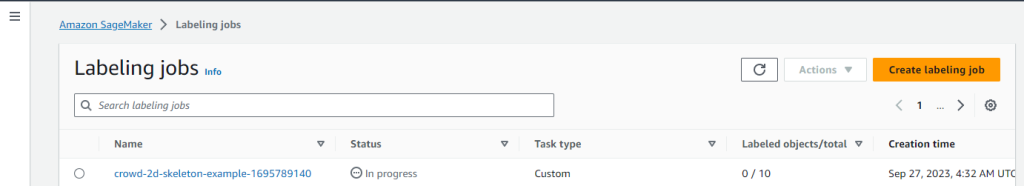

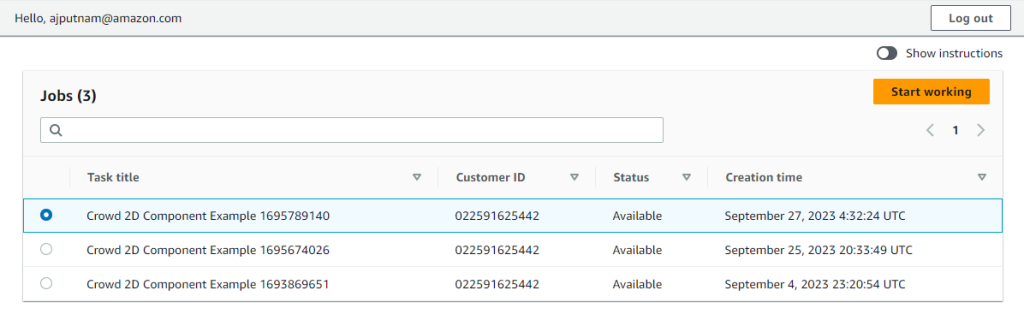

Una vez que haya iniciado el trabajo de etiquetado de ejemplo, aparecerá en la consola de SageMaker y en el portal de personal.

En el portal de fuerza laboral, seleccione el trabajo de etiquetado y elija Empezar a trabajar.

Se le presentará una imagen del conjunto de datos de ejemplo. En este punto, puede utilizar la interfaz de usuario personalizada de crowd-2d-skeleton para anotar las imágenes. Puede familiarizarse con la interfaz de usuario de crowd-2d-skeleton consultando Descripción general de la interfaz de usuario. Usamos la definición de plataforma del Desafío del conjunto de datos de detección de puntos clave de COCO como la plataforma de pose humana. Para reiterar, puede personalizar esto sin nuestro componente de interfaz de usuario personalizado para eliminar o agregar puntos según sus requisitos.

Cuando haya terminado de anotar una imagen, elija Enviar. Esto lo llevará a la siguiente imagen del conjunto de datos hasta que todas las imágenes estén etiquetadas.

Acceder a los resultados del etiquetado

Cuando haya terminado de etiquetar todas las imágenes en el trabajo de etiquetado, SageMaker Ground Truth invocará la función Lambda posterior a la anotación y producirá un archivo output.manifest que contiene todas las anotaciones. Este output.manifest se almacenará en el depósito S3. En nuestro caso, la ubicación del manifiesto de salida debe seguir la ruta URI de S3. s3://<bucket name> /labeling_jobs/output/<labeling job name>/manifests/output/output.manifest. El archivo output.manifest es un archivo de líneas JSON, donde cada línea corresponde a una única imagen y sus anotaciones del personal de etiquetado. Cada elemento de Líneas JSON es un objeto JSON con muchos campos. El campo que nos interesa se llama label-results. El valor de este campo es un objeto que contiene los siguientes campos:

- conjunto de datos_objeto_id – El ID o índice del elemento del manifiesto de entrada

- objeto_datos_s3_uri – El URI de Amazon S3 de la imagen.

- nombre_de_archivo_de_imagen – El nombre del archivo de la imagen.

- imagen_s3_ubicación – La URL de Amazon S3 de la imagen.

- anotaciones_originales – Las anotaciones originales (solo configuradas y utilizadas si estás utilizando un flujo de trabajo previo a la anotación)

- anotaciones_actualizadas – Las anotaciones para la imagen.

- trabajador_id – El trabajador de la plantilla que realizó las anotaciones.

- no_cambios_necesarios – Si se seleccionó la casilla de verificación No se necesitan cambios

- fue modificado – Si los datos de anotación difieren de los datos de entrada originales

- tiempo_total_en_segundos – El tiempo que le tomó al trabajador de la fuerza laboral anotar la imagen.

Con estos campos, puede acceder a los resultados de sus anotaciones para cada imagen y realizar cálculos como el tiempo promedio para etiquetar una imagen.

Crea tus propios trabajos de etiquetado

Ahora que hemos creado un trabajo de etiquetado de ejemplo y comprende el proceso general, lo guiaremos a través del código responsable de crear el archivo de manifiesto e iniciar el trabajo de etiquetado. Nos centramos en las partes clave del script que quizás desee modificar para iniciar sus propios trabajos de etiquetado.

Cubrimos fragmentos de código del create_example_labeling_job.py guión ubicado en el Repositorio GitHub. El script comienza configurando variables que se utilizan más adelante en el script. Algunas de las variables están codificadas para simplificar, mientras que otras, que dependen de la pila, se importarán dinámicamente en tiempo de ejecución obteniendo los valores creados a partir de nuestra pila de AWS CDK.

La primera sección clave de este script es la creación del archivo de manifiesto. Recuerde que el archivo de manifiesto es un archivo de líneas JSON que contiene los detalles de un trabajo de etiquetado de SageMaker Ground Truth. Cada objeto JSON Lines representa un elemento (por ejemplo, una imagen) que debe etiquetarse. Para este flujo de trabajo, el objeto debe contener los siguientes campos:

- fuente-ref – El URI de Amazon S3 de la imagen que desea etiquetar.

- anotaciones – Una lista de objetos de anotación, que se utiliza para flujos de trabajo de anotación previa. Ver el documentación de crowd-2d-skeleton para obtener más detalles sobre los valores esperados.

El script crea una línea de manifiesto para cada imagen en el directorio de imágenes utilizando la siguiente sección de código:

Si desea utilizar imágenes diferentes o apuntar a un directorio de imágenes diferente, puede modificar esa sección del código. Además, si utiliza un flujo de trabajo previo a la anotación, puede actualizar la matriz de anotaciones con una cadena JSON que consta de la matriz y todos sus objetos de anotación. Los detalles del formato de esta matriz están documentados en el documentación de crowd-2d-skeleton.

Con las líneas de pedido del manifiesto ahora creadas, puede crear y cargar el archivo de manifiesto en el depósito S3 que creó anteriormente:

Ahora que ha creado un archivo de manifiesto que contiene las imágenes que desea etiquetar, puede crear un trabajo de etiquetado. Puede crear el trabajo de etiquetado mediante programación utilizando el AWS SDK para Python (Boto3). El código para crear un trabajo de etiquetado es el siguiente:

Los aspectos de este código que quizás quieras modificar son LabelingJobName, TaskTitley TaskDescription. LabelingJobName es el nombre único del trabajo de etiquetado que SageMaker utilizará para hacer referencia a su trabajo. Este es también el nombre que aparecerá en la consola de SageMaker. TaskTitle Tiene un propósito similar, pero no es necesario que sea único y será el nombre del trabajo que aparece en el portal de fuerza laboral. Es posible que desee hacerlos más específicos sobre lo que está etiquetando o para qué sirve el trabajo de etiquetado. Por último, tenemos el TaskDescription campo. Este campo aparece en el portal de la fuerza laboral para proporcionar contexto adicional a los etiquetadores sobre cuál es la tarea, como instrucciones y orientación para la tarea. Para obtener más información sobre estos campos y otros, consulte la documentación create_labeling_job.

Realizar ajustes en la interfaz de usuario

En esta sección, repasamos algunas de las formas en que puede personalizar la interfaz de usuario. La siguiente es una lista de las posibles personalizaciones más comunes de la interfaz de usuario para ajustarla a su tarea de modelado:

- Puede definir qué puntos clave se pueden etiquetar. Esto incluye el nombre del punto clave y su color.

- Puede cambiar la estructura del esqueleto (qué puntos clave están conectados).

- Puede cambiar los colores de las líneas para líneas específicas entre puntos clave específicos.

Todas estas personalizaciones de la interfaz de usuario se pueden configurar a través de argumentos pasados al componente crowd-2d-skeleton, que es el componente JavaScript utilizado en este plantilla de flujo de trabajo personalizada. En esta plantilla, encontrará el uso del componente crowd-2d-skeleton. Una versión simplificada se muestra en el siguiente código:

En el ejemplo de código anterior, puede ver los siguientes atributos en el componente: imgSrc, keypointClasses, skeletonRig, skeletonBoundingBoxy intialValues. Describimos el propósito de cada atributo en las siguientes secciones, pero personalizar la interfaz de usuario es tan sencillo como cambiar los valores de estos atributos, guardar la plantilla y volver a ejecutar el post_deployment_script.py utilizamos anteriormente.

atributo imgSrc

La imgSrc El atributo controla qué imagen mostrar en la interfaz de usuario al etiquetar. Por lo general, se utiliza una imagen diferente para cada elemento de línea del manifiesto, por lo que este atributo a menudo se completa dinámicamente usando la función integrada Líquido lenguaje de plantillas. Puede ver en el ejemplo de código anterior que el valor del atributo está establecido en {{ task.input.image_s3_uri | grant_read_access }}, que es la variable de plantilla de Liquid que será reemplazada por la variable real image_s3_uri valor cuando se procesa la plantilla. El proceso de renderizado comienza cuando el usuario abre una imagen para realizar anotaciones. Este proceso toma una línea de pedido del archivo de manifiesto de entrada y la envía a la función Lambda previa a la anotación como un event.dataObject. La función de anotación previa toma la información que necesita del artículo de línea y devuelve un taskInput diccionario, que luego se pasa al motor de renderizado de Liquid, que reemplazará cualquier variable de Liquid en su plantilla. Por ejemplo, digamos que tiene un archivo de manifiesto con la siguiente línea:

Estos datos se pasarían a la función de preanotación. El siguiente código muestra cómo la función extrae los valores del objeto de evento:

El objeto devuelto por la función en este caso se parecería al siguiente código:

Los datos devueltos por la función luego están disponibles para el motor de plantillas de Liquid, que reemplaza los valores de la plantilla con los valores de datos devueltos por la función. El resultado sería algo como el siguiente código:

atributo keypointClasses

La keypointClasses El atributo define qué puntos clave aparecerán en la interfaz de usuario y serán utilizados por los anotadores. Este atributo toma una cadena JSON que contiene una lista de objetos. Cada objeto representa un punto clave. Cada objeto de punto clave debe contener los siguientes campos:

- id – Un valor único para identificar ese punto clave.

- Color – El color del punto clave representado como un color hexadecimal HTML.

- Label – El nombre o clase de punto clave.

- x – Este atributo opcional solo es necesario si desea utilizar la función de dibujar esqueleto en la interfaz de usuario. El valor de este atributo es la posición x del punto clave en relación con el cuadro delimitador del esqueleto. Este valor generalmente se obtiene mediante el Herramienta Creador de plataforma esqueleto. Si está haciendo anotaciones de puntos clave y no necesita dibujar un esqueleto completo a la vez, puede establecer este valor en 0.

- y – Este atributo opcional es similar a x, pero para la dimensión vertical.

Para obtener más información sobre el keypointClasses atributo, ver el documentación de clases de puntos clave.

atributo esqueletoRig

La skeletonRig El atributo controla qué puntos clave deben tener líneas dibujadas entre ellos. Este atributo toma una cadena JSON que contiene una lista de pares de etiquetas de puntos clave. Cada par informa a la interfaz de usuario entre qué puntos clave trazar líneas. Por ejemplo, '[["left_ankle","left_knee"],["left_knee","left_hip"]]' informa a la interfaz de usuario que dibuje líneas entre "left_ankle" y "left_knee" y trazar líneas entre "left_knee" y "left_hip". Esto puede ser generado por el Herramienta Creador de plataforma esqueleto.

atributo esqueletoBoundingBox

La skeletonBoundingBox El atributo es opcional y solo es necesario si desea utilizar la función de dibujo de esqueleto en la interfaz de usuario. La funcionalidad de dibujar esqueleto es la capacidad de anotar esqueletos completos con una sola acción de anotación. No cubrimos esta característica en esta publicación. El valor de este atributo son las dimensiones del cuadro delimitador del esqueleto. Este valor generalmente se obtiene mediante el Herramienta Creador de plataforma esqueleto. Si está haciendo anotaciones de puntos clave y no necesita dibujar un esqueleto completo a la vez, puede establecer este valor en nulo. Se recomienda utilizar la herramienta Skeleton Rig Creator para obtener este valor.

atributo valores iniciales

La initialValues El atributo se utiliza para rellenar previamente la interfaz de usuario con anotaciones obtenidas de otro proceso (como otro trabajo de etiquetado o modelo de aprendizaje automático). Esto es útil al realizar trabajos de ajuste o revisión. Los datos para este campo generalmente se completan dinámicamente en la misma descripción para el imgSrc atributo. Más detalles se pueden encontrar en el documentación de crowd-2d-skeleton.

Limpiar

Para evitar incurrir en cargos futuros, debe eliminar los objetos de su depósito S3 y eliminar su pila de AWS CDK. Puede eliminar sus objetos S3 a través de la consola de Amazon SageMaker o el Interfaz de línea de comandos de AWS (AWS CLI). Una vez que haya eliminado todos los objetos de S3 en el depósito, puede destruir el AWS CDK ejecutando el siguiente código:

Esto eliminará los recursos que creó anteriormente.

Consideraciones

Es posible que se necesiten pasos adicionales para poner en producción su flujo de trabajo. A continuación se presentan algunas consideraciones según el perfil de riesgo de su organización:

- Agregar acceso y registro de aplicaciones

- Agregar un firewall de aplicaciones web (WAF)

- Ajustar los permisos de IAM para seguir el privilegio mínimo

Conclusión

En esta publicación, compartimos la importancia de la eficiencia y precisión del etiquetado en la creación de conjuntos de datos de estimación de pose. Para ayudar con ambos elementos, mostramos cómo puede utilizar SageMaker Ground Truth para crear flujos de trabajo de etiquetado personalizados para respaldar tareas de etiquetado de poses basadas en esqueletos, con el objetivo de mejorar la eficiencia y la precisión durante el proceso de etiquetado. Mostramos cómo se puede ampliar aún más el código y los ejemplos a varios requisitos de etiquetado de estimación de pose personalizados.

Le recomendamos que utilice esta solución para sus tareas de etiquetado y que contacte a AWS para obtener ayuda o consultas relacionadas con flujos de trabajo de etiquetado personalizados.

Acerca de los autores

Arturo Putnam es un científico de datos Full-Stack en los servicios profesionales de AWS. La experiencia de Arthur se centra en el desarrollo y la integración de tecnologías front-end y back-end en sistemas de inteligencia artificial. Fuera del trabajo, Arthur disfruta explorar los últimos avances en tecnología, pasar tiempo con su familia y disfrutar del aire libre.

Arturo Putnam es un científico de datos Full-Stack en los servicios profesionales de AWS. La experiencia de Arthur se centra en el desarrollo y la integración de tecnologías front-end y back-end en sistemas de inteligencia artificial. Fuera del trabajo, Arthur disfruta explorar los últimos avances en tecnología, pasar tiempo con su familia y disfrutar del aire libre.

ben fenker es un científico de datos sénior en los servicios profesionales de AWS y ha ayudado a los clientes a crear e implementar soluciones de aprendizaje automático en industrias que van desde deportes hasta atención médica y fabricación. Tiene un doctorado. en física de la Universidad de Texas A&M y 6 años de experiencia en la industria. Ben disfruta del béisbol, la lectura y la crianza de sus hijos.

ben fenker es un científico de datos sénior en los servicios profesionales de AWS y ha ayudado a los clientes a crear e implementar soluciones de aprendizaje automático en industrias que van desde deportes hasta atención médica y fabricación. Tiene un doctorado. en física de la Universidad de Texas A&M y 6 años de experiencia en la industria. Ben disfruta del béisbol, la lectura y la crianza de sus hijos.

jarvis lee es un científico de datos sénior de los servicios profesionales de AWS. Ha estado en AWS durante más de seis años, trabajando con clientes en problemas de aprendizaje automático y visión por computadora. Fuera del trabajo, le gusta andar en bicicleta.

jarvis lee es un científico de datos sénior de los servicios profesionales de AWS. Ha estado en AWS durante más de seis años, trabajando con clientes en problemas de aprendizaje automático y visión por computadora. Fuera del trabajo, le gusta andar en bicicleta.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/skeleton-based-pose-annotation-labeling-using-amazon-sagemaker-ground-truth/

- :posee

- :es

- :no

- :dónde

- $ UP

- 1

- 10

- 100

- 13

- 15%

- 17

- 2D

- 31

- 320

- 7

- 8

- 9

- a

- capacidad

- Poder

- de la máquina

- accesible

- Mi Cuenta

- la exactitud

- preciso

- precisamente

- adquirir

- adquisición

- a través de

- la columna Acción

- hechos

- real

- add

- Adicionales

- Adicionalmente

- del Riesgo

- ajustes

- avances

- Después

- AI

- Sistemas de IA

- Con el objetivo

- Todos

- permitir

- permite

- también

- Amazon

- Amazon SageMaker

- Verdad fundamental de Amazon SageMaker

- Amazon Web Services

- an

- y

- animales

- Otra

- cualquier

- Aparecer

- aparece

- Aplicación

- aplicaciones

- aplicada

- arquitectura

- somos

- argumento

- argumentos

- en torno a

- Formación

- Arturo

- AS

- aspectos

- asigna

- Ayuda

- asume

- At

- atributos

- aumentado

- Realidad Aumentada

- automáticamente

- Hoy Disponibles

- promedio

- evitar

- AWS

- Servicios profesionales de AWS

- Back-end

- Béisbol

- basado

- Base

- BE

- porque

- esto

- antes

- comenzar

- "Ser"

- bien

- entre

- ambas

- Box

- general

- cada navegador

- build

- Construir la

- incorporado

- carga

- pero

- by

- cálculos

- , que son

- PUEDEN

- estudiar cuidadosamente

- case

- CD

- centrado

- el cambio

- Cambios

- cambio

- cargos

- comprobar

- Elige

- clase

- limpiador

- Cli

- cliente

- código

- Color

- proviene

- Algunos

- completar

- componente

- componentes

- Compuesto

- computadora

- Visión por computador

- conectado

- consideraciones

- consistente

- Que consiste

- Consola

- que no contengo

- contiene

- contexto

- controles

- corresponde

- Cost

- Protectora

- Para crear

- creado

- crea

- Creamos

- creación

- creador

- crítico

- cruce

- multitud

- personalizado

- Custom-construido

- Clientes

- personalización

- personalizan

- datos

- proceso de datos

- científico de datos

- conjuntos de datos

- datetime

- profundo

- deep learning

- más profundo

- definir

- se define

- Define

- definición

- demostrar

- dependiente

- Dependiente

- depende

- desplegar

- desplegado

- describir

- descripción

- diseñado

- diseño

- deseado

- destruir

- detalle

- detalles

- Detección

- el desarrollo

- diagrama

- una experiencia diferente

- Dimensiones

- dimensiones

- directamente

- directorio

- inmersión

- diverso

- do

- No

- "Hacer"

- hecho

- No

- Descargas

- dibujar

- dibujado

- dos

- durante

- dinamicamente

- cada una

- Más temprano

- facilidad

- pasan fácilmente

- eficacia

- eficiencia

- fomentar

- y conseguir de esta manera

- Motor

- mejorar

- disfrutar

- asegura

- Entretenimiento

- Todo

- Entorno

- error

- Errores

- Incluso

- Evento

- examinar

- ejemplo

- ejemplos

- Expandir

- esperado

- experience

- Experiencia

- Explicar

- Explorar

- ampliar

- extra

- Extractos

- familiar

- familiarizar

- familia

- Feature

- Caracteristicas

- campo

- Terrenos

- Archive

- archivos

- final

- Encuentre

- cortafuegos

- Nombre

- Flexibilidad

- Focus

- seguir

- siguiendo

- siguiente

- Fútbol

- formato

- encontrado

- Desde

- función

- a la fatiga

- funciones

- fundamental

- promover

- futuras

- generado

- obtener

- gif

- GitHub

- Donar

- Go

- Polo a Tierra

- guía

- Manijas

- Tienen

- es

- he

- la salud

- fuertemente

- ayuda

- ayudado

- serviciales

- ayuda

- esta página

- HEX

- alta calidad

- su

- fortaleza

- organizado

- hosting

- Cómo

- Como Hacer

- HTML

- http

- HTTPS

- humana

- Cientos

- ID

- no haber aun identificado una solucion para el problema

- Identifique

- identificar

- Identidad

- if

- imagen

- imágenes

- importancia

- importante

- mejorar

- mejorado

- in

- incluye

- Incorporado

- índice

- industrias

- energético

- ineficiente

- influenciado

- información

- Informa

- iniciativas

- Las opciones de entrada

- Consultas

- instalar

- Instrucciones

- Integración

- intereses

- interesado

- Interfaz

- Internet

- dentro

- implica

- IT

- artículos

- SUS

- JavaScript

- Trabajos

- Empleo

- jpg

- json

- Clave

- Detección de punto clave

- Niños

- Label

- etiquetado

- Etiquetas

- idioma

- large

- Finalmente

- luego

- más reciente

- lanzamiento

- lanzado

- lanzamiento

- líder

- APRENDE:

- aprendizaje

- menos

- Permíteme

- como

- línea

- líneas

- Líquido

- Lista

- situados

- Ubicación

- log

- conectado

- Mira

- parece

- máquina

- máquina de aprendizaje

- hecho

- para lograr

- gestionan

- manual

- Fabricación

- muchos

- marca

- marcado

- Puede..

- Quizas

- Medios

- servicios

- Aplicaciones médicas

- metadatos

- minimizar

- errores

- ML

- modelo

- modelado

- modelos

- Modificaciones

- modificar

- más,

- MEJOR DE TU

- nombre

- Naturaleza

- necesario

- ¿ Necesita ayuda

- Next

- no

- nota

- ahora

- objeto

- objetos

- obtenido

- obtención

- of

- a menudo

- on

- una vez

- ONE

- en línea

- , solamente

- habiertos

- de código abierto

- abre

- or

- solicite

- para las fiestas.

- natural

- reconocida por

- OS

- Otro

- Otros

- "nuestr

- salir

- al exterior

- salida

- afuera

- Más de

- total

- EL DESARROLLADOR

- paquetes

- par

- pares

- parte

- partes

- pasado

- camino

- Personas

- actuación

- permisos

- Física

- Colocar

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- punto

- puntos

- política

- poblado

- Portal

- plantear

- Estimación de poses

- plantea

- posición

- Publicación

- posible

- anterior

- Precisión

- requisitos previos

- presentó

- presentación

- evitar

- evita

- anterior

- previamente

- principio

- privada

- problemas

- en costes

- tratamiento

- producir

- Profesional

- Mi Perfil

- proporcionar

- previsto

- proporciona un

- público

- propósito

- fines

- Python

- calidad

- con rapidez

- elevar

- distancia

- que van

- Leer

- Reading

- ready

- mundo real

- Realidad

- reconocer

- recomendado

- la reducción de

- remitir

- referencia

- relacionado

- relativo

- confianza

- permanecer

- remove

- prestados

- representación

- reemplazar

- reemplazados

- repositorio

- representado

- representa

- Requisitos

- Requisitos

- requiere

- Recursos

- respuesta

- responsable

- restricciones

- resultado

- Resultados

- volvemos

- devoluciones

- una estrategia SEO para aparecer en las búsquedas de Google.

- equitación

- aparejo

- Riesgo

- robótica

- robusto

- Función

- Ejecutar

- correr

- tiempo de ejecución

- sabio

- mismo

- muestra

- ahorro

- dices

- escenarios

- Científico

- guión

- guiones

- Sdk

- Sección

- (secciones)

- EN LINEA

- ver

- selecciona

- envía

- mayor

- sirve

- Servicios

- set

- pólipo

- Varios

- compartido

- tienes

- Mostrar

- mostró

- mostrado

- Shows

- importante

- similares

- sencillos

- sencillez

- simplificado

- simplemente

- soltero

- SEIS

- So

- a medida

- Soluciones

- algo

- algo

- Fuente

- especial

- soluciones y

- específicamente

- Gastos

- Deportes

- montón

- comienza

- pasos

- STORAGE

- tienda

- almacenados

- sencillo

- aerodinamizar

- Cordón

- estructura

- sustancial

- tal

- SOPORTE

- intercambio

- permutas

- te

- Todas las funciones a su disposición

- ¡Prepárate!

- toma

- afectados

- Tarea

- tareas

- la técnica

- Tecnologías

- Tecnología

- plantilla

- tener

- Texas

- esa

- La

- la información

- La línea

- su

- Les

- luego

- de este modo

- por lo tanto

- Estas

- ellos

- así

- miles

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- Atado

- equipo

- a

- se

- del IRS

- Entrenar

- entrenado

- Formación

- desencadenados

- camión

- verdadero

- verdad

- GIRO

- típicamente

- ui

- entender

- único

- universidad

- hasta

- Actualizar

- Uso

- utilizan el

- usado

- eficiente

- Usuario

- Interfaz de usuario

- usos

- usando

- generalmente

- propuesta de

- Valores

- variable

- variaciones

- diversos

- Vehículos

- versión

- vertical

- vía

- Videos

- visión

- visual

- volumen

- W

- caminar

- camina

- tutorial

- quieres

- fue

- Camino..

- formas

- we

- web

- Aplicación web

- navegador web

- servicios web

- WELL

- ¿

- cuando

- mientras

- sean

- que

- mientras

- QUIENES

- seguirá

- deseo

- dentro de

- sin

- Actividades:

- obrero

- flujo de trabajo

- flujos de trabajo

- Empleados

- trabajando

- se

- la escritura

- X

- años

- Usted

- tú

- a ti mismo

- zephyrnet