En el panorama de la atención médica actual, que evoluciona rápidamente, los médicos se enfrentan a grandes cantidades de datos clínicos de diversas fuentes, como notas del cuidador, registros de salud electrónicos e informes de imágenes. Esta gran cantidad de información, si bien es esencial para la atención del paciente, también puede ser abrumadora y llevar mucho tiempo para que los profesionales médicos la examinen y la analicen. Resumir y extraer información de manera eficiente de estos datos es crucial para mejorar la atención al paciente y la toma de decisiones. La información resumida del paciente puede ser útil para una serie de procesos posteriores, como la agregación de datos, la codificación efectiva de pacientes o la agrupación de pacientes con diagnósticos similares para su revisión.

Los modelos de inteligencia artificial (IA) y aprendizaje automático (ML) se han mostrado muy prometedores para abordar estos desafíos. Los modelos se pueden entrenar para analizar e interpretar grandes volúmenes de datos de texto, condensando efectivamente la información en resúmenes concisos. Al automatizar el proceso de resumen, los médicos pueden acceder rápidamente a información relevante, lo que les permite concentrarse en la atención del paciente y tomar decisiones más informadas. Ver lo siguiente ejemplo para obtener más información sobre un caso de uso del mundo real.

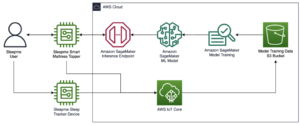

Amazon SageMaker, un servicio de ML completamente administrado, proporciona una plataforma ideal para alojar e implementar varios modelos y enfoques de resumen basados en IA/ML. En esta publicación, exploramos diferentes opciones para implementar técnicas de resumen en SageMaker, incluido el uso JumpStart de Amazon SageMaker modelos básicos, ajuste fino de modelos preentrenados de Hugging Face y creación de modelos de resumen personalizados. También discutimos los pros y los contras de cada enfoque, lo que permite a los profesionales de la salud elegir la solución más adecuada para generar resúmenes concisos y precisos de datos clínicos complejos.

Dos términos importantes que debe conocer antes de comenzar: pre-entrenado y sintonia FINA. Un modelo básico o preentrenado es uno que se ha creado y entrenado en un gran corpus de datos, generalmente para el conocimiento general del idioma. El ajuste fino es el proceso mediante el cual un modelo previamente entrenado recibe otro conjunto de datos más específico del dominio para mejorar su rendimiento en una tarea específica. En un entorno de atención médica, esto significaría darle al modelo algunos datos, incluidas frases y terminología relacionada específicamente con la atención del paciente.

Cree modelos de resumen personalizados en SageMaker

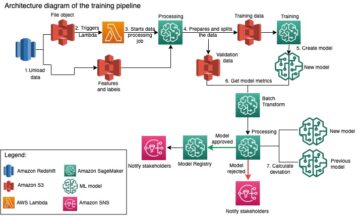

Aunque es el enfoque de mayor esfuerzo, algunas organizaciones pueden preferir crear modelos de resumen personalizados en SageMaker desde cero. Este enfoque requiere un conocimiento más profundo de los modelos AI/ML y puede implicar la creación de una arquitectura de modelo desde cero o la adaptación de modelos existentes para satisfacer necesidades específicas. La creación de modelos personalizados puede ofrecer una mayor flexibilidad y control sobre el proceso de resumen, pero también requiere más tiempo y recursos en comparación con los enfoques que parten de modelos previamente entrenados. Es esencial sopesar cuidadosamente las ventajas y desventajas de esta opción antes de continuar, ya que puede no ser adecuada para todos los casos de uso.

Modelos básicos de SageMaker JumpStart

Una excelente opción para implementar resúmenes en SageMaker es usar modelos básicos de JumpStart. Estos modelos, desarrollados por organizaciones líderes en investigación de IA, ofrecen una gama de modelos de lenguaje preentrenados optimizados para diversas tareas, incluido el resumen de texto. SageMaker JumpStart proporciona dos tipos de modelos básicos: modelos propietarios y modelos de código abierto. SageMaker JumpStart también brinda elegibilidad de HIPAA, lo que lo hace útil para las cargas de trabajo de atención médica. En última instancia, depende del cliente garantizar el cumplimiento, así que asegúrese de tomar las medidas adecuadas. Ver Arquitectura para la seguridad y el cumplimiento de HIPAA en Amazon Web Services para más información.

Modelos de cimientos patentados

Los modelos patentados, como los modelos Jurassic de AI21 y el modelo Cohere Generate de Cohere, se pueden descubrir a través de SageMaker JumpStart en el Consola de administración de AWS y actualmente se encuentran en versión preliminar. La utilización de modelos patentados para el resumen es ideal cuando no necesita ajustar su modelo en datos personalizados. Esto ofrece una solución fácil de usar y lista para usar que puede cumplir con sus requisitos de resumen con una configuración mínima. Al utilizar las capacidades de estos modelos preentrenados, puede ahorrar tiempo y recursos que, de otro modo, se gastarían en entrenar y ajustar un modelo personalizado. Además, los modelos propietarios generalmente vienen con API y SDK fáciles de usar, lo que simplifica el proceso de integración con sus sistemas y aplicaciones existentes. Si sus necesidades de resúmenes pueden satisfacerse con modelos patentados previamente entrenados sin necesidad de personalización específica o ajuste fino, ofrecen una solución conveniente, rentable y eficiente para sus tareas de resúmenes de texto. Debido a que estos modelos no están capacitados específicamente para casos de uso de atención médica, no se puede garantizar la calidad para el lenguaje médico listo para usar sin un ajuste fino.

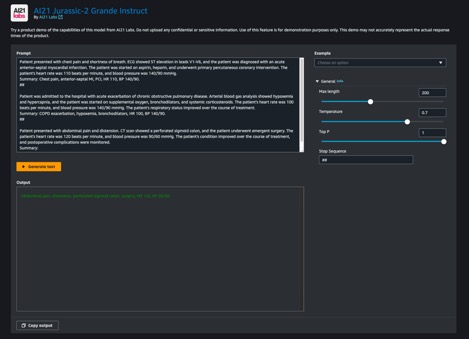

Jurassic-2 Grande Instruct es un modelo de lenguaje grande (LLM) de AI21 Labs, optimizado para instrucciones en lenguaje natural y aplicable a varias tareas de lenguaje. Ofrece una API y un SDK de Python fáciles de usar, que equilibran la calidad y la asequibilidad. Los usos populares incluyen la generación de copias de marketing, la activación de chatbots y el resumen de texto.

En la consola de SageMaker, vaya a SageMaker JumpStart, busque el modelo AI21 Jurassic-2 Grande Instruct y elija Probar modelo.

Si desea implementar el modelo en un extremo de SageMaker que administra, puede seguir los pasos de este ejemplo. cuaderno, que le muestra cómo implementar Jurassic-2 Large con SageMaker.

Modelos básicos de código abierto

Los modelos de código abierto incluyen modelos FLAN T5, Bloom y GPT-2 que se pueden descubrir a través de SageMaker JumpStart en el Estudio Amazon SageMaker Interfaz de usuario, SageMaker JumpStart en la consola de SageMaker y las API de SageMaker JumpStart. Estos modelos se pueden ajustar e implementar en los puntos finales de su cuenta de AWS, lo que le otorga la propiedad total de los pesos del modelo y los códigos de script.

Flan-T5 XL es un modelo potente y versátil diseñado para una amplia gama de tareas lingüísticas. Al ajustar el modelo con los datos específicos de su dominio, puede optimizar su rendimiento para su caso de uso particular, como el resumen de texto o cualquier otra tarea de NLP. Para obtener detalles sobre cómo ajustar Flan-T5 XL con la interfaz de usuario de SageMaker Studio, consulte Ajuste de instrucciones para FLAN T5 XL con Amazon SageMaker Jumpstart.

Ajuste fino de modelos previamente entrenados con Hugging Face en SageMaker

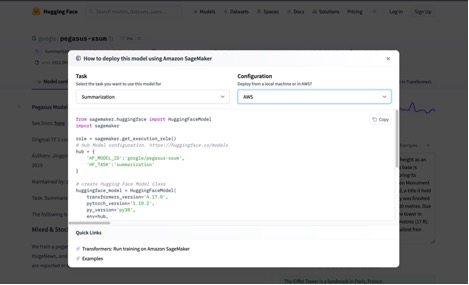

Una de las opciones más populares para implementar resúmenes en SageMaker es ajustar modelos previamente entrenados usando Hugging Face. Transformers biblioteca. Hugging Face proporciona una amplia gama de modelos de transformadores preentrenados diseñados específicamente para diversas tareas de procesamiento de lenguaje natural (NLP), incluido el resumen de texto. Con la biblioteca Hugging Face Transformers, puede ajustar fácilmente estos modelos previamente entrenados en los datos específicos de su dominio usando SageMaker. Este enfoque tiene varias ventajas, como tiempos de capacitación más rápidos, mejor rendimiento en dominios específicos y un empaquetado e implementación de modelos más sencillos utilizando las herramientas y los servicios integrados de SageMaker. Si no puede encontrar un modelo adecuado en SageMaker JumpStart, puede elegir cualquier modelo ofrecido por Hugging Face y ajustarlo con SageMaker.

Para comenzar a trabajar con un modelo para conocer las capacidades de ML, todo lo que necesita hacer es abrir SageMaker Studio, buscar un modelo previamente entrenado que desee usar en el Hub modelo de cara abrazaday elija SageMaker como su método de implementación. Hugging Face te dará el código para copiar, pegar y ejecutar en tu cuaderno. ¡Es tan fácil como eso! No se requiere experiencia en ingeniería de ML.

La biblioteca Hugging Face Transformers permite a los constructores operar en los modelos previamente entrenados y realizar tareas avanzadas como ajustes, que exploramos en las siguientes secciones.

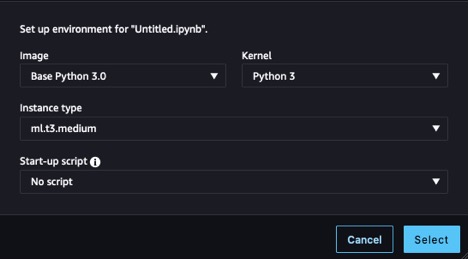

Aprovisionar recursos

Antes de que podamos comenzar, necesitamos aprovisionar un cuaderno. Para obtener instrucciones, consulte los pasos 1 y 2 en Cree y entrene un modelo de aprendizaje automático localmente. Para este ejemplo, usamos la configuración que se muestra en la siguiente captura de pantalla.

También tenemos que crear un Servicio de almacenamiento simple de Amazon (Amazon S3) cubo para almacenar los datos de entrenamiento y los artefactos de entrenamiento. Para obtener instrucciones, consulte Crear un cubo.

Preparar el conjunto de datos

Para ajustar nuestro modelo para tener un mejor conocimiento del dominio, necesitamos obtener datos adecuados para la tarea. Al capacitar para un caso de uso empresarial, deberá realizar una serie de tareas de ingeniería de datos para preparar sus propios datos para que estén listos para la capacitación. Esas tareas están fuera del alcance de esta publicación. Para este ejemplo, generamos algunos datos sintéticos para emular notas de enfermería y los almacenamos en Amazon S3. Almacenar nuestros datos en Amazon S3 nos permite diseñar nuestras cargas de trabajo para el cumplimiento de HIPAA. Comenzamos por obtener esas notas y cargarlas en la instancia donde se ejecuta nuestro cuaderno:

Las notas se componen de una columna que contiene la entrada completa, nota, y una columna que contiene una versión abreviada que ejemplifica cuál debería ser nuestro resultado deseado, resumen. El propósito de usar este conjunto de datos es mejorar el vocabulario biológico y médico de nuestro modelo para que esté más en sintonía con el resumen en un contexto de atención médica, llamado ajuste de dominio, y muestre a nuestro modelo cómo estructurar su salida resumida. En algunos casos de resumen, es posible que deseemos crear un resumen de un artículo o una sinopsis de una línea de una revisión, pero en este caso, estamos tratando de que nuestro modelo genere una versión abreviada de los síntomas y las acciones realizadas. para un paciente hasta ahora.

Cargar el modelo

El modelo que usamos como base es una versión de Pegasus de Google, disponible en Hugging Face Hub, llamado pegaso-xsum. Ya está pre-entrenado para resumir, por lo que nuestro proceso de ajuste puede enfocarse en ampliar su conocimiento de dominio. Modificar la tarea que ejecuta nuestro modelo es un tipo diferente de ajuste fino que no se cubre en esta publicación. La biblioteca Transformer nos proporciona una clase para cargar la definición del modelo desde nuestro model_checkpoint: google/pegasus-xsum. Esto cargará el modelo desde el concentrador y lo instanciará en nuestro cuaderno para que podamos usarlo más adelante. Porque pegasus-xsum es un modelo de secuencia a secuencia, queremos usar el tipo Seq2Seq del Automodelo clase:

Ahora que tenemos nuestro modelo, es hora de poner nuestra atención en los otros componentes que nos permitirán ejecutar nuestro ciclo de entrenamiento.

Crear un tokenizador

El primero de estos componentes es el tokenizador. Tokenization es el proceso por el cual las palabras de los datos de entrada se transforman en representaciones numéricas que nuestro modelo puede comprender. Una vez más, la biblioteca de Transformer proporciona una clase para que carguemos una definición de tokenizador desde el mismo punto de control que usamos para instanciar el modelo:

Con este objeto tokenizador, podemos crear una función de preprocesamiento y mapearla en nuestro conjunto de datos para brindarnos tokens listos para ingresar al modelo. Finalmente, formateamos la salida tokenizada y eliminamos las columnas que contienen nuestro texto original, porque el modelo no podrá interpretarlas. Ahora nos queda una entrada tokenizada lista para introducirse en el modelo. Ver el siguiente código:

Con nuestros datos tokenizados y nuestro modelo instanciado, estamos casi listos para ejecutar un ciclo de entrenamiento. Los siguientes componentes que queremos crear son el recopilador de datos y el optimizador. El recopilador de datos es otra clase proporcionada por Hugging Face a través de la biblioteca de Transformers, que usamos para crear lotes de nuestros datos tokenizados para el entrenamiento. Podemos construir esto fácilmente usando el tokenizador y los objetos de modelo que ya tenemos simplemente encontrando el tipo de clase correspondiente que hemos usado previamente para nuestro modelo (Seq2Seq) para la clase de intercalación. La función del optimizador es mantener el estado de entrenamiento y actualizar los parámetros en función de nuestra pérdida de entrenamiento a medida que avanzamos en el bucle. Para crear un optimizador, podemos importar el optimo paquete del módulo de la antorcha, donde están disponibles una serie de algoritmos de optimización. Algunos de los más comunes que puede haber encontrado antes son el descenso de gradiente estocástico y Adam, el último de los cuales se aplica en nuestro ejemplo. El constructor de Adam toma los parámetros del modelo y la tasa de aprendizaje parametrizada para la ejecución de entrenamiento dada. Ver el siguiente código:

Los últimos pasos antes de que podamos comenzar a entrenar son construir el acelerador y el programador de tasa de aprendizaje. El acelerador proviene de una biblioteca diferente (hemos estado usando principalmente Transformers) producida por Hugging Face, acertadamente llamada Accelerate, y abstraerá la lógica necesaria para administrar dispositivos durante el entrenamiento (usando múltiples GPU, por ejemplo). Para el componente final, volvemos a visitar la siempre útil biblioteca de Transformers para implementar nuestro programador de tasa de aprendizaje. Al especificar el tipo de programador, el número total de pasos de entrenamiento en nuestro ciclo y el optimizador creado previamente, el get_scheduler La función devuelve un objeto que nos permite ajustar nuestra tasa de aprendizaje inicial a lo largo del proceso de entrenamiento:

¡Ya estamos completamente preparados para el entrenamiento! Configuremos un trabajo de entrenamiento, empezando por instanciar el entrenamiento_args usando la biblioteca de Transformers y eligiendo valores de parámetros. Podemos pasarlos, junto con nuestros otros componentes y conjuntos de datos preparados, directamente al entrenador y comience a entrenar, como se muestra en el siguiente código. Según el tamaño de su conjunto de datos y los parámetros elegidos, esto puede llevar una cantidad significativa de tiempo.

Empaquetar el modelo para la inferencia

Una vez que se ha ejecutado el entrenamiento, el objeto modelo está listo para usarse para la inferencia. Como práctica recomendada, guardemos nuestro trabajo para uso futuro. Necesitamos crear nuestros artefactos modelo, comprimirlos juntos y cargar nuestro tarball en Amazon S3 para su almacenamiento. Para preparar nuestro modelo para comprimirlo, debemos desenvolver el modelo ahora ajustado y luego guardar el modelo binario y los archivos de configuración asociados. También necesitamos guardar nuestro tokenizador en el mismo directorio en el que guardamos los artefactos de nuestro modelo para que esté disponible cuando usemos el modelo para la inferencia. Nuestro model_dir La carpeta ahora debería verse como el siguiente código:

Todo lo que queda es ejecutar un comando tar para comprimir nuestro directorio y cargar el archivo tar.gz en Amazon S3:

Nuestro modelo recién ajustado ahora está listo y disponible para ser utilizado para la inferencia.

Realizar inferencia

Para usar este artefacto modelo para la inferencia, abra un nuevo archivo y use el siguiente código, modificando el model_data parámetro para adaptarse a la ubicación de guardado de su artefacto en Amazon S3. El HuggingFaceModel constructor reconstruirá nuestro modelo desde el punto de control que guardamos en model.tar.gz, que luego podemos implementar para la inferencia usando el método de implementación. La implementación del punto final llevará unos minutos.

Después de implementar el punto final, podemos usar el predictor que hemos creado para probarlo. Pasa el predict método una carga útil de datos y ejecute la celda, y obtendrá la respuesta de su modelo ajustado:

Para ver el beneficio de ajustar un modelo, hagamos una prueba rápida. La siguiente tabla incluye un aviso y los resultados de pasar ese aviso al modelo antes y después del ajuste fino.

| Rápido | Respuesta sin ajuste fino | Respuesta con ajuste fino |

| Resumir los síntomas que el paciente está experimentando. El paciente es un hombre de 45 años que se queja de dolor torácico retroesternal que se irradia al brazo izquierdo. El dolor es de inicio repentino mientras estaba trabajando en el jardín, asociado con dificultad respiratoria leve y diaforesis. A su llegada, la frecuencia cardíaca del paciente era 120, frecuencia respiratoria 24, presión arterial 170/95. Electrocardiograma de 12 derivaciones realizado a la llegada a urgencias y administración de tres nitroglicerinas sublinguales sin alivio del dolor torácico. El electrocardiograma muestra una elevación del ST en las derivaciones anteriores que demuestra un infarto agudo de miocardio anterior. Nos hemos puesto en contacto con el laboratorio de cateterismo cardíaco y la preparación para el cateterismo cardíaco por parte del cardiólogo. | Presentamos un caso de infarto agudo de miocardio. | Dolor torácico, IM anterior, ICP. |

Como puede ver, nuestro modelo perfeccionado usa la terminología de salud de manera diferente y hemos podido cambiar la estructura de la respuesta para que se ajuste a nuestros propósitos. Tenga en cuenta que los resultados dependen de su conjunto de datos y de las elecciones de diseño realizadas durante el entrenamiento. Su versión del modelo podría ofrecer resultados muy diferentes.

Limpiar

Cuando haya terminado con su computadora portátil SageMaker, asegúrese de apagarla para evitar los costos de los recursos de ejecución prolongada. Tenga en cuenta que cerrar la instancia hará que pierda todos los datos almacenados en la memoria efímera de la instancia, por lo que debe guardar todo su trabajo en un almacenamiento persistente antes de la limpieza. También tendrá que ir a la Endpoints en la consola de SageMaker y elimine los puntos finales implementados para la inferencia. Para eliminar todos los artefactos, también debe ir a la consola de Amazon S3 para eliminar los archivos cargados en su depósito.

Conclusión

En esta publicación, exploramos varias opciones para implementar técnicas de resumen de texto en SageMaker para ayudar a los profesionales de la salud a procesar y extraer información de forma eficiente de grandes cantidades de datos clínicos. Hablamos sobre el uso de modelos básicos de SageMaker Jumpstart, el ajuste fino de modelos previamente entrenados de Hugging Face y la creación de modelos de resumen personalizados. Cada enfoque tiene sus propias ventajas y desventajas, y satisface diferentes necesidades y requisitos.

La creación de modelos de resumen personalizados en SageMaker permite una gran flexibilidad y control, pero requiere más tiempo y recursos que el uso de modelos previamente entrenados. Los modelos básicos de SageMaker Jumpstart brindan una solución rentable y fácil de usar para las organizaciones que no requieren una personalización o un ajuste fino específicos, así como algunas opciones para un ajuste fino simplificado. El ajuste fino de los modelos preentrenados de Hugging Face ofrece tiempos de entrenamiento más rápidos, un mejor rendimiento específico del dominio y una integración perfecta con las herramientas y los servicios de SageMaker en un amplio catálogo de modelos, pero requiere cierto esfuerzo de implementación. Al momento de escribir esta publicación, Amazon ha anunciado otra opción, lecho rocoso del amazonas, que ofrecerá capacidades de resumen en un entorno aún más administrado.

Al comprender los pros y los contras de cada enfoque, los profesionales de la salud y las organizaciones pueden tomar decisiones informadas sobre la solución más adecuada para generar resúmenes concisos y precisos de datos clínicos complejos. En última instancia, el uso de modelos de resumen basados en IA/ML en SageMaker puede mejorar significativamente la atención al paciente y la toma de decisiones al permitir que los profesionales médicos accedan rápidamente a información relevante y se concentren en brindar atención de calidad.

Recursos

Para ver el script completo discutido en esta publicación y algunos datos de muestra, consulte el Repositorio GitHub. Para obtener más información sobre cómo ejecutar cargas de trabajo de ML en AWS, consulte los siguientes recursos:

Sobre los autores

codycollins es un arquitecto de soluciones con sede en Nueva York en Amazon Web Services. Trabaja con clientes ISV para crear soluciones líderes en la industria en la nube. Ha entregado con éxito proyectos complejos para diversas industrias, optimizando la eficiencia y la escalabilidad. En su tiempo libre, disfruta leer, viajar y entrenar jiu-jitsu.

codycollins es un arquitecto de soluciones con sede en Nueva York en Amazon Web Services. Trabaja con clientes ISV para crear soluciones líderes en la industria en la nube. Ha entregado con éxito proyectos complejos para diversas industrias, optimizando la eficiencia y la escalabilidad. En su tiempo libre, disfruta leer, viajar y entrenar jiu-jitsu.

Ameer Hakme es un arquitecto de soluciones de AWS que reside en Pensilvania. Su enfoque profesional consiste en colaborar con proveedores de software independientes en todo el noreste, guiándolos en el diseño y la construcción de plataformas escalables y de última generación en la nube de AWS.

Ameer Hakme es un arquitecto de soluciones de AWS que reside en Pensilvania. Su enfoque profesional consiste en colaborar con proveedores de software independientes en todo el noreste, guiándolos en el diseño y la construcción de plataformas escalables y de última generación en la nube de AWS.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Automoción / vehículos eléctricos, Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- Desplazamientos de bloque. Modernización de la propiedad de compensaciones ambientales. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- :posee

- :es

- :no

- :dónde

- $ UP

- 1

- 10

- 100

- 12

- 14

- 15%

- 24

- 33

- 7

- 8

- 9

- a

- Poder

- Nuestra Empresa

- RESUMEN

- acelerar

- acelerador

- de la máquina

- Mi Cuenta

- preciso

- a través de

- acciones

- Adam

- direccionamiento

- administrado

- avanzado

- ventajas

- Después

- de nuevo

- agregación

- AI

- ai investigación

- AI / ML

- algoritmos

- Todos

- Permitir

- permite

- a lo largo de

- ya haya utilizado

- también

- Amazon

- Amazon SageMaker

- Amazon Web Services

- cantidad

- cantidades

- an

- analizar

- y

- anunció

- Otra

- cualquier

- abejas

- API

- aplicable

- aplicaciones

- aplicada

- enfoque

- enfoques

- adecuado

- arquitectura

- somos

- ARM

- llegada

- artículo

- AS

- asociado

- At

- automatizar

- Hoy Disponibles

- evitar

- lejos

- AWS

- equilibrio

- basado

- BE

- porque

- esto

- antes

- comenzar

- es el beneficio

- beneficios

- MEJOR

- mejores

- BIN

- sangre

- Presión sanguínea

- Florecer (bloom)

- Box

- Aliento

- general

- build

- constructores

- Construir la

- construido

- incorporado

- pero

- by

- llamar al

- , que son

- PUEDEN

- capacidades

- servicios sociales

- estudiar cuidadosamente

- case

- cases

- catalogar

- Causa

- retos

- el cambio

- Chatbots

- opciones

- Elige

- la elección de

- elegido

- clase

- Clínico

- Soluciones

- código

- los códigos de

- Codificación

- colaborar

- Columna

- Columnas

- cómo

- proviene

- Algunos

- en comparación con

- quejas

- integraciones

- compliance

- componente

- componentes

- compuesto

- conciso

- Configuración

- Desventajas

- Consola

- construcción

- contexto

- control

- Conveniente

- Correspondiente

- rentable

- Precio

- podría

- cubierto

- Para crear

- creado

- Creamos

- crucial

- En la actualidad

- personalizado

- cliente

- Clientes

- personalización

- datos

- conjuntos de datos

- Toma de Decisiones

- decisiones

- definición

- liberado

- vas demostrando

- Departamento

- dependiente

- Dependiente

- desplegar

- desplegado

- Desplegando

- despliegue

- Diseño

- diseñado

- diseño

- deseado

- detalles

- desarrollado

- Dispositivos

- una experiencia diferente

- directamente

- descubierto CRISPR

- discutir

- discutido

- diverso

- do

- Doctores

- "Hacer"

- dominio

- dominios

- hecho

- No

- DE INSCRIPCIÓN

- inconvenientes

- durante

- cada una

- más fácil

- pasan fácilmente

- de forma sencilla

- fácil de usar

- de manera eficaz

- eficiencia

- eficiente

- eficiente.

- esfuerzo

- Electronic

- Registros electrónicos de salud

- elegibilidad

- Emergencia Dental

- habilitar

- permite

- permitiendo

- Punto final

- Ingeniería

- mejorar

- garantizar

- Empresa

- entrada

- Entorno

- época

- esencial

- Incluso

- evolución

- ejemplo

- existente

- experience

- experimentando

- explorar

- explorado

- Explorar

- extensión

- extraerlos

- Cara

- enfrentado

- muchos

- más rápida

- Fed

- pocos

- Archive

- archivos

- final

- Finalmente

- Encuentre

- la búsqueda de

- Nombre

- cómodo

- Flexibilidad

- Focus

- seguir

- siguiendo

- formato

- Fundación

- Desde

- ser completados

- completamente

- función

- Además

- futuras

- Obtén

- General

- generar

- generado

- la generación de

- obtener

- conseguir

- Donar

- dado

- Diezmos y Ofrendas

- Go

- De Google

- GPU

- maravillosa

- mayor

- garantia

- Tienen

- he

- Salud

- la salud

- Corazón

- ayuda

- su

- hosting

- Cómo

- Como Hacer

- HTML

- http

- HTTPS

- Bujes

- AbrazandoCara

- ideal

- if

- Proyección de imagen

- implementar

- implementación

- implementación

- importar

- importante

- mejorar

- in

- a fondo

- incluir

- incluye

- Incluye

- independientes

- industrias

- energético

- información

- informó

- inicial

- Las opciones de entrada

- entradas

- Insights

- ejemplo

- Instrucciones

- integración

- Intelligence

- dentro

- involucrar

- IT

- SUS

- Trabajos

- json

- solo

- Saber

- especialistas

- el lab

- labs

- paisaje

- idioma

- large

- Apellidos

- luego

- Lead

- líder

- Prospectos

- APRENDE:

- aprendizaje

- izquierda

- Biblioteca

- como

- LLM

- carga

- carga

- Ubicación

- lógica

- Mira

- perder

- de

- máquina

- máquina de aprendizaje

- hecho

- mantener

- para lograr

- Realizar

- gestionan

- gestionado

- Management

- mapa

- Marketing

- Puede..

- personalizado

- servicios

- Conoce a

- Salud Cerebral

- las etiquetas

- Método

- podría

- mínimo

- Min

- ML

- modelo

- modelos

- Módulo

- más,

- MEJOR DE TU

- Más popular

- múltiples

- Llamado

- Natural

- Procesamiento natural del lenguaje

- Navegar

- ¿ Necesita ayuda

- Nuevo

- New York

- recién

- Next

- nlp

- no

- cuaderno

- Notas

- ahora

- número

- objeto

- objetos

- of

- LANZAMIENTO

- Ofrecido

- Ofertas

- Viejo

- on

- ONE

- las

- comienzo

- sobre

- habiertos

- de código abierto

- funcionar

- optimización

- Optimización

- optimizado

- optimizando

- Optión

- Opciones

- or

- solicite

- para las fiestas.

- reconocida por

- Otro

- de otra manera

- "nuestr

- salir

- salida

- afuera

- Más de

- EL DESARROLLADOR

- propiedad

- paquete

- embalaje

- página

- Dolor

- parámetro

- parámetros

- particular

- pass

- Pasando (Paso)

- paciente

- los pacientes

- Pegasus

- Pennsylvania

- actuación

- a respecto a

- frases

- plataforma

- Plataformas

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- punto

- Popular

- Publicación

- poderoso

- Alimentación

- Predictor

- preferir

- Preparar

- preparado

- presente

- presión

- Vista previa

- previamente

- las cuales

- en costes

- tratamiento

- producido

- Profesional

- profesionales

- proyecta

- PROMETEMOS

- propietario

- PROS

- proporcionar

- previsto

- proporciona un

- proporcionando

- provisión

- propósito

- fines

- poner

- Python

- calidad

- Búsqueda

- con rapidez

- distancia

- rápidamente

- Rate

- Reading

- ready

- mundo real

- archivos

- alivio

- remove

- Informes

- exigir

- Requisitos

- Requisitos

- requiere

- la investigación

- Recursos

- respuesta

- Resultados

- devoluciones

- una estrategia SEO para aparecer en las búsquedas de Google.

- Función

- Ejecutar

- correr

- corre

- sabio

- mismo

- Guardar

- Escalabilidad

- escalable

- alcance

- rayar

- Sdk

- SDK

- sin costura

- (secciones)

- EN LINEA

- ver

- separado

- de coches

- Servicios

- set

- pólipo

- ajustes

- Varios

- acortado

- tienes

- Mostrar

- mostrado

- Shows

- cerrar

- Tamizar

- importante

- significativamente

- similares

- sencillos

- simplificado

- Tamaño

- So

- hasta aquí

- Software

- a medida

- Soluciones

- algo

- algo

- Fuentes

- soluciones y

- específicamente

- gastado

- comienzo

- Comience a

- Estado

- el estado de la técnica

- pasos

- STORAGE

- tienda

- almacenados

- almacenamiento

- racionalización

- estructura

- estudio

- sublingual

- Con éxito

- tal

- repentino

- siguiente

- adecuado

- RESUMEN

- seguro

- Síntomas

- sinopsis

- sintético

- datos sintéticos

- Todas las funciones a su disposición

- mesa

- ¡Prepárate!

- toma

- toma

- Tarea

- tareas

- técnicas

- terminología

- términos

- test

- que

- esa

- La

- el centro

- Les

- luego

- Estas

- ellos

- así

- aquellos

- Tres

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- a lo largo de

- equipo

- prolongado

- veces

- a

- de hoy

- juntos

- tokenized

- Tokens

- antorcha

- Total

- Entrenar

- entrenado

- Formación

- transformado

- transformador

- transformers

- Viajar

- dos

- tipo

- tipos

- típicamente

- ui

- Finalmente, a veces

- incapaz

- bajo

- entender

- comprensión

- Actualizar

- subido

- us

- utilizan el

- caso de uso

- usado

- fácil de utilizar

- usos

- usando

- Utilizando

- validación

- Valores

- diversos

- Vasto

- vendedores

- versátil

- versión

- muy

- volúmenes

- quieres

- fue

- we

- Gestión de Patrimonio

- web

- servicios web

- pesar

- WELL

- ¿

- cuando

- que

- mientras

- amplio

- Amplia gama

- seguirá

- sin

- palabras

- Actividades:

- trabajando

- funciona

- se

- la escritura

- año

- york

- Usted

- tú

- zephyrnet

- Zip