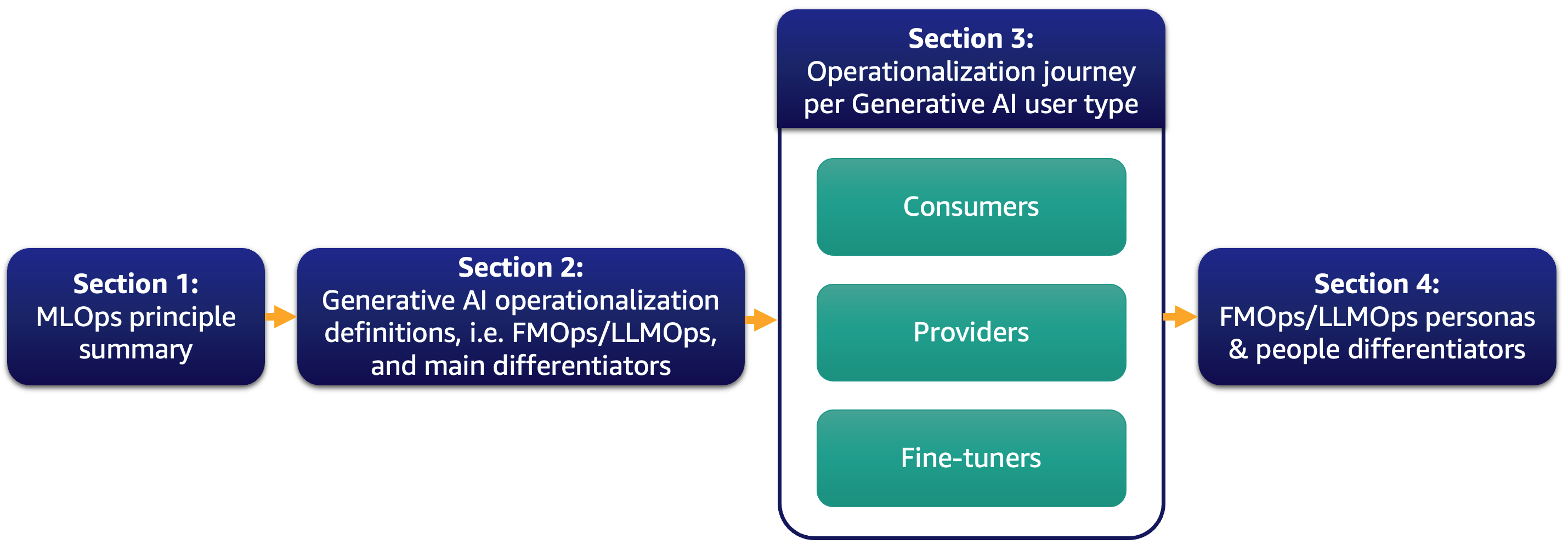

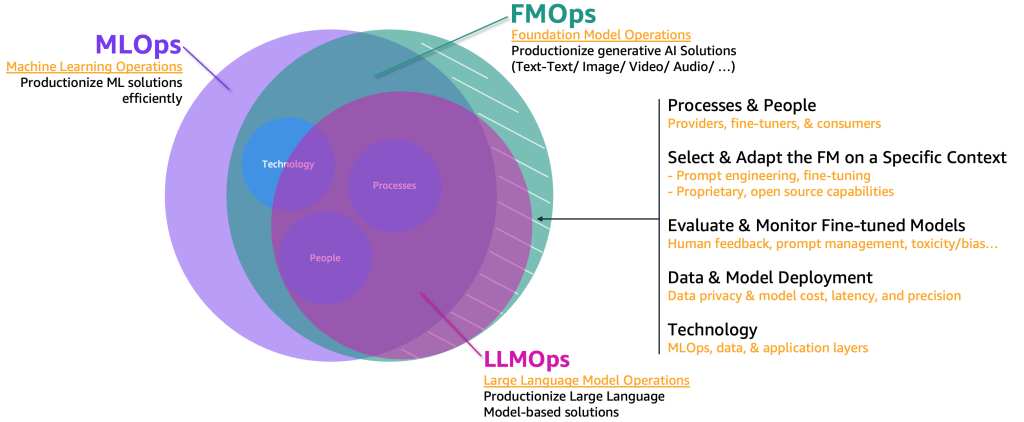

Hoy en día, la mayoría de nuestros clientes están entusiasmados con los grandes modelos de lenguaje (LLM) y piensan en cómo la IA generativa podría transformar su negocio. Sin embargo, llevar estas soluciones y modelos a las operaciones habituales no es una tarea fácil. En esta publicación, analizamos cómo poner en funcionamiento aplicaciones de IA generativa utilizando principios MLOps que conducen a operaciones del modelo básico (FMOps). Además, profundizamos en el caso de uso de IA generativa más común de aplicaciones de texto a texto y operaciones LLM (LLMOps), un subconjunto de FMOps. La siguiente figura ilustra los temas que discutimos.

Específicamente, presentamos brevemente los principios de MLOps y nos centramos en los principales diferenciadores en comparación con FMOps y LLMOps con respecto a procesos, personas, selección y evaluación de modelos, privacidad de datos e implementación de modelos. Esto se aplica a los clientes que los utilizan de forma inmediata, crean modelos de base desde cero o los ajustan. Nuestro enfoque se aplica por igual tanto a los modelos de código abierto como a los propietarios.

Resumen de operacionalización de ML

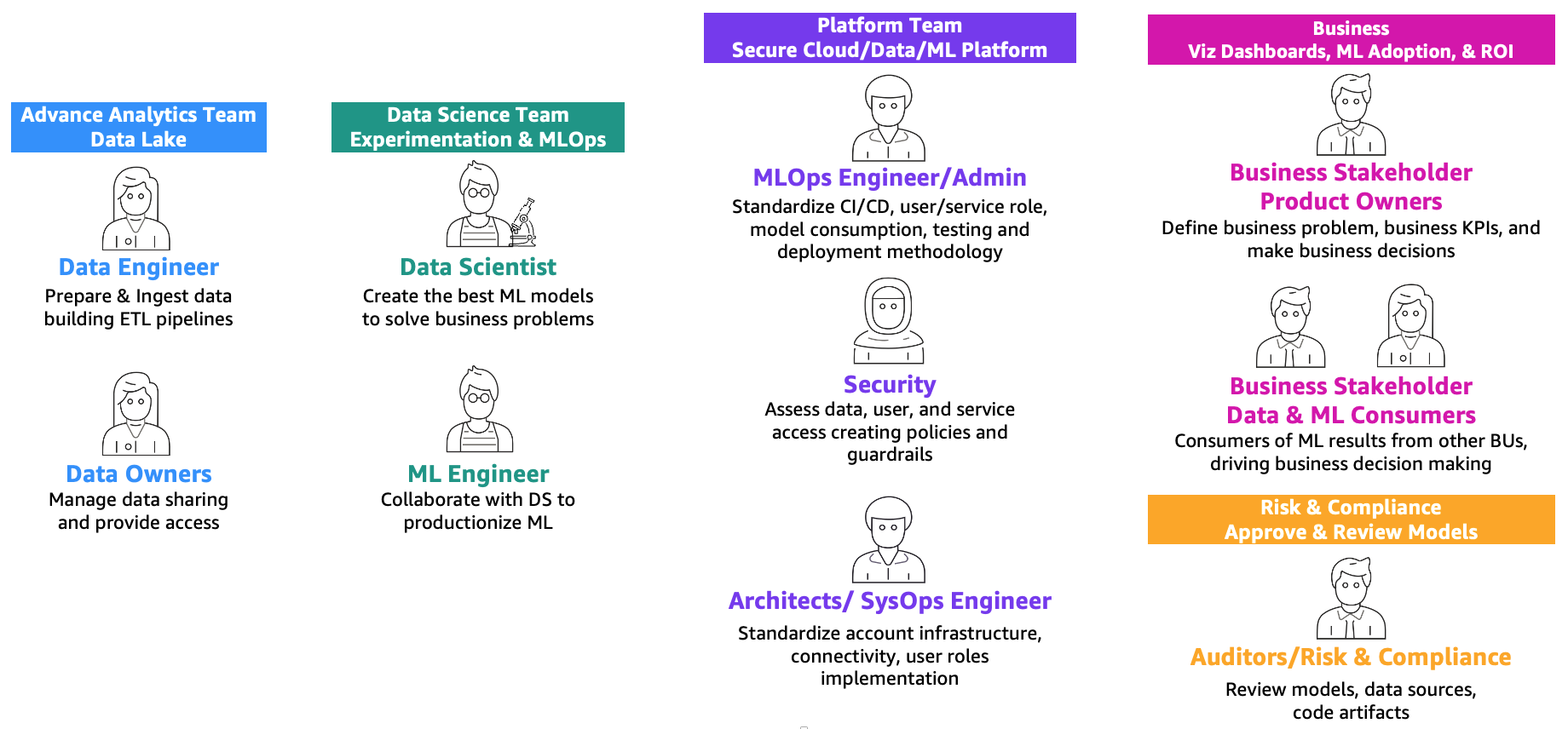

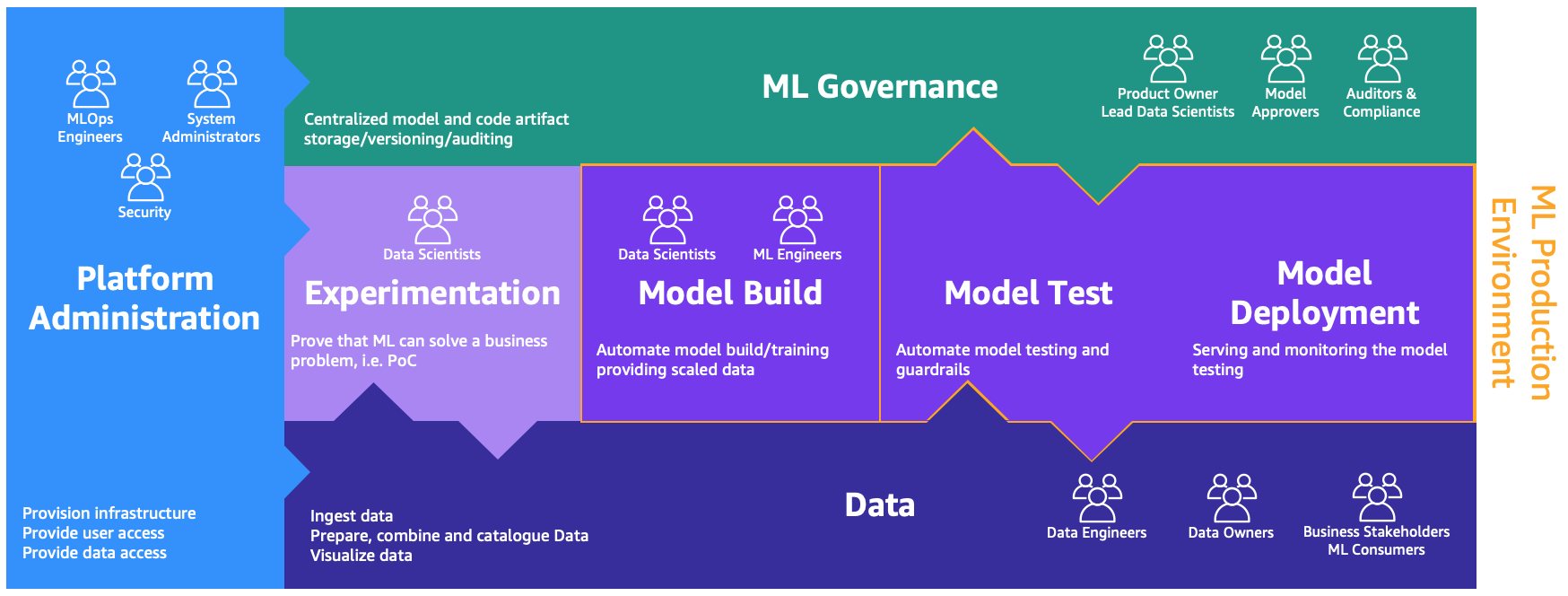

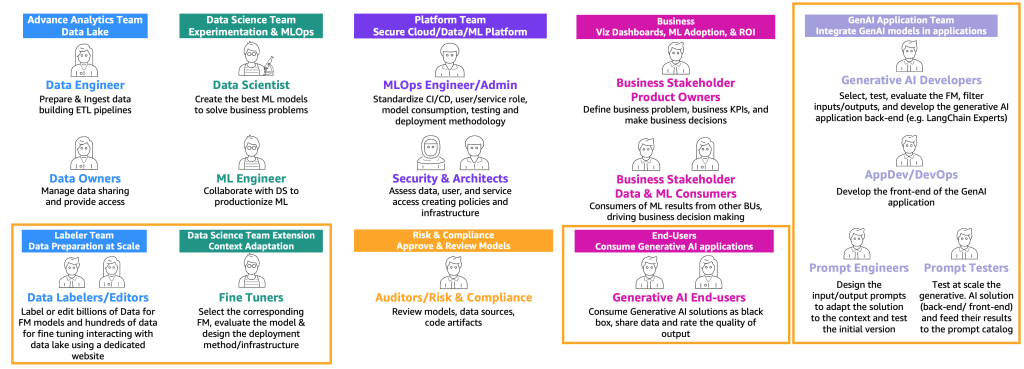

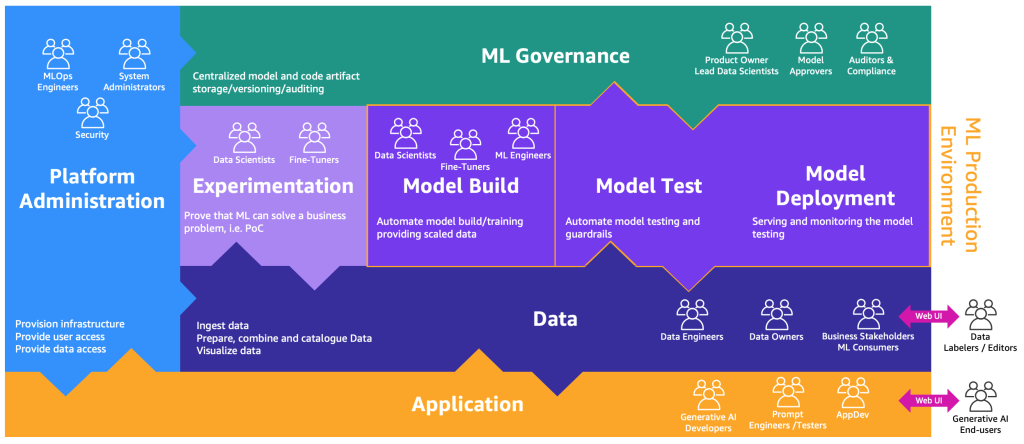

Como se define en la publicación. Hoja de ruta básica de MLOps para empresas con Amazon SageMaker, ML y operaciones (MLOps) es la combinación de personas, procesos y tecnología para producir soluciones de aprendizaje automático (ML) de manera eficiente. Para lograr esto, es necesario colaborar una combinación de equipos y personas, como se ilustra en la siguiente figura.

Estos equipos son los siguientes:

- Equipo de análisis avanzado (lago de datos y malla de datos) – Los ingenieros de datos son responsables de preparar e ingerir datos de múltiples fuentes, crear canales ETL (extraer, transformar y cargar) para seleccionar y catalogar los datos y preparar los datos históricos necesarios para los casos de uso de ML. Estos propietarios de datos se centran en brindar acceso a sus datos a múltiples unidades o equipos de negocios.

- equipo de ciencia de datos – Los científicos de datos deben centrarse en crear el mejor modelo basado en indicadores clave de rendimiento (KPI) predefinidos que funcionan en portátiles. Después de completar la fase de investigación, los científicos de datos deben colaborar con los ingenieros de ML para crear automatizaciones para construir (canalizaciones de ML) e implementar modelos en producción utilizando canalizaciones de CI/CD.

- Equipo de negocios – El propietario del producto es responsable de definir el caso de negocio, los requisitos y los KPI que se utilizarán para evaluar el rendimiento del modelo. Los consumidores de ML son otras partes interesadas del negocio que utilizan los resultados de la inferencia (predicciones) para impulsar decisiones.

- equipo de la plataforma – Los arquitectos son responsables de la arquitectura general de la nube de la empresa y de cómo se conectan entre sí los diferentes servicios. Seguridad Las PYMES revisan la arquitectura en función de las políticas y necesidades de seguridad del negocio. Los ingenieros de MLOps son responsables de proporcionar un entorno seguro para que los científicos de datos y los ingenieros de ML produzcan los casos de uso de ML. Específicamente, son responsables de estandarizar las canalizaciones de CI/CD, los roles de usuarios y servicios y la creación de contenedores, el consumo de modelos, las pruebas y la metodología de implementación en función de los requisitos comerciales y de seguridad.

- Equipo de riesgo y cumplimiento – Para entornos más restrictivos, los auditores son responsables de evaluar los datos, el código y los artefactos del modelo y asegurarse de que la empresa cumpla con las regulaciones, como la privacidad de los datos.

Tenga en cuenta que la misma persona puede cubrir varias personas según la escala y la madurez de MLOps de la empresa.

Estas personas necesitan entornos dedicados para realizar los diferentes procesos, como se ilustra en la siguiente figura.

Los ambientes son los siguientes:

- Administración de plataforma – El entorno de administración de la plataforma es el lugar donde el equipo de la plataforma tiene acceso para crear cuentas de AWS y vincular los usuarios y datos correctos.

- Datos – La capa de datos, a menudo conocida como lago de datos o malla de datos, es el entorno que los ingenieros o propietarios de datos y las partes interesadas del negocio utilizan para preparar, interactuar y visualizar los datos.

- Experimentación – Los científicos de datos utilizan un entorno de pruebas o de experimentación para probar nuevas bibliotecas y técnicas de aprendizaje automático para demostrar que su prueba de concepto puede resolver problemas comerciales.

- Construcción de modelos, prueba de modelos, implementación de modelos. – El entorno de creación, prueba e implementación del modelo es la capa de MLOps, donde los científicos de datos y los ingenieros de ML colaboran para automatizar y llevar la investigación a producción.

- Gobernanza del aprendizaje automático – La última pieza del rompecabezas es el entorno de gobierno de ML, donde todos los artefactos de modelo y código son almacenados, revisados y auditados por las personas correspondientes.

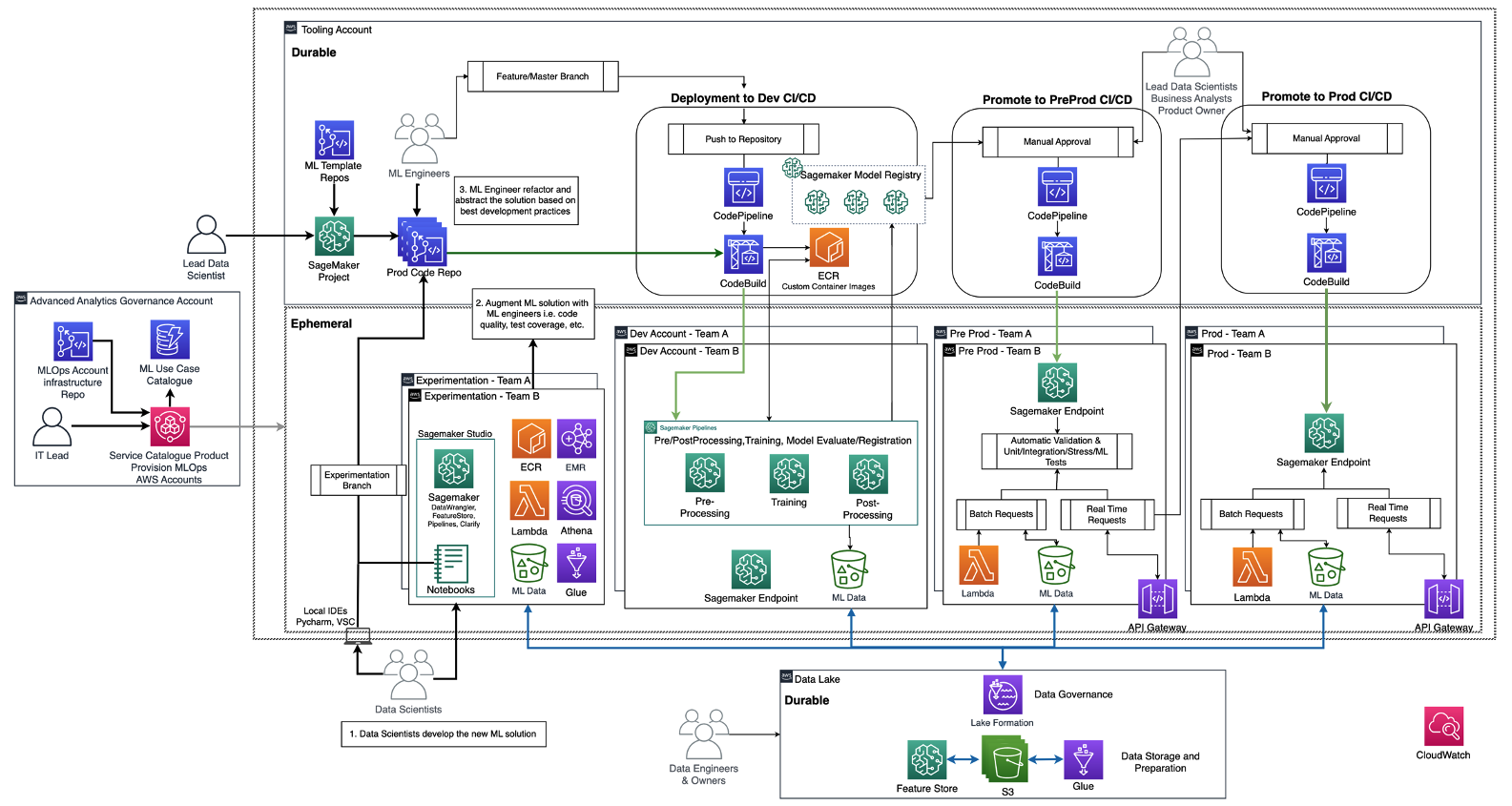

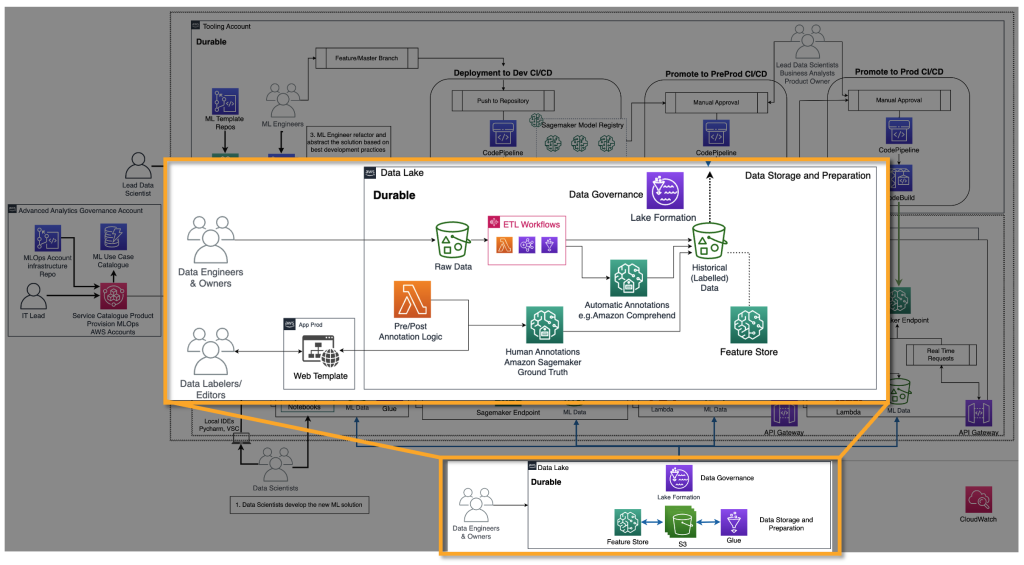

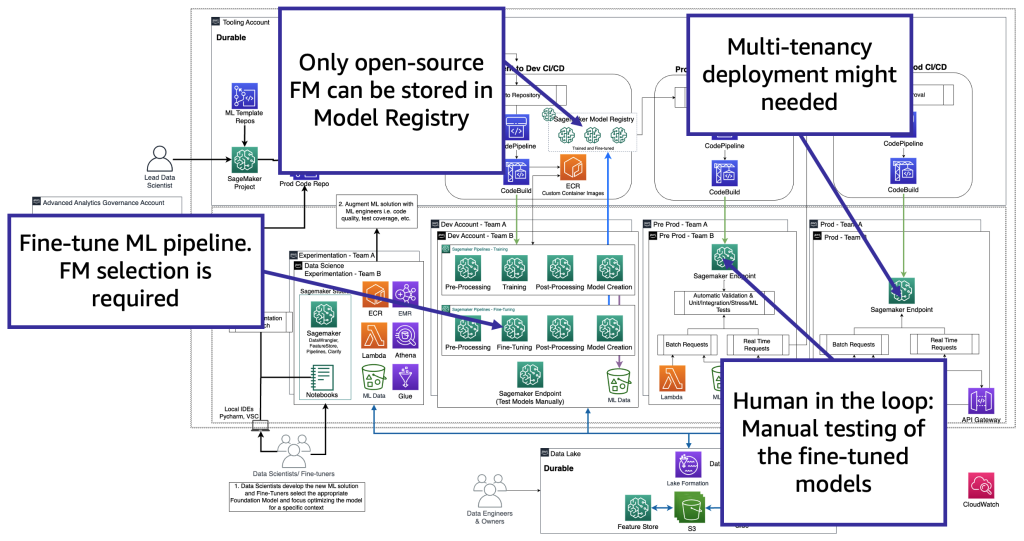

El siguiente diagrama ilustra la arquitectura de referencia, que ya se ha analizado en Hoja de ruta básica de MLOps para empresas con Amazon SageMaker.

Cada unidad de negocio tiene su propio conjunto de cuentas de desarrollo (formación y creación de modelos automatizados), preproducción (pruebas automáticas) y producción (implementación y servicio de modelos) para producir casos de uso de ML, que recuperan datos de un lago de datos o datos centralizados o descentralizados. malla, respectivamente. Todos los modelos producidos y la automatización del código se almacenan en una cuenta de herramientas centralizada utilizando la capacidad de un registro de modelos. El código de infraestructura para todas estas cuentas está versionado en una cuenta de servicio compartida (cuenta de gobernanza de análisis avanzado) que el equipo de la plataforma puede abstraer, crear plantillas, mantener y reutilizar para la incorporación a la plataforma MLOps de cada nuevo equipo.

Definiciones de IA generativa y diferencias con MLOps

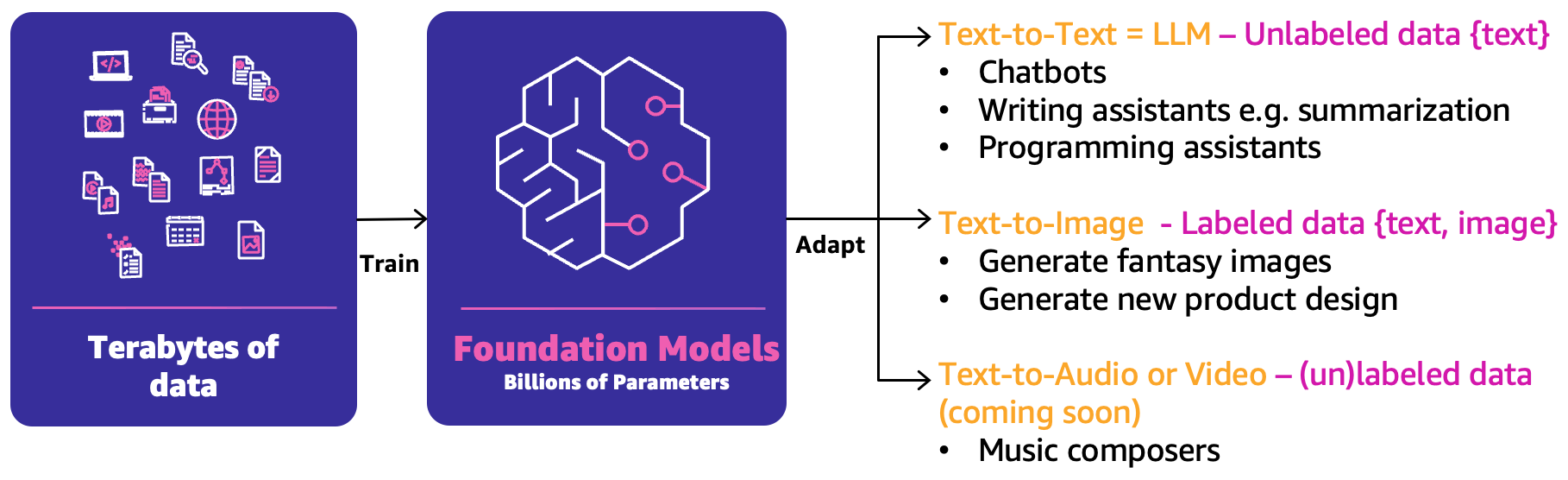

En el ML clásico, la combinación anterior de personas, procesos y tecnología puede ayudarle a producir sus casos de uso de ML. Sin embargo, en la IA generativa, la naturaleza de los casos de uso requiere una extensión de esas capacidades o nuevas capacidades. Una de estas nuevas nociones es el modelo fundacional (FM). Se llaman así porque pueden usarse para crear una amplia gama de otros modelos de IA, como se ilustra en la siguiente figura.

Los FM han sido entrenados en base a terabytes de datos y tienen cientos de miles de millones de parámetros para poder predecir la siguiente mejor respuesta en función de tres categorías principales de casos de uso de IA generativa:

- Texto a texto – Los FM (LLM) han sido entrenados en base a datos sin etiquetar (como texto libre) y son capaces de predecir la siguiente mejor palabra o secuencia de palabras (párrafos o ensayos largos). Los principales casos de uso se relacionan con chatbots de apariencia humana, resúmenes u otra creación de contenido, como código de programación.

- Texto a imagen – Datos etiquetados, como pares de , se ha utilizado para entrenar FM, que son capaces de predecir la mejor combinación de píxeles. Ejemplos de casos de uso son la generación de diseño de ropa o imágenes personalizadas imaginarias.

- Texto a audio o vídeo – Se pueden utilizar datos tanto etiquetados como no etiquetados para el entrenamiento de FM. Un ejemplo principal de caso de uso de IA generativa es la composición musical.

Para producir esos casos de uso de IA generativa, necesitamos tomar prestado y ampliar el dominio MLOps para incluir lo siguiente:

- Operaciones FM (FMOps) – Esto puede producir soluciones de IA generativa, incluido cualquier tipo de caso de uso.

- Operaciones LLM (LLMOps) – Este es un subconjunto de FMOps que se centra en la producción de soluciones basadas en LLM, como texto a texto.

La siguiente figura ilustra la superposición de estos casos de uso.

En comparación con los clásicos ML y MLOps, FMOps y LLMOps se basan en cuatro categorías principales que cubrimos en las siguientes secciones: personas y procesos, selección y adaptación de FM, evaluación y monitoreo de FM, privacidad de datos e implementación de modelos, y necesidades tecnológicas. Cubriremos el monitoreo en una publicación separada.

Viaje de operacionalización por tipo de usuario de IA generativa

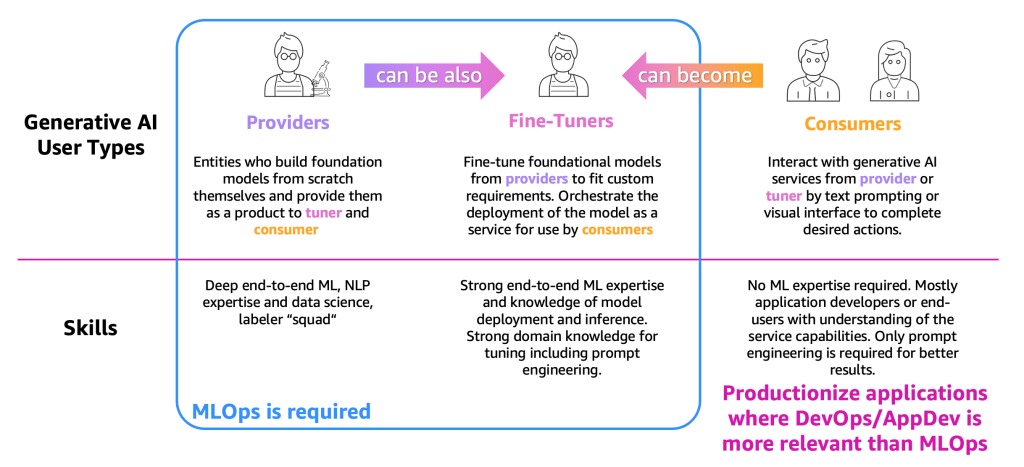

Para simplificar la descripción de los procesos, necesitamos categorizar los principales tipos de usuarios de IA generativa, como se muestra en la siguiente figura.

Los tipos de usuarios son los siguientes:

- Los proveedores – Usuarios que construyen FM desde cero y los proporcionan como producto a otros usuarios (afinadores y consumidores). Tienen una profunda experiencia en aprendizaje automático y procesamiento de lenguaje natural (NLP) de extremo a extremo y habilidades en ciencia de datos, y equipos masivos de etiquetado y edición de datos.

- Afinadores – Usuarios que vuelven a capacitar (afinar) los FM de los proveedores para que se ajusten a los requisitos personalizados. Orquestan el despliegue del modelo como un servicio para uso de los consumidores. Estos usuarios necesitan una sólida experiencia en ciencia de datos y aprendizaje automático de extremo a extremo y conocimientos sobre la implementación e inferencia de modelos. También se requiere un sólido conocimiento del dominio para el ajuste, incluida la ingeniería rápida.

- Clientes – Usuarios que interactúan con servicios de IA generativa de proveedores o ajustadores mediante mensajes de texto o una interfaz visual para completar las acciones deseadas. No se requiere experiencia en ML, pero, sobre todo, desarrolladores de aplicaciones o usuarios finales que comprendan las capacidades del servicio. Sólo es necesaria una ingeniería rápida para obtener mejores resultados.

Según la definición y la experiencia en ML requerida, MLOps es necesario principalmente para proveedores y ajustadores, mientras que los consumidores pueden usar principios de producción de aplicaciones, como DevOps y AppDev para crear aplicaciones de IA generativas. Además, hemos observado un movimiento entre los tipos de usuarios, donde los proveedores podrían convertirse en sintonizadores para respaldar casos de uso basados en una vertical específica (como el sector financiero) o los consumidores podrían convertirse en sintonizadores para lograr resultados más precisos. Pero observemos los principales procesos por tipo de usuario.

El viaje de los consumidores

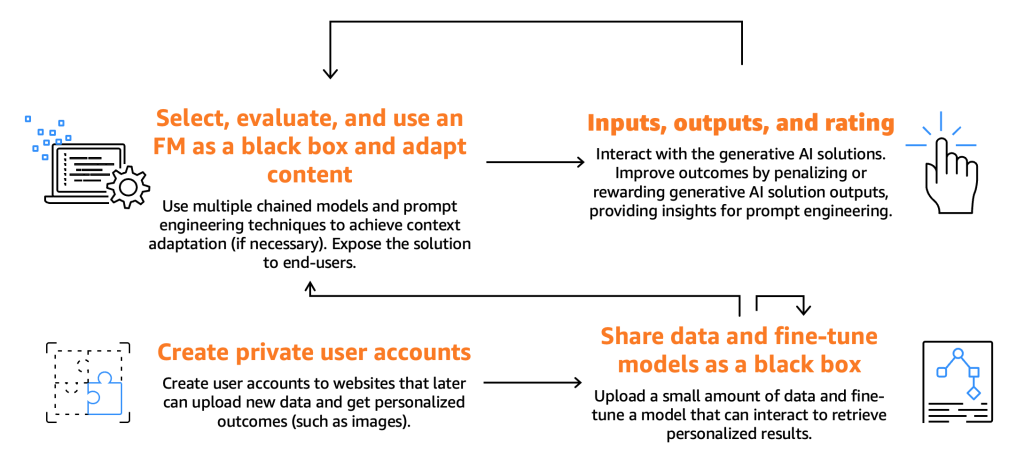

La siguiente figura ilustra el recorrido del consumidor.

Como se mencionó anteriormente, los consumidores deben seleccionar, probar y usar un FM, interactuando con él proporcionando entradas específicas, también conocidas como ideas. Las indicaciones, en el contexto de la programación informática y la inteligencia artificial, se refieren a la entrada que se proporciona a un modelo o sistema para generar una respuesta. Esto puede ser en forma de texto, comando o pregunta, que el sistema utiliza para procesar y generar un resultado. Los resultados generados por el FM pueden luego ser utilizados por los usuarios finales, quienes también deberían poder calificar estos resultados para mejorar las respuestas futuras del modelo.

Más allá de estos procesos fundamentales, hemos notado que los consumidores expresan el deseo de perfeccionar un modelo aprovechando la funcionalidad que ofrecen los optimizadores. Tomemos, por ejemplo, un sitio web que genera imágenes. Aquí, los usuarios finales pueden configurar cuentas privadas, cargar fotos personales y posteriormente generar contenido relacionado con esas imágenes (por ejemplo, generar una imagen que muestre al usuario final en una motocicleta empuñando una espada o ubicado en un lugar exótico). En este escenario, la aplicación de IA generativa, diseñada por el consumidor, debe interactuar con el backend del sintonizador a través de API para ofrecer esta funcionalidad a los usuarios finales.

Sin embargo, antes de profundizar en eso, concentrémonos primero en el proceso de selección, prueba, uso, interacción de entrada y salida y calificación del modelo, como se muestra en la siguiente figura.

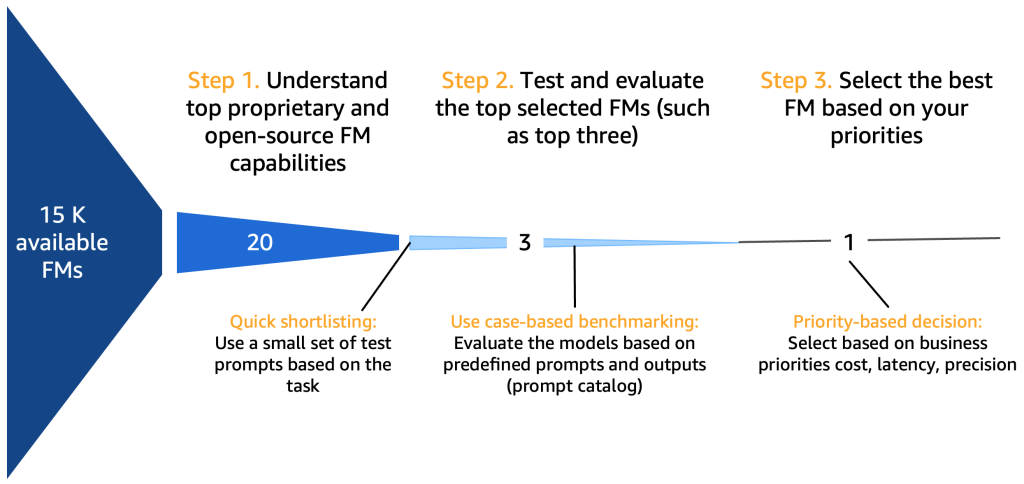

*Referencia FM disponible de 15K

Paso 1. Comprender las principales capacidades de FM

Hay muchas dimensiones que deben considerarse al seleccionar modelos de cimientos, según el caso de uso, los datos disponibles, las regulaciones, etc. Una buena lista de verificación, aunque no exhaustiva, podría ser la siguiente:

- FM propietario o de código abierto – Los modelos propietarios a menudo tienen un costo financiero, pero generalmente ofrecen un mejor rendimiento (en términos de calidad del texto o imagen generado), y a menudo son desarrollados y mantenidos por equipos dedicados de proveedores de modelos que garantizan un rendimiento y confiabilidad óptimos. Por otro lado, también vemos la adopción de modelos de código abierto que, además de ser gratuitos, ofrecen beneficios adicionales de ser accesibles y flexibles (por ejemplo, cada modelo de código abierto se puede ajustar). Un ejemplo de modelo propietario es el modelo Claude de Anthropic, y un ejemplo de modelo de código abierto de alto rendimiento es Falcon-40B, a partir de julio de 2023.

- Licencia comercial – Las consideraciones sobre la licencia son cruciales a la hora de decidirse por un FM. Es importante tener en cuenta que algunos modelos son de código abierto pero no se pueden utilizar con fines comerciales debido a restricciones o condiciones de licencia. Las diferencias pueden ser sutiles: el recién lanzado xgen-7b-8k-base El modelo, por ejemplo, es de código abierto y utilizable comercialmente (licencia Apache-2.0), mientras que la versión mejorada del modelo con instrucciones xgen-7b-8k-inst solo se publica con fines de investigación. Al seleccionar un FM para una aplicación comercial, es esencial verificar el acuerdo de licencia, comprender sus limitaciones y asegurarse de que se ajuste al uso previsto del proyecto.

- parámetros – El número de parámetros, que consisten en los pesos y sesgos de la red neuronal, es otro factor clave. Más parámetros generalmente significan un modelo más complejo y potencialmente poderoso, porque puede capturar patrones y correlaciones más complejos en los datos. Sin embargo, la desventaja es que requiere más recursos computacionales y, por lo tanto, su ejecución cuesta más. Además, vemos una tendencia hacia modelos más pequeños, especialmente en el espacio de código abierto (modelos que oscilan entre 7 y 40 mil millones) que funcionan bien, especialmente cuando se ajustan con precisión.

- Velocidad – La velocidad de un modelo está influenciada por su tamaño. Los modelos más grandes tienden a procesar datos más lentamente (mayor latencia) debido a la mayor complejidad computacional. Por lo tanto, es crucial equilibrar la necesidad de un modelo con alto poder predictivo (a menudo modelos más grandes) con los requisitos prácticos de velocidad, especialmente en aplicaciones, como los chat bots, que exigen respuestas en tiempo real o casi en tiempo real.

- Tamaño de la ventana de contexto (número de tokens) – La ventana de contexto, definida por la cantidad máxima de tokens que se pueden ingresar o generar por mensaje, es crucial para determinar cuánto contexto puede considerar el modelo a la vez (un token se traduce aproximadamente en 0.75 palabras en inglés). Los modelos con ventanas de contexto más grandes pueden comprender y generar secuencias de texto más largas, lo que puede resultar útil para tareas que implican conversaciones o documentos más largos.

- Conjunto de datos de entrenamiento – También es importante comprender en qué tipo de datos se entrenó el FM. Algunos modelos pueden entrenarse en diversos conjuntos de datos de texto, como datos de Internet, scripts de codificación, instrucciones o comentarios humanos. Otros también pueden recibir capacitación en conjuntos de datos multimodales, como combinaciones de datos de texto e imágenes. Esto puede influir en la idoneidad del modelo para diferentes tareas. Además, una organización puede tener problemas de derechos de autor dependiendo de las fuentes exactas en las que se haya entrenado un modelo; por lo tanto, es obligatorio inspeccionar de cerca el conjunto de datos de entrenamiento.

- Quality – La calidad de un FM puede variar según su tipo (propietario o de código abierto), tamaño y en qué fue entrenado. La calidad depende del contexto, lo que significa que lo que se considera de alta calidad para una aplicación puede no serlo para otra. Por ejemplo, un modelo entrenado con datos de Internet podría considerarse de alta calidad para generar texto conversacional, pero no tanto para tareas técnicas o especializadas.

- Sintonizable – La capacidad de ajustar un FM ajustando los pesos o capas de su modelo puede ser un factor crucial. El ajuste fino permite que el modelo se adapte mejor al contexto específico de la aplicación, mejorando el rendimiento en la tarea específica en cuestión. Sin embargo, el ajuste requiere recursos computacionales adicionales y experiencia técnica, y no todos los modelos admiten esta característica. Los modelos de código abierto (en general) siempre son ajustables porque los artefactos del modelo están disponibles para descargar y los usuarios pueden ampliarlos y usarlos a voluntad. En ocasiones, los modelos propietarios pueden ofrecer la opción de realizar ajustes.

- Habilidades existentes del cliente – La selección de un FM también puede verse influenciada por las habilidades y la familiaridad del cliente o del equipo de desarrollo. Si una organización no tiene expertos en IA/ML en su equipo, entonces un servicio API podría ser más adecuado para ellos. Además, si un equipo tiene amplia experiencia con un FM específico, podría ser más eficiente continuar usándolo en lugar de invertir tiempo y recursos para aprender y adaptarse a uno nuevo.

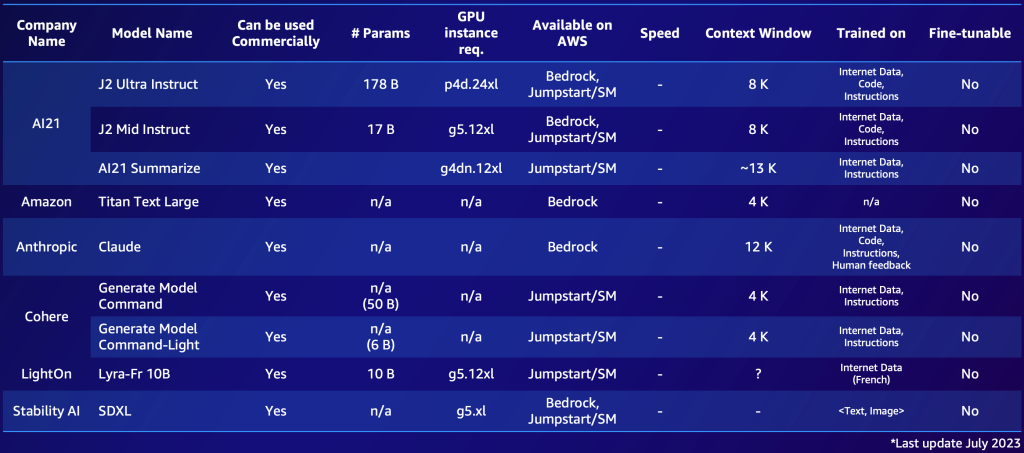

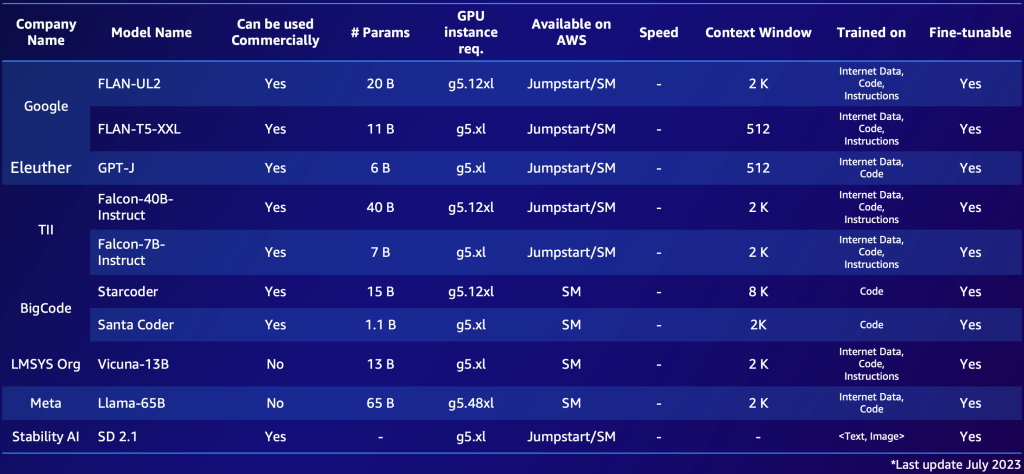

El siguiente es un ejemplo de dos listas cortas, una para modelos propietarios y otra para modelos de código abierto. Puede compilar tablas similares según sus necesidades específicas para obtener una descripción general rápida de las opciones disponibles. Tenga en cuenta que el rendimiento y los parámetros de esos modelos cambian rápidamente y pueden estar desactualizados en el momento de la lectura, mientras que otras capacidades pueden ser importantes para clientes específicos, como el idioma admitido.

El siguiente es un ejemplo de FM propietarios destacados disponibles en AWS (julio de 2023).

El siguiente es un ejemplo de FM de código abierto destacado disponible en AWS (julio de 2023).

Una vez que haya recopilado una descripción general de entre 10 y 20 modelos candidatos potenciales, es necesario perfeccionar aún más esta lista corta. En esta sección proponemos un mecanismo rápido que producirá dos o tres modelos finales viables como candidatos para la próxima ronda.

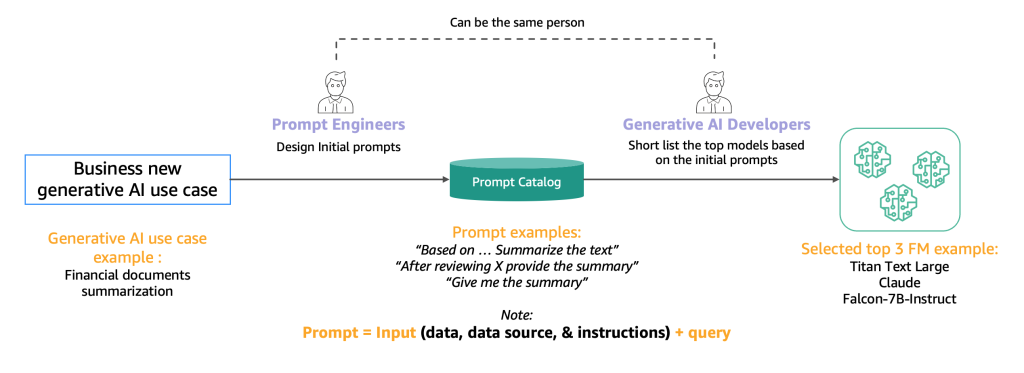

El siguiente diagrama ilustra el proceso de preselección inicial.

Por lo general, los ingenieros de avisos, que son expertos en la creación de avisos de alta calidad que permiten que los modelos de IA comprendan y procesen las entradas del usuario, experimentan con varios métodos para realizar la misma tarea (como el resumen) en un modelo. Sugerimos que estos mensajes no se creen sobre la marcha, sino que se extraigan sistemáticamente de un catálogo de mensajes. Este catálogo de mensajes es una ubicación central para almacenar mensajes para evitar replicaciones, habilitar el control de versiones y compartir mensajes dentro del equipo para garantizar la coherencia entre los diferentes evaluadores de mensajes en las diferentes etapas de desarrollo, que presentamos en la siguiente sección. Este catálogo de avisos es análogo a un repositorio Git de una tienda de funciones. El desarrollador de IA generativa, que potencialmente podría ser la misma persona que el ingeniero rápido, debe evaluar el resultado para determinar si sería adecuado para la aplicación de IA generativa que busca desarrollar.

Paso 2. Pruebe y evalúe el mejor FM

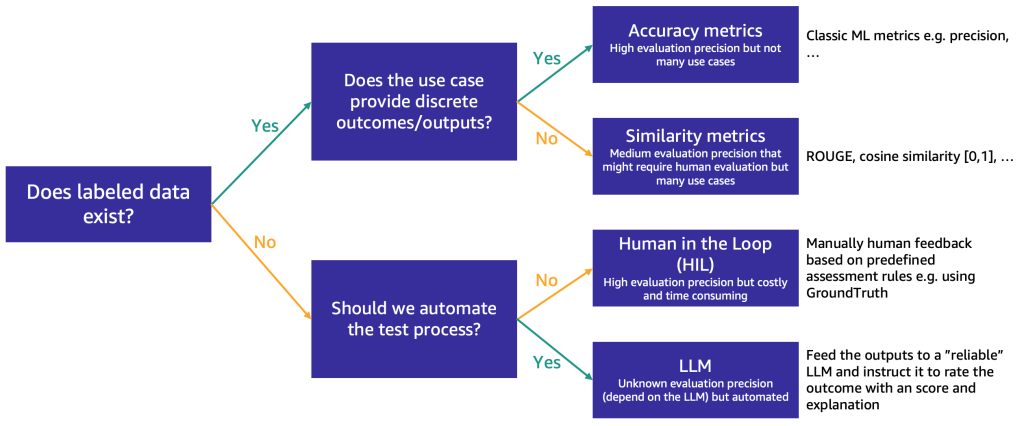

Después de que la lista corta se reduzca a aproximadamente tres FM, recomendamos un paso de evaluación para probar más a fondo las capacidades y la idoneidad de los FM para el caso de uso. Dependiendo de la disponibilidad y la naturaleza de los datos de evaluación, sugerimos diferentes métodos, como se ilustra en la siguiente figura.

El método a utilizar primero depende de si ha etiquetado los datos de prueba o no.

Si tiene datos etiquetados, puede usarlos para realizar una evaluación del modelo, como lo hacemos con los modelos ML tradicionales (ingrese algunas muestras y compare el resultado con las etiquetas). Dependiendo de si los datos de la prueba tienen etiquetas discretas (como análisis de sentimiento positivo, negativo o neutral) o son texto no estructurado (como un resumen), proponemos diferentes métodos de evaluación:

- Métricas de precisión – En el caso de resultados discretos (como el análisis de sentimiento), podemos utilizar métricas de precisión estándar como precisión, recuperación y puntuación F1.

- Métricas de similitud – Si el resultado no está estructurado (como un resumen), sugerimos métricas de similitud como ROUGE y similitud de coseno.

Algunos casos de uso no se prestan a tener una respuesta verdadera (por ejemplo, "Crear un cuento infantil corto para mi hija de 5 años"). En tales casos, resulta más difícil evaluar los modelos porque no se tienen datos de prueba etiquetados. Proponemos dos enfoques, dependiendo de la importancia de la revisión humana del modelo frente a la evaluación automatizada:

- Humano en el circuito (HIL) – En este caso, un equipo de evaluadores rápidos revisará las respuestas de un modelo. Dependiendo de cuán crítica sea la aplicación, los probadores rápidos pueden revisar el 100% de los resultados del modelo o solo una muestra.

- Evaluación impulsada por LLM – En este escenario, los probadores rápidos son reemplazados por un LLM, idealmente uno que sea más poderoso (aunque quizás más lento y más costoso) que los que se están probando. El LLM revisará todas las respuestas generadas por el modelo y las calificará. Este método puede dar como resultado una calidad inferior, pero es una opción de evaluación más barata y rápida que podría proporcionar una buena evaluación inicial del rendimiento de los modelos.

Por ejemplo, podemos utilizar el siguiente mensaje de ejemplo para un LLM, que incluye la consulta de entrada, la respuesta del LLM e instrucciones: "Nos gustaría solicitar su opinión sobre el desempeño de un asistente de IA en respuesta a la pregunta del usuario que se muestra arriba". . Califique la utilidad, relevancia, precisión y nivel de detalle de la respuesta del asistente. El asistente recibirá una puntuación global en una escala del 1 al 10, donde una puntuación más alta indica un mejor desempeño general”.

Este mensaje se enviará a otro LLM (EvalLLM) para su evaluación. El siguiente es un ejemplo donde la respuesta del modelo Falcon-40B ha sido evaluada por un EvalLLM (en este caso Claude). Usamos la pregunta "¿Y si el Canal de Suez nunca se hubiera construido?" La respuesta es la siguiente:

Pregunta: ¿Y si el Canal de Suez nunca se hubiera construido?

falcon-40b-instruir

Si el Canal de Suez nunca se hubiera construido, los barcos tendrían que rodear África para navegar entre el Mediterráneo y el Mar Rojo. Esto añadiría mucho tiempo y distancia al viaje, haciéndolo menos eficiente y más caro. Además, sin el Canal de Suez, muchos países de Medio Oriente y África del Norte habrían estado mucho menos conectados con el resto del mundo, lo que obstaculizaría el desarrollo económico y cultural.

Revisión (Puntuación: 9/10)

La respuesta del asistente es muy relevante, precisa y detallada. Proporciona una excelente respuesta a la hipotética pregunta del usuario sobre la inexistencia del Canal de Suez. El asistente señala correctamente las implicaciones para los viajes marítimos y el impacto económico y cultural en Oriente Medio y el Norte de África. Sin embargo, podría haber profundizado en las implicaciones geopolíticas o el impacto en los patrones del comercio global para una respuesta más integral.

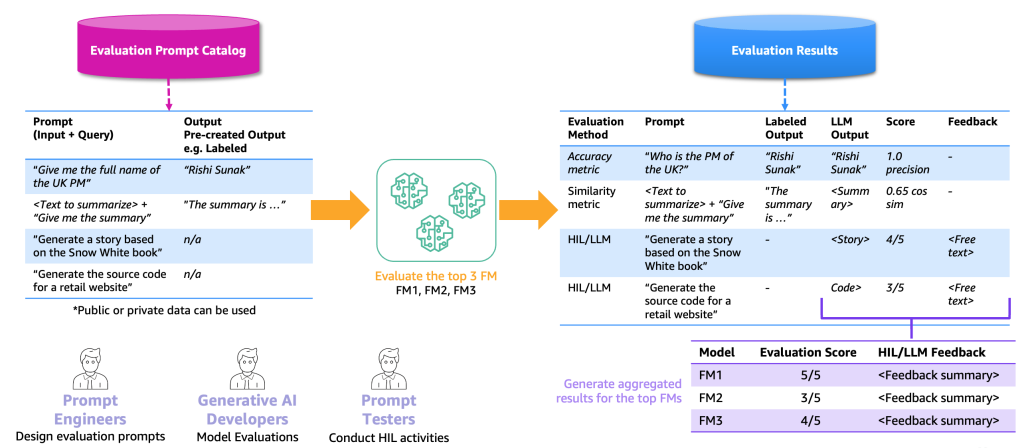

La siguiente figura ilustra el ejemplo del proceso de evaluación de un extremo a otro.

Según este ejemplo, para realizar la evaluación, debemos proporcionar las indicaciones de ejemplo, que almacenamos en el catálogo de indicaciones, y un conjunto de datos de evaluación etiquetados o no etiquetados en función de nuestras aplicaciones específicas. Por ejemplo, con un conjunto de datos de evaluación etiquetado, podemos proporcionar indicaciones (entradas y consultas) como "Dame el nombre completo del primer ministro del Reino Unido en 2023" y resultados y respuestas, como "Rishi Sunak". Con un conjunto de datos sin etiquetar, proporcionamos solo la pregunta o instrucción, como "Generar el código fuente para un sitio web minorista". A la combinación de catálogo rápido y conjunto de datos de evaluación la llamamos catálogo de indicaciones de evaluación. La razón por la que diferenciamos el catálogo de indicaciones y el catálogo de indicaciones de evaluación es porque este último está dedicado a un caso de uso específico en lugar de las indicaciones e instrucciones genéricas (como la respuesta a preguntas) que contiene el catálogo de indicaciones.

Con este catálogo de mensajes de evaluación, el siguiente paso es enviar los mensajes de evaluación a los principales FM. El resultado es un conjunto de datos de resultados de evaluación que contiene las indicaciones, los resultados de cada FM y el resultado etiquetado junto con una puntuación (si existe). En el caso de un catálogo de indicaciones de evaluación sin etiquetar, existe un paso adicional para que un HIL o LLM revise los resultados y proporcione una puntuación y comentarios (como describimos anteriormente). El resultado final serán resultados agregados que combinen las puntuaciones de todos los resultados (calcule la precisión promedio o la calificación humana) y permitan a los usuarios comparar la calidad de los modelos.

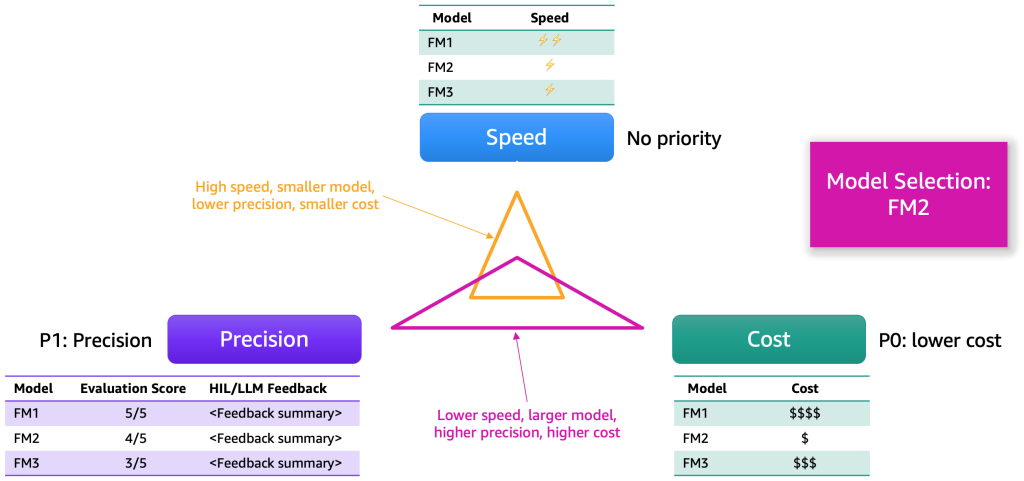

Una vez recopilados los resultados de la evaluación, proponemos elegir un modelo basado en varias dimensiones. Por lo general, estos se reducen a factores como la precisión, la velocidad y el costo. La siguiente figura muestra un ejemplo.

Cada modelo tendrá fortalezas y ciertas compensaciones en estas dimensiones. Dependiendo del caso de uso, deberíamos asignar diferentes prioridades a estas dimensiones. En el ejemplo anterior, elegimos priorizar el costo como el factor más importante, seguido de la precisión y luego la velocidad. Aunque es más lento y no tan eficiente como FM1, sigue siendo lo suficientemente efectivo y significativamente más barato de alojar. En consecuencia, podríamos seleccionar FM2 como la mejor opción.

Paso 3. Desarrollar el backend y el frontend de la aplicación de IA generativa

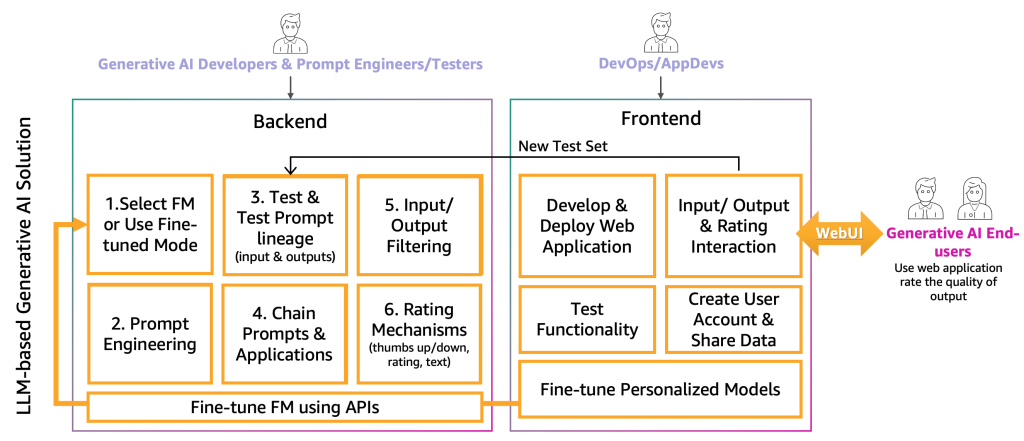

En este punto, los desarrolladores de IA generativa han seleccionado el FM adecuado para la aplicación específica junto con la ayuda de ingenieros y evaluadores rápidos. El siguiente paso es empezar a desarrollar la aplicación de IA generativa. Hemos separado el desarrollo de la aplicación de IA generativa en dos capas, un backend y un front-end, como se muestra en la siguiente figura.

En el backend, los desarrolladores de IA generativa incorporan el FM seleccionado en las soluciones y trabajan junto con los ingenieros de avisos para crear la automatización para transformar la entrada del usuario final en avisos de FM apropiados. Los probadores de solicitudes crean las entradas necesarias en el catálogo de solicitudes para pruebas automáticas o manuales (HIL o LLM). Luego, los desarrolladores de IA generativa crean el mecanismo de aplicación y encadenamiento rápido para proporcionar el resultado final. El encadenamiento rápido, en este contexto, es una técnica para crear aplicaciones LLM más dinámicas y contextualmente conscientes. Funciona dividiendo una tarea compleja en una serie de subtareas más pequeñas y manejables. Por ejemplo, si le preguntamos a un LLM la pregunta "¿Dónde nació el primer ministro del Reino Unido y qué tan lejos está ese lugar de Londres?", la tarea se puede dividir en sugerencias individuales, donde se podría construir una sugerencia basada en la respuesta. de una evaluación previa, como "¿Quién es el primer ministro del Reino Unido?", "¿Cuál es su lugar de nacimiento" y "¿A qué distancia está ese lugar de Londres?" Para garantizar una cierta calidad de entrada y salida, los desarrolladores de IA generativa también deben crear el mecanismo para monitorear y filtrar las entradas del usuario final y las salidas de las aplicaciones. Si, por ejemplo, se supone que la aplicación LLM debe evitar solicitudes y respuestas tóxicas, podrían aplicar un detector de toxicidad para la entrada y la salida y filtrarlas. Por último, deben proporcionar un mecanismo de calificación que respalde el aumento del catálogo de indicaciones de evaluación con buenos y malos ejemplos. En publicaciones futuras se presentará una representación más detallada de esos mecanismos.

Para proporcionar la funcionalidad al usuario final de IA generativa, es necesario el desarrollo de un sitio web frontend que interactúe con el backend. Por lo tanto, las personas DevOps y AppDevs (desarrolladores de aplicaciones en la nube) deben seguir las mejores prácticas de desarrollo para implementar la funcionalidad de entrada/salida y calificación.

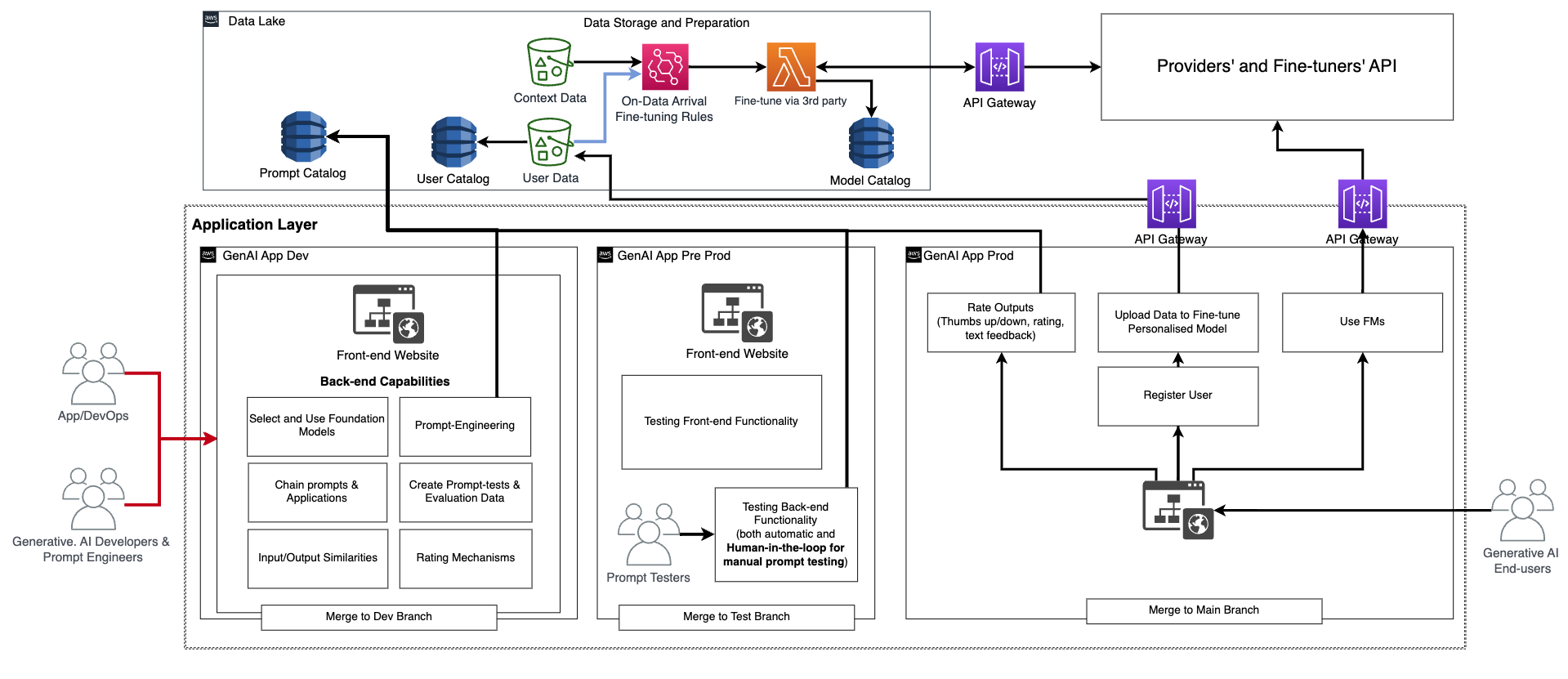

Además de esta funcionalidad básica, el frontend y el backend deben incorporar la función de crear cuentas de usuario personales, cargar datos, iniciar ajustes como una caja negra y utilizar el modelo personalizado en lugar del FM básico. La producción de una aplicación de IA generativa es similar a la de una aplicación normal. La siguiente figura muestra un ejemplo de arquitectura.

En esta arquitectura, los desarrolladores de IA generativa, los ingenieros de avisos y los DevOps o AppDevs crean y prueban la aplicación manualmente implementándola a través de CI/CD en un entorno de desarrollo (AI App Dev generativa en la figura anterior) utilizando repositorios de código dedicados y fusionándose con la rama de desarrollo. En esta etapa, los desarrolladores de IA generativa utilizarán el FM correspondiente llamando a la API tal como lo proporcionaron los proveedores de sintonizadores finos de FM. Luego, para probar la aplicación exhaustivamente, deben promover el código a la rama de prueba, lo que desencadenará la implementación a través de CI/CD en el entorno de preproducción (preproducción de aplicación de IA generativa). En este entorno, los evaluadores de indicaciones deben probar una gran cantidad de combinaciones de indicaciones y revisar los resultados. La combinación de indicaciones, resultados y revisión debe trasladarse al catálogo de indicaciones de evaluación para automatizar el proceso de prueba en el futuro. Después de esta prueba exhaustiva, el último paso es promover la aplicación de IA generativa a producción a través de CI/CD fusionándola con la rama principal (generative AI App Prod). Tenga en cuenta que todos los datos, incluido el catálogo de solicitudes, los datos y resultados de la evaluación, los datos y metadatos del usuario final y los metadatos del modelo ajustado, deben almacenarse en el lago de datos o en la capa de malla de datos. Las canalizaciones y repositorios de CI/CD deben almacenarse en una cuenta de herramientas separada (similar a la descrita para MLOps).

El viaje de los proveedores

Los proveedores de FM deben capacitar a los FM, como los modelos de aprendizaje profundo. Para ellos, la infraestructura y el ciclo de vida de MLOps de extremo a extremo son necesarios. Se requieren adiciones en la preparación de datos históricos, la evaluación de modelos y el seguimiento. La siguiente figura ilustra su viaje.

En el ML clásico, los datos históricos se crean con mayor frecuencia alimentando la verdad básica a través de canalizaciones ETL. Por ejemplo, en un caso de uso de predicción de abandono, una automatización actualiza una tabla de base de datos en función del nuevo estado de un cliente para abandonar/no abandonar automáticamente. En el caso de los FM, necesitan miles de millones de puntos de datos etiquetados o no etiquetados. En los casos de uso de texto a imagen, un equipo de etiquetadores de datos debe etiquetar pares manualmente. Este es un ejercicio costoso que requiere una gran cantidad de recursos humanos. Amazon SageMaker Tierra Verdad Plus puede proporcionarle un equipo de etiquetadores para realizar esta actividad por usted. Para algunos casos de uso, este proceso también se puede automatizar parcialmente, por ejemplo mediante el uso de modelos tipo CLIP. En el caso de un LLM, como texto a texto, los datos no están etiquetados. Sin embargo, deben estar preparados y seguir el formato de los datos históricos no etiquetados existentes. Por lo tanto, se necesitan editores de datos para realizar la preparación de datos necesaria y garantizar la coherencia.

Con los datos históricos preparados, el siguiente paso es el entrenamiento y producción del modelo. Tenga en cuenta que se pueden utilizar las mismas técnicas de evaluación que describimos para los consumidores.

El viaje de los afinadores

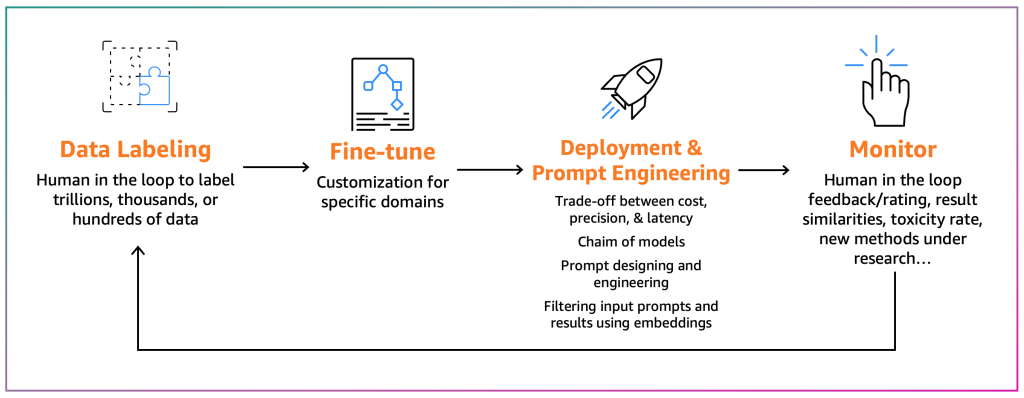

Los sintonizadores tienen como objetivo adaptar un FM existente a su contexto específico. Por ejemplo, un modelo FM puede resumir un texto de propósito general pero no un informe financiero con precisión o no puede generar código fuente para un lenguaje de programación no común. En esos casos, los ajustadores necesitan etiquetar datos, ajustar un modelo ejecutando un trabajo de entrenamiento, implementar el modelo, probarlo en función de los procesos del consumidor y monitorear el modelo. El siguiente diagrama ilustra este proceso.

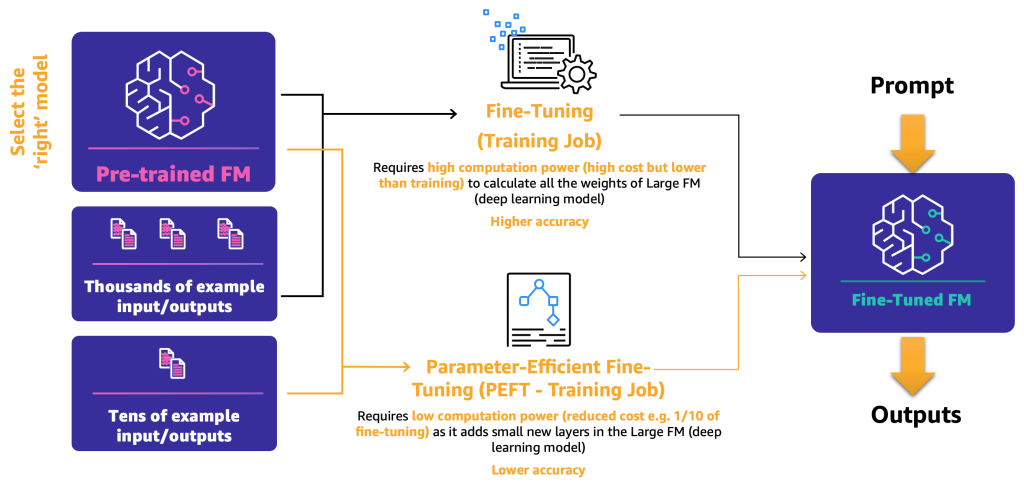

Por el momento, existen dos mecanismos de ajuste:

- Sintonia FINA – Al utilizar un FM y datos etiquetados, un trabajo de capacitación vuelve a calcular los pesos y sesgos de las capas del modelo de aprendizaje profundo. Este proceso puede ser computacionalmente intensivo y requiere una cantidad representativa de datos, pero puede generar resultados precisos.

- Ajuste fino eficiente en parámetros (PEFT) – En lugar de volver a calcular todos los pesos y sesgos, los investigadores han demostrado que al agregar pequeñas capas adicionales a los modelos de aprendizaje profundo, pueden lograr resultados satisfactorios (por ejemplo, lora). PEFT requiere menor potencia computacional que un ajuste profundo y un trabajo de capacitación con menos datos de entrada. El inconveniente es una posible menor precisión.

El siguiente diagrama ilustra estos mecanismos.

Ahora que hemos definido los dos métodos principales de ajuste, el siguiente paso es determinar cómo podemos implementar y utilizar el FM propietario y de código abierto.

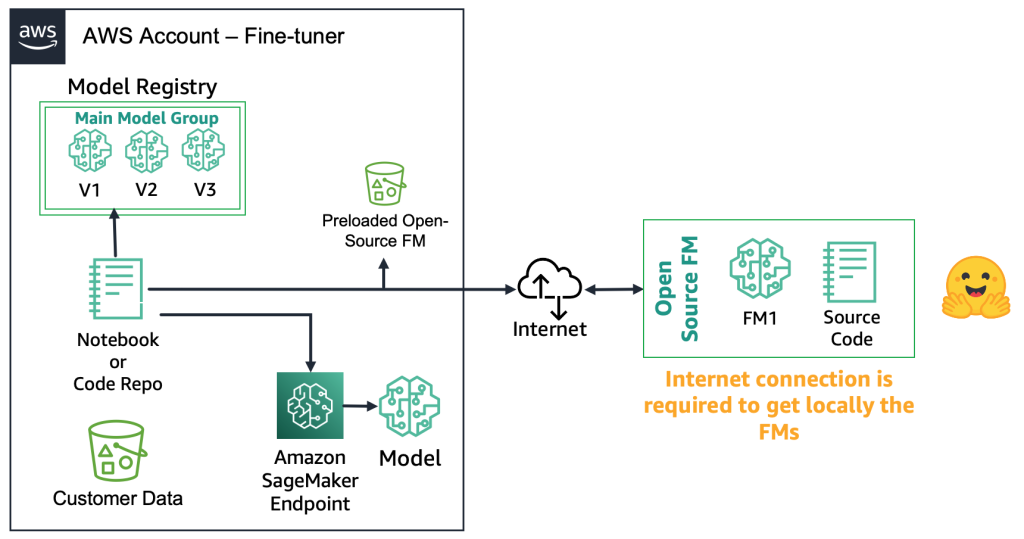

Con los FM de código abierto, los sintonizadores pueden descargar el artefacto del modelo y el código fuente de la web, por ejemplo, utilizando el Hub modelo de cara abrazada. Esto le brinda la flexibilidad de realizar un ajuste profundo del modelo, almacenarlo en un registro de modelo local e implementarlo en un Amazon SageMaker punto final. Este proceso requiere una conexión a Internet. Para admitir entornos más seguros (como para clientes del sector financiero), puede descargar el modelo localmente, ejecutar todas las comprobaciones de seguridad necesarias y cargarlas en un depósito local en una cuenta de AWS. Luego, los sintonizadores utilizan la FM del depósito local sin conexión a Internet. Esto garantiza la privacidad de los datos y los datos no viajan a través de Internet. El siguiente diagrama ilustra este método.

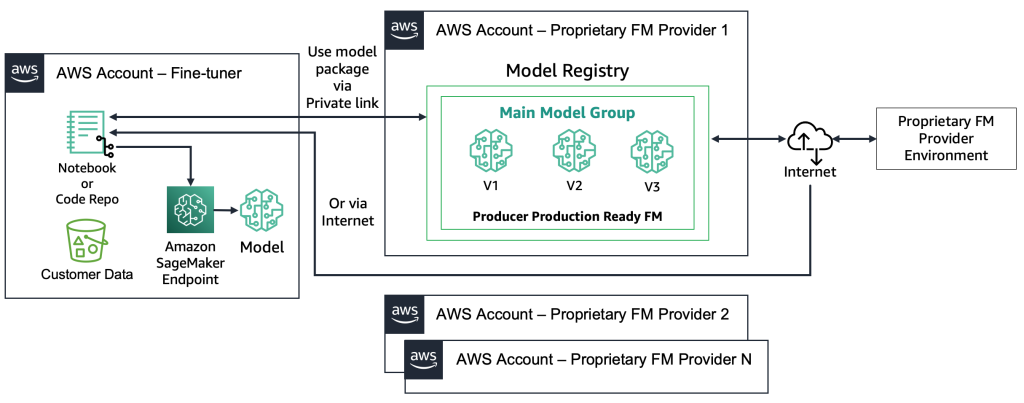

Con los FM propietarios, el proceso de implementación es diferente porque los sintonizadores no tienen acceso al artefacto del modelo ni al código fuente. Los modelos se almacenan en cuentas y registros de modelos propietarios de AWS del proveedor de FM. Para implementar un modelo de este tipo en un punto final de SageMaker, los optimizadores pueden solicitar solo el paquete del modelo que se implementará directamente en un punto final. Este proceso requiere que los datos del cliente se utilicen en las cuentas de los proveedores de FM propietarios, lo que plantea dudas sobre el uso de datos confidenciales del cliente en una cuenta remota para realizar ajustes y los modelos alojados en un registro de modelos que se comparte entre varios clientes. . Esto conduce a un problema de arrendamiento múltiple que se vuelve más desafiante si los proveedores de FM propietarios necesitan atender estos modelos. Si los afinadores usan lecho rocoso del amazonas, estos desafíos se resuelven: los datos no viajan a través de Internet y los proveedores de FM no tienen acceso a los datos de los sintonizadores. Los mismos desafíos se aplican a los modelos de código abierto si los optimizadores quieren ofrecer modelos de múltiples clientes, como el ejemplo que dimos anteriormente con el sitio web al que miles de clientes subirán imágenes personalizadas. Sin embargo, estos escenarios pueden considerarse controlables porque sólo interviene el sintonizador. El siguiente diagrama ilustra este método.

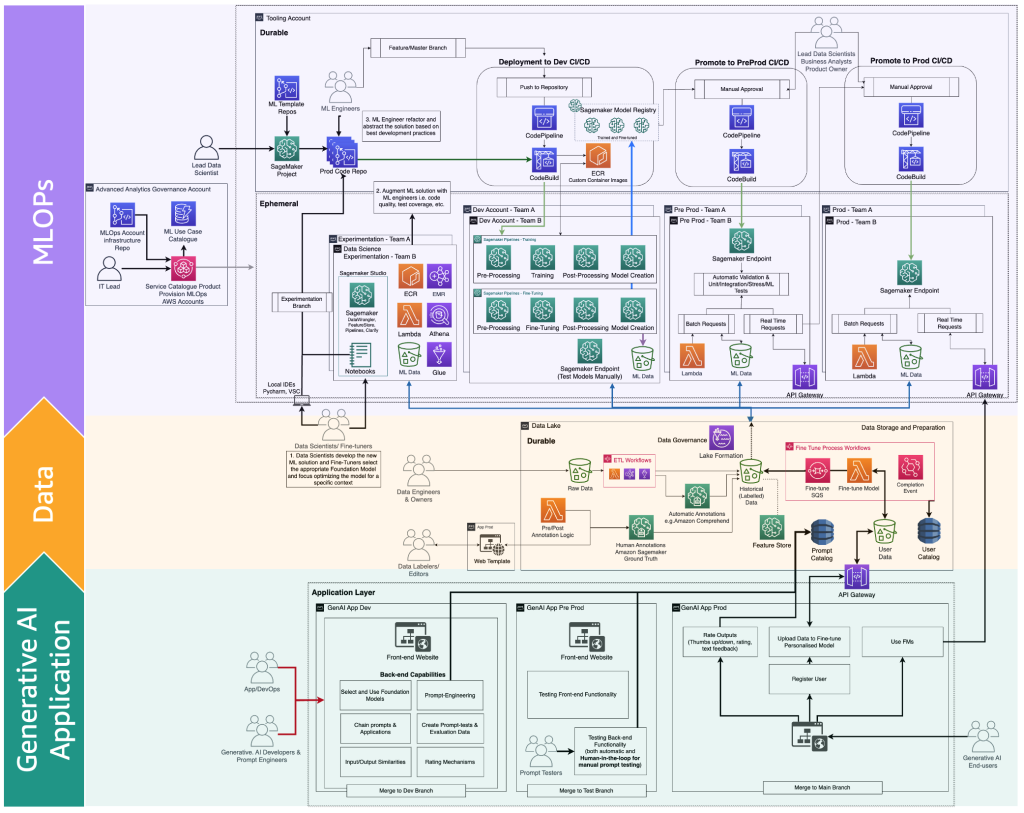

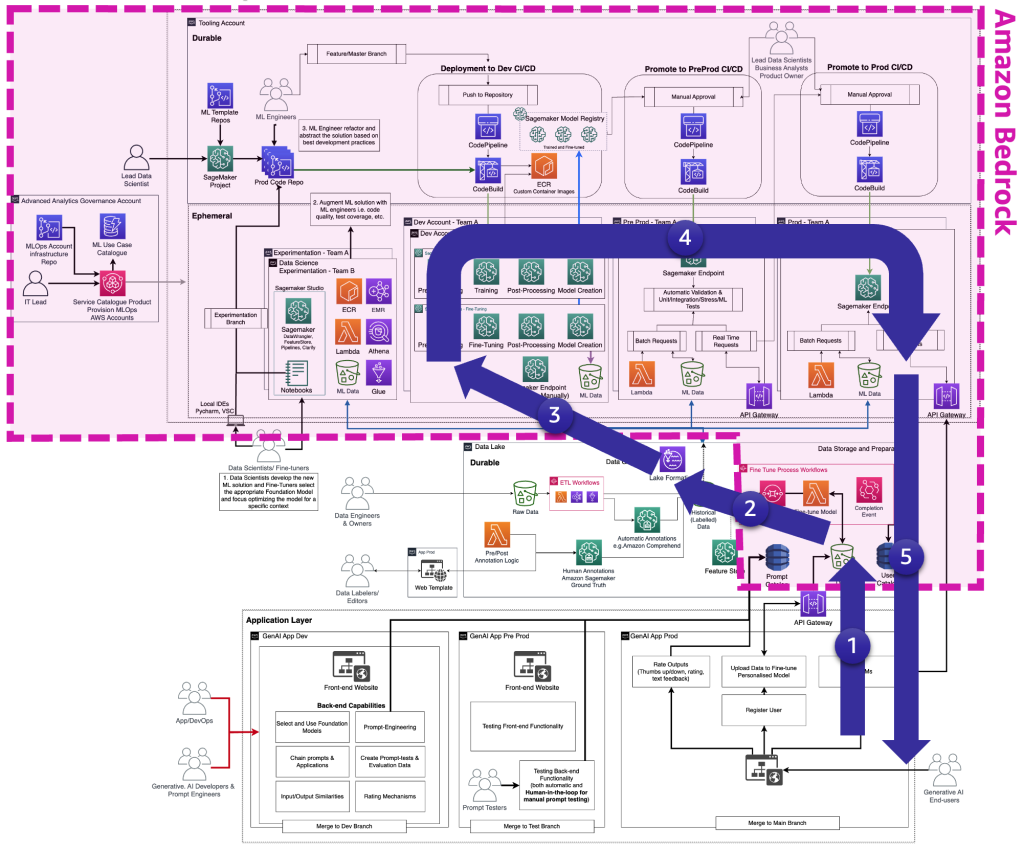

Desde una perspectiva tecnológica, la arquitectura que un sintonizador debe admitir es como la de MLOps (consulte la siguiente figura). El ajuste debe realizarse en desarrollo mediante la creación de canales de aprendizaje automático, como el uso Canalizaciones de Amazon SageMaker; realizar preprocesamiento, ajuste fino (trabajo de capacitación) y posprocesamiento; y enviar los modelos ajustados a un registro de modelos local en el caso de un FM de código abierto (de lo contrario, el nuevo modelo se almacenará en el entorno de suministro de FM propietario). Luego, en preproducción, debemos probar el modelo como lo describimos para el escenario de los consumidores. Finalmente, el modelo será atendido y monitoreado en prod. Tenga en cuenta que el FM actual (ajustado) requiere puntos finales de instancia de GPU. Si necesitamos implementar cada modelo ajustado en un punto final separado, esto podría aumentar el costo en el caso de cientos de modelos. Por lo tanto, debemos utilizar puntos finales multimodelo y resolver el desafío del multiinquilino.

Los afinadores adaptan un modelo de FM en función de un contexto específico para utilizarlo para sus fines comerciales. Eso significa que la mayoría de las veces, los sintonizadores también son consumidores que deben admitir todas las capas, como describimos en las secciones anteriores, incluido el desarrollo de aplicaciones de IA generativa, el lago de datos y la malla de datos, y MLOps.

La siguiente figura ilustra el ciclo de vida completo de ajuste de FM que los sintonizadores necesitan para proporcionar al usuario final de IA generativa.

La siguiente figura ilustra los pasos clave.

Los pasos clave son los siguientes:

- El usuario final crea una cuenta personal y carga datos privados.

- Los datos se almacenan en el lago de datos y se preprocesan para seguir el formato que espera el FM.

- Esto desencadena una canalización de ML de ajuste que agrega el modelo al registro de modelos,

- A partir de ahí, el modelo se implementa en producción con pruebas mínimas o se realizan pruebas exhaustivas con HIL y puertas de aprobación manuales.

- El modelo perfeccionado está disponible para los usuarios finales.

Debido a que esta infraestructura es compleja para clientes no empresariales, AWS lanzó Amazon Bedrock para aliviar el esfuerzo de crear dichas arquitecturas y acercar los FM optimizados a la producción.

Diferenciadores de procesos y personas de FMOps y LLMOps

Según los recorridos de los tipos de usuarios anteriores (consumidor, productor y perfeccionador), se requieren nuevas personas con habilidades específicas, como se ilustra en la siguiente figura.

Los nuevos personajes son los siguientes:

- Etiquetadores y editores de datos – Estos usuarios etiquetan datos, como pares o preparar datos sin etiquetar, como texto libre, y ampliar el equipo de análisis avanzado y los entornos del lago de datos.

- Afinadores – Estos usuarios tienen un conocimiento profundo sobre FM y saben cómo ajustarlos, ampliando el equipo de ciencia de datos que se centrará en el ML clásico.

- Desarrolladores de IA generativa – Tienen un conocimiento profundo sobre la selección de FM, el encadenamiento de mensajes y aplicaciones y el filtrado de entradas y salidas. Pertenecen a un nuevo equipo: el equipo de aplicaciones de IA generativa.

- Ingenieros rápidos – Estos usuarios diseñan los mensajes de entrada y salida para adaptar la solución al contexto y probar y crear la versión inicial del catálogo de mensajes. Su equipo es el equipo de aplicación de IA generativa.

- probadores rápidos – Prueban a escala la solución de IA generativa (backend y frontend) y alimentan sus resultados para aumentar el catálogo rápido y el conjunto de datos de evaluación. Su equipo es el equipo de aplicación de IA generativa.

- AppDev y DevOps – Desarrollan el front-end (como un sitio web) de la aplicación de IA generativa. Su equipo es el equipo de aplicación de IA generativa.

- Usuarios finales de IA generativa – Estos usuarios consumen aplicaciones de IA generativa como cajas negras, comparten datos y califican la calidad del resultado.

La versión ampliada del mapa de procesos MLOps para incorporar IA generativa se puede ilustrar con la siguiente figura.

Una nueva capa de aplicación es el entorno donde los desarrolladores de IA generativa, los ingenieros, los evaluadores y los AppDevs crearon el backend y el front-end de las aplicaciones de IA generativa. Los usuarios finales de IA generativa interactúan con la interfaz de las aplicaciones de IA generativa a través de Internet (como una interfaz de usuario web). Por otro lado, los etiquetadores y editores de datos necesitan preprocesar los datos sin acceder al backend del lago de datos o la malla de datos. Por lo tanto, es necesaria una interfaz de usuario web (sitio web) con un editor para interactuar de forma segura con los datos. SageMaker Ground Truth proporciona esta funcionalidad lista para usar.

Conclusión

MLOps puede ayudarnos a producir modelos ML de manera eficiente. Sin embargo, para poner en funcionamiento aplicaciones de IA generativa, se necesitan habilidades, procesos y tecnologías adicionales, lo que lleva a FMOps y LLMOps. En esta publicación, definimos los conceptos principales de FMOps y LLMOps y describimos los diferenciadores clave en comparación con las capacidades de MLOps en términos de personas, procesos, tecnología, selección y evaluación del modelo FM. Además, ilustramos el proceso de pensamiento de un desarrollador de IA generativa y el ciclo de vida de desarrollo de una aplicación de IA generativa.

En el futuro, nos centraremos en proporcionar soluciones según el dominio que analizamos y proporcionaremos más detalles sobre cómo integrar el monitoreo de FM (como toxicidad, sesgo y alucinaciones) y patrones arquitectónicos de fuentes de datos privadas o de terceros, como Recuperación de Generación Aumentada (RAG), en FMOps/LLMOps.

Para obtener más información, consulte Hoja de ruta básica de MLOps para empresas con Amazon SageMaker y pruebe la solución integral en Implementación de prácticas de MLOps con modelos preentrenados de Amazon SageMaker JumpStart.

Si tiene algún comentario o pregunta, déjelo en la sección de comentarios.

Acerca de los autores

Dra. Sokratis Kartakis es arquitecto senior de soluciones especialista en operaciones y aprendizaje automático para Amazon Web Services. Sokratis se centra en permitir que los clientes empresariales industrialicen sus soluciones de aprendizaje automático (ML) explotando los servicios de AWS y dando forma a su modelo operativo, es decir, la base MLOps y la hoja de ruta de transformación aprovechando las mejores prácticas de desarrollo. Ha dedicado más de 15 años a inventar, diseñar, liderar e implementar soluciones innovadoras de aprendizaje automático e Internet de las cosas (IoT) de nivel de producción de extremo a extremo en los ámbitos de la energía, el comercio minorista, la salud, las finanzas/banca, los deportes de motor, etc. A Sokratis le gusta pasar su tiempo libre con familiares y amigos o andar en moto.

Dra. Sokratis Kartakis es arquitecto senior de soluciones especialista en operaciones y aprendizaje automático para Amazon Web Services. Sokratis se centra en permitir que los clientes empresariales industrialicen sus soluciones de aprendizaje automático (ML) explotando los servicios de AWS y dando forma a su modelo operativo, es decir, la base MLOps y la hoja de ruta de transformación aprovechando las mejores prácticas de desarrollo. Ha dedicado más de 15 años a inventar, diseñar, liderar e implementar soluciones innovadoras de aprendizaje automático e Internet de las cosas (IoT) de nivel de producción de extremo a extremo en los ámbitos de la energía, el comercio minorista, la salud, las finanzas/banca, los deportes de motor, etc. A Sokratis le gusta pasar su tiempo libre con familiares y amigos o andar en moto.

Heiko Hotz es arquitecto sénior de soluciones para inteligencia artificial y aprendizaje automático con un enfoque especial en el procesamiento de lenguaje natural, modelos de lenguaje extenso e inteligencia artificial generativa. Antes de ocupar este puesto, fue director de ciencia de datos del servicio de atención al cliente de la UE de Amazon. Heiko ayuda a nuestros clientes a tener éxito en su viaje de IA/ML en AWS y ha trabajado con organizaciones en muchas industrias, incluidas las de seguros, servicios financieros, medios y entretenimiento, atención médica, servicios públicos y fabricación. En su tiempo libre, Heiko viaja tanto como puede.

Heiko Hotz es arquitecto sénior de soluciones para inteligencia artificial y aprendizaje automático con un enfoque especial en el procesamiento de lenguaje natural, modelos de lenguaje extenso e inteligencia artificial generativa. Antes de ocupar este puesto, fue director de ciencia de datos del servicio de atención al cliente de la UE de Amazon. Heiko ayuda a nuestros clientes a tener éxito en su viaje de IA/ML en AWS y ha trabajado con organizaciones en muchas industrias, incluidas las de seguros, servicios financieros, medios y entretenimiento, atención médica, servicios públicos y fabricación. En su tiempo libre, Heiko viaja tanto como puede.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Automoción / vehículos eléctricos, Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- ChartPrime. Eleve su juego comercial con ChartPrime. Accede Aquí.

- Desplazamientos de bloque. Modernización de la propiedad de compensaciones ambientales. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/fmops-llmops-operationalize-generative-ai-and-differences-with-mlops/

- :posee

- :es

- :no

- :dónde

- $ UP

- 1

- 10

- 100

- 2023

- 23

- 7

- 75

- a

- capacidad

- Poder

- Nuestra Empresa

- arriba

- RESUMEN

- de la máquina

- accesible

- el acceso

- Mi Cuenta

- Cuentas

- la exactitud

- preciso

- precisamente

- Lograr

- acciones

- actividad

- adaptar

- adaptaciónes

- add

- la adición de

- adición

- Adicionales

- Adicionalmente

- Adiciones

- Añade

- administración

- Adopción

- avanzado

- África

- Después

- Agreement

- AI

- IA y aprendizaje automático

- Asistente de inteligencia

- Modelos AI

- Servicios de IA

- casos de uso de ia

- AI / ML

- objetivo

- Alinea

- Todos

- permitir

- permite

- a lo largo de

- ya haya utilizado

- también

- Aunque

- hacerlo

- Amazon

- Amazon SageMaker

- JumpStart de Amazon SageMaker

- Amazon Web Services

- entre

- cantidad

- an

- análisis

- Analytics

- y

- e infraestructura

- Otra

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- respuestas

- cualquier

- abejas

- API

- applicación

- Aplicación

- Desarrollo de aplicaciones

- aplicaciones

- Aplicá

- enfoque

- enfoques

- adecuado

- aprobación

- aproximadamente

- arquitectos

- arquitectónico

- arquitectura

- somos

- en torno a

- AS

- Evaluación

- Legal

- At

- auditado

- los auditores

- aumentado

- automatizado

- Confirmación de Viaje

- Automático

- automáticamente

- Automatización

- disponibilidad

- Hoy Disponibles

- promedio

- evitar

- AWS

- Backend

- Malo

- Balance

- basado

- básica

- BE

- porque

- a las que has recomendado

- se convierte en

- esto

- antes

- "Ser"

- beneficios

- MEJOR

- mejores

- entre

- parcialidad

- los prejuicios

- mil millones

- miles de millones

- Negro

- nacido

- pedir prestado

- ambas

- los robots

- Box

- cajas

- Rama

- Ruptura

- brevemente

- Trayendo

- Roto

- build

- Construir la

- construido

- pero

- by

- calcular

- llamar al

- , que son

- llamar

- PUEDEN

- candidato

- candidatos

- capacidades

- capacidad

- capturar

- case

- cases

- catalogar

- categoría

- central

- centralizado

- a ciertos

- Reto

- retos

- desafiante

- el cambio

- Chatbots

- más barato

- Cheques

- manera?

- la elección de

- clásico

- de cerca

- más cerca

- Ropa

- Soluciones

- código

- Codificación

- colaboran

- combinación

- combinaciones

- combinar

- cómo

- comentarios

- completo

- comercialmente

- Algunos

- comparar

- en comparación con

- completar

- terminación

- integraciones

- complejidad

- compliance

- obediente

- composición

- exhaustivo

- potencia de cálculo

- computadora

- concentrarse

- concepto

- conceptos

- Inquietudes

- condiciones

- Conducir

- llevado a cabo

- conectado

- conexión

- En consecuencia

- Considerar

- consideraciones

- considerado

- consumir

- consumidor

- Clientes

- consumo

- Envase

- contiene

- contenido

- creación de contenido

- contexto

- continue

- control

- conversacional

- conversaciones

- derechos de autor,

- Correspondiente

- Cost

- costoso

- Precio

- podría

- países

- Protectora

- cubierto

- Para crear

- creado

- crea

- Creamos

- creación

- crítico

- crucial

- cultural

- Current

- personalizado

- cliente

- datos de los clientes

- Servicio al Cliente

- Clientes

- datos

- Lago de datos

- puntos de datos

- Preparación de datos

- privacidad de datos

- Ciencia de los datos

- Base de datos

- conjuntos de datos

- Descentralizado

- Decidir

- decisiones

- a dedicados

- profundo

- bucear profundo

- deep learning

- se define

- definir

- definición

- Definiciones

- entregamos

- ahondar

- Demanda

- Dependiente

- depende

- representando

- desplegar

- desplegado

- Desplegando

- despliegue

- describir

- descrito

- descripción

- Diseño

- diseñado

- diseño

- deseo

- deseado

- detallado

- detalles

- Determinar

- determinar

- Dev

- desarrollar

- desarrollado

- Developer

- desarrolladores

- el desarrollo

- Desarrollo

- Equipo de desarrollo

- diferencias

- una experiencia diferente

- diferenciar

- dimensiones

- directamente

- discutir

- discutido

- aquí

- distancia

- inmersión

- diverso

- do

- documentos

- No

- dominio

- dominios

- No

- DE INSCRIPCIÓN

- descargar

- el lado de la transmisión

- dos

- lugar de trabajo dinámico

- e

- cada una

- Más temprano

- Este

- de forma sencilla

- Economic

- editor

- Eficaz

- eficiente

- eficiente.

- esfuerzo

- ya sea

- elaborado

- elegidos

- habilitar

- permitiendo

- final

- de extremo a extremo

- Punto final

- energía

- ingeniero

- Ingeniería

- certificados

- Inglés

- mejorar

- garantizar

- asegura

- Empresa

- empresas

- Entretenimiento

- Entorno

- ambientes

- igualmente

- especialmente

- esencial

- etc.

- EU

- evaluar

- evaluado

- evaluación

- Incluso

- Cada

- ejemplo

- ejemplos

- excelente,

- excitado

- Haz ejercicio

- existente

- existe

- aves

- espera

- costoso

- experience

- experimento

- Experiencia

- expertos

- explotando

- ampliar

- extensión

- extensión

- en los detalles

- Amplia experiencia

- se dedica ampliamente

- extraerlos

- f1

- Cara

- factor

- factores importantes

- Familiaridad

- familia

- muchos

- más rápida

- Feature

- realimentación

- alimentación

- Figura

- filtrar

- filtración

- final

- Finalmente

- financiero

- informe financiero

- Sector financiero

- servicios financieros

- Nombre

- cómodo

- Flexibilidad

- flexible

- Focus

- centrado

- se centra

- enfoque

- seguir

- seguido

- siguiendo

- siguiente

- Para consumidores

- formulario

- formato

- Fundación

- Digital XNUMXk

- Gratuito

- amigos

- Desde

- frontal o trasero

- Interfaz

- Frontend

- ser completados

- a la fatiga

- fundamental

- promover

- Además

- futuras

- -

- calibre

- General

- propósito general

- en general

- generar

- generado

- genera

- la generación de

- generación de AHSS

- generativo

- IA generativa

- geopolítica

- obtener

- Git

- dado

- da

- Buscar

- comercio global

- candidato

- gobierno

- GPU

- Polo a Tierra

- tenido

- mano

- Aprovechamiento

- Tienen

- es

- he

- cabeza

- Salud

- la salud

- ayuda

- ayuda

- esta página

- Alta

- alta calidad

- más alto

- altamente

- su

- histórico

- mantener

- fortaleza

- organizado

- Cómo

- Como Hacer

- Sin embargo

- HTML

- HTTPS

- humana

- Cientos

- i

- idealmente

- if

- ilustra

- imagen

- imágenes

- imaginario

- Impacto

- implementar

- implementación

- implicaciones

- importancia

- importante

- la mejora de

- in

- incluir

- incluye

- Incluye

- incorporar

- aumente

- aumentado

- Indica

- indicadores

- INSTRUMENTO individual

- industrias

- influir

- influenciado

- EN LA MINA

- inicial

- originales

- Las opciones de entrada

- entradas

- ejemplo

- Instrucciones

- aseguradora

- integrar

- Destinado a

- interactuar

- interactuando

- interacción

- interactúa

- Interfaz

- Internet

- conexión a Internet

- Internet de las cosas

- dentro

- introducir

- metas de

- involucra

- que implica

- IOT

- IT

- SUS

- Trabajos

- Viajes

- Julio

- solo

- Clave

- factor clave

- Tipo

- Saber

- especialistas

- conocido

- Label

- Etiquetas

- lago

- idioma

- large

- mayores

- Apellido

- Estado latente

- .

- ponedoras

- líder

- Prospectos

- APRENDE:

- aprendizaje

- Abandonar

- prestar

- menos

- Nivel

- aprovechando

- bibliotecas

- Licencia

- Licencias

- ciclo de vida

- como

- Me gusta

- limitaciones

- LINK

- LLM

- carga

- local

- situados

- Ubicación

- Londres

- Largo

- por más tiempo

- inferior

- máquina

- máquina de aprendizaje

- hecho

- Inicio

- mantener

- Mayoría

- Realizar

- manejable

- obligatorio

- manual

- a mano

- Fabricación

- muchos

- mapa

- masivo

- madurez

- máximas

- Puede..

- me

- sentido

- significa

- mecanismo

- los mecanismos de

- Medios

- Mediterráneo

- mencionado

- la fusión de

- malla

- metadatos

- Método

- Metodología

- métodos

- Métrica

- Ed. Media

- Oriente Medio

- podría

- mínimo

- ML

- MLOps

- modelo

- modelos

- Monitorear

- monitoreado

- monitoreo

- más,

- más eficiente

- MEJOR DE TU

- cuales son las que reflejan

- Motorsports

- movimiento

- emocionado

- movimiento

- mucho más

- múltiples

- Música

- debe

- my

- nombre

- Natural

- Procesamiento natural del lenguaje

- Naturaleza

- Navegar

- necesario

- ¿ Necesita ayuda

- negativas

- del sistema,

- red neural

- Neutro

- nunca

- Nuevo

- recién

- Next

- nlp

- no

- normal

- North

- notable

- número

- observar

- of

- LANZAMIENTO

- Ofrecido

- a menudo

- on

- Inmersión

- ONE

- las

- , solamente

- habiertos

- de código abierto

- funcionamiento

- Operaciones

- óptimo

- Optión

- Opciones

- or

- organización

- para las fiestas.

- Otro

- Otros

- de otra manera

- nuestros

- salir

- Resultado

- salida

- Más de

- total

- visión de conjunto

- EL DESARROLLADOR

- propietario

- los propietarios de

- paquete

- pares

- parámetros

- .

- Personas

- para

- Realizar

- actuación

- realizar

- quizás

- persona

- con

- Personalizado

- la perspectiva

- fase

- Fotos

- pieza

- industrial

- Colocar

- plataforma

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Por favor

- punto

- puntos

- políticas

- positivo

- poseer

- posible

- Publicación

- Artículos

- posible

- la posibilidad

- industria

- poderoso

- Metodología

- prácticas

- Precisión

- predecir

- predicción

- Predicciones

- preparación

- Preparar

- preparado

- preparación

- presentó

- anterior

- previamente

- Prime

- primer ministro

- principios

- Anterior

- priorizar

- política de privacidad

- privada

- Problema

- en costes

- tratamiento

- producido

- productor

- Producto

- Producción

- Programación

- proyecto

- promover

- prueba

- prueba de concepto

- ofrece

- propietario

- Demostrar.

- proporcionar

- previsto

- proveedor

- los proveedores

- proporciona un

- proporcionando

- propósito

- fines

- empuja

- rompecabezas

- calidad

- pregunta

- Preguntas

- Búsqueda

- plantea

- distancia

- que van

- rápidamente

- Rate

- más bien

- .

- Reading

- en tiempo real

- razón

- recepción

- recomiendan

- Rojo

- Reducción

- FILTRO

- con respecto a

- registros

- registro

- reglamentos

- relacionado

- liberado

- la relevancia

- fiabilidad

- permanece

- sanaciones

- reemplazados

- reporte

- repositorio

- representación

- representante

- solicita

- solicitudes

- Requisitos

- Requisitos

- requiere

- la investigación

- investigadores

- Recursos

- respectivamente

- respuesta

- respuestas

- responsable

- RESTO

- restricciones

- Restrictivo

- resultado

- Resultados

- el comercio minorista

- reutilizar

- una estrategia SEO para aparecer en las búsquedas de Google.

- revisado

- equitación

- Derecho

- hoja de ruta

- Función

- También soy miembro del cuerpo docente de World Extreme Medicine (WEM) y embajadora europea de igualdad para The Transformational Travel Council (TTC). En mi tiempo libre, soy una incansable aventurera, escaladora, patrona de día, buceadora y defensora de la igualdad de género en el deporte y la aventura. En XNUMX, fundé Almas Libres, una ONG nacida para involucrar, educar y empoderar a mujeres y niñas a través del deporte urbano, la cultura y la tecnología.

- aproximadamente

- redondo

- Ejecutar

- correr

- sabio

- mismo

- arenero

- Escala

- la ampliación

- guión

- escenarios

- Ciencia:

- los científicos

- Puntuación

- rayar

- guiones

- MAR

- Sección

- (secciones)

- sector

- seguro

- segura

- EN LINEA

- políticas de seguridad

- ver

- la búsqueda de

- seleccionado

- seleccionar

- selección

- enviando

- mayor

- expedido

- sentimiento

- separado

- Secuencia

- Serie

- ayudar

- de coches

- Servicios

- servicio

- set

- Varios

- la formación

- Compartir

- compartido

- barcos

- En Corto

- tienes

- mostrado

- Shows

- lado

- importante

- significativamente

- similares

- simplificar

- Tamaño

- habilidades

- chica

- menores

- PYME

- So

- a medida

- Soluciones

- RESOLVER

- algo

- Fuente

- código fuente

- Fuentes

- Espacio

- especial

- especialista

- especializado

- soluciones y

- específicamente

- velocidad

- pasar

- gastado

- Etapa

- etapas

- las partes interesadas

- estándar

- estandarizando

- comienzo

- Estado

- paso

- pasos

- tienda

- almacenados

- almacenamiento

- Historia

- fortalezas

- fuerte

- Después

- exitosos

- tal

- sugieren

- idoneidad

- adecuado

- resumir

- RESUMEN

- SOPORTE

- Soportado

- Supuesto

- seguro

- SWIFT

- te

- mesa

- ¡Prepárate!

- Tarea

- tareas

- equipo

- equipos

- Técnico

- técnicas

- Tecnologías

- Tecnología

- términos

- test

- probado

- probadores

- Pruebas

- que

- esa

- La

- El futuro de las

- La Fuente

- el Reino Unido

- el mundo

- su

- Les

- sí mismos

- luego

- Ahí.

- por lo tanto

- Estas

- ellos

- cosas

- Ideas

- terceros.

- así

- aquellos

- ¿aunque?

- pensamiento

- miles

- Tres

- equipo

- a

- juntos

- ficha

- Tokens

- parte superior

- Temas

- hacia

- comercio

- tradicional

- Entrenar

- entrenado

- Formación

- Transformar

- viajes

- viajes

- Tendencia

- detonante

- verdadero

- verdad

- try

- dos

- tipo

- tipos

- típicamente

- ui

- Uk

- entender

- comprensión

- unidad

- unidades que

- Actualizaciones

- ¿Cómo subir tu libro?

- us

- usable

- Uso

- utilizan el

- caso de uso

- usado

- Usuario

- usuarios

- usos

- usando

- utilidades

- utilizado

- diversos

- verificar

- versión

- Versus

- vertical

- vía

- y

- visualizar

- vs

- quieres

- fue

- we

- web

- servicios web

- Página web

- WELL

- ¿

- Que es

- cuando

- mientras

- sean

- que

- mientras

- QUIENES

- amplio

- Amplia gama

- seguirá

- ventana

- ventanas

- dentro de

- sin

- Palabra

- palabras

- Actividades:

- trabajar juntos

- trabajado

- trabajando

- funciona

- mundo

- se

- años

- Rendimiento

- Usted

- tú

- zephyrnet