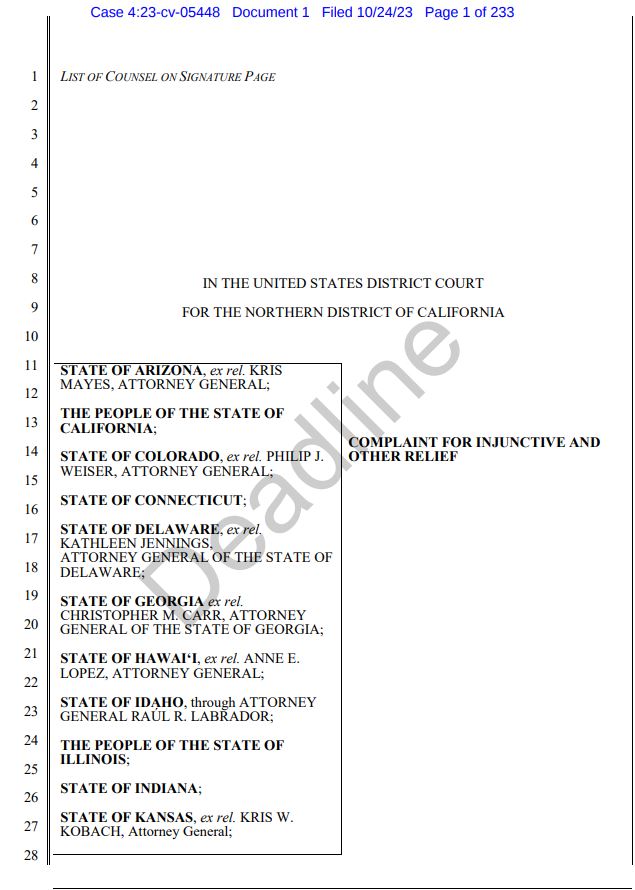

Un grupo de 34 estados de Estados Unidos está presentando una demanda contra Meta, propietario de Facebook e Instagram, acusando a la empresa de manipular indebidamente a menores que utilizan las plataformas. Este desarrollo se produce en medio de una rápida inteligencia artificial (AI) avances que involucran tanto texto como IA generativa.

Representantes legales de varios estados, incluidos California, Nueva York, Ohio, Dakota del Sur, Virginia y Luisiana. alegar que Meta utiliza sus algoritmos para fomentar comportamientos adictivos e impactar negativamente el bienestar mental de los niños a través de sus funciones dentro de la aplicación, como el botón "Me gusta".

Los litigantes gubernamentales son proceder con acciones legales a pesar del jefe de IA Científico de Meta hablando recientemente, supuestamente diciendo que las preocupaciones sobre los riesgos existenciales de la tecnología aún son "prematuras", y Meta ya ha aprovechó la IA para abordar problemas de confianza y seguridad en sus plataformas.

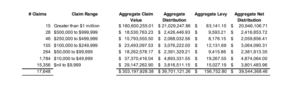

Los abogados de los estados buscan diferentes daños, restitución y compensación para cada estado mencionado en el documento, con cifras que van desde $5,000 a $25,000 por presunto suceso. Cointelegraph contactó a Meta para obtener más información, pero aún no ha recibido una respuesta.

Mientras tanto, la Internet Watch Foundation (IWF), con sede en el Reino Unido, ha expresado su preocupación por la alarmante proliferación de material de abuso sexual infantil (CSAM) generado por IA. En una reciente reporte, la IWF reveló el descubrimiento de más de 20,254 imágenes CSAM generadas por IA en un solo foro de la web oscura en solo un mes, advirtiendo que este aumento de contenido perturbador tiene el potencial de inundar Internet.

La organización instó a la cooperación global para combatir el problema del CSAM, sugiriendo una estrategia multifacética, que incluya ajustes a las leyes existentes, mejoras en la educación policial y la implementación de supervisión regulatoria para los modelos de IA.

Relacionado: Investigadores en China desarrollaron un motor de corrección de alucinaciones para modelos de IA

En cuanto a los desarrolladores de IA, la IWF aconseja prohibir que la IA genere contenido de abuso infantil, excluir los modelos asociados y centrarse en eliminar dicho material de sus modelos.

El avance de los generadores de imágenes de IA ha mejorado significativamente la creación de réplicas humanas realistas. Plataformas como Midjourney, Runway, Stable Diffusion y Dall-E de OpenAI son ejemplos populares de herramientas capaces de generar imágenes realistas.

Magazine: 'La IA ha matado a la industria': el jefe de EasyTranslate habla sobre cómo adaptarse al cambio

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://cointelegraph.com/news/meta-faces-legal-scrutiny-ai-advancements-raise-concerns-child-safety

- :posee

- :es

- 000

- 10

- 20

- a

- Nuestra Empresa

- abuso

- la columna Acción

- dirección

- ajustes

- avance

- avances

- en contra

- AI

- Modelos AI

- algoritmos

- presunto

- ya haya utilizado

- En medio de

- y

- somos

- AS

- asociado

- At

- comportamiento

- JEFE

- ambas

- pero

- .

- California

- capaz

- jefe

- sus hijos

- Niños

- China

- Cointelegraph

- luchar contra la

- proviene

- compañía

- para Trabajadores

- Inquietudes

- contenido

- cooperación

- creación

- Dakota

- de dall

- Oscuro

- Web Obscura

- dc

- A pesar de las

- desarrollado

- desarrolladores

- Desarrollo

- una experiencia diferente

- Difusión

- descubrimiento

- documento

- cada una

- Educación

- cumplimiento

- interactuando

- Motor

- mejoras

- ejemplos

- excluyendo

- existencial

- existente

- caras

- Caracteristicas

- Figuras

- Presentación

- enfoque

- Foro

- Cuidados de acogida

- Fundación

- Desde

- la generación de

- generativo

- IA generativa

- generadores

- Buscar

- Gobierno

- Grupo procesos

- HTTPS

- humana

- imagen

- imágenes

- Impacto

- implementación

- mejorado

- in

- Incluye

- información

- Intelligence

- Internet

- que implica

- SUS

- jpg

- solo

- de derecho criminal

- aplicación de la ley

- leyes

- pleito

- Legal

- Accion legal

- Louisiana

- Manipulación

- materiales

- mental

- mencionado

- Meta

- Medio viaje

- modelos

- Mes

- más,

- multifacético

- negativamente

- Nuevo

- New York

- aparición

- of

- Ohio

- on

- organización

- salir

- Más de

- propietario

- (PDF)

- para

- Plataformas

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Popular

- posible

- aumento

- elevado

- que van

- rápido

- alcanzado

- realista

- recepción

- reciente

- recientemente

- regulador

- la eliminación de

- Representantes

- respuesta

- Revelado

- riesgos

- pista

- Safety

- decir

- escrutinio

- la búsqueda de

- Sexual

- significativamente

- soltero

- Fuente

- Sur

- hablar

- estable

- Estado

- Zonas

- Sin embargo

- Estrategia

- tal

- supervisión

- oleada

- Tecnología

- texto

- que

- esa

- La

- su

- así

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- a

- Confía en

- United

- Estados Unidos

- utilizan el

- utiliza

- diversos

- Virginia

- advertencia

- Ver ahora

- web

- QUIENES

- aún

- york

- zephyrnet