La preparación de datos es un paso fundamental en cualquier proyecto basado en datos y contar con las herramientas adecuadas puede mejorar en gran medida la eficiencia operativa. Wrangler de datos de Amazon SageMaker reduce el tiempo que lleva agregar y preparar datos tabulares y de imágenes para el aprendizaje automático (ML) de semanas a minutos. Con SageMaker Data Wrangler, puede simplificar el proceso de preparación de datos y la ingeniería de características y completar cada paso del flujo de trabajo de preparación de datos, incluida la selección, limpieza, exploración y visualización de datos desde una única interfaz visual.

En esta publicación, exploramos las funciones más recientes de SageMaker Data Wrangler que están específicamente diseñadas para mejorar la experiencia operativa. Profundizamos en el apoyo de Servicio de almacenamiento simple (Amazon S3) manifiesto archivos, artefactos de inferencia en un flujo de datos interactivo y la perfecta integración con JSON (notación de objetos JavaScript) formato para inferencia, destacando cómo estas mejoras hacen que la preparación de datos sea más fácil y eficiente.

Introduciendo nuevas funciones

En esta sección, analizamos las nuevas funciones de SageMaker Data Wrangler para una preparación óptima de los datos.

Compatibilidad con archivos de manifiesto de S3 con SageMaker Autopilot para inferencia de aprendizaje automático

SageMaker Data Wrangler permite un preparación de datos unificados y entrenamiento de modelos experiencia con Piloto automático Amazon SageMaker en unos pocos clics. Puede usar SageMaker Autopilot para entrenar, ajustar e implementar automáticamente modelos en los datos que ha transformado en su flujo de datos.

Esta experiencia ahora se simplifica aún más con la compatibilidad con archivos de manifiesto de S3. Un archivo de manifiesto de S3 es un archivo de texto que enumera los objetos (archivos) almacenados en un depósito de S3. Si su conjunto de datos exportado en SageMaker Data Wrangler es bastante grande y se divide en archivos de datos de varias partes en Amazon S3, ahora SageMaker Data Wrangler creará automáticamente un archivo de manifiesto en S3 que representa todos estos archivos de datos. Este archivo de manifiesto generado ahora se puede usar con la interfaz de usuario de SageMaker Autopilot en SageMaker Data Wrangler para recoger todos los datos particionados para el entrenamiento.

Antes del lanzamiento de esta función, cuando usaba modelos de SageMaker Autopilot capacitados con datos preparados de SageMaker Data Wrangler, solo podía elegir un archivo de datos, que podría no representar todo el conjunto de datos, especialmente si el conjunto de datos es muy grande. Con esta nueva experiencia de archivo de manifiesto, no está limitado a un subconjunto de su conjunto de datos. Puede crear un modelo de ML con SageMaker Autopilot que represente todos sus datos mediante el archivo de manifiesto y utilizarlo para la inferencia de ML y la implementación de producción. Esta función mejora la eficiencia operativa al simplificar el entrenamiento de modelos ML con SageMaker Autopilot y agilizar los flujos de trabajo de procesamiento de datos.

Se agregó soporte para flujo de inferencia en artefactos generados.

Los clientes quieren tomar las transformaciones de datos que han aplicado a los datos de entrenamiento de su modelo, como la codificación one-hot, PCA e imputar valores faltantes, y aplicar esas transformaciones de datos a la inferencia en tiempo real o la inferencia por lotes en producción. Para hacerlo, debe tener un artefacto de inferencia de SageMaker Data Wrangler, que es consumido por un modelo de SageMaker.

Anteriormente, los artefactos de inferencia solo se podían generar desde la interfaz de usuario al exportar a la capacitación de SageMaker Autopilot o al exportar un cuaderno de canalización de inferencia. Esto no brindaba flexibilidad si deseaba llevar sus flujos de SageMaker Data Wrangler fuera del Estudio Amazon SageMaker ambiente. Ahora, puede generar un artefacto de inferencia para cualquier archivo de flujo compatible a través de un trabajo de procesamiento de SageMaker Data Wrangler. Esto permite MLOps programáticos de extremo a extremo con flujos de SageMaker Data Wrangler para personas de MLOps con código primero, así como una ruta intuitiva sin código para obtener un artefacto de inferencia mediante la creación de un trabajo desde la interfaz de usuario.

Optimización de la preparación de datos

JSON se ha convertido en un formato ampliamente adoptado para el intercambio de datos en los ecosistemas de datos modernos. La integración de SageMaker Data Wrangler con el formato JSON le permite manejar sin problemas los datos JSON para su transformación y limpieza. Al brindar soporte nativo para JSON, SageMaker Data Wrangler simplifica el proceso de trabajo con datos estructurados y semiestructurados, lo que le permite extraer información valiosa y preparar datos de manera eficiente. SageMaker Data Wrangler ahora es compatible con el formato JSON para la implementación de terminales de inferencia en tiempo real y por lotes.

Resumen de la solución

Para nuestro caso de uso, usamos la muestra Conjunto de datos de reseñas de clientes de Amazon para mostrar cómo SageMaker Data Wrangler puede simplificar el esfuerzo operativo para crear un nuevo modelo ML utilizando SageMaker Autopilot. El conjunto de datos de reseñas de clientes de Amazon contiene reseñas de productos y metadatos de Amazon, incluidas 142.8 millones de reseñas que abarcan desde mayo de 1996 hasta julio de 2014.

En un alto nivel, usamos SageMaker Data Wrangler para administrar este gran conjunto de datos y realizar las siguientes acciones:

- Desarrolle un modelo ML en SageMaker Autopilot utilizando todo el conjunto de datos, no solo una muestra.

- Cree una canalización de inferencia en tiempo real con el artefacto de inferencia generado por SageMaker Data Wrangler y utilice el formato JSON para la entrada y la salida.

Compatibilidad con archivos de manifiesto de S3 con SageMaker Autopilot

Al crear un experimento de SageMaker Autopilot con SageMaker Data Wrangler, anteriormente solo podía especificar un solo archivo CSV o Parquet. Ahora también puede usar un archivo de manifiesto de S3, lo que le permite usar grandes cantidades de datos para los experimentos de SageMaker Autopilot. SageMaker Data Wrangler dividirá automáticamente los archivos de datos de entrada en varios archivos más pequeños y generará un manifiesto que se puede usar en un experimento de SageMaker Autopilot para extraer todos los datos de la sesión interactiva, no solo una pequeña muestra.

Complete los siguientes pasos:

- Importe los datos de reseñas de clientes de Amazon desde un archivo CSV a SageMaker Data Wrangler. Asegúrese de desactivar el muestreo al importar los datos.

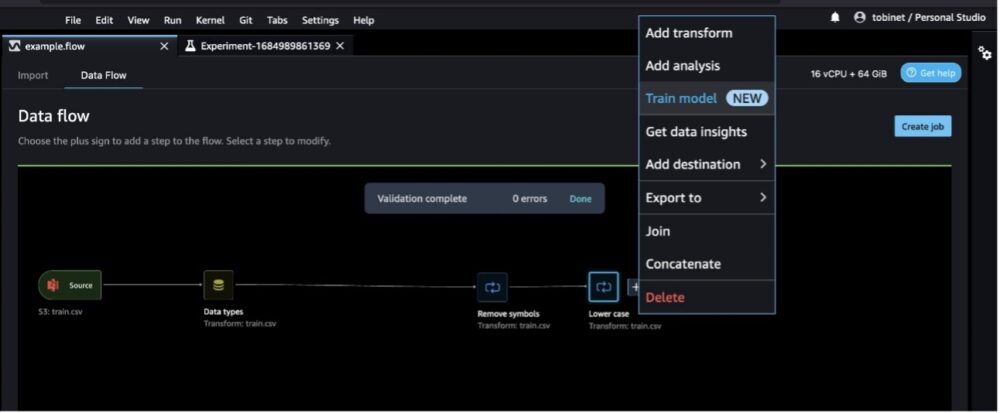

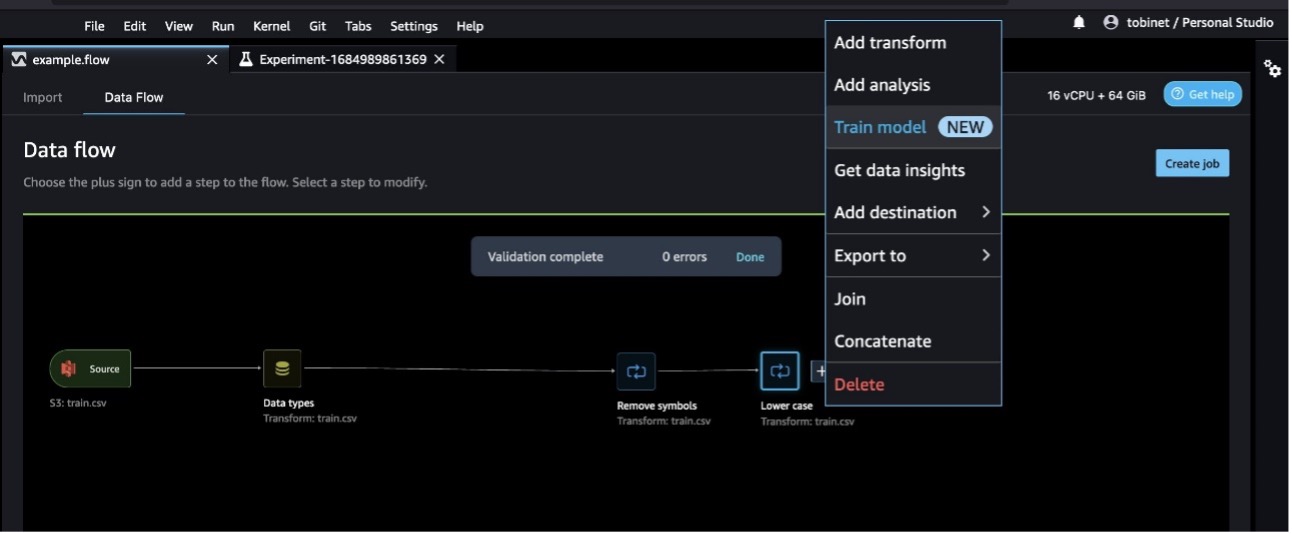

- Especifique las transformaciones que normalizan los datos. Para este ejemplo, elimine los símbolos y transforme todo a minúsculas utilizando las transformaciones integradas de SageMaker Data Wrangler.

- Elige Modelo de tren para empezar a entrenar.

Para entrenar un modelo con SageMaker Autopilot, SageMaker exporta datos automáticamente a un depósito S3. Para grandes conjuntos de datos como este, dividirá automáticamente el archivo en archivos más pequeños y generará un manifiesto que incluye la ubicación de los archivos más pequeños.

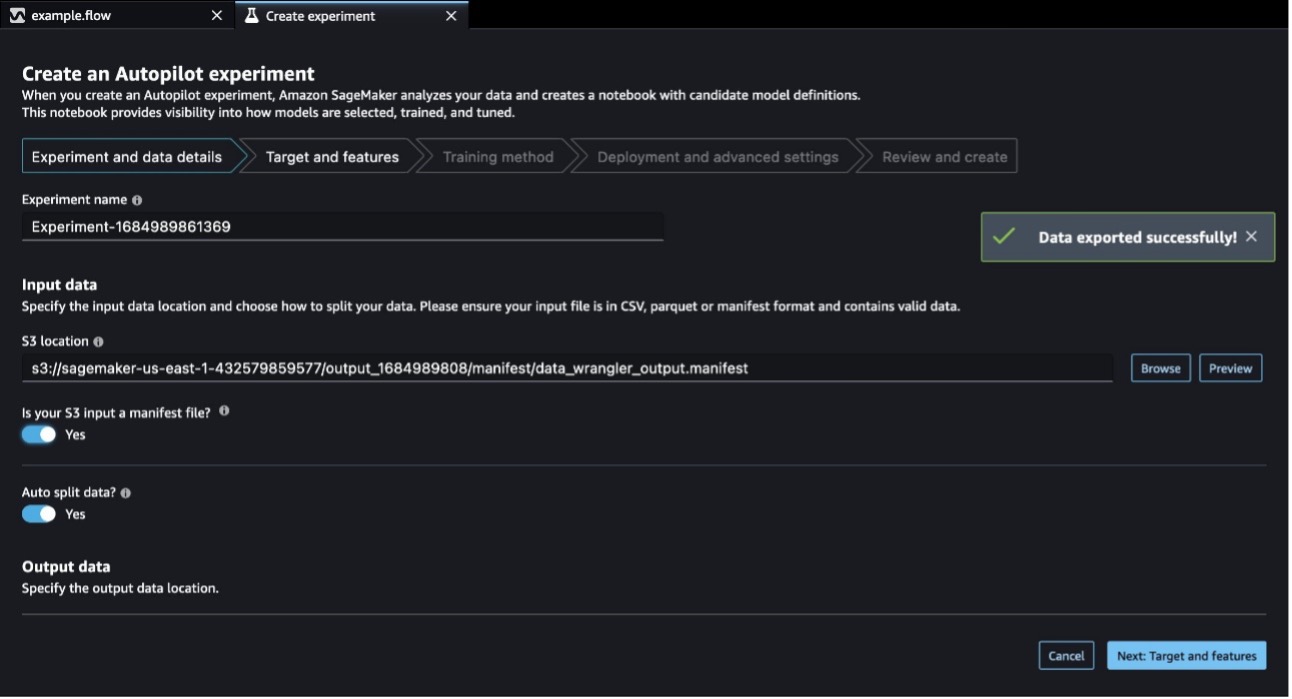

- Primero, seleccione sus datos de entrada.

Anteriormente, SageMaker Data Wrangler no tenía la opción de generar un archivo de manifiesto para usar con SageMaker Autopilot. Hoy, con el lanzamiento de la compatibilidad con archivos de manifiesto, SageMaker Data Wrangler exportará automáticamente un archivo de manifiesto a Amazon S3, completará previamente la ubicación de S3 de la capacitación de SageMaker Autopilot con la ubicación de S3 del archivo de manifiesto y cambiará la opción de archivo de manifiesto a Sí. No es necesario realizar ningún trabajo para generar o utilizar el archivo de manifiesto.

- Configure su experimento seleccionando el objetivo para que el modelo prediga.

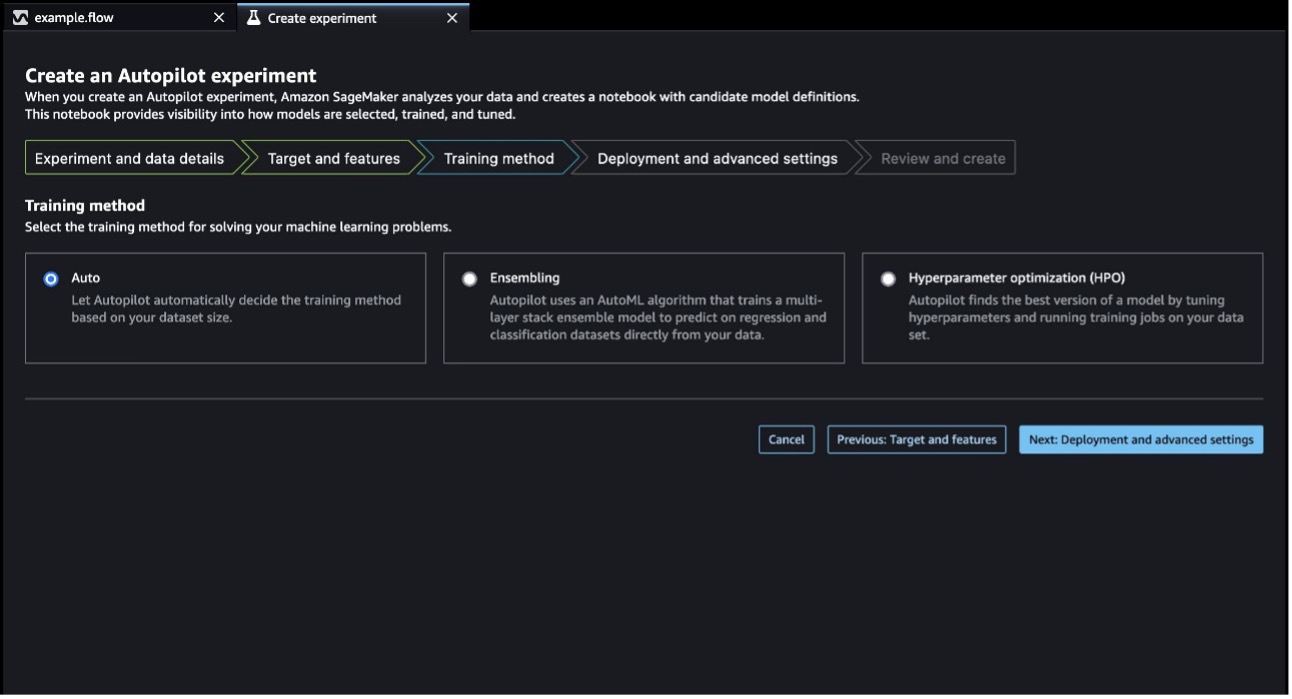

- A continuación, seleccione un método de entrenamiento. En este caso, seleccionamos Auto y deje que SageMaker Autopilot decida el mejor método de entrenamiento en función del tamaño del conjunto de datos.

- Especifique la configuración de implementación.

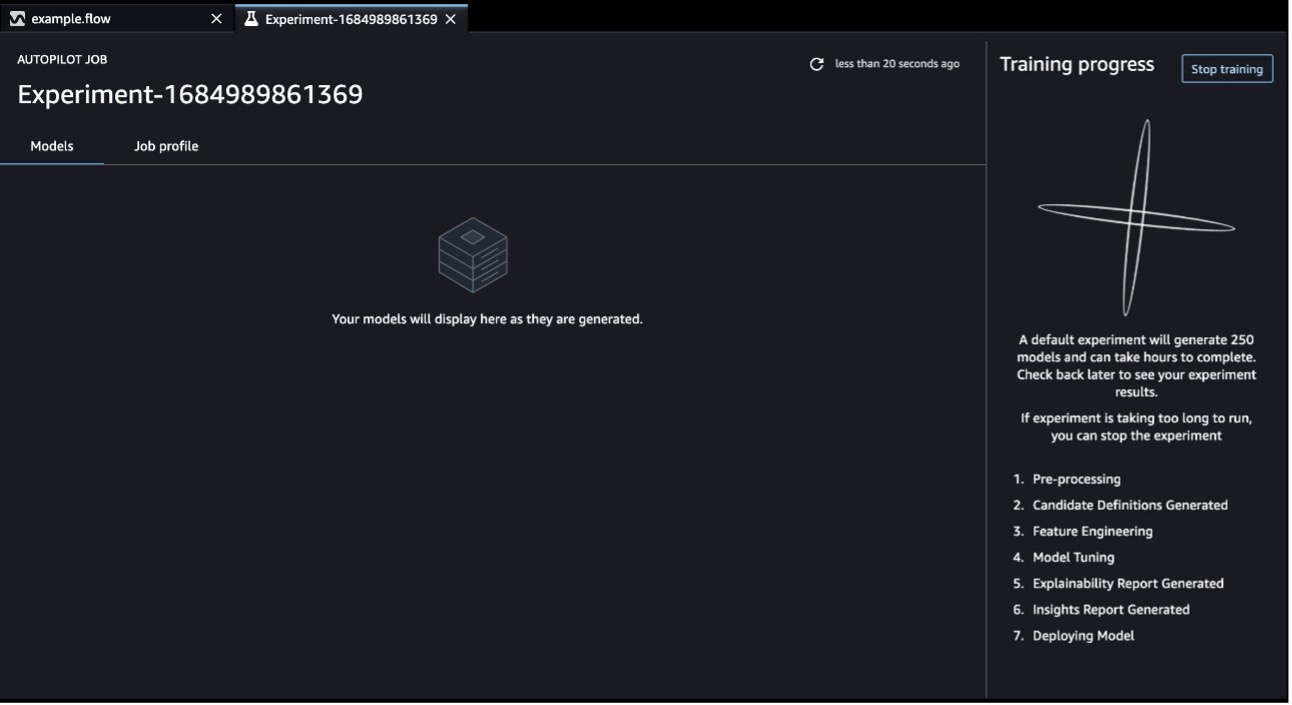

- Finalmente, revise la configuración del trabajo y envíe el experimento de SageMaker Autopilot para entrenamiento. Cuando SageMaker Autopilot completa el experimento, puede ver los resultados del entrenamiento y explorar el mejor modelo.

Gracias a la compatibilidad con los archivos de manifiesto, puede usar todo su conjunto de datos para el experimento de SageMaker Autopilot, no solo un subconjunto de sus datos.

Para obtener más información sobre el uso de SageMaker Autopilot con SageMaker Data Wrangler, consulte Preparación unificada de datos y entrenamiento de modelos con Amazon SageMaker Data Wrangler y Amazon SageMaker Autopilot.

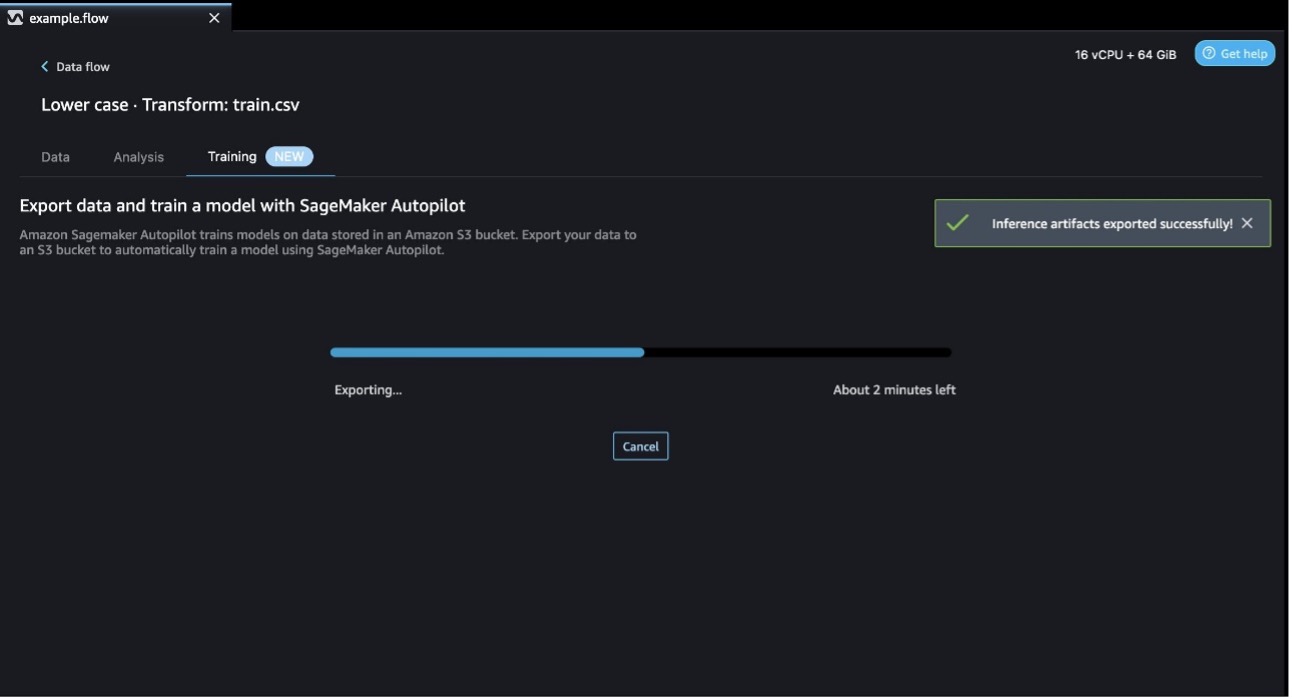

Genere artefactos de inferencia a partir de trabajos de procesamiento de SageMaker

Ahora, veamos cómo podemos generar artefactos de inferencia a través de la interfaz de usuario de SageMaker Data Wrangler y los cuadernos de SageMaker Data Wrangler.

Interfaz de usuario de SageMaker Data Wrangler

Para nuestro caso de uso, queremos procesar nuestros datos a través de la interfaz de usuario y luego usar los datos resultantes para entrenar e implementar un modelo a través de la consola de SageMaker. Complete los siguientes pasos:

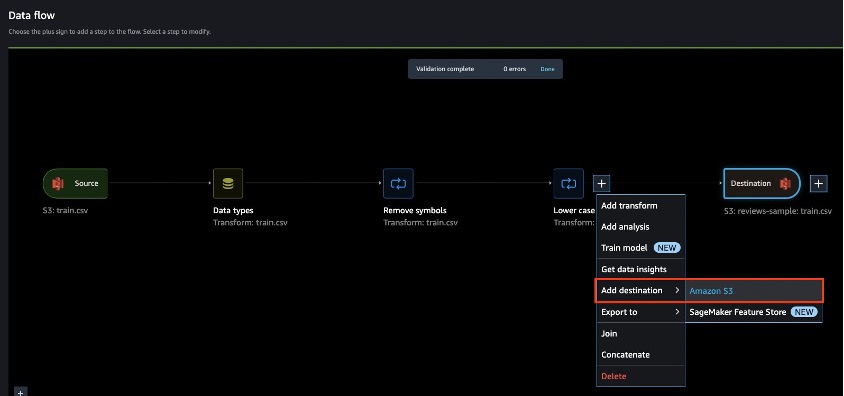

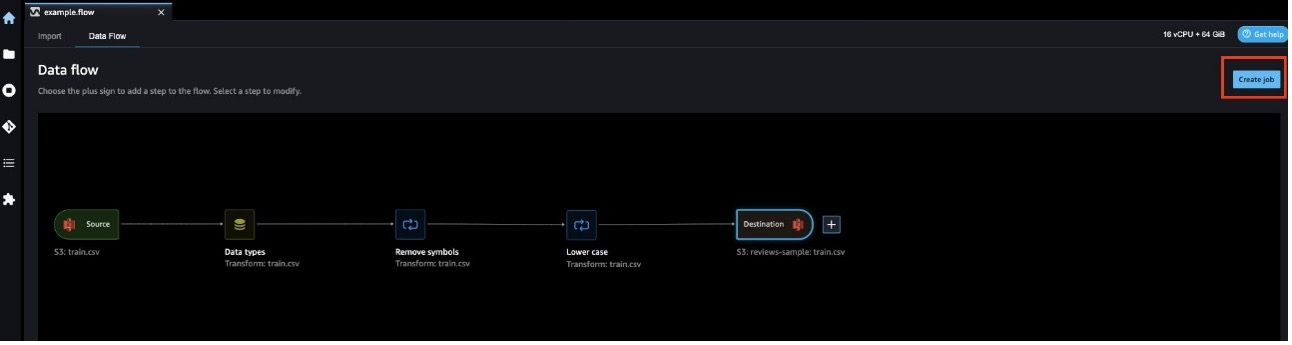

- Abra el flujo de datos que creó en la sección anterior.

- Elija el signo más junto a la última transformación, elija Añadir destino, y elige Amazon S3. Aquí será donde se almacenarán los datos procesados.

- Elige Crear trabajo.

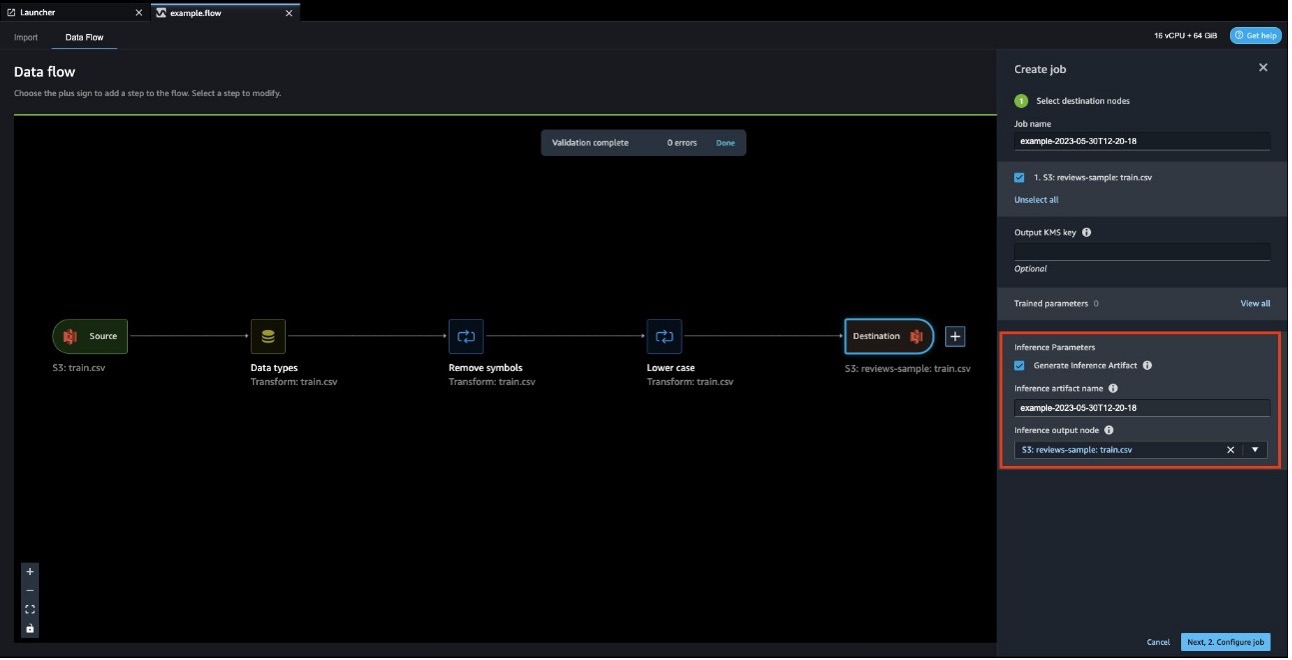

- Seleccione Generar artefactos de inferencia en la sección Parámetros de inferencia para generar un artefacto de inferencia.

- Para el nombre del artefacto de inferencia, ingrese el nombre de su artefacto de inferencia (con .tar.gz como extensión de archivo).

- Para el nodo de salida de inferencia, ingrese el nodo de destino correspondiente a las transformaciones aplicadas a sus datos de entrenamiento.

- Elige Configurar trabajo.

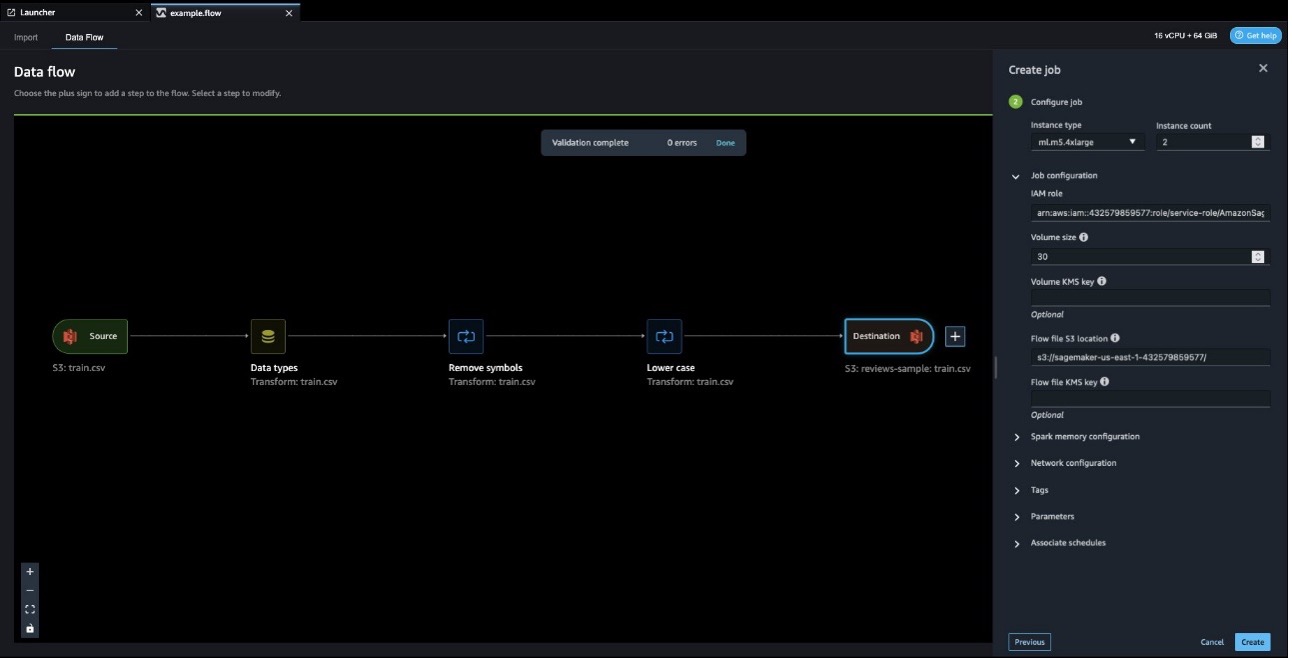

- under Configuración del trabajo, introduzca una ruta para Ubicación del archivo de flujo S3. Una carpeta llamada

data_wrangler_flowsse creará en esta ubicación y el artefacto de inferencia se cargará en esta carpeta. Para cambiar la ubicación de carga, configure una ubicación de S3 diferente. - Deje los valores predeterminados para todas las demás opciones y elija Crear para crear el trabajo de procesamiento.

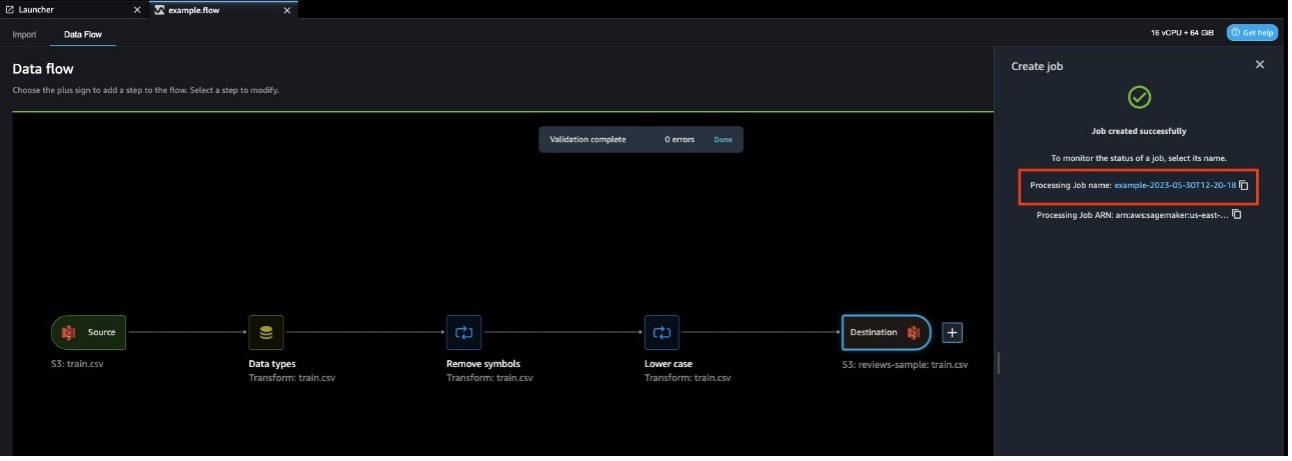

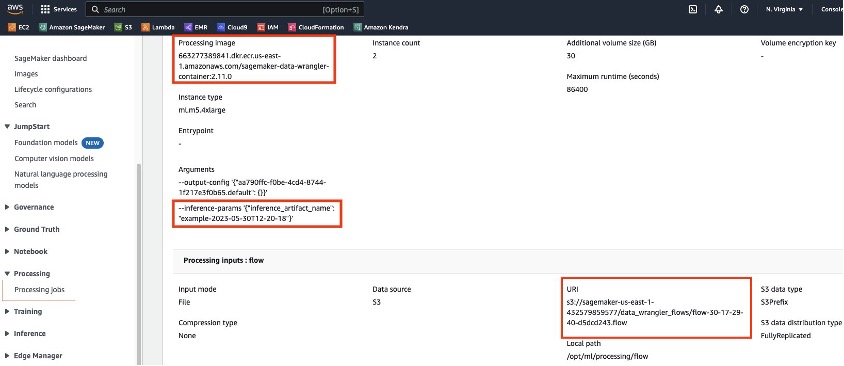

El trabajo de procesamiento creará untarball (.tar.gz)que contiene un archivo de flujo de datos modificado con una sección de inferencia recién agregada que le permite usarlo para la inferencia. Necesita el identificador uniforme de recursos (URI) de S3 del artefacto de inferencia para proporcionar el artefacto a un modelo de SageMaker al implementar su solución de inferencia. El URI tendrá la forma{Flow file S3 location}/data_wrangler_flows/{inference artifact name}.tar.gz. - Si no anotó estos valores anteriormente, puede elegir el enlace al trabajo de procesamiento para encontrar los detalles relevantes. En nuestro ejemplo, el URI es

s3://sagemaker-us-east-1-43257985977/data_wrangler_flows/example-2023-05-30T12-20-18.tar.gz.

- Copie el valor de Imagen de procesamiento; también necesitamos este URI al crear nuestro modelo.

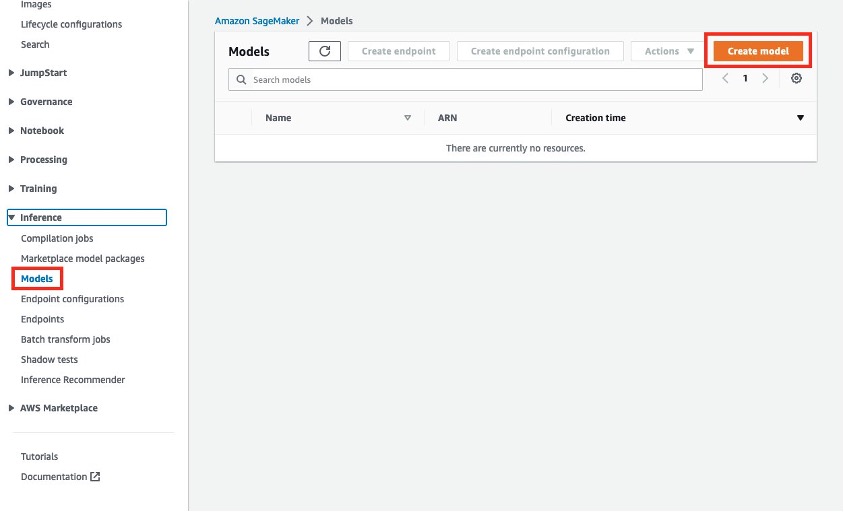

- Ahora podemos usar este URI para crear un modelo de SageMaker en la consola de SageMaker, que luego podemos implementar en un punto final o en un trabajo de transformación por lotes.

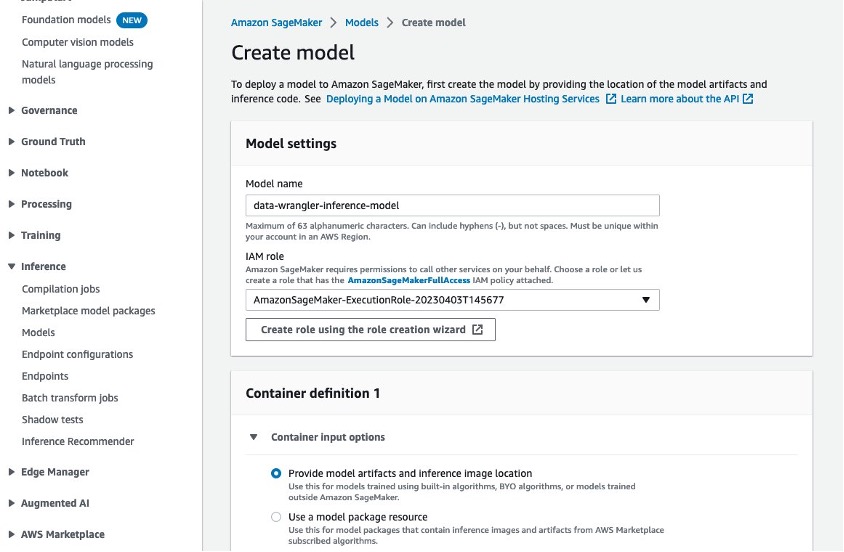

- under Configuración del modelo¸ introduzca un nombre de modelo y especifique su función de IAM.

- Opciones de entrada de contenedores, seleccione Proporcione artefactos modelo y ubicación de imágenes de inferencia.

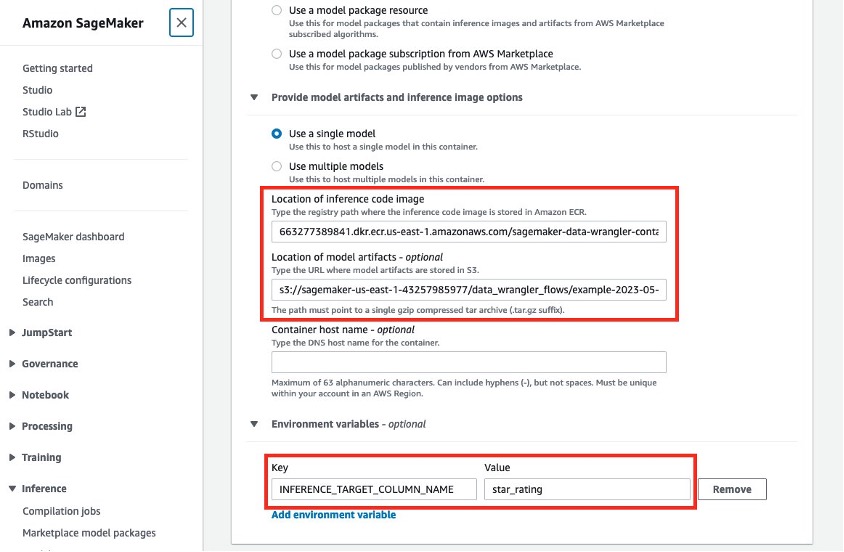

- Ubicación de la imagen del código de inferencia, ingrese el URI de la imagen de procesamiento.

- Ubicación de los artefactos del modelo, ingrese el URI del artefacto de inferencia.

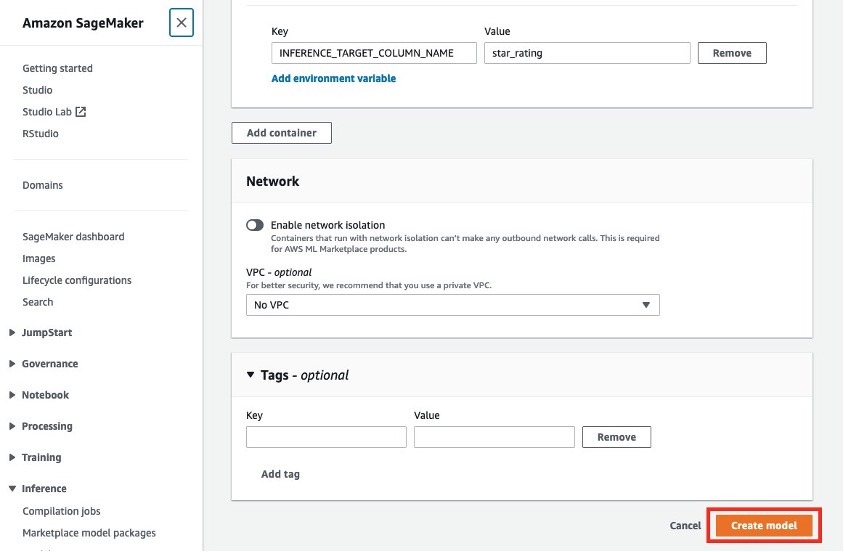

- Además, si sus datos tienen una columna de destino que será predicha por un modelo de ML entrenado, especifique el nombre de esa columna en Variables de entorno, con las

INFERENCE_TARGET_COLUMN_NAMEas Clave y el nombre de la columna como Valor.

- Termine de crear su modelo eligiendo Crear modelo.

Ahora tenemos un modelo que podemos implementar en un punto final o en un trabajo de transformación por lotes.

Cuadernos SageMaker Data Wrangler

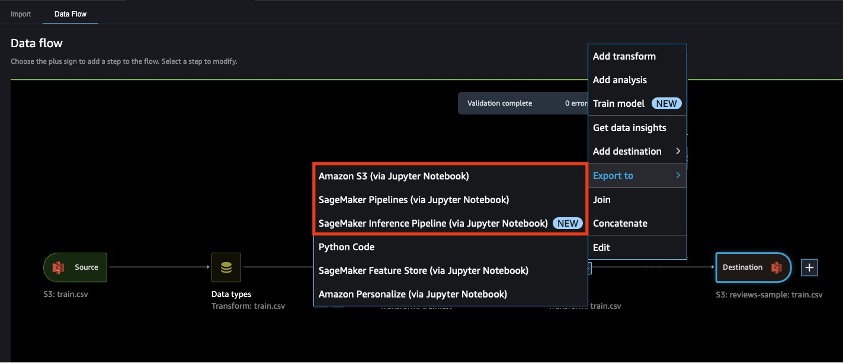

Para un enfoque de código primero para generar el artefacto de inferencia a partir de un trabajo de procesamiento, podemos encontrar el código de ejemplo eligiendo Exportar a en el menú del nodo y seleccionando Amazon S3, Tuberías de SageMakero Canalización de inferencia de SageMaker. Nosotros elegimos Canalización de inferencia de SageMaker en este ejemplo.

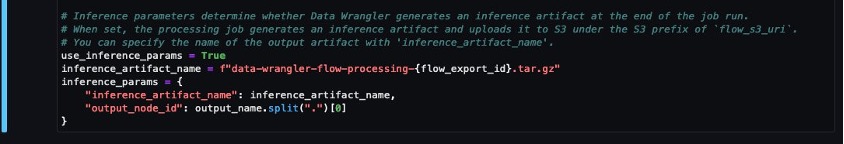

En este cuaderno, hay una sección titulada Crear procesador (Esto es idéntico en el cuaderno de SageMaker Pipelines, pero en el cuaderno de Amazon S3, el código equivalente estará bajo el Configuraciones de trabajo sección). Al final de esta sección hay una configuración para nuestro artefacto de inferencia llamado inference_params. Contiene la misma información que vimos en la interfaz de usuario, es decir, el nombre del artefacto de inferencia y el nodo de salida de la inferencia. Estos valores se completarán previamente, pero se pueden modificar. Hay además un parámetro llamado use_inference_params, que debe establecerse en True para utilizar esta configuración en el trabajo de procesamiento.

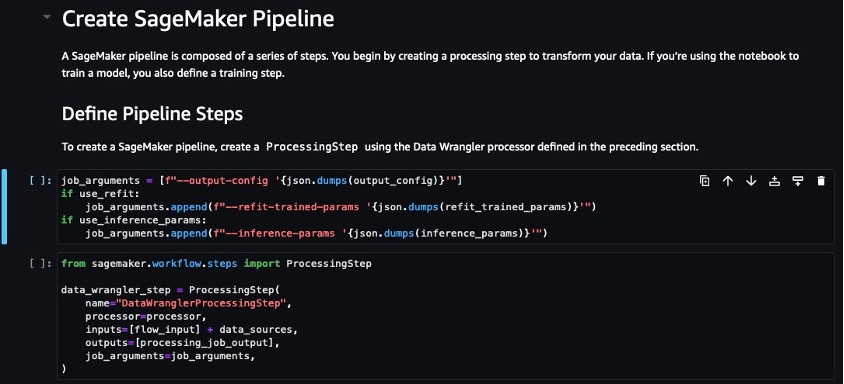

Más abajo hay una sección titulada Definir pasos de canalización, durante la cual la inference_params La configuración se agrega a una lista de argumentos de trabajo y se pasa a la definición de un paso de procesamiento de SageMaker Data Wrangler. En el portátil Amazon S3, job_arguments se define inmediatamente después de la Configuraciones de trabajo .

Con estas configuraciones simples, el trabajo de procesamiento creado por este cuaderno generará un artefacto de inferencia en la misma ubicación de S3 que nuestro archivo de flujo (definido anteriormente en nuestro cuaderno). Podemos determinar mediante programación esta ubicación de S3 y usar este artefacto para crear un modelo de SageMaker usando el SDK de SageMaker Python, que se demuestra en el cuaderno SageMaker Inference Pipeline.

El mismo enfoque se puede aplicar a cualquier código de Python que cree un trabajo de procesamiento de SageMaker Data Wrangler.

Soporte de formato de archivo JSON para entrada y salida durante la inferencia

Es bastante común que los sitios web y las aplicaciones usen JSON como solicitud/respuesta para las API para que la información sea fácil de analizar por diferentes lenguajes de programación.

Anteriormente, después de tener un modelo entrenado, solo podía interactuar con él a través de CSV como formato de entrada en una canalización de inferencia de SageMaker Data Wrangler. Hoy en día, puede usar JSON como formato de entrada y salida, lo que brinda más flexibilidad al interactuar con los contenedores de inferencia de SageMaker Data Wrangler.

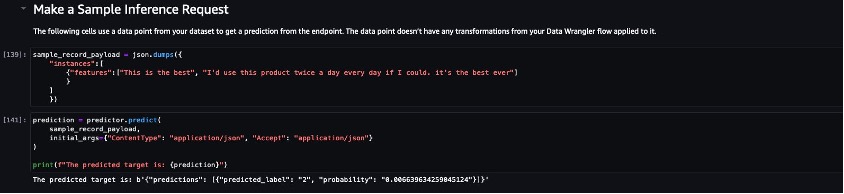

Para comenzar a usar JSON para entrada y salida en el cuaderno de canalización de inferencia, complete los siguientes pasos:

- Defina una carga útil.

Para cada carga útil, el modelo espera una clave llamada instancias. El valor es una lista de objetos, cada uno con su propio punto de datos. Los objetos requieren una clave llamada características, y los valores deben ser las características de un solo punto de datos que se pretende enviar al modelo. Se pueden enviar varios puntos de datos en una sola solicitud, hasta un tamaño total de 6 MB por solicitud.

Ver el siguiente código:

- Especifica el

ContentTypeasapplication/json. - Proporcione datos al modelo y reciba la inferencia en formato JSON.

See Formatos de datos comunes para inferencia para ejemplos de JSON de entrada y salida de muestra.

Limpiar

Cuando termine de usar SageMaker Data Wrangler, le recomendamos que cierre la instancia en la que se ejecuta para evitar incurrir en cargos adicionales. Para obtener instrucciones sobre cómo cerrar la aplicación SageMaker Data Wrangler y la instancia asociada, consulte Cerrar Data Wrangler.

Conclusión

Las nuevas funciones de SageMaker Data Wrangler, incluida la compatibilidad con los archivos de manifiesto de S3, las capacidades de inferencia y la integración del formato JSON, transforman la experiencia operativa de la preparación de datos. Estas mejoras agilizan la importación de datos, automatizan las transformaciones de datos y simplifican el trabajo con datos JSON. Con estas características, puede mejorar su eficiencia operativa, reducir el esfuerzo manual y extraer información valiosa de sus datos con facilidad. Aproveche el poder de las nuevas funciones de SageMaker Data Wrangler y desbloquee todo el potencial de sus flujos de trabajo de preparación de datos.

Para comenzar con SageMaker Data Wrangler, consulte la información más reciente en el Página de producto de SageMaker Data Wrangler.

Sobre los autores

Munish Dabra es Arquitecto Principal de Soluciones en Amazon Web Services (AWS). Sus áreas de enfoque actuales son AI/ML y Observabilidad. Tiene una sólida experiencia en el diseño y la construcción de sistemas distribuidos escalables. Le gusta ayudar a los clientes a innovar y transformar su negocio en AWS. LinkedIn: /mdabra

Munish Dabra es Arquitecto Principal de Soluciones en Amazon Web Services (AWS). Sus áreas de enfoque actuales son AI/ML y Observabilidad. Tiene una sólida experiencia en el diseño y la construcción de sistemas distribuidos escalables. Le gusta ayudar a los clientes a innovar y transformar su negocio en AWS. LinkedIn: /mdabra

Patricio Lin es ingeniero de desarrollo de software en Amazon SageMaker Data Wrangler. Tiene el compromiso de convertir a Amazon SageMaker Data Wrangler en la herramienta de preparación de datos número uno para los flujos de trabajo de aprendizaje automático en producción. Fuera del trabajo, puedes encontrarlo leyendo, escuchando música, conversando con amigos y sirviendo en su iglesia.

Patricio Lin es ingeniero de desarrollo de software en Amazon SageMaker Data Wrangler. Tiene el compromiso de convertir a Amazon SageMaker Data Wrangler en la herramienta de preparación de datos número uno para los flujos de trabajo de aprendizaje automático en producción. Fuera del trabajo, puedes encontrarlo leyendo, escuchando música, conversando con amigos y sirviendo en su iglesia.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Automoción / vehículos eléctricos, Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- Desplazamientos de bloque. Modernización de la propiedad de compensaciones ambientales. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/optimize-data-preparation-with-new-features-in-aws-sagemaker-data-wrangler/

- :posee

- :es

- :no

- :dónde

- $ UP

- 100

- 1996

- 2014

- 7

- 8

- 9

- a

- acciones

- adicional

- Adicionales

- Adicionalmente

- adoptado

- Después

- AI / ML

- Todos

- Permitir

- permite

- también

- Amazon

- Amazon SageMaker

- Piloto automático Amazon SageMaker

- Wrangler de datos de Amazon SageMaker

- Amazon Web Services

- Servicios Web de Amazon (AWS)

- cantidades

- an

- y

- cualquier

- API

- applicación

- aplicaciones

- aplicada

- Aplicá

- enfoque

- somos

- áreas

- argumentos

- AS

- asociado

- At

- automatizado

- automáticamente

- evitar

- AWS

- fondo

- basado

- BE

- a las que has recomendado

- "Ser"

- MEJOR

- Big

- ambas

- Fondo

- Descanso

- build

- Construir la

- incorporado

- pero

- by

- , que son

- PUEDEN

- capacidades

- case

- el cambio

- cargos

- comprobar

- Elige

- la elección de

- iglesia

- Limpieza

- código

- Columna

- comprometido

- Algunos

- compatible

- completar

- ultima

- Configuración

- Consola

- consumido

- Contenedores

- contiene

- conversaciones

- Correspondiente

- podría

- Para crear

- creado

- crea

- Creamos

- crítico

- Current

- cliente

- Clientes

- datos

- El intercambio de datos

- puntos de datos

- Preparación de datos

- proceso de datos

- basada en datos

- conjuntos de datos

- día

- decidir

- por defecto

- se define

- definición

- ahondar

- demostrado

- desplegar

- Desplegando

- despliegue

- diseñado

- diseño

- destino

- detalles

- Determinar

- Desarrollo

- una experiencia diferente

- discutir

- distribuidos

- sistemas distribuidos

- do

- DE INSCRIPCIÓN

- durante

- cada una

- Más temprano

- facilidad

- más fácil

- de forma sencilla

- ecosistemas

- eficiencia

- eficiente

- eficiente.

- esfuerzo

- ya sea

- Abrazar

- permite

- permitiendo

- de extremo a extremo

- Punto final

- ingeniero

- Ingeniería

- mejorar

- mejoras

- Mejora

- Participar

- Todo

- Entorno

- Equivalente a

- especialmente

- NUNCA

- Cada

- diario

- todo

- ejemplo

- ejemplos

- Intercambio

- esperando

- experience

- experimento

- experimentos

- exploración

- explorar

- exportar

- las exportaciones

- extensión

- extraerlos

- Feature

- Caracteristicas

- pocos

- Archive

- archivos

- Encuentre

- Flexibilidad

- de tus señales

- Flujos

- Focus

- seguir

- siguiendo

- formulario

- formato

- amigos

- Desde

- ser completados

- promover

- generar

- generado

- obtener

- muy

- tenido

- encargarse de

- Tienen

- es

- he

- ayudando

- Alta

- destacando

- su

- Cómo

- Como Hacer

- HTML

- HTTPS

- i

- idéntico

- identificador

- if

- imagen

- inmediatamente

- importar

- importador

- mejorar

- in

- incluye

- Incluye

- información

- innovar

- Las opciones de entrada

- Insights

- ejemplo

- Instrucciones

- integración

- Destinado a

- interactuar

- interactuando

- interactivo

- Interfaz

- dentro

- intuitivo

- IT

- SUS

- JavaScript

- Trabajos

- jpg

- json

- Julio

- solo

- Clave

- Idiomas

- large

- Apellidos

- luego

- más reciente

- lanzamiento

- aprendizaje

- dejar

- Nivel

- como

- Limitada

- LINK

- Etiqueta LinkedIn

- Lista

- Escucha Activa

- Listas

- Ubicación

- Mira

- máquina

- máquina de aprendizaje

- para lograr

- Realizar

- gestionan

- manual

- Puede..

- Menú

- metadatos

- Método

- podría

- millones

- Min

- que falta

- ML

- MLOps

- modelo

- modelos

- Moderno

- modificado

- más,

- más eficiente

- múltiples

- Música

- debe

- nombre

- Llamado

- a saber

- nativo

- necesario

- ¿ Necesita ayuda

- Nuevo

- Nuevas características

- recién

- Next

- no

- nodo

- cuaderno

- ahora

- número

- objeto

- objetos

- of

- on

- ONE

- , solamente

- operativos.

- óptimo

- Optimización

- Optión

- Opciones

- or

- Otro

- "nuestr

- salir

- salida

- afuera

- EL DESARROLLADOR

- parámetro

- parámetros

- pasado

- camino

- para

- Realizar

- recoger

- industrial

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- más

- punto

- puntos

- Publicación

- posible

- industria

- predecir

- previsto

- preparación

- Preparar

- preparado

- bastante

- previamente

- Director de la escuela

- Procesado

- tratamiento

- Producto

- Evaluación de productos

- Producción

- programático

- Programación

- lenguajes de programación

- proyecto

- proporcionar

- proporcionando

- Python

- Reading

- en tiempo real

- recepción

- recomiendan

- reducir

- reduce

- ,

- remove

- representar

- que representa

- solicita

- exigir

- Recurso

- resultante

- Resultados

- una estrategia SEO para aparecer en las búsquedas de Google.

- Reseñas

- Derecho

- Función

- corre

- s

- sabio

- Inferencia de SageMaker

- Tuberías de SageMaker

- mismo

- Sierra

- escalable

- sin costura

- sin problemas

- Sección

- ver

- seleccionar

- selección

- Servicios

- servicio

- Sesión

- set

- ajustes

- Varios

- tienes

- Mostrar

- cerrar

- firmar

- sencillos

- simplificado

- simplificar

- simplificando

- soltero

- Tamaño

- chica

- menores

- So

- Software

- Desarrollo de software ad-hoc

- a medida

- Soluciones

- abarcando

- específicamente

- dividido

- comienzo

- fundó

- paso

- pasos

- STORAGE

- almacenados

- aerodinamizar

- racionalización

- fuerte

- estructurado

- enviar

- Subido

- tal

- SOPORTE

- soportes

- seguro

- Todas las funciones a su disposición

- ¡Prepárate!

- toma

- Target

- esa

- La

- la información

- su

- luego

- Ahí.

- Estas

- así

- aquellos

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- titulada

- a

- hoy

- demasiado

- del IRS

- Total

- Entrenar

- entrenado

- Formación

- Transformar

- transformaciones

- transformado

- transformadas

- Twice

- ui

- bajo

- desbloquear

- subido

- utilizan el

- caso de uso

- usado

- usando

- Valioso

- propuesta de

- Valores

- muy

- vía

- Ver

- visualización

- quieres

- deseado

- we

- web

- servicios web

- sitios web

- Semanas

- WELL

- cuando

- que

- extensamente

- seguirá

- Actividades:

- flujo de trabajo

- flujos de trabajo

- trabajando

- Usted

- tú

- zephyrnet