En el mundo de la toma de decisiones basada en datos, predicción de series de tiempo Es clave para permitir que las empresas utilicen patrones de datos históricos para anticipar resultados futuros. Ya sea que trabaje en gestión de riesgos de activos, comercio, predicción meteorológica, pronóstico de la demanda de energía, monitoreo de signos vitales o análisis de tráfico, la capacidad de pronosticar con precisión es crucial para el éxito.

En estas aplicaciones, los datos de series temporales pueden tener cola pesada distribuciones, donde el cruz representan valores extremos. Es importante realizar pronósticos precisos en estas regiones para determinar qué tan probable es que se produzca un evento extremo y si es necesario dar la alarma. Sin embargo, estos valores atípicos afectan significativamente la estimación de la distribución base, lo que dificulta la elaboración de pronósticos sólidos. Las instituciones financieras dependen de modelos sólidos para predecir valores atípicos, como las caídas del mercado. En los sectores de energía, clima y salud, los pronósticos precisos de eventos poco frecuentes pero de alto impacto, como desastres naturales y pandemias, permiten una planificación y asignación de recursos efectivas. Descuidar el comportamiento de la cola puede provocar pérdidas, oportunidades perdidas y comprometer la seguridad. Dar prioridad a la precisión en las colas ayuda a generar pronósticos confiables y procesables. En esta publicación, entrenamos un modelo robusto de pronóstico de series de tiempo capaz de capturar eventos tan extremos utilizando Amazon SageMaker.

Para entrenar eficazmente este modelo, establecemos una infraestructura MLOps para agilizar el proceso de desarrollo del modelo mediante la automatización del preprocesamiento de datos, la ingeniería de características, el ajuste de hiperparámetros y la selección de modelos. Esta automatización reduce el error humano, mejora la reproducibilidad y acelera el ciclo de desarrollo del modelo. Con un canal de capacitación, las empresas pueden incorporar de manera eficiente nuevos datos y adaptar sus modelos a las condiciones cambiantes, lo que ayuda a garantizar que los pronósticos sigan siendo confiables y actualizados.

Una vez entrenado el modelo de pronóstico de series temporales, su implementación dentro de un punto final otorga capacidades de predicción en tiempo real. Esto le permite tomar decisiones bien informadas y receptivas basadas en los datos más recientes. Además, implementar el modelo en un punto final permite la escalabilidad, porque múltiples usuarios y aplicaciones pueden acceder y utilizar el modelo simultáneamente. Siguiendo estos pasos, las empresas pueden aprovechar el poder de una sólida previsión de series temporales para tomar decisiones informadas y mantenerse a la vanguardia en un entorno que cambia rápidamente.

Resumen de la solución

Esta solución muestra el entrenamiento de un modelo de pronóstico de series de tiempo, diseñado específicamente para manejar valores atípicos y variabilidad en los datos utilizando un Red convolucional temporal (TCN) con una distribución de Pareto binada y empalmada (SBP). Para obtener más información sobre una versión multimodal de esta solución, consulte La ciencia detrás de la nueva métrica de pases de NFL Next Gen Stats. Para ilustrar mejor la efectividad de la distribución SBP, la comparamos con el mismo modelo TCN pero usando una distribución gaussiana.

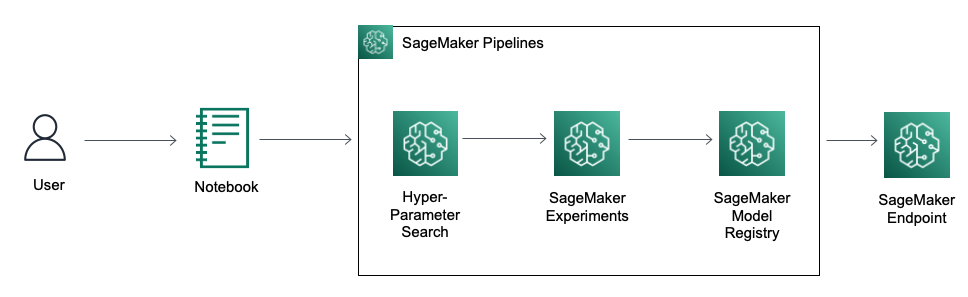

Este proceso se beneficia significativamente de la Funciones de MLOps de SageMaker, que agiliza el flujo de trabajo de ciencia de datos aprovechando la potente infraestructura de nube de AWS. En nuestra solución utilizamos Ajuste automático de modelos de Amazon SageMaker para búsqueda de hiperparámetros, Experimentos de Amazon SageMaker para gestionar experimentos, Registro de modelos de Amazon SageMaker para gestionar versiones de modelos, y Canalizaciones de Amazon SageMaker para orquestar el proceso. Luego implementamos nuestro modelo en un punto final de SageMaker para obtener predicciones en tiempo real.

El siguiente diagrama ilustra la arquitectura del proceso de capacitación.

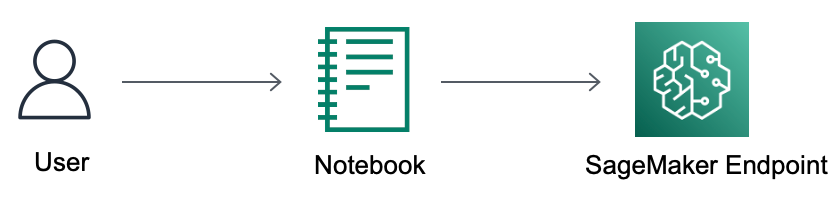

El siguiente diagrama ilustra el proceso de inferencia.

Puedes encontrar el código completo en el Repositorio GitHub. Para implementar la solución, ejecute las celdas en SBP_main.ipynb.

Haga clic aquí para abrir la consola de AWS y seguir adelante.

Canalización de SageMaker

SageMaker Pipelines ofrece una solución fácil de usar SDK de Python para crear flujos de trabajo integrados de aprendizaje automático (ML). Estos flujos de trabajo, representados como gráficos acíclicos dirigidos (DAG), constan de pasos con varios tipos y dependencias. Con SageMaker Pipelines, puede optimizar el proceso de extremo a extremo de entrenamiento y evaluación de modelos, mejorando la eficiencia y la reproducibilidad en sus flujos de trabajo de ML.

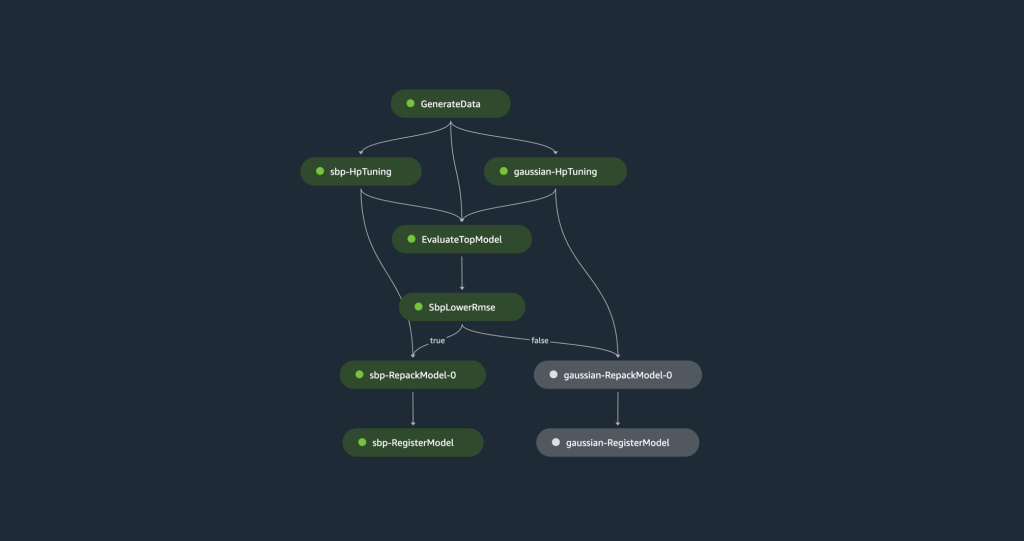

El proceso de capacitación comienza con la generación de un conjunto de datos sintéticos que se divide en conjuntos de capacitación, validación y prueba. El conjunto de entrenamiento se utiliza para entrenar dos modelos TCN, uno que utiliza Distribución Binned-Pareto empalmada y el otro emplea distribución gaussiana. Ambos modelos pasan por un ajuste de hiperparámetros utilizando el conjunto de validación para optimizar cada modelo. Luego, se realiza una evaluación contra el conjunto de prueba para determinar el modelo con el error cuadrático medio (RMSE) más bajo. El modelo con la mejor métrica de precisión se carga en el registro de modelos.

El siguiente diagrama ilustra los pasos del proceso.

Analicemos los pasos con más detalle.

Generación de datos

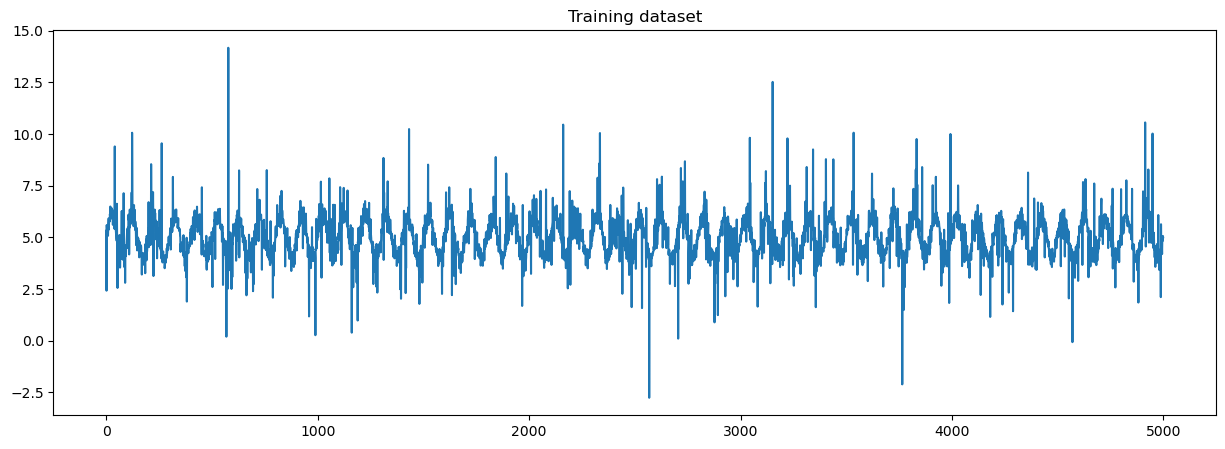

El primer paso de nuestro proceso genera un conjunto de datos sintéticos, que se caracteriza por una forma de onda sinusoidal y un ruido asimétrico de cola pesada. Los datos se crearon utilizando varios parámetros, como grados de libertad, un multiplicador de ruido y un parámetro de escala. Estos elementos influyen en la forma de la distribución de datos, modulan la variabilidad aleatoria de nuestros datos y ajustan la dispersión de nuestra distribución de datos, respectivamente.

Este trabajo de procesamiento de datos se logra utilizando un Procesador PyTorch, que ejecuta código PyTorch (generar_datos.py) dentro de un contenedor administrado por SageMaker. Los datos y otros artefactos relevantes para la depuración se encuentran en el archivo predeterminado. Servicio de almacenamiento simple de Amazon (Amazon S3) depósito asociado con la cuenta de SageMaker. Los registros de cada paso del proceso se pueden encontrar en Reloj en la nube de Amazon.

La siguiente figura es una muestra de los datos generados por la tubería.

Puede reemplazar la entrada con una amplia variedad de datos de series temporales, como distribución simétrica, asimétrica, de cola ligera, de cola pesada o multimodal. La robustez del modelo permite que sea aplicable a una amplia gama de problemas de series de tiempo, siempre que haya suficientes observaciones disponibles.

Entrenamiento modelo

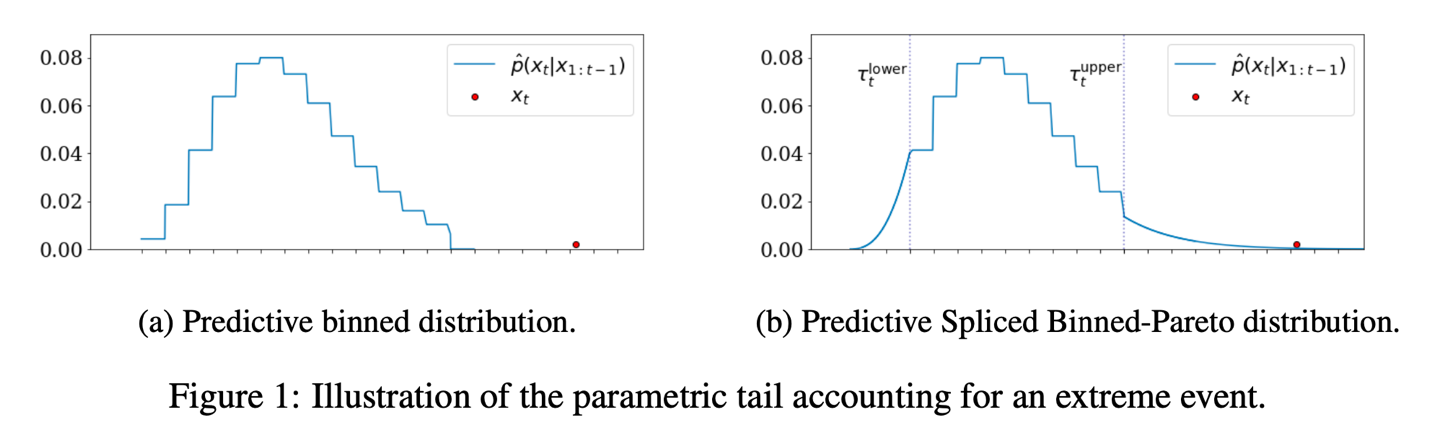

Después de la generación de datos, entrenamos dos TCN: uno usando la distribución SBP y otro usando la distribución Gaussiana. La distribución SBP emplea una distribución discreta en intervalos como base predictiva, donde el eje real se divide en intervalos discretos y el modelo predice la probabilidad de que una observación caiga dentro de cada intervalo. Esta metodología permite la captura de asimetrías y modos múltiples porque la probabilidad de cada contenedor es independiente. En la siguiente figura se muestra un ejemplo de distribución agrupada.

La distribución agrupada predictiva de la izquierda es robusta ante eventos extremos porque la probabilidad logarítmica no depende de la distancia entre la media predicha y el punto observado, a diferencia de las distribuciones paramétricas como la gaussiana o la t de Student. Por lo tanto, el evento extremo representado por el punto rojo no sesgará la media aprendida de la distribución. Sin embargo, el evento extremo tendrá probabilidad cero. Para capturar eventos extremos, formamos una distribución de SBP definiendo la cola inferior en el 5.° cuantil y la cola superior en el 95.° cuantil, reemplazando ambas colas con Distribuciones Generalizadas de Pareto (GPD) ponderadas, que pueden cuantificar la probabilidad del evento. El TCN generará los parámetros para la base de distribución agrupada y las colas del GPD.

Búsqueda de hiperparámetros

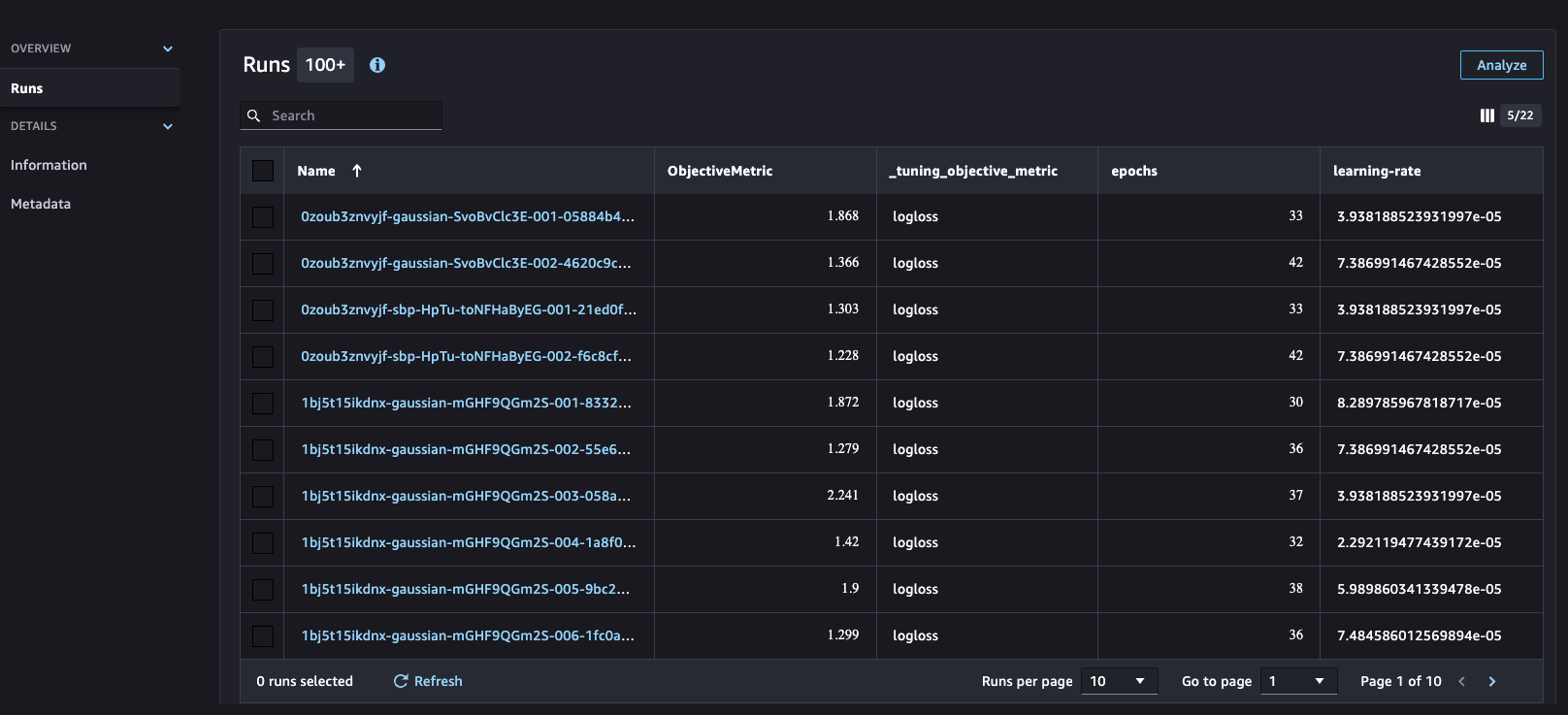

Para obtener un resultado óptimo, utilizamos ajuste automático del modelo para encontrar la mejor versión de un modelo a través de ajuste de hiperparámetros. Este paso está integrado en SageMaker Pipelines y permite la ejecución paralela de múltiples trabajos de capacitación, empleando varios métodos y rangos de hiperparámetros predefinidos. El resultado es la selección del mejor modelo en función de la métrica del modelo especificada, que es RMSE. En nuestro proceso, ajustamos específicamente la tasa de aprendizaje y la cantidad de épocas de entrenamiento para optimizar el rendimiento de nuestro modelo. Con la capacidad de ajuste de hiperparámetros en SageMaker, aumentamos la probabilidad de que nuestro modelo logre una precisión y generalización óptimas para la tarea determinada.

Debido a la naturaleza sintética de nuestros datos, mantenemos la duración del contexto y el tiempo de entrega como parámetros estáticos. La longitud del contexto se refiere a la cantidad de pasos de tiempo históricos ingresados en el modelo, y el tiempo de entrega representa la cantidad de pasos de tiempo en nuestro horizonte de pronóstico. Para el código de muestra, solo estamos ajustando la tasa de aprendizaje y la cantidad de épocas para ahorrar tiempo y costos.

Los parámetros específicos de la PAS se mantienen constantes según las pruebas exhaustivas realizadas por los autores en el artículo original en diferentes conjuntos de datos:

- Número de contenedores (100) – Este parámetro determina el número de contenedores utilizados para modelar la base de la distribución. Se mantiene en 100, lo que ha demostrado ser más eficaz en múltiples industrias.

- Cola percentil (0.05) – Esto denota el tamaño de las distribuciones de Pareto generalizadas en la cola. Al igual que el parámetro anterior, este ha sido probado exhaustivamente y se ha demostrado que es el más eficiente.

Experimentos

El proceso de hiperparámetros está integrado con Experimentos de SageMaker, que ayuda a organizar, analizar y comparar experimentos de aprendizaje automático iterativos, proporcionando información y facilitando el seguimiento de los modelos de mejor rendimiento. El aprendizaje automático es un proceso iterativo que implica numerosos experimentos que abarcan variaciones de datos, elecciones de algoritmos y ajuste de hiperparámetros. Estos experimentos sirven para perfeccionar gradualmente la precisión del modelo. Sin embargo, la gran cantidad de ejecuciones de entrenamiento e iteraciones de modelos puede dificultar la identificación de los modelos con mejor rendimiento y la realización de comparaciones significativas entre los experimentos actuales y pasados. SageMaker Experiments aborda esto rastreando automáticamente nuestros trabajos de ajuste de hiperparámetros y permitiéndonos obtener más detalles e información sobre el proceso de ajuste, como se muestra en la siguiente captura de pantalla.

Evaluación modelo

Los modelos se someten a entrenamiento y ajuste de hiperparámetros, y posteriormente se evalúan mediante el evaluar.py guion. Este paso utiliza el conjunto de prueba, distinto de la etapa de ajuste de hiperparámetros, para medir la precisión del modelo en el mundo real. RMSE se utiliza para evaluar la precisión de las predicciones.

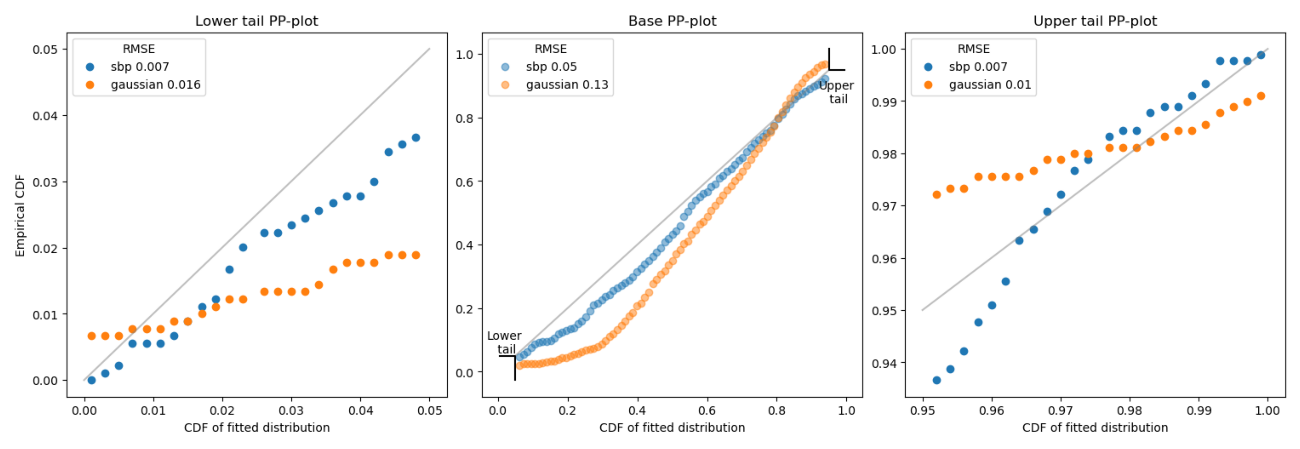

Para comparar la distribución, empleamos un gráfico de probabilidad-probabilidad (PP), que evalúa el ajuste entre las distribuciones reales y las predichas. La cercanía de los puntos a la diagonal indica un ajuste perfecto. Nuestras comparaciones entre las distribuciones predichas de SBP y Gaussiana con la distribución real muestran que las predicciones de SBP se alinean más estrechamente con los datos reales.

Como podemos observar, SBP tiene un RMSE más bajo en la base, la cola inferior y la cola superior. La distribución SBP mejoró la precisión de la distribución gaussiana en un 61% en la base, un 56% en la cola inferior y un 30% en la cola superior. En general, la distribución de la PAS tiene resultados significativamente mejores.

Selección de modelo

Usamos un paso de condición en SageMaker Pipelines para analizar los informes de evaluación del modelo, optando por el modelo con el RMSE más bajo para mejorar la precisión de la distribución. El modelo seleccionado se convierte en un objeto de modelo de SageMaker, preparándolo para su implementación. Esto implica crear un paquete modelo con parámetros cruciales y empaquetarlo en un ModeloPaso.

registro modelo

El modelo seleccionado luego se carga en Registro de modelos de SageMaker, que desempeña un papel fundamental en la gestión de modelos listos para la producción. Almacena modelos, organiza versiones de modelos, captura metadatos y artefactos esenciales, como imágenes de contenedores, y rige el estado de aprobación de cada modelo. Al utilizar el registro, podemos implementar modelos de manera eficiente en entornos accesibles de SageMaker y establecer una base para canalizaciones de integración continua e implementación continua (CI/CD).

Inferencia

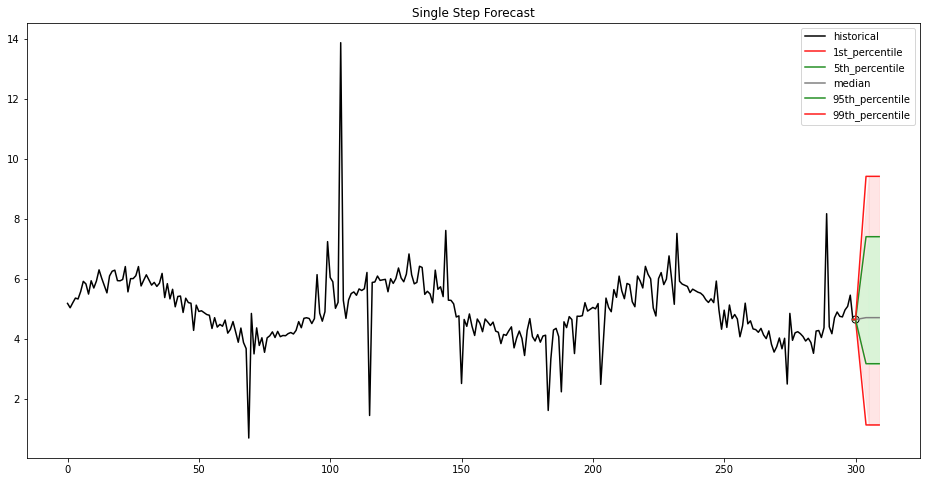

Una vez finalizado nuestro proceso de capacitación, nuestro modelo se implementa utilizando Servicios de alojamiento de SageMaker, que permite la creación de un punto final de inferencia para predicciones en tiempo real. Este punto final permite una integración perfecta con aplicaciones y sistemas, proporcionando acceso bajo demanda a las capacidades predictivas del modelo a través de una interfaz HTTPS segura. Las predicciones en tiempo real se pueden utilizar en escenarios como el precio de las acciones y el pronóstico de la demanda de energía. Nuestro criterio de valoración proporciona un pronóstico de un solo paso para los datos de series temporales proporcionados, presentados como percentiles y mediana, como se muestra en la siguiente figura y tabla.

| 1st percentil | 5th percentil | Mediana | 95th percentil | 99th percentil |

| 1.12 | 3.16 | 4.70 | 7.40 | 9.41 |

Limpiar

Después de ejecutar esta solución, asegúrese de limpiar todos los recursos de AWS innecesarios para evitar costos inesperados. Puede limpiar estos recursos utilizando el SDK de Python de SageMaker, que se encuentra al final del cuaderno. Al eliminar estos recursos, evita cargos adicionales por los recursos que ya no utiliza.

Conclusión

Tener un pronóstico preciso puede tener un gran impacto en la planificación futura de una empresa y también puede proporcionar soluciones a una variedad de problemas en diferentes industrias. Nuestra exploración de pronósticos sólidos de series de tiempo con MLOps en SageMaker ha demostrado un método para obtener un pronóstico preciso y la eficiencia de un proceso de capacitación optimizado.

Nuestro modelo, impulsado por una red convolucional temporal con distribución de Pareto binada y empalmada, ha demostrado precisión y adaptabilidad a valores atípicos al mejorar el RMSE en un 61 % en la base, un 56 % en la cola inferior y un 30 % en la cola superior con respecto al mismo TCN con distribución gaussiana. Estas cifras la convierten en una solución confiable para las necesidades de pronóstico del mundo real.

El proceso demuestra el valor de automatizar las funciones de MLOps. Esto puede reducir el esfuerzo humano manual, permitir la reproducibilidad y acelerar la implementación del modelo. Las funciones de SageMaker, como SageMaker Pipelines, el ajuste automático de modelos, los experimentos de SageMaker, el registro de modelos de SageMaker y los puntos finales, lo hacen posible.

Nuestra solución emplea un TCN en miniatura, optimizando solo unos pocos hiperparámetros con un número limitado de capas, que son suficientes para resaltar de manera efectiva el rendimiento del modelo. Para casos de uso más complejos, considere usar PyTorch u otras bibliotecas basadas en PyTorch para construir un TCN más personalizado que se alinee con sus necesidades específicas. Además, sería beneficioso explorar otros Funciones de SageMaker para mejorar aún más la funcionalidad de su canalización. Para automatizar completamente el proceso de implementación, puede utilizar el Kit de desarrollo en la nube de AWS (AWS CDK) o Formación en la nube de AWS.

Para obtener más información sobre la previsión de series temporales en AWS, consulte lo siguiente:

¡No dudes en dejar un comentario con cualquier idea o pregunta!

Acerca de los autores

Nick Biso es ingeniero de aprendizaje automático en AWS Professional Services. Resuelve complejos desafíos organizativos y técnicos utilizando la ciencia y la ingeniería de datos. Además, crea e implementa modelos de IA/ML en la nube de AWS. Su pasión se extiende a su propensión a viajar y diversas experiencias culturales.

Nick Biso es ingeniero de aprendizaje automático en AWS Professional Services. Resuelve complejos desafíos organizativos y técnicos utilizando la ciencia y la ingeniería de datos. Además, crea e implementa modelos de IA/ML en la nube de AWS. Su pasión se extiende a su propensión a viajar y diversas experiencias culturales.

Alston Chan es ingeniero de desarrollo de software en Amazon Ads. Crea canales de aprendizaje automático y sistemas de recomendación para recomendaciones de productos en la página de detalles. Fuera del trabajo, le gusta el desarrollo de juegos y la escalada en roca.

Alston Chan es ingeniero de desarrollo de software en Amazon Ads. Crea canales de aprendizaje automático y sistemas de recomendación para recomendaciones de productos en la página de detalles. Fuera del trabajo, le gusta el desarrollo de juegos y la escalada en roca.

María Masod se especializa en la creación de canalizaciones de datos y visualizaciones de datos en AWS Commerce Platform. Tiene experiencia en aprendizaje automático, que abarca el procesamiento del lenguaje natural, la visión por computadora y el análisis de series temporales. María, una entusiasta de la sostenibilidad de corazón, disfruta de la jardinería y jugar con su perro durante su tiempo libre.

María Masod se especializa en la creación de canalizaciones de datos y visualizaciones de datos en AWS Commerce Platform. Tiene experiencia en aprendizaje automático, que abarca el procesamiento del lenguaje natural, la visión por computadora y el análisis de series temporales. María, una entusiasta de la sostenibilidad de corazón, disfruta de la jardinería y jugar con su perro durante su tiempo libre.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/robust-time-series-forecasting-with-mlops-on-amazon-sagemaker/

- :posee

- :es

- :no

- :dónde

- $ UP

- 100

- 5

- 7

- a

- capacidad

- Nuestra Empresa

- acelerar

- acelera

- de la máquina

- accesible

- logrado

- Mi Cuenta

- la exactitud

- preciso

- precisamente

- Logra

- a través de

- real

- acíclico

- adaptar

- adición

- Adicionalmente

- direcciones

- Anuncios

- en contra

- adelante

- AI / ML

- alarma

- algoritmo

- alinear

- Alinea

- asignación

- Permitir

- permite

- a lo largo de

- también

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- análisis

- analizar

- y

- anticiparse a

- cualquier

- aplicable

- aplicaciones

- aprobación

- arquitectura

- somos

- AS

- evaluar

- evalúa

- activo

- asociado

- At

- Autorzy

- automatizado

- Automático

- automáticamente

- automatizar

- Automatización

- Hoy Disponibles

- evitar

- AWS

- Servicios profesionales de AWS

- Eje

- bases

- basado

- BE

- porque

- esto

- comportamiento

- detrás de

- beneficioso

- beneficios

- MEJOR

- mejores

- entre

- parcialidad

- BIN

- ambas

- general

- Construir la

- construye

- negocios

- pero

- .

- by

- PUEDEN

- capacidades

- capacidad

- capaz

- capturar

- capturas

- Capturando

- cases

- Células

- retos

- desafiante

- cambio

- caracterizada

- cargos

- opciones

- clic

- Alpinismo

- de cerca

- Soluciones

- infraestructura de nube

- código

- comentario

- Locales

- comparar

- comparación

- completar

- terminación

- integraciones

- Comprometida

- computadora

- Visión por computador

- condición

- condiciones

- llevado a cabo

- Considerar

- Consola

- constante

- construir

- Envase

- contexto

- continuo

- convertido

- Cost

- Precio

- cubierta

- Para crear

- creado

- Creamos

- creación

- crítico

- crucial

- cultural

- Current

- se adaptan

- Cycle

- datos

- proceso de datos

- Ciencia de los datos

- basada en datos

- conjuntos de datos

- Fecha

- Toma de Decisiones

- decisiones

- Predeterminado

- definir

- Demanda

- Previsión de la demanda

- demostrado

- demuestra

- denota

- dependencias

- dependiente

- desplegar

- desplegado

- Desplegando

- despliegue

- despliega

- diseñado

- detalle

- detalles

- Determinar

- determina

- determinar

- Desarrollo

- una experiencia diferente

- A diferencia

- que dirigieron

- desastres

- discutir

- distancia

- distinto

- distribuciones

- diverso

- dividido

- Perro

- DOT

- el tiempo de inactividad

- durante

- cada una

- Eficaz

- de manera eficaz

- eficacia

- eficiencia

- eficiente

- eficiente.

- esfuerzo

- elementos

- empleando

- emplea

- empodera

- habilitar

- permite

- permitiendo

- que abarca

- final

- de extremo a extremo

- Punto final

- energía

- ingeniero

- Ingeniería

- mejorar

- mejorar

- garantizar

- entusiasta

- Entorno

- ambientes

- épocas

- error

- esencial

- establecer

- evaluado

- evaluación

- evaluación

- Evento

- Eventos

- evolución

- ejemplo

- Experiencias

- experimentos

- Experiencia

- exploración

- explorar

- Se extiende

- en los detalles

- extremo

- facilitando

- Que cae

- Feature

- Caracteristicas

- pocos

- Figura

- Figuras

- financiero

- Instituciones financieras

- Encuentre

- Nombre

- cómodo

- seguir

- siguiendo

- Pronóstico

- previsiones

- formulario

- encontrado

- Fundación

- Gratis

- Freedom

- Desde

- completamente

- a la fatiga

- promover

- Además

- futuras

- Obtén

- juego

- desarrollo de juegos

- calibre

- Gen

- generado

- genera

- la generación de

- generación de AHSS

- dado

- Go

- gobierna

- GPD

- subvenciones

- gráficos

- encargarse de

- aprovechar

- Aprovechamiento

- Tienen

- he

- la salud

- Corazón

- ayuda

- aquí

- esta página

- destacando

- altamente

- su

- histórico

- horizonte

- hosting

- Cómo

- Sin embargo

- HTML

- HTTPS

- humana

- Ajuste de hiperparámetros

- Identifique

- ilustra

- imágenes

- Impacto

- implementar

- importante

- mejorado

- mejora

- la mejora de

- in

- incorporar

- aumente

- independientes

- Indica

- industrias

- influir

- información

- informó

- EN LA MINA

- Las opciones de entrada

- penetración

- Insights

- instituciones

- COMPLETAMENTE

- integración

- Interfaz

- dentro

- que implica

- IT

- iteraciones

- SUS

- Trabajos

- Empleo

- jpg

- solo

- acuerdo

- mantenido

- Clave

- idioma

- large

- ponedoras

- Lead

- aprendido

- aprendizaje

- Abandonar

- izquierda

- Longitud Mínima

- bibliotecas

- como

- probabilidad

- que otros

- Limitada

- situados

- por más tiempo

- pérdidas

- inferior

- más bajo

- máquina

- máquina de aprendizaje

- para lograr

- Realizar

- gestionan

- gestionado

- Management

- administrar

- manual

- maria

- Mercado

- caídas del mercado

- personalizado

- significativo

- metadatos

- Método

- Metodología

- métodos

- métrico

- perdida

- ML

- MLOps

- modelo

- modelos

- los modos

- monitoreo

- más,

- MEJOR DE TU

- múltiples

- Natural

- Procesamiento natural del lenguaje

- Naturaleza

- descuidar

- del sistema,

- Nuevo

- Next

- próxima generación

- NFL

- no

- ruido

- cuaderno

- número

- numeroso

- objeto

- observar

- obtener

- of

- Ofertas

- on

- On-Demand

- ONE

- , solamente

- habiertos

- Del Mañana

- óptimo

- Optimización

- optimizando

- or

- organizativo

- organiza

- reconocida por

- Otro

- "nuestr

- resultados

- salida

- afuera

- Más de

- total

- paquete

- embalaje

- página

- Pandemias

- Papel

- Paralelo

- parámetro

- parámetros

- Pareto

- Pasando (Paso)

- pasión

- pasado

- .

- (PDF)

- perfecto

- actuación

- industrial

- planificar

- plataforma

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- jugando

- juega

- punto

- puntos

- posible

- Publicación

- industria

- alimentado

- poderoso

- predecir

- previsto

- predicción

- Predicciones

- Predice

- presentó

- evitar

- anterior

- precio

- priorización

- problemas

- tratamiento

- Producto

- Producción

- Profesional

- probado

- proporcionar

- previsto

- proporciona un

- proporcionando

- Python

- piñón

- aumento

- azar

- distancia

- rápidamente

- Rate

- ready

- Preparando

- real

- mundo real

- en tiempo real

- reciente

- Recomendación

- recomendaciones

- Rojo

- reducir

- reduce

- remitir

- se refiere

- FILTRO

- regiones

- registro

- confianza

- confiar

- permanecer

- reemplazar

- Informes

- representar

- representado

- representa

- Recurso

- Recursos

- respectivamente

- sensible

- resultado

- Resultados

- Riesgo

- Gestión sistemática del riesgo,

- robusto

- robustez

- Rock

- Función

- raíz

- Ejecutar

- corre

- Safety

- sabio

- Tuberías de SageMaker

- mismo

- Guardar

- Escalabilidad

- Escala

- escenarios

- Ciencia:

- guión

- Sdk

- sin costura

- Buscar

- Sectores

- seguro

- seleccionado

- selección

- Serie

- ayudar

- Servicios

- set

- Sets

- Forma

- ella

- Mostrar

- mostrado

- firmar

- significativamente

- sencillos

- simultáneamente

- Tamaño

- Software

- Desarrollo de software ad-hoc

- a medida

- Soluciones

- Resuelve

- se especializa

- soluciones y

- específicamente

- especificado

- dividido

- propagación

- Squared

- Etapa

- Estado

- quedarse

- paso

- pasos

- en stock

- STORAGE

- tiendas

- aerodinamizar

- racionalizado

- Después

- comercial

- tal

- suficiente

- seguro

- Sostenibilidad

- sintético

- Todas las funciones a su disposición

- mesa

- Tarea

- Técnico

- test

- probado

- Pruebas

- esa

- La

- el mundo

- su

- luego

- por lo tanto

- Estas

- así

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- Series de tiempo

- a

- Seguimiento

- Plataforma de

- tráfico

- Entrenar

- entrenado

- Formación

- viajes

- dos

- tipos

- someterse

- Inesperado

- innecesario

- subido

- us

- utilizan el

- usado

- fácil de utilizar

- usuarios

- usando

- utilizar

- utiliza

- Utilizando

- validación

- propuesta de

- Valores

- variedad

- diversos

- versión

- versiones

- vía

- visión

- vital

- vs

- fue

- we

- Tiempo

- web

- servicios web

- sean

- que

- amplio

- seguirá

- dentro de

- Actividades:

- flujo de trabajo

- flujos de trabajo

- trabajando

- mundo

- se

- Usted

- tú

- zephyrnet

- cero