Amazon SageMaker proporciona una amplia selección de infraestructura de aprendizaje automático (ML) y opciones de implementación de modelos para ayudar a satisfacer sus necesidades de inferencia de ML. Es un servicio completamente administrado y se integra con las herramientas de MLOps para que pueda trabajar para escalar la implementación de su modelo, reducir los costos de inferencia, administrar modelos de manera más efectiva en producción y reducir la carga operativa. SageMaker proporciona múltiples opciones de inferencia para que pueda elegir la opción que mejor se adapte a su carga de trabajo.

Las nuevas generaciones de CPU ofrecen una mejora significativa del rendimiento en la inferencia de ML debido a las instrucciones integradas especializadas. En esta publicación, nos enfocamos en cómo puede aprovechar el Gravitón3 de AWSbasado en Amazon Elastic Compute Cloud (EC2) Instancias C7g para ayudar a reducir los costos de inferencia hasta en un 50 % en relación con las instancias EC2 comparables para inferencia en tiempo real en Amazon SageMaker. Le mostramos cómo puede evaluar el rendimiento de la inferencia y cambiar sus cargas de trabajo de ML a instancias de AWS Graviton en solo unos pocos pasos.

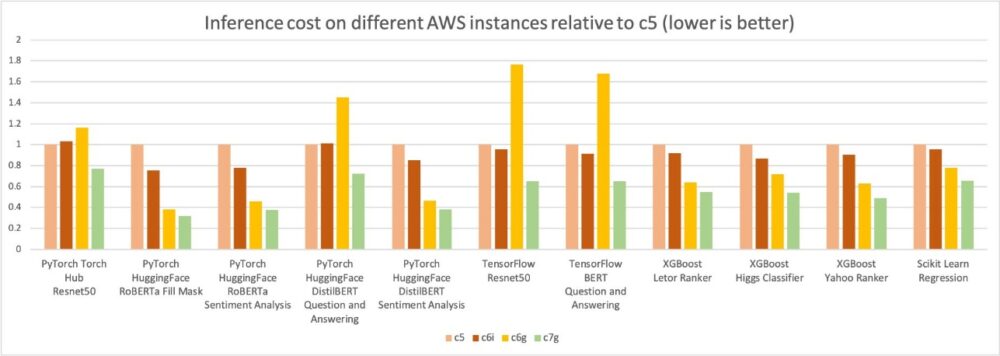

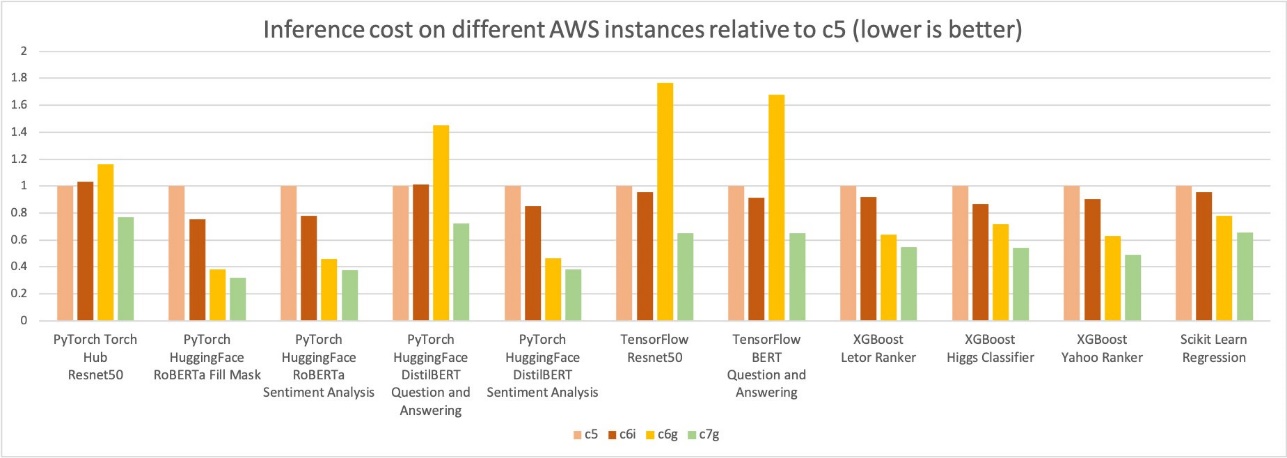

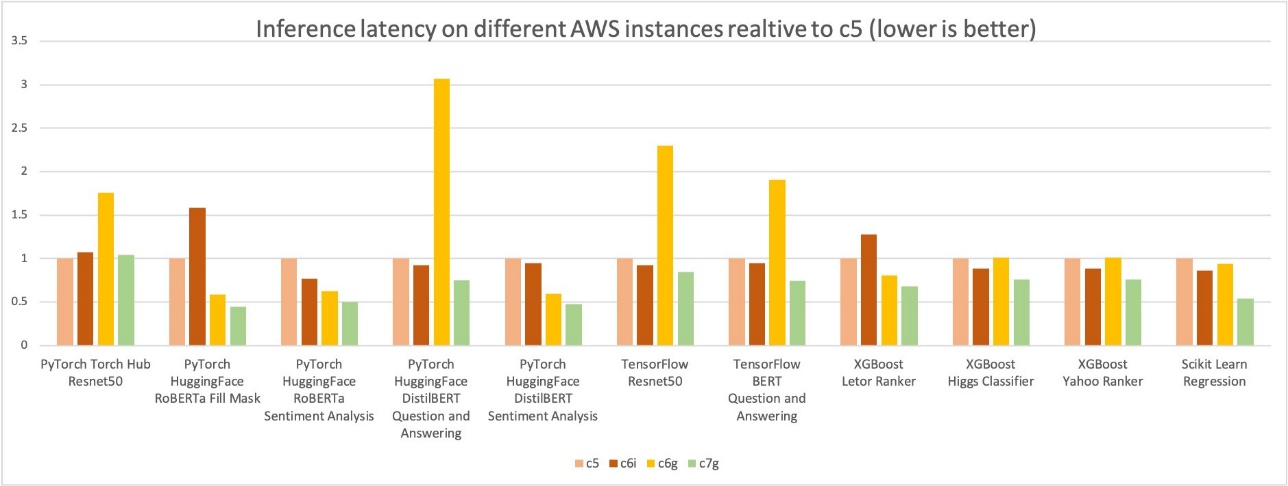

Para cubrir la amplia y popular gama de aplicaciones de los clientes, en esta publicación analizamos el rendimiento de inferencia de los marcos PyTorch, TensorFlow, XGBoost y scikit-learn. Cubrimos visión por computadora (CV), procesamiento de lenguaje natural (NLP), clasificación y escenarios de clasificación para modelos e instancias de SageMaker ml.c6g, ml.c7g, ml.c5 y ml.c6i para evaluación comparativa.

Resultados de la evaluación comparativa

AWS midió hasta un 50 % de ahorro de costos para la inferencia de modelos PyTorch, TensorFlow, XGBoost y scikit-learn con instancias EC3 C2g basadas en Graviton7 de AWS en relación con instancias EC2 comparables en Amazon SageMaker. Al mismo tiempo, también se reduce la latencia de la inferencia.

A modo de comparación, utilizamos cuatro tipos de instancias diferentes:

Las cuatro instancias tienen 16 vCPU y 32 GiB de memoria.

En el siguiente gráfico, medimos el costo por millón de inferencias para los cuatro tipos de instancias. Además, normalizamos el costo por millón de resultados de inferencia a una instancia c5.4xlarge, que se mide como 1 en el eje Y del gráfico. Puede ver que para los modelos XGBoost, el costo por millón de inferencia para c7g.4xlarge (AWS Graviton3) es aproximadamente el 50 % del c5.4xlarge y el 40 % de c6i.4xlarge; para los modelos PyTorch NLP, el ahorro de costos es de aproximadamente un 30-50 % en comparación con las instancias c5 y c6i.4xlarge. Para otros modelos y marcos, medimos al menos un 30 % de ahorro de costos en comparación con las instancias c5 y c6i.4xlarge.

Similar al gráfico de comparación de costos de inferencia anterior, el siguiente gráfico muestra la latencia p90 del modelo para los mismos cuatro tipos de instancias. Normalizamos aún más los resultados de latencia a la instancia c5.4xlarge, que se mide como 1 en el eje Y del gráfico. La latencia de inferencia del modelo c7g.4xlarge (AWS Graviton3) es hasta un 50 % mejor que las latencias medidas en c5.4xlarge y c6i.4xlarge.

Migrar a instancias de AWS Graviton

Para implementar sus modelos en instancias de AWS Graviton, puede usar Contenedores de aprendizaje profundo de AWS (DLC) o trae tus propios contenedores que son compatibles con la arquitectura ARMv8.2.

La migración (o nueva implementación) de sus modelos a instancias de AWS Graviton es sencilla porque AWS no solo proporciona contenedores para alojar modelos con PyTorch, TensorFlow, scikit-learn y XGBoost, sino que los modelos también son arquitectónicamente independientes. También puede traer sus propias bibliotecas, pero asegúrese de que su contenedor esté construido con un entorno compatible con la arquitectura ARMv8.2. Para más información, ver Construyendo su propio contenedor de algoritmos.

Deberá completar tres pasos para implementar su modelo:

- Cree un modelo de SageMaker. Este contendrá, entre otros parámetros, la información sobre la ubicación del archivo del modelo, el contenedor que se usará para la implementación y la ubicación del script de inferencia. (Si ya tiene un modelo existente implementado en una instancia de inferencia optimizada para computación, puede omitir este paso).

- Cree una configuración de punto final. Este contendrá información sobre el tipo de instancia que desea para el punto de enlace (por ejemplo, ml.c7g.xlarge para AWS Graviton3), el nombre del modelo que creó en el paso anterior y la cantidad de instancias por punto de enlace.

- Inicie el punto final con la configuración del punto final creada en el paso anterior.

Para obtener instrucciones detalladas, consulte Ejecute cargas de trabajo de inferencia de aprendizaje automático en instancias basadas en Graviton de AWS con Amazon SageMaker

Metodología de evaluación comparativa

Se utilizó Recomendador de inferencia de Amazon SageMaker para automatizar la evaluación comparativa del rendimiento en diferentes instancias. Este servicio compara el rendimiento de su modelo ML en términos de latencia y costo en diferentes instancias y recomienda la instancia y la configuración que brinda el mejor rendimiento al menor costo. Hemos recopilado los datos de rendimiento antes mencionados utilizando el Recomendador de inferencia. Para obtener más detalles, consulte el Repositorio GitHub.

Puede utilizar el cuaderno de muestra para ejecutar los puntos de referencia y reproducir los resultados. Utilizamos los siguientes modelos para la evaluación comparativa:

Conclusión

AWS midió hasta un 50 % de ahorro de costos para la inferencia de modelos PyTorch, TensorFlow, XGBoost y scikit-learn con instancias EC3 C2g basadas en Graviton7 de AWS en relación con instancias EC2 comparables en Amazon SageMaker. Puede migrar sus casos de uso de inferencia existentes o implementar nuevos modelos de ML en AWS Graviton siguiendo los pasos proporcionados en esta publicación. También puede consultar la Guía técnica de AWS Graviton, que proporciona la lista de bibliotecas optimizadas y mejores prácticas que lo ayudarán a lograr beneficios de costos con instancias de AWS Graviton en diferentes cargas de trabajo.

Si encuentra casos de uso en los que no se observan ganancias de rendimiento similares en AWS Graviton, comuníquese con nosotros. Continuaremos agregando más mejoras de rendimiento para hacer de AWS Graviton el procesador de propósito general más rentable y eficiente para la inferencia de ML.

Sobre los autores

Sunita Nadampalli es gerente de desarrollo de software en AWS. Dirige las optimizaciones de rendimiento del software Graviton para cargas de trabajo de aprendizaje automático, HPC y multimedia. Le apasiona el desarrollo de código abierto y la entrega de soluciones de software rentables con Arm SoC.

Sunita Nadampalli es gerente de desarrollo de software en AWS. Dirige las optimizaciones de rendimiento del software Graviton para cargas de trabajo de aprendizaje automático, HPC y multimedia. Le apasiona el desarrollo de código abierto y la entrega de soluciones de software rentables con Arm SoC.

jaymin desai es ingeniero de desarrollo de software en el equipo de inferencia de Amazon SageMaker. Le apasiona llevar la IA a las masas y mejorar la usabilidad de los activos de IA de última generación transformándolos en funciones y servicios. En su tiempo libre, le gusta explorar la música y viajar.

jaymin desai es ingeniero de desarrollo de software en el equipo de inferencia de Amazon SageMaker. Le apasiona llevar la IA a las masas y mejorar la usabilidad de los activos de IA de última generación transformándolos en funciones y servicios. En su tiempo libre, le gusta explorar la música y viajar.

mike schneider es un desarrollador de sistemas, con sede en Phoenix AZ. Es miembro de los contenedores de aprendizaje profundo y admite varias imágenes de contenedores de Framework, para incluir Graviton Inference. Se dedica a la eficiencia y estabilidad de la infraestructura.

mike schneider es un desarrollador de sistemas, con sede en Phoenix AZ. Es miembro de los contenedores de aprendizaje profundo y admite varias imágenes de contenedores de Framework, para incluir Graviton Inference. Se dedica a la eficiencia y estabilidad de la infraestructura.

Mohán Gandhi es ingeniero de software sénior en AWS. Ha estado en AWS durante los últimos 10 años y ha trabajado en varios servicios de AWS como EMR, EFA y RDS. Actualmente, se centra en mejorar la experiencia de inferencia de SageMaker. En su tiempo libre, disfruta de caminatas y maratones.

Mohán Gandhi es ingeniero de software sénior en AWS. Ha estado en AWS durante los últimos 10 años y ha trabajado en varios servicios de AWS como EMR, EFA y RDS. Actualmente, se centra en mejorar la experiencia de inferencia de SageMaker. En su tiempo libre, disfruta de caminatas y maratones.

qingweili es un especialista en aprendizaje automático en Amazon Web Services. Recibió su Ph.D. en Investigación de Operaciones después de que rompió la cuenta de subvenciones de investigación de su asesor y no pudo entregar el Premio Nobel que prometió. Actualmente, ayuda a los clientes de la industria de seguros y servicios financieros a crear soluciones de aprendizaje automático en AWS. En su tiempo libre le gusta leer y enseñar.

qingweili es un especialista en aprendizaje automático en Amazon Web Services. Recibió su Ph.D. en Investigación de Operaciones después de que rompió la cuenta de subvenciones de investigación de su asesor y no pudo entregar el Premio Nobel que prometió. Actualmente, ayuda a los clientes de la industria de seguros y servicios financieros a crear soluciones de aprendizaje automático en AWS. En su tiempo libre le gusta leer y enseñar.

Wayne Toh es Arquitecto de Soluciones Especializado para Graviton en AWS. Se enfoca en ayudar a los clientes a adoptar la arquitectura ARM para cargas de trabajo de contenedores a gran escala. Antes de unirse a AWS, Wayne trabajó para varios proveedores de software importantes, incluidos IBM y Red Hat.

Wayne Toh es Arquitecto de Soluciones Especializado para Graviton en AWS. Se enfoca en ayudar a los clientes a adoptar la arquitectura ARM para cargas de trabajo de contenedores a gran escala. Antes de unirse a AWS, Wayne trabajó para varios proveedores de software importantes, incluidos IBM y Red Hat.

lauren mullennex es arquitecta de soluciones con sede en Denver, CO. Trabaja con los clientes para ayudarlos a diseñar soluciones en AWS. En su tiempo libre, le gusta hacer caminatas y cocinar comida hawaiana.

lauren mullennex es arquitecta de soluciones con sede en Denver, CO. Trabaja con los clientes para ayudarlos a diseñar soluciones en AWS. En su tiempo libre, le gusta hacer caminatas y cocinar comida hawaiana.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoAiStream. Inteligencia de datos Web3. Conocimiento amplificado. Accede Aquí.

- Acuñando el futuro con Adryenn Ashley. Accede Aquí.

- Compra y Vende Acciones en Empresas PRE-IPO con PREIPO®. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :posee

- :es

- :no

- :dónde

- $ UP

- 1

- 10

- 100

- 7

- 98

- a

- Nuestra Empresa

- Mi Cuenta

- Lograr

- a través de

- add

- adoptar

- Ventaja

- Después

- AI

- algoritmo

- ya haya utilizado

- también

- Amazon

- Amazon SageMaker

- Amazon Web Services

- entre

- an

- y

- aplicaciones

- arquitectura

- somos

- ARM

- AS

- Activos

- At

- automatizado

- AWS

- basado

- BE

- porque

- esto

- evaluación comparativa

- los puntos de referencia

- beneficios

- MEJOR

- y las mejores prácticas

- mejores

- llevar

- general

- Rompió

- build

- construido

- incorporado

- carga

- pero

- by

- PUEDEN

- cases

- Tabla

- clasificación

- Soluciones

- CO

- comparable

- en comparación con

- comparación

- compatible

- completar

- Calcular

- computadora

- Visión por computador

- Configuración

- que no contengo

- Envase

- Contenedores

- continue

- Cost

- ahorro de costes

- rentable

- Precio

- Protectora

- creado

- En la actualidad

- cliente

- Clientes

- datos

- a dedicados

- profundo

- deep learning

- entregamos

- entregar

- Denver

- desplegar

- desplegado

- despliegue

- detallado

- detalles

- Developer

- Desarrollo

- una experiencia diferente

- discutir

- sí

- dos

- de manera eficaz

- eficiencia

- eficiente

- ya sea

- Punto final

- ingeniero

- Entorno

- evaluar

- ejemplo

- existente

- experience

- Explorar

- Fallidos

- Caracteristicas

- pocos

- Archive

- financiero

- servicios financieros

- Encuentre

- Focus

- centrado

- se centra

- siguiendo

- Digital XNUMXk

- Marco conceptual

- marcos

- Gratuito

- promover

- Ganancias

- propósito general

- generaciones

- da

- conceder

- gráfica

- ¿Qué

- Tienen

- he

- ayuda

- ayudando

- ayuda

- aquí

- su

- fortaleza

- Cómo

- HPC

- HTML

- HTTPS

- IBM

- if

- imágenes

- es la mejora continua

- mejoras

- la mejora de

- in

- incluir

- Incluye

- energético

- información

- EN LA MINA

- ejemplo

- Instrucciones

- aseguradora

- Integra

- dentro

- unión

- jpg

- solo

- idioma

- large

- Apellido

- Estado latente

- Prospectos

- aprendizaje

- menos

- bibliotecas

- como

- Me gusta

- Lista

- Ubicación

- más bajo

- máquina

- máquina de aprendizaje

- para lograr

- gestionan

- gerente

- masas

- Conoce a

- miembro

- Salud Cerebral

- migrado

- migración

- millones

- ML

- MLOps

- modelo

- modelos

- más,

- MEJOR DE TU

- Multimedia

- múltiples

- Música

- nombre

- Natural

- Procesamiento natural del lenguaje

- ¿ Necesita ayuda

- Nuevo

- nlp

- premio Nobel

- número

- of

- LANZAMIENTO

- on

- , solamente

- de código abierto

- operativos.

- Operaciones

- optimizado

- Optión

- Opciones

- or

- solicite

- Otro

- salir

- EL DESARROLLADOR

- parámetros

- apasionado

- actuación

- fénix

- recoger

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Por favor

- Popular

- Publicación

- prácticas

- anterior

- Anterior

- premio

- tratamiento

- Procesador

- Producción

- prometido

- proporcionar

- previsto

- proporciona un

- piñón

- distancia

- Clasificación

- en comunicarse

- Reading

- recibido

- de CFP.

- Rojo

- Red Hat

- reducir

- Reducción

- la investigación

- Resultados

- Ejecutar

- sabio

- Inferencia de SageMaker

- mismo

- Ahorros

- Escala

- escenarios

- scikit-aprender

- ver

- selección

- mayor

- de coches

- Servicios

- Varios

- ella

- Mostrar

- Shows

- importante

- similares

- So

- Software

- Desarrollo de software ad-hoc

- Ingeniero de Software

- Soluciones

- especialista

- especializado

- Estabilidad

- el estado de la técnica

- paso

- pasos

- sencillo

- Apoyar

- soportes

- Switch

- Todas las funciones a su disposición

- ¡Prepárate!

- toma

- Educación

- equipo

- Técnico

- tensorflow

- términos

- que

- esa

- La

- la información

- Les

- así

- Tres

- equipo

- a

- Viajar

- tipo

- tipos

- us

- usabilidad

- utilizan el

- usado

- usando

- diversos

- vendedores

- visión

- quieres

- we

- web

- servicios web

- WELL

- que

- seguirá

- Actividades:

- trabajado

- funciona

- XGBoost

- años

- Usted

- tú

- zephyrnet