La implementación de una arquitectura de datos moderna proporciona un método escalable para integrar datos de fuentes dispares. Al organizar los datos por dominios comerciales en lugar de infraestructura, cada dominio puede elegir herramientas que se adapten a sus necesidades. Las organizaciones pueden maximizar el valor de su arquitectura de datos moderna con soluciones de IA generativa mientras innovan continuamente.

Las capacidades de lenguaje natural permiten a los usuarios no técnicos consultar datos a través de un inglés conversacional en lugar de SQL complejo. Sin embargo, obtener todos los beneficios requiere superar algunos desafíos. Los modelos de lenguaje e inteligencia artificial deben identificar las fuentes de datos adecuadas, generar consultas SQL efectivas y producir respuestas coherentes con resultados integrados a escala. También necesitan una interfaz de usuario para preguntas en lenguaje natural.

En general, implementar una arquitectura de datos moderna y técnicas de IA generativa con AWS es un enfoque prometedor para recopilar y difundir información clave de datos diversos y expansivos a escala empresarial. La última oferta de IA generativa de AWS es lecho rocoso del amazonas, que es un servicio totalmente administrado y la forma más fácil de crear y escalar aplicaciones de IA generativa con modelos básicos. AWS también ofrece modelos básicos a través de JumpStart de Amazon SageMaker as Amazon SageMaker puntos finales La combinación de modelos de lenguaje extenso (LLM), incluida la facilidad de integración que ofrece Amazon Bedrock, y una infraestructura de datos escalable y orientada al dominio lo posiciona como un método inteligente para aprovechar la abundante información contenida en varias bases de datos de análisis y lagos de datos.

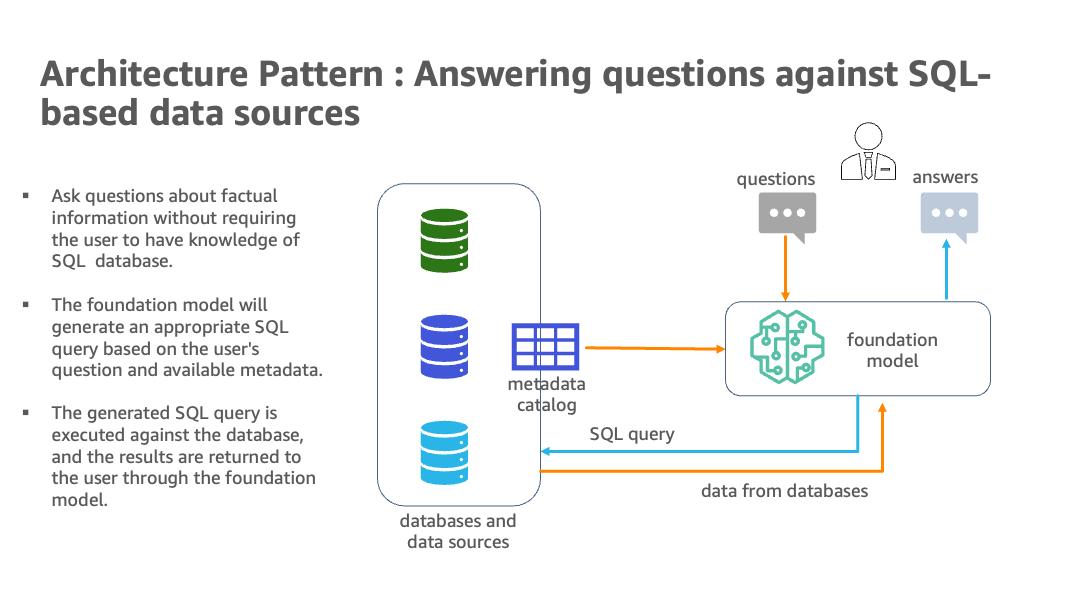

En la publicación, mostramos un escenario en el que una empresa implementó una arquitectura de datos moderna con datos que residen en múltiples bases de datos y API, como datos legales en Servicio de almacenamiento simple de Amazon (Amazon S3), recursos humanos en Servicio de base de datos relacional de Amazon (Amazon RDS), ventas y marketing en Desplazamiento al rojo de Amazon, datos del mercado financiero en una solución de almacén de datos de terceros en Copo de nievey datos de productos como una API. Esta implementación tiene como objetivo mejorar la productividad de los análisis de negocios, los propietarios de productos y los expertos en dominios de negocios de la empresa. Todo esto logrado mediante el uso de IA generativa en esta arquitectura de malla de dominio, que permite a la empresa alcanzar sus objetivos comerciales de manera más eficiente. Esta solución tiene la opción de incluir LLM de JumpStart como punto final de SageMaker, así como modelos de terceros. Brindamos a los usuarios empresariales un medio para hacer preguntas basadas en hechos sin tener un conocimiento subyacente de los canales de datos, abstrayendo así las complejidades de escribir consultas SQL simples a complejas.

Resumen de la solución

Una arquitectura de datos moderna en AWS aplica inteligencia artificial y procesamiento de lenguaje natural para consultar múltiples bases de datos de análisis. Mediante el uso de servicios como Amazon Redshift, Amazon RDS, Snowflake, Atenea amazónicay Pegamento AWS, crea una solución escalable para integrar datos de varias fuentes. Usando LangChain, una poderosa biblioteca para trabajar con LLM, que incluye modelos básicos de Amazon Bedrock y JumpStart en Estudio Amazon SageMaker cuadernos, se construye un sistema donde los usuarios pueden hacer preguntas comerciales en inglés natural y recibir respuestas con datos extraídos de las bases de datos relevantes.

El siguiente diagrama ilustra la arquitectura.

La arquitectura híbrida utiliza varias bases de datos y LLM, con modelos básicos de Amazon Bedrock y JumpStart para la identificación de fuentes de datos, la generación de SQL y la generación de texto con resultados.

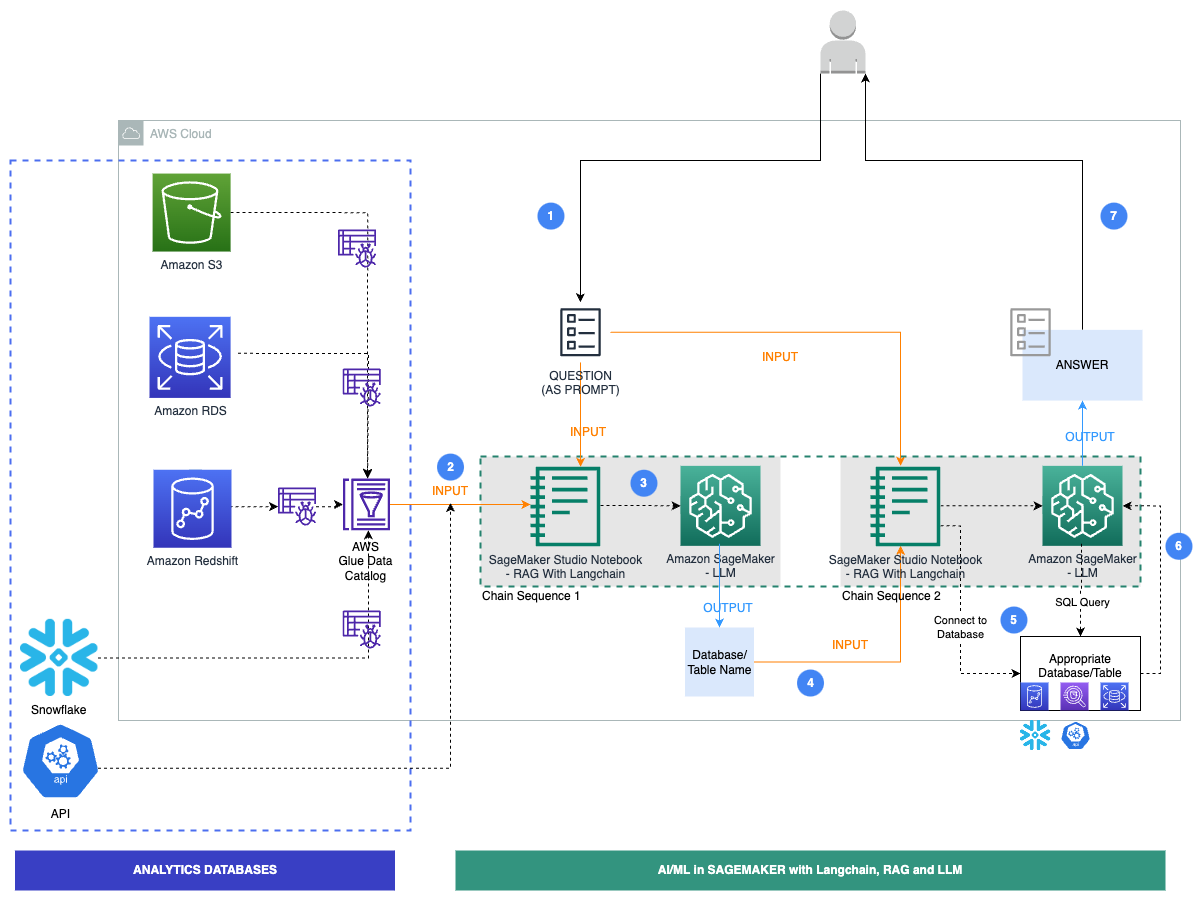

El siguiente diagrama ilustra los pasos específicos del flujo de trabajo para nuestra solución.

Los pasos son los siguientes:

- Un usuario comercial proporciona un mensaje de pregunta en inglés.

- Un rastreador de AWS Glue está programado para ejecutarse a intervalos frecuentes para extraer metadatos de las bases de datos y crear definiciones de tablas en el Catálogo de datos de AWS Glue. El catálogo de datos se ingresa en la secuencia de cadena 1 (consulte el diagrama anterior).

- LangChain, una herramienta para trabajar con LLM y avisos, se usa en los cuadernos de Studio. LangChain requiere que se defina un LLM. Como parte de la Secuencia en cadena 1, los metadatos del catálogo de datos y la solicitud se pasan a un LLM, alojado en un extremo de SageMaker, para identificar la base de datos y la tabla relevantes mediante LangChain.

- La base de datos y la tabla solicitadas e identificadas se pasan a la Secuencia en cadena 2.

- LangChain establece una conexión con la base de datos y ejecuta la consulta SQL para obtener los resultados.

- Los resultados se pasan al LLM para generar una respuesta en inglés con los datos.

- El usuario recibe una respuesta en inglés a su aviso, consultando datos de diferentes bases de datos.

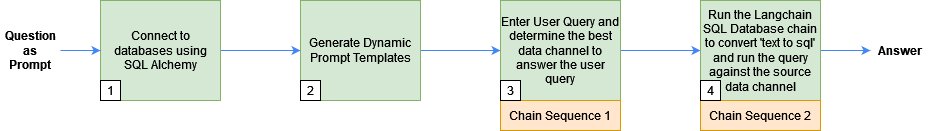

Las siguientes secciones explican algunos de los pasos clave con el código asociado. Para profundizar en la solución y el código de todos los pasos que se muestran aquí, consulte el Repositorio GitHub. El siguiente diagrama muestra la secuencia de pasos seguidos:

Requisitos previos

Puede utilizar cualquier base de datos que sea compatible con SQLAlchemy para generar respuestas de LLM y LangChain. Sin embargo, estas bases de datos deben tener sus metadatos registrados en AWS Glue Data Catalog. Además, deberá tener acceso a los LLM a través de claves JumpStart o API.

Conéctese a bases de datos usando SQLAlchemy

LangChain usa SQLAlchemy para conectarse a bases de datos SQL. Inicializamos la función SQLDatabase de LangChain creando un motor y estableciendo una conexión para cada fuente de datos. El siguiente es un ejemplo de cómo conectarse a un Edición compatible con MySQL de Amazon Aurora base de datos sin servidor e incluir solo la tabla de empleados:

A continuación, creamos indicaciones utilizadas por Chain Sequence 1 para identificar la base de datos y el nombre de la tabla en función de la pregunta del usuario.

Generar plantillas de mensajes dinámicos

Usamos el catálogo de datos de AWS Glue, que está diseñado para almacenar y administrar información de metadatos, para identificar el origen de los datos para una consulta de usuario y generar solicitudes para la secuencia de cadena 1, como se detalla en los siguientes pasos:

- Creamos un catálogo de datos rastreando los metadatos de múltiples fuentes de datos usando el Conexión Jdbc utilizado en la demostración.

- Con la biblioteca Boto3, creamos una vista consolidada del catálogo de datos a partir de múltiples fuentes de datos. El siguiente es un ejemplo de cómo obtener los metadatos de la tabla de empleados del Catálogo de datos para la base de datos Aurora MySQL:

Un catálogo de datos consolidado tiene detalles sobre la fuente de datos, como el esquema, los nombres de las tablas y los nombres de las columnas. La siguiente es una muestra de la salida del catálogo de datos consolidado:

- Pasamos el catálogo de datos consolidado a la plantilla de solicitud y definimos las solicitudes utilizadas por LangChain:

Secuencia de cadena 1: Detectar metadatos de origen para la consulta del usuario mediante LangChain y un LLM

Pasamos la plantilla de solicitud generada en el paso anterior a la solicitud, junto con la consulta del usuario al modelo LangChain, para encontrar la mejor fuente de datos para responder la pregunta. LangChain utiliza el modelo LLM de nuestra elección para detectar metadatos de origen.

Use el siguiente código para usar un LLM de JumpStart o modelos de terceros:

El texto generado contiene información como la base de datos y los nombres de las tablas en los que se ejecuta la consulta del usuario. Por ejemplo, para la consulta del usuario "Nombre de todos los empleados con fecha de nacimiento este mes", generated_text tiene la información database == rdsmysql y database.table == rdsmysql.employees.

A continuación, pasamos los detalles del dominio de recursos humanos, la base de datos Aurora MySQL y la tabla de empleados a Chain Sequence 2.

Secuencia en cadena 2: recuperar respuestas de las fuentes de datos para responder a la consulta del usuario

A continuación, ejecutamos la cadena de base de datos SQL de LangChain para convertir texto a SQL e implícitamente ejecutamos el SQL generado contra la base de datos para recuperar los resultados de la base de datos en un lenguaje legible simple.

Comenzamos con la definición de una plantilla de solicitud que instruye al LLM para generar SQL en un dialecto sintácticamente correcto y luego ejecutarlo en la base de datos:

Finalmente, pasamos el LLM, la conexión de la base de datos y el aviso a la cadena de la base de datos SQL y ejecutamos la consulta SQL:

Por ejemplo, para la consulta del usuario "Nombre de todos los empleados con fecha de nacimiento este mes", la respuesta es la siguiente:

Limpiar

Después de ejecutar la arquitectura de datos moderna con IA generativa, asegúrese de limpiar los recursos que no se utilizarán. Cierre y elimine las bases de datos utilizadas (Amazon Redshift, Amazon RDS, Snowflake). Además, elimine los datos en Amazon S3 y detenga cualquier instancia de notebook de Studio para no incurrir en cargos adicionales. Si usó JumpStart para implementar un LLM como punto final en tiempo real de SageMaker, elimine el punto final a través de la consola de SageMaker o Studio.

Conclusión

En esta publicación, integramos una arquitectura de datos moderna con IA generativa y LLM dentro de SageMaker. Esta solución utiliza varios modelos básicos de texto a texto de JumpStart, así como modelos de terceros. Este enfoque híbrido identifica las fuentes de datos, escribe consultas SQL y genera respuestas con los resultados de las consultas. Utiliza Amazon Redshift, Amazon RDS, Snowflake y LLM. Para mejorar la solución, puede agregar más bases de datos, una interfaz de usuario para consultas en inglés, ingeniería rápida y herramientas de datos. Esto podría convertirse en una forma inteligente y unificada de obtener información de múltiples almacenes de datos. Para profundizar en la solución y el código que se muestra en esta publicación, consulte el Repositorio GitHub . También, refiérase a lecho rocoso del amazonas para casos de uso en IA generativa, modelos básicos y modelos de lenguaje extenso.

Apéndice

Indicaciones de ejemplo

| Dominio | Base de datos/API | Rápido | SQL (Generado por LLM) | Salida |

| Ventas y Marketing | Desplazamiento al rojo de Amazon | ¿Cuántas ventas de boletos hay? | SELECT COUNT(*) AS total_salesFROM tickit.sales; |

There are 172,456 ticket sales. |

| Ventas y Marketing | Desplazamiento al rojo de Amazon | ¿Cuál fue la comisión total por la venta de boletos en el año 2008? | SELECT SUM(commission) AS total_commissionFROM tickit.salesWHERE EXTRACT(YEAR FROM saletime) = 2008 |

The total commission for ticket sales in the year 2008 was $16,614,814.65. |

| Legal | S3 | ¿Cuántos fraudes ocurrieron en el año 2023? | SELECT count(*)FROM claimsWHERE extract(year from write_time) = 2023 AND fraud = 1; |

There were 164 fraud claims in 2023. |

| Legal | S3 | ¿Cuántas pólizas se reclamaron este año? | SELECT count(*)FROM claims; |

There were 5000 claims made this year. |

| Recursos Humanos | Amazon Aurora MySQL | Nombre de todos los empleados con fecha de nacimiento este mes | SELECT * FROM employeesWHERE MONTH(birth_date) = MONTH(CURRENT_DATE()); |

The employees with birthdays this month are:Christian KoblickTzvetan ZielinskiKazuhito CappellettiYinghua Dredge |

| Recursos Humanos | Amazon Aurora MySQL | ¿Cuántos empleados se contrataron antes de 1990? | SELECT COUNT(*) AS 'Number of employees hired before 1990'FROM employeesWHERE hire_date < '1990-01-01' |

29 employees were hired before 1990. |

| Finanzas e inversiones | Copo de nieve | ¿Qué acción se desempeñó mejor y peor en mayo de 2013? | SELECT name, MAX(close) AS max_close, MIN(close) AS min_closeFROM all_stocks_5yrWHERE date BETWEEN '2013-05-01' AND '2013-05-31'GROUP BY nameORDER BY max_close DESC, min_close ASC |

The stock that performed the best in May 2013 was AnySock1 (ASTOCK1) with a maximum closing price of $842.50. The stock that performed the worst was AnySock2 (ASTOCK2) with a minimum closing price of $3.22. |

| Finanzas e inversiones | Copo de nieve | ¿Cuál es el volumen promedio de acciones negociadas en julio de 2013? | SELECT AVG(volume) AS average_volumeFROM all_stocks_5yrWHERE date BETWEEN '2013-07-01' AND '2013-07-31' |

The average volume of stocks traded in July 2013 was 4,374,177 |

| Producto – Clima | API | ¿Cómo es el clima ahora mismo en la ciudad de Nueva York en grados Fahrenheit? |

Acerca de los autores

Navneet Tuteja es especialista en datos en Amazon Web Services. Antes de unirse a AWS, Navneet trabajó como facilitador para organizaciones que buscaban modernizar sus arquitecturas de datos e implementar soluciones integrales de inteligencia artificial y aprendizaje automático. Tiene un título en ingeniería de la Universidad Thapar, así como una maestría en estadística de la Universidad Texas A&M.

Navneet Tuteja es especialista en datos en Amazon Web Services. Antes de unirse a AWS, Navneet trabajó como facilitador para organizaciones que buscaban modernizar sus arquitecturas de datos e implementar soluciones integrales de inteligencia artificial y aprendizaje automático. Tiene un título en ingeniería de la Universidad Thapar, así como una maestría en estadística de la Universidad Texas A&M.

Sovik Kumar Nath es un arquitecto de soluciones de IA/ML con AWS. Tiene una amplia experiencia en el diseño de soluciones integrales de aprendizaje automático y análisis empresarial en finanzas, operaciones, marketing, atención médica, gestión de la cadena de suministro e IoT. Sovik ha publicado artículos y posee una patente en el monitoreo de modelos ML. Tiene doble maestría de la Universidad del Sur de Florida, Universidad de Friburgo, Suiza, y una licenciatura del Instituto Indio de Tecnología, Kharagpur. Fuera del trabajo, a Sovik le gusta viajar, viajar en ferry y ver películas.

Sovik Kumar Nath es un arquitecto de soluciones de IA/ML con AWS. Tiene una amplia experiencia en el diseño de soluciones integrales de aprendizaje automático y análisis empresarial en finanzas, operaciones, marketing, atención médica, gestión de la cadena de suministro e IoT. Sovik ha publicado artículos y posee una patente en el monitoreo de modelos ML. Tiene doble maestría de la Universidad del Sur de Florida, Universidad de Friburgo, Suiza, y una licenciatura del Instituto Indio de Tecnología, Kharagpur. Fuera del trabajo, a Sovik le gusta viajar, viajar en ferry y ver películas.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- EVM Finanzas. Interfaz unificada para finanzas descentralizadas. Accede Aquí.

- Grupo de medios cuánticos. IR/PR amplificado. Accede Aquí.

- PlatoAiStream. Inteligencia de datos Web3. Conocimiento amplificado. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/reinventing-the-data-experience-use-generative-ai-and-modern-data-architecture-to-unlock-insights/

- :posee

- :es

- :no

- :dónde

- $3

- $ UP

- 1

- 100

- 11

- 12

- 13

- 16

- 2008

- 2013

- 2023

- 22

- 32

- 50

- 5000

- 7

- 8

- 9

- a

- abundante

- de la máquina

- Lograr

- alcanzado

- add

- adición

- Adicionalmente

- en contra

- AI

- AI / ML

- paquete de capacitación DWoVH

- Todos

- permitir

- a lo largo de

- también

- Amazon

- RDS de Amazon

- Desplazamiento al rojo de Amazon

- Amazon Web Services

- an

- Analytics

- y

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- respuestas

- cualquier

- abejas

- CLAVES API

- API

- aplicaciones

- enfoque

- adecuado

- arquitectura

- somos

- artificial

- inteligencia artificial

- AS

- asociado

- At

- Aurora

- promedio

- AWS

- Pegamento AWS

- basado

- BE

- a las que has recomendado

- antes

- a continuación

- beneficios

- MEJOR

- entre

- build

- construido

- by

- PUEDEN

- capacidades

- cases

- catalogar

- cadena

- retos

- canales

- cargos

- comprobar

- manera?

- Elige

- Ciudad

- afirmó

- reclamaciones

- Cerrar

- cierre

- código

- COHERENTE

- Columna

- Columnas

- combinación

- referencia

- compañía

- compatible

- integraciones

- complejidades

- exhaustivo

- Contacto

- conexión

- Consola

- que no contengo

- contiene

- continuamente

- conversacional

- convertir

- correcta

- Correspondiente

- podría

- rastreador

- Para crear

- crea

- Creamos

- datos

- infraestructura de datos

- Base de datos

- bases de datos

- Fecha

- más profundo

- se define

- definir

- Definiciones

- Grado

- desplegar

- desplegado

- diseñado

- diseño

- detallado

- detalles

- una experiencia diferente

- dispar

- diverso

- dominio

- dominios

- doble

- DE INSCRIPCIÓN

- dibujado

- lugar de trabajo dinámico

- cada una

- facilidad

- fácil

- Eficaz

- eficiente.

- ya sea

- integrado

- personas

- permite

- de extremo a extremo

- Punto final

- Motor

- Ingeniería

- Inglés

- mejorar

- Empresa

- el establecimiento

- ejemplo

- expansivo

- experience

- expertos

- Explicar

- en los detalles

- Amplia experiencia

- extraerlos

- facilitador

- financiar

- financiero

- Mercado financiero

- Encuentre

- Nombre

- Florida

- seguido

- siguiendo

- siguiente

- Fundación

- fraude

- frecuente

- Desde

- ser completados

- completamente

- función

- promover

- generar

- generado

- genera

- generación de AHSS

- generativo

- IA generativa

- obtener

- Donar

- dado

- pasó

- Tienen

- es

- he

- la salud

- Retenida

- esta página

- mantiene

- organizado

- Cómo

- Como Hacer

- Sin embargo

- HTML

- http

- HTTPS

- humana

- Recursos Humanos

- Híbrido

- Identificación

- no haber aun identificado una solucion para el problema

- identifica

- Identifique

- if

- ilustra

- implementar

- implementación

- implementación

- mejorar

- in

- incluir

- Incluye

- Indian

- información

- EN LA MINA

- innovando

- Las opciones de entrada

- Insights

- Innovadora

- integrar

- COMPLETAMENTE

- integración

- Intelligence

- De Operación

- Interfaz

- dentro

- IOT

- IT

- SUS

- unión

- jpg

- Julio

- Clave

- claves

- especialistas

- idioma

- large

- más reciente

- aprendizaje

- Legal

- Biblioteca

- como

- LLM

- Mira

- máquina

- máquina de aprendizaje

- hecho

- para lograr

- gestionan

- gestionado

- Management

- muchos

- Mercado

- Datos del mercado

- Marketing

- Máster

- Maximizar

- máximas

- Puede..

- personalizado

- mediano

- malla

- metadatos

- Método

- mínimo

- ML

- modelo

- modelos

- Moderno

- modernizar

- monitoreo

- Mes

- más,

- Películas

- múltiples

- debe

- mysql

- nombre

- nombres

- Natural

- Procesamiento natural del lenguaje

- ¿ Necesita ayuda

- Nuevo

- New York

- Ciudad de Nueva York

- no técnico

- cuaderno

- ahora

- número

- ,

- of

- que ofrece

- Ofertas

- on

- , solamente

- Operaciones

- Optión

- or

- para las fiestas.

- la organización de

- "nuestr

- salir

- salida

- afuera

- los propietarios de

- parte

- pass

- pasado

- patentar

- realizado

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- políticas

- abiertas

- Publicación

- poderoso

- anterior

- precio

- tratamiento

- producir

- Producto

- productividad

- prometedor

- proporcionar

- proporciona un

- publicado

- consultas

- pregunta

- Preguntas

- más bien

- en tiempo real

- realización

- realmente

- recepción

- recibe

- registrado

- requiere

- Recursos

- respuesta

- respuestas

- Resultados

- volvemos

- Derecho

- Ejecutar

- sabio

- ventas

- Guardar

- escalable

- Escala

- guión

- programada

- (secciones)

- ver

- la búsqueda de

- Secuencia

- Sin servidor

- de coches

- Servicios

- ella

- mostrar

- mostrado

- Shows

- cerrar

- sencillos

- a medida

- Soluciones

- algo

- Alguien

- Fuente

- Fuentes

- Sur

- Premium

- especialista

- soluciones y

- comienzo

- statistics

- paso

- pasos

- en stock

- Acciones

- Detener

- STORAGE

- tienda

- tiendas

- estudio

- tal

- siguiente

- suministro

- cadena de suministro

- gestión de la cadena de suministro

- Suiza

- te

- mesa

- toma

- técnicas

- Tecnología

- plantilla

- Texas

- que

- esa

- La

- la información

- La Fuente

- su

- luego

- Ahí.

- de este modo

- Estas

- ellos

- terceros.

- datos de terceros

- así

- este año

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- boleto

- venta de boletos

- a

- del IRS

- Total

- negocian

- Viajar

- ui

- subyacente

- unificado

- universidad

- desbloquear

- utilizan el

- usado

- Usuario

- Interfaz de usuario

- usuarios

- usos

- usando

- utilizado

- propuesta de

- diversos

- Ver

- volumen

- fue

- ver

- Camino..

- we

- Tiempo

- web

- servicios web

- WELL

- tuvieron

- que

- mientras

- seguirá

- dentro de

- sin

- Actividades:

- trabajado

- flujo de trabajo

- trabajando

- Peor

- la escritura

- año

- york

- Usted

- tú

- zephyrnet