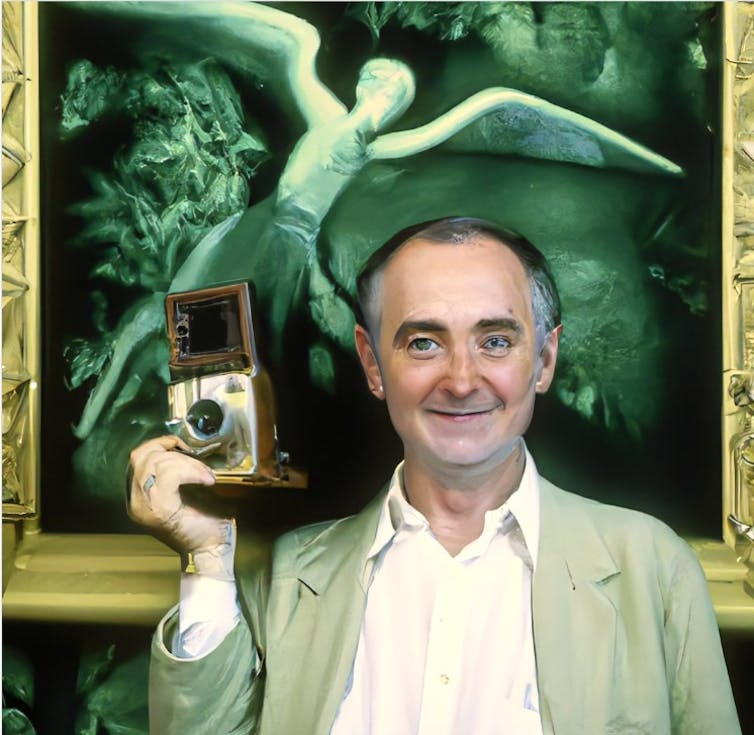

La fotografía falsa no es nada nuevo. En la década de 1910, el autor británico Arthur Conan Doyle fue engañado por dos hermanas en edad escolar que habían producido fotografías de elegantes hadas retozando en su jardín.

Hoy en día es difícil creer que estas fotos pudieran haber engañado a alguien, pero no fue sino hasta la década de 1980 que un experto llamado Geoffrey Crawley tuvo el descaro de aplicar directamente su conocimiento de la fotografía cinematográfica y deducir lo obvio.

Las fotografías eran falsas, como admitió más tarde una de las propias hermanas.

Caza de artefactos y sentido común

La fotografía digital ha abierto una gran cantidad de técnicas para falsificadores y detectives por igual.

Hoy en día, el examen forense de imágenes sospechosas implica la búsqueda de cualidades inherentes a la fotografía digital, como examinar metadatos incrustados en las fotos, utilizando software como Adobe Photoshop para corregir distorsiones en las imágenes, y en busca de signos reveladores de manipulación, como la duplicación de regiones para ocultar las características originales.

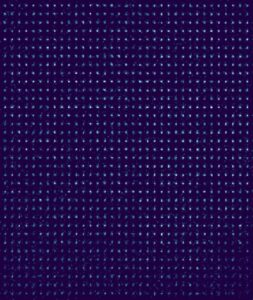

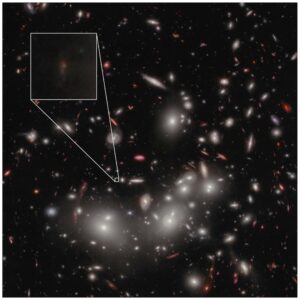

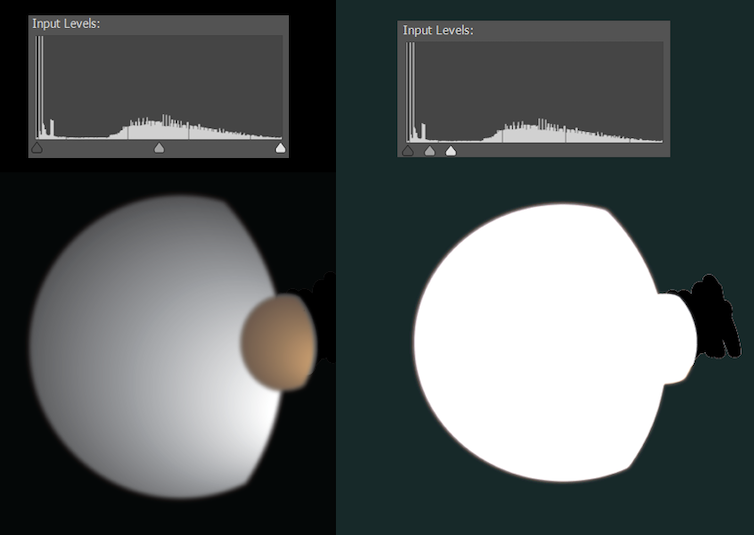

A veces, las ediciones digitales son demasiado sutiles para detectarlas, pero saltan a la vista cuando ajustamos la forma en que se distribuyen los píxeles claros y oscuros. Por ejemplo, en 2010, la NASA lanzó un foto de las lunas de Saturno Dione y Titán. No era falso de ninguna manera, pero se había limpiado para eliminar los artefactos perdidos, lo que consiguió la atención de los teóricos de la conspiración.

Curioso, puse la imagen en Photoshop. La siguiente ilustración recrea aproximadamente cómo se veía esto.

La mayoría de las fotografías digitales están en formatos comprimidos como JPEG, reducidos al eliminar gran parte de la información capturada por la cámara. Los algoritmos estandarizados garantizan que la información eliminada tenga un impacto visible mínimo, pero deja rastros.

La compresión de cualquier región de una imagen dependerá de lo que suceda en la imagen y de la configuración actual de la cámara; cuando una imagen falsa combina múltiples fuentes, a menudo es posible detectar esto por análisis cuidadoso de los artefactos de compresión.

Cierta metodología forense tiene poco que ver con el formato de una imagen, pero es esencialmente trabajo de detective visual. ¿Todos en la fotografía están iluminados de la misma manera? ¿Tienen sentido las sombras y los reflejos? ¿Las orejas y las manos muestran luces y sombras en los lugares correctos? ¿Qué se refleja en los ojos de las personas? ¿Se sumarían todas las líneas y ángulos de la habitación si modeláramos la escena en 3D?

Puede que Arthur Conan Doyle se haya dejado engañar por las fotos de hadas, pero creo que su creación, Sherlock Holmes, se sentiría como en casa en el mundo del análisis forense de fotos.

Una nueva era de inteligencia artificial

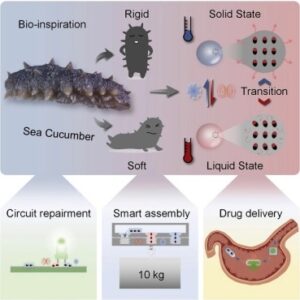

El explosión actual de imágenes creado por texto a imagen inteligencia artificial tools es, en muchos sentidos, más radical que el cambio de la película a la fotografía digital.

Ahora podemos conjurar cualquier imagen que queramos, simplemente escribiendo. Estas imágenes no son fotografías franken hechas improvisando grupos de píxeles preexistentes. Son imágenes completamente nuevas con el contenido, la calidad y el estilo especificados.

Hasta hace poco, las complejas redes neuronales utilizadas para generar estas imágenes han tenido una disponibilidad limitada para el público. Esto cambió el 23 de agosto de 2022, con el lanzamiento al público del Difusión estable de código abierto. Ahora cualquier persona con una tarjeta gráfica Nvidia de nivel de juego en su computadora puede crear contenido de imagen de IA sin ningún laboratorio de investigación o control comercial de sus actividades.

Esto ha llevado a muchos a preguntarse: “¿Podemos volver a creer lo que vemos en línea?”. Eso depende.

La inteligencia artificial de texto a imagen obtiene su inteligencia del entrenamiento: el análisis de una gran cantidad de pares de imágenes/títulos. Las fortalezas y debilidades de cada sistema se derivan en parte de las imágenes con las que se ha entrenado. He aquí un ejemplo: así es como Stable Diffusion ve a George Clooney planchando.

Esto está lejos de ser realista. Todo lo que Stable Diffusion tiene para continuar es la información que ha aprendido, y si bien está claro que ha visto a George Clooney y puede vincular esa cadena de letras con las características del actor, no es un experto en Clooney.

Sin embargo, habría visto y digerido muchas más fotos de hombres de mediana edad en general, así que veamos qué sucede cuando preguntamos por un hombre genérico de mediana edad en el mismo escenario.

Esta es una clara mejora, pero aún no del todo realista. Como siempre ha sido el caso, la complicada geometría de las manos y las orejas son buenos lugares para buscar signos de falsificación, aunque en este medio estamos mirando la geometría espacial en lugar de los indicadores de iluminación imposible.

Puede haber otras pistas. Si reconstruyéramos cuidadosamente la habitación, ¿las esquinas serían cuadradas? ¿Los estantes tendrían sentido? Un experto forense acostumbrado a examinar fotografías digitales probablemente podría hacer una llamada al respecto.

Ya no podemos creer lo que ven nuestros ojos

Si ampliamos el conocimiento de un sistema de texto a imagen, puede funcionar aún mejor. Puede agregar sus propias fotografías descritas para complementar la capacitación existente. Este proceso se conoce como inversión textual.

Recientemente, Google ha lanzado cabina de ensueño, un método alternativo y más sofisticado para inyectar personas, objetos o incluso estilos artísticos específicos en sistemas de IA de texto a imagen.

Este proceso requiere hardware de alta resistencia, pero los resultados son asombrosos. Se ha comenzado a compartir un gran trabajo en Reddit. Mira las fotos en la publicación de abajo que muestran imágenes puestas en DreamBooth e imágenes falsas realistas de Stable Diffusion.

Ya no podemos creer lo que vemos, pero aún podemos confiar en los de los expertos forenses, al menos por ahora. Es muy posible que los sistemas futuros puedan ser entrenados deliberadamente para engañarlos también.

Nos estamos moviendo rápidamente hacia una era en la que la fotografía e incluso el video perfectos serán comunes. El tiempo dirá cuán significativo será esto, pero mientras tanto vale la pena recordar la lección de las fotos de Cottingley Fairy: a veces la gente solo quiere creer, incluso en falsificaciones obvias.![]()

Este artículo se republica de La conversación bajo una licencia Creative Commons. Leer el articulo original.

Crédito de la imagen: Brendan Murphy / unuthor proporcionado