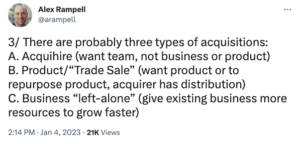

Esta es una versión editada de una publicación que se publicó originalmente esta página.

La neurociencia y la IA tienen una larga historia entrelazada. Los pioneros de la inteligencia artificial se inspiraron en los principios de la organización del cerebro para crear máquinas inteligentes. En un cambio sorprendente, la IA ahora nos está ayudando a comprender su fuente de inspiración: el cerebro humano. Este enfoque de usar IA para construir modelos del cerebro se conoce como neuroAI. Durante la próxima década, haremos cada vez más precisos in silico modelos cerebrales, especialmente modelos de nuestros dos sentidos más destacados, la vista y el oído. Como resultado, podremos descargar y utilizar modelos sensoriales, bajo demanda, con la misma comodidad con la que podemos hacer reconocimiento de objetos o procesamiento de lenguaje natural.

Muchos neurocientíficos e investigadores de inteligencia artificial lo son, ¡comprensiblemente! – muy entusiasmado con esto: ¡cerebros a pedido! ¡Descubriendo lo que significa ver, sentir, ser humano! Menos reconocido es que existen amplias aplicaciones prácticas en la industria. Durante mucho tiempo he sido investigador en este campo, habiendo trabajado en cómo el cerebro transforma la visión en significado desde mi doctorado. He visto la progresión del campo desde su inicio, y creo que ahora es el momento de investigar cómo la neuroIA puede impulsar más creatividad y mejorar nuestra salud.

Predigo que neuroAI primero encontrará un uso generalizado en el arte y la publicidad, especialmente cuando se conecte a nuevos modelos generativos de IA como GPT-3 y DALL-E. Si bien los modelos de IA generativa actuales pueden producir arte y medios creativos, no pueden decirle si esos medios finalmente comunicarán un mensaje a la audiencia prevista, pero la neuroIA podría. Por ejemplo, podríamos reemplazar el ensayo y error de los grupos focales y las pruebas A/B y crear directamente medios que comuniquen exactamente lo que queremos. Las tremendas presiones del mercado en torno a esta aplicación crearán un círculo virtuoso que mejorará los modelos de neuroIA.

Los modelos mejorados resultantes permitirán aplicaciones en salud en medicina, desde ayudar a personas con problemas neurológicos hasta mejorar las habilidades del pozo. Imagine crear las imágenes y los sonidos correctos para ayudar a una persona a recuperar la vista o la audición más rápidamente después de una cirugía LASIK o después de recibir un implante coclear, respectivamente.

Estas innovaciones serán mucho más potentes gracias a otras tecnologías que se avecinan: la realidad aumentada y las interfaces cerebro-computadora. Sin embargo, para realizar completamente la utilidad potencial de los sistemas sensoriales descargables bajo demanda, necesitaremos llenar los vacíos actuales en herramientas, talento y financiación.

En este artículo, explicaré qué es la neuroIA, cómo podría comenzar a evolucionar y comenzar a impactar nuestras vidas, cómo complementa otras innovaciones y tecnologías, y qué se necesita para impulsarla.

¿Qué es la neuroIA?

NeuroAI es una disciplina emergente que busca 1) estudiar el cerebro para aprender a construir una mejor inteligencia artificial y 2) usar la inteligencia artificial para comprender mejor el cerebro. Una de las herramientas principales de la neuroIA es el uso de redes neuronales artificiales para crear modelos informáticos de funciones cerebrales específicas. Este enfoque se inició en 2014, cuando los investigadores de MIT y Columbia mostró que las redes neuronales artificiales profundas podrían explicar las respuestas en una parte del cerebro que reconoce objetos: la corteza inferotemporal (IT). Introdujeron una receta básica para comparar una red neuronal artificial con un cerebro. Usando esta receta y repitiendo las pruebas iterativas a través de los procesos cerebrales (reconocimiento de formas, procesamiento de movimiento, procesamiento del habla, control del brazo, memoria espacial), los científicos están construyendo un mosaico de modelos informáticos para el cerebro.

Una receta para comparar cerebros con máquinas

Entonces, ¿cómo se construye un modelo de NeuroAI? Desde su creación en 2014, el campo ha seguido la misma receta básica:

1. Entrenar redes neuronales artificiales in silico para resolver una tarea, por ejemplo para el reconocimiento de objetos. La red resultante se denomina optimizada para tareas. Es importante destacar que esto generalmente implica entrenamiento solo con imágenes, películas y sonidos, no con datos cerebrales.

2. Compare las activaciones intermedias de redes neuronales artificiales entrenadas con grabaciones cerebrales reales. La comparación se realiza utilizando técnicas estadísticas como la regresión lineal o el análisis de similitud de representación.

3. Elija el modelo con mejor desempeño como el mejor modelo actual de estas áreas del cerebro.

Esta receta se puede aplicar con datos recopilados dentro del cerebro a partir de neuronas individuales o de técnicas no invasivas como la magnetoencefalografía (MEG) o la resonancia magnética funcional (fMRI).

Un modelo de neuroIA de una parte del cerebro tiene dos características clave. Es computable: podemos alimentar a este modelo de computadora con un estímulo y nos dirá cómo reaccionará un área del cerebro. También es diferenciable: es una red neuronal profunda que podemos optimizar de la misma manera que optimizamos modelos que resuelven el reconocimiento visual y el procesamiento del lenguaje natural. Eso significa que los neurocientíficos obtienen acceso a todas las herramientas poderosas que impulsaron la revolución del aprendizaje profundo, incluidos los sistemas de álgebra tensorial como PyTorch y TensorFlow.

¿Qué significa esto? Pasamos de no entender grandes porciones del cerebro a poder descargar buenos modelos en menos de una década. Con las inversiones adecuadas, pronto tendremos excelentes modelos de grandes porciones del cerebro. El sistema visual fue el primero en ser modelado; el sistema auditivo no se quedó atrás; y otras áreas seguramente caerán como fichas de dominó cuando los intrépidos neurocientíficos se apresuren a resolver los misterios del cerebro. Además de satisfacer nuestra curiosidad intelectual, ¡un gran motivador para los científicos!, esta innovación permitirá a cualquier programador descargar buenos modelos del cerebro y desbloquear innumerables aplicaciones.

Las áreas de aplicación

Arte y publicidad

Comencemos con esta premisa simple: el 99% de los medios que experimentamos son a través de nuestros ojos y oídos. Hay industrias enteras que se pueden resumir para brindar los píxeles y tonos correctos a estos sentidos: arte visual, diseño, películas, juegos, música y publicidad son solo algunos de ellos. Ahora bien, no son nuestros ojos y oídos los que interpretan estas experiencias, ya que son meros sensores: es nuestro cerebro el que le da sentido a esa información. Los medios se crean para informar, para entretener, para provocar las emociones deseadas. Pero determinar si el mensaje en una pintura, una fotografía profesional o un anuncio se recibe según lo previsto es un ejercicio frustrante de prueba y error: los humanos tienen que estar al tanto para determinar si el mensaje llega, lo cual es costoso y requiere tiempo. consumidor.

Los servicios en línea a gran escala han descubierto formas de evitar esto mediante la automatización de prueba y error: pruebas A/B. Google famoso probó cuál de los 50 tonos de azul usar para los enlaces en la página de resultados del motor de búsqueda. Según The Guardian, la mejor opción provocó mejoras en los ingresos por encima de la referencia de 200 millones de dólares en 2009, o aproximadamente 1% de los ingresos de Google en ese momento. Netflix personaliza las miniaturas al espectador para optimizar su experiencia de usuario. Estos métodos están disponibles para gigantes en línea con tráfico masivo, que pueden superar el ruido inherente al comportamiento de las personas.

¿Qué pasaría si pudiéramos predecir cómo reaccionará la gente ante los medios antes de obtener datos? Esto haría posible que las pequeñas empresas optimicen sus materiales escritos y sitios web a pesar de tener poca tracción preexistente. NeuroAI está cada vez más cerca de poder predecir cómo reaccionarán las personas a los materiales visuales. Por ejemplo, los investigadores en Adobe están trabajando en herramientas predecir y dirigir la atención visual en las ilustraciones.

Los investigadores también han demostrado cómo editar fotos para hacerlas más visualmente memorable o estéticamente agradable. Se podría usar, por ejemplo, para seleccionar automáticamente una foto de rostro profesional más alineada con la imagen que las personas quieren proyectar de sí mismas: profesional, seria o creativa. Las redes neuronales artificiales pueden incluso encontrar formas de comunicar mensajes de manera más efectiva que las imágenes realistas. El CLIP de OpenAI se puede probar para encontrar imágenes que estén alineadas con las emociones. La imagen mejor alineada con el concepto de conmoción no estaría fuera de lugar al lado del Grito de Munch.

Durante el último año, OpenAI y Google han demostrado redes de arte generativo con una capacidad impresionante para generar imágenes fotorrealistas a partir de indicaciones de texto. No hemos llegado a ese momento para la música, pero con el ritmo de progreso en los modelos generativos, esto seguramente sucederá en los próximos años. Al construir máquinas que puedan escuchar como los humanos, podemos democratizar la producción musical, dando a cualquiera la capacidad de hacer lo que pueden hacer los productores musicales altamente calificados: comunicar la emoción correcta durante un coro, ya sea melancolía o alegría; para crear un gusano de oído de una melodía; o hacer una pieza irresistiblemente bailable.

Hay tremendas presiones del mercado para optimizar los medios audiovisuales, los sitios web y especialmente los anuncios, y ya estamos integrando neuroIA y arte algorítmico en este proceso. Esta presión conducirá a un círculo virtuoso en el que la neuroIA mejorará y será más útil a medida que se inviertan más recursos en aplicaciones prácticas. Un efecto secundario de esto es que obtendremos muy buenos modelos del cerebro que serán útiles mucho más allá de los anuncios.

Accesibilidad y diseño algorítmico

Una de las aplicaciones más emocionantes de neuroAI es la accesibilidad. La mayoría de los medios están diseñados para la persona "promedio", sin embargo, todos procesamos la información visual y auditiva de manera diferente. El 8% de los hombres y el 0.5% de las mujeres son daltónicos para el rojo y el verde, y una gran cantidad de medios no se adaptan a sus necesidades. Hay una serie de productos que simulan el daltonismo en la actualidad, pero requieren una persona con visión de color normal para interpretar los resultados y realizar los cambios necesarios. La reasignación estática de colores tampoco funciona para estas necesidades, ya que algunos materiales no conservan su semántica con la reasignación de colores (por ejemplo, gráficos que se vuelven difíciles de leer). Podríamos automatizar la generación de materiales y sitios web seguros para los daltónicos a través de métodos de neuroIA que mantienen la semántica de los gráficos existentes.

Otro ejemplo es ayudar a las personas con problemas de aprendizaje, como la dislexia, que afecta hasta al 10 % de las personas en todo el mundo. Uno de los problemas subyacentes en la dislexia es sensibilidad al hacinamiento, que es la dificultad para reconocer formas con características subyacentes similares, incluidas letras con simetría especular como p y q. Anne Harrington y Arturo Deza en el MIT están trabajando en modelos de neuroIA que modelan este efecto y obteniendo unos resultados muy prometedores. Imagine tomar modelos del sistema visual disléxico para diseñar fuentes que sean estéticamente agradables y fáciles de leer. Con los datos correctos sobre el sistema visual de una persona específica, podemos incluso personalizar la fuente a un individuo específico, que se ha mostrado prometedor en la mejora del rendimiento de lectura. Estas son mejoras potencialmente grandes en la calidad de vida que esperan aquí.

Salud

Muchos neurocientíficos ingresan al campo con la esperanza de que su investigación tenga un impacto positivo en la salud humana, en particular para las personas que viven con trastornos neurológicos o problemas de salud mental. Tengo muchas esperanzas de que la neuroIA desbloquee nuevas terapias: con un buen modelo del cerebro, podemos crear los estímulos correctos para que llegue el mensaje correcto, como una llave que encaja en una cerradura. En ese sentido, la neuroIA podría aplicarse de manera similar al diseño algorítmico de fármacos, pero en lugar de moléculas pequeñas, entregamos imágenes y sonidos.

Los problemas más abordables involucran a los receptores de los ojos y los oídos, que ya están bien caracterizados. Cientos de miles de personas han recibido implantes cocleares, neuroprótesis que estimulan eléctricamente la cóclea del oído, lo que permite que las personas sordas o con dificultades auditivas vuelvan a oír. Estos implantes, que contienen unas pocas docenas de electrodos, pueden resultar difíciles de usar en entornos ruidosos con múltiples altavoces. Un modelo de cerebro puede optimizar el patrón de estimulación del implante para amplificar el habla. Lo notable es que esta tecnología, desarrollada para personas con implantes, podría adaptarse para ayudar a las personas sin implantes a comprender mejor el habla mediante la modificación de los sonidos en tiempo real, ya sea que tengan un trastorno del procesamiento auditivo o que simplemente se encuentren con frecuencia en entornos ruidosos.

Muchas personas experimentan cambios en sus sistemas sensoriales a lo largo de su vida, ya sea al recuperarse de una cirugía de cataratas o volverse miopes con la edad. Sabemos que después de tal cambio, las personas pueden aprender a reinterpretar el mundo correctamente a través de la repetición, un fenómeno llamado aprendizaje perceptivo. Es posible que podamos maximizar este aprendizaje perceptivo para que las personas puedan recuperar sus habilidades de manera más rápida y efectiva. Una idea similar podría ayudar a las personas que han perdido la capacidad de mover sus extremidades con fluidez después de un derrame cerebral. Si pudiéramos encontrar la secuencia correcta de movimientos para fortalecer el cerebro de manera óptima, podríamos ayudar a los sobrevivientes de accidentes cerebrovasculares a recuperar más funciones, como caminar con mayor fluidez o simplemente sostener una taza de café sin derramarla. Además de ayudar a las personas a recuperar las funciones físicas perdidas, la misma idea podría ayudar a las personas sanas a alcanzar el máximo rendimiento sensorial, ya sean jugadores de béisbol, arqueros o patólogos.

Finalmente, podríamos ver estas ideas aplicadas al tratamiento de los trastornos del estado de ánimo. Fui a muchos espectáculos de artes visuales para aliviar mi aburrimiento durante la pandemia, y me levantó el ánimo tremendamente. El arte visual y la música pueden levantarnos el ánimo, y es una prueba de concepto de que podemos estar capaz de ofrecer terapias para los trastornos del estado de ánimo a través de los sentidos. Sabemos que controlar la actividad de partes específicas del cerebro con estimulación eléctrica puede aliviar la depresión resistente al tratamiento; quizás controlar la actividad del cerebro indirectamente a través de los sentidos podría mostrar efectos similares. Mediante la implementación de modelos simples (fruta al alcance de la mano) que afectan a partes del cerebro bien entendidas, pondremos en marcha la construcción de modelos más complejos que pueden ayudar a la salud humana.

Habilitación de tendencias tecnológicas

NeuroAI tardará muchos años en ser domesticado e implementado en aplicaciones, e interceptará otras tendencias tecnológicas emergentes. Aquí destaco dos tendencias en particular que harán que la neuroIA sea mucho más poderosa: la realidad aumentada (AR), que puede entregar estímulos con precisión; e interfaces cerebro-computadora (BCI), que pueden medir la actividad cerebral para verificar que los estímulos actúan de la manera esperada.

Realidad aumentada

Una tendencia que hará que las aplicaciones de neuroIA sean mucho más poderosas es la adopción de gafas de realidad aumentada. La realidad aumentada (AR) tiene el potencial de convertirse en una plataforma informática ubicua, porque AR se integra en la vida diaria.

La hipótesis de Michael Abrash, científico jefe de Meta Reality Labs, es que si construyes lentes AR suficientemente capaces, todos los querrán. Eso significa construir anteojos conscientes del mundo que pueden crear objetos virtuales persistentes bloqueados por el mundo; marcos ligeros y de moda, como un par de Ray-Bans; y dándote superpoderes de la vida real, como ser capaz de interactuar naturalmente con las personas sin importar la distancia y mejorando su audición. Si puede construir estos, un gran desafío técnico, los anteojos AR podrían seguir una trayectoria similar a la de un iPhone, de modo que todos tengan uno (o una imitación) 5 años después del lanzamiento.

Para hacer esto realidad, Meta pasó 10 mil millones de dólares el año pasado en I+D para el metaverso. Si bien no sabemos con certeza qué está haciendo Apple, hay fuertes señales de que están trabajando en gafas AR. Entonces, también hay un tremendo impulso en el lado de la oferta para que AR suceda.

Esto pondrá a disposición de todos un dispositivo de visualización mucho más potente que las pantallas estáticas actuales. Si se sigue la trayectoria de la realidad virtual, eventualmente tendrá seguimiento ocular integrado. Esto significaría una forma ampliamente disponible de presentar estímulos que está mucho más controlada de lo que es posible actualmente, un sueño para los neurocientíficos. Y es probable que estos dispositivos tengan aplicaciones de salud de gran alcance, según lo dicho por Michael Abrash en 2017, como mejorar la visión en condiciones de poca luz o permitir que las personas lleven una vida normal a pesar de la degeneración macular.

La importancia para la neuroIA es clara: podemos proporcionar el estímulo adecuado de forma muy controlada y continua en la vida cotidiana. Esto es cierto para la visión, y quizás menos obviamente para la audición, ya que podemos ofrecer audio espacial. Lo que eso significa es que nuestras herramientas para generar terapias de neuroIA para personas con problemas neurológicos o para mejoras de accesibilidad serán mucho más poderosas.

BCI

Con una gran pantalla y parlantes, podemos controlar con precisión las principales entradas al cerebro. La siguiente etapa, más poderosa en la entrega de estímulos a través de los sentidos, es verificar que el cerebro está reaccionando de la manera esperada a través de una interfaz cerebro-computadora (BCI) de solo lectura. Por lo tanto, podemos medir los efectos de los estímulos en el cerebro y, si no son los esperados, podemos ajustarlos en lo que se denomina control de circuito cerrado.

Para ser claros, aquí no estoy hablando de métodos BCI como el chip de Neuralink o estimuladores cerebrales profundos que van dentro del cráneo; es suficiente para estos fines medir la actividad cerebral fuera del cráneo, de forma no invasiva. Tampoco es necesario estimular directamente el cerebro: gafas y auriculares son todo lo que necesita para controlar la mayoría de las entradas del cerebro.

Hay una serie de BCI no invasivos de solo lectura que se comercializan actualmente o que están en desarrollo y que podrían usarse para el control de circuito cerrado. Algunos ejemplos incluyen:

- EEG. La electroencefalografía mide la actividad eléctrica del cerebro fuera del cráneo. Debido a que el cráneo actúa como conductor de volumen, el EEG tiene una resolución temporal alta pero una resolución espacial baja. Si bien esto ha limitado la aplicación del consumidor a los productos de meditación (Musa) y aplicaciones de neuromarketing de nicho, soy optimista sobre algunos de sus usos en el contexto del control de circuito cerrado. EEG puede ser mucho más poderoso cuando uno tiene control sobre el estímulo, porque es posible correlacionar el estímulo presentado con la señal de EEG y decodificar a qué estaba prestando atención una persona (métodos de potencial evocado). De hecho, se adquirió NextMind, que hizo un "clic mental" basado en EEG basado en potenciales evocados. por chasquido, que ahora fabrica productos AR. OpenBCI es planificar para lanzar unos auriculares que integran sus sensores EEG con los auriculares Aero de gama alta de Varjo. Yo no descartaría el EEG.

- IRMf. La resonancia magnética funcional mide los pequeños cambios en la oxigenación de la sangre asociados con la actividad neural. Es lento, no es portátil, requiere su propia habitación y es muy caro. Sin embargo, fMRI sigue siendo la única tecnología que puede leer de forma no invasiva la actividad en las profundidades del cerebro de una manera espacialmente precisa. Hay dos paradigmas que son bastante maduros y relevantes para el control neuronal de circuito cerrado. El primero es la biorretroalimentación basada en fMRI. Un subcampo de fMRI muestra que las personas pueden modular su actividad cerebral presentándola visualmente en una pantalla o auriculares. El segundo es el mapeo cortical, que incluye enfoques como campos receptivos de población y estimación de la selectividad de vóxel con clips de película o los podcasts, que permiten estimar cómo distintas áreas del cerebro responden a diferentes estímulos visuales y auditivos. Estos dos métodos sugieren que debería ser posible estimar cómo una intervención de neuroIA afecta al cerebro y dirigirla para que sea más eficaz.

- FNIRS. La espectroscopia de infrarrojo cercano funcional utiliza luz difusa para estimar el volumen de sangre cerebral entre un transmisor y un receptor. Se basa en el hecho de que la sangre es opaca y el aumento de la actividad neuronal conduce a un retraso en el flujo de sangre en un volumen cerebral dado (el mismo principio que la resonancia magnética funcional). La NIRS convencional tiene una resolución espacial baja, pero con la sincronización temporal (TD-NIRS) y el sobremuestreo masivo (tomografía óptica difusa), la resolución espacial es mucho mejor. En el frente académico, El grupo de Joe Culver en WUSTL han demostrado la decodificación de películas desde la corteza visual. En el frente comercial, Kernel es ahora fabricación y envío de auriculares TD-NIRS que son impresionantes hazañas de ingeniería. Y es un área donde la gente sigue esforzándose y el progreso es rápido; mi antiguo grupo en Meta demostró una mejora de 32 veces en la relación señal-ruido (que podría escalarse a >300) en una técnica relacionada.

- MEG. La magnetoencefalografía mide pequeños cambios en los campos magnéticos, localizando así la actividad cerebral. MEG es similar a EEG en que mide los cambios en el campo electromagnético, pero no sufre de conducción de volumen y, por lo tanto, tiene una mejor resolución espacial. El MEG portátil que no requiere refrigeración cambiaría las reglas del juego para la BCI no invasiva. La gente está progresando con los magnetómetros de bombeo óptico y es posible comprar sensores OPM individuales en el mercado abierto, de fabricantes como QuSpin.

Además de estas técnicas más conocidas, algunas tecnologías de caballos oscuros como la holografía digital, la tomografía fotoacústica y el ultrasonido funcional podrían conducir a cambios rápidos de paradigma en este espacio.

Si bien la BCI no invasiva de grado de consumo aún está en su infancia, hay una serie de presiones del mercado en torno a los casos de uso de AR que harán que el pastel sea más grande. De hecho, un problema importante para AR es controlar el dispositivo: no querrás tener que caminar con un controlador o murmurarle a tus anteojos si puedes evitarlo. Las empresas se toman muy en serio la solución de este problema, como lo demuestra la compra de Facebook de CTRL+Labs en 2019, Snap adquiere NextMind y Valve se asocia con OpenBCI. Por lo tanto, es probable que veamos que se desarrollan rápidamente BCI de baja dimensión. Las BCI de alta dimensión podrían seguir la misma trayectoria si encuentran una aplicación excelente como AR. Es posible que los tipos de aplicaciones de neuroIA que defiendo aquí sean precisamente el caso de uso correcto para esta tecnología.

Si podemos controlar la entrada a los ojos y los oídos, así como medir los estados cerebrales con precisión, podemos administrar terapias basadas en neuroIA de forma monitoreada para lograr la máxima eficacia.

Lo que le falta al campo

La ciencia central detrás de las aplicaciones de NeuroAI está madurando rápidamente y hay una serie de tendencias positivas que aumentarán su aplicabilidad general. Entonces, ¿qué falta para llevar las aplicaciones de neuroIA al mercado?

- Estampación. Otros subcampos dentro de la IA se han beneficiado enormemente de las cajas de herramientas que permiten un progreso rápido y el intercambio de resultados. Esto incluye bibliotecas de álgebra tensorial como Tensorflow y PyTorch, entornos de entrenamiento como OpenAI Gym y ecosistemas para compartir datos y modelos como 🤗 HuggingFace. Un depósito centralizado de modelos y métodos, así como conjuntos de evaluación, que potencialmente aprovechen abundantes datos de simulación, impulsaría el campo. Ya existe una sólida comunidad de organizaciones de neurociencia de código abierto, y podrían servir como anfitriones naturales para estos esfuerzos.

- Talento. Hay un número cada vez más pequeño de lugares donde la investigación y el desarrollo se realizan en la intersección de la neurociencia y la IA. El Área de la Bahía, con laboratorios en Stanford y Berkeley, y el área metropolitana de Boston con numerosos laboratorios en el MIT y Harvard probablemente recibirán la mayor parte de la inversión del ecosistema de capital de riesgo preexistente. Un tercer centro probable es Montreal, Canadá, impulsado por departamentos masivos de neurociencia en McGill y la Universidad de Montreal, combinados con la atracción de Mila, el instituto de inteligencia artificial fundado por el pionero de la IA Yoshua Bengio. Nuestro campo se beneficiaría de programas de doctorado especializados y centros de excelencia en neuroIA para impulsar la comercialización.

- Nuevos modelos de financiación y comercialización de aplicaciones médicas. Las aplicaciones médicas tienen un largo camino hacia la comercialización, y la propiedad intelectual protegida suele ser un requisito previo para obtener financiación para reducir el riesgo de inversión en la tecnología. Las innovaciones basadas en IA son notoriamente difíciles de patentar, y el software como dispositivo médico (SaMD) recién está comenzando a llegar al mercado, lo que hace que el camino hacia la comercialización sea incierto. Necesitaremos fondos que se centren en reunir la inteligencia artificial y la experiencia en tecnología médica para nutrir este campo naciente.

Construyamos neuroIA

Los científicos y los filósofos se han preguntado cómo funciona el cerebro desde tiempos inmemoriales. ¿Cómo una fina lámina de tejido, de un pie cuadrado de superficie, nos permite ver, oír, sentir y pensar? NeuroAI nos está ayudando a manejar estas preguntas profundas mediante la construcción de modelos de sistemas neurológicos en computadoras. Al satisfacer esa sed fundamental de conocimiento, ¿qué significa ser humano? – Los neurocientíficos también están creando herramientas que podrían ayudar a millones de personas a vivir vidas más ricas.

Publicado el 4 de agosto de 2022

Tecnología, innovación y el futuro, contado por quienes lo construyen.

Las opiniones expresadas en "publicaciones" (incluidos artículos, podcasts, videos y redes sociales) son las de las personas citadas en el mismo y no son necesariamente las opiniones de AH Capital Management, LLC ("a16z") o sus respectivos afiliados. Cierta información contenida aquí se ha obtenido de fuentes de terceros, incluso de compañías de cartera de fondos administrados por a16z. Si bien se tomó de fuentes que se consideran confiables, a16z no ha verificado de forma independiente dicha información y no hace declaraciones sobre la precisión duradera de la información o su idoneidad para una situación determinada.

Este contenido se proporciona solo con fines informativos y no debe considerarse como asesoramiento legal, comercial, de inversión o fiscal. Debe consultar a sus propios asesores sobre estos asuntos. Las referencias a cualquier valor o activo digital son solo para fines ilustrativos y no constituyen una recomendación de inversión ni una oferta para proporcionar servicios de asesoramiento de inversión. Además, este contenido no está dirigido ni destinado a ser utilizado por ningún inversionista o posible inversionista, y bajo ninguna circunstancia se puede confiar en él al tomar una decisión de invertir en cualquier fondo administrado por a16z. (Una oferta para invertir en un fondo a16z se realizará solo mediante el memorando de colocación privada, el acuerdo de suscripción y otra documentación relevante de dicho fondo y debe leerse en su totalidad). Cualquier inversión o compañía de cartera mencionada, referida o descritas no son representativas de todas las inversiones en vehículos administrados por a16z, y no puede garantizarse que las inversiones serán rentables o que otras inversiones realizadas en el futuro tendrán características o resultados similares. Una lista de inversiones realizadas por fondos administrados por Andreessen Horowitz (excluyendo inversiones para las cuales el emisor no ha otorgado permiso para que a16z divulgue públicamente, así como inversiones no anunciadas en activos digitales que cotizan en bolsa) está disponible en https://a16z.com/investments/.

Los cuadros y gráficos proporcionados en este documento tienen únicamente fines informativos y no se debe tener en cuenta al tomar cualquier decisión de inversión. El rendimiento pasado no es indicativo de resultados futuros. El contenido habla solo a partir de la fecha indicada. Las proyecciones, estimaciones, pronósticos, objetivos, perspectivas y / u opiniones expresadas en estos materiales están sujetas a cambios sin previo aviso y pueden diferir o ser contrarias a las opiniones expresadas por otros. Por favor mira https://a16z.com/disclosures para información importante adicional.

- Andreessen Horowitz

- Bio y cienciaDatos

- Bitcoin

- blockchain

- cumplimiento de blockchain

- conferencia de la cadena de bloque

- coinbase

- Coingenius

- Consenso

- conferencia criptográfica

- minería criptográfica

- criptomoneda

- Descentralizado

- DeFi

- Acciones digitales

- Etereum

- máquina de aprendizaje

- token no fungible

- Platón

- platón ai

- Inteligencia de datos de Platón

- platoblockchain

- PlatónDatos

- juego de platos

- Polígono

- prueba de participación

- W3

- zephyrnet