Los chatbots modernos pueden actuar como agentes digitales, proporcionando una nueva vía para brindar servicio al cliente y soporte las 24 horas, los 7 días de la semana en muchas industrias. Su popularidad se debe a la capacidad de responder a las consultas de los clientes en tiempo real y gestionar múltiples consultas simultáneamente en diferentes idiomas. Los chatbots también ofrecen información valiosa basada en datos sobre el comportamiento del cliente y, al mismo tiempo, escalan sin esfuerzo a medida que crece la base de usuarios; por lo tanto, presentan una solución rentable para atraer clientes. Los chatbots utilizan las capacidades avanzadas de lenguaje natural de los modelos de lenguaje grandes (LLM) para responder a las preguntas de los clientes. Pueden comprender el lenguaje conversacional y responder con naturalidad. Sin embargo, los chatbots que simplemente responden preguntas básicas tienen una utilidad limitada. Para convertirse en asesores confiables, los chatbots deben brindar respuestas bien pensadas y personalizadas.

Una forma de permitir conversaciones más contextuales es vincular el chatbot a bases de conocimiento y sistemas de información internos. La integración de datos empresariales propietarios de bases de conocimiento internas permite a los chatbots contextualizar sus respuestas a las necesidades e intereses individuales de cada usuario. Por ejemplo, un chatbot podría sugerir productos que coincidan con las preferencias de un comprador y con compras anteriores, explicar detalles en un lenguaje adaptado al nivel de experiencia del usuario o brindar soporte a la cuenta accediendo a los registros específicos del cliente. La capacidad de incorporar información de manera inteligente, comprender el lenguaje natural y brindar respuestas personalizadas en un flujo conversacional permite a los chatbots brindar valor comercial real en diversos casos de uso.

El patrón arquitectónico popular de Recuperación Generación Aumentada (RAG) se utiliza a menudo para aumentar el contexto de las consultas y las respuestas de los usuarios. RAG combina las capacidades de los LLM con la base en hechos y el conocimiento del mundo real que proviene de la recuperación de textos y pasajes relevantes de un corpus de datos. Estos textos recuperados se utilizan luego para informar y fundamentar el resultado, reduciendo las alucinaciones y mejorando la relevancia.

En esta publicación, ilustramos cómo mejorar contextualmente un chatbot mediante el uso Bases de conocimiento para Amazon Bedrock, un servicio sin servidor totalmente administrado. La integración de las bases de conocimiento para Amazon Bedrock permite que nuestro chatbot brinde respuestas más relevantes y personalizadas al vincular las consultas de los usuarios con puntos de datos de información relacionados. Internamente, lecho rocoso del amazonas utiliza incrustaciones almacenadas en una base de datos vectorial para aumentar el contexto de consulta del usuario en tiempo de ejecución y habilitar una solución de arquitectura RAG administrada. Usamos el Cartas de Amazon a los accionistas conjunto de datos para desarrollar esta solución.

Recuperación Generación Aumentada

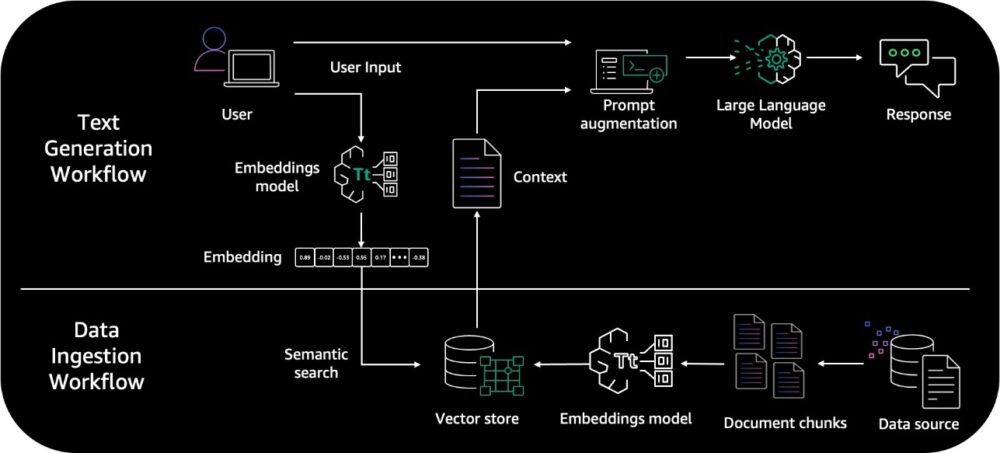

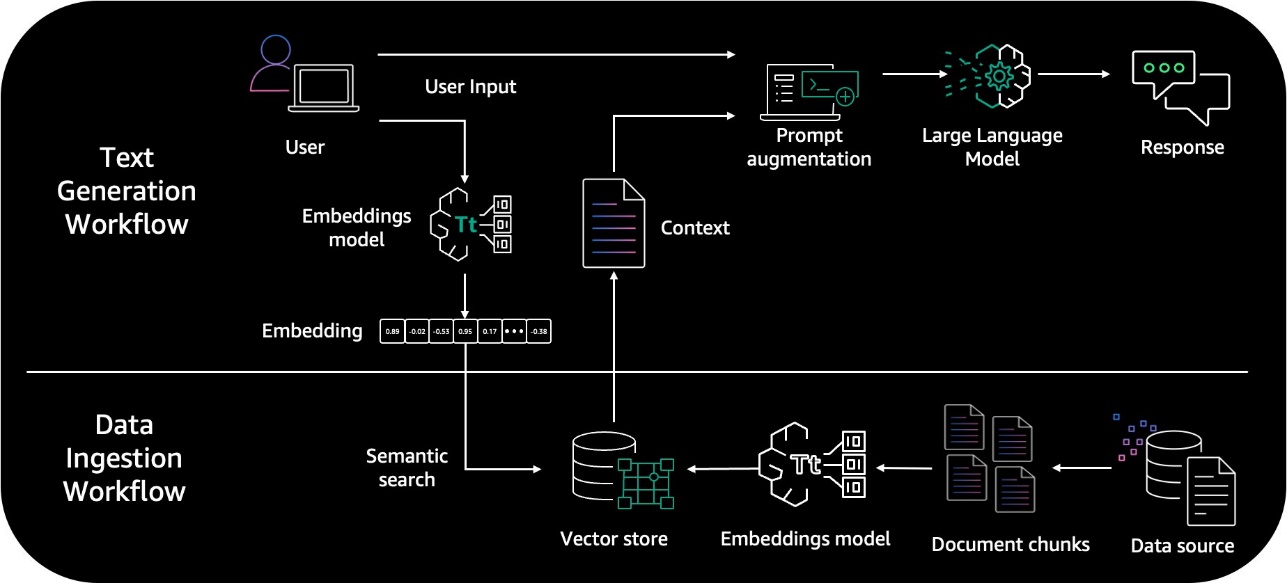

RAG es un enfoque para la generación de lenguaje natural que incorpora la recuperación de información en el proceso de generación. La arquitectura RAG implica dos flujos de trabajo clave: preprocesamiento de datos mediante ingesta y generación de texto utilizando contexto mejorado.

El flujo de trabajo de ingesta de datos utiliza LLM para crear vectores de incrustación que representan el significado semántico de los textos. Las incrustaciones se crean para documentos y preguntas de los usuarios. Las incrustaciones de documentos se dividen en fragmentos y se almacenan como índices en una base de datos vectorial. Luego, el flujo de trabajo de generación de texto toma el vector de incrustación de una pregunta y lo utiliza para recuperar los fragmentos de documentos más similares en función de la similitud del vector. Aumenta las indicaciones con estos fragmentos relevantes para generar una respuesta utilizando el LLM. Para obtener más detalles, consulte la Introducción a la recuperación, generación aumentada, incrustaciones y bases de datos vectoriales sección en Vista previa: conecte modelos básicos a las fuentes de datos de su empresa con agentes para Amazon Bedrock.

El siguiente diagrama ilustra la arquitectura RAG de alto nivel.

Aunque la arquitectura RAG tiene muchas ventajas, involucra múltiples componentes, incluida una base de datos, un mecanismo de recuperación, un indicador y un modelo generativo. La gestión de estas partes interdependientes puede introducir complejidades en el desarrollo y la implementación del sistema. La integración de la recuperación y la generación también requiere esfuerzos de ingeniería y recursos computacionales adicionales. Algunas bibliotecas de código abierto proporcionan contenedores para reducir esta sobrecarga; sin embargo, los cambios en las bibliotecas pueden introducir errores y agregar una sobrecarga adicional de control de versiones. Incluso con las bibliotecas de código abierto, se requiere un esfuerzo significativo para escribir código, determinar el tamaño de fragmento óptimo, generar incrustaciones y más. Este trabajo de configuración por sí solo puede llevar semanas dependiendo del volumen de datos.

Por lo tanto, una solución administrada que maneje estas tareas indiferenciadas podría agilizar y acelerar el proceso de implementación y administración de aplicaciones RAG.

Bases de conocimiento para Amazon Bedrock

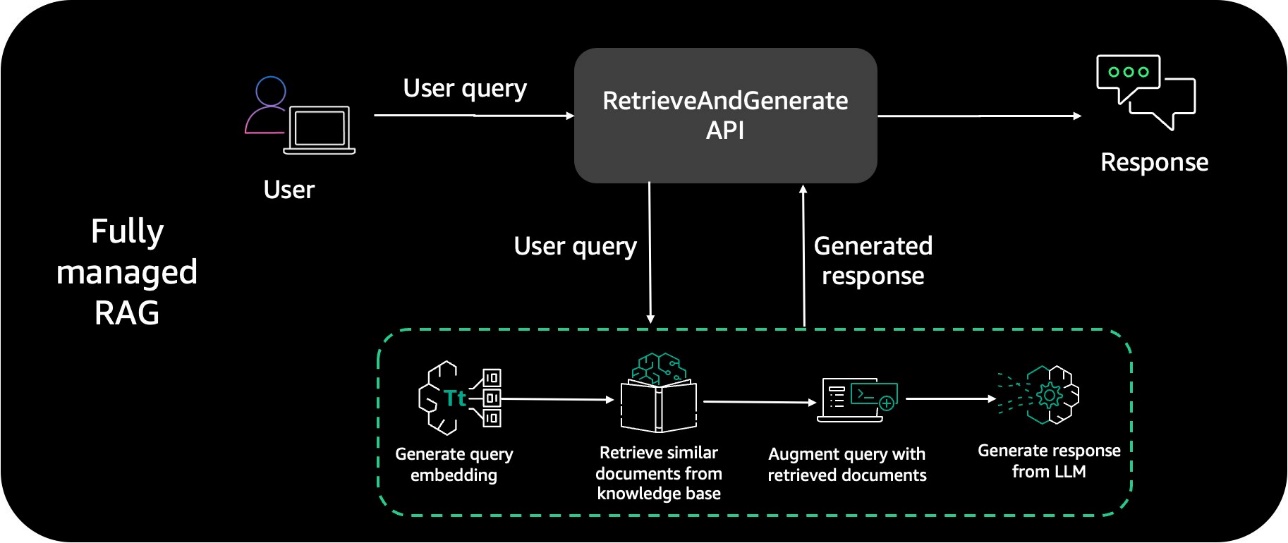

Knowledge Bases para Amazon Bedrock es una opción sin servidor para crear potentes sistemas de IA conversacional utilizando RAG. Ofrece flujos de trabajo de generación de texto e ingesta de datos totalmente administrados.

Para la ingesta de datos, se encarga de crear, almacenar, administrar y actualizar automáticamente las incrustaciones de texto de datos de documentos en la base de datos vectorial. Divide los documentos en partes manejables para una recuperación eficiente. Luego, los fragmentos se convierten en incrustaciones y se escriben en un índice vectorial, al tiempo que le permiten ver los documentos fuente al responder una pregunta.

Para la generación de texto, Amazon Bedrock proporciona la Recuperar y generar API para crear incrustaciones de consultas de usuarios y recupera fragmentos relevantes de la base de datos vectorial para generar respuestas precisas. También admite la atribución de origen y la memoria a corto plazo necesarias para las aplicaciones RAG.

Esto le permite centrarse en sus aplicaciones empresariales principales y elimina el trabajo pesado indiferenciado.

Resumen de la solución

La solución presentada en esta publicación utiliza un chatbot creado usando un iluminado aplicación e incluye los siguientes servicios de AWS:

El siguiente diagrama es un patrón de arquitectura de solución común que puede utilizar para integrar cualquier aplicación de chatbot a las bases de conocimiento de Amazon Bedrock.

Esta arquitectura incluye los siguientes pasos:

- Un usuario interactúa con la interfaz del chatbot Streamlit y envía una consulta en lenguaje natural

- Esto activa una función Lambda, que invoca las bases de conocimiento.

RetrieveAndGenerateAPI. Internamente, Bases de Conocimiento utiliza un Titán Amazonas incrusta el modelo y convierte la consulta del usuario en un vector y encuentra fragmentos que son semánticamente similares a la consulta del usuario. El mensaje del usuario se aumenta con los fragmentos que se recuperan de la base de conocimientos. Luego, el mensaje junto con el contexto adicional se envía a un LLM para generar una respuesta. En esta solución utilizamos Antrópico Claude instantáneo como nuestro LLM para generar respuestas de los usuarios utilizando contexto adicional. Tenga en cuenta que esta solución es compatible con las regiones donde Anthropic Claude en Amazon Bedrock está Hoy Disponibles. - Se envía una respuesta contextualmente relevante a la aplicación del chatbot y al usuario.

Requisitos previos

Los usuarios de Amazon Bedrock deben solicitar acceso a los modelos de cimientos antes de que estén disponibles para su uso. Esta es una acción única y lleva menos de un minuto. Para esta solución, deberá habilitar el acceso al modelo Titan Embeddings G1 – Text y Claude Instant – v1.2 en Amazon Bedrock. Para obtener más información, consulte Modelo de acceso.

Clonar el repositorio de GitHub

La solución presentada en esta publicación está disponible en el siguiente Repositorio GitHub. Debe clonar el repositorio de GitHub en su máquina local. Abra una ventana de terminal y ejecute el siguiente comando. Tenga en cuenta que este es un único comando de clonación de git.

Cargue su conjunto de datos de conocimiento en Amazon S3

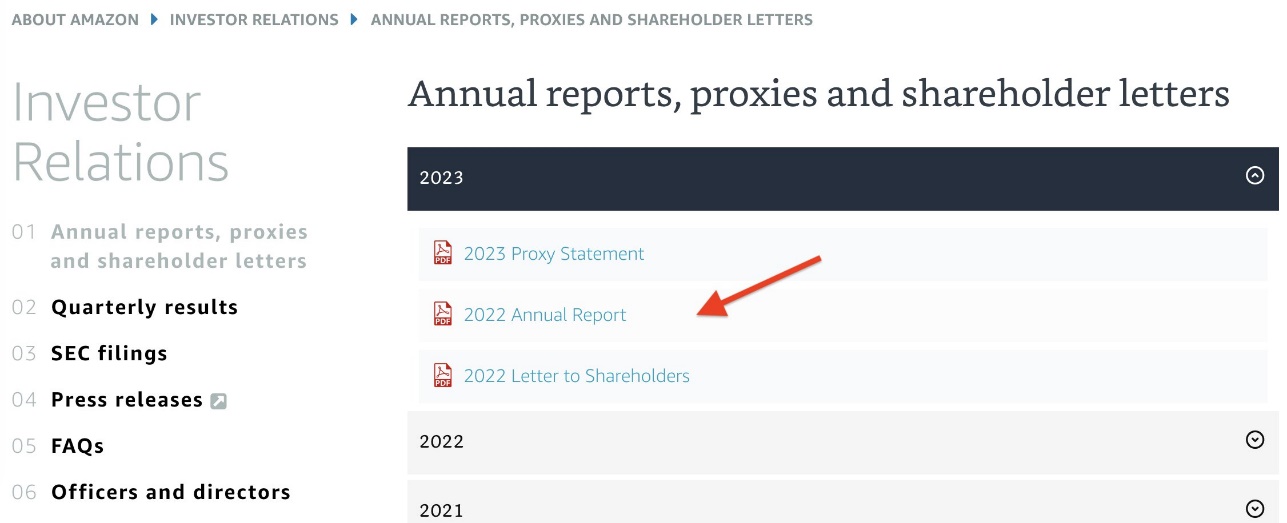

Descargamos el conjunto de datos para nuestra base de conocimientos y lo cargamos en un depósito S3. Este conjunto de datos alimentará y potenciará la base de conocimientos. Complete los siguientes pasos:

- Navegue hasta la Informes anuales, delegaciones y cartas a los accionistas repositorio de datos y descargar las cartas a los accionistas de Amazon de los últimos años.

- En la consola de Amazon S3, elija cubos en el panel de navegación.

- Elige Crear cubeta.

- Nombra el cubo

knowledgebase-<your-awsaccount-number>. - Deje todas las demás configuraciones del depósito como predeterminadas y elija Crear.

- Navegue hasta la

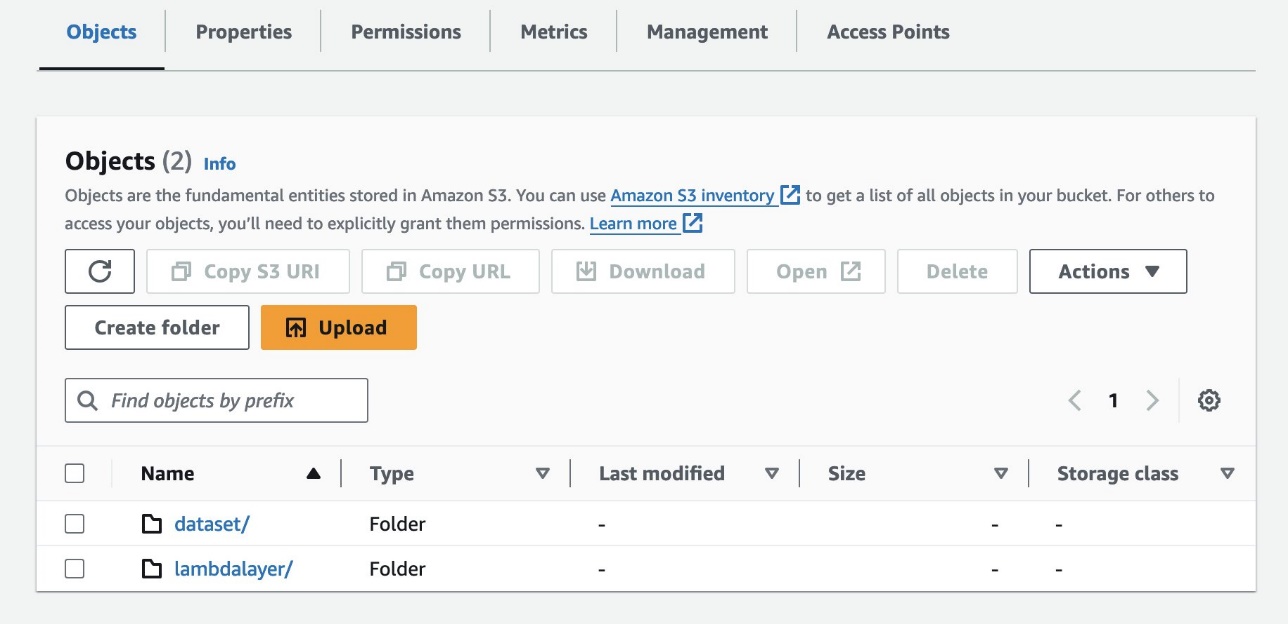

knowledgebase-<your-awsaccount-number>Cubeta. - Elige crear una carpeta y asígnele el nombre conjunto de datos.

- Deje todas las demás configuraciones de carpetas como predeterminadas y elija Crear.

- Vuelve al inicio del depósito y elige crear una carpeta para crear una nueva carpeta y ponerle un nombre

lambdalayer. - Deje todas las demás configuraciones como predeterminadas y elija Crear.

- Navegue hasta la

datasetcarpeta. - Cargue los archivos del conjunto de datos de informes anuales, poderes y cartas a los accionistas que descargó anteriormente en este depósito y elija Subir.

- Navegue hasta la

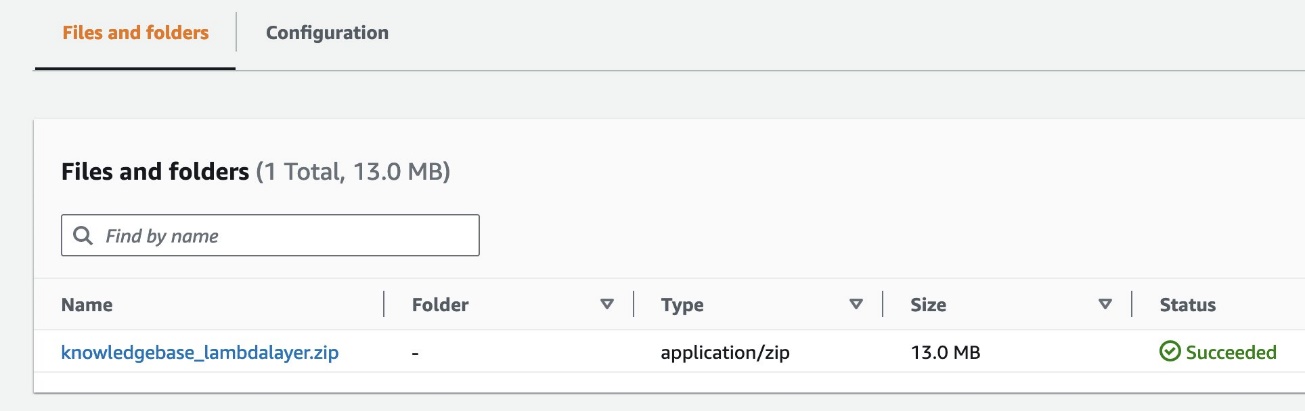

lambdalayercarpeta. - Cargar la

knowledgebase-lambdalayer.ziparchivo disponible bajo el/lambda/layercarpeta en el repositorio de GitHub que clonaste anteriormente y elige Subir. Utilizará este código de capa Lambda más adelante para crear la función Lambda.

Crea una base de conocimiento

En este paso, creamos una base de conocimientos utilizando el conjunto de datos de cartas a los accionistas de Amazon que cargamos en nuestro depósito S3 en el paso anterior.

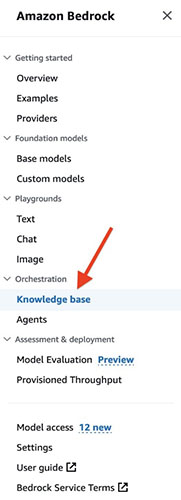

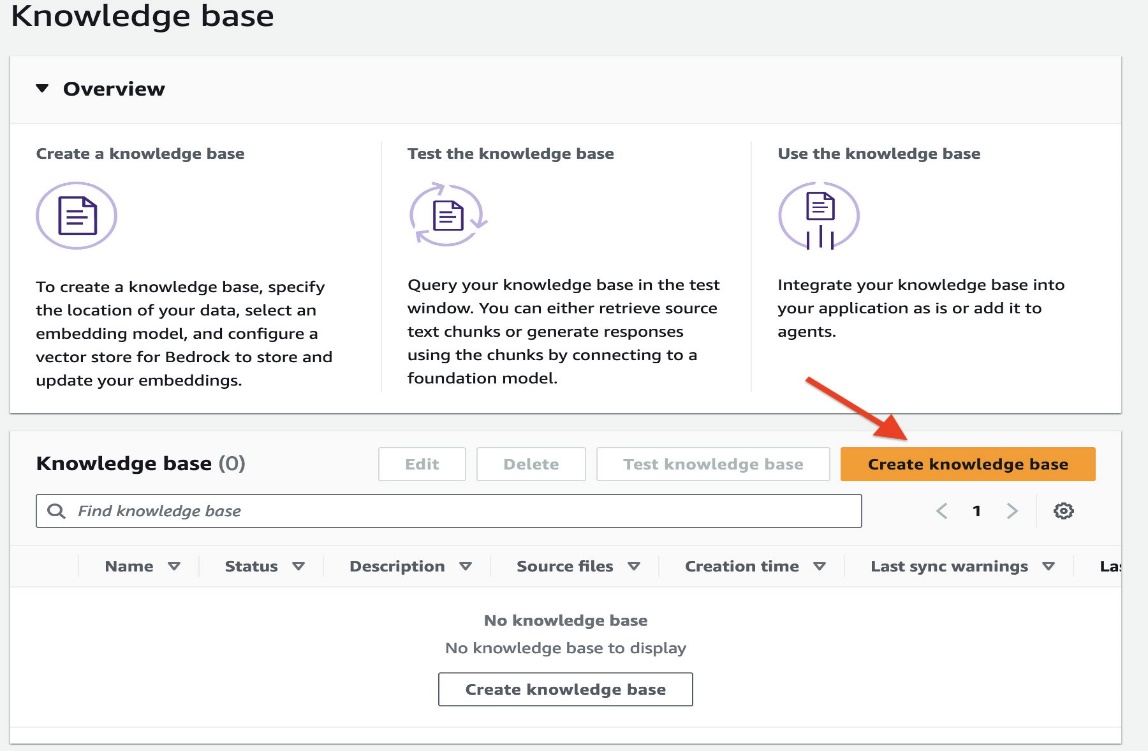

- En la consola de Amazon Bedrock, en Orquestación en el panel de navegación, elija Base de conocimiento.

- Elige Crear base de conocimientos.

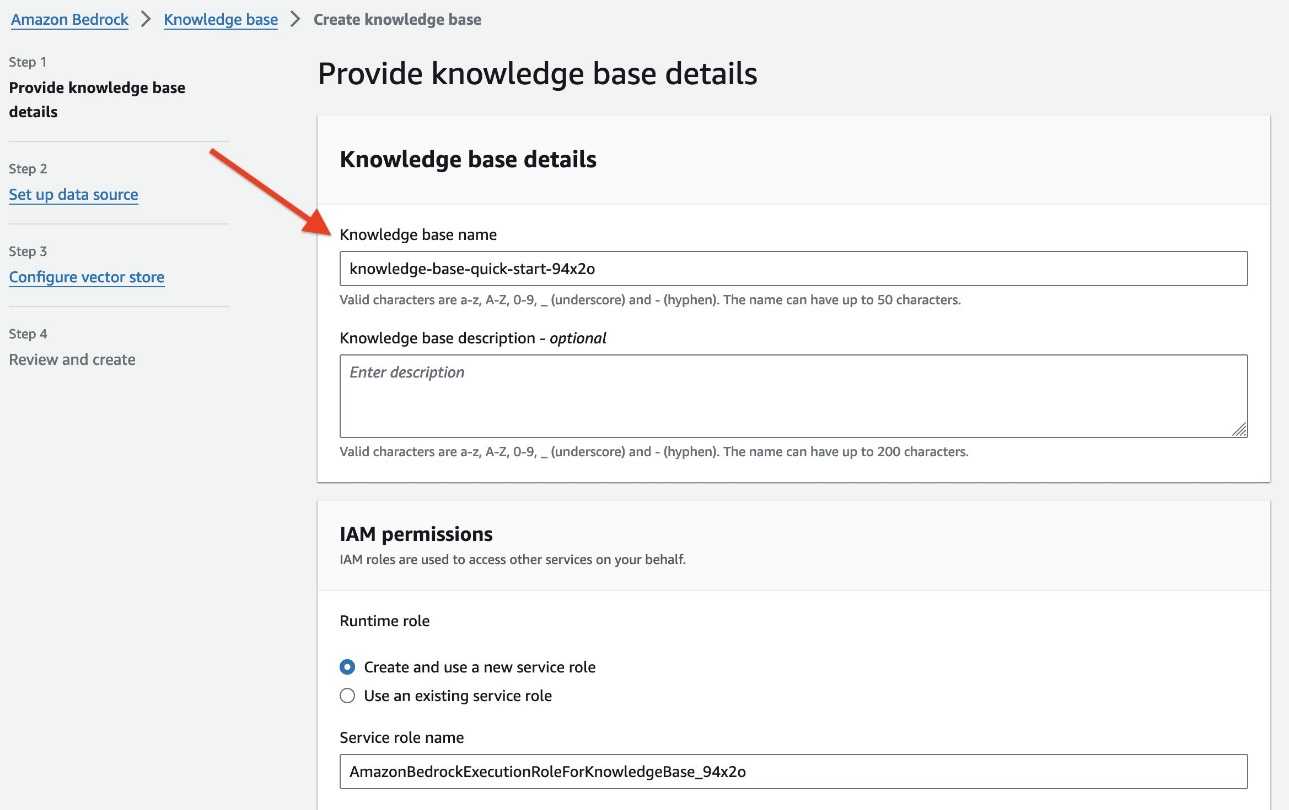

- En Detalles de la base de conocimientos , ingrese un nombre y una descripción opcional.

- En permisos de gestión de identidades y accesos sección, seleccionar Crear y utilizar un nuevo rol de servicio e ingrese un nombre para el rol.

- Agregue etiquetas según sea necesario.

- Elige Siguiente.

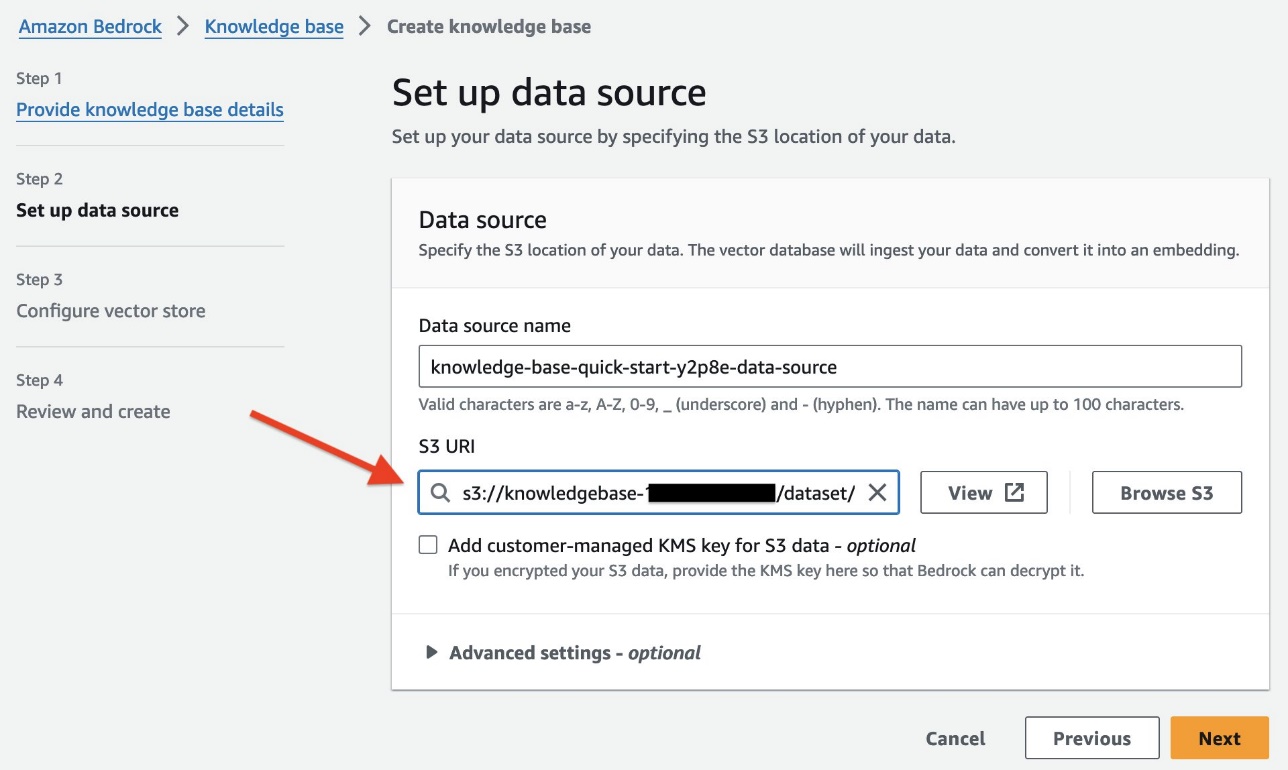

- Abandonar Nombre de fuente de datos como nombre predeterminado.

- URI de S3, escoger Examinar S3 para elegir el cubo S3

knowledgebase-<your-account-number>/dataset/Debe señalar la carpeta del depósito y del conjunto de datos que creó en los pasos anteriores. - En Configuración avanzada sección, deje los valores predeterminados (si lo desea, puede cambiar la estrategia de fragmentación predeterminada y especificar el tamaño del fragmento y la superposición en porcentaje).

- Elige Siguiente.

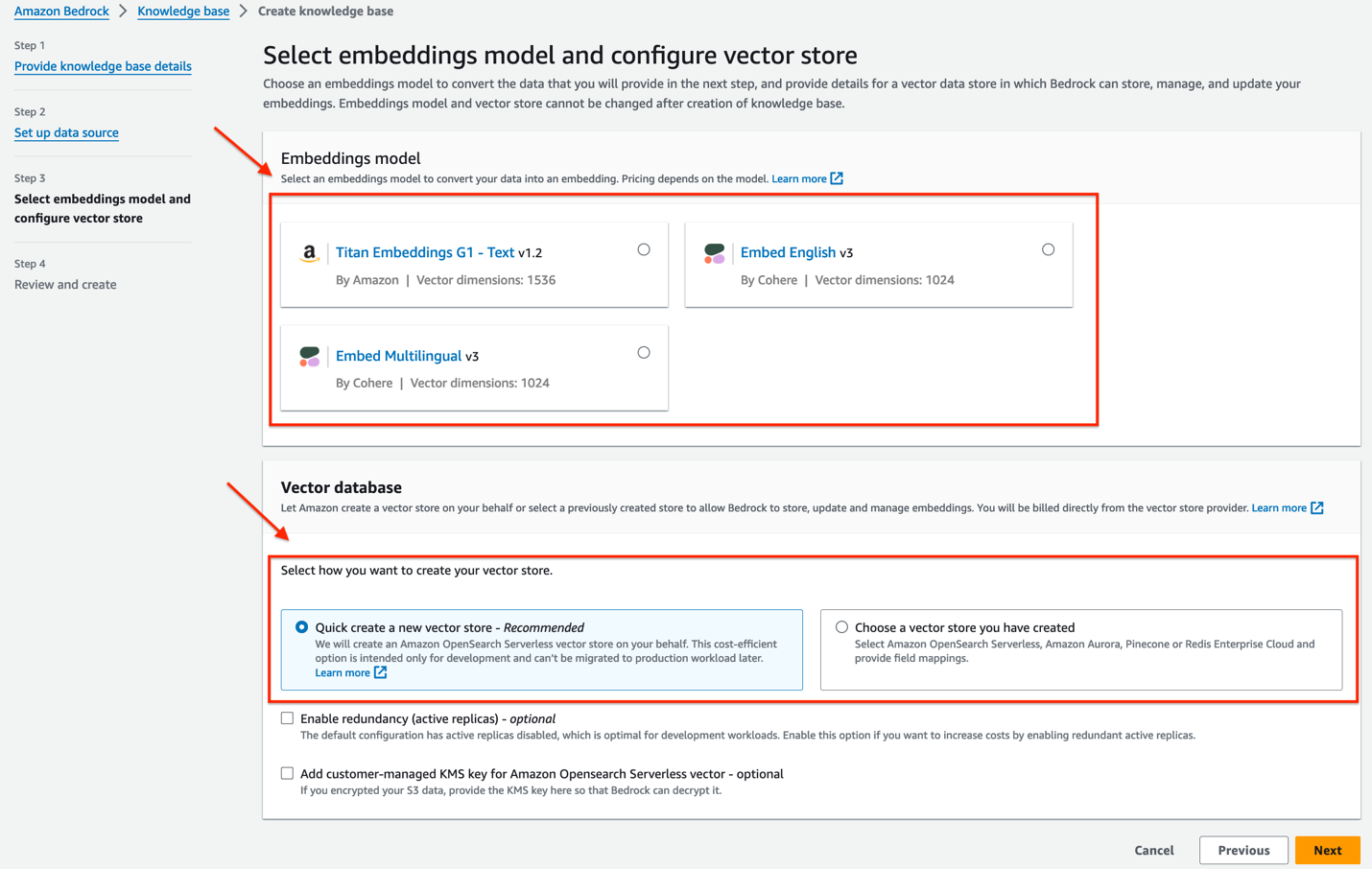

- Modelo de incrustaciones, seleccione Titan Embedding G1 – Texto.

- Base de datos vectorial, puedes seleccionar Crea rápidamente una nueva tienda de vectores or Elija una tienda de vectores que haya creado. Tenga en cuenta que, para utilizar el almacén de vectores de su elección, necesita tener un almacén de vectores preconfigurado para su uso. Actualmente admitimos cuatro tipos de motores vectoriales: el motor vectorial para Amazon OpenSearch Serverless, Amazon Aurora, Pinecone y Redis Enterprise Cloud. Para esta publicación, seleccionamos Creación rápida de un nuevo almacén de vectores, que de forma predeterminada crea un nuevo almacén de vectores OpenSearch Serverless en su cuenta.

- Elige Siguiente.

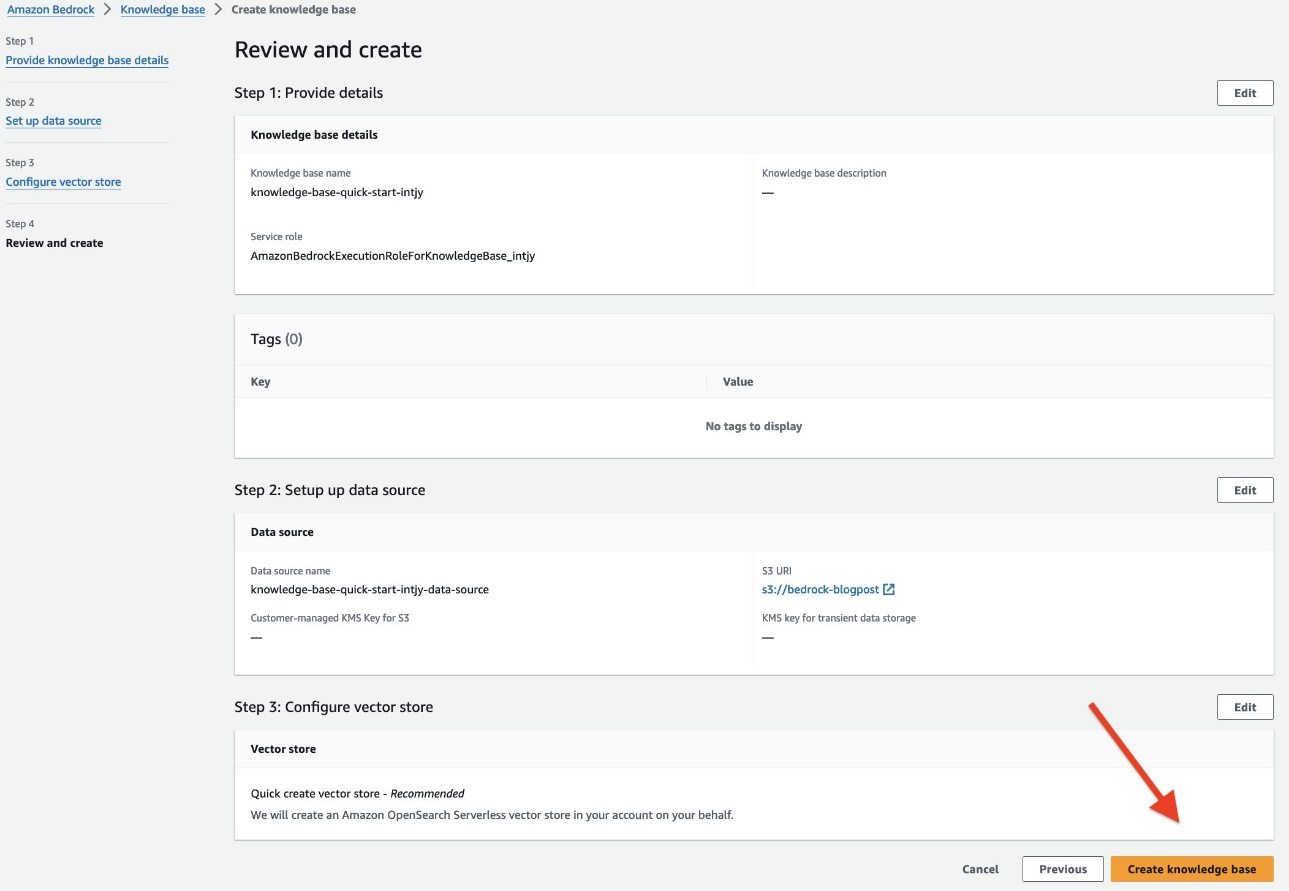

- En Revisar y crear página, revisar toda la información, o elegir Previo para modificar cualquier opción.

- Elige Crear base de conocimientos.

Tenga en cuenta que comienza el proceso de creación de la base de conocimientos y el estado es En curso. Le llevará unos minutos crear el almacén de vectores y la base de conocimientos. No salga de la página; de lo contrario, la creación fallará.

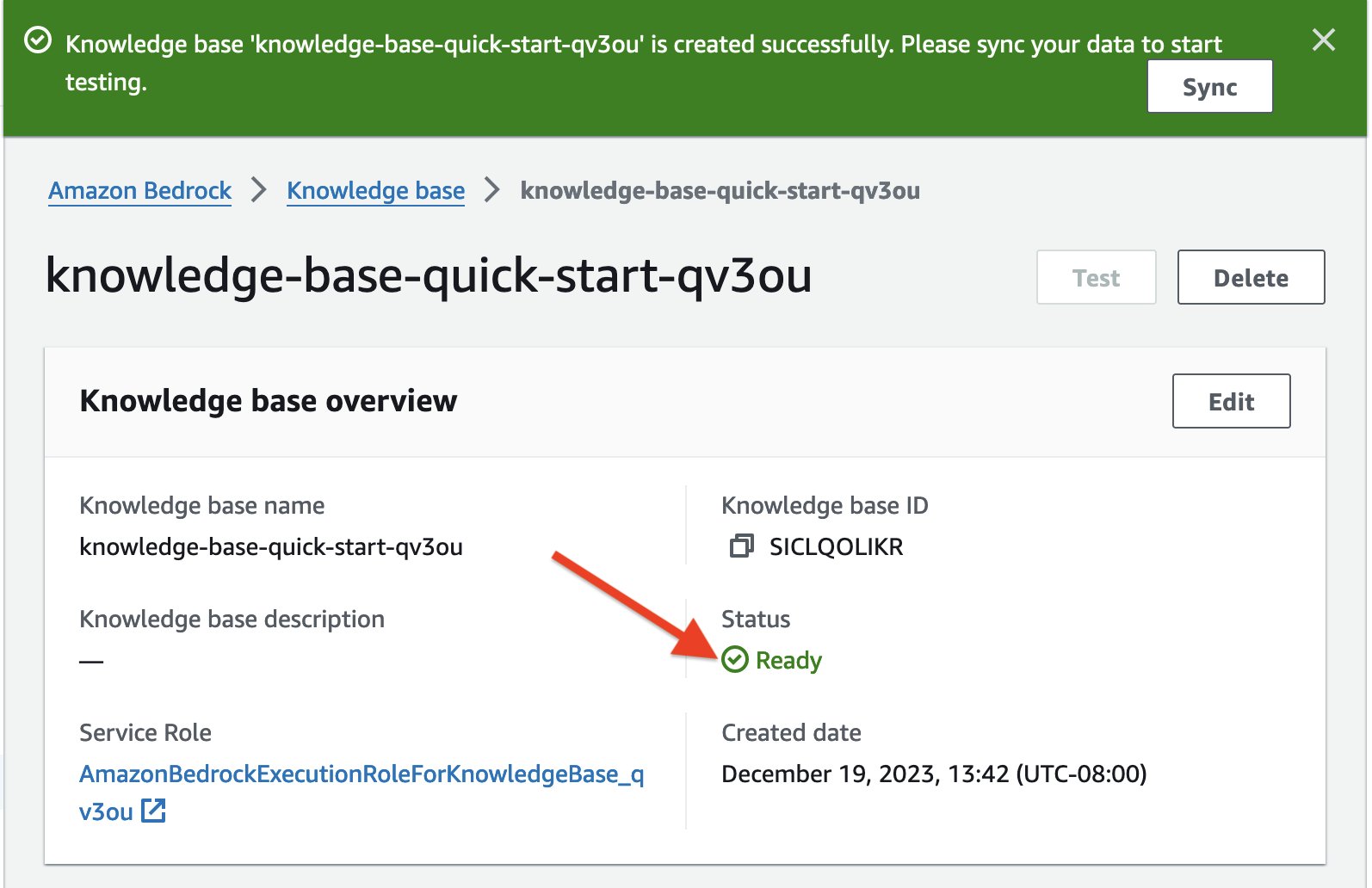

Tenga en cuenta que comienza el proceso de creación de la base de conocimientos y el estado es En curso. Le llevará unos minutos crear el almacén de vectores y la base de conocimientos. No salga de la página; de lo contrario, la creación fallará. - Cuando el estado de la base de conocimientos está en el

Readyestado, anote el ID de la base de conocimientos. Lo utilizará en los siguientes pasos para configurar la función Lambda.

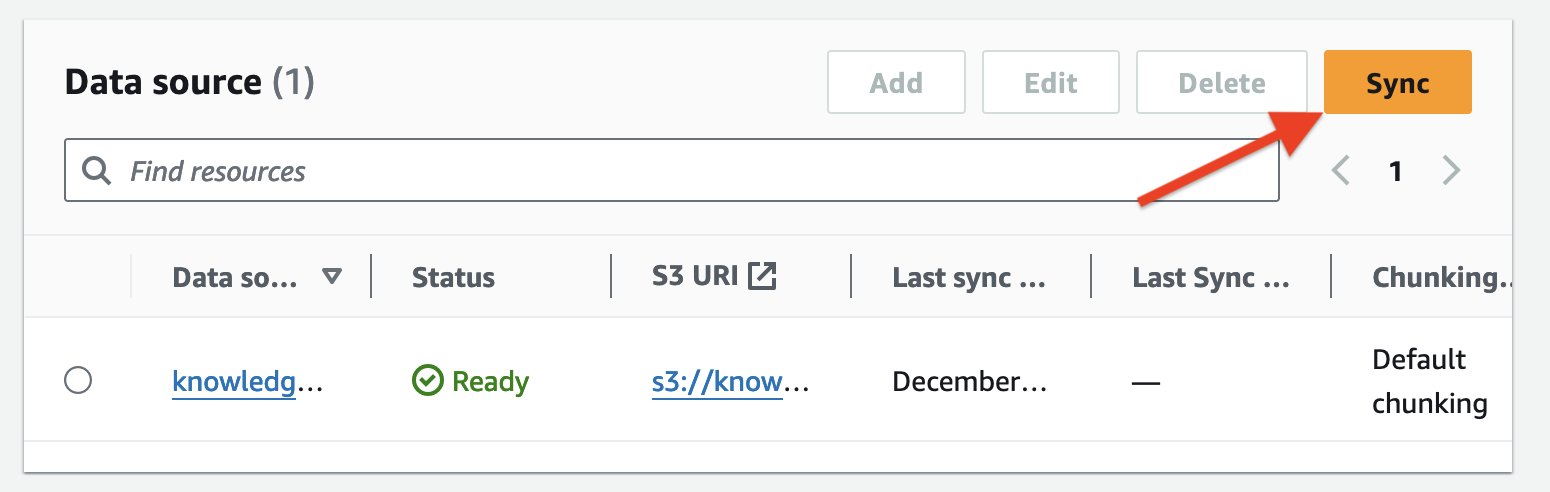

- Ahora que la base de conocimientos está lista, debemos sincronizar los datos de las cartas de los accionistas de Amazon con ella. En el Fuente de datos sección de la página de detalles de la base de conocimientos, elija Sincronizar para desencadenar el proceso de ingesta de datos desde el depósito de S3 a la base de conocimientos.

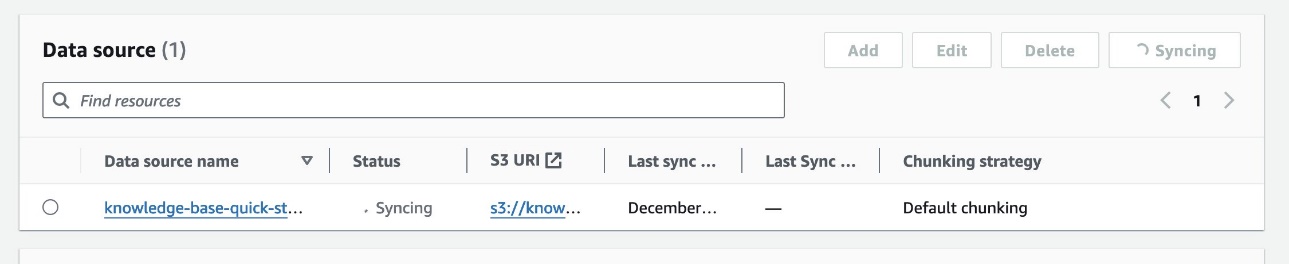

Este proceso de sincronización divide los archivos del documento en fragmentos más pequeños del tamaño de fragmento especificado anteriormente, genera incrustaciones de vectores utilizando el modelo de incrustación de texto seleccionado y los almacena en el almacén de vectores administrado por Knowledge Bases for Amazon Bedrock.

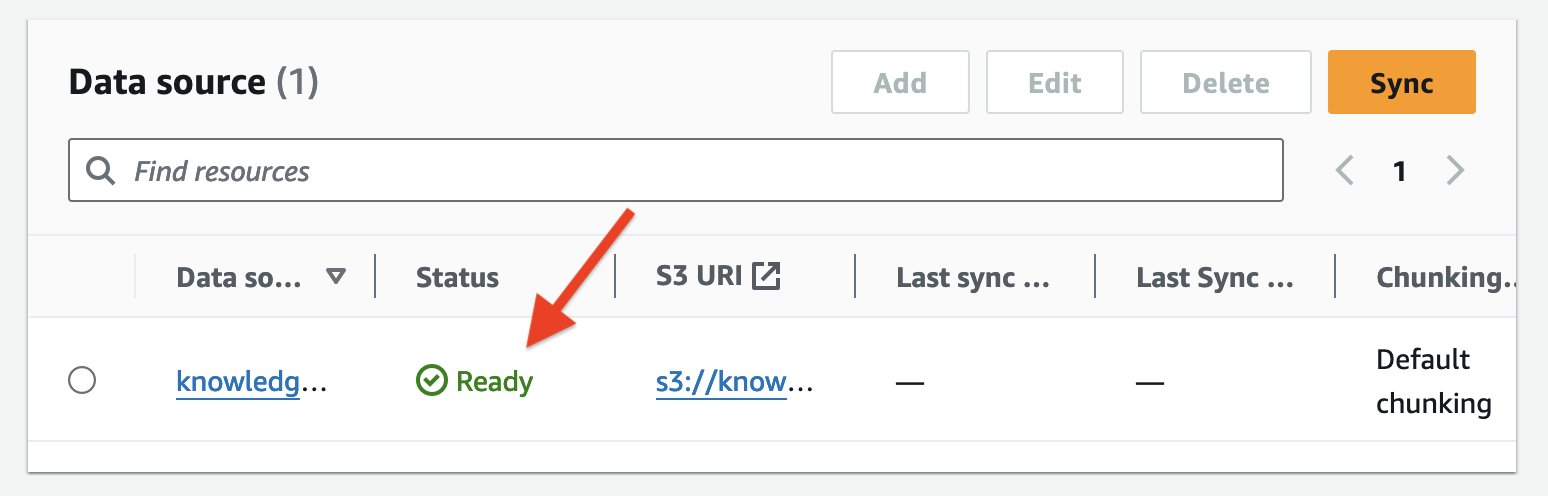

Cuando se complete la sincronización del conjunto de datos, el estado de la fuente de datos cambiará al Ready estado. Tenga en cuenta que, si agrega documentos adicionales en la carpeta de datos de S3, deberá volver a sincronizar la base de conocimientos.

Felicitaciones, su base de conocimientos está lista.

Tenga en cuenta que también puede utilizar las bases de conocimientos para las API del servicio Amazon Bedrock y la Interfaz de línea de comandos de AWS (AWS CLI) para crear mediante programación una base de conocimientos. Deberá ejecutar varias secciones del cuaderno de Jupyter proporcionado en la /notebook carpeta en el repositorio de GitHub.

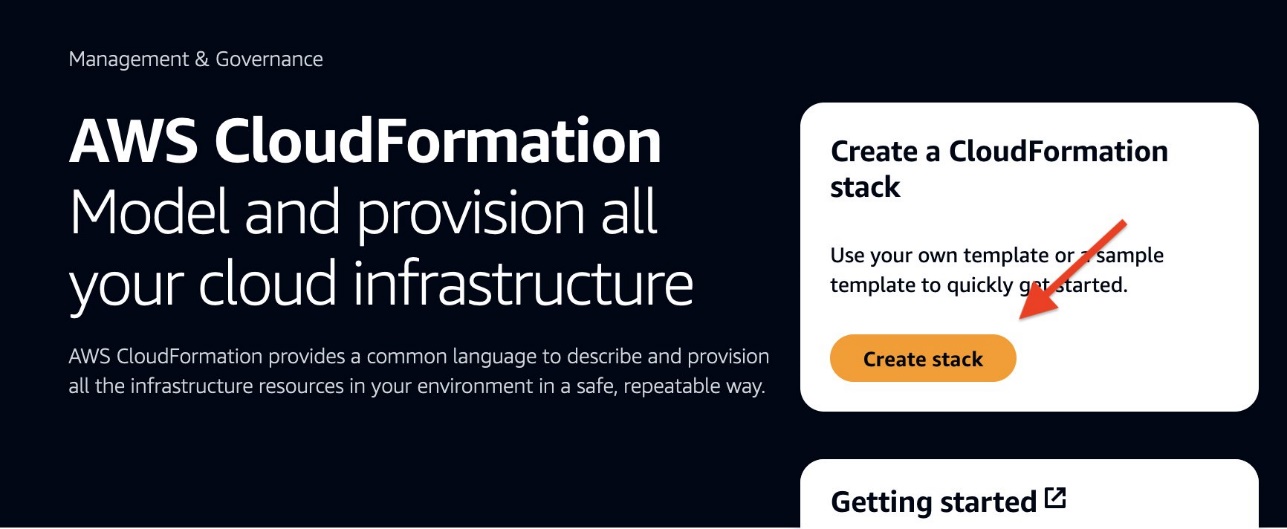

Crear una función Lambda

Esta función Lambda se implementa mediante un Formación en la nube de AWS plantilla disponible en el repositorio de GitHub en el /cfn carpeta. La plantilla requiere dos parámetros: el nombre del depósito S3 y el ID de la base de conocimientos.

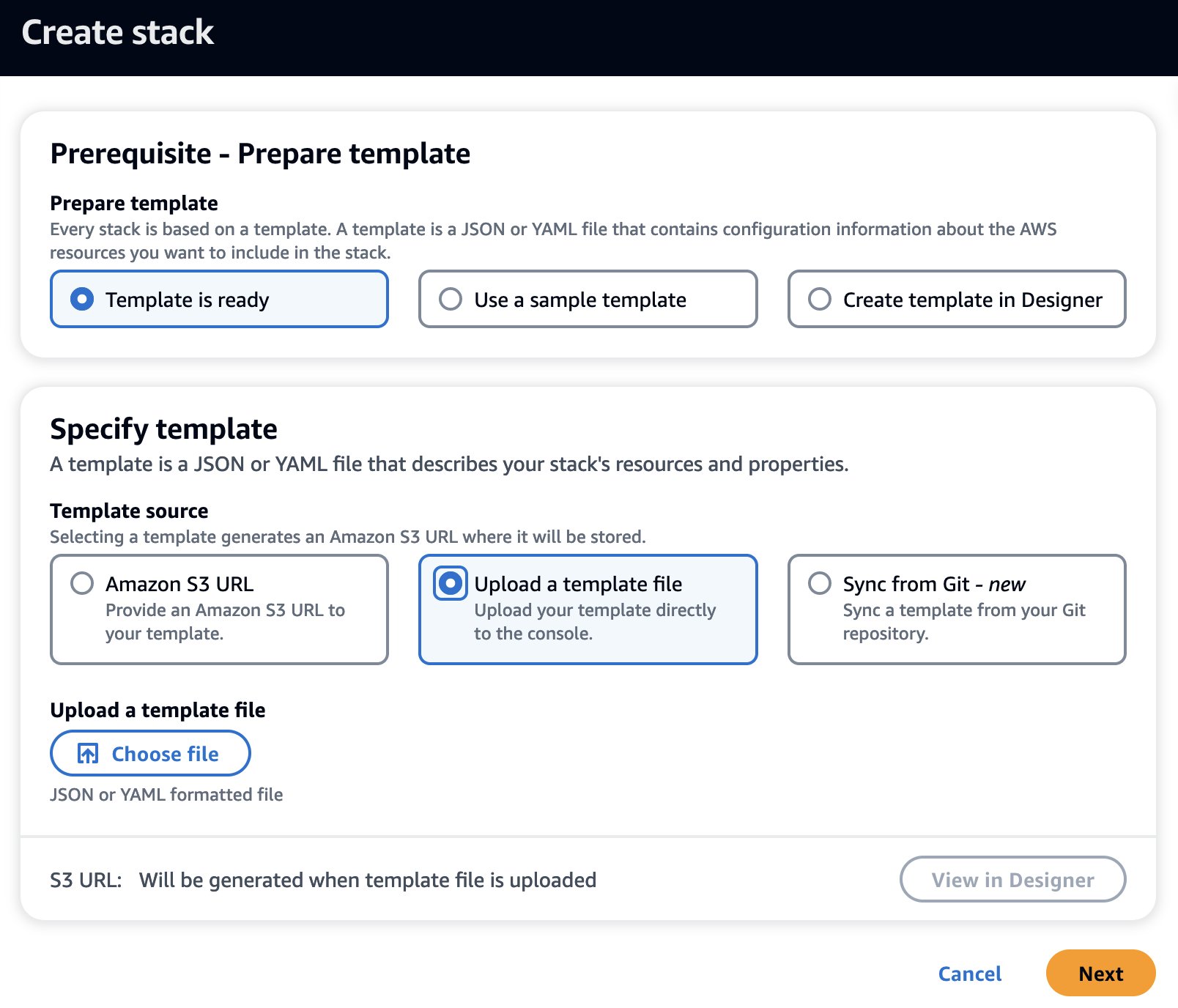

- En la página de inicio del servicio AWS CloudFormation, elija Crear pila para crear una nueva pila.

- Seleccione La plantilla está lista para Preparar plantilla.

- Seleccione Sube el archivo de plantilla para Fuente de la plantilla.

- Elige Elija el archivo, navegue hasta el repositorio de GitHub que clonó anteriormente y elija el archivo .yaml debajo del

/cfncarpeta. - Elige Siguiente.

- Nombre de pila, ingresa un nombre.

- En parámetros , ingrese el ID de la base de conocimientos y el nombre del depósito S3 que anotó anteriormente.

- Elige Siguiente.

- Deje todas las opciones predeterminadas como están, elija Siguiente, y elige Enviar.

- Verifique que la plantilla de CloudFormation se haya ejecutado correctamente y que no haya errores.

Felicitaciones, ha creado correctamente una función Lambda, roles relacionados y políticas.

Pruebe la aplicación de chatbot contextual

Para probar su aplicación de chatbot, complete los siguientes pasos:

- Abra una nueva terminal o una ventana de línea de comando en su máquina.

- Ejecute el siguiente comando para instalar el AWS SDK para Python (Boto3). Boto3 simplifica la integración de una aplicación, biblioteca o script de Python con los servicios de AWS.

- Ejecute el siguiente comando para instalar y configurar un entorno de desarrollo local de Python para ejecutar la aplicación Streamlit:

- Navegue hasta la

/streamlitcarpeta en la carpeta del repositorio de GitHub que clonaste anteriormente. - Ejecute el siguiente comando para crear una instancia de la aplicación chatbot:

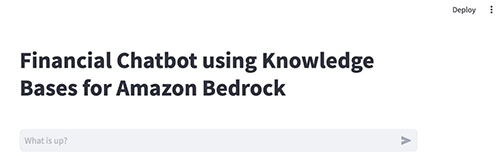

Esto debería abrir una aplicación de chat basada en web impulsada por Streamlit en su navegador web predeterminado.

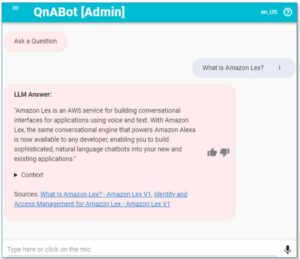

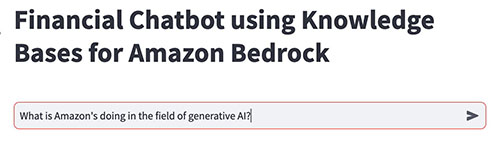

- Utilice esta aplicación de chatbot Streamlit para publicar preguntas en lenguaje natural para iniciar conversaciones impulsadas por Knowledge Bases for Amazon Bedrock.

Cuando envía un mensaje, la aplicación Streamlit activa la función Lambda, que invoca las bases de conocimiento RetrieveAndGenerate API para buscar y generar respuestas.

La siguiente tabla incluye algunos ejemplos de preguntas y respuestas de la base de conocimientos relacionadas. Pruebe algunas de estas preguntas utilizando indicaciones.

| Preguntas | respuestas |

| ¿Qué está haciendo Amazon en el campo de la IA generativa? | Amazon ha estado trabajando en sus propios modelos de lenguaje grandes (LLM) para IA generativa y cree que transformarán y mejorarán la experiencia de cada cliente. Planean continuar invirtiendo sustancialmente en estos modelos en todas sus experiencias de consumidores, vendedores, marcas y creadores. |

| ¿Cuáles son los ingresos interanuales de AWS en 2022? | Los ingresos de AWS crecieron un 29 % año tras año en 2022 sobre una base de ingresos de 62 mil millones de dólares. |

| ¿Cuántos días ha pedido Amazon a los empleados que vengan a trabajar a la oficina? | Amazon ha pedido a los empleados corporativos que regresen a la oficina al menos tres días a la semana a partir de mayo de 2022. |

| ¿En qué porcentaje crecieron los ingresos de AWS año tras año en 2022? | AWS tuvo unos ingresos interanuales ("YoY") del 29% en 2022. |

| En comparación con los procesadores Graviton2, ¿qué mejora de rendimiento ofrecieron los chips Graviton3 según el pasaje? | En 2022, AWS entregó sus chips Graviton3, que ofrecen un rendimiento un 25 % mejor que los procesadores Graviton2. |

| ¿Cuál fue el primer chip de inferencia lanzado por AWS según el pasaje? | AWS lanzó sus primeros chips de inferencia (“Inferentia”) en 2019 y ha ahorrado a empresas como Amazon más de cien millones de dólares en gastos de capital. |

| Según el contexto, ¿en qué año los ingresos anuales de Amazon aumentaron de 245 mil millones de dólares a 434 mil millones de dólares? | Los ingresos anuales de Amazon aumentaron de 245 mil millones de dólares en 2019 a 434 mil millones de dólares en 2022. |

| Cuéntame nuevamente ¿cuáles fueron los ingresos en 2019? | Los ingresos de Amazon en 2019 fueron de 245 mil millones de dólares. |

| y, 2021? | Los ingresos de Amazon en 2021 fueron de 469.8 millones de dólares, un aumento del 22% con respecto a 2020. |

| Y recuérdenme nuevamente ¿cuándo se lanzó el primer chip de inferencia? | El primer chip de inferencia de Amazon fue Inferentia, que se lanzó en 2019. |

Durante la primera llamada a la función Lambda, el RetrieveAndGenerate API devuelve un sessionId, que luego pasa por la aplicación Streamlit junto con el mensaje de usuario posterior como entrada a la API RetrieveAndGenerate para continuar la conversación en la misma sesión. El RetrieveAndGenerate API gestiona la memoria a corto plazo y utiliza el historial de chat siempre que se pase el mismo sessionId como entrada en las sucesivas llamadas.

Felicitaciones, ha creado y probado con éxito una aplicación de chatbot utilizando Knowledge Bases para Amazon Bedrock.

Limpiar

Si no se eliminan recursos como el depósito S3, la colección OpenSearch Serverless y la base de conocimientos, se generarán cargos. Para limpiar estos recursos, elimine la pila de CloudFormation, elimine el depósito de S3 (incluidas las carpetas de documentos y los archivos almacenados en ese depósito), elimine la colección OpenSearch Serverless, elimine la base de conocimientos y elimine las funciones, políticas y permisos que creado anteriormente.

Conclusión

En esta publicación, brindamos una descripción general de los chatbots contextuales y explicamos por qué son importantes. Describimos las complejidades involucradas en los flujos de trabajo de ingesta de datos y generación de texto para una arquitectura RAG. Luego presentamos cómo Knowledge Bases for Amazon Bedrock crea un sistema RAG sin servidor totalmente administrado, que incluye un almacén de vectores. Finalmente, proporcionamos una arquitectura de solución y un código de muestra en un Repositorio GitHub para recuperar y generar respuestas contextuales para una aplicación de chatbot utilizando una base de conocimientos.

Al explicar el valor de los chatbots contextuales, los desafíos de los sistemas RAG y cómo las bases de conocimiento para Amazon Bedrock abordan esos desafíos, esta publicación tuvo como objetivo mostrar cómo Amazon Bedrock le permite crear aplicaciones sofisticadas de IA conversacional con un mínimo esfuerzo.

Para obtener más información, consulte la sección de Guía para desarrolladores de Amazon Bedrock y API de la base de conocimientos.

Acerca de los autores

Manish Chugh es arquitecto principal de soluciones en AWS con sede en San Francisco, CA. Se especializa en aprendizaje automático e inteligencia artificial generativa. Trabaja con organizaciones que van desde grandes empresas hasta nuevas empresas en sus etapas iniciales en problemas relacionados con el aprendizaje automático. Su función consiste en ayudar a estas organizaciones a diseñar cargas de trabajo escalables, seguras y rentables en AWS. Presenta regularmente en conferencias de AWS y otros eventos de socios. Fuera del trabajo, le gusta caminar por los senderos de East Bay, andar en bicicleta y ver (y jugar) cricket.

Manish Chugh es arquitecto principal de soluciones en AWS con sede en San Francisco, CA. Se especializa en aprendizaje automático e inteligencia artificial generativa. Trabaja con organizaciones que van desde grandes empresas hasta nuevas empresas en sus etapas iniciales en problemas relacionados con el aprendizaje automático. Su función consiste en ayudar a estas organizaciones a diseñar cargas de trabajo escalables, seguras y rentables en AWS. Presenta regularmente en conferencias de AWS y otros eventos de socios. Fuera del trabajo, le gusta caminar por los senderos de East Bay, andar en bicicleta y ver (y jugar) cricket.

Mani Januja es líder tecnológica: especialistas en IA generativa, autora del libro Applied Machine Learning and High Performance Computing on AWS y miembro de la junta directiva de la Junta Directiva de la Women in Manufacturing Education Foundation. Lidera proyectos de aprendizaje automático en diversos ámbitos, como la visión por computadora, el procesamiento del lenguaje natural y la inteligencia artificial generativa. Habla en conferencias internas y externas como AWS re:Invent, Women in Manufacturing West, seminarios web de YouTube y GHC 23. En su tiempo libre, le gusta salir a correr largas distancias por la playa.

Mani Januja es líder tecnológica: especialistas en IA generativa, autora del libro Applied Machine Learning and High Performance Computing on AWS y miembro de la junta directiva de la Junta Directiva de la Women in Manufacturing Education Foundation. Lidera proyectos de aprendizaje automático en diversos ámbitos, como la visión por computadora, el procesamiento del lenguaje natural y la inteligencia artificial generativa. Habla en conferencias internas y externas como AWS re:Invent, Women in Manufacturing West, seminarios web de YouTube y GHC 23. En su tiempo libre, le gusta salir a correr largas distancias por la playa.

Pallavi Nargund es arquitecto principal de soluciones en AWS. En su función como facilitadora de tecnología en la nube, trabaja con los clientes para comprender sus objetivos y desafíos y brindarles orientación prescriptiva para lograr su objetivo con las ofertas de AWS. Le apasionan las mujeres en la tecnología y es miembro principal de Women in AI/ML en Amazon. Habla en conferencias internas y externas como AWS re:Invent, AWS Summits y seminarios web. Fuera del trabajo, le gusta el voluntariado, la jardinería, el ciclismo y el senderismo.

Pallavi Nargund es arquitecto principal de soluciones en AWS. En su función como facilitadora de tecnología en la nube, trabaja con los clientes para comprender sus objetivos y desafíos y brindarles orientación prescriptiva para lograr su objetivo con las ofertas de AWS. Le apasionan las mujeres en la tecnología y es miembro principal de Women in AI/ML en Amazon. Habla en conferencias internas y externas como AWS re:Invent, AWS Summits y seminarios web. Fuera del trabajo, le gusta el voluntariado, la jardinería, el ciclismo y el senderismo.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-chatbot-application-using-knowledge-bases-for-amazon-bedrock/

- :posee

- :es

- :dónde

- $ UP

- 100

- 125

- 2019

- 2020

- 2021

- 2022

- 23

- 27

- 500

- 7

- 8

- 9

- a

- capacidad

- Nuestra Empresa

- acelerar

- de la máquina

- el acceso

- Conforme

- Mi Cuenta

- preciso

- Lograr

- a través de

- la columna Acción

- add

- Adicionales

- direcciones

- avanzado

- ventajas

- asesores

- de nuevo

- agentes

- AI

- Sistemas de IA

- AI / ML

- Dirigido

- Todos

- Permitir

- permite

- solo

- a lo largo de

- junto al

- también

- Amazon

- Amazon Web Services

- an

- y

- anual

- INGRESOS ANUALES

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- responder

- Antrópico

- cualquier

- abejas

- API

- applicación

- Aplicación

- aplicaciones

- aplicada

- enfoque

- arquitectura

- somos

- AS

- At

- aumentar

- aumentado

- Augments

- Aurora

- autor

- automáticamente

- Hoy Disponibles

- Avenida

- lejos

- AWS

- Formación en la nube de AWS

- AWS re: Invent

- Atrás

- bases

- basado

- básica

- Bay

- Beach

- a las que has recomendado

- esto

- antes

- Comienzo

- comienza

- comportamiento

- cree

- mejores

- mil millones

- tablero

- Consejo de Administración

- primer libro

- marca

- cada navegador

- build

- Aplicaciones empresariales

- by

- CA

- llamar al

- Calls

- PUEDEN

- capacidades

- capital

- cases

- CD

- retos

- el cambio

- Cambios

- cargos

- chat

- chatterbot

- Chatbots

- Pagar ahora

- chip

- Papas fritas

- manera?

- Elige

- limpia

- Cli

- Soluciones

- TECNOLOGÍA EN LA NUBE

- código

- --

- combina

- cómo

- proviene

- Algunos

- Empresas

- compañía

- completar

- complejidades

- componentes

- computational

- computadora

- Visión por computador

- informática

- conferencias

- Contacto

- Consola

- consumidor

- contexto

- contextual

- contextualizar

- continue

- Conversación

- conversacional

- AI conversacional

- conversaciones

- convertido

- Core

- Sector empresarial

- rentable

- podría

- Para crear

- creado

- crea

- Creamos

- creación

- creador

- cricket

- En la actualidad

- cliente

- comportamiento del cliente

- experiencia del cliente

- Servicio al Cliente

- Clientes

- se adaptan

- datos

- puntos de datos

- basada en datos

- Base de datos

- Días

- Predeterminado

- entregamos

- liberado

- entregar

- Dependiente

- desplegado

- despliegue

- descrito

- descripción

- detalles

- Determinar

- desarrollar

- Developer

- Desarrollo

- diagrama

- HIZO

- una experiencia diferente

- digital

- directiva

- diverso

- documento

- documentos

- "Hacer"

- dólares

- dominios

- No

- DE INSCRIPCIÓN

- descargar

- cada una

- Más temprano

- Etapa temprana

- Este

- Educación

- eficiente

- esfuerzo

- sin esfuerzo

- ya sea

- incrustación

- personas

- habilitar

- habilitador

- permite

- interactuando

- Motor

- Ingeniería

- mejorado

- mejorar

- Participar

- Empresa

- empresas

- Entorno

- Errores

- Incluso

- Eventos

- Cada

- ejemplo

- experience

- Experiencias

- Experiencia

- Explicar

- explicado

- explicando

- externo

- hechos

- FALLO

- pocos

- campo

- Archive

- archivos

- Finalmente

- encuentra

- Nombre

- de tus señales

- Focus

- siguiendo

- Fundación

- Digital XNUMXk

- Francisco

- Gratuito

- Desde

- completamente

- función

- g1

- generar

- genera

- generación de AHSS

- generativo

- IA generativa

- Git

- GitHub

- Donar

- Go

- Goals

- creció

- Polo a Tierra

- Crecer

- crece

- guía

- tenido

- encargarse de

- Manijas

- Tienen

- he

- pesado

- levantar objetos pesados

- ayudando

- aquí

- Alta

- de alto nivel

- su

- historia

- Inicio

- Cómo

- Sin embargo

- HTML

- http

- HTTPS

- cien

- ID

- if

- ilustrar

- ilustra

- implementación

- importante

- mejorar

- es la mejora continua

- la mejora de

- in

- incluye

- Incluye

- incorporar

- incorpora

- aumente

- aumentado

- índice

- índices

- INSTRUMENTO individual

- industrias

- informar

- información

- Sistemas De Información

- Las opciones de entrada

- Consultas

- Insights

- instalar

- instantáneo

- integrar

- Integración

- integración

- interactúa

- intereses

- Interfaz

- interno

- internamente

- dentro

- introducir

- Introducido

- metas de

- invoca

- involucra

- implica

- IT

- jpg

- Clave

- especialistas

- idioma

- Idiomas

- large

- Grandes empresas

- Apellido

- luego

- lanzado

- .

- Lead

- Prospectos

- aprendizaje

- menos

- Abandonar

- menos

- carta

- Nivel

- bibliotecas

- Biblioteca

- cirugía estética

- como

- Me gusta

- Limitada

- línea

- enlace

- LLM

- local

- Largo

- máquina

- máquina de aprendizaje

- Inicio

- HACE

- manejable

- gestionado

- gestiona

- administrar

- Fabricación

- muchos

- Match

- Puede..

- me

- sentido

- mecanismo

- miembro

- Salud Cerebral

- simplemente

- millones

- Millón de dólares

- mínimo

- minuto

- Min

- modelo

- modelos

- modificar

- más,

- MEJOR DE TU

- múltiples

- nombre

- Natural

- Procesamiento natural del lenguaje

- Navegar

- Navegación

- ¿ Necesita ayuda

- Nuevo

- Next

- no

- Ninguna

- nota

- cuaderno

- señaló

- objetivo

- of

- LANZAMIENTO

- Lista de ofrendas

- Ofertas

- Oficina

- a menudo

- on

- ONE

- habiertos

- de código abierto

- óptimo

- Optión

- Opciones

- or

- para las fiestas.

- Otro

- de otra manera

- nuestros

- salir

- salida

- afuera

- Más de

- gastos generales

- visión de conjunto

- EL DESARROLLADOR

- página

- cristal

- parámetros

- Socio

- partes

- passage

- pasajes

- pasado

- apasionado

- pasado

- Patrón de Costura

- porcentaje

- actuación

- permisos

- Personalizado

- plan

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- jugando

- punto

- puntos

- políticas

- Popular

- popularidad

- Publicación

- industria

- alimentado

- poderoso

- preferencias

- presente

- presentó

- regalos

- anterior

- Director de la escuela

- problemas

- tratamiento

- procesadores

- Productos

- Progreso

- proyecta

- ideas

- propietario

- proporcionar

- previsto

- proporciona un

- proporcionando

- compras

- Python

- consultas

- pregunta

- pregunta

- Preguntas

- Búsqueda

- trapo

- que van

- RE

- ready

- real

- mundo real

- en tiempo real

- archivos

- reducir

- la reducción de

- remitir

- regiones

- regularmente

- relacionado

- la relevancia

- elimina

- Informes

- repositorio

- representar

- solicita

- Requisitos

- requiere

- Recursos

- Responder

- respuesta

- respuestas

- recuperación

- devoluciones

- ingresos

- una estrategia SEO para aparecer en las búsquedas de Google.

- carretera

- Función

- También soy miembro del cuerpo docente de World Extreme Medicine (WEM) y embajadora europea de igualdad para The Transformational Travel Council (TTC). En mi tiempo libre, soy una incansable aventurera, escaladora, patrona de día, buceadora y defensora de la igualdad de género en el deporte y la aventura. En XNUMX, fundé Almas Libres, una ONG nacida para involucrar, educar y empoderar a mujeres y niñas a través del deporte urbano, la cultura y la tecnología.

- Ejecutar

- corre

- tiempo de ejecución

- mismo

- muestra

- San

- San Francisco

- salvado

- escalable

- la ampliación

- guión

- Sdk

- Buscar

- Sección

- (secciones)

- seguro

- ver

- selecciona

- seleccionado

- semántico

- expedido

- ayudar

- Sin servidor

- de coches

- Servicios

- Sesión

- set

- ajustes

- Configure

- accionista

- Accionistas

- ella

- a corto plazo

- tienes

- mostrar

- importante

- similares

- simultáneamente

- soltero

- Tamaño

- menores

- a medida

- Soluciones

- algo

- sofisticado

- Fuente

- Fuentes

- Habla

- especialistas

- se especializa

- soluciones y

- especificado

- dividido

- escisiones

- montón

- comienzo

- Startups

- Estado

- Estado

- deriva

- paso

- pasos

- tienda

- almacenados

- tiendas

- almacenamiento

- sencillo

- Estrategia

- aerodinamizar

- enviar

- posterior

- sustancialmente

- Con éxito

- tal

- sugieren

- Cumbres

- SOPORTE

- Soportado

- soportes

- sincronizar

- te

- Todas las funciones a su disposición

- mesa

- adaptado

- ¡Prepárate!

- toma

- tareas

- tecnología

- Tecnología

- plantilla

- terminal

- test

- probado

- texto

- que

- esa

- El proyecto

- la información

- La Fuente

- su

- Les

- luego

- Ahí.

- por lo tanto

- Estas

- ellos

- así

- aquellos

- Tres

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- titán

- a

- Transformar

- detonante

- de confianza

- try

- dos

- tipos

- bajo

- entender

- actualización

- subido

- utilizan el

- usado

- Usuario

- usuarios

- usos

- usando

- utilidad

- v1

- Valioso

- propuesta de

- Valores

- diversos

- visión

- volumen

- quieres

- fue

- ver

- Camino..

- we

- web

- navegador web

- servicios web

- Basado en la Web

- Webinars

- semana

- Semanas

- West

- ¿

- cuando

- que

- mientras

- porque

- seguirá

- ventana

- Mujeres

- las mujeres en la tecnología

- Actividades:

- flujo de trabajo

- flujos de trabajo

- trabajando

- funciona

- escribir

- escribir código

- escrito

- yaml

- año

- años

- Usted

- tú

- Youtube

- zephyrnet