Los investigadores continúan desarrollando nuevas arquitecturas modelo para tareas comunes de aprendizaje automático (ML). Una de esas tareas es la clasificación de imágenes, donde las imágenes se aceptan como entrada y el modelo intenta clasificar la imagen como un todo con salidas de etiquetas de objetos. Con muchos modelos disponibles en la actualidad que realizan esta tarea de clasificación de imágenes, un profesional de ML puede hacer preguntas como: "¿Qué modelo debo ajustar y luego implementar para lograr el mejor rendimiento en mi conjunto de datos?" Y un investigador de ML puede hacer preguntas como: "¿Cómo puedo generar mi propia comparación justa de múltiples arquitecturas modelo contra un conjunto de datos específico mientras controlo los hiperparámetros de entrenamiento y las especificaciones de la computadora, como GPU, CPU y RAM?" La primera pregunta aborda la selección de modelos en las arquitecturas de modelos, mientras que la última pregunta se refiere a la comparación de modelos entrenados con un conjunto de datos de prueba.

En este post, verás cómo el Clasificación de imágenes de TensorFlow algoritmo de JumpStart de Amazon SageMaker puede simplificar las implementaciones requeridas para abordar estas preguntas. Junto con los detalles de implementación en un correspondiente ejemplo de cuaderno Jupyter, tendrá herramientas disponibles para realizar la selección de modelos explorando las fronteras de Pareto, donde no es posible mejorar una métrica de rendimiento, como la precisión, sin empeorar otra métrica, como el rendimiento.

Resumen de la solución

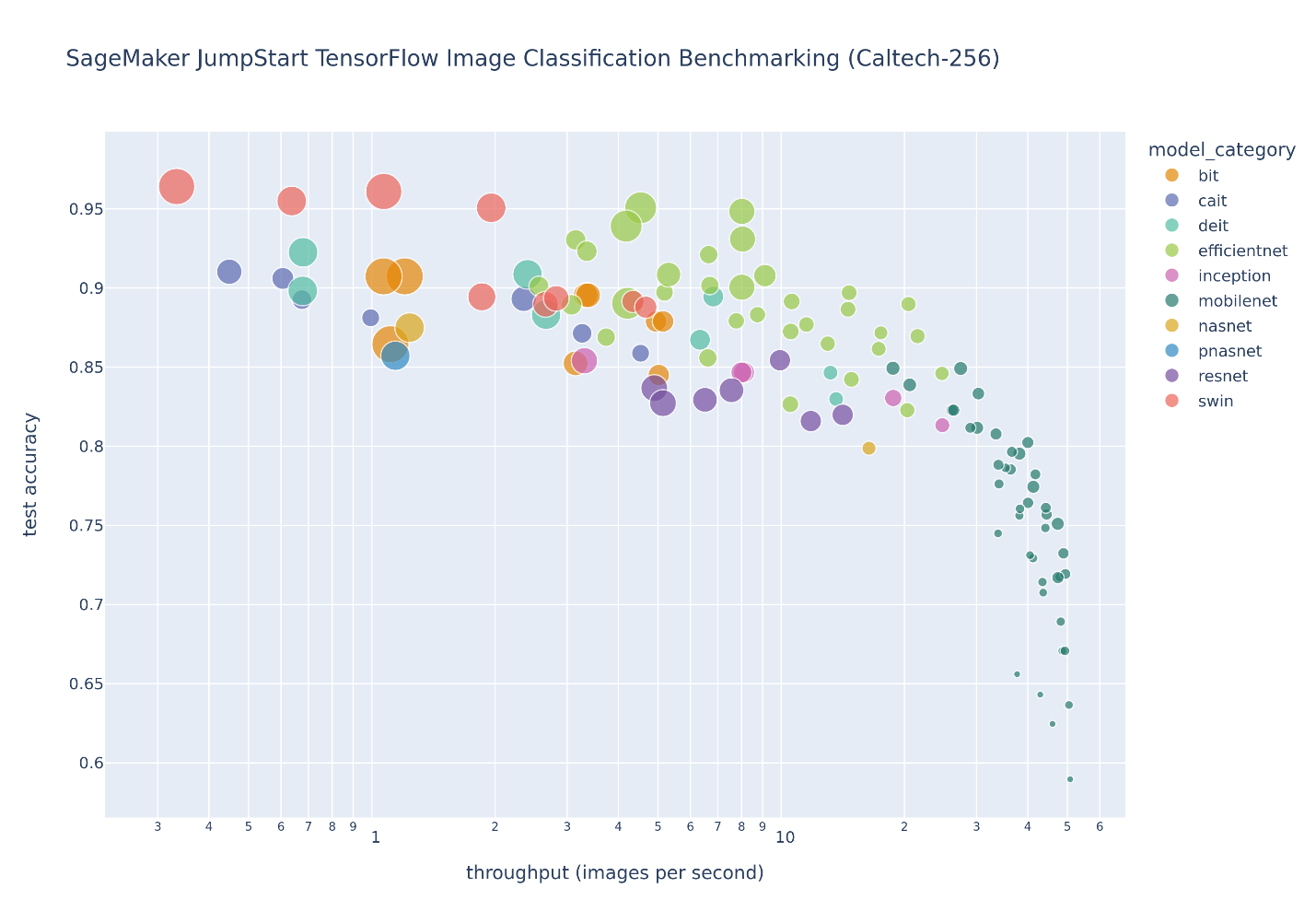

La siguiente figura ilustra el compromiso de selección de modelo para una gran cantidad de modelos de clasificación de imágenes ajustados en el Caltech-256 conjunto de datos, que es un conjunto desafiante de 30,607 imágenes del mundo real que abarcan 256 categorías de objetos. Cada punto representa un solo modelo, los tamaños de los puntos se escalan con respecto a la cantidad de parámetros que componen el modelo y los puntos están codificados por colores según la arquitectura de su modelo. Por ejemplo, los puntos de color verde claro representan la arquitectura EfficientNet; cada punto verde claro es una configuración diferente de esta arquitectura con medidas únicas de rendimiento del modelo ajustadas. La figura muestra la existencia de una frontera de Pareto para la selección del modelo, donde se intercambia una mayor precisión por un menor rendimiento. En última instancia, la selección de un modelo a lo largo de la frontera de Pareto, o el conjunto de soluciones eficientes de Pareto, depende de los requisitos de rendimiento de la implementación de su modelo.

Si observa las fronteras de interés de la precisión de la prueba y el rendimiento de la prueba, el conjunto de soluciones eficientes de Pareto en la figura anterior se extraen en la siguiente tabla. Las filas se ordenan de manera que el rendimiento de la prueba aumenta y la precisión de la prueba disminuye.

| Nombre de Modelo | Número de parámetros | Exactitud de prueba | Pruebe la precisión de los 5 principales | Rendimiento (imágenes/s) | Duración por Época(s) |

| swin-parche-grande4-window12-384 | 195.6 m | 96.4% | 99.5% | 0.3 | 2278.6 |

| swin-parche-grande4-window7-224 | 195.4 m | 96.1% | 99.5% | 1.1 | 698.0 |

| red-eficiente-v2-imagenet21k-ft1k-l | 118.1 m | 95.1% | 99.2% | 4.5 | 1434.7 |

| eficientenet-v2-imagenet21k-ft1k-m | 53.5 m | 94.8% | 99.1% | 8.0 | 769.1 |

| red-eficiente-v2-imagenet21k-m | 53.5 m | 93.1% | 98.5% | 8.0 | 765.1 |

| red-eficiente-b5 | 29.0 m | 90.8% | 98.1% | 9.1 | 668.6 |

| red-eficiente-v2-imagenet21k-ft1k-b1 | 7.3 m | 89.7% | 97.3% | 14.6 | 54.3 |

| red-eficiente-v2-imagenet21k-ft1k-b0 | 6.2 m | 89.0% | 97.0% | 20.5 | 38.3 |

| red-eficiente-v2-imagenet21k-b0 | 6.2 m | 87.0% | 95.6% | 21.5 | 38.2 |

| mobilenet-v3-grande-100-224 | 4.6 m | 84.9% | 95.4% | 27.4 | 28.8 |

| mobilenet-v3-grande-075-224 | 3.1 m | 83.3% | 95.2% | 30.3 | 26.6 |

| mobilenet-v2-100-192 | 2.6 m | 80.8% | 93.5% | 33.5 | 23.9 |

| mobilenet-v2-100-160 | 2.6 m | 80.2% | 93.2% | 40.0 | 19.6 |

| mobilenet-v2-075-160 | 1.7 m | 78.2% | 92.8% | 41.8 | 19.3 |

| mobilenet-v2-075-128 | 1.7 m | 76.1% | 91.1% | 44.3 | 18.3 |

| mobilenet-v1-075-160 | 2.0 m | 75.7% | 91.0% | 44.5 | 18.2 |

| mobilenet-v1-100-128 | 3.5 m | 75.1% | 90.7% | 47.4 | 17.4 |

| mobilenet-v1-075-128 | 2.0 m | 73.2% | 90.0% | 48.9 | 16.8 |

| mobilenet-v2-075-96 | 1.7 m | 71.9% | 88.5% | 49.4 | 16.6 |

| mobilenet-v2-035-96 | 0.7 m | 63.7% | 83.1% | 50.4 | 16.3 |

| mobilenet-v1-025-128 | 0.3 m | 59.0% | 80.7% | 50.8 | 16.2 |

Esta publicación proporciona detalles sobre cómo implementar a gran escala Amazon SageMaker tareas de benchmarking y selección de modelos. Primero, presentamos JumpStart y los algoritmos de clasificación de imágenes integrados de TensorFlow. Luego analizamos las consideraciones de implementación de alto nivel, como las configuraciones de hiperparámetros de JumpStart, la extracción de métricas de Registros de Amazon CloudWatchy el lanzamiento de trabajos de ajuste de hiperparámetros asíncronos. Finalmente, cubrimos el entorno de implementación y la parametrización que conducen a las soluciones eficientes de Pareto en la tabla y la figura anteriores.

Introducción a la clasificación de imágenes JumpStart TensorFlow

JumpStart proporciona ajuste e implementación con un solo clic de una amplia variedad de modelos previamente entrenados en tareas populares de ML, así como una selección de soluciones integrales que resuelven problemas comerciales comunes. Estas características eliminan el trabajo pesado de cada paso del proceso de ML, lo que facilita el desarrollo de modelos de alta calidad y reduce el tiempo de implementación. El API JumpStart le permite implementar y ajustar mediante programación una amplia selección de modelos preentrenados en sus propios conjuntos de datos.

El centro de modelos JumpStart brinda acceso a una gran cantidad de Modelos de clasificación de imágenes de TensorFlow que permiten transferir el aprendizaje y el ajuste fino en conjuntos de datos personalizados. Al momento de escribir este artículo, el concentrador de modelos JumpStart contiene 135 modelos de clasificación de imágenes de TensorFlow en una variedad de arquitecturas de modelos populares de Centro TensorFlow, para incluir redes residuales (Resnet), red móvil, Red eficiente, Comienzo, Redes de búsqueda de arquitectura neuronal (NASnet), Gran Transferencia (Un poco), ventana desplazada (Swin) transformadores, Clase-Atención en Transformadores de Imagen (Cai T), y transformadores de imagen eficientes en datos (Deit).

Estructuras internas muy diferentes comprenden la arquitectura de cada modelo. Por ejemplo, los modelos ResNet utilizan conexiones de salto para permitir redes sustancialmente más profundas, mientras que los modelos basados en transformadores utilizan mecanismos de autoatención que eliminan la localidad intrínseca de las operaciones de convolución a favor de campos receptivos más globales. Además de los diversos conjuntos de características que brindan estas diferentes estructuras, cada arquitectura de modelo tiene varias configuraciones que ajustan el tamaño, la forma y la complejidad del modelo dentro de esa arquitectura. Esto da como resultado cientos de modelos únicos de clasificación de imágenes disponibles en el centro de modelos JumpStart. En combinación con el aprendizaje de transferencia integrado y los scripts de inferencia que abarcan muchas funciones de SageMaker, la API JumpStart es un excelente punto de partida para que los profesionales de ML comiencen a entrenar e implementar modelos rápidamente.

Consulte Transferir aprendizaje para modelos de clasificación de imágenes de TensorFlow en Amazon SageMaker y lo siguiente cuaderno de ejemplo para obtener más información sobre la clasificación de imágenes de SageMaker TensorFlow, incluido cómo ejecutar la inferencia en un modelo previamente entrenado, así como también cómo ajustar el modelo previamente entrenado en un conjunto de datos personalizado.

Consideraciones de selección de modelos a gran escala

La selección de modelos es el proceso de seleccionar el mejor modelo de un conjunto de modelos candidatos. Este proceso se puede aplicar a través de modelos del mismo tipo con diferentes ponderaciones de parámetros ya través de modelos de diferentes tipos. Los ejemplos de selección de modelos entre modelos del mismo tipo incluyen ajustar el mismo modelo con diferentes hiperparámetros (por ejemplo, tasa de aprendizaje) y detenerse antes de tiempo para evitar el ajuste excesivo de los pesos del modelo al conjunto de datos del tren. La selección de modelos entre modelos de diferentes tipos incluye seleccionar la mejor arquitectura de modelo (por ejemplo, Swin vs. MobileNet) y seleccionar las mejores configuraciones de modelo dentro de una arquitectura de modelo único (por ejemplo, mobilenet-v1-025-128 vs mobilenet-v3-large-100-224).

Las consideraciones descritas en esta sección permiten todos estos procesos de selección de modelos en un conjunto de datos de validación.

Seleccionar configuraciones de hiperparámetros

La clasificación de imágenes de TensorFlow en JumpStart tiene una gran cantidad de hiperparámetros que puede ajustar los comportamientos del script de aprendizaje de transferencia de manera uniforme para todas las arquitecturas modelo. Estos hiperparámetros se relacionan con el aumento y el preprocesamiento de datos, la especificación del optimizador, los controles de sobreajuste y los indicadores de capa entrenables. Le recomendamos que ajuste los valores predeterminados de estos hiperparámetros según sea necesario para su aplicación:

Para este análisis y el cuaderno asociado, todos los hiperparámetros se establecen en valores predeterminados, excepto la tasa de aprendizaje, el número de épocas y la especificación de detención anticipada. La tasa de aprendizaje se ajusta como un parámetro categórico según el Ajuste automático del modelo SageMaker trabajo. Debido a que cada modelo tiene valores de hiperparámetro predeterminados únicos, la lista discreta de posibles tasas de aprendizaje incluye la tasa de aprendizaje predeterminada, así como una quinta parte de la tasa de aprendizaje predeterminada. Esto inicia dos trabajos de entrenamiento para un solo trabajo de ajuste de hiperparámetros y se selecciona el trabajo de entrenamiento con el mejor rendimiento informado en el conjunto de datos de validación. Debido a que el número de épocas se establece en 10, que es mayor que la configuración de hiperparámetros predeterminada, el mejor trabajo de capacitación seleccionado no siempre se corresponde con la tasa de aprendizaje predeterminada. Finalmente, se utiliza un criterio de parada temprana con una paciencia, o el número de épocas para seguir entrenando sin mejoría, de tres épocas.

Una configuración predeterminada de hiperparámetro de particular importancia es train_only_on_top_layer, donde, si se establece en True, las capas de extracción de características del modelo no están ajustadas en el conjunto de datos de entrenamiento proporcionado. El optimizador solo entrenará parámetros en la capa superior de clasificación completamente conectada con una dimensionalidad de salida igual al número de etiquetas de clase en el conjunto de datos. De forma predeterminada, este hiperparámetro se establece en True, que es un entorno destinado a la transferencia de aprendizaje en pequeños conjuntos de datos. Es posible que tenga un conjunto de datos personalizado en el que la extracción de características del entrenamiento previo en el conjunto de datos de ImageNet no sea suficiente. En estos casos, debe establecer train_only_on_top_layer a False. Aunque esta configuración aumentará el tiempo de entrenamiento, extraerá características más significativas para su problema de interés, aumentando así la precisión.

Extraer métricas de CloudWatch Logs

El algoritmo de clasificación de imágenes JumpStart TensorFlow registra de manera confiable una variedad de métricas durante el entrenamiento a las que SageMaker puede acceder Estimator y objetos HyperparameterTuner. El constructor de un SageMaker Estimator tiene un metric_definitions argumento de palabra clave, que se puede utilizar para evaluar el trabajo de entrenamiento al proporcionar una lista de diccionarios con dos claves: Nombre para el nombre de la métrica y Regex para la expresión regular utilizada para extraer la métrica de los registros. El acompañamiento cuaderno muestra los detalles de implementación. La siguiente tabla enumera las métricas disponibles y las expresiones regulares asociadas para todos los modelos de clasificación de imágenes de JumpStart TensorFlow.

| Nombre de la métrica | Expresión Regular |

| número de parámetros | “- Número de parámetros: ([0-9\.]+)” |

| número de parámetros entrenables | “- Número de parámetros entrenables: ([0-9\.]+)” |

| número de parámetros no entrenables | “- Número de parámetros no entrenables: ([0-9\.]+)” |

| entrenar la métrica del conjunto de datos | f”- {métrica}: ([0-9\.]+)” |

| métrica del conjunto de datos de validación | f”- val_{métrica}: ([0-9\.]+)” |

| métrica del conjunto de datos de prueba | f”- Prueba {métrica}: ([0-9\.]+)” |

| duración del tren | “- Duración total del entrenamiento: ([0-9\.]+)” |

| duración del tren por época | “- Duración media del entrenamiento por época: ([0-9\.]+)” |

| latencia de evaluación de prueba | “- Prueba de latencia de evaluación: ([0-9\.]+)” |

| latencia de prueba por muestra | “- Latencia de prueba promedio por muestra: ([0-9\.]+)” |

| rendimiento de prueba | "- Rendimiento de prueba promedio: ([0-9\.]+)" |

El script de aprendizaje de transferencia incorporado proporciona una variedad de métricas de conjunto de datos de entrenamiento, validación y prueba dentro de estas definiciones, como se representa en los valores de reemplazo de la cadena f. Las métricas exactas disponibles varían según el tipo de clasificación que se realice. Todos los modelos compilados tienen un loss métrica, que está representada por una pérdida de entropía cruzada para un problema de clasificación binaria o categórica. El primero se usa cuando hay una etiqueta de clase; este último se utiliza si hay dos o más etiquetas de clase. Si solo hay una etiqueta de clase única, las siguientes métricas se calculan, registran y extraen a través de las expresiones regulares de cadena f en la tabla anterior: número de verdaderos positivos (true_pos), número de falsos positivos (false_pos), número de verdaderos negativos (true_neg), número de falsos negativos (false_neg), precision, recall, área bajo la curva característica operativa del receptor (ROC) (auc) y el área bajo la curva de recuperación de precisión (PR) (prc). De manera similar, si hay seis o más etiquetas de clase, una métrica de precisión de las 5 principales (top_5_accuracy) también se puede calcular, registrar y extraer a través de las expresiones regulares anteriores.

Durante el entrenamiento, las métricas especificadas para un SageMaker Estimator se emiten a CloudWatch Logs. Cuando se completa el entrenamiento, puede invocar el API DescribeTrainingJob de SageMaker e inspeccionar el FinalMetricDataList clave en la respuesta JSON:

Esta API solo requiere que se proporcione el nombre del trabajo a la consulta, por lo que, una vez completada, se pueden obtener métricas en análisis futuros siempre que el nombre del trabajo de entrenamiento se registre correctamente y sea recuperable. Para esta tarea de selección de modelos, los nombres de los trabajos de ajuste de hiperparámetros se almacenan y los análisis posteriores vuelven a adjuntar un HyperparameterTuner dado el nombre del trabajo de ajuste, extraiga el mejor nombre del trabajo de entrenamiento del sintonizador de hiperparámetro adjunto y luego invoque el DescribeTrainingJob API como se describió anteriormente para obtener métricas asociadas con el mejor trabajo de capacitación.

Lanzar trabajos de ajuste de hiperparámetros asíncronos

Consulte el correspondiente cuaderno para obtener detalles de implementación sobre el lanzamiento asíncrono de trabajos de ajuste de hiperparámetros, que utiliza la biblioteca estándar de Python futuros concurrentes módulo, una interfaz de alto nivel para ejecutar invocables de forma asincrónica. En esta solución se implementan varias consideraciones relacionadas con SageMaker:

- Cada cuenta de AWS está afiliada a Cuotas de servicio de SageMaker. Debe ver sus límites actuales para utilizar completamente sus recursos y potencialmente solicitar aumentos del límite de recursos según sea necesario.

- Las llamadas API frecuentes para crear muchos trabajos de ajuste de hiperparámetros simultáneos pueden exceda la tasa de SDK de Python y genere excepciones de limitación. Una solución a esto es crear un cliente SageMaker Boto3 con una configuración de reintento personalizada.

- ¿Qué sucede si su secuencia de comandos encuentra un error o la secuencia de comandos se detiene antes de completarse? Para una selección de modelos tan grande o un estudio de evaluación comparativa, puede registrar nombres de trabajos de ajuste y proporcionar funciones convenientes para volver a adjuntar trabajos de ajuste de hiperparámetros que ya existen:

Detalles del análisis y discusión.

El análisis en esta publicación realiza transferencia de aprendizaje para ID de modelo en el algoritmo de clasificación de imágenes JumpStart TensorFlow en el conjunto de datos Caltech-256. Todos los trabajos de capacitación se realizaron en la instancia de capacitación de SageMaker ml.g4dn.xlarge, que contiene una sola GPU NVIDIA T4.

El conjunto de datos de prueba se evalúa en la instancia de entrenamiento al final del entrenamiento. La selección del modelo se realiza antes de la evaluación del conjunto de datos de prueba para establecer los pesos del modelo en la época con el mejor rendimiento del conjunto de validación. El rendimiento de la prueba no está optimizado: el tamaño del lote del conjunto de datos se establece en el tamaño del lote de hiperparámetros de entrenamiento predeterminado, que no se ajusta para maximizar el uso de la memoria de la GPU; el rendimiento de prueba informado incluye el tiempo de carga de datos porque el conjunto de datos no está almacenado en caché; y no se utiliza la inferencia distribuida en varias GPU. Por estos motivos, este rendimiento es una buena medida relativa, pero el rendimiento real dependería en gran medida de las configuraciones de implementación del punto final de inferencia para el modelo entrenado.

Aunque el concentrador de modelos JumpStart contiene muchos tipos de arquitectura de clasificación de imágenes, esta frontera de Pareto está dominada por modelos Swin, EfficientNet y MobileNet seleccionados. Los modelos Swin son más grandes y relativamente más precisos, mientras que los modelos MobileNet son más pequeños, relativamente menos precisos y adecuados para las limitaciones de recursos de los dispositivos móviles. Es importante tener en cuenta que esta frontera está condicionada por una variedad de factores, incluido el conjunto de datos exacto utilizado y los hiperparámetros de ajuste fino seleccionados. Es posible que descubra que su conjunto de datos personalizado produce un conjunto diferente de soluciones eficientes en términos de Pareto y que desee tiempos de entrenamiento más prolongados con diferentes hiperparámetros, como más aumento de datos o ajuste más que solo la capa de clasificación superior del modelo.

Conclusión

En esta publicación, mostramos cómo ejecutar tareas de evaluación comparativa o selección de modelos a gran escala utilizando el centro de modelos JumpStart. Esta solución puede ayudarlo a elegir el mejor modelo para sus necesidades. Le animamos a que pruebe y explore este a medida en su propio conjunto de datos.

Referencias

Hay más información disponible en los siguientes recursos:

Sobre los autores

Dr.Kyle Ulrich es un científico aplicado con el Algoritmos integrados de Amazon SageMaker equipo. Sus intereses de investigación incluyen algoritmos escalables de aprendizaje automático, visión artificial, series temporales, no paramétricos bayesianos y procesos gaussianos. Su doctorado es de la Universidad de Duke y ha publicado artículos en NeurIPS, Cell y Neuron.

Dr.Kyle Ulrich es un científico aplicado con el Algoritmos integrados de Amazon SageMaker equipo. Sus intereses de investigación incluyen algoritmos escalables de aprendizaje automático, visión artificial, series temporales, no paramétricos bayesianos y procesos gaussianos. Su doctorado es de la Universidad de Duke y ha publicado artículos en NeurIPS, Cell y Neuron.

Dr. Ashish Khetan es un científico senior aplicado con Algoritmos integrados de Amazon SageMaker y ayuda a desarrollar algoritmos de aprendizaje automático. Obtuvo su doctorado en la Universidad de Illinois Urbana Champaign. Es un investigador activo en aprendizaje automático e inferencia estadística y ha publicado muchos artículos en conferencias NeurIPS, ICML, ICLR, JMLR, ACL y EMNLP.

Dr. Ashish Khetan es un científico senior aplicado con Algoritmos integrados de Amazon SageMaker y ayuda a desarrollar algoritmos de aprendizaje automático. Obtuvo su doctorado en la Universidad de Illinois Urbana Champaign. Es un investigador activo en aprendizaje automático e inferencia estadística y ha publicado muchos artículos en conferencias NeurIPS, ICML, ICLR, JMLR, ACL y EMNLP.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- Platoblockchain. Inteligencia del Metaverso Web3. Conocimiento amplificado. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/image-classification-model-selection-using-amazon-sagemaker-jumpstart/

- 10

- 100

- 7

- 9

- a

- Nuestra Empresa

- de la máquina

- accesible

- Mi Cuenta

- la exactitud

- preciso

- Lograr

- a través de

- lector activo

- adición

- dirección

- direcciones

- Equilibrado

- Organización

- en contra

- algoritmo

- algoritmos

- Todos

- ya haya utilizado

- Aunque

- hacerlo

- Amazon

- Amazon SageMaker

- JumpStart de Amazon SageMaker

- Analiza

- análisis

- y

- Otra

- abejas

- Aplicación

- aplicada

- adecuadamente

- arquitectura

- Reservada

- argumento

- asociado

- adjuntar

- Los intentos

- Automático

- Hoy Disponibles

- promedio

- AWS

- basado

- Bayesiano

- porque

- antes

- "Ser"

- evaluación comparativa

- MEJOR

- Big

- incorporado

- Calls

- candidato

- cases

- categoría

- desafiante

- característica

- Elige

- clase

- clasificación

- clasificar

- cliente

- combinado

- Algunos

- comparación

- completar

- Completado

- terminación

- complejidad

- computadora

- Visión por computador

- Inquietudes

- conferencias

- Configuración

- conectado

- Conexiones

- consideraciones

- restricciones

- contiene

- continue

- CONTROL

- controles

- comodidad

- Correspondiente

- Protectora

- Para crear

- Current

- curva

- personalizado

- datos

- conjuntos de datos

- más profundo

- Predeterminado

- depende

- desplegar

- Desplegando

- despliegue

- profundidad

- descrito

- descripción

- detalles

- desarrollar

- Dispositivos

- una experiencia diferente

- discutir

- distribuidos

- diverso

- No

- Duque

- duke university

- durante

- cada una

- Más temprano

- Temprano en la

- más fácil

- eficiente

- ya sea

- eliminarlos

- habilitar

- fomentar

- ser dado

- de extremo a extremo

- Punto final

- Entorno

- época

- épocas

- error

- evaluar

- evaluado

- evaluación

- ejemplo

- ejemplos

- Excepto

- explorar

- Explorar

- expresiones

- extraerlos

- factores importantes

- feria

- Favorecer

- Feature

- Caracteristicas

- Terrenos

- Figura

- Finalmente

- Encuentre

- Nombre

- adecuado

- siguiendo

- Ex

- Desde

- frontera

- Frontiers

- completamente

- funciones

- futuras

- Futuros

- generar

- obtener

- dado

- Buscar

- candidato

- GPU

- GPU

- maravillosa

- mayor

- Verde

- que sucede

- fuertemente

- ayuda

- ayuda

- de alto nivel

- alta calidad

- más alto

- Cómo

- Como Hacer

- HTML

- HTTPS

- Bujes

- Cientos

- Ajuste de hiperparámetros

- Illinois

- imagen

- Clasificación de la imagen

- imágenes

- implementar

- implementación

- implementado

- importancia

- importante

- es la mejora continua

- la mejora de

- in

- incluir

- incluye

- Incluye

- aumente

- Los aumentos

- creciente

- indicadores

- información

- Las opciones de entrada

- ejemplo

- intereses

- intereses

- Interfaz

- interno

- intrínseco

- introducir

- IT

- Trabajos

- Empleo

- json

- Clave

- claves

- Label

- Etiquetas

- large

- Gran escala

- mayores

- Estado latente

- pone en marcha

- lanzamiento

- .

- ponedoras

- líder

- APRENDE:

- aprendizaje

- cirugía estética

- luz

- LIMITE LAS

- límites

- Lista

- Listas

- carga

- Largo

- por más tiempo

- de

- máquina

- máquina de aprendizaje

- Realizar

- muchos

- Maximizar

- significativo

- medidas

- Salud Cerebral

- métrico

- Métrica

- ML

- Móvil

- dispositivos móviles

- modelo

- modelos

- Módulo

- más,

- múltiples

- nombre

- nombres

- necesario

- telecomunicaciones

- Nuevo

- cuaderno

- número

- Nvidia

- objeto

- objetos

- observar

- obtener

- obtenido

- ONE

- funcionamiento

- Operaciones

- optimizado

- esbozado

- EL DESARROLLADOR

- papeles

- parámetro

- parámetros

- particular

- Paciencia

- (PDF)

- Realizar

- actuación

- realiza

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- punto

- puntos

- Popular

- posible

- Publicación

- la posibilidad

- pr

- evitar

- Anterior

- Problema

- problemas

- en costes

- proporcionar

- previsto

- proporciona un

- proporcionando

- publicado

- Python

- pregunta

- Preguntas

- con rapidez

- RAM

- Rate

- Tarifas

- mundo real

- razones

- la reducción de

- regular

- relativamente

- remove

- reportado

- representar

- representado

- representa

- solicita

- Requisitos

- Requisitos

- requiere

- la investigación

- investigador

- Resolución

- Recurso

- Recursos

- respuesta

- Resultados

- Ejecutar

- correr

- sabio

- mismo

- escalable

- Científico

- guiones

- Sdk

- Buscar

- Sección

- seleccionado

- seleccionar

- selección

- mayor

- Serie

- de coches

- Sesión

- set

- Sets

- pólipo

- Varios

- Forma

- tienes

- Shows

- Del mismo modo

- simplificar

- soltero

- SEIS

- Tamaño

- tamaños

- chica

- menores

- So

- a medida

- Soluciones

- RESOLVER

- especificación

- Especificaciones

- especificado

- estándar

- fundó

- estadístico

- paso

- detenido

- parada

- almacenados

- ESTUDIO

- posterior

- tal

- suficiente

- adecuado

- mesa

- afectados

- Tarea

- tareas

- equipo

- tensorflow

- test

- La

- su

- de este modo

- Tres

- rendimiento

- equipo

- Series de tiempo

- veces

- a

- hoy

- juntos

- parte superior

- top 5

- Total

- Entrenar

- entrenado

- Formación

- transferir

- transformers

- verdadero

- tipos

- Finalmente, a veces

- bajo

- único

- universidad

- Uso

- utilizan el

- utilizar

- utilizado

- validación

- Valores

- variedad

- Vasto

- vía

- Ver

- visión

- que

- mientras

- todo

- amplio

- seguirá

- dentro de

- sin

- se

- la escritura

- Usted

- tú

- zephyrnet