En la era de la información actual, los grandes volúmenes de datos alojados en innumerables documentos presentan tanto un desafío como una oportunidad para las empresas. Los métodos tradicionales de procesamiento de documentos a menudo carecen de eficiencia y precisión, lo que deja espacio para la innovación, la rentabilidad y las optimizaciones. El procesamiento de documentos ha sido testigo de avances significativos con la llegada del procesamiento inteligente de documentos (IDP). Con IDP, las empresas pueden transformar datos no estructurados de varios tipos de documentos en información estructurada y procesable, mejorando drásticamente la eficiencia y reduciendo los esfuerzos manuales. Sin embargo, el potencial no termina ahí. Al integrar la inteligencia artificial (IA) generativa en el proceso, podemos mejorar aún más las capacidades de los desplazados internos. La IA generativa no solo introduce capacidades mejoradas en el procesamiento de documentos, sino que también introduce una adaptabilidad dinámica a los patrones de datos cambiantes. Esta publicación lo lleva a través de la sinergia entre IDP y la IA generativa, revelando cómo representan la próxima frontera en el procesamiento de documentos.

Analizamos IDP en detalle en nuestra serie Procesamiento inteligente de documentos con servicios de IA de AWS (Parte 1 y Parte 2). En esta publicación, analizamos cómo ampliar una arquitectura IDP nueva o existente con modelos de lenguaje grandes (LLM). Más específicamente, discutimos cómo podemos integrar Amazon Textil LangChain como cargador de documentos y lecho rocoso del amazonas para extraer datos de documentos y utilizar capacidades de IA generativa dentro de las distintas fases de los desplazados internos.

Amazon Textract es un servicio de aprendizaje automático (ML) que extrae automáticamente texto, escritura a mano y datos de documentos escaneados. Amazon Bedrock es un servicio totalmente administrado que ofrece una variedad de modelos básicos (FM) de alto rendimiento a través de API fáciles de usar.

El siguiente diagrama es una arquitectura de referencia de alto nivel que explica cómo se puede mejorar aún más un flujo de trabajo IDP con modelos básicos. Puede utilizar LLM en una o todas las fases de IDP según el caso de uso y el resultado deseado.

En las siguientes secciones, profundizamos en cómo se integra Amazon Textract en los flujos de trabajo de IA generativa utilizando LangChain para procesar documentos para cada una de estas tareas específicas. Los bloques de código proporcionados aquí se han recortado para mayor brevedad. Consulte nuestro Repositorio GitHub para obtener cuadernos de Python detallados y un tutorial paso a paso.

La extracción de texto de documentos es un aspecto crucial cuando se trata de procesar documentos con LLM. Puede utilizar Amazon Textract para extraer texto sin formato no estructurado de documentos y conservar los objetos estructurados o semiestructurados originales, como pares clave-valor y tablas presentes en el documento. Los paquetes de documentos, como reclamaciones de seguros y atención sanitaria o hipotecas, constan de formularios complejos que contienen mucha información en formatos estructurados, semiestructurados y no estructurados. La extracción de documentos es un paso importante aquí porque los LLM se benefician del contenido enriquecido para generar respuestas más precisas y relevantes, que de otro modo podrían afectar la calidad de la producción de los LLM.

LangChain es un potente marco de código abierto para integrarse con LLM. Los LLM en general son versátiles, pero pueden tener dificultades con tareas de dominios específicos donde se necesita un contexto más profundo y respuestas matizadas. LangChain permite a los desarrolladores en tales escenarios crear agentes que puedan dividir tareas complejas en subtareas más pequeñas. Luego, las subtareas pueden introducir contexto y memoria en los LLM conectando y encadenando indicaciones de LLM.

LangChain ofrece cargadores de documentos que puede cargar y transformar datos de documentos. Puede utilizarlos para estructurar documentos en formatos preferidos que los LLM puedan procesar. El AmazonTexttractPDFLoader es un tipo de cargador de servicios que proporciona una forma rápida de automatizar el procesamiento de documentos utilizando Amazon Textract en combinación con LangChain. Para más detalles sobre AmazonTextractPDFLoader, referirse a LangChain documentación. Para utilizar el cargador de documentos de Amazon Textract, comience importándolo desde la biblioteca LangChain:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()También puede almacenar documentos en Amazon S3 y consultarlos utilizando el patrón de URL s3://, como se explica en Accediendo a un depósito usando S3://y pase esta ruta S3 al cargador de PDF de Amazon Textract:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()Un documento de varias páginas contendrá varias páginas de texto, a las que luego se podrá acceder a través del objeto documentos, que es una lista de páginas. El siguiente código recorre las páginas del objeto de documentos e imprime el texto del documento, que está disponible a través del page_content atributo:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend y LLM se pueden utilizar de forma eficaz para la clasificación de documentos. Amazon Comprehend es un servicio de procesamiento de lenguaje natural (NLP) que utiliza ML para extraer información del texto. Amazon Comprehend también admite la capacitación de modelos de clasificación personalizados con conocimiento del diseño en documentos como PDF, Word y formatos de imagen. Para obtener más información sobre el uso del clasificador de documentos de Amazon Comprehend, consulte El clasificador de documentos de Amazon Comprehend agrega soporte de diseño para una mayor precisión.

Cuando se combina con los LLM, la clasificación de documentos se convierte en un enfoque poderoso para gestionar grandes volúmenes de documentos. Los LLM son útiles en la clasificación de documentos porque pueden analizar el texto, los patrones y los elementos contextuales del documento utilizando la comprensión del lenguaje natural. También puede ajustarlos para clases de documentos específicas. Cuando un nuevo tipo de documento introducido en el proceso de IDP necesita clasificación, el LLM puede procesar texto y categorizar el documento según un conjunto de clases. El siguiente es un código de muestra que utiliza el cargador de documentos LangChain con tecnología de Amazon Textract para extraer el texto del documento y usarlo para clasificarlo. Usamos el Claude antrópico v2 modelo a través de Amazon Bedrock para realizar la clasificación.

En el siguiente ejemplo, primero extraemos texto de un informe de alta de un paciente y usamos un LLM para clasificarlo dada una lista de tres tipos de documentos diferentes:DISCHARGE_SUMMARY, RECEIPTy PRESCRIPTION. La siguiente captura de pantalla muestra nuestro informe.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

El resumen implica condensar un texto o documento determinado en una versión más corta conservando su información clave. Esta técnica es beneficiosa para la recuperación eficiente de información, lo que permite a los usuarios captar rápidamente los puntos clave de un documento sin leer todo el contenido. Aunque Amazon Textract no realiza resúmenes de texto directamente, proporciona las capacidades fundamentales para extraer el texto completo de los documentos. Este texto extraído sirve como entrada a nuestro modelo LLM para realizar tareas de resumen de texto.

Utilizando el mismo informe de alta de muestra, utilizamos AmazonTextractPDFLoader para extraer texto de este documento. Como antes, utilizamos el modelo Claude v2 a través de Amazon Bedrock y lo inicializamos con un mensaje que contiene instrucciones sobre qué hacer con el texto (en este caso, un resumen). Finalmente, ejecutamos la cadena LLM pasando el texto extraído del cargador de documentos. Esto ejecuta una acción de inferencia en el LLM con el mensaje que consta de las instrucciones para resumir y el texto del documento marcado con Document. Ver el siguiente código:

El código genera el resumen de un informe resumido de alta del paciente:

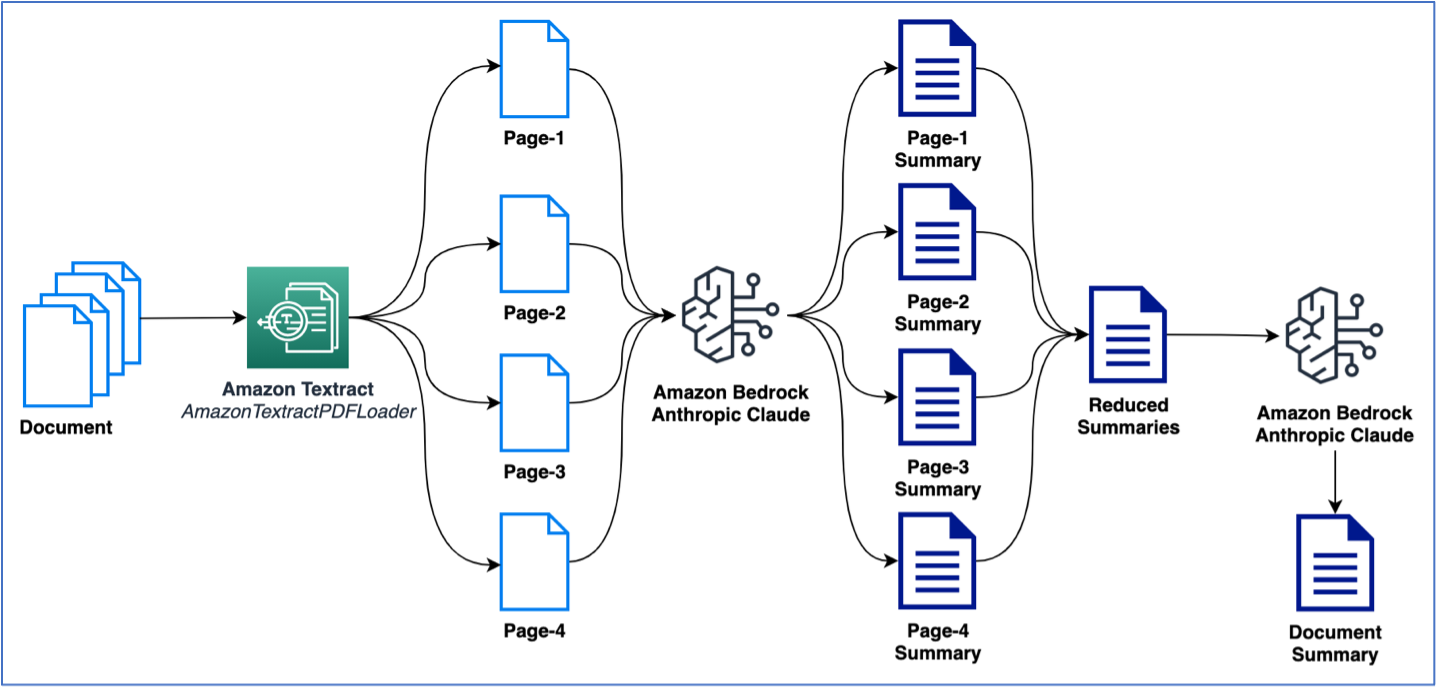

El ejemplo anterior utilizó un documento de una sola página para realizar el resumen. Sin embargo, es probable que trabaje con documentos que contengan varias páginas que necesiten un resumen. Una forma común de realizar resúmenes en varias páginas es generar primero resúmenes en fragmentos de texto más pequeños y luego combinar los resúmenes más pequeños para obtener un resumen final del documento. Tenga en cuenta que este método requiere varias llamadas al LLM. La lógica para esto se puede elaborar fácilmente; sin embargo, LangChain proporciona una cadena de resumen incorporada que puede resumir textos grandes (de documentos de varias páginas). El resumen puede realizarse mediante map_reduce o con stuff opciones, que están disponibles como opciones para gestionar las múltiples llamadas al LLM. En el siguiente ejemplo, utilizamos map_reduce para resumir un documento de varias páginas. La siguiente figura ilustra nuestro flujo de trabajo.

Primero comencemos extrayendo el documento y veamos el recuento total de tokens por página y el número total de páginas:

A continuación, utilizamos el integrado de LangChain. load_summarize_chain para resumir todo el documento:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())Estandarización y preguntas y respuestas

En esta sección, analizamos las tareas de estandarización y preguntas y respuestas.

Normalización

La estandarización de la salida es una tarea de generación de texto en la que se utilizan LLM para proporcionar un formato consistente del texto de salida. Esta tarea es particularmente útil para la automatización de la extracción de entidades clave que requiere que la salida esté alineada con los formatos deseados. Por ejemplo, podemos seguir las mejores prácticas de ingeniería para ajustar un LLM para formatear las fechas en formato MM/DD/AAAA, que puede ser compatible con una columna FECHA de la base de datos. El siguiente bloque de código muestra un ejemplo de cómo se hace esto usando un LLM e ingeniería rápida. No solo estandarizamos el formato de salida para los valores de fecha, sino que también solicitamos al modelo que genere el resultado final en formato JSON para que sea fácilmente consumible en nuestras aplicaciones posteriores. Usamos Lenguaje de expresión LangChain (LCEL) para encadenar dos acciones. La primera acción solicita al LLM que genere una salida en formato JSON de solo las fechas del documento. La segunda acción toma la salida JSON y estandariza el formato de fecha. Tenga en cuenta que esta acción de dos pasos también se puede realizar en un solo paso con la ingeniería de avisos adecuada, como veremos en la normalización y la creación de plantillas.

El resultado del ejemplo de código anterior es una estructura JSON con las fechas 07/09/2020 y 08/09/2020, que están en el formato DD/MM/AAAA y son la fecha de admisión y alta del paciente del hospital, respectivamente, según al informe resumen de alta.

Preguntas y respuestas con recuperación de generación aumentada

Se sabe que los LLM retienen información objetiva, a menudo denominada conocimiento del mundo o visión del mundo. Cuando se ajustan con precisión, pueden producir resultados de última generación. Sin embargo, existen limitaciones en cuanto a la eficacia con la que un LLM puede acceder y manipular este conocimiento. Como resultado, en tareas que dependen en gran medida de conocimientos específicos, es posible que su rendimiento no sea óptimo para determinados casos de uso. Por ejemplo, en escenarios de preguntas y respuestas, es esencial que el modelo se adhiera estrictamente al contexto proporcionado en el documento sin depender únicamente de su conocimiento del mundo. Desviarse de esto puede dar lugar a tergiversaciones, inexactitudes o incluso respuestas incorrectas. El método más utilizado para abordar este problema se conoce como Recuperación Generación Aumentada (TRAPO). Este enfoque combina las fortalezas de los modelos de recuperación y de lenguaje, mejorando la precisión y la calidad de las respuestas generadas.

Los LLM también pueden imponer limitaciones de tokens debido a sus limitaciones de memoria y las limitaciones del hardware en el que se ejecutan. Para manejar este problema, se utilizan técnicas como la fragmentación para dividir documentos grandes en porciones más pequeñas que se ajusten a los límites simbólicos de los LLM. Por otro lado, las incrustaciones se emplean en PNL principalmente para capturar el significado semántico de las palabras y sus relaciones con otras palabras en un espacio de alta dimensión. Estas incrustaciones transforman palabras en vectores, lo que permite que los modelos procesen y comprendan datos textuales de manera eficiente. Al comprender los matices semánticos entre palabras y frases, las incorporaciones permiten a los LLM generar resultados coherentes y contextualmente relevantes. Tenga en cuenta los siguientes términos clave:

- Chunking – Este proceso divide grandes cantidades de texto de documentos en fragmentos de texto más pequeños y significativos.

- incrustaciones – Estas son transformaciones vectoriales de dimensión fija de cada fragmento que retienen la información semántica de los fragmentos. Estas incrustaciones se cargan posteriormente en una base de datos vectorial.

- Base de datos vectorial – Esta es una base de datos de incrustaciones de palabras o vectores que representan el contexto de las palabras. Actúa como una fuente de conocimiento que ayuda a las tareas de PNL en los procesos de procesamiento de documentos. El beneficio de la base de datos vectorial aquí es que permite proporcionar solo el contexto necesario a los LLM durante la generación de texto, como explicamos en la siguiente sección.

RAG utiliza el poder de las incrustaciones para comprender y recuperar segmentos de documentos relevantes durante la fase de recuperación. Al hacerlo, RAG puede trabajar dentro de las limitaciones simbólicas de los LLM, garantizando que se seleccione la información más pertinente para su generación, lo que da como resultado resultados más precisos y contextualmente relevantes.

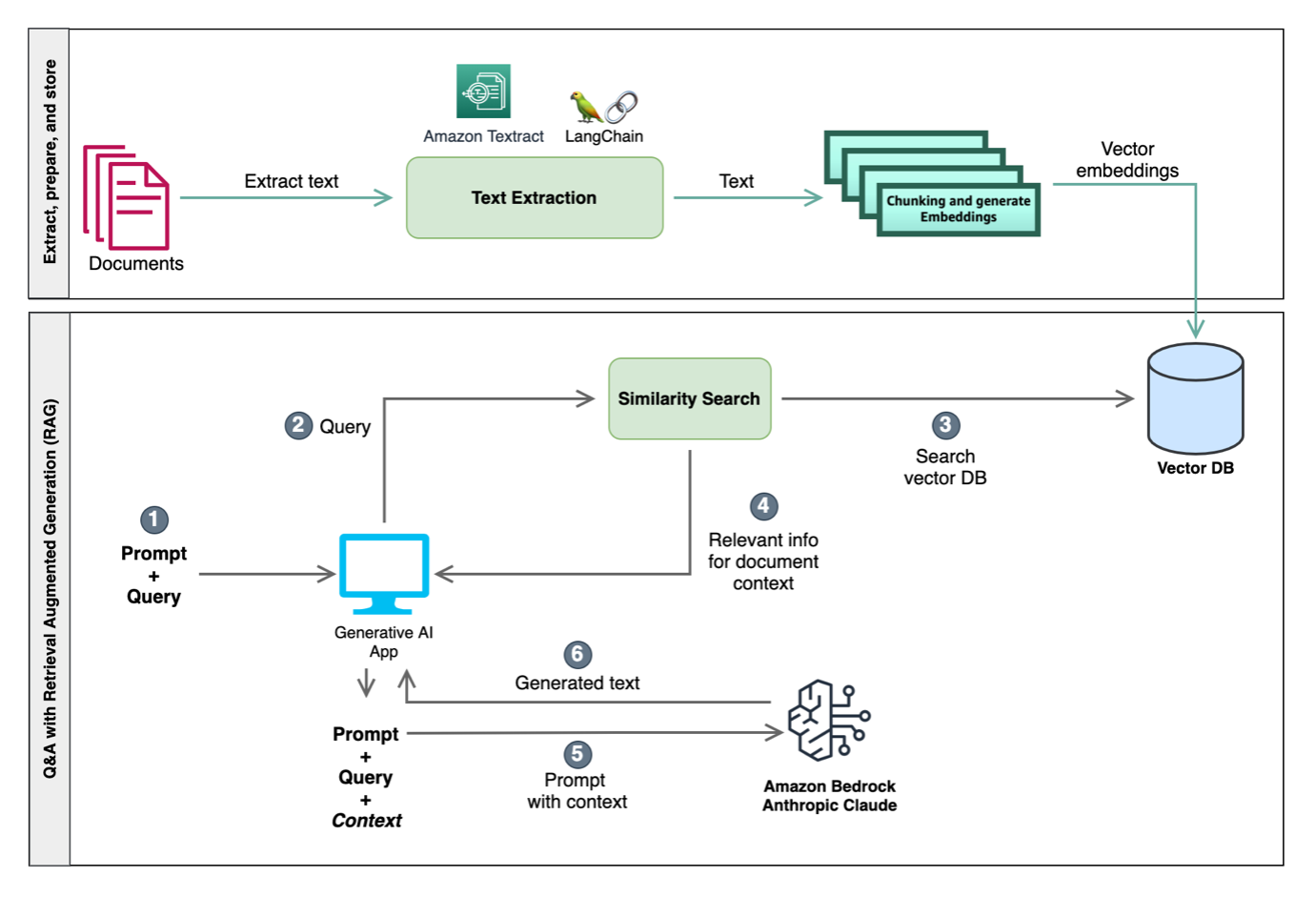

El siguiente diagrama ilustra la integración de estas técnicas para elaborar los aportes a los LLM, mejorando su comprensión contextual y permitiendo respuestas en contexto más relevantes. Un enfoque implica la búsqueda de similitudes, utilizando tanto una base de datos vectorial como fragmentación. La base de datos vectorial almacena incrustaciones que representan información semántica y la fragmentación divide el texto en secciones manejables. Utilizando este contexto de búsqueda de similitudes, los LLM pueden ejecutar tareas como responder preguntas y operaciones específicas de dominio como clasificación y enriquecimiento.

Para esta publicación, utilizamos un enfoque basado en RAG para realizar preguntas y respuestas en contexto con documentos. En el siguiente ejemplo de código, extraemos texto de un documento y luego dividimos el documento en fragmentos de texto más pequeños. Se requiere fragmentación porque es posible que tengamos documentos grandes de varias páginas y nuestros LLM pueden tener límites de tokens. Luego, estos fragmentos se cargan en la base de datos de vectores para realizar una búsqueda de similitud en los pasos siguientes. En el siguiente ejemplo, utilizamos el modelo Amazon Titan Embed Text v1, que realiza la incrustación vectorial de los fragmentos del documento:

El código crea un contexto relevante para el LLM utilizando los fragmentos de texto que devuelve la acción de búsqueda de similitudes de la base de datos de vectores. Para este ejemplo, utilizamos un código abierto. Tienda de vectores FAISS como una base de datos de vectores de muestra para almacenar incrustaciones de vectores de cada fragmento de texto. Luego definimos la base de datos vectorial como Perro perdiguero de LangChain, que se pasa al RetrievalQA cadena. Esto ejecuta internamente una consulta de búsqueda de similitud en la base de datos de vectores que devuelve los n primeros fragmentos de texto (donde n=3 en nuestro ejemplo) que son relevantes para la pregunta. Finalmente, la cadena LLM se ejecuta con el contexto relevante (un grupo de fragmentos de texto relevantes) y la pregunta que debe responder el LLM. Para obtener un tutorial paso a paso sobre el código de preguntas y respuestas con RAG, consulte el cuaderno de Python en GitHub.

Como alternativa a FAISS, también puede utilizar Capacidades de base de datos vectoriales de Amazon OpenSearch Service, Servicio de base de datos relacional de Amazon (Amazon RDS) para PostgreSQL con el pgvector extensión como bases de datos vectoriales o Chroma Database de código abierto.

Preguntas y respuestas con datos tabulares

Los datos tabulares dentro de los documentos pueden ser difíciles de procesar para los LLM debido a su complejidad estructural. Amazon Textract se puede complementar con LLM porque permite extraer tablas de documentos en un formato anidado de elementos como páginas, tablas y celdas. Realizar preguntas y respuestas con datos tabulares es un proceso de varios pasos y se puede lograr mediante autoconsulta. La siguiente es una descripción general de los pasos:

- Extraiga tablas de documentos utilizando Amazon Textract. Con Amazon Textract, la estructura tabular (filas, columnas, encabezados) se puede extraer de un documento.

- Almacene los datos tabulares en una base de datos vectorial junto con información de metadatos, como los nombres de los encabezados y la descripción de cada encabezado.

- Utilice el mensaje para construir una consulta estructurada, utilizando un LLM, para derivar los datos de la tabla.

- Utilice la consulta para extraer los datos de la tabla relevantes de la base de datos vectorial.

Por ejemplo, en un extracto bancario, ante el mensaje "¿Cuáles son las transacciones con más de $1000 en depósitos?", el LLM completaría los siguientes pasos:

- Elaborar una consulta, como

“Query: transactions” , “filter: greater than (Deposit$)”. - Convierta la consulta en una consulta estructurada.

- Aplicar la consulta estructurada a la base de datos vectorial donde se almacenan los datos de nuestra tabla.

Para obtener un código de muestra paso a paso de preguntas y respuestas con tabular, consulte el cuaderno de Python en GitHub.

Plantillas y normalizaciones

En esta sección, veremos cómo utilizar técnicas de ingeniería rápida y el mecanismo integrado de LangChain para generar una salida con extracciones de un documento en un esquema específico. También realizamos cierta estandarización de los datos extraídos, utilizando las técnicas discutidas anteriormente. Comenzamos definiendo una plantilla para nuestro resultado deseado. Esto servirá como esquema y encapsulará los detalles de cada entidad que queremos extraer del texto del documento.

Tenga en cuenta que para cada una de las entidades, utilizamos la descripción para explicar qué es esa entidad para ayudar al LLM a extraer el valor del texto del documento. En el siguiente código de muestra, usamos esta plantilla para elaborar nuestro mensaje para el LLM junto con el texto extraído del documento usando AmazonTextractPDFLoader y posteriormente realizar inferencia con el modelo:

Como se puede ver, el {keys} parte del mensaje son las claves de nuestra plantilla, y el {details} Son las claves junto con su descripción. En este caso, no solicitamos explícitamente al modelo el formato de salida, excepto especificar en la instrucción que genere la salida en formato JSON. Esto funciona en su mayor parte; sin embargo, debido a que el resultado de los LLM es una generación de texto no determinista, queremos especificar el formato explícitamente como parte de la instrucción en el mensaje. Para resolver esto, podemos usar LangChain. analizador de salida estructurado módulo para aprovechar la ingeniería de avisos automatizada que ayuda a convertir nuestra plantilla a un formato de aviso de instrucciones. Usamos la plantilla definida anteriormente para generar el mensaje de instrucción de formato de la siguiente manera:

Luego usamos esta variable dentro de nuestro mensaje original como una instrucción para el LLM para que extraiga y formatee la salida en el esquema deseado haciendo una pequeña modificación en nuestro mensaje:

Hasta ahora, sólo hemos extraído los datos del documento en el esquema deseado. Sin embargo, todavía necesitamos realizar cierta estandarización. Por ejemplo, queremos que la fecha de admisión y la fecha de alta del paciente se extraigan en formato DD/MM/AAAA. En este caso aumentamos la description de la clave con la instrucción de formato:

Consulte el cuaderno de Python en GitHub para obtener un tutorial y una explicación completos paso a paso.

Correctores ortográficos y correcciones

Los LLM han demostrado habilidades notables para comprender y generar textos similares a los humanos. Una de las aplicaciones de los LLM menos discutidas pero inmensamente útiles es su potencial en las revisiones gramaticales y la corrección de oraciones en documentos. A diferencia de los correctores gramaticales tradicionales que se basan en un conjunto de reglas predefinidas, los LLM utilizan patrones que han identificado a partir de grandes cantidades de datos de texto para determinar qué constituye un lenguaje correcto o fluido. Esto significa que pueden detectar matices, contexto y sutilezas que los sistemas basados en reglas podrían pasar por alto.

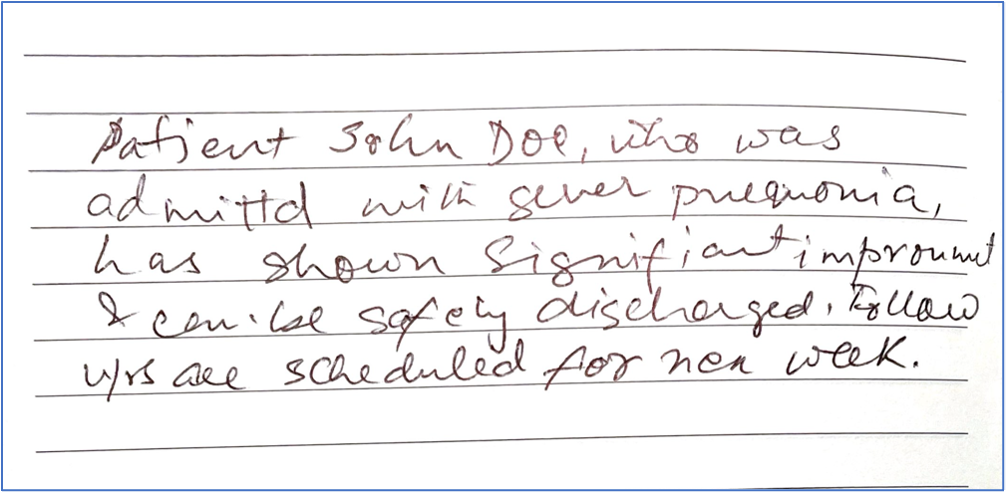

Imagine el texto extraído de un resumen de alta de un paciente que dice: “El paciente Jon Doe, que ingresó con neumonía grave, ha mostrado una mejoría significativa y puede ser dado de alta de forma segura. Los seguimientos están programados para la próxima semana”. Un corrector ortográfico tradicional podría reconocer "admitido", "neumonía", "mejora" y "nex" como errores. Sin embargo, el contexto de estos errores podría dar lugar a más errores o sugerencias genéricas. Un LLM, equipado con su amplia capacitación, podría sugerir: “El paciente John Doe, que ingresó con neumonía grave, ha mostrado una mejoría significativa y puede ser dado de alta de manera segura. Los seguimientos están programados para la próxima semana”.

El siguiente es un documento de muestra mal escrito a mano con el mismo texto explicado anteriormente.

Extraemos el documento con un cargador de documentos de Amazon Textract y luego le indicamos al LLM, mediante ingeniería rápida, que rectifique el texto extraído para corregir cualquier error ortográfico o gramatical:

El resultado del código anterior muestra el texto original extraído por el cargador de documentos seguido del texto corregido generado por el LLM:

Tenga en cuenta que, por más poderosos que sean los LLM, es esencial ver sus sugerencias simplemente como eso: sugerencias. Aunque captan impresionantemente bien las complejidades del lenguaje, no son infalibles. Algunas sugerencias pueden cambiar el significado o el tono previsto del texto original. Por lo tanto, es fundamental que los revisores humanos utilicen las correcciones generadas por el LLM como guía, no como algo absoluto. La colaboración de la intuición humana con las capacidades de LLM promete un futuro en el que nuestra comunicación escrita no sólo estará libre de errores, sino también más rica y matizada.

Conclusión

La IA generativa está cambiando la forma de procesar documentos con IDP para obtener información. En el post Mejora del procesamiento inteligente de documentos de AWS con IA generativa, analizamos las distintas etapas del proceso y cómo Ricoh, el cliente de AWS, está mejorando su proceso de IDP con LLM. En esta publicación, analizamos varios mecanismos para aumentar el flujo de trabajo de IDP con LLM a través de Amazon Bedrock, Amazon Textract y el popular marco LangChain. Puede comenzar hoy con el nuevo cargador de documentos de Amazon Textract con LangChain utilizando los cuadernos de muestra disponibles en nuestro Repositorio GitHub. Para obtener más información sobre cómo trabajar con IA generativa en AWS, consulte Anuncio de nuevas herramientas para compilar con IA generativa en AWS.

Acerca de los autores

sonali sahu lidera el procesamiento inteligente de documentos con el equipo de servicios de AI/ML en AWS. Es autora, líder intelectual y tecnóloga apasionada. Su área principal de enfoque es la IA y el ML, y con frecuencia habla en conferencias y reuniones de IA y ML en todo el mundo. Tiene una amplia y profunda experiencia en tecnología y la industria de la tecnología, con experiencia en la industria de la salud, el sector financiero y los seguros.

sonali sahu lidera el procesamiento inteligente de documentos con el equipo de servicios de AI/ML en AWS. Es autora, líder intelectual y tecnóloga apasionada. Su área principal de enfoque es la IA y el ML, y con frecuencia habla en conferencias y reuniones de IA y ML en todo el mundo. Tiene una amplia y profunda experiencia en tecnología y la industria de la tecnología, con experiencia en la industria de la salud, el sector financiero y los seguros.

anjan biswas es un arquitecto sénior de soluciones de servicios de IA con un enfoque en IA/ML y análisis de datos. Anjan es parte del equipo mundial de servicios de IA y trabaja con los clientes para ayudarlos a comprender y desarrollar soluciones a los problemas comerciales con IA y ML. Anjan tiene más de 14 años de experiencia trabajando con organizaciones globales de cadena de suministro, fabricación y venta al por menor, y está ayudando activamente a los clientes a comenzar y escalar en los servicios de IA de AWS.

anjan biswas es un arquitecto sénior de soluciones de servicios de IA con un enfoque en IA/ML y análisis de datos. Anjan es parte del equipo mundial de servicios de IA y trabaja con los clientes para ayudarlos a comprender y desarrollar soluciones a los problemas comerciales con IA y ML. Anjan tiene más de 14 años de experiencia trabajando con organizaciones globales de cadena de suministro, fabricación y venta al por menor, y está ayudando activamente a los clientes a comenzar y escalar en los servicios de IA de AWS.

Rane Chinmayee es un arquitecto de soluciones especializado en IA/ML en Amazon Web Services. Le apasionan las matemáticas aplicadas y el aprendizaje automático. Se centra en el diseño de procesamiento inteligente de documentos y soluciones de inteligencia artificial generativa para clientes de AWS. Fuera del trabajo, le gusta bailar salsa y bachata.

Rane Chinmayee es un arquitecto de soluciones especializado en IA/ML en Amazon Web Services. Le apasionan las matemáticas aplicadas y el aprendizaje automático. Se centra en el diseño de procesamiento inteligente de documentos y soluciones de inteligencia artificial generativa para clientes de AWS. Fuera del trabajo, le gusta bailar salsa y bachata.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :posee

- :es

- :no

- :dónde

- .nexo

- $1000

- $ UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- <del>

- Nuestra Empresa

- Absoluto

- de la máquina

- visitada

- Conforme

- la exactitud

- preciso

- alcanzado

- a través de

- la columna Acción

- acciones

- activamente

- actividad

- hechos

- Ad

- dirección

- Añade

- adherirse

- admitir

- aceptado

- avances

- Ventaja

- adviento

- edad

- agentes

- AI

- Servicios de IA

- AI / ML

- alineado

- Todos

- Permitir

- permite

- a lo largo de

- también

- alternativa

- Aunque

- Amazon

- Amazon Comprehend

- RDS de Amazon

- Amazon Textil

- Amazon Web Services

- cantidades

- an

- Analytics

- analizar

- y

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- Antrópico

- cualquier

- API

- aplicaciones

- aplicada

- citas

- enfoque

- arquitectura

- somos

- Reservada

- en torno a

- Arte

- artificial

- inteligencia artificial

- Inteligencia Artificial (AI)

- AS

- aspecto

- ayudar

- Legal

- At

- aumentar

- aumentado

- autor

- automatizado

- Confirmación de Viaje

- automáticamente

- Automatización

- Hoy Disponibles

- conciencia

- AWS

- Cliente de AWS

- Banca

- BE

- porque

- se convierte en

- esto

- antes

- beneficioso

- es el beneficio

- MEJOR

- y las mejores prácticas

- entre

- Bloquear

- Bloques

- ambas

- amplitud

- Descanso

- rompe

- build

- Construir la

- incorporado

- negocios

- pero

- by

- Calls

- PUEDEN

- Puede conseguir

- capacidades

- capturar

- case

- cases

- Células

- a ciertos

- cadena

- cadenas

- Reto

- desafiante

- el cambio

- Cambios

- cambio

- Cheques

- manera?

- reclamaciones

- clase

- privadas

- clasificación

- clasificar

- código

- COHERENTE

- colaboración

- Columna

- Columnas

- combinación

- combinar

- proviene

- Algunos

- comúnmente

- Comunicación

- compatible

- completar

- integraciones

- complejidad

- comprender

- conciso

- conferencias

- Conectándote

- consistente

- consiste

- restricciones

- construir

- que no contengo

- contenida

- contiene

- contenido

- contexto

- contextual

- convertir

- Core

- correcta

- corregido

- correcciones

- podría

- arte

- Elaborado

- crea

- crucial

- personalizado

- cliente

- Clientes

- danza

- datos

- Data Analytics

- Base de datos

- bases de datos

- Fecha

- Fechas

- acuerdo

- profundo

- más profundo

- definir

- se define

- definir

- demostrado

- Dependiente

- XNUMX%

- profundidad

- descrito

- descripción

- diseño

- deseado

- detalle

- detallado

- detalles

- detectar

- Determinar

- desarrollar

- desarrolladores

- Dieta

- una experiencia diferente

- directamente

- discutir

- discutido

- inmersión

- dividir

- divide

- do

- Médico

- documento

- documentación

- documentos

- gama

- No

- "Hacer"

- don

- hecho

- No

- DE INSCRIPCIÓN

- dramáticamente

- dos

- durante

- lugar de trabajo dinámico

- e

- cada una

- Más temprano

- pasan fácilmente

- fácil de usar

- de manera eficaz

- eficiencia

- eficiente

- eficiente.

- esfuerzos

- ya sea

- elementos

- incrustar

- empleado

- empodera

- habilitar

- permite

- permitiendo

- final

- Ingeniería

- mejorar

- mejorado

- mejorar

- garantizar

- asegurando que

- Todo

- entidades

- entidad

- equipado

- Errores

- esencial

- Incluso

- ejemplo

- Excepto

- excepción

- existente

- experience

- Experiencia

- Explicar

- explicado

- Explica

- explicación

- explícitamente

- expresión

- ampliar

- extensión

- en los detalles

- extraerlos

- Extracción

- Extractos

- Otoño

- false

- muchos

- fatiga

- Terrenos

- Figura

- final

- Finalmente

- financiero

- Sector financiero

- Nombre

- cómodo

- Focus

- se centra

- seguir

- seguido

- siguiendo

- siguiente

- formato

- Formularios

- encontrado

- Fundación

- Marco conceptual

- Gratis

- frecuentemente

- Desde

- frontera

- ser completados

- completamente

- promover

- futuras

- General

- generar

- generado

- genera

- la generación de

- generación de AHSS

- generativo

- IA generativa

- obtener

- Donar

- dado

- Buscar

- gramática

- agarrar

- mayor

- Grupo procesos

- guía

- mano

- encargarse de

- suceder

- En Curso

- Materiales

- Tienen

- cabeceras

- la salud

- fuertemente

- ayuda

- serviciales

- ayudando

- ayuda

- aquí

- esta página

- de alto nivel

- alto rendimiento

- más alto

- mantiene

- hospital

- Cómo

- Como Hacer

- Sin embargo

- HTML

- HTTPS

- humana

- i

- ID

- no haber aun identificado una solucion para el problema

- if

- ilustra

- imagen

- inmensamente

- Impacto

- importar

- importante

- importador

- impuesta

- es la mejora continua

- in

- Incluye

- índice

- energético

- información

- Edad de información

- Innovation

- Las opciones de entrada

- Insights

- ejemplo

- Instrucciones

- aseguradora

- integrar

- COMPLETAMENTE

- Integración

- integración

- Intelligence

- De Operación

- Procesamiento inteligente de documentos

- Destinado a

- internamente

- dentro

- complejidades

- introducir

- Introducido

- Presenta

- IT

- SUS

- Jackson

- Juan

- JOHN DOE

- jon

- jpg

- json

- solo

- Clave

- claves

- Saber

- especialistas

- conocido

- idioma

- large

- Disposición

- Lead

- líder

- líder

- aprendizaje

- dejarlo

- Biblioteca

- como

- que otros

- limitaciones

- límites

- Lista

- LLM

- carga

- cargador

- lógica

- Mira

- Lote

- máquina

- máquina de aprendizaje

- Realizar

- gestionan

- manejable

- gestionado

- administrar

- manual

- Fabricación

- marcado

- matemáticas

- Puede..

- me

- sentido

- significativo

- significa

- mecanismo

- los mecanismos de

- Meetups

- Salud Cerebral

- Meta

- metadatos

- Método

- métodos

- podría

- mente

- perder

- errores

- ML

- modelo

- modelos

- Módulo

- más,

- Intermediación hipotecaria

- MEJOR DE TU

- múltiples

- nombre

- nombres

- Natural

- Procesamiento natural del lenguaje

- necesario

- ¿ Necesita ayuda

- Nuevo

- Next

- la próxima semana

- nlp

- cuaderno

- ahora

- matices

- número

- objeto

- objetos

- of

- Ofertas

- a menudo

- on

- ONE

- , solamente

- de código abierto

- Operaciones

- Oportunidad

- óptimo

- Opciones

- or

- para las fiestas.

- reconocida por

- Otro

- de otra manera

- "nuestr

- salir

- Resultado

- salida

- salidas

- afuera

- Más de

- visión de conjunto

- paquetes

- página

- paginas

- Dolor

- emparejado

- pares

- parte

- particularmente

- pass

- pasado

- Pasando (Paso)

- apasionado

- camino

- paciente

- Patrón de Costura

- .

- (PDF)

- para

- Realizar

- actuación

- realizado

- realizar

- realiza

- fase

- Doctor en Filosofía

- frases

- industrial

- plan

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Por favor

- neumonía

- puntos

- Popular

- posible

- Publicación

- posible

- industria

- alimentado

- poderoso

- prácticas

- precisamente

- Precisión

- preferido

- presente

- previamente

- las cuales

- Imprimir

- huellas dactilares

- Problema

- problemas

- Procesado

- tratamiento

- producir

- Promete

- apropiado

- proporcionar

- previsto

- proveedor

- proporciona un

- Python

- Q&A

- calidad

- pregunta

- Búsqueda

- con rapidez

- Crudo

- Reading

- reconocer

- la reducción de

- remitir

- referencia

- referido

- Relaciones

- confiar

- confiando

- relevantes

- reporte

- representar

- que representa

- Requisitos

- requiere

- respectivamente

- respuestas

- restricciones

- resultado

- resultante

- Resultados

- el comercio minorista

- conservar

- retención

- devoluciones

- Rico

- Conferencia

- reglas

- Ejecutar

- corre

- s

- de manera segura

- mismo

- dices

- Escala

- escenarios

- programada

- Buscar

- Segundo

- Sección

- (secciones)

- sector

- ver

- segmentos

- seleccionado

- mayor

- sentencia

- Serie

- ayudar

- sirve

- de coches

- Servicios

- set

- grave

- ella

- En Corto

- tienes

- mostrado

- Shows

- importante

- soltero

- chica

- menores

- retazo

- So

- únicamente

- Soluciones

- RESOLVER

- algo

- Fuente

- Espacio

- Habla

- especialista

- soluciones y

- específicamente

- especificado

- ortografía

- dividido

- etapas

- estandarización

- comienzo

- fundó

- el estado de la técnica

- Posicionamiento

- paso

- pasos

- Sin embargo

- tienda

- almacenados

- tiendas

- fortalezas

- Cordón

- estructural

- estructura

- estructurado

- Luchar

- posterior

- Después

- tal

- sugieren

- resumir

- RESUMEN

- suministro

- cadena de suministro

- SOPORTE

- soportes

- sinergia

- Todas las funciones a su disposición

- mesa

- ¡Prepárate!

- toma

- Tarea

- tareas

- equipo

- la técnica

- técnicas

- tecnólogo

- Tecnología

- plantilla

- términos

- texto

- textual

- que

- esa

- La

- el mundo

- su

- Les

- luego

- Ahí.

- por lo tanto

- Estas

- ellos

- así

- pensamiento

- Tres

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- titán

- a

- hoy

- de hoy

- juntos

- ficha

- Tokens

- TONO

- parte superior

- Total

- tradicional

- arrastrando

- Formación

- Transacciones

- Transformar

- transformaciones

- verdadero

- try

- dos

- tipo

- tipos

- entender

- comprensión

- diferente a

- develar

- Enlance

- utilizan el

- caso de uso

- usado

- usuarios

- usos

- usando

- utilizado

- Utilizando

- v1

- propuesta de

- Valores

- variable

- diversos

- Vasto

- versátil

- versión

- vía

- Ver

- volúmenes

- tutorial

- quieres

- fue

- Camino..

- we

- web

- servicios web

- semana

- WELL

- ¿

- cuando

- que

- mientras

- QUIENES

- seguirá

- dentro de

- sin

- fue testigo de

- Palabra

- palabras

- Actividades:

- flujo de trabajo

- flujos de trabajo

- trabajando

- funciona

- mundo

- se

- escrito

- X

- años

- Usted

- zephyrnet