Tehisintellekt (AI) on muutunud tehnoloogiakogukonnas oluliseks ja populaarseks teemaks. AI arenedes oleme näinud erinevat tüüpi masinõppe (ML) mudeleid. Üks lähenemine, tuntud kui ansambli modelleerimine, on andmeteadlaste ja praktikute seas kiiresti tuntust kogunud. Selles postituses arutleme, millised on ansamblimudelid ja miks nende kasutamine võib olla kasulik. Seejärel anname näite selle kohta, kuidas saate oma kohandatud ansambleid kasutades treenida, optimeerida ja juurutada Amazon SageMaker.

Ansambelõpe viitab mitme õppemudeli ja algoritmi kasutamisele täpsemate prognooside saamiseks kui ükski individuaalne õppealgoritm. Need on osutunud tõhusateks erinevates rakendustes ja õppeseadetes, nagu küberturvalisus [1] ja pettuste tuvastamine, kaugseire, parimate järgmiste sammude ennustamine finantsotsuste tegemisel, meditsiiniline diagnoos ja isegi arvutinägemine ja loomuliku keele töötlemine (NLP). ülesandeid. Me kipume rühmitama ansambleid nende treenimiseks kasutatud tehnikate, koostise ja selle järgi, kuidas nad ühendavad erinevad ennustused üheks järelduseks. Nende kategooriate hulka kuuluvad:

- Elavdamine – Mitme nõrga õppija järjestikuse koolitamine, kus igale eelnevate õppijate valele ennustusele antakse järgmisele õppijale suurem kaal ja sisend, luues seeläbi tugevama õppija. Näiteks AdaBoost, Gradient Boosting ja XGBoost.

- Bagging – Kasutab mitut mudelit, et vähendada ühe mudeli dispersiooni. Näited hõlmavad Random Forest ja Extra Trees.

- Virnastamine (segamine) – Kasutab sageli heterogeenseid mudeleid, kus iga üksiku hindaja ennustused on virnastatud ja neid kasutatakse prognoosiga tegeleva lõpliku hindaja sisendina. Selle lõpliku hindaja koolitusprotsessis kasutatakse sageli ristvalideerimist.

Prognooside üheks kombineerimiseks, mille mudel lõpuks loob, on mitu meetodit, näiteks kasutades metahindajat, nagu lineaarne õppija, hääletusmeetod, mis kasutab mitut mudelit, et teha ennustus, mis põhineb klassifitseerimisülesannete häälteenamusel. või regressiooni keskmistav ansambel.

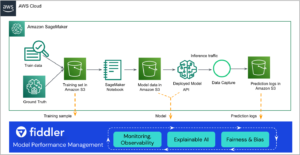

Kuigi mitmed teegid ja raamistikud pakuvad ansamblimudelite rakendusi, nagu XGBoost, CatBoost või scikit-learn’i juhuslik mets, keskendume selles postituses teie enda mudelite toomisele ja nende virnastamisansamblina kasutamisele. Selle asemel, et kasutada iga mudeli jaoks spetsiaalseid ressursse (spetsiaalsed koolitus- ja häälestustööd ning lõpp-punktide hostimine mudeli kohta), treenime, häälestame ja juurutame kohandatud komplekti (mitu mudelit), kasutades ühte SageMakeri koolitustööd ja üht häälestustööd. juurutada ühte lõpp-punkti, vähendades seeläbi võimalikke kulusid ja tegevuskulusid.

BYOE: Tooge oma ansambel

Heterogeensete ansamblimudelite treenimiseks ja juurutamiseks SageMakeriga on mitu võimalust: saate iga mudelit treenida eraldi koolitustöö ja optimeerige iga mudelit eraldi kasutades Amazon SageMakeri automaatne mudeli häälestamine. Nende mudelite majutamisel pakub SageMaker erinevaid kulutõhusaid viise mitme mudeli majutamiseks samas rentniku infrastruktuuris. Seda tüüpi seadete üksikasjalikud juurutusmustrid leiate aadressilt Mudelite hostimismustrid rakenduses Amazon SageMaker, 1. osa: tavalised kujundusmustrid ML-rakenduste loomiseks Amazon SageMakeris. Need mustrid hõlmavad mitme lõpp-punkti (iga koolitatud mudeli jaoks) või ühe lõpp-punkti kasutamist mitme mudeli lõpp-punktvõi isegi üksik mitme konteineri lõpp-punkt kus konteinereid saab kutsuda üksikult või aheldatuna torujuhtmesse. Kõik need lahendused sisaldavad metahinnangut (näiteks an AWS Lambda funktsioon), mis kutsub esile iga mudeli ja rakendab segamis- või hääletamisfunktsiooni.

Mitme treeningtöö tegemine võib aga tekitada töö- ja kulukulusid, eriti kui teie ansambel vajab samade andmetega treenimist. Sarnaselt nõuab erinevate mudelite hostimine eraldi lõpp-punktides või konteinerites ja nende prognoositulemuste kombineerimine suurema täpsuse huvides mitut väljakutsumist ning seepärast toob see kaasa täiendavaid haldus-, kulusid ja jälgimiskulusid. Näiteks toetab SageMaker Ensemble ML mudelid kasutades Triton Inference Server, kuid see lahendus eeldab, et mudeleid või mudeliansambleid toetaks Tritoni taustaprogramm. Lisaks on kliendilt vaja täiendavaid jõupingutusi Tritoni serveri seadistamiseks ja täiendavat õppimist, et mõista, kuidas erinevad Tritoni taustaprogrammid töötavad. Seetõttu eelistavad kliendid lahenduste juurutamiseks sirgjoonelisemat viisi, kus neil on vaja ainult üks kord lõpp-punktile kutse saata ja neil on paindlikkus kontrollida, kuidas tulemused lõpliku väljundi genereerimiseks koondatakse.

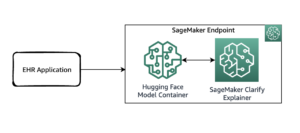

Lahenduse ülevaade

Nende probleemide lahendamiseks vaatame läbi näite ansamblikoolitusest, kasutades üht treeningtööd, optimeerides mudeli hüperparameetreid ja juurutades selle ühe konteineri abil serverita lõpp-punkti. Kasutame oma ansamblite virna jaoks kahte mudelit: CatBoost ja XGBoost (mõlemad on võimenduskomplektid). Oma andmete jaoks kasutame diabeedi andmestik [2] scikit-learni raamatukogust: see koosneb 10 tunnusest (vanus, sugu, kehamass, vererõhk ja kuus vereseerumi mõõtmist) ning meie mudel ennustab haiguse progresseerumist 1 aasta pärast algtaseme tunnuste kogumist (regressioon). mudel).

Täieliku koodihoidla leiate aadressilt GitHub.

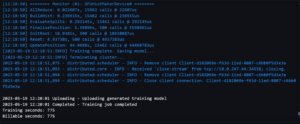

Treenige mitu mudelit ühe SageMakeri tööga

Oma mudelite koolitamiseks kasutame SageMakeri koolitustöid skriptirežiimis. Skriptirežiimiga saate SageMakeri raamistiku konteinereid kasutades kirjutada kohandatud koolitust (ja hilisemat järelduskoodi). Raamkonteinerid võimaldavad kasutada AWS-i hallatavaid valmiskeskkondi, mis sisaldavad kõiki vajalikke konfiguratsioone ja mooduleid. Raamikonteineri kohandamise demonstreerimiseks kasutame näiteks eelehitatud SKLearni konteinerit, mis ei sisalda pakette XGBoost ja CatBoost. Nende pakettide lisamiseks on kaks võimalust: kas pikendage sisseehitatud konteinerit installida CatBoost ja XGBoost (ja seejärel juurutada kohandatud konteinerina) või kasutada SageMakeri koolitustöö skriptirežiimi funktsiooni, mis võimaldab teil pakkuda requirements.txt faili treeninguhinnangu loomisel. SageMakeri koolitustöö installib loetletud teegid requirements.txt faili käitamise ajal. Nii ei pea te ise oma Dockeri pildihoidlat haldama ja see pakub täiendavaid Pythoni pakette vajavate treeningskriptide käitamiseks suuremat paindlikkust.

Järgmine koodiplokk näitab koodi, mida kasutame treeningu alustamiseks. The entry_point parameeter osutab meie treeningskriptile. Kasutame ka kahte SageMaker SDK API mõjuvat funktsiooni:

- Esiteks määrame lähtekataloogi kohaliku tee ja sõltuvused

source_dirjadependenciesparameetrid vastavalt. SDK tihendab ja laadib need kataloogid üles Amazoni lihtne salvestusteenus (Amazon S3) ja SageMaker teevad need töökataloogi koolituseksemplaris kättesaadavaks/opt/ml/code. - Teiseks kasutame SDK-d

SKLearnhindajaobjekt meie eelistatud Pythoni ja raamistiku versiooniga, nii et SageMaker tõmbab vastava konteineri. Samuti oleme määratlenud kohandatud koolitusmõõdiku "validation:rmse“, mis väljastatakse treeninglogidesse ja jäädvustab SageMaker. Hiljem kasutame seda mõõdikut häälestustöös objektiivse mõõdikuna.

hyperparameters = {"num_round": 6, "max_depth": 5}

estimator_parameters = {

"entry_point": "multi_model_hpo.py",

"source_dir": "code",

"dependencies": ["my_custom_library"],

"instance_type": training_instance_type,

"instance_count": 1,

"hyperparameters": hyperparameters,

"role": role,

"base_job_name": "xgboost-model",

"framework_version": "1.0-1",

"keep_alive_period_in_seconds": 60,

"metric_definitions":[

{'Name': 'validation:rmse', 'Regex': 'validation-rmse:(.*?);'}

]

}

estimator = SKLearn(**estimator_parameters)Järgmisena kirjutame oma koolituse skripti (multi_model_hpo.py). Meie skript järgib lihtsat voolu: jäädvustada hüperparameetreid millega töö konfigureeriti ja treenige CatBoosti mudelit ja XGBoost mudel. Samuti rakendame a k-kordne rist valideerimisfunktsioon. Vaadake järgmist koodi:

if __name__ == "__main__":

parser = argparse.ArgumentParser() # Sagemaker specific arguments. Defaults are set in the environment variables.

parser.add_argument("--output-data-dir", type=str, default=os.environ["SM_OUTPUT_DATA_DIR"])

parser.add_argument("--model-dir", type=str, default=os.environ["SM_MODEL_DIR"])

parser.add_argument("--train", type=str, default=os.environ["SM_CHANNEL_TRAIN"])

parser.add_argument("--validation", type=str, default=os.environ["SM_CHANNEL_VALIDATION"])

.

.

.

"""

Train catboost

"""

K = args.k_fold

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}

rmse_list, model_catboost = cross_validation_catboost(train_df, K, catboost_hyperparameters)

.

.

.

"""

Train the XGBoost model

""" hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

"objective": args.objective,

"num_round": args.num_round,

} rmse_list, model_xgb = cross_validation(train_df, K, hyperparameters)Pärast mudelite koolitamist arvutame nii CatBoosti kui ka XGBoosti ennustuste keskmise. Tulemus, pred_mean, on meie ansambli viimane ennustus. Seejärel määrame kindlaks mean_squared_error vastu valideerimiskomplekti. val_rmse kasutatakse kogu ansambli hindamiseks treeningu ajal. Pange tähele, et prindime ka RMSE väärtuse mustrina, mis sobib regexiga, mida kasutasime metric_definitions. Hiljem kasutab SageMakeri automaatne mudeli häälestamine seda objektiivse mõõdiku jäädvustamiseks. Vaadake järgmist koodi:

pred_mean = np.mean(np.array([pred_catboost, pred_xgb]), axis=0)

val_rmse = mean_squared_error(y_validation, pred_mean, squared=False)

print(f"Final evaluation result: validation-rmse:{val_rmse}")Lõpuks salvestab meie skript mõlemad mudeli artefaktid väljundkausta, mis asub aadressil /opt/ml/model.

Kui koolitustöö on lõpetatud, pakendab ja kopeerib SageMaker selle sisu /opt/ml/model kataloogi ühe objektina tihendatud TAR-vormingus S3 asukohta, mille määrasite töö konfiguratsioonis. Meie puhul koondab SageMaker kaks mudelit TAR-faili ja laadib selle koolitustöö lõpus Amazon S3-sse. Vaadake järgmist koodi:

model_file_name = 'catboost-regressor-model.dump'

# Save CatBoost model

path = os.path.join(args.model_dir, model_file_name)

print('saving model file to {}'.format(path))

model.save_model(path)

.

.

.

# Save XGBoost model

model_location = args.model_dir + "/xgboost-model"

pickle.dump(model, open(model_location, "wb"))

logging.info("Stored trained model at {}".format(model_location))Kokkuvõttes peaksite märkama, et selle protseduuri käigus laadisime andmed alla ühe korra ja koolitasime kahte mudelit ühe koolitustööga.

Automaatne ansamblimudeli häälestamine

Kuna me koostame ML-mudelite kogu, on kõigi võimalike hüperparameetrite permutatsioonide uurimine ebapraktiline. SageMaker pakub Automaatne mudeli häälestamine (AMT), mis otsib parimaid mudeli hüperparameetreid, keskendudes kõige paljutõotavamatele väärtuste kombinatsioonidele teie määratud vahemikes (teie otsustada on õiged vahemikud, mida uurida). SageMaker toetab mitut optimeerimismeetodit Et saaksite valida.

Alustuseks määratleme optimeerimisprotsessi kaks osa: objektiivne mõõdik ja hüperparameetrid, mida tahame häälestada. Meie näites kasutame sihtmõõdikuna valideerimis-RMSE-d ja häälestame eta ja max_depth (muude hüperparameetrite kohta vt XGBoost hüperparameetrid ja CatBoosti hüperparameetrid):

from sagemaker.tuner import (

IntegerParameter,

ContinuousParameter,

HyperparameterTuner,

) hyperparameter_ranges = {

"eta": ContinuousParameter(0.2, 0.3),

"max_depth": IntegerParameter(3, 4)

}

metric_definitions = [{"Name": "validation:rmse", "Regex": "validation-rmse:([0-9.]+)"}]

objective_metric_name = "validation:rmse"Samuti peame tagama koolituse skript et meie hüperparameetrid ei ole kõvakodeeritud ja on võetud SageMakeri käitusaja argumentidest:

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}SageMaker kirjutab hüperparameetrid ka JSON-faili ja neid saab lugeda /opt/ml/input/config/hyperparameters.json koolituse näitel.

Nagu CatBoost, jäädvustame ka XGBoosti mudeli hüperparameetrid (pange tähele, et objective ja num_round pole häälestatud):

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}Lõpuks käivitame hüperparameetrite häälestustöö, kasutades järgmisi konfiguratsioone:

tuner = HyperparameterTuner(

estimator,

objective_metric_name,

hyperparameter_ranges,

max_jobs=4,

max_parallel_jobs=2,

objective_type='Minimize'

)

tuner.fit({"train": train_location, "validation": validation_location}, include_cls_metadata=False)Kui töö on lõpetatud, saate hankida parima koolitustöö väärtused (minimaalse RMSE-ga):

job_name=tuner.latest_tuning_job.name

attached_tuner = HyperparameterTuner.attach(job_name)

attached_tuner.describe()["BestTrainingJob"]AMT kohta lisateabe saamiseks vaadake Tehke SageMakeriga automaatne mudeli häälestamine.

Deployment

Oma kohandatud ansambli juurutamiseks peame esitama skripti, mis käsitleb järelduspäringut ja konfigureerib SageMakeri hostimise. Selles näites kasutasime ühte faili, mis sisaldab nii koolitus- kui ka järelduskoodi (multi_model_hpo.py). SageMaker kasutab koodi all if _ name _ == "_ main _" koolituse ja funktsioonide jaoks model_fn, input_fnja predict_fn mudeli juurutamisel ja teenindamisel.

Järeldusskript

Nagu koolituse puhul, kasutame ka SageMaker SKLearni raamistiku konteinerit koos oma järeldusskriptiga. Skript rakendab kolme SageMakeri nõutavat meetodit.

Esiteks model_fn meetod loeb meie salvestatud mudeliartefaktifailid ja laadib need mällu. Meie puhul tagastab meetod meie ansambli kui all_model, mis on Pythoni loend, kuid võite kasutada ka sõnastikku, kus on klahvidena mudelinimed.

def model_fn(model_dir):

catboost_model = CatBoostRegressor()

catboost_model.load_model(os.path.join(model_dir, model_file_name))

model_file = "xgboost-model"

model = pickle.load(open(os.path.join(model_dir, model_file), "rb"))

all_model = [catboost_model, model]

return all_modelTeiseks, input_fn meetod deserialiseerib päringu sisendandmed, mis edastatakse meie järelduste töötlejale. Lisateavet sisendtöötlejate kohta leiate aadressilt Oma järelduskonteineri kohandamine.

def input_fn(input_data, content_type):

dtype=None

payload = StringIO(input_data)

return np.genfromtxt(payload, dtype=dtype, delimiter=",")Kolmandaks predict_fn meetod vastutab mudelitelt prognooside saamise eest. Meetod võtab mudeli ja tagastatud andmed input_fn parameetritena ja tagastab lõpliku ennustuse. Meie näites saame CatBoosti tulemuse mudeliloendi esimesest liikmest (model[0]) ja XGBoost teisest liikmest (model[1]) ja kasutame segamisfunktsiooni, mis tagastab mõlema ennustuse keskmise:

def predict_fn(input_data, model):

predictions_catb = model[0].predict(input_data)

dtest = xgb.DMatrix(input_data)

predictions_xgb = model[1].predict(dtest,

ntree_limit=getattr(model, "best_ntree_limit", 0),

validate_features=False)

return np.mean(np.array([predictions_catb, predictions_xgb]), axis=0)Nüüd, kui meil on väljaõppinud mudelid ja järeldusskript, saame konfigureerida keskkonna oma ansambli juurutamiseks.

SageMaker serverita järeldus

Kuigi on olemas SageMakeris palju hostimisvõimalusi, selles näites kasutame serverita lõpp-punkti. Serverita lõpp-punktid käivitavad automaatselt arvutusressursid ning skaleerivad neid sõltuvalt liiklusest sisse ja välja. See eemaldab serverite haldamise diferentseerimata raske koormuse. See valik sobib ideaalselt töökoormuste jaoks, millel on liiklusspurtide vahel tühikäiguperioodid ja mis taluvad külmkäivitust.

Serverita lõpp-punkti konfigureerimine on lihtne, kuna me ei pea valima eksemplaritüüpe ega haldama skaleerimispoliitikaid. Peame esitama ainult kaks parameetrit: mälumaht ja maksimaalne samaaegsus. Serverita lõpp-punkt määrab automaatselt arvutusressursid proportsionaalselt teie valitud mäluga. Kui valite suurema mälumahu, on teie konteineril juurdepääs rohkematele vCPU-dele. Peaksite alati valima lõpp-punkti mälumahu vastavalt mudeli suurusele. Teine parameeter, mida peame esitama, on maksimaalne samaaegsus. Ühe lõpp-punkti jaoks saab selle parameetri seadistada kuni 200-ni (selle kirjutamise seisuga on serverita lõpp-punktide koguarvu piirang piirkonnas 50). Peaksite arvestama, et üksiku lõpp-punkti maksimaalne samaaegsus takistab sellel lõpp-punktil võtmast vastu kõiki teie konto jaoks lubatud kutseid, kuna kõik lõpp-punkti kutsed, mis ületavad maksimumi, on blokeeritud (lisateabe saamiseks kõigi serverita lõpp-punktide koguaegsuse kohta piirkonna kohta vt juurde Amazon SageMakeri lõpp-punktid ja kvoodid).

from sagemaker.serverless.serverless_inference_config import ServerlessInferenceConfig

serverless_config = ServerlessInferenceConfig(

memory_size_in_mb=6144,

max_concurrency=1,

) Nüüd, kui oleme lõpp-punkti konfigureerinud, saame lõpuks juurutada meie hüperparameetrite optimeerimistöös valitud mudeli:

estimator=attached_tuner.best_estimator()

predictor = estimator.deploy(serverless_inference_config=serverless_config)Koristage

Kuigi serverita lõpp-punktid ei maksa, kui neid ei kasutata, peaksite pärast selle näite käitamise lõpetamist lõpp-punkti kindlasti kustutama:

predictor.delete_endpoint(predictor.endpoint)Järeldus

Selles postituses käsitlesime üht lähenemist kohandatud ansambli koolitamiseks, optimeerimiseks ja juurutamiseks. Üksikasjalikult kirjeldasime ühe koolitustöö kasutamise protsessi mitme mudeli koolitamiseks, kuidas kasutada automaatset mudeli häälestamist ansambli hüperparameetrite optimeerimiseks ja kuidas juurutada ühte serverita lõpp-punkti, mis ühendab mitme mudeli järeldused.

Selle meetodi kasutamine lahendab võimalikud kulud ja tegevusprobleemid. Koolitustöö maksumus põhineb ressurssidel, mida kasutate kasutusaja jooksul. Laadides andmed alla ainult ühe korra kahe mudeli koolitamiseks, vähendasime poole võrra töö andmete allalaadimise faasi ja andmete salvestamiseks kasutatud mahtu, vähendades seeläbi koolitustöö kogumaksumust. Lisaks tegi AMT töö neli koolitustööd, millest igaühel oli eelnimetatud lühendatud aeg ja salvestusruum, mis tähendab 4-kordset kulude kokkuhoidu! Mis puudutab mudeli juurutamist serverita lõpp-punktis, siis maksate ka töödeldud andmemahu eest, kui kutsute lõpp-punkti kahe mudeli puhul ainult üks kord, maksate poole I/O andmeside tasudest.

Kuigi see postitus näitas ainult kahe mudeli eeliseid, saate seda meetodit kasutada paljude ansamblimudelite treenimiseks, häälestamiseks ja juurutamiseks, et näha veelgi suuremat efekti.

viited

[1] Raj Kumar, P. Arun; Selvakumar, S. (2011). "Hajutatud teenuse keelamise rünnaku tuvastamine närviklassifikaatori ansambli abil". Arvuti side. 34 (11): 1328–1341. doi:10.1016/j.comcom.2011.01.012.

[2] Bradley Efron, Trevor Hastie, Iain Johnstone ja Robert Tibshirani (2004) "Least Angle Regression", Annals of Statistics (koos aruteluga), 407-499. (https://web.stanford.edu/~hastie/Papers/LARS/LeastAngle_2002.pdf)

Autoritest

Melanie Li, PhD, on Austraalias Sydneys asuva AWS-i AI/ML-i vanemspetsialist TAM. Ta aitab ettevõtte klientidel luua lahendusi, mis kasutavad AWS-i tipptasemel AI/ML-i tööriistu, ning annab juhiseid masinõppelahenduste väljatöötamiseks ja rakendamiseks parimate tavadega. Vabal ajal meeldib talle õues loodust uurida ning pere ja sõpradega aega veeta.

Melanie Li, PhD, on Austraalias Sydneys asuva AWS-i AI/ML-i vanemspetsialist TAM. Ta aitab ettevõtte klientidel luua lahendusi, mis kasutavad AWS-i tipptasemel AI/ML-i tööriistu, ning annab juhiseid masinõppelahenduste väljatöötamiseks ja rakendamiseks parimate tavadega. Vabal ajal meeldib talle õues loodust uurida ning pere ja sõpradega aega veeta.

Uri Rosenberg on AI ja ML spetsialiseerunud tehniline juht Euroopas, Lähis-Idas ja Aafrikas. Iisraelist väljas asuv Uri töötab selle nimel, et anda ettevõtetele klientidele võimalus kavandada, ehitada ja hallata ML töökoormust ulatuslikult. Vabal ajal naudib ta jalgrattasõitu, matkamist ja RMSE-de minimeerimist.

Uri Rosenberg on AI ja ML spetsialiseerunud tehniline juht Euroopas, Lähis-Idas ja Aafrikas. Iisraelist väljas asuv Uri töötab selle nimel, et anda ettevõtetele klientidele võimalus kavandada, ehitada ja hallata ML töökoormust ulatuslikult. Vabal ajal naudib ta jalgrattasõitu, matkamist ja RMSE-de minimeerimist.

- SEO-põhise sisu ja PR-levi. Võimenduge juba täna.

- PlatoData.Network Vertikaalne generatiivne Ai. Jõustage ennast. Juurdepääs siia.

- PlatoAiStream. Web3 luure. Täiustatud teadmised. Juurdepääs siia.

- PlatoESG. Autod/elektrisõidukid, Süsinik, CleanTech, Energia, Keskkond päikeseenergia, Jäätmekäitluse. Juurdepääs siia.

- BlockOffsets. Keskkonnakompensatsiooni omandi ajakohastamine. Juurdepääs siia.

- Allikas: https://aws.amazon.com/blogs/machine-learning/efficiently-train-tune-and-deploy-custom-ensembles-using-amazon-sagemaker/

- :on

- :on

- :mitte

- : kus

- ][lk

- $ UP

- 1

- 10

- 100

- 11

- 200

- 2011

- 50

- 60

- 7

- a

- MEIST

- juurdepääs

- Vastavalt

- konto

- täpsus

- täpne

- lisama

- Täiendavad lisad

- Lisaks

- aadress

- Aafrika

- pärast

- vastu

- vanus

- AI

- AI / ML

- algoritm

- algoritme

- Materjal: BPA ja flataatide vaba plastik

- lubatud

- võimaldab

- Ka

- alati

- Amazon

- Amazon SageMaker

- Amazon Web Services

- vahel

- summa

- an

- ja

- mistahes

- rakendused

- lähenemine

- OLEME

- argumendid

- AS

- At

- rünnak

- Austraalia

- Automaatne

- automaatselt

- saadaval

- keskmiselt

- ära

- AWS

- Taustaprogramm

- põhineb

- Baseline

- BE

- sest

- muutuma

- olnud

- on

- kasulik

- Kasu

- BEST

- parimaid tavasid

- Parem

- vahel

- Peale

- segunemine

- segud

- Blokeerima

- veri

- Vererõhk

- keha

- võimendamine

- mõlemad

- tooma

- Toomine

- ehitama

- Ehitus

- sisseehitatud

- kimbud

- kuid

- by

- arvutama

- CAN

- lüüa

- pildistatud

- juhul

- kategooriad

- aheldatud

- koormuste

- Vali

- klassifikatsioon

- kood

- külm

- kogumine

- kombinatsioonid

- kombineerimine

- ühine

- Side

- kogukond

- kaalukad

- täitma

- Arvutama

- arvuti

- Arvuti visioon

- Murettekitav

- konfiguratsioon

- konfigureeritud

- koosneb

- Konteiner

- Konteinerid

- sisu

- kontrollida

- Vastav

- Maksma

- kuluefektiivne

- kaetud

- loomine

- tava

- klient

- Kliendid

- kohandada

- Küberturvalisus

- andmed

- Otsuse tegemine

- pühendunud

- vaikimisi

- määratlema

- määratletud

- määratlemisel

- näitama

- Denial of Service

- Olenevalt

- juurutada

- juurutamine

- kasutuselevõtu

- Disain

- kujundusmustrid

- üksikasjalik

- Detection

- Määrama

- erinev

- kataloogid

- arutama

- arutelu

- haigus

- mitu

- laevalaadija

- Ei tee

- Ära

- lae alla

- maha kallama

- kestus

- ajal

- iga

- Ida

- mõju

- tõhus

- tõhusalt

- jõupingutusi

- kumbki

- tekkima

- volitama

- võimaldama

- lõpp

- Lõpp-punkt

- tagama

- ettevõte

- keskkond

- keskkondades

- eriti

- Euroopa

- hindamine

- Isegi

- arenenud

- näide

- näited

- uurima

- Avastades

- lisatasu

- pere

- tunnusjoon

- FUNKTSIOONID

- fail

- Faile

- lõplik

- Lõpuks

- finants-

- esimene

- Paindlikkus

- voog

- Keskenduma

- keskendumine

- Järel

- järgneb

- eest

- mets

- formaat

- avastatud

- neli

- Raamistik

- raamistikud

- pettus

- pettuste avastamine

- sõbrad

- Alates

- täis

- funktsioon

- funktsioonid

- Pealegi

- kasu

- kasumi saamine

- tekitama

- saama

- saamine

- antud

- suurem

- juhised

- Pool

- käepide

- Varred

- Olema

- he

- raske

- raske tõstmine

- aitab

- siin

- rohkem

- tema

- võõrustaja

- Hosting

- Kuidas

- Kuidas

- aga

- HTML

- http

- HTTPS

- Hüperparameetrite optimeerimine

- Hüperparameetrite häälestamine

- ideaalne

- Idle

- if

- pilt

- rakendada

- rakendamisel

- tööriistad

- oluline

- in

- sisaldama

- hõlmab

- eraldi

- Üksikult

- info

- Infrastruktuur

- sisend

- paigaldama

- Näiteks

- selle asemel

- Intelligentsus

- sisse

- kehtestama

- Tutvustab

- kutsutud

- kutsub

- Iisrael

- küsimustes

- IT

- töö

- Tööturg

- jpg

- Json

- võtmed

- Laps

- teatud

- keel

- suurem

- pärast

- algatama

- õppimine

- võimendav

- Li

- raamatukogud

- Raamatukogu

- tõstmine

- LIMIT

- nimekiri

- Loetletud

- saadetised

- kohalik

- asub

- liising

- metsaraie

- välimus

- armastab

- masin

- masinõpe

- põhiline

- Enamus

- tegema

- juhtima

- juhitud

- juhtimine

- juht

- juhtiv

- Mass

- maksimaalne

- keskmine

- mõõdud

- meditsiini-

- liige

- Mälu

- Merge

- meetod

- meetodid

- meetriline

- Kesk-

- Lähis-Ida

- võib

- minimaalne

- minimeerimine

- ML

- viis

- mudel

- mudelid

- Moodulid

- järelevalve

- rohkem

- kõige

- mitmekordne

- nimi

- nimed

- Natural

- Natural Language Processing

- loodus

- vajalik

- Vajadus

- järgmine

- nlp

- Märka..

- number

- arvukad

- objekt

- eesmärk

- of

- Pakkumised

- sageli

- on

- kunagi

- ONE

- ainult

- töötama

- töökorras

- optimeerimine

- optimeerima

- optimeerimine

- valik

- Valikud

- or

- OS

- Muu

- meie

- välja

- väljas

- väljund

- üldine

- enda

- pakette

- parameeter

- parameetrid

- osa

- osad

- Vastu võetud

- tee

- Muster

- mustrid

- Maksma

- kohta

- perioodid

- faas

- torujuhe

- Platon

- Platoni andmete intelligentsus

- PlatoData

- võrra

- Poliitika

- populaarne

- võimalik

- post

- potentsiaal

- tavad

- prognoosimine

- ennustus

- Ennustused

- Predictor

- Ennustab

- eelistama

- eelistatud

- surve

- takistab

- eelmine

- trükk

- menetlus

- protsess

- Töödeldud

- töötlemine

- tootma

- progressioon

- paljutõotav

- tõestatud

- anda

- annab

- Python

- juhuslik

- kiiresti

- Lugenud

- vähendama

- Lühendatud

- vähendamine

- viitab

- pidama

- regulaaravaldis

- piirkond

- kauge

- Hoidla

- esindama

- taotleda

- nõutav

- Vajab

- Vahendid

- vastavalt

- vastutav

- kaasa

- Tulemused

- tagasipöördumine

- Tulu

- õige

- ROBERT

- Roll

- jooks

- jooksmine

- s

- salveitegija

- SageMakeri automaatne mudeli häälestamine

- sama

- Säästa

- säästmine

- Skaala

- ketendamine

- teadlased

- skikit õppima

- skripte

- SDK

- Teine

- vaata

- nähtud

- väljavalitud

- saatma

- vanem

- eri

- Jada

- Seerum

- Serverita

- Serverid

- teenus

- Teenused

- teenindavad

- komplekt

- seaded

- mitu

- Sugu

- ta

- peaks

- näitas

- Näitused

- Samamoodi

- lihtne

- ühekordne

- SIX

- SUURUS

- So

- lahendus

- Lahendused

- Lahendab

- allikas

- spetsialist

- konkreetse

- määratletud

- kulutama

- Kestab

- laotud

- virnastamine

- Stanford

- algus

- algab

- modernne

- statistika

- Sammud

- ladustamine

- ladustatud

- kauplustes

- lihtne

- tugevam

- selline

- KOKKUVÕTE

- Toetatud

- Toetab

- kindel

- sydney

- võtab

- võtmine

- sihtmärk

- ülesanded

- Tehniline

- tehnikat

- Tehnoloogia

- üürnik

- kui

- et

- .

- oma

- Neile

- SIIS

- Seal.

- sellega

- seetõttu

- Need

- nad

- see

- need

- kuigi?

- kolm

- Läbi

- aeg

- korda

- et

- kokku

- töövahendid

- teema

- Summa

- vedamine

- liiklus

- Rong

- koolitatud

- koolitus

- Puud

- Trevor

- Lõitkodalane

- kaks

- liigid

- all

- mõistma

- Kasutus

- kasutama

- Kasutatud

- kasutusalad

- kasutamine

- kinnitamine

- väärtus

- Väärtused

- eri

- versioon

- nägemus

- maht

- Hääletamine

- tahan

- oli

- Tee..

- kuidas

- we

- web

- veebiteenused

- kaal

- olid

- M

- millal

- mis

- kuigi

- kogu

- miks

- will

- koos

- jooksul

- Töö

- töö

- töötab

- kirjutama

- kirjutamine

- XGBoost

- aasta

- sa

- Sinu

- sephyrnet

- null