Üha enam organisatsioone võtab kasutusele generatiivsed AI-tehnoloogiad – esitluste koostamiseks, toetustaotluste täitmiseks ja kirjutamiseks katla kood — turvameeskonnad mõistavad vajadust tegeleda uue küsimusega: kuidas kaitsta tehisintellekti tööriistu?

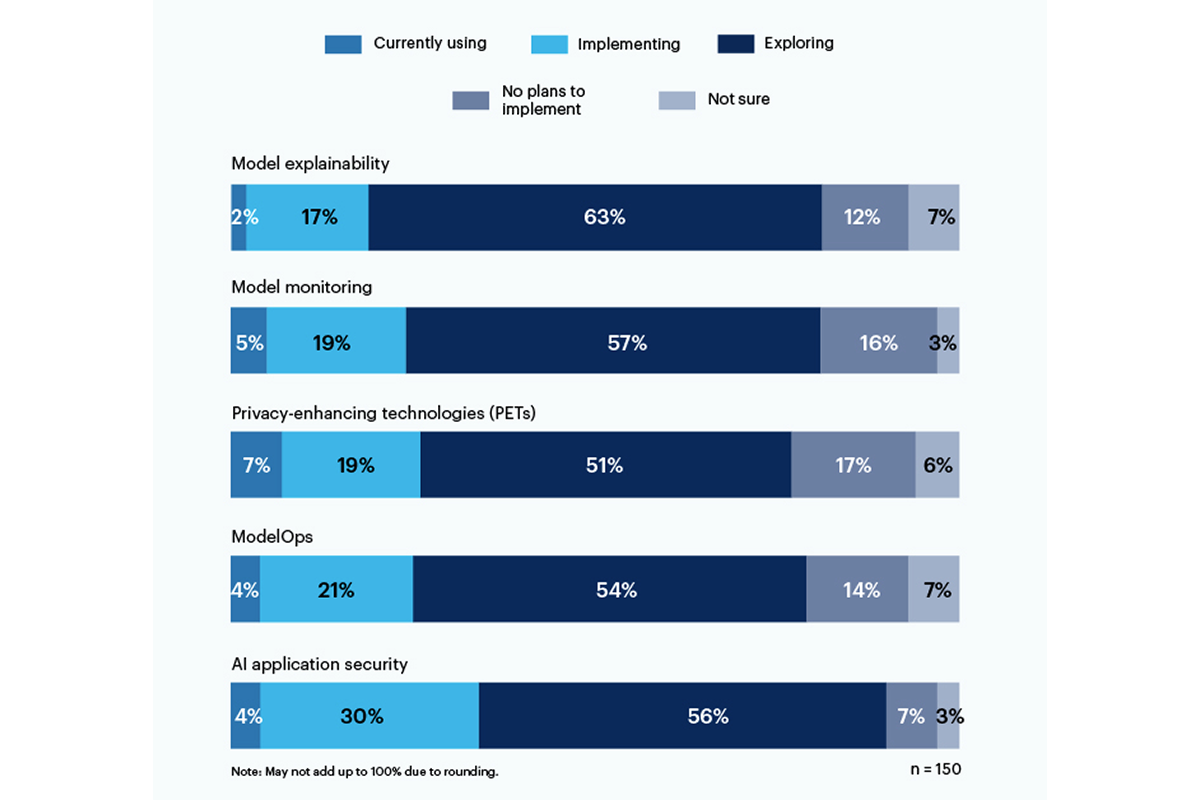

Üks kolmandik Gartneri hiljutises uuringus vastanutest teatas kumbagi AI-põhiste rakenduste turbetööriistade kasutamine või juurutamine tegeleda generatiivse tehisintellekti kasutamisega oma organisatsioonis kaasnevate riskidega.

Privaatsust suurendavaid tehnoloogiaid (PET) kasutati praegu kõige rohkem, 7% vastanutest, kusjuures 19% ettevõtetest rakendab seda; sellesse kategooriasse kuuluvad võimalused isikuandmete kaitsmiseks, nt homomorfne krüpteerimine, AI-ga loodud sünteetilised andmed, turvaline mitme osapoole arvutus, föderaalne õpeja erinev privaatsus. 17% ei kavatse aga oma keskkonda PET-e juurutada.

Vaid 19% kasutab või rakendab tööriistu mudeli seletatavuse tagamiseks, kuid vastanute seas on märkimisväärne huvi (56%) nende tööriistade uurimise ja mõistmise vastu, et tegeleda generatiivse AI riskiga. Gartneri sõnul saab seletatavust, mudelite jälgimist ja AI-rakenduste turbetööriistu kasutada avatud lähtekoodiga või patenteeritud mudelitel, et saavutada ettevõttekasutajate jaoks vajalik usaldusväärsus ja töökindlus.

Riskid, mille pärast vastajad enim muret teevad, on valed või kallutatud väljundid (58%) ning tehisintellekti loodud koodi haavatavused või lekkinud saladused (57%). Märkimisväärne on see, et 43% nimetas oma organisatsiooni peamiste riskidena AI-ga loodud sisust tulenevaid võimalikke autoriõiguse või litsentsimise probleeme.

"Andmemudelite koolituse osas puudub endiselt läbipaistvus, seega on eelarvamuste ja privaatsusega seotud riski väga raske mõista ja hinnata," kirjutas C-suite'i juht vastuseks Gartneri uuringule.

Juunis National Institute of Standards and Technology (NIST) käivitas avaliku töörühma selle küsimuse lahendamiseks, tuginedes jaanuaris avaldatud tehisintellekti riskijuhtimise raamistikule. Nagu Gartneri andmed näitavad, ettevõtted ei oota NIST-i direktiivide jaoks.

- SEO-põhise sisu ja PR-levi. Võimenduge juba täna.

- PlatoData.Network Vertikaalne generatiivne Ai. Jõustage ennast. Juurdepääs siia.

- PlatoAiStream. Web3 luure. Täiustatud teadmised. Juurdepääs siia.

- PlatoESG. Süsinik, CleanTech, Energia, Keskkond päikeseenergia, Jäätmekäitluse. Juurdepääs siia.

- PlatoTervis. Biotehnoloogia ja kliiniliste uuringute luureandmed. Juurdepääs siia.

- Allikas: https://www.darkreading.com/tech-talks/companies-rely-multiple-methods-secure-generative-ai

- :on

- :mitte

- 7

- a

- MEIST

- Vastavalt

- Saavutada

- aadress

- vastu võtma

- AI

- Materjal: BPA ja flataatide vaba plastik

- vahel

- ja

- taotlus

- rakenduse turvalisus

- rakendused

- OLEME

- AS

- seotud

- At

- põhineb

- BE

- erapoolikus

- erapooletu

- kuid

- by

- C-sviit

- CAN

- Kategooria

- Tsiteeritud

- kood

- Ettevõtted

- täitma

- mures

- sisu

- autoriõigus

- käsitöö

- Praegune

- andmed

- raske

- direktiivid

- do

- kumbki

- ettevõte

- keskkond

- hinnata

- täidesaatev

- Avastades

- eest

- Raamistik

- Alates

- Gartner

- generatiivne

- Generatiivne AI

- anda

- suurim

- Olema

- aitama

- Kuidas

- aga

- HTTPS

- rakendamisel

- in

- sisaldama

- hõlmab

- Instituut

- huvi

- küsimustes

- IT

- ITS

- Jaanuar

- juuni

- käivitatud

- litsentsimine

- juhtimine

- meetodid

- mudel

- mudelid

- järelevalve

- rohkem

- kõige

- mitmekordne

- riiklik

- Vajadus

- Uus

- nst

- ei

- of

- on

- avatud

- avatud lähtekoodiga

- or

- organisatsioon

- organisatsioonid

- isiklik

- isiklikud andmed

- Majapidamine

- pigi

- plaanid

- Platon

- Platoni andmete intelligentsus

- PlatoData

- tulenevad

- potentsiaal

- privaatsus

- varaline

- kaitsma

- avalik

- küsimus

- realiseerimisel

- hiljuti

- usaldusväärsus

- lootma

- Teatatud

- vastanutest

- vastus

- Oht

- riskijuhtimise

- riskide

- saladusi

- kindlustama

- turvalisus

- näitas

- Näitused

- märkimisväärne

- märgatavalt

- So

- tahke

- allikas

- standardite

- Veel

- selline

- Uuring

- sünteetiline

- meeskonnad

- Tehnoloogiad

- Tehnoloogia

- et

- .

- oma

- Seal.

- Need

- see

- et

- töövahendid

- ülemine

- koolitus

- läbipaistvus

- usaldusväärsus

- mõistma

- mõistmine

- kasutama

- Kasutatud

- Kasutajad

- kasutamine

- väga

- Haavatavused

- kuidas

- koos

- töö

- kirjutama

- kirjutas

- sa

- sephyrnet