See postitus on kirjutatud koos Forethought Technologies, Inc. inseneridirektori Jad Chamouni ja Forethought Technologies, Inc. ML vaneminseneriga Salina Wu'ga.

Ettemõtlemine on juhtiv generatiivne AI komplekt klienditeeninduseks. Selle sviidi keskmes on uuenduslikkus SupportGPT™ tehnoloogia, mis kasutab masinõpet klienditoe elutsükli muutmiseks – suurendades kõrvalekaldeid, parandades CSAT-i ja suurendades agentide tootlikkust. SupportGPT™ kasutab nüüdisaegseid teabeotsingu (IR) süsteeme ja suuri keelemudeleid (LLM), et võimaldada igal aastal üle 30 miljoni kliendiga suhtlemise.

SupportGPT peamine kasutusjuht on klienditoe suhtluse ja toimingute kvaliteedi ja tõhususe parandamine. Kasutades nüüdisaegseid IR-süsteeme, mida toidavad manustused ja järjestusmudelid, saab SupportGPT kiiresti otsida asjakohast teavet, pakkudes klientide päringutele täpseid ja kokkuvõtlikke vastuseid. Forethought kasutab kliendipõhiseid peenhäälestatud mudeleid, et tuvastada klientide kavatsused, et lahendada klientidega suhtlemine. Suurte keelemudelite integreerimine aitab humaniseerida suhtlemist automatiseeritud agentidega, luues kaasahaaravama ja rahuldavama tugikogemuse.

SupportGPT abistab ka klienditoe agente, pakkudes automaatse täitmise soovitusi ja koostades kliendipiletitele asjakohaseid vastuseid, mis vastavad ettevõtte varasematele vastustele. Täiustatud keelemudeleid kasutades saavad agendid klientide muresid kiiremini ja täpsemalt lahendada, mille tulemuseks on suurem klientide rahulolu.

Lisaks võimaldab SupportGPT arhitektuur tuvastada lünki tugiteadmiste baasides, mis aitab agentidel pakkuda klientidele täpsemat teavet. Kui need lüngad on tuvastatud, saab SupportGPT automaatselt luua artikleid ja muud sisu, et täita need teadmistelünkad, tagades, et tugiteadmistebaas jääb kliendikeskseks ja ajakohaseks.

Selles postituses jagame, kuidas Forethought kasutab Amazon SageMaker mitme mudeli lõpp-punktid generatiivsetel tehisintellekti kasutusjuhtudel, et säästa kulusid üle 66%.

Infrastruktuuri väljakutsed

Nende võimaluste turule toomiseks skaleerib Forethought tõhusalt oma ML töökoormust ja pakub ülipersonaliseeritud lahendusi, mis on kohandatud iga kliendi konkreetsele kasutusjuhule. See hüperisikupärastamine saavutatakse kliendiandmete mudelite ja klassifikaatorite peenhäälestusega, tagades täpsed teabeotsingu tulemused ja domeeniteadmised, mis vastavad iga kliendi ainulaadsetele vajadustele. Kohandatud automaatse täitmise mudelid on samuti viimistletud kliendiandmete põhjal, et genereeritud vastuste täpsust ja asjakohasust veelgi suurendada.

Üks olulisi väljakutseid tehisintellekti töötlemisel on riistvararessursside, näiteks GPU-de, tõhus kasutamine. Selle väljakutsega toimetulemiseks kasutab Forethought SageMakeri mitme mudeli lõpp-punkte (MME), et käitada mitu AI mudelit ühel järelduse lõpp-punktil ja skaalal. Kuna mudelite hüperpersonaliseerimine nõuab ainulaadsete mudelite koolitamist ja kasutuselevõttu, skaalaldub mudelite arv lineaarselt klientide arvuga, mis võib muutuda kulukaks.

Reaalajas järelduste ja kulude õige tasakaalu saavutamiseks otsustas Forethought kasutada SageMakeri MME-sid, mis toetavad GPU kiirendust. SageMakeri MME-d võimaldavad Forethoughtil pakkuda suure jõudlusega, skaleeritavaid ja kulutõhusaid lahendusi alamsekundilise latentsusega, käsitledes mitut klienditoe stsenaariumi mastaapselt.

SageMaker ja Forethought

SageMaker on täielikult hallatav teenus, mis annab arendajatele ja andmeteadlastele võimaluse kiiresti ML-mudeleid luua, koolitada ja juurutada. SageMakeri MME-d pakuvad skaleeritavat ja kulutõhusat lahendust suure hulga mudelite juurutamiseks reaalajas järelduste tegemiseks. MME-d kasutavad jagatud serveerimiskonteinerit ja ressursside parki, mis saavad kasutada kiirendatud eksemplare, näiteks GPU-sid, et majutada kõiki teie mudeleid. See vähendab hostimiskulusid, maksimeerides lõpp-punkti kasutust võrreldes ühe mudeli lõpp-punktide kasutamisega. See vähendab ka juurutamise üldkulusid, kuna SageMaker haldab mudelite mällu laadimist ja mahalaadimist ning nende skaleerimist lõpp-punkti liiklusmustrite alusel. Lisaks saavad kõik SageMakeri reaalajas lõpp-punktid kasu sisseehitatud võimalustest mudelite haldamiseks ja jälgimiseks, näiteks varju variandid, automaatne skaleerimine, ja natiivset integreerimist Amazon CloudWatch (lisateabe saamiseks vaadake CloudWatchi mõõdikud mitme mudeli lõpp-punkti juurutamiseks).

Kuna Forethought kasvas, et majutada sadu mudeleid, mis nõudsid ka GPU ressursse, nägime võimalust luua SageMaker MME-de kaudu kuluefektiivsem, usaldusväärsem ja hallatavam arhitektuur. Enne SageMakeri MME-dele üleminekut juurutati meie mudelid Kubernetesis Amazoni elastse Kubernetese teenus (Amazon EKS). Kuigi Amazon EKS pakkus haldusvõimalusi, oli kohe näha, et haldame infrastruktuuri, mis ei olnud spetsiaalselt järelduste tegemiseks kohandatud. Foretthought pidi ise Amazon EKS-i mudelijäreldusi juhtima, mis oli inseneri efektiivsuse jaoks koormav. Näiteks kulukate GPU-ressursside jagamiseks mitme mudeli vahel vastutasime jäikade mälufraktsioonide eraldamise eest juurutamise ajal määratud mudelitele. Tahtsime oma olemasoleva infrastruktuuriga lahendada järgmised peamised probleemid:

- Kõrge hind – Tagamaks, et igal mudelil oleks piisavalt ressursse, oleksime väga konservatiivsed selle osas, kui palju mudeleid eksemplari jaoks sobitada. Selle tulemuseks olid mudelimajutuskulud palju suuremad kui vaja.

- Madal töökindlus – Hoolimata sellest, et oleme mälu jaotamisel konservatiivsed, ei ole kõigil mudelitel samad nõuded ja mõnikord võivad mõned mudelid põhjustada mälust tühjaks jäämise (OOM) tõrkeid.

- Ebaefektiivne juhtimine – Pidime iga mudelitüübi jaoks (nt klassifikaatorid, manustused ja automaatne täitmine) haldama erinevaid juurutusmanifeste, mis oli aeganõudev ja vigadetundlik. Samuti pidime säilitama loogika, et määrata mälu eraldamine erinevate mudelitüüpide jaoks.

Lõppkokkuvõttes vajasime järeldusplatvormi, et võtta oma mudelite haldamise raskused enda peale, et parandada kulusid, töökindlust ja mudelite teenindamise juhtimist. SageMakeri MME-d võimaldasid meil neid vajadusi rahuldada.

Tänu nutikale ja dünaamilisele mudeli laadimisele ja mahalaadimisele ning skaleerimisvõimalustele pakkusid SageMakeri MME-d meie mudelite majutamiseks oluliselt odavamat ja usaldusväärsemat lahendust. Nüüd saame ühe eksemplari jaoks sobitada palju rohkem mudeleid ja ei pea muretsema OOM-i vigade pärast, sest SageMakeri MME-d käitlevad mudelite laadimist ja mahalaadimist dünaamiliselt. Lisaks on juurutamine nüüd sama lihtne kui Boto3 SageMaker API-de kutsumine ja õigete automaatse skaleerimise poliitikate lisamine.

Järgmine diagramm illustreerib meie pärandarhitektuuri.

SageMakeri MME-dele ülemineku alustamiseks tuvastasime MME-de parimad kasutusjuhud ja millised meie mudelid saaksid sellest muudatusest kõige rohkem kasu. MME-sid on kõige parem kasutada järgmistel juhtudel:

- Mudelid, millel on eeldatavasti madal latentsusaeg, kuid mis taluvad külmkäivitusaega (esmakordsel sisselaadimisel)

- Mudelid, mida kutsutakse sageli ja järjekindlalt

- Mudelid, mis vajavad osalisi GPU ressursse

- Mudelid, millel on ühised nõuded ja järeldusloogika

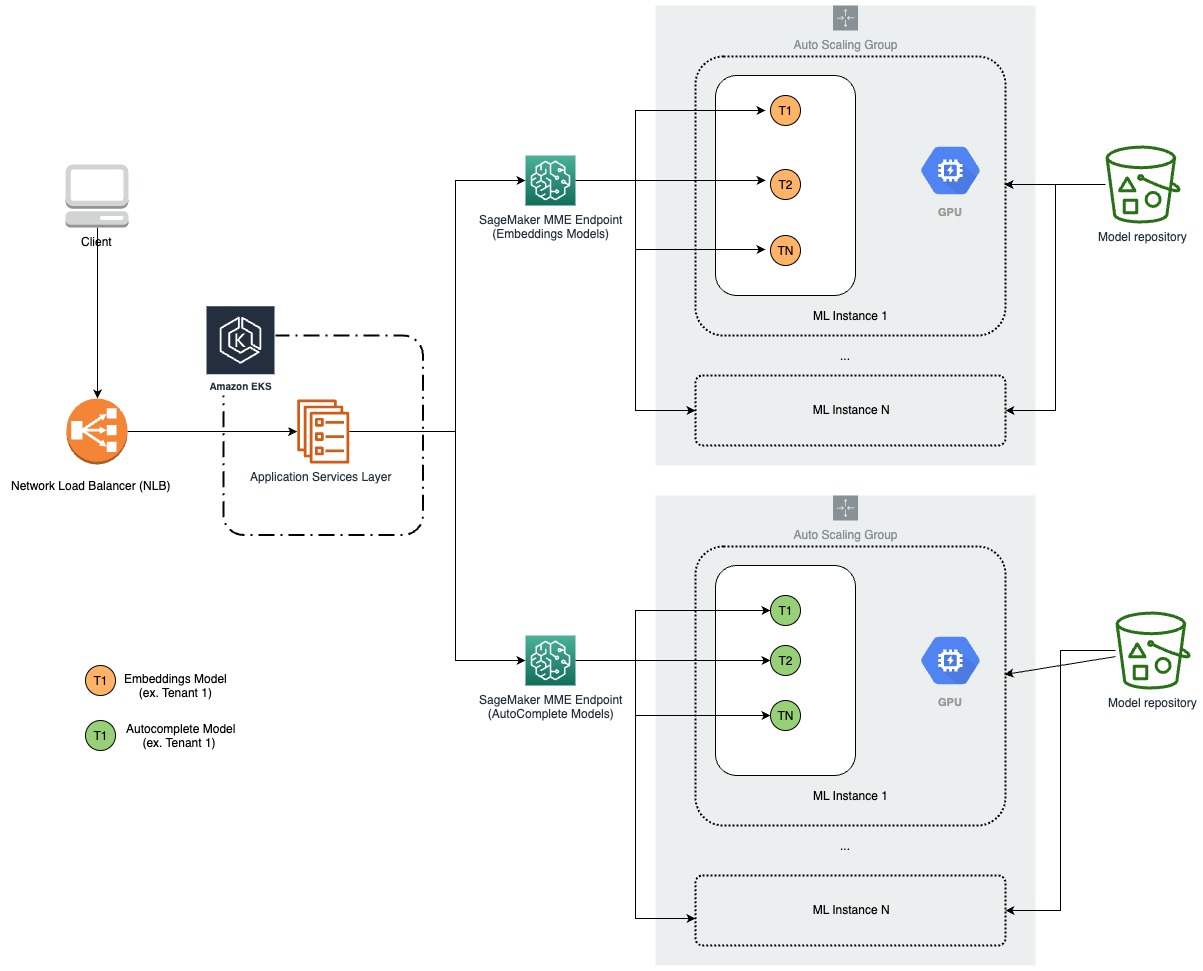

Leidsime, et meie manustamismudelid ja automaatse täitmise keelemudelid on meie migratsiooni parimad kandidaadid. Nende mudelite korraldamiseks MME-de alla looksime ühe MME iga mudelitüübi või ülesande kohta, ühe meie manustamismudelite jaoks ja teise automaatse täitmise keelemudelite jaoks.

Meil oli juba mudelite peal API kiht mudelite haldamiseks ja järelduste tegemiseks. Meie ülesanne oli ümber töötada, kuidas see API juurutas ja käsitles SageMakeriga mudelite põhjal tehtud järeldusi, muutes minimaalselt klientide ja tootemeeskondade API-ga suhtlemist. Samuti pidime oma mudelid ja kohandatud järeldusloogika pakkima, et need ühilduksid NVIDIA Triton Inference Serveriga, kasutades SageMaker MME-sid.

Järgmine diagramm illustreerib meie uut arhitektuuri.

Kohandatud järeldusloogika

Enne SageMakerile üleviimist jooksis mudeli käivitamisel API kihis Forethoughti kohandatud järelduskood (eel- ja järeltöötlus). Eesmärk oli kanda see funktsionaalsus üle mudelile endale, et selgitada vastutuste lahusust, moduleerida ja lihtsustada nende koodi ning vähendada API koormust.

Manustamised

Forethoughti manustamismudelid koosnevad kahest PyTorchi mudeli artefaktist ja järelduspäring määrab, millist mudelit kutsuda. Iga mudel nõuab sisendiks eeltöödeldud teksti. Peamised väljakutsed olid eeltöötlusetapi integreerimine ja kahe mudeliartefakti mahutamine mudeli määratluse kohta. Järeldusloogikas mitme sammu vajaduse rahuldamiseks töötas Forethought välja kaheastmelise Tritoni ansamblimudeli: Pythoni taustaprogrammi eeltöötlusprotsess ja PyTorchi taustamudeli kutse. Ansamblimudelid võimaldavad määratleda ja järjestada samme järeldusloogikas, kusjuures iga sammu esindab mis tahes taustatüüpi Tritoni mudel. Ühilduvuse tagamiseks Triton PyTorchi taustaprogrammiga teisendati olemasolevad mudeliartefaktid TorchScripti vormingusse. Iga mudeli määratluse jaoks loodi eraldi Tritoni mudelid ja Forethoughti API kiht vastutas sobiva määramise eest. TargetModel sissetuleva päringu alusel välja kutsuda.

Automaatteksti

Automaatse täitmise mudelid (järjestus jada) esitasid selged nõuded. Täpsemalt pidime võimaldama võimaluse läbida mitu mudelikõnet ja salvestada vahemällu iga kõne jaoks olulisi sisendeid, säilitades samal ajal madala latentsuse. Lisaks nõudsid need mudelid nii eel- kui ka järeltöötlusetappe. Nende nõuete täitmiseks ja soovitud paindlikkuse saavutamiseks töötas Forethought välja automaatse täitmise MME mudelid, kasutades Triton Pythoni taustaprogrammi, mille eeliseks on mudeli kirjutamine Pythoni koodina.

Benchmarking

Pärast Tritoni mudeli kujude kindlaksmääramist juurutasime mudelid lõpp-punktide määramiseks ning viisime läbi ressursside ja jõudluse võrdlusuuringu. Meie peamine eesmärk oli teha kindlaks külmkäivituse ja mälusiseste mudelite latentsusaeg ning see, kuidas latentsusaega mõjutasid päringu suurus ja samaaegsus. Tahtsime ka teada, kui palju mudeleid igale eksemplarile mahub, kui palju mudeleid meie automaatse skaleerimise poliitikaga eksemplare suurendaks ja kui kiiresti suurendamine toimuks. Kooskõlas juba kasutatavate eksemplaritüüpidega tegime võrdlusuuringu eksemplaridega ml.g4dn.xlarge ja ml.g4dn.2xlarge.

Tulemused

Järgmine tabel võtab kokku meie tulemused.

| Taotle suurust | Külmkäivituse latentsus | Vahemällu salvestatud järelduste latentsus | Samaaegne latentsusaeg (5 taotlust) |

| Väike (30 märki) | 12.7 sekundit | 0.03 sekundit | 0.12 sekundit |

| Keskmine (250 märki) | 12.7 sekundit | 0.05 sekundit | 0.12 sekundit |

| Suur (550 märki) | 12.7 sekundit | 0.13 sekundit | 0.12 sekundit |

Märkimisväärne on see, et külmkäivituspäringute latentsusaeg on oluliselt kõrgem kui vahemällu salvestatud järeldustaotluste latentsusaeg. Seda seetõttu, et mudel tuleb laadida kettalt või Amazoni lihtne salvestusteenus (Amazon S3), kui esitatakse külmkäivituse taotlus. Samaaegsete päringute latentsusaeg on samuti suurem kui üksikute päringute latentsusaeg. Selle põhjuseks on asjaolu, et mudelit tuleb jagada samaaegsete päringute vahel, mis võib põhjustada tüli.

Järgmises tabelis võrreldakse pärandmudelite ja SageMakeri mudelite latentsust.

| Taotle suurust | Pärandmudelid | SageMakeri mudelid |

| Väike (30 märki) | 0.74 sekundit | 0.24 sekundit |

| Keskmine (250 märki) | 0.74 sekundit | 0.24 sekundit |

| Suur (550 märki) | 0.80 sekundit | 0.32 sekundit |

Üldiselt on SageMakeri mudelid automaatse täitmise mudelite majutamiseks parem valik kui pärandmudelid. Need pakuvad madalamat latentsusaega, mastaapsust, töökindlust ja turvalisust.

Ressursikasutus

Püüdes kindlaks teha igale eksemplarile sobivate mudelite optimaalne arv, viisime läbi rea teste. Meie katse hõlmas mudelite laadimist meie lõpp-punktidesse, kasutades eksemplari tüüpi ml.g4dn.xlarge, ilma automaatse skaleerimise poliitikata.

Need konkreetsed eksemplarid pakuvad 15.5 GB mälu ja meie eesmärk oli saavutada ligikaudu 80% GPU mälukasutus eksemplari kohta. Arvestades iga kodeerija mudeli artefakti suurust, õnnestus meil leida optimaalne arv Tritoni kodeerijaid, mida eksemplarile laadida, et saavutada meie sihitud GPU mälukasutus. Lisaks, arvestades, et iga meie manustamismudel vastab kahele Tritoni kodeerija mudelile, saime majutada kindla arvu manustamismudeleid eksemplari kohta. Selle tulemusena arvutasime välja kõigi meie manustamismudelite teenindamiseks vajalike eksemplaride koguarvu. See katsetamine on olnud meie ressursikasutuse optimeerimisel ja mudelite tõhususe suurendamisel otsustava tähtsusega.

Tegime oma automaatse täitmise mudelite jaoks sarnase võrdlusuuringu. Kõik need mudelid olid umbes 292.0 MB. Testides, mitu mudelit mahuks ühele ml.g4dn.xlarge eksemplarile, märkasime, et saime mahutada vaid neli mudelit, enne kui meie eksemplar hakkas mudeleid maha laadima, hoolimata mudelite väikesest suurusest. Meie peamised mured olid järgmised:

- Protsessori mälu kasutamise suurenemise põhjus

- Põhjus, miks mudelid laaditi maha, kui proovisime laadida kõige vähem hiljuti kasutatud (LRU) mudeli asemel veel ühte mudelit

Suutsime täpselt kindlaks teha mälukasutuse hüppe algpõhjuse, mis tulenes meie Pythoni mudelis meie CUDA käituskeskkonna initsialiseerimisest, mis oli vajalik meie mudelite ja andmete teisaldamiseks GPU-seadmesse ja sealt välja. CUDA laadib käitusaja initsialiseerimisel protsessori mällu palju väliseid sõltuvusi. Kuna Triton PyTorchi taustaprogramm käsitleb ja koondab GPU-seadmesse ja sealt välja liikuvaid andmeid, ei puutunud me selle probleemiga meie manustamismudelite puhul kokku. Selle probleemi lahendamiseks proovisime kasutada ml.g4dn.2xlarge eksemplare, millel oli sama palju GPU mälu, kuid kaks korda rohkem CPU mälu. Lisaks lisasime Pythoni taustakoodi mitu väiksemat optimeerimist, sealhulgas tensorite kustutamine pärast kasutamist, vahemälu tühjendamine, gradientide keelamine ja prügi kogumine. Suurema eksemplari tüübiga suutsime mahutada 10 mudelit eksemplari kohta ning protsessori ja graafikaprotsessori mälukasutus joondusid palju paremini.

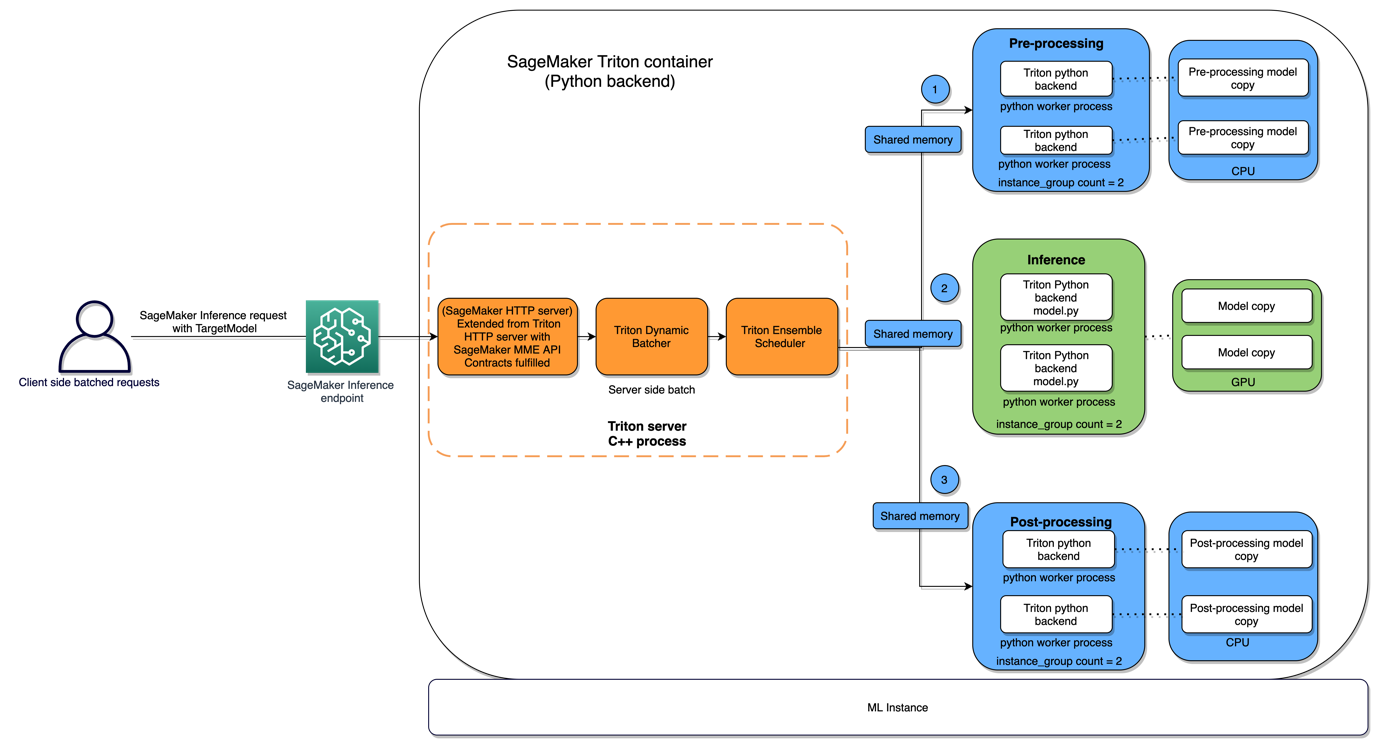

Järgmine diagramm illustreerib seda arhitektuuri.

Automaatne skaleerimine

Lisasime nii oma manustele kui ka automaatse täitmise MME-dele automaatse skaleerimise eeskirjad. Meie manustamise lõpp-punkti eeskirjad sihivad kohandatud mõõdikuid kasutades 80% keskmist GPU-mälu kasutust. Meie automaatse täitmise mudelid nägid tööajal tihedat liiklust ja öösel minimaalset liiklust. Seetõttu lõime automaatse skaleerimise poliitika, mis põhineb InvocationsPerInstance et saaksime vastavalt liiklusharjumustele skaleerida, säästes kulusid ilma usaldusväärsust ohverdamata. Ressursikasutuse võrdlusuuringu põhjal konfigureerisime oma skaleerimispoliitikad eesmärgiga 225 InvocationsPerInstance.

Juurutage loogika ja konveier

MME loomine SageMakeris on lihtne ja sarnane mis tahes muu lõpp-punkti loomisega SageMakeris. Pärast lõpp-punkti loomist on lõpp-punktile täiendavate mudelite lisamine sama lihtne kui mudeli artefakti teisaldamine lõpp-punkti sihitud S3 teele; siinkohal saame teha järeldusi oma uue mudeli kohta.

Määratlesime loogika, mis võtab mudeli metaandmed sisse, vormindab lõpp-punkti metaandmete põhjal deterministlikult ja kontrollib, kas lõpp-punkt on olemas. Kui seda ei juhtunud, loome lõpp-punkti ja lisame Tritoni mudeli artefakti lõpp-punkti S3 plaastrile (samuti deterministlikult vormindatud). Näiteks kui mudeli metaandmed näitavad, et tegemist on automaatse täitmise mudeliga, loob see automaatse täitmise mudelite jaoks lõpp-punkti ja sellega seotud S3 tee automaatse täitmise mudeli artefaktide jaoks. Kui lõpp-punkt oleks olemas, kopeeriksime mudeli artefakti S3 teele.

Nüüd, kui meil olid MME mudelite mudelid ja mudelite MME-sse juurutamise funktsioonid, vajasime viisi juurutamise automatiseerimiseks. Meie kasutajad peavad määrama, millist mudelit nad juurutada soovivad; tegeleme mudeli pakendamise ja kasutuselevõtuga. Mudeliga kaasas olev kohandatud järelduskood muudetakse versioonideks ja edastatakse Amazon S3-le; pakkimise etapis tõmbame järelkoodi vastavalt määratud versioonile (või uusimale versioonile) ja kasutame YAML-faile, mis näitavad Tritoni mudelite failistruktuure.

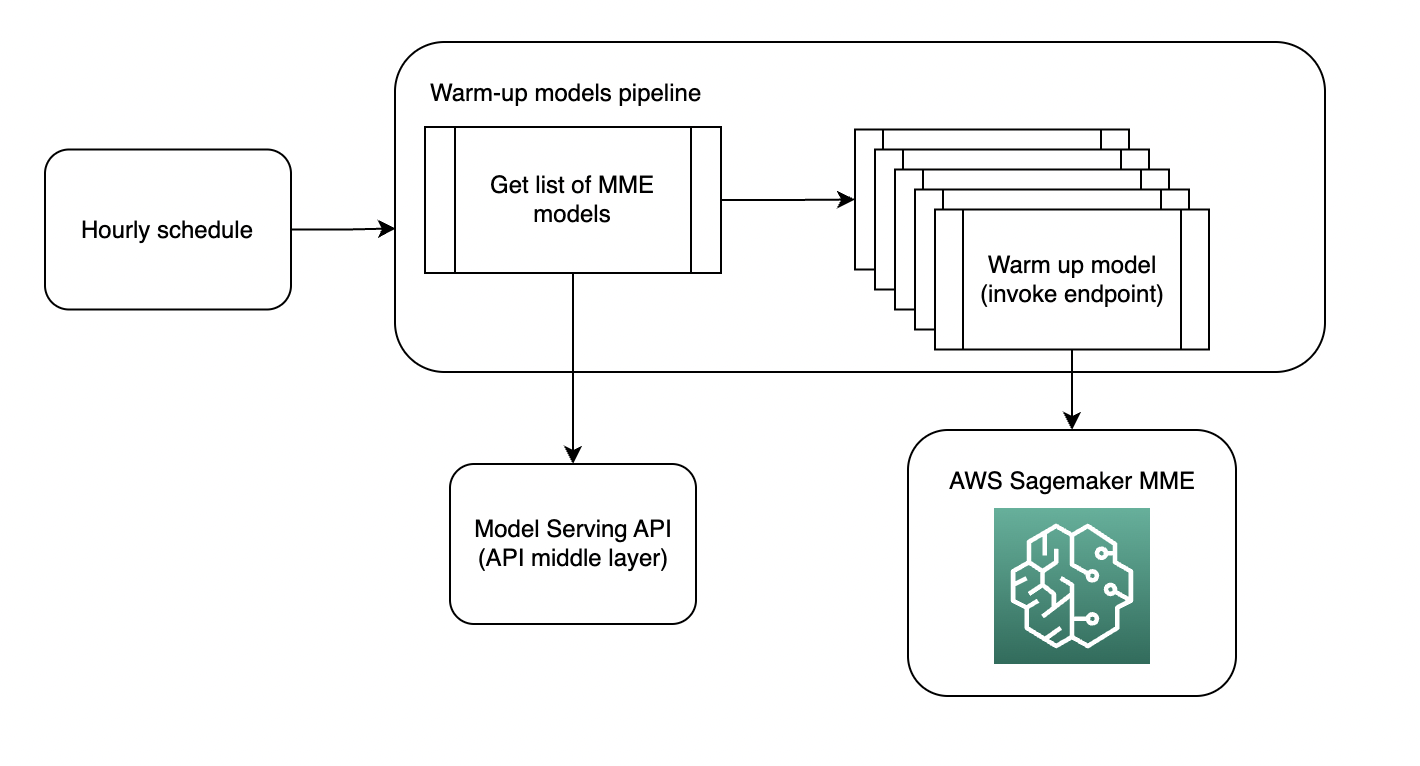

Üks meie jaoks oli nõue, et kõik meie MME mudelid laaditaks mällu, et vältida külmkäivituse latentsust tootmisjärelduste laadimise taotluste ajal mudelites. Selle saavutamiseks pakume piisavalt ressursse, et need sobiksid kõigi meie mudelitega (vastavalt eelnevale võrdlusuuringule) ja kutsume kõiki meie MME mudeleid tunnisagedusega.

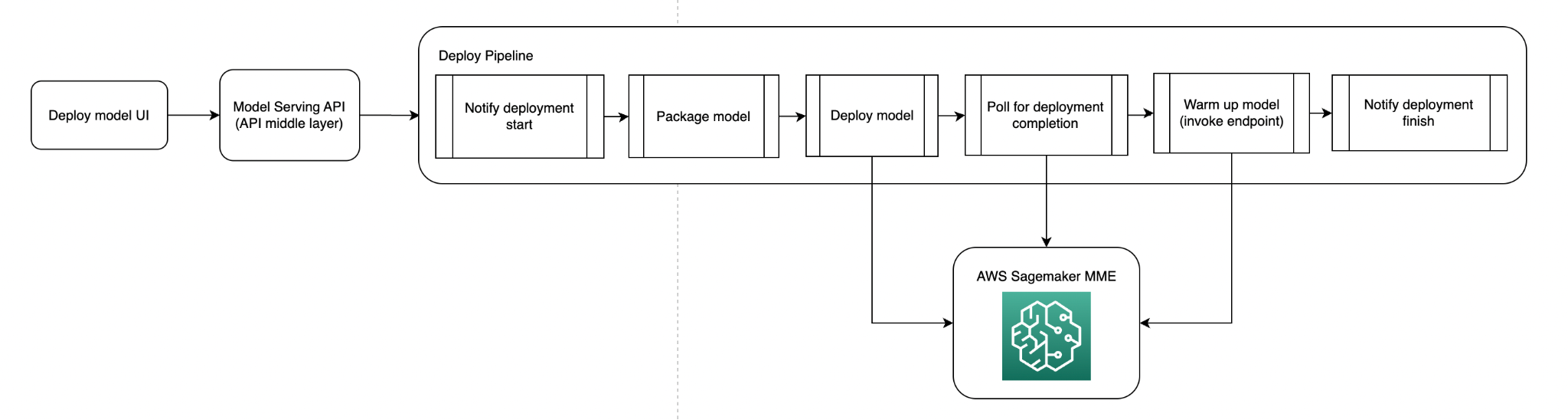

Järgmine diagramm illustreerib mudeli juurutamise konveieri.

Järgmine diagramm illustreerib soojendustorustiku mudelit.

Mudeli kutsumine

Meie olemasolev API kiht pakub helistajatele abstraktsiooni, et teha järeldusi kõigi meie ML-mudelite kohta. See tähendas, et pidime lisama API-kihile ainult funktsionaalsuse, et helistada SageMaker MME-le õige sihtmudeliga, olenevalt järeldustaotlusest, ilma kutsumiskoodi muutmata. SageMakeri järelduskood võtab järeldamispäringu, vormindab meie Tritoni mudelites määratletud Tritoni sisendid ja kutsub Boto3 abil MME-sid.

Kuluhüvitised

Tänu SageMakeri MME-dele üleminekule tegi ettenägelikkus märkimisväärseid edusamme mudelite hostimiskulude vähendamisel ja mudeli OOM-i vigade leevendamisel. Enne seda muudatust töötasid Amazon EKS-is ml.g4dn.xlarge eksemplarid. MME-dele üleminekuga avastasime, et see võib sisaldada 12 manustamismudelit eksemplari kohta, saavutades samal ajal 80% GPU mälu kasutamise. See tõi kaasa meie igakuiste kulude olulise languse. Vaadates seda perspektiivi, saavutasime kuni 80% kulude kokkuhoiu. Lisaks kaalusime suurema liikluse haldamiseks koopiate suurendamist. Eeldades stsenaariumit, kus kasutame kolme koopiat, leidsime, et meie kulude kokkuhoid oleks isegi nendel tingimustel siiski märkimisväärne, jäädes 43% ümber.

Teekond SageMaker MME-dega on osutunud rahaliselt kasulikuks, vähendades meie kulusid, tagades samal ajal mudeli optimaalse jõudluse. Varem kasutati meie automaatse täitmise keelemudeleid Amazon EKS-is, mistõttu oli vaja erinevat arvu ml.g4dn.xlarge eksemplare, mis põhinevad mälujaotusel mudeli kohta. See tõi kaasa märkimisväärse igakuise kulu. Kuid hiljutise SageMakeri MME-dele üleminekuga oleme suutnud neid kulusid oluliselt vähendada. Nüüd majutame kõiki oma mudeleid ml.g4dn.2xlarge eksemplaridel, mis annab meile võimaluse mudeleid tõhusamalt pakkida. See on oluliselt kärpinud meie igakuisi kulusid ja oleme nüüd saavutanud 66–74% kulude kokkuhoiu. See samm on näidanud, kuidas tõhus ressursside kasutamine võib SageMakeri MME-de kasutamisel kaasa tuua märkimisväärse rahalise kokkuhoiu.

Järeldus

Selles postituses vaatasime üle, kuidas Forethought kasutab SageMakeri mitme mudeli lõpp-punkte, et vähendada reaalajas järelduste tegemise kulusid. SageMaker võtab enda peale eristumatu raskete tõstmise, nii et Forethought võib suurendada inseneri tõhusust. Samuti võimaldab see Forethoughtil märkimisväärselt vähendada reaalajas järelduste tegemise kulusid, säilitades samal ajal ärikriitiliste toimingute jaoks vajaliku jõudluse. Seda tehes suudab Forethought pakkuda oma klientidele diferentseeritud pakkumist, kasutades hüperisikupärastatud mudeleid. Kasutage SageMaker MME-d, et majutada oma mudeleid ulatuslikult ja vähendada hostimiskulusid, parandades lõpp-punktide kasutamist. See vähendab ka juurutamise üldkulusid, kuna Amazon SageMaker haldab mudelite mällu laadimist ja nende skaleerimist teie lõpp-punkti liiklusmustrite alusel. Koodinäidised leiate mitme mudeli hostimisest, kasutades rakenduses SageMaker MME GitHub.

Autoritest

Jad Chamoun on Forethoughti põhitehnoloogia direktor. Tema meeskond keskendub platvormide projekteerimisele, mis hõlmab andmetehnoloogiat, masinõppe infrastruktuuri ja pilveinfrastruktuuri. Leiad ta siit LinkedIn.

Jad Chamoun on Forethoughti põhitehnoloogia direktor. Tema meeskond keskendub platvormide projekteerimisele, mis hõlmab andmetehnoloogiat, masinõppe infrastruktuuri ja pilveinfrastruktuuri. Leiad ta siit LinkedIn.

Salina Wu on Forethought.ai vanem masinõppe infrastruktuuri insener. Ta teeb tihedat koostööd masinõppe meeskonnaga, et luua ja hooldada nende täielikku koolitus-, teenindus- ja andmeinfrastruktuuri. Ta on eriti motiveeritud uute viiside kasutuselevõtust tõhususe parandamiseks ja kulude vähendamiseks kogu ML-ruumis. Kui Salina ei tööta, naudib ta surfamist, keraamikat ja looduses viibimist.

Salina Wu on Forethought.ai vanem masinõppe infrastruktuuri insener. Ta teeb tihedat koostööd masinõppe meeskonnaga, et luua ja hooldada nende täielikku koolitus-, teenindus- ja andmeinfrastruktuuri. Ta on eriti motiveeritud uute viiside kasutuselevõtust tõhususe parandamiseks ja kulude vähendamiseks kogu ML-ruumis. Kui Salina ei tööta, naudib ta surfamist, keraamikat ja looduses viibimist.

Jamesi park on Amazon Web Servicesi lahenduste arhitekt. Ta teeb koostööd Amazon.com-iga, et kavandada, ehitada ja juurutada AWS-is tehnoloogilised lahendused ning ta on eriti huvitatud AI-st ja masinõppest. Vabal ajal meeldib talle otsida uusi kultuure, uusi kogemusi ja olla kursis uusimate tehnoloogiatrendidega. Leiate ta aadressilt LinkedIn.

Jamesi park on Amazon Web Servicesi lahenduste arhitekt. Ta teeb koostööd Amazon.com-iga, et kavandada, ehitada ja juurutada AWS-is tehnoloogilised lahendused ning ta on eriti huvitatud AI-st ja masinõppest. Vabal ajal meeldib talle otsida uusi kultuure, uusi kogemusi ja olla kursis uusimate tehnoloogiatrendidega. Leiate ta aadressilt LinkedIn.

Sunil Padmanabhan on AWS-i käivituslahenduste arhitekt. Endise idufirma asutajana ja tehnoloogiajuhina suhtub ta kirglikult masinõppesse ning keskendub sellele, et aidata idufirmadel AI/ML-i oma äritulemuste saavutamiseks kasutada ning ML/AI-lahendusi ulatuslikult kavandada ja juurutada.

Sunil Padmanabhan on AWS-i käivituslahenduste arhitekt. Endise idufirma asutajana ja tehnoloogiajuhina suhtub ta kirglikult masinõppesse ning keskendub sellele, et aidata idufirmadel AI/ML-i oma äritulemuste saavutamiseks kasutada ning ML/AI-lahendusi ulatuslikult kavandada ja juurutada.

Dhawal Patel on AWS-i peamine masinõppearhitekt. Ta on töötanud hajutatud andmetöötluse ja tehisintellektiga seotud probleemide lahendamisel organisatsioonidega alates suurettevõtetest kuni keskmise suurusega idufirmadeni. Ta keskendub süvaõppele, sealhulgas NLP ja Computer Vision domeenidele. Ta aitab klientidel teha SageMakeris suure jõudlusega mudeli järeldusi.

Dhawal Patel on AWS-i peamine masinõppearhitekt. Ta on töötanud hajutatud andmetöötluse ja tehisintellektiga seotud probleemide lahendamisel organisatsioonidega alates suurettevõtetest kuni keskmise suurusega idufirmadeni. Ta keskendub süvaõppele, sealhulgas NLP ja Computer Vision domeenidele. Ta aitab klientidel teha SageMakeris suure jõudlusega mudeli järeldusi.

- SEO-põhise sisu ja PR-levi. Võimenduge juba täna.

- EVM Finance. Detsentraliseeritud rahanduse ühtne liides. Juurdepääs siia.

- Quantum Media Group. IR/PR võimendatud. Juurdepääs siia.

- PlatoAiStream. Web3 andmete luure. Täiustatud teadmised. Juurdepääs siia.

- Allikas: https://aws.amazon.com/blogs/machine-learning/how-forethought-saves-over-66-in-costs-for-generative-ai-models-using-amazon-sagemaker/

- :on

- :on

- :mitte

- : kus

- $ UP

- 1

- 10

- 100

- 12

- 13

- 15%

- 24

- 250

- 30

- 32

- 7

- 80

- a

- võime

- Võimalik

- MEIST

- abstraktsioon

- kokkuvõtteid

- kiirendatud

- Vastavalt

- täpsus

- täpne

- täpselt

- Saavutada

- saavutada

- saavutamisel

- üle

- lisama

- lisatud

- lisades

- lisamine

- Täiendavad lisad

- Lisaks

- aadress

- adresseerimine

- edasijõudnud

- ADEelis

- pärast

- Agent

- ained

- AI

- ai kasutusjuhtumeid

- AI / ML

- eesmärk

- viia

- joondatud

- Materjal: BPA ja flataatide vaba plastik

- eraldamine

- võimaldama

- võimaldab

- juba

- Ka

- Kuigi

- Amazon

- Amazon SageMaker

- Amazon Web Services

- Amazon.com

- summa

- an

- ja

- Aastas

- Teine

- vastuseid

- mistahes

- API

- API-liidesed

- ilmne

- asjakohane

- umbes

- arhitektuur

- OLEME

- ümber

- kaubad

- kunstlik

- tehisintellekti

- AS

- abistab

- seotud

- At

- auto

- automatiseerima

- Automatiseeritud

- automaatselt

- keskmine

- vältima

- ära

- AWS

- Taustaprogramm

- Saldo

- baas

- põhineb

- BE

- sai

- sest

- muutuma

- olnud

- enne

- alustama

- on

- võrdlusuuringud

- kasulik

- kasu

- BEST

- Parem

- vahel

- võimendamine

- mõlemad

- tooma

- ehitama

- sisseehitatud

- koormus

- äri

- kuid

- by

- Cache

- arvutatud

- helistama

- kutsutud

- kutsudes

- Kutsub

- CAN

- kandidaadid

- võimeid

- juhul

- juhtudel

- näeb ette

- Põhjus

- väljakutse

- väljakutseid

- muutma

- Vaidluste lahendamine

- kontrollima

- valik

- Valisin

- kliendid

- lähedalt

- Cloud

- pilve infrastruktuur

- kood

- külm

- Kollektsioneerimine

- COM

- tulevad

- ühine

- Ettevõtte omad

- võrreldes

- ühilduvus

- kokkusobiv

- arvuti

- Arvuti visioon

- arvutustehnika

- Murettekitav

- konkurent

- Tingimused

- läbi

- konfigureeritud

- konservatiivne

- märkimisväärne

- kaaluda

- arvestades

- Konteiner

- sisu

- ümber

- tuum

- parandada

- vastab

- Maksma

- kulude kokkuhoid

- kuluefektiivne

- kulukas

- kulud

- võiks

- kattes

- looma

- loodud

- loomine

- otsustav

- CTO

- tava

- klient

- kliendi andmed

- Kliendi rahulolu

- Kasutajatugi

- Klienditugi

- Kliendid

- kohandatud

- andmed

- kuupäev

- Väheneb

- vähenema

- sügav

- sügav õpe

- määratletud

- määratlemisel

- tarnima

- edastamine

- Näidatud

- Olenevalt

- juurutada

- lähetatud

- juurutamine

- kasutuselevõtu

- kasutuselevõtt

- Disain

- soovitud

- Vaatamata

- Määrama

- kindlaksmääratud

- määrab

- määrates kindlaks

- arenenud

- Arendajad

- seade

- DID

- erinev

- diferentseeritud

- Juhataja

- avastasin

- eristatav

- jagatud

- hajutatud arvutus

- teeme

- domeen

- Domeenid

- Ära

- dramaatiliselt

- ajal

- dünaamiline

- dünaamiliselt

- iga

- efektiivsus

- tõhus

- tõhusalt

- kinnistamine

- võimaldama

- võimaldab

- Lõpuks-lõpuni

- Lõpp-punkt

- kaasamine

- insener

- Inseneriteadus

- suurendama

- suurendamine

- piisavalt

- tagama

- tagades

- ettevõtete

- keskkond

- vead

- Isegi

- Iga

- näide

- olemasolevate

- oodatav

- kulud

- kallis

- kogemus

- Kogemused

- eksperiment

- väline

- kiiremini

- fail

- Faile

- täitma

- finants-

- rahaliselt

- leidma

- esimene

- sobima

- FLEET

- Paindlikkus

- keskendub

- Järel

- eest

- formaat

- endine

- avastatud

- Asutaja

- neli

- Alates

- täielikult

- funktsionaalsus

- edasi

- Pealegi

- lünki

- tekitama

- loodud

- generatiivne

- Generatiivne AI

- saamine

- gif

- antud

- andmine

- eesmärk

- GPU

- GPU

- kalded

- olnud

- käsi

- käepide

- Varred

- Käsitsemine

- juhtuda

- riistvara

- Olema

- võttes

- he

- raske

- raske tõstmine

- aitama

- aidates

- aitab

- Suur

- suur jõudlus

- rohkem

- teda

- tema

- kapuuts

- võõrustaja

- Hosting

- hostimiskulud

- Lahtiolekuajad

- maja

- Kuidas

- aga

- HTML

- http

- HTTPS

- sajad

- tuvastatud

- if

- illustreerib

- kohe

- parandama

- Paranemist

- in

- Inc

- Kaasa arvatud

- Sissetulev

- Suurendama

- näitama

- osutatud

- info

- Infrastruktuur

- infrastruktuur

- uuenduslik

- sisend

- sisendite

- Näiteks

- selle asemel

- Integreerimine

- integratsioon

- Intelligentsus

- suhtlemist

- interaktsioonid

- huvi

- sisse

- sisse

- kutsutud

- kutsub

- seotud

- probleem

- IT

- ITS

- ise

- teekond

- jpg

- lihtsalt

- pidamine

- Võti

- Teadma

- teadmised

- keel

- suur

- Suured ettevõtted

- suurem

- Hilinemine

- hiljemalt

- kiht

- viima

- juhtivate

- õppimine

- kõige vähem

- Led

- Pärand

- vähem

- Finantsvõimendus

- võimendab

- tõstmine

- koormus

- laadimine

- saadetised

- loogika

- Madal

- vähendada

- masin

- masinõpe

- tehtud

- põhiline

- säilitada

- säilitamine

- tegema

- juhtima

- juhitud

- juhtimine

- haldab

- juhtiv

- palju

- Turg

- maksimeerimine

- tähendas

- Mälu

- Metaandmed

- Meetrika

- rändavad

- ränne

- miljon

- minimaalne

- alaealine

- leevendav

- ML

- mudel

- mudelid

- Jälgida

- igakuine

- rohkem

- Pealegi

- kõige

- motiveeritud

- liikuma

- liikuv

- palju

- Mitme mudeli lõpp-punkt

- mitmekordne

- peab

- emakeelena

- loodus

- vajalik

- Vajadus

- vaja

- vajadustele

- Uus

- nlp

- nüüd

- number

- Nvidia

- eesmärk

- of

- maha

- pakkuma

- pakkumine

- Pakkumised

- sageli

- on

- kunagi

- ONE

- ainult

- Operations

- Võimalus

- optimaalselt

- optimeerimine

- or

- et

- organisatsioonid

- Muu

- meie

- ise

- välja

- tulemusi

- üle

- üleöö

- Pakk

- pakend

- pakendatud

- pakendamine

- eriline

- eriti

- kirglik

- Plaaster

- tee

- Muster

- mustrid

- jõudlus

- perspektiiv

- torujuhe

- inimesele

- Platon

- Platoni andmete intelligentsus

- PlatoData

- Punkt

- Poliitika

- poliitika

- post

- võim

- sisse

- esitatud

- eelmine

- varem

- esmane

- Peamine

- Eelnev

- probleeme

- protsess

- töötlemine

- Toode

- Produktsioon

- tootlikkus

- korralik

- tõestatud

- anda

- tingimusel

- annab

- säte

- lükatakse

- panema

- Python

- pütorch

- kvaliteet

- päringud

- otsimine

- kiiresti

- valik

- alates

- Edetabel

- jõudma

- reaalajas

- realiseeritud

- hiljuti

- hiljuti

- vähendama

- vähendab

- vähendamine

- seotud

- asjakohasus

- asjakohane

- usaldusväärsus

- usaldusväärne

- jäänused

- esindatud

- taotleda

- Taotlusi

- nõutav

- nõue

- Nõuded

- Vajab

- ressurss

- Vahendid

- vastuste

- kohustused

- vastutav

- kaasa

- tulemuseks

- Tulemused

- -Läbi

- õige

- jäik

- juur

- jooks

- jooksmine

- ohverdama

- salveitegija

- SageMakeri järeldus

- sama

- rahulolu

- Säästa

- säästmine

- Hoiused

- nägin

- Skaalautuvus

- skaalautuvia

- Skaala

- laiendamine

- Kaalud

- ketendamine

- stsenaarium

- stsenaariumid

- teadlased

- Otsing

- turvalisus

- otsib

- vanem

- eri

- Jada

- Seeria

- teenima

- teenus

- Teenused

- teenindavad

- komplekt

- mitu

- vari

- kuju

- Jaga

- jagatud

- ta

- märkimisväärne

- märgatavalt

- sarnane

- lihtne

- lihtsustama

- ühekordne

- SUURUS

- väike

- nutikas

- So

- lahendus

- Lahendused

- LAHENDAGE

- mõned

- Ruum

- konkreetse

- eriti

- määratletud

- ora

- matkimine

- algus

- alustatud

- käivitamisel

- Alustavatel

- modernne

- Samm

- Sammud

- Veel

- ladustamine

- lihtne

- sammud

- mahukas

- selline

- komplekt

- toetama

- süsteemid

- tabel

- lahendada

- kohandatud

- Võtma

- võtab

- sihtmärk

- suunatud

- eesmärgid

- Ülesanne

- meeskond

- meeskonnad

- Tehnoloogiad

- Tehnoloogia

- katsetatud

- testid

- kui

- tänan

- et

- .

- oma

- Neile

- Need

- nad

- see

- kolm

- Läbi

- piletid

- aeg

- aega võttev

- et

- märgid

- ülemine

- Summa

- liiklus

- Rong

- koolitatud

- koolitus

- üle

- Muutma

- üleminek

- Trends

- proovitud

- Lõitkodalane

- Kaks korda

- kaks

- tüüp

- liigid

- all

- ainulaadne

- us

- Kasutus

- kasutama

- kasutage juhtumit

- Kasutatud

- Kasutajad

- kasutusalad

- kasutamine

- kasutades

- versioon

- väga

- nägemus

- vs

- tahan

- tagaotsitav

- oli

- Tee..

- kuidas

- we

- web

- veebiteenused

- olid

- millal

- kas

- mis

- kuigi

- koos

- ilma

- Töö

- töötas

- töötab

- muretsema

- oleks

- kirjutamine

- wu

- yaml

- sa

- Sinu

- sephyrnet