Hoolimata sellest, et LLM-id on näiliselt peatamatu kasutuselevõtt erinevates tööstusharudes, on need üks osa laiemast tehnoloogilisest ökosüsteemist, mis toidab uut tehisintellekti lainet. Paljud vestluspõhised AI kasutusjuhtumid nõuavad kasutaja päringutele vastamiseks LLM-e, nagu Llama 2, Flan T5 ja Bloom. Need mudelid tuginevad küsimustele vastamiseks parameetrite teadmistele. Mudel õpib need teadmised koolituse käigus ja kodeerib need mudeli parameetritesse. Nende teadmiste värskendamiseks peame LLM-i ümber koolitama, mis võtab palju aega ja raha.

Õnneks saame oma LLM-ide teavitamiseks kasutada ka allikateadmisi. Allikateadmised on teave, mis sisestatakse LLM-i sisendviipa kaudu. Üks populaarne viis allikateadmiste pakkumiseks on Retrieval Augmented Generation (RAG). RAG-i kasutades hangime asjakohase teabe välisest andmeallikast ja edastame selle teabe LLM-i.

Selles ajaveebi postituses uurime, kuidas juurutada LLM-e, nagu Llama-2, kasutades Amazon Sagemaker JumpStart ja hoida oma LLM-e kursis asjakohase teabega Retrieval Augmented Generation (RAG) abil, kasutades Pinecone vektorandmebaasi, et vältida tehisintellekti hallutsinatsioone. .

Retrieval Augmented Generation (RAG) rakenduses Amazon SageMaker

Pinecone tegeleb RAG-i otsingukomponendiga, kuid teil on vaja veel kahte kriitilist komponenti: kuskil LLM-i järelduse käitamiseks ja kusagil manustamismudeli käitamiseks.

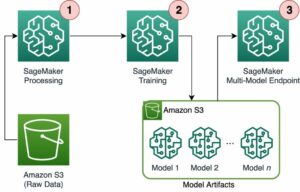

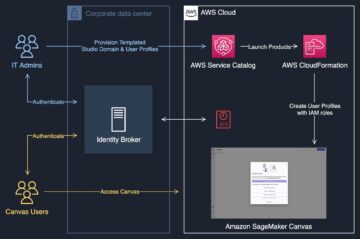

Amazon SageMaker Studio on integreeritud arenduskeskkond (IDE), mis pakub ühtset veebipõhist visuaalset liidest, kus pääsete juurde spetsiaalselt loodud tööriistadele kogu masinõppe (ML) arendamiseks. See pakub SageMaker JumpStart, mis on mudelikeskus, kus kasutajad saavad oma SageMakeri kontol konkreetse mudeli leida, eelvaateid vaadata ja käivitada. See pakub eelkoolitatud, avalikult kättesaadavaid ja patenteeritud mudeleid paljudele probleemitüüpidele, sealhulgas alusmudelitele.

Amazon SageMaker Studio pakub ideaalset keskkonda RAG-toega LLM-torujuhtmete arendamiseks. Esiteks, kasutades AWS-i konsooli, minge Amazon SageMakerisse ja looge SageMaker Studio domeen ja avage Jupyter Studio märkmik.

Eeldused

Täitke järgmised eeltingimusetapid:

- Seadistage Amazon SageMaker Studio.

- Amazon SageMakeri domeeni pardal.

- Registreeruge tasuta Pinecone Vectori andmebaasi kasutajaks.

- Eelduslikud teegid: SageMaker Python SDK, Pinecone Client

Lahendus Juurdepääs

SageMaker Studio sülearvutit kasutades peame esmalt installima eeltingimusteekid:

LLM-i juurutamine

Selles postituses käsitleme kahte lähenemisviisi LLM-i juurutamiseks. Esimene on läbi HuggingFaceModel objektiks. Saate seda kasutada LLM-ide juurutamisel (ja mudelite manustamisel) otse Hugging Face mudelikeskusest.

Näiteks saate luua juurutatava konfiguratsiooni jaoks google/flan-t5-xl mudel, nagu on näidatud järgmisel ekraanipildil:

Mudeleid otse Hugging Face'ist juurutades lähtestage my_model_configuration järgmisega:

- An

envconfig ütleb meile, millist mudelit ja millise ülesande jaoks kasutada tahame. - Meie SageMakeri teostus

roleannab meile loa oma mudeli juurutamiseks. - An

image_urion pildikonfiguratsioon spetsiaalselt Hugging Face'i LLM-ide juurutamiseks.

Alternatiivina on SageMakeril komplekt mudeleid, mis ühilduvad otseselt lihtsamaga JumpStartModel objektiks. See mudel toetab paljusid populaarseid LLM-e, nagu Llama 2, mida saab lähtestada, nagu on näidatud järgmises ekraanipildis:

Mõlema versiooni jaoks my_model, juurutage need, nagu on näidatud järgmises ekraanipildis:

Meie initsialiseeritud LLM-i lõpp-punktiga saate päringuid alustada. Meie päringute vorming võib erineda (eriti vestlus- ja mittevestlusvõimeliste LLM-ide vahel), kuid protsess on üldiselt sama. Hugging Face mudeli puhul tehke järgmist.

Lahenduse leiate aadressilt GitHubi hoidla.

Loodud vastusel, mille me siin saame, pole erilist mõtet – see on hallutsinatsioon.

LLM-ile täiendava konteksti pakkumine

Laama 2 püüab vastata meie küsimusele ainult sisemiste parameetriliste teadmiste põhjal. On selge, et mudeli parameetrid ei salvesta teadmisi selle kohta, milliseid juhtumeid saame SageMakeris hallatud kohakoolitusega.

Sellele küsimusele õigesti vastamiseks peame kasutama allikateadmisi. See tähendab, et anname viipa kaudu LLM-ile lisateavet. Lisame selle teabe otse mudeli täiendava kontekstina.

Nüüd näeme küsimusele õiget vastust; see oli lihtne! Tõenäoliselt ei lisa kasutaja aga oma viipadesse kontekste, ta teaks juba vastust oma küsimusele.

Ühe konteksti käsitsi sisestamise asemel tuvastage asjakohane teave automaatselt ulatuslikumast teabeandmebaasist. Selleks vajate Retrieval Augmented Generation.

Täiustatud põlvkonna otsimine

Retrieval Augmented Generation abil saate kodeerida teabe andmebaasi vektorruumi, kus vektorite vaheline lähedus näitab nende asjakohasust/semantilist sarnasust. Selle vektorruumi kui teadmistebaasi abil saate teisendada uue kasutajapäringu, kodeerida selle samasse vektorruumi ja hankida kõige asjakohasemad varem indekseeritud kirjed.

Pärast nende asjakohaste kirjete toomist valige neist mõned ja lisage need LLM-i viipale täiendava kontekstina, pakkudes LLM-ile väga asjakohaseid allikateadmisi. See on kaheetapiline protsess, kus:

- Indekseerimine täidab vektorindeksi andmestiku teabega.

- Otsimine toimub päringu ajal ja sealt saame vektorindeksist asjakohase teabe.

Mõlemad etapid nõuavad manustamismudelit, et tõlkida meie inimloetav lihttekst semantiilisse vektorruumi. Kasutage Hugging Face'i ülitõhusat MiniLM-lausemuundurit, nagu on näidatud järgmisel ekraanipildil. See mudel ei ole LLM ja seetõttu pole seda lähtestatud samal viisil kui meie Llama 2 mudelit.

aasta hub_config, määrake mudeli ID, nagu on näidatud ülaloleval ekraanipildil, kuid ülesande jaoks kasutage funktsioonide ekstrakti, kuna genereerime vektormanustusi, mitte teksti nagu meie LLM. Pärast seda lähtestage mudeli konfiguratsioon käsuga HuggingFaceModel nagu varemgi, aga seekord ilma LLM-pildita ja mõningate versiooniparameetritega.

Saate mudeli uuesti juurutada, kasutades deploy, kasutades väiksemat (ainult CPU) eksemplari ml.t2.large. MiniLM-mudel on pisike, nii et see ei vaja palju mälu ega vaja GPU-d, kuna see suudab kiiresti luua manuseid isegi protsessoris. Soovi korral saate mudelit GPU-ga kiiremini käivitada.

Manuste loomiseks kasutage predict meetodit ja edastage kodeerimiseks kontekstide loend inputs võti nagu näidatud:

Läbitakse kaks sisendkonteksti, tagastades kaks kontekstivektori manustamist, nagu näidatud:

len(out)

2

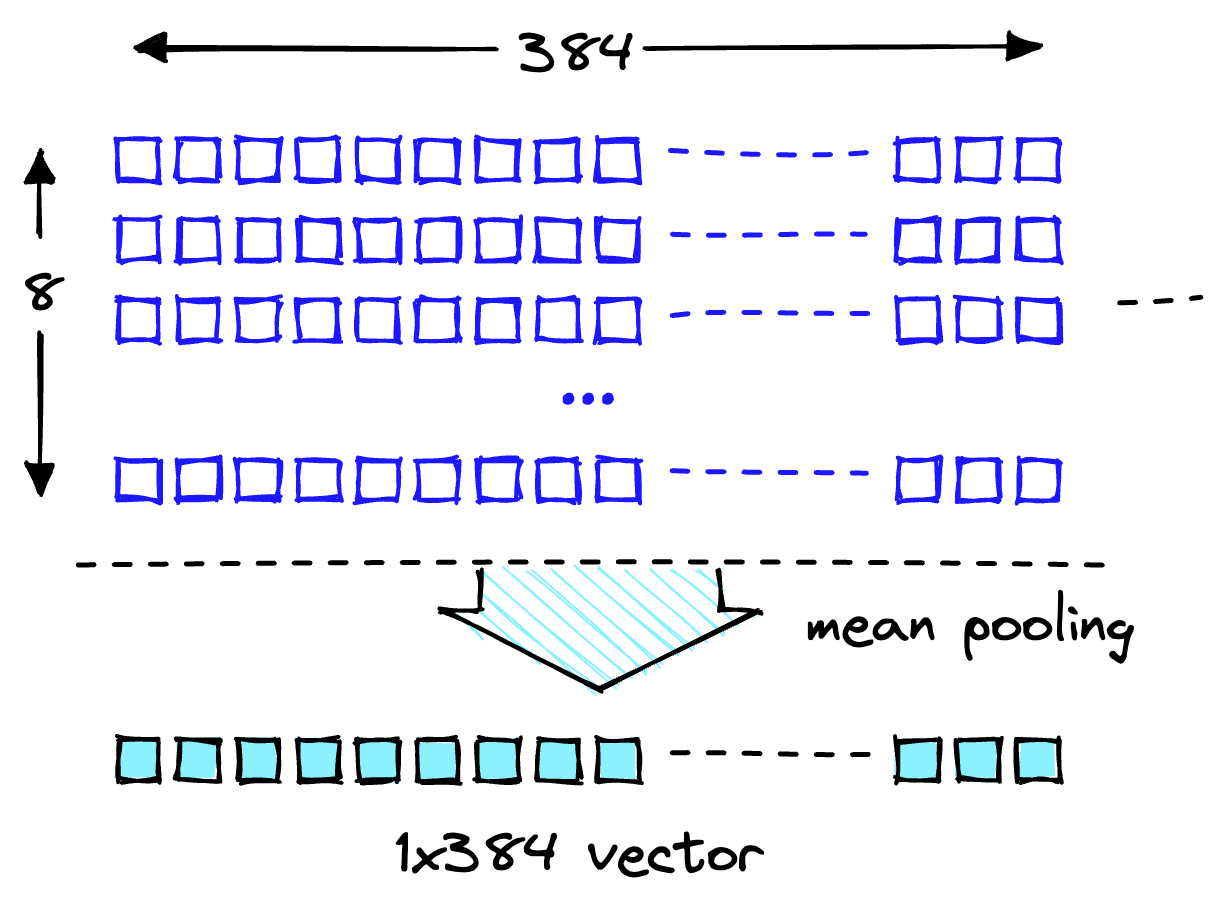

MiniLM-i mudeli manustamise mõõtmed on 384 mis tähendab, et iga MiniLM-i väljundit põimiv vektor peaks olema mõõtmetega 384. Kuid vaadates meie manuste pikkust, näete järgmist.

len(out[0]), len(out[1])

(8, 8)

Kahes loendis on kaheksa üksust. MiniLM töötleb teksti esmalt märgistamise etapis. See tokeniseerimine muudab meie inimloetava lihtteksti mudeliloetavate märgi ID-de loendiks. Mudeli väljundfunktsioonides näete märgitaseme manuseid. üks neist manustest näitab eeldatavat dimensiooni 384 nagu näidatud:

len(out[0][0])

384

Teisendage need märgitaseme manustused dokumenditasemel manusteks, kasutades iga vektori dimensiooni keskmisi väärtusi, nagu on näidatud järgmisel joonisel.

Keskmine koondamisoperatsioon ühe 384-mõõtmelise vektori saamiseks.

Kahe 384-mõõtmelise vektormanustusega, üks iga sisendteksti jaoks. Meie elu lihtsamaks muutmiseks mähkige kodeerimisprotsess üheks funktsiooniks, nagu on näidatud järgmises ekraanipildis:

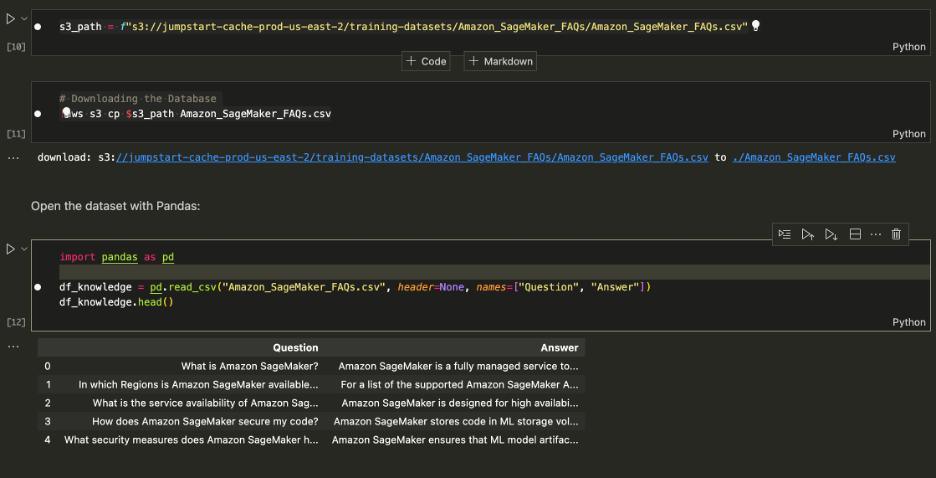

Andmestiku allalaadimine

Laadige alla Amazon SageMakeri KKK-d teadmistebaasina, et hankida andmeid, mis sisaldavad nii küsimuste kui ka vastuste veerge.

Laadige alla Amazon SageMakeri KKK-d

Otsingut tehes otsige ainult vastuseid, et saaksite veeru Küsimus tühistada. Täpsemalt vaadake märkmikku.

Meie andmekogum ja manustamiskonveier on valmis. Nüüd vajame ainult kohta, kuhu need manused salvestada.

Indekseerimine

Pinecone vektorandmebaas salvestab vektormanused ja otsib neid tõhusalt laiaulatuslikult. Andmebaasi loomiseks vajate Pinecone'i tasuta API-võtit.

Pärast Pinecone vektori andmebaasiga ühenduse loomist looge üks vektorindeks (sarnaselt traditsiooniliste andmebaaside tabeliga). Nimetage indeks retrieval-augmentation-aws ja joondage indeks dimension ja metric parameetrid parameetritega, mida nõuab manustamismudel (antud juhul MiniLM).

Andmete sisestamise alustamiseks käivitage järgmine:

Indeksi päringuid saate alustada selle postituse varasema küsimusega.

Ülaltoodud väljund näitab, et tagastame asjakohased kontekstid, mis aitavad meil oma küsimusele vastata. Kuna meie top_k = 1, index.query tagastas parima tulemuse koos metaandmetega, mis loevad Managed Spot Training can be used with all instances supported in Amazon.

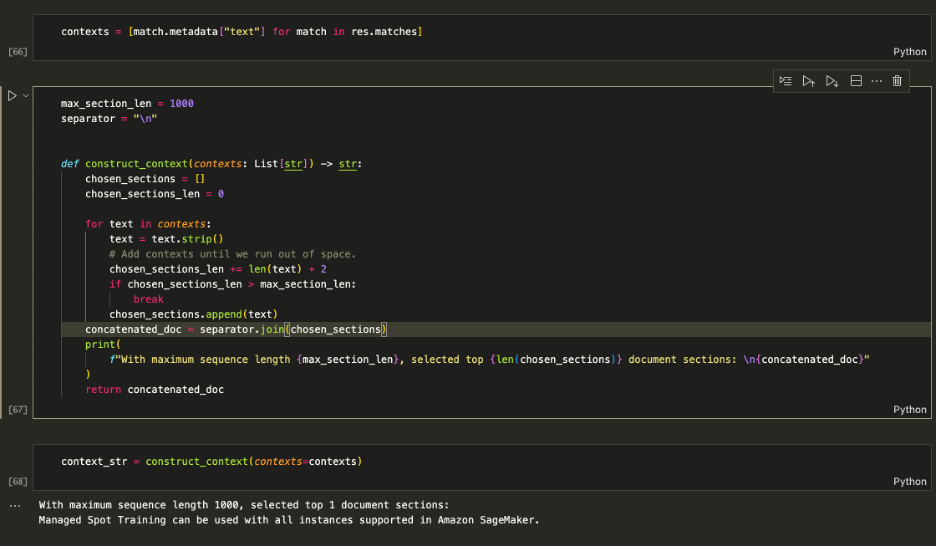

Viipa suurendamine

Kasutage otsitud kontekste, et viipa täiendada ja otsustada, kui palju konteksti LLM-i sisestada. Kasuta 1000 tähemärgipiirang, et iga tagastatud konteksti iteratiivselt lisada viipale, kuni ületate sisu pikkuse.

Viipa suurendamine

Sööda context_str LLM-i viibale, nagu on näidatud järgmises ekraanipildis:

[Sisend]: milliseid eksemplare saan SageMakeris hallatud kohakoolitusega kasutada? [Väljund]: Esitatud konteksti põhjal saate kasutada hallatud kohakoolitust kõigi Amazon SageMakeri toetatud eksemplaridega. Seetõttu on vastus järgmine: Amazon SageMaker toetab kõiki eksemplare.

Loogika töötab, nii et pakkige see üheks funktsiooniks, et asjad puhtana hoida.

Nüüd saate esitada selliseid küsimusi, nagu on näidatud järgmises.

Koristage

Soovimatute tasude peatamiseks kustutage mudel ja lõpp-punkt.

Järeldus

Selles postituses tutvustasime teile RAG-i avatud juurdepääsuga LLM-idega SageMakeris. Näitasime ka, kuidas juurutada Llama 2-ga Amazon SageMaker Kiirstardi mudeleid, Flan T5-ga Hugging Face LLM-e ja MiniLM-iga mudeleid manustada.

Rakendasime täieliku otsast lõpuni RAG torujuhtme, kasutades meie avatud juurdepääsu mudeleid ja Pinecone vektorindeksit. Seda kasutades näitasime, kuidas hallutsinatsioone minimeerida ja LLM-i teadmisi ajakohasena hoida ning lõppkokkuvõttes suurendada kasutajakogemust ja usaldust meie süsteemide vastu.

Selle näite iseseisvaks käitamiseks kloonige see GitHubi hoidla ja tutvuge eelnevate sammudega, kasutades Küsimustele vastamise märkmik GitHubis.

Autoritest

Vedant Jain on Sr. AI/ML spetsialist, kes töötab strateegiliste generatiivse AI algatuste kallal. Enne AWS-iga liitumist on Vedant töötanud ML/Data Science Specialty ametikohtadel erinevates ettevõtetes, nagu Databricks, Hortonworks (nüüd Cloudera) ja JP Morgan Chase. Väljaspool oma tööd on Vedant kirglik muusika tegemine, kaljuronimine, teaduse kasutamine tähendusrikka elu elamiseks ja köökide avastamine kogu maailmast.

Vedant Jain on Sr. AI/ML spetsialist, kes töötab strateegiliste generatiivse AI algatuste kallal. Enne AWS-iga liitumist on Vedant töötanud ML/Data Science Specialty ametikohtadel erinevates ettevõtetes, nagu Databricks, Hortonworks (nüüd Cloudera) ja JP Morgan Chase. Väljaspool oma tööd on Vedant kirglik muusika tegemine, kaljuronimine, teaduse kasutamine tähendusrikka elu elamiseks ja köökide avastamine kogu maailmast.

James Briggs on Pinecone'i personali arendaja advokaat, kes on spetsialiseerunud vektorotsingule ja AI/ML-ile. Ta juhendab arendajaid ja ettevõtteid veebipõhise hariduse kaudu oma GenAI lahenduste väljatöötamisel. Enne Pinecone'i töötas James tehisintellekti kallal väikeste tehnoloogiliste idufirmade ja asutatud finantsettevõtete jaoks. Väljaspool tööd on Jamesil kirg reisimise ja uute seikluste vastu, alates surfamisest ja akvalangist kuni Muay Thai ja BJJ-ni.

James Briggs on Pinecone'i personali arendaja advokaat, kes on spetsialiseerunud vektorotsingule ja AI/ML-ile. Ta juhendab arendajaid ja ettevõtteid veebipõhise hariduse kaudu oma GenAI lahenduste väljatöötamisel. Enne Pinecone'i töötas James tehisintellekti kallal väikeste tehnoloogiliste idufirmade ja asutatud finantsettevõtete jaoks. Väljaspool tööd on Jamesil kirg reisimise ja uute seikluste vastu, alates surfamisest ja akvalangist kuni Muay Thai ja BJJ-ni.

Xin Huang on Amazon SageMaker JumpStart ja Amazon SageMaker sisseehitatud algoritmide vanemrakendusteadlane. Ta keskendub skaleeritavate masinõppe algoritmide arendamisele. Tema uurimishuvid on seotud loomuliku keele töötlemise, tabeliandmete seletatava süvaõppe ja mitteparameetrilise aegruumi klastrite tugeva analüüsiga. Ta on avaldanud palju artikleid ACL-is, ICDM-is, KDD konverentsidel ja Kuninglikus Statistikaühingus: A-seeria.

Xin Huang on Amazon SageMaker JumpStart ja Amazon SageMaker sisseehitatud algoritmide vanemrakendusteadlane. Ta keskendub skaleeritavate masinõppe algoritmide arendamisele. Tema uurimishuvid on seotud loomuliku keele töötlemise, tabeliandmete seletatava süvaõppe ja mitteparameetrilise aegruumi klastrite tugeva analüüsiga. Ta on avaldanud palju artikleid ACL-is, ICDM-is, KDD konverentsidel ja Kuninglikus Statistikaühingus: A-seeria.

- SEO-põhise sisu ja PR-levi. Võimenduge juba täna.

- PlatoData.Network Vertikaalne generatiivne Ai. Jõustage ennast. Juurdepääs siia.

- PlatoAiStream. Web3 luure. Täiustatud teadmised. Juurdepääs siia.

- PlatoESG. Süsinik, CleanTech, Energia, Keskkond päikeseenergia, Jäätmekäitluse. Juurdepääs siia.

- PlatoTervis. Biotehnoloogia ja kliiniliste uuringute luureandmed. Juurdepääs siia.

- Allikas: https://aws.amazon.com/blogs/machine-learning/mitigate-hallucinations-through-retrieval-augmented-generation-using-pinecone-vector-database-llama-2-from-amazon-sagemaker-jumpstart/

- :on

- :on

- :mitte

- : kus

- $ UP

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 16

- 17

- 19

- 23

- 32

- 7

- 8

- 9

- a

- MEIST

- üle

- juurdepääs

- Vastavalt

- konto

- üle

- lisama

- Täiendavad lisad

- Tooteinfo

- Vastuvõtmine

- seiklused

- advokaat

- jälle

- AI

- ai kasutusjuhtumeid

- AI / ML

- algoritme

- viia

- Materjal: BPA ja flataatide vaba plastik

- mööda

- juba

- Ka

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon SageMaker Studio

- Amazon Web Services

- summa

- an

- analüüs

- ja

- vastus

- vastuseid

- mistahes

- API

- app

- rakendatud

- lähenemine

- lähenemisviisid

- OLEME

- PIIRKOND

- ümber

- AS

- küsima

- At

- Katsed

- suurendama

- suurendatud

- auto

- automaatselt

- saadaval

- AWS

- baas

- põhineb

- BE

- sest

- enne

- alustama

- vahel

- Blogi

- Õitsema

- mõlemad

- laiem

- ehitama

- sisseehitatud

- ettevõtted

- kuid

- by

- CAN

- lüüa

- juhul

- juhtudel

- märki

- koormuste

- tagaajamine

- puhastama

- selgelt

- Ronimine

- cloudera

- Klastrite loomine

- Veerg

- Veerud

- Ettevõtted

- kokkusobiv

- täitma

- komponent

- komponendid

- konverentsid

- seotud

- konsool

- sisaldama

- sisaldab

- sisu

- kontekst

- kontekstid

- jutukas

- jutukas AI

- muutma

- Korporatsioonid

- parandada

- õigesti

- looma

- kriitiline

- Praegu

- andmed

- andmebaas

- kuupäev

- DBS

- otsustama

- sügav

- sügav õpe

- juurutada

- juurutamine

- arendaja

- Arendajad

- arenev

- & Tarkvaraarendus

- mõõde

- otse

- arutama

- do

- ei

- ei

- Ei tee

- domeen

- don

- Drop

- ajal

- iga

- Ajalugu

- lihtsam

- ökosüsteemi

- Käsitöö

- tõhus

- tõhusalt

- kinnistamine

- omaks

- kodeerimine

- lõpp

- Lõpuks-lõpuni

- Lõpp-punkt

- suurendama

- keskkond

- asutatud

- Isegi

- näide

- ületama

- täitmine

- oodatav

- kogemus

- uurima

- Avastades

- ulatuslik

- väline

- väljavõte

- nägu

- kiiremini

- FUNKTSIOONID

- Toidetud

- vähe

- rahastama

- leidma

- lõpetama

- esimene

- Float

- keskendub

- Järel

- eest

- formaat

- Sihtasutus

- tasuta

- Alates

- funktsioon

- üldiselt

- loodud

- teeniva

- põlvkond

- generatiivne

- Generatiivne AI

- saama

- GitHub

- Andma

- antud

- annab

- Go

- Goes

- GPU

- juhendid

- käepide

- juhtub

- Olema

- he

- Held

- aitama

- siin

- kõrgelt

- tema

- Kuidas

- Kuidas

- aga

- HTTPS

- huang

- Keskus

- Kallistav Nägu

- inimesele loetav

- i

- ID

- ideaalne

- identifitseerima

- IDd

- if

- pilt

- rakendatud

- import

- in

- sisaldama

- Kaasa arvatud

- Suurendama

- indeks

- indekseeritud

- tööstusharudes

- teatama

- info

- algatused

- sisend

- sisendite

- paigaldama

- Näiteks

- integreeritud

- el

- Interface

- sisemine

- sisse

- sisse

- IT

- kirjed

- james

- liitumine

- jp

- JP Morgani

- JP Morgan Chase

- jpg

- hoidma

- Võti

- Teadma

- teadmised

- keel

- suur

- suurem

- algatama

- viima

- õppimine

- õpib

- Pikkus

- raamatukogud

- elu

- nagu

- LIMIT

- nimekiri

- Nimekirjad

- Elab

- Laama

- LLM

- loogika

- Vaata

- otsin

- Partii

- masin

- masinõpe

- tegema

- Tegemine

- juhitud

- käsitsi

- palju

- Vastama

- tikud

- maksimaalne

- maksimaalne summa

- mai..

- keskmine

- tähendusrikas

- vahendid

- Mälu

- Metaandmed

- meetod

- Leevendada

- ML

- mudel

- mudelid

- raha

- rohkem

- Morgan

- kõige

- palju

- mitmekordne

- muusika

- peab

- nimi

- Natural

- Natural Language Processing

- Vajadus

- vajadustele

- Uus

- järgmine

- nlp

- märkmik

- nüüd

- tuim

- objekt

- of

- on

- ONE

- Internetis

- ainult

- avatud

- töö

- or

- et

- OS

- muidu

- meie

- välja

- väljund

- väljundid

- väljaspool

- enda

- dokumendid

- parameetrid

- eriline

- eriti

- sooritama

- Vastu võetud

- kirg

- kirglik

- täitma

- esitades

- Õigused

- pilt

- torujuhe

- tavaline

- Platon

- Platoni andmete intelligentsus

- PlatoData

- populaarne

- positsioone

- post

- Toide

- ennustus

- Ennustused

- Predictor

- eelistatud

- vältida

- Eelvaade

- eelmine

- varem

- Eelnev

- Probleem

- protsess

- Protsessid

- töötlemine

- profiil

- küsib

- varaline

- tingimusel

- annab

- pakkudes

- avalikult

- avaldatud

- Python

- pütorch

- päringud

- küsimus

- Küsimused

- kiiresti

- valik

- alates

- valmis

- vastuvõtmine

- andmed

- piirkondades

- asjakohane

- lootma

- Hoidla

- esindab

- nõudma

- nõutav

- teadustöö

- Reageerida

- kaasa

- Tulemused

- tagasipöördumine

- tagasi

- jõuline

- Rokk

- Roll

- kuninglik

- jooks

- jookseb

- salveitegija

- sama

- ütlema

- skaalautuvia

- Skaala

- teadus

- teadlane

- skoor

- Ekraan

- SDK

- Otsing

- otsingud

- vaata

- näiliselt

- valima

- vanem

- tunne

- Lause

- Seeria

- Seeria A

- Teenused

- komplekt

- peaks

- näitama

- näitas

- näidatud

- Näitused

- külg

- sarnane

- lihtsam

- alates

- ühekordne

- SUURUS

- väike

- väiksem

- So

- Ühiskond

- Ainult

- lahendus

- Lahendused

- mõned

- kuskil

- allikas

- Ruum

- spetsialist

- spetsialiseerunud

- Eriala

- eriti

- Kaubandus-

- Personal

- Alustavatel

- statistiline

- Samm

- Sammud

- Peatus

- salvestada

- kauplustes

- Strateegiline

- nöör

- stuudio

- selline

- toetama

- Toetatud

- Toetab

- süsteem

- süsteemid

- tabel

- võtab

- Ülesanne

- tech

- tech idufirmad

- Tehnoloogia

- ütleb

- tekst

- tai

- kui

- et

- .

- Piirkond

- maailm

- oma

- Neile

- seetõttu

- Need

- nad

- asjad

- see

- need

- Läbi

- aeg

- et

- sümboolne

- Tokeniseerimine

- liiga

- töövahendid

- ülemine

- traditsiooniline

- koolitus

- trafo

- trafod

- muudab

- tõlkima

- Reisimine

- Usalda

- kaks

- liigid

- lõpuks

- Ebatõenäoline

- peatamatu.

- kuni

- soovimatu

- Värskendused

- us

- kasutama

- Kasutatud

- Kasutaja

- User Experience

- Kasutajad

- kasutamine

- Väärtused

- eri

- versioon

- versioonid

- kaudu

- visuaalne

- ootama

- läbikäiguks

- tahan

- oli

- Wave

- Tee..

- we

- web

- veebiteenused

- Veebipõhine

- M

- millal

- mis

- kuigi

- lai

- Lai valik

- will

- koos

- ilma

- Töö

- töötas

- töö

- töötab

- maailm

- oleks

- pakkima

- X

- jah

- sa

- Sinu

- sephyrnet