Sissejuhatus

Aeg-ajalt võib inimene võtta abstraktse kontseptsiooni, mis näib ametlikuks uurimiseks liiga ebamäärane, ja pakkuda elegantset formaalset määratlust. Claude Shannon tegi seda koos info, ja Andrei Kolmogorov tegi seda koos juhuslikkus. Viimastel aastatel on teadlased püüdnud teha sama masinõppe õigluse kontseptsiooni jaoks. Kahjuks on see olnud keerulisem. Mõistet pole mitte ainult raskem defineerida, vaid ka üksainus määratlus ei suuda rahuldada kõiki soovitavaid õigluse näitajaid. Arvind Narayanan, Princetoni ülikooli arvutiteadlane, on aidanud kaasa erinevate vaadete kontekstualiseerimisele ja selle uue valdkonna kehtestamisele.

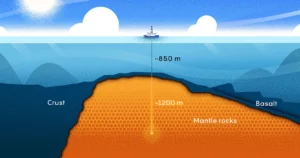

Tema karjäär on hõlmanud kõiki abstraktsioonitasemeid teooriast poliitikani, kuid teekond, mis lõpuks viis tema praeguse tööni, algas 2006. aastal. Sel aastal sponsoreeris Netflix võistlust, mille raames anti miljon dollarit kõigile, kes parandasid oma soovitussüsteemi täpsust. 1%. Netflix esitas väidetavalt anonüümse andmekogumi kasutajate ja nende hinnangute kohta, millest eemaldati isikut tuvastav teave. Kuid Narayanan näitas, et keeruka statistilise tehnikaga on andmekogumis anonüümse kasutaja identiteedi paljastamiseks vaja vaid mõnda andmepunkti.

Sellest ajast peale on Narayanan keskendunud teistele valdkondadele, kus teooria kohtub praktikaga. Läbi Princetoni veebi läbipaistvuse ja vastutuse projekt, avastas tema meeskond salajasi viise, kuidas veebisaidid kasutajaid jälgivad ja tundlikke andmeid eraldavad. Tema meeskond avastas, et selline rühm nagu Riiklik Julgeolekuagentuur võib kasutada veebisirvimisandmeid (täpsemalt kolmandate isikute paigutatud küpsiseid) mitte ainult kasutaja tegeliku identiteedi tuvastamiseks, vaid ka 62–73% sirvimisajaloo rekonstrueerimiseks. . Nad näitasid, et - riff on kuulus New Yorker multifilm — Internetis teavad veebisaidid nüüd, et olete koer.

Viimastel aastatel on Narayanan spetsiaalselt pöördunud masinõpe — tehisintellekti rakendus, mis annab masinatele võimaluse andmetest õppida. Kuigi ta tervitab tehisintellekti arengut, juhib ta tähelepanu sellele, kuidas sellised süsteemid võivad ebaõnnestuda isegi heade kavatsuste korral ja kuidas need muidu kasulikud tehnoloogiad võivad saada diskrimineerimise õigustamise vahenditeks. Selles valguses moodustavad Narayanani uurimistrajektoori määratlenud näiliselt mitteühendatud punktid omamoodi tähtkuju.

Quanta rääkis Narayananiga tema tööst anonüümsuse kaotamisel, statistilise intuitsiooni tähtsusest ja tehisintellektisüsteemide paljudest lõkse. Intervjuu on koondatud ja selguse huvides toimetatud.

Sissejuhatus

Kas olete alati tahtnud matemaatikat ja loodusteadusi uurida?

Kasvasin üles väga huvitatud mõlemast, kuid eelkõige matemaatikast. Mul oli hea mõistatusi lahendada ja isegi rahvusvahelisel matemaatikaolümpiaadil õnnestus. Kuid mul oli tohutu eksiarvamus mõistatuste lahendamise ja uurimistöö matemaatika erinevusest.

Ja nii varakult keskendusin ma oma uurimistöös krüptograafiale, eriti teoreetilisele krüptograafiale, kuna töötasin endiselt pettekujutelma all, et olen matemaatikas väga hea. Ja siis on mu ülejäänud karjäär olnud teekond, et mõista, et see pole tegelikult minu tugevus.

See pidi olema teie anonüümsuse kaotamise töö jaoks hea taust.

Sul on õigus. Anonüümsuse kaotamise uurimist võimaldas oskus, mida ma nimetan statistiliseks intuitsiooniks. See ei ole tegelikult formaalne matemaatiline teadmine. See tähendab, et teie peas on intuitsioon: "Kui ma võtan selle keeruka andmestiku ja rakendan sellele selle teisenduse, siis mis on usutav tulemus?"

Intuitsioon võib sageli olla vale ja see on OK. Kuid oluline on omada intuitsiooni, sest see võib suunata teid teedele, mis võivad olla viljakad.

Sissejuhatus

Kuidas aitas statistiline intuitsioon teie tööd Netflixi andmetega?

Olin püüdnud välja töötada kõrgmõõtmeliste andmete anonüümseks muutmise skeemi. See ebaõnnestus täielikult, kuid ebaõnnestumise käigus tekkis mul intuitsioon, et kõrgmõõtmelisi andmeid ei saa tõhusalt anonüümseks muuta. Muidugi väitis Netflix oma konkurentsiga, et tegi täpselt seda.

Mul oli loomulik skeptitsism ettevõtete turundusavalduste suhtes, mistõttu olin motiveeritud tõestama, et need eksivad. Mu nõunik Vitali Šmatikov ja mina töötasime selle kallal paar intensiivset nädalat. Kui saime aru, et tööl on tõesti mõju, hakkasin rohkem tegema.

Milline oli üldine mõju? Kas kuulsite tagasi Netflixilt ja teistelt ettevõtetelt, kelle andmed osutusid mitte nii anonüümseks?

Noh, üks positiivne mõju on see, et see innustas teadust erinev privaatsus. Kuid ettevõtete reageerimise osas on olnud mõned erinevad reaktsioonid. Paljudel juhtudel ei tee ettevõtted, kes oleksid muidu andmekogumeid avalikkusele avaldanud, seda enam – nad relvastavad privaatsust, et võidelda läbipaistvuspüüdluste vastu.

Facebook on selle poolest tuntud. Kui teadlased lähevad Facebooki ja ütlevad: "Me vajame juurdepääsu mõnele neist andmetest, et uurida, kuidas teave platvormil levib", saab Facebook nüüd öelda: "Ei, me ei saa teile seda anda. See seab ohtu meie kasutajate privaatsuse.

Sa kirjutasid kunagi a paber väites, et mõiste "isikut tuvastav teave" võib olla eksitav. Kuidas nii?

Ma arvan, et poliitikakujundajate seas valitseb segadus, mis tuleneb selle mõiste kahest erinevast kasutusviisist. Üks on teie kohta käiv väga tundlik teave, näiteks teie sotsiaalkindlustusnumber. Teine tähendus on teave, mida saab indekseerida teatud andmekogumitesse ja kasutada seeläbi teie kohta lisateabe leidmiseks.

Neil kahel on erinev tähendus. Mul pole PII mõistega veiseliha esimeses tähenduses. Teatud andmed inimeste kohta on väga tundlikud ja me peaksime neid hoolikamalt käsitlema. Kuid kuigi teie e-posti aadress ei pruugi enamiku inimeste jaoks olla väga tundlik, on see siiski kordumatu identifikaator, mida saab kasutada teie leidmiseks teistest andmekogumitest. Niikaua kui inimese atribuutide kombinatsioon on kõigile teistele maailmas kättesaadav, on see kõik, mida anonüümseks muutmiseks vajate.

Sissejuhatus

Kuidas jõudsite lõpuks õiglust õppima?

Õpetasin 2017. aastal õigluse ja masinõppe kursust. See andis mulle hea ettekujutuse valdkonna lahtistest probleemidest. Ja koos sellega pidasin ma kõne nimega "21 õigluse määratlused ja nende poliitika.” Selgitasin, et tehniliste määratluste vohamine ei ole tingitud tehnilistest põhjustest, vaid sellest, et kõige selle keskmes on ehtsad moraalsed küsimused. Mitte mingil juhul ei saa teil olla ühte statistilist kriteeriumi, mis hõlmaks kõiki normatiivseid soove – kõiki asju, mida soovite. Jutt võeti hästi vastu, nii et need kaks koos veensid mind, et peaksin selle teemaga tegelema hakkama.

Sina samuti pidas kõne AI maduõli tuvastamise kohta, mis võeti samuti hästi vastu. Kuidas on see seotud masinõppe õiglusega?

Nii et selle ajendiks oli see, et AI-s toimub ilmselgelt palju tõelisi tehnilisi uuendusi, näiteks tekstist pildiks muutmise programm. DALL E 2 või maleprogrammi AlfaZero. See on tõesti hämmastav, et see areng on olnud nii kiire. Suur osa sellest uuendusest väärib tähistamist.

Probleem tekib siis, kui kasutame seda väga lahtist ja laia katusterminit "AI" nii selliste asjade kui ka keerukamate rakenduste jaoks, nagu kriminaalsete riskide prognoosimise statistilised meetodid. Selles kontekstis on kasutatud tehnoloogia tüüp väga erinev. Need on kaks väga erinevat tüüpi rakendust ning võimalikud eelised ja kahjud on samuti väga erinevad. Nende vahel pole peaaegu üldse seost, nii et mõlema jaoks sama termini kasutamine on täiesti segane.

Inimesi eksitatakse arvama, et kogu see edusamm, mida nad pildi loomisel näevad, tähendaks tegelikult edusamme sotsiaalsete ülesannete, nagu kuritegeliku riski ennustamine või koolist väljalangemise ennustamine. Kuid see pole sugugi nii. Esiteks, me saame vaid veidi paremini kui juhuslik juhus ennustada, kes võidakse kuriteo eest vahistada. Ja see täpsus saavutatakse tõesti lihtsate klassifikaatoritega. See ei muutu aja jooksul paremaks ega muutu paremaks, kuna kogume rohkem andmekogumeid. Seega on kõik need tähelepanekud vastupidised näiteks sügava õppimise kasutamisele kujutise genereerimiseks.

Kuidas eristaksite eri tüüpi masinõppeprobleeme?

See ei ole ammendav loetelu, kuid on kolm ühist kategooriat. Esimene kategooria on taju, mis hõlmab selliseid ülesandeid nagu pildi sisu kirjeldamine. Teine kategooria on see, mida ma nimetan "otsuste automatiseerimiseks", näiteks kui Facebook soovib kasutada algoritme, et teha kindlaks, milline kõne on platvormile jäämiseks liiga mürgine. Ja kolmas ennustab tulevasi sotsiaalseid tulemusi inimeste seas – kas keegi arreteeritakse kuriteo eest või kas laps jätab koolist välja.

Kõigil kolmel juhul on saavutatavad täpsused väga erinevad, ebatäpse tehisintellekti võimalikud ohud on väga erinevad ja sellele järgnevad eetilised tagajärjed on väga erinevad.

Näiteks näotuvastus on minu klassifikatsioonis tajumisprobleem. Paljud inimesed räägivad, et näotuvastus on ebatäpne, ja mõnikord on neil õigus. Kuid ma ei usu, et see on sellepärast, et näotuvastuse täpsusel on põhimõttelised piirid. See tehnoloogia on paranenud ja see läheb paremaks. Just seetõttu peaksime selle pärast eetilisest vaatenurgast muretsema – kui annate selle politsei kätte, kes võib olla vastutustundetu või riigid, kes ei ole selle kasutamise osas läbipaistvad.

Sissejuhatus

Mis muudab sotsiaalse prognoosimise probleemid nii palju raskemaks kui tajuprobleemid?

Tajuprobleemidel on paar tunnust. Esiteks ei ole kahemõtteline, kas pildil on kass. Nii et teil on põhitõde. Teiseks on teil praktiliselt piiramatud treeningandmed, kuna saate kasutada kõiki veebis olevaid pilte. Ja kui olete Google või Facebook, saate kasutada kõiki pilte, mille inimesed on teie rakendusse üles laadinud. Nii et need kaks tegurit – ebaselgus ja andmete kättesaadavus – võimaldavad klassifikaatoritel tõesti hästi toimida.

See erineb ennustusprobleemidest, millel need kaks omadust puuduvad. Peaksin mainima kolmandat erinevust, mis on mõnes mõttes kõige olulisem: nende ennustusmudelite rakendamise moraalsed tagajärjed on väga erinevad telefonis keeletõlketööriista või piltide märgistamise tööriista kasutamisest.

Kuid see ei ole sama tõsidus kui vahend, mida kasutatakse selleks, et otsustada, kas kedagi tuleks näiteks kohtueelselt kinni pidada. Sellel on tagajärjed inimeste vabadusele. Iroonia on see, et valdkond, kus AI töötab kõige kehvemini, pole aja jooksul tegelikult paranenud ja tõenäoliselt ei parane ka tulevikus, on valdkond, millel on kõik need uskumatult olulised tagajärjed.

Suur osa teie tööst on nõudnud teie valdkonnaväliste ekspertidega rääkimist. Mis tunne on teistega niimoodi koostööd teha?

Interdistsiplinaarne koostöö on olnud ühed meeldivaimad koostööd. Ma arvan, et igal sellisel koostööl on omad masendavad hetked, sest inimesed ei räägi sama keelt.

Minu ettekirjutus selleks on: kultuur, siis keel, siis sisu. Kui te ei mõista nende kultuuri – näiteks millist stipendiumi nad hindavad –, on see tõesti raske. See, mis on ühe inimese jaoks väärtuslik, võib teisele tunduda ebaoluline. Seega tuleb kõigepealt navigeerida kultuurilistes aspektides. Seejärel saab hakata looma ühist keelt ja sõnavara ning jõuda lõpuks koostöö sisuni.

Kui optimistlik olete selle suhtes, kas saame uut tehnoloogiat ohutult ja targalt kasutusele võtta?

Üks osa probleemist on teadmiste lünk. Otsustajad, valitsusasutused, ettevõtted ja teised inimesed, kes neid tehisintellekti tööriistu ostavad, ei pruugi ennustamise täpsuse tõsiseid piire ära tunda.

Kuid lõpuks arvan, et see on poliitiline probleem. Mõned inimesed tahavad kulusid kärpida, seega tahavad nad automatiseeritud tööriista, mis kaotab töökohad. Seega on väga tugev surve uskuda, mida iganes need müüjad oma ennustamistööriistade kohta ütlevad.

Need on kaks erinevat probleemi. Minusugused inimesed saavad ehk aidata teabelünka lahendada. Kuid poliitilise probleemiga tegelemine nõuab aktiivsust. See nõuab meilt demokraatliku protsessi eeliseid. Tore on näha, et sellega tegeleb palju inimesi. Ja pikemas perspektiivis arvan, et suudame AI kahjulike ja kuritarvitavate rakenduste vastu tagasi lükata. Ma arvan, et see ei muutu hetkega, vaid läbi pika, veninud ja pikaleveninud aktivismiprotsessi, mis on kestnud juba kümme aastat või kauem. Olen kindel, et see jätkub veel kauaks.

- SEO-põhise sisu ja PR-levi. Võimenduge juba täna.

- Platoblockchain. Web3 metaversiooni intelligentsus. Täiustatud teadmised. Juurdepääs siia.

- Allikas: https://www.quantamagazine.org/he-protects-privacy-and-ai-fairness-with-statistics-20230310/

- :on

- ][lk

- $ 1 miljonit

- $ UP

- 2017

- a

- võime

- Võimalik

- MEIST

- sellest

- ABSTRACT

- juurdepääs

- aruandekohustus

- täpsus

- saavutada

- ACM

- tegevus

- Aktivism

- tegelikult

- aadress

- adresseerimine

- vastu võtma

- ettemaksed

- ADEelis

- vastu

- asutused

- agentuur

- AI

- algoritme

- Materjal: BPA ja flataatide vaba plastik

- juba

- alati

- hämmastav

- Mitmetähenduslikkus

- vahel

- ja

- anonüümne

- Teine

- keegi

- app

- taotlus

- rakendused

- kehtima

- OLEME

- PIIRKOND

- valdkondades

- arreteeriti

- kunstlik

- tehisintellekti

- AS

- aspektid

- At

- atribuudid

- Automatiseeritud

- kättesaadavus

- saadaval

- auhind

- tagasi

- tagapõhi

- BE

- sest

- muutuma

- Veiseliha

- hakkas

- on

- Uskuma

- Kasu

- Parem

- vahel

- lai

- Sirvimine

- Ostmine

- by

- helistama

- kutsutud

- CAN

- ei saa

- lööb

- Karjäär

- hoolikalt

- juhul

- juhtudel

- CAT

- kategooriad

- Kategooria

- tähistati

- kindel

- võimalus

- muutma

- omadused

- Male

- väitis

- selgus

- klassifikatsioon

- selgelt

- Teevad koostööd

- koostöö

- koostöö

- koguma

- kombinatsioon

- Tulema

- ühine

- Ettevõtted

- konkurents

- täiesti

- keeruline

- kompromiss

- arvuti

- mõiste

- mures

- segane

- segadus

- ühendus

- Tagajärjed

- sisu

- kontekst

- jätkama

- kontrast

- küpsised

- kulud

- võiks

- Paar

- Kursus

- Kuritegevus

- Criminal

- krüptograafia

- kultuuriline

- kultuur

- Praegune

- lõigatud

- kärpida kulusid

- ohud

- andmed

- andmepunktid

- andmekogum

- andmekogumid

- kümme aastat

- otsustajad

- sügav

- sügav õpe

- määratletud

- demokraatlik

- väärib

- kinni peetud

- Määrama

- arenenud

- valuuta

- DID

- erinevus

- erinev

- erinevaid probleeme

- avastama

- eristama

- koer

- teeme

- Ära

- Drop

- Varajane

- tõhusalt

- jõupingutusi

- kõrvaldab

- mõnus

- eriti

- põhiliselt

- looma

- asutades

- eetiline

- Isegi

- lõpuks

- täpselt

- ekspertide

- selgitas

- väljavõte

- nägu

- näotuvastus

- tegurid

- FAIL

- Ebaõnnestunud

- õiglane

- õiglus

- vähe

- väli

- võitlema

- Lõpuks

- leidma

- esimene

- keskendunud

- järgima

- eest

- vorm

- formaalne

- avastatud

- Vabadus

- Alates

- masendav

- põhiline

- tulevik

- lõhe

- põlvkond

- saama

- saamine

- Andma

- annab

- Go

- läheb

- hea

- Valitsus

- Maa

- Grupp

- suunata

- Käed

- Juhtub

- Raske

- kahjulik

- kahjustab

- Olema

- võttes

- juhataja

- kuulama

- süda

- aitama

- aidates

- ajalugu

- Kuidas

- HTTPS

- tohutu

- i

- idee

- tunnus

- Identity

- pilt

- pildid

- mõju

- mõjud

- tähtsus

- oluline

- võimatu

- parandama

- paranenud

- Paranemist

- in

- Teistes

- ebatäpne

- hõlmab

- uskumatult

- info

- Innovatsioon

- Näiteks

- kiire

- instrumentaal-

- Intelligentsus

- kavatsused

- huvitatud

- rahvusvaheliselt

- Internet

- Intervjuu

- seotud

- probleem

- IT

- ITS

- ise

- Tööturg

- teekond

- laps

- lapsed

- Laps

- Teadma

- teadmised

- teatud

- märgistamine

- puudus

- keel

- Õppida

- õppimine

- Led

- taset

- valgus

- nagu

- piirid

- nimekiri

- Pikk

- kaua aega

- enam

- Partii

- masin

- masinõpe

- masinad

- TEEB

- palju

- Turundus

- matemaatika

- matemaatiline

- tähendus

- vastab

- meetodid

- Meetrika

- võib

- miljon

- mudelid

- Hetki

- rohkem

- kõige

- motiveeritud

- Motiveerimine

- riiklik

- rahvuslik julgeolek

- Natural

- tingimata

- Vajadus

- Netflix

- Uus

- number

- of

- pakkuma

- Õli

- on

- ONE

- avatud

- Optimistlik

- Muu

- teised

- muidu

- Tulemus

- väljaspool

- üldine

- isikutele

- minevik

- Inimesed

- inimeste

- taju

- täitma

- ehk

- inimene

- Isiklikult

- perspektiiv

- telefon

- tükki

- inimesele

- Platon

- Platoni andmete intelligentsus

- PlatoData

- usutav

- võrra

- Politsei

- poliitika

- poliitikakujundajad

- poliitiline

- positiivne

- potentsiaal

- tava

- täpselt

- prognoosimine

- ennustus

- retsept

- surve

- eelkõige

- privaatsus

- Probleem

- probleeme

- protsess

- Programm

- Edu

- Tõesta

- tingimusel

- avalik

- Lükkama

- lükka tagasi

- panema

- Putting

- Pusled

- Kvantamagazin

- Küsimused

- juhuslik

- kiire

- hinnangust

- reaktsioonid

- päris maailm

- realiseeritud

- realiseerimisel

- põhjustel

- saadud

- hiljuti

- tunnustamine

- tunnistama

- Soovitus

- vabastatud

- jääma

- Eemaldatud

- nõutav

- Vajab

- teadustöö

- uurija

- Teadlased

- REST

- avalduma

- Oht

- jooks

- ohutult

- sama

- kava

- Kool

- teadus

- teadlane

- Teine

- turvalisus

- nägemine

- tunne

- tundlik

- tõsine

- komplekt

- Komplektid

- peaks

- lihtne

- ühekordne

- Skeptitsism

- oskus

- So

- sotsiaalmeedia

- Lahendamine

- mõned

- Keegi

- keeruline

- rääkima

- eriti

- kõne

- Sponsorite

- algus

- alustatud

- avaldused

- Ühendriigid

- statistiline

- Veel

- tugevus

- tugev

- Uuring

- Õppimine

- aine

- edu

- selline

- süsteem

- süsteemid

- Võtma

- rääkima

- rääkimine

- ülesanded

- meeskond

- Tehniline

- Tehnoloogiad

- Tehnoloogia

- tingimused

- et

- .

- Piirkond

- Tulevik

- teave

- maailm

- oma

- Neile

- teoreetiline

- sellega

- Need

- asjad

- Mõtlemine

- Kolmas

- kolmandad isikud

- põhjalikult

- kolm

- Läbi

- aeg

- et

- kokku

- liiga

- tööriist

- töövahendid

- teema

- suunas

- jälgida

- koolitus

- trajektoor

- Transformation

- tõlkima

- Tõlge

- läbipaistvus

- läbipaistev

- käsitlema

- Pöördunud

- liigid

- lõpuks

- vihmavari

- all

- mõistma

- ainulaadne

- Ülikool

- piiramatu

- laetud

- us

- kasutama

- Kasutaja

- Kasutajad

- väärtuslik

- väärtus

- müüjad

- vaated

- Tee..

- kuidas

- web

- webp

- veebilehed

- nädalat

- Tervitab

- Hästi

- M

- Mis on

- kas

- mis

- kuigi

- WHO

- kes iganes

- Wikipedia

- will

- koos

- Töö

- töötas

- töötab

- maailm

- oleks

- Vale

- aasta

- aastat

- sa

- Sinu

- youtube

- sephyrnet