Kui loete sellist lauset, ütleb teie varasem kogemus, et selle on kirjutanud mõtlev ja tundev inimene. Ja sel juhul kirjutab tõesti inimene neid sõnu: [Tere!]. Kuid tänapäeval on mõned laused, mis tunduvad märkimisväärselt inimlikud, tegelikult genereeritud tehisintellekti süsteemid, mis on treenitud tohutul hulgal inimtekstidel.

Inimesed on nii harjunud eeldama, et nad valdavad keel tuleneb mõtlevast ja inimesena tundvast inimesest, et vastupidiseid tõendeid võib olla raske ümber pöörata. Kuidas inimesed tõenäoliselt sellel suhteliselt kaardistamata territooriumil navigeerivad? Kuna kalduvus seostada ladusat väljendust ladusa mõtlemisega, on loomulik – kuid potentsiaalselt eksitav – arvata, et kui tehisintellekti mudel suudab end ladusalt väljendada, tähendab see, et see mõtleb ja tunneb samamoodi nagu inimesed.

Seega pole ehk üllatav, et endine Google'i insener väitis hiljuti, et Google'i tehisintellektisüsteemil LaMDA on enesetunne, kuna see suudab kõnekalt luua teksti oma väidetavate tunnete kohta. See sündmus ja järgnev meediakajastus viis a number õigustatult skeptiline kaubad ja postitused väitest, et inimkeele arvutuslikud mudelid on tundlikud, tähendusvõimelised mõtlema, tundma ja kogema.

Küsimus, mida tähendaks tehisintellekti mudeli tundlik olemine, on keeruline (vaata näiteks meie kolleegi arvamust) ja meie eesmärk ei ole seda lahendada. Aga keel Teadlased, saame kasutada oma tööd kognitiivteaduses ja lingvistikas, et selgitada, miks on inimestel liiga lihtne langeda kognitiivsesse lõksu, mis arvab, et üksus, kes oskab keelt ladusalt kasutada, on tundlik, teadlik või intelligentne.

AI kasutamine inimliku keele genereerimiseks

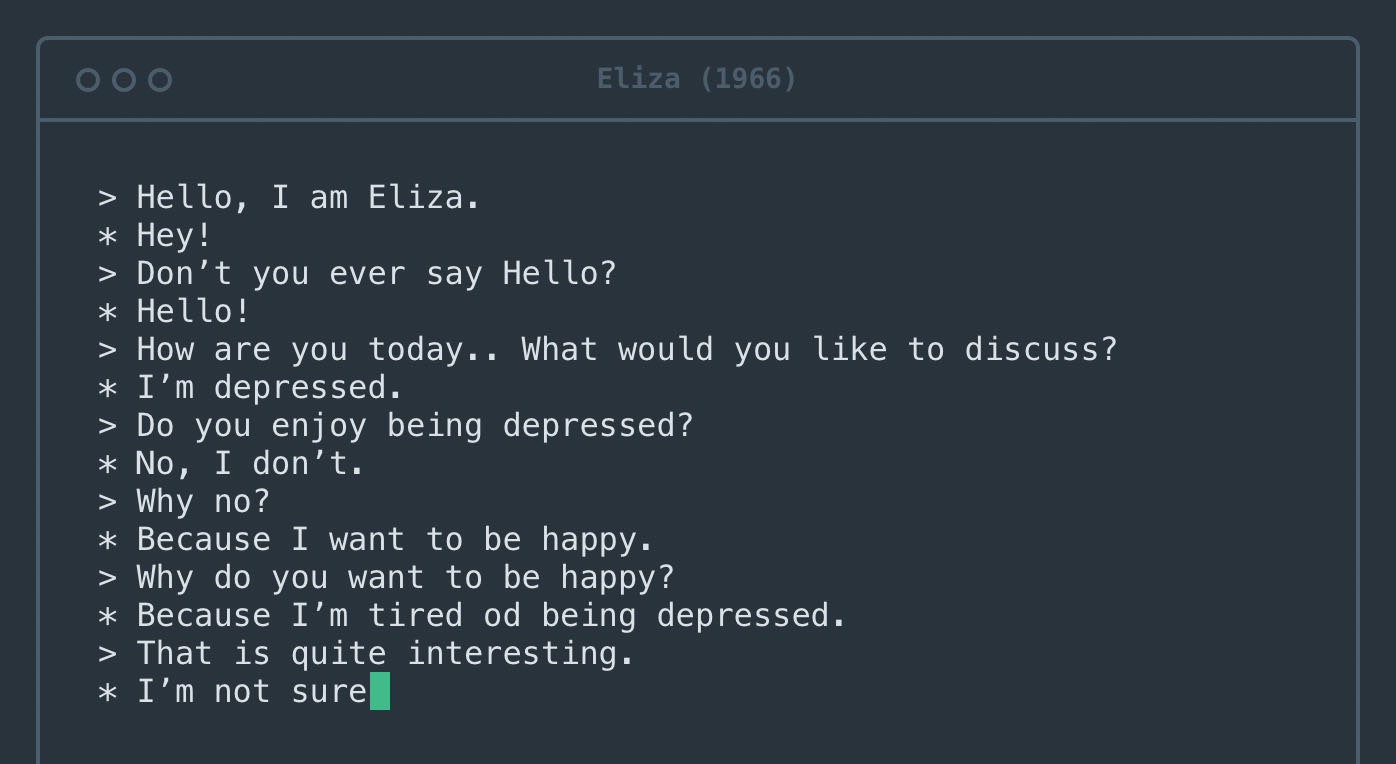

Mudelite, nagu Google'i LaMDA, loodud teksti võib olla raske eristada inimeste kirjutatud tekstist. See muljetavaldav saavutus on aastakümneid kestnud programmi tulemus, mille eesmärk on luua grammatilist ja tähendusrikast keelt loovaid mudeleid.

Varasemad versioonid, mis pärinevad vähemalt 1950. aastatest, mida tuntakse n-grammi mudelitena, lihtsalt loendasid konkreetsete fraaside esinemised ja kasutasid neid, et arvata, millised sõnad konkreetses kontekstis tõenäoliselt esinevad. Näiteks on lihtne teada, et "maapähklivõi ja tarretis" on tõenäolisem fraas kui "maapähklivõi ja ananassid". Kui teil on piisavalt ingliskeelset teksti, näete ikka ja jälle fraasi "maapähklivõi ja želee", kuid ei pruugi kunagi näha fraasi "maapähklivõi ja ananassid".

Tänased inimkeelele ligilähedased mudelid, andmekogumid ja reeglid erinevad neist varajastest katsetest mitmel olulisel moel. Esiteks koolitatakse neid sisuliselt kogu Internetis. Teiseks saavad nad õppida seoseid üksteisest kaugel olevate sõnade vahel, mitte ainult naabersõnu. Kolmandaks häälestavad neid tohutul hulgal sisemisi "nuppe" – nii palju, et isegi neid kujundavatel inseneridel on raske aru saada, miks nad genereerivad ühe sõnajada, mitte teise.

Mudelite ülesanne jääb aga samaks, mis 1950. aastatel: määrake kindlaks, milline sõna tõenäoliselt järgmisena tuleb. Täna saavad nad selle ülesandega nii hästi hakkama, et peaaegu kõik nende genereeritud laused tunduvad sujuvad ja grammatilised.

Maapähklivõi ja ananassid?

Küsisime suurelt keelemudelilt, GPT-3, et lõpetada lause “Maapähklivõi ja ananassid___”. Seal oli kirjas: "Maapähklivõi ja ananassid on suurepärane kombinatsioon. Maapähklivõi ja ananassi magusad ja soolased maitsed täiendavad üksteist suurepäraselt. Kui inimene seda ütleks, võiks järeldada, et nad olid maapähklivõid ja ananassi koos proovinud, oma arvamuse kujundanud ja seda lugejaga jaganud.

Aga kuidas GPT-3 selle lõiguni jõudis? Loodes sõna, mis sobib meie esitatud kontekstiga. Ja siis veel üks. Ja siis veel üks. Modell ei näinud, puudutas ega maitsnud kunagi ananasse – ta lihtsalt töötles kõiki neid mainitud Interneti-tekste. Selle lõigu lugemine võib inimmõistuse – isegi Google’i inseneri – aga ette kujutada GPT-3 intelligentse olendina, kes oskab maapähklivõi ja ananassiroogade üle arutleda.

Inimese aju on võimeline järeldama sõnade taga olevaid kavatsusi. Iga kord, kui osalete vestluses, loob teie meel automaatselt teie vestluspartneri vaimse mudeli. Seejärel kasutate sõnu, mida nad ütlevad, et täita mudelit selle inimese eesmärkide, tunnete ja tõekspidamistega.

Sõnadelt mentaalsele mudelile hüppamise protsess on sujuv ja käivitub iga kord, kui saate täisväärtusliku lause. See kognitiivne protsess säästab teie igapäevaelus palju aega ja vaeva, hõlbustades oluliselt teie sotsiaalset suhtlust.

Tehisintellektisüsteemide puhul see aga tõrkub, ehitades õhust mõttelise mudeli.

Veidi põhjalikum uurimine võib paljastada selle süütetõrke tõsiduse. Mõelge järgmisele viipale: "Maapähklivõi ja suled maitsevad koos suurepäraselt, sest___". GPT-3 jätkas: „Maapähklivõi ja suled maitsevad koos suurepäraselt, sest neil mõlemal on pähkline maitse. Maapähklivõi on ka sile ja kreemjas, mis aitab kompenseerida sulgede tekstuuri.

Sel juhul on tekst sama ladus kui meie näide ananassidega, kuid seekord ütleb modell midagi selgelt vähem mõistlikku. Hakkab kahtlustama, et GPT-3 pole kunagi proovinud maapähklivõid ja sulgi.

Intellekti omistamine masinatele, selle keelamine inimestele

Kurb iroonia on see, et sama kognitiivne eelarvamus, mis paneb inimesi GPT-3-le inimlikkust omistama, võib panna neid kohtlema tegelikke inimesi ebainimlikult. Sotsiokultuuriline lingvistika – keele uurimine selle sotsiaalses ja kultuurilises kontekstis – näitab, et liiga tiheda seose oletamine ladusa väljenduse ja ladusa mõtlemise vahel võib viia kallutatuseni inimeste suhtes, kes räägivad erinevalt.

Näiteks on sageli võõra aktsendiga inimesed peetakse vähem intelligentseks ja on vähem tõenäoline, et nad saavad tööd, milleks nad on kvalifitseeritud. Sarnased eelarvamused on olemas murrete kõnelejad mida ei peeta prestiižseks, nagu lõuna inglise keel USA-s vastu viipekeeli kasutavad kurdidja kõnepuudega inimeste vastu nagu kogelemine.

Need eelarvamused on sügavalt kahjulikud, viivad sageli rassistlike ja seksistlike oletusteni ning on ikka ja jälle osutunud alusetuks.

Ainuüksi ladus keel ei tähenda inimlikkust

Kas tehisintellekt muutub kunagi tundlikuks? See küsimus nõuab sügavat läbimõtlemist ja seda on teinud ka filosoofid mõtiskles it aastakümneid. Teadlased on aga kindlaks teinud, et te ei saa lihtsalt usaldada keelemudelit, kui see ütleb teile, kuidas see tundub. Sõnad võivad olla eksitavad ja ladusat kõnet on liiga lihtne segi ajada ladusa mõttega.![]()

See artikkel avaldatakse uuesti Vestlus Creative Commonsi litsentsi all. Loe algse artikli.

Image Credit: Tancha/Shutterstock.com

- Münditark. Euroopa parim Bitcoini ja krüptobörs.

- Platoblockchain. Web3 metaversiooni intelligentsus. Täiustatud teadmised. TASUTA PÄÄS.

- CryptoHawk. Altcoini radar. Tasuta prooviversioon.

- Allikas: https://singularityhub.com/2022/06/30/googles-ai-spotlights-a-human-cognitive-glitch-mistaking-fluent-speech-for-fluent-thought/

- "

- a

- MEIST

- edasijõudnud

- vastu

- AI

- Materjal: BPA ja flataatide vaba plastik

- summad

- Teine

- lahus

- ilmuma

- ümber

- artikkel

- Partner

- automaatselt

- tagapõhi

- sest

- muutuma

- taga

- on

- alla

- vahel

- piir

- Aju

- ehitama

- Ehitus

- võimeline

- juhul

- Põhjus

- Sajand

- nõudma

- kood

- tunnetuslik

- koguma

- kombinatsioon

- Tulema

- Täiendus

- täitma

- arvuti

- Arvestama

- tasu

- kontekstid

- Vestlus

- Loominguline

- krediit

- andmed

- Tutvumisleht

- Päeva

- sügav

- Disain

- Määrama

- DID

- erinevad

- raske

- iga

- Varajane

- jõupingutusi

- tegelema

- insener

- Inseneride

- Inglise

- üksus

- põhiliselt

- sündmus

- igapäevane

- näide

- kogemus

- kogevad

- esimene

- sobima

- Järel

- välis-

- Alates

- tekitama

- loodud

- teeniva

- saamine

- glitch

- eesmärk

- Eesmärgid

- hea

- suur

- suuresti

- juhataja

- aitab

- siin

- Kuidas

- aga

- HTTPS

- tohutu

- inim-

- Inimkond

- Inimestel

- pilt

- oluline

- muljetavaldav

- info

- Näiteks

- Intelligentsus

- Intelligentne

- Internet

- IT

- ise

- Tööturg

- Teadma

- teatud

- keel

- suur

- viima

- Õppida

- Led

- litsents

- Tõenäoliselt

- LINK

- vähe

- masinad

- TEEB

- suur

- tähendus

- tähendusrikas

- vahendid

- Meedia

- vaimne

- võib

- meeles

- mudel

- mudelid

- rohkem

- Navigate

- järgmine

- number

- tasakaalustama

- Arvamus

- Muu

- eriline

- partner

- Inimesed

- ehk

- inimene

- isiklik

- isiklikud andmed

- fraasid

- palun

- maineka

- protsess

- Programm

- tingimusel

- kvalifitseeritud

- küsimus

- lugeja

- Lugemine

- saama

- hiljuti

- Suhted

- jäänused

- Vajab

- Teadlased

- eeskirjade

- Ütlesin

- sama

- teadus

- sujuv

- tunne

- mitu

- jagatud

- näidatud

- Shutterstock

- kirjutama

- sarnane

- So

- sotsiaalmeedia

- tarkvara

- mõned

- midagi

- Lõunapoolne

- rääkima

- kõlarid

- konkreetse

- Uuring

- magus

- süsteem

- süsteemid

- ütleb

- .

- Mõtlemine

- aeg

- täna

- kokku

- käsitlema

- vallandas

- Usalda

- mõistma

- us

- kasutama

- kuidas

- M

- WHO

- sõnad

- Töö

- oleks

- Sinu

- youtube