Amazon SageMaker Data Wrangler on kasutajaliidesepõhine andmete ettevalmistamise tööriist, mis aitab andmeid analüüsida, eeltöötleda ja visualiseerida koos funktsioonidega andmete kiiremaks puhastamiseks, teisendamiseks ja ettevalmistamiseks. Data Wrangleri eelseadistatud voomallid aitavad andmeteadlastel ja masinõppe praktikutel kiirendada andmete ettevalmistamist, aidates teil tavalisi andmekogumeid kasutades kiirendada ja mõista andmevoogude parimaid tavasid.

Saate kasutada Data Wrangleri vooge järgmiste toimingute tegemiseks.

- Andmete visualiseerimine – Andmestiku iga veeru statistiliste omaduste uurimine, histogrammide koostamine, kõrvalekallete uurimine

- Andmete puhastamine – Duplikaatide eemaldamine, kirjete mahajätmine või puuduvate väärtustega täitmine, kõrvalekallete eemaldamine

- Andmete rikastamine ja funktsioonide projekteerimine – Veergude töötlemine väljendusrikkamate funktsioonide loomiseks, funktsioonide alamhulga valimine treenimiseks

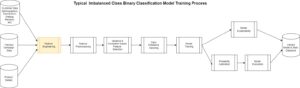

See postitus aitab teil mõista Data Wranglerit, kasutades järgmisi eelehitatud voogusid GitHub. Hoidlas kuvatakse tabeliandmete teisendusi, aegridade andmete teisendusi ja ühendatud andmehulga teisendusi. Igaüks neist nõuab oma põhiolemuse tõttu erinevat tüüpi teisendusi. Standardseid tabeli- või ristlõikeandmeid kogutakse kindlal ajahetkel. Seevastu aegridade andmeid kogutakse aja jooksul korduvalt, kusjuures iga järgnev andmepunkt sõltub selle varasematest väärtustest.

Vaatame näidet selle kohta, kuidas saame kasutada näidisandmevoogu tabeliandmete jaoks.

Eeldused

Data Wrangler on Amazon SageMaker sees saadaval olev funktsioon Amazon SageMaker Studio, seega peame Studio keskkonna ja märkmike täiustamiseks järgima Studio sisseviimise protsessi. Kuigi saate valida mõne autentimismeetodi vahel, on kõige lihtsam viis Studio domeeni loomiseks järgida Kiire algus juhiseid. Kiirkäivitus kasutab samu vaikesätteid nagu standardne stuudio seadistus. Saate valida ka pardal oleva kasutamise AWS IAM identiteedikeskus (AWS Single Sign-On järglane) autentimiseks (vt Sisseehitatud Amazon SageMakeri domeeniga, kasutades IAM-i identiteedikeskust).

Importige andmestik ja voofailid Studio abil Data Wranglerisse

Järgmised sammud kirjeldavad, kuidas importida andmeid SageMakerisse, et neid Data Wrangler tarbiks.

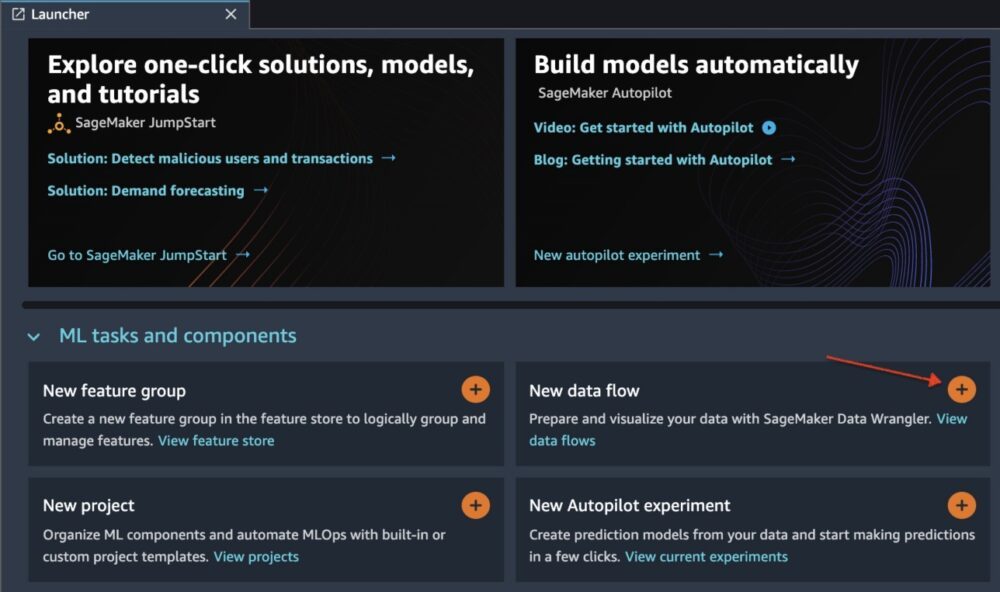

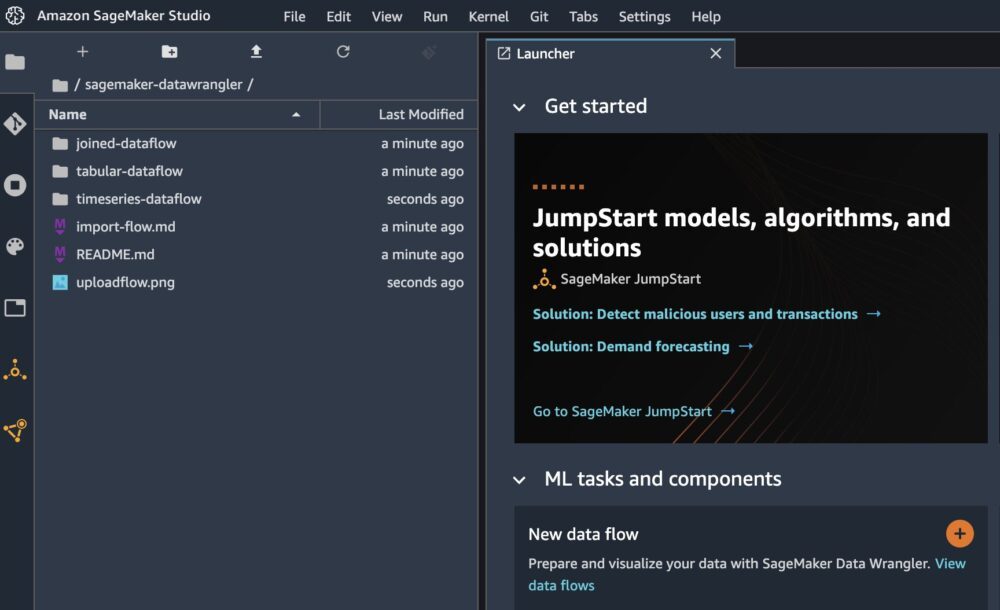

Initsialiseerige Data Wrangler Studio kasutajaliidese kaudu, valides Uus andmevoog.

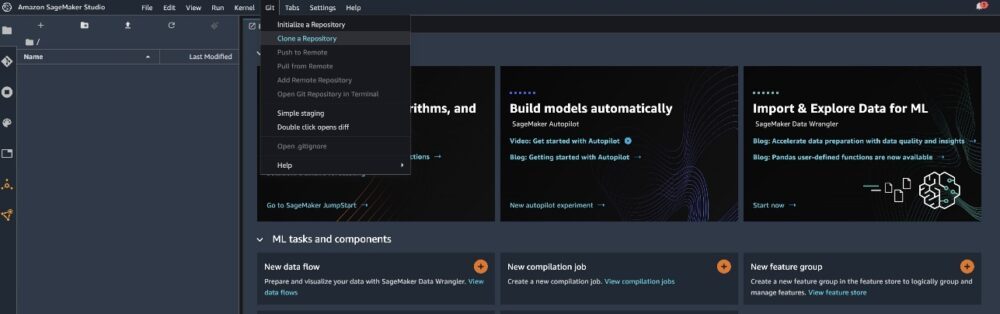

Kloonige GitHub repo voofailide allalaadimiseks oma Studio keskkonda.

Kui kloon on lõpetatud, peaksite vasakpoolsel paanil nägema hoidla sisu.

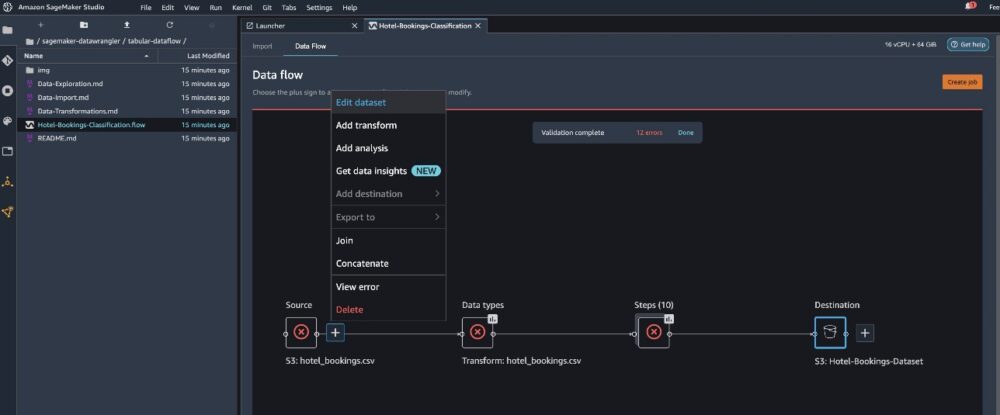

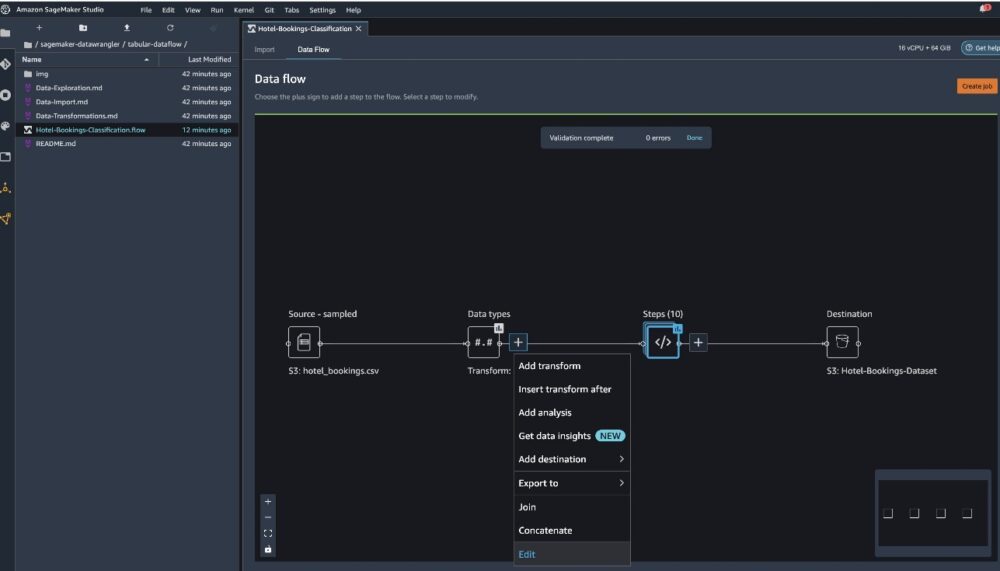

Valige fail Hotel-Bookings-Classification.flow voofaili importimiseks Data Wranglerisse.

Kui kasutate aegrida või ühendatud andmevoogu, kuvatakse voog erineva nimega.Pärast voo importimist peaksite nägema järgmist ekraanipilti. See näitab meile vigu, kuna peame veenduma, et voofail osutab õigele andmeallikale Amazoni lihtne salvestusteenus (Amazon S3).

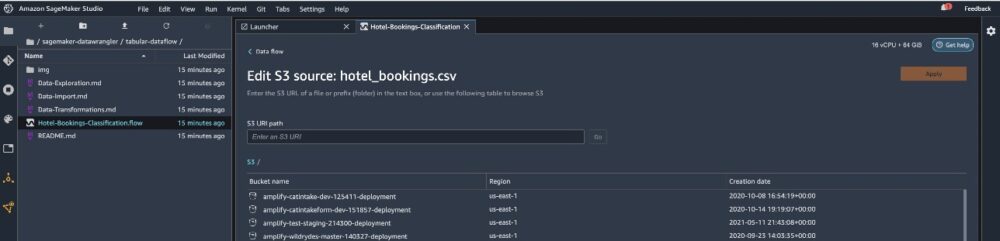

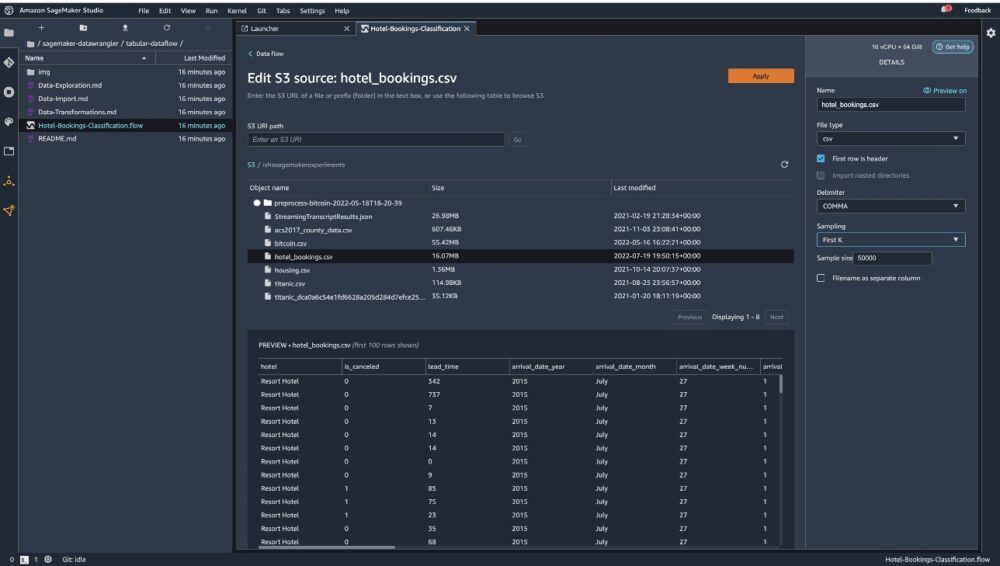

Vali Andmestiku muutmine et tuua kõik oma S3 ämbrid üles. Järgmisena valige andmestik hotel_bookings.csv oma S3 ämbrist läbi jooksmiseks tabeliline andmevoog.

Pange tähele, et kui kasutate ühendatud andmevoogu, peate võib-olla importima mitu andmestikku Data Wranglerisse

Paremal paanil veenduge LÕIGE valitakse eraldajaks ja väljavõtteline uuring on seatud väärtusele Esiteks K. Meie andmestik on piisavalt väike, et käitada Data Wrangleri teisendusi kogu andmekogumis, kuid soovisime rõhutada, kuidas saate andmestikku importida. Kui teil on suur andmestik, kaaluge valimi kasutamist. Vali Import selle andmestiku importimiseks Data Wranglerisse.

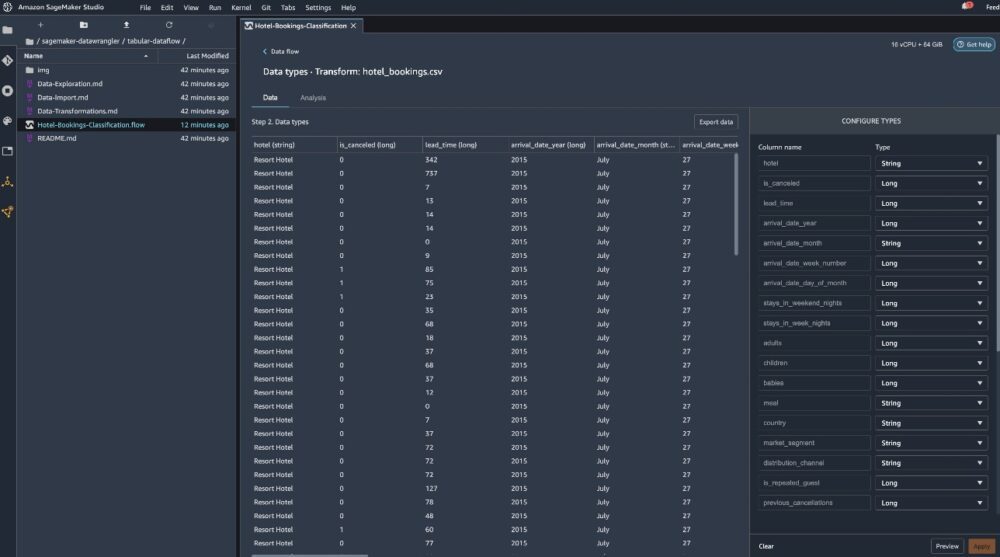

Pärast andmekogumi importimist kinnitab Data Wrangler andmestiku automaatselt ja tuvastab andmetüübid. Näete, et vead on kadunud, kuna osutame õigele andmekogumile. Vooredaktor näitab nüüd kahte plokki, mis näitavad, et andmed imporditi allikast ja andmetüübid tuvastati. Vajadusel saate muuta ka andmetüüpe.

Järgmine ekraanipilt näitab meie andmetüüpe.

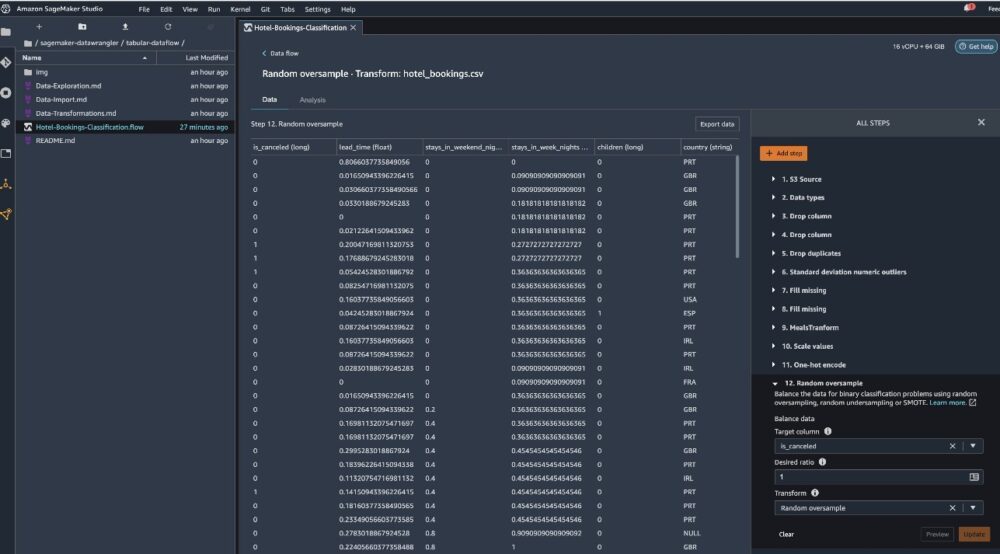

Vaatame mõnda selle tabelivoo osana tehtud teisendusi. Kui kasutate aegridad or liitunud andmevoogusid, vaadake mõningaid levinumaid teisendusi GitHub repo. Tegime mõned põhilised uurimuslikud andmete analüüsid, kasutades andmeülevaate aruandeid, mis uurisid andmestiku sihtleket ja funktsioonide kollineaarsust, tabeli kokkuvõtte analüüse ja kiiret modelleerimisvõimalust. Uurige samme GitHub repo.

Nüüd eemaldame veerud andmete ülevaate ja kvaliteediaruande soovituste põhjal.

- Sihtlekke korral langetage broneeringu_olek.

- Üleliigsete veergude puhul kukutage days_in_waiting_list, hotel, reserved_room_type, érkezési_kuupäev_kuu, booking_status_date, beebid, ja saabumise_kuupäev_kuu_päev.

- Lineaarse korrelatsiooni tulemuste põhjal langetage veerud saabumise_kuupäev_nädala_number ja saabumise_kuupäev_aasta kuna nende tunnuste (veeru) paaride korrelatsiooniväärtused on suuremad kui soovitatud lävi 0.90.

- Mittelineaarse korrelatsiooni tulemuste põhjal langeda broneeringu_olek. See veerg oli sihtlekkeanalüüsi põhjal juba märgitud mahajätmiseks.

- Protsessi arvväärtused (min-max skaleerimine) jaoks läbiviimisaeg, viibib nädalapäevadel, ööbib nädalapäevadel, on_korduv külaline, eelmine_tühistamised, eelmine_broneeringud_ei_tühistatud, broneerimismuudatused, adr, eritaotluste_kokku, ja nõutavad_auto_parkimiskohad.

- One-hot kodeerib kategoorilisi muutujaid nagu eine, on_korduv_külaline, turu_segment, määratud_toa_tüüp, hoiuse_tüüp, ja kliendi_tüüp.

- Tasakaalustage sihtmuutuja Juhuslik ülevalim klassi tasakaalustamatuse jaoks. Kasutage kiiret modelleerimisvõimalust kõrvalekallete ja puuduvate väärtuste käsitlemiseks.

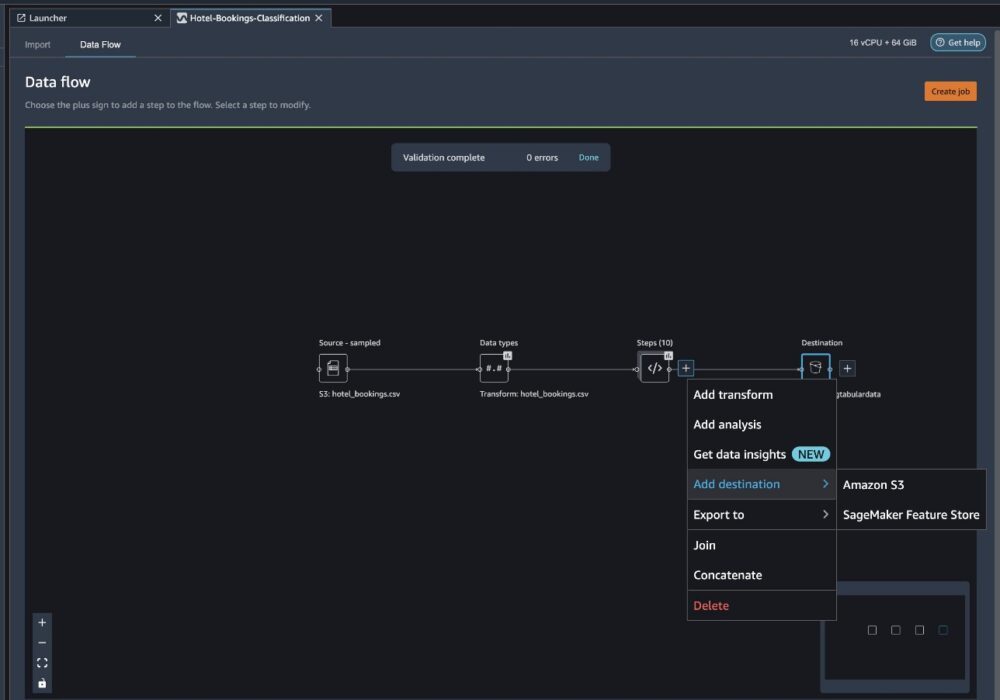

Ekspordi Amazon S3-sse

Nüüd oleme läbinud erinevad teisendused ja oleme valmis andmeid Amazon S3-sse eksportima. See suvand loob SageMakeri töötlemistöö, mis käivitab Data Wrangleri töötlemisvoo ja salvestab saadud andmestiku määratud S3 ämbrisse. Amazon S3-sse eksportimise seadistamiseks järgige järgmisi samme.

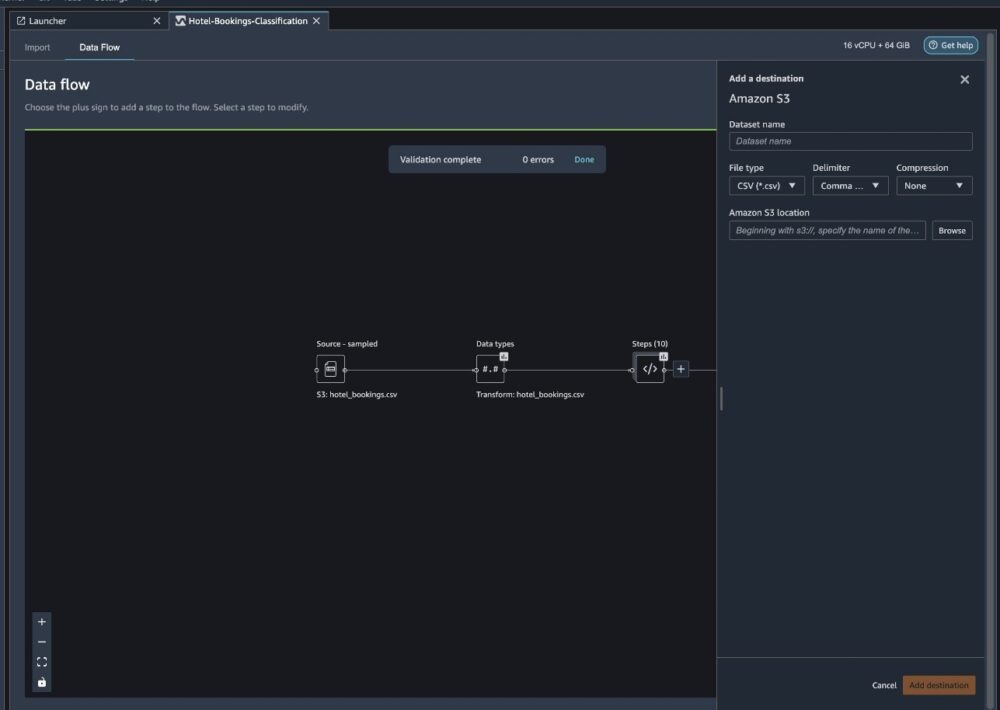

Valige teisenduselementide kogu kõrval plussmärk ja valige Lisa sihtkoht, Siis Amazon S3.

- eest Andmestiku nimi, sisestage näiteks uue andmestiku nimi

NYC_export. - eest Faili tüüp, vali CSV.

- eest Eraldaja, vali Koma.

- eest Kokkusurumine, vali mitte ükski.

- eest Amazon S3 asukoht, kasutage sama ämbri nime, mille lõime varem.

- Vali Lisa sihtkoht.

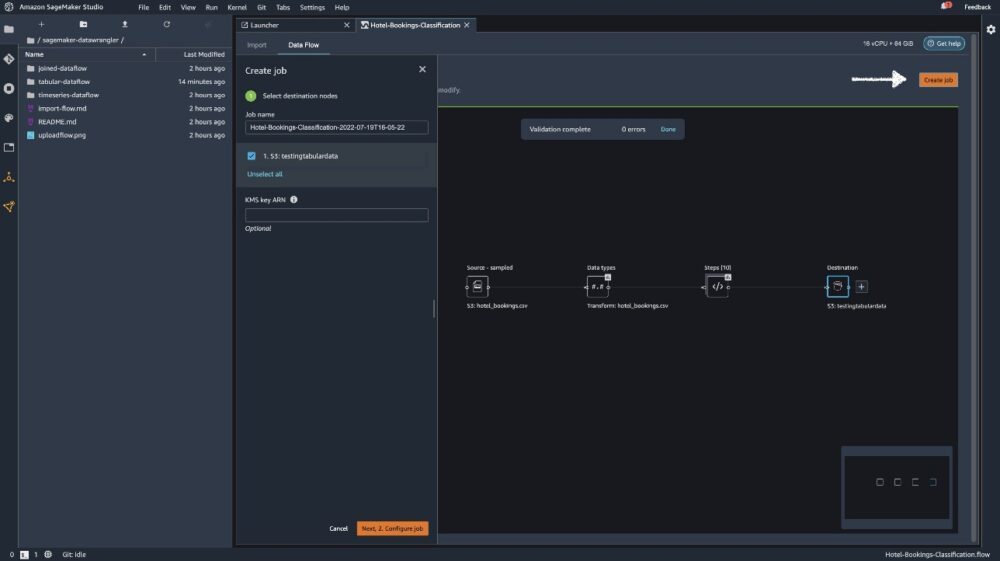

Vali Loo töökoht.

eest Töö nimi, sisestage nimi või jätke automaatselt genereeritud valik alles ja valige sihtkoht. Meil on ainult üks sihtkoht, S3:testingtabulardata, kuid teie töövoo eri etappides võib olla mitu sihtkohta. Jäta KMS-i võti ARN väli tühjaks ja valige järgmine.

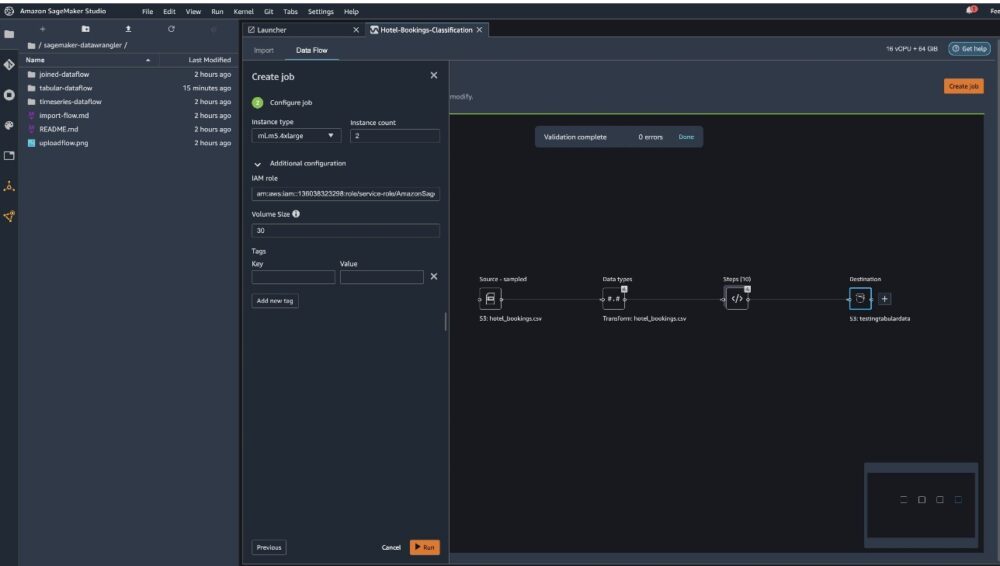

Nüüd peate konfigureerima töö arvutusvõimsuse. Selle näite puhul saate säilitada kõik vaikeväärtused.

- eest Eksemplari tüüp, kasutage ml.m5.4xlarge.

- eest Juhtumite arv, kasutage 2.

- Saate uurida Täiendav konfiguratsioon, kuid säilita vaikeseaded.

- Vali jooks.

Nüüd on teie töö alanud ja 6 GB andmete töötlemine meie Data Wrangleri töötlemisvoo järgi võtab veidi aega. Selle töö maksumus on umbes 2 USD, sest ml.m5.4xlarge maksab 0.922 USD tunnis ja me kasutame neist kahte.

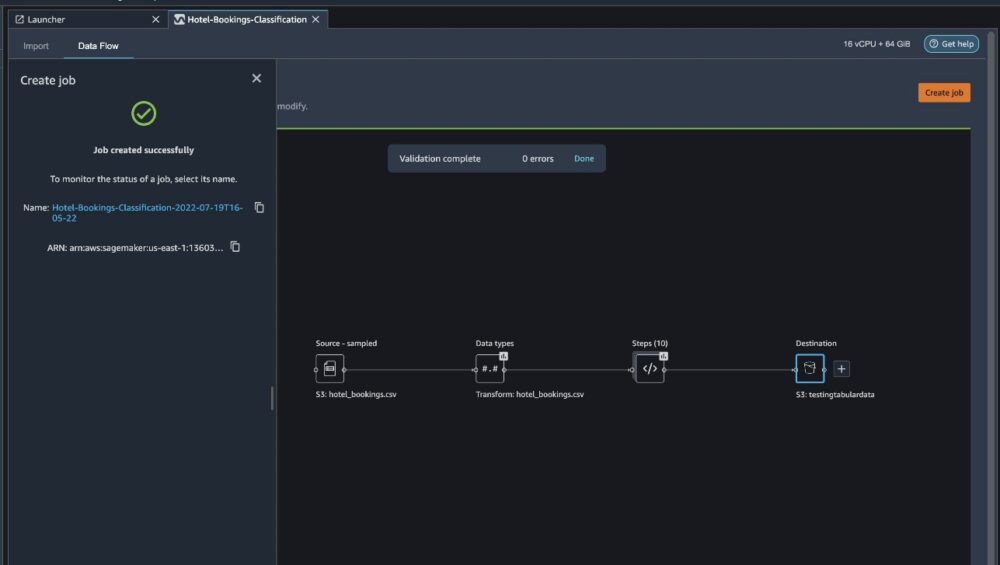

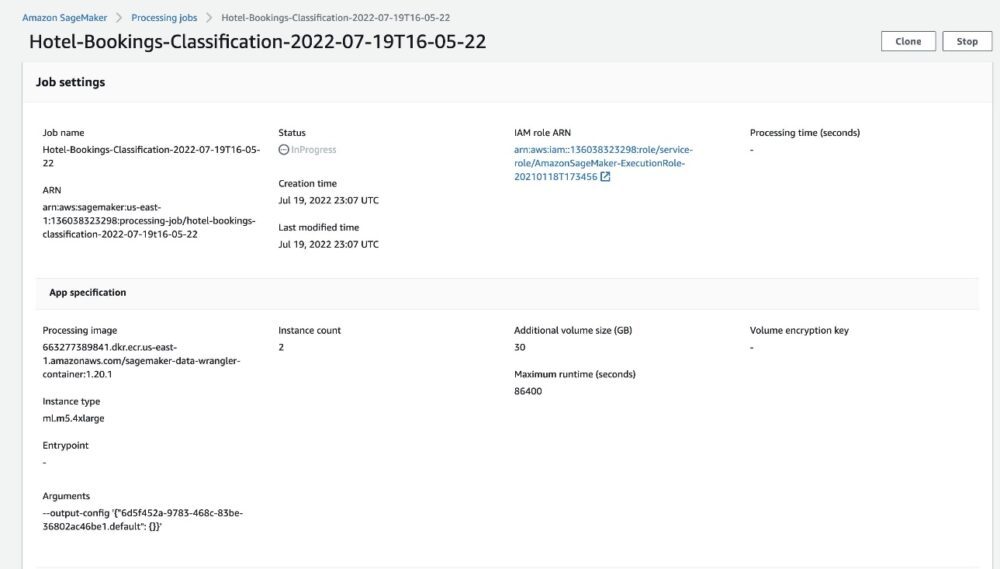

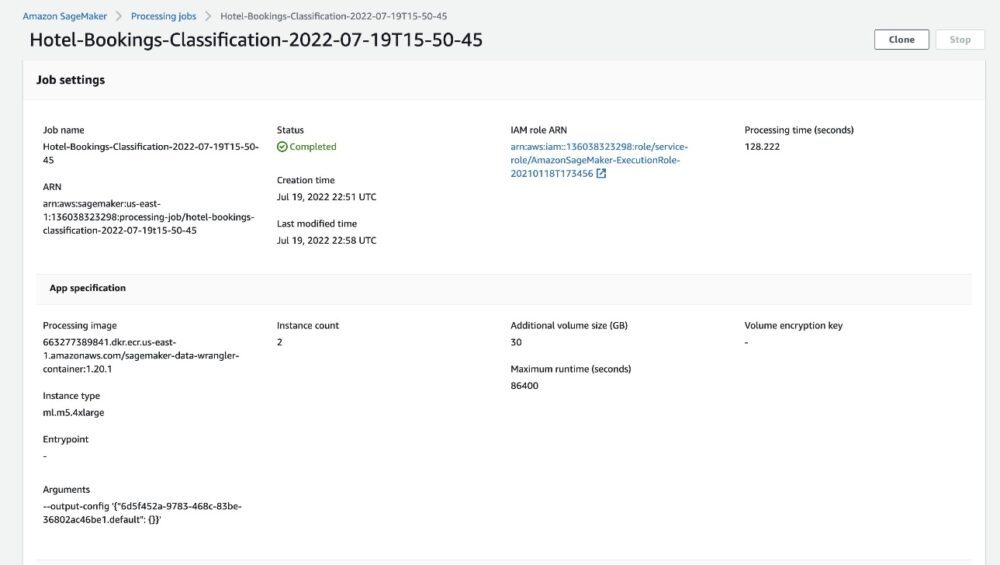

Kui valite töö nime, suunatakse teid töö üksikasjadega uude aknasse.

Töö üksikasjade lehel näete kõiki eelmiste sammude parameetreid.

Kui töö olekuks muutub Lõpetatud, saate kontrollida ka Töötlemisaeg (sekundites) väärtus. Selle töötlemistöö lõpuleviimiseks kulub umbes 5–10 minutit.

Kui töö on lõpetatud, on koolitus- ja testiväljundfailid saadaval vastavates S3 väljundkaustades. Väljundi asukoha leiate töötlemistöö konfiguratsioonidest.

Pärast Data Wrangleri töötlemistöö lõpetamist saame kontrollida meie S3 ämbrisse salvestatud tulemusi. Ärge unustage värskendada job_name muutuja teie töönimega.

Nüüd saate neid eksporditud andmeid kasutada ML-mudelite käitamiseks.

Koristage

Kustutage oma S3 ämbrid ja teie Data Wrangleri voog et kustutada aluseks olevad ressursid ja vältida soovimatuid kulusid pärast katse lõpetamist.

Järeldus

Selles postituses näitasime, kuidas saate importida tabelina koostatud eelseadistatud andmevoogu Data Wranglerisse, ühendada selle meie andmekogumiga ja eksportida tulemused Amazon S3-sse. Kui teie kasutusjuhtumid nõuavad aegridade andmetega manipuleerimist või mitme andmestiku ühendamist, saate läbida muud eelnevalt koostatud valimivood GitHub repo.

Pärast eelseadistatud andmete ettevalmistamise töövoo importimist saate selle integreerida rakendusega Amazon SageMaker Processing, Amazon SageMakeri torujuhtmedja Amazon SageMakeri funktsioonipood ML koolitusandmete töötlemise, jagamise ja salvestamise ülesande lihtsustamiseks. Saate selle näidisandmevoo eksportida ka Pythoni skripti ja luua kohandatud ML-i andmete ettevalmistamise konveieri, kiirendades sellega vabastamise kiirust.

Soovitame teil meiega tutvuda GitHubi hoidla et saada praktilist praktikat ja leida uusi viise mudeli täpsuse parandamiseks! SageMakeri kohta lisateabe saamiseks külastage lehte Amazon SageMakeri arendaja juhend.

Autoritest

Isha Dua on San Francisco lahe piirkonnas asuv vanemlahenduste arhitekt. Ta aitab AWS Enterprise'i klientidel kasvada, mõistes nende eesmärke ja väljakutseid, ning juhendab neid, kuidas nad saavad oma rakendusi pilvepõhiselt üles ehitada, tagades samas nende vastupidavuse ja skaleeritavuse. Ta on kirglik masinõppetehnoloogiate ja keskkonnasäästlikkuse vastu.

Isha Dua on San Francisco lahe piirkonnas asuv vanemlahenduste arhitekt. Ta aitab AWS Enterprise'i klientidel kasvada, mõistes nende eesmärke ja väljakutseid, ning juhendab neid, kuidas nad saavad oma rakendusi pilvepõhiselt üles ehitada, tagades samas nende vastupidavuse ja skaleeritavuse. Ta on kirglik masinõppetehnoloogiate ja keskkonnasäästlikkuse vastu.

- AI

- ai kunst

- ai kunsti generaator

- on robot

- Amazon SageMaker

- Amazon SageMaker Data Wrangler

- tehisintellekti

- tehisintellekti sertifikaat

- tehisintellekt panganduses

- tehisintellekti robot

- tehisintellekti robotid

- tehisintellekti tarkvara

- AWS-i masinõpe

- blockchain

- plokiahela konverents ai

- coingenius

- vestluslik tehisintellekt

- krüptokonverents ai

- dall's

- sügav õpe

- google ai

- masinõpe

- Platon

- plato ai

- Platoni andmete intelligentsus

- Platoni mäng

- PlatoData

- platogaming

- skaala ai

- süntaks

- sephyrnet