در 2021، صنعت داروسازی 550 میلیارد دلار درآمد ایالات متحده داشت. شرکت های داروسازی انواع مختلفی از داروهای مختلف و اغلب جدید را در بازار می فروشند، جایی که گاهی اوقات ممکن است عوارض جانبی ناخواسته اما جدی رخ دهد.

این رویدادها را می توان در هر جایی، از بیمارستان ها یا در خانه گزارش کرد و باید مسئولانه و کارآمد نظارت شود. پردازش دستی سنتی رویدادهای نامطلوب به دلیل افزایش حجم داده ها و هزینه های بهداشتی چالش برانگیز است. به طور کلی، تا سال 384، 2022 میلیارد دلار به عنوان هزینه فعالیتهای مراقبت دارویی برای صنعت مراقبتهای بهداشتی کلی پیشبینی میشود. برای حمایت از فعالیتهای مراقبت دارویی، مشتریان دارویی ما میخواهند از قدرت یادگیری ماشینی (ML) برای خودکار کردن تشخیص رویدادهای نامطلوب از منابع دادههای مختلف استفاده کنند. مانند فیدهای رسانههای اجتماعی، تماسهای تلفنی، ایمیلها و یادداشتهای دستنویس، و اقدامات مناسب را آغاز میکنند.

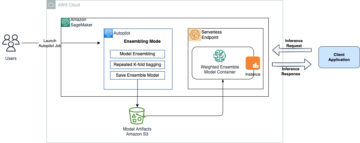

در این پست، نحوه توسعه راه حل مبتنی بر ML را با استفاده از آن نشان می دهیم آمازون SageMaker برای تشخیص عوارض جانبی با استفاده از مجموعه دادههای واکنش نامطلوب دارویی در دسترس عموم در صورت در آغوش گرفتن. در این راه حل، ما انواع مدل ها را روی Hugging Face که از قبل بر روی داده های پزشکی آموزش داده شده اند، به خوبی تنظیم می کنیم و از مدل BioBERT استفاده می کنیم که از قبل آموزش داده شده بود. مجموعه داده منتشر شده و بهترین عملکرد را از بین کسانی که امتحان کرده اند انجام می دهد.

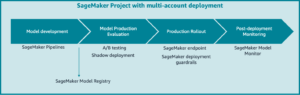

ما راه حل را با استفاده از کیت توسعه ابری AWS (AWS CDK). با این حال، ما در این پست به جزئیات ساخت راه حل نمی پردازیم. برای اطلاعات بیشتر در مورد اجرای این راهکار به ادامه مطلب مراجعه نمایید با استفاده از Amazon SageMaker و Amazon QuickSight سیستمی برای ثبت رویدادهای نامطلوب در زمان واقعی بسازید.

این پست به چندین حوزه کلیدی می پردازد و کاوشی جامع از موضوعات زیر ارائه می دهد:

- چالش های داده ای که سرویس های حرفه ای AWS با آن مواجه می شوند

- چشم انداز و کاربرد مدل های زبان بزرگ (LLM):

- ترانسفورماتورها، BERT و GPT

- در آغوش کشیدن صورت

- راه حل دقیق تنظیم شده LLM و اجزای آن:

- آماده سازی داده ها

- آموزش مدل

چالش داده

انحراف داده ها اغلب در هنگام انجام وظایف طبقه بندی یک مشکل است. شما در حالت ایده آل دوست دارید یک مجموعه داده متعادل داشته باشید، و این مورد استفاده از این قاعده مستثنی نیست.

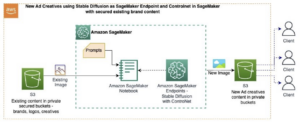

ما این کج بودن را با هوش مصنوعی مولد مدلهایی (Falcon-7B و Falcon-40B)، که بر اساس پنج مثال از مجموعه آموزشی برای افزایش تنوع معنایی و افزایش حجم نمونه رویدادهای نامطلوب برچسبگذاری شده، به تولید نمونه رویداد پرداختند. استفاده از مدلهای فالکون در اینجا برای ما مفید است، زیرا برخلاف برخی از LLMها در Hugging Face، Falcon مجموعه دادههای آموزشی را که استفاده میکنند در اختیار شما قرار میدهد، بنابراین میتوانید مطمئن باشید که هیچ یک از نمونههای مجموعه آزمایشی شما در مجموعه آموزشی Falcon موجود نیست و از دادهها اجتناب کنید. آلودگی.

چالش داده های دیگر برای مشتریان مراقبت های بهداشتی الزامات انطباق HIPAA است. رمزگذاری در حالت استراحت و در حال انتقال باید در راه حل گنجانده شود تا این الزامات برآورده شود.

ترانسفورماتورها، BERT و GPT

معماری ترانسفورماتور یک معماری شبکه عصبی است که برای وظایف پردازش زبان طبیعی (NLP) استفاده می شود. برای اولین بار در مقاله معرفی شد "توجه تنها چیزی است که نیاز دارید" توسط واسوانی و همکاران (2017). معماری ترانسفورماتور مبتنی بر مکانیزم توجه است که به مدل اجازه می دهد تا وابستگی های دوربرد بین کلمات را یاد بگیرد. ترانسفورماتورها، همانطور که در مقاله اصلی آمده است، از دو جزء اصلی تشکیل شده اند: رمزگذار و رمزگشا. رمزگذار دنباله ورودی را به عنوان ورودی می گیرد و دنباله ای از حالت های پنهان را تولید می کند. سپس رمزگشا این حالت های پنهان را به عنوان ورودی می گیرد و دنباله خروجی را تولید می کند. مکانیسم توجه هم در رمزگذار و هم در رمزگشا استفاده می شود. مکانیسم توجه به مدل این امکان را می دهد که در هنگام تولید دنباله خروجی به کلمات خاصی در توالی ورودی توجه کند. این به مدل اجازه می دهد تا وابستگی های دوربرد بین کلمات را بیاموزد، که برای بسیاری از وظایف NLP، مانند ترجمه ماشینی و خلاصه سازی متن ضروری است.

یکی از محبوبترین و مفیدترین معماریهای ترانسفورماتور، نمایش رمزگذار دوطرفه از ترانسفورماتورها (BERT)، یک مدل نمایش زبان است که معرفی شده در 2018. BERT روی دنباله هایی آموزش می بیند که برخی از کلمات در یک جمله پوشانده شده اند و باید آن کلمات را با در نظر گرفتن کلمات قبل و بعد از کلمات پوشانده شده پر کند. BERT را می توان برای انواع وظایف NLP، از جمله پاسخ به سؤال، استنتاج زبان طبیعی و تجزیه و تحلیل احساسات، به خوبی تنظیم کرد.

یکی دیگر از معماری های محبوب ترانسفورماتور که جهان را به شدت تحت تاثیر خود قرار داده است، ترانسفورماتور از پیش آموزش دیده ژنراتور (GPT) است. اولین مدل GPT بود در سال 2018 توسط OpenAI معرفی شد. با آموزش دقیق کلمه بعدی در یک دنباله، فقط از بافت قبل از کلمه آگاه است، کار می کند. مدلهای GPT بر روی مجموعه داده عظیمی از متن و کد آموزش داده میشوند و میتوان آنها را برای طیف وسیعی از وظایف NLP، از جمله تولید متن، پاسخگویی به سؤال، و خلاصهسازی بهخوبی تنظیم کرد.

به طور کلی، BERT در کارهایی که نیاز به درک عمیقتر بافت کلمات دارند، بهتر عمل میکند، در حالی که GPT برای کارهایی که نیاز به تولید متن دارند مناسب تر است.

در آغوش کشیدن صورت

Hugging Face یک شرکت هوش مصنوعی است که در NLP تخصص دارد. این پلتفرم با ابزارها و منابعی فراهم می کند که توسعه دهندگان را قادر می سازد تا مدل های ML متمرکز بر وظایف NLP را بسازند، آموزش دهند و به کار گیرند. یکی از پیشنهادات کلیدی Hugging Face کتابخانه آن است. ترانسفورماتور، که شامل مدل های از پیش آموزش دیده ای است که می توانند برای کارهای مختلف زبانی مانند طبقه بندی متن، ترجمه، خلاصه سازی و پاسخگویی به سوالات به خوبی تنظیم شوند.

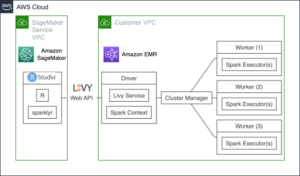

Hugging Face به طور یکپارچه با SageMaker یکپارچه می شود، که یک سرویس کاملاً مدیریت شده است که توسعه دهندگان و دانشمندان داده را قادر می سازد مدل های ML را در مقیاس بسازند، آموزش دهند و به کار گیرند. این همافزایی با ارائه زیرساختی قوی و مقیاسپذیر برای انجام وظایف NLP با مدلهای پیشرفتهای که Hugging Face ارائه میدهد، همراه با سرویسهای قدرتمند و انعطافپذیر ML از AWS، به نفع کاربران است. همچنین می توانید مستقیماً به مدل های صورت در آغوش گرفته دسترسی داشته باشید Amazon SageMaker JumpStart، شروع با راه حل های از پیش ساخته شده را راحت می کند.

بررسی اجمالی راه حل

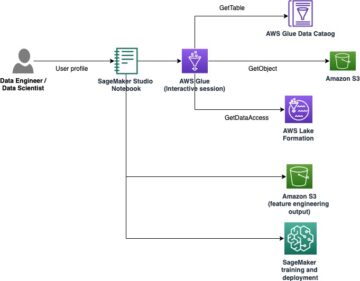

ما از کتابخانه Hugging Face Transformers برای تنظیم دقیق مدلهای ترانسفورماتور در SageMaker برای طبقهبندی رویدادهای نامطلوب استفاده کردیم. کار آموزشی با استفاده از برآوردگر PyTorch SageMaker ساخته شده است. SageMaker JumpStart همچنین دارای برخی ادغام های مکمل با Hugging Face است که اجرای آن را ساده می کند. در این بخش، مراحل اصلی آماده سازی داده ها و آموزش مدل را شرح می دهیم.

آماده سازی داده ها

ما از داده های واکنش نامطلوب دارویی استفاده کردیم (ade_corpus_v2) در مجموعه داده Hugging Face با تقسیم آموزش/آزمون 80/20. ساختار داده مورد نیاز برای آموزش و استنتاج مدل ما دارای دو ستون است:

- یک ستون برای محتوای متنی به عنوان داده های ورودی مدل.

- ستون دیگری برای کلاس برچسب. ما دو کلاس ممکن برای یک متن داریم:

Not_AEوAdverse_Event.

آموزش و آزمایش مدل

به منظور کاوش کارآمد در فضای مدلهای صورت در آغوش گرفتن برای تنظیم دقیق دادههای ترکیبی از رویدادهای نامطلوب، ما یک کار بهینهسازی ابرپارامتر SageMaker (HPO) ایجاد کردیم و مدلهای مختلف Hugging Face را بهعنوان یک فراپارامتر، همراه با سایر فراپارامترهای مهم ارسال کردیم. مانند اندازه دسته آموزشی، طول توالی، مدل ها و نرخ یادگیری. کارهای آموزشی از یک نمونه ml.p3dn.24xlarge استفاده می کردند و به طور متوسط 30 دقیقه برای هر کار با آن نوع نمونه زمان می بردند. معیارهای آموزشی هر چند گرفته شد آزمایشات آمازون SageMaker ابزار، و هر کار آموزشی در 10 دوره انجام شد.

ما در کد خود موارد زیر را مشخص می کنیم:

- اندازه دسته آموزشی - تعداد نمونه هایی که قبل از به روز رسانی وزن مدل با هم پردازش می شوند

- طول توالی - حداکثر طول دنباله ورودی که BERT می تواند پردازش کند

- میزان یادگیری – مدل با چه سرعتی وزنه های خود را در طول تمرین به روز می کند

- مدل – مدل های از قبل آموزش دیده Hugging Face

نتایج

مدلی که در مورد استفاده ما بهترین عملکرد را داشت monologg/biobert_v1.1_pubmed مدل میزبانی شده در Hugging Face، که نسخه ای از معماری BERT است که بر روی مجموعه داده Pubmed که شامل 19,717 نشریه علمی است، از قبل آموزش داده شده است. قبل از آموزش BERT بر روی این مجموعه داده، به این مدل در شناسایی زمینه در مورد اصطلاحات علمی مرتبط با پزشکی، تخصص بیشتری می دهد. این کارایی مدل را برای کار تشخیص رویدادهای نامطلوب افزایش میدهد، زیرا از پیش آموزش داده شده است که از نظر دستوری خاص پزشکی است که اغلب در مجموعه داده ما نشان داده میشود.

جدول زیر معیارهای ارزیابی ما را خلاصه می کند.

| مدل | دقت | به یاد بیاورید | F1 |

| پایه BERT | 0.87 | 0.95 | 0.91 |

| بیوبرت | 0.89 | 0.95 | 0.92 |

| BioBERT با HPO | 0.89 | 0.96 | 0.929 |

| BioBERT با HPO و عارضه جانبی مصنوعی ایجاد شده است | 0.90 | 0.96 | 0.933 |

اگرچه اینها بهبودهای نسبتاً کوچک و افزایشی نسبت به مدل پایه BERT هستند، اما با این وجود برخی از استراتژیهای قابل دوام برای بهبود عملکرد مدل از طریق این روشها را نشان میدهد. به نظر می رسد تولید داده های مصنوعی با فالکون نوید و پتانسیل زیادی برای بهبود عملکرد دارد، به خصوص که این مدل های هوش مصنوعی مولد با گذشت زمان بهتر می شوند.

پاک کردن

برای جلوگیری از تحمیل هزینههای آتی، منابع ایجاد شده مانند مدل و نقاط پایانی مدلی را که با کد زیر ایجاد کردهاید حذف کنید:

نتیجه

امروزه بسیاری از شرکتهای داروسازی میخواهند فرآیند شناسایی رویدادهای نامطلوب ناشی از تعامل با مشتریان خود را به روشی سیستماتیک به منظور کمک به بهبود ایمنی و نتایج مشتری، خودکار کنند. همانطور که در این پست نشان دادیم، LLM BioBERT تنظیم شده با عوارض جانبی مصنوعی که به دادهها اضافه شده است، رویدادهای نامطلوب را با امتیاز F1 بالا طبقهبندی میکند و میتواند برای ایجاد یک راهحل منطبق با HIPAA برای مشتریانمان استفاده شود.

مثل همیشه، AWS از بازخورد شما استقبال می کند. لطفا نظرات و سوالات خود را در قسمت نظرات مطرح کنید.

درباره نویسندگان

زک پترسون یک دانشمند داده در خدمات حرفه ای AWS است. او سالهاست که راهحلهای یادگیری ماشینی را به مشتریان ارائه میدهد و دارای مدرک کارشناسی ارشد در اقتصاد است.

زک پترسون یک دانشمند داده در خدمات حرفه ای AWS است. او سالهاست که راهحلهای یادگیری ماشینی را به مشتریان ارائه میدهد و دارای مدرک کارشناسی ارشد در اقتصاد است.

دکتر Adewale Akinfaderin یک دانشمند ارشد داده در مراقبت های بهداشتی و علوم زندگی در AWS است. تخصص او در روشهای AI/ML قابل تکرار و سرتاسر، پیادهسازیهای عملی، و کمک به مشتریان جهانی مراقبتهای بهداشتی در تدوین و توسعه راهحلهای مقیاسپذیر برای مشکلات بینرشتهای است. وی دارای دو مدرک تحصیلات تکمیلی در رشته فیزیک و یک مدرک دکترا در رشته مهندسی است.

دکتر Adewale Akinfaderin یک دانشمند ارشد داده در مراقبت های بهداشتی و علوم زندگی در AWS است. تخصص او در روشهای AI/ML قابل تکرار و سرتاسر، پیادهسازیهای عملی، و کمک به مشتریان جهانی مراقبتهای بهداشتی در تدوین و توسعه راهحلهای مقیاسپذیر برای مشکلات بینرشتهای است. وی دارای دو مدرک تحصیلات تکمیلی در رشته فیزیک و یک مدرک دکترا در رشته مهندسی است.

اکتا ولیا بولار، دکترا، مشاور ارشد AI/ML با واحد تجاری خدمات حرفه ای خدمات بهداشت و درمان و علوم زندگی AWS (HCLS) است. او تجربه گسترده ای در کاربرد AI/ML در حوزه مراقبت های بهداشتی، به ویژه در رادیولوژی دارد. در خارج از محل کار، وقتی در مورد هوش مصنوعی در رادیولوژی صحبت نمی کند، دوست دارد بدود و پیاده روی کند.

اکتا ولیا بولار، دکترا، مشاور ارشد AI/ML با واحد تجاری خدمات حرفه ای خدمات بهداشت و درمان و علوم زندگی AWS (HCLS) است. او تجربه گسترده ای در کاربرد AI/ML در حوزه مراقبت های بهداشتی، به ویژه در رادیولوژی دارد. در خارج از محل کار، وقتی در مورد هوش مصنوعی در رادیولوژی صحبت نمی کند، دوست دارد بدود و پیاده روی کند.

هان من یک مدیر ارشد علوم داده و یادگیری ماشین با خدمات حرفه ای AWS مستقر در سن دیگو، کالیفرنیا است. او دارای مدرک دکترای مهندسی از دانشگاه نورث وسترن است و چندین سال تجربه به عنوان مشاور مدیریت مشاوره به مشتریان در زمینه تولید، خدمات مالی و انرژی دارد. امروز، او مشتاقانه با مشتریان کلیدی از بخشهای مختلف صنعت کار میکند تا راهحلهای ML و هوش مصنوعی مولد را در AWS توسعه و پیادهسازی کند.

هان من یک مدیر ارشد علوم داده و یادگیری ماشین با خدمات حرفه ای AWS مستقر در سن دیگو، کالیفرنیا است. او دارای مدرک دکترای مهندسی از دانشگاه نورث وسترن است و چندین سال تجربه به عنوان مشاور مدیریت مشاوره به مشتریان در زمینه تولید، خدمات مالی و انرژی دارد. امروز، او مشتاقانه با مشتریان کلیدی از بخشهای مختلف صنعت کار میکند تا راهحلهای ML و هوش مصنوعی مولد را در AWS توسعه و پیادهسازی کند.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/deploy-large-language-models-for-a-healthtech-use-case-on-amazon-sagemaker/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 1

- 10

- 100

- 16

- 19

- 2017

- 2018

- 2021

- 2022

- 30

- 32

- 7

- a

- دسترسی

- حساب

- ACM

- اقدامات

- فعالیت ها

- اضافه

- نشانی

- با صرفه

- منفی است

- مشاوره

- پس از

- AI

- مدل های هوش مصنوعی

- AI / ML

- AL

- معرفی

- اجازه می دهد تا

- در امتداد

- همچنین

- همیشه

- آمازون

- آمازون SageMaker

- آمازون خدمات وب

- مقدار

- an

- تحلیل

- و

- پاسخ دادن

- هر

- هر جا

- کاربرد

- مناسب

- معماری

- معماری

- هستند

- مناطق

- دور و بر

- مصنوعی

- هوش مصنوعی

- AS

- At

- مراجعه كردن

- توجه

- خودکار بودن

- در دسترس

- میانگین

- اجتناب از

- مطلع

- AWS

- خدمات حرفه ای AWS

- متعادل

- پایه

- مستقر

- BE

- زیرا

- بوده

- قبل از

- بودن

- مزایای

- بهترین

- بهتر

- میان

- دو طرفه

- بیلیون

- تقویت می کند

- هر دو

- مرز

- ساختن

- بنا

- ساخته

- کسب و کار

- اما

- by

- CA

- تماس ها

- CAN

- اسیر

- مورد

- به چالش

- چالش ها

- به چالش کشیدن

- بار

- کلاس

- کلاس ها

- طبقه بندی

- مشتریان

- ابر

- رمز

- ستون

- ستون ها

- ترکیب شده

- می آید

- آینده

- نظرات

- شرکت

- شرکت

- مکمل

- انطباق

- اجزاء

- جامع

- تشکیل شده است

- ساخته

- مشاور

- موجود

- محتوا

- زمینه

- مناسب

- هزینه

- هزینه

- پوشش

- ایجاد

- ایجاد شده

- مشتری

- مشتریان

- داده ها

- آماده سازی داده ها

- علم اطلاعات

- دانشمند داده

- ساختار داده ها

- عمیق تر

- تعريف كردن

- درجه

- تحویل

- غوطه ور شدن

- نشان می دهد

- وابستگی

- گسترش

- توصیف

- کشف

- توسعه

- توسعه دهندگان

- پروژه

- دیگو

- مختلف

- مستقیما

- بحث در مورد

- تنوع

- دامنه

- آیا

- دارو

- مواد مخدر

- در طی

- E&T

- هر

- اقتصاد (Economics)

- موثر

- ایمیل

- قادر ساختن

- را قادر می سازد

- رمزگذاری

- پشت سر هم

- انرژی

- مهندسی

- دوره ها

- به خصوص

- ضروری است

- ارزیابی

- واقعه

- حوادث

- مثال ها

- استثنا

- تجربه

- تخصص

- اکتشاف

- اکتشاف

- وسیع

- تجربه گسترده

- اضافی

- f1

- چهره

- باز خورد

- پر کردن

- مالی

- خدمات مالی

- نام خانوادگی

- پنج

- قابل انعطاف

- متمرکز شده است

- پیروی

- برای

- از جانب

- کاملا

- آینده

- سوالات عمومی

- تولید می کنند

- تولید

- مولد

- نسل

- مولد

- هوش مصنوعی مولد

- دریافت کنید

- می دهد

- جهانی

- فارغ التحصیل

- دسته

- دست ها

- آیا

- he

- سلامتی

- بهداشت و درمان

- صنعت بهداشت و درمان

- HealthTech

- کمک

- کمک

- اینجا کلیک نمایید

- پنهان

- زیاد

- پیاده روی

- خود را

- نگه داشتن

- صفحه اصلی

- بیمارستان ها

- میزبانی

- چگونه

- چگونه

- اما

- HTTPS

- بهینه سازی هایپرپارامتر

- ایده آل

- شناسایی

- انجام

- پیاده سازی

- پیاده سازی ها

- اجرا

- واردات

- مهم

- بهبود

- ارتقاء

- in

- شامل

- از جمله

- ادغام شده

- افزایش

- افزایش

- افزایشی

- صنعت

- اطلاعات

- شالوده

- ورودی

- نمونه

- ادغام

- یکپارچگی

- اطلاعات

- فعل و انفعالات

- به

- معرفی

- گرفتار

- IT

- ITS

- کار

- شغل ها

- JPG

- کلید

- مناطق کلیدی

- برچسب

- گذاشته

- چشم انداز

- زبان

- بزرگ

- یاد گرفتن

- یادگیری

- ترک کردن

- طول

- کتابخانه

- زندگی

- علوم زندگی

- پسندیدن

- دوست دارد

- LLM

- خیلی

- دستگاه

- فراگیری ماشین

- ساخته

- اصلی

- عمده

- باعث می شود

- ساخت

- مرد

- اداره می شود

- مدیریت

- مدیر

- کتابچه راهنمای

- تولید

- بسیاری

- بازار

- عظیم

- کارشناسی ارشد

- بیشینه ساختن

- بیشترین

- مکانیزم

- رسانه ها

- پزشکی

- داده های پزشکی

- دیدار

- روش

- متریک

- دقیقه

- ML

- مدل

- مدل

- نظارت

- بیش

- باید

- نام

- طبیعی

- پردازش زبان طبیعی

- شبکه

- عصبی

- شبکه های عصبی

- با این اوصاف

- بعد

- nlp

- نه

- هیچ

- یادداشت

- رمان

- عدد

- رخ می دهد

- of

- پیشنهادات

- پیشنهادات

- غالبا

- on

- ONE

- فقط

- بهینه سازی

- or

- سفارش

- اصلی

- دیگر

- ما

- خارج

- نتایج

- تولید

- خارج از

- روی

- به طور کلی

- کلاهبرداری

- مقاله

- گذشت

- برای

- کارایی

- انجام

- انجام می دهد

- دارویی

- دکترا

- تلفن

- تماس های تلفنی

- فیزیک

- سکو

- افلاطون

- هوش داده افلاطون

- PlatoData

- لطفا

- محبوب

- ممکن

- پست

- پتانسیل

- قدرت

- قوی

- عملی

- پیش بینی

- تهیه

- مشکل

- مشکلات

- روند

- فرآوری شده

- در حال پردازش

- تولید می کند

- حرفه ای

- پیش بینی

- وعده

- فراهم می کند

- ارائه

- انتشارات

- عمومی

- مارماهی

- سوال

- سوالات

- به سرعت

- محدوده

- نرخ

- واکنش

- زمان واقعی

- مراجعه

- regex

- مربوط

- نسبتا

- گزارش

- نمایندگی

- نیاز

- ضروری

- مورد نیاز

- منابع

- مسئولانه

- REST

- تنومند

- دویدن

- ایمنی

- حکیم ساز

- نمونه

- سان

- سن دیگو

- مقیاس پذیر

- مقیاس

- علم

- علوم

- علمی

- دانشمند

- دانشمندان

- یکپارچه

- بخش

- به نظر می رسد

- فروش

- معنایی

- ارشد

- جمله

- احساس

- دنباله

- جدی

- سرویس

- خدمات

- تنظیم

- چند

- او

- نشان

- نشان داد

- نشان می دهد

- اندازه

- سرخ کردن

- کوچک

- So

- آگاهی

- رسانه های اجتماعی

- راه حل

- مزایا

- برخی از

- گاهی

- منابع

- فضا

- تخصص دارد

- خاص

- جزئیات

- انشعاب

- شروع

- وضعیت هنر

- ایالات

- مراحل

- طوفان

- ساده

- استراتژی ها

- ساختار

- چنین

- پشتیبانی

- مطمئن

- همکاری

- نحو

- ترکیبی

- داده های مصنوعی

- مصنوعی

- سیستم

- جدول

- صورت گرفته

- طول می کشد

- مصرف

- کار

- وظایف

- قوانین و مقررات

- آزمون

- متن

- طبقه بندی متن

- که

- La

- جهان

- شان

- سپس

- اینها

- آنها

- این

- کسانی که

- اگر چه؟

- از طریق

- زمان

- به

- امروز

- با هم

- در زمان

- ابزار

- ابزار

- تاپیک

- سنتی

- قطار

- آموزش دیده

- آموزش

- ترانسفورماتور

- ترانسفورماتور

- عبور

- ترجمه

- سعی

- ماشه

- دو

- نوع

- درک

- واحد

- دانشگاه

- بر خلاف

- به روز رسانی

- us

- استفاده کنید

- مورد استفاده

- استفاده

- مفید

- کاربران

- با استفاده از

- تنوع

- مختلف

- نسخه

- عمودی

- قابل اعتماد

- می خواهم

- بود

- مسیر..

- we

- وب

- خدمات وب

- خوش آمدید

- بود

- چه زمانی

- در حالیکه

- که

- با

- در داخل

- کلمه

- کلمات

- مهاجرت کاری

- کارگر

- با این نسخهها کار

- جهان

- خواهد بود

- سال

- شما

- شما

- زفیرنت