پذیرش هوش مصنوعی (AI) در صنایع و موارد استفاده در حال افزایش است. پیشرفتهای علمی اخیر در یادگیری عمیق (DL)، مدلهای زبان بزرگ (LLM) و هوش مصنوعی مولد به مشتریان این امکان را میدهد تا از راهحلهای پیشرفته پیشرفته با عملکرد تقریباً شبیه انسان استفاده کنند. این مدلهای پیچیده اغلب به شتاب سختافزاری نیاز دارند زیرا نه تنها آموزش سریعتر، بلکه استنتاج سریعتر را در هنگام استفاده از شبکههای عصبی عمیق در برنامههای بلادرنگ امکانپذیر میسازد. تعداد زیاد هستههای پردازش موازی پردازندههای گرافیکی، آنها را برای این وظایف DL مناسب میسازد.

با این حال، علاوه بر فراخوانی مدل، آن برنامه های DL اغلب مستلزم پیش پردازش یا پس پردازش در خط لوله استنتاج هستند. به عنوان مثال، تصاویر ورودی برای یک مورد استفاده تشخیص شی ممکن است نیاز به تغییر اندازه یا برش قبل از ارائه به یک مدل بینایی کامپیوتری داشته باشند، یا قبل از استفاده در یک LLM، ورودیهای متن را نشانه گذاری کنند. انویدیا تریتون یک سرور استنتاج منبع باز است که به کاربران امکان می دهد چنین خطوط لوله استنتاجی را به عنوان مجموعه ای از مدل ها در قالب یک گراف غیر چرخه جهت دار (DAG) تعریف کنند. این برای اجرای مدل ها در مقیاس بر روی CPU و GPU طراحی شده است. آمازون SageMaker از استقرار یکپارچه تریتون پشتیبانی می کند و به شما امکان می دهد از ویژگی های تریتون استفاده کنید و در عین حال از مزایای آن نیز بهره مند شوید قابلیت های SageMaker: یک محیط مدیریت شده و ایمن با یکپارچه سازی ابزارهای MLOps، مقیاس بندی خودکار مدل های میزبانی شده و موارد دیگر.

AWS در تلاش خود برای کمک به مشتریان برای دستیابی به بالاترین صرفه جویی، به طور مداوم نه تنها در این زمینه نوآوری کرده است گزینه های قیمت گذاری و خدمات پیشگیرانه بهینه سازی هزینه، بلکه در راه اندازی ویژگی های صرفه جویی در هزینه مانند نقاط پایانی چند مدلی (MME). MME ها یک راه حل مقرون به صرفه برای استقرار تعداد زیادی مدل با استفاده از ناوگان یکسان منابع و یک کانتینر سرویس مشترک برای میزبانی همه مدل های شما هستند. به جای استفاده از چندین نقطه پایانی تک مدلی، میتوانید هزینههای میزبانی خود را با استقرار چندین مدل کاهش دهید در حالی که فقط برای یک محیط استنتاج پرداخت میکنید. علاوه بر این، MME ها سربار استقرار را کاهش می دهند زیرا SageMaker بارگیری مدل ها را در حافظه مدیریت می کند و آنها را بر اساس الگوهای ترافیکی به نقطه پایانی شما مقیاس می دهد.

در این پست، نحوه اجرای چندین مدل گروه یادگیری عمیق را در یک نمونه GPU با SageMaker MME نشان میدهیم. برای دنبال کردن این مثال، میتوانید کد را در عمومی پیدا کنید مخزن نمونه های SageMaker.

نحوه کار SageMaker MME با GPU

با MME ها، یک ظرف واحد میزبان چندین مدل است. SageMaker چرخه عمر مدل های میزبانی شده در MME را با بارگیری و تخلیه آنها در حافظه کانتینر کنترل می کند. SageMaker به جای دانلود همه مدلها در نقطه پایانی، مدلها را بهصورت پویا بارگیری و ذخیره میکند.

هنگامی که یک درخواست فراخوانی برای یک مدل خاص انجام می شود، SageMaker کارهای زیر را انجام می دهد:

- ابتدا درخواست را به نمونه پایانی هدایت می کند.

- اگر مدل بارگذاری نشده باشد، آرتیفکت مدل را از آن دانلود می کند سرویس ذخیره سازی ساده آمازون (Amazon S3) به آن نمونه ذخیره سازی بلوک الاستیک آمازون حجم (Amazon EBS).

- این مدل را در حافظه کانتینر در نمونه محاسباتی با شتاب GPU بارگذاری می کند. اگر مدل قبلاً در حافظه کانتینر بارگذاری شده باشد، فراخوانی سریعتر انجام میشود زیرا نیازی به مراحل بیشتری نیست.

هنگامی که یک مدل اضافی نیاز به بارگیری داشته باشد و میزان استفاده از حافظه نمونه بالا باشد، SageMaker مدلهای استفاده نشده را از ظرف آن نمونه تخلیه میکند تا اطمینان حاصل کند که حافظه کافی وجود دارد. این مدلهای تخلیهنشده روی ولوم EBS نمونه باقی میمانند تا بعداً بتوان آنها را در حافظه کانتینر بارگیری کرد و در نتیجه نیاز به بارگیری مجدد آنها از سطل S3 برطرف میشود. با این حال، اگر حجم ذخیرهسازی نمونه به ظرفیت خود برسد، SageMaker مدلهای استفاده نشده را از حجم ذخیرهسازی حذف میکند. در مواردی که MME درخواستهای فراخوانی زیادی دریافت میکند و نمونههای اضافی (یا یک خطمشی مقیاسبندی خودکار) وجود دارد، SageMaker برخی از درخواستها را به نمونههای دیگر در خوشه استنتاج هدایت میکند تا با ترافیک بالا سازگار شود.

این نه تنها یک مکانیسم صرفه جویی در هزینه را فراهم می کند، بلکه شما را قادر می سازد تا به صورت پویا مدل های جدید را مستقر کرده و مدل های قدیمی را منسوخ کنید. برای افزودن یک مدل جدید، آن را در سطل S3 آپلود میکنید که MME برای استفاده و فراخوانی آن پیکربندی شده است. برای حذف یک مدل، ارسال درخواست را متوقف کنید و آن را از سطل S3 حذف کنید. اضافه کردن مدل ها یا حذف آنها از MME نیازی به به روز رسانی خود نقطه پایانی ندارد!

گروه های تریتون

مجموعه مدل تریتون نشان دهنده خط لوله ای است که از یک مدل، منطق پیش پردازش و پس پردازش، و اتصال تانسورهای ورودی و خروجی بین آنها تشکیل شده است. یک درخواست استنتاج منفرد به یک مجموعه، اجرای کل خط لوله را به عنوان یک سری مراحل با استفاده از زمانبندی گروه آغاز می کند. زمانبند تانسورهای خروجی را در هر مرحله جمع آوری می کند و طبق مشخصات آنها را به عنوان تانسور ورودی برای مراحل دیگر ارائه می دهد. برای روشن شدن: مدل گروهی هنوز هم از دید خارجی به عنوان یک مدل واحد مشاهده می شود.

سرور تریتون معماری شامل یک مخزن مدل: یک مخزن مبتنی بر سیستم فایل از مدل هایی که تریتون برای استنباط در دسترس قرار می دهد. تریتون می تواند از یک یا چند مسیر فایل در دسترس محلی یا از مکان های راه دور مانند Amazon S3 به مدل ها دسترسی داشته باشد.

هر مدل در یک مخزن مدل باید دارای پیکربندی مدل باشد که اطلاعات مورد نیاز و اختیاری را در مورد مدل ارائه دهد. به طور معمول، این پیکربندی در a ارائه می شود config.pbtxt فایل مشخص شده به عنوان Protobuf ModelConfig. یک پیکربندی حداقل مدل باید پلتفرم یا باطن (مانند PyTorch یا TensorFlow) را مشخص کند. max_batch_size ویژگی، و تانسورهای ورودی و خروجی مدل.

تریتون در SageMaker

SageMaker استقرار مدل را با استفاده از سرور تریتون با کد سفارشی فعال می کند. این قابلیت از طریق مدیریت SageMaker در دسترس است کانتینرهای سرور استنتاج تریتون. این کانتینرها از چارچوبهای متداول مبتنی بر ماشین (ML) (مانند TensorFlow، ONNX، و PyTorch و همچنین قالبهای مدل سفارشی) و متغیرهای محیطی مفیدی پشتیبانی میکنند که به شما امکان میدهند عملکرد را در SageMaker بهینه کنید. استفاده از تصاویر SageMaker Deep Learning Containers (DLC) توصیه می شود زیرا آنها نگهداری می شوند و به طور منظم با وصله های امنیتی به روز می شوند.

راه حل

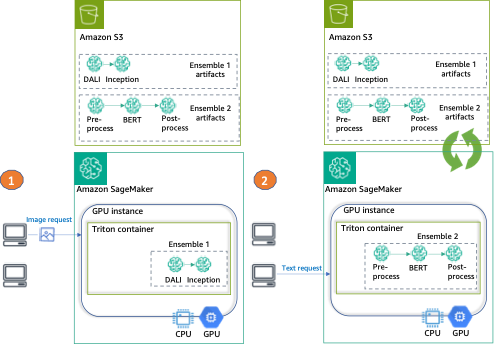

برای این پست، ما دو نوع مختلف از مجموعهها را در یک نمونه GPU، با استفاده از Triton و یک نقطه پایانی SageMaker، مستقر میکنیم.

مجموعه اول از دو مدل تشکیل شده است: یک مدل DALI برای پیش پردازش تصویر و یک مدل TensorFlow Inception v3 برای استنتاج واقعی. مجموعه خط لوله تصاویر رمزگذاری شده را به عنوان ورودی می گیرد، که باید رمزگشایی شوند، اندازه آنها به وضوح 299×299 تغییر داده شود و نرمال شود. این پیش پردازش توسط مدل DALI انجام خواهد شد. DALI یک منبع باز است کتابخانه ای برای کارهای رایج پیش پردازش تصویر و گفتار مانند رمزگشایی و تقویت داده ها. Inception v3 یک مدل تشخیص تصویر است که متشکل از پیچیدگی های متقارن و نامتقارن و ادغام متوسط و حداکثر لایه های کاملاً متصل است (و بنابراین برای استفاده از GPU عالی است).

گروه دوم جملات خام زبان طبیعی را به جاسازی تبدیل می کند و از سه مدل تشکیل شده است. ابتدا یک مدل پیش پردازش برای توکن سازی متن ورودی (که در پایتون پیاده سازی شده است) اعمال می شود. سپس از یک از پیش آموزش دیده استفاده می کنیم مدل BERT (بدون قاب). از Hugging Face Model Hub برای استخراج جاسازی های نشانه BERT یک مدل زبان انگلیسی است که با استفاده از هدف مدل سازی زبان ماسک (MLM) آموزش داده شده است. در نهایت، ما یک مدل پس پردازش را اعمال میکنیم که در آن جاسازیهای توکن خام از مرحله قبل در جاسازیهای جمله ترکیب میشوند.

پس از اینکه تریتون را برای استفاده از این مجموعه ها پیکربندی کردیم، نحوه پیکربندی و اجرای SageMaker MME را نشان می دهیم.

در نهایت، همانطور که در نمودار زیر مشاهده میشود، نمونهای از فراخوانی هر گروه ارائه میکنیم:

- تنظیم 1 - نقطه پایانی را با یک تصویر فراخوانی کنید و DALI-Inception را به عنوان گروه هدف مشخص کنید

- تنظیم 2 - همان نقطه پایانی را فراخوانی کنید، این بار با ورودی متن و درخواست مجموعه preprocess-BERT-postprocess

محیط را تنظیم کنید

ابتدا محیط مورد نیاز را تنظیم می کنیم. این شامل به روز رسانی کتابخانه های AWS (مانند Boto3 و SageMaker SDK) و نصب وابستگی های مورد نیاز برای بسته بندی مجموعه ها و اجرای استنتاج ها با استفاده از Triton. ما همچنین از نقش اجرای پیش فرض SageMaker SDK استفاده می کنیم. ما از این نقش برای فعال کردن SageMaker برای دسترسی به Amazon S3 (جایی که مصنوعات مدل ما ذخیره می شوند) و رجیستری کانتینر (جایی که از تصویر NVIDIA Triton استفاده خواهد شد). کد زیر را ببینید:

گروه ها را آماده کنید

در این مرحله بعدی، دو مجموعه را آماده می کنیم: TensorFlow (TF) Inception با پیش پردازش DALI و BERT با پیش پردازش و پس پردازش پایتون.

این مستلزم دانلود مدلهای از پیش آموزشدیده، ارائه فایلهای پیکربندی تریتون و بستهبندی مصنوعات برای ذخیرهسازی در آمازون S3 قبل از استقرار است.

گروه TF و DALI را آماده کنید

ابتدا دایرکتوری هایی را برای ذخیره مدل ها و تنظیمات خود آماده می کنیم: برای TF Inception (inception_graphdefبرای پیش پردازش DALI (dali) و برای گروه (ensemble_dali_inception). از آنجایی که تریتون از نسخه سازی مدل پشتیبانی می کند، نسخه مدل را نیز به مسیر دایرکتوری اضافه می کنیم (که با 1 مشخص می شود زیرا فقط یک نسخه داریم). برای کسب اطلاعات بیشتر در مورد خط مشی نسخه تریتون، مراجعه کنید سیاست نسخه. در مرحله بعد، مدل Inception v3 را دانلود کرده، آن را استخراج کرده و در آن کپی می کنیم inception_graphdef دایرکتوری مدل کد زیر را ببینید:

اکنون، تریتون را برای استفاده از خط لوله مجموعه خود پیکربندی می کنیم. در یک config.pbtxt در فایل، شکلها و انواع تانسور ورودی و خروجی و مراحلی که زمانبندی تریتون باید انجام دهد را مشخص میکنیم (پیشپردازش DALI و مدل اولیه برای طبقهبندی تصویر):

در مرحله بعد، هر یک از مدل ها را پیکربندی می کنیم. ابتدا پیکربندی مدل برای باطن DALI:

سپس، پیکربندی مدل برای TensorFlow Inception v3 که قبلا دانلود کردیم:

از آنجایی که این یک مدل طبقه بندی است، باید برچسب های مدل Inception را نیز در آن کپی کنیم inception_graphdef دایرکتوری در مخزن مدل این برچسب ها شامل 1,000 برچسب کلاس از IMAGEnet مجموعه داده

در مرحله بعد، خط لوله DALI را پیکربندی و سریال می کنیم که پیش پردازش ما را به پرونده انجام می دهد. پیش پردازش شامل خواندن تصویر (با استفاده از CPU)، رمزگشایی (تسریع با استفاده از GPU) و تغییر اندازه و عادی سازی تصویر است.

در نهایت، مصنوعات را با هم بسته بندی می کنیم و آنها را به عنوان یک شی واحد در آمازون S3 آپلود می کنیم:

مجموعه TensorRT و Python را آماده کنید

برای این مثال، ما از یک مدل از پیش آموزش دیده استفاده می کنیم کتابخانه ترانسفورماتور.

شما می توانید همه مدل ها (پیش پردازش و پس پردازش، به همراه config.pbtxt فایل ها) در پوشه ensemble_hf. ساختار سیستم فایل ما شامل چهار دایرکتوری (سه تا برای مراحل مدل فردی و یکی برای مجموعه) و همچنین نسخههای مربوطه خواهد بود:

در پوشه فضای کاری، ما با دو اسکریپت ارائه می دهیم: اولین اسکریپت برای تبدیل مدل به فرمت ONNX (onnx_exporter.py) و اسکریپت کامپایل TensorRT (gene_model_trt.sh).

تریتون به طور بومی از زمان اجرا TensorRT پشتیبانی می کند، که به شما امکان می دهد به راحتی یک موتور TensorRT را مستقر کنید و در نتیجه برای معماری انتخاب شده GPU بهینه سازی کنید.

برای اطمینان از استفاده از نسخه TensorRT و وابستگیهایی که با موارد موجود در کانتینر تریتون ما سازگار هستند، مدل را با استفاده از نسخه مربوط به تصویر کانتینر PyTorch NVIDIA کامپایل میکنیم:

سپس مصنوعات مدل را در دایرکتوری که قبلا ایجاد کرده بودیم کپی می کنیم و یک نسخه به مسیر اضافه می کنیم:

ما از یک بسته Conda برای ایجاد یک محیط Conda استفاده می کنیم که باطن Triton Python در پیش پردازش و پس پردازش از آن استفاده می کند:

در نهایت، مصنوعات مدل را در آمازون S3 آپلود می کنیم:

مجموعهها را روی نمونه SageMaker MME GPU اجرا کنید

اکنون که مصنوعات مجموعه ما در آمازون S3 ذخیره شده اند، می توانیم SageMaker MME را پیکربندی و راه اندازی کنیم.

ما با بازیابی URI تصویر ظرف برای شروع میکنیم تصویر DLC تریتون که با یکی در منطقه ما رجیستری کانتینر (و برای کامپایل مدل TensorRT استفاده می شود):

سپس مدل را در SageMaker ایجاد می کنیم. در create_model درخواست، ظرف مورد استفاده و مکان مصنوعات مدل را توصیف می کنیم و با استفاده از آن مشخص می کنیم Mode پارامتری که این یک مدل چندگانه است.

برای میزبانی مجموعههایمان، یک پیکربندی نقطه پایانی با the ایجاد میکنیم create_endpoint_config API را فراخوانی کنید و سپس با استفاده از آن یک نقطه پایانی ایجاد کنید create_endpoint API. سپس SageMaker تمام کانتینرهایی را که برای مدل تعریف کرده اید در محیط میزبانی مستقر می کند.

اگرچه در این مثال ما یک نمونه واحد را برای میزبانی مدل خود تنظیم می کنیم، MME های SageMaker به طور کامل از تنظیم یک خط مشی مقیاس خودکار پشتیبانی می کنند. برای اطلاعات بیشتر در مورد این ویژگی، نگاه کنید چندین مدل یادگیری عمیق را روی GPU با نقاط پایانی چند مدل Amazon SageMaker اجرا کنید.

بارهای درخواستی ایجاد کنید و MME را برای هر مدل فراخوانی کنید

پس از اینکه MME بلادرنگ ما مستقر شد، زمان آن فرا می رسد که نقطه پایانی خود را با هر یک از مجموعه های مدلی که استفاده می کردیم فراخوانی کنیم.

ابتدا یک بار برای گروه DALI-Inception ایجاد می کنیم. ما استفاده می کنیم shiba_inu_dog.jpg تصویر از مجموعه داده عمومی SageMaker از تصاویر حیوانات خانگی. ما تصویر را به عنوان یک آرایه رمزگذاری شده از بایت ها برای استفاده در باطن DALI بارگذاری می کنیم (برای کسب اطلاعات بیشتر، رجوع کنید به نمونه های رسیور تصویر).

در حالی که تصویر رمزگذاری شده و بارگذاری آماده است، نقطه پایانی را فراخوانی می کنیم.

توجه داشته باشید که ما گروه هدف خود را مشخص می کنیم model_tf_dali.tar.gz غیرواقعی، ساختگی. پارامتر TargetModel چیزی است که MME ها را از نقاط پایانی تک مدل متمایز می کند و ما را قادر می سازد تا درخواست را به مدل مناسب هدایت کنیم.

پاسخ شامل ابرداده در مورد فراخوانی (مانند نام مدل و نسخه) و پاسخ استنتاج واقعی در بخش داده شی خروجی است. در این مثال، آرایه ای از 1,001 مقدار دریافت می کنیم، که در آن هر مقدار احتمال کلاسی است که تصویر به آن تعلق دارد (1,000 کلاس و 1 اضافی برای دیگران).

بعد، دوباره MME خود را فراخوانی می کنیم، اما این بار گروه دوم را هدف قرار می دهیم. در اینجا داده ها فقط دو جمله متنی ساده هستند:

برای ساده کردن ارتباط با تریتون، پروژه تریتون چندین مورد را ارائه می دهد کتابخانه های مشتری. ما از آن کتابخانه برای آماده سازی بار در درخواست خود استفاده می کنیم:

اکنون ما آماده ایم تا نقطه پایانی را فراخوانی کنیم - این بار، مدل هدف همان است model_trt_python.tar.gz گروه:

پاسخ عبارت است از جاسازی جملات که می تواند در انواع برنامه های کاربردی پردازش زبان طبیعی (NLP) استفاده شود.

پاک کردن

در نهایت، نقطه پایانی، پیکربندی نقطه پایانی و مدل را پاکسازی و حذف می کنیم:

نتیجه

در این پست، نحوه پیکربندی، استقرار و فراخوانی یک MME SageMaker با مجموعههای Triton را در یک نمونه با شتاب GPU نشان دادیم. ما دو گروه را در یک محیط استنتاج بیدرنگ میزبانی کردیم، که هزینه ما را 50% کاهش داد (برای نمونه g4dn.4xlarge، که نشاندهنده بیش از 13,000 دلار صرفهجویی سالانه است). اگرچه این مثال فقط از دو خط لوله استفاده میکند، SageMaker MME میتواند هزاران مجموعه مدل را پشتیبانی کند، که آن را به یک مکانیسم صرفهجویی در هزینههای فوقالعاده تبدیل میکند. علاوه بر این، میتوانید از توانایی پویای SageMaker MME برای بارگیری (و تخلیه) مدلها برای به حداقل رساندن هزینههای عملیاتی مدیریت استقرار مدل در تولید استفاده کنید.

درباره نویسندگان

ساوراب تریکاند مدیر محصول ارشد Amazon SageMaker Inference است. او مشتاق کار با مشتریان است و هدفش دموکراتیک کردن یادگیری ماشین است. او روی چالشهای اصلی مربوط به استقرار برنامههای پیچیده ML، مدلهای ML چند مستاجر، بهینهسازی هزینهها و در دسترستر کردن استقرار مدلهای یادگیری عمیق تمرکز میکند. Saurabh در اوقات فراغت خود از پیاده روی، یادگیری در مورد فن آوری های نوآورانه، دنبال کردن TechCrunch و گذراندن وقت با خانواده خود لذت می برد.

ساوراب تریکاند مدیر محصول ارشد Amazon SageMaker Inference است. او مشتاق کار با مشتریان است و هدفش دموکراتیک کردن یادگیری ماشین است. او روی چالشهای اصلی مربوط به استقرار برنامههای پیچیده ML، مدلهای ML چند مستاجر، بهینهسازی هزینهها و در دسترستر کردن استقرار مدلهای یادگیری عمیق تمرکز میکند. Saurabh در اوقات فراغت خود از پیاده روی، یادگیری در مورد فن آوری های نوآورانه، دنبال کردن TechCrunch و گذراندن وقت با خانواده خود لذت می برد.

نیکیل کولکارنی یک توسعهدهنده نرمافزار با یادگیری ماشینی AWS است که بر روی کارآمدتر کردن بارهای کاری یادگیری ماشین در فضای ابری تمرکز دارد و یکی از سازندههای AWS Deep Learning Containers برای آموزش و استنتاج است. او مشتاق سیستم های یادگیری عمیق توزیع شده است. در خارج از محل کار، او از خواندن کتاب، بازی با گیتار و درست کردن پیتزا لذت می برد.

نیکیل کولکارنی یک توسعهدهنده نرمافزار با یادگیری ماشینی AWS است که بر روی کارآمدتر کردن بارهای کاری یادگیری ماشین در فضای ابری تمرکز دارد و یکی از سازندههای AWS Deep Learning Containers برای آموزش و استنتاج است. او مشتاق سیستم های یادگیری عمیق توزیع شده است. در خارج از محل کار، او از خواندن کتاب، بازی با گیتار و درست کردن پیتزا لذت می برد.

اوری روزنبرگ مدیر فنی متخصص AI و ML برای اروپا، خاورمیانه و آفریقا است. Uri در خارج از اسرائیل کار می کند تا مشتریان سازمانی را برای طراحی، ساخت و بهره برداری از حجم کاری ML در مقیاس توانمند کند. در اوقات فراغت از دوچرخه سواری، کوله گردی و تکثیر لذت می برد.

اوری روزنبرگ مدیر فنی متخصص AI و ML برای اروپا، خاورمیانه و آفریقا است. Uri در خارج از اسرائیل کار می کند تا مشتریان سازمانی را برای طراحی، ساخت و بهره برداری از حجم کاری ML در مقیاس توانمند کند. در اوقات فراغت از دوچرخه سواری، کوله گردی و تکثیر لذت می برد.

الیوت تریانا ایزازا مدیر روابط توسعه دهنده در تیم NVIDIA-AWS است. او رهبران محصولات آمازون و AWS، توسعه دهندگان و دانشمندان را با تکنولوژیست های NVIDIA و رهبران محصولات مرتبط می کند تا بار کاری آمازون ML/DL، محصولات EC2 و خدمات AWS AI را تسریع بخشد. علاوه بر این، الیوت یک دوچرخه سوار کوهستانی، اسکی باز و بازیکن پوکر پرشور است.

الیوت تریانا ایزازا مدیر روابط توسعه دهنده در تیم NVIDIA-AWS است. او رهبران محصولات آمازون و AWS، توسعه دهندگان و دانشمندان را با تکنولوژیست های NVIDIA و رهبران محصولات مرتبط می کند تا بار کاری آمازون ML/DL، محصولات EC2 و خدمات AWS AI را تسریع بخشد. علاوه بر این، الیوت یک دوچرخه سوار کوهستانی، اسکی باز و بازیکن پوکر پرشور است.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. خودرو / خودروهای الکتریکی، کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- BlockOffsets. نوسازی مالکیت افست زیست محیطی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/deploy-thousands-of-model-ensembles-with-amazon-sagemaker-multi-model-endpoints-on-gpu-to-minimize-your-hosting-costs/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 14

- 16

- 22

- 224

- 23

- 7

- 8

- a

- توانایی

- درباره ما

- شتاب دادن

- تسریع شد

- تسریع

- دسترسی

- در دسترس

- تطبیق

- مطابق

- رسیدن

- در میان

- واقعی

- حلقوی

- اضافه کردن

- اضافه کردن

- اضافه

- اضافی

- علاوه بر این

- اتخاذ

- پیشرفته

- افریقا

- از نو

- AI

- خدمات هوش مصنوعی

- معرفی

- اجازه دادن

- در امتداد

- قبلا

- همچنین

- هر چند

- آمازون

- آمازون SageMaker

- آمازون خدمات وب

- an

- و

- API

- کاربرد

- برنامه های کاربردی

- اعمال می شود

- درخواست

- روش

- معماری

- هستند

- صف

- AS

- At

- خودکار

- اتوماتیک

- در دسترس

- میانگین

- AWS

- آموزش ماشین AWS

- بخش مدیریت

- پایه

- مستقر

- BE

- زیرا

- بوده

- قبل از

- بودن

- متعلق

- سودمند است

- میان

- مسدود کردن

- کتاب

- هر دو

- پیشرفت ها

- ساختن

- اما

- by

- صدا

- CAN

- ظرفیت

- مورد

- موارد

- مرکزی

- چالش ها

- کلاس

- کلاس ها

- طبقه بندی

- ابر

- خوشه

- رمز

- COM

- ترکیب شده

- مشترک

- ارتباط

- سازگار

- پیچیده

- محاسبه

- کامپیوتر

- چشم انداز کامپیوتر

- پیکر بندی

- پیکربندی

- متصل

- ارتباط

- متصل

- تشکیل شده است

- ظرف

- ظروف

- به طور مداوم

- گروه شاهد

- تبدیل

- هسته

- متناظر

- هزینه

- صرفه جویی در هزینه

- مقرون به صرفه

- هزینه

- ایجاد

- ایجاد شده

- سفارشی

- مشتریان

- DAG

- داده ها

- رمز گشایی

- فداکاری

- عمیق

- یادگیری عمیق

- به طور پیش فرض

- تعريف كردن

- مشخص

- دموکراتیک کردن

- وابستگی

- گسترش

- مستقر

- استقرار

- گسترش

- اعزام ها

- مستقر می کند

- توصیف

- طرح

- طراحی

- کشف

- توسعه دهنده

- توسعه دهندگان

- مختلف

- مستقیم

- دایرکتوری

- توزیع شده

- کارگر بارانداز

- میکند

- نمی کند

- دانلود

- دانلود

- پویا

- بطور پویا

- هر

- پیش از آن

- به آسانی

- شرق

- دیگر

- قدرت دادن

- قادر ساختن

- را قادر می سازد

- نقطه پایانی

- موتور

- انگلیسی

- کافی

- اطمینان حاصل شود

- سرمایه گذاری

- تمام

- محیط

- اروپا

- مثال

- مثال ها

- اعدام

- منبسط

- خارجی

- اضافی

- عصاره

- فوق العاده

- چهره

- خانواده

- سریعتر

- ویژگی

- امکانات

- پرونده

- فایل ها

- سرانجام

- پیدا کردن

- نام خانوادگی

- ناوگان

- شناور

- تمرکز

- تمرکز

- به دنبال

- پیروی

- برای

- فرم

- قالب

- چهار

- چارچوب

- از جانب

- کاملا

- قابلیت

- بیشتر

- بعلاوه

- تولید می کنند

- مولد

- هوش مصنوعی مولد

- دریافت کنید

- هدف

- GPU

- گراف

- دسته

- سخت افزار

- آیا

- he

- کمک

- اینجا کلیک نمایید

- زیاد

- بالاترین

- خود را

- میزبان

- میزبانی

- میزبانی وب

- هزینه های میزبانی

- میزبان

- چگونه

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- i

- if

- تصویر

- طبقه بندی تصویر

- شناسایی تصویر

- تصاویر

- اجرا

- واردات

- in

- آغازگر

- شامل

- شامل

- فرد

- لوازم

- اطلاعات

- ابتکاری

- فن آوری های نوآورانه

- ورودی

- ورودی

- نصب کردن

- نمونه

- در عوض

- ادغام

- اطلاعات

- به

- استناد کرد

- اسرائيل

- IT

- ITS

- JPG

- json

- تنها

- کلید

- نوع

- برچسب ها

- زبان

- بزرگ

- بعد

- راه اندازی

- راه اندازی

- لایه

- رهبران

- یاد گرفتن

- یادگیری

- اجازه

- کتابخانه ها

- کتابخانه

- wifecycwe

- پسندیدن

- LLM

- بار

- بارگیری

- بارهای

- به صورت محلی

- محل

- مکان

- منطق

- دستگاه

- فراگیری ماشین

- ساخته

- ساخت

- باعث می شود

- ساخت

- اداره می شود

- مدیر

- مدیریت می کند

- مدیریت

- بسیاری

- ماسک

- حداکثر

- مکانیزم

- حافظه

- متاداده

- متوسط

- خاورمیانه

- قدرت

- حداقل

- مخلوط

- ML

- MLO ها

- حالت

- مدل

- مدل سازی

- مدل

- بیش

- انگیزه

- کوه

- چندگانه

- باید

- نام

- طبیعی

- پردازش زبان طبیعی

- نیاز

- ضروری

- نیازهای

- شبکه

- شبکه های عصبی

- جدید

- بعد

- nlp

- نه

- عدد

- بی حس

- کارت گرافیک Nvidia

- هدف

- تشخیص شی

- هدف

- of

- غالبا

- قدیمی

- on

- ONE

- آنهایی که

- فقط

- منبع باز

- کار

- قابل استفاده

- بهینه سازی

- بهینه سازی

- or

- دیگر

- ما

- خارج

- تولید

- خارج از

- روی

- بسته

- بسته

- بسته بندی

- موازی

- پارامتر

- پارامترهای

- بخش

- ویژه

- احساساتی

- پچ های

- مسیر

- الگوهای

- پرداخت

- کامل

- کارایی

- پی اچ پی

- خط لوله

- پیتزا

- محل

- برنامه

- سکو

- افلاطون

- هوش داده افلاطون

- PlatoData

- بازیکن

- پوکر

- سیاست

- پست

- آماده

- قبلی

- بلادرنگ

- در حال پردازش

- محصول

- مدیر تولید

- تولید

- محصولات

- پروژه

- ویژگی

- نیا

- ارائه

- ارائه

- فراهم می کند

- ارائه

- عمومی

- پــایتــون

- مارماهی

- بالا بردن

- خام

- می رسد

- مطالعه

- اماده

- زمان واقعی

- دریافت

- اخیر

- به رسمیت شناختن

- توصیه می شود

- كاهش دادن

- کاهش

- منطقه

- رجیستری

- به طور منظم

- مربوط

- روابط

- ماندن

- دور

- از بین بردن

- مخزن

- نشان دهنده

- درخواست

- درخواست

- نیاز

- ضروری

- وضوح

- منابع

- قابل احترام

- پاسخ

- برگشت

- بازده

- RGB

- راست

- نقش

- مسیرها

- دویدن

- حکیم ساز

- استنباط SageMaker

- همان

- صرفه جویی کردن

- پس انداز

- مقیاس

- مقیاس گذاری

- علمی

- دانشمندان

- اسکریپت

- sdk

- یکپارچه

- دوم

- امن

- تیم امنیت لاتاری

- دیدن

- مشاهده گردید

- انتخاب شد

- در حال ارسال

- ارشد

- جمله

- سلسله

- خدمات

- خدمت

- تنظیم

- محیط

- چند

- شکل

- اشکال

- به اشتراک گذاشته شده

- نشان

- نشان داد

- ساده

- ساده کردن

- تنها

- اندازه

- So

- نرم افزار

- راه حل

- مزایا

- برخی از

- متخصص

- مشخصات

- مشخص شده

- سخنرانی - گفتار

- هزینه

- شروع

- وضعیت هنر

- گام

- مراحل

- هنوز

- توقف

- ذخیره سازی

- ذخیره شده

- ذخیره سازی

- ساختار

- چنین

- پشتیبانی

- پشتیبانی از

- مطمئن

- سیستم

- سیستم های

- گرفتن

- طول می کشد

- هدف

- وظایف

- تیم

- TechCrunch

- فنی

- فن آوری

- تکنسین ها

- جریان تنسور

- که

- La

- شان

- آنها

- سپس

- آنجا.

- در نتیجه

- از این رو

- اینها

- آنها

- این

- کسانی که

- هزاران نفر

- سه

- از طریق

- زمان

- به

- با هم

- رمز

- از Tokenization

- ابزار

- ترافیک

- آموزش دیده

- آموزش

- تبدیل می شود

- تریتون

- دو

- انواع

- نوعی

- به طور معمول

- استفاده نشده

- به روز شده

- به روز رسانی

- us

- استفاده

- استفاده کنید

- مورد استفاده

- استفاده

- کاربران

- با استفاده از

- ارزش

- ارزشها

- تنوع

- نسخه

- نسخه

- چشم انداز

- دید

- حجم

- می خواهم

- بود

- we

- وب

- خدمات وب

- خوب

- چی

- چه زمانی

- که

- در حین

- اراده

- با

- مهاجرت کاری

- کارگر

- با این نسخهها کار

- سالانه

- شما

- شما

- زفیرنت