دنیای هوش مصنوعی (AI) و یادگیری ماشین (ML) با ظهور مدلهای هوش مصنوعی مولد که میتوانند متن، تصاویر، کد و صدا شبیه انسان ایجاد کنند، شاهد یک تغییر پارادایم بوده است. در مقایسه با مدلهای کلاسیک ML، مدلهای هوش مصنوعی مولد به طور قابلتوجهی بزرگتر و پیچیدهتر هستند. با این حال، پیچیدگی فزاینده آنها همچنین با هزینه های بالا برای استنتاج و نیاز روزافزون به منابع محاسباتی قدرتمند همراه است. هزینه بالای استنتاج برای مدلهای هوش مصنوعی مولد میتواند مانعی برای ورود کسبوکارها و محققان با منابع محدود باشد و نیاز به راهحلهای کارآمدتر و مقرونبهصرفهتر را ضروری میکند. علاوه بر این، اکثر موارد استفاده از هوش مصنوعی مولد شامل تعامل انسانی یا سناریوهای دنیای واقعی است که نیاز به سختافزاری دارد که بتواند عملکرد با تأخیر پایین ارائه دهد. AWS با تراشه های هدفمند نوآوری کرده است تا نیاز روزافزون به سخت افزار محاسباتی قدرتمند، کارآمد و مقرون به صرفه را برطرف کند.

امروز، ما مشتاقیم که اعلام کنیم آمازون SageMaker پشتیبانی از AWS Inferentia2 (ml.inf2) و AWS Trainium (ml.trn1) نمونههای مبتنی بر SageMaker برای میزبانی مدلهای هوش مصنوعی مولد برای استنتاج بلادرنگ و ناهمزمان. نمونههای ml.inf2 برای استقرار مدل در SageMaker در شرق ایالات متحده (اوهایو) و نمونههای ml.trn1 در شرق ایالات متحده (N. Virginia) در دسترس هستند.

میتوانید از این نمونهها در SageMaker برای دستیابی به عملکرد بالا با هزینه کم برای مدلهای AI مولد، از جمله مدلهای زبان بزرگ (LLM)، Stable Diffusion و ترانسفورماتورهای بینایی استفاده کنید. علاوه بر این، می توانید استفاده کنید توصیه کننده استنباط آمازون SageMaker برای کمک به شما در اجرای تست های بارگذاری و ارزیابی مزایای قیمت-عملکرد استقرار مدل خود در این نمونه ها.

میتوانید از نمونههای ml.inf2 و ml.trn1 برای اجرای برنامههای ML خود در SageMaker برای خلاصهسازی متن، تولید کد، تولید ویدیو و تصویر، تشخیص گفتار، شخصیسازی، تشخیص تقلب و موارد دیگر استفاده کنید. هنگام پیکربندی نقطه پایانی SageMaker، میتوانید به راحتی با مشخص کردن نمونههای ml.trn1 یا ml.inf2 شروع کنید. برای شروع آسان می توانید از ظروف یادگیری عمیق AWS (DLC) سازگار با ml.trn1 و ml.inf2 برای PyTorch، TensorFlow، Hugging Face و مدل بزرگ (LMI) استفاده کنید. برای لیست کامل با نسخه ها، نگاه کنید تصاویر ظروف یادگیری عمیق موجود.

در این پست، فرآیند استقرار یک مدل زبان بزرگ در AWS Inferentia2 با استفاده از SageMaker، بدون نیاز به کدگذاری اضافی، با بهرهگیری از ظرف LMI را نشان میدهیم. ما استفاده می کنیم GPT4ALL-J، یک مدل GPT-J 7B با تنظیم دقیق که یک تعامل سبک چت بات را فراهم می کند.

مروری بر موارد ml.trn1 و ml.inf2

نمونههای ml.trn1 توسط شتابدهنده Trainium نیرو میگیرند که عمدتاً برای آموزش یادگیری عمیق با کارایی بالا مدلهای مولد هوش مصنوعی، از جمله LLM ساخته شده است. با این حال، این نمونهها از حجم کار استنتاج برای مدلهایی که حتی بزرگتر از آنچه در Inf2 قرار میگیرند نیز پشتیبانی میکنند. بزرگترین اندازه نمونه، trn1.32xlarge instances، دارای 16 است شتاب دهنده های Trainium با 512 گیگابایت حافظه شتاب دهنده در یک نمونه که حداکثر 3.4 پتافلاپ توان محاسباتی FP16/BF16 را ارائه می کند. 16 شتاب دهنده Trainium به NeuronLinkv2 بسیار سریع برای ارتباطات جمعی کارآمد متصل شده اند.

نمونه های ml.Inf2 توسط شتاب دهنده AWS Inferentia2، یک شتاب دهنده هدفمند برای استنتاج. در مقایسه با نسل اول AWS Inferentia سه برابر عملکرد محاسباتی بالاتر، تا چهار برابر توان عملیاتی بالاتر و تا 10 برابر تاخیر کمتری ارائه می دهد. بزرگترین اندازه نمونه، Inf2.48xlarge، دارای 12 شتاب دهنده AWS Inferentia2 با 384 گیگابایت حافظه شتاب دهنده در یک نمونه برای قدرت محاسباتی ترکیبی 2.3 پتافلاپ برای BF16/FP16 است. این به شما امکان می دهد تا یک مدل با پارامتر 175 میلیارد را در یک نمونه پیاده سازی کنید. Inf2 تنها نمونه استنتاج بهینه شده برای ارائه این اتصال است، ویژگی که فقط در نمونه های آموزشی گران تر در دسترس است. برای مدلهای بسیار بزرگ که در یک شتابدهنده قرار نمیگیرند، دادهها مستقیماً بین شتابدهندهها با NeuronLink جریان مییابند و CPU را به طور کامل دور میزنند. با NeuronLink، Inf2 از استنتاج توزیع شده سریعتر پشتیبانی می کند و توان عملیاتی و تأخیر را بهبود می بخشد.

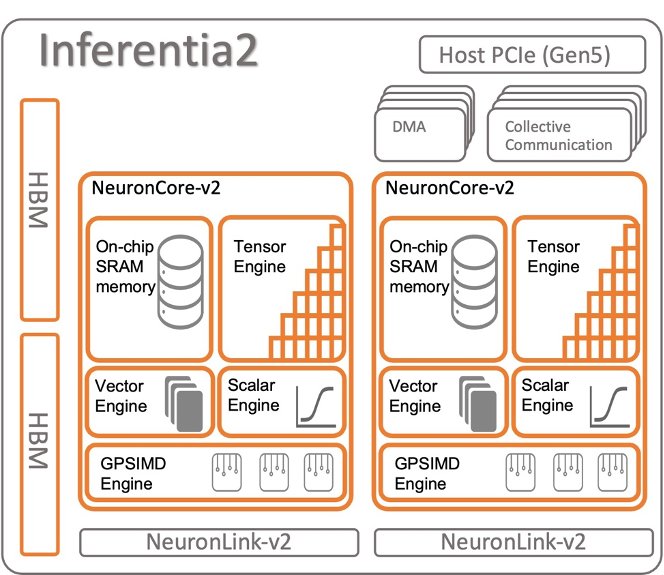

هر دو شتاب دهنده AWS Inferentia2 و Trainium دو دارند NeuronCores-v2، پشته های حافظه 32 گیگابایتی HBM و موتورهای محاسبات جمعی اختصاصی که به طور خودکار زمان اجرا را با همپوشانی محاسبات و ارتباطات هنگام استنتاج چند شتاب دهنده بهینه می کنند. برای جزئیات بیشتر در مورد معماری به ادامه مطلب مراجعه کنید دستگاه های Trainium و Inferentia.

نمودار زیر نمونه ای از معماری را با استفاده از AWS Inferentia2 نشان می دهد.

AWS Neuron SDK

نورون AWS SDK است که برای اجرای بارهای کاری یادگیری عمیق در نمونه های مبتنی بر AWS Inferentia و Trainium استفاده می شود. AWS Neuron شامل یک کامپایلر یادگیری عمیق، زمان اجرا و ابزارهایی است که به صورت بومی در TensorFlow و PyTorch ادغام شدهاند. با Neuron، میتوانید بارهای کاری ML را با کارایی بالا در ml.trn1 و ml.inf2 توسعه دهید، نمایه کنید و به کار ببرید.

La کامپایلر نورون مدلهای ML را در قالبهای مختلف (TensorFlow، PyTorch، XLA HLO) میپذیرد و آنها را برای اجرا بر روی دستگاههای Neuron بهینه میکند. کامپایلر Neuron در چارچوب ML فراخوانی می شود، جایی که مدل های ML توسط افزونه فریمورک Neuron به کامپایلر ارسال می شوند. مصنوع کامپایلر به دست آمده یک فایل NEFF (فرمت فایل اجرایی نورون) نامیده می شود که به نوبه خود توسط زمان اجرا نورون در دستگاه نورون بارگذاری می شود.

La زمان اجرا نورون شامل درایور هسته و کتابخانه های C/C++ است که API هایی را برای دسترسی به دستگاه های AWS Inferentia و Trainium Neuron ارائه می کنند. افزونههای فریمورکهای Neuron ML برای TensorFlow و PyTorch از زمان اجرا Neuron برای بارگذاری و اجرای مدلها در NeuronCores استفاده میکنند. Neuron زمان اجرا، مدلهای یادگیری عمیق (NEFF) را در دستگاههای Neuron بارگذاری میکند و برای توان عملیاتی بالا و تأخیر کم بهینهسازی شده است.

میزبانی مدلهای NLP با استفاده از نمونههای SageMaker ml.inf2

قبل از اینکه عمیقاً در خدمت به LLM ها با آن غوطه ور شویم ترانسفورماتور - نورونکس، که یک کتابخانه منبع باز برای خرد کردن ماتریس های وزن بزرگ مدل بر روی هسته های عصبی متعدد است، اجازه دهید به طور خلاصه جریان استقرار معمولی را برای مدلی که می تواند روی یک NeuronCore قرار گیرد مرور کنیم.

را بررسی کنید لیست مدل های پشتیبانی شده برای اطمینان از پشتیبانی مدل در AWS Inferentia2. سپس، مدل باید توسط Neuron Compiler از قبل کامپایل شود. می توانید از یک نوت بوک SageMaker یا یک دفترچه یادداشت استفاده کنید ابر محاسبه الاستیک آمازون (Amazon EC2) نمونه برای کامپایل مدل. همانطور که در کد زیر نشان داده شده است، می توانید از SageMaker Python SDK برای استقرار مدل ها با استفاده از چارچوب های یادگیری عمیق محبوب مانند PyTorch استفاده کنید. می توانید مدل خود را در سرویس های میزبانی SageMaker مستقر کنید و یک نقطه پایانی دریافت کنید که می تواند برای استنتاج استفاده شود. این نقاط پایانی به طور کامل مدیریت می شوند و از مقیاس خودکار پشتیبانی می کنند.

به مراجعه جریان های توسعه دهنده برای جزئیات بیشتر در مورد جریان های توسعه معمولی Inf2 در SageMaker با اسکریپت های نمونه.

LLM ها را با استفاده از نمونه های SageMaker ml.inf2 میزبانی کنید

مدلهای زبان بزرگ با میلیاردها پارامتر اغلب برای جا دادن در یک شتابدهنده بسیار بزرگ هستند. این امر مستلزم استفاده از تکنیک های موازی مدل برای میزبانی LLM در چندین شتاب دهنده است. یکی دیگر از نیازهای حیاتی برای میزبانی LLM، اجرای یک راه حل ارائه مدل با کارایی بالا است. این راه حل باید به طور موثر مدل را بارگیری کند، پارتیشن بندی را مدیریت کند و درخواست ها را از طریق نقاط پایانی HTTP به طور یکپارچه ارائه دهد.

SageMaker شامل ظروف یادگیری عمیق تخصصی (DLC)، کتابخانه ها و ابزارهایی برای موازی سازی مدل و استنتاج مدل های بزرگ است. برای منابعی برای شروع کار با LMI در SageMaker، مراجعه کنید توازی مدل و استنتاج مدل بزرگ. SageMaker DLC ها را با کتابخانه های منبع باز محبوب برای میزبانی مدل های بزرگ مانند GPT، T5، OPT، BLOOM و Stable Diffusion در زیرساخت AWS نگهداری می کند. این DLC های تخصصی به عنوان ظروف SageMaker LMI شناخته می شوند.

ظروف LMI SageMaker از DJLServing استفاده کنید، یک سرور مدل که با کتابخانه ترانسفورماتور-نرونکس یکپارچه شده است تا از موازی سازی تانسور در سراسر NeuronCores پشتیبانی کند. برای کسب اطلاعات بیشتر در مورد نحوه عملکرد DJLServing به ادامه مطلب مراجعه کنید استقرار مدل های بزرگ در Amazon SageMaker با استفاده از استنتاج موازی مدل DJLServing و DeepSpeed. سرور مدل DJL و کتابخانه transformers-neuronx به عنوان اجزای اصلی کانتینر عمل می کنند که شامل Neuron SDK نیز می شود. این راهاندازی بارگذاری مدلها را در شتابدهندههای AWS Inferentia2 تسهیل میکند، مدل را در چند هستهی عصبی موازی میکند، و سرویسدهی از طریق نقاط پایانی HTTP را امکانپذیر میسازد.

ظرف LMI از مدل های بارگیری پشتیبانی می کند سرویس ذخیره سازی ساده آمازون سطل (Amazon S3) یا Hugging Face Hub. اسکریپت پیشفرض کنترلکننده مدل را بارگیری میکند، آن را کامپایل میکند و آن را به یک فرمت بهینهسازی نورون تبدیل میکند و آن را بارگذاری میکند. برای استفاده از کانتینر LMI برای میزبانی LLM ها، دو گزینه داریم:

- بدون کد (ترجیحا) - این ساده ترین راه برای استقرار یک LLM با استفاده از یک ظرف LMI است. در این روش می توانید از موارد ارائه شده استفاده کنید کنترل کننده پیش فرض و فقط نام مدل و پارامترهای مورد نیاز را وارد کنید

serving.propertiesفایل برای بارگذاری و میزبانی مدل. برای استفاده از کنترل کننده پیش فرض، ما آن را ارائه می کنیمentryPointپارامتر به عنوانdjl_python.transformers-neuronx. - اسکریپت خودت رو بیار – در این روش، شما این امکان را دارید که فایل model.py خود را بسازید که حاوی کدهای لازم برای بارگذاری و سرویس مدل است. این فایل به عنوان یک واسطه بین

DJLServingAPI ها وtransformers-neuronxAPI ها برای سفارشی کردن فرآیند بارگیری مدل، می توانید ارائه دهیدserving.propertiesبا پارامترهای قابل تنظیم برای یک لیست جامع از پارامترهای قابل تنظیم موجود، به مراجعه کنید تمام گزینه های پیکربندی DJL. در اینجا یک مثال از a است model.py فایل.

معماری زمان اجرا

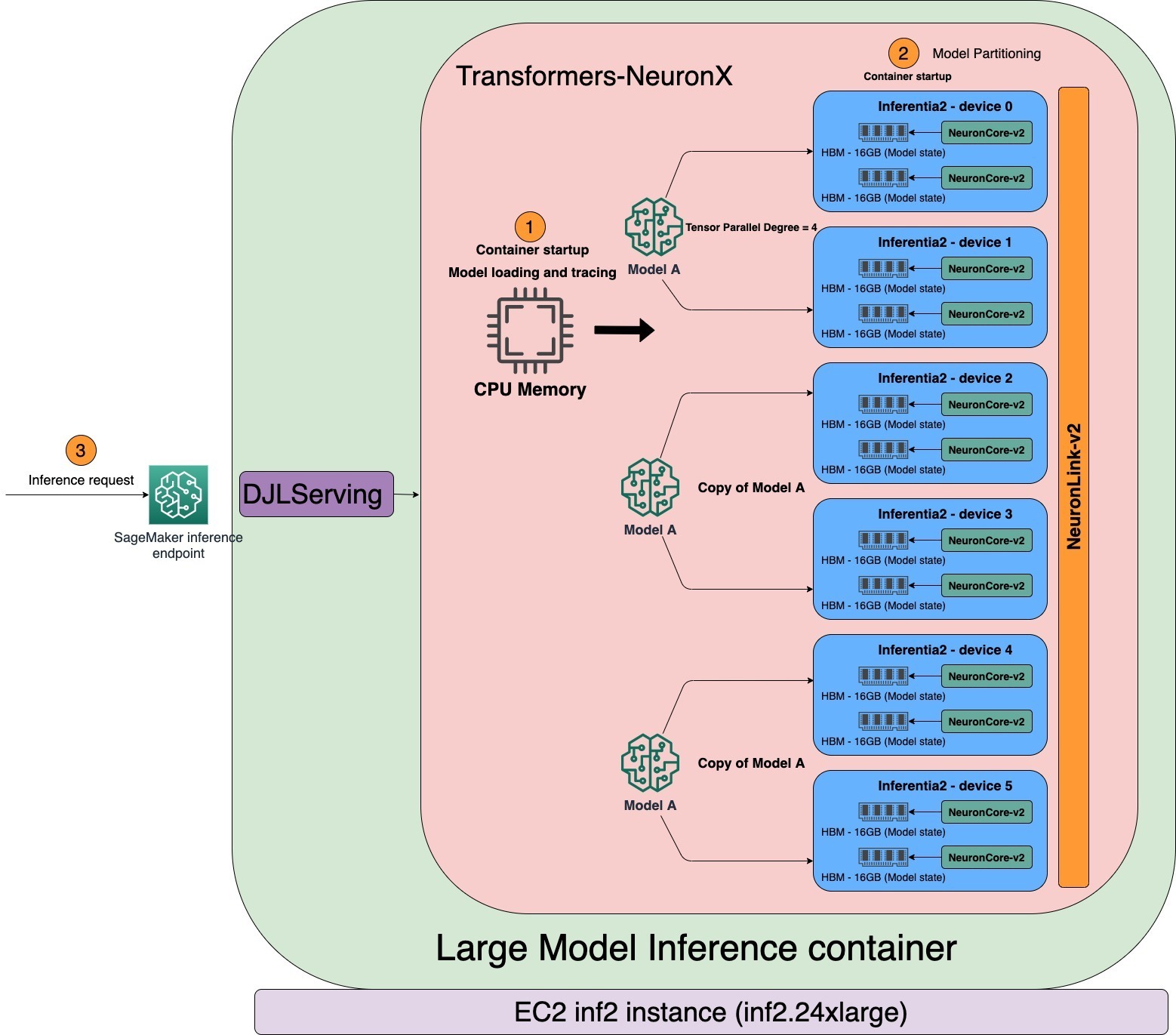

La tensor_parallel_degree مقدار ویژگی توزیع ماژول های موازی تانسور را در چند هسته عصبی تعیین می کند. به عنوان مثال، inf2.24xlarge دارای شش شتاب دهنده AWS Inferentia2 است. هر شتاب دهنده AWS Inferentia2 دارای دو هسته عصبی است. هر NeuronCore دارای یک حافظه اختصاصی با پهنای باند بالا (HBM) با ظرفیت 16 گیگابایت است که ماژول های موازی تانسور را ذخیره می کند. با درجه موازی تانسور 4، LMI سه نسخه مدل از همان مدل را به خود اختصاص می دهد که هر کدام از چهار هسته عصبی استفاده می کند. همانطور که در نمودار زیر نشان داده شده است، هنگامی که محفظه LMI راه اندازی می شود، مدل ابتدا در حافظه آدرس پذیر CPU بارگذاری و ردیابی می شود. هنگامی که ردیابی کامل شد، مدل بر اساس درجه موازی تانسور در سراسر هستههای عصبی تقسیم میشود.

LMI از DJLServing به عنوان پشته سرویس مدل خود استفاده می کند. پس از بررسی سلامت کانتینر در SageMaker، کانتینر آماده ارائه درخواست استنتاج است. DJLServing چندین فرآیند پایتون را راه اندازی می کند TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. هر فرآیند پایتون حاوی رشته هایی به زبان C++ معادل آن است TENSOR_PARALLEL_DEGREE. هر نخ C++ یک قطعه از مدل را در یک NeuronCore نگه می دارد.

هنگامی که سرور با چندین درخواست مستقل فراخوانی می شود، بسیاری از متخصصان (فرایند پایتون) تمایل دارند استنتاج را به صورت متوالی اجرا کنند. اگرچه راهاندازی آن آسانتر است، اما معمولاً بهترین روش استفاده از توان محاسباتی شتابدهنده نیست. برای رفع این مشکل، DJLServing بهینهسازیهای داخلی دستهبندی پویا را برای ترکیب این درخواستهای استنتاج مستقل در سمت سرور ارائه میکند تا یک دسته بزرگتر به صورت پویا برای افزایش توان تولید تشکیل دهد. تمام درخواستها قبل از ورود به صفهای شغلی واقعی، ابتدا به دسته پویا میرسند تا منتظر استنتاج شوند. شما می توانید اندازه های دسته ای دلخواه خود را برای دسته بندی پویا با استفاده از batch_size تنظیمات در serving.properties. همچنین می توانید پیکربندی کنید max_batch_delay برای تعیین حداکثر زمان تاخیر در batcher برای منتظر ماندن سایر درخواستها برای پیوستن به دسته بر اساس الزامات تاخیر شما. توان عملیاتی همچنین به تعداد نسخههای مدل و گروههای فرآیند پایتون راهاندازی شده در ظرف بستگی دارد. همانطور که در نمودار زیر نشان داده شده است، با تنظیم درجه موازی تانسور روی 4، ظرف LMI سه گروه فرآیند پایتون را راهاندازی میکند که هر کدام نسخه کامل مدل را در خود جای میدهند. این به شما امکان می دهد اندازه دسته را افزایش دهید و توان عملیاتی بالاتری داشته باشید.

نوت بوک SageMaker برای استقرار LLM

در این بخش، به طور گام به گام پیادهسازی GPT4All-J، یک مدل 6 میلیارد پارامتری که 24 گیگابایت در FP32 است، ارائه میکنیم. GPT4All-J یک ربات چت محبوب است که بر روی انواع مختلفی از محتوای تعاملی مانند مشکلات کلمه، دیالوگ ها، کدها، شعرها، آهنگ ها و داستان ها آموزش دیده است. GPT4all-J یک مدل GPT-J دقیق تنظیم شده است که پاسخ هایی شبیه به تعاملات انسانی ایجاد می کند.

دفترچه یادداشت کامل این مثال در ارائه شده است GitHub. ما می توانیم از SageMaker Python SDK برای استقرار مدل در یک نمونه Inf2 استفاده کنیم. ما از ارائه شده استفاده می کنیم کنترل کننده پیش فرض برای بارگذاری مدل با این، ما فقط نیاز به ارائه یک خدمات. خواص فایل. این فایل دارای تنظیمات لازم برای سرور مدل DJL برای دانلود و میزبانی مدل است. ما می توانیم نام مدل Hugging Face را با استفاده از عبارت مشخص کنیم model_id پارامتر برای دانلود مستقیم مدل از مخزن Hugging Face. همچنین، میتوانید با ارائه آن، مدل را از آمازون S3 دانلود کنید s3url پارامتر. entryPoint پارامتر برای اشاره به کتابخانه برای بارگذاری مدل پیکربندی شده است. برای جزئیات بیشتر در djl_python.fastertransformer، مراجعه کنید کد GitHub.

La tensor_parallel_degree ارزش ویژگی توزیع ماژول های موازی تانسور را در چندین دستگاه تعیین می کند. به عنوان مثال، با 12 هسته عصبی و درجه موازی تانسور 4، LMI سه نسخه مدل را به خود اختصاص می دهد که هر کدام از چهار هسته عصبی استفاده می کند. شما همچنین می توانید نوع دقیق را با استفاده از ویژگی تعریف کنید dtype. n_position پارامتر مجموع حداکثر طول توالی ورودی و خروجی را برای مدل تعریف می کند. کد زیر را ببینید:

ساختن tarball حاوی serving.properties و آن را در یک سطل S3 آپلود کنید. اگرچه در این مثال از کنترل کننده پیش فرض استفاده شده است، شما می توانید a را توسعه دهید model.py فایل برای سفارشی کردن فرآیند بارگیری و سرویس دهی. اگر بسته هایی وجود دارد که نیاز به نصب دارند، آنها را در قسمت قرار دهید requirements.txt فایل. کد زیر را ببینید:

تصویر ظرف DJL را بازیابی کنید و مدل SageMaker را ایجاد کنید:

در مرحله بعد، نقطه پایانی SageMaker را با پیکربندی مدلی که قبلا تعریف شده بود ایجاد می کنیم. ظرف مدل را در داخل دانلود می کند /tmp فضا زیرا SageMaker نقشهبرداری میکند /tmp به فروشگاه بلوک الاستیک آمازون (Amazon EBS). باید a اضافه کنیم volume_size پارامتر برای اطمینان از /tmp دایرکتوری فضای کافی برای دانلود و کامپایل مدل دارد. تنظیم کردیم container_startup_health_check_timeout به 3,600 ثانیه برای اطمینان از شروع بررسی سلامت پس از آماده شدن مدل. ما از نمونه ml.inf2.8xlarge استفاده می کنیم. کد زیر را ببینید:

پس از ایجاد نقطه پایانی SageMaker، میتوانیم با استفاده از Predictor هدف - شی:

پاک کردن

برای صرفه جویی در هزینه ها پس از اتمام آزمایشات، نقاط پایانی را حذف کنید:

نتیجه

در این پست، ما قابلیت جدید SageMaker را به نمایش گذاشتیم که اکنون از نمونههای ml.inf2 و ml.trn1 برای میزبانی مدلهای هوش مصنوعی مولد پشتیبانی میکند. ما نشان دادیم که چگونه GPT4ALL-J، یک مدل هوش مصنوعی مولد، را با استفاده از SageMaker و ظرف LMI، بدون نوشتن کد، روی AWS Inferentia2 استقرار دهیم. ما همچنین نحوه استفاده از DJLServing و را نشان دادیم transformers-neuronx برای بارگذاری یک مدل، پارتیشن بندی آن و سرویس دهی.

نمونه های Inf2 مقرون به صرفه ترین راه را برای اجرای مدل های هوش مصنوعی مولد در AWS ارائه می دهند. برای جزئیات عملکرد، مراجعه کنید عملکرد Inf2.

اتمام GitHub مخزن یک نوت بوک نمونه آن را امتحان کنید و اگر سوالی دارید با ما در میان بگذارید!

درباره نویسنده

ویوک گانگاسانی یک معمار ارشد راه حل های یادگیری ماشین در خدمات وب آمازون است. او با استارتآپهای یادگیری ماشینی برای ساخت و استقرار برنامههای AI/ML در AWS کار میکند. او در حال حاضر بر ارائه راهحلهایی برای MLOps، ML Inference و ML با کد پایین متمرکز است. او روی پروژه هایی در حوزه های مختلف از جمله پردازش زبان طبیعی و بینایی کامپیوتری کار کرده است.

ویوک گانگاسانی یک معمار ارشد راه حل های یادگیری ماشین در خدمات وب آمازون است. او با استارتآپهای یادگیری ماشینی برای ساخت و استقرار برنامههای AI/ML در AWS کار میکند. او در حال حاضر بر ارائه راهحلهایی برای MLOps، ML Inference و ML با کد پایین متمرکز است. او روی پروژه هایی در حوزه های مختلف از جمله پردازش زبان طبیعی و بینایی کامپیوتری کار کرده است.

هیروشی توکویو یک معمار راه حل در آزمایشگاه AWS Annapurna است. او که در ژاپن مستقر است، حتی قبل از خرید توسط AWS به آزمایشگاههای آناپورنا ملحق شد و به طور مداوم با فناوری آزمایشگاههای آناپورنا به مشتریان کمک کرده است. تمرکز اخیر او بر راهحلهای یادگیری ماشین مبتنی بر سیلیکون ساختهشده، AWS Inferentia و Trainium است.

هیروشی توکویو یک معمار راه حل در آزمایشگاه AWS Annapurna است. او که در ژاپن مستقر است، حتی قبل از خرید توسط AWS به آزمایشگاههای آناپورنا ملحق شد و به طور مداوم با فناوری آزمایشگاههای آناپورنا به مشتریان کمک کرده است. تمرکز اخیر او بر راهحلهای یادگیری ماشین مبتنی بر سیلیکون ساختهشده، AWS Inferentia و Trainium است.

داوال پاتل یک معمار اصلی یادگیری ماشین در AWS است. او با سازمانهایی از شرکتهای بزرگ گرفته تا استارتآپهای متوسط در زمینه مشکلات مربوط به محاسبات توزیعشده و هوش مصنوعی کار کرده است. او بر روی یادگیری عمیق از جمله دامنه های NLP و Computer Vision تمرکز دارد. او به مشتریان کمک می کند تا به استنباط مدل با عملکرد بالا در SageMaker دست یابند.

داوال پاتل یک معمار اصلی یادگیری ماشین در AWS است. او با سازمانهایی از شرکتهای بزرگ گرفته تا استارتآپهای متوسط در زمینه مشکلات مربوط به محاسبات توزیعشده و هوش مصنوعی کار کرده است. او بر روی یادگیری عمیق از جمله دامنه های NLP و Computer Vision تمرکز دارد. او به مشتریان کمک می کند تا به استنباط مدل با عملکرد بالا در SageMaker دست یابند.

چینگ لان مهندس توسعه نرم افزار در AWS است. او روی چندین محصول چالش برانگیز در آمازون کار کرده است، از جمله راه حل های استنتاج ML با کارایی بالا و سیستم ثبت گزارش با کارایی بالا. تیم Qing با موفقیت اولین مدل میلیارد پارامتر را در تبلیغات آمازون با تاخیر بسیار کم مورد نیاز راه اندازی کرد. Qing دانش عمیقی در مورد بهینه سازی زیرساخت و شتاب یادگیری عمیق دارد.

چینگ لان مهندس توسعه نرم افزار در AWS است. او روی چندین محصول چالش برانگیز در آمازون کار کرده است، از جمله راه حل های استنتاج ML با کارایی بالا و سیستم ثبت گزارش با کارایی بالا. تیم Qing با موفقیت اولین مدل میلیارد پارامتر را در تبلیغات آمازون با تاخیر بسیار کم مورد نیاز راه اندازی کرد. Qing دانش عمیقی در مورد بهینه سازی زیرساخت و شتاب یادگیری عمیق دارد.

کینگوی لی یک متخصص یادگیری ماشین در خدمات وب آمازون است. او دکترای خود را دریافت کرد. در تحقیقات عملیات پس از اینکه حساب کمک هزینه تحقیقاتی مشاورش را شکست و نتوانست جایزه نوبل را که وعده داده بود تحویل دهد. در حال حاضر او به مشتریان در صنعت خدمات مالی و بیمه کمک می کند تا راه حل های یادگیری ماشینی را در AWS بسازند. در اوقات فراغت به مطالعه و تدریس علاقه دارد.

کینگوی لی یک متخصص یادگیری ماشین در خدمات وب آمازون است. او دکترای خود را دریافت کرد. در تحقیقات عملیات پس از اینکه حساب کمک هزینه تحقیقاتی مشاورش را شکست و نتوانست جایزه نوبل را که وعده داده بود تحویل دهد. در حال حاضر او به مشتریان در صنعت خدمات مالی و بیمه کمک می کند تا راه حل های یادگیری ماشینی را در AWS بسازند. در اوقات فراغت به مطالعه و تدریس علاقه دارد.

آلن تان یک مدیر ارشد محصول با تلاش های SageMaker در استنتاج مدل های بزرگ است. او علاقه زیادی به استفاده از یادگیری ماشینی در حوزه تجزیه و تحلیل دارد. خارج از محل کار، او از فضای باز لذت می برد.

آلن تان یک مدیر ارشد محصول با تلاش های SageMaker در استنتاج مدل های بزرگ است. او علاقه زیادی به استفاده از یادگیری ماشینی در حوزه تجزیه و تحلیل دارد. خارج از محل کار، او از فضای باز لذت می برد.

وارون سیال یک مهندس توسعه نرمافزار با AWS Sagemaker است که روی ویژگیهای مهم مواجهه با مشتری برای پلتفرم ML Inference کار میکند. او مشتاق کار در سیستم های توزیع شده و فضای هوش مصنوعی است. در اوقات فراغت به مطالعه و باغبانی علاقه دارد.

وارون سیال یک مهندس توسعه نرمافزار با AWS Sagemaker است که روی ویژگیهای مهم مواجهه با مشتری برای پلتفرم ML Inference کار میکند. او مشتاق کار در سیستم های توزیع شده و فضای هوش مصنوعی است. در اوقات فراغت به مطالعه و باغبانی علاقه دارد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoAiStream. Web3 Data Intelligence دانش تقویت شده دسترسی به اینجا.

- ضرب کردن آینده با آدرین اشلی. دسترسی به اینجا.

- خرید و فروش سهام در شرکت های PRE-IPO با PREIPO®. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 10

- 100

- 12

- 13

- 14

- ٪۱۰۰

- 22

- 24

- 7

- 8

- 9

- a

- درباره ما

- شتاب دهنده

- شتاب دهنده ها

- قبول می کند

- دسترسی

- حساب

- رسیدن

- اکتساب

- در میان

- اعمال

- اضافه کردن

- اضافه

- نشانی

- آدرس پذیر

- مزیت - فایده - سود - منفعت

- تبلیغات

- پس از

- در برابر

- AI

- موارد استفاده ai

- AI / ML

- معرفی

- اجازه می دهد تا

- همچنین

- هر چند

- آمازون

- آمازون EC2

- آمازون SageMaker

- آمازون خدمات وب

- an

- علم تجزیه و تحلیل

- و

- اعلام

- دیگر

- هر

- رابط های برنامه کاربردی

- برنامه های کاربردی

- با استفاده از

- روش

- معماری

- هستند

- محدوده

- مصنوعی

- هوش مصنوعی

- هوش مصنوعی (AI)

- AS

- At

- سمعی

- خودکار

- بطور خودکار

- در دسترس

- AWS

- استنتاج AWS

- توپ

- پهنای باند

- سد

- مستقر

- BE

- زیرا

- بوده

- قبل از

- مزایای

- بهترین

- میان

- بزرگ

- بزرگتر

- میلیاردها

- مسدود کردن

- بلاگ

- شکوفه

- بطور خلاصه

- شکست

- ساختن

- ساخته

- ساخته شده در

- کسب و کار

- by

- ++C

- نام

- CAN

- موارد

- به چالش کشیدن

- chatbot

- بررسی

- چیپس

- رمز

- برنامه نویسی

- Collective - Dubai Hills Estate

- ترکیب

- ترکیب شده

- می آید

- ارتباط

- ارتباطات

- مقایسه

- سازگار

- کامل

- به طور کامل

- پیچیده

- پیچیدگی

- اجزاء

- جامع

- محاسبه

- محاسبه

- کامپیوتر

- چشم انداز کامپیوتر

- محاسبه

- پیکر بندی

- متصل

- ظرف

- ظروف

- شامل

- محتوا

- هسته

- هزینه

- مقرون به صرفه

- هزینه

- ایجاد

- ایجاد شده

- بحرانی

- بسیار سخت

- در حال حاضر

- مشتری

- مشتریان

- سفارشی

- داده ها

- اختصاصی

- عمیق

- یادگیری عمیق

- به طور پیش فرض

- مشخص

- تعریف می کند

- درجه

- تاخیر

- ارائه

- تحویل

- ارائه

- نشان

- بستگی دارد

- گسترش

- استقرار

- گسترش

- جزئیات

- کشف

- تعیین می کند

- توسعه

- پروژه

- دستگاه

- دستگاه ها

- مختلف

- انتشار

- مستقیما

- توزیع شده

- محاسبات توزیع شده

- سیستم های توزیع شده

- توزیع

- عمل

- حوزه

- آیا

- دانلود

- دانلود

- راننده

- پویا

- بطور پویا

- هر

- پیش از آن

- آسان تر

- آسان ترین

- به آسانی

- شرق

- موثر

- موثر

- تلاش

- را قادر می سازد

- پایان

- نقطه پایانی

- مهندس

- موتورهای حرفه ای

- کافی

- اطمینان حاصل شود

- وارد شدن

- شرکت

- ورود

- معادل

- ارزیابی

- حتی

- مثال

- برانگیخته

- گران

- اضافی

- چهره

- تسهیل می کند

- نما

- ناموفق

- سریعتر

- ویژگی

- امکانات

- پرونده

- مالی

- خدمات مالی

- پایان

- نام خانوادگی

- مناسب

- جریان

- جریانها

- تمرکز

- متمرکز شده است

- تمرکز

- پیروی

- برای

- فرم

- قالب

- چهار

- چارچوب

- چارچوب

- تقلب

- کشف تقلب

- از جانب

- کامل

- کاملا

- بعلاوه

- تولید می کند

- نسل

- مولد

- هوش مصنوعی مولد

- دریافت کنید

- Go

- اعطا کردن

- گروه ها

- در حال رشد

- سخت افزار

- آیا

- he

- سلامتی

- کمک

- کمک کرد

- کمک می کند

- اینجا کلیک نمایید

- زیاد

- عملکرد بالا

- بالاتر

- خود را

- برگزاری

- دارای

- میزبان

- میزبانی وب

- خدمات میزبانی

- خانه

- چگونه

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- قطب

- انسان

- if

- تصویر

- تصاویر

- پیاده سازی

- واردات

- in

- در عمق

- شامل

- شامل

- از جمله

- افزایش

- افزایش

- مستقل

- صنعت

- شالوده

- نوآوری

- ورودی

- ورودی

- نصب و راه اندازی

- نمونه

- بیمه

- یکپارچه

- اطلاعات

- اثر متقابل

- فعل و انفعالات

- میانجی

- به

- استناد کرد

- شامل

- IT

- ITS

- ژاپن

- کار

- پیوستن

- پیوست

- JPG

- json

- تنها

- دانستن

- دانش

- آزمایشگاه

- زبان

- بزرگ

- شرکت های بزرگ

- بزرگتر

- بزرگترین

- تاخیر

- راه اندازی

- راه اندازی

- برجسته

- یاد گرفتن

- یادگیری

- طول

- اجازه

- کتابخانه ها

- کتابخانه

- پسندیدن

- دوست دارد

- محدود شده

- فهرست

- LLM

- بار

- بارگیری

- بارهای

- ورود به سیستم

- کم

- کاهش

- پایین ترین

- دستگاه

- فراگیری ماشین

- عمدتا

- حفظ

- اکثریت

- ساخت

- مدیریت

- اداره می شود

- مدیر

- نقشه ها

- حداکثر

- بیشترین

- حافظه

- روش

- ML

- MLO ها

- مدل

- مدل

- ماژول ها

- بیش

- کارآمدتر

- اکثر

- چندگانه

- نام

- طبیعی

- پردازش زبان طبیعی

- لازم

- نیاز

- نیازهای

- جدید

- نیویورک

- بعد

- nlp

- جایزه نوبل

- دفتر یادداشت

- اکنون

- عدد

- هدف

- of

- ارائه

- پیشنهادات

- غالبا

- اوهایو

- on

- ONE

- فقط

- منبع باز

- عملیات

- بهینه سازی

- بهینه سازی

- بهینه

- بهینه سازی می کند

- گزینه

- گزینه

- or

- سازمان های

- دیگر

- ما

- خارج

- خارج از منزل

- تولید

- خارج از

- خود

- بسته

- نمونه

- موازی

- پارامتر

- پارامترهای

- عبور

- عبور می کند

- احساساتی

- کارایی

- شخصی

- سکو

- افلاطون

- هوش داده افلاطون

- PlatoData

- پلاگین

- پلاگین ها

- نقطه

- محبوب

- پست

- قدرت

- صفحه اصلی

- قوی

- تمرین

- دقت

- پیش بینی

- پیشگو

- مرجح

- اصلی

- جایزه

- مشکلات

- روند

- فرآیندهای

- در حال پردازش

- محصول

- مدیر تولید

- محصولات

- مشخصات

- پروژه ها

- وعده داده شده

- املاک

- ویژگی

- ارائه

- ارائه

- فراهم می کند

- ارائه

- هدف

- پــایتــون

- مارماهی

- اعم

- رسیدن به

- مطالعه

- اماده

- دنیای واقعی

- زمان واقعی

- اخذ شده

- اخیر

- به رسمیت شناختن

- اشاره

- مربوط

- درخواست

- درخواست

- ضروری

- نیاز

- مورد نیاز

- تحقیق

- محققان

- منابع

- پاسخ

- نتیجه

- طلوع

- دویدن

- حکیم ساز

- استنباط SageMaker

- همان

- ذخیره

- مقیاس گذاری

- سناریوها

- اسکریپت

- sdk

- یکپارچه

- ثانیه

- بخش

- دیدن

- ارشد

- دنباله

- خدمت

- سرویس

- خدمات

- خدمت

- تنظیم

- تنظیمات

- برپایی

- چند

- تغییر

- باید

- نشان

- نمایش داده شده

- نشان داده شده

- نشان می دهد

- طرف

- به طور قابل توجهی

- سیلیکون

- مشابه

- ساده

- تنها

- شش

- اندازه

- اندازه

- So

- نرم افزار

- توسعه نرم افزار

- راه حل

- مزایا

- فضا

- متخصص

- تخصصی

- سخنرانی - گفتار

- تشخیص گفتار

- پایدار

- پشته

- پشته

- شروع

- آغاز شده

- شروع می شود

- نوپا

- ذخیره سازی

- داستان

- ذخیره سازی

- ساده

- سبک

- موفقیت

- چنین

- پشتیبانی

- پشتیبانی

- پشتیبانی از

- سیستم

- سیستم های

- مصرف

- تعلیم

- تیم

- تکنیک

- پیشرفته

- جریان تنسور

- تست

- نسبت به

- که

- La

- محوطه

- شان

- آنها

- آنجا.

- اینها

- این

- سه

- از طریق

- توان

- زمان

- بار

- به

- هم

- ابزار

- ردیابی

- آموزش دیده

- آموزش

- ترانسفورماتور

- دور زدن

- دو

- نوع

- نوعی

- آپلود شده

- us

- استفاده کنید

- استفاده

- با استفاده از

- معمولا

- استفاده کنید

- با استفاده از

- ارزش

- تنوع

- مختلف

- وسیع

- بسیار

- از طريق

- تصویری

- ویرجینیا

- دید

- صبر کنيد

- خرید

- مسیر..

- we

- وب

- خدمات وب

- وزن

- چی

- چه زمانی

- که

- اراده

- با

- در داخل

- بدون

- شاهد

- کلمه

- مهاجرت کاری

- مشغول به کار

- کارگر

- با این نسخهها کار

- جهان

- نوشتن

- نوشته

- نیویورک

- شما

- شما

- زفیرنت