چشم انداز هوش مصنوعی با ظهور مدل های تولیدی که قادر به ترکیب داده های با کیفیت بالا مانند متن، تصاویر، موسیقی و فیلم هستند، تغییر شکل می دهد. دوره دموکراتیزه سازی هوش مصنوعی به محبوبیت بیشتر هوش مصنوعی مولد به دنبال نسخه های منبع باز برای خانواده های مدل بنیادی مانند BERT، T5، GPT، CLIP و اخیرا، کمک کرد. انتشار پایدار. صدها نرم افزار به عنوان یک سرویس (SaaS) حول این مدل های از پیش آموزش دیده در حال توسعه هستند که یا مستقیماً به مشتریان نهایی ارائه می شوند، یا ابتدا بر اساس هر مشتری تنظیم می شوند تا محتوای شخصی و منحصر به فرد تولید شود (مانند آواتارها، ویرایشهای تلطیفشده عکس، داراییهای بازی ویدیویی، متن خاص دامنه، و موارد دیگر). با سرعت نوآوری فناوری و گسترش موارد استفاده جدید برای هوش مصنوعی مولد، ارائهدهندگان و استارتآپهای SaaS بومی هوش مصنوعی در بخش B2C باید از روز اول خود را برای مقیاس آماده کنند و با کاهش عملیاتی، زمان ورود به بازار خود را کوتاه کنند. سربار تا حد امکان

در این پست، نیازمندیهای فنی و ملاحظات طراحی اپلیکیشن برای تنظیم دقیق و ارائه مدلهای هوش مصنوعی فوقشخصیشده در مقیاس در AWS را بررسی میکنیم. ما یک معماری مبتنی بر مدیریت کامل پیشنهاد می کنیم آمازون SageMaker آموزش و ارائه ویژگی هایی که ارائه دهندگان SaaS را قادر می سازد تا برنامه های خود را سریعتر توسعه دهند، کیفیت خدمات را ارائه دهند و مقرون به صرفه بودن را افزایش دهند.

دامنه راه حل و الزامات

بیایید ابتدا محدوده برنامه های کاربردی AI SaaS مولد شخصی سازی شده را تعریف کنیم:

در مرحله بعد، بیایید الزامات فنی و گردش کار برنامهای را که از تنظیم دقیق و ارائه هزاران مدل شخصیشده بالقوه پشتیبانی میکند، مرور کنیم. گردش کار به طور کلی از دو بخش تشکیل شده است:

- با تنظیم دقیق مدل پایه از پیش آموزش دیده، یک مدل شخصی سازی شده ایجاد کنید

- میزبانی مدل شخصیشده برای درخواستهای استنتاج درخواستی هنگام بازگشت کاربر

یکی از ملاحظات بخش اول گردش کار این است که باید برای ترافیک غیرقابل پیشبینی و تند کاربر آماده باشیم. اوج استفاده ممکن است، بهعنوان مثال، به دلیل عرضههای مدل پایه جدید یا عرضههای جدید ویژگی SaaS ایجاد شود. این نیاز به ظرفیت GPU متناوب بزرگ و همچنین نیاز به راه اندازی کارهای تنظیم دقیق ناهمزمان برای جذب افزایش ترافیک را تحمیل می کند.

با توجه به میزبانی مدل، با پر شدن بازار از برنامههای SaaS مبتنی بر هوش مصنوعی، سرعت سرویس به یک عامل متمایز تبدیل میشود. تجربه کاربری سریع و روان ممکن است به دلیل شروع سرد زیرساخت یا تأخیر استنتاج بالا مختل شود. اگرچه الزامات تأخیر استنتاج به مورد استفاده و انتظارات کاربر بستگی دارد، به طور کلی این در نظر گرفتن منجر به ترجیح میزبانی مدل بلادرنگ در GPUها می شود (برخلاف گزینه های میزبانی فقط CPU). با این حال، میزبانی مدل GPU در زمان واقعی می تواند به سرعت منجر به هزینه های عملیاتی بالایی شود. بنابراین، برای ما حیاتی است که یک استراتژی میزبانی تعریف کنیم که از افزایش خطی هزینه ها با تعداد مدل های مستقر (کاربران فعال) جلوگیری کند.

معماری راه حل

قبل از اینکه معماری پیشنهادی را توضیح دهیم، بیایید با بررسی برخی از ویژگیهای آن بحث کنیم که چرا SageMaker برای نیازهای برنامه ما مناسب است.

اول، آموزش SageMaker و میزبانی APIها مزیت بهره وری مشاغل آموزشی کاملاً مدیریت شده و استقرار مدل را فراهم می کنند، به طوری که تیم های سریع می توانند زمان بیشتری را بر روی ویژگی ها و تمایز محصول متمرکز کنند. علاوه بر این، پارادایم راهاندازی و فراموش کردن مشاغل آموزش SageMaker کاملاً با ماهیت گذرا کارهای تنظیم دقیق مدل همزمان در مرحله ورود کاربر مطابقت دارد. در بخش بعدی در مورد ملاحظات بیشتر در مورد همزمانی بحث خواهیم کرد.

دوم، SageMaker از گزینه های میزبانی منحصر به فرد مجهز به GPU برای استقرار مدل های یادگیری عمیق در مقیاس پشتیبانی می کند. به عنوان مثال، NVIDIA Triton Inference Server، یک نرم افزار استنتاج منبع باز با کارایی بالا، در سال 2022 به صورت بومی در اکوسیستم SageMaker ادغام شد. به دنبال آن پشتیبانی GPU برای نقاط پایانی چند مدل SageMaker ارائه شد که مقیاس پذیر و کم را ارائه می دهد. -تاخیر و روشی مقرون به صرفه برای استقرار هزاران مدل یادگیری عمیق در پشت یک نقطه پایانی واحد.

در نهایت، وقتی به سطح زیرساخت پایین میرویم، این ویژگیها توسط بهترین گزینههای محاسباتی در کلاس پشتیبانی میشوند. به عنوان مثال، نوع نمونه G5، که مجهز به پردازندههای گرافیکی NVIDIA A10g (محصول به AWS) است، نسبت قیمت به عملکرد قوی را هم برای آموزش مدل و هم برای میزبانی ارائه میکند. کمترین هزینه را به ازای هر FP32 FLOP (معیار مهم میزان توان محاسباتی شما به ازای هر دلار) در پالت نمونه GPU در AWS به همراه دارد و نسبت به نوع نمونه قبلی (G4dn) با کمترین هزینه قبلی، بسیار بهبود مییابد. برای اطلاعات بیشتر مراجعه کنید با استفاده از نمونههای آمازون EC2 G5 برای مدلهای NLP و CV PyTorch، چهار برابر توان استنتاج ML بالاتر با سه برابر هزینه کمتر در هر استنتاج به دست آورید..

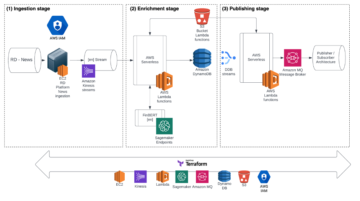

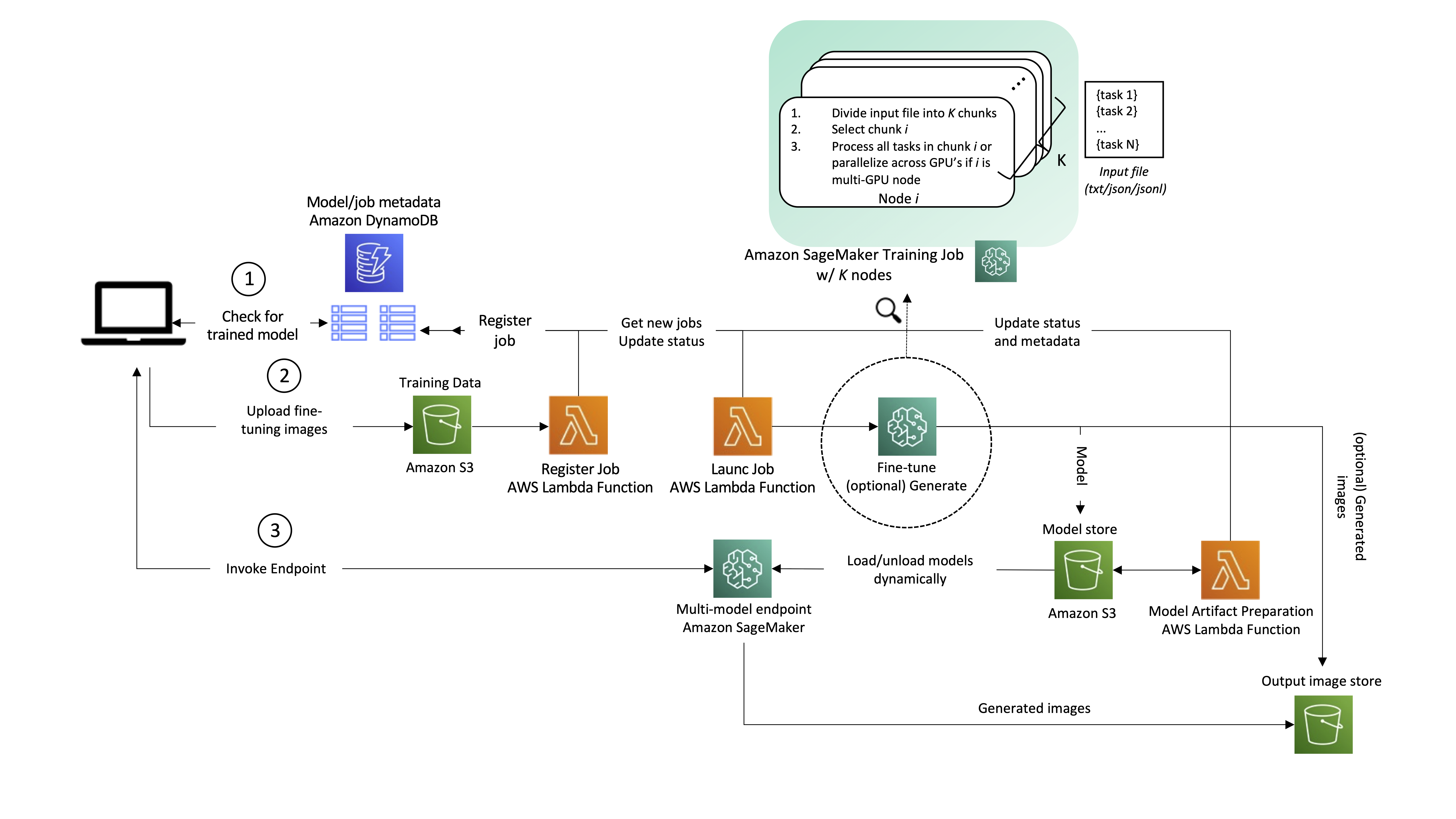

اگرچه معماری زیر به طور کلی برای موارد مختلف استفاده از هوش مصنوعی مولد اعمال می شود، اجازه دهید از تولید متن به تصویر به عنوان مثال استفاده کنیم. در این سناریو، یک برنامه تولید تصویر یک یا چند مدل سفارشی و با تنظیم دقیق برای هر یک از کاربران خود ایجاد میکند و آن مدلها برای تولید تصویر در زمان واقعی در صورت تقاضای کاربر نهایی در دسترس خواهند بود. همانطور که از معماری مشخص است، گردش کار راه حل را می توان به دو فاز عمده تقسیم کرد. مرحله اول (A) مربوط به فرآیند ورود کاربر است - این زمانی است که یک مدل برای کاربر جدید تنظیم می شود. در فاز دوم (B)، مدل دقیق تنظیم شده برای استنتاج درخواستی استفاده می شود.

بیایید مراحل معماری را با جزئیات بیشتر، همانطور که در نمودار شماره گذاری شده است، مرور کنیم.

1. بررسی وضعیت مدل

هنگامی که کاربر با سرویس تعامل می کند، ابتدا بررسی می کنیم که آیا کاربر بازگشتی است که قبلاً به سرویس وارد شده است و مدل های شخصی سازی شده برای ارائه خدمات را دارد یا خیر. یک کاربر ممکن است بیش از یک مدل شخصی سازی شده داشته باشد. نقشه بین کاربر و مدل های مربوطه در آن ذخیره می شود آمازون DynamoDB، که به عنوان یک فروشگاه ابرداده کاملاً مدیریت شده، بدون سرور و غیرمرتبط عمل می کند که به راحتی قابل جستجو، ارزان و مقیاس پذیر است. حداقل، توصیه می کنیم دو جدول داشته باشید:

- یکی برای ذخیره نقشه بین کاربران و مدل ها. این شامل شناسه کاربری و مصنوع مدل است سرویس ذخیره سازی ساده آمازون (Amazon S3) URI.

- دیگری برای خدمت به عنوان یک صف، ذخیره درخواست های ایجاد مدل و وضعیت تکمیل آنها. این شامل شناسه کاربری، شناسه شغلی آموزش مدل، و وضعیت، همراه با فراپارامترها و ابرداده های مرتبط با آموزش است.

2. نصب کاربر و تنظیم دقیق مدل.

اگر قبلاً هیچ مدلی برای کاربر تنظیم نشده باشد، برنامه تصاویر با تنظیم دقیق را در آمازون S3 آپلود می کند و باعث ایجاد یک AWS لامبدا تابعی برای ثبت یک کار جدید در جدول DynamoDB.

یکی دیگر از تابع های Lambda جدول را برای یک کار جدید جستجو می کند و آن را با SageMaker Training راه اندازی می کند. با استفاده از هر رکورد می توان آن را فعال کرد آمازون DynamoDB Streams، یا بر اساس یک برنامه با استفاده از پل رویداد آمازون (الگویی که توسط مشتریان AWS آزمایش و آزمایش شده است، از جمله داخلی در آمازون). به صورت اختیاری، تصاویر یا درخواستها را میتوان برای استنتاج ارسال کرد و بلافاصله پس از آموزش مدل، مستقیماً در کار آموزش SageMaker پردازش کرد. این می تواند به کوتاه کردن زمان تحویل اولین تصاویر به برنامه کمک کند. همانطور که تصاویر تولید می شوند، می توانید از آن سوء استفاده کنید مکانیسم همگام سازی ایست بازرسی در SageMaker برای آپلود نتایج میانی در Amazon S3. در مورد همزمانی راه اندازی کار، SageMaker CreateTrainingJob API از نرخ درخواست یک در ثانیه پشتیبانی می کند، با نرخ های انفجاری بزرگتر در دوره های پر ترافیک. اگر به طور پایدار نیاز به راه اندازی بیش از یک کار تنظیم دقیق در ثانیه (TPS) دارید، کنترل ها و گزینه های زیر را دارید:

- استفاده کنید SageMaker مدیریت استخرهای گرم، که به شما امکان می دهد پس از اتمام یک کار آموزشی، زیرساخت های تدارک دیده شده را حفظ کرده و مجدداً استفاده کنید تا تأخیر شروع سرد را برای بارهای کاری تکراری کاهش دهید.

- تلاشهای مجدد را در تابع Lambda کار راهاندازی خود اجرا کنید (نشان داده شده در نمودار معماری).

- در نهایت، اگر نرخ درخواست تنظیم دقیق به طور مداوم بالای 1 TPS باشد، میتوانید N تنظیم دقیق را به موازات یک کار SageMaker Training با درخواست کار با

num_instances=K، و گسترش کار در موارد مختلف. نمونه ای از نحوه دستیابی به این هدف این است که لیستی از کارها را برای اجرا به عنوان فایل ورودی به کار آموزشی ارسال کنید و هر نمونه یک کار یا تکه متفاوتی از این فایل را پردازش می کند که توسط شناسه عددی نمونه متمایز می شود (موجود در resourceconfig.json). به خاطر داشته باشید که وظایف فردی نباید تفاوت زیادی در مدت زمان تمرین داشته باشند، تا از موقعیتی که در آن یک کار واحد کل کلاستر را برای مدت طولانیتر از زمان مورد نیاز نگه میدارد، جلوگیری شود.

در نهایت، مدل تنظیمشده ذخیره میشود و یک تابع Lambda را راهاندازی میکند که مصنوع را برای ارائه در نقطه پایانی چند مدل SageMaker آماده میکند. در این مرحله می توان به کاربر اطلاع داد که آموزش کامل شده و مدل آماده استفاده است. رجوع شود به مدیریت درخواستهای باطن و اعلانهای ظاهری در برنامههای وب بدون سرور برای بهترین شیوه در این مورد.

3. سرویس دهی درخواستی کاربران

اگر یک مدل قبلاً برای کاربر تنظیم شده باشد، مسیر بسیار سادهتر است. برنامه، نقطه پایانی چند مدلی را فراخوانی می کند، بار بار و شناسه مدل کاربر را ارسال می کند. مدل انتخاب شده به صورت پویا از آمازون S3 بر روی دیسک نمونه پایانی و حافظه GPU بارگذاری می شود (اگر اخیراً استفاده نشده است؛ برای اطلاعات بیشتر، به نحوه عملکرد نقاط پایانی چند مدل) و برای استنتاج استفاده می شود. خروجی مدل (محتوای شخصی) در نهایت به برنامه بازگردانده می شود.

ورودی و خروجی درخواست باید برای مرجع آینده کاربر در S3 ذخیره شود. برای جلوگیری از تأثیر تأخیر درخواست (زمان اندازه گیری شده از لحظه ای که کاربر درخواست می دهد تا زمانی که پاسخ برگردانده شود)، می توانید این آپلود را مستقیماً از برنامه مشتری یا به طور متناوب در کد استنتاج نقطه پایانی خود انجام دهید.

این معماری ناهمزمانی و همزمانی را که بخشی از الزامات راه حل بود، فراهم می کند.

نتیجه

در این پست، ملاحظاتی را برای تنظیم دقیق و ارائه مدلهای هوش مصنوعی فوقشخصیشده در مقیاس بررسی کردیم و یک راهحل انعطافپذیر و مقرونبهصرفه در AWS با استفاده از SageMaker پیشنهاد کردیم.

ما مورد استفاده از پیش آموزش مدل بزرگ را پوشش ندادیم. برای اطلاعات بیشتر مراجعه کنید آموزش توزیع شده در آمازون SageMaker و موازی سازی داده های خرد شدهو همچنین داستان هایی در مورد اینکه چگونه مشتریان AWS مدل های عظیمی را در SageMaker آموزش داده اند، مانند AI21 و هوش مصنوعی پایداری.

درباره نویسنده

ژائو مورا یک معمار راه حل های تخصصی AI/ML در AWS، مستقر در اسپانیا است. او در آموزش مدلهای یادگیری عمیق و بهینهسازی استنتاج و ساختن پلتفرمهای ML در مقیاس بزرگ در AWS به مشتریان کمک میکند. او همچنین یکی از حامیان فعال سخت افزارهای تخصصی ML و راه حل های ML با کد پایین است.

ژائو مورا یک معمار راه حل های تخصصی AI/ML در AWS، مستقر در اسپانیا است. او در آموزش مدلهای یادگیری عمیق و بهینهسازی استنتاج و ساختن پلتفرمهای ML در مقیاس بزرگ در AWS به مشتریان کمک میکند. او همچنین یکی از حامیان فعال سخت افزارهای تخصصی ML و راه حل های ML با کد پایین است.

دکتر الکساندر آرژانوف یک معمار راه حل های تخصصی AI/ML است که در فرانکفورت آلمان مستقر است. او به مشتریان AWS کمک می کند تا راه حل های ML خود را در سراسر منطقه EMEA طراحی و اجرا کنند. قبل از پیوستن به AWS، الکساندر در حال تحقیق در مورد منشأ عناصر سنگین در جهان ما بود و پس از استفاده از آن در محاسبات علمی بزرگ خود، علاقه زیادی به ML پیدا کرد.

دکتر الکساندر آرژانوف یک معمار راه حل های تخصصی AI/ML است که در فرانکفورت آلمان مستقر است. او به مشتریان AWS کمک می کند تا راه حل های ML خود را در سراسر منطقه EMEA طراحی و اجرا کنند. قبل از پیوستن به AWS، الکساندر در حال تحقیق در مورد منشأ عناصر سنگین در جهان ما بود و پس از استفاده از آن در محاسبات علمی بزرگ خود، علاقه زیادی به ML پیدا کرد.

اولیویه کروشانت یک معمار راه حل های متخصص یادگیری ماشین در AWS، مستقر در فرانسه است. اولیویه به مشتریان AWS - از استارتآپهای کوچک گرفته تا شرکتهای بزرگ - کمک میکند تا برنامههای یادگیری ماشینی درجه تولید را توسعه داده و به کار گیرند. در اوقات فراغت خود از خواندن مقالات تحقیقاتی و کاوش در بیابان با دوستان و خانواده لذت می برد.

اولیویه کروشانت یک معمار راه حل های متخصص یادگیری ماشین در AWS، مستقر در فرانسه است. اولیویه به مشتریان AWS - از استارتآپهای کوچک گرفته تا شرکتهای بزرگ - کمک میکند تا برنامههای یادگیری ماشینی درجه تولید را توسعه داده و به کار گیرند. در اوقات فراغت خود از خواندن مقالات تحقیقاتی و کاوش در بیابان با دوستان و خانواده لذت می برد.

هایکو هاتز یک معمار ارشد راه حل برای هوش مصنوعی و یادگیری ماشین با تمرکز ویژه بر پردازش زبان طبیعی (NLP)، مدلهای زبان بزرگ (LLM) و هوش مصنوعی مولد است. قبل از این سمت، او رئیس بخش علوم داده برای خدمات مشتریان اتحادیه اروپا آمازون بود. Heiko به مشتریان ما کمک میکند تا در سفر AI/ML خود در AWS موفق باشند و با سازمانهایی در بسیاری از صنایع، از جمله بیمه، خدمات مالی، رسانه و سرگرمی، مراقبتهای بهداشتی، آب و برق، و تولید کار کرده است. هایکو در اوقات فراغت خود تا حد امکان به مسافرت می رود.

هایکو هاتز یک معمار ارشد راه حل برای هوش مصنوعی و یادگیری ماشین با تمرکز ویژه بر پردازش زبان طبیعی (NLP)، مدلهای زبان بزرگ (LLM) و هوش مصنوعی مولد است. قبل از این سمت، او رئیس بخش علوم داده برای خدمات مشتریان اتحادیه اروپا آمازون بود. Heiko به مشتریان ما کمک میکند تا در سفر AI/ML خود در AWS موفق باشند و با سازمانهایی در بسیاری از صنایع، از جمله بیمه، خدمات مالی، رسانه و سرگرمی، مراقبتهای بهداشتی، آب و برق، و تولید کار کرده است. هایکو در اوقات فراغت خود تا حد امکان به مسافرت می رود.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/architect-personalized-generative-ai-saas-applications-on-amazon-sagemaker/

- :است

- $UP

- 1

- 100

- 2022

- 7

- a

- درباره ما

- بالاتر

- رسیدن

- در میان

- فعال

- پس از

- AI

- هوش مصنوعی و یادگیری ماشین

- موارد استفاده ai

- AI / ML

- الکساندر

- قبلا

- هر چند

- آمازون

- آمازون EC2

- آمازون SageMaker

- و

- رابط های برنامه کاربردی

- نرم افزار

- کاربرد

- برنامه های کاربردی

- معماری

- هستند

- دور و بر

- AS

- دارایی

- مرتبط است

- ناهمزمان

- At

- در دسترس

- آواتار ها

- AWS

- B2C

- به عقب

- حمایت کرد

- بخش مدیریت

- پایه

- مستقر

- اساس

- BE

- شود

- قبل از

- پشت سر

- بودن

- سود

- بهترین

- بهترین شیوه

- میان

- گسترده

- بنا

- by

- محاسبات

- CAN

- توانا

- ظرفیت

- مورد

- موارد

- بررسی

- مشتری

- خوشه

- رمز

- کامل

- اتمام

- محاسبه

- رقیب

- توجه

- ملاحظات

- محتوا

- گروه شاهد

- متناظر

- مطابقت دارد

- هزینه

- مقرون به صرفه

- هزینه

- میتوانست

- دوره

- پوشش

- ایجاد

- ایجاد

- سفارشی

- مشتری

- خدمات مشتری

- مشتریان

- داده ها

- علم اطلاعات

- روز

- عمیق

- یادگیری عمیق

- ارائه

- تقاضا

- گسترش

- مستقر

- استقرار

- اعزام ها

- توصیف

- طرح

- جزئیات

- توسعه

- توسعه

- متفاوت است

- مختلف

- متفاوت است

- تفکیک

- مستقیما

- بحث و تبادل نظر

- تقسیم شده

- دلار

- پایین

- در طی

- بطور پویا

- هر

- اکوسیستم

- هر دو

- عناصر

- EMEA

- را قادر می سازد

- نقطه پایانی

- شرکت

- سرگرمی

- مجهز بودن

- EU

- مثال

- انتظارات

- تجربه

- بهره برداری

- بررسی

- خانواده

- خانواده

- سریع در حال حرکت

- سریعتر

- ویژگی

- امکانات

- پرونده

- سرانجام

- مالی

- خدمات مالی

- نام خانوادگی

- مناسب

- قابل انعطاف

- تمرکز

- به دنبال

- پیروی

- برای

- یافت

- پایه

- فرانسه

- تازه

- دوستان

- از جانب

- ظاهر

- کاملا

- تابع

- بیشتر

- آینده

- بازی

- سوالات عمومی

- عموما

- تولید می کنند

- تولید

- نسل

- مولد

- هوش مصنوعی مولد

- آلمان

- دریافت کنید

- Go

- GPU

- GPU ها

- بزرگ

- تا حد زیادی

- در حال رشد

- سخت افزار

- آیا

- داشتن

- سر

- بهداشت و درمان

- سنگین

- کمک

- کمک کرد

- کمک می کند

- زیاد

- عملکرد بالا

- با کیفیت بالا

- بالاتر

- میزبانی وب

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- صدها نفر

- ID

- شناسه

- تصویر

- تصاویر

- مهم

- تحمیل

- in

- شامل

- از جمله

- افزایش

- فرد

- لوازم

- اطلاعات

- شالوده

- ابداع

- ورودی

- نمونه

- بیمه

- یکپارچه

- در ارتباط بودن

- داخلی

- فراخوانی میکند

- IT

- ITS

- کار

- شغل ها

- پیوستن

- سفر

- نگاه داشتن

- چشم انداز

- زبان

- بزرگ

- در مقیاس بزرگ

- بزرگتر

- تاخیر

- راه اندازی

- راه اندازی

- رهبری

- منجر می شود

- یادگیری

- سطح

- سبک وزن

- فهرست

- دیگر

- به دنبال

- دستگاه

- فراگیری ماشین

- عمده

- باعث می شود

- اداره می شود

- تولید

- بسیاری

- نقشه برداری

- بازار

- عظیم

- اندازه

- رسانه ها

- حافظه

- متاداده

- قدرت

- ذهن

- حد اقل

- ML

- مدل

- مدل

- لحظه

- بیش

- علاوه بر این

- اکثر

- نقطه پایانی چند مدل

- چندگانه

- موسیقی

- طبیعی

- پردازش زبان طبیعی

- طبیعت

- نیاز

- نیازهای

- جدید

- بعد

- nlp

- اطلاعیه ها

- رمان

- عدد

- شماره گذاری شده

- کارت گرافیک Nvidia

- of

- پیشنهادات

- زیتون

- on

- بر روی تقاضا

- شبانه روزی

- ONE

- منبع باز

- قابل استفاده

- مخالف

- بهینه سازی

- گزینه

- سازمان های

- تولید

- سرعت

- اوراق

- نمونه

- موازی

- بخش

- بخش

- گذشت

- عبور

- احساساتی

- مسیر

- الگو

- دوره ها

- شخصی

- شخصی

- فاز

- سیستم عامل

- افلاطون

- هوش داده افلاطون

- PlatoData

- نقطه

- ممکن

- پست

- بالقوه

- قدرت

- شیوه های

- آماده

- آماده شده

- آماده می کند

- جلوگیری از

- قبلی

- قبلا

- قبلا

- فرآوری شده

- فرآیندهای

- در حال پردازش

- محصول

- بهره وری

- طرفدار

- پیشنهادات

- پیشنهاد شده

- ارائه

- ارائه دهندگان

- فراهم می کند

- مارماهی

- کیفیت

- به سرعت

- نرخ

- نرخ

- نسبت

- مطالعه

- اماده

- زمان واقعی

- تازه

- توصیه

- رکورد

- كاهش دادن

- کاهش

- با توجه

- منطقه

- ثبت نام

- منتشر شده

- تکراری

- درخواست

- درخواست

- مورد نیاز

- تحقیق

- پاسخ

- نتایج

- نگه داشتن

- عودت

- این فایل نقد می نویسید:

- طلوع

- نقش

- دویدن

- در حال اجرا

- SAAS

- حکیم ساز

- مقیاس پذیر

- مقیاس

- سناریو

- برنامه

- علم

- علمی

- حوزه

- دوم

- بخش

- بخش

- انتخاب شد

- ارشد

- خدمت

- بدون سرور

- خدمت

- سرویس

- خدمات

- خدمت

- باید

- نشان داده شده

- ساده

- تنها

- وضعیت

- کوچک

- So

- نرم افزار

- نرم افزار به عنوان یک سرویس

- راه حل

- مزایا

- برخی از

- اسپانیا

- ویژه

- متخصص

- سرعت

- سنبله

- گسترش

- شروع

- شروع می شود

- نوپا

- وضعیت

- مراحل

- ذخیره سازی

- opbevare

- داستان

- استراتژی

- قوی

- موفق

- چنین

- پشتیبانی

- پشتیبانی از

- جدول

- کار

- وظایف

- تیم ها

- فنی

- فنی

- که

- La

- شان

- از این رو

- اینها

- هزاران نفر

- سه

- از طریق

- توان

- زمان

- بار

- به

- نسبت به

- thps

- ترافیک

- آموزش دیده

- آموزش

- سفر

- باعث شد

- راه اندازی

- تریتون

- منحصر به فرد

- جهان

- غیرقابل پیش بینی

- نزدیک

- us

- استفاده

- استفاده کنید

- مورد استفاده

- کاربر

- سابقه کاربر

- کاربران

- آب و برق

- مختلف

- از طريق

- تصویری

- بازی های ویدئویی

- فیلم های

- حیاتی

- راه می رفت

- گرم

- مسیر..

- وب

- خوب

- که

- تمام

- اراده

- با

- در داخل

- مهاجرت کاری

- مشغول به کار

- بازده

- شما

- شما

- یوتیوب

- زفیرنت