آمازون SageMaker یک سرویس کاملاً مدیریت شده است که توسعه دهندگان و دانشمندان داده را قادر می سازد تا به سرعت و بدون زحمت مدل های یادگیری ماشین (ML) را در هر مقیاسی بسازند، آموزش دهند و به کار گیرند. SageMaker استقرار مدلها را مستقیماً از طریق تماسهای API به سرویس به تولید آسان میکند. مدل ها برای استقرار قوی و مقیاس پذیر در ظروف بسته بندی می شوند. اگرچه نقاط ورودی مختلفی مانند SageMaker Python SDK، AWS SDK، کنسول SageMaker و Amazon SageMaker Studio نوتبوکها برای سادهسازی فرآیند آموزش و استقرار مدلهای ML در مقیاس، مشتریان همچنان به دنبال راههای بهتری برای استقرار مدلهای خود برای آزمایش زمین بازی و بهینهسازی استقرار تولید هستند.

ما در حال راه اندازی دو راه جدید برای ساده سازی فرآیند بسته بندی و استقرار مدل ها با استفاده از SageMaker هستیم.

در این پست SageMaker Python SDK جدید را معرفی می کنیم ModelBuilder تجربه، که هدف آن به حداقل رساندن منحنی یادگیری برای کاربران جدید SageMaker مانند دانشمندان داده است، در حالی که به مهندسان باتجربه MLOps کمک می کند تا استفاده از خدمات میزبانی SageMaker را به حداکثر برسانند. این پیچیدگی راه اندازی و استقرار اولیه را کاهش می دهد و با ارائه راهنمایی در مورد بهترین شیوه ها برای استفاده از قابلیت های کامل SageMaker. ما اطلاعات دقیق و نمونه های GitHub را برای این قابلیت جدید SageMaker ارائه می دهیم.

راه اندازی جدید دیگر استفاده از تجربه استقرار تعاملی جدید در SageMaker Studio است. ما در این مورد در قسمت 2 بحث می کنیم.

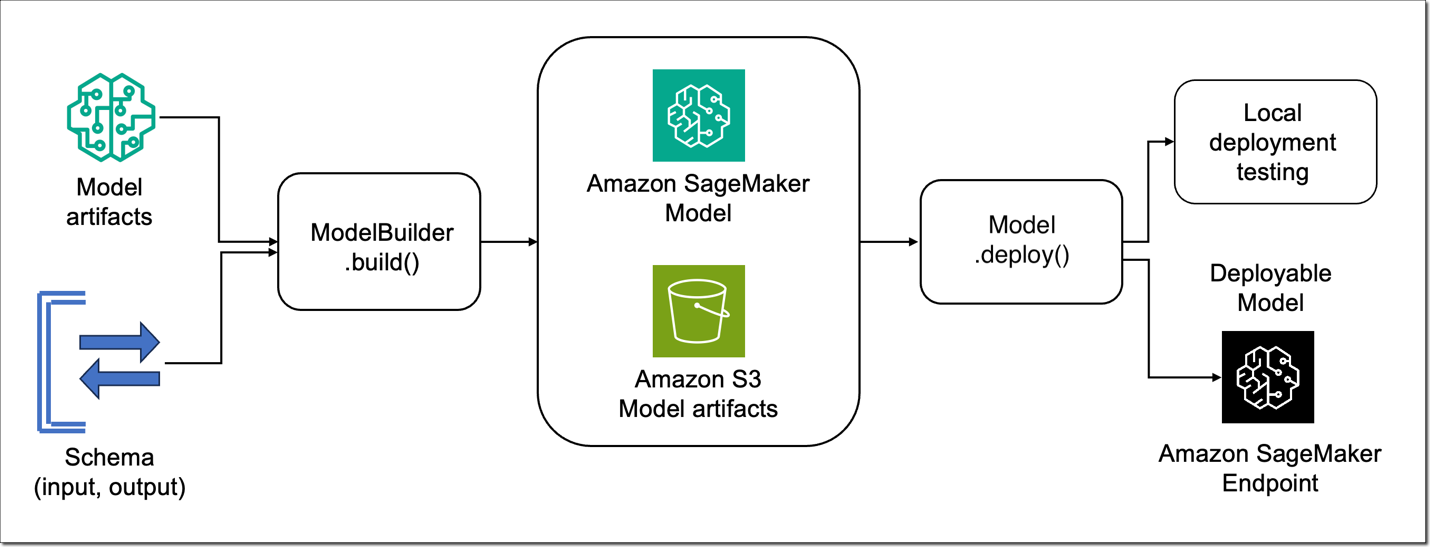

استقرار مدلها در یک نقطه پایانی SageMaker مستلزم یک سری مراحل برای آماده کردن مدل برای میزبانی در یک نقطه پایانی SageMaker است. این شامل گرفتن مصنوعات مدل در قالب و ساختار صحیح، ایجاد کد استنتاج، و مشخص کردن جزئیات ضروری مانند URL تصویر مدل، سرویس ذخیره سازی ساده آمازون (Amazon S3) مکان یابی مصنوعات مدل، مراحل سریال سازی و سریال سازی و ضروری است هویت AWS و مدیریت دسترسی نقش های (IAM) برای تسهیل مجوزهای دسترسی مناسب. به دنبال این، یک پیکربندی نقطه پایانی نیاز به تعیین نوع استنتاج و پیکربندی پارامترهای مربوطه مانند انواع نمونه، تعداد و توزیع ترافیک بین انواع مدل دارد.

برای کمک بیشتر به مشتریان خود در هنگام استفاده از هاست SageMaker، ما جدید را معرفی کردیم ModelBuilder کلاس در SageMaker Python SDK، که مزایای کلیدی زیر را هنگام استقرار مدلها در نقاط پایانی SageMaker به ارمغان میآورد:

- تجربه استقرار را در بین چارچوب ها یکسان می کند - تجربه جدید یک گردش کار ثابت برای استقرار مدلهای ساخته شده با استفاده از چارچوبهای مختلف مانند PyTorch، TensorFlow و XGBoost فراهم میکند. این روند استقرار را ساده می کند.

- استقرار مدل را خودکار می کند - کارهایی مانند انتخاب کانتینرهای مناسب، گرفتن وابستگی ها، و مدیریت سریال/آسیبی سازی خودکار هستند و تلاش دستی مورد نیاز برای استقرار را کاهش می دهند.

- انتقال آرام از محلی به نقطه پایانی میزبان SageMaker را فراهم می کند – با حداقل تغییرات کد، مدل ها را می توان به راحتی از آزمایش محلی به استقرار در نقطه پایانی SageMaker انتقال داد. لاگ های زنده اشکال زدایی را یکپارچه می کنند.

به طور کلی، SageMaker ModelBuilder فرآیند بستهبندی مدل را برای استنتاج SageMaker با مدیریت جزئیات سطح پایین ساده و ساده میکند و ابزارهایی برای آزمایش، اعتبارسنجی و بهینهسازی نقاط پایانی فراهم میکند. این کار بهره وری توسعه دهندگان را بهبود می بخشد و خطاها را کاهش می دهد.

در بخشهای بعدی، به جزئیات این ویژگی جدید میپردازیم. ما همچنین در مورد نحوه استقرار مدل ها در میزبانی SageMaker با استفاده از آن صحبت می کنیم ModelBuilder، که فرآیند را ساده می کند. سپس چند نمونه را برای چارچوبهای مختلف به شما معرفی میکنیم تا هم مدلهای سنتی ML و هم مدلهای پایهای را که از موارد استفاده از هوش مصنوعی مولد نیرو میدهند، استفاده کنید.

آشنایی با SageMaker ModelBuilder

جدید ModelBuilder یک کلاس پایتون است که بر روی گرفتن مدلهای ML ساخته شده با استفاده از چارچوبهایی مانند XGBoost یا PyTorch تمرکز دارد و آنها را به مدلهایی تبدیل میکند که برای استقرار در SageMaker آماده هستند. ModelBuilder فراهم می کند build() تابع، که مصنوعات را مطابق با سرور مدل تولید می کند، و a deploy() عملکردی برای استقرار به صورت محلی یا در یک نقطه پایانی SageMaker. معرفی این ویژگی ادغام مدل ها با محیط SageMaker را ساده می کند و آنها را برای عملکرد و مقیاس پذیری بهینه می کند. نمودار زیر نشان می دهد که چگونه ModelBuilder در سطح بالا کار می کند

کلاس ModelBuilder

La مدل ساز کلاس گزینه های مختلفی را برای سفارشی سازی ارائه می دهد. با این حال، برای استقرار مدل چارچوب، سازنده مدل فقط از مدل، ورودی، خروجی و نقش انتظار دارد:

SchemaBuilder

La SchemaBuilder کلاس شما را قادر می سازد تا ورودی و خروجی را برای نقطه پایانی خود تعریف کنید. این به سازنده طرحواره اجازه میدهد تا توابع مارشالسازی متناظر را برای سریالسازی و جداسازی ورودی و خروجی تولید کند. فایل کلاس زیر تمام گزینه های سفارشی سازی را ارائه می دهد:

با این حال، در بیشتر موارد، فقط ورودی و خروجی نمونه کار می کند. مثلا:

با ارائه نمونه ورودی و خروجی، SchemaBuilder می تواند به طور خودکار تحولات لازم را تعیین کند و روند ادغام را ساده تر کند. برای موارد استفاده پیشرفتهتر، انعطافپذیری برای ارائه توابع ترجمه سفارشی برای ورودی و خروجی وجود دارد که تضمین میکند ساختارهای داده پیچیدهتر نیز میتوانند به طور کارآمد مدیریت شوند. ما این را در بخشهای بعدی با استفاده از مدلهای مختلف با فریمورکهای مختلف نشان میدهیم ModelBuilder.

تجربه حالت محلی

در این مثال از ModelBuilder برای استقرار مدل XGBoost به صورت محلی. می توانید از Mode برای جابجایی بین تست محلی و استقرار به نقطه پایانی SageMaker استفاده کنید. ما ابتدا مدل XGBoost (به صورت محلی یا در SageMaker) را آموزش می دهیم و مصنوعات مدل را در دایرکتوری کاری ذخیره می کنیم:

سپس یک شی ModelBuilder با پاس دادن شی مدل واقعی یعنی the ایجاد می کنیم SchemaBuilder که از نمونه اشیاء ورودی و خروجی تست (همان ورودی و خروجی که هنگام آموزش و آزمایش مدل استفاده کردیم) برای استنباط سریال سازی مورد نیاز استفاده می کند. توجه داشته باشید که استفاده می کنیم Mode.LOCAL_CONTAINER برای تعیین استقرار محلی پس از آن، ما به ساختن عملکردی برای شناسایی خودکار تصویر ظرف فریمورک پشتیبانی شده و همچنین اسکن وابستگی ها. کد زیر را ببینید:

در نهایت، ما می توانیم تماس بگیرید deploy عملکرد در شی مدل، که همچنین گزارش زنده را برای اشکال زدایی آسان تر فراهم می کند. شما نیازی به تعیین نوع یا تعداد نمونه ندارید زیرا مدل به صورت محلی مستقر می شود. اگر این پارامترها را ارائه دهید، نادیده گرفته می شوند. این تابع شی پیش بینی را که می توانیم برای پیش بینی با داده های تست استفاده کنیم، برمی گرداند:

به صورت اختیاری، می توانید بارگذاری مدل و پیش پردازش و پس پردازش را نیز با استفاده از کنترل کنید InferenceSpec. جزئیات بیشتر را در ادامه این پست ارائه می دهیم. استفاده كردن LOCAL_CONTAINER یک راه عالی برای آزمایش اسکریپت خود به صورت محلی قبل از استقرار در نقطه پایانی SageMaker است.

به model-builder-xgboost.ipynb نمونه ای برای آزمایش استقرار هم به صورت محلی و هم در نقطه پایانی SageMaker با استفاده از ModelBuilder.

استقرار مدلهای سنتی در نقاط پایانی SageMaker

در مثال های زیر نحوه استفاده را نشان می دهیم ModelBuilder برای استقرار مدل های سنتی ML.

مدل های XGBoost

مشابه بخش قبل، می توانید یک مدل XGBoost را با تغییر mode پارامتر هنگام ایجاد ModelBuilder هدف - شی:

توجه داشته باشید که هنگام استقرار در نقاط پایانی SageMaker، باید نوع نمونه و تعداد نمونه را هنگام فراخوانی مشخص کنید. deploy تابع.

به model-builder-xgboost.ipynb مثال برای استقرار یک مدل XGBoost.

مدل های تریتون

شما می توانید ModelBuilder برای ارائه مدل های PyTorch در سرور استنتاج تریتون. برای آن، شما باید مشخص کنید model_server پارامتر به عنوان ModelServer.TRITON، یک مدل پاس کنید و یک SchemaBuilder شی، که به ورودی و خروجی نمونه از مدل نیاز دارد. ModelBuilder بقیه کارها را برای شما انجام خواهد داد.

به مراجعه model-builder-triton.ipynb برای استقرار یک مدل با تریتون.

مدل های صورت در آغوش گرفته

در این مثال، ما به شما نشان می دهیم که چگونه یک مدل ترانسفورماتور از پیش آموزش دیده ارائه شده توسط Hugging Face را برای SageMaker پیاده سازی کنید. ما می خواهیم از چهره در آغوش گرفته استفاده کنیم pipeline برای بارگذاری مدل، بنابراین ما یک مشخصات استنتاج سفارشی برای آن ایجاد می کنیم ModelBuilder:

همچنین ورودی و خروجی حجم کار استنتاج را با تعریف کردن تعریف می کنیم SchemaBuilder شی بر اساس ورودی و خروجی مدل:

سپس ما ایجاد می کنیم ModelBuilder شیء کنید و مدل را در نقطه پایانی SageMaker با همان منطقی که در مثال دیگر نشان داده شده است، مستقر کنید:

به مراجعه model-builder-huggingface.ipynb برای استقرار مدل خط لوله Hugging Face.

استقرار مدل های پایه در نقاط پایانی SageMaker

در مثال های زیر نحوه استفاده را نشان می دهیم ModelBuilder برای استقرار مدل های پایه درست مانند مدل هایی که قبلا ذکر شد، تنها چیزی که مورد نیاز است شناسه مدل است.

هاب صورت در آغوش

اگر می خواهید یک مدل پایه از هاب صورت در آغوش، تنها کاری که باید انجام دهید این است که شناسه مدل از پیش آموزش دیده را ارسال کنید. به عنوان مثال، قطعه کد زیر را مستقر می کند متا لاما/Llama-2-7b-hf مدل محلی می توانید حالت را به Mode.SAGEMAKER_ENDPOINT برای استقرار در نقاط پایانی SageMaker.

برای مدلهای دروازهدار در Hugging Face Hub، باید از طریق Hugging Face Hub درخواست دسترسی کنید و از کلید مرتبط با عبور آن به عنوان متغیر محیطی استفاده کنید. HUGGING_FACE_HUB_TOKEN. برخی از مدلهای «Huging Face» ممکن است نیاز به کد راه دور مطمئن داشته باشند. می توان آن را به عنوان یک متغیر محیطی و همچنین با استفاده از آن تنظیم کرد HF_TRUST_REMOTE_CODE. به صورت پیش فرض، ModelBuilder از استنباط نسل متن در آغوش گرفتن صورت استفاده خواهد کرد (TGI) ظرف به عنوان ظرف زیرین مدل های صورت در آغوش گرفته. اگر می خواهید از استنتاج مدل بزرگ AWS استفاده کنید (LMI) ظروف، می توانید راه اندازی کنید model_server پارامتر به عنوان ModelServer.DJL_SERVING هنگامی که شما پیکربندی کنید ModelBuilder هدف - شی.

یک ویژگی منظم از ModelBuilder توانایی اجرای تنظیم محلی پارامترهای کانتینر هنگام استفاده است LOCAL_CONTAINER حالت این قابلیت با اجرای ساده قابل استفاده است tuned_model = model.tune().

به مراجعه دمو-مدل-ساز-huggingface-llama2.ipynb برای استقرار یک مدل Hugging Face Hub.

SageMaker JumpStart

Amazon SageMaker JumpStart همچنین تعدادی مدل فونداسیون از قبل آموزش دیده را ارائه می دهد. درست مانند فرآیند استقرار یک مدل از Hugging Face Hub، شناسه مدل مورد نیاز است. استقرار یک مدل SageMaker JumpStart در یک نقطه پایانی SageMaker به اندازه اجرای کد زیر ساده است:

برای همه شناسه های مدل SageMaker JumpStart موجود، به مراجعه کنید الگوریتم های داخلی با جدول مدل از پیش آموزش دیده. رجوع شود به model-builder-jumpstart-falcon.ipynb برای استقرار یک مدل SageMaker JumpStart.

جزء استنتاج

ModelBulder به شما اجازه می دهد تا از قابلیت جدید مؤلفه استنتاج در SageMaker برای استقرار مدل ها استفاده کنید. برای اطلاعات بیشتر در مورد اجزای استنتاج، رجوع کنید به با استفاده از آخرین ویژگی های SageMaker، هزینه های استقرار مدل را تا 50 درصد به طور متوسط کاهش دهید. می توانید از اجزای استنتاج برای استقرار با استفاده کنید ModelBuilder با مشخص کردن endpoint_type=EndpointType.INFERENCE_COMPONENT_BASED در deploy() روش. شما همچنین می توانید استفاده کنید tune() روشی که تعداد بهینه شتاب دهنده ها را دریافت می کند و در صورت نیاز آن را اصلاح می کند.

به مراجعه model-builder-inference-component.ipynb برای استقرار یک مدل به عنوان یک جزء استنتاج.

کلاس ModelBuilder را سفارشی کنید

La ModelBuilder class به شما امکان می دهد بارگذاری مدل را با استفاده از آن سفارشی کنید InferenceSpec.

علاوه بر این، میتوانید سریالسازی بار و پاسخ و سریالزدایی را کنترل کنید و پیشپردازش و پسپردازش را با استفاده از CustomPayloadTranslator. علاوه بر این، هنگامی که نیاز دارید کانتینرهای از پیش ساخته شده ما را برای استقرار مدل در SageMaker گسترش دهید، می توانید از ModelBuilder برای رسیدگی به فرآیند بسته بندی مدل در این بخش، جزئیات بیشتری از این قابلیت ها ارائه می کنیم.

InferenceSpec

InferenceSpec یک لایه اضافی از سفارشی سازی را ارائه می دهد. این به شما امکان می دهد نحوه بارگذاری مدل و نحوه رسیدگی به درخواست های استنتاج ورودی را تعریف کنید. از طریق InferenceSpec، می توانید رویه های بارگذاری سفارشی را برای مدل های خود تعریف کنید و مکانیسم های بارگذاری پیش فرض را دور بزنید. این انعطاف پذیری به ویژه هنگام کار با مدل های غیر استاندارد یا خطوط لوله استنتاج سفارشی مفید است. روش فراخوانی را می توان سفارشی کرد و به شما این امکان را می دهد که نحوه پردازش درخواست های دریافتی (پیش پردازش و پس پردازش) توسط مدل را تنظیم کنید. این سفارشیسازی میتواند برای اطمینان از همسویی فرآیند استنتاج با نیازهای خاص مدل ضروری باشد. کد زیر را ببینید:

کد زیر نمونه ای از استفاده از این کلاس را نشان می دهد:

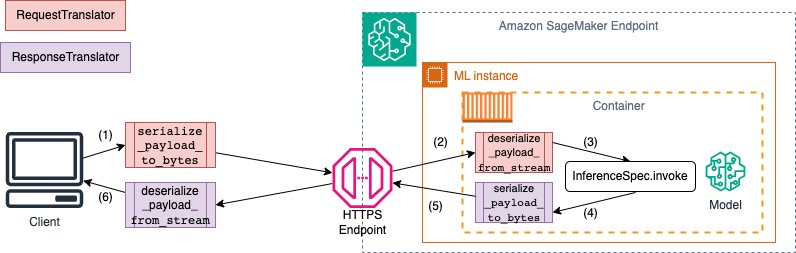

CustomPayload Translator

هنگام فراخوانی نقاط پایانی SageMaker، داده ها از طریق بارهای HTTP با انواع مختلف MIME ارسال می شوند. برای مثال، تصویری که برای استنتاج به نقطه پایانی ارسال میشود باید در سمت مشتری به بایت تبدیل شود و از طریق بار HTTP به نقطه پایانی ارسال شود. هنگامی که نقطه پایانی بار بار را دریافت می کند، باید رشته بایت را به نوع داده ای که توسط مدل مورد انتظار است (همچنین به عنوان شناخته شده deserialization سمت سرور). پس از اتمام پیشبینی مدل، نتایج باید به بایتهایی سریال شوند که میتوانند از طریق بار HTTP به کاربر یا مشتری ارسال شوند. وقتی مشتری دادههای بایت پاسخ را دریافت میکند، برای تبدیل دادههای بایت به فرمت دادههای مورد انتظار، مانند JSON، باید سریالسازی سمت مشتری را انجام دهد. حداقل، شما باید داده ها را برای موارد زیر تبدیل کنید (همانطور که در نمودار زیر شماره گذاری شده است):

- سریالسازی درخواست استنتاج (که توسط مشتری انجام میشود)

- جداسازی درخواست استنتاج (که توسط سرور یا الگوریتم مدیریت می شود)

- فراخوانی مدل در برابر بار

- ارسال بار پاسخ به عقب

- سریال سازی پاسخ استنتاج (که توسط سرور یا الگوریتم مدیریت می شود)

- غیراصولی سازی پاسخ استنتاج (با مدیریت مشتری)

نمودار زیر روند سریال سازی و سریال زدایی را در طی فرآیند فراخوانی نشان می دهد.

در قطعه کد زیر، نمونه ای از آن را نشان می دهیم CustomPayloadTranslator هنگامی که به سفارشی سازی اضافی برای رسیدگی به سریال سازی و سریال زدایی به ترتیب در سمت مشتری و سرور نیاز است:

در demo-model-builder-pytorch.ipynb نوت بوک، ما نشان می دهیم که چگونه می توان به راحتی یک مدل PyTorch را با استفاده از یک نقطه پایانی SageMaker مستقر کرد ModelBuilder با CustomPayloadTranslator و InferenceSpec کلاس.

مدل مرحله برای استقرار

اگر می خواهید مدل را برای استنتاج یا در رجیستری مدل مرحله بندی کنید، می توانید استفاده کنید model.create() or model.register(). مدل فعال شده روی سرویس ایجاد میشود و بعداً میتوانید آن را مستقر کنید. کد زیر را ببینید:

از ظروف سفارشی استفاده کنید

SageMaker فراهم می کند تصاویر Docker از پیش ساخته شده برای الگوریتم های داخلی و چارچوب های یادگیری عمیق پشتیبانی شده که برای آموزش و استنتاج استفاده می شود. اگر کانتینر SageMaker از پیش ساخته شده همه نیازهای شما را برآورده نمی کند، می توانید تصویر موجود را گسترش دهید تا نیازهای شما را برآورده کند. با گسترش یک تصویر از پیش ساخته شده، میتوانید از کتابخانهها و تنظیمات یادگیری عمیق بدون نیاز به ایجاد تصویر از ابتدا استفاده کنید. برای جزئیات بیشتر در مورد نحوه گسترش کانتینرهای از پیش ساخته شده، به سند SageMaker مراجعه کنید. ModelBuilder از موارد استفاده در هنگام آوردن کانتینرهای خود که از ظروف Docker از پیش ساخته شده ما ساخته شده اند پشتیبانی می کند.

برای استفاده از تصویر ظرف خود در این مورد، باید فیلدها را تنظیم کنید image_uri و model_server هنگام تعریف ModelBuilder:

اینجا image_uri تصویر ظرف ARN خواهد بود که در حساب شما ذخیره می شود رجیستری ظروف الاستیک آمازون مخزن (Amazon ECR). یک مثال به صورت زیر نشان داده شده است:

هنگامی که image_uri تنظیم شده است، در طول ModelBuilder فرآیند ساخت، از تشخیص خودکار تصویر با ارائه URI تصویر صرفنظر می کند. اگر model_server در ModelBuilder تنظیم نشده است، یک پیام خطای اعتبارسنجی دریافت خواهید کرد، به عنوان مثال:

تا زمان انتشار این پست، ModelBuilder از آوردن ظروف خود که از ما گسترش یافته اند پشتیبانی می کند تصاویر کانتینر DLC از پیش ساخته شده یا ظروف ساخته شده با سرورهای مدل مانند کتابخانه عمیق جاوا (DJL), استنتاج تولید متن (TGI), TorchServeو سرور استنتاج تریتون.

وابستگی های سفارشی

هنگام دویدن ModelBuilder.build()، به طور پیش فرض به طور خودکار محیط پایتون شما را در a می گیرد requirements.txt فایل و همان وابستگی را در کانتینر نصب می کند. با این حال، گاهی اوقات محیط پایتون محلی شما با محیط موجود در کانتینر در تضاد است. ModelBuilder راه ساده ای را برای شما فراهم می کند تا وابستگی های ضبط شده را اصلاح کنید تا این گونه تعارضات وابستگی را برطرف کنید و به شما امکان می دهد پیکربندی های سفارشی خود را در ModelBuilder. توجه داشته باشید که این فقط برای TorchServe و Triton با است InferenceSpec. برای مثال، میتوانید وابستگیهای پارامتر ورودی را که یک فرهنگ لغت پایتون است، در ModelBuilder به صورت زیر مشخص کنید:

فیلدهای زیر را تعریف می کنیم:

- خودکار - آیا سعی کنید به طور خودکار وابستگی های موجود در محیط خود را ضبط کنید.

- مقررات - رشته ای از مسیری که به سمت خودتان می رود

requirements.txtفایل. (این اختیاری است.) - سفارشی – فهرستی از هر وابستگی سفارشی دیگری که میخواهید اضافه یا تغییر دهید. (این اختیاری است.)

اگر همان ماژول در چندین مکان مشخص شده باشد، custom پس از آن بالاترین اولویت را خواهد داشت requirementsو auto کمترین اولویت را خواهد داشت به عنوان مثال، بیایید بگوییم که در حین تشخیص خودکار، ModelBuilder تشخیص می دهد numpy==1.25و requirements.txt فایل ارائه شده است که مشخص می کند numpy>=1.24,<1.26. علاوه بر این، یک وابستگی سفارشی وجود دارد: custom = ["numpy==1.26.1"]. در این مورد، numpy==1.26.1 زمانی انتخاب می شود که وابستگی ها را در کانتینر نصب کنیم.

پاک کردن

وقتی آزمایش مدلها را تمام کردید، به عنوان بهترین روش، نقطه پایانی را حذف کنید تا در صورت عدم نیاز به نقطه پایانی در هزینهها صرفهجویی کنید. می توانید دنبال کنید پاک کردن بخش در هر یک از نوت بوک های آزمایشی یا از کد زیر برای حذف مدل و نقطه پایانی ایجاد شده توسط دمو استفاده کنید:

نتیجه

قابلیت جدید SageMaker ModelBuilder فرآیند استقرار مدل های ML را برای تولید در SageMaker ساده می کند. با مدیریت بسیاری از جزئیات پیچیده در پشت صحنه، ModelBuilder منحنی یادگیری را برای کاربران جدید کاهش می دهد و استفاده را برای کاربران با تجربه به حداکثر می رساند. تنها با چند خط کد، میتوانید مدلهایی با چارچوبهای داخلی مانند XGBoost، PyTorch، Triton، و Hugging Face و همچنین مدلهای ارائهشده توسط SageMaker JumpStart را در نقاط پایانی قوی و مقیاسپذیر در SageMaker مستقر کنید.

ما همه کاربران SageMaker را تشویق می کنیم تا با مراجعه به این قابلیت جدید را امتحان کنند مدل ساز صفحه مستندات ModelBuilder در حال حاضر برای همه کاربران SageMaker بدون هزینه اضافی در دسترس است. از این گردش کار ساده استفاده کنید تا مدلهای خود را سریعتر اجرا کنید. ما مشتاقانه منتظریم تا بشنویم که ModelBuilder چگونه چرخه عمر توسعه مدل شما را تسریع می کند!

تشکر ویژه از سیریشا اوپادیایالا، ریموند لیو، گری وانگ، داوال پاتل، دیپاک گارگ و رام وگیراجو.

درباره نویسندگان

ملانی لیدکترا، یک متخصص ارشد AI/ML TAM در AWS مستقر در سیدنی، استرالیا است. او به مشتریان سازمانی کمک می کند تا راه حل هایی را با استفاده از ابزارهای پیشرفته AI/ML در AWS بسازند و راهنمایی هایی را در مورد معماری و اجرای راه حل های ML با بهترین شیوه ها ارائه می دهد. او در اوقات فراغت خود عاشق کشف طبیعت و گذراندن وقت با خانواده و دوستان است.

ملانی لیدکترا، یک متخصص ارشد AI/ML TAM در AWS مستقر در سیدنی، استرالیا است. او به مشتریان سازمانی کمک می کند تا راه حل هایی را با استفاده از ابزارهای پیشرفته AI/ML در AWS بسازند و راهنمایی هایی را در مورد معماری و اجرای راه حل های ML با بهترین شیوه ها ارائه می دهد. او در اوقات فراغت خود عاشق کشف طبیعت و گذراندن وقت با خانواده و دوستان است.

مارک کارپ یک معمار ML با تیم Amazon SageMaker Service است. او بر کمک به مشتریان در طراحی، استقرار و مدیریت حجم کاری ML در مقیاس تمرکز دارد. او در اوقات فراغت خود از سفر و کاوش در مکان های جدید لذت می برد.

مارک کارپ یک معمار ML با تیم Amazon SageMaker Service است. او بر کمک به مشتریان در طراحی، استقرار و مدیریت حجم کاری ML در مقیاس تمرکز دارد. او در اوقات فراغت خود از سفر و کاوش در مکان های جدید لذت می برد.

سام ادواردز، یک مهندس ابر (AI/ML) در AWS Sydney متخصص در یادگیری ماشین و Amazon SageMaker است. او مشتاق کمک به مشتریان در حل مسائل مربوط به گردش کار یادگیری ماشین و ایجاد راه حل های جدید برای آنها است. در خارج از محل کار، او از ورزش راکت و مسافرت لذت می برد.

سام ادواردز، یک مهندس ابر (AI/ML) در AWS Sydney متخصص در یادگیری ماشین و Amazon SageMaker است. او مشتاق کمک به مشتریان در حل مسائل مربوط به گردش کار یادگیری ماشین و ایجاد راه حل های جدید برای آنها است. در خارج از محل کار، او از ورزش راکت و مسافرت لذت می برد.

راغو رامشا یک معمار ارشد راه حل های ML با تیم خدمات آمازون SageMaker است. او بر کمک به مشتریان در ساخت، استقرار و انتقال بارهای کاری تولید ML به SageMaker در مقیاس متمرکز است. او در زمینه های یادگیری ماشین، هوش مصنوعی و بینایی کامپیوتر تخصص دارد و دارای مدرک کارشناسی ارشد در علوم کامپیوتر از UT Dallas است. در اوقات فراغت از مسافرت و عکاسی لذت می برد.

راغو رامشا یک معمار ارشد راه حل های ML با تیم خدمات آمازون SageMaker است. او بر کمک به مشتریان در ساخت، استقرار و انتقال بارهای کاری تولید ML به SageMaker در مقیاس متمرکز است. او در زمینه های یادگیری ماشین، هوش مصنوعی و بینایی کامپیوتر تخصص دارد و دارای مدرک کارشناسی ارشد در علوم کامپیوتر از UT Dallas است. در اوقات فراغت از مسافرت و عکاسی لذت می برد.

شیوا رااج کوتینی به عنوان مدیر محصول اصلی در مجموعه محصولات استنباط آمازون SageMaker کار می کند. او برای استنتاج بر روی استقرار مدل، تنظیم عملکرد و بهینه سازی در SageMaker تمرکز می کند.

شیوا رااج کوتینی به عنوان مدیر محصول اصلی در مجموعه محصولات استنباط آمازون SageMaker کار می کند. او برای استنتاج بر روی استقرار مدل، تنظیم عملکرد و بهینه سازی در SageMaker تمرکز می کند.

موهان گاندی مهندس نرم افزار ارشد در AWS است. او در 10 سال گذشته با AWS کار کرده و روی سرویس های مختلف AWS مانند EMR، EFA و RDS کار کرده است. در حال حاضر، او بر روی بهبود تجربه استنتاج SageMaker متمرکز شده است. در اوقات فراغت خود از پیاده روی و ماراتن لذت می برد.

موهان گاندی مهندس نرم افزار ارشد در AWS است. او در 10 سال گذشته با AWS کار کرده و روی سرویس های مختلف AWS مانند EMR، EFA و RDS کار کرده است. در حال حاضر، او بر روی بهبود تجربه استنتاج SageMaker متمرکز شده است. در اوقات فراغت خود از پیاده روی و ماراتن لذت می برد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/package-and-deploy-classical-ml-and-llms-easily-with-amazon-sagemaker-part-1-pysdk-improvements/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 1

- 10

- 100

- 11

- 114

- 12

- 125

- 13

- 14

- ٪۱۰۰

- 16

- 17

- 20

- 24

- ٪۱۰۰

- 7

- 8

- 9

- a

- الفبا

- توانایی

- درباره ما

- تسریع می شود

- شتاب دهنده ها

- دسترسی

- تطبیق

- مطابق

- در میان

- واقعی

- اضافه کردن

- اضافه

- اضافی

- علاوه بر این

- پیشرفته

- مزیت - فایده - سود - منفعت

- پس از

- در برابر

- AI

- موارد استفاده ai

- AI / ML

- اهداف

- الگوریتم

- الگوریتم

- تراز می کند

- معرفی

- اجازه دادن

- اجازه می دهد تا

- همچنین

- هر چند

- آمازون

- آمازون SageMaker

- آمازون خدمات وب

- در میان

- an

- و

- هر

- API

- مناسب

- هستند

- AS

- مرتبط است

- At

- استرالیا

- خودکار

- خودکار

- بطور خودکار

- در دسترس

- میانگین

- AWS

- به عقب

- مستقر

- BE

- زیرا

- بوده

- قبل از

- پشت سر

- پشت صحنه

- مفید

- مزایای

- بهترین

- بهترین شیوه

- بهتر

- میان

- هر دو

- آوردن

- به ارمغان می آورد

- ساختن

- سازنده

- ساخته

- ساخته شده در

- by

- صدا

- فراخوانی

- تماس ها

- CAN

- قابلیت های

- قابلیت

- گرفتن

- اسیر

- جلب

- ضبط

- اهميت دادن

- مورد

- موارد

- تغییر دادن

- تبادل

- متغیر

- بار

- انتخاب

- کلاس

- مشتری

- ابر

- رمز

- توضیح

- پیچیده

- پیچیدگی

- جزء

- اجزاء

- کامپیوتر

- علم کامپیوتر

- چشم انداز کامپیوتر

- پیکر بندی

- پیکربندی

- تضاد

- درگیری

- استوار

- کنسول

- ظرف

- ظروف

- کنترل

- تبدیل

- مبدل

- تبدیل

- اصلاح

- متناظر

- هزینه

- ایجاد

- ایجاد شده

- ایجاد

- در حال حاضر

- منحنی

- سفارشی

- مشتریان

- سفارشی سازی

- سفارشی

- سفارشی

- دالاس

- داده ها

- عمیق

- شیرجه عمیق

- یادگیری عمیق

- دیپاک

- به طور پیش فرض

- تعريف كردن

- تعریف می کند

- تعریف کردن

- درجه

- نسخه ی نمایشی

- نشان دادن

- وابستگی

- وابستگی

- گسترش

- مستقر

- استقرار

- گسترش

- اعزام ها

- مستقر می کند

- طرح

- دقیق

- جزئیات

- کشف

- مشخص کردن

- تعیین

- توسعه دهنده

- توسعه دهندگان

- پروژه

- مختلف

- مستقیما

- بحث و تبادل نظر

- توزیع

- شیرجه رفتن

- do

- کارگر بارانداز

- سند

- مستندات

- نمی کند

- حوزه

- انجام شده

- آیا

- در طی

- هر

- پیش از آن

- آسان تر

- به آسانی

- موثر

- تلاش

- زحمت

- فعال

- را قادر می سازد

- تشویق

- نقطه پایانی

- مهندس

- مورد تأیید

- اطمینان حاصل شود

- حصول اطمینان از

- سرمایه گذاری

- ورود

- محیط

- خطا

- خطاهای

- ضروری است

- مثال

- مثال ها

- موجود

- انتظار می رود

- انتظار می رود

- تجربه

- با تجربه

- اکتشاف

- بررسی

- گسترش

- گسترش

- چهره

- تسهیل کردن

- خانواده

- سریعتر

- ویژگی

- کمی از

- زمینه

- پرونده

- نام خانوادگی

- رفع

- انعطاف پذیری

- متمرکز شده است

- تمرکز

- به دنبال

- پیروی

- به دنبال آن است

- برای

- قالب

- به جلو

- پایه

- چارچوب

- چارچوب

- رایگان

- دوستان

- از جانب

- تکمیل کنید

- کامل

- کاملا

- تابع

- توابع

- بیشتر

- غرق کردن

- گری

- گری وانگ

- دردار

- تولید می کنند

- تولید می کند

- نسل

- مولد

- هوش مصنوعی مولد

- دریافت کنید

- گرفتن

- GitHub

- رفتن

- بزرگ

- راهنمایی

- دسته

- اداره

- اتفاق می افتد

- آیا

- داشتن

- he

- شنوایی

- کمک

- کمک

- کمک می کند

- او

- در سطح بالا

- بالاترین

- خود را

- دارای

- میزبانی

- میزبانی وب

- خدمات میزبانی

- چگونه

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- قطب

- ID

- شناسایی

- هویت

- شناسه

- if

- تصویر

- اجرای

- واردات

- ارتقاء

- را بهبود می بخشد

- بهبود

- in

- مشمول

- وارد شونده

- اطلاعات

- اول

- ورودی

- ورودی

- نصب

- نمونه

- ادغام

- تعاملی

- به

- معرفی

- معرفی

- معرفی

- استناد کرد

- مسائل

- IT

- ITS

- جاوه

- JPG

- json

- تنها

- کلید

- دانستن

- شناخته شده

- بزرگ

- نام

- بعد

- آخرین

- راه اندازی

- راه اندازی

- لایه

- یادگیری

- کتابخانه ها

- کتابخانه

- پسندیدن

- خطوط

- فهرست

- زنده

- پشم لاما

- بار

- بارگیری

- محلی

- به صورت محلی

- محل

- ورود به سیستم

- منطق

- دیگر

- نگاه کنيد

- به دنبال

- دوست دارد

- پایین ترین

- دستگاه

- فراگیری ماشین

- ساخت

- باعث می شود

- ساخت

- مدیریت

- اداره می شود

- مدیر

- کتابچه راهنمای

- بسیاری

- کارشناسی ارشد

- بیشینه ساختن

- به حداکثر می رسد

- ممکن است..

- مکانیسم

- حافظه

- ذکر شده

- پیام

- روش

- مهاجرت

- حداقل

- حد اقل

- ML

- MLO ها

- حالت

- مدل

- مدل

- تغییر

- ماژول ها

- بیش

- اکثر

- چندگانه

- باید

- طبیعت

- لازم

- نیاز

- ضروری

- نیازهای

- جدید

- کاربران جدید

- نه

- هیچ

- توجه داشته باشید

- دفتر یادداشت

- اکنون

- عدد

- شماره گذاری شده

- هدف

- اشیاء

- of

- پیشنهادات

- on

- ONE

- فقط

- به سوی

- بهینه

- بهینه سازی

- بهینه سازی

- بهینه سازی

- گزینه

- or

- دیگر

- ما

- خارج

- تولید

- خروجی

- خارج از

- خود

- بسته

- بسته بندی

- بسته بندی

- با ما

- پارامتر

- پارامترهای

- بخش

- ویژه

- عبور

- عبور

- احساساتی

- مسیر

- انجام

- کارایی

- مجوز

- شخصی

- دکترا

- عکاسی

- برگزیده

- خط لوله

- اماکن

- افلاطون

- هوش داده افلاطون

- PlatoData

- زمین بازی

- بازی

- نقطه

- مقام

- پست

- قدرت

- تمرین

- شیوه های

- پیش بینی

- پیش گویی

- پیشگو

- قبلی

- اصلی

- اولویت

- روش

- روند

- فرآیندهای

- محصول

- مدیر تولید

- تولید

- بهره وری

- ارائه

- ارائه

- فراهم می کند

- ارائه

- انتشار

- تحت فشار قرار دادند

- پــایتــون

- مارماهی

- به سرعت

- رم

- اماده

- گرفتن

- دریافت

- را کاهش می دهد

- کاهش

- مراجعه

- رجیستری

- مربوط

- دور

- مخزن

- درخواست

- درخواست

- نیاز

- ضروری

- مورد نیاز

- نیاز

- قابل احترام

- به ترتیب

- پاسخ

- REST

- نتایج

- برگشت

- تنومند

- نقش

- نقش

- دویدن

- در حال اجرا

- حکیم ساز

- استنباط SageMaker

- همان

- ذخیره

- نگهداری می شود

- گفتن

- مقیاس پذیری

- مقیاس پذیر

- مقیاس

- اسکن

- صحنه های

- علم

- دانشمندان

- خراش

- خط

- sdk

- sdks

- بدون درز

- بخش

- بخش

- دیدن

- را انتخاب کنید

- انتخاب

- خود

- ارشد

- فرستاده

- سلسله

- خدمت

- سرور

- سرور

- سرویس

- خدمات

- تنظیم

- تنظیمات

- برپایی

- او

- نشان

- نمایشگاه

- نشان داده شده

- نشان می دهد

- طرف

- ساده

- ساده شده

- ساده می کند

- ساده کردن

- به سادگی

- هموار کردن

- قطعه

- So

- نرم افزار

- مهندس نرمافزار

- مزایا

- حل

- برخی از

- گاهی

- متخصص

- تخصصی

- تخصص دارد

- خاص

- مشخص شده

- خرج کردن

- ورزش ها

- صحنه

- وضعیت هنر

- مراحل

- هنوز

- ذخیره سازی

- opbevare

- ذخیره شده

- ساده

- جریان

- ساده سازی

- رشته

- ساختار

- ساختار

- استودیو

- چنین

- پشتیبانی

- پشتیبانی از

- گزینه

- سیدنی

- خیاط

- گرفتن

- مصرف

- وظایف

- تیم

- جریان تنسور

- آزمون

- تست

- متن

- با تشکر

- که

- La

- شان

- آنها

- سپس

- آنجا.

- اینها

- آنها

- این

- از طریق

- زمان

- به

- رمز

- ابزار

- سنتی

- ترافیک

- قطار

- آموزش

- تحولات

- ترانسفورماتور

- انتقال

- منتقل شده

- ترجمه

- سفر

- تریتون

- درست

- اعتماد کردن

- امتحان

- میزان سازی

- دو

- نوع

- انواع

- اساسی

- URL

- استفاده کنید

- استفاده

- کاربر

- کاربران

- استفاده

- با استفاده از

- اعتبار سنجی

- ارزش

- متغیر

- مختلف

- از طريق

- دید

- راه رفتن

- می خواهم

- مسیر..

- راه

- we

- وب

- خدمات وب

- خوب

- چه زمانی

- چه

- که

- در حین

- اراده

- با

- بدون

- مهاجرت کاری

- مشغول به کار

- گردش کار

- گردش کار

- کارگر

- با این نسخهها کار

- خواهد بود

- XGBoost

- سال

- شما

- شما

- زفیرنت