خلاصه سازی تکنیکی است که اطلاعات قابل توجهی را به شکلی فشرده و معنادار تراکم می کند و به عنوان سنگ بنای ارتباطات کارآمد در عصر غنی از اطلاعات ما قرار دارد. در دنیایی مملو از داده، خلاصه کردن متون طولانی به خلاصههای کوتاه باعث صرفهجویی در زمان و تصمیمگیری آگاهانه میشود. خلاصه سازی محتوا را فشرده می کند و با ارائه مختصر و منسجم اطلاعات باعث صرفه جویی در زمان و بهبود وضوح می شود. خلاصه سازی برای تصمیم گیری و مدیریت حجم زیاد محتوا بسیار ارزشمند است.

روشهای خلاصهسازی طیف گستردهای از کاربردها را برای اهداف مختلف دارند، مانند:

- تجمیع اخبار - تجمیع اخبار شامل خلاصه کردن مقالات خبری در یک خبرنامه برای صنعت رسانه است

- خلاصه اسناد حقوقی - خلاصه اسناد حقوقی به متخصصان حقوقی کمک می کند تا اطلاعات حقوقی کلیدی را از اسناد طولانی مانند شرایط، شرایط و قراردادها استخراج کنند

- تحقیقات دانشگاهی - خلاصه سازی، اطلاعات مهم را از مقالات دانشگاهی حاشیه نویسی، نمایه سازی، فشرده سازی و ساده سازی می کند.

- مدیریت محتوا برای وبلاگ ها و وب سایت ها - می توانید خلاصه های محتوای جذاب و اصلی را برای خوانندگان ایجاد کنید، به خصوص در بازاریابی

- گزارش های مالی و تحلیل بازار - می توانید استخراج کنید بینش مالی از گزارش ها و ایجاد خلاصه های اجرایی برای ارائه سرمایه گذاران در صنعت مالی

با پیشرفت در پردازش زبان طبیعی (NLP)، مدلهای زبان و هوش مصنوعی تولیدی، خلاصه کردن متون با طولهای مختلف قابل دسترستر شده است. ابزارهایی مانند LangChain، همراه با یک مدل زبان بزرگ (LLM) که توسط بستر آمازون or Amazon SageMaker JumpStart، فرآیند پیاده سازی را ساده می کند.

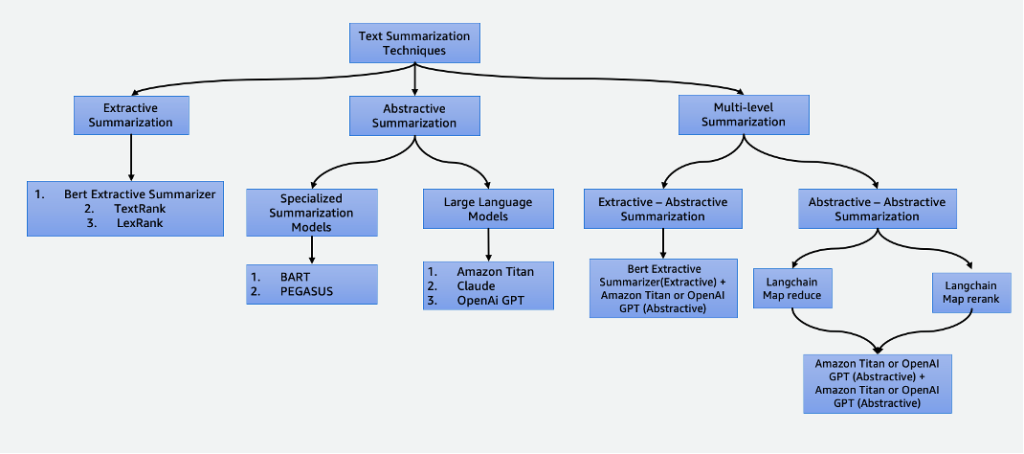

این پست به تکنیک های خلاصه سازی زیر می پردازد:

- خلاصه سازی استخراجی با استفاده از خلاصه کننده استخراجی BERT

- خلاصه سازی انتزاعی با استفاده از مدل های خلاصه سازی تخصصی و LLM

- دو تکنیک خلاصه سازی چند سطحی:

- خلاصه سازی استخراجی-انتزاعی با استفاده از استراتژی خلاصه سازی محتوای استخراجی-انتزاعی (EACSS)

- خلاصه انتزاعی-انتزاعی با استفاده از Map Reduce و Map ReRank

نمونه کد کامل در یافت می شود GitHub repo. شما می توانید راه اندازی این راه حل in Amazon SageMaker Studio.

برای باز کردن کنسول AWS اینجا را کلیک کنید و ادامه دهید.

انواع خلاصه

چندین تکنیک برای خلاصه کردن متن وجود دارد که به طور کلی به دو رویکرد اصلی طبقهبندی میشوند: استخراج و انتزاعی خلاصه سازی. علاوه بر این، روشهای خلاصهسازی چند سطحی مجموعهای از مراحل را شامل میشوند که هر دو تکنیک استخراجی و انتزاعی را با هم ترکیب میکنند. این رویکردهای چند سطحی هنگام برخورد با متن با توکنهای طولانیتر از حد مجاز یک LLM سودمند هستند و درک روایتهای پیچیده را امکانپذیر میسازند.

جمع بندی استخراجی

خلاصه سازی استخراجی تکنیکی است که در NLP و تحلیل متن برای ایجاد خلاصه با استخراج جملات کلیدی استفاده می شود. بهجای تولید جملات یا محتوای جدید مانند خلاصهسازی انتزاعی، خلاصهسازی استخراجی به شناسایی و بیرون کشیدن مرتبطترین و آموزندهترین بخشهای متن اصلی برای ایجاد یک نسخه فشرده متکی است.

خلاصه نویسی استخراجی، اگرچه در حفظ محتوای اصلی و اطمینان از خوانایی بالا با بیرون کشیدن مستقیم جملات مهم از متن منبع سودمند است، اما محدودیت هایی دارد. فاقد خلاقیت است، قادر به تولید جملات بدیع نیست و ممکن است جزییات ظریف را نادیده بگیرد و به طور بالقوه اطلاعات مهم را از دست بدهد. علاوه بر این، ممکن است خلاصه های طولانی را تولید کند که گاهی اوقات خوانندگان را با اطلاعات بیش از حد و ناخواسته غرق می کند. تکنیک های خلاصه سازی استخراجی زیادی وجود دارد، مانند TextRank و LexRank. در این پست، ما بر خلاصهکننده استخراجی BERT تمرکز میکنیم.

خلاصه کننده استخراجی BERT

La خلاصه کننده استخراجی BERT نوعی مدل خلاصه سازی استخراجی است که از مدل زبان BERT برای استخراج مهمترین جملات از یک متن استفاده می کند. برت یک مدل زبان از پیش آموزش دیده است که می تواند برای کارهای مختلف از جمله خلاصه سازی متن به خوبی تنظیم شود. با استفاده از BERT ابتدا جملات را در متن جاسازی می کند. این یک نمایش برداری برای هر جمله ایجاد می کند که معنی و زمینه آن را نشان می دهد. سپس مدل از یک الگوریتم خوشه بندی برای گروه بندی جملات در خوشه ها استفاده می کند. جملاتی که نزدیکترین آنها به مرکز هر خوشه هستند برای تشکیل خلاصه انتخاب می شوند.

در مقایسه با LLM ها، مزیت خلاصه کننده استخراجی BERT این است که آموزش و استقرار مدل نسبتاً ساده است و قابل توضیح تر است. نقطه ضعف این است که خلاصه سازی خلاقانه نیست و جملات تولید نمی کند. فقط جملات را از متن اصلی انتخاب می کند. این توانایی آن را برای خلاصه کردن متون پیچیده یا ظریف محدود می کند.

خلاصه انتزاعی

خلاصه نویسی انتزاعی تکنیکی است که در NLP و تجزیه و تحلیل متن برای ایجاد خلاصه ای استفاده می شود که فراتر از استخراج صرف جملات یا عبارات از متن منبع است. بهجای انتخاب و سازماندهی مجدد محتوای موجود، خلاصهسازی انتزاعی جملات یا عبارات جدیدی تولید میکند که معنای اصلی و ایدههای اصلی متن اصلی را به شکل فشردهتر و منسجمتری نشان میدهد. این رویکرد مستلزم آن است که مدل محتوای متن را درک کند و آن را به گونه ای بیان کند که لزوماً در منبع منبع وجود نداشته باشد.

مدل های خلاصه سازی تخصصی

این مدل های زبان طبیعی از پیش آموزش دیده، مانند بارت و PEGASUS، به طور خاص برای کارهای خلاصه سازی متن طراحی شده اند. آنها از معماری رمزگذار-رمزگشا استفاده می کنند و از نظر پارامترها در مقایسه با همتایان خود کوچکتر هستند. این اندازه کاهش یافته امکان تنظیم دقیق و استقرار در نمونه های کوچکتر را فراهم می کند. با این حال، توجه به این نکته مهم است که این مدلهای خلاصهسازی با اندازه توکن ورودی و خروجی کوچکتر نیز ارائه میشوند. این مدلها بر خلاف همتایان عمومیتر خود، منحصراً برای کارهای خلاصهسازی طراحی شدهاند. در نتیجه، ورودی مورد نیاز برای این مدلها صرفاً متنی است که باید خلاصه شود.

مدل های زبان بزرگ

A مدل زبان بزرگ به هر مدلی اطلاق می شود که بر روی مجموعه داده های گسترده و متنوع، معمولاً از طریق یادگیری خود نظارتی در مقیاس بزرگ، تحت آموزش قرار می گیرد، و می تواند متناسب با مجموعه وسیعی از وظایف پایین دستی خاص تنظیم شود. این مدل ها از نظر اندازه پارامتر بزرگتر هستند و در وظایف بهتر عمل می کنند. قابل ذکر است، آنها دارای اندازه توکن ورودی به طور قابل توجهی بزرگتر هستند، که برخی از آنها ادامه دارند تا 100,000مانند آنتروپیک کلود. برای استفاده از یکی از این مدل ها، AWS سرویس کاملاً مدیریت شده Amazon Bedrock را ارائه می دهد. اگر به کنترل بیشتری بر چرخه عمر توسعه مدل نیاز دارید، می توانید LLM ها را از طریق SageMaker مستقر کنید.

با توجه به ماهیت همه کاره آنها، این مدل ها به دستورالعمل های وظایف خاصی نیاز دارند که از طریق متن ورودی ارائه می شود، عملی که به آن گفته می شود مهندسی سریع. این فرآیند خلاقانه بر اساس نوع مدل و متن ورودی، نتایج متفاوتی را به همراه دارد. اثربخشی عملکرد مدل و کیفیت اعلان به طور قابل توجهی بر کیفیت نهایی خروجی های مدل تأثیر می گذارد. در زیر نکاتی وجود دارد که مهندسی برای خلاصه کردن درخواست می کند:

- متن را برای خلاصه کردن وارد کنید - متنی را که باید خلاصه شود وارد کنید. این به عنوان منبع منبع برای خلاصه عمل می کند.

- تکلیف را مشخص کنید - به وضوح بیان کنید که هدف، خلاصه سازی متن است. برای مثال، «متن زیر را خلاصه کنید: [متن ورودی]».

- زمینه را فراهم کنید - یک مقدمه یا زمینه مختصر برای متن داده شده ارائه دهید که باید خلاصه شود. این به مدل کمک می کند تا محتوا و زمینه را درک کند. به عنوان مثال، "مقاله زیر در مورد هوش مصنوعی و نقش آن در مراقبت های بهداشتی به شما داده شده است: [متن ورودی]."

- خلاصه را درخواست کنید – از مدل بخواهید خلاصه ای از متن ارائه شده را تولید کند. در مورد طول یا قالب مورد نظر خلاصه صحبت کنید. به عنوان مثال، "لطفاً خلاصه ای مختصر از مقاله داده شده در مورد هوش مصنوعی و نقش آن در مراقبت های بهداشتی ایجاد کنید: [متن ورودی]."

- محدودیت ها یا دستورالعمل های طول را تنظیم کنید - به صورت اختیاری، طول خلاصه را با تعیین تعداد کلمات دلخواه، تعداد جمله یا محدودیت کاراکتر هدایت کنید. برای مثال، «لطفاً خلاصهای ایجاد کنید که بیش از 50 کلمه نباشد: [متن ورودی]».

مهندسی سریع موثر برای حصول اطمینان از اینکه خلاصه های تولید شده دقیق، مرتبط و همسو با وظیفه خلاصه سازی مورد نظر هستند، حیاتی است. درخواست را برای نتیجه خلاصه سازی بهینه با آزمایش ها و تکرارها اصلاح کنید. بعد از اینکه اثربخشی دستورات را مشخص کردید، میتوانید با استفاده از آنها دوباره از آنها استفاده کنید قالب های سریع.

خلاصه سازی چند سطحی

خلاصه های استخراجی و انتزاعی برای متون کوتاهتر مفید هستند. با این حال، هنگامی که متن ورودی از حداکثر حد مجاز مدل فراتر می رود، خلاصه سازی چند سطحی ضروری می شود. خلاصهسازی چند سطحی شامل ترکیبی از تکنیکهای خلاصهسازی مختلف، مانند روشهای استخراجی و انتزاعی، برای فشردهسازی مؤثر متون طولانیتر با اعمال لایههای متعدد فرآیندهای خلاصهسازی است. در این بخش، دو تکنیک خلاصهسازی چند سطحی را مورد بحث قرار میدهیم: خلاصهسازی استخراجی-انتزاعی و خلاصهسازی انتزاعی-انتزاعی.

خلاصه استخراجی-انتزاعی

خلاصه سازی استخراجی-انتزاعی ابتدا با ایجاد یک خلاصه استخراجی از متن کار می کند. سپس از یک سیستم خلاصه سازی انتزاعی برای اصلاح خلاصه استخراجی استفاده می کند و آن را مختصرتر و آموزنده تر می کند. این امر با ارائه خلاصه های آموزنده تر در مقایسه با روش های استخراجی به تنهایی، دقت را افزایش می دهد.

استراتژی خلاصه سازی محتوای استخراجی-انتزاعی

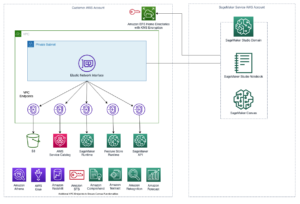

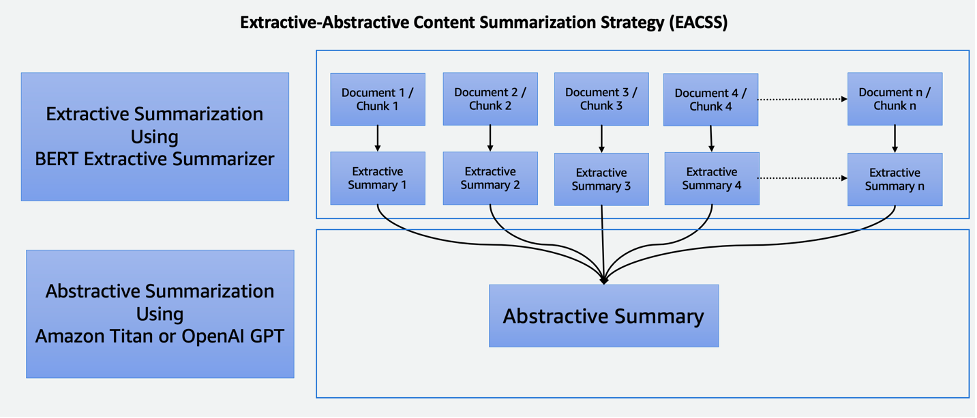

تکنیک EACSS نقاط قوت دو تکنیک قدرتمند را ترکیب میکند: خلاصهکننده استخراج BERT برای فاز استخراج و LLMs برای فاز انتزاعی، همانطور که در نمودار زیر نشان داده شده است.

EACSS چندین مزیت از جمله حفظ اطلاعات حیاتی، خوانایی افزایش یافته و سازگاری را ارائه می دهد. با این حال، پیاده سازی EACSS از نظر محاسباتی گران و پیچیده است. خطر از دست رفتن اطلاعات بالقوه وجود دارد، و کیفیت خلاصه به شدت به عملکرد مدلهای زیربنایی بستگی دارد، و انتخاب دقیق مدل و تنظیم آن برای دستیابی به نتایج بهینه ضروری است. پیاده سازی شامل مراحل زیر است:

- اولین قدم این است که سند بزرگ، مانند یک کتاب، را به بخش های کوچکتر تقسیم کنید یا تکه ها. این تکه ها بسته به جزئیات مورد نظر برای خلاصه به عنوان جملات، پاراگراف ها یا حتی فصل ها تعریف می شوند.

- برای مرحله استخراج، از خلاصهکننده استخراجی BERT استفاده میکنیم. این مؤلفه با جاسازی جملات در هر بخش و سپس استفاده از یک الگوریتم خوشهبندی برای شناسایی جملاتی که نزدیکترین آنها به مرکز خوشه هستند، کار میکند. این مرحله استخراجی به حفظ مهم ترین و مرتبط ترین محتوا از هر بخش کمک می کند.

- پس از ایجاد خلاصههای استخراجی برای هر بخش، به مرحله خلاصهسازی انتزاعی میرویم. در اینجا، ما از LLM هایی استفاده می کنیم که به دلیل توانایی آنها در تولید خلاصه های منسجم و مرتبط با زمینه شناخته شده است. این مدلها خلاصههای استخراجشده را به عنوان ورودی میگیرند و خلاصههای انتزاعی را تولید میکنند که ماهیت سند اصلی را در بر میگیرد و در عین حال از خوانایی و انسجام اطمینان میدهد.

این رویکرد با ترکیب تکنیکهای خلاصهسازی استخراجی و انتزاعی، راهی کارآمد و جامع برای خلاصهسازی اسناد طولانی مانند کتابها ارائه میدهد. این تضمین می کند که اطلاعات مهم استخراج می شود و در عین حال امکان تولید خلاصه های مختصر و قابل خواندن توسط انسان را فراهم می کند و آن را به ابزاری ارزشمند برای کاربردهای مختلف در حوزه خلاصه سازی اسناد تبدیل می کند.

خلاصه انتزاعی-انتزاعی

خلاصه سازی انتزاعی-انتزاعی رویکردی است که در آن از روش های انتزاعی هم برای استخراج و هم برای تولید خلاصه استفاده می شود. مزایای قابل توجهی از جمله خوانایی افزایش یافته، انسجام، و انعطاف پذیری برای تنظیم طول خلاصه و جزئیات ارائه می دهد. این زبان در تولید زبان برتر است و امکان بازنویسی و اجتناب از افزونگی را فراهم می کند. با این حال، اشکالاتی وجود دارد. به عنوان مثال، از نظر محاسباتی گران و منابع فشرده است، و کیفیت آن به شدت به اثربخشی مدلهای زیربنایی بستگی دارد، که اگر به خوبی آموزش دیده یا همهکاره نباشند، ممکن است بر کیفیت خلاصههای تولید شده تأثیر بگذارد. انتخاب مدلها برای کاهش این چالشها و اطمینان از خلاصههای انتزاعی با کیفیت بسیار مهم است. برای خلاصهسازی انتزاعی-انتزاعی، ما دو استراتژی را مورد بحث قرار میدهیم: Map Reduce و Map ReRank.

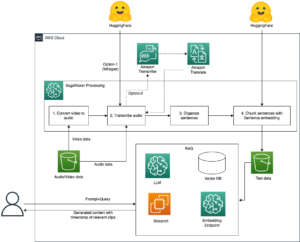

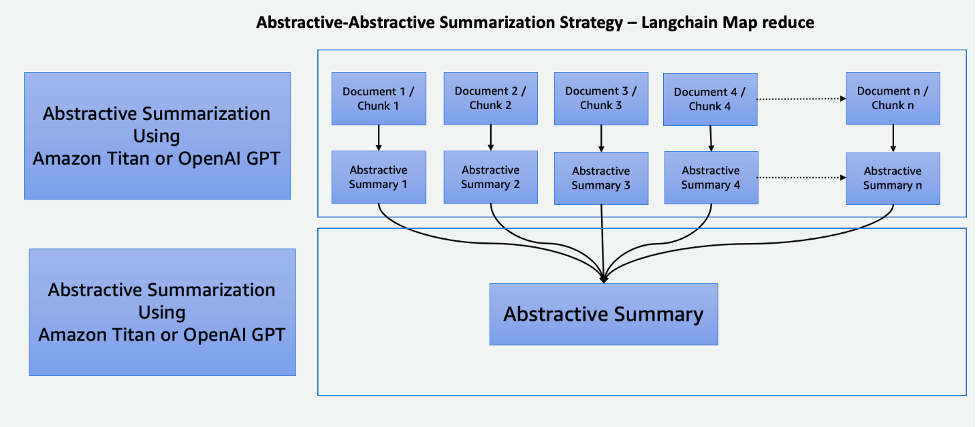

کاهش نقشه با استفاده از LangChain

این فرآیند دو مرحله ای شامل یک مرحله نقشه و یک مرحله کاهش، همانطور که در نمودار زیر نشان داده شده است. این تکنیک به شما امکان میدهد ورودیهایی را که طولانیتر از حد توکن ورودی مدل است، خلاصه کنید.

این فرآیند شامل سه مرحله اصلی است:

- بدنه ها به قطعات کوچکتر تقسیم می شوند که در حد توکن LLM قرار می گیرند.

- ما از یک گام Map برای اعمال یک زنجیره LLM استفاده می کنیم که تمام اطلاعات مهم را از هر قسمت استخراج می کند و خروجی آن به عنوان یک پاساژ جدید استفاده می شود. بسته به اندازه و ساختار مجموعه ها، این می تواند به صورت مضامین فراگیر یا خلاصه های کوتاه باشد.

- مرحله Reduce مسیرهای خروجی از مرحله Map یا یک Reduce Step را با هم ترکیب میکند تا با محدودیت توکن مطابقت داشته باشد و آن را به LLM وارد کند. این فرآیند تا زمانی که خروجی نهایی یک گذرگاه منفرد باشد تکرار می شود.

مزیت استفاده از این تکنیک این است که بسیار مقیاس پذیر و موازی پذیر است. تمام پردازش ها در هر مرحله از یکدیگر مستقل است که از سیستم های توزیع شده یا خدمات بدون سرور و زمان محاسبه کمتر بهره می برد.

نقشه مجدد با استفاده از LangChain

این زنجیره یک اعلان اولیه را روی هر سند اجرا میکند که نه تنها تلاش میکند تا یک کار را تکمیل کند، بلکه امتیازی نیز برای اطمینان از پاسخ آن میدهد. بالاترین امتیاز پاسخ داده می شود.

این تکنیک بسیار شبیه به Map Reduce است اما با مزیت نیاز به تماس های کلی کمتر، فرآیند خلاصه سازی را ساده می کند. با این حال، محدودیت آن در عدم توانایی آن در ادغام اطلاعات در چندین سند است. این محدودیت آن را در سناریوهایی که از یک سند منفرد انتظار میرود یک پاسخ ساده و منفرد مؤثر باشد، و آن را برای کارهای پیچیدهتر یا چند وجهی بازیابی اطلاعات که شامل منابع متعدد است، کمتر مناسب میسازد. بررسی دقیق زمینه و ماهیت داده ها برای تعیین مناسب بودن این روش برای نیازهای خلاصه سازی خاص ضروری است.

Cohere ReRank از یک سیستم رتبهبندی مجدد مبتنی بر معنایی استفاده میکند که معنای پرس و جو کاربر را فراتر از ارتباط کلمه کلیدی میسازد. این با سیستم های فروشگاه برداری و همچنین موتورهای جستجوی مبتنی بر کلمات کلیدی استفاده می شود و به آن انعطاف پذیری می دهد.

مقایسه تکنیک های خلاصه سازی

هر تکنیک خلاصه سازی مزایا و معایب منحصر به فرد خود را دارد:

- خلاصهسازی استخراجی محتوای اصلی را حفظ میکند و خوانایی بالا را تضمین میکند، اما خلاقیت ندارد و ممکن است خلاصههای طولانی ایجاد کند.

- خلاصهسازی انتزاعی، در حالی که خلاقیت ارائه میدهد و خلاصههای موجز و روان را ایجاد میکند، با خطر اصلاح ناخواسته محتوا، چالشهایی در دقت زبان و توسعه منابع فشرده همراه است.

- خلاصه سازی چند سطحی استخراجی-انتزاعی به طور موثر اسناد بزرگ را خلاصه می کند و انعطاف پذیری بهتری را در تنظیم دقیق بخش استخراجی مدل ها فراهم می کند. با این حال، گران، وقت گیر و فاقد موازی سازی است که تنظیم پارامتر را به چالش می کشد.

- خلاصهسازی چند سطحی انتزاعی-انتزاعی نیز به طور مؤثر اسناد بزرگ را خلاصه میکند و در خوانایی و انسجام بیشتر برتری دارد. با این حال، از نظر محاسباتی گران و منابع فشرده است و به شدت بر اثربخشی مدلهای زیربنایی متکی است.

انتخاب دقیق مدل برای کاهش چالشها و اطمینان از خلاصههای انتزاعی با کیفیت بالا در این رویکرد بسیار مهم است. جدول زیر قابلیت های هر نوع خلاصه سازی را خلاصه می کند.

| منظر | خلاصه استخراجی | خلاصه انتزاعی | خلاصه سازی چند سطحی |

| خلاصه های خلاقانه و جذاب ایجاد کنید | نه | بله | بله |

| محتوای اصلی را حفظ کنید | بله | نه | نه |

| حفظ تعادل اطلاعات و خلاقیت | نه | بله | بله |

| مناسب برای متن کوتاه و عینی (طول متن ورودی کوچکتر از حداکثر نشانه های مدل) | بله | بله | نه |

| برای اسناد طولانی تر و پیچیده مانند کتاب ها (طول متن ورودی بیشتر از حداکثر نشانه های مدل) موثر است. | نه | نه | بله |

| استخراج و تولید محتوا را با هم ترکیب می کند | نه | نه | بله |

تکنیکهای خلاصهسازی چند سطحی برای اسناد طولانی و پیچیده که طول متن ورودی از حد نشانه مدل بیشتر است، مناسب هستند. جدول زیر این تکنیک ها را با هم مقایسه می کند.

| تکنیک | مزایای | معایب |

| EACSS (استخراجی-انتزاعی) | اطلاعات مهم را حفظ می کند، توانایی تنظیم دقیق بخش استخراجی مدل ها را فراهم می کند. | از نظر محاسباتی گران، از دست دادن اطلاعات بالقوه، و عدم موازی سازی. |

| کاهش نقشه (انتزاعی-انتزاعی) | مقیاس پذیر و موازی پذیر، با زمان محاسبه کمتر. بهترین تکنیک برای ایجاد خلاصه های خلاقانه و مختصر. | فرآیند فشرده حافظه |

| رتبه بندی مجدد نقشه (انتزاعی-انتزاعی) | خلاصه سازی ساده با رتبه بندی مبتنی بر معنایی. | ادغام اطلاعات محدود |

نکاتی هنگام خلاصه کردن متن

بهترین روش های زیر را هنگام خلاصه کردن متن در نظر بگیرید:

- از اندازه کل توکن آگاه باشید - آماده باشید که متن را در صورت فراتر از حد مجاز مدل، تقسیم کنید یا در هنگام استفاده از LLM از چندین سطح خلاصه سازی استفاده کنید.

- از انواع و تعداد منابع داده آگاه باشید - ترکیب اطلاعات از منابع متعدد ممکن است نیازمند تحولات، سازماندهی روشن و استراتژی های یکپارچه سازی باشد. LangChain Stuff دارای ادغام در طیف گسترده ای از منابع داده و انواع سند. با استفاده از این تکنیک، فرآیند ترکیب متن از اسناد و منابع داده های مختلف را ساده می کند.

- از تخصص مدل آگاه باشید - برخی از مدلها ممکن است در انواع خاصی از محتوا برتر باشند، اما با برخی دیگر مشکل دارند. ممکن است مدلهای تنظیمشدهای وجود داشته باشند که برای دامنه متن شما مناسبتر باشند.

- از خلاصه سازی چند سطحی برای متن های بزرگ استفاده کنید - برای متونی که از محدودیت های رمز عبور می کنند، یک رویکرد خلاصه سازی چند سطحی را در نظر بگیرید. با یک خلاصه سطح بالا شروع کنید تا ایده های اصلی را به دست آورید و سپس به تدریج زیربخش ها یا فصل ها را برای بینش های دقیق تر خلاصه کنید.

- خلاصه کردن متن بر اساس موضوعات - این رویکرد به حفظ یک جریان منطقی و کاهش از دست دادن اطلاعات کمک می کند و حفظ اطلاعات حیاتی را در اولویت قرار می دهد. اگر از LLM استفاده میکنید، اعلانهای واضح و مشخصی ایجاد کنید که مدل را راهنمایی میکند تا یک موضوع خاص را بهجای کل متن خلاصه کند.

نتیجه

خلاصه سازی به عنوان یک ابزار حیاتی در عصر غنی از اطلاعات ما می ایستد و امکان تقطیر کارآمد اطلاعات گسترده را به اشکال مختصر و معنی دار فراهم می کند. این نقش محوری در حوزه های مختلف ایفا می کند و مزایای متعددی را ارائه می دهد. خلاصهسازی با انتقال سریع محتوای ضروری از اسناد طولانی، در زمان صرفهجویی میکند، با استخراج اطلاعات حیاتی به تصمیمگیری کمک میکند، و درک در آموزش و تنظیم محتوا را افزایش میدهد.

این پست یک مرور کلی از تکنیک های مختلف خلاصه سازی، از جمله رویکردهای استخراجی، انتزاعی و چند سطحی ارائه می دهد. با ابزارهایی مانند LangChain و مدلهای زبان، میتوانید از قدرت خلاصهسازی برای سادهسازی ارتباطات، بهبود تصمیمگیری و باز کردن پتانسیل کامل مخازن اطلاعات گسترده استفاده کنید. جدول مقایسه در این پست می تواند به شما در شناسایی مناسب ترین تکنیک های خلاصه سازی برای پروژه های خود کمک کند. علاوه بر این، نکات به اشتراک گذاشته شده در پست به عنوان دستورالعمل های ارزشمندی برای جلوگیری از خطاهای تکراری هنگام آزمایش با LLM برای خلاصه سازی متن عمل می کند. این توصیه عملی به شما قدرت می دهد تا دانش به دست آمده را به کار ببرید و از خلاصه سازی موفق و کارآمد در پروژه ها اطمینان حاصل کنید.

منابع

درباره نویسندگان

نیک بیسو مهندس یادگیری ماشین در AWS Professional Services است. او چالش های پیچیده سازمانی و فنی را با استفاده از علم داده و مهندسی حل می کند. علاوه بر این، او مدلهای AI/ML را روی AWS Cloud میسازد و مستقر میکند. اشتیاق او به میل او به سفر و تجربیات فرهنگی متنوع گسترش می یابد.

نیک بیسو مهندس یادگیری ماشین در AWS Professional Services است. او چالش های پیچیده سازمانی و فنی را با استفاده از علم داده و مهندسی حل می کند. علاوه بر این، او مدلهای AI/ML را روی AWS Cloud میسازد و مستقر میکند. اشتیاق او به میل او به سفر و تجربیات فرهنگی متنوع گسترش می یابد.

سوهاس چودری جونالاگدا دانشمند داده در خدمات جهانی AWS است. او مشتاق کمک به مشتریان سازمانی برای حل پیچیده ترین مشکلات خود با قدرت AI/ML است. او به مشتریان کمک کرده است تا راه حل های تجاری خود را در صنایع مختلف از جمله مالی، مراقبت های بهداشتی، بانکداری، تجارت الکترونیک، رسانه، تبلیغات و بازاریابی تغییر دهند.

سوهاس چودری جونالاگدا دانشمند داده در خدمات جهانی AWS است. او مشتاق کمک به مشتریان سازمانی برای حل پیچیده ترین مشکلات خود با قدرت AI/ML است. او به مشتریان کمک کرده است تا راه حل های تجاری خود را در صنایع مختلف از جمله مالی، مراقبت های بهداشتی، بانکداری، تجارت الکترونیک، رسانه، تبلیغات و بازاریابی تغییر دهند.

تابی وارد یک معمار اصلی ابر/مشاور فنی استراتژیک با تجربه گسترده در مهاجرت مشتریان و مدرن کردن حجم کاری برنامه و خدمات آنها به AWS است. او با بیش از 25 سال تجربه در توسعه و معماری نرم افزار، به دلیل توانایی غواصی عمیق و همچنین جلب مهارت اعتماد مشتریان و شرکا برای طراحی معماری ها و راه حل ها در چندین پشته فناوری و ارائه دهندگان ابر شناخته شده است.

تابی وارد یک معمار اصلی ابر/مشاور فنی استراتژیک با تجربه گسترده در مهاجرت مشتریان و مدرن کردن حجم کاری برنامه و خدمات آنها به AWS است. او با بیش از 25 سال تجربه در توسعه و معماری نرم افزار، به دلیل توانایی غواصی عمیق و همچنین جلب مهارت اعتماد مشتریان و شرکا برای طراحی معماری ها و راه حل ها در چندین پشته فناوری و ارائه دهندگان ابر شناخته شده است.

شیام دسای یک مهندس ابر برای خدمات داده های بزرگ و یادگیری ماشین در AWS است. او با استفاده از ترکیبی از تخصص مهندسی نرم افزار با علم داده، از برنامه های کاربردی داده های بزرگ و مشتریان در سطح سازمانی پشتیبانی می کند. او دانش گسترده ای در کاربردهای بینایی کامپیوتری و تصویربرداری برای هوش مصنوعی و همچنین کاربردهای زیست پزشکی و بیوانفورماتیک دارد.

شیام دسای یک مهندس ابر برای خدمات داده های بزرگ و یادگیری ماشین در AWS است. او با استفاده از ترکیبی از تخصص مهندسی نرم افزار با علم داده، از برنامه های کاربردی داده های بزرگ و مشتریان در سطح سازمانی پشتیبانی می کند. او دانش گسترده ای در کاربردهای بینایی کامپیوتری و تصویربرداری برای هوش مصنوعی و همچنین کاربردهای زیست پزشکی و بیوانفورماتیک دارد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/techniques-for-automatic-summarization-of-documents-using-language-models/

- : دارد

- :است

- :نه

- :جایی که

- 1

- 100

- 11

- 20

- 25

- 50

- 7

- 8

- 9

- a

- توانایی

- درباره ما

- دانشگاهی

- در دسترس

- دقت

- دقیق

- دستیابی به

- در میان

- اضافه

- علاوه بر این

- پیشرفت

- مزیت - فایده - سود - منفعت

- با صرفه

- مزایای

- تبلیغات

- نصیحت

- مشاور

- پس از

- سن

- تجمع

- AI

- AI / ML

- ایدز

- الگوریتم

- هم راستا

- معرفی

- اجازه دادن

- اجازه می دهد تا

- تنها

- در امتداد

- همچنین

- هر چند

- آمازون

- آمازون خدمات وب

- an

- تحلیل

- و

- پاسخ

- آنتروپیک

- هر

- کاربرد

- برنامه های کاربردی

- درخواست

- با استفاده از

- روش

- رویکردها

- هستند

- صف

- مقاله

- مقالات

- مصنوعی

- هوش مصنوعی

- AS

- At

- اتوماتیک

- اجتناب از

- اجتناب از

- مطلع

- AWS

- خدمات حرفه ای AWS

- بانکداری

- مستقر

- BE

- شدن

- شود

- بودن

- بهترین

- بهترین شیوه

- بهتر

- خارج از

- بزرگ

- بزرگ داده

- بیومدیکال

- وبلاگ ها

- بدن

- بدن

- کتاب

- کتاب

- هر دو

- شکستن

- پهن

- گسترده

- می سازد

- کسب و کار

- اما

- دکمه

- by

- تماس ها

- CAN

- قابلیت های

- توانا

- گرفتن

- جلب

- دقیق

- مرکز

- معین

- زنجیر

- چالش ها

- به چالش کشیدن

- فصل ها

- شخصیت

- وضوح

- واضح

- به وضوح

- کلیک

- ابر

- خوشه

- خوشه بندی

- رمز

- منسجم

- ترکیب

- ترکیب شده

- ترکیب

- ترکیب

- بیا

- می آید

- ارتباط

- جمع و جور

- مقایسه

- مقایسه

- کامل

- پیچیده

- جزء

- جامع

- شامل

- محاسبه

- کامپیوتر

- چشم انداز کامپیوتر

- مختصر

- شرایط

- در نظر بگیرید

- توجه

- تشکیل شده است

- کنسول

- محدودیت ها

- مصرف کننده

- محتوا

- گزینش محتوا

- زمینه

- کنترل

- هسته

- بنیاد

- میتوانست

- همتایان

- سادگی

- ایجاد

- خالق

- خلاقیت

- بحرانی

- بسیار سخت

- فرهنگی

- سوزش

- مشتریان

- داده ها

- علم اطلاعات

- دانشمند داده

- مجموعه داده ها

- معامله

- تصمیم گیری

- تصمیم گیری

- مشخص

- بستگی دارد

- بستگی دارد

- گسترش

- گسترش

- مستقر می کند

- طرح

- طراحی

- مطلوب

- جزئیات

- دقیق

- جزئیات

- مشخص کردن

- در حال توسعه

- پروژه

- مختلف

- مستقیما

- بی بهره

- بحث و تبادل نظر

- توزیع شده

- سیستم های توزیع شده

- مختلف

- سند

- اسناد و مدارک

- نمی کند

- دامنه

- حوزه

- پایین

- اشکالاتی

- هر

- سود

- سهولت

- تجارت الکترونیک

- آموزش

- موثر

- به طور موثر

- اثر

- موثر

- تعبیه کردن

- استخدام

- توانمندسازی

- را قادر می سازد

- را قادر می سازد

- جذاب

- مهندس

- مهندسی

- موتورهای حرفه ای

- افزایش

- افزایش می یابد

- اطمینان حاصل شود

- تضمین می کند

- حصول اطمینان از

- سرمایه گذاری

- در سطح سازمانی

- عصر

- خطاهای

- به خصوص

- ماهیت

- ضروری است

- تاسیس

- حتی

- مثال

- تجاوز

- بیش از

- اکسل

- بیش از اندازه

- منحصرا

- اجرایی

- موجود

- انتظار می رود

- گران

- تجربه

- تجارب

- آزمایش

- تخصص

- صریح

- گسترش می یابد

- وسیع

- تجربه گسترده

- عصاره

- استخراج

- عصاره ها

- ویژگی

- کمتر

- نهایی

- سرمایه گذاری

- نام خانوادگی

- مناسب

- انعطاف پذیری

- جریان

- تمرکز

- به دنبال

- پیروی

- برای

- فرم

- قالب

- اشکال

- یافت

- از جانب

- کامل

- کاملا

- بعلاوه

- به دست آورد

- همه منظوره

- تولید می کنند

- تولید

- تولید می کند

- مولد

- نسل

- مولد

- هوش مصنوعی مولد

- داده

- می دهد

- دادن

- جهانی

- می رود

- رفتن

- بیشتر

- گروه

- راهنمایی

- دستورالعمل ها

- دهنه

- آیا

- he

- بهداشت و درمان

- به شدت

- کمک

- کمک کرد

- کمک

- کمک می کند

- او

- اینجا کلیک نمایید

- زیاد

- در سطح بالا

- با کیفیت بالا

- بالاترین

- خیلی

- خود را

- چگونه

- اما

- HTML

- HTTPS

- قابل خواندن انسان است

- ایده ها

- شناسایی

- شناسایی

- if

- تصویربرداری

- تأثیر

- پیاده سازی

- اجرای

- مهم

- بهبود

- بهبود

- in

- عجز

- شامل

- از جمله

- ترکیب کردن

- مستقل

- فهرستها

- به طور جداگانه

- لوازم

- نفوذ

- اطلاعات

- حاوی اطلاعات مفید

- اطلاع

- اول

- ورودی

- بینش

- در عوض

- دستورالعمل

- ادغام

- اطلاعات

- مورد نظر

- به

- معرفی

- فوق العاده گرانبها

- سرمایه گذار

- شامل

- IT

- تکرار

- ITS

- JPG

- کلید

- دانش

- شناخته شده

- زبان

- بزرگ

- بزرگتر

- لایه

- یادگیری

- قانونی

- طول

- کمتر

- سطح

- نهفته است

- wifecycwe

- پسندیدن

- محدود

- محدودیت

- محدودیت

- محدودیت

- LLM

- منطقی

- طولانی

- دیگر

- خاموش

- کاهش

- دستگاه

- فراگیری ماشین

- اصلی

- حفظ

- ساخت

- باعث می شود

- ساخت

- اداره می شود

- مدیریت

- بسیاری

- نقشه

- بازار

- بازار یابی (Marketing)

- ماده

- بیشترین

- ممکن است..

- معنی

- معنی دار

- رسانه ها

- تولید گزارشات تاریخی

- ادغام کردن

- ادغام

- روش

- متدولوژی ها

- روش

- مهاجرت

- گم

- کاهش

- مدل

- مدل

- مدرنیزه کردن

- بیش

- علاوه بر این

- اکثر

- حرکت

- چند وجهی

- چندگانه

- روایت ها

- طبیعی

- پردازش زبان طبیعی

- طبیعت

- لزوما

- لازم

- نیاز

- نیازهای

- جدید

- اخبار

- عضویت در خبرنامه

- nlp

- نه

- قابل توجه

- به ویژه

- توجه داشته باشید

- رمان

- عدد

- متعدد

- هدف

- of

- ارائه

- ارائه

- پیشنهادات

- on

- ONE

- فقط

- باز کن

- بهینه

- or

- کدام سازمان ها

- سازمانی

- اصلی

- دیگر

- دیگران

- ما

- خارج

- نتایج

- تولید

- خروجی

- روی

- به طور کلی

- کلاهبرداری

- مروری

- قریب به اتفاق

- خود

- پارامتر

- پارامترهای

- بخش

- ویژه

- شرکای

- عبور

- شور

- احساساتی

- انجام

- کارایی

- فاز

- عبارات

- محوری

- افلاطون

- هوش داده افلاطون

- PlatoData

- نقش

- پست

- پتانسیل

- بالقوه

- قدرت

- صفحه اصلی

- قوی

- عملی

- تمرین

- شیوه های

- آماده شده

- در حال حاضر

- ارایهها در همایشهای علمی

- حفظ

- حفظ کردن

- اصلی

- اولویت بندی می کند

- مشکلات

- روند

- فرآیندهای

- در حال پردازش

- تولید کردن

- تولید می کند

- حرفه ای

- حرفه ای

- به تدریج

- پروژه ها

- پرسیدن

- ارائه

- ارائه دهندگان

- فراهم می کند

- ارائه

- کشیدن

- اهداف

- کیفیت

- محدوده

- رتبه بندی

- خوانندگان

- به رسمیت شناخته شده

- كاهش دادن

- کاهش

- اشاره

- اشاره دارد

- خالص کردن

- نسبتا

- ربط

- مربوط

- تکیه بر

- سازماندهی مجدد

- مکرر

- تکراری

- گزارش ها

- نمایندگی

- نیاز

- ضروری

- نیاز

- منابع

- منابع فشرده

- پاسخ

- محدودیت

- نتیجه

- نتایج

- نگهداری

- استفاده مجدد

- خطر

- نقش

- اجرا می شود

- حکیم ساز

- صرفه جویی کردن

- مقیاس پذیر

- مقیاس

- سناریوها

- علم

- دانشمند

- نمره

- به ثمر رساندن

- جستجو

- موتورهای جستجو

- بخش

- بخش

- انتخاب شد

- انتخاب

- انتخاب

- جمله

- سلسله

- خدمت

- بدون سرور

- خدمت

- سرویس

- خدمات

- خدمت

- چند

- به اشتراک گذاشته شده

- او

- کوتاه

- به طور قابل توجهی

- مشابه

- ساده می کند

- ساده کردن

- تنها

- مفرد

- قابل اندازه

- اندازه

- اندازه

- کوچکتر

- نرم افزار

- مهندسی نرم افزار

- فقط

- مزایا

- حل

- حل می کند

- برخی از

- گاهی

- منبع

- منابع

- تخصصی

- خاص

- به طور خاص

- انشعاب

- پشته

- می ایستد

- شروع

- دولت

- گام

- مراحل

- opbevare

- ساده

- استراتژی ها

- استراتژی

- ساده کردن

- ساده

- نقاط قوت

- ساختار

- مبارزه

- قابل ملاحظه ای

- موفق

- چنین

- کت و شلوار

- مناسب

- خلاصه کردن

- خلاصه

- پشتیبانی از

- به سرعت

- سیستم

- سیستم های

- جدول

- طراحی شده

- گرفتن

- طول می کشد

- کار

- وظایف

- فن آوری

- فنی

- تکنیک

- تکنیک

- قوانین و مقررات

- متن

- نسبت به

- که

- La

- پروژه ها

- منبع

- شان

- آنها

- تم

- سپس

- آنجا.

- اینها

- آنها

- این

- سه

- از طریق

- زمان

- نکات

- به

- رمز

- نشانه

- ابزار

- ابزار

- موضوع

- تاپیک

- جمع

- قطار

- آموزش

- تحولات

- تبدیل شدن

- سفر

- اعتماد

- میزان سازی

- دو

- نوع

- انواع

- به طور معمول

- ناتوان

- تحت عمل قرار می گیرد

- اساسی

- فهمیدن

- درک

- منحصر به فرد

- بر خلاف

- باز

- تا

- ناخواسته

- استفاده کنید

- استفاده

- استفاده

- با استفاده از

- استفاده کنید

- ارزشمند

- تنوع

- مختلف

- متفاوت است

- وسیع

- همه کاره

- نسخه

- بسیار

- دید

- حیاتی

- جلد

- مسیر..

- we

- وب

- خدمات وب

- خوب

- چه زمانی

- که

- در حین

- تمام

- وسیع

- ویکیپدیا

- با

- در داخل

- کلمه

- کلمات

- با این نسخهها کار

- جهان

- سال

- بازده

- شما

- شما

- زفیرنت