این پست وبلاگ با همکاری Tuana Çelik از عمق نوشته شده است.

جستجوی سازمانی جزء حیاتی کارایی سازمانی از طریق دیجیتالی کردن اسناد و مدیریت دانش است. جستجوی سازمانی ذخیره اسنادی مانند فایلهای دیجیتال، فهرستبندی اسناد برای جستجو و ارائه نتایج مرتبط بر اساس درخواستهای کاربر را پوشش میدهد. با ظهور مدلهای زبان بزرگ (LLM)، میتوانیم تجربیات مکالمه را در ارائه نتایج به کاربران پیادهسازی کنیم. با این حال، ما باید اطمینان حاصل کنیم که LLM ها پاسخ ها را به داده های شرکت محدود می کنند و در نتیجه توهمات مدل را کاهش می دهند.

در این پست، نحوه ساخت یک برنامه هوش مصنوعی مولد سرتاسر برای جستجوی سازمانی با استفاده از Retrieval Augmented Generation (RAG) را با استفاده از خطوط لوله کاه و مدل دستورالعمل Falcon-40b نشان می دهیم. Amazon SageMaker JumpStart و سرویس جستجوی باز آمازون. کد منبع برای نمونه نمایش داده شده در این پست در دسترس است مخزن GitHub

بررسی اجمالی راه حل

برای محدود کردن پاسخهای برنامههای هوش مصنوعی مولد فقط به دادههای شرکت، باید از تکنیکی به نام Retrieval Augmented Generation (RAG) استفاده کنیم. برنامهای که از رویکرد RAG استفاده میکند، اطلاعات مرتبط با درخواست کاربر را از پایگاه دانش یا محتوای سازمانی بازیابی میکند، آنها را بهعنوان زمینه همراه با درخواست کاربر بهعنوان یک درخواست جمعآوری میکند، و سپس آن را برای دریافت پاسخ به LLM ارسال میکند. LLM ها محدودیت هایی در مورد حداکثر تعداد کلمات برای اعلان های ورودی دارند، بنابراین انتخاب متن مناسب در بین هزاران یا میلیون ها سند در سازمان تأثیر مستقیمی بر دقت LLM دارد.

تکنیک RAG اهمیت فزاینده ای در جستجوی سازمانی پیدا کرده است. در این پست، جریان کاری را نشان میدهیم که از SageMaker JumpStart برای استقرار یک مدل دستورالعمل Falcon-40b بهره میبرد و از Haystack برای طراحی و اجرای خط لوله پاسخدهی به سؤالات افزوده شده بازیابی استفاده میکند. جریان کار تقویت نهایی بازیابی مراحل سطح بالا زیر را پوشش می دهد:

- پرس و جو کاربر برای یک جزء بازیابی استفاده می شود، که یک جستجوی برداری انجام می دهد تا مرتبط ترین زمینه را از پایگاه داده ما بازیابی کند.

- این زمینه در یک اعلان تعبیه شده است که برای دستور دادن به یک LLM طراحی شده است تا پاسخی را فقط از زمینه ارائه شده ایجاد کند.

- LLM تنها با در نظر گرفتن زمینه تعبیه شده در درخواستی که دریافت کرده است، پاسخی به پرس و جو اصلی ایجاد می کند.

SageMaker JumpStart

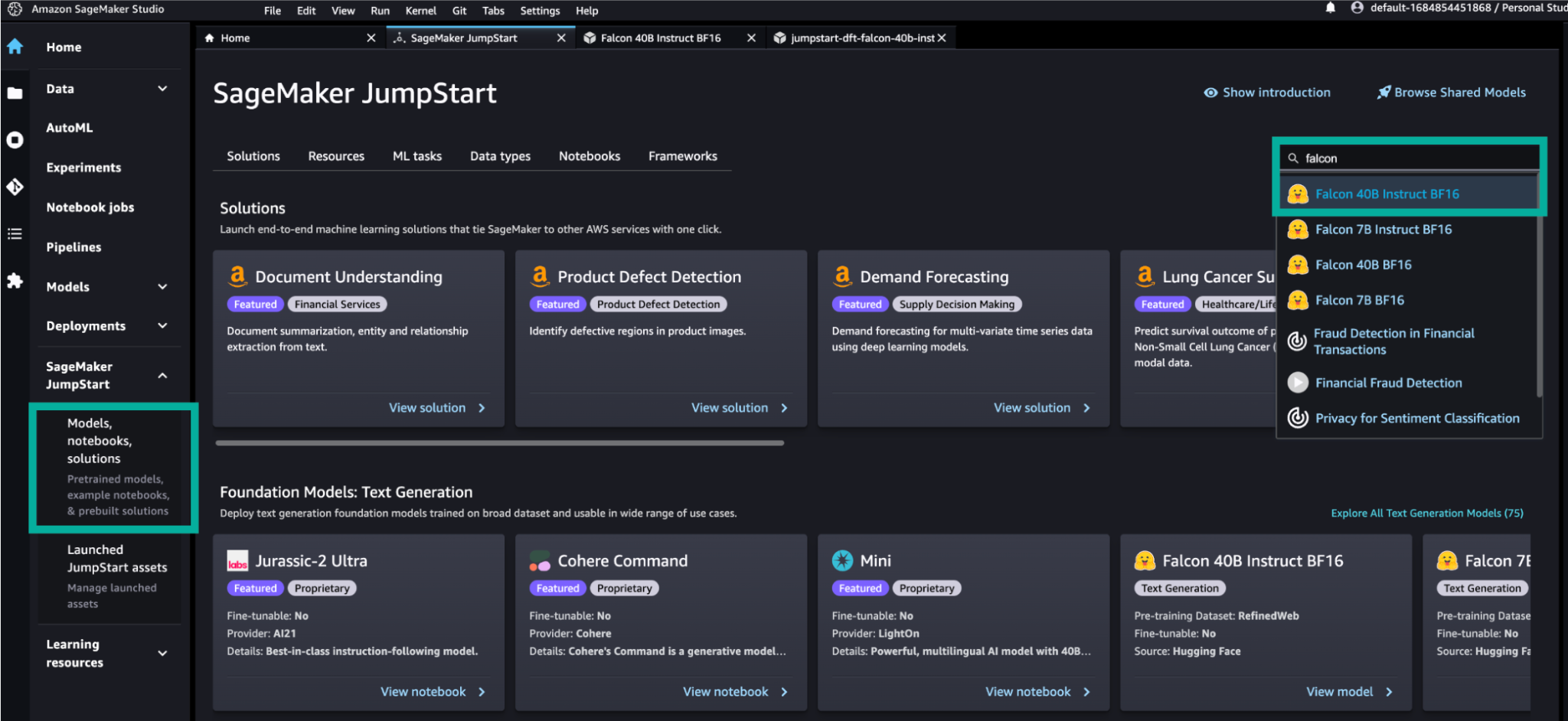

SageMaker JumpStart بهعنوان یک مرکز مدل عمل میکند که مجموعهای از مدلهای یادگیری عمیق را برای متن، دید، صدا و موارد استفاده تعبیهشده در بر میگیرد. با بیش از 500 مدل، مرکز مدل آن شامل مدلهای عمومی و اختصاصی از شرکای AWS مانند AI21، Stability AI، Cohere، و LightOn است. همچنین میزبان مدل های پایه است که صرفاً توسط آمازون توسعه یافته است، مانند AlexaTM. برخی از مدلها قابلیتهایی را برای شما فراهم میکنند تا آنها را با دادههای خود تنظیم کنید. SageMaker JumpStart همچنین قالبهای راهحلی را ارائه میکند که زیرساختهایی را برای موارد استفاده رایج تنظیم میکند، و نمونههای نوتبوکهای اجرایی برای یادگیری ماشین (ML) با SageMaker.

کاهگل

کاهگل یک چارچوب متن باز توسط دیپ ست است که به توسعه دهندگان اجازه می دهد تا برنامه های LLM متشکل از اجزای مختلف مانند مدل ها، DB های برداری، مبدل های فایل و ماژول های بی شمار دیگر را هماهنگ کنند. انبار کاه فراهم می کند خطوط لوله و عوامل، دو ساختار قدرتمند برای طراحی برنامه های LLM برای موارد استفاده مختلف از جمله جستجو، پاسخگویی به سؤال و هوش مصنوعی محاوره ای. با تمرکز زیاد بر روشهای بازیابی پیشرفته و معیارهای ارزیابی جامد، همه چیزهایی را که برای ارسال یک برنامه کاربردی قابل اعتماد و قابل اعتماد نیاز دارید در اختیار شما قرار میدهد. شما می توانید خطوط لوله را سریال کنید فایل های YAML، آنها را از طریق a افشا کنید REST APIو آنها را به طور انعطاف پذیر با بارهای کاری خود مقیاس دهید، و انتقال برنامه خود را از مرحله نمونه اولیه به مرحله تولید آسان می کند.

جستجوی باز آمازون

OpenSearch Service یک سرویس کاملاً مدیریت شده است که استقرار، مقیاسبندی و اجرای OpenSearch را در AWS Cloud ساده میکند. OpenSearch یک مجموعه نرمافزار متنباز مقیاسپذیر، منعطف و توسعهپذیر برای جستجو، تجزیه و تحلیل، نظارت بر امنیت و برنامههای کاربردی است که تحت مجوز Apache 2.0 مجوز دارد.

در سال های اخیر، تکنیک های ML به طور فزاینده ای برای بهبود جستجو محبوب شده اند. از جمله آنها استفاده از مدل های تعبیه شده، نوعی مدل است که می تواند حجم زیادی از داده ها را در یک فضای n بعدی رمزگذاری کند که در آن هر موجودیت در یک فضای رمزگذاری شده است. بردار، یک نقطه داده در آن فضا، و سازماندهی شده به گونه ای که موجودیت های مشابه به هم نزدیکتر باشند. یک پایگاه داده برداری با ارائه نمایه های تخصصی مانند نمایه های k-NN، جستجوی شباهت برداری کارآمد را فراهم می کند.

با قابلیت های وکتور پایگاه داده سرویس OpenSearch، می توانید جستجوی معنایی، RAG با LLM، موتورهای توصیه و رسانه های غنی را جستجو کنید. در این پست، ما از RAG استفاده میکنیم تا بتوانیم LLMهای مولد را با یک پایگاه دانش خارجی تکمیل کنیم که معمولاً با استفاده از یک پایگاه داده برداری که با مقالات دانش رمزگذاری شده بردار ساخته میشود، ساخته میشود.

بررسی اجمالی برنامه

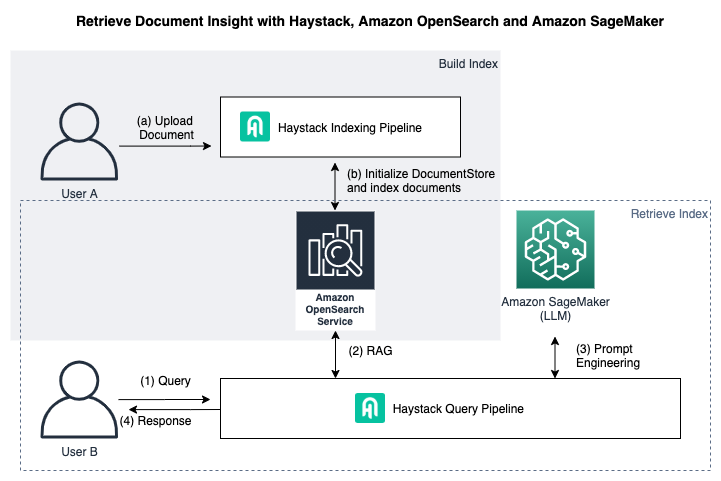

نمودار زیر ساختار برنامه نهایی را نشان می دهد.

در این برنامه، ما از Haystack Indexing Pipeline برای مدیریت اسناد آپلود شده و اسناد نمایه شده و Haystack Query Pipeline برای انجام بازیابی دانش از اسناد نمایه شده استفاده می کنیم.

خط لوله نمایه سازی انبار کاه شامل مراحل سطح بالا زیر است:

- یک سند آپلود کنید

- شروع کردن

DocumentStoreو اسناد نمایه.

ما از OpenSearch به عنوان خود استفاده می کنیم DocumentStore و یک انبار کاه خط لوله نمایه سازی برای پیش پردازش و فهرست بندی فایل های خود در OpenSearch. انبار کاه تبدیل فایل ها و پیش پردازنده به شما این امکان را می دهد که فایل های خام خود را به شکل و قالبی تمیز و آماده کنید که خط لوله پردازش زبان طبیعی (NLP) و مدل زبان انتخابی شما می تواند با آن مقابله کند. خط لوله نمایه سازی که ما در اینجا استفاده کرده ایم نیز استفاده می کند sentence-transformers/all-MiniLM-L12-v2 برای ایجاد جاسازی برای هر سند، که ما از آنها برای بازیابی کارآمد استفاده می کنیم.

Haystack Query Pipeline شامل مراحل سطح بالا زیر است:

- ما یک پرس و جو به خط لوله RAG ارسال می کنیم.

- An EmbeddingRetriever جزء به عنوان فیلتری عمل می کند که مرتبط ترین ها را بازیابی می کند

top_kاسناد از اسناد نمایه شده ما در OpenSearch. ما از انتخاب مدل جاسازی برای جاسازی پرس و جو و اسناد (در نمایه سازی) برای رسیدن به این هدف استفاده می کنیم. - اسناد بازیابی شده در دستور ما به مدل Falcon-40b-instruct تعبیه شده است.

- LLM با پاسخی برمیگردد که بر اساس اسناد بازیابی شده است.

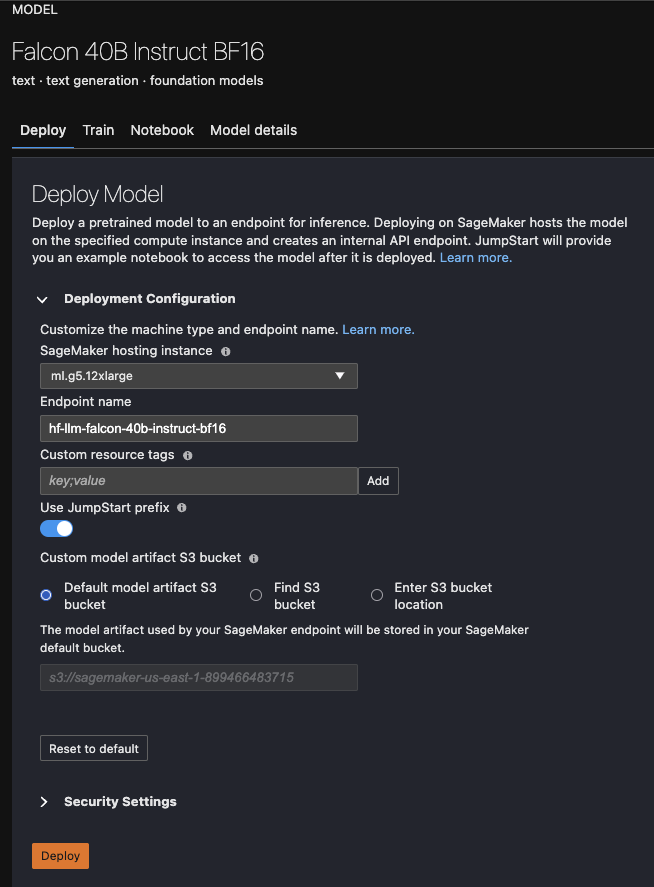

برای استقرار مدل، ما از SageMaker JumpStart استفاده میکنیم که استقرار مدلها را با فشار دادن یک دکمه ساده میکند. اگرچه ما از دستورالعمل Falcon-40b برای این مثال استفاده و آزمایش کردهایم، اما میتوانید از هر مدل Hagging Face موجود در SageMaker استفاده کنید.

راه حل نهایی در دسترس است انبار کاه و حکیم ساز مخزن و از وب سایت OpenSearch و مستندات (برای OpenSearch 2.7) به عنوان داده های نمونه ما برای انجام بازیابی پاسخ سوالات تکمیل شده استفاده می کند.

پیش نیازها

اولین کاری که قبل از اینکه بتوانیم از خدمات AWS استفاده کنیم این است که مطمئن شویم در AWS ثبت نام کرده ایم و یک حساب AWS ایجاد کرده ایم. سپس باید یک کاربر و گروه مدیریت ایجاد کنید. برای دستورالعمل های مربوط به هر دو مرحله، مراجعه کنید پیش نیازهای Amazon SageMaker را تنظیم کنید.

برای اینکه بتوانید از Haystack استفاده کنید، باید آن را نصب کنید farm-haystack بسته با وابستگی های مورد نیاز برای انجام این کار، از requirements.txt فایل در مخزن GitHub با دویدن pip install requirements.txt.

فهرست اسناد به OpenSearch

Haystack تعدادی اتصال دهنده به پایگاه های داده ارائه می دهد که به آنها می گویند DocumentStores. برای این گردش کار RAG، ما از OpenSearchDocumentStore. مثال مخزن شامل خط لوله نمایه سازی و AWS CloudFormation قالب راه اندازی یک OpenSearchDocumentStore با اسنادی که از وب سایت OpenSearch و صفحات اسناد خزیده شده اند.

اغلب، برای اینکه یک برنامه NLP برای موارد استفاده تولیدی کار کند، در نهایت باید به آماده سازی و تمیز کردن داده ها فکر کنیم. این پوشیده شده است خطوط لوله نمایه سازی انبار کاه، که به شما امکان می دهد مراحل آماده سازی داده های خود را طراحی کنید که در نهایت اسناد شما را در پایگاه داده انتخابی شما می نویسند.

خط لوله نمایه سازی همچنین ممکن است شامل مرحله ای برای ایجاد جاسازی برای اسناد شما باشد. این برای مرحله بازیابی بسیار مهم است. در مثال خود ما استفاده می کنیم جمله-transformers/all-MiniLM-L12-v2 به عنوان مدل جاسازی ما. این مدل برای ایجاد جاسازی برای تمام اسناد نمایه شده ما، و همچنین درخواست کاربر در زمان پرس و جو استفاده می شود.

برای فهرست کردن اسناد در OpenSearchDocumentStore، ما دو گزینه را با دستورالعمل های دقیق در ارائه می دهیم README مخزن نمونه در اینجا، مراحل نمایه سازی به یک سرویس OpenSearch مستقر در AWS را طی می کنیم.

یک سرویس OpenSearch را راه اندازی کنید

ارائه شده استفاده کنید قالب CloudFormation برای راه اندازی یک سرویس OpenSearch در AWS. با اجرای دستور زیر، یک سرویس OpenSearch خالی خواهید داشت. سپس می توانید داده های نمونه ای را که ارائه کرده ایم فهرست بندی کنید یا از داده های خود استفاده کنید، که می توانید با استفاده از خط لوله نمایه سازی انبار کاه. توجه داشته باشید که این یک نمونه را ایجاد می کند که برای اینترنت باز است، که برای استفاده در تولید توصیه نمی شود.

تقریباً 30 دقیقه زمان بگذارید تا راه اندازی پشته کامل شود. میتوانید پیشرفت آن را در کنسول AWS CloudFormation با پیمایش به آن بررسی کنید پشته صفحه و به دنبال پشته نامگذاری شده است HaystackOpensearch.

اسناد را در OpenSearch فهرست کنید

اکنون که یک سرویس OpenSearch در حال اجرا داریم، می توانیم از کلاس OpenSearchDocumentStore برای اتصال به آن استفاده کرده و اسناد خود را در آن بنویسیم.

برای دریافت نام میزبان برای OpenSearch، دستور زیر را اجرا کنید:

ابتدا موارد زیر را صادر کنید:

سپس، می توانید از opensearch_indexing_pipeline.py اسکریپت برای پیش پردازش و نمایه سازی داده های آزمایشی ارائه شده.

اگر می خواهید از داده های خود استفاده کنید، خط لوله نمایه سازی را تغییر دهید opensearch_indexing_pipeline.py شامل شود تبدیل فایل و پیش پردازنده مراحل تنظیم مورد نیاز شما

خط لوله پاسخگویی به سؤالات افزوده بازیابی را پیاده سازی کنید

اکنون که دادهها را در OpenSearch نمایهسازی کردهایم، میتوانیم پاسخگویی به این اسناد را انجام دهیم. برای این خط لوله RAG، ما از مدل دستورالعمل Falcon-40b استفاده می کنیم که در SageMaker JumpStart به کار گرفته ایم.

شما همچنین می توانید مدل را به صورت برنامه ریزی شده از یک نوت بوک Jupyter اجرا کنید. برای دستورالعمل، به GitHub repo.

- مدل Falcon-40b-instruct را در SageMaker JumpStart جستجو کنید.

- مدل خود را در SageMaker JumpStart مستقر کنید و به نام نقطه پایانی توجه داشته باشید.

- مقادیر زیر را صادر کنید:

- دویدن

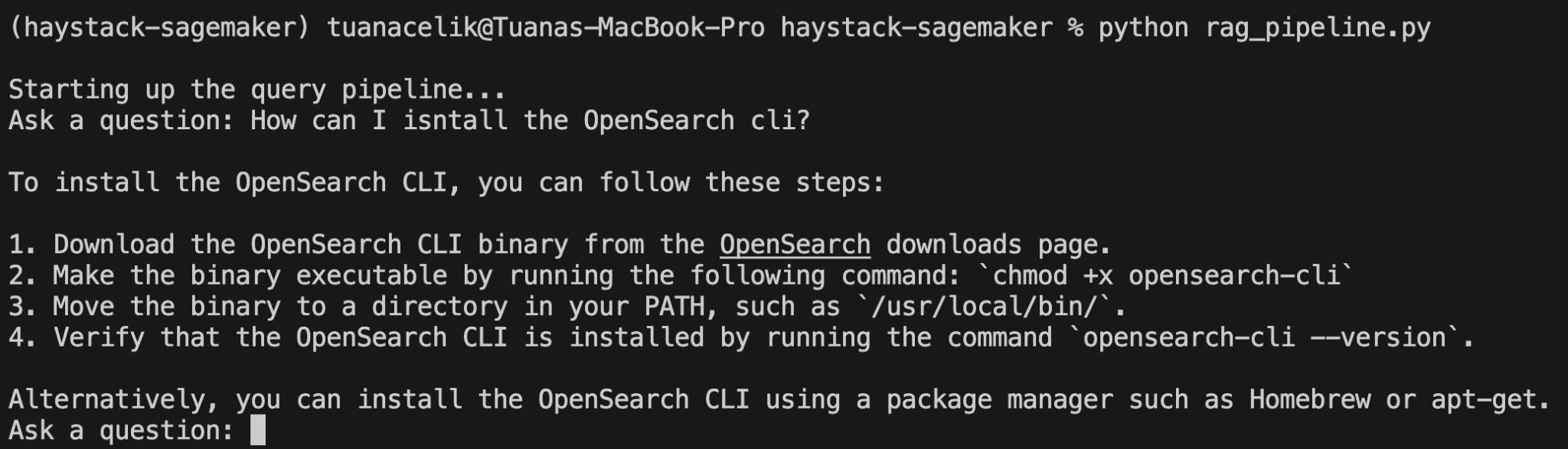

python rag_pipeline.py.

این یک ابزار خط فرمان را شروع می کند که منتظر سؤال کاربر است. به عنوان مثال، بیایید بپرسیم "چگونه می توانم cli OpenSearch را نصب کنم؟"

این نتیجه به این دلیل به دست می آید که ما دستور خود را در آن تعریف کرده ایم Haystack PromptTemplate به شرح زیر باشد:

سفارشی سازی های بیشتر

شما می توانید سفارشی سازی های اضافی را برای عناصر مختلف در راه حل انجام دهید، مانند موارد زیر:

- داده - ما OpenSearch را ارائه کرده ایم مستندات و سایت اینترنتی داده ها به عنوان داده های نمونه به یاد داشته باشید که آن را اصلاح کنید

opensearch_indexing_pipeline.pyاسکریپت متناسب با نیازهای شما اگر تصمیم گرفتید از داده های خود استفاده کنید. - مدل – در این مثال، ما از مدل دستورالعمل Falcon-40b استفاده کردهایم. شما آزاد هستید که هر مدل Hugging Face دیگری را در SageMaker استقرار و استفاده کنید. توجه داشته باشید که تغییر یک مدل احتمالاً به این معنی است که شما باید درخواست خود را با چیزی که برای مدیریت آن طراحی شده است تطبیق دهید.

- اعلان - برای این پست، پست خود را ایجاد کردیم

PromptTemplateکه به مدل دستور می دهد تا بر اساس زمینه ارائه شده به سؤالات پاسخ دهد و اگر زمینه شامل اطلاعات مرتبط نباشد، به «نمی دانم» پاسخ دهد. میتوانید این دستور را تغییر دهید تا با دستور Falcon-40b، با دستورات مختلف آزمایش کنید. شما همچنین میتوانید به سادگی برخی از درخواستهای ما را از قسمت خارج کنید PromptHub. - مدل تعبیه - برای مرحله بازیابی، از مدل تعبیه سبک وزن استفاده می کنیم: جمله-transformers/all-MiniLM-L12-v2. با این حال، شما همچنین ممکن است این را به نیازهای خود تغییر دهید. به یاد داشته باشید که ابعاد تعبیه مورد انتظار را در خود تغییر دهید

DocumentStoreبر این اساس. - تعداد اسناد بازیابی شده - همچنین می توانید با تعداد اسنادی که از آنها می خواهید بازی کنید

EmbeddingRetrieverبرای بازیابی برای هر پرس و جو در تنظیمات ما، این تنظیم شده است top_k=5. می توانید با تغییر این شکل آزمایش کنید تا ببینید آیا ارائه زمینه بیشتر دقت نتایج شما را بهبود می بخشد یا خیر.

آمادگی تولید

راه حل پیشنهادی در این پست می تواند زمان رسیدن به ارزش فرآیند توسعه پروژه را تسریع بخشد. میتوانید پروژهای بسازید که مقیاسپذیری آن با محیط امنیتی و حریم خصوصی در AWS Cloud آسان باشد.

برای امنیت و حفظ حریم خصوصی، OpenSearch Service حفاظت از داده ها را با آن فراهم می کند هویت و مدیریت دسترسی و پیشگیری از پروکسی گیج کننده سرویس متقابل. شما می توانید از کنترل دسترسی کاربر دقیق استفاده کنید تا کاربر فقط بتواند به داده هایی که مجاز به دسترسی است دسترسی داشته باشد. علاوه بر این، SageMaker تنظیمات امنیتی قابل تنظیم را برای آن فراهم می کند کنترل دسترسی, حفاظت از داده هاو ثبت و نظارت. شما می توانید از داده های خود در حالت استراحت و حمل و نقل محافظت کنید سرویس مدیریت کلید AWS کلیدهای (AWS KMS). همچنین میتوانید گزارش استقرار مدل SageMaker یا دسترسی نقطه پایانی را با استفاده از آن ردیابی کنید CloudWatch آمازون. برای اطلاعات بیشتر مراجعه کنید Amazon SageMaker را با Amazon CloudWatch مانیتور کنید.

برای مقیاسپذیری بالا در سرویس OpenSearch، میتوانید آن را با تنظیم کنید اندازه دامنه های سرویس OpenSearch خود را تعیین کنید و به کارگیری بهترین شیوه های عملیاتی. همچنین میتوانید از مقیاس خودکار نقطه پایانی SageMaker خود استفاده کنید—شما میتوانید مقیاس خودکار مدل های SageMaker برای تنظیم نقطه پایانی چه زمانی که ترافیک افزایش یافته و چه از منابع استفاده نمی شود.

پاک کردن

برای صرفه جویی در هزینه ها، تمام منابعی را که به عنوان بخشی از این پست استفاده کرده اید حذف کنید. اگر پشته CloudFormation را راه اندازی کرده اید، می توانید آن را از طریق کنسول AWS CloudFormation حذف کنید. به طور مشابه، می توانید هر نقطه پایانی SageMaker را که ممکن است از طریق کنسول SageMaker ایجاد کرده باشید، حذف کنید.

نتیجه

در این پست، نحوه ساختن یک برنامه هوش مصنوعی مولد سرتاسر برای جستجوی سازمانی با RAG با استفاده از خطوط لوله Haystack و مدل Falcon-40b-instruct از SageMaker JumpStart و OpenSearch Service را به نمایش گذاشتیم. رویکرد RAG در جستجوی سازمانی بسیار مهم است زیرا تضمین میکند که پاسخهای ایجاد شده درون دامنه هستند و بنابراین توهمات را کاهش میدهند. با استفاده از خطوط لوله Haystack، ما قادریم برنامه های LLM را که از اجزای مختلف مانند مدل ها و پایگاه های داده برداری تشکیل شده اند، هماهنگ کنیم. SageMaker JumpStart راه حلی با یک کلیک برای استقرار LLM در اختیار ما قرار می دهد و ما از OpenSearch Service به عنوان پایگاه داده برداری برای داده های نمایه شده خود استفاده کردیم. میتوانید با استفاده از مراحل ذکر شده در این پست و کد منبع موجود در برنامههای کاربردی هوش مصنوعی شرکتی خود، آزمایش و ساختن شواهد مفهومی RAG را آغاز کنید. مخزن GitHub.

درباره نویسنده

توانا چلیک مدافع اصلی توسعه دهنده در عمق است، جایی که او بر روی جامعه منبع باز برای Haystack تمرکز می کند. او عملکرد روابط توسعهدهنده را رهبری میکند و به طور منظم در رویدادهایی درباره NLP صحبت میکند و مطالب آموزشی برای جامعه ایجاد میکند.

توانا چلیک مدافع اصلی توسعه دهنده در عمق است، جایی که او بر روی جامعه منبع باز برای Haystack تمرکز می کند. او عملکرد روابط توسعهدهنده را رهبری میکند و به طور منظم در رویدادهایی درباره NLP صحبت میکند و مطالب آموزشی برای جامعه ایجاد میکند.

روی آللا یک معمار ارشد راه حل های تخصصی AI/ML در AWS مستقر در مونیخ، آلمان است. روی به مشتریان AWS - از استارتآپهای کوچک گرفته تا شرکتهای بزرگ - کمک میکند تا مدلهای زبان بزرگ را بهطور کارآمد در AWS آموزش داده و به کار گیرند. روی مشتاق مشکلات بهینهسازی محاسباتی و بهبود عملکرد بارهای کاری هوش مصنوعی است.

روی آللا یک معمار ارشد راه حل های تخصصی AI/ML در AWS مستقر در مونیخ، آلمان است. روی به مشتریان AWS - از استارتآپهای کوچک گرفته تا شرکتهای بزرگ - کمک میکند تا مدلهای زبان بزرگ را بهطور کارآمد در AWS آموزش داده و به کار گیرند. روی مشتاق مشکلات بهینهسازی محاسباتی و بهبود عملکرد بارهای کاری هوش مصنوعی است.

میا چانگ یک معمار راه حل های تخصصی ML برای خدمات وب آمازون است. او با مشتریان در EMEA کار میکند و بهترین شیوهها را برای اجرای بارهای کاری AI/ML در فضای ابری با سابقهاش در ریاضیات کاربردی، علوم کامپیوتر، و AI/ML به اشتراک میگذارد. او بر حجم کاری خاص NLP تمرکز می کند و تجربه خود را به عنوان سخنران کنفرانس و نویسنده کتاب به اشتراک می گذارد. او در اوقات فراغت خود از پیاده روی، بازی های رومیزی و دم کردن قهوه لذت می برد.

میا چانگ یک معمار راه حل های تخصصی ML برای خدمات وب آمازون است. او با مشتریان در EMEA کار میکند و بهترین شیوهها را برای اجرای بارهای کاری AI/ML در فضای ابری با سابقهاش در ریاضیات کاربردی، علوم کامپیوتر، و AI/ML به اشتراک میگذارد. او بر حجم کاری خاص NLP تمرکز می کند و تجربه خود را به عنوان سخنران کنفرانس و نویسنده کتاب به اشتراک می گذارد. او در اوقات فراغت خود از پیاده روی، بازی های رومیزی و دم کردن قهوه لذت می برد.

انعام سید یک معمار راهحلهای راهاندازی در AWS است که تمرکز زیادی بر کمک به استارتآپهای B2B و SaaS در مقیاسبندی و دستیابی به رشد دارد. او علاقه عمیقی به معماری های بدون سرور و AI/ML دارد. Inaam در اوقات فراغت خود از لحظات با کیفیتی در کنار خانواده خود لذت می برد و در عشق خود به دوچرخه سواری و بدمینتون غرق می شود.

انعام سید یک معمار راهحلهای راهاندازی در AWS است که تمرکز زیادی بر کمک به استارتآپهای B2B و SaaS در مقیاسبندی و دستیابی به رشد دارد. او علاقه عمیقی به معماری های بدون سرور و AI/ML دارد. Inaam در اوقات فراغت خود از لحظات با کیفیتی در کنار خانواده خود لذت می برد و در عشق خود به دوچرخه سواری و بدمینتون غرق می شود.

دیوید تیپت مدافع توسعهدهنده ارشد است که روی OpenSearch منبع باز در AWS کار میکند. کار او شامل همه حوزههای OpenSearch از جستجو و ارتباط گرفته تا قابلیت مشاهده و تجزیه و تحلیل امنیتی است.

دیوید تیپت مدافع توسعهدهنده ارشد است که روی OpenSearch منبع باز در AWS کار میکند. کار او شامل همه حوزههای OpenSearch از جستجو و ارتباط گرفته تا قابلیت مشاهده و تجزیه و تحلیل امنیتی است.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. خودرو / خودروهای الکتریکی، کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- ChartPrime. بازی معاملاتی خود را با ChartPrime ارتقا دهید. دسترسی به اینجا.

- BlockOffsets. نوسازی مالکیت افست زیست محیطی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- قادر

- درباره ما

- شتاب دادن

- دسترسی

- انجام دادن

- بر این اساس

- حساب

- دقت

- رسیدن

- دست

- دستیابی به

- اعمال

- وفق دادن

- اضافی

- علاوه بر این

- اداری

- مزیت - فایده - سود - منفعت

- ظهور

- مدافع

- AI

- AI / ML

- معرفی

- اجازه دادن

- اجازه می دهد تا

- در امتداد

- همچنین

- هر چند

- آمازون

- آمازون SageMaker

- Amazon SageMaker JumpStart

- آمازون خدمات وب

- در میان

- an

- علم تجزیه و تحلیل

- و

- پاسخ

- هر

- آپاچی

- کاربرد

- برنامه های کاربردی

- اعمال می شود

- روش

- تقریبا

- هستند

- مناطق

- دور و بر

- صف

- هنر

- مقالات

- AS

- کمک کردن

- At

- سمعی

- افزوده شده

- نویسنده

- مجاز

- خودکار

- در دسترس

- AWS

- AWS CloudFormation

- B2B

- زمینه

- پایه

- مستقر

- BE

- زیرا

- شدن

- قبل از

- بودن

- در زیر

- بهترین

- بهترین شیوه

- بزرگ

- بلاگ

- تخته

- بازی ها و بنگاه

- بدن

- کتاب

- هر دو

- پهن

- ساختن

- بنا

- ساخته

- بسته

- اما

- دکمه

- by

- نام

- CAN

- قابلیت های

- موارد

- تغییر دادن

- متغیر

- بررسی

- انتخاب

- را انتخاب کنید

- انتخاب

- را انتخاب

- کلاس

- تمیز کاری

- نزدیک

- ابر

- رمز

- کشت

- مشترک

- انجمن

- شرکت

- متمم

- کامل

- جزء

- اجزاء

- شامل

- کامپیوتر

- علم کامپیوتر

- مفهوم

- کنفرانس

- اشتباه

- اتصال

- با توجه به

- کنسول

- موجود

- محتوا

- زمینه

- کنترل

- محاورهای

- هوش مصنوعی محاوره ای

- هزینه

- پوشش داده شده

- را پوشش می دهد

- ایجاد

- ایجاد شده

- ایجاد

- بحرانی

- مشتریان

- داده ها

- آماده سازی داده ها

- حفاظت از داده ها

- پایگاه داده

- پایگاه های داده

- DBS

- مقدار

- عمیق

- یادگیری عمیق

- مشخص

- نسخه ی نمایشی

- وابستگی

- گسترش

- مستقر

- استقرار

- گسترش

- طرح

- طراحی

- طراحی

- دقیق

- توسعه

- توسعه دهنده

- توسعه دهندگان

- پروژه

- مختلف

- دیجیتال

- دیجیتالی شدن

- ابعاد

- مستقیم

- do

- سند

- مستندات

- اسناد و مدارک

- میکند

- نمی کند

- دان

- آیا

- هر

- ساده

- بهره وری

- موثر

- موثر

- هر دو

- عناصر

- جاسازی کردن

- جاسازی شده

- تعبیه کردن

- EMEA

- قادر ساختن

- پایان

- پشت سر هم

- نقطه پایانی

- موتورهای حرفه ای

- بالا بردن

- اطمینان حاصل شود

- تضمین می کند

- سرمایه گذاری

- اشخاص

- موجودیت

- محیط

- ارزیابی

- حوادث

- همه چیز

- مثال

- انتظار می رود

- تجربه

- تجارب

- تجربه

- صادرات

- خارجی

- چهره

- خانواده

- شکل

- پرونده

- فایل ها

- فیلتر

- نهایی

- نام خانوادگی

- مناسب

- قابل انعطاف

- انعطاف پذیر

- تمرکز

- تمرکز

- پیروی

- برای

- قالب

- پایه

- چارچوب

- رایگان

- از جانب

- کاملا

- تابع

- بازیها

- تولید می کنند

- تولید

- تولید می کند

- نسل

- مولد

- هوش مصنوعی مولد

- آلمان

- دریافت کنید

- داده

- گروه

- رشد

- دسته

- آیا

- داشتن

- he

- کمک می کند

- او

- اینجا کلیک نمایید

- زیاد

- در سطح بالا

- خیلی

- خود را

- میزبان

- چگونه

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- قطب

- i

- هویت

- if

- تأثیر

- انجام

- مهم

- بهبود

- in

- شامل

- شامل

- از جمله

- افزایش

- به طور فزاینده

- شاخص

- نمایه شده

- فهرستها

- اطلاعات

- شالوده

- ورودی

- نصب

- نمونه

- دستورالعمل

- اینترنت

- به

- IT

- ITS

- JPG

- کلید

- کلید

- دانستن

- دانش

- مدیریت دانش

- زبان

- بزرگ

- راه اندازی

- راه اندازی

- رهبری

- منجر می شود

- یادگیری

- مجوز

- مجاز

- سبک وزن

- پسندیدن

- احتمالا

- محدود

- محدودیت

- لاین

- LLM

- ورود به سیستم

- ورود به سیستم

- به دنبال

- عشق

- دستگاه

- فراگیری ماشین

- ساخته

- ساخت

- باعث می شود

- ساخت

- مدیریت

- اداره می شود

- مدیریت

- مصالح

- ریاضیات

- بیشترین

- ممکن است..

- متوسط

- رسانه ها

- روش

- متریک

- میلیون ها نفر

- دقیقه

- تسکین دهنده

- ML

- مدل

- مدل

- تغییر

- ماژول ها

- لحظه

- نظارت بر

- بیش

- اکثر

- حرکت

- نام

- تحت عنوان

- طبیعی

- پردازش زبان طبیعی

- پیمایش

- نیاز

- نیازهای

- nlp

- دفتر یادداشت

- عدد

- of

- ارائه

- پیشنهادات

- on

- فقط

- باز کن

- منبع باز

- نرم افزار منبع باز

- کار

- بهینه سازی

- گزینه

- گزینه

- or

- سازمانی

- سازمان یافته

- اصلی

- دیگر

- ما

- مشخص شده

- روی

- خود

- بسته

- با ما

- صفحات

- بخش

- شرکای

- شور

- احساساتی

- انجام

- کارایی

- خط لوله

- افلاطون

- هوش داده افلاطون

- PlatoData

- بازی

- لطفا

- نقطه

- محبوب

- پست

- قوی

- شیوه های

- تهیه

- آماده

- خلوت

- مشکلات

- روند

- در حال پردازش

- تولید

- پیشرفت

- پروژه

- اثبات

- پیشنهاد شده

- اختصاصی

- محافظت از

- حفاظت

- نمونه اولیه

- ارائه

- ارائه

- فراهم می کند

- ارائه

- پروکسی

- عمومی

- فشار

- کیفیت

- نمایش ها

- سوال

- سوالات

- خام

- اخذ شده

- اخیر

- توصیه

- توصیه می شود

- به طور منظم

- روابط

- ربط

- مربوط

- قابل اعتماد

- به یاد داشته باشید

- مخزن

- درخواست

- نیاز

- ضروری

- مورد نیاز

- منابع

- پاسخ

- پاسخ

- REST

- محدود کردن

- نتیجه

- نتایج

- بازده

- غنی

- راست

- روی

- دویدن

- در حال اجرا

- SAAS

- حکیم ساز

- ذخیره

- گفتن

- مقیاس پذیری

- مقیاس پذیر

- مقیاس

- مقیاس گذاری

- علم

- جستجو

- تیم امنیت لاتاری

- دیدن

- ارسال

- می فرستد

- ارشد

- بدون سرور

- خدمت

- سرویس

- خدمات

- تنظیم

- تنظیمات

- برپایی

- شکل

- سهام

- او

- کشتی

- باید

- نشان

- نمایشگاه

- نمایش داده شده

- امضاء شده

- مشابه

- به طور مشابه

- ساده

- به سادگی

- کوچک

- So

- نرم افزار

- فقط

- جامد

- راه حل

- مزایا

- برخی از

- چیزی

- منبع

- کد منبع

- فضا

- گوینده

- صحبت می کند

- متخصص

- تخصصی

- ثبات

- پشته

- صحنه

- شروع

- شروع

- نوپا

- گام

- مراحل

- ذخیره سازی

- قوی

- ساختار

- چنین

- دنباله

- مطمئن

- گرفتن

- طول می کشد

- تکنیک

- قالب

- آزمایش

- که

- La

- منبع

- آنها

- سپس

- در نتیجه

- از این رو

- اینها

- آنها

- چیز

- فکر می کنم

- این

- هزاران نفر

- از طریق

- زمان

- به

- با هم

- مسیر

- ترافیک

- عبور

- قابل اعتماد

- دو

- نوع

- به طور معمول

- در نهایت

- زیر

- آپلود شده

- us

- استفاده کنید

- استفاده

- کاربر

- کاربران

- استفاده

- با استفاده از

- سودمندی

- ارزش

- ارزشها

- مختلف

- از طريق

- دید

- منتظر است

- we

- وب

- خدمات وب

- سایت اینترنتی

- چه زمانی

- که

- اراده

- با

- در داخل

- کلمه

- مهاجرت کاری

- گردش کار

- کارگر

- با این نسخهها کار

- خواهد بود

- نوشتن

- یامل

- سال

- شما

- شما

- زفیرنت