آمازون Redshift محبوب ترین انبار داده ابری است که روزانه ده ها هزار مشتری از آن برای تجزیه و تحلیل اگزابایت داده استفاده می کنند. بسیاری از پزشکان در حال گسترش این مجموعه داده های Redshift در مقیاس برای یادگیری ماشین (ML) هستند آمازون SageMaker، یک سرویس ML کاملاً مدیریت شده، با الزامات توسعه ویژگیهای آفلاین به روش کد یا کم کد/بدون کد، ذخیره دادههای ویژه از Amazon Redshift و انجام این کار در مقیاس در یک محیط تولید.

در این پست، ما سه گزینه برای آماده سازی داده های منبع Redshift در مقیاس در SageMaker را به شما نشان می دهیم، از جمله بارگیری داده ها از Amazon Redshift، انجام مهندسی ویژگی ها و جذب ویژگی ها در فروشگاه ویژگی آمازون SageMaker:

اگر کاربر AWS Glue هستید و میخواهید این فرآیند را به صورت تعاملی انجام دهید، گزینه A را در نظر بگیرید. اگر با SageMaker و نوشتن کد Spark آشنایی دارید، گزینه B میتواند انتخاب شما باشد. اگر میخواهید فرآیند را به روشی کمکد/بدون کد انجام دهید، میتوانید گزینه C را دنبال کنید.

Amazon Redshift از SQL برای تجزیه و تحلیل دادههای ساختاریافته و نیمه ساختاریافته در انبارهای داده، پایگاههای داده عملیاتی و دریاچههای داده، با استفاده از سختافزار طراحیشده توسط AWS و ML استفاده میکند تا بهترین عملکرد قیمتی را در هر مقیاسی ارائه دهد.

SageMaker Studio اولین محیط توسعه کاملاً یکپارچه (IDE) برای ML است. این یک رابط بصری مبتنی بر وب فراهم می کند که در آن می توانید تمام مراحل توسعه ML را انجام دهید، از جمله تهیه داده ها و ساخت، آموزش و استقرار مدل ها.

AWS Glue یک سرویس یکپارچه سازی داده بدون سرور است که کشف، آماده سازی و ترکیب داده ها را برای تجزیه و تحلیل، ML و توسعه برنامه آسان می کند. چسب AWS شما را قادر میسازد تا با استفاده از قابلیتهای مختلف، دادهها را بهطور یکپارچه جمعآوری، تبدیل، پاکسازی و آمادهسازی برای ذخیرهسازی در دریاچههای داده و خطوط لوله داده خود کنید. تبدیل های داخلی.

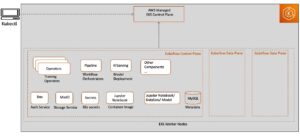

بررسی اجمالی راه حل

نمودار زیر معماری راه حل برای هر گزینه را نشان می دهد.

پیش نیازها

برای ادامه مثال های این پست، باید منابع AWS مورد نیاز را ایجاد کنید. برای انجام این کار، ما یک AWS CloudFormation قالبی برای ایجاد پشته ای که حاوی منابع است. هنگامی که پشته را ایجاد می کنید، AWS تعدادی منبع در حساب شما ایجاد می کند:

- یک دامنه SageMaker، که شامل یک مرتبط است سیستم فایل الاستیک آمازون حجم (Amazon EFS).

- لیستی از کاربران مجاز و انواع امنیت، برنامه، سیاست، و ابر خصوصی مجازی آمازون تنظیمات (Amazon VPC).

- یک خوشه Redshift

- راز Redshift

- اتصال AWS Glue برای Amazon Redshift

- An AWS لامبدا برای تنظیم منابع، نقش های اجرایی و سیاست های مورد نیاز

مطمئن شوید که قبلاً دو دامنه SageMaker Studio در منطقه ای که در آن الگوی CloudFormation را اجرا می کنید ندارید. این حداکثر تعداد مجاز دامنه در هر منطقه پشتیبانی شده است.

قالب CloudFormation را مستقر کنید

مراحل زیر را برای استقرار الگوی CloudFormation تکمیل کنید:

- قالب CloudFormation را ذخیره کنید sm-redshift-demo-vpc-cfn-v1.yaml محلی

- در کنسول AWS CloudFormation، را انتخاب کنید پشته ایجاد کنید.

- برای قالب را آماده کنید، انتخاب کنید قالب آماده است.

- برای منبع قالب، انتخاب کنید یک فایل قالب بارگذاری کنید.

- را انتخاب کنید انتخاب فایل و به مکانی در رایانه خود که قالب CloudFormation در آن بارگیری شده است بروید و فایل را انتخاب کنید.

- یک نام پشته وارد کنید، مانند

Demo-Redshift. - بر پیکربندی گزینه های پشته صفحه، همه چیز را به عنوان پیش فرض بگذارید و انتخاب کنید بعدی.

- بر مرور صفحه، را انتخاب کنید من تصدیق می کنم که AWS CloudFormation ممکن است منابع IAM را با نام های سفارشی ایجاد کند و انتخاب کنید پشته ایجاد کنید.

باید یک پشته جدید CloudFormation با نام ببینید Demo-Redshift در حال ایجاد منتظر بمانید تا وضعیت پشته باشد CREATE_COMPLETE (تقریباً 7 دقیقه) قبل از حرکت. می توانید به پشته ها بروید منابع برای بررسی اینکه چه منابع AWS ایجاد شده اند را برگه بزنید.

SageMaker Studio را راه اندازی کنید

مراحل زیر را برای راه اندازی دامنه SageMaker Studio خود انجام دهید:

- در کنسول SageMaker، را انتخاب کنید دامنه در صفحه ناوبری

- دامنه ای را که ایجاد کرده اید به عنوان بخشی از پشته CloudFormation انتخاب کنید (

SageMakerDemoDomain). - را انتخاب کنید راه اندازی و استودیو

وقتی برای اولین بار به استودیوی SageMaker دسترسی پیدا می کنید، این صفحه ممکن است 1 تا 2 دقیقه طول بکشد، و پس از آن به یک صفحه هدایت می شوید. صفحه اصلی تب.

مخزن GitHub را دانلود کنید

مراحل زیر را برای دانلود مخزن GitHub انجام دهید:

- در نوت بوک SageMaker، در پرونده منو ، انتخاب کنید جدید و پایانه.

- در ترمینال دستور زیر را وارد کنید:

اکنون می توانید ببینید amazon-sagemaker-featurestore-redshift-integration پوشه در پنجره ناوبری SageMaker Studio.

مصرف دسته ای را با کانکتور Spark تنظیم کنید

مراحل زیر را برای تنظیم بلع دسته ای کامل کنید:

- در SageMaker Studio، نوت بوک را باز کنید 1-uploadJar.ipynb زیر

amazon-sagemaker-featurestore-redshift-integration. - اگر از شما خواسته شد که یک هسته را انتخاب کنید، انتخاب کنید علم اطلاعات به عنوان تصویر و پایتون 3 به عنوان هسته، سپس انتخاب کنید انتخاب کنید.

- برای نوتبوکهای زیر، همان تصویر و هسته را به جز نوتبوک AWS Glue Interactive Sessions (4a) انتخاب کنید.

- سلول ها را با فشار دادن اجرا کنید Shift + Enter در هر یک از سلول ها

در حالی که کد اجرا می شود، یک ستاره (*) بین پرانتز ظاهر می شود. هنگامی که اجرای کد به پایان رسید، * با اعداد جایگزین می شود. این عمل برای تمام نوت بوک های دیگر نیز قابل اجرا است.

طرح واره را تنظیم کنید و داده ها را در Amazon Redshift بارگیری کنید

مرحله بعدی تنظیم طرح و بارگذاری داده ها از آن است سرویس ذخیره سازی ساده آمازون (Amazon S3) به Amazon Redshift. برای انجام این کار، نوت بوک را اجرا کنید 2-loadredshiftdata.ipynb.

فروشگاه های ویژگی را در فروشگاه ویژگی SageMaker ایجاد کنید

برای ایجاد فروشگاه های ویژگی خود، نوت بوک را اجرا کنید 3-createFeatureStore.ipynb.

مهندسی ویژگی را انجام دهید و ویژگیها را در فروشگاه ویژگی SageMaker وارد کنید

در این بخش، مراحل هر سه گزینه برای انجام مهندسی ویژگی و ورود ویژگیهای پردازش شده به فروشگاه ویژگی SageMaker را ارائه میکنیم.

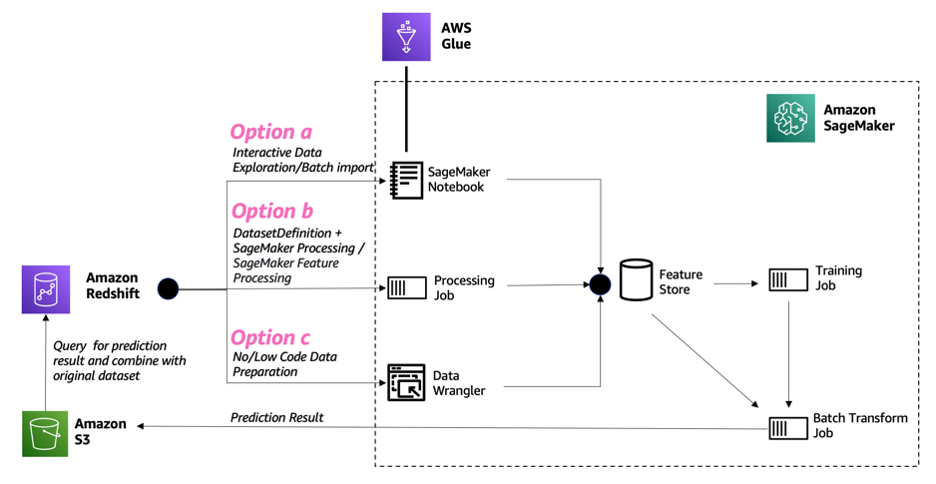

گزینه A: از SageMaker Studio با یک جلسه تعاملی AWS Glue بدون سرور استفاده کنید

برای گزینه A مراحل زیر را انجام دهید:

- در SageMaker Studio، نوت بوک را باز کنید 4a-glue-int-session.ipynb.

- اگر از شما خواسته شد که یک هسته را انتخاب کنید، انتخاب کنید SparkAnalytics 2.0 به عنوان تصویر و چسب پایتون [PySpark and Ray] به عنوان هسته، سپس انتخاب کنید انتخاب کنید.

فرآیند آماده سازی محیط ممکن است مدتی طول بکشد تا تکمیل شود.

گزینه B: از یک کار پردازش SageMaker با Spark استفاده کنید

در این گزینه، ما از یک کار پردازش SageMaker با یک اسکریپت Spark برای بارگیری مجموعه داده اصلی از Amazon Redshift، انجام مهندسی ویژگیها و ورود دادهها به SageMaker Feature Store استفاده میکنیم. برای انجام این کار، نوت بوک را باز کنید 4b-processing-rs-to-fs.ipynb در محیط SageMaker Studio شما.

در اینجا ما استفاده می کنیم RedshiftDatasetDefinition برای بازیابی مجموعه داده از خوشه Redshift. RedshiftDatasetDefinition یکی از انواع ورودی کار پردازش است که یک رابط ساده برای متخصصین فراهم می کند تا پارامترهای مرتبط با اتصال Redshift مانند شناسه، پایگاه داده، جدول، رشته جستجو و موارد دیگر را پیکربندی کنند. شما به راحتی می توانید اتصال Redshift خود را با استفاده از آن برقرار کنید RedshiftDatasetDefinition بدون حفظ اتصال تمام وقت ما نیز از کتابخانه اتصال SageMaker Feature Store Spark در کار پردازش برای اتصال به SageMaker Feature Store در یک محیط توزیع شده. با این رابط Spark، میتوانید به راحتی دادهها را از Spark DataFrame به فروشگاه آنلاین و آفلاین گروه ویژگی وارد کنید. همچنین، این رابط دارای قابلیت بارگیری خودکار تعاریف ویژگی ها برای کمک به ایجاد گروه های ویژگی است. مهمتر از همه، این راه حل به شما یک راه بومی Spark برای پیاده سازی خط لوله داده سرتاسر از Amazon Redshift به SageMaker را ارائه می دهد. شما می توانید هر مهندسی ویژگی را در زمینه Spark انجام دهید و ویژگی های نهایی را در فروشگاه ویژگی SageMaker فقط در یک پروژه Spark وارد کنید.

برای استفاده از کانکتور SageMaker Feature Store Spark، یک پیش ساخته را گسترش می دهیم ظرف SageMaker Spark با sagemaker-feature-store-pyspark نصب شده است. در اسکریپت Spark از دستور اجرایی سیستم برای اجرا استفاده کنید pip install، این کتابخانه را در محیط محلی خود نصب کنید و مسیر محلی وابستگی فایل JAR را دریافت کنید. در API کار پردازش، این مسیر را به پارامتر of ارائه دهید submit_jars به گره خوشه Spark که کار پردازش ایجاد می کند.

در اسکریپت Spark برای کار پردازش، ابتدا فایل های مجموعه داده اصلی را از Amazon S3 می خوانیم، که به طور موقت مجموعه داده های بارگیری نشده از Amazon Redshift را به عنوان یک رسانه ذخیره می کند. سپس مهندسی ویژگی را به روش Spark انجام می دهیم و استفاده می کنیم feature_store_pyspark برای وارد کردن داده ها به فروشگاه ویژگی های آفلاین.

برای کار پردازش، ما یک ProcessingInput با یک redshift_dataset_definition. در اینجا ما ساختاری را با توجه به رابط ایجاد می کنیم و تنظیمات مربوط به اتصال Redshift را ارائه می دهیم. شما می توانید استفاده کنید query_string برای فیلتر کردن مجموعه داده های خود بر اساس SQL و تخلیه آن در آمازون S3. کد زیر را ببینید:

برای هر کار پردازشی از جمله باید 6 تا 7 دقیقه صبر کنید USER, PLACEو RATING مجموعه داده ها

برای جزئیات بیشتر در مورد مشاغل SageMaker Processing، مراجعه کنید پردازش داده ها.

برای راهحلهای بومی SageMaker برای پردازش ویژگیهای Amazon Redshift نیز میتوانید استفاده کنید پردازش ویژگی در SageMaker Feature Store، که برای زیرساخت های اساسی از جمله فراهم کردن محیط های محاسباتی و ایجاد و نگهداری خطوط لوله SageMaker برای بارگیری و دریافت داده ها است. شما فقط می توانید بر روی تعاریف پردازنده ویژگی خود تمرکز کنید که شامل توابع تبدیل، منبع Amazon Redshift و سینک SageMaker Feature Store می شود. زمانبندی، مدیریت کار و سایر حجمهای کاری در تولید توسط SageMaker مدیریت میشوند. خطوط لوله پردازنده ویژگی، خطوط لوله SageMaker هستند، بنابراین مکانیزم های نظارت استاندارد و ادغام در دسترس هستند.

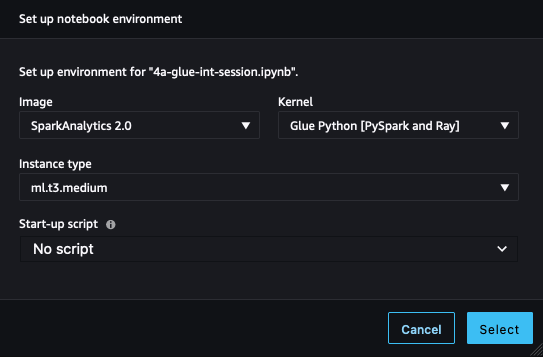

گزینه C: از SageMaker Data Wrangler استفاده کنید

SageMaker Data Wrangler به شما این امکان را می دهد که داده ها را از منابع داده مختلف از جمله Amazon Redshift وارد کنید تا روشی کم کد/بدون کد برای آماده سازی، تبدیل، و ویژگی داده های خود را وارد کنید. پس از اتمام آمادهسازی دادهها، میتوانید از SageMaker Data Wrangler برای صادرات ویژگیها به فروشگاه ویژگی SageMaker استفاده کنید.

وجود دارد هویت AWS و مدیریت دسترسی تنظیمات (IAM) که به SageMaker Data Wrangler اجازه میدهد به Amazon Redshift متصل شود. ابتدا یک نقش IAM ایجاد کنید (به عنوان مثال، redshift-s3-dw-connect) که شامل خط مشی دسترسی آمازون S3 است. برای این پست، ما آن را پیوست کردیم AmazonS3FullAccess سیاست به نقش IAM اگر برای دسترسی به یک سطل S3 مشخص محدودیت دارید، می توانید آن را در خط مشی دسترسی Amazon S3 تعریف کنید. ما نقش IAM را به خوشه Redshift که قبلا ایجاد کرده بودیم متصل کردیم. در مرحله بعد، یک خط مشی برای SageMaker ایجاد کنید تا با دریافت اعتبار کلاستر به Amazon Redshift دسترسی پیدا کند و این خط مشی را به نقش SageMaker IAM متصل کنید. این خط مشی شبیه کد زیر است:

پس از این راهاندازی، SageMaker Data Wrangler به شما اجازه میدهد تا Amazon Redshift را پرس و جو کنید و نتایج را در یک سطل S3 خروجی بگیرید. برای دستورالعملهای مربوط به اتصال به یک کلاستر Redshift و پرس و جو و وارد کردن دادهها از Amazon Redshift به SageMaker Data Wrangler، به وارد کردن داده ها از Amazon Redshift.

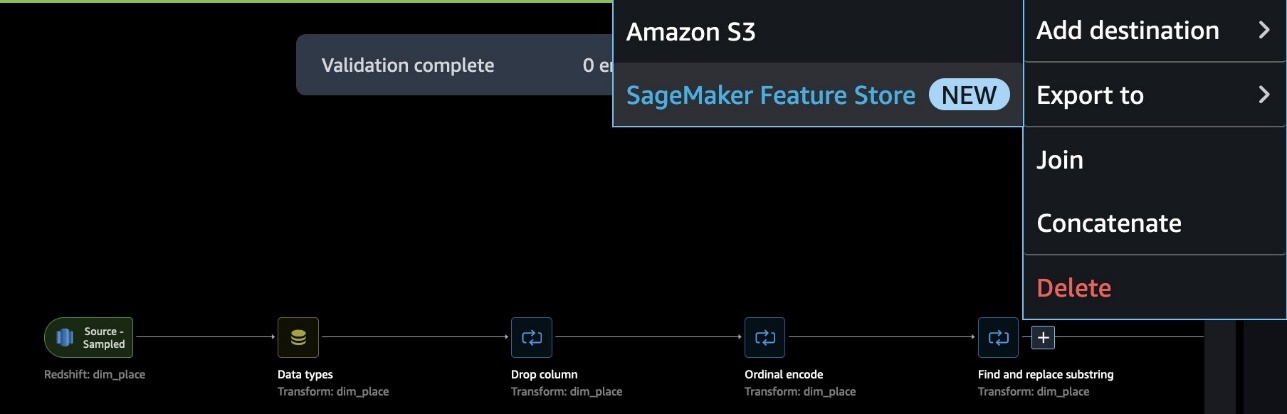

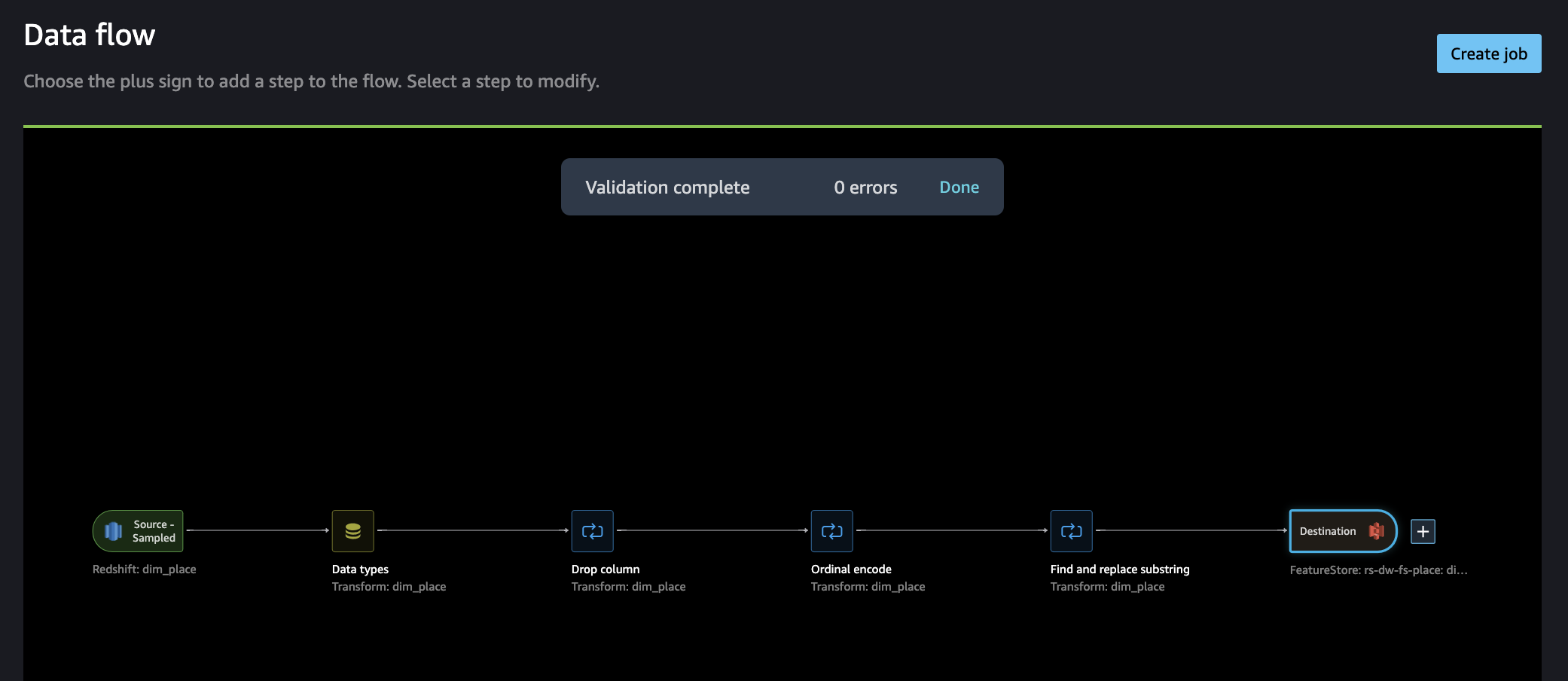

SageMaker Data Wrangler مجموعه ای از بیش از 300 تبدیل داده از پیش ساخته شده را برای موارد استفاده رایج مانند حذف ردیف های تکراری، منتسب کردن داده های از دست رفته، رمزگذاری یکباره، و مدیریت داده های سری زمانی ارائه می دهد. شما همچنین می توانید تبدیل های سفارشی را در پانداها یا PySpark اضافه کنید. در مثال ما، برخی از تبدیلها مانند ستون drop، اجرای نوع داده و رمزگذاری ترتیبی را روی دادهها اعمال کردیم.

هنگامی که جریان داده شما کامل شد، می توانید آن را به فروشگاه ویژگی SageMaker صادر کنید. در این مرحله، باید یک گروه ویژگی ایجاد کنید: به گروه ویژگی یک نام بدهید، فضای ذخیرهسازی آنلاین و آفلاین را انتخاب کنید، نام یک سطل S3 را برای استفاده برای فروشگاه آفلاین ارائه دهید، و نقشی را ارائه کنید که به فروشگاه ویژگی SageMaker دسترسی داشته باشد. . در نهایت، میتوانید یک کار ایجاد کنید، که یک کار پردازش SageMaker ایجاد میکند که جریان SageMaker Data Wrangler را اجرا میکند تا ویژگیها را از منبع داده Redshift به گروه ویژگی شما وارد کند.

در اینجا یک جریان داده سرتاسر در سناریوی مهندسی ویژگی PLACE آمده است.

از SageMaker Feature Store برای آموزش و پیش بینی مدل استفاده کنید

برای استفاده از فروشگاه ویژگی SageMaker برای آموزش مدل و پیش بینی، نوت بوک را باز کنید 5-classification-using-feature-groups.ipynb.

پس از تبدیل دادههای Redshift به ویژگیها و ورود به SageMaker Feature Store، ویژگیها برای جستجو و کشف در میان تیمهایی از دانشمندان داده که مسئول بسیاری از مدلهای مستقل ML و موارد استفاده هستند در دسترس هستند. این تیم ها می توانند بدون نیاز به بازسازی یا اجرای مجدد خطوط لوله مهندسی ویژگی از ویژگی ها برای مدل سازی استفاده کنند. گروههای ویژگی بهطور مستقل مدیریت و مقیاسبندی میشوند و میتوانند بدون در نظر گرفتن منبع داده بالادستی مورد استفاده مجدد قرار گیرند و به یکدیگر متصل شوند.

مرحله بعدی ساخت مدل های ML با استفاده از ویژگی های انتخاب شده از یک یا چند گروه ویژگی است. شما تصمیم می گیرید که از کدام گروه های ویژگی برای مدل های خود استفاده کنید. دو گزینه برای ایجاد یک مجموعه داده ML از گروه های ویژگی وجود دارد که هر دو از SageMaker Python SDK استفاده می کنند:

- از SageMaker Feature Store DatasetBuilder API استفاده کنید – فروشگاه ویژگی SageMaker

DatasetBuilderAPI به دانشمندان داده اجازه می دهد مجموعه داده های ML را از یک یا چند گروه ویژگی در فروشگاه آفلاین ایجاد کنند. می توانید از API برای ایجاد یک مجموعه داده از یک یا چند گروه ویژگی استفاده کنید و آن را به عنوان یک فایل CSV یا یک پاندای DataFrame خروجی بگیرید. کد نمونه زیر را ببینید:

- پرس و جوهای SQL را با استفاده از تابع athena_query در FeatureGroup API اجرا کنید – گزینه دیگر استفاده از کاتالوگ داده چسب AWS ساخته شده برای API FeatureGroup است. FeatureGroup API شامل یک

Athena_queryتابعی که یک نمونه AthenaQuery را برای اجرای رشته های پرس و جوی SQL تعریف شده توسط کاربر ایجاد می کند. سپس کوئری Athena را اجرا می کنید و نتیجه پرس و جو را در یک DataFrame pandas سازماندهی می کنید. این گزینه به شما اجازه می دهد تا پرس و جوهای پیچیده SQL را برای استخراج اطلاعات از یک گروه ویژگی مشخص کنید. کد نمونه زیر را ببینید:

در مرحله بعد، میتوانیم دادههای درخواست شده از گروههای ویژگی مختلف را در مجموعه داده نهایی خود برای آموزش و آزمایش مدل ادغام کنیم. برای این پست استفاده می کنیم تبدیل دسته ای برای استنتاج مدل تبدیل دسته ای به شما این امکان را می دهد که استنتاج مدل را روی حجم زیادی از داده ها در آمازون S3 بدست آورید و نتیجه استنتاج آن در آمازون S3 نیز ذخیره می شود. برای جزئیات آموزش مدل و استنباط به دفترچه یادداشت مراجعه کنید 5-classification-using-feature-groups.ipynb.

در آمازون Redshift یک جستار عضویت در نتایج پیشبینی اجرا کنید

در نهایت، نتیجه استنتاج را پرس و جو می کنیم و آن را با پروفایل های کاربر اصلی در Amazon Redshift می پیوندیم. برای این کار استفاده می کنیم آمازون Redshift Spectrum برای پیوستن به نتایج پیشبینی دستهای در آمازون S3 با دادههای اصلی Redshift. برای جزئیات، به نوت بوک اجرا مراجعه کنید 6-read-results-in-redshift.ipynb.

پاک کردن

در این بخش، مراحل پاکسازی منابع ایجاد شده به عنوان بخشی از این پست را برای جلوگیری از هزینه های مداوم ارائه می دهیم.

برنامه های SageMaker را خاموش کنید

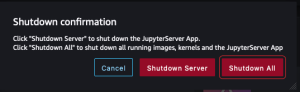

مراحل زیر را برای خاموش کردن منابع خود انجام دهید:

- در SageMaker Studio، در پرونده منو ، انتخاب کنید بستن.

- در تایید خاموش شدن گفتگو، انتخاب کنید خاموش کردن همه برای ادامه.

- پس از دریافت پیام "Server stoped"، می توانید این برگه را ببندید.

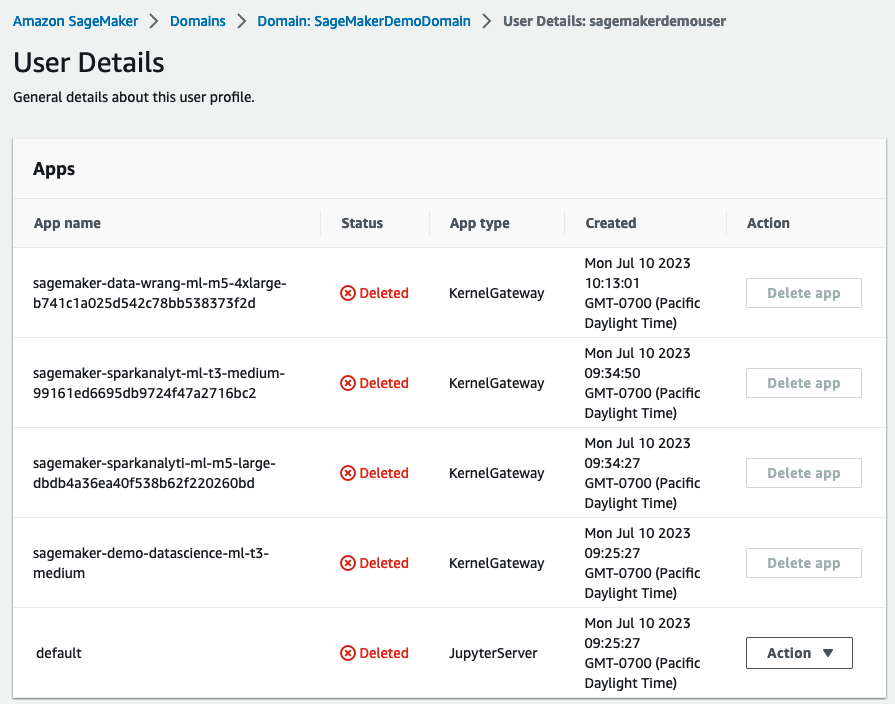

برنامه ها را حذف کنید

مراحل زیر را برای حذف برنامه های خود انجام دهید:

- در کنسول SageMaker، در قسمت ناوبری، را انتخاب کنید دامنه.

- بر دامنه صفحه ، انتخاب کنید

SageMakerDemoDomain. - در صفحه جزئیات دامنه، در زیر پروفایل کاربر، کاربر را انتخاب کنید

sagemakerdemouser. - در نرم افزار بخش، در عمل ستون، انتخاب کنید حذف برنامه برای هر برنامه فعال

- اطمینان حاصل کنید که وضعیت ستون می گوید حذف شده برای همه برنامه ها

حجم ذخیره سازی EFS مرتبط با دامنه SageMaker خود را حذف کنید

حجم EFS خود را در کنسول SageMaker پیدا کنید و آن را حذف کنید. برای دستورالعمل، مراجعه کنید حجم ذخیره سازی Amazon EFS خود را در SageMaker Studio مدیریت کنید.

سطل های پیش فرض S3 را برای SageMaker حذف کنید

سطل های پیش فرض S3 را حذف کنید (sagemaker-<region-code>-<acct-id>) برای SageMaker اگر از SageMaker در آن منطقه استفاده نمی کنید.

پشته CloudFormation را حذف کنید

پشته CloudFormation را در حساب AWS خود حذف کنید تا همه منابع مرتبط پاک شوند.

نتیجه

در این پست، ما یک جریان داده و ML از یک انبار داده Redshift به SageMaker را نشان دادیم. شما به راحتی می توانید از ادغام بومی AWS موتورهای ساخته شده برای انجام یکپارچه سفر داده استفاده کنید. بررسی کنید وبلاگ AWS برای اقدامات بیشتر در مورد ساخت ویژگی های ML از یک انبار داده مدرن.

درباره نویسنده

آخیله دوبهمعمار ارشد راه حل های تجزیه و تحلیل در AWS، دارای بیش از دو دهه تخصص در کار با پایگاه های داده و محصولات تجزیه و تحلیل است. نقش اصلی او شامل همکاری با مشتریان سازمانی برای طراحی راهحلهای تجزیه و تحلیل داده قوی و در عین حال ارائه راهنماییهای فنی جامع در مورد طیف گستردهای از خدمات AWS Analytics و AI/ML است.

آخیله دوبهمعمار ارشد راه حل های تجزیه و تحلیل در AWS، دارای بیش از دو دهه تخصص در کار با پایگاه های داده و محصولات تجزیه و تحلیل است. نقش اصلی او شامل همکاری با مشتریان سازمانی برای طراحی راهحلهای تجزیه و تحلیل داده قوی و در عین حال ارائه راهنماییهای فنی جامع در مورد طیف گستردهای از خدمات AWS Analytics و AI/ML است.

رن گو یک معمار ارشد راه حل متخصص داده در حوزه های هوش مصنوعی، تجزیه و تحلیل، و AI/ML سنتی در AWS، منطقه چین بزرگ است.

رن گو یک معمار ارشد راه حل متخصص داده در حوزه های هوش مصنوعی، تجزیه و تحلیل، و AI/ML سنتی در AWS، منطقه چین بزرگ است.

شری دینگ یک معمار ارشد راه حل های تخصصی AI/ML است. او تجربه گسترده ای در یادگیری ماشین با مدرک دکترا در علوم کامپیوتر دارد. او عمدتاً با مشتریان بخش عمومی در چالشهای مختلف تجاری مرتبط با هوش مصنوعی کار میکند و به آنها کمک میکند تا سفر یادگیری ماشین خود را در AWS Cloud تسریع کنند. وقتی به مشتریان کمک نمی کند، از فعالیت های بیرون از خانه لذت می برد.

شری دینگ یک معمار ارشد راه حل های تخصصی AI/ML است. او تجربه گسترده ای در یادگیری ماشین با مدرک دکترا در علوم کامپیوتر دارد. او عمدتاً با مشتریان بخش عمومی در چالشهای مختلف تجاری مرتبط با هوش مصنوعی کار میکند و به آنها کمک میکند تا سفر یادگیری ماشین خود را در AWS Cloud تسریع کنند. وقتی به مشتریان کمک نمی کند، از فعالیت های بیرون از خانه لذت می برد.

مارک روی یک معمار اصلی یادگیری ماشین برای AWS است که به مشتریان در طراحی و ساخت راهحلهای AI/ML کمک میکند. کار مارک طیف گسترده ای از موارد استفاده از ML را پوشش می دهد، با علاقه اولیه به بینایی کامپیوتر، یادگیری عمیق، و مقیاس بندی ML در سراسر سازمان. او به شرکت ها در بسیاری از صنایع از جمله بیمه، خدمات مالی، رسانه و سرگرمی، مراقبت های بهداشتی، آب و برق و تولید کمک کرده است. مارک دارای شش گواهینامه AWS، از جمله گواهینامه تخصصی ML است. قبل از پیوستن به AWS، مارک به مدت بیش از 25 سال، از جمله 19 سال در خدمات مالی، معمار، توسعه دهنده و رهبر فناوری بود.

مارک روی یک معمار اصلی یادگیری ماشین برای AWS است که به مشتریان در طراحی و ساخت راهحلهای AI/ML کمک میکند. کار مارک طیف گسترده ای از موارد استفاده از ML را پوشش می دهد، با علاقه اولیه به بینایی کامپیوتر، یادگیری عمیق، و مقیاس بندی ML در سراسر سازمان. او به شرکت ها در بسیاری از صنایع از جمله بیمه، خدمات مالی، رسانه و سرگرمی، مراقبت های بهداشتی، آب و برق و تولید کمک کرده است. مارک دارای شش گواهینامه AWS، از جمله گواهینامه تخصصی ML است. قبل از پیوستن به AWS، مارک به مدت بیش از 25 سال، از جمله 19 سال در خدمات مالی، معمار، توسعه دهنده و رهبر فناوری بود.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. خودرو / خودروهای الکتریکی، کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- ChartPrime. بازی معاملاتی خود را با ChartPrime ارتقا دهید. دسترسی به اینجا.

- BlockOffsets. نوسازی مالکیت افست زیست محیطی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/build-ml-features-at-scale-with-amazon-sagemaker-feature-store-using-data-from-amazon-redshift/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 100

- 11

- 12

- ٪۱۰۰

- 19

- 23

- 25

- 7

- a

- درباره ما

- بالاتر

- شتاب دادن

- دسترسی

- دسترسی

- مطابق

- حساب

- اذعان

- در میان

- عمل

- فعال

- فعالیت ها

- اضافه کردن

- پس از

- AI

- AI / ML

- معرفی

- اجازه دادن

- مجاز

- اجازه می دهد تا

- قبلا

- همچنین

- آمازون

- آمازون Redshift

- آمازون SageMaker

- آمازون خدمات وب

- an

- علم تجزیه و تحلیل

- تحلیل

- و

- دیگر

- هر

- API

- ظاهر می شود

- کاربرد

- برنامه توسعه

- اعمال می شود

- تقریبا

- برنامه های

- معماری

- هستند

- AS

- مرتبط است

- At

- ضمیمه کردن

- مجاز

- بطور خودکار

- در دسترس

- اجتناب از

- AWS

- AWS CloudFormation

- چسب AWS

- پایه

- BE

- قبل از

- بودن

- بهترین

- میان

- هر دو

- ساختن

- بنا

- کسب و کار

- by

- CAN

- قابلیت های

- موارد

- کاتالوگ

- سلول ها

- گواهی

- گواهینامه ها

- چالش ها

- بار

- بررسی

- چین

- انتخاب

- را انتخاب کنید

- مشتریان

- نزدیک

- ابر

- خوشه

- رمز

- همکاری

- جمع آوری

- ستون

- ترکیب

- مشترک

- شرکت

- کامل

- بغرنج

- جامع

- محاسبه

- کامپیوتر

- علم کامپیوتر

- چشم انداز کامپیوتر

- تایید

- اتصال

- ارتباط

- در نظر بگیرید

- کنسول

- شامل

- زمینه

- ادامه دادن

- میتوانست

- را پوشش می دهد

- ایجاد

- ایجاد شده

- ایجاد

- ایجاد

- مجوزها و اعتبارات

- سفارشی

- مشتریان

- داده ها

- تجزیه و تحلیل داده ها

- آماده سازی داده ها

- پایگاه داده

- پایگاه های داده

- مجموعه داده ها

- روز

- دهه

- تصمیم گیری

- عمیق

- یادگیری عمیق

- به طور پیش فرض

- تعريف كردن

- تعاریف

- درجه

- ارائه

- نشان

- وابستگی

- گسترش

- استقرار

- طرح

- جزئیات

- توسعه

- توسعه دهنده

- پروژه

- مختلف

- كشف كردن

- کشف

- توزیع شده

- do

- دامنه

- حوزه

- آیا

- پایین

- دانلود

- قطره

- هر

- پیش از آن

- به آسانی

- ساده

- اثر

- را قادر می سازد

- پشت سر هم

- اجرای

- مهندسی

- موتورهای حرفه ای

- وارد

- سرمایه گذاری

- سرگرمی

- محیط

- محیط

- ایجاد

- هر

- هر روز

- همه چیز

- مثال

- مثال ها

- جز

- اعدام

- تجربه

- تخصص

- صادرات

- گسترش

- گسترش

- وسیع

- تجربه گسترده

- عصاره

- آشنا

- ویژگی

- ویژه

- گروه ویژه

- امکانات

- پرونده

- فایل ها

- فیلتر

- نهایی

- سرانجام

- مالی

- خدمات مالی

- پایان

- نام خانوادگی

- بار اول

- جریان

- تمرکز

- به دنبال

- پیروی

- برای

- از جانب

- کامل

- کاملا

- تابع

- قابلیت

- توابع

- مولد

- هوش مصنوعی مولد

- دریافت کنید

- گرفتن

- GitHub

- دادن

- Go

- بیشتر

- گروه

- گروه ها

- راهنمایی

- اداره

- رخ دادن

- سخت افزار

- آیا

- داشتن

- he

- بهداشت و درمان

- کمک

- کمک کرد

- کمک

- اینجا کلیک نمایید

- خود را

- دارای

- HTML

- HTTP

- HTTPS

- شناسه

- هویت

- if

- نشان می دهد

- تصویر

- انجام

- واردات

- in

- شامل

- شامل

- از جمله

- مستقل

- به طور مستقل

- لوازم

- اطلاعات

- شالوده

- ورودی

- نصب

- نصب شده

- نمونه

- دستورالعمل

- بیمه

- یکپارچه

- ادغام

- تعاملی

- علاقه

- رابط

- به

- IT

- ITS

- کار

- شغل ها

- پیوستن

- پیوست

- پیوستن

- سفر

- JPG

- تنها

- فقط یکی

- راه اندازی

- رهبر

- یادگیری

- ترک کردن

- کتابخانه

- پسندیدن

- فهرست

- بار

- بارگیری

- محلی

- به صورت محلی

- محل

- مطالب

- دستگاه

- فراگیری ماشین

- عمدتا

- حفظ

- ساخت

- باعث می شود

- اداره می شود

- مدیریت

- تولید

- بسیاری

- علامت

- مارک

- بیشترین

- ممکن است..

- مکانیسم

- رسانه ها

- متوسط

- فهرست

- ادغام کردن

- پیام

- قدرت

- دقیقه

- گم

- ML

- مدل

- مدل سازی

- مدل

- مدرن

- نظارت بر

- بیش

- اکثر

- محبوبترین

- متحرک

- چندگانه

- نام

- بومی

- هدایت

- جهت یابی

- نیاز

- جدید

- بعد

- گره

- دفتر یادداشت

- اکنون

- عدد

- تعداد

- of

- ارائه

- پیشنهادات

- آنلاین نیست.

- on

- ONE

- مداوم

- آنلاین

- فقط

- باز کن

- قابل استفاده

- گزینه

- گزینه

- or

- اصلی

- دیگر

- ما

- خارج

- تولید

- روی

- با ما

- پانداها

- قطعه

- پارامتر

- پارامترهای

- بخش

- مسیر

- انجام

- انجام

- دکترا

- خط لوله

- محل

- افلاطون

- هوش داده افلاطون

- PlatoData

- نقطه

- سیاست

- محبوب

- پست

- شیوه های

- پیش گویی

- تهیه

- آماده

- آماده

- در حال حاضر

- فشار

- اصلی

- اصلی

- قبلا

- خصوصی

- روند

- فرآوری شده

- در حال پردازش

- پردازنده

- تولید

- محصولات

- پروفایل

- پروژه

- ارائه

- فراهم می کند

- ارائه

- عمومی

- پــایتــون

- نمایش ها

- محدوده

- اشعه

- خواندن

- بدون در نظر گرفتن

- منطقه

- مربوط

- رن

- جایگزین

- ضروری

- مورد نیاز

- منابع

- منابع

- مسئوليت

- محدودیت های

- نتیجه

- نتایج

- تنومند

- نقش

- نقش

- روی

- دویدن

- در حال اجرا

- اجرا می شود

- حکیم ساز

- خطوط لوله SageMaker

- همان

- می گوید:

- مقیاس

- مقیاس گذاری

- سناریو

- زمان بندی

- علم

- دانشمندان

- sdk

- یکپارچه

- جستجو

- بخش

- بخش

- تیم امنیت لاتاری

- دیدن

- انتخاب شد

- انتخاب

- ارشد

- سلسله

- بدون سرور

- سرویس

- خدمات

- جلسات

- تنظیم

- تنظیمات

- برپایی

- او

- باید

- نشان

- خاموش

- ساده

- تنها

- شش

- So

- راه حل

- مزایا

- برخی از

- منبع

- منابع

- جرقه

- متخصص

- تخصص

- مشخص شده

- مربع

- پشته

- بیانیه

- وضعیت

- گام

- مراحل

- ذخیره سازی

- opbevare

- ذخیره شده

- پرده

- رشته

- ساختار

- ساخت یافته

- استودیو

- چنین

- پشتیبانی

- مطمئن

- سیستم

- جدول

- گرفتن

- تیم ها

- فنی

- پیشرفته

- قالب

- ده ها

- پایانه

- تست

- نسبت به

- که

- La

- منبع

- شان

- آنها

- سپس

- آنجا.

- اینها

- این

- هزاران نفر

- سه

- از طریق

- زمان

- سری زمانی

- برچسب زمان

- به

- با هم

- سنتی

- آموزش

- دگرگون کردن

- دگرگونی

- تحولات

- مبدل

- دو

- نوع

- زیر

- اساسی

- داده بالادستی

- استفاده کنید

- استفاده

- کاربر

- کاربران

- استفاده

- با استفاده از

- آب و برق

- با استفاده از

- تنوع

- مختلف

- نسخه

- مجازی

- دید

- حجم

- صبر کنيد

- می خواهم

- بود

- مسیر..

- we

- وب

- خدمات وب

- مبتنی بر وب

- خوب

- بود

- چی

- چه زمانی

- که

- در حین

- وسیع

- دامنه گسترده

- اراده

- با

- بدون

- مهاجرت کاری

- کارگر

- با این نسخهها کار

- خواهد بود

- نوشته

- یامل

- سال

- شما

- شما

- زفیرنت