همانطور که یادگیری ماشین (ML) به جریان اصلی تبدیل میشود و پذیرش گستردهتری پیدا میکند، برنامههای استنتاج مبتنی بر ML برای حل طیف وسیعی از مشکلات تجاری پیچیده رایجتر میشوند. راه حل این مشکلات پیچیده تجاری اغلب مستلزم استفاده از چندین مدل و مراحل ML است. این پست به شما نشان می دهد که چگونه یک برنامه ML را با کانتینرهای سفارشی بسازید و میزبانی کنید آمازون SageMaker.

Amazon SageMaker ارائه می دهد الگوریتم های داخلی و SageMaker از پیش ساخته شده است تصاویر داکر برای استقرار مدل اما، اگر اینها با نیازهای شما مطابقت ندارند، می توانید ظروف خود (BYOC) را برای میزبانی در Amazon SageMaker بیاورید.

چندین مورد استفاده وجود دارد که ممکن است کاربران برای میزبانی در Amazon SageMaker نیاز به BYOC داشته باشند.

- چارچوبها یا کتابخانههای سفارشی ML: اگر قصد دارید از چارچوب ML یا کتابخانههایی استفاده کنید که توسط الگوریتمهای داخلی Amazon SageMaker یا کانتینرهای از پیش ساخته شده پشتیبانی نمیشوند، باید یک کانتینر سفارشی ایجاد کنید.

- مدلهای تخصصی: برای حوزهها یا صنایع خاص، ممکن است به معماریهای مدل خاصی یا مراحل پیشپردازش متناسب نیاز داشته باشید که در پیشنهادات داخلی Amazon SageMaker موجود نباشد.

- الگوریتمهای اختصاصی: اگر الگوریتمهای اختصاصی خود را در داخل توسعه دادهاید، به یک کانتینر سفارشی برای استقرار آنها در Amazon SageMaker نیاز دارید.

- خطوط لوله استنتاج پیچیده: اگر گردش کار استنتاج ML شما شامل منطق تجاری سفارشی می شود - مجموعه ای از مراحل پیچیده که باید به ترتیب خاصی اجرا شوند - BYOC می تواند به شما کمک کند این مراحل را به طور موثرتری مدیریت و هماهنگ کنید.

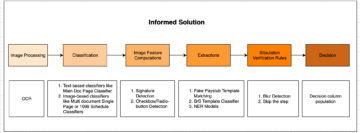

بررسی اجمالی راه حل

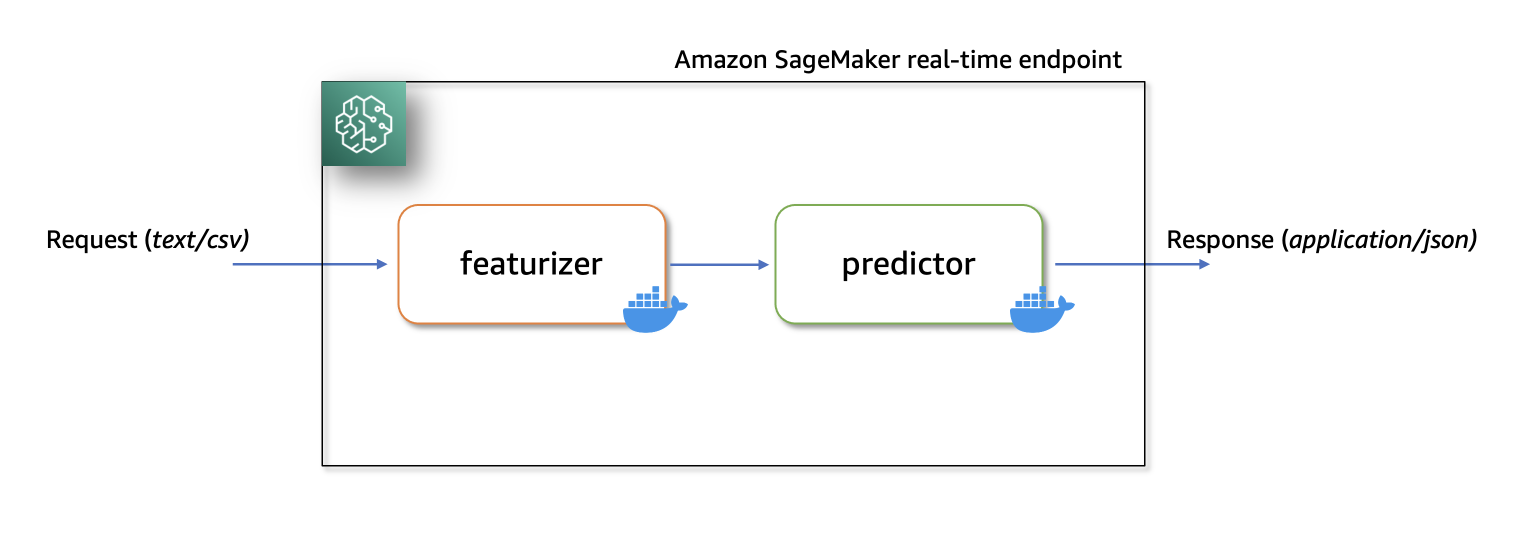

در این راه حل، ما نشان می دهیم که چگونه می توان یک برنامه استنتاج سریال ML را در Amazon SageMaker با نقاط پایانی بلادرنگ با استفاده از دو ظرف استنتاج سفارشی با جدیدترین ها میزبانی کرد. scikit-learn و xgboost بسته ها

ظرف اول از a استفاده می کند scikit-learn مدلی برای تبدیل داده های خام به ستون های ویژه. اعمال می شود StandardScaler برای ستون های عددی و OneHotEncoder به دسته بندی ها

ظرف دوم میزبان یک از پیش آموزش دیده است XGboost مدل (یعنی پیش بینی کننده). مدل پیشبینیکننده ورودی مشخص شده را میپذیرد و پیشبینیهای خروجی را انجام میدهد.

در نهایت، ما را مستقر می کنیم برجسته کننده و پیشگو در یک خط لوله استنتاج سریالی به نقطه پایانی در زمان واقعی Amazon SageMaker.

در اینجا چند ملاحظه مختلف وجود دارد که چرا ممکن است بخواهید کانتینرهای جداگانه در برنامه استنتاج خود داشته باشید.

- جدایی - مراحل مختلف خط لوله دارای هدف مشخص و مشخصی هستند و به دلیل وابستگی های اساسی درگیر باید در کانتینرهای جداگانه اجرا شوند. این همچنین به حفظ ساختار لوله کمک می کند.

- چارچوب - مراحل مختلف خط لوله از چارچوبهای مناسب برای هدف خاص (مانند scikit یا Spark ML) استفاده میکنند و بنابراین باید روی کانتینرهای جداگانه اجرا شوند.

- جداسازی منابع - مراحل مختلف خط لوله نیازهای مصرف منابع متفاوتی دارند و بنابراین برای انعطاف و کنترل بیشتر باید روی کانتینرهای جداگانه اجرا شوند.

- تعمیر و نگهداری و ارتقاء - از نقطه نظر عملیاتی، این انزوای عملکردی را ارتقا میدهد و میتوانید به ارتقا یا اصلاح گامهای فردی بسیار آسانتر ادامه دهید، بدون اینکه روی مدلهای دیگر تأثیر بگذارد.

علاوه بر این، ساخت محلی کانتینرهای جداگانه به فرآیند تکراری توسعه و آزمایش با ابزارهای مورد علاقه و محیط های توسعه یکپارچه (IDE) کمک می کند. پس از آماده شدن کانتینرها، میتوانید با استفاده از نقاط پایانی Amazon SageMaker از آنها برای استنتاج در ابر AWS استفاده کنید.

پیاده سازی کامل، از جمله قطعه کد، در این مخزن Github موجود است اینجا کلیک نمایید.

پیش نیازها

همانطور که ابتدا این کانتینرهای سفارشی را به صورت محلی آزمایش می کنیم، به دسکتاپ docker نیاز داریم که روی رایانه محلی شما نصب شده باشد. شما باید با ساخت کانتینرهای داکر آشنایی داشته باشید.

شما همچنین به یک حساب AWS با دسترسی به Amazon SageMaker، Amazon ECR و Amazon S3 برای تست سرتاسر این برنامه نیاز دارید.

مطمئن شوید که آخرین نسخه را دارید Boto3 و بسته های Amazon SageMaker Python نصب شده است:

راه حل

کانتینر مخصوص ویژگی سفارشی بسازید

برای ساخت اولین کانتینر یعنی کانتینر featurizer a را آموزش می دهیم scikit-learn مدل برای پردازش ویژگی های خام در فرسوده مجموعه داده اسکریپت پیش پردازش استفاده می کند SimpleImputer برای مدیریت مقادیر از دست رفته، StandardScaler برای عادی سازی ستون های عددی و OneHotEncoder برای تبدیل ستون های طبقه بندی شده پس از نصب ترانسفورماتور، مدل را در داخل ذخیره می کنیم joblib قالب سپس این مصنوع مدل ذخیره شده را در یک سرویس ذخیره سازی ساده آمازون فشرده و آپلود می کنیم (آمازون S3) سطل.

در اینجا یک قطعه کد نمونه است که این را نشان می دهد. رجوع شود به featurizer.ipynb برای اجرای کامل:

در مرحله بعد، برای ایجاد یک محفظه استنتاج سفارشی برای مدل featurizer، یک تصویر Docker با بستههای nginx، gunicorn، flask، همراه با سایر وابستگیهای مورد نیاز برای مدل featurizer میسازیم.

Nginx، Gunicorn و برنامه Flask به عنوان پشته سرویس مدل عمل خواهند کرد در نقاط پایانی آنی Amazon SageMaker.

هنگام آوردن کانتینرهای سفارشی برای میزبانی در Amazon SageMaker، باید اطمینان حاصل کنیم که اسکریپت استنتاج پس از راهاندازی در داخل کانتینر، وظایف زیر را انجام میدهد:

- بارگذاری مدل: اسکریپت استنتاج (

preprocessing.py) باید به/opt/ml/modelدایرکتوری برای بارگذاری مدل در ظرف. مصنوعات مدل در آمازون S3 دانلود و بر روی کانتینر موجود در مسیر نصب خواهند شد/opt/ml/model. - متغیرهای محیطی: برای ارسال متغیرهای محیطی سفارشی به کانتینر، باید آنها را در طول مسیر مشخص کنید مدل مرحله ایجاد یا در طول نقطه پایانی ایجاد از یک شغل آموزشی

- الزامات API: اسکریپت Inference باید هر دو را پیاده سازی کند

/pingو/invocationsمسیرها به عنوان یک برنامه Flask. را/pingAPI برای بررسی های سلامت استفاده می شود، در حالی که/invocationsAPI درخواستهای استنتاج را مدیریت میکند. - ورود به سیستم: گزارش های خروجی در اسکریپت استنتاج باید در خروجی استاندارد نوشته شوند (stdout) و خطای استاندارد (استدرر) جریان ها. این گزارشها سپس به استریم میشوند CloudWatch آمازون توسط Amazon SageMaker.

در اینجا یک قطعه از preprocessing.py که اجرای آن را نشان می دهد /ping و /invocations.

به مراجعه preprocessing.py برای پیاده سازی کامل در زیر پوشه featurizer.

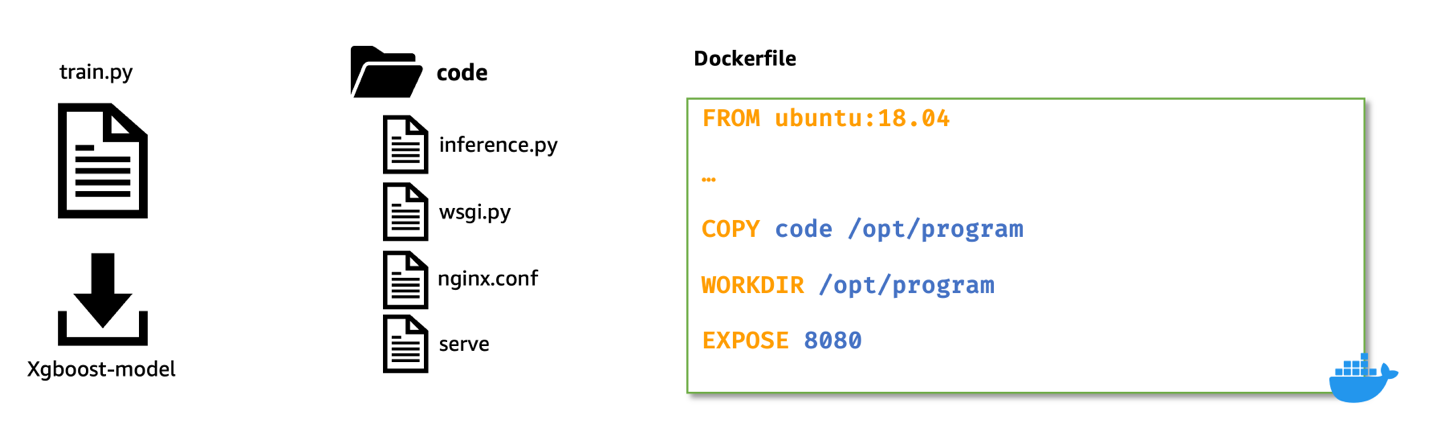

تصویر داکر را با ویژگیساز و پشته سرویس مدل بسازید

بیایید اکنون یک Dockerfile با استفاده از یک تصویر پایه سفارشی بسازیم و وابستگی های مورد نیاز را نصب کنیم.

برای این کار استفاده می کنیم python:3.9-slim-buster به عنوان تصویر پایه شما می توانید این تصویر پایه دیگری را که مربوط به مورد استفاده شما باشد تغییر دهید.

سپس پیکربندی nginx، فایل دروازه وب سرور gunicorn و اسکریپت استنتاج را در ظرف کپی می کنیم. ما همچنین یک اسکریپت پایتون به نام serve ایجاد میکنیم که فرآیندهای nginx و gunicorn را در پسزمینه راهاندازی میکند و اسکریپت استنتاج (یعنی برنامه preprocessing.py Flask) را به عنوان نقطه ورودی برای کانتینر تنظیم میکند.

در اینجا یک قطعه از Dockerfile برای میزبانی از مدل ویژگی ارائه شده است. برای اجرای کامل مراجعه کنید dockerfile زیر برجسته کننده پوشه.

تصویر استنتاج سفارشی را با ویژگیساز به صورت محلی آزمایش کنید

اکنون، با استفاده از آمازون، محفظه استنتاج سفارشی را با featurzer به صورت محلی بسازید و آزمایش کنید حالت محلی SageMaker. حالت محلی برای آزمایش اسکریپت های پردازش، آموزش و استنتاج شما بدون راه اندازی هیچ کاری در Amazon SageMaker عالی است. پس از تایید نتایج تست های محلی خود، می توانید به راحتی اسکریپت های آموزشی و استنباط را برای استقرار در Amazon SageMaker با حداقل تغییرات تطبیق دهید.

برای آزمایش تصویر سفارشی featurizer به صورت محلی، ابتدا تصویر را با استفاده از تعریف قبلی بسازید dockerfile. سپس، با نصب دایرکتوری حاوی مدل featurizer، یک ظرف راه اندازی کنید (preprocess.joblib) به /opt/ml/model دایرکتوری داخل کانتینر علاوه بر این، پورت 8080 را از کانتینر به میزبان نقشه برداری کنید.

پس از راهاندازی، میتوانید درخواستهای استنتاج را به آن ارسال کنید http://localhost:8080/invocations.

برای ساخت و راه اندازی کانتینر، یک ترمینال باز کنید و دستورات زیر را اجرا کنید.

توجه داشته باشید که باید آن را جایگزین کنید <IMAGE_NAME>، همانطور که در کد زیر نشان داده شده است، با نام تصویر ظرف شما.

دستور زیر نیز چنین فرض می کند که آموزش داده شده است scikit-learn مدل (preprocess.joblib) تحت دایرکتوری به نام وجود دارد models.

پس از آماده شدن کانتینر، می توانیم هر دو را آزمایش کنیم /پینگ و / فراخوانی ها مسیرها با استفاده از دستورات curl.

دستورات زیر را از یک ترمینال اجرا کنید

هنگامی که داده های خام (تبدیل نشده) به http://localhost:8080/invocations، نقطه پایانی با داده های تبدیل شده پاسخ می دهد.

شما باید پاسخ چیزی شبیه به زیر را ببینید:

اکنون کانتینر در حال اجرا را خاتمه می دهیم، و سپس تصویر سفارشی محلی را تگ کرده و به یک رجیستری کانتینر الاستیک آمازون خصوصی فشار می دهیم (آمازون ECR) مخزن.

دستورات زیر را برای ورود به آمازون ECR مشاهده کنید، که تصویر محلی را با مسیر تصویر کامل آمازون ECR برچسب گذاری می کند و سپس تصویر را به Amazon ECR فشار می دهد. حتما تعویض کنید region و account متغیرهایی متناسب با محیط شما

به مراجعه یک مخزن ایجاد کنید و یک تصویر را به Amazon ECR فشار دهید رابط خط فرمان AWS (AWS CLI) برای اطلاعات بیشتر دستور می دهد.

مرحله اختیاری

به صورت اختیاری، میتوانید با استقرار مدل ویژگیساز در نقطه پایانی بلادرنگ با تصویر داکر سفارشی در Amazon ECR، یک آزمایش زنده انجام دهید. رجوع شود به featurizer.ipynb نوت بوک برای اجرای کامل ساخت، آزمایش و انتقال تصویر سفارشی به Amazon ECR.

Amazon SageMaker نقطه پایانی استنتاج را مقداردهی اولیه می کند و مصنوعات مدل را در آن کپی می کند /opt/ml/model دایرکتوری داخل کانتینر دیدن چگونه SageMaker مصنوعات مدل شما را بارگذاری می کند.

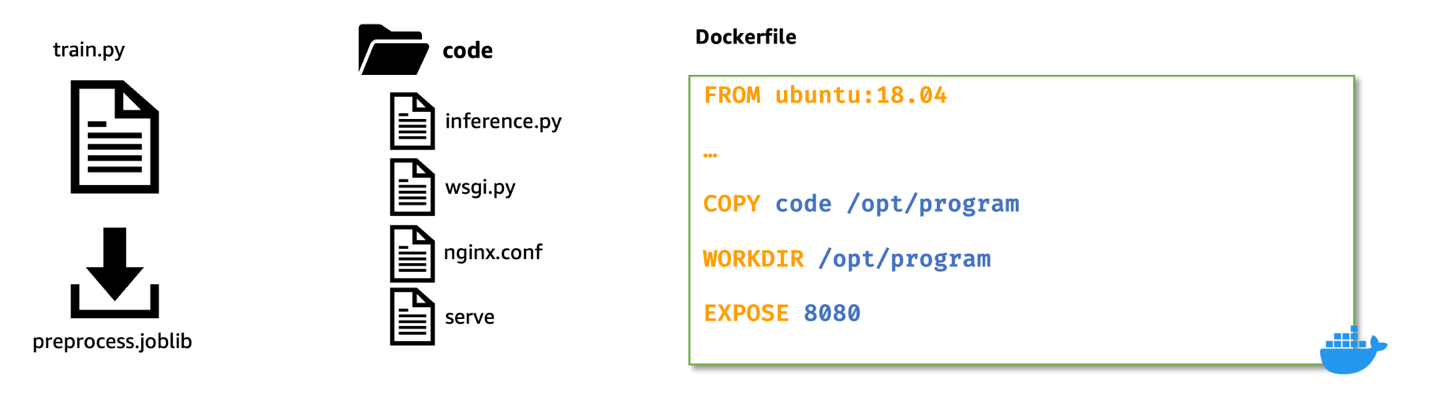

ظرف پیشبینی XGBoost سفارشی بسازید

برای ساختن محفظه استنتاج XGBoost، مراحل مشابهی را که در هنگام ساختن تصویر برای محفظه مشخص کننده انجام دادیم، دنبال می کنیم:

- دانلود از قبل آموزش داده شده

XGBoostمدل از آمازون S3. - ایجاد

inference.pyاسکریپتی که از قبل آموزش دیده را بارگذاری می کندXGBoostمدل، دادههای ورودی تبدیلشده دریافتشده از ویژگیساز را تبدیل میکند و بهXGBoost.DMatrixفرمت، اجرا می شودpredictروی تقویت کننده، و پیش بینی ها را در قالب json برمی گرداند. - اسکریپت ها و فایل های پیکربندی که پشته سرویس دهی مدل را تشکیل می دهند (به عنوان مثال،

nginx.conf,wsgi.pyوserveبدون تغییر باقی می ماند و نیازی به اصلاح ندارد. - استفاده می کنیم

Ubuntu:18.04به عنوان تصویر پایه برای Dockerfile. این یک پیش نیاز نیست ما از تصویر پایه اوبونتو استفاده می کنیم تا نشان دهیم که کانتینرها را می توان با هر تصویر پایه ساخت. - مراحل ساخت تصویر داکر مشتری، آزمایش تصویر به صورت محلی، و فشار دادن تصویر آزمایش شده به Amazon ECR مانند قبل باقی می ماند.

برای اختصار، همانطور که مراحل مشابه قبلا نشان داده شده است. با این حال، ما فقط کدگذاری تغییر یافته را در ادامه نشان می دهیم.

اول، inference.py اسکریپت در اینجا یک قطعه است که اجرای آن را نشان می دهد /ping و /invocations. رجوع شود به inference.py تحت پیشگو پوشه برای پیاده سازی کامل این فایل.

در اینجا یک قطعه از Dockerfile برای میزبانی از مدل پیش بینی است. برای اجرای کامل مراجعه کنید dockerfile زیر پوشه پیش بینی

سپس به ساخت، آزمایش و انتقال این تصویر پیشبینیکننده سفارشی به یک مخزن خصوصی در Amazon ECR ادامه میدهیم. رجوع شود به predictor.ipynb نوت بوک برای اجرای کامل ساخت، آزمایش و فشار دادن تصویر سفارشی به Amazon ECR.

استقرار خط لوله استنتاج سریال

پس از اینکه هم تصاویر برجسته و هم پیشبینیکننده را آزمایش کردیم و آنها را به Amazon ECR فرستادیم، اکنون مصنوعات مدل خود را در یک سطل Amazon S3 آپلود میکنیم.

سپس، دو شی مدل ایجاد می کنیم: یکی برای featurizer (یعنی ، preprocess.joblib) و دیگر برای predictor (یعنی ، xgboost-model) با مشخص کردن تصویر سفارشی uri که قبلا ساختیم.

در اینجا یک قطعه است که نشان می دهد. رجوع شود به serial-inference-pipeline.ipynb برای اجرای کامل

حال، برای استقرار این کانتینرها به صورت سریال، ابتدا a ایجاد می کنیم Pipeline Model اعتراض کنید و عبور دهید featurizer مدل و predictor به یک ترتیب به یک شی لیست پایتون مدل کنید.

سپس، ما به .deploy() روش در Pipeline Model تعیین نوع نمونه و تعداد نمونه.

در این مرحله، آمازون SageMaker خط لوله استنتاج سریال را در یک نقطه پایانی بلادرنگ مستقر می کند. منتظر می مانیم تا نقطه پایانی باشد InService.

اکنون میتوانیم نقطه پایانی را با ارسال چند درخواست استنتاج به این نقطه پایانی زنده آزمایش کنیم.

به مراجعه serial-inference-pipeline.ipynb برای اجرای کامل

پاک کردن

پس از اتمام تست، لطفاً دستورالعملهای موجود در بخش پاکسازی نوتبوک را دنبال کنید تا منابع ارائه شده در این پست را حذف کنید تا از هزینههای غیرضروری جلوگیری کنید. رجوع شود به قیمت گذاری آمازون SageMaker برای جزئیات در مورد هزینه نمونه های استنتاج.

نتیجه

در این پست، من نشان دادم که چگونه میتوانیم یک برنامه استنتاج سریالی ML با استفاده از کانتینرهای استنتاج سفارشی در نقاط پایانی همزمان در Amazon SageMaker بسازیم و مستقر کنیم.

این راه حل نشان می دهد که چگونه مشتریان می توانند ظروف سفارشی خود را برای میزبانی در Amazon SageMaker به روشی مقرون به صرفه بیاورند. با گزینه BYOC، مشتریان می توانند به سرعت برنامه های ML خود را بسازند و تطبیق دهند تا در Amazon SageMaker مستقر شوند.

ما شما را تشویق می کنیم که این راه حل را با مجموعه داده مرتبط با شاخص های کلیدی عملکرد (KPI) کسب و کار خود امتحان کنید. شما می توانید به کل راه حل در این مراجعه کنید مخزن GitHub.

منابع

درباره نویسنده

پراوین چامارتی یک متخصص ارشد AI/ML با خدمات وب آمازون است. او مشتاق هوش مصنوعی/ML و همه چیزهای AWS است. او به مشتریان در سرتاسر قاره آمریکا کمک میکند تا حجمهای کاری ML را به طور کارآمد در AWS تغییر دهند، نوآوری کنند. پراوین در اوقات فراغت خود عاشق خواندن فیلم های علمی تخیلی است.

پراوین چامارتی یک متخصص ارشد AI/ML با خدمات وب آمازون است. او مشتاق هوش مصنوعی/ML و همه چیزهای AWS است. او به مشتریان در سرتاسر قاره آمریکا کمک میکند تا حجمهای کاری ML را به طور کارآمد در AWS تغییر دهند، نوآوری کنند. پراوین در اوقات فراغت خود عاشق خواندن فیلم های علمی تخیلی است.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/build-and-deploy-ml-inference-applications-from-scratch-using-amazon-sagemaker/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 08

- 09

- 1

- 10

- 100

- 11

- 13

- 14

- 150

- 16

- 17

- 20

- 200

- 2023

- 25

- 28

- 30

- 500

- 7

- 8

- 87

- 9

- a

- درباره ما

- پذیرفتن

- قبول می کند

- دسترسی

- بر این اساس

- حساب

- در میان

- وفق دادن

- علاوه بر این

- اتخاذ

- موثر بر

- پس از

- AI / ML

- الگوریتم

- معرفی

- در امتداد

- همچنین

- آمازون

- آمازون SageMaker

- آمازون خدمات وب

- آمریکا

- an

- و

- هر

- API

- نرم افزار

- کاربرد

- برنامه های کاربردی

- اعمال میشود

- آوریل

- هستند

- صف

- AS

- فرض می کند

- At

- در دسترس

- اجتناب از

- AWS

- زمینه

- پایه

- مستقر

- BE

- تبدیل شدن به

- قبل از

- بودن

- در زیر

- بدن

- تقویت کننده

- هر دو

- به ارمغان بیاورد

- آوردن

- ساختن

- بنا

- ساخته

- ساخته شده در

- بسته

- کسب و کار

- اما

- by

- صدا

- نام

- CAN

- مورد

- موارد

- CAT

- معین

- تغییر دادن

- تغییر

- تبادل

- بار

- بررسی

- چک

- به وضوح

- ابر

- رمز

- برنامه نویسی

- ستون

- ستون ها

- COM

- مشترک

- پیچیده

- کامپیوتر

- پیکر بندی

- متصل

- ارتباط

- ملاحظات

- ثابت

- ساختن

- مصرف

- ظرف

- ظروف

- محتوا

- محتویات

- ادامه دادن

- کنترل

- تبدیل

- هزینه

- میتوانست

- ایجاد

- ایجاد

- ایجاد

- مجوزها و اعتبارات

- سفارشی

- مشتری

- مشتریان

- داده ها

- تاریخ

- تعريف كردن

- مشخص

- نشان دادن

- نشان می دهد

- وابستگی

- گسترش

- مستقر

- استقرار

- گسترش

- مستقر می کند

- دسکتاپ

- جزئیات

- مشخص

- توسعه

- پروژه

- DICT

- DID

- مختلف

- کارگر بارانداز

- حوزه

- انجام شده

- آیا

- دو

- در طی

- e

- پیش از آن

- به آسانی

- موثر

- دیگر

- تشویق

- پشت سر هم

- نقطه پایانی

- اطمینان حاصل شود

- تمام

- ورود

- محیط

- محیط

- خطا

- و غیره

- مثال

- جز

- استثنا

- اجرا شده

- آشنا

- روش

- محبوب

- امکانات

- کمی از

- پرونده

- فایل ها

- نام خانوادگی

- مناسب

- مناسب

- انعطاف پذیری

- به دنبال

- پیروی

- برای

- فرم

- قالب

- یافت

- چارچوب

- چارچوب

- از جانب

- کامل

- تابع

- تابعی

- عایدات

- دروازه

- دریافت کنید

- GitHub

- GMT

- می رود

- دسته

- دستگیره

- اداره

- آیا

- he

- سلامتی

- ارتفاع

- کمک

- کمک می کند

- خود را

- میزبان

- میزبانی وب

- میزبان

- چگونه

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- i

- if

- تصویر

- تصاویر

- انجام

- پیاده سازی

- واردات

- in

- شامل

- از جمله

- به طور فزاینده

- شاخص ها

- فرد

- لوازم

- اطلاعات

- در خانه

- نوآوری

- ورودی

- داخل

- نصب

- نصب شده

- نمونه

- دستورالعمل

- یکپارچه

- رابط

- به

- گرفتار

- انزوا

- IT

- کار

- شغل ها

- JPG

- json

- نگاه داشتن

- کلید

- برچسب

- آخرین

- راه اندازی

- راه اندازی

- راه اندازی

- راه اندازی

- یادگیری

- ترک کرد

- طول

- کتابخانه ها

- لاین

- فهرست

- ذکر شده

- زنده

- بار

- بارگیری

- بارهای

- محلی

- به صورت محلی

- منطق

- ورود

- دوست دارد

- دستگاه

- فراگیری ماشین

- مسیر اصلی

- باعث می شود

- ساخت

- مدیریت

- روش

- نقشه

- علامت

- مسابقه

- ممکن است..

- روش

- قدرت

- حداقل

- گم

- ML

- حالت

- مدل

- مدل

- تغییر

- بیش

- فیلم ها

- بسیار

- چندگانه

- باید

- نام

- نام

- نیاز

- نیازهای

- نه

- هیچ

- دفتر یادداشت

- اکنون

- عدد

- بی حس

- هدف

- اشیاء

- of

- پیشنهادات

- پیشنهادات

- غالبا

- on

- یک بار

- ONE

- آنهایی که

- فقط

- به سوی

- باز کن

- کار

- قابل استفاده

- گزینه

- or

- سفارش

- OS

- دیگر

- ما

- تولید

- خود

- بسته

- پانداها

- پارامترهای

- ویژه

- عبور

- احساساتی

- مسیر

- کامل

- انجام

- کارایی

- انجام می دهد

- خط لوله

- برنامه

- افلاطون

- هوش داده افلاطون

- PlatoData

- لطفا

- نقطه

- پست

- پیش گویی

- پیش بینی

- پیشگو

- در حال حاضر

- قبلا

- خصوصی

- مشکلات

- روند

- فرآیندهای

- در حال پردازش

- پردازنده

- ترویج می کند

- اختصاصی

- هدف

- فشار

- تحت فشار قرار دادند

- هل دادن

- پــایتــون

- به سرعت

- بالا بردن

- محدوده

- خام

- خواندن

- اماده

- زمان واقعی

- اخذ شده

- مراجعه

- رجیستری

- مربوط

- ماندن

- جایگزین کردن

- مخزن

- درخواست

- درخواست

- نیاز

- ضروری

- مورد نیاز

- نیاز

- منابع

- منابع

- پاسخ

- نتیجه

- نتایج

- برگشت

- عودت

- بازده

- حلقه

- مسیر

- مسیرها

- ROW

- دویدن

- در حال اجرا

- اجرا می شود

- حکیم ساز

- همان

- ذخیره

- نگهداری می شود

- مقیاس

- Sci-Fi حجم

- خراش

- خط

- اسکریپت

- دوم

- بخش

- دیدن

- ارسال

- در حال ارسال

- ارشد

- فرستاده

- جداگانه

- سریال

- سلسله

- خدمت

- سرور

- سرویس

- خدمات

- خدمت

- جلسه

- تنظیم

- مجموعه

- چند

- ارتباط جنسی

- باید

- نشان

- نشان داد

- نشان داده شده

- نشان می دهد

- مشابه

- ساده

- قطعه

- So

- راه حل

- حل

- برخی از

- چیزی

- جرقه

- متخصص

- خاص

- پشته

- صحنه

- استاندارد

- دیدگاه

- وضعیت

- گام

- مراحل

- ذخیره سازی

- جریان

- جریان

- رشته

- ساخت یافته

- موفقیت

- چنین

- خورشید

- پشتیبانی

- حمایت از

- پشتیبانی از

- TAG

- طراحی شده

- طول می کشد

- وظایف

- پایانه

- آزمون

- آزمایش

- تست

- تست

- که

- La

- شان

- آنها

- سپس

- آنجا.

- از این رو

- اینها

- اشیاء

- این

- زمان

- به

- ابزار

- قطار

- آموزش دیده

- آموزش

- دگرگون کردن

- مبدل

- ترانسفورماتور

- ترانسفورماتور

- تبدیل شدن

- امتحان

- تلاش

- دو

- نوع

- اوبونتو

- زیر

- اساسی

- غیر ضروری

- ارتقاء

- قابل استفاده

- استفاده کنید

- مورد استفاده

- استفاده

- کاربران

- استفاده

- با استفاده از

- ارزشها

- مختلف

- متفاوت است

- تایید

- نسخه

- صبر کنيد

- می خواهم

- بود

- we

- وب

- وب سرور

- خدمات وب

- خوب

- که

- در حین

- چرا

- گسترده تر

- اراده

- با

- در داخل

- بدون

- گردش کار

- کارگر

- کتبی

- X

- XGBoost

- شما

- شما

- زفیرنت