در این پست، ما تنظیم دقیق مدل Llama 2 را با استفاده از روش تنظیم دقیق پارامتر کارآمد (PEFT) به نمایش می گذاریم و مدل تنظیم شده را بر روی آن مستقر می کنیم. AWS Inferentia2. ما استفاده می کنیم نورون AWS کیت توسعه نرم افزار (SDK) برای دسترسی به دستگاه AWS Inferentia2 و بهره مندی از عملکرد بالای آن. سپس از یک ظرف استنتاج مدل بزرگ استفاده می کنیم کتابخانه عمیق جاوا (DJLServing) به عنوان راه حل ارائه مدل ما.

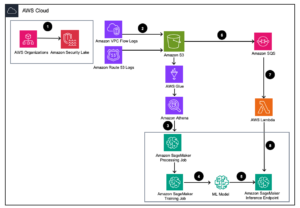

بررسی اجمالی راه حل

تنظیم دقیق کارآمد Llama2 با استفاده از QLoRa

خانواده مدلهای زبان بزرگ Llama 2 (LLMs) مجموعهای از مدلهای متنی مولد از پیش آموزشدیده و تنظیمشده است که در مقیاسی از ۷ میلیارد تا ۷۰ میلیارد پارامتر متغیر است. Llama 7 بر روی 70 تریلیون توکن داده از منابع در دسترس عموم از قبل آموزش داده شده بود. مشتریان AWS گاهی اوقات مدل های Llama 2 را با استفاده از داده های خود مشتریان برای دستیابی به عملکرد بهتر برای کارهای پایین دستی تنظیم می کنند. با این حال، به دلیل تعداد زیاد پارامترهای مدل Llama 2، تنظیم دقیق کامل می تواند بسیار گران و زمان بر باشد. رویکرد تنظیم دقیق پارامترهای کارآمد (PEFT) میتواند این مشکل را تنها با تنظیم دقیق تعداد کمی از پارامترهای مدل اضافی در حالی که اکثر پارامترهای مدل از پیش آموزشدیده را منجمد میکند، برطرف کند. برای اطلاعات بیشتر در مورد PEFT، می توانید این را بخوانید پست. در این پست استفاده می کنیم QLoRa برای تنظیم دقیق مدل Llama 2 7B.

با استفاده از آمازون SageMaker یک مدل تنظیم شده را در Inf2 مستقر کنید

AWS Inferentia2 شتابدهنده یادگیری ماشینی (ML) است که برای بارهای کاری استنتاج طراحی شده است و عملکرد بالا را با حداکثر 40 درصد هزینه کمتر برای بارهای کاری مولد هوش مصنوعی و LLM نسبت به سایر نمونههای بهینهسازی استنتاج در AWS ارائه میکند. در این پست، ما از Amazon Elastic Compute Cloud (آمازون EC2) نمونه Inf2، دارای AWS Inferentia2، نسل دوم شتاب دهنده Inferentia2، که هر کدام شامل دو NeuronCores-v2. هر NeuronCore-v2 یک واحد محاسباتی مستقل و ناهمگن با چهار موتور اصلی است: موتورهای Tensor، Vector، Scalar و GPSIMD. این شامل یک حافظه SRAM با مدیریت نرم افزار روی تراشه برای به حداکثر رساندن موقعیت داده ها است. از آنجایی که چندین وبلاگ در Inf2 منتشر شده است، خواننده می تواند به این موضوع مراجعه کند پست و ما مستندات برای اطلاعات بیشتر در مورد Inf2.

برای استقرار مدلها در Inf2، به AWS Neuron SDK به عنوان لایه نرمافزاری که در بالای سختافزار Inf2 اجرا میشود، نیاز داریم. AWS Neuron SDK است که برای اجرای بارهای کاری یادگیری عمیق در AWS Inferentia و AWS Trainium نمونه های مبتنی بر این چرخه عمر توسعه ML را قادر می سازد تا مدل های جدید بسازد، این مدل ها را آموزش داده و بهینه سازی کند، و آنها را برای تولید به کار گیرد. AWS Neuron شامل یک یادگیری عمیق است کامپایلر, زمان اجراو ابزار که به صورت بومی با فریمورک های محبوبی مانند TensorFlow و PyTorch ادغام شده اند. در این وبلاگ قصد داریم استفاده کنیم transformers-neuronx، که بخشی از AWS Neuron SDK برای گردش کار استنتاج رمزگشای ترانسفورماتور است. آی تی پشتیبانی از طیف وسیعی از مدل های محبوب، از جمله Llama 2.

برای استقرار مدل ها در آمازون SageMaker، معمولاً از ظرفی استفاده می کنیم که شامل کتابخانه های مورد نیاز باشد مانند Neuron SDK و transformers-neuronx و همچنین مولفه سرویس دهی مدل. Amazon SageMaker حفظ می کند ظروف یادگیری عمیق (DLC) با کتابخانه های منبع باز محبوب برای میزبانی مدل های بزرگ. در این پست از ظرف استنتاج مدل بزرگ برای نورون. این کانتینر همه چیزهایی را دارد که برای استقرار مدل Llama 2 خود در Inf2 نیاز دارید. برای منابعی برای شروع با LMI در Amazon SageMaker، لطفاً به بسیاری از پستهای موجود ما مراجعه کنید (وبلاگ 1, وبلاگ 2, وبلاگ 3) در این مورد. به طور خلاصه، می توانید کانتینر را بدون نوشتن کد اضافی اجرا کنید. می توانید استفاده کنید کنترل کننده پیش فرض برای تجربه کاربری یکپارچه و پاس در یکی از نام های مدل پشتیبانی شده و هر پارامتر قابل تنظیم زمان بارگذاری. این یک LLM را در یک نمونه Inf2 کامپایل و ارائه می کند. به عنوان مثال، برای استقرار OpenAssistant/llama2-13b-orca-8k-3319، می توانید پیکربندی زیر را ارائه دهید (مانند serving.properties فایل). که در serving.properties، نوع مدل را به صورت مشخص می کنیم llama2-13b-orca-8k-3319، اندازه دسته 4، درجه موازی تانسور 2، و بس. برای لیست کامل پارامترهای قابل تنظیم، مراجعه کنید تمام گزینه های پیکربندی DJL.

از طرف دیگر، می توانید فایل کنترل کننده مدل خود را همانطور که در این نشان داده شده است بنویسید مثال، اما این نیاز به پیاده سازی روش های بارگذاری و استنتاج مدل دارد تا به عنوان پلی بین API های DJLServing عمل کند.

پیش نیازها

فهرست زیر پیش نیازهای به کارگیری مدل شرح داده شده در این پست وبلاگ را مشخص می کند. شما می توانید هر دو را از کنسول مدیریت AWS یا از آخرین نسخه استفاده کنید رابط خط فرمان AWS (AWS CLI).

خرید

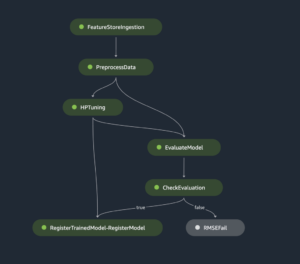

در بخش زیر کد را در دو قسمت بررسی می کنیم:

- یک مدل Llama2-7b را دقیق تنظیم کنید، و مصنوعات مدل را در یک مکان مشخص آمازون S3 بارگذاری کنید.

- با استفاده از ظرف سرو DJL که در Amazon SageMaker میزبانی شده است، مدل را در Inferentia2 مستقر کنید.

نمونه کد کامل به همراه دستورالعمل را می توان در این مطلب یافت GitHub مخزن

قسمت 1: یک مدل Llama2-7b را با استفاده از PEFT تنظیم دقیق کنید

ما قصد داریم از روشی که اخیراً در مقاله معرفی شده است استفاده کنیم QLoRA: تنظیم آداپتور کم رتبه با آگاهی از کوانتیشن برای تولید زبان توسط تیم دتمرز و همکاران QLoRA یک تکنیک جدید برای کاهش ردپای حافظه مدل های زبان بزرگ در طول تنظیم دقیق، بدون به خطر انداختن عملکرد است.

توجه داشته باشید: تنظیم دقیق مدل llama2-7b نشان داده شده در زیر در آمازون آزمایش شد نوت بوک SageMaker Studio با هسته بهینه سازی شده GPU Python 2.0 با استفاده از a ml.g5.2xlarge نوع نمونه به عنوان بهترین روش، توصیه می کنیم از یک Amazon SageMaker Studio محیط توسعه یکپارچه (IDE) در خود شما راه اندازی شد ابر خصوصی مجازی آمازون (Amazon VPC). این به شما امکان می دهد تا با استفاده از شبکه استاندارد AWS و قابلیت های امنیتی، ترافیک شبکه را در داخل و خارج از VPC خود کنترل، نظارت و بازرسی کنید. برای اطلاعات بیشتر ببین ایمن کردن اتصال Amazon SageMaker Studio با استفاده از VPC خصوصی.

مدل پایه را کمی کنید

ابتدا یک مدل کوانتیزه را با استفاده از کوانتیزاسیون 4 بیتی بارگذاری می کنیم ترانسفورماتورهای صورت بغل کردن کتابخانه به شرح زیر

بارگذاری مجموعه داده های آموزشی

در مرحله بعد، مجموعه داده را برای تغذیه مدل برای مرحله تنظیم دقیق که به صورت زیر نشان داده شده است، بارگذاری می کنیم:

یک لایه آداپتور وصل کنید

در اینجا ما یک لایه آداپتور کوچک و قابل آموزش وصل می کنیم که به صورت پیکربندی شده است LoraConfig در صورت در آغوش گرفتن تعریف شده است پفت کتابخانه

یک مدل تربیت کنید

با استفاده از پیکربندی LoRA که در بالا نشان داده شده است، مدل Llama2 را به همراه پارامترهای فوق تنظیم می کنیم. یک قطعه کد برای آموزش مدل در شکل زیر نشان داده شده است:

وزن مدل را ادغام کنید

مدل دقیق اجرا شده در بالا یک مدل جدید حاوی وزنه های آداپتور LoRA آموزش دیده ایجاد کرد. در قطعه کد زیر، آداپتور را با مدل پایه ادغام می کنیم تا بتوانیم از مدل دقیق تنظیم شده برای استنتاج استفاده کنیم.

وزن مدل را در آمازون S3 بارگذاری کنید

در مرحله آخر قسمت 1، وزن های مدل ادغام شده را در یک مکان مشخص آمازون S3 ذخیره می کنیم. وزن مدل توسط یک ظرف سرو مدل در Amazon SageMaker برای میزبانی مدل با استفاده از یک نمونه Inferentia2 استفاده خواهد شد.

قسمت 2: میزبان مدل QLoRA برای استنتاج با AWS Inf2 با استفاده از SageMaker LMI Container

در این بخش، مراحل استقرار یک مدل تنظیم شده QLoRA در محیط میزبانی Amazon SageMaker را مرور خواهیم کرد. ما از a استفاده خواهیم کرد سرویس DJL ظرف از SageMaker DLC، که با ادغام می شود ترانسفورماتور - نورونکس کتابخانه ای برای میزبانی این مدل این راهاندازی بارگذاری مدلها را بر روی شتابدهندههای AWS Inferentia2 تسهیل میکند، مدل را در چند هستهی عصبی موازی میکند و امکان سرویس دهی از طریق نقاط پایانی HTTP را فراهم میکند.

مصنوعات مدل را آماده کنید

DJL از بسیاری از کتابخانه های بهینه سازی یادگیری عمیق پشتیبانی می کند، از جمله در اعماق, سریع ترانسفورماتور و بیشتر. برای پیکربندیهای خاص مدل، a serving.properties با پارامترهای کلیدی مانند tensor_parallel_degree و model_id برای تعریف گزینه های بارگذاری مدل. این model_id می تواند شناسه مدل Hugging Face یا مسیر Amazon S3 باشد که وزن مدل در آن ذخیره می شود. در مثال ما، مکان آمازون S3 مدل دقیق تنظیم شده خود را ارائه می دهیم. قطعه کد زیر ویژگی های مورد استفاده برای سرویس مدل را نشان می دهد:

لطفا به این مطلب مراجعه فرمایید مستندات برای اطلاعات بیشتر در مورد گزینه های قابل تنظیم موجود از طریق serving.properties. لطفا توجه داشته باشید که ما استفاده می کنیم option.n_position=512 در این وبلاگ برای گردآوری سریعتر AWS Neuron. اگر میخواهید طول نشانه ورودی بزرگتری را امتحان کنید، ما به خواننده توصیه میکنیم که مدل را از قبل کامپایل کند (نگاه کنید به AOT Pre-Compile Model در EC2). در غیر این صورت، اگر زمان کامپایل بیش از حد باشد، ممکن است با خطای timeout مواجه شوید.

بعد از serving.properties فایل تعریف شده است، ما فایل را در یک بسته بندی می کنیم tar.gz قالب، به شرح زیر:

سپس، tar.gz را در یک مکان سطل آمازون S3 آپلود می کنیم:

یک نقطه پایانی مدل Amazon SageMaker ایجاد کنید

برای استفاده از یک نمونه Inf2 برای سرویس دهی، از آمازون استفاده می کنیم ظرف LMI SageMaker با پشتیبانی از DJL neuronX. لطفا به این مطلب مراجعه فرمایید پست برای اطلاعات بیشتر در مورد استفاده از ظرف DJL NeuronX برای استنتاج. کد زیر نحوه استقرار یک مدل با استفاده از Amazon SageMaker Python SDK را نشان می دهد:

نقطه پایانی مدل تست

پس از اینکه مدل با موفقیت مستقر شد، میتوانیم با ارسال یک درخواست نمونه به پیشبین، نقطه پایانی را تأیید کنیم:

خروجی نمونه به صورت زیر نشان داده شده است:

در زمینه تجزیه و تحلیل داده ها، یادگیری ماشین (ML) به یک تکنیک آماری اشاره دارد که قادر به استخراج قدرت پیش بینی از یک مجموعه داده با پیچیدگی و دقت فزاینده با محدود کردن مکرر دامنه یک آمار است.

یادگیری ماشینی یک تکنیک آماری جدید نیست، بلکه ترکیبی از تکنیک های موجود است. علاوه بر این، برای استفاده با یک مجموعه داده خاص یا برای تولید یک نتیجه خاص طراحی نشده است. در عوض، به گونه ای طراحی شده بود که به اندازه کافی انعطاف پذیر باشد تا بتواند با هر مجموعه داده ای سازگار باشد و در مورد هر نتیجه ای پیش بینی کند.

پاک کردن

اگر تصمیم گرفتید که دیگر نمیخواهید نقطه پایانی SageMaker را در حال اجرا نگه دارید، میتوانید با استفاده از آن آن را حذف کنید AWS SDK برای Python (boto3)، AWS CLI یا Amazon SageMaker Console. علاوه بر این ، شما همچنین می توانید منابع استودیو آمازون SageMaker را خاموش کنید که دیگر مورد نیاز نیستند

نتیجه

در این پست، ما به شما نشان دادیم که چگونه یک مدل Llama2-7b را با استفاده از آداپتور LoRA با کوانتیزاسیون 4 بیتی با استفاده از یک نمونه واحد پردازش گرافیکی تنظیم کنید. سپس مدل را در یک نمونه Inf2 که در آمازون SageMaker میزبانی شده بود با استفاده از یک ظرف سرویس DJL مستقر کردیم. در نهایت، نقطه پایانی مدل Amazon SageMaker را با پیشبینی تولید متن با استفاده از SageMaker Python SDK تأیید کردیم. ادامه دهید و آن را امتحان کنید، ما دوست داریم نظرات شما را بشنویم. منتظر بهروزرسانیها در مورد قابلیتهای بیشتر و نوآوریهای جدید با AWS Inferentia باشید.

برای مثال های بیشتر در مورد AWS Neuron، نگاه کنید aws-neuron-samps.

درباره نویسنده

وی ته یک معمار ارشد راه حل های تخصصی AI/ML در AWS است. او علاقه زیادی به کمک به مشتریان در پیشبرد سفر AWS خود دارد، با تمرکز بر خدمات یادگیری ماشین آمازون و راه حل های مبتنی بر یادگیری ماشین. خارج از محل کار، او از فعالیت های خارج از منزل مانند کمپینگ، ماهیگیری و پیاده روی با خانواده لذت می برد.

وی ته یک معمار ارشد راه حل های تخصصی AI/ML در AWS است. او علاقه زیادی به کمک به مشتریان در پیشبرد سفر AWS خود دارد، با تمرکز بر خدمات یادگیری ماشین آمازون و راه حل های مبتنی بر یادگیری ماشین. خارج از محل کار، او از فعالیت های خارج از منزل مانند کمپینگ، ماهیگیری و پیاده روی با خانواده لذت می برد.

کینگوهمن لی یک متخصص یادگیری ماشین در خدمات وب آمازون است. او دکترای خود را دریافت کرد. در تحقیقات عملیات پس از اینکه حساب کمک هزینه تحقیقاتی مشاورش را شکست و نتوانست جایزه نوبل را که وعده داده بود تحویل دهد. در حال حاضر او به مشتریان در صنعت خدمات مالی و بیمه کمک می کند تا راه حل های یادگیری ماشینی را در AWS بسازند. در اوقات فراغت به مطالعه و تدریس علاقه دارد.

کینگوهمن لی یک متخصص یادگیری ماشین در خدمات وب آمازون است. او دکترای خود را دریافت کرد. در تحقیقات عملیات پس از اینکه حساب کمک هزینه تحقیقاتی مشاورش را شکست و نتوانست جایزه نوبل را که وعده داده بود تحویل دهد. در حال حاضر او به مشتریان در صنعت خدمات مالی و بیمه کمک می کند تا راه حل های یادگیری ماشینی را در AWS بسازند. در اوقات فراغت به مطالعه و تدریس علاقه دارد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/fine-tune-llama-2-using-qlora-and-deploy-it-on-amazon-sagemaker-with-aws-inferentia2/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 1

- 10

- 100

- 11

- ٪۱۰۰

- 16

- 19

- 24

- 300

- 7

- 70

- 8

- a

- درباره ما

- بالاتر

- شتاب دهنده

- شتاب دهنده ها

- دسترسی

- حساب

- دقت

- رسیدن

- در میان

- فعالیت ها

- وفق دادن

- اضافی

- علاوه بر این

- نشانی

- پیشرفت

- پس از

- پیش

- AI

- AI / ML

- AL

- اجازه می دهد تا

- در امتداد

- آلفا

- همچنین

- آمازون

- آموزش ماشین آمازون

- آمازون SageMaker

- Amazon SageMaker Studio

- آمازون خدمات وب

- an

- تحلیل

- و

- هر

- رابط های برنامه کاربردی

- درخواست

- روش

- هستند

- AS

- At

- ضمیمه کردن

- خودکار

- در دسترس

- AWS

- استنتاج AWS

- توپ

- پایه

- مستقر

- دسته

- BE

- بوده

- سود

- بهترین

- بهتر

- میان

- بیلیون

- بلاگ

- وبلاگ ها

- بریج

- شکست

- ساختن

- اما

- by

- CAN

- قابلیت های

- توانا

- را انتخاب کنید

- ابر

- رمز

- مجموعه

- ترکیب

- کامل

- پیچیدگی

- جزء

- محاسبه

- پیکر بندی

- پیکربندی

- اتصال

- کنسول

- مصرف کننده

- ظرف

- شامل

- زمینه

- کنترل

- هزینه

- میتوانست

- ایجاد شده

- در حال حاضر

- مشتریان

- داده ها

- تحلیل داده ها

- تصمیم گیری

- عمیق

- یادگیری عمیق

- به طور پیش فرض

- تعريف كردن

- مشخص

- درجه

- ارائه

- ارائه

- گسترش

- مستقر

- استقرار

- شرح داده شده

- طراحی

- پروژه

- دستگاه

- کارگر بارانداز

- پایین

- دو

- در طی

- پویا

- E&T

- هر

- هر دو

- را قادر می سازد

- پشت سر هم

- نقطه پایانی

- موتور

- موتورهای حرفه ای

- کافی

- محیط

- خطا

- و غیره

- همه چیز

- مثال

- مثال ها

- اجرا شده

- موجود

- گران

- تجربه

- اضافی

- چهره

- تسهیل می کند

- ناموفق

- غلط

- خانواده

- سریعتر

- ویژگی های

- باز خورد

- پرونده

- نهایی

- سرانجام

- مالی

- خدمات مالی

- نام خانوادگی

- صید ماهی

- قابل انعطاف

- تمرکز

- به دنبال

- به دنبال

- پیروی

- به دنبال آن است

- رد پا

- برای

- قالب

- یافت

- چهار

- چارچوب

- انجماد

- از جانب

- کامل

- بعلاوه

- نسل

- مولد

- هوش مصنوعی مولد

- دریافت کنید

- دادن

- Go

- رفتن

- GPU

- اعطا کردن

- سخت افزار

- he

- شنیدن

- کمک

- کمک می کند

- اینجا کلیک نمایید

- زیاد

- عملکرد بالا

- خود را

- میزبان

- میزبانی

- میزبانی وب

- خانه

- چگونه

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- ID

- if

- تصویر

- انجام

- اجرای

- in

- شامل

- شامل

- از جمله

- افزایش

- مستقل

- صنعت

- اطلاعات

- نوآوری

- ورودی

- ورودی

- نمونه

- دستورالعمل

- بیمه

- یکپارچه

- ادغام

- به

- معرفی

- IT

- تکرار

- ITS

- جاوه

- سفر

- JPG

- json

- نگاه داشتن

- کلید

- کیت (SDK)

- زبان

- بزرگ

- بزرگتر

- آخرین

- راه اندازی

- لایه

- لایه

- یادگیری

- طول

- سطح

- کتابخانه ها

- کتابخانه

- wifecycwe

- پسندیدن

- دوست دارد

- لاین

- فهرست

- پشم لاما

- LLM

- بار

- بارگیری

- محل

- دیگر

- عشق

- کاهش

- دستگاه

- فراگیری ماشین

- اصلی

- حفظ

- ساخت

- مدیریت

- بسیاری

- به حداکثر رساندن

- حافظه

- ادغام کردن

- روش

- روش

- قدرت

- ML

- مدل

- مدل

- ماژول ها

- مانیتور

- بیش

- اکثر

- بسیار

- چندگانه

- نام

- در

- نیاز

- شبکه

- ترافیک شبکه

- شبکه

- جدید

- نه

- جایزه نوبل

- هیچ

- توجه داشته باشید

- عدد

- of

- on

- ONE

- فقط

- به سوی

- باز کن

- منبع باز

- عملیات

- بهینه سازی

- بهینه سازی

- بهینه

- گزینه

- گزینه

- or

- دیگر

- در غیر این صورت

- ما

- نتیجه

- نمای کلی

- تولید

- خارج از

- روی

- خود

- بسته

- مقاله

- موازی

- پارامتر

- پارامترهای

- بخش

- بخش

- عبور

- احساساتی

- مسیر

- کارایی

- انجام

- برنامه

- افلاطون

- هوش داده افلاطون

- PlatoData

- لطفا

- محبوب

- پست

- پست ها

- قدرت

- صفحه اصلی

- تمرین

- دقت

- پیش گویی

- پیش بینی

- پیشگو

- پیش نیازها

- خصوصی

- جایزه

- مشکل

- روند

- تولید کردن

- تولید

- وعده داده شده

- املاک

- ارائه

- عمومی

- منتشر شده

- پــایتــون

- مارماهی

- محدوده

- اعم

- نسبتا

- خواندن

- خواننده

- مطالعه

- اخذ شده

- تازه

- توصیه

- كاهش دادن

- مراجعه

- اشاره دارد

- مخزن

- درخواست

- درخواست

- ضروری

- نیاز

- تحقیق

- منابع

- پاسخ

- پاسخ

- راست

- دویدن

- در حال اجرا

- قربانی کردن

- حکیم ساز

- ذخیره

- مقیاس

- مقیاس گذاری

- حوزه

- sdk

- بدون درز

- دوم

- نسل دوم

- بخش

- تیم امنیت لاتاری

- دیدن

- در حال ارسال

- ارشد

- دنباله

- خدمت

- سرویس

- خدمات

- خدمت

- تنظیم

- محیط

- برپایی

- چند

- کوتاه

- نمایشگاه

- نشان داد

- نشان داده شده

- نشان می دهد

- پس از

- تنها

- اندازه

- کوچک

- قطعه

- So

- نرم افزار

- توسعه نرم افزار

- بسته توسعه نرم افزار

- راه حل

- مزایا

- گاهی

- منبع

- منابع

- متخصص

- خاص

- مشخص شده

- استاندارد

- آغاز شده

- آماری

- ماندن

- گام

- مراحل

- ذخیره شده

- استودیو

- موفقیت

- چنین

- پشتیبانی

- پشتیبانی

- پشتیبانی از

- وظایف

- تعلیم

- تکنیک

- تکنیک

- جریان تنسور

- آزمایش

- متن

- که

- La

- شان

- آنها

- سپس

- اینها

- این

- از طریق

- تیم

- زمان

- به

- رمز

- نشانه

- هم

- بالا

- موضوع

- مشعل

- ترافیک

- قطار

- آموزش دیده

- آموزش

- ترانسفورماتور

- تریلیون

- درست

- امتحان

- کوک شده

- میزان سازی

- دو

- نوع

- به روز رسانی

- آپلود شده

- URL

- استفاده کنید

- استفاده

- کاربر

- سابقه کاربر

- با استفاده از

- معمولا

- تصدیق

- تایید شده

- نسخه

- از طريق

- مجازی

- راه رفتن

- خرید

- می خواهم

- بود

- we

- وب

- خدمات وب

- وزن

- خوب

- چی

- چه شده است

- که

- در حین

- اراده

- با

- در داخل

- بدون

- مهاجرت کاری

- کارگر

- گردش کار

- نوشتن

- نوشته

- شما

- شما

- زفیرنت