Amazon SageMaker JumpStart مرکز یادگیری ماشینی (ML) SageMaker است که مدل های از پیش آموزش دیده و در دسترس عموم را برای طیف وسیعی از انواع مشکلات ارائه می دهد تا به شما در شروع یادگیری ماشین کمک کند.

درک رفتار مشتری امروز برای هر کسب و کاری مهم است. به دست آوردن بینش در مورد چرایی و نحوه خرید مشتریان می تواند به افزایش درآمد کمک کند. ریزش مشتری مشکلی است که طیف گسترده ای از شرکت ها از مخابرات گرفته تا بانکداری با آن مواجه هستند، جایی که مشتریان معمولاً به دست رقبا از دست می روند. به نفع یک شرکت است که به جای جذب مشتریان جدید، مشتریان فعلی را حفظ کند، زیرا معمولاً برای جذب مشتریان جدید هزینه بسیار بیشتری دارد. هنگام تلاش برای حفظ مشتریان، شرکت ها اغلب تلاش خود را بر روی مشتریانی متمرکز می کنند که احتمال ترک آنها بیشتر است. رفتار کاربر و گزارش های چت پشتیبانی مشتری می تواند حاوی شاخص های ارزشمندی در مورد احتمال پایان دادن به سرویس توسط مشتری باشد. در این راهحل، ما یک مدل پیشبینی انقباض را آموزش داده و به کار میگیریم که از یک مدل پیشرفته پردازش زبان طبیعی (NLP) برای یافتن سیگنالهای مفید در متن استفاده میکند. علاوه بر ورودیهای متنی، این مدل از ورودیهای دادههای ساختاری سنتی مانند فیلدهای عددی و طبقهای استفاده میکند.

چندوجهی یک زمینه تحقیقاتی چند رشته ای است که برخی از اهداف اولیه هوش مصنوعی را با یکپارچه سازی و مدل سازی روش های متعدد مورد بررسی قرار می دهد. هدف این پست ایجاد مدلی است که میتواند اطلاعات را از روشهای متعددی مانند ویژگیهای جدولی و متنی پردازش و مرتبط کند.

ما به شما نشان میدهیم که چگونه یک مدل پیشبینی ریزش را که دارای ویژگیهای عددی، مقولهای و متنی برای پیشبینی آن پردازش کرده است، آموزش، استقرار و استفاده کنید. اگرچه ما در این پست به یک مورد استفاده از پیشبینی ریزش عمیق میپردازیم، میتوانید از این راهحل بهعنوان الگویی برای تعمیم مدلهای از پیش آموزشدیده شده با مجموعه دادههای خود استفاده کنید و متعاقباً برای بهبود دقت، بهینهسازی هایپرپارامتر (HPO) را اجرا کنید. حتی میتوانید مجموعه دادههای نمونه را با مجموعه دادههای خود جایگزین کنید و آن را از سر تا سر اجرا کنید تا موارد استفاده خودتان را حل کنید. راه حل ذکر شده در پست در دسترس است GitHub.

قالب های راه حل JumpStart

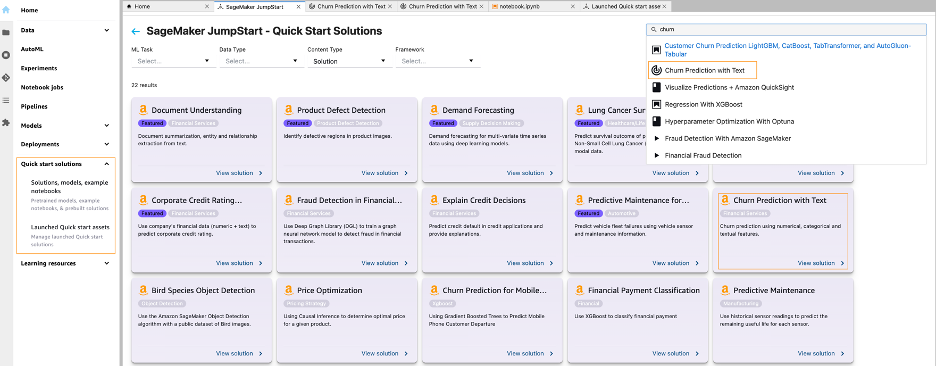

Amazon SageMaker JumpStart راه حل های یک کلیک و سرتاسر برای بسیاری از موارد رایج استفاده از ML ارائه می دهد. برای اطلاعات بیشتر در مورد الگوهای راه حل موجود، موارد استفاده زیر را کاوش کنید:

قالبهای راهحل JumpStart موارد استفاده مختلفی را پوشش میدهند، که تحت هر یک از آنها چندین الگوی راهحل مختلف ارائه میشود (این راهحل درک سند در زیر مورد استفاده «استخراج و تجزیه و تحلیل دادهها از اسناد» است).

از صفحه فرود JumpStart الگوی راه حلی را انتخاب کنید که به بهترین وجه مناسب مورد استفاده شما باشد. برای اطلاعات بیشتر در مورد راه حل های خاص در هر مورد و نحوه راه اندازی راه حل JumpStart، نگاه کنید الگوهای راه حل.

بررسی اجمالی راه حل

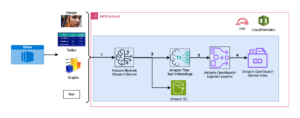

شکل زیر نشان می دهد که چگونه می توانید از این محلول استفاده کنید آمازون SageMaker اجزاء. مشاغل آموزشی SageMaker برای آموزش مدلهای مختلف NLP و نقاط پایانی SageMaker برای استقرار مدلها در هر مرحله استفاده میشوند. ما استفاده می کنیم سرویس ذخیره سازی ساده آمازون (Amazon S3) در کنار SageMaker برای ذخیره داده های آموزشی و مدل سازی مصنوعات و CloudWatch آمازون برای ورود به سیستم آموزشی و خروجی های نقطه پایانی.

ما به حل مسئله پیشبینی ریزش با مراحل زیر نزدیک میشویم:

- کاوش داده ها برای آماده سازی داده ها برای آماده سازی ML.

- آموزش یک مدل چندوجهی با a ترانسفورماتور جمله بغل کردن و طبقهبندیکننده جنگل تصادفی Scikit-Learn.

- با استفاده از HPO عملکرد مدل را بیشتر بهبود بخشید تنظیم خودکار مدل SageMaker.

- قطار دو مدل های چند وجهی AutoGluon: یک مدل مجموعه وزنی/انباشته چندوجهی AutoGluon و یک مدل ترکیبی چندوجهی AutoGluon.

- ارزیابی و مقایسه عملکرد مدل بر روی داده های آزمون نگهدارنده.

پیش نیازها

برای امتحان کردن راه حل در حساب شخصی خود، مطمئن شوید که موارد زیر را در اختیار دارید:

- یک حساب AWS اگر حساب کاربری ندارید، می توانید برای یکی ثبت نام کنید.

- راه حل ذکر شده در پست بخشی از SageMaker JumpStart است. برای اجرای این راه حل JumpStart و استقرار زیرساخت در حساب AWS خود، باید یک فعال ایجاد کنید Amazon SageMaker Studio نمونه (نگاه کنید به ورود به Amazon SageMaker Studio). هنگامی که نمونه استودیو شما آماده است، از دستورالعمل های موجود در JumpStart برای راه اندازی راه حل استفاده کنید.

- هنگام اجرای این دفتر یادداشت در استودیو، باید مطمئن شوید Python 3 (PyTorch 1.10 Python 3.8 CPU بهینه شده) تصویر/کرنل استفاده می شود.

برای اجرای این نوت بوک می توانید بسته های مورد نیاز را همانطور که در راه حل ذکر شده است نصب کنید:

مورد استفاده پیشبینی ریزش را باز کنید

در کنسول استودیو، را انتخاب کنید راه حل ها، مدل ها، نمونه نوت بوک ها زیر راه حل های شروع سریع در صفحه ناوبری حرکت به پیش بینی ریزش با متن راه حل در JumpStart

اکنون میتوانیم نگاهی دقیقتر به برخی از داراییهای موجود در این راهحل بیندازیم.

اکتشاف داده ها

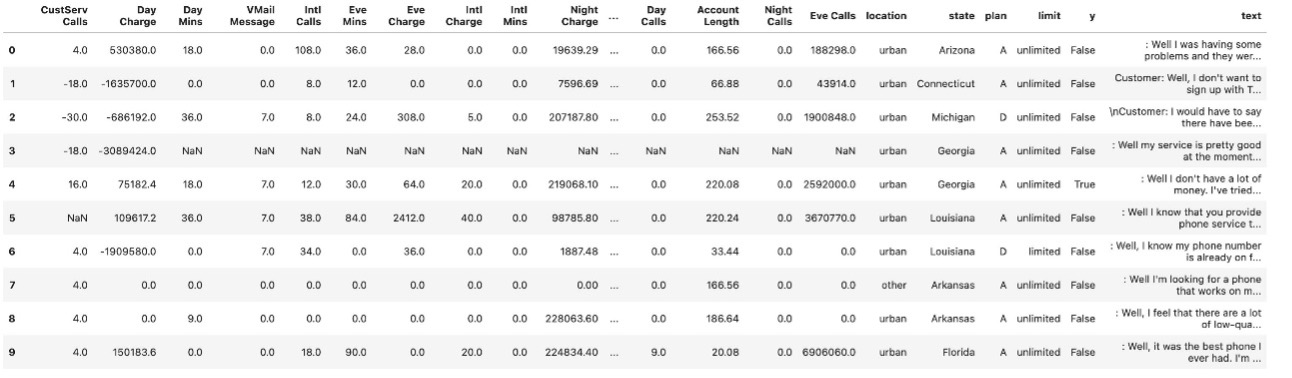

ابتدا بیایید مجموعه داده آزمایشی، اعتبارسنجی و آموزش را از سطل منبع S3 دانلود کرده و در سطل S3 خود آپلود کنیم. تصویر زیر 10 مشاهده از داده های آموزشی را به ما نشان می دهد.

بیایید شروع به کاوش در مجموعه داده های قطار و اعتبار سنجی کنیم.

همانطور که می بینید، ما ویژگی های مختلفی مانند CustServ Calls, Day Chargeو Day Calls که برای پیش بینی ستون هدف استفاده می کنیم y (اینکه آیا مشتری سرویس را ترک کرده است).

y به عنوان شناخته شده است ویژگی هدف: مشخصه ای که می خواهیم مدل ML آن را پیش بینی کند. از آنجایی که ویژگی هدف باینری است، مدل ما پیشبینی باینری را انجام میدهد که به آن نیز معروف است طبقه بندی باینری.

21 ویژگی از جمله متغیر هدف وجود دارد. تعداد نمونه ها برای داده های آموزش و اعتبارسنجی به ترتیب 43,000 و 5,000 است.

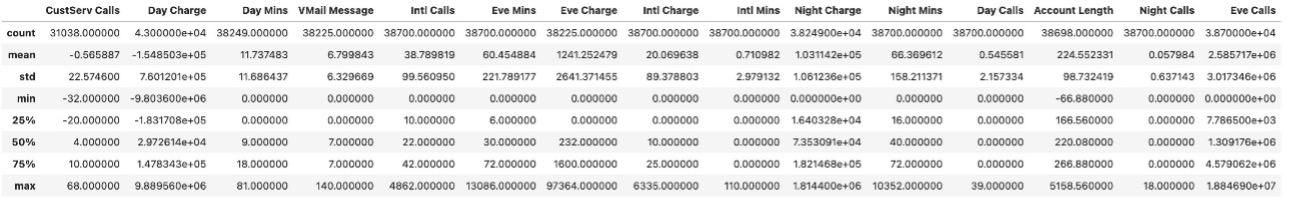

اسکرین شات زیر آمار خلاصه مجموعه داده آموزشی را نشان می دهد.

ما مجموعه داده را بررسی کردهایم و آن را به مجموعههای آموزشی، اعتبارسنجی و آزمایش تقسیم کردهایم. مجموعه آموزش و اعتبارسنجی برای آموزش و HPO استفاده می شود. مجموعه آزمون به عنوان مجموعه نگهدارنده برای ارزیابی عملکرد مدل استفاده می شود. اکنون مراحل مهندسی ویژگی را انجام می دهیم و سپس مدل را متناسب می کنیم.

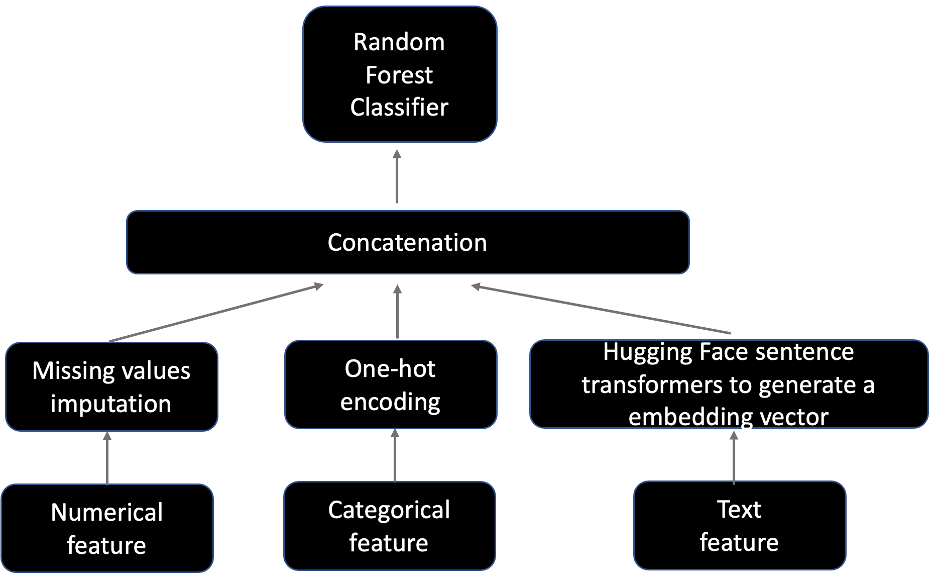

یک مدل چندوجهی را با ترانسفورماتور جمله Hugging Face و طبقهبندی جنگل تصادفی Scikit-learn متناسب کنید.

آموزش مدل از دو جزء تشکیل شده است: یک مرحله مهندسی ویژگی که ویژگی های عددی، مقوله ای و متنی را پردازش می کند، و یک مرحله برازش مدل که با ویژگی های تبدیل شده مطابقت دارد. طبقهبندیکننده جنگل تصادفی Scikit-Learn.

برای مهندسی ویژگی، مراحل زیر را انجام می دهیم:

- مقادیر از دست رفته برای ویژگی های عددی را پر کنید.

- ویژگیهای دستهبندی را در مقادیر تکی رمزگذاری کنید، جایی که مقادیر گمشده به عنوان یکی از دستههای هر ویژگی شمارش میشوند.

- استفاده ترانسفورماتور جمله بغل کردن برای رمزگذاری ویژگی متن برای تولید یک بردار متراکم بعدی X، که در آن مقدار X به یک ترانسفورماتور جمله خاص بستگی دارد.

ما سه مدل ترانسفورماتور جملاتی را که بیشترین دانلود را دریافت کرده اند انتخاب می کنیم و از آنها در فیتینگ مدل و HPO زیر استفاده می کنیم. به طور خاص، ما استفاده می کنیم all-MiniLM-L6-v2, multi-qa-mpnet-base-dot-v1و ترجمه-MiniLM-L6-v2. برای فراپارامترهای طبقهبندیکننده جنگل تصادفی، به GitHub repo.

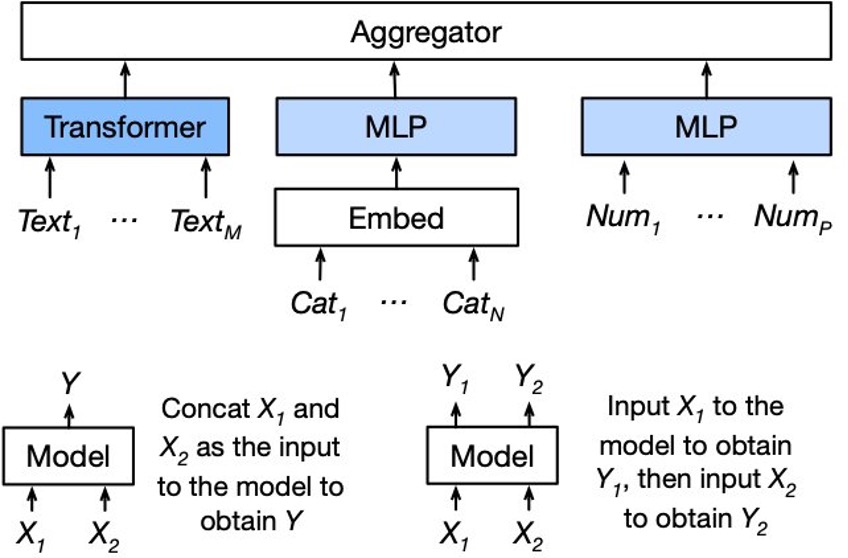

شکل زیر نمودار معماری مدل را نشان می دهد.

هایپرپارامترهای زیادی وجود دارد که می توانید تنظیم کنید، مانند n-estimators، max-depth و bootstrap. برای جزئیات بیشتر، به GitHub repo.

برای اهداف نمایشی، ما فقط از ویژگی های عددی استفاده می کنیم CustServ Calls و Account Length، ویژگی های طبقه بندی شده planو limitو ویژگی متن text متناسب با مدل چندین ویژگی باید با , از هم جدا شوند.

ما پس از اتمام آموزش مدل را مستقر می کنیم:

هنگام فراخوانی نقطه پایانی جدید خود از نوت بوک، از SageMaker SDK استفاده می کنیم پیشگو. Predictor برای ارسال داده ها به نقطه پایانی (به عنوان بخشی از یک درخواست) و تفسیر پاسخ استفاده می شود. JSON به عنوان فرمت هم برای داده های ورودی و هم برای پاسخ خروجی استفاده می شود زیرا یک فرمت نقطه پایانی استاندارد است و پاسخ نقطه پایانی می تواند شامل ساختارهای داده تو در تو باشد.

با اجرای موفقیت آمیز مدل ما و پیکربندی پیشبینیکننده، میتوانیم مدل پیشبینی ریزش را در یک ورودی نمونه امتحان کنیم:

کد زیر پاسخ (احتمال ریزش) از پرس و جو از نقطه پایانی را نشان می دهد:

توجه داشته باشید که احتمال برگشتی توسط این مدل کالیبره نشده است. برای مثال، وقتی مدل احتمال ریزش 20 درصد را ارائه می دهد، این لزوماً به این معنی نیست که 20 درصد از مشتریان با احتمال 20 درصد منجر به ریزش شده اند. کالیبراسیون در شرایط خاص یک ویژگی مفید است، اما در مواردی که تمایز بین موارد ریزش و عدم خروج کافی است، لازم نیست. CalibratedClassifierCV از جانب Scikit یاد بگیر می تواند برای کالیبره کردن یک مدل استفاده شود.

اکنون نقطه پایانی را با استفاده از دادههای تست نگهدارنده که شامل 1,939 مثال است، جستجو میکنیم. جدول زیر نتایج ارزیابی مدل چندوجهی ما را با ترانسفورماتور جمله Hugging Face و طبقهبندی جنگل تصادفی Scikit-learn خلاصه میکند.

| متری | BERT + جنگل تصادفی |

| دقت | 0.77463 |

| ROC AUC | 0.75905 |

عملکرد مدل به پیکربندی هایپرپارامتر بستگی دارد. آموزش یک مدل با یک مجموعه از تنظیمات هایپرپارامتر، یک مدل بهینه را تضمین نمی کند. در نتیجه، فرآیند HPO را در بخش زیر برای بهبود بیشتر عملکرد مدل اجرا میکنیم.

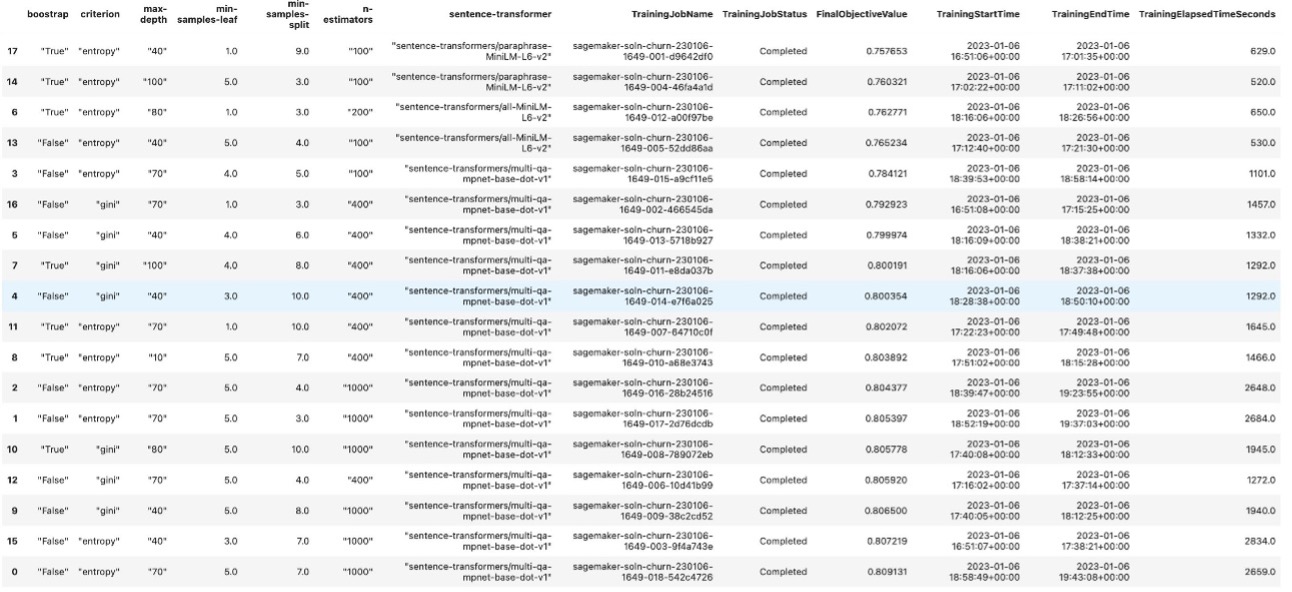

یک مدل چند وجهی را با HPO مناسب کنید

در این بخش، عملکرد مدل را با افزودن تنظیم HPO با بیشتر بهبود میدهیم تنظیم خودکار مدل SageMaker. تنظیم خودکار مدل SageMaker که به عنوان تنظیم هایپرپارامتر نیز شناخته می شود، با اجرای بسیاری از کارهای آموزشی روی مجموعه داده شما با استفاده از الگوریتم و محدوده هایپرپارامترهایی که شما مشخص کرده اید، بهترین نسخه یک مدل را پیدا می کند. سپس مقادیر فراپارامتر را انتخاب می کند که منجر به مدلی می شود که بهترین عملکرد را دارد، همانطور که توسط متریکی که انتخاب می کنید اندازه گیری می شود. بهترین مدل و فراپارامترهای مربوط به آن بر روی داده های اعتبار سنجی انتخاب می شوند. در مرحله بعد، بهترین مدل بر روی داده های تست نگهدارنده ارزیابی می شود، که همان داده های آزمایشی است که در بخش قبل ایجاد کردیم. در نهایت، نشان میدهیم که عملکرد مدل آموزش دیده با HPO به طور قابل توجهی بهتر از مدل آموزش دیده بدون HPO است.

موارد زیر فراپارامترهای استاتیکی هستند که ما تنظیم نمی کنیم و هایپرپارامترهای پویا که می خواهیم تنظیم کنیم و محدوده جستجوی آنها:

ما نام متریک هدف، تعریف متریک (با الگوی regex) و نوع هدف را برای کار تنظیم تعریف می کنیم.

ابتدا، هدف را به عنوان امتیاز دقت در داده های اعتبار سنجی (roc auc score on validation data) و معیارهایی را برای کار تنظیم با تعیین نام متریک هدف و یک عبارت منظم (regex) تعریف کرد. عبارت منظم برای مطابقت با خروجی گزارش الگوریتم و گرفتن مقادیر عددی معیارها استفاده می شود.

در مرحله بعد، محدوده هایپرپارامتر را مشخص می کنیم تا بهترین مقادیر هایپرپارامتر را از بین آنها انتخاب کنیم. تعداد کل کارهای تنظیم را 10 تنظیم می کنیم و این کارها را در پنج کار مختلف توزیع می کنیم ابر محاسبه الاستیک آمازون نمونه هایی (Amazon EC2) برای اجرای کارهای تنظیم موازی.

در نهایت، ما آن مقادیر را برای نمونه سازی یک شی SageMaker Estimator، مشابه آنچه در مرحله آموزش قبلی انجام دادیم، ارسال می کنیم. به جای فراخوانی تابع fit شیء Estimator، شی Estimator را به عنوان پارامتر به HyperparameterTuner سازنده و فراخوانی تابع fit آن برای راه اندازی کارهای تنظیم:

وقتی کار تنظیم کامل شد، میتوانیم جدول خلاصه تمام کارهای تنظیم را ایجاد کنیم.

پس از تکمیل کارهای تنظیم، مدلی را به کار میگیریم که بهترین امتیاز معیار ارزیابی را در مجموعه داده اعتبارسنجی میدهد، استنتاج را بر روی همان مجموعه داده تست نگهدارنده که در بخش قبل انجام دادیم، انجام میدهیم و معیارهای ارزیابی را محاسبه میکنیم.

| متری | BERT + جنگل تصادفی | BERT + جنگل تصادفی با HPO |

| دقت | 0.77463 | 0.9278 |

| ROC AUC | 0.75905 | 0.79861 |

میتوانیم ببینیم که اجرای HPO با تنظیم خودکار مدل SageMaker عملکرد مدل را به طور قابل توجهی بهبود میبخشد.

علاوه بر HPO، عملکرد مدل نیز به الگوریتم وابسته است. آموزش چندین الگوریتم پیشرفته، مقایسه عملکرد آنها بر روی همان دادههای تست نگهدارنده و انتخاب بهینه آن بسیار مهم است. بنابراین، دو مدل چند وجهی AutoGluon دیگر را در بخشهای زیر آموزش میدهیم.

یک مدل مجموعه وزنی/انباشته چندوجهی AutoGluon را متناسب کنید

دو نوع AutoGluon چند وجهی وجود دارد:

- آموزش چند مدل جدولی و همچنین

TextPredictorمدل (با استفاده ازTextPredictorمدل داخلTabularPredictor، و سپس آنها را از طریق یک گروه وزنی یا گروه انباشته، همانطور که در توضیح داده شد، ترکیب کنید AutoGluon-Tabular: AutoML قوی و دقیق برای داده های ساختاریافته - چندین مدل شبکه عصبی را مستقیماً ترکیب کنید و متن خام را مدیریت کنید (که همچنین قادر به مدیریت ستون های عددی و دسته بندی اضافی هستند)

ما ابتدا در این بخش یک مدل چندوجهی وزن دار یا انباشته را آموزش می دهیم و در بخش بعدی یک مدل شبکه عصبی فیوژن را آموزش می دهیم.

ابتدا تصویر آموزش AutoGluon را بازیابی می کنیم:

بعد، ما در hyperparameters عبور می کنیم. برخلاف چارچوبهای AutoML موجود که عمدتاً بر روی مدل یا انتخاب فراپارامتر تمرکز میکنند، AutoGluonTabular با ترکیب چندین مدل و چیدن آنها در چندین لایه موفق میشود. بنابراین، HPO معمولاً برای مدلهای مجموعه AutoGluon مورد نیاز نیست.

در نهایت، یک را ایجاد می کنیم برآوردگر SageMaker و تماس بگیرید estimator.fit() برای شروع کار آموزشی:

پس از اتمام آموزش، تصویر استنتاج AutoGluon را بازیابی می کنیم و مدل را مستقر می کنیم:

پس از استقرار نقاط پایانی، نقطه پایانی را با استفاده از همان مجموعه تست و معیارهای ارزیابی محاسبه میکنیم. در جدول زیر، میتوان مشاهده کرد که مجموعه چندوجهی AutoGluon حدود 3% در ROC AUC در مقایسه با ترانسفورماتور جمله BERT و جنگل تصادفی با HPO بهبود مییابد.

| متری | BERT + جنگل تصادفی | BERT + جنگل تصادفی با HPO | مجموعه چند وجهی AutoGluon |

| دقت | 0.77463 | 0.9278 | 0.92625 |

| ROC AUC | 0.75905 | 0.79861 | 0.82918 |

یک مدل همجوشی چندوجهی AutoGluon را مناسب کنید

نمودار زیر معماری مدل را نشان می دهد. برای جزئیات، نگاه کنید AutoMM برای متن + جدول - شروع سریع.

در داخل، ما از شبکه های مختلف برای رمزگذاری ستون های متن، ستون های طبقه بندی و ستون های عددی استفاده می کنیم. ویژگیهای ایجاد شده توسط شبکههای مجزا توسط یک جمعآوری با همجوشی دیرهنگام تجمیع میشوند. تجمیع کننده می تواند هر دو logits یا پیش بینی امتیاز را خروجی دهد.

در اینجا، ما از ستون فقرات NLP از پیش آموزش دیده برای استخراج ویژگی های متن استفاده می کنیم و سپس از دو برج دیگر برای استخراج ویژگی از ستون طبقه بندی و ستون عددی استفاده می کنیم.

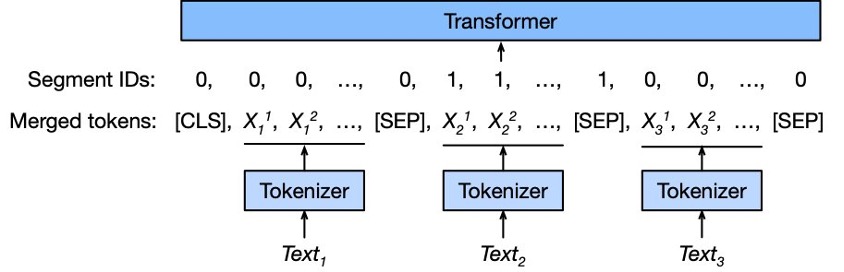

علاوه بر این، برای مقابله با چندین فیلد متنی، همانطور که در نمودار زیر نشان داده شده است، این فیلدها را با نشانه [SEP] و 0 و 1های جایگزین به عنوان شناسه بخش جدا می کنیم.

به طور مشابه، دستورالعملهای بخش قبل را برای آموزش و استقرار مدل همجوشی چندوجهی AutoGluon دنبال میکنیم:

جدول زیر نتایج ارزیابی مدل همجوشی چندوجهی AutoGluon را به همراه نتایج سه مدلی که در بخشهای قبلی ارزیابی کردیم، خلاصه میکند. ما میتوانیم ببینیم که مجموعه چندوجهی AutoGluon و مدلهای همجوشی چندوجهی بهترین عملکرد را دارند.

| متریک | BERT + جنگل تصادفی | BERT + جنگل تصادفی با HPO | مجموعه چند وجهی AutoGluon | AutoGluon Multimodal Fusion |

| دقت | 0.77463 | 0.9278 | 0.92625 | 0.9247 |

| ROC AUC | 0.75905 | 0.79861 | 0.82918 | 0.81115 |

توجه داشته باشید که نتایج و عملکرد نسبی بین این مدل ها به مجموعه داده ای که برای آموزش استفاده می کنید بستگی دارد. این نتایج نشاندهنده هستند، و حتی اگر تمایل الگوریتمهای خاص به عملکرد بهتر بر اساس عوامل مرتبط است، تعادل در عملکرد ممکن است با توجه به توزیع دادههای متفاوت تغییر کند. میتوانید مجموعه دادههای نمونه را با دادههای خود جایگزین کنید تا مشخص کنید چه مدلی برای شما بهتر کار میکند.

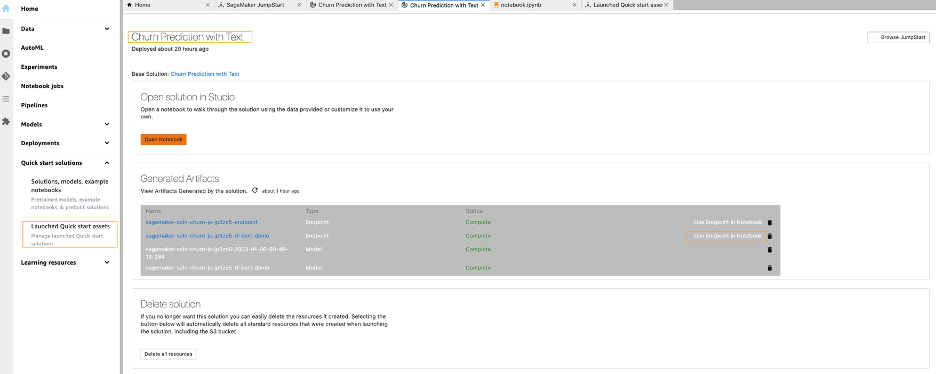

نوت بوک نمایشی

می توانید از نوت بوک آزمایشی برای ارسال داده های نمونه به نقاط پایانی مدل از قبل مستقر شده استفاده کنید. نوت بوک نسخه ی نمایشی به سرعت به شما امکان می دهد با جستجو در داده های نمونه، تجربه عملی داشته باشید. پس از راهاندازی راهحل Churn Prediction with Text، نوتبوک آزمایشی را با انتخاب باز کنید از Endpoint در Notebook استفاده کنید.

پاک کردن

پس از اتمام کار با این راه حل، مطمئن شوید که تمام منابع AWS ناخواسته را با انتخاب حذف کرده اید تمام منابع را حذف کنید.

توجه داشته باشید که باید منابع اضافی را که ممکن است در این دفترچه ایجاد کرده اید به صورت دستی حذف کنید.

نتیجه

در این پست نشان دادیم که چگونه میتوانید از Sagemaker JumpStart برای پیشبینی ریزش با استفاده از ویژگیهای چندوجهی متن و جدولی استفاده کنید.

اگر علاقه مند به یادگیری بیشتر در مورد مدل های ریزش مشتری هستید، پست های زیر را بررسی کنید:

درباره نویسنده

دکتر شین هوانگ یک دانشمند کاربردی برای آمازون SageMaker JumpStart و آمازون SageMaker الگوریتم های داخلی است. او بر روی توسعه الگوریتم های یادگیری ماشینی مقیاس پذیر تمرکز می کند. علایق تحقیقاتی او در زمینه پردازش زبان طبیعی، یادگیری عمیق قابل توضیح بر روی داده های جدولی و تجزیه و تحلیل قوی خوشه بندی ناپارامتریک فضا-زمان است. او مقالات زیادی را در کنفرانسهای ACL، ICDM، KDD و مجله Royal Statistical Society: Series A منتشر کرده است.

دکتر شین هوانگ یک دانشمند کاربردی برای آمازون SageMaker JumpStart و آمازون SageMaker الگوریتم های داخلی است. او بر روی توسعه الگوریتم های یادگیری ماشینی مقیاس پذیر تمرکز می کند. علایق تحقیقاتی او در زمینه پردازش زبان طبیعی، یادگیری عمیق قابل توضیح بر روی داده های جدولی و تجزیه و تحلیل قوی خوشه بندی ناپارامتریک فضا-زمان است. او مقالات زیادی را در کنفرانسهای ACL، ICDM، KDD و مجله Royal Statistical Society: Series A منتشر کرده است.

راجاکومار سامپاتکومار یک مدیر حساب فنی اصلی در AWS است که راهنمایی های مشتریان را در مورد همسویی فناوری تجاری ارائه می دهد و از اختراع مجدد مدل ها و فرآیندهای عملیات ابری آنها پشتیبانی می کند. او علاقه زیادی به یادگیری ابری و ماشینی دارد. راج همچنین یک متخصص یادگیری ماشین است و با مشتریان AWS برای طراحی، استقرار و مدیریت حجم کاری و معماری AWS آنها کار می کند.

راجاکومار سامپاتکومار یک مدیر حساب فنی اصلی در AWS است که راهنمایی های مشتریان را در مورد همسویی فناوری تجاری ارائه می دهد و از اختراع مجدد مدل ها و فرآیندهای عملیات ابری آنها پشتیبانی می کند. او علاقه زیادی به یادگیری ابری و ماشینی دارد. راج همچنین یک متخصص یادگیری ماشین است و با مشتریان AWS برای طراحی، استقرار و مدیریت حجم کاری و معماری AWS آنها کار می کند.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/churn-prediction-using-multimodality-of-text-and-tabular-features-with-amazon-sagemaker-jumpstart/

- 000

- 1

- 10

- 100

- 28

- 7

- 70

- 9

- a

- درباره ما

- حساب

- دقت

- دقیق

- رسیدن

- کسب

- فعال

- اضافه

- اضافی

- آدرس

- پس از

- عامل

- جمع کننده

- اهداف

- الگوریتم

- الگوریتم

- معرفی

- اجازه می دهد تا

- در کنار

- هر چند

- آمازون

- آمازون EC2

- آمازون SageMaker

- Amazon SageMaker JumpStart

- تحلیل

- تحلیل

- و

- اعمال می شود

- روش

- معماری

- محدوده

- مصنوعی

- هوش مصنوعی

- دارایی

- اتوماتیک

- خودکار کردن

- در دسترس

- AWS

- ستون فقرات

- برج میزان

- بانکداری

- مستقر

- زیرا

- بهترین

- بهتر

- میان

- خود راه انداز

- ساختن

- ساخته شده در

- کسب و کار

- خرید

- صدا

- فراخوانی

- تماس ها

- توانا

- گرفتن

- حمل

- مورد

- موارد

- دسته

- معین

- شانس

- تغییر دادن

- بررسی

- را انتخاب کنید

- انتخاب

- موقعیت

- طبقه بندی

- نزدیک

- ابر

- خوشه بندی

- رمز

- ستون

- ستون ها

- ترکیب

- مشترک

- شرکت

- شرکت

- مقايسه كردن

- مقایسه

- رقبای

- کامل

- اجزاء

- محاسبه

- همایش ها

- کنسول

- ظرف

- قرارداد

- قرارداد

- متناظر

- هزینه

- پوشش

- ایجاد

- ایجاد شده

- مشتری

- رفتار مشتری

- خدمات مشتری

- پشتیبانی مشتریان

- مشتریان

- داده ها

- مقدار

- معامله

- مصمم

- عمیق

- یادگیری عمیق

- وابسته

- بستگی دارد

- گسترش

- مستقر

- طرح

- جزئیات

- مشخص کردن

- در حال توسعه

- DID

- مختلف

- مستقیما

- توزیع کردن

- توزیع

- کارگر بارانداز

- سند

- نمی کند

- آیا

- دانلود

- پویا

- هر

- تلاش

- هر دو

- پشت سر هم

- نقطه پایانی

- مهندسی

- ارزیابی

- ارزیابی

- حتی

- مثال

- مثال ها

- موجود

- تجربه

- توضیح داده شده

- اکتشاف

- اکتشاف

- کشف

- بررسی

- عصاره

- خیلی

- چهره

- در مواجهه

- عوامل

- ویژگی

- امکانات

- رشته

- زمینه

- شکل

- سرانجام

- پیدا کردن

- پیدا می کند

- نام خانوادگی

- مناسب

- مناسب

- تمرکز

- تمرکز

- به دنبال

- پیروی

- جنگل

- قالب

- چارچوب

- از جانب

- تابع

- بیشتر

- ادغام

- به دست آوردن

- تولید می کنند

- تولید

- دریافت کنید

- داده

- می دهد

- گلوئون

- اهداف

- خوب

- شدن

- ضمانت

- دسته

- اداره

- دست

- کمک

- مفید

- چگونه

- چگونه

- HTML

- HTTPS

- قطب

- بهینه سازی هایپرپارامتر

- تنظیم فراپارامتر

- شناسایی

- تصویر

- واردات

- مهم

- بهبود

- in

- مشمول

- از جمله

- افزایش

- شاخص ها

- فرد

- اطلاعات

- شالوده

- ورودی

- بینش

- نصب

- نمونه

- در عوض

- دستورالعمل

- ادغام

- اطلاعات

- علاقه

- علاقه مند

- منافع

- گرفتار

- مسائل

- IT

- کار

- شغل ها

- روزنامه

- json

- کلید

- نوع

- شناخته شده

- فرود

- زبان

- راه اندازی

- لایه

- یادگیری

- ترک کردن

- طول

- احتمالا

- محدود

- لاین

- طولانی

- نگاه کنيد

- دستگاه

- فراگیری ماشین

- ساخت

- مدیریت

- مدیر

- دستی

- بسیاری

- مسابقه

- بیشینه ساختن

- بیشترین

- متری

- متریک

- قدرت

- ذهن

- گم

- ML

- مدل

- مدل

- ماه

- ماه

- بیش

- اکثر

- چند رشته ای

- چندگانه

- نام

- طبیعی

- پردازش زبان طبیعی

- هدایت

- جهت یابی

- لزوما

- نیاز

- شبکه

- شبکه

- شبکه های عصبی

- جدید

- بعد

- nlp

- دفتر یادداشت

- عدد

- هدف

- هدف

- ارائه شده

- ONE

- باز کن

- عمل

- بهینه

- بهینه سازی

- بهینه

- اصلی

- دیگر

- مشخص شده

- خود

- بسته

- قطعه

- اوراق

- موازی

- پارامتر

- بخش

- ویژه

- احساساتی

- الگو

- انجام

- کارایی

- اجرای

- انجام می دهد

- تلفن

- انتخاب کنید

- محل

- برنامه

- افلاطون

- هوش داده افلاطون

- PlatoData

- پست

- پست ها

- پیش بینی

- پیش گویی

- پیش بینی

- پیشگو

- آماده

- قبلی

- در درجه اول

- اصلی

- مشکل

- روند

- فرآوری شده

- فرآیندهای

- در حال پردازش

- ویژگی

- فراهم می کند

- ارائه

- عمومی

- منتشر شده

- اهداف

- پــایتــون

- مارماهی

- سریع

- به سرعت

- تصادفی

- محدوده

- خام

- RE

- اماده

- regex

- منظم

- مربوط

- جایگزین کردن

- نماینده

- درخواست

- ضروری

- تحقیق

- منابع

- پاسخ

- پاسخگو

- نتیجه

- نتایج

- درامد

- تنومند

- سلطنتی

- دویدن

- در حال اجرا

- حکیم ساز

- تنظیم خودکار مدل SageMaker

- همان

- مقیاس پذیر

- دانشمند

- یادگیری

- sdk

- جستجو

- جستجو

- بخش

- بخش

- بخش

- انتخاب شد

- انتخاب

- جمله

- سلسله

- سری A

- سرویس

- تنظیم

- مجموعه

- چند

- باید

- نشان

- نشان داده شده

- نشان می دهد

- سیگنال

- به طور قابل توجهی

- مشابه

- ساده

- So

- جامعه

- راه حل

- مزایا

- حل

- حل کردن

- برخی از

- منبع

- متخصص

- خاص

- به طور خاص

- انشعاب

- با حداکثر سرعت دویدن

- انباشته

- پشتهسازی

- صحنه

- استاندارد

- شروع

- آغاز شده

- وضعیت هنر

- آماری

- ارقام

- گام

- مراحل

- ذخیره سازی

- opbevare

- ساخت یافته

- استودیو

- متعاقبا

- موفقیت

- چنین

- کافی

- خلاصه

- پشتیبانی

- حمایت از

- جدول

- گرفتن

- هدف

- فن آوری

- فنی

- ارتباط از راه دور

- قالب

- قالب

- قوانین و مقررات

- آزمون

- La

- محوطه

- منبع

- شان

- از این رو

- سه

- به

- امروز

- رمز

- بالا

- جمع

- سنتی

- قطار

- آموزش دیده

- آموزش

- مبدل

- درست

- انواع

- به طور معمول

- زیر

- درک

- نا محدود

- ناخواسته

- ارتقاء

- us

- استفاده کنید

- مورد استفاده

- کاربر

- معمولا

- با استفاده از

- تصدیق

- اعتبار سنجی

- ارزشمند

- ارزش

- ارزشها

- تنوع

- مختلف

- Ve

- ورایزون

- نسخه

- از طريق

- چی

- چه

- که

- WHO

- وسیع

- دامنه گسترده

- اراده

- بدون

- مهاجرت کاری

- با این نسخهها کار

- خواهد بود

- اشتباه

- X

- شما

- شما

- زفیرنت