در دنیای پویا جریان در آمازون موسیقی، هر جستجوی یک آهنگ، پادکست یا لیست پخش، داستان، حال و هوا یا سیلی از احساسات را در خود جای می دهد که منتظر رونمایی هستند. این جستجوها به عنوان دروازه ای برای اکتشافات جدید، تجربیات گرامی و خاطرات ماندگار عمل می کنند. نوار جستجو فقط برای یافتن یک آهنگ نیست. این در مورد میلیون ها کاربر فعال است که سفر شخصی خود را به دنیای غنی و متنوعی که آمازون موزیک ارائه می دهد آغاز می کنند.

ارائه یک تجربه مشتری برتر برای یافتن فورا موسیقی مورد جستجوی کاربران نیازمند پلتفرمی است که هم هوشمند و هم پاسخگو باشد. آمازون موزیک از قدرت هوش مصنوعی برای انجام این کار استفاده می کند. با این حال، بهینهسازی تجربه مشتری در حین مدیریت هزینههای آموزش و استنباط مدلهای هوش مصنوعی که تواناییهای نوار جستجو را تقویت میکنند، مانند بررسی املای زمان واقعی و جستجوی برداری، در زمان اوج ترافیک دشوار است.

آمازون SageMaker مجموعه ای سرتاسری از خدمات را ارائه می دهد که به آمازون موزیک اجازه می دهد تا با کمترین تلاش، روی AWS Cloud بسازد، آموزش دهد و استقرار دهد. SageMaker با مراقبت از وزنه برداری غیرمتمایز، به شما این امکان را می دهد که بر روی مدل های یادگیری ماشینی (ML) خود تمرکز کنید و نگران چیزهایی مانند زیرساخت نباشید. به عنوان بخشی از مدل مسئولیت مشترک، SageMaker اطمینان حاصل می کند که خدماتی که ارائه می دهد قابل اعتماد، کارآمد و مقیاس پذیر هستند، در حالی که شما مطمئن می شوید که استفاده از مدل های ML از قابلیت هایی که SageMaker ارائه می دهد بهترین استفاده را می کند.

در این پست، سفری را که آمازون موزیک برای بهینهسازی عملکرد و هزینه با استفاده از SageMaker و NVIDIA Triton Server و TensorRT طی کرد، طی میکنیم. ما عمیقاً به نشان دادن نحوه عملکرد آن نوار جستجوی به ظاهر ساده و در عین حال پیچیده می پردازیم، که سفری ناگسستنی به دنیای آمازون موزیک را با تأخیرهای ناامیدکننده تایپی و نتایج جستجوی بلادرنگ مرتبط تضمین می کند.

Amazon SageMaker و NVIDIA: ارائه قابلیت های جستجوی برداری سریع و دقیق و بررسی املا

آمازون موزیک کتابخانه وسیعی با بیش از 100 میلیون آهنگ و میلیون ها قسمت پادکست ارائه می دهد. با این حال، یافتن آهنگ یا پادکست مناسب میتواند چالش برانگیز باشد، به خصوص اگر عنوان، هنرمند یا نام آلبوم را دقیقاً نمیدانید، یا جستجوی جستجو شده بسیار گسترده است، مانند «پادکستهای خبری».

آمازون موزیک برای بهبود فرآیند جستجو و بازیابی رویکردی دو جانبه در پیش گرفته است. اولین قدم معرفی جستجوی برداری (همچنین به عنوان بازیابی مبتنی بر تعبیه شناخته می شود)، یک تکنیک ML است که می تواند به کاربران کمک کند مرتبط ترین محتوای مورد نظر خود را با استفاده از معنایی محتوا پیدا کنند. مرحله دوم شامل معرفی یک مدل تصحیح املا مبتنی بر ترانسفورماتور در پشته جستجو است. این می تواند به ویژه هنگام جستجوی موسیقی مفید باشد، زیرا کاربران ممکن است همیشه املای دقیق عنوان آهنگ یا نام هنرمند را ندانند. تصحیح املا می تواند به کاربران کمک کند موسیقی مورد نظر خود را پیدا کنند، حتی اگر در عبارت جستجوی خود اشتباه املایی داشته باشند.

معرفی مدلهای ترانسفورماتور در خط لوله جستجو و بازیابی (در جستوجوی پرس و جوی مورد نیاز برای جستجوی برداری و مدل مولد ترانسفورماتور Seq2Seq در تصحیح املا) ممکن است منجر به افزایش قابلتوجه در تأخیر کلی شود و بر تجربه مشتری تأثیر منفی بگذارد. بنابراین، بهینهسازی تأخیر استنتاج بلادرنگ برای مدلهای جستجوی برداری و تصحیح املا به اولویت اصلی ما تبدیل شد.

آمازون موزیک و انویدیا گرد هم آمدهاند تا بهترین تجربه مشتری ممکن را به نوار جستجو بیاورند و از SageMaker برای پیادهسازی قابلیتهای غلط املایی سریع و دقیق و پیشنهادهای جستجوی معنایی بلادرنگ با استفاده از تکنیکهای مبتنی بر جستجوی برداری استفاده میکنند. این راه حل شامل استفاده از میزبانی SageMaker با استفاده از نمونه های G5 است که از پردازنده های گرافیکی NVIDIA A10G Tensor Core، کانتینر سرور استنتاج انویدیا تریتون پشتیبانی شده توسط SageMaker و NVIDIA TensorRT قالب مدل آمازون موزیک با کاهش تأخیر استنتاج مدل غلطگیر املایی به 25 میلیثانیه در اوج ترافیک، و کاهش تأخیر تولید جاسازی پرس و جو تا 63 درصد و هزینه 73 درصد در مقایسه با استنتاج مبتنی بر CPU، عملکرد نوار جستجو را افزایش داده است.

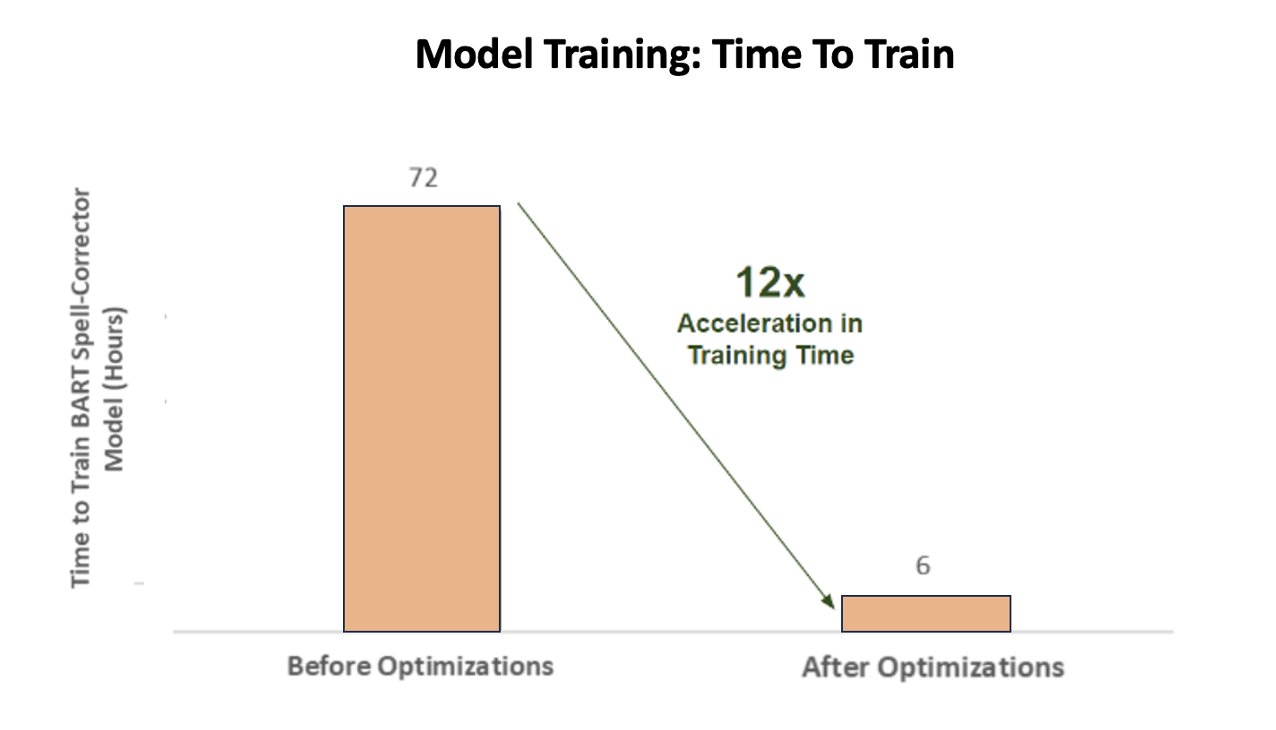

علاوه بر این، هنگام آموزش مدل هوش مصنوعی برای ارائه نتایج دقیق، آمازون موزیک به شتاب 12 برابری در زمان آموزش برای مدل ترانسفورماتور تصحیح کننده املای توالی به دنباله BART خود دست یافت و با بهینه سازی استفاده از GPU، در زمان و هزینه آنها صرفه جویی کرد.

آمازون موزیک با NVIDIA همکاری کرد تا تجربه جستجوی مشتری را در اولویت قرار دهد و یک نوار جستجو با قابلیتهای بهینهسازی املا و جستجوی برداری ایجاد کند. در بخشهای بعدی، اطلاعات بیشتری درباره نحوه تنظیم این بهینهسازیها به اشتراک میگذاریم.

بهینه سازی آموزش با پردازنده های گرافیکی NVIDIA Tensor Core

دسترسی به یک پردازنده گرافیکی NVIDIA Tensor Core برای آموزش مدل های زبان بزرگ برای به تصویر کشیدن پتانسیل واقعی آن کافی نیست. مراحل بهینه سازی کلیدی وجود دارد که باید در طول آموزش اتفاق بیفتد تا به طور کامل استفاده از GPU به حداکثر برسد. با این حال، استفاده ناکافی از GPU بدون شک منجر به استفاده ناکارآمد از منابع، طولانی شدن مدت زمان آموزش و افزایش هزینه های عملیاتی می شود.

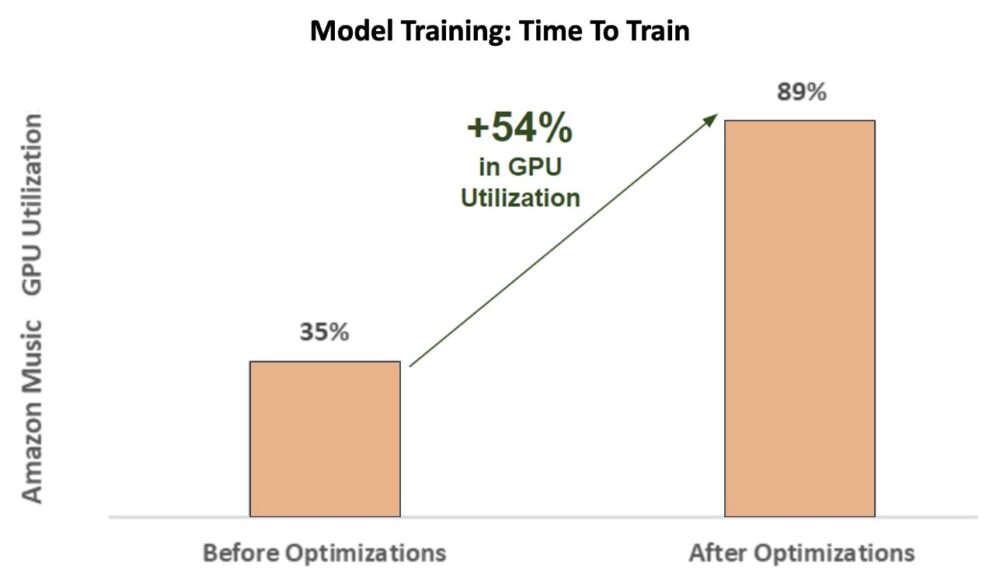

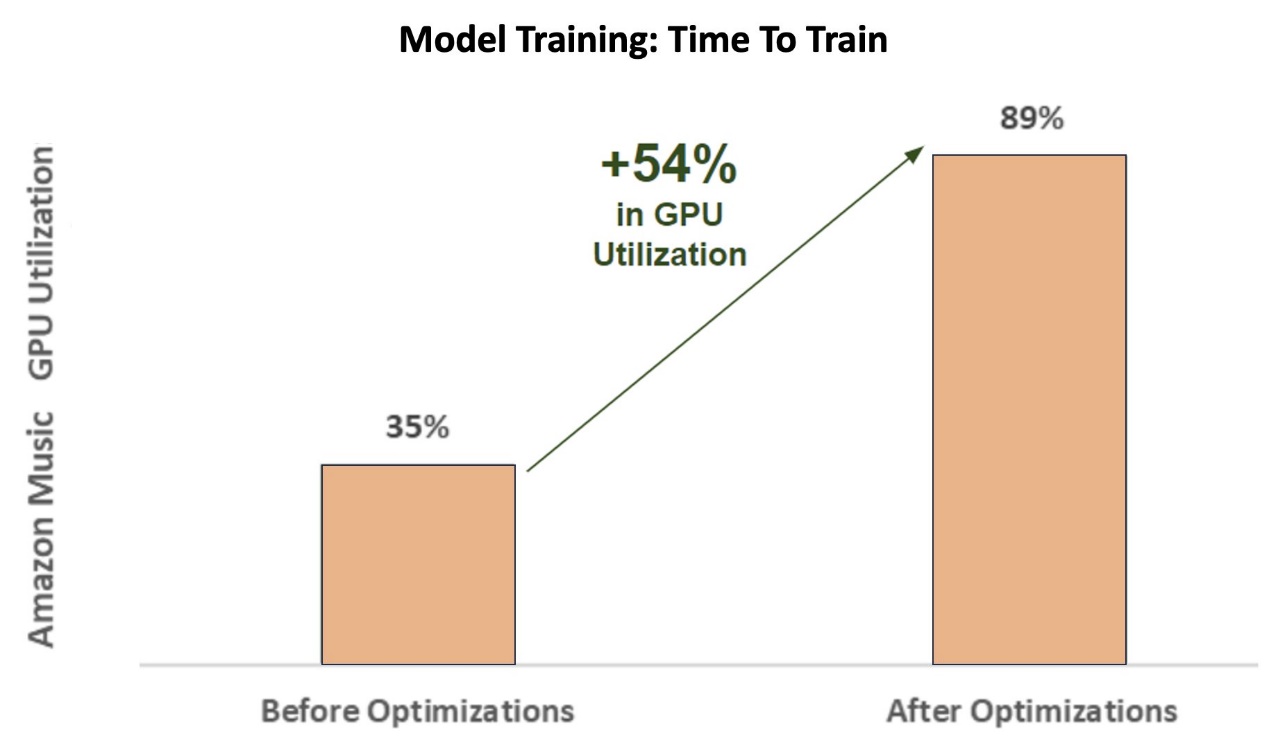

در مراحل اولیه آموزش، اصلاح کننده املایی BART (بارت پایه) مدل ترانسفورماتور در یک نمونه SageMaker ml.p3.24xlarge (8 پردازنده گرافیکی NVIDIA V100 Tensor Core)، استفاده از پردازنده گرافیکی آمازون موزیک حدود 35٪ بود. برای به حداکثر رساندن مزایای آموزش با شتاب GPU NVIDIA، معماران راه حل AWS و NVIDIA از آمازون موزیک در شناسایی مناطق برای بهینه سازی، به ویژه در مورد اندازه دسته و پارامترهای دقیق پشتیبانی کردند. این دو پارامتر حیاتی بر کارایی، سرعت و دقت آموزش مدلهای یادگیری عمیق تأثیر میگذارند.

بهینهسازیهای بهدستآمده، استفاده جدید و بهبود یافتهای از GPU V100 را به همراه داشت که ثابت در حدود 89 درصد بود و زمان آموزش آمازون موزیک را به شدت از 3 روز به 5 تا 6 ساعت کاهش داد. با تغییر اندازه دسته از 32 به 256 و استفاده از تکنیک های بهینه سازی مانند اجرا آموزش دقیق ترکیبی خودکار به جای استفاده از دقت FP32، آمازون موزیک توانست در زمان و هزینه صرفه جویی کند.

نمودار زیر افزایش 54 درصدی در استفاده از GPU را پس از بهینه سازی نشان می دهد.

شکل زیر شتاب در زمان تمرین را نشان می دهد.

این افزایش در اندازه دسته، GPU NVIDIA را قادر می سازد تا داده های بیشتری را به طور همزمان در چندین هسته Tensor پردازش کند و در نتیجه زمان آموزش تسریع شود. با این حال، حفظ تعادل ظریف با حافظه مهم است، زیرا اندازه های بزرگتر به حافظه بیشتری نیاز دارند. هم افزایش اندازه دسته و هم استفاده از دقت ترکیبی می تواند در باز کردن قدرت پردازنده های گرافیکی NVIDIA Tensor Core حیاتی باشد.

پس از اینکه مدل برای همگرایی آموزش دید، زمان بهینه سازی برای استقرار استنتاج در نوار جستجوی آمازون موزیک فرا رسید.

تصحیح املا: استنباط مدل BART

آمازون موزیک با کمک نمونههای SageMaker G5 و NVIDIA Triton Inference Server (یک نرمافزار استنتاج منبع باز)، و همچنین NVIDIA TensorRT، یک SDK برای استنتاج یادگیری عمیق با کارایی بالا که شامل بهینهساز استنتاج و زمان اجرا میشود، املای BART خود را محدود میکند. (بارت پایه) تأخیر استنتاج سرور را تا تنها 25 میلی ثانیه در اوج ترافیک مدل کنید. این شامل سربارهایی مانند تعادل بار، پیش پردازش، استنتاج مدل و زمان های پس پردازش می شود.

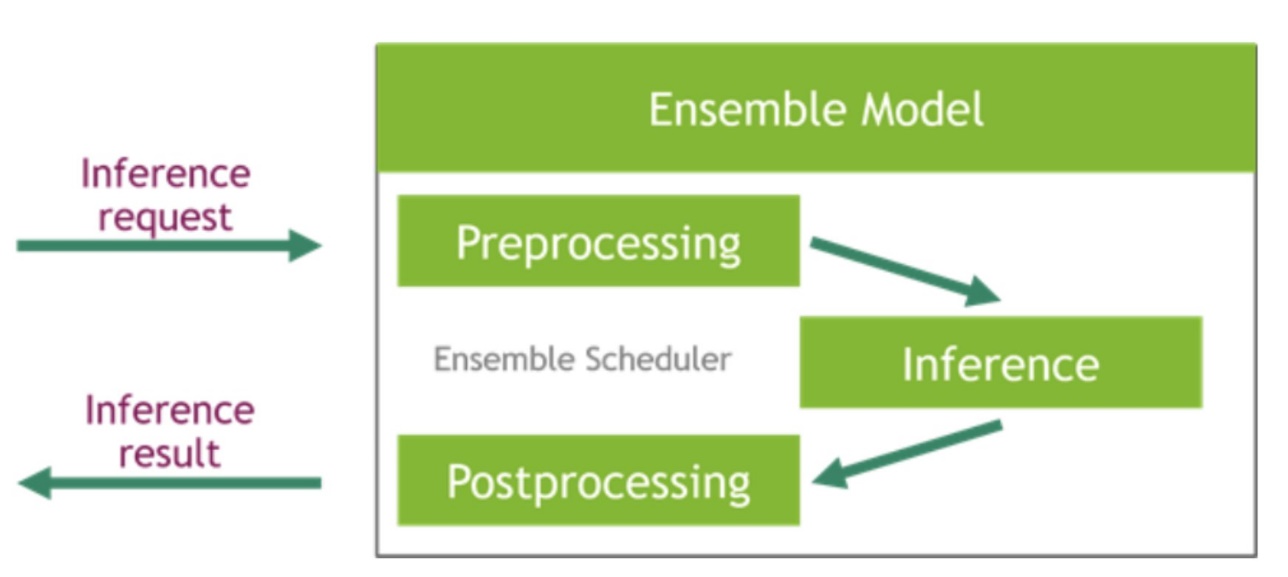

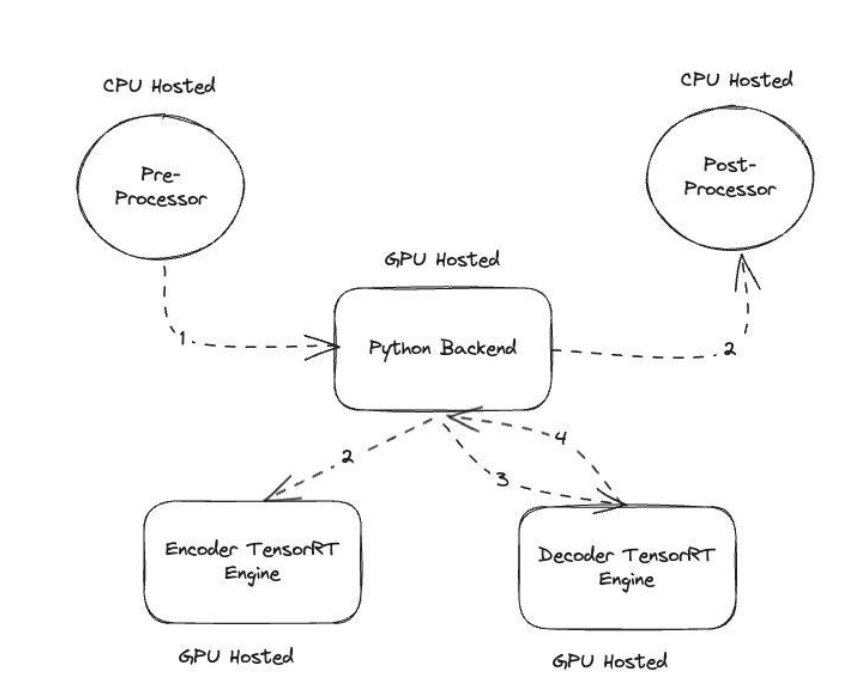

NVIDIA Triton Inference Server دو نوع پشتیبان مختلف ارائه میکند: یکی برای میزبانی مدلها در GPU، و دیگری پایتون که میتوانید کد سفارشی خود را برای استفاده در مراحل پیشپردازش و پس پردازش بیاورید. شکل زیر نشان می دهد طرح گروه مدل.

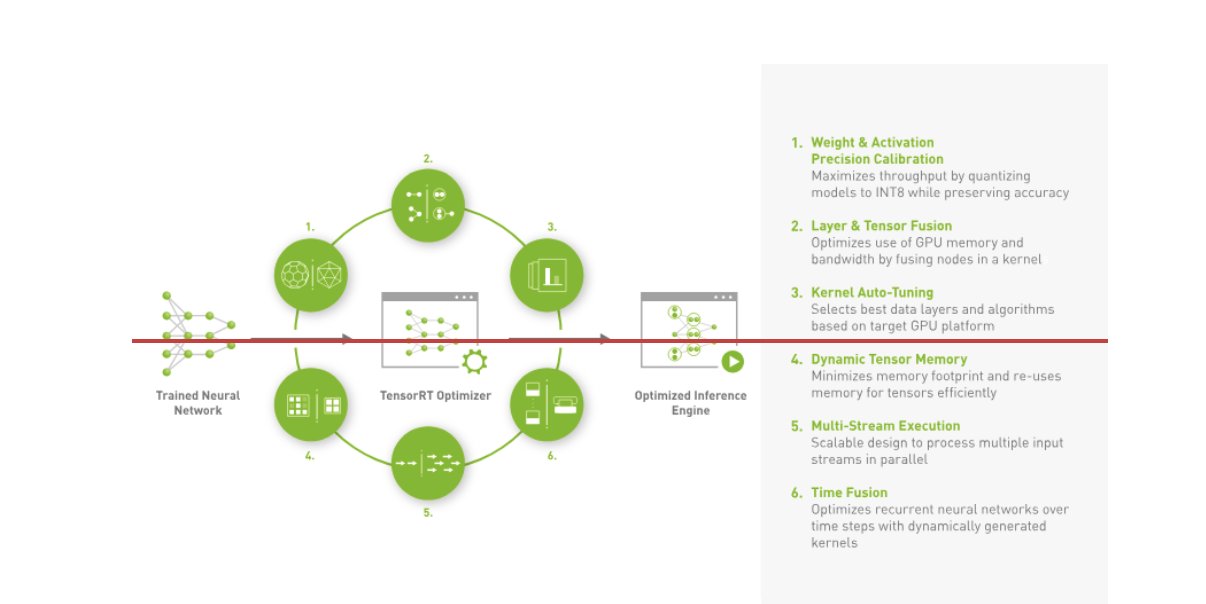

آمازون موزیک BART خود را ساخت خط لوله استنتاج با اجرای هر دو مرحله پیش پردازش (توکن سازی متن) و پس پردازش (توکن به متن) در CPU، در حالی که مرحله اجرای مدل در CPU اجرا می شود. پردازندههای گرافیکی NVIDIA A10G Tensor Core. یک Backend پایتون در وسط مراحل پیش پردازش و پس پردازش قرار دارد و مسئول ارتباط با مدل های BART تبدیل شده توسط TensorRT و همچنین شبکه های رمزگذار/رمزگشا است. تنفر عملکرد استنتاج را با کالیبراسیون دقیق، ترکیب لایه و تانسور، تنظیم خودکار هسته، حافظه تانسور پویا، اجرای چند جریانی و همجوشی زمانی افزایش میدهد.

شکل زیر طراحی سطح بالای ماژول های کلیدی را نشان می دهد که خط لوله استنتاج مدل BART اصلاح کننده املا را تشکیل می دهند.

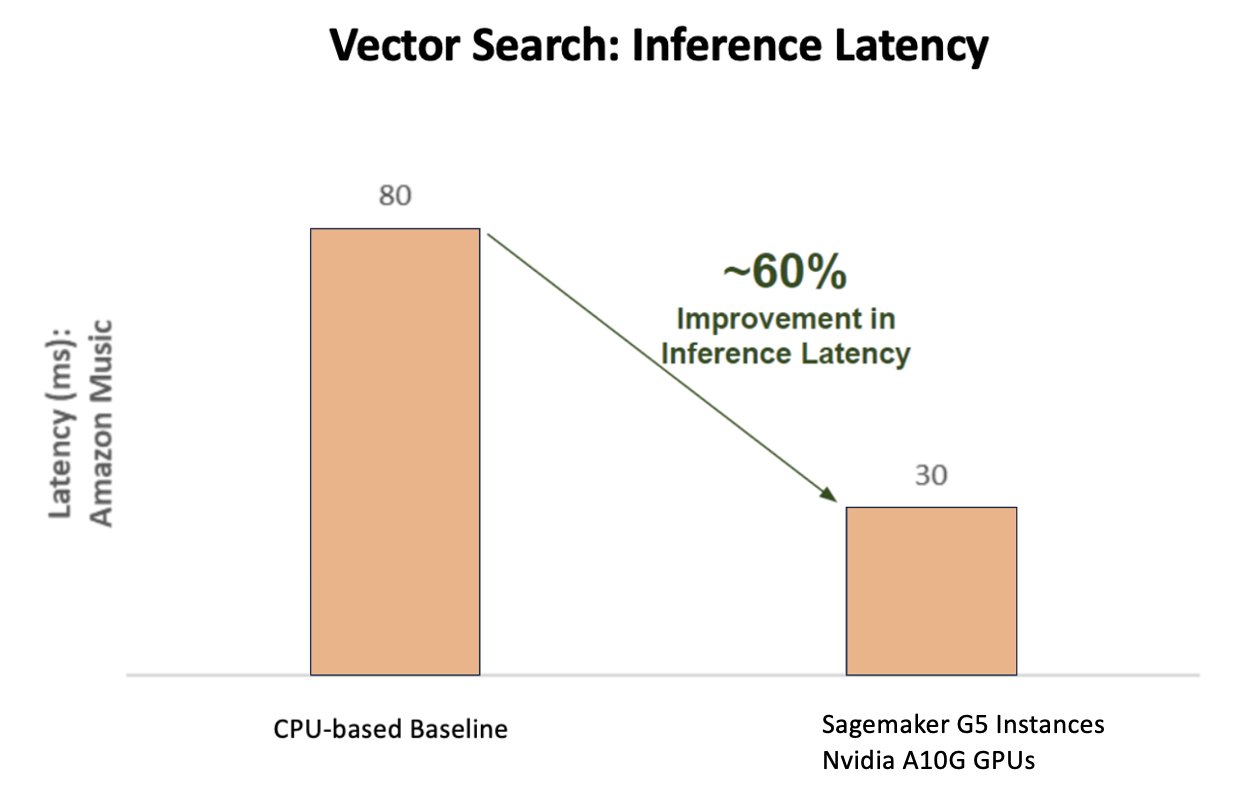

جستجوی برداری: استنتاج مدل BERT نسل جمله جاسازی پرس و جو

نمودار زیر بهبود 60 درصدی تأخیر (ارائه P90 800–900 TPS) را هنگام استفاده از پلتفرم استنتاج هوش مصنوعی NVIDIA در مقایسه با خط پایه مبتنی بر CPU نشان میدهد.

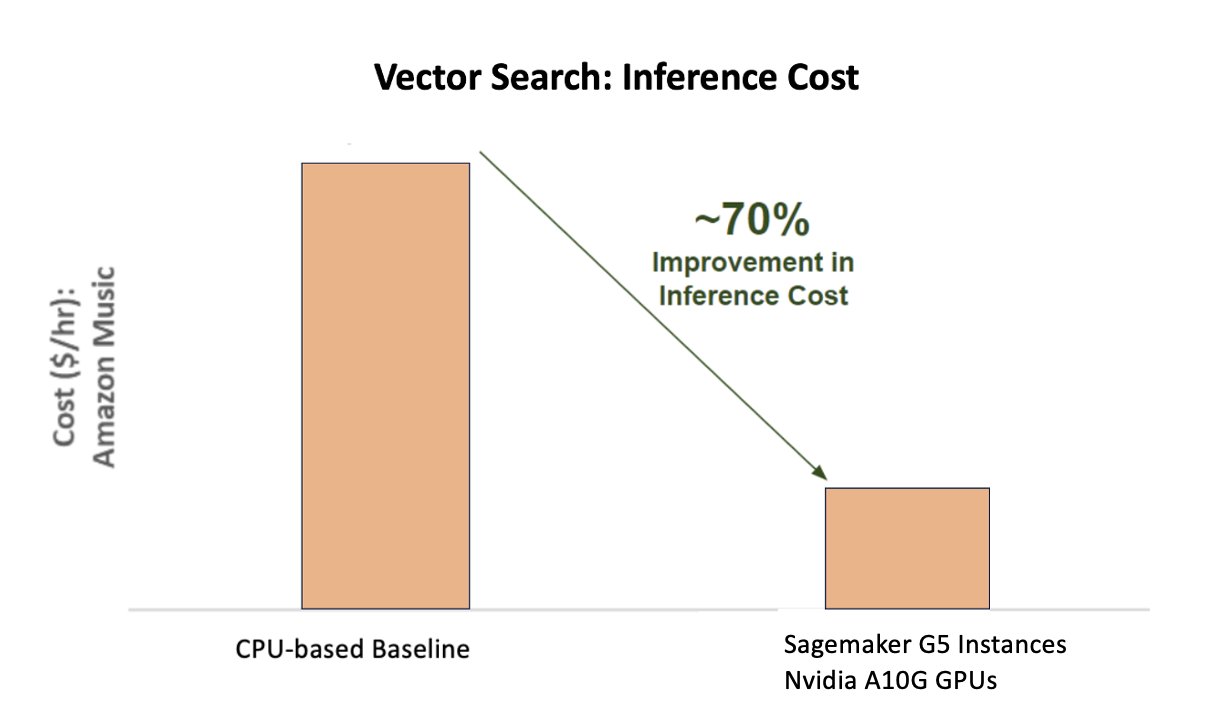

نمودار زیر بهبود 70 درصدی هزینه را هنگام استفاده از پلتفرم استنتاج هوش مصنوعی NVIDIA در مقایسه با پایه مبتنی بر CPU نشان می دهد.

شکل زیر یک SDK برای استنتاج یادگیری عمیق با کارایی بالا را نشان می دهد. این شامل یک بهینه ساز استنتاج یادگیری عمیق و زمان اجرا است که تأخیر کم و توان عملیاتی بالا را برای برنامه های استنتاج ارائه می دهد.

برای دستیابی به این نتایج، آمازون موزیک چندین پارامتر مختلف استقرار Triton را با استفاده از آزمایش کرد آنالایزر مدل تریتون، ابزاری است که به یافتن بهترین پیکربندی مدل NVIDIA Triton برای استقرار استنتاج کارآمد کمک می کند. برای بهینهسازی استنتاج مدل، تریتون ویژگیهایی مانند دستهبندی پویا و اجرای همزمان مدل را ارائه میکند و از چارچوبی برای قابلیتهای انعطافپذیری دیگر پشتیبانی میکند. دستهبندی پویا درخواستهای استنتاج را جمعآوری میکند، و بهطور یکپارچه آنها را در گروههایی با هم گروهبندی میکند تا توان عملیاتی را به حداکثر برساند، و در عین حال پاسخهای بلادرنگ را برای کاربران Amazon Music تضمین میکند. قابلیت اجرای مدل همزمان با میزبانی چندین نسخه از مدل در یک GPU، عملکرد استنتاج را بیشتر افزایش میدهد. در نهایت با استفاده از آنالایزر مدل تریتونآمازون موزیک توانست پارامترهای میزبانی دستهای پویا و مدلسازی پارامترهای میزبانی استنتاج همزمان را به دقت تنظیم کند تا تنظیمات بهینه را پیدا کند که عملکرد استنتاج را با استفاده از ترافیک شبیهسازی شده به حداکثر میرساند.

نتیجه

بهینه سازی پیکربندی ها با Triton Inference Server و TensorRT در SageMaker به آمازون موزیک اجازه داد تا به نتایج برجسته ای برای خطوط لوله آموزشی و استنتاج دست یابد. پلتفرم SageMaker پلتفرم باز سرتاسری برای تولید هوش مصنوعی است که زمان سریعی برای ارزش گذاری و تطبیق پذیری برای پشتیبانی از تمام موارد اصلی استفاده از هوش مصنوعی در سخت افزار و نرم افزار فراهم می کند. با بهینهسازی استفاده از پردازنده گرافیکی V100 برای آموزش و جابجایی از CPU به نمونههای G5 با استفاده از پردازندههای گرافیکی NVIDIA A10G Tensor Core، و همچنین با استفاده از نرمافزار بهینهسازی شده NVIDIA مانند Triton Inference Server و TensorRT، شرکتهایی مانند آمازون موزیک میتوانند در زمان و هزینه صرفهجویی کنند و در عین حال عملکرد را در هر دو افزایش دهند. آموزش و استنباط، به طور مستقیم به تجربه بهتر مشتری و هزینه های عملیاتی کمتر تبدیل می شود.

SageMaker با انجام کارهای سنگین غیرمتمایز برای آموزش و میزبانی ML، به آمازون موزیک اجازه می دهد تا عملیات ML قابل اعتماد و مقیاس پذیر را در سخت افزار و نرم افزار ارائه دهد.

ما شما را تشویق میکنیم که با ارزیابی گزینههای سختافزار و نرمافزار خود، بررسی کنید که حجم کاریتان با استفاده از SageMaker بهینه شده است تا ببینید آیا راههایی وجود دارد که بتوانید با کاهش هزینهها به عملکرد بهتری دست یابید.

برای کسب اطلاعات بیشتر در مورد NVIDIA AI در AWS، به موارد زیر مراجعه کنید:

درباره نویسندگان

سیدارت شارما یک رهبر فناوری یادگیری ماشین در تیم علم و مدل سازی در آمازون موزیک است. او در مسائل مربوط به جستجو، بازیابی، رتبه بندی و مدل سازی NLP تخصص دارد. سیدارت پیشینه ای غنی دارد که روی مشکلات یادگیری ماشینی در مقیاس بزرگ کار می کند که به تأخیر حساس هستند، مثلاً هدف گذاری تبلیغات، بازیابی چند وجهی، درک پرس و جوی جستجو و غیره. قبل از کار در آمازون موزیک، سیدارت در شرکت هایی مانند Meta، Walmart Labs، Rakuten کار می کرد. در مورد مسائل تجارت الکترونیک محور ML. سیدهارت بخشی از اوایل دوران حرفهای خود را با استارتآپهای فناوری تبلیغاتی منطقه خلیج گذراند.

سیدارت شارما یک رهبر فناوری یادگیری ماشین در تیم علم و مدل سازی در آمازون موزیک است. او در مسائل مربوط به جستجو، بازیابی، رتبه بندی و مدل سازی NLP تخصص دارد. سیدارت پیشینه ای غنی دارد که روی مشکلات یادگیری ماشینی در مقیاس بزرگ کار می کند که به تأخیر حساس هستند، مثلاً هدف گذاری تبلیغات، بازیابی چند وجهی، درک پرس و جوی جستجو و غیره. قبل از کار در آمازون موزیک، سیدارت در شرکت هایی مانند Meta، Walmart Labs، Rakuten کار می کرد. در مورد مسائل تجارت الکترونیک محور ML. سیدهارت بخشی از اوایل دوران حرفهای خود را با استارتآپهای فناوری تبلیغاتی منطقه خلیج گذراند.

تارون شارما یک مدیر توسعه نرم افزار است که در زمینه جستجوی موسیقی آمازون پیشرو است. تیم او متشکل از دانشمندان و مهندسان ML مسئول ارائه نتایج جستجوی مرتبط و شخصی شده به مشتریان آمازون موزیک است.

تارون شارما یک مدیر توسعه نرم افزار است که در زمینه جستجوی موسیقی آمازون پیشرو است. تیم او متشکل از دانشمندان و مهندسان ML مسئول ارائه نتایج جستجوی مرتبط و شخصی شده به مشتریان آمازون موزیک است.

جیمز پارک یک معمار راه حل در خدمات وب آمازون است. او با Amazon.com برای طراحی، ساخت و استقرار راه حل های فناوری در AWS کار می کند و علاقه خاصی به هوش مصنوعی و یادگیری ماشین دارد. در اوقات فراغت او از جستجوی فرهنگ های جدید، تجربیات جدید و به روز ماندن با آخرین روندهای فناوری لذت می برد. می توانید او را در اینجا پیدا کنید. لینک.

جیمز پارک یک معمار راه حل در خدمات وب آمازون است. او با Amazon.com برای طراحی، ساخت و استقرار راه حل های فناوری در AWS کار می کند و علاقه خاصی به هوش مصنوعی و یادگیری ماشین دارد. در اوقات فراغت او از جستجوی فرهنگ های جدید، تجربیات جدید و به روز ماندن با آخرین روندهای فناوری لذت می برد. می توانید او را در اینجا پیدا کنید. لینک.

کشیتیز گوپتا یک معمار راه حل در NVIDIA است. او از آموزش دادن به مشتریان ابری درباره فناوریهای هوش مصنوعی GPU که NVIDIA ارائه میکند و کمک به آنها در تسریع یادگیری ماشینی و برنامههای یادگیری عمیق لذت میبرد. خارج از محل کار، او از دویدن، پیاده روی و تماشای حیات وحش لذت می برد.

کشیتیز گوپتا یک معمار راه حل در NVIDIA است. او از آموزش دادن به مشتریان ابری درباره فناوریهای هوش مصنوعی GPU که NVIDIA ارائه میکند و کمک به آنها در تسریع یادگیری ماشینی و برنامههای یادگیری عمیق لذت میبرد. خارج از محل کار، او از دویدن، پیاده روی و تماشای حیات وحش لذت می برد.

جیاهونگ لیو یک معمار راه حل در تیم ارائه دهنده خدمات ابری در NVIDIA است. او به مشتریان در اتخاذ راهحلهای یادگیری ماشین و هوش مصنوعی کمک میکند که از محاسبات تسریعشده NVIDIA برای رسیدگی به چالشهای آموزشی و استنتاج آنها استفاده میکند. او در اوقات فراغت خود از اوریگامی، پروژه های DIY و بازی بسکتبال لذت می برد.

جیاهونگ لیو یک معمار راه حل در تیم ارائه دهنده خدمات ابری در NVIDIA است. او به مشتریان در اتخاذ راهحلهای یادگیری ماشین و هوش مصنوعی کمک میکند که از محاسبات تسریعشده NVIDIA برای رسیدگی به چالشهای آموزشی و استنتاج آنها استفاده میکند. او در اوقات فراغت خود از اوریگامی، پروژه های DIY و بازی بسکتبال لذت می برد.

طغرل کنوک یک معمار ارشد راه حل در NVIDIA است که در آموزش در مقیاس بزرگ، یادگیری عمیق چندوجهی و محاسبات علمی با کارایی بالا تخصص دارد. قبل از NVIDIA، او در صنعت انرژی کار می کرد و بر توسعه الگوریتم هایی برای تصویربرداری محاسباتی تمرکز داشت. به عنوان بخشی از دکترای خود، او بر روی یادگیری عمیق مبتنی بر فیزیک برای شبیه سازی عددی در مقیاس کار کرد. در اوقات فراغت از مطالعه، نواختن گیتار و پیانو لذت می برد.

طغرل کنوک یک معمار ارشد راه حل در NVIDIA است که در آموزش در مقیاس بزرگ، یادگیری عمیق چندوجهی و محاسبات علمی با کارایی بالا تخصص دارد. قبل از NVIDIA، او در صنعت انرژی کار می کرد و بر توسعه الگوریتم هایی برای تصویربرداری محاسباتی تمرکز داشت. به عنوان بخشی از دکترای خود، او بر روی یادگیری عمیق مبتنی بر فیزیک برای شبیه سازی عددی در مقیاس کار کرد. در اوقات فراغت از مطالعه، نواختن گیتار و پیانو لذت می برد.

روهیل بهارگاوا یک مدیر بازاریابی محصول در NVIDIA است که بر روی استقرار چارچوب های کاربردی NVIDIA و SDK ها بر روی پلتفرم های خاص CSP تمرکز دارد.

روهیل بهارگاوا یک مدیر بازاریابی محصول در NVIDIA است که بر روی استقرار چارچوب های کاربردی NVIDIA و SDK ها بر روی پلتفرم های خاص CSP تمرکز دارد.

الیوت تریانا ایزازا مدیر روابط توسعهدهنده در NVIDIA است که به MLOps، DevOps، دانشمندان و کارشناسان فنی AWS آمازون برای تسلط بر پشته محاسباتی NVIDIA برای تسریع و بهینهسازی مدلهای Generative AI Foundation که شامل پردازش داده، آموزش GPU، استنتاج مدل و استقرار تولید در GPU AWS در استانستان میشود، قدرت میدهد. . علاوه بر این، الیوت یک دوچرخه سوار کوهستانی، اسکی باز، تنیس و پوکر پرشور است.

الیوت تریانا ایزازا مدیر روابط توسعهدهنده در NVIDIA است که به MLOps، DevOps، دانشمندان و کارشناسان فنی AWS آمازون برای تسلط بر پشته محاسباتی NVIDIA برای تسریع و بهینهسازی مدلهای Generative AI Foundation که شامل پردازش داده، آموزش GPU، استنتاج مدل و استقرار تولید در GPU AWS در استانستان میشود، قدرت میدهد. . علاوه بر این، الیوت یک دوچرخه سوار کوهستانی، اسکی باز، تنیس و پوکر پرشور است.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/how-amazon-music-uses-sagemaker-with-nvidia-to-optimize-ml-training-and-inference-performance-and-cost/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 100

- 12

- 25

- 32

- ٪۱۰۰

- 7

- 8

- a

- قادر

- درباره ما

- تسریع شد

- تسریع

- شتاب

- دسترسی

- انجام دادن

- دقت

- دقیق

- رسیدن

- دست

- در میان

- فعال

- اضافه

- نشانی

- تصویب

- آگهی

- موثر بر

- پس از

- AI

- مدل های هوش مصنوعی

- موارد استفاده ai

- البوم

- الگوریتم

- معرفی

- اجازه دادن

- مجاز

- اجازه دادن

- اجازه می دهد تا

- همچنین

- همیشه

- آمازون

- آمازون خدمات وب

- Amazon.com

- an

- و

- کاربرد

- برنامه های کاربردی

- روش

- معماران

- هستند

- محدوده

- مناطق

- دور و بر

- هنرمند

- AS

- کمک کردن

- کمک می کند

- At

- میانگین

- AWS

- بخش مدیریت

- برج میزان

- موازنه

- بار

- مستقر

- خط مقدم

- بسکتبال

- سرخ مایل به قرمز

- BE

- شد

- زیرا

- مزایای

- بهترین

- بهتر

- تقویت

- تقویت می کند

- هر دو

- به ارمغان بیاورد

- پهن

- ساختن

- ساخته

- by

- CAN

- قابلیت های

- قابلیت

- گرفتن

- اهميت دادن

- کاریابی

- Осторожно

- موارد

- چالش ها

- به چالش کشیدن

- چارت سازمانی

- بررسی

- گرامی

- انتخاب

- مشتریان

- ابر

- رمز

- COM

- بیا

- ارتباط

- شرکت

- مقایسه

- محاسباتی

- محاسبه

- رقیب

- پیکر بندی

- ظرف

- محتوا

- همگرایی

- هسته

- هزینه

- هزینه

- سادگی

- بحرانی

- بسیار سخت

- CSP

- سوزش

- سفارشی

- مشتری

- تجربه مشتری

- مشتریان

- داده ها

- تاریخ

- روز

- کاهش یافته

- عمیق

- یادگیری عمیق

- تاخیر

- ارائه

- تحویل

- ارائه

- تقاضا

- گسترش

- استقرار

- گسترش

- طرح

- توسعه دهنده

- در حال توسعه

- پروژه

- مختلف

- مشکل

- مستقیما

- شیرجه رفتن

- مختلف

- DIY

- آیا

- به شدت

- در طی

- پویا

- e

- تجارت الکترونیک

- در اوایل

- آموزش

- بهره وری

- موثر

- تلاش

- مرتفع

- تعبیه کردن

- احساسات

- استخدام

- توانمندسازی

- فعال

- تشویق

- پشت سر هم

- انرژی

- مورد تأیید

- افزایش می یابد

- کافی

- حصول اطمینان از

- به خصوص

- و غیره

- ارزیابی

- حتی

- هر

- اعدام

- تجربه

- تجارب

- کارشناسان

- FAST

- امکانات

- شکل

- سرانجام

- پیدا کردن

- پیدا کردن

- نام خانوادگی

- انعطاف پذیری

- سیل

- تمرکز

- متمرکز شده است

- تمرکز

- پیروی

- برای

- قالب

- پایه

- چارچوب

- چارچوب

- از جانب

- خسته کننده، اذیت کننده

- کاملا

- ویژگی های

- بیشتر

- ادغام

- دروازه

- نسل

- مولد

- هوش مصنوعی مولد

- GPU

- GPU ها

- دستگیره

- رخ دادن

- سخت افزار

- آیا

- he

- سنگین

- بلند کردن سنگین

- کمک

- مفید

- کمک می کند

- زیاد

- در سطح بالا

- عملکرد بالا

- او را

- خود را

- دارای

- میزبانی وب

- ساعت ها

- چگونه

- اما

- HTML

- HTTPS

- شناسایی

- if

- نشان می دهد

- تصویربرداری

- انجام

- مهم

- بهبود

- بهبود یافته

- بهبود

- in

- شامل

- افزایش

- افزایش

- افزایش

- صنعت

- ناکارآمد

- نفوذ

- شالوده

- اول

- نمونه

- فورا

- در عوض

- علاقه

- به

- معرفی

- معرفی

- IT

- ITS

- سفر

- JPG

- تنها

- کلید

- نوع

- دانستن

- شناخته شده

- آزمایشگاه

- زبان

- بزرگ

- در مقیاس بزرگ

- بزرگتر

- ماندنی

- تاخیر

- آخرین

- لایه

- رهبری

- برجسته

- یاد گرفتن

- یادگیری

- قدرت نفوذ

- کتابخانه

- بلند کردن اجسام

- پسندیدن

- محدودیت

- لینک

- بار

- به دنبال

- کم

- کاهش

- دستگاه

- فراگیری ماشین

- حفظ

- عمده

- ساخت

- باعث می شود

- مدیر

- مدیریت

- بازار یابی (Marketing)

- استاد

- بیشینه ساختن

- ممکن است..

- خاطرات

- حافظه

- متا

- متوسط

- میلیون

- میلیون ها نفر

- میلی ثانیه

- حداقل

- اشتباه

- مخلوط

- ML

- MLO ها

- مدل

- مدل سازی

- مدل

- ماژول ها

- پول

- بیش

- اکثر

- کوه

- چند

- چندگانه

- موسیقی

- باید

- نام

- ضروری

- منفی است

- شبکه

- جدید

- nlp

- کارت گرافیک Nvidia

- of

- ارائه

- پیشنهادات

- on

- ONE

- فقط

- باز کن

- منبع باز

- عملیاتی

- قابل استفاده

- عملیات

- بهینه

- بهینه سازی

- بهینه سازی

- بهینه

- بهینه سازی

- or

- هماهنگ شده

- سفارش

- دیگر

- خارج

- خارج از

- برجسته

- روی

- به طور کلی

- خود

- پارامترهای

- بخش

- ویژه

- ویژه

- مشارکت کرد

- احساساتی

- اوج

- درصد

- کارایی

- شخصی

- شخصی

- دکترا

- خط لوله

- سکو

- سیستم عامل

- افلاطون

- هوش داده افلاطون

- PlatoData

- بازیکن

- بازی

- پادکست

- پــادکـست

- نقطه

- پوکر

- ممکن

- پست

- پتانسیل

- قدرت

- صفحه اصلی

- دقت

- قبلا

- اولویت بندی

- اولویت

- مشکلات

- روند

- محصول

- تولید

- پروژه ها

- ارائه

- ارائه دهنده

- فراهم می کند

- ارائه

- پــایتــون

- سریع

- رتبه بندی

- مطالعه

- زمان واقعی

- کاهش

- مراجعه

- مربوط

- روابط

- ربط

- مربوط

- قابل اعتماد

- درخواست

- نیاز

- منابع

- پاسخ

- مسئوليت

- مسئوليت

- پاسخگو

- نتیجه

- نتایج

- غنی

- راست

- در حال اجرا

- اجرا می شود

- زمان اجرا

- حکیم ساز

- همان

- ذخیره

- صرفه جویی کردن

- مقیاس پذیر

- مقیاس

- علم

- علمی

- دانشمندان

- sdk

- sdks

- یکپارچه

- جستجو

- جستجو

- جستجو

- دوم

- بخش

- دیدن

- به دنبال

- ظاهرا

- معنایی

- ارشد

- حساس

- جمله

- خدمت

- سرور

- سرویس

- ارائه دهنده خدمات

- خدمات

- خدمت

- تنظیم

- تنظیمات

- چند

- اشتراک گذاری

- به اشتراک گذاشته شده

- نشان می دهد

- قابل توجه

- به طور قابل توجهی

- ساده

- نشسته است

- اندازه

- اندازه

- هوشمند

- نرم افزار

- توسعه نرم افزار

- راه حل

- مزایا

- ترانه

- منبع

- تنش

- تخصص دارد

- متخصص

- خاص

- سرعت

- هجی کردن

- هجی

- صرف

- پشته

- راه افتادن

- نوپا

- اقامت

- ثابت

- گام

- مراحل

- داستان

- جریان

- چنین

- برتر

- پشتیبانی

- پشتیبانی

- مطمئن

- صورت گرفته

- مصرف

- هدف گذاری

- تیم

- فن آوری

- فنی

- تکنیک

- تکنیک

- فن آوری

- پیشرفته

- متن

- که

- La

- شان

- آنها

- آنجا.

- از این رو

- اینها

- آنها

- اشیاء

- این

- از طریق

- توان

- زمان

- بار

- عنوان

- به

- با هم

- از Tokenization

- نشانه

- در زمان

- ابزار

- بالا

- thps

- ترافیک

- قطار

- آموزش دیده

- آموزش

- ترانسفورماتور

- روند

- تریتون

- درست

- دو

- درک

- بی شک

- جهان

- باز کردن قفل

- پرده برداری کرد

- us

- استفاده کنید

- استفاده

- کاربران

- استفاده

- با استفاده از

- با استفاده از

- ارزش

- وسیع

- تطبیق پذیری

- بسیار

- منتظر

- راه رفتن

- WALMART

- بود

- تماشای

- راه

- we

- وب

- خدمات وب

- خوب

- بود

- چه زمانی

- در حالیکه

- در حین

- اراده

- با

- مهاجرت کاری

- مشغول به کار

- کارگر

- با این نسخهها کار

- جهان

- نگرانی

- هنوز

- به همراه داشت

- شما

- شما

- زفیرنت