اگرچه مدلهای زبانی در مقیاس بزرگ ممکن است قانعکننده باشند، اما این واقعیت باقی میماند که تنها بزرگترین شرکتها منابع لازم برای استقرار و آموزش آنها را در مقیاس معنادار دارند.

برای شرکتهایی که مشتاق استفاده از هوش مصنوعی به یک مزیت رقابتی هستند، یک جایگزین ارزانتر و کاهشیافته ممکن است مناسبتر باشد، به خصوص اگر بتوان آن را در صنایع یا حوزههای خاصی تنظیم کرد.

اینجاست که مجموعهای از استارتآپهای نوظهور هوش مصنوعی که امیدوارند جایگاه خود را ایجاد کنند: با ساختن مدلهای کمیاب و متناسب که شاید به اندازه قدرتمندی نباشند. GPT-3، برای موارد استفاده سازمانی به اندازه کافی خوب هستند و روی سخت افزاری اجرا می شوند که حافظه پهنای باند گران قیمت (HBM) را برای DDR کالا حذف می کند.

استارتاپ آلمانی هوش مصنوعی Aleph Alpha یکی از این نمونه هاست. در سال 2019، شرکت هایدلبرگ، مستقر در آلمان، تاسیس شد درخشان مدل زبان طبیعی دارای بسیاری از ویژگیهای جذاب عنوان GPT-3 OpenAI است: کپینویسی، طبقهبندی، خلاصهنویسی و ترجمه، برای نام بردن از چند مورد.

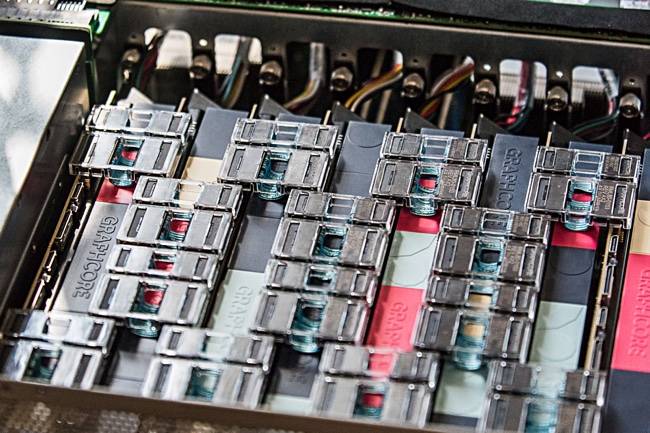

این استارتآپ مدل با Graphcore همکاری کرده است تا مدلهای زبان پراکنده در بریتانیا را بررسی و توسعه دهد سخت افزار تراشه ساز.

جوناس آندرولیوس، مدیر عامل Aleph Alpha گفت: «IPUهای Graphcore فرصتی برای ارزیابی رویکردهای تکنولوژیکی پیشرفته مانند پراکندگی مشروط هستند. بیانیه. این معماری ها بدون شک نقشی در تحقیقات آینده الف آلفا خواهند داشت.

شرط بزرگ Graphcore بر روی پراکندگی

مدلهای مشروط پراکنده - که گاهی اوقات مخلوطی از متخصصان یا مدلهای مسیریابی نامیده میشوند - فقط دادهها را بر اساس پارامترهای قابلاجرا پردازش میکنند، چیزی که میتواند منابع محاسباتی مورد نیاز برای اجرای آنها را به میزان قابل توجهی کاهش دهد.

به عنوان مثال، اگر یک مدل زبان به تمام زبانهای موجود در اینترنت آموزش داده شده باشد، و سپس یک سوال به زبان روسی پرسیده شود، منطقی نیست که آن دادهها را در کل مدل اجرا کنیم، فقط پارامترهای مربوط به زبان روسی، Simon Knowles مدیر ارشد فناوری Graphcore در مصاحبه ای با ثبت نام.

«کاملاً واضح است. مغز شما اینگونه کار می کند و همچنین یک هوش مصنوعی نیز باید کار کند.» این را بارها گفتهام، اما اگر یک هوش مصنوعی میتواند بسیاری از کارها را انجام دهد، برای انجام یک کار نیازی به دسترسی به تمام دانش خود ندارد.

ناولز که شرکت شتابدهندههای متناسب با این نوع مدلها را میسازد، بدون تعجب معتقد است که آنها آینده هوش مصنوعی هستند. او افزود: "من تعجب می کنم اگر تا سال آینده، کسی مدل هایی با زبان متراکم بسازد."

HBM-2 گران است؟ به جای آن در DDR ذخیره کنید

مدل های زبان پراکنده بدون چالش نیستند. به گفته نولز، یکی از مهمترین موارد مربوط به حافظه است. HBM مورد استفاده در پردازندههای گرافیکی پیشرفته برای دستیابی به پهنای باند و ظرفیتهای لازم مورد نیاز این مدلها، گران است و به شتابدهندههای گرانتری متصل است.

او توضیح داد که این موضوع برای مدلهای با زبان متراکم که ممکن است به همه آن محاسبات و حافظه نیاز داشته باشید، نیست، اما برای مدلهای پراکنده که حافظه را بر محاسبات ترجیح میدهند، مشکل ایجاد میکند.

فناوری Interconnect، مانند NVLink انویدیا، میتواند برای تجمیع حافظه در چندین GPU مورد استفاده قرار گیرد، اما اگر مدل به همه این محاسبات نیاز نداشته باشد، GPUها میتوانند بیکار بمانند. نولز گفت: «این یک راه واقعاً گران برای خرید حافظه است.

شتابدهندههای Graphcore تلاش میکنند تا با قرض گرفتن تکنیکی به قدمت خود محاسبات: کش کردن، از این چالش دوری کنند. هر IPU دارای یک حافظه نهان SRAM نسبتاً بزرگ - 1 گیگابایت - برای برآورده کردن پهنای باند مورد نیاز این مدلها است، در حالی که ظرفیت خام با استفاده از استخرهای بزرگ حافظه ارزان قیمت DDR4 به دست میآید.

ناولز گفت: «هرچه SRAM بیشتری داشته باشید، به پهنای باند DRAM کمتری نیاز دارید، و این چیزی است که به ما امکان می دهد از HBM استفاده نکنیم.

با جدا کردن حافظه از شتابدهنده، پشتیبانی از مدلهای هوش مصنوعی بزرگتر برای شرکتها بسیار کمهزینه - هزینه چند ماژول DDR کالایی - است.

علاوه بر پشتیبانی از حافظه ارزانتر، ناولز ادعا میکند که IPUهای این شرکت نسبت به پردازندههای گرافیکی مزیت معماری نیز دارند، حداقل در مورد مدلهای کمیاب.

تراشههای Graphcore بهجای اجرا بر روی تعداد کمی از ضربکنندههای ماتریس بزرگ - مانند آنچه در واحد پردازش تانسور میبینید، تعداد زیادی واحد ریاضی ماتریس کوچکتر را ارائه میکنند که میتوانند به طور مستقل حافظه را آدرسدهی کنند.

او توضیح داد که این ویژگی دانه بندی بیشتری را برای مدل های پراکنده فراهم می کند، جایی که "شما به آزادی برای واکشی زیرمجموعه های مربوطه نیاز دارید، و هر چه واحدی که مجبور به واکشی آن هستید کوچکتر باشد، آزادی بیشتری دارید."

حکم هنوز صادر نشده است

در مجموع، Knowles استدلال میکند که این رویکرد IPUهایش را قادر میسازد تا مدلهای بزرگ AI/ML را با صدها میلیارد یا حتی تریلیونها پارامتر، با هزینهای بسیار کمتر در مقایسه با GPUها آموزش دهند.

با این حال، بازار هوش مصنوعی سازمانی هنوز در مراحل ابتدایی خود است و Graphcore با رقابت سختی در این فضا با رقبای بزرگتر و معتبرتر مواجه است.

بنابراین، در حالی که توسعه مدلهای زبانی بسیار پراکنده و با نرخ کاهش برای هوش مصنوعی بعید است به این زودی کاهش یابد، باید دید که آیا IPUهای Graphcore یا شتابدهنده شخص دیگری در نهایت حجم کاری هوش مصنوعی سازمانی را تامین میکند. ®

- AI

- آی هنر

- مولد هنر ai

- ربات ai

- هوش مصنوعی

- گواهی هوش مصنوعی

- هوش مصنوعی در بانکداری

- ربات هوش مصنوعی

- ربات های هوش مصنوعی

- نرم افزار هوش مصنوعی

- بلاکچین

- کنفرانس بلاک چین ai

- coingenius

- هوش مصنوعی محاوره ای

- کنفرانس کریپتو ai

- دل-ه

- یادگیری عمیق

- گوگل ai

- فراگیری ماشین

- افلاطون

- افلاطون آی

- هوش داده افلاطون

- بازی افلاطون

- PlatoData

- بازی پلاتو

- مقیاس Ai

- نحو

- ثبت نام

- زفیرنت