مانتیوم یک ارائه دهنده پلتفرم ابری جهانی برای ساخت برنامه های کاربردی هوش مصنوعی و مدیریت آنها در مقیاس است. پلتفرم توسعه انتها به انتها Mantium به شرکت ها و مشاغل در هر اندازه امکان می دهد تا برنامه های کاربردی هوش مصنوعی و اتوماسیون را سریعتر و آسان تر از آنچه به طور سنتی امکان پذیر بوده است بسازند. با Mantium، تیمهای فنی و غیرفنی میتوانند برنامههای کاربردی هوش مصنوعی را نمونهسازی، توسعه، آزمایش و استقرار کنند، همگی با رویکردی کمکد. Mantium از طریق ثبت خودکار، نظارت و ویژگیهای ایمنی، نرمافزار و مهندسان DevOps را از صرف وقت خود برای اختراع مجدد چرخ رها میکند. در سطح بالایی، Mantium ارائه می دهد:

- هوش مصنوعی پیشرفته - با انتخاب گسترده ای از مدل های زبان بزرگ منبع باز و خصوصی با یک UI یا API ساده آزمایش و توسعه دهید.

- اتوماسیون فرآیند هوش مصنوعی – به راحتی برنامه های مبتنی بر هوش مصنوعی را با کتابخانه روبه رشدی از ادغام ها و سازنده هوش مصنوعی گرافیکی Mantium بسازید.

- استقرار سریع - با استقرار یک کلیک، جدول زمانی تولید را از ماه ها به هفته ها یا حتی روزها کوتاه کنید. این ویژگی اپلیکیشن های هوش مصنوعی را با یک کلیک به برنامه های وب قابل اشتراک گذاری تبدیل می کند.

- ایمنی و مقررات - اطمینان از ایمنی و انطباق با سیاست های حاکمیتی و پشتیبانی از فرآیندهای انسان در حلقه.

با Mantium AI Builder، میتوانید گردشهای کاری پیچیدهای ایجاد کنید که APIهای خارجی، عملیات منطقی و مدلهای هوش مصنوعی را یکپارچه میکند. تصویر زیر نمونهای از برنامه Mantium AI را نشان میدهد که ورودی Twilio، خطمشی حاکمیت، بلوک AI (که میتواند به یک مدل منبع باز مانند GPT-J متکی باشد) و خروجی Twilio را به هم متصل میکند.

برای پشتیبانی از این برنامه، Mantium نه تنها به APIهای مدل از ارائه دهندگان هوش مصنوعی مانند Open AI، Co:here، و AI21 دسترسی جامع و یکنواخت، بلکه به مدلهای منبع باز پیشرفته نیز ارائه میکند. در Mantium، ما معتقدیم که هر کسی باید بتواند برنامههای کاربردی هوش مصنوعی مدرنی را که مالک آن است، سرتاسر بسازد، و ما از این امر با ارائه دسترسی بدون کد و کمکد به مدلهای منبع باز بهینهسازی شده برای عملکرد پشتیبانی میکنیم.

به عنوان مثال، یکی از مدل های منبع باز اصلی Mantium است GPT-J، یک مدل پیشرفته پردازش زبان طبیعی (NLP) که توسط الوتر هوش مصنوعی. با 6 میلیارد پارامتر، GPT-J یکی از بزرگترین و بهترین مدل های تولید متن متن باز است. کاربران Mantium می توانند GPT-J را از طریق AI Builder Mantium در برنامه های هوش مصنوعی خود ادغام کنند. در مورد GPT-J، این شامل مشخص کردن a است سریع (نمایشی به زبان طبیعی از کاری که مدل باید انجام دهد) و پیکربندی برخی پارامترهای اختیاری.

برای مثال، اسکرین شات زیر نمایش مختصری از یک درخواست تحلیل احساسات را نشان میدهد که توضیحات و پیشبینی احساسات را تولید میکند. در این مثال، نویسنده نوشت که "غذا فوق العاده بود" و "خدمات آنها فوق العاده بود." بنابراین، این متن بیانگر احساسات مثبت است.

با این حال، یک چالش با مدل های منبع باز این است که به ندرت برای عملکرد در سطح تولید طراحی شده اند. در مورد مدلهای بزرگ مانند GPT-J، این امر میتواند بسته به مورد استفاده، استقرار تولید را غیرعملی و حتی غیرممکن کند.

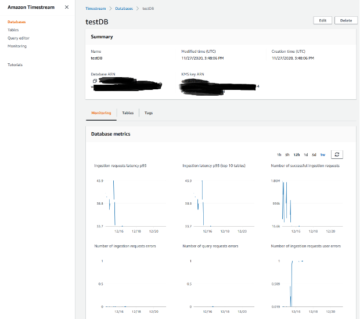

برای اطمینان از دسترسی کاربران به بهترین عملکرد در کلاس، ما همیشه به دنبال راههایی برای کاهش تأخیر مدلهای اصلی خود هستیم. در این پست، نتایج یک آزمایش بهینهسازی استنتاج را شرح میدهیم که در آن از موتور استنتاج DeepSpeed برای افزایش سرعت استنتاج GPT-J تقریباً 116٪ استفاده میکنیم. ما همچنین توضیح میدهیم که چگونه پیادهسازی Hugging Face Transformers GPT-J با DeepSpeed را در ما به کار گرفتهایم. آمازون SageMaker نقاط پایانی استنتاج

مروری بر مدل GPT-J

GPT-J یک مدل زبان پیشآموزشی (GPT) است و از نظر معماری، با مدلهای زبانی محبوب، خصوصی و بزرگ مانند GPT-3 Open AI قابل مقایسه است. همانطور که قبلاً ذکر شد، تقریباً از 6 میلیارد پارامتر و 28 لایه تشکیل شده است که از یک بلوک پیشخور و یک بلوک خود توجهی تشکیل شده است. هنگامی که برای اولین بار منتشر شد، GPT-J یکی از اولین مدل های زبان بزرگی بود که از آن استفاده کرد تعبیه های چرخشییک استراتژی رمزگذاری موقعیت جدید که رمزگذارهای موقعیت مطلق و نسبی را یکی می کند. همچنین از یک استراتژی موازی سازی نوآورانه استفاده می کند که در آن لایه های متراکم و پیشرو در یک لایه ترکیب می شوند که سربار ارتباط را به حداقل می رساند.

اگرچه GPT-J ممکن است از نظر استانداردهای امروزی به اندازه کافی بزرگ نباشد - مدل های بزرگ معمولاً از بیش از 100 میلیارد پارامتر تشکیل می شوند - هنوز عملکرد قابل توجهی دارد و با مهندسی سریع یا حداقل تنظیم دقیق، می توانید از آن برای حل بسیاری از مشکلات استفاده کنید. علاوه بر این، اندازه نسبتاً متوسط آن به این معنی است که می توانید آن را با سرعت بیشتری و با هزینه بسیار کمتر نسبت به مدل های بزرگتر اجرا کنید.

با این حال، GPT-J هنوز هم بسیار بزرگ است. به عنوان مثال، آموزش GPT-J در FP32 با بهروزرسانیهای وزن کامل و بهینهساز Adam به بیش از 200 گیگابایت حافظه نیاز دارد: 24 گیگابایت برای پارامترهای مدل، 24 گیگابایت برای گرادیان، 24 گیگابایت برای گرادیانهای مربع آدام، 24 گیگابایت برای حالتهای بهینهساز، و حافظه اضافی مورد نیاز برای بارگیری دسته های آموزشی و ذخیره سازی فعال سازی ها. البته، آموزش در FP16 این نیاز به حافظه را تقریباً به نصف کاهش میدهد، اما ردپای حافظه بیش از 100 گیگابایت همچنان نیازمند استراتژیهای آموزشی نوآورانه است. به عنوان مثال، با همکاری SageMaker، تیم NLP Mantium یک گردش کار برای آموزش (تنظیم دقیق) GPT-J با استفاده از کتابخانه موازی مدل توزیع شده SageMaker.

در مقابل، ارائه GPT-J برای استنتاج نیاز به حافظه بسیار کمتری دارد - در FP16، وزن مدل کمتر از 13 گیگابایت را اشغال میکند، به این معنی که استنتاج به راحتی میتواند روی یک پردازنده گرافیکی 16 گیگابایتی انجام شود. با این حال، استنباط با پیاده سازی های خارج از جعبه GPT-J، مانند ترانسفورماتور Hugging Face پیاده سازی که ما استفاده می کنیم، نسبتا کند است. برای پشتیبانی از موارد استفاده که به تولید متن بسیار پاسخگو نیاز دارند، ما بر کاهش تأخیر استنتاج GPT-J تمرکز کردهایم.

چالشهای تاخیر پاسخ GPT-J

تأخیر پاسخ یک مانع اصلی برای ترانسفورماتورهای از پیش آموزش دیده مولد (GPT) مانند GPT-J است که تولید متن مدرن را تامین می کند. مدلهای GPT متن را از طریق دنبالهای از مراحل استنتاج تولید میکنند. در هر مرحله استنتاج، به مدل متنی به عنوان ورودی داده می شود، و مشروط به این ورودی، یک کلمه را از واژگان خود نمونه برداری می کند تا به متن اضافه شود. برای مثال، با توجه به دنباله ژتونها «من به یک چتر نیاز دارم، چون این است»، یک نشانه بعدی با احتمال زیاد ممکن است «باران» باشد. با این حال، میتواند «آفتابی» یا «محصول» باشد، که میتواند اولین گام به سمت دنباله متنی مانند «من به یک چتر نیاز دارم، زیرا حتماً باران میبارد» باشد.

سناریوهایی مانند این چالشهای جالبی را برای استقرار مدلهای GPT ایجاد میکنند، زیرا موارد استفاده در دنیای واقعی ممکن است شامل دهها، صدها یا حتی هزاران مرحله استنتاج باشد. به عنوان مثال، تولید یک پاسخ 1,000 توکن به 1,000 مرحله استنتاج نیاز دارد! بر این اساس، اگرچه یک مدل ممکن است سرعت های استنتاجی را ارائه دهد که به طور جداگانه به اندازه کافی سریع به نظر می رسند، زمانی که متون طولانی تولید می شوند، تأخیر به راحتی می تواند به سطوح غیرقابل دفاع برسد. ما تأخیر متوسط 280 میلی ثانیه در هر مرحله استنتاج را روی یک GPU V100 مشاهده کردیم. این ممکن است برای یک مدل پارامتر 6.7 میلیارد سریع به نظر برسد، اما با چنین تأخیرهایی، تقریباً 30 ثانیه طول می کشد تا یک پاسخ 500 توکن ایجاد شود که از دیدگاه تجربه کاربر ایده آل نیست.

بهینه سازی سرعت استنتاج با DeepSpeed Inference

در اعماق یک کتابخانه بهینه سازی یادگیری عمیق منبع باز است که توسط مایکروسافت توسعه یافته است. اگرچه DeepSpeed اساساً بر روی بهینه سازی آموزش مدل های بزرگ تمرکز دارد، اما DeepSpeed همچنین یک چارچوب بهینه سازی استنتاج ارائه می کند که از مجموعه ای از مدل ها از جمله BERT، Megatron، GPT-Neo، GPT2 و GPT-J پشتیبانی می کند. DeepSpeed Inference استنتاج با کارایی بالا را با معماریهای بزرگ مبتنی بر ترانسفورماتور از طریق ترکیبی از موازیسازی مدل، هستههای CUDA بهینهشده با استنتاج و کوانتیزه کردن تسهیل میکند.

برای افزایش سرعت استنتاج با GPT-J، از موتور استنتاج DeepSpeed برای تزریق هسته های CUDA بهینه شده به اجرای Hugging Face Transformers GPT-J استفاده می کنیم.

برای ارزیابی مزایای سرعت موتور استنتاج DeepSpeed، ما یک سری تست تأخیر انجام دادیم که در آن GPT-J را تحت پیکربندیهای مختلف زمانبندی کردیم. به طور خاص، استفاده یا عدم استفاده از DeepSpeed، سخت افزار، طول دنباله خروجی و طول توالی ورودی را تغییر دادیم. ما بر روی خروجی و طول توالی ورودی تمرکز کردیم، زیرا هر دو بر سرعت استنتاج تأثیر میگذارند. برای تولید یک دنباله خروجی از 50 توکن، مدل باید 50 مرحله استنتاج را انجام دهد. علاوه بر این، زمان لازم برای انجام یک مرحله استنتاج به اندازه دنباله ورودی بستگی دارد - ورودی های بزرگتر به زمان پردازش بیشتری نیاز دارند. اگرچه تأثیر اندازه توالی خروجی بسیار بزرگتر از تأثیر اندازه توالی ورودی است، هنوز لازم است هر دو عامل را در نظر بگیریم.

در آزمایش خود از طرح زیر استفاده کردیم:

- موتور استنتاج DeepSpeed - روشن خاموش

- سخت افزار – T4 (ml.g4dn.2xlarge)، V100 (ml.p3.2xlarge)

- طول دنباله ورودی - 50 ، 200 ، 500 ، 1000

- طول دنباله خروجی - 50 ، 100 ، 150 ، 200

در مجموع، این طرح دارای 64 ترکیب از این چهار عامل است و برای هر ترکیب، 20 تست تاخیر انجام دادیم. هر آزمایش بر روی یک نقطه پایانی استنتاج SageMaker از قبل راهاندازیشده اجرا شد، و اطمینان حاصل کرد که آزمایشهای تأخیر ما زمانهای تولید، از جمله تبادل API و پیش پردازش را منعکس میکند.

آزمایشهای ما نشان میدهد که موتور استنتاج GPT-J DeepSpeed به طور قابلتوجهی سریعتر از پیادهسازی پایه Hugging Face Transformers PyTorch است. شکل زیر میانگین تأخیرهای تولید متن برای GPT-J با و بدون شتاب DeepSpeed در نقاط پایانی ml.g4dn.2xlarge و ml.p3.2xlarge SageMaker را نشان میدهد.

در نمونه ml.g4dn.2xlarge، که مجهز به پردازنده گرافیکی NVIDIA T16 با ظرفیت 4 گیگابایت است، میانگین کاهش تأخیر تقریباً 24 درصد را مشاهده کردیم [انحراف استاندارد (SD) = 0.05]. این با افزایش از میانگین 12.5 (SD = 0.91) توکن در ثانیه به میانگین 16.5 (SD = 2.13) توکن در ثانیه مطابقت دارد. قابل توجه است که اثر شتاب DeepSpeed در نمونه ml.p3.2xlarge که مجهز به پردازنده گرافیکی NVIDIA V100 است حتی قویتر بود. در آن سختافزار، کاهش تأخیر 53% (SD = 07) را مشاهده کردیم. از نظر توکن در ثانیه، این با افزایش از میانگین 21.9 (SD = 1.97) توکن در ثانیه به میانگین 47.5 (SD = 5.8) توکن در ثانیه مطابقت دارد.

ما همچنین مشاهده کردیم که شتاب ارائه شده توسط DeepSpeed در هر دو پیکربندی سخت افزاری با افزایش اندازه توالی های ورودی، اندکی کاهش یافت. با این حال، در تمام شرایط، استنباط با بهینهسازیهای GPT-J DeepSpeed همچنان به طور قابلتوجهی سریعتر از خط پایه بود. به عنوان مثال، در نمونه g4dn، حداکثر و حداقل کاهش تاخیر به ترتیب 31٪ (اندازه دنباله ورودی = 50) و 15٪ (اندازه دنباله ورودی = 1000) بود. و در نمونه p3، حداکثر و حداقل کاهش تأخیر به ترتیب 62 درصد (اندازه توالی ورودی = 50) و 40 درصد (اندازه توالی ورودی = 1000) بود.

استقرار GPT-J با DeepSpeed در نقطه پایانی استنتاج SageMaker

علاوه بر افزایش چشمگیر سرعت تولید متن برای GPT-J، موتور استنتاج DeepSpeed به سادگی در یک نقطه پایانی استنتاج SageMaker ادغام می شود. قبل از افزودن DeepSpeed به پشته استنتاج، نقاط پایانی ما بر روی یک تصویر Docker سفارشی بر اساس یک تصویر رسمی PyTorch اجرا میشدند. SageMaker استقرار نقاط پایانی استنتاج سفارشی را بسیار آسان می کند و ادغام DeepSpeed به سادگی شامل وابستگی و نوشتن چند خط کد بود. راهنمای منبع باز گردش کار استقرار برای استقرار GPT-J با DeepSpeed در دسترس است GitHub.

نتیجه

Mantium به نوآوری های پیشرو اختصاص داده شده است تا همه بتوانند به سرعت با هوش مصنوعی بسازند. از اتوماسیون فرآیند مبتنی بر هوش مصنوعی گرفته تا تنظیمات ایمنی و انطباق دقیق، پلتفرم کامل ما همه ابزارهای لازم را برای توسعه و مدیریت برنامههای کاربردی هوش مصنوعی قوی و مسئولانه در مقیاس فراهم میکند و مانع ورود را کاهش میدهد. SageMaker به شرکت هایی مانند Mantium کمک می کند تا به سرعت وارد بازار شوند.

برای اینکه بدانید Mantium چگونه میتواند به شما در ایجاد گردشهای کاری پیچیده مبتنی بر هوش مصنوعی برای سازمانتان کمک کند، به این سایت مراجعه کنید www.mantiumai.com.

درباره نویسندگان

جو هوور یک دانشمند کاربردی ارشد در تیم تحقیق و توسعه هوش مصنوعی Mantium است. او مشتاق توسعه مدلها، روشها و زیرساختهایی است که به مردم کمک میکند مشکلات دنیای واقعی را با سیستمهای پیشرفته NLP حل کنند. او در اوقات فراغت خود از کولهپشتی، باغبانی، آشپزی و معاشرت با خانواده لذت میبرد.

جو هوور یک دانشمند کاربردی ارشد در تیم تحقیق و توسعه هوش مصنوعی Mantium است. او مشتاق توسعه مدلها، روشها و زیرساختهایی است که به مردم کمک میکند مشکلات دنیای واقعی را با سیستمهای پیشرفته NLP حل کنند. او در اوقات فراغت خود از کولهپشتی، باغبانی، آشپزی و معاشرت با خانواده لذت میبرد.

داوال پاتل یک معمار اصلی یادگیری ماشین در AWS است. او با سازمانهایی از شرکتهای بزرگ گرفته تا استارتآپهای متوسط در زمینه مشکلات مربوط به محاسبات توزیعشده و هوش مصنوعی کار کرده است. او بر روی یادگیری عمیق از جمله دامنه های NLP و Computer Vision تمرکز دارد. او به مشتریان کمک می کند تا به استنباط مدل با عملکرد بالا در SageMaker دست یابند.

داوال پاتل یک معمار اصلی یادگیری ماشین در AWS است. او با سازمانهایی از شرکتهای بزرگ گرفته تا استارتآپهای متوسط در زمینه مشکلات مربوط به محاسبات توزیعشده و هوش مصنوعی کار کرده است. او بر روی یادگیری عمیق از جمله دامنه های NLP و Computer Vision تمرکز دارد. او به مشتریان کمک می کند تا به استنباط مدل با عملکرد بالا در SageMaker دست یابند.

سونیل پادمانابهان یک معمار راه حل های استارتاپی در AWS است. او بهعنوان یک بنیانگذار سابق استارتآپ و مدیر ارشد فناوری، علاقهمند به یادگیری ماشینی است و بر کمک به استارتآپها در استفاده از AI/ML برای نتایج کسبوکارشان و طراحی و استقرار راهحلهای ML/AI در مقیاس تمرکز میکند.

سونیل پادمانابهان یک معمار راه حل های استارتاپی در AWS است. او بهعنوان یک بنیانگذار سابق استارتآپ و مدیر ارشد فناوری، علاقهمند به یادگیری ماشینی است و بر کمک به استارتآپها در استفاده از AI/ML برای نتایج کسبوکارشان و طراحی و استقرار راهحلهای ML/AI در مقیاس تمرکز میکند.

- Coinsmart. بهترین صرافی بیت کوین و کریپتو اروپا.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی رایگان.

- CryptoHawk. رادار آلت کوین امتحان رایگان.

- منبع: https://aws.amazon.com/blogs/machine-learning/how-mantium-achieves-low-latency-gpt-j-inference-with-deepspeed-on-amazon-sagemaker/

- "

- 000

- 100

- 28

- 7

- 9

- a

- درباره ما

- مطلق

- دسترسی

- بر این اساس

- حساب

- رسیدن

- در میان

- اضافه

- اضافی

- اثر

- AI

- معرفی

- هر چند

- همیشه

- آمازون

- تحلیل

- هر کس

- API

- رابط های برنامه کاربردی

- نرم افزار

- برنامه های کاربردی

- اعمال می شود

- روش

- تقریبا

- برنامه های

- معماری

- مصنوعی

- هوش مصنوعی

- اتوماتیک

- اتوماسیون

- در دسترس

- میانگین

- AWS

- سد

- خط مقدم

- زیرا

- قبل از

- مزایای

- بیلیون

- مسدود کردن

- ساختن

- سازنده

- بنا

- کسب و کار

- کسب و کار

- موارد

- به چالش

- چالش ها

- ابر

- بستر ابری

- رمز

- همکاری

- ترکیب

- ترکیب

- ترکیب شده

- ارتباط

- شرکت

- کامل

- پیچیده

- انطباق

- جامع

- کامپیوتر

- محاسبه

- شرایط

- هسته

- میتوانست

- CTO

- سفارشی

- مشتریان

- لبه برش

- اختصاصی

- عمیق

- ارائه

- نشان دادن

- بستگی دارد

- بستگی دارد

- گسترش

- مستقر

- استقرار

- گسترش

- توصیف

- طرح

- طراحی

- توسعه

- توسعه

- در حال توسعه

- پروژه

- توزیع شده

- محاسبات توزیع شده

- کارگر بارانداز

- حوزه

- به طور چشمگیری

- به آسانی

- اثر

- کار می کند

- را قادر می سازد

- پشت سر هم

- نقطه پایانی

- موتور

- مهندسی

- مورد تأیید

- حصول اطمینان از

- شرکت

- مجهز بودن

- ارزیابی

- هر کس

- مثال

- مبادلات

- تجربه

- تجربه

- وسیع

- فوق العاده

- چهره

- عوامل

- خانواده

- FAST

- سریعتر

- ویژگی

- امکانات

- شکل

- نام خانوادگی

- متمرکز شده است

- تمرکز

- پیروی

- رد پا

- موسس

- چارچوب

- از جانب

- کامل

- بعلاوه

- تولید می کنند

- مولد

- نسل

- مولد

- جهانی

- حکومت

- GPU

- در حال رشد

- راهنمایی

- سخت افزار

- کمک

- کمک

- کمک می کند

- اینجا کلیک نمایید

- زیاد

- خیلی

- چگونه

- اما

- HTTPS

- صدها نفر

- دلخواه

- تصویر

- پیاده سازی

- از جمله

- افزایش

- افزایش

- ابداع

- ابتکاری

- ورودی

- نمونه

- ادغام

- یکپارچگی

- اطلاعات

- انزوا

- IT

- زبان

- بزرگ

- بزرگتر

- بزرگترین

- لایه

- برجسته

- یاد گرفتن

- یادگیری

- سطح

- سطح

- قدرت نفوذ

- کتابخانه

- خطوط

- بارگیری

- طولانی

- به دنبال

- دستگاه

- فراگیری ماشین

- ساخت

- باعث می شود

- مدیریت

- مدیریت

- بازار

- به معنی

- حافظه

- روش

- مایکروسافت

- قدرت

- حد اقل

- ML

- مدل

- مدل

- نظارت بر

- ماه

- بیش

- طبیعی

- لازم

- کارت گرافیک Nvidia

- مانع

- ارائه

- ارائه شده

- رسمی

- باز کن

- منبع باز

- عملیات

- بهینه سازی

- بهینه

- بهینه سازی

- کدام سازمان ها

- سازمان های

- خود

- احساساتی

- مردم

- کارایی

- چشم انداز

- سکو

- سیاست

- سیاست

- محبوب

- موقعیت

- مثبت

- ممکن

- قدرت

- پیش بینی

- زیبا

- اصلی

- خصوصی

- مشکلات

- روند

- خودکارسازی فرایند

- فرآیندهای

- در حال پردازش

- تولید

- ارائه دهنده

- ارائه دهندگان

- فراهم می کند

- ارائه

- واجد شرایط شدن

- به سرعت

- تحقیق و توسعه

- بالا بردن

- اعم

- رسیدن به

- کاهش

- بازتاب

- منتشر شد

- منتشر شده

- نمایندگی

- نیاز

- ضروری

- مورد نیاز

- نیاز

- پاسخ

- مسئوليت

- نتایج

- دویدن

- در حال اجرا

- ایمنی

- سعید

- مقیاس

- دانشمند

- ثانیه

- انتخاب

- احساس

- سلسله

- خدمت

- تنظیم

- ساده

- تنها

- اندازه

- So

- نرم افزار

- مزایا

- حل

- برخی از

- مصنوعی

- به طور خاص

- سرعت

- سرعت

- هزینه

- پشته

- استاندارد

- شروع

- شروع

- نوپا

- وضعیت هنر

- ایالات

- هنوز

- استراتژی ها

- استراتژی

- قوی

- پشتیبانی

- پشتیبانی از

- سیستم های

- تیم

- فنی

- قوانین و مقررات

- آزمون

- تست

- La

- از این رو

- هزاران نفر

- از طریق

- زمان

- بار

- امروز

- با هم

- رمز

- نشانه

- ابزار

- به طور سنتی

- آموزش

- به طور معمول

- ui

- زیر

- به روز رسانی

- استفاده کنید

- کاربران

- مختلف

- دید

- راه

- وب

- چی

- چرخ

- چه

- بدون

- مشغول به کار

- گردش کار

- نوشته

- شما