- Kesäkuu 30, 2014

- Vasilis Vryniotis

- . Ei kommentteja

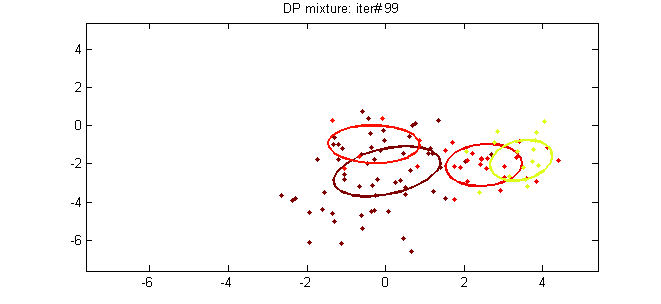

Tämä artikkeli on opetusohjelman viides osa Klusterointi DPMM:llä. Aiemmissa viesteissä käsittelimme yksityiskohtaisesti menetelmän teoreettista taustaa ja kuvailimme sen matemaattisia esityksiä ja tapoja rakentaa se. Tässä viestissä yritämme yhdistää teorian käytäntöön ottamalla käyttöön kaksi DPMM-mallia: Dirichlet Multivariate Normal Mixture -mallin, jota voidaan käyttää Gaussin datan klusterointiin, ja Dirichlet-Multinomial Mixture -mallin, jota käytetään asiakirjojen klusterointiin.

Päivitys: Datumbox Machine Learning Framework on nyt avoimen lähdekoodin ja ilmainen download. Tutustu pakettiin com.datumbox.framework.machinelearning.clustering nähdäksesi Dirichlet-prosessisekoitusmallien käyttöönotto Javassa.

1. Dirichlet Multivariate Normal Mixture -malli

Ensimmäinen tarkastelemamme Dirichlet-prosessin seosmalli on Dirichlet Multivariate Normal Mixture -malli, jota voidaan käyttää klusteroimaan jatkuville tietojoukoille. Seosmalli määritellään seuraavasti:

![]()

![]()

![]()

Yhtälö 1: Dirichlet-monimuuttuja normaalisekoitusmalli

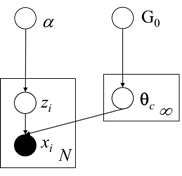

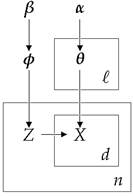

Kuten yllä näemme, kyseinen malli olettaa, että generatiivinen jakauma on moninominen Gaussin jakauma, ja käyttää kiinalaisen ravintolan prosessia kuten aiemmin klusteritehtävissä. Lisäksi perusjakelulle G0 se käyttää Normal-Inverse-Wishart ennen, joka on konjugoida ennen Multivariate Normaalijakauma tuntemattomalla keskiarvo- ja kovarianssimatriisilla. Alla esittelemme sekoitusmallin graafisen mallin:

Kuva 1: Dirichlet Multivariate Normal Mixture -mallin graafinen malli

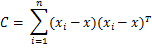

Kuten aiemmin keskustelimme, jotta voimme arvioida klusteritehtävät, käytämme Tiivistetty Gibbs-näytteenotto joka vaatii valitsemisen sopivat konjugaattipriorit. Lisäksi meidän on päivitettävä annetut parametrit jälkikäteen ennakko ja todisteet. Alla näemme MAP-arviot yhden klusterin parametreista:

![]()

![]()

![]()

![]()

![]()

Yhtälö 2: MAP-arviot klusteriparametreista

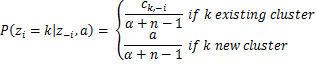

Missä d on tietojemme ulottuvuus ja ![]() on näytteen keskiarvo. Lisäksi meillä on useita Normal-Inverse-Wishartin hyperparametrejä, kuten μ0 joka on alkukeskiarvo κ0 on keskimääräinen murtoluku, joka toimii tasoitusparametrina, ν0 on vapausaste, joka on asetettu dimensioiden lukumäärään ja Ψ0 on pareittainen poikkeamatulo, joka asetetaan dxd-identiteettimatriisiin kerrottuna vakiolla. Tästä eteenpäin kaikki G:n aiemmat hyperparametrit0 merkitään λ:lla merkinnän yksinkertaistamiseksi. Lopuksi, kun on kaikki edellä mainitut, voimme arvioida Collapsed Gibbs Samplerin vaatimat todennäköisyydet. Havainnon i todennäköisyys kuulua klusteriin k ottaen huomioon klusterin määritykset, tietojoukon ja kaikki DP:n ja G:n hyperparametrit α ja λ0 on annettu alla:

on näytteen keskiarvo. Lisäksi meillä on useita Normal-Inverse-Wishartin hyperparametrejä, kuten μ0 joka on alkukeskiarvo κ0 on keskimääräinen murtoluku, joka toimii tasoitusparametrina, ν0 on vapausaste, joka on asetettu dimensioiden lukumäärään ja Ψ0 on pareittainen poikkeamatulo, joka asetetaan dxd-identiteettimatriisiin kerrottuna vakiolla. Tästä eteenpäin kaikki G:n aiemmat hyperparametrit0 merkitään λ:lla merkinnän yksinkertaistamiseksi. Lopuksi, kun on kaikki edellä mainitut, voimme arvioida Collapsed Gibbs Samplerin vaatimat todennäköisyydet. Havainnon i todennäköisyys kuulua klusteriin k ottaen huomioon klusterin määritykset, tietojoukon ja kaikki DP:n ja G:n hyperparametrit α ja λ0 on annettu alla:

![]()

![]()

Yhtälö 3: Gibbs Samplerin käyttämät todennäköisyydet MNMM:lle

Missä zi on havainnon x klusteriosoitusi, x1:n on täydellinen tietojoukko, z-i on joukko klusterimäärityksiä ilman yhtä ith havainto, x-i on täydellinen tietojoukko ith havainto, ck,-i on klusteriin k määritettyjen havaintojen kokonaismäärä ilman i:täth tarkkailu samalla ![]() ja

ja ![]() ovat klusterin k keskiarvo ja kovarianssimatriisi ilman i:täth havainto.

ovat klusterin k keskiarvo ja kovarianssimatriisi ilman i:täth havainto.

2. Dirichlet-Multinomial Mixture Model

Dirichlet-Multinomial Mixture -mallia käytetään asiakirjojen klusterianalyysiin. Tietyn mallin hierarkia on hieman monimutkaisempi, koska se mallintaa asiakirjojen aiheita/luokkia, sanatodennäköisyyksiä kunkin aiheen sisällä, klusterimäärityksiä ja dokumenttien generatiivista jakautumista. Sen tavoitteena on suorittaa ohjaamatonta oppimista ja klusteroida dokumenttiluettelo kohdistamalla ne ryhmiin. Seosmalli määritellään seuraavasti:

![]()

![]()

![]()

![]()

Yhtälö 4: Dirichlet-Multinominen sekoitusmalli

Missä φ mallintaa aiheen todennäköisyyksiä, zi on aiheen valitsin, θk ovat sanatodennäköisyydet kussakin klusterissa ja xi, j edustaa asiakirjan sanoja. Meidän on huomattava, että tämä tekniikka käyttää sanojen laukku joka edustaa dokumentteja järjestämättömänä sanakokoelmana, kielioppia ja sanajärjestystä huomioimatta. Tätä yksinkertaistettua esitystapaa käytetään yleisesti luonnollisen kielen käsittelyssä ja tiedonhaussa. Alla esittelemme sekoitusmallin graafisen mallin:

Kuva 2: Dirichlet-Multinomial Mixture -mallin graafinen malli

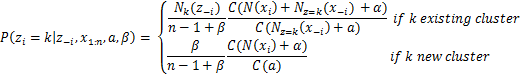

Tietty malli käyttää Multinomi Diskreetti jakauma generatiiviselle jakaumille ja Dirichlet-jakaumille priorille. ℓ on aktiivisten klusteriemme koko, n asiakirjojen kokonaismäärä, β ohjaa a priori odotettua klusterien määrää, kun taas α ohjaa kullekin klusterille määritettyjen sanojen määrää. Arvioidaksesi todennäköisyydet, jotka vaaditaan Kaatunut Gibbs-näytteenotin käytämme seuraava yhtälö:

![]()

Yhtälö 5: Gibbs Samplerin käyttämät todennäköisyydet DMMM:lle

Missä Γ on gammafunktio, zi on asiakirjan x klusterimääritysi, x1:n on täydellinen tietojoukko, z-i on joukko klusterimäärityksiä ilman yhtä ith asiakirja, x-i on täydellinen tietojoukko ith asiakirja, Nk(z-i) on klusteriin k määritettyjen havaintojen määrä ilman i:täth asiakirja, Nz=k(x-i) on vektori, jossa on lukujen summat jokaiselle sanalle kaikille klusteriin k kohdistetuille asiakirjoille, paitsi ith asiakirja ja N(xi) on harvalukuinen vektori asiakirjan x jokaisen sanan lukumäärälläi. Lopuksi, kuten yllä näemme, käyttämällä Collapsed Gibbs -sampleria kiinalaisen ravintolaprosessin kanssa θjk muuttuja, joka tallentaa sanan j todennäköisyyden aiheeseen k, voidaan integroida pois.

- AI

- ai taide

- ai taiteen generaattori

- ai robotti

- tekoäly

- tekoälyn sertifiointi

- tekoäly robotti

- tekoälyrobotit

- tekoälyohjelmisto

- blockchain

- blockchain-konferenssi ai

- coingenius

- keskustelullinen tekoäly

- kryptokonferenssi ai

- dall's

- Datumbox

- syvä oppiminen

- google ai

- koneoppiminen

- Koneoppiminen ja tilastot

- Platon

- plato ai

- Platonin tietotieto

- Platon peli

- PlatonData

- platopeliä

- mittakaava ai

- syntaksi

- zephyrnet