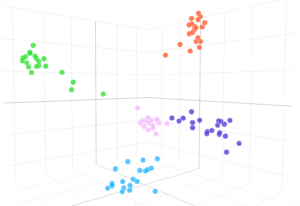

Osoitamme, että GPT-3-malli voi oppia ilmaisemaan epävarmuutta omista vastauksistaan luonnollisella kielellä – ilman mallilogiitteja. Kun kysymys annetaan, malli luo sekä vastauksen että luottamustason (esim. "90 % luottamus" tai "korkea luottamus"). Nämä tasot kuvaavat todennäköisyyksiä, jotka on kalibroitu hyvin. Malli pysyy myös maltillisesti kalibroituna jakauman muutoksen alla ja on herkkä omien vastaustensa epävarmuudelle sen sijaan, että se matkisi ihmisesimerkkejä. Tietojemme mukaan tämä on ensimmäinen kerta, kun mallin on osoitettu ilmaisevan kalibroitua epävarmuutta omista vastauksistaan luonnollisella kielellä. Kalibroinnin testaamista varten esittelemme CalibratedMath-tehtävien sarjan. Vertaamme sanoilla ilmaistun epävarmuuden kalibrointia ("verbaloitu todennäköisyys") mallilogisteista saatuun epävarmuuteen. Molemmat epävarmuudet pystyvät yleistämään kalibroinnin jakautumissiirtymän aikana. Tarjoamme myös todisteita siitä, että GPT-3:n kyky yleistää kalibrointi riippuu ennalta koulutetuista latenteista esityksistä, jotka korreloivat sen vastausten episteemisen epävarmuuden kanssa.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- Platoblockchain. Web3 Metaverse Intelligence. Tietoa laajennettu. Pääsy tästä.

- Lähde: https://openai.com/research/teaching-models-to-express-their-uncertainty-in-words

- :On

- a

- kyky

- Meistä

- ja

- vastaus

- vastauksia

- OVAT

- CAN

- kykenee

- verrata

- luottamus

- riippuu

- jakelu

- e

- näyttö

- Esimerkit

- ilmaista

- ilmaistuna

- Etunimi

- ensimmäistä kertaa

- varten

- alkaen

- synnyttää

- tietty

- Korkea

- HTTPS

- ihmisen

- in

- esitellä

- SEN

- tuntemus

- Kieli

- OPPIA

- Taso

- tasot

- kartta

- malli

- mallit

- Luonnollinen

- of

- on

- oma

- Platon

- Platonin tietotieto

- PlatonData

- toimittaa

- kysymys

- pikemminkin

- jäännökset

- s

- sensible

- siirtää

- näyttää

- esitetty

- sviitti

- tehtävät

- Opetus

- Testaus

- että

- -

- heidän

- Nämä

- aika

- että

- Epävarmuus

- varten

- käyttää

- HYVIN

- with

- sanoja

- zephyrnet