Intelligence artificielle générative (IA générative) les modèles ont démontré des capacités impressionnantes à générer du texte, des images et d’autres contenus de haute qualité. Cependant, ces modèles nécessitent d’énormes quantités de données d’entraînement propres et structurées pour atteindre leur plein potentiel. La plupart des données du monde réel existent dans des formats non structurés comme les PDF, qui nécessitent un prétraitement avant de pouvoir être utilisés efficacement.

Selon IDC, les données non structurées représentent aujourd'hui plus de 80 % de toutes les données d'entreprise. Cela inclut des formats tels que les e-mails, les PDF, les documents numérisés, les images, l'audio, la vidéo, etc. Bien que ces données contiennent des informations précieuses, leur nature non structurée rend difficile leur interprétation et l’apprentissage par les algorithmes d’IA. Selon un Sondage 2019 de Deloitte, seules 18 % des entreprises déclarent pouvoir tirer parti des données non structurées.

Alors que l’adoption de l’IA continue de s’accélérer, le développement de mécanismes efficaces pour digérer et apprendre à partir de données non structurées deviendra encore plus crucial à l’avenir. Cela pourrait impliquer de meilleurs outils de prétraitement, des techniques d’apprentissage semi-supervisé et des progrès dans le traitement du langage naturel. Les entreprises qui utilisent leurs données non structurées le plus efficacement bénéficieront d’avantages concurrentiels significatifs grâce à l’IA. Des données propres sont importantes pour de bonnes performances du modèle. Les textes extraits contiennent encore de grandes quantités de charabia et de texte passe-partout (par exemple, lire du HTML). Les données récupérées sur Internet contiennent souvent de nombreuses duplications. Les données des réseaux sociaux, les avis ou tout contenu généré par les utilisateurs peuvent également contenir des contenus toxiques et biaisés, et vous devrez peut-être les filtrer à l'aide de certaines étapes de prétraitement. Il peut également y avoir de nombreux contenus de mauvaise qualité ou des textes générés par des robots, qui peuvent être filtrés à l'aide des métadonnées associées (par exemple, filtrer les réponses du service client qui ont reçu de faibles notes de la part des clients).

La préparation des données est importante à plusieurs étapes de la génération augmentée de récupération (CHIFFON) des modèles. Les documents sources de connaissances nécessitent un prétraitement, comme le nettoyage du texte et la génération d'intégrations sémantiques, afin qu'ils puissent être indexés et récupérés efficacement. La requête en langage naturel de l'utilisateur nécessite également un prétraitement, afin qu'elle puisse être codée dans un vecteur et comparée aux intégrations de documents. Après avoir récupéré les contextes pertinents, ils peuvent nécessiter un prétraitement supplémentaire, comme la troncature, avant d'être concaténés à la requête de l'utilisateur afin de créer l'invite finale pour le modèle de base. Toile Amazon SageMaker prend désormais en charge des fonctionnalités complètes de préparation de données optimisées par Gestionnaire de données Amazon SageMaker. Grâce à cette intégration, SageMaker Canvas offre aux clients un espace de travail sans code de bout en bout pour préparer les données, créer et utiliser des modèles de ML et de fondations afin d'accélérer le passage des données aux informations commerciales. Vous pouvez désormais facilement découvrir et regrouper des données provenant de plus de 50 sources de données, et explorer et préparer des données à l'aide de plus de 300 analyses et transformations intégrées dans l'interface visuelle de SageMaker Canvas.

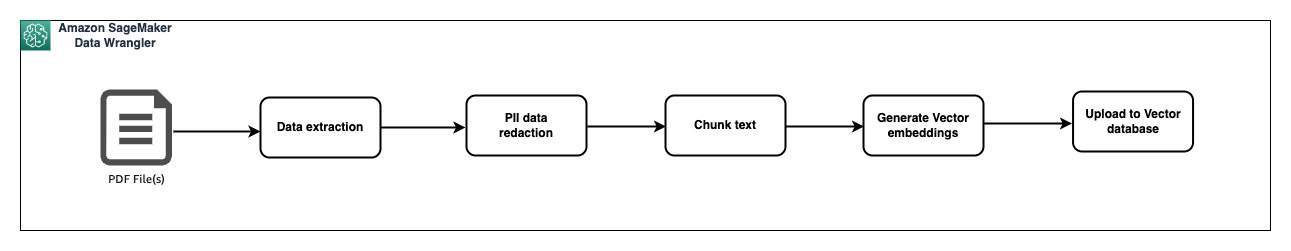

Vue d'ensemble de la solution

Dans cet article, nous travaillons avec un ensemble de données de documentation PDF :Socle amazonien mode d'emploi. De plus, nous montrons comment prétraiter un ensemble de données pour RAG. Plus précisément, nous nettoyons les données et créons des artefacts RAG pour répondre aux questions sur le contenu de l'ensemble de données. Considérez le problème d'apprentissage automatique (ML) suivant : l'utilisateur pose une question de modèle de langage étendu (LLM) : « Comment filtrer et rechercher des modèles dans Amazon Bedrock ? » LLM n'a pas vu la documentation pendant la phase de formation ou de mise au point, il ne serait donc pas en mesure de répondre à la question et aurait très probablement des hallucinations. Notre objectif avec cet article est de trouver un morceau de texte pertinent à partir du PDF (c'est-à-dire RAG) et de le joindre à l'invite, permettant ainsi à LLM de répondre aux questions spécifiques à ce document.

Ci-dessous, nous montrons comment vous pouvez effectuer toutes ces principales étapes de prétraitement à partir de Toile Amazon SageMaker (alimenté par Gestionnaire de données Amazon SageMaker):

- Extraire du texte d'un document PDF (propulsé par Texttract)

- Supprimer les informations sensibles (propulsé par Comprehend)

- Découpez le texte en morceaux.

- Créez des intégrations pour chaque pièce (propulsées par Bedrock).

- Téléchargez l'intégration dans une base de données vectorielle (propulsée par OpenSearch)

Pré-requis

Pour cette procédure pas à pas, vous devez disposer des éléments suivants :

Notes: Créez des domaines OpenSearch Service en suivant les instructions ici. Pour plus de simplicité, choisissons l'option avec un nom d'utilisateur et un mot de passe principaux pour un contrôle d'accès plus précis. Une fois le domaine créé, créez un index vectoriel avec les mappages suivants, et la dimension vectorielle 1536 s'aligne sur les intégrations Amazon Titan :

Procédure pas à pas

Créer un flux de données

Dans cette section, nous expliquons comment créer un flux de données pour extraire le texte et les métadonnées des PDF, nettoyer et traiter les données, générer des intégrations à l'aide d'Amazon Bedrock et indexer les données dans Amazon OpenSearch.

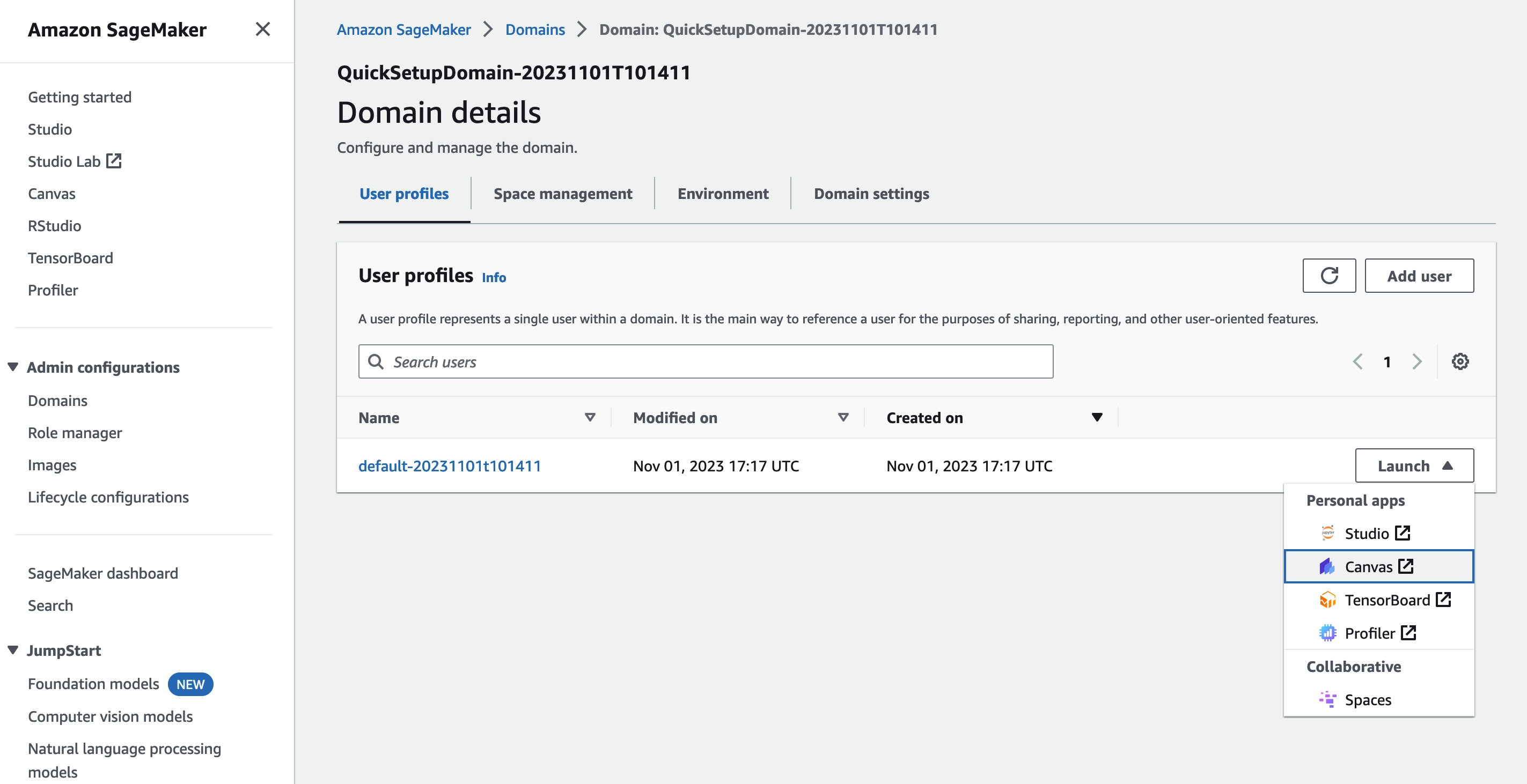

Lancer SageMaker Canvas

Pour lancer SageMaker Canvas, procédez comme suit :

- Sur l'Amazonie Console Sage Maker, choisissez Domaines dans le volet de navigation.

- Choisissez votre domaine.

- Dans le menu de lancement, choisissez Toile.

Créer un flux de données

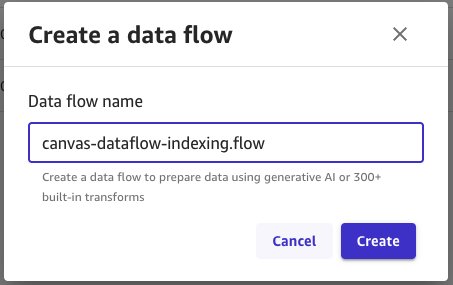

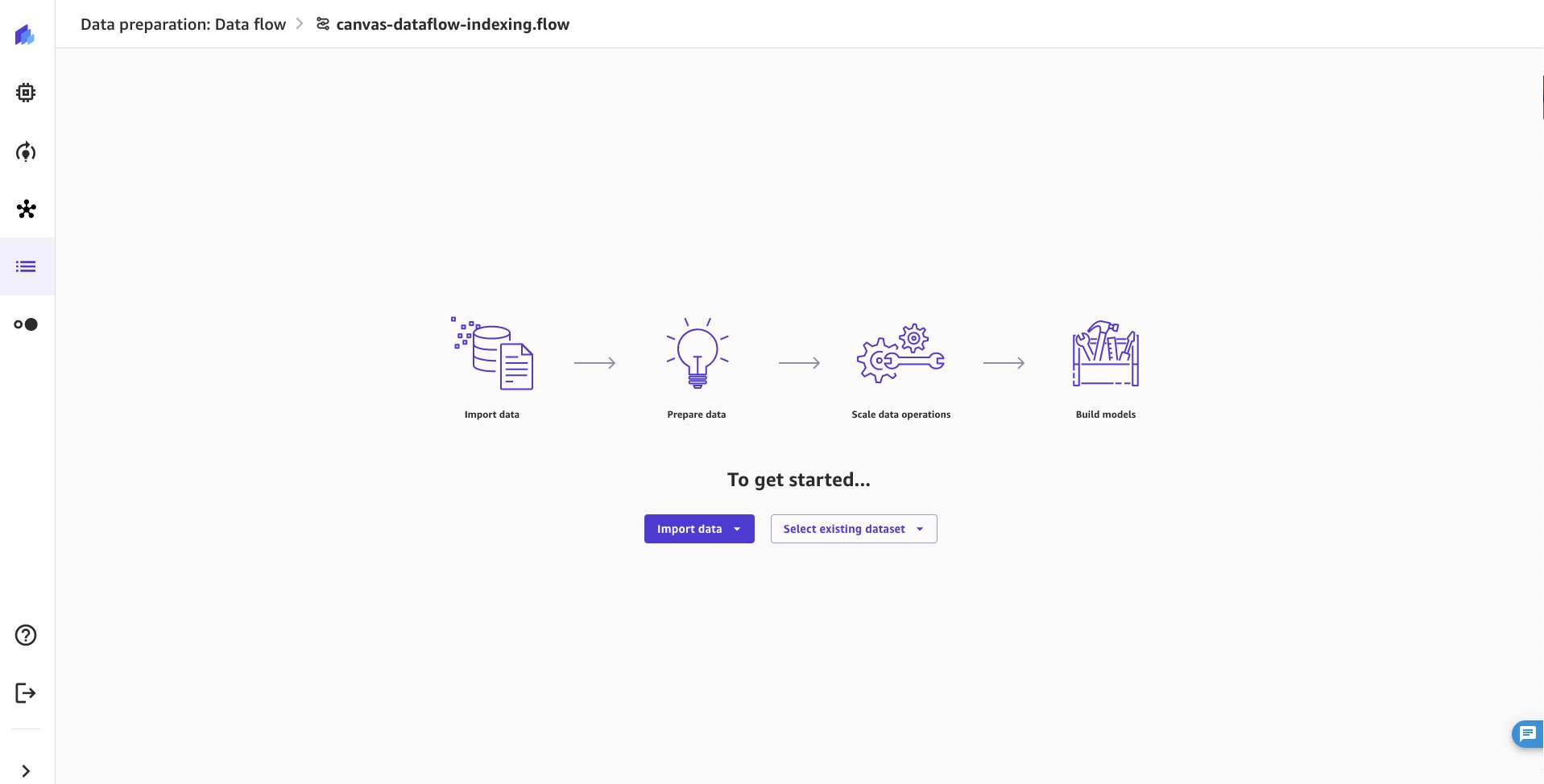

Effectuez les étapes suivantes pour créer un flux de données dans SageMaker Canvas :

- Sur la page d'accueil de SageMaker Canvas, choisissez Traqueur de données.

- Selectionnez Création sur le côté droit de la page, puis donnez un nom de flux de données et sélectionnez Création.

- Cela atterrira sur une page de flux de données.

- Selectionnez Importer des dates, sélectionnez les données tabulaires.

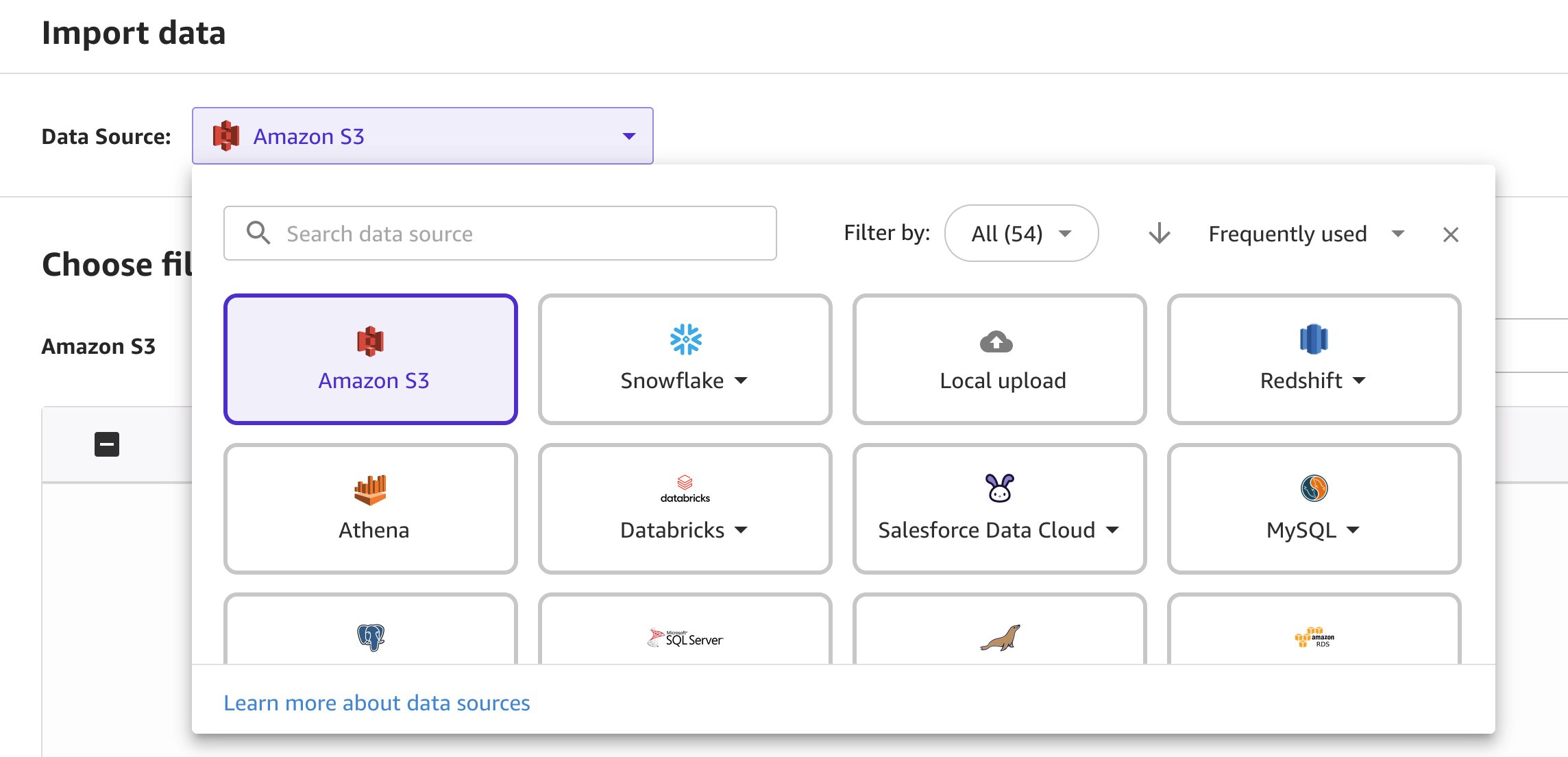

Importons maintenant les données du compartiment Amazon S3 :

- Selectionnez Importer des dates et sélectionnez Tabulaire dans la liste déroulante.

- La source de données et sélectionnez Amazon S3 dans la liste déroulante.

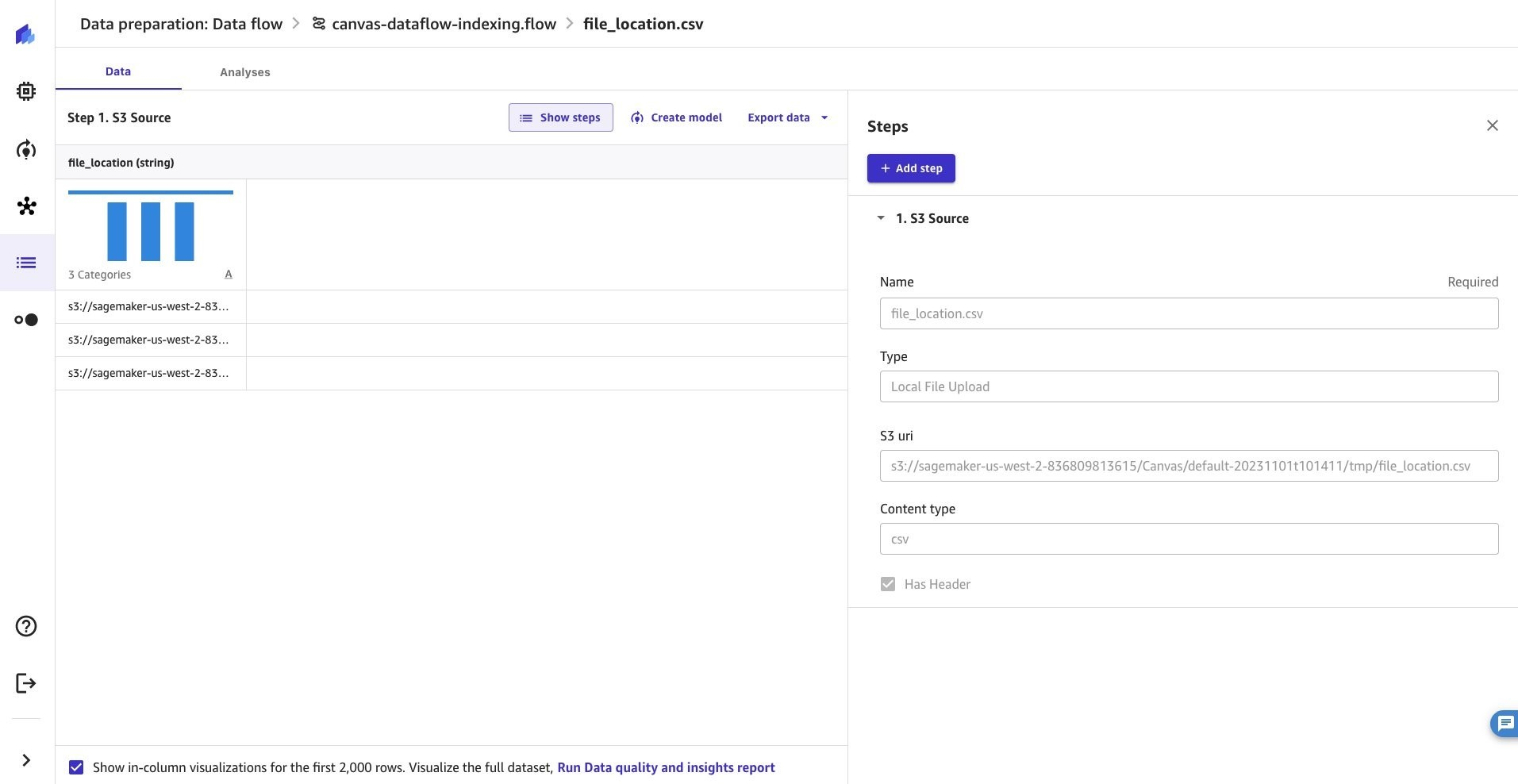

- Accédez au fichier de métadonnées avec les emplacements des fichiers PDF et choisissez le fichier.

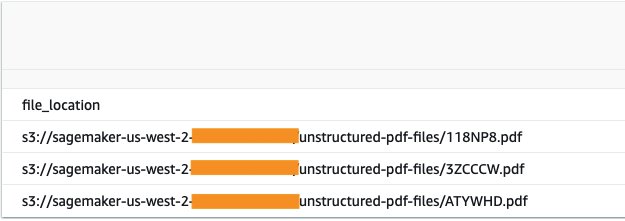

- Le fichier de métadonnées est maintenant chargé dans le flux de données de préparation des données et nous pouvons procéder à l'ajout des étapes suivantes pour transformer les données et l'index en Amazon. Opensearch. Dans ce cas, le fichier contient les métadonnées suivantes, avec l'emplacement de chaque fichier dans le répertoire Amazon S3.

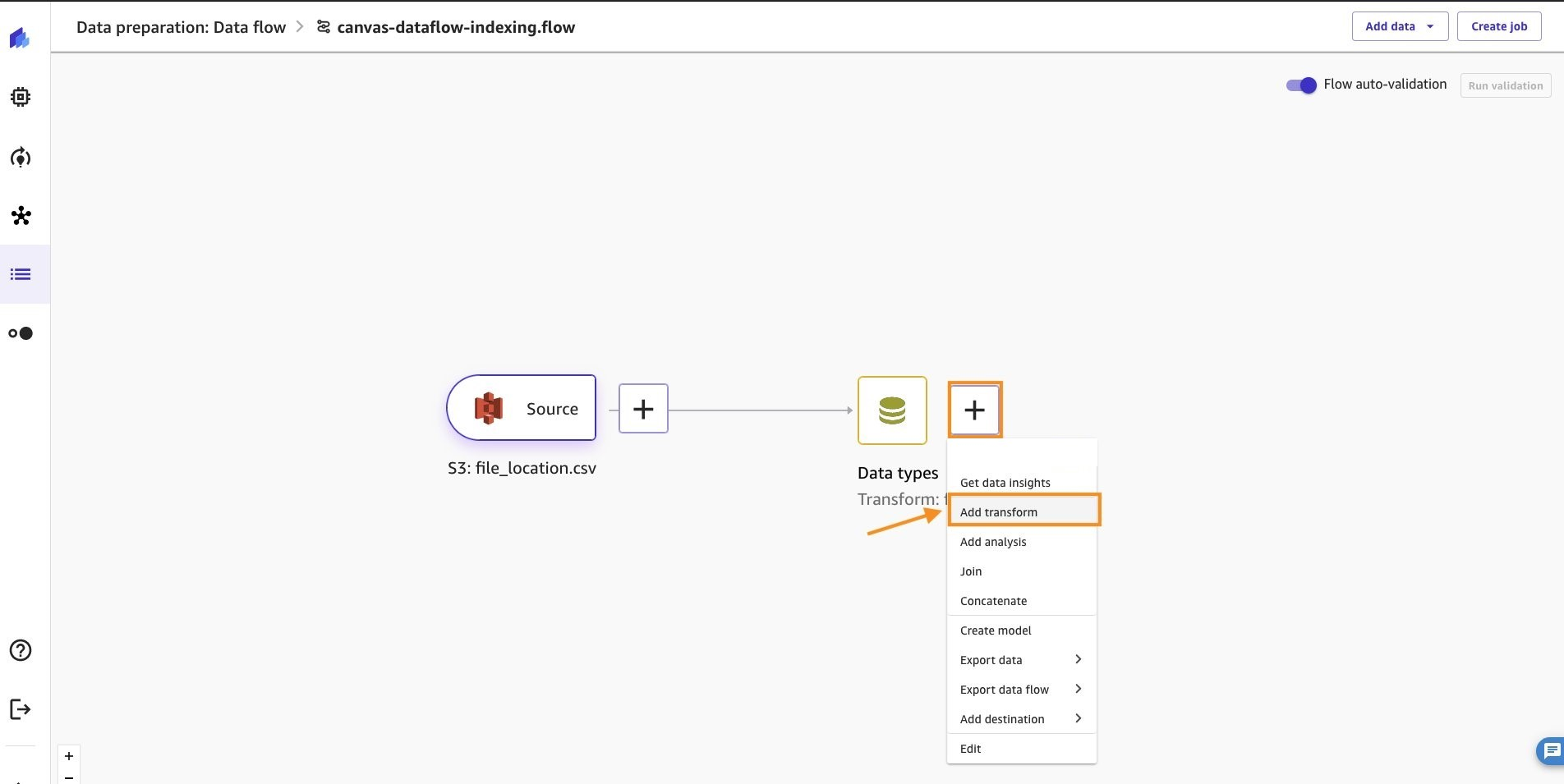

Pour ajouter une nouvelle transformation, procédez comme suit :

- Choisissez le signe plus et choisissez Ajouter une transformation.

- Selectionnez Ajouter une étape et choisissez Transformation personnalisée.

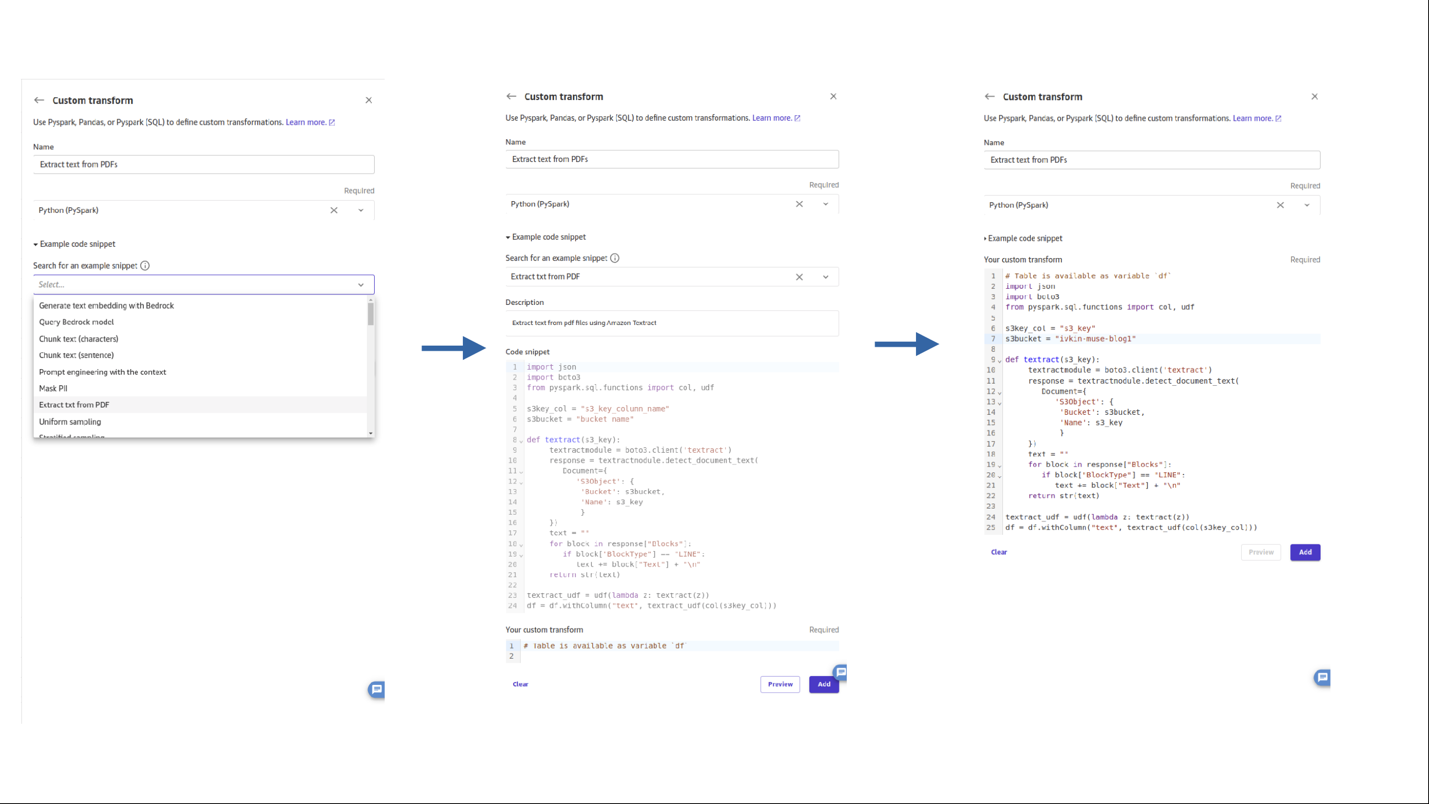

- Vous pouvez créer une transformation personnalisée à l'aide de Pandas, PySpark, des fonctions définies par l'utilisateur Python et de SQL PySpark. Choisir Python (PySpark) pour ce cas d'utilisation.

- Entrez un nom pour l'étape. À partir des exemples d'extraits de code, parcourez et sélectionnez extraire le texte d'un pdf. Apportez les modifications nécessaires à l'extrait de code et sélectionnez Ajouter.

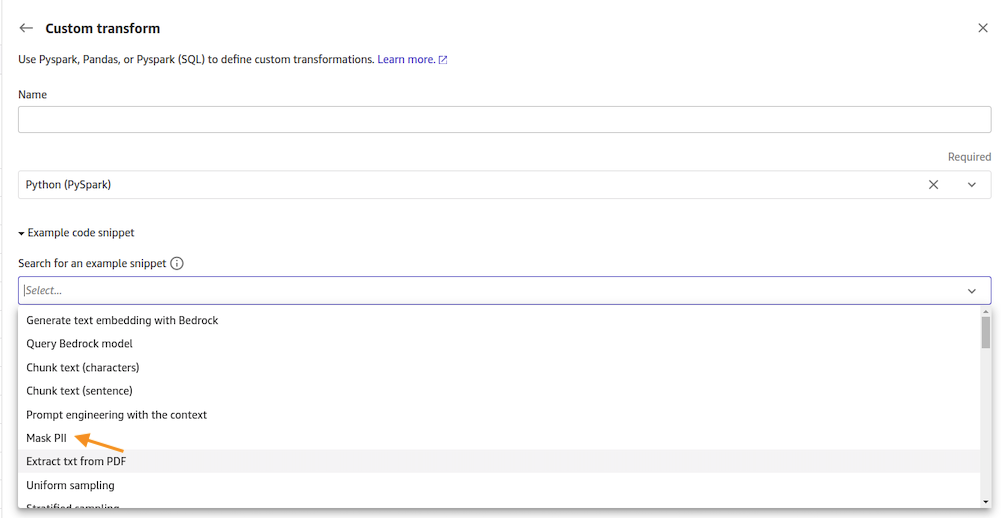

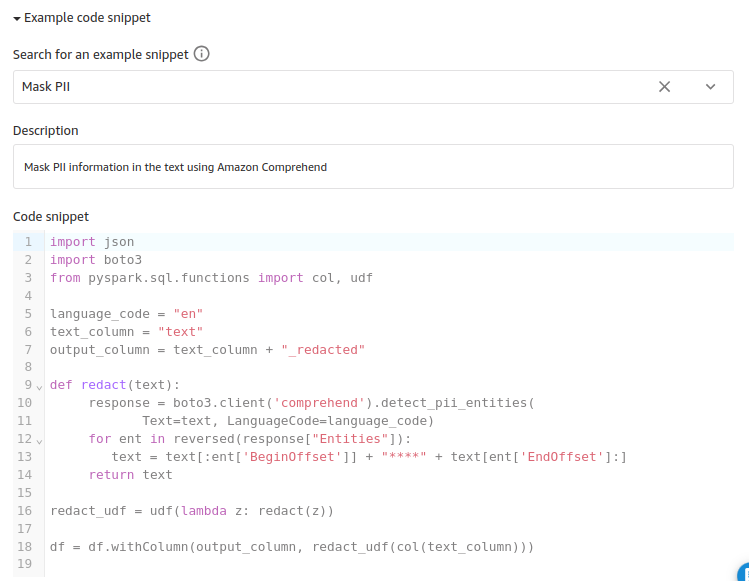

- Ajoutons une étape pour supprimer les données d'informations personnelles identifiables (PII) des données extraites en exploitant Amazon comprendre. Choisir Ajouter une étape et choisissez Transformation personnalisée. Et sélectionnez Python (PySpark).

À partir des exemples d'extraits de code, parcourez et sélectionnez masque PII. Apportez les modifications nécessaires à l'extrait de code et sélectionnez Ajouter.

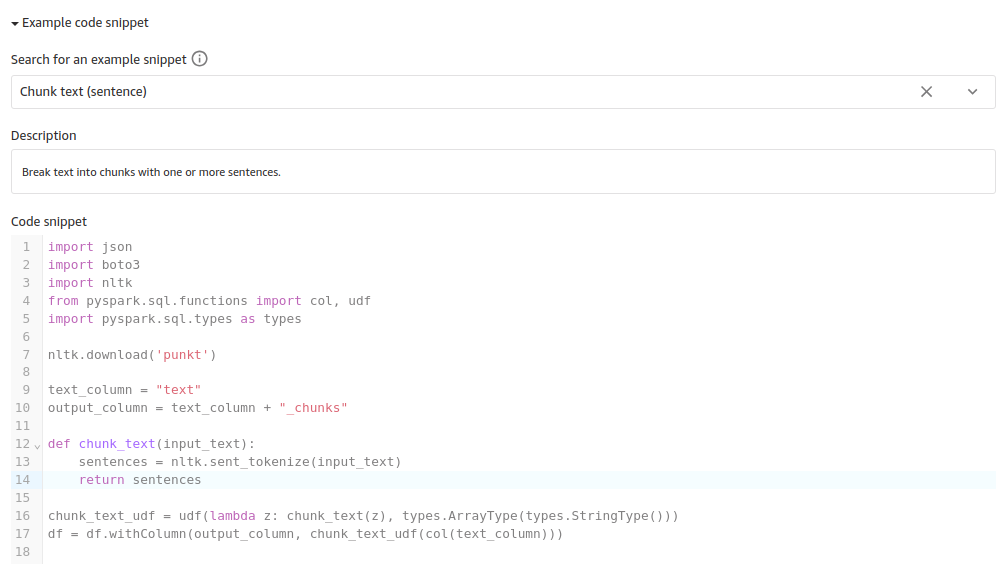

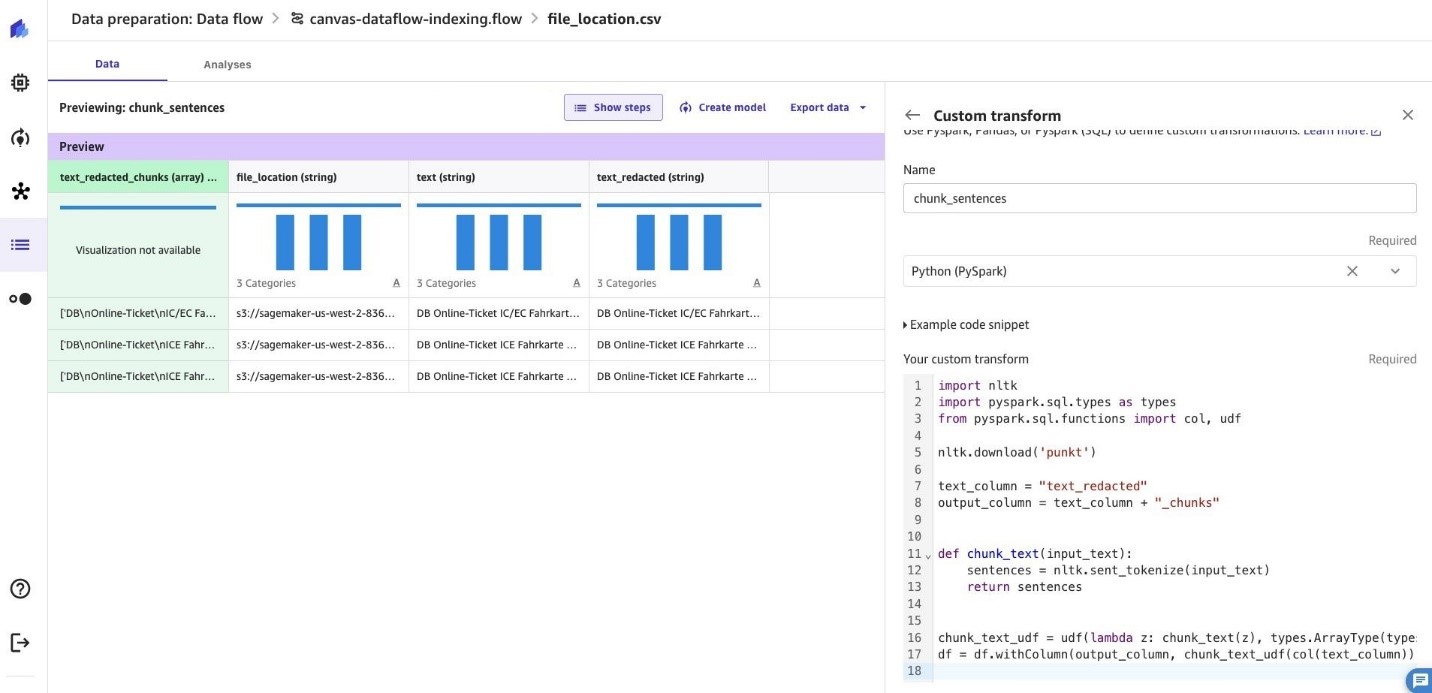

- L'étape suivante consiste à décomposer le contenu du texte. Choisir Ajouter une étape et choisissez Transformation personnalisée. Et sélectionnez Python (PySpark).

À partir des exemples d'extraits de code, parcourez et sélectionnez Texte en morceaux. Apportez les modifications nécessaires à l'extrait de code et sélectionnez Ajouter.

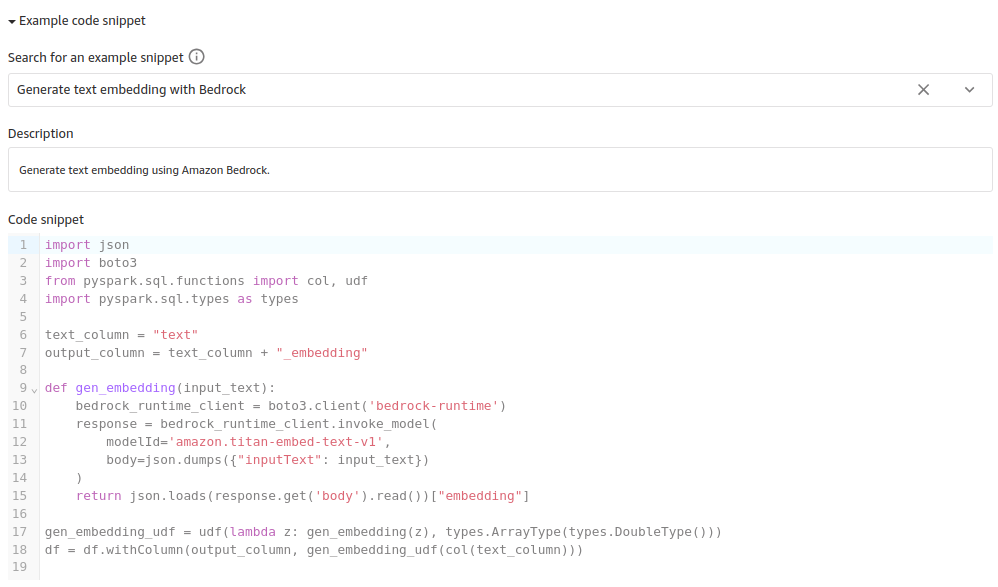

- Convertissons le contenu du texte en intégrations vectorielles à l'aide du Socle amazonien Modèle d'intégration Titan. Choisir Ajouter une étape et choisissez Transformation personnalisée. Et sélectionnez Python (PySpark).

À partir des exemples d'extraits de code, parcourez et sélectionnez Générez du texte intégré avec Bedrock. Apportez les modifications nécessaires à l'extrait de code et sélectionnez Ajouter.

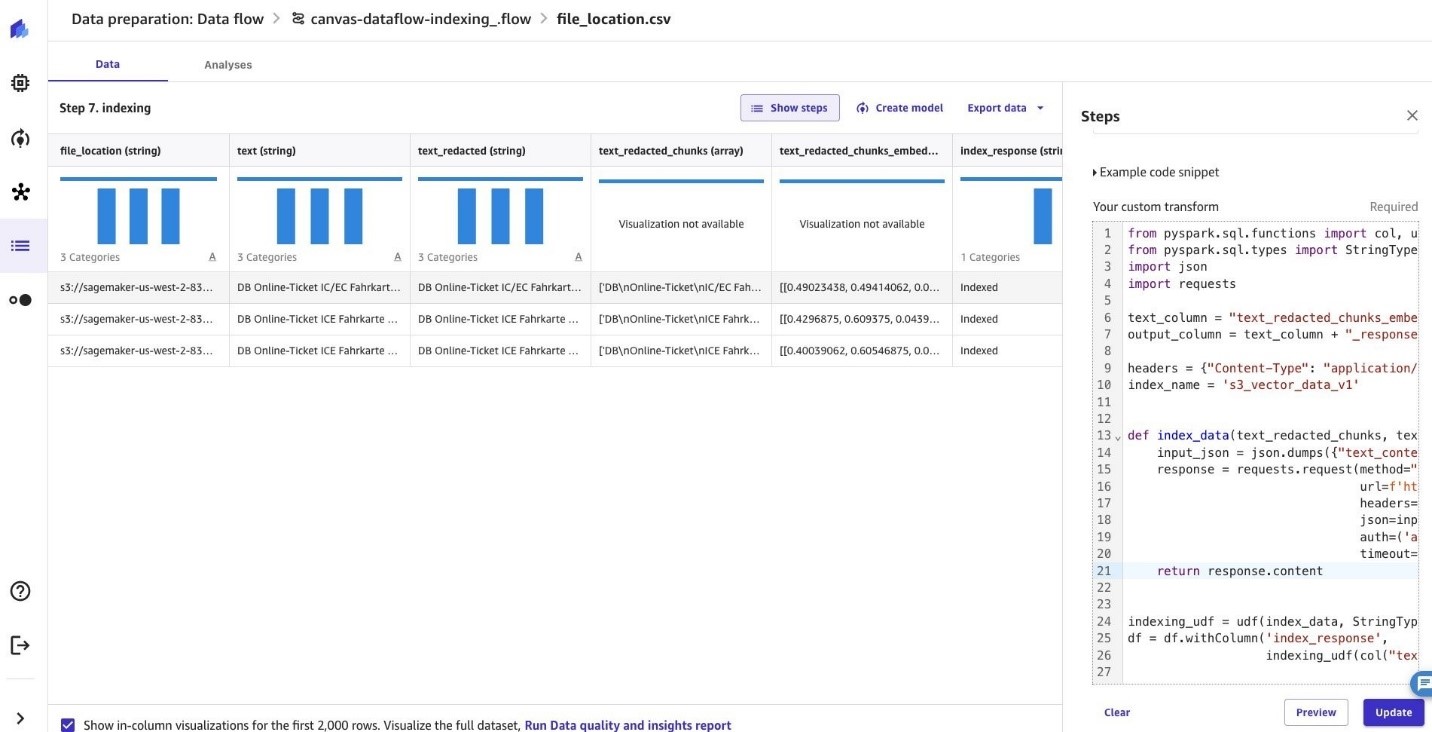

- Nous disposons désormais d'intégrations vectorielles disponibles pour le contenu du fichier PDF. Allons-y et indexons les données dans Amazon OpenSearch. Choisir Ajouter une étape et choisissez Transformation personnalisée. Et sélectionnez Python (PySpark). Vous êtes libre de réécrire le code suivant pour utiliser votre base de données vectorielles préférée. Pour plus de simplicité, nous utilisons le nom d'utilisateur et le mot de passe principaux pour accéder aux API OpenSearch. Pour les charges de travail de production, sélectionnez l'option en fonction des politiques de votre organisation.

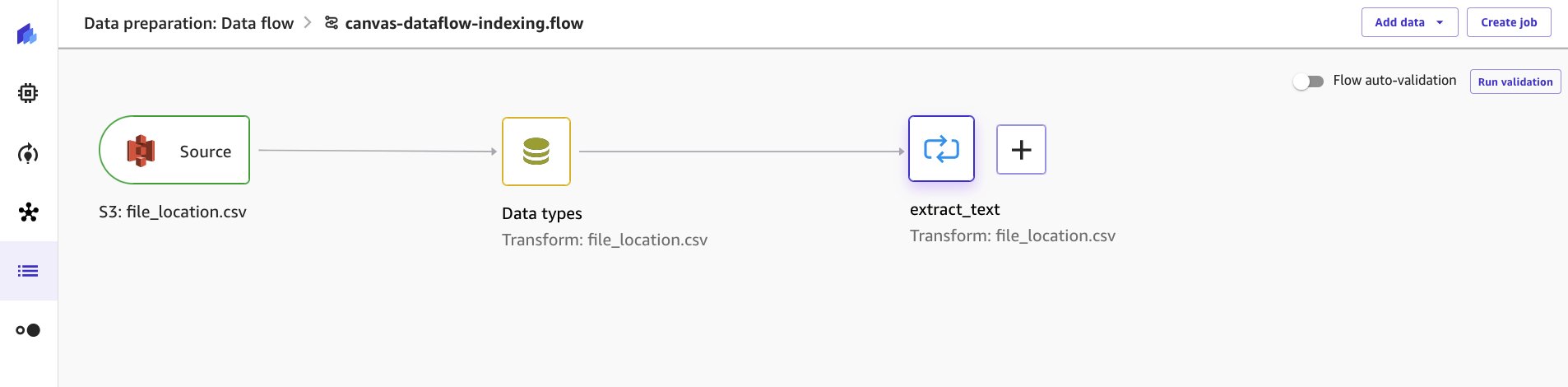

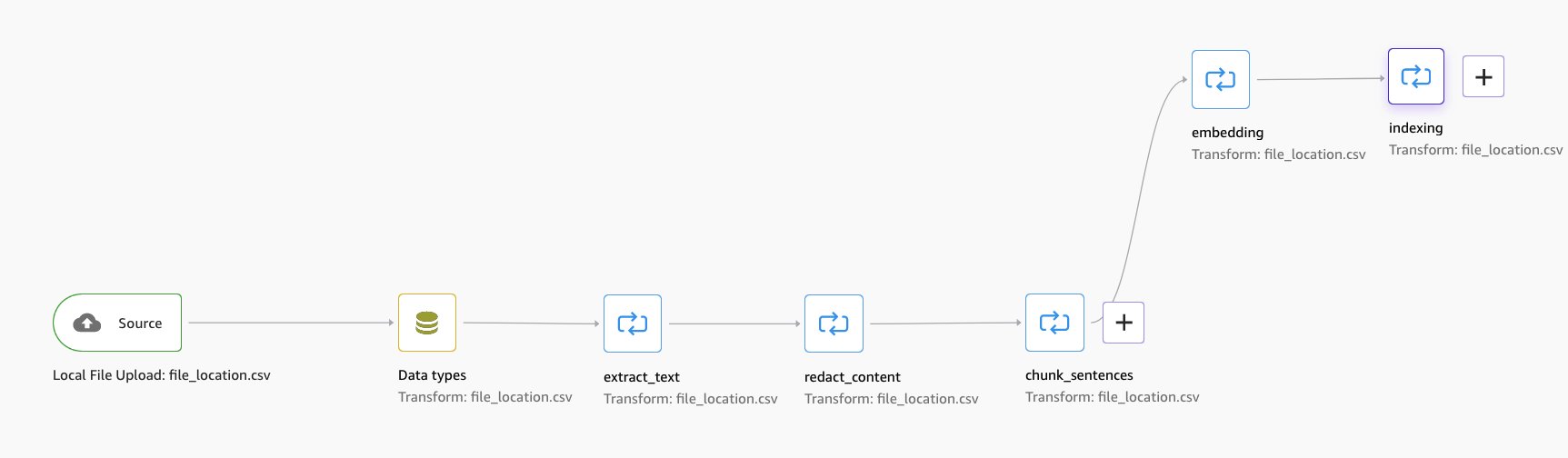

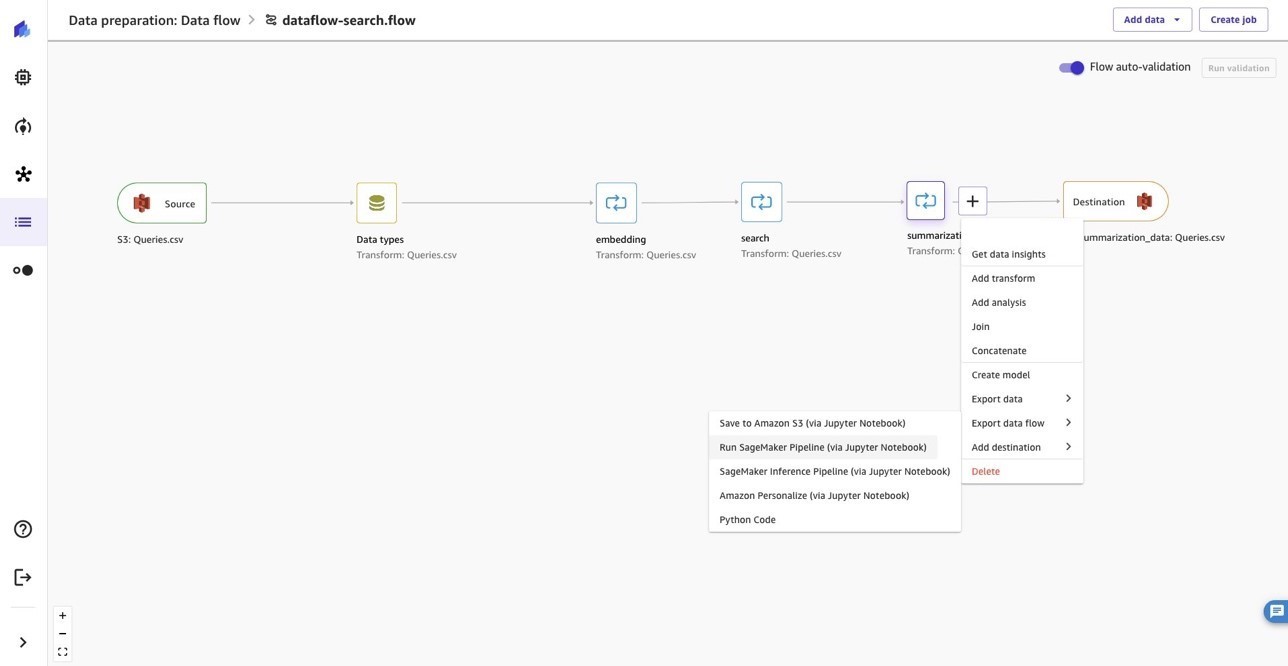

Finalement, le flux de données créé serait le suivant :

Avec ce flux de données, les données du fichier PDF ont été lues et indexées avec des intégrations vectorielles dans Amazon OpenSearch. Il est maintenant temps pour nous de créer un fichier avec des requêtes pour interroger les données indexées et les enregistrer à l'emplacement Amazon S3. Nous dirigerons notre flux de données de recherche vers le fichier et générerons un fichier avec les résultats correspondants dans un nouveau fichier dans un emplacement Amazon S3.

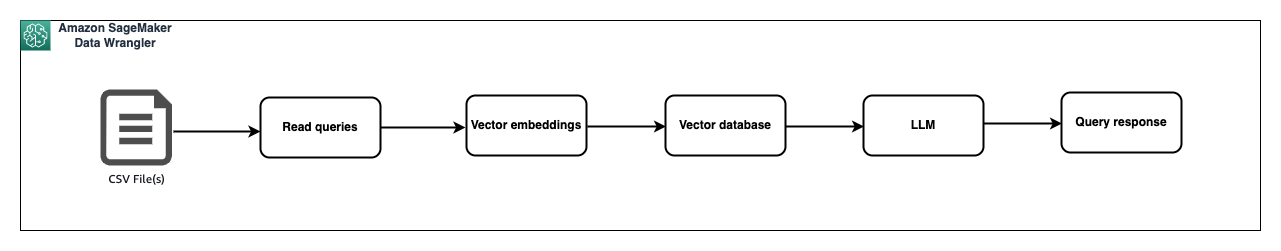

Préparation d'une invite

Après avoir créé une base de connaissances à partir de notre PDF, nous pouvons la tester en recherchant quelques exemples de requêtes dans la base de connaissances. Nous traiterons chaque requête comme suit :

- Générer l'intégration pour la requête (propulsé par Amazon Bedrock)

- Base de données vectorielles de requête pour le contexte du voisin le plus proche (optimisé par Amazon OpenSearch)

- Combinez la requête et le contexte dans l'invite.

- Interrogez LLM avec une invite (propulsé par Amazon Bedrock)

- Sur la page d'accueil de SageMaker Canvas, choisissez Préparation des données.

- Selectionnez Création sur le côté droit de la page, puis donnez un nom de flux de données et sélectionnez Création.

Chargeons maintenant les questions de l'utilisateur, puis créons une invite en combinant la question et les documents similaires. Cette invite est fournie au LLM pour générer une réponse à la question de l'utilisateur.

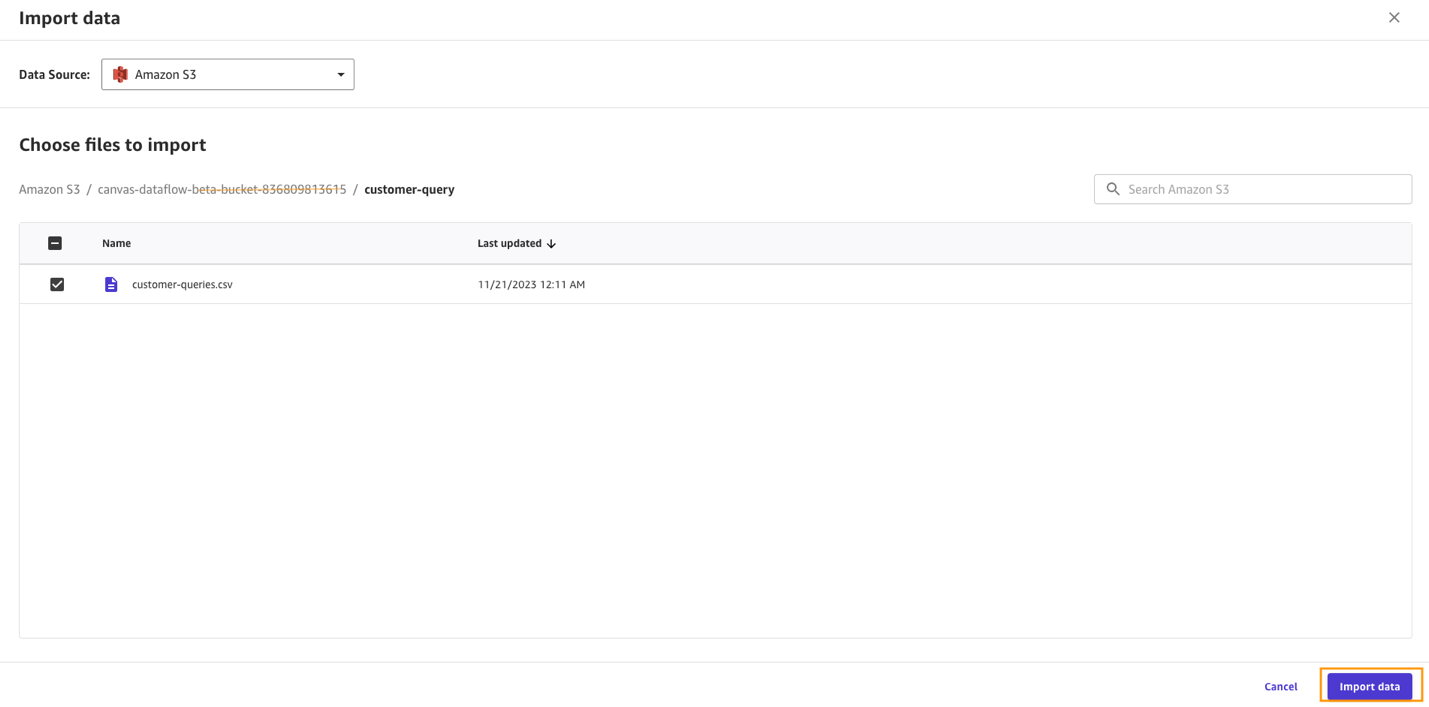

- Chargons un fichier csv avec les questions des utilisateurs. Choisir Importer des données et sélectionnez Tabulaire dans la liste déroulante.

- La source de données, et sélectionnez Amazon S3 dans la liste déroulante. Vous pouvez également choisir de télécharger un fichier contenant les requêtes des utilisateurs.

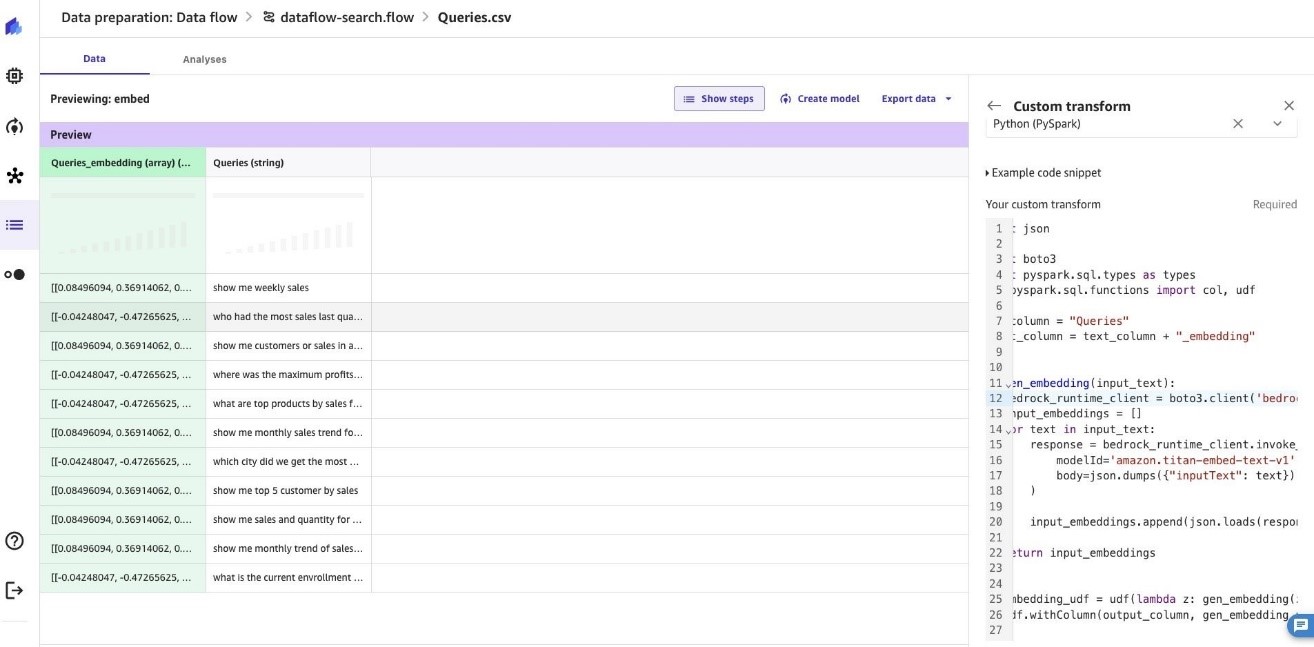

- Ajoutons une transformation personnalisée pour convertir les données en intégrations vectorielles, suivies d'une recherche des intégrations associées à partir d'Amazon OpenSearch, avant d'envoyer une invite à Amazon Bedrock avec la requête et le contexte de la base de connaissances. Pour générer des intégrations pour la requête, vous pouvez utiliser le même exemple d'extrait de code Générer du texte intégré avec Bedrock mentionné à l’étape 7 ci-dessus.

Invoquons l'API Amazon OpenSearch pour rechercher dans les documents pertinents les intégrations vectorielles générées. Ajoutez une transformation personnalisée avec Python (PySpark).

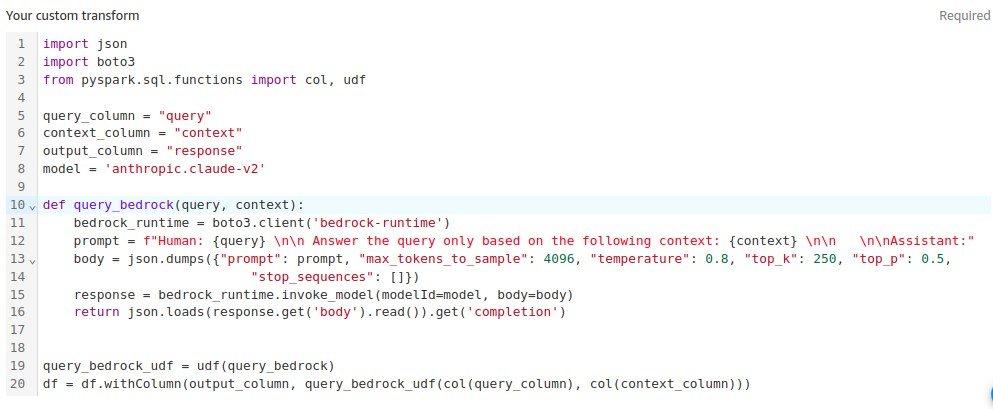

Ajoutons une transformation personnalisée pour appeler l'API Amazon Bedrock pour la réponse aux requêtes, en transmettant les documents de la base de connaissances Amazon OpenSearch. À partir des exemples d'extraits de code, parcourez et sélectionnez Interrogez Bedrock avec le contexte. Apportez les modifications nécessaires à l'extrait de code et sélectionnez Ajouter.

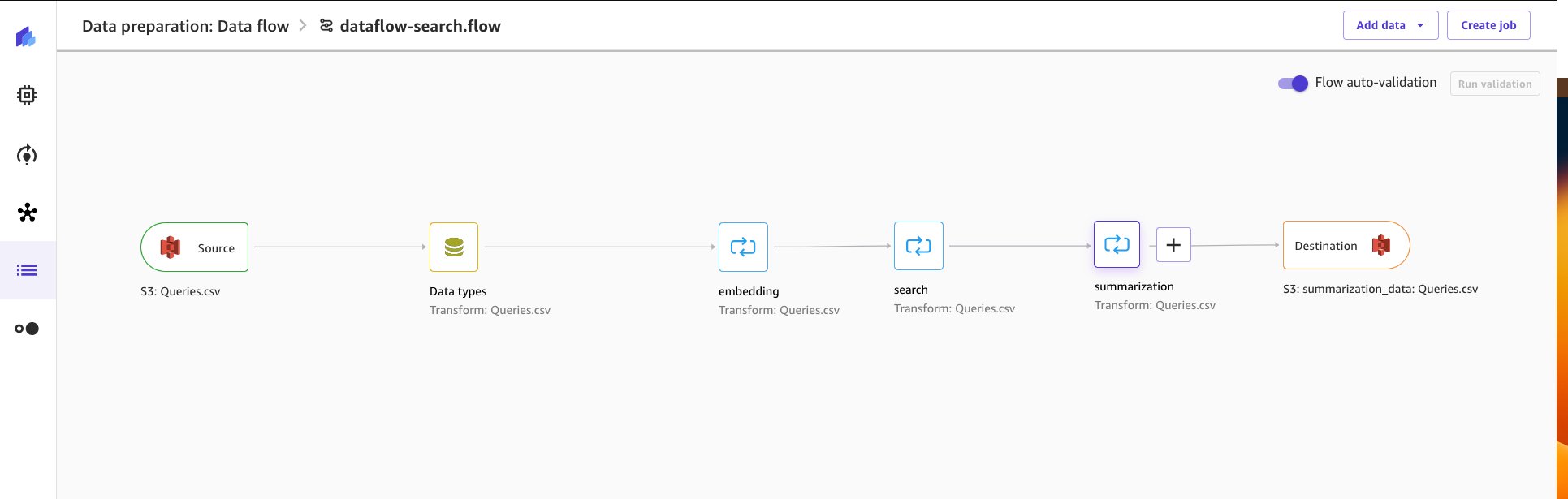

En résumé, le flux de données de réponse aux questions basé sur RAG est le suivant :

Les praticiens du ML passent beaucoup de temps à créer du code d'ingénierie de fonctionnalités, à l'appliquer à leurs ensembles de données initiaux, à former des modèles sur les ensembles de données créés et à évaluer la précision du modèle. Compte tenu de la nature expérimentale de ce travail, même le plus petit projet donne lieu à de multiples itérations. Le même code d’ingénierie de fonctionnalités est souvent exécuté encore et encore, ce qui fait perdre du temps et des ressources de calcul à répéter les mêmes opérations. Dans les grandes organisations, cela peut entraîner une perte de productivité encore plus importante, car différentes équipes exécutent souvent des tâches identiques ou même écrivent du code d'ingénierie de fonctionnalités en double parce qu'elles n'ont aucune connaissance des travaux antérieurs. Pour éviter le retraitement des fonctionnalités, nous exporterons notre flux de données vers un Amazon Pipeline SageMaker. Choisissons le Bouton + à droite de la requête. Sélectionnez Exporter le flux de données et choisissez Exécuter le pipeline SageMaker (via le bloc-notes Jupyter).

Nettoyer

Pour éviter d'encourir des frais futurs, supprimez ou fermez les ressources que vous avez créées en suivant ce message. Faire référence à Déconnexion d'Amazon SageMaker Canvas pour plus de détails.

Conclusion

Dans cet article, nous vous avons montré comment exploiter les capacités de bout en bout d'Amazon SageMaker Canvas en assumant le rôle d'un professionnel des données préparant les données pour un LLM. La préparation interactive des données a permis de nettoyer, transformer et analyser rapidement les données pour concevoir des fonctionnalités informatives. En supprimant les complexités de codage, SageMaker Canvas a permis une itération rapide pour créer un ensemble de données de formation de haute qualité. Ce flux de travail accéléré a conduit directement à la création, à la formation et au déploiement d'un modèle d'apprentissage automatique performant pour un impact commercial. Grâce à sa préparation complète des données et à son expérience unifiée, des données aux informations, SageMaker Canvas permet aux utilisateurs d'améliorer leurs résultats en matière de ML.

Nous vous encourageons à en savoir plus en explorant Gestionnaire de données Amazon SageMaker, Toile Amazon SageMaker, Titan d'Amazonie modèles, Socle amazonienet Amazon Service OpenSearch pour créer une solution en utilisant l'exemple d'implémentation fourni dans cet article et un ensemble de données pertinent pour votre entreprise. Si vous avez des questions ou des suggestions, veuillez laisser un commentaire.

À propos des auteurs

Ajjay Govindaram est architecte de solutions senior chez AWS. Il travaille avec des clients stratégiques qui utilisent l'IA/ML pour résoudre des problèmes commerciaux complexes. Son expérience consiste à fournir une direction technique ainsi qu'une assistance à la conception pour les déploiements d'applications AI/ML à petite et grande échelle. Ses connaissances vont de l'architecture d'application au big data, à l'analyse et à l'apprentissage automatique. Il aime écouter de la musique tout en se reposant, profiter du plein air et passer du temps avec ses proches.

Ajjay Govindaram est architecte de solutions senior chez AWS. Il travaille avec des clients stratégiques qui utilisent l'IA/ML pour résoudre des problèmes commerciaux complexes. Son expérience consiste à fournir une direction technique ainsi qu'une assistance à la conception pour les déploiements d'applications AI/ML à petite et grande échelle. Ses connaissances vont de l'architecture d'application au big data, à l'analyse et à l'apprentissage automatique. Il aime écouter de la musique tout en se reposant, profiter du plein air et passer du temps avec ses proches.

Nikita Ivkine est un scientifique appliqué senior chez Amazon SageMaker Data Wrangler avec des intérêts dans l'apprentissage automatique et les algorithmes de nettoyage des données.

Nikita Ivkine est un scientifique appliqué senior chez Amazon SageMaker Data Wrangler avec des intérêts dans l'apprentissage automatique et les algorithmes de nettoyage des données.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/simplify-data-prep-for-gen-ai-with-amazon-sagemaker-data-wrangler/

- :possède

- :est

- :ne pas

- 100

- 14

- 20

- 25

- 28

- 50

- 7

- 8

- 804

- a

- Capable

- A Propos

- au dessus de

- accélérer

- accéléré

- accès

- Selon

- hybrides

- précision

- ajouter

- Supplémentaire

- Adoption

- avances

- Avantage

- avantages

- Après

- encore

- agrégat

- devant

- AI

- AI / ML

- algorithmes

- Aligne

- Tous

- permis

- aussi

- Amazon

- Amazon Sage Maker

- Gestionnaire de données Amazon SageMaker

- Amazon Web Services

- quantités

- an

- Analyses

- analytique

- l'analyse

- ainsi que

- répondre

- tous

- api

- Application

- appliqué

- Application

- architecture

- SONT

- artificiel

- intelligence artificielle

- AS

- Assistance

- At

- joindre

- acoustique

- augmentée

- disponibles

- éviter

- AWS

- base

- basé

- BE

- car

- devient

- était

- before

- va

- Améliorée

- biaisé

- Big

- Big Data

- construire

- Développement

- intégré

- la performance des entreprises

- entreprises

- bouton (dans la fenêtre de contrôle qui apparaît maintenant)

- by

- Appelez-nous

- CAN

- la toile

- capacités

- maisons

- Causes

- Modifications

- des charges

- Selectionnez

- espace extérieur plus propre,

- Nettoyage

- code

- Codage

- combinant

- commentaire

- Sociétés

- par rapport

- compétitif

- complet

- complexe

- complexités

- comprendre

- complet

- calcul

- Considérer

- Console

- contiennent

- contient

- contenu

- contenu

- contexte

- contextes

- continue

- des bactéries

- convertir

- Correspondant

- pourriez

- couverture

- engendrent

- créée

- critique

- Customiser

- des clients

- Service à la clientèle

- Clients

- données

- Préparation des données

- Base de données

- ensembles de données

- Deloitte

- démontré

- déployer

- déploiements

- Conception

- détails

- développement

- différent

- difficile

- Dimension

- direction

- directement

- découvrez

- do

- document

- Documentation

- INSTITUTIONNELS

- domaine

- domaines

- down

- pendant

- e

- chacun

- même

- de manière efficace

- efficace

- efficacement

- emails

- enrobage

- responsabilise

- activé

- permettant

- encourager

- end-to-end

- ingénieur

- conçu

- ENGINEERING

- évaluer

- Pourtant, la

- exemple

- existe

- d'experience

- l'expérience

- expérimental

- explorez

- Explorer

- Exporter

- extrait

- Fonctionnalité

- Fonctionnalités:

- few

- Des champs

- Déposez votre dernière attestation

- une fonction filtre

- finale

- Trouvez

- flux

- suivi

- Abonnement

- suit

- Pour

- Forbes

- Fondation

- Fondations

- gratuitement ici

- De

- plein

- fonctions

- plus

- avenir

- Gain

- générer

- généré

- générateur

- génération

- génératif

- IA générative

- obtenez

- Donner

- donné

- Global

- Go

- objectif

- Bien

- plus grand

- Vous avez

- he

- têtes

- de haute qualité

- sa

- détient

- Accueil

- Comment

- How To

- Cependant

- HTML

- HTTPS

- i

- identique

- if

- satellite

- Impact

- la mise en oeuvre

- importer

- important

- impressionnant

- améliorer

- in

- inclut

- indice

- indexé

- d'information

- informatif

- initiale

- idées.

- Des instructions

- l'intégration

- Intelligence

- Interactif

- intérêts

- Interfaces

- Internet

- développement

- impliquer

- IT

- itération

- itérations

- SES

- Emplois

- jpg

- json

- spécialisées

- Transport routier

- langue

- gros

- grande échelle

- lancer

- Conduit

- APPRENTISSAGE

- apprentissage

- Laisser

- LED

- en tirant parti

- se trouve

- comme

- Liste

- Écoute

- LLM

- charge

- emplacement

- emplacements

- perte

- Lot

- aimé

- Faible

- click

- machine learning

- Entrée

- a prendre une

- FAIT DU

- masque

- massif

- maître

- Mai..

- mécanismes

- Médias

- Menu

- Meta

- Métadonnées

- ML

- modèle

- numériques jumeaux (digital twin models)

- modeste

- PLUS

- (en fait, presque toutes)

- plusieurs

- Musique

- prénom

- Nature

- Traitement du langage naturel

- Nature

- Navigation

- nécessaire

- Besoin

- Nouveauté

- next

- aucune

- cahier

- maintenant

- of

- souvent

- on

- une fois

- et, finalement,

- uniquement

- Opérations

- Option

- or

- organisation

- organisations

- Autre

- nos

- ande

- les résultats

- l'extérieur

- sortie

- plus de

- page

- pandas

- pain

- En passant

- Mot de Passe

- performant

- personnel

- en particulier pendant la préparation

- pièce

- pièces

- pipeline

- Platon

- Intelligence des données Platon

- PlatonDonnées

- veuillez cliquer

- plus

- Point

- politiques

- Post

- défaillances

- alimenté

- préféré

- préparation

- Préparer

- en train de préparer

- Avant

- Probablement

- Problème

- d'ouvrabilité

- procéder

- processus

- traitement

- Vidéo

- productivité

- professionels

- Projet

- propriétés

- à condition de

- fournit

- aportando

- Python

- requêtes

- question

- fréquemment posées

- vite.

- gammes

- Nos tests de diagnostic produisent des résultats rapides et précis sans nécessiter d'équipement de laboratoire complexe et coûteux,

- votes

- nous joindre

- Lire

- monde réel

- reçu

- reportez-vous

- en relation

- pertinent

- enlever

- Signalé

- demandes

- exigent

- a besoin

- Resources

- réponse

- réponses

- reposant

- Résultats

- retourner

- Avis

- bon

- Rôle

- Courir

- sagemaker

- même

- Épargnez

- Scientifique

- Rechercher

- recherche

- Section

- vu

- Sélectionner

- envoi

- supérieur

- sensible

- service

- Services

- Paramétres

- devrait

- montrer

- montré

- fermer

- arrêter

- côté

- signer

- significative

- similaires

- simplicité

- simplifier

- Taille

- Fragment

- So

- Réseaux sociaux

- réseaux sociaux

- sur mesure

- Solutions

- RÉSOUDRE

- quelques

- Identifier

- Sources

- groupe de neurones

- spécifiquement

- passer

- Dépenses

- Étape

- étapes

- étapes

- Étapes

- Encore

- Stratégique

- structuré

- RÉSUMÉ

- Les soutiens

- Sondage

- Prenez

- équipes

- Technique

- techniques

- tester

- texte

- qui

- La

- El futuro

- leur

- Les

- puis

- Là.

- Ces

- l'ont

- this

- Ainsi

- fiable

- Titan

- à

- aujourd'hui

- les outils

- Formation

- Transformer

- De La Carrosserie

- transformations

- transformer

- oui

- troncature

- type

- types

- unifiée

- us

- utilisé

- d'utiliser

- Utilisateur

- utilisateurs

- en utilisant

- Précieux

- via

- Vidéo

- visuel

- walkthrough

- we

- web

- services Web

- WELL

- qui

- tout en

- WHO

- sera

- comprenant

- activités principales

- workflow

- vos contrats

- pourra

- écrire

- Vous n'avez

- Votre

- zéphyrnet