Lancé en 2021, Toile Amazon SageMaker est un service visuel pointer-cliquer permettant de créer et de déployer des modèles d'apprentissage automatique (ML) sans avoir besoin d'écrire de code. Les modèles de base (FM) prêts à l'emploi disponibles dans SageMaker Canvas permettent aux clients d'utiliser l'IA générative pour des tâches telles que la génération et la synthèse de contenu.

Nous sommes ravis d'annoncer les dernières mises à jour d'Amazon SageMaker Canvas, qui apportent de nouvelles fonctionnalités d'IA générative passionnantes à la plateforme. Avec la prise en charge des modèles Meta Llama 2 et Mistral.AI et le lancement de réponses en streaming, SageMaker Canvas continue de donner les moyens à tous ceux qui souhaitent se lancer dans l'IA générative sans écrire une seule ligne de code. Dans cet article, nous discutons de ces mises à jour et de leurs avantages.

Présentation des modèles Meta Llama 2 et Mistral

Llama 2 est un modèle de base de pointe de Meta qui offre une évolutivité et une polyvalence améliorées pour un large éventail de tâches d'IA générative. Les utilisateurs ont signalé que Llama 2 est capable de s'engager dans des conversations significatives et cohérentes, de générer du nouveau contenu et d'extraire des réponses à partir de notes existantes. Llama 2 fait partie des grands modèles de langage (LLM) de pointe disponibles aujourd'hui pour que la communauté open source puisse créer ses propres applications basées sur l'IA.

Mistral.AI, start-up française leader en IA, a développé le Mistral 7B, un modèle de langage puissant doté de 7.3 milliards de paramètres. Les modèles Mistral ont été très bien accueillis par la communauté open source grâce à l'utilisation de l'attention de requête groupée (GQA) pour une inférence plus rapide, ce qui le rend très efficace et comparable à un modèle avec deux ou trois fois plus de paramètres.

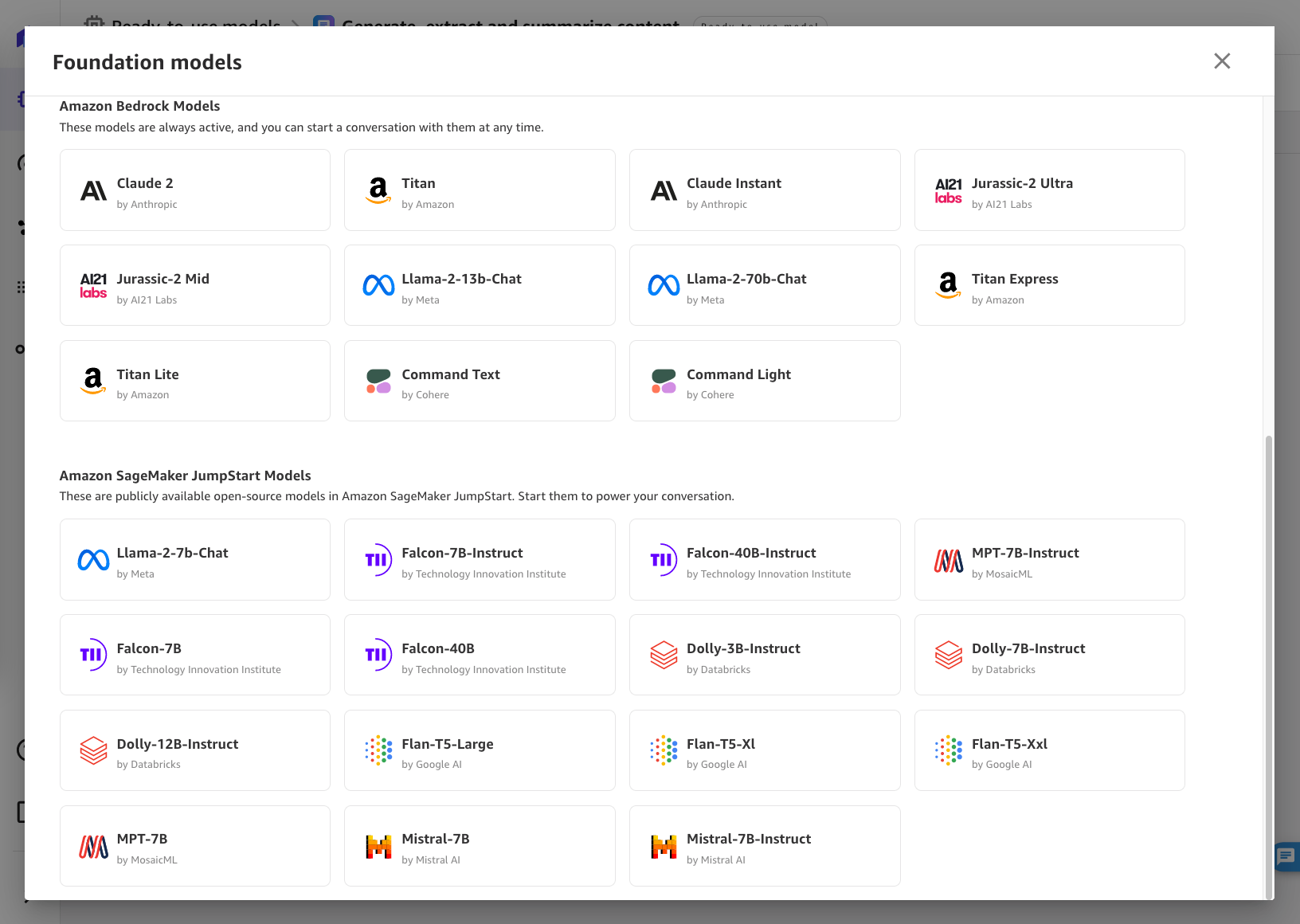

Aujourd'hui, nous sommes ravis d'annoncer que SageMaker Canvas prend désormais en charge trois variantes de modèle Llama 2 et deux variantes de Mistral 7B :

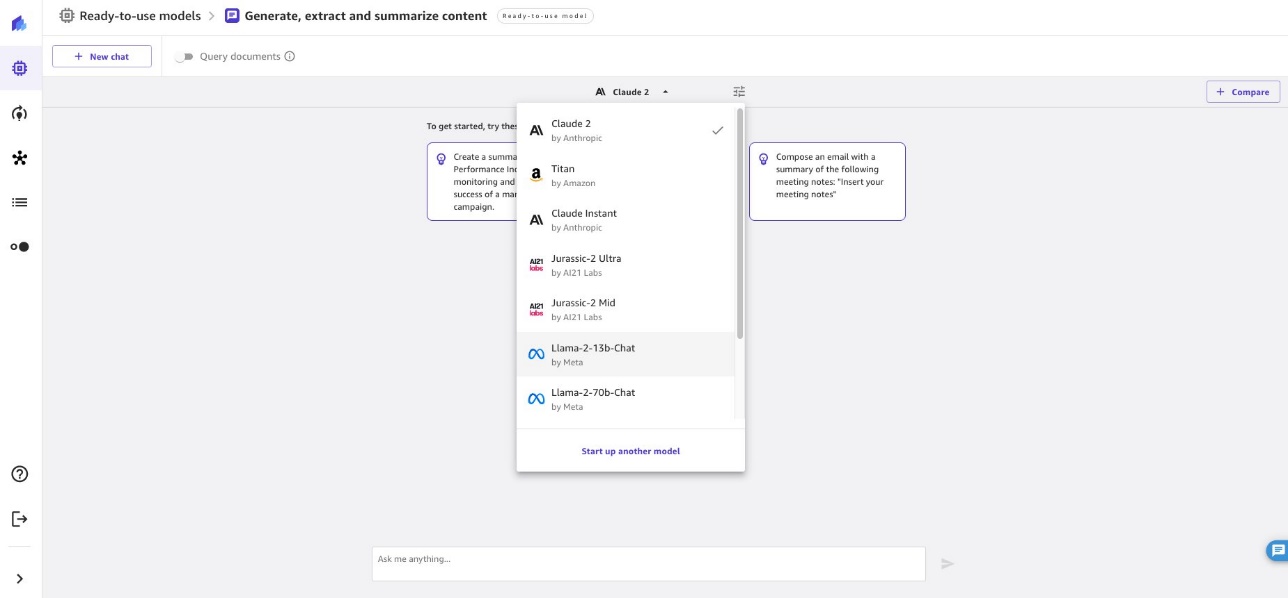

Pour tester ces modèles, accédez au SageMaker Canvas Modèles prêts à l'emploi page, puis choisissez Générer, extraire et résumer du contenu. C'est ici que vous trouverez l'expérience de chat SageMaker Canvas GenAI. Ici, vous pouvez utiliser n'importe quel modèle d'Amazon Bedrock ou de SageMaker JumpStart en les sélectionnant dans le menu déroulant du modèle.

Dans notre cas, nous choisissons l’un des modèles Llama 2. Vous pouvez maintenant fournir votre contribution ou votre requête. Lorsque vous envoyez l'entrée, SageMaker Canvas transmet votre entrée au modèle.

Choisir lequel des modèles disponibles dans SageMaker Canvas convient le mieux à votre cas d'utilisation nécessite que vous preniez en compte les informations sur les modèles eux-mêmes : le modèle Llama-2-70B-chat est un modèle plus grand (70 milliards de paramètres, contre 13 milliards avec Llama-2-13B-chat ), ce qui signifie que ses performances sont généralement supérieures à celles du plus petit, au prix d'une latence légèrement plus élevée et d'un coût par jeton accru. Mistral-7B a des performances comparables à Llama-2-7B ou Llama-2-13B, mais il est hébergé sur Amazon SageMaker. Cela signifie que le modèle de tarification est différent, passant d'un modèle de tarification en dollars par jeton à un modèle en dollars par heure. Cela peut être plus rentable avec un nombre important de requêtes par heure et une utilisation cohérente à grande échelle. Tous les modèles ci-dessus peuvent fonctionner correctement dans une variété de cas d'utilisation. Notre suggestion est donc d'évaluer quel modèle résout le mieux votre problème, en tenant compte des compromis en matière de rendement, de débit et de coût.

Si vous recherchez un moyen simple de comparer le comportement des modèles, SageMaker Canvas fournit nativement cette fonctionnalité sous la forme de comparaisons de modèles. Vous pouvez sélectionner jusqu'à trois modèles différents et leur envoyer la même requête à tous en même temps. SageMaker Canvas obtiendra ensuite les réponses de chacun des modèles et les affichera dans une interface utilisateur de discussion côte à côte. Pour ce faire, choisissez Comparer et choisissez d'autres modèles à comparer, comme indiqué ci-dessous :

Présentation du streaming de réponses : interactions en temps réel et performances améliorées

L'une des principales avancées de cette version est l'introduction de réponses en continu. Le streaming des réponses offre une expérience plus riche à l’utilisateur et reflète mieux une expérience de chat. Grâce aux réponses en streaming, les utilisateurs peuvent recevoir des commentaires instantanés et une intégration transparente dans leurs applications de chatbot. Cela permet une expérience plus interactive et réactive, améliorant les performances globales et la satisfaction des utilisateurs du chatbot. La possibilité de recevoir des réponses immédiates sous la forme d'un chat crée un flux de conversation plus naturel et améliore l'expérience utilisateur.

Grâce à cette fonctionnalité, vous pouvez désormais interagir avec vos modèles d'IA en temps réel, recevoir des réponses instantanées et permettre une intégration transparente dans une variété d'applications et de flux de travail. Tous les modèles pouvant être interrogés dans SageMaker Canvas (à partir d'Amazon Bedrock et de SageMaker JumpStart) peuvent diffuser des réponses à l'utilisateur.

Commencez dès aujourd'hui

Que vous construisiez un chatbot, un système de recommandation ou un assistant virtuel, les modèles Llama 2 et Mistral combinés à des réponses en streaming apportent des performances et une interactivité améliorées à vos projets.

Pour utiliser les dernières fonctionnalités de SageMaker Canvas, assurez-vous de supprimer et de recréer l'application. Pour ce faire, déconnectez-vous de l'application en choisissant Déconnexion, puis ouvrez à nouveau SageMaker Canvas. Vous devriez voir les nouveaux modèles et profiter des dernières versions. La déconnexion de l'application SageMaker Canvas libérera toutes les ressources utilisées par l'instance d'espace de travail, évitant ainsi d'encourir des frais supplémentaires involontaires.

Conclusion

Pour commencer avec les nouvelles réponses diffusées en continu pour les modèles Llama 2 et Mistral dans SageMaker Canvas, visitez le Console SageMaker et explorez l'interface intuitive. Pour en savoir plus sur la façon dont SageMaker Canvas et l'IA générative peuvent vous aider à atteindre vos objectifs commerciaux, reportez-vous à Donnez à vos utilisateurs professionnels les moyens d'extraire des informations à partir de documents d'entreprise à l'aide d'Amazon SageMaker Canvas et de Generative AI. et les Surmonter les défis courants des centres de contact grâce à l'IA générative et à Amazon SageMaker Canvas.

Si vous souhaitez en savoir plus sur les fonctionnalités de SageMaker Canvas et approfondir d'autres cas d'utilisation du ML, consultez les autres articles disponibles dans le Catégorie Toile SageMaker du blog AWS ML. Nous avons hâte de voir les étonnantes applications d'IA que vous créerez avec ces nouvelles fonctionnalités !

À propos des auteurs

David Gallitelli est un architecte de solutions spécialisé senior pour l'IA/ML. Il est basé à Bruxelles et travaille en étroite collaboration avec des clients du monde entier qui cherchent à adopter les technologies d'apprentissage automatique Low-Code/No-Code et l'IA générative. Il est développeur depuis qu'il est très jeune, commençant à coder à l'âge de 7 ans. Il a commencé à apprendre l'IA/ML à l'université et en est depuis tombé amoureux.

David Gallitelli est un architecte de solutions spécialisé senior pour l'IA/ML. Il est basé à Bruxelles et travaille en étroite collaboration avec des clients du monde entier qui cherchent à adopter les technologies d'apprentissage automatique Low-Code/No-Code et l'IA générative. Il est développeur depuis qu'il est très jeune, commençant à coder à l'âge de 7 ans. Il a commencé à apprendre l'IA/ML à l'université et en est depuis tombé amoureux.

Dan Sinnreich est chef de produit senior chez AWS, contribuant à démocratiser l'apprentissage automatique low-code/no-code. Avant AWS, Dan a créé et commercialisé des plates-formes SaaS d'entreprise et des modèles de séries chronologiques utilisés par les investisseurs institutionnels pour gérer les risques et construire des portefeuilles optimaux. En dehors du travail, on le trouve en train de jouer au hockey, de faire de la plongée sous-marine et de lire de la science-fiction.

Dan Sinnreich est chef de produit senior chez AWS, contribuant à démocratiser l'apprentissage automatique low-code/no-code. Avant AWS, Dan a créé et commercialisé des plates-formes SaaS d'entreprise et des modèles de séries chronologiques utilisés par les investisseurs institutionnels pour gérer les risques et construire des portefeuilles optimaux. En dehors du travail, on le trouve en train de jouer au hockey, de faire de la plongée sous-marine et de lire de la science-fiction.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/announcing-support-for-llama-2-models-and-streaming-responses-in-amazon-sagemaker-canvas/

- :possède

- :est

- :où

- $UP

- 100

- 13

- 2021

- 7

- 70

- a

- capacité

- A Propos

- au dessus de

- Compte

- atteindre

- Supplémentaire

- adopter

- progrès

- encore

- à opposer à

- âge

- AI

- Modèles AI

- Alimenté par l'IA

- AI / ML

- Tous

- permet

- incroyable

- Amazon

- Amazon Sage Maker

- Toile Amazon SageMaker

- Amazon Web Services

- parmi

- montant

- an

- et les

- Annoncer

- Annoncer

- réponses

- tous

- appli

- Application

- applications

- SONT

- autour

- AS

- Assistante gérante

- At

- précaution

- disponibles

- en évitant

- AWS

- basé

- BE

- était

- ci-dessous

- avantages.

- LES MEILLEURS

- Améliorée

- plus gros

- Milliards

- Blog

- apporter

- Bruxelles

- construire

- Développement

- construit

- la performance des entreprises

- by

- CAN

- la toile

- capacités

- aptitude

- capable

- maisons

- cas

- Canaux centraux

- globaux

- des charges

- le chat

- Chatbot

- vérifier

- Selectionnez

- choose

- étroitement

- code

- COHÉRENT

- combiné

- Commun

- Communautés

- Société

- comparable

- comparer

- par rapport

- comparaisons

- considérant

- cohérent

- construire

- contact

- centre de contact

- contenu

- Génération de contenu

- continue

- Conversation

- conversations

- Prix

- engendrent

- crée des

- Clients

- En investissant dans une technologie de pointe, les restaurants peuvent non seulement rester compétitifs dans un marché en constante évolution, mais aussi améliorer significativement l'expérience de leurs clients.

- profond

- plongée profonde

- démocratiser

- déployer

- développé

- Développeur

- différent

- discuter

- plongeon

- plongée

- do

- INSTITUTIONNELS

- chacun

- Efficace

- efficace

- vous accompagner

- permettre

- permettant

- engageant

- améliorée

- améliorer

- jouir

- Entreprise

- évaluer

- tout le monde

- excité

- passionnant

- existant

- d'experience

- explorez

- extrait

- Déchu

- plus rapide

- Fonctionnalité

- Fonctionnalités:

- Réactions

- Fiction

- Trouvez

- fits

- flux

- Pour

- formulaire

- trouvé

- Fondation

- Français

- De

- Genai

- généralement

- générateur

- génération

- génératif

- IA générative

- obtenez

- globe

- Objectifs

- Vous avez

- he

- vous aider

- aider

- ici

- augmentation

- très

- organisé

- heure

- Comment

- Cependant

- HTTPS

- Immédiat

- amélioré

- améliore

- in

- increased

- d'information

- contribution

- idées.

- instance

- instantané

- DOCUMENTS

- investisseurs institutionnels

- l'intégration

- interagir

- interactions

- Interactif

- interactivité

- Interfaces

- développement

- Introduction

- intuitif

- Investisseurs

- IT

- SES

- jpg

- ACTIVITES

- langue

- gros

- Latence

- Nouveautés

- Dernières mises à jour

- lancer

- conduisant

- APPRENTISSAGE

- apprentissage

- Gamme

- Flamme

- enregistrer

- enregistrement

- recherchez-

- love

- click

- machine learning

- a prendre une

- Fabrication

- gérer

- manager

- manière

- significative

- veux dire

- Menu

- Meta

- ML

- modèle

- numériques jumeaux (digital twin models)

- PLUS

- en mouvement

- nativement

- Nature

- NAVIGUER

- Besoin

- Nouveauté

- Notes

- maintenant

- nombre

- of

- Offres Speciales

- on

- une fois

- ONE

- ouvert

- open source

- optimaux

- or

- Autre

- nos

- ande

- sortie

- au contrôle

- global

- propre

- page

- paramètres

- /

- Effectuer

- performant

- performances

- effectuer

- image

- plateforme

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- portefeuilles

- Post

- Poteaux

- solide

- précédent

- établissement des prix

- Modèle de prix

- Problème

- Produit

- chef de produit

- projets

- fournir

- fournit

- question

- gamme

- en cours

- réal

- en temps réel

- recevoir

- reçu

- recevoir

- Recommandation

- reportez-vous

- reflète

- libérer

- de Presse

- Signalé

- demandes

- a besoin

- Resources

- réponse

- réponses

- sensible

- plus riche

- Analyse

- SaaS.

- sagemaker

- même

- client

- Évolutivité

- Escaliers intérieurs

- Sciences

- Science-fiction

- fluide

- sur le lien

- Sélectionner

- la sélection

- envoyer

- supérieur

- service

- Services

- devrait

- montrer

- montré

- significative

- depuis

- unique

- faibles

- So

- Solutions

- Résout

- Identifier

- spécialiste

- Démarrage

- j'ai commencé

- Commencez

- state-of-the-art

- simple

- courant

- streaming

- streaming

- tel

- résumé

- Support

- Les soutiens

- sûr

- combustion propre

- Prenez

- tâches

- Les technologies

- tester

- Merci

- qui

- Le

- leur

- Les

- se

- puis

- donc

- Ces

- this

- trois

- ravi

- débit

- fiable

- fois

- à

- aujourd'hui

- jeton

- Twice

- deux

- ui

- université

- Actualités

- Utilisation

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- Expérience utilisateur

- utilisateurs

- en utilisant

- variété

- la versatilité

- très

- Salle de conférence virtuelle

- assistant virtuel

- Visiter

- visuel

- attendez

- souhaitez

- veut

- était

- Façon..

- we

- web

- services Web

- WELL

- qui

- large

- Large gamme

- sera

- comprenant

- sans

- activités principales

- workflows

- vos contrats

- écrire

- écriture

- Vous n'avez

- jeune

- Votre

- zéphyrnet