Ce message est co-écrit par Jyoti Sharma et Sharmo Sarkar de Vericast.

Pour tout problème d'apprentissage automatique (ML), le scientifique des données commence par travailler avec des données. Cela comprend la collecte, l'exploration et la compréhension des aspects commerciaux et techniques des données, ainsi que l'évaluation de toutes les manipulations qui peuvent être nécessaires pour le processus de construction du modèle. L'un des aspects de cette préparation des données est l'ingénierie des fonctionnalités.

Ingénierie des fonctionnalités fait référence au processus où les variables pertinentes sont identifiées, sélectionnées et manipulées pour transformer les données brutes en formes plus utiles et utilisables à utiliser avec l'algorithme ML utilisé pour former un modèle et effectuer une inférence par rapport à celui-ci. L'objectif de ce processus est d'augmenter les performances de l'algorithme et du modèle prédictif qui en résulte. Le processus d'ingénierie des fonctionnalités comprend plusieurs étapes, notamment la création de fonctionnalités, la transformation de données, l'extraction de fonctionnalités et la sélection de fonctionnalités.

La création d'une plate-forme pour l'ingénierie des fonctionnalités généralisées est une tâche courante pour les clients qui doivent produire de nombreux modèles ML avec des ensembles de données différents. Ce type de plate-forme comprend la création d'un processus piloté par programme pour produire des données d'ingénierie finalisées prêtes pour la formation de modèles avec peu d'intervention humaine. Cependant, la généralisation de l'ingénierie des fonctionnalités est un défi. Chaque problème métier est différent, chaque ensemble de données est différent, les volumes de données varient énormément d'un client à l'autre, et la qualité des données et souvent la cardinalité d'une certaine colonne (dans le cas de données structurées) peuvent jouer un rôle important dans la complexité de l'ingénierie des fonctionnalités. processus. De plus, la nature dynamique des données d'un client peut également entraîner une grande variation du temps de traitement et des ressources nécessaires pour compléter de manière optimale l'ingénierie des fonctionnalités.

Client AWS Véricast est une société de solutions marketing qui prend des décisions basées sur les données pour augmenter le retour sur investissement marketing de ses clients. La plate-forme d'apprentissage automatique basée sur le cloud de Vericast, construite autour du processus CRISP-ML(Q), utilise divers services AWS, notamment Amazon Sage Maker, Traitement d'Amazon SageMaker, AWS Lambdaet une Fonctions d'étape AWS, pour produire les meilleurs modèles possibles adaptés aux données spécifiques du client. Cette plate-forme vise à capturer la répétabilité des étapes qui entrent dans la construction de divers flux de travail ML et à les regrouper dans des modules de flux de travail généralisables standard au sein de la plate-forme.

Dans cet article, nous partageons comment Vericast a optimisé l'ingénierie des fonctionnalités à l'aide du traitement SageMaker.

Vue d'ensemble de la solution

La plate-forme d'apprentissage automatique de Vericast facilite le déploiement plus rapide de nouveaux modèles commerciaux basés sur les flux de travail existants ou l'activation plus rapide des modèles existants pour les nouveaux clients. Par exemple, un modèle prédisant la propension au publipostage est assez différent d'un modèle prédisant la sensibilité aux coupons de réduction des clients d'un client Vericast. Ils résolvent différents problèmes commerciaux et ont donc différents scénarios d'utilisation dans une conception de campagne marketing. Mais d'un point de vue ML, les deux peuvent être interprétés comme des modèles de classification binaires et pourraient donc partager de nombreuses étapes communes du point de vue du flux de travail ML, y compris le réglage et la formation du modèle, l'évaluation, l'interprétabilité, le déploiement et l'inférence.

Parce que ces modèles sont des problèmes de classification binaires (en termes de ML), nous séparons les clients d'une entreprise en deux classes (binaires) : ceux qui répondraient positivement à la campagne et ceux qui ne le feraient pas. De plus, ces exemples sont considérés comme une classification déséquilibrée car les données utilisées pour former le modèle ne contiendraient pas un nombre égal de clients qui répondraient favorablement et non.

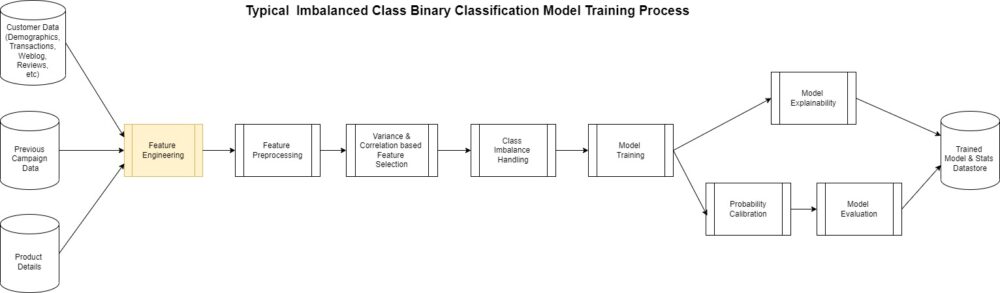

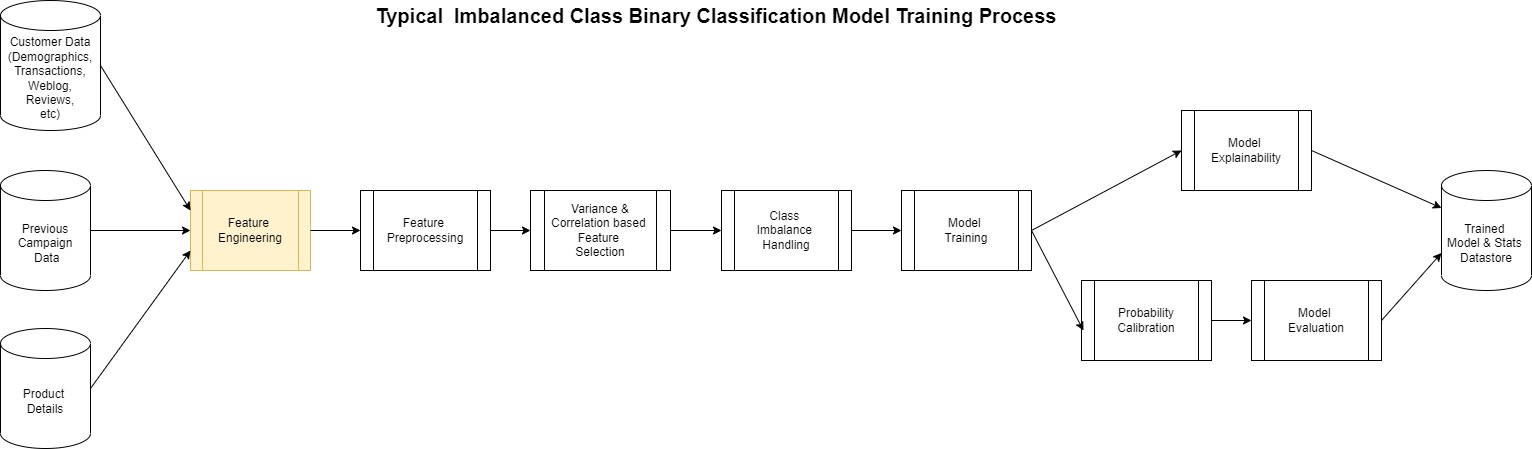

La création réelle d'un modèle tel que celui-ci suit le modèle généralisé illustré dans le diagramme suivant.

La majeure partie de ce processus est la même pour toute classification binaire, à l'exception de l'étape d'ingénierie des fonctionnalités. C'est peut-être l'étape la plus compliquée mais parfois négligée du processus. Les modèles ML dépendent largement des fonctionnalités utilisées pour les créer.

La plate-forme d'apprentissage automatique cloud native de Vericast vise à généraliser et à automatiser les étapes d'ingénierie des fonctionnalités pour divers flux de travail ML et à optimiser leurs performances sur une métrique de coût par rapport au temps en utilisant les fonctionnalités suivantes :

- La bibliothèque d'ingénierie de fonctionnalités de la plateforme – Il s'agit d'un ensemble de transformations en constante évolution qui ont été testées pour produire des fonctionnalités généralisables de haute qualité basées sur des concepts clients spécifiques (par exemple, les données démographiques des clients, les détails des produits, les détails des transactions, etc.).

- Optimiseurs de ressources intelligents – La plate-forme utilise la capacité d'infrastructure à la demande d'AWS pour créer le type de ressources de traitement le plus optimal pour le travail d'ingénierie de fonctionnalités particulier en fonction de la complexité attendue de l'étape et de la quantité de données qu'elle doit traiter.

- Mise à l'échelle dynamique des tâches d'ingénierie des fonctionnalités – Une combinaison de divers services AWS est utilisée pour cela, mais plus particulièrement SageMaker Processing. Cela garantit que la plate-forme produit des fonctionnalités de haute qualité de manière rentable et rapide.

Cet article se concentre sur le troisième point de cette liste et montre comment réaliser une mise à l'échelle dynamique des tâches de traitement SageMaker pour obtenir un cadre de traitement des données plus géré, plus performant et plus rentable pour les gros volumes de données.

Le traitement SageMaker active les charges de travail qui exécutent des étapes pour le prétraitement ou le post-traitement des données, l'ingénierie des fonctionnalités, la validation des données et l'évaluation des modèles sur SageMaker. Il fournit également un environnement géré et supprime la complexité du travail lourd indifférencié requis pour configurer et maintenir l'infrastructure nécessaire pour exécuter les charges de travail. De plus, SageMaker Processing fournit une interface API pour l'exécution, la surveillance et l'évaluation de la charge de travail.

L'exécution des tâches de traitement SageMaker s'effectue entièrement au sein d'un cluster SageMaker géré, avec des tâches individuelles placées dans des conteneurs d'instance au moment de l'exécution. Le cluster, les instances et les conteneurs gérés transmettent des métriques à Amazon Cloud Watch, y compris l'utilisation du GPU, du CPU, de la mémoire, de la mémoire GPU, des métriques de disque et de la journalisation des événements.

Ces fonctionnalités offrent des avantages aux ingénieurs de données et aux scientifiques de Vericast en aidant au développement de flux de travail de prétraitement généralisés et en éliminant la difficulté de maintenir les environnements générés dans lesquels les exécuter. Cependant, des problèmes techniques peuvent survenir compte tenu de la nature dynamique des données et de leurs caractéristiques variées qui peuvent être introduites dans une solution aussi générale. Le système doit faire une estimation initiale éclairée de la taille du cluster et des instances qui le composent. Cette estimation doit évaluer les critères des données et déduire les exigences en matière de CPU, de mémoire et de disque. Cette supposition peut être tout à fait appropriée et fonctionner de manière adéquate pour le travail, mais dans d'autres cas, ce n'est peut-être pas le cas. Pour un jeu de données et une tâche de prétraitement donnés, le processeur peut être sous-dimensionné, ce qui entraîne des performances de traitement maximales et des temps d'exécution longs. Pire encore, la mémoire pourrait devenir un problème, entraînant soit des performances médiocres, soit des événements de manque de mémoire entraînant l'échec de l'ensemble du travail.

Avec ces obstacles techniques à l'esprit, Vericast a décidé de créer une solution. Ils devaient rester de nature générale et s'intégrer dans l'image plus large du flux de travail de prétraitement en étant flexible dans les étapes impliquées. Il était également important de résoudre à la fois le besoin potentiel d'augmenter l'environnement dans les cas où les performances étaient compromises et de se remettre en douceur d'un tel événement ou lorsqu'un travail se terminait prématurément pour une raison quelconque.

La solution conçue par Vericast pour résoudre ce problème utilise plusieurs services AWS travaillant ensemble pour atteindre leurs objectifs commerciaux. Il a été conçu pour redémarrer et mettre à l'échelle le cluster SageMaker Processing en fonction des métriques de performances observées à l'aide des fonctions Lambda surveillant les tâches. Pour ne pas perdre de travail lorsqu'un événement de mise à l'échelle se produit ou pour récupérer d'un arrêt inattendu d'une tâche, un service basé sur des points de contrôle a été mis en place qui utilise Amazon DynamoDB et stocke les données partiellement traitées dans Service de stockage simple Amazon (Amazon S3) à mesure que les étapes sont terminées. Le résultat final est une solution à mise à l'échelle automatique, robuste et surveillée dynamiquement.

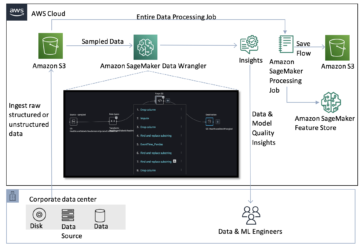

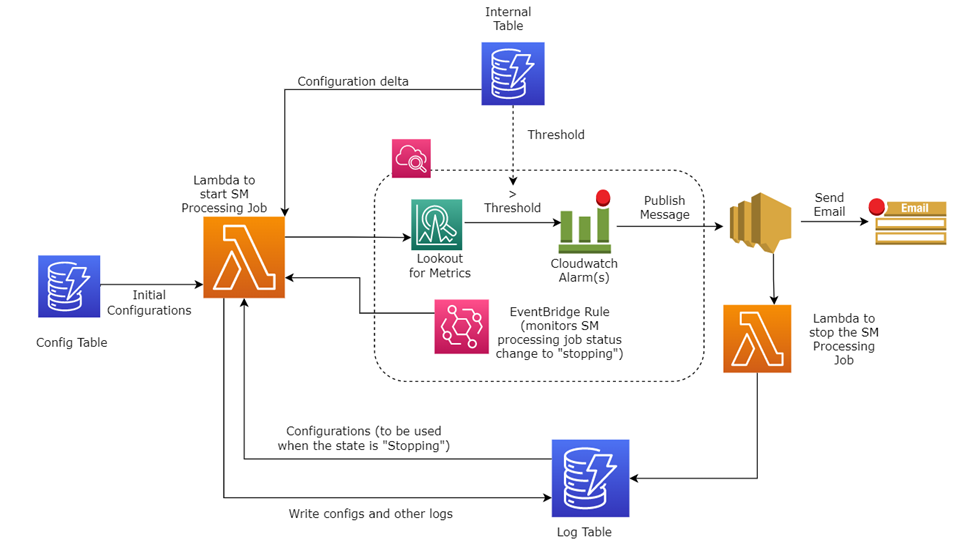

Le diagramme suivant montre une vue d'ensemble de haut niveau du fonctionnement du système.

Dans les sections suivantes, nous discutons plus en détail des composants de la solution.

Initialisation de la solution

Le système suppose qu'un processus distinct lance la solution. À l'inverse, cette conception n'est pas conçue pour fonctionner seule, car elle ne génère aucun artefact ni aucune sortie, mais agit plutôt comme une implémentation parallèle à l'un des systèmes qui utilisent les tâches de traitement SageMaker. Dans le cas de Vericast, la solution est initiée au moyen d'un appel à partir d'une étape Step Functions démarrée dans un autre module du système plus large.

Une fois la solution lancée et une première exécution déclenchée, une configuration standard de base est lue à partir d'une table DynamoDB. Cette configuration est utilisée pour définir les paramètres du travail de traitement SageMaker et contient les hypothèses initiales des besoins en infrastructure. La tâche de traitement SageMaker est maintenant lancée.

Surveillance des métadonnées et de la sortie

Lorsque la tâche démarre, une fonction Lambda écrit les métadonnées de traitement de la tâche (la configuration actuelle de la tâche et d'autres informations de journal) dans la table de journal DynamoDB. Ces métadonnées et informations de journal conservent un historique de la tâche, sa configuration initiale et en cours, ainsi que d'autres données importantes.

À certains moments, au fur et à mesure que les étapes se terminent dans la tâche, les données de point de contrôle sont ajoutées à la table de journal DynamoDB. Les données de sortie traitées sont déplacées vers Amazon S3 pour une récupération rapide si nécessaire.

Cette fonction Lambda configure également un Amazon Event Bridge règle qui surveille l'état de la tâche en cours d'exécution. Plus précisément, cette règle surveille la tâche pour observer si l'état de la tâche passe à stopping ou est dans un stopped État. Cette règle EventBridge joue un rôle important dans le redémarrage d'une tâche en cas d'échec ou d'événement de mise à l'échelle automatique planifié.

Surveillance des métriques CloudWatch

La fonction Lambda définit également une alarme CloudWatch basée sur une expression mathématique de métrique sur la tâche de traitement, qui surveille les métriques de toutes les instances pour l'utilisation du processeur, l'utilisation de la mémoire et l'utilisation du disque. Ce type d'alarme (métrique) utilise les seuils d'alarme CloudWatch. L'alarme génère des événements basés sur la valeur de la métrique ou de l'expression relative aux seuils sur un certain nombre de périodes.

Dans le cas d'utilisation de Vericast, l'expression de seuil est conçue pour considérer les instances de pilote et d'exécuteur comme distinctes, avec des métriques surveillées individuellement pour chacune. En les séparant, Vericast sait qui est à l'origine de l'alarme. Ceci est important pour décider comment mettre à l'échelle en conséquence :

- Si les métriques de l'exécuteur dépassent le seuil, il est bon de mettre à l'échelle horizontalement

- Si les métriques du pilote franchissent le seuil, la mise à l'échelle horizontale n'aidera probablement pas, nous devons donc mettre à l'échelle verticalement

Expression des métriques d'alarme

Vericast peut accéder aux métriques suivantes dans son évaluation de la mise à l'échelle et de l'échec :

- Utilisation du processeur - La somme de l'utilisation de chaque cœur de processeur individuel

- Utilisation de la mémoire – Le pourcentage de mémoire utilisé par les conteneurs sur une instance

- Utilisation du disque – Le pourcentage d'espace disque utilisé par les conteneurs sur une instance

- Utilisation du GPU – Le pourcentage d'unités GPU utilisées par les conteneurs sur une instance

- Utilisation de la mémoire GPU – Le pourcentage de mémoire GPU utilisé par les conteneurs sur une instance

Au moment d'écrire ces lignes, Vericast ne considère que CPUUtilization, MemoryUtilizationet une DiskUtilization. À l'avenir, ils entendent envisager GPUUtilization ainsi que GPUMemoryUtilization également.

Le code suivant est un exemple d'alarme CloudWatch basée sur une expression mathématique de métrique pour la mise à l'échelle automatique de Vericast :

Cette expression illustre que l'alarme CloudWatch considère DriverMemoryUtilization (memoryDriver), CPUUtilization (cpuDriver), DiskUtilization (diskDriver), ExecutorMemoryUtilization (memoryExec), CPUUtilization (cpuExec)et une DiskUtilization (diskExec) comme indicateurs de suivi. Le nombre 80 dans l'expression précédente représente la valeur seuil.

Ici, IF((cpuDriver) > 80, 1, 0 implique que si l'utilisation du processeur du pilote dépasse 80 %, 1 est attribué comme seuil, sinon 0. IF(AVG(METRICS("memoryExec")) > 80, 1, 0 implique que toutes les métriques avec une chaîne memoryExec y sont pris en compte et une moyenne est calculée sur celle-ci. Si ce pourcentage moyen d'utilisation de la mémoire dépasse 80, 1 est attribué comme seuil, sinon 0.

L'opérateur logique OR est utilisé dans l'expression pour unifier toutes les utilisations dans l'expression. Si l'une des utilisations atteint son seuil, déclenche l'alarme.

Pour plus d'informations sur l'utilisation des alarmes de métrique CloudWatch basées sur des expressions mathématiques de métrique, reportez-vous à Création d'une alarme CloudWatch basée sur une expression mathématique de métrique.

Limitations des alarmes CloudWatch

CloudWatch limite le nombre de métriques par alarme à 10. Cela peut entraîner des limitations si vous devez prendre en compte plus de métriques que cela.

Pour surmonter cette limitation, Vericast a défini des alarmes en fonction de la taille globale du cluster. Une alarme est créée pour trois instances (pour trois instances, il y aura une alarme car cela ajouterait jusqu'à neuf métriques). En supposant que l'instance de pilote doit être considérée séparément, une autre alarme distincte est créée pour l'instance de pilote. Par conséquent, le nombre total d'alarmes créées est à peu près équivalent à un tiers du nombre de nœuds exécuteurs et un supplémentaire pour l'instance de pilote. Dans chaque cas, le nombre de métriques par alarme est inférieur à la limite de 10 métriques.

Que se passe-t-il en état d'alarme

Si un seuil prédéterminé est atteint, l'alarme passe à un alarm État, qui utilise Service de notification simple d'Amazon (Amazon SNS) pour envoyer des notifications. Dans ce cas, il envoie une notification par e-mail à tous les abonnés avec les détails de l'alarme dans le message.

Amazon SNS est également utilisé comme déclencheur d'une fonction Lambda qui arrête la tâche de traitement SageMaker en cours d'exécution, car nous savons que la tâche échouera probablement. Cette fonction enregistre également les journaux dans la table des journaux liés à l'événement.

La règle EventBridge configurée au démarrage de la tâche remarquera que la tâche est entrée dans une stopping déclarer quelques secondes plus tard. Cette règle réexécute ensuite la première fonction Lambda pour redémarrer la tâche.

Le processus de mise à l'échelle dynamique

La première fonction Lambda après avoir été exécutée deux fois ou plus saura qu'une tâche précédente avait déjà démarré et qu'elle s'est maintenant arrêtée. La fonction passera par un processus similaire d'obtention de la configuration de base à partir de la tâche d'origine dans la table de journal DynamoDB et récupérera également la configuration mise à jour à partir de la table interne. Cette configuration mise à jour est une configuration delta de ressources qui est définie en fonction du type de mise à l'échelle. Le type de mise à l'échelle est déterminé à partir des métadonnées d'alarme comme décrit précédemment.

La configuration d'origine plus le delta des ressources sont utilisés car une nouvelle configuration et une nouvelle tâche de traitement SageMaker sont lancées avec les ressources augmentées.

Ce processus se poursuit jusqu'à ce que le travail se termine avec succès et peut entraîner plusieurs redémarrages selon les besoins, en ajoutant plus de ressources à chaque fois.

Le résultat de Vericast

Cette solution de mise à l'échelle automatique personnalisée a contribué à rendre la plate-forme d'apprentissage automatique de Vericast plus robuste et tolérante aux pannes. La plate-forme peut désormais gérer avec élégance des charges de travail de différents volumes de données avec une intervention humaine minimale.

Avant de mettre en œuvre cette solution, l'estimation des besoins en ressources pour tous les modules basés sur Spark dans le pipeline était l'un des plus gros goulots d'étranglement du nouveau processus d'intégration des clients. Les flux de travail échoueraient si le volume de données client augmentait, ou le coût serait injustifiable si le volume de données diminuait en production.

Avec ce nouveau module en place, les échecs de flux de travail dus à des contraintes de ressources ont été réduits de près de 80 %. Les quelques échecs restants sont principalement dus aux contraintes du compte AWS et au-delà du processus de mise à l'échelle automatique. Le plus grand avantage de Vericast avec cette solution est la facilité avec laquelle ils peuvent intégrer de nouveaux clients et flux de travail. Vericast s'attend à accélérer le processus d'au moins 60 à 70 %, les données devant encore être collectées pour un chiffre final.

Bien que cela soit considéré comme un succès par Vericast, cela a un coût. Sur la base de la nature de ce module et du concept de mise à l'échelle dynamique dans son ensemble, les flux de travail ont tendance à prendre environ 30 % plus de temps (cas moyen) qu'un flux de travail avec un cluster personnalisé pour chaque module du flux de travail. Vericast continue d'optimiser dans ce domaine, cherchant à améliorer la solution en incorporant l'initialisation des ressources basée sur l'heuristique pour chaque module client.

Sharmo Sarkar, Senior Manager, Machine Learning Platform chez Vericast, déclare : « Alors que nous continuons à étendre notre utilisation d'AWS et de SageMaker, je voulais prendre un moment pour souligner le travail incroyable de notre équipe AWS Client Services, des architectes de solutions AWS dédiés, et les services professionnels AWS avec lesquels nous travaillons. Leur compréhension approfondie d'AWS et de SageMaker nous a permis de concevoir une solution qui répondait à tous nos besoins et nous a fourni la flexibilité et l'évolutivité dont nous avions besoin. Nous sommes très reconnaissants d'avoir une équipe de soutien aussi talentueuse et compétente à nos côtés.

Conclusion

Dans cet article, nous avons expliqué comment SageMaker et SageMaker Processing ont permis à Vericast de créer une infrastructure de traitement de données gérée, performante et rentable pour les gros volumes de données. En combinant la puissance et la flexibilité de SageMaker Processing avec d'autres services AWS, ils peuvent facilement surveiller le processus généralisé d'ingénierie des fonctionnalités. Ils peuvent détecter automatiquement les problèmes potentiels générés par le manque de calcul, de mémoire et d'autres facteurs, et implémenter automatiquement la mise à l'échelle verticale et horizontale selon les besoins.

SageMaker et ses outils peuvent également aider votre équipe à atteindre ses objectifs de ML. Pour en savoir plus sur le traitement SageMaker et sur la manière dont il peut vous aider dans vos charges de travail de traitement de données, reportez-vous à Données de processus. Si vous débutez avec le ML et que vous recherchez des exemples et des conseils, Amazon SageMaker JumpStart peut vous aider à démarrer. JumpStart est un hub ML à partir duquel vous pouvez accéder à des algorithmes intégrés avec des modèles de base pré-formés pour vous aider à effectuer des tâches telles que la synthèse d'articles et la génération d'images et des solutions prédéfinies pour résoudre des cas d'utilisation courants.

Enfin, si cet article vous aide ou vous inspire pour résoudre un problème, nous serions ravis d'en entendre parler ! S'il vous plaît partager vos commentaires et vos commentaires.

À propos des auteurs

Anthony McClure est un architecte de solutions partenaire principal au sein de l'équipe AWS SaaS Factory. Anthony a également un vif intérêt pour l'apprentissage automatique et l'intelligence artificielle en travaillant avec la communauté de terrain technique AWS ML/AI pour aider les clients à concrétiser leurs solutions d'apprentissage automatique.

Anthony McClure est un architecte de solutions partenaire principal au sein de l'équipe AWS SaaS Factory. Anthony a également un vif intérêt pour l'apprentissage automatique et l'intelligence artificielle en travaillant avec la communauté de terrain technique AWS ML/AI pour aider les clients à concrétiser leurs solutions d'apprentissage automatique.

Jyoti Sharma est un ingénieur en science des données au sein de l'équipe de la plateforme d'apprentissage automatique chez Vericast. Elle est passionnée par tous les aspects de la science des données et se concentre sur la conception et la mise en œuvre d'une plateforme d'apprentissage automatique hautement évolutive et distribuée.

Jyoti Sharma est un ingénieur en science des données au sein de l'équipe de la plateforme d'apprentissage automatique chez Vericast. Elle est passionnée par tous les aspects de la science des données et se concentre sur la conception et la mise en œuvre d'une plateforme d'apprentissage automatique hautement évolutive et distribuée.

Sharmo Sarkar est cadre supérieur chez Vericast. Il dirige les équipes de R&D Cloud Machine Learning Platform et Marketing Platform ML chez Vericast. Il possède une vaste expérience dans l'analyse des mégadonnées, l'informatique distribuée et le traitement du langage naturel. En dehors du travail, il aime faire de la moto, de la randonnée et du vélo sur les sentiers de montagne.

Sharmo Sarkar est cadre supérieur chez Vericast. Il dirige les équipes de R&D Cloud Machine Learning Platform et Marketing Platform ML chez Vericast. Il possède une vaste expérience dans l'analyse des mégadonnées, l'informatique distribuée et le traitement du langage naturel. En dehors du travail, il aime faire de la moto, de la randonnée et du vélo sur les sentiers de montagne.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoAiStream. Intelligence des données Web3. Connaissance Amplifiée. Accéder ici.

- Frapper l'avenir avec Adryenn Ashley. Accéder ici.

- Achetez et vendez des actions de sociétés PRE-IPO avec PREIPO®. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/how-vericast-optimized-feature-engineering-using-amazon-sagemaker-processing/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 10

- 100

- 15%

- 7

- a

- A Propos

- accès

- en conséquence

- Compte

- atteindre

- Activation

- actes

- ajouter

- ajoutée

- ajoutant

- Supplémentaire

- adéquatement

- Après

- à opposer à

- SIDA

- vise

- alarme

- algorithme

- algorithmes

- Tous

- seul

- le long de

- déjà

- aussi

- Amazon

- Amazon Sage Maker

- montant

- an

- analytique

- ainsi que

- Une autre

- Anthony

- tous

- api

- approprié

- architecture

- SONT

- Réservé

- autour

- article

- artificiel

- intelligence artificielle

- AS

- d'aspect

- aspects

- attribué

- aider

- At

- auto

- automatiser

- automatiquement

- moyen

- AWS

- Services professionnels AWS

- base

- basé

- BE

- car

- devenez

- était

- va

- avantages.

- LES MEILLEURS

- Au-delà

- Big

- Big Data

- Le plus grand

- renforcer

- tous les deux

- Apporter

- construire

- Développement

- construit

- intégré

- la performance des entreprises

- mais

- by

- calculé

- Appelez-nous

- Campagne

- CAN

- Peut obtenir

- Capturer

- maisons

- cas

- Causes

- causer

- certaines

- difficile

- Modifications

- classe

- les classes

- classification

- client

- intégration du client

- CLIENTS

- le cloud

- Grappe

- code

- Colonne

- combinaison

- combinant

- vient

- commentaires

- Commun

- Communautés

- Société

- complet

- finalise

- complexité

- compliqué

- composants électriques

- Compromise

- calcul

- informatique

- concept

- concepts

- configuration

- Considérer

- considéré

- considérant

- considère

- contraintes

- contiennent

- Conteneurs

- continuer

- continue

- Prix

- rentable

- pourriez

- coupon

- engendrent

- créée

- création

- critères

- Cross

- Courant

- Lecture

- Customiser

- des clients

- Clients

- données

- Analyse de Donnée

- Préparation des données

- informatique

- science des données

- Data Scientist

- data-driven

- ensembles de données

- décider

- décisions

- dévoué

- profond

- Delta

- Démographie

- dépendant

- déploiement

- décrit

- Conception

- un

- conception

- détail

- détails

- déterminé

- Développement

- différent

- différent

- Difficulté

- La remise

- discuter

- distribué

- informatique distribuée

- entraîné

- driver

- deux

- Dynamic

- dynamiquement

- chacun

- Plus tôt

- facilité

- même

- non plus

- activé

- permet

- ingénieur

- ENGINEERING

- Les ingénieurs

- Assure

- Tout

- Environment

- environnements

- égal

- Équivalent

- évaluer

- évaluer

- évaluation

- événement

- événements

- exemple

- exemples

- Sauf

- existant

- Développer vous

- attendu

- attend

- d'experience

- Explorer

- expressions

- les

- Une vaste expérience

- facteurs

- PERSONNEL

- FAIL

- Échec

- Fonctionnalité

- Fonctionnalités:

- Fed

- Réactions

- few

- champ

- finale

- Finalisé

- Prénom

- s'adapter

- Flexibilité

- flexible

- concentré

- Abonnement

- suit

- Pour

- document

- Fondation

- Framework

- De

- d’étiquettes électroniques entièrement

- fonction

- fonctions

- En outre

- avenir

- rassemblement

- Général

- généré

- génère

- génération

- obtenez

- obtention

- donné

- Go

- objectif

- Objectifs

- Goes

- Bien

- GPU

- reconnaissant

- l'orientation

- ait eu

- manipuler

- arrive

- Vous avez

- ayant

- he

- entendre

- lourd

- levage de charges lourdes

- vous aider

- aide

- de haut niveau

- de haute qualité

- Souligner

- très

- Histoire

- Horizontal

- horizontalement

- Comment

- How To

- Cependant

- HTML

- http

- HTTPS

- Moyeu

- humain

- Haies

- i

- identifié

- if

- illustre

- image

- Mettre en oeuvre

- la mise en oeuvre

- la mise en œuvre

- important

- améliorer

- in

- Dans d'autres

- inclut

- Y compris

- incorporation

- Améliore

- increased

- l'incroyable

- individuel

- Individuellement

- d'information

- Infrastructure

- initiale

- Initie

- instance

- instrumental

- Intelligence

- l'intention

- intérêt

- Interfaces

- interne

- intervention

- développement

- impliqué

- aide

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- SES

- Emploi

- Emplois

- jpg

- juste

- Genre

- Savoir

- Peindre

- langue

- gros

- principalement

- plus importantes

- plus tard

- Conduit

- APPRENTISSAGE

- apprentissage

- au

- Bibliothèque

- lifting

- limitation

- limites

- limites

- Liste

- peu

- enregistrer

- enregistrement

- logique

- plus long

- recherchez-

- perdre

- love

- click

- machine learning

- maintenir

- Maintenir

- maintient

- a prendre une

- FAIT DU

- Fabrication

- gérés

- manager

- manipulé

- manière

- de nombreuses

- Stratégie

- math

- Mai..

- Découvrez

- Mémoire

- message

- Métadonnées

- métrique

- Métrique

- pourrait

- l'esprit

- minimal

- ML

- modèle

- numériques jumeaux (digital twin models)

- Module

- Modules

- moment

- Surveiller

- surveillé

- Stack monitoring

- moniteurs

- PLUS

- (en fait, presque toutes)

- la plupart

- Montagne

- plusieurs

- must

- Nature

- Traitement du langage naturel

- Nature

- Besoin

- nécessaire

- besoin

- Besoins

- Nouveauté

- nœuds

- notamment

- Remarquer..

- déclaration

- Notifications

- maintenant

- nombre

- objectifs

- observer

- of

- souvent

- on

- À la demande

- Débuter

- Onboarding

- ONE

- en cours

- uniquement

- opérateur

- optimaux

- Optimiser

- optimisé

- or

- original

- Autre

- nos

- ande

- Résultat

- sortie

- au contrôle

- plus de

- global

- Overcome

- vue d'ensemble

- paramètres

- partie

- particulier

- les partenaires

- En passant

- passionné

- Patron de Couture

- pourcentage

- Effectuer

- performant

- être

- périodes

- objectifs

- image

- pipeline

- Place

- prévu

- plateforme

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Jouez

- joue

- veuillez cliquer

- plus

- Point

- des notes bonus

- pauvres

- possible

- Post

- défaillances

- power

- prévoir

- précédent

- Probablement

- Problème

- d'ouvrabilité

- processus

- Traité

- traitement

- produire

- Produit

- Vidéo

- professionels

- fournir

- à condition de

- fournit

- mettre

- qualité

- Rapide

- plus rapidement

- R & D

- plutôt

- raw

- nous joindre

- Lire

- solutions

- Réalité

- raison

- Articles

- Récupérer

- récupération

- Prix Réduit

- se réfère

- en relation

- pertinent

- rester

- restant

- rapport

- conditions

- Exigences

- ressource

- Resources

- Réagir

- résultat

- résultant

- robuste

- Rôle

- grossièrement

- Règle

- Courir

- pour le running

- SaaS.

- sagemaker

- même

- dit

- Évolutivité

- évolutive

- Escaliers intérieurs

- mise à l'échelle

- Solution de mise à l'échelle

- scénarios

- Sciences

- Scientifique

- scientifiques

- secondes

- les sections

- choisi

- sélection

- envoyer

- envoie

- supérieur

- Sensibilité

- séparé

- séparation

- service

- Services

- set

- Sets

- plusieurs

- Partager

- commun

- Sharma

- elle

- montré

- Spectacles

- côté

- significative

- similaires

- étapes

- Taille

- So

- sur mesure

- Solutions

- RÉSOUDRE

- Space

- groupe de neurones

- spécifiquement

- vitesse

- Spin

- étapes

- Standard

- peuplements

- Commencer

- j'ai commencé

- départs

- Région

- Statut

- étapes

- Étapes

- Encore

- arrêté

- arrêt

- Arrête

- storage

- STORES

- Chaîne

- STRONG

- structuré

- les abonnés

- succès

- Avec succès

- tel

- Support

- combustion propre

- Système

- table

- Prenez

- prend

- talentueux

- Tâche

- tâches

- équipe

- équipes

- Technique

- conditions

- que

- qui

- La

- El futuro

- leur

- Les

- puis

- Là.

- donc

- Ces

- l'ont

- Troisièmement

- this

- ceux

- trois

- порог

- Avec

- fiable

- fois

- à

- ensemble

- les outils

- Total

- Train

- Formation

- transaction

- détails de la transaction

- Transformer

- De La Carrosserie

- transformations

- déclencher

- déclenché

- deux

- type

- débutante

- sous

- compréhension

- unités

- jusqu'à

- a actualisé

- us

- utilisable

- Utilisation

- utilisé

- cas d'utilisation

- d'utiliser

- en utilisant

- validation

- Plus-value

- divers

- vertical

- le volume

- volumes

- vs

- voulu

- était

- personne(s) regarde(nt) cette fiche produit

- Façon..

- we

- WELL

- quand

- qui

- WHO

- la totalité

- entièrement

- sera

- gagner

- comprenant

- dans les

- activités principales

- workflows

- de travail

- vos contrats

- pire

- pourra

- écriture

- encore

- Rendement

- Vous n'avez

- Votre

- zéphyrnet