Ce billet de blog est co-écrit avec Tuana Çelik de deepset.

La recherche d'entreprise est un élément essentiel de l'efficacité organisationnelle grâce à la numérisation des documents et à la gestion des connaissances. La recherche d'entreprise couvre le stockage de documents tels que les fichiers numériques, l'indexation des documents pour la recherche et la fourniture de résultats pertinents en fonction des requêtes des utilisateurs. Avec l'avènement des grands modèles de langage (LLM), nous pouvons mettre en œuvre des expériences conversationnelles en fournissant les résultats aux utilisateurs. Cependant, nous devons nous assurer que les LLM limitent les réponses aux données de l'entreprise, atténuant ainsi les hallucinations du modèle.

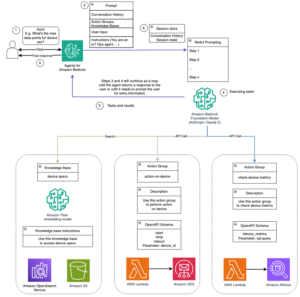

Dans cet article, nous montrons comment créer une application d'IA générative de bout en bout pour la recherche d'entreprise avec Retrieval Augmented Generation (RAG) en utilisant les pipelines Haystack et le modèle Falcon-40b-instruct de Amazon SageMaker JumpStart ainsi que Service Amazon OpenSearch. Le code source de l'exemple présenté dans cet article est disponible dans le GitHub référentiel

Vue d'ensemble de la solution

Pour limiter les réponses des applications d'IA génératives aux seules données de l'entreprise, nous devons utiliser une technique appelée Retrieval Augmented Generation (RAG). Une application utilisant l'approche RAG récupère les informations les plus pertinentes pour la demande de l'utilisateur à partir de la base de connaissances ou du contenu de l'entreprise, les regroupe en tant que contexte avec la demande de l'utilisateur en tant qu'invite, puis les envoie au LLM pour obtenir une réponse. Les LLM ont des limites concernant le nombre maximal de mots pour les invites de saisie, de sorte que le choix des bons passages parmi des milliers ou des millions de documents dans l'entreprise a un impact direct sur la précision du LLM.

La technique RAG est devenue de plus en plus importante dans la recherche d'entreprise. Dans cet article, nous montrons un flux de travail qui tire parti de SageMaker JumpStart pour déployer un modèle Falcon-40b-instruct et utilise Haystack pour concevoir et exécuter un pipeline de réponse aux questions augmentées de récupération. Le workflow d'augmentation de récupération final couvre les étapes de haut niveau suivantes :

- La requête utilisateur est utilisée pour un composant de récupération, qui effectue une recherche vectorielle, pour récupérer le contexte le plus pertinent de notre base de données.

- Ce contexte est intégré dans une invite conçue pour demander à un LLM de générer une réponse uniquement à partir du contexte fourni.

- Le LLM génère une réponse à la requête d'origine en ne tenant compte que du contexte intégré dans l'invite qu'il a reçue.

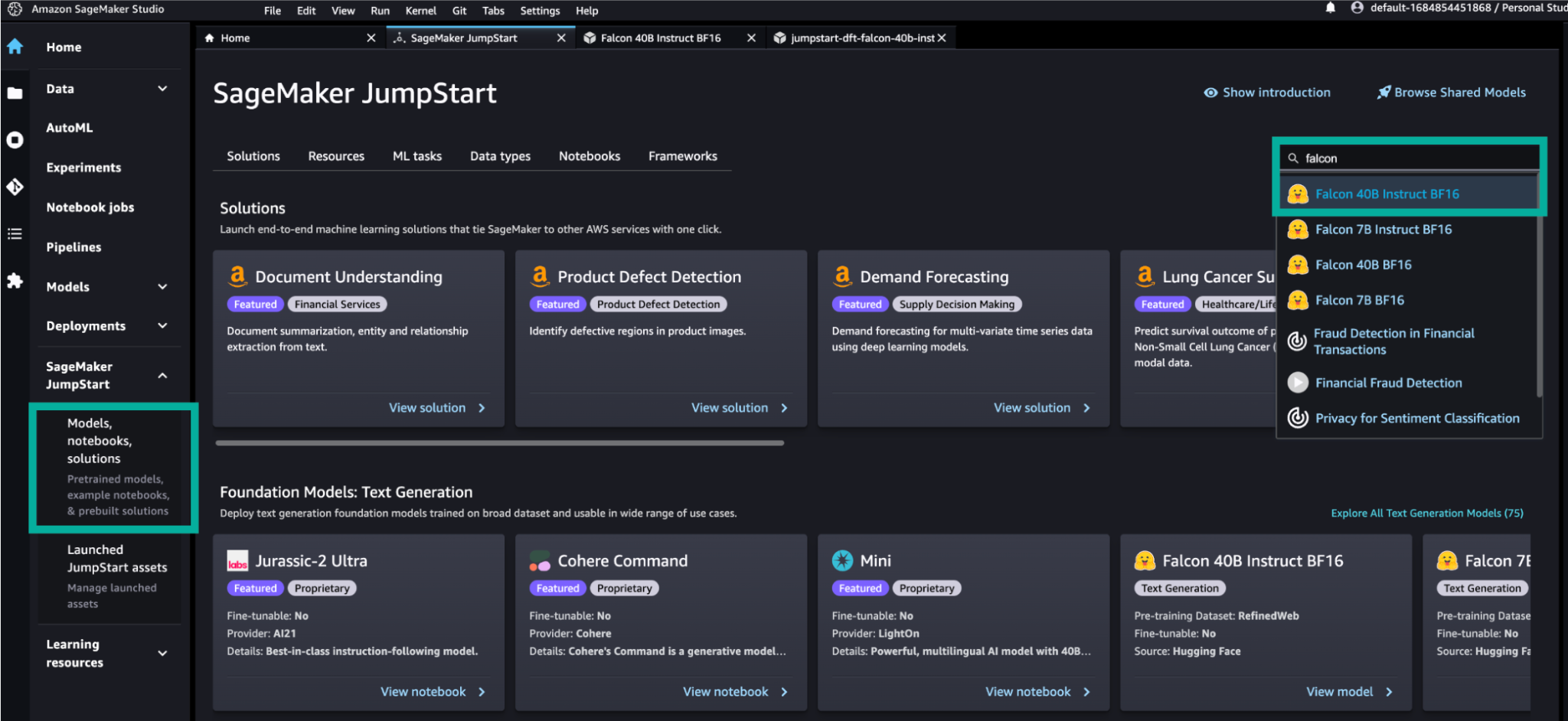

SageMaker JumpStart

SageMaker JumpStart sert de hub de modèles encapsulant un large éventail de modèles d'apprentissage en profondeur pour le texte, la vision, l'audio et l'intégration de cas d'utilisation. Avec plus de 500 modèles, son hub de modèles comprend à la fois des modèles publics et propriétaires des partenaires d'AWS tels que AI21, Stability AI, Cohere et LightOn. Il héberge également des modèles de fondation uniquement développés par Amazon, comme AlexaTM. Certains modèles vous permettent de les affiner avec vos propres données. SageMaker JumpStart fournit également des modèles de solution qui configurent l'infrastructure pour les cas d'utilisation courants et des exemples de blocs-notes exécutables pour l'apprentissage automatique (ML) avec SageMaker.

Meule de foin

Meule de foin est un framework open source par deepset qui permet aux développeurs d'orchestrer des applications LLM composées de différents composants tels que des modèles, des bases de données vectorielles, des convertisseurs de fichiers et d'innombrables autres modules. La botte de foin fournit pipelines ainsi que Agents, deux structures puissantes pour concevoir des applications LLM pour divers cas d'utilisation, notamment la recherche, la réponse aux questions et l'IA conversationnelle. En mettant l'accent sur les méthodes de récupération de pointe et sur des mesures d'évaluation solides, il vous fournit tout ce dont vous avez besoin pour livrer une application fiable et digne de confiance. Vous pouvez sérialiser les pipelines pour Fichiers YAML, les exposer via un API REST, et adaptez-les de manière flexible à vos charges de travail, ce qui facilite le passage de votre application du stade de prototype à celui de production.

Amazon OpenSearch

OpenSearch Service est un service entièrement géré qui simplifie le déploiement, la mise à l'échelle et l'exploitation d'OpenSearch dans le cloud AWS. OpenSearch est une suite logicielle open source évolutive, flexible et extensible pour les applications de recherche, d'analyse, de surveillance de la sécurité et d'observabilité, sous licence Apache 2.0.

Ces dernières années, les techniques de ML sont devenues de plus en plus populaires pour améliorer la recherche. Parmi eux figurent l'utilisation de incorporation de modèles, un type de modèle qui peut encoder un grand nombre de données dans un espace à n dimensions où chaque entité est encodée dans un vecteur, un point de données dans cet espace, et organisé de telle sorte que des entités similaires soient plus proches les unes des autres. Une base de données vectorielle fournit une recherche de similarité vectorielle efficace en fournissant des index spécialisés tels que les index k-NN.

Avec les capacités de base de données vectorielles d'OpenSearch Service, vous pouvez implémenter la recherche sémantique, le RAG avec les LLM, les moteurs de recommandation et la recherche de médias enrichis. Dans cet article, nous utilisons RAG pour nous permettre de compléter les LLM génératifs avec une base de connaissances externe qui est généralement construite à l'aide d'une base de données vectorielle hydratée avec des articles de connaissances codés en vecteur.

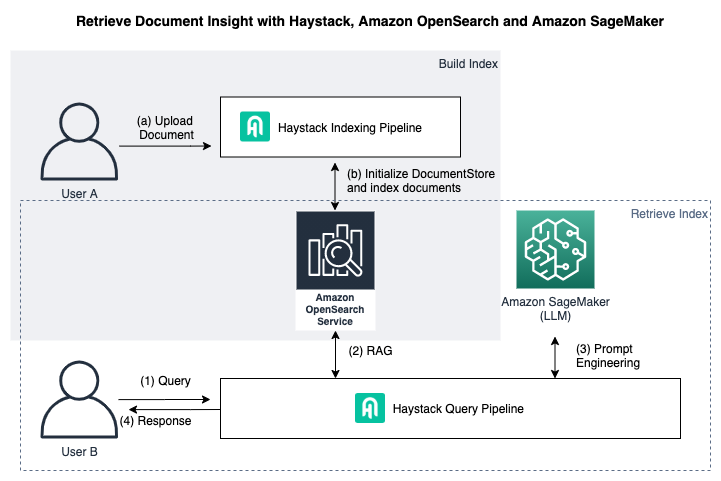

Aperçu de l'application

Le diagramme suivant illustre la structure de l'application finale.

Dans cette application, nous utilisons le pipeline d'indexation Haystack pour gérer les documents téléchargés et indexer les documents et le pipeline de requête Haystack pour effectuer la récupération des connaissances à partir des documents indexés.

Le pipeline d'indexation Haystack comprend les étapes de haut niveau suivantes :

- Téléchargez un document.

- Initialiser

DocumentStoreet indexer les documents.

Nous utilisons OpenSearch comme notre Magasin de documents et une botte de foin pipeline d'indexation pour prétraiter et indexer nos fichiers sur OpenSearch. Meule de foin Convertisseurs de fichiers ainsi que Préprocesseur vous permettent de nettoyer et de préparer vos fichiers bruts pour qu'ils soient dans une forme et un format que votre pipeline de traitement du langage naturel (NLP) et le modèle de langage de votre choix peuvent gérer. Le pipeline d'indexation que nous avons utilisé ici utilise également sentence-transformers/all-MiniLM-L12-v2 pour créer des intégrations pour chaque document, que nous utilisons pour une récupération efficace.

Le pipeline de requêtes Haystack comprend les étapes de haut niveau suivantes :

- Nous envoyons une requête au pipeline RAG.

- An IncorporationRetriever composant agit comme un filtre qui récupère le plus pertinent

top_kdocuments de nos documents indexés dans OpenSearch. Nous utilisons notre choix de modèle d'intégration pour intégrer à la fois la requête et les documents (à l'indexation) pour y parvenir. - Les documents récupérés sont intégrés dans notre invite au modèle Falcon-40b-instruct.

- Le LLM revient avec une réponse basée sur les documents récupérés.

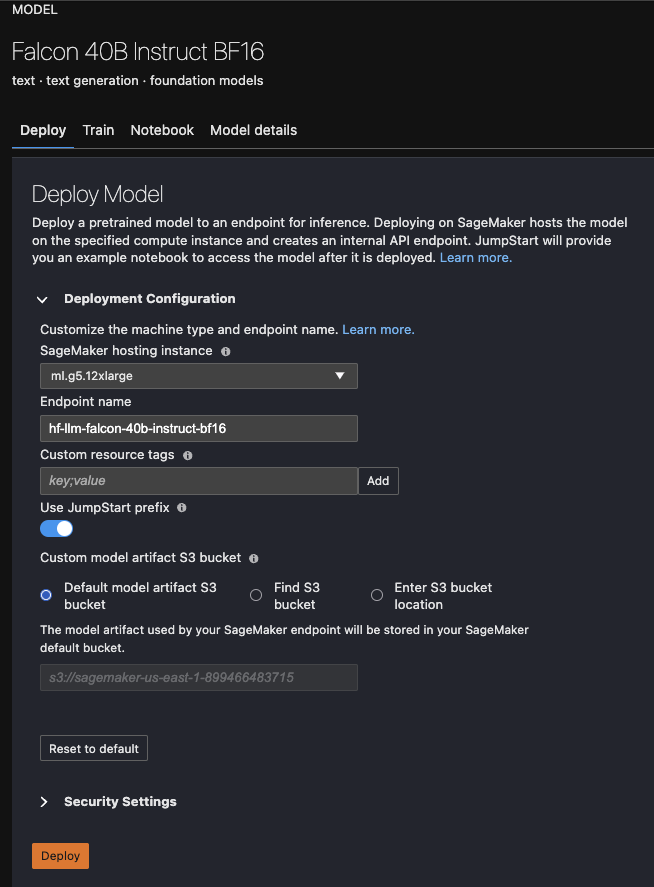

Pour le déploiement de modèles, nous utilisons SageMaker JumpStart, qui simplifie le déploiement de modèles en appuyant simplement sur un bouton. Bien que nous ayons utilisé et testé Falcon-40b-instruct pour cet exemple, vous pouvez utiliser n'importe quel modèle Hugging Face disponible sur SageMaker.

La solution finale est disponible sur le faiseur de botte de foin référentiel et utilise le site Web et la documentation d'OpenSearch (pour OpenSearch 2.7) comme exemples de données pour effectuer la récupération des réponses aux questions augmentées.

Pré-requis

La première chose à faire avant de pouvoir utiliser les services AWS est de s'assurer que nous nous sommes inscrits et avons créé un compte AWS. Ensuite, vous devez créer un utilisateur et un groupe administratifs. Pour obtenir des instructions sur les deux étapes, reportez-vous à Configurer les prérequis d'Amazon SageMaker.

Pour pouvoir utiliser le Haystack, vous devrez installer le farm-haystack package avec les dépendances requises. Pour ce faire, utilisez le requirements.txt déposer dans le GitHub référentiel en exécutant pip install requirements.txt.

Indexer des documents dans OpenSearch

Haystack propose un certain nombre de connecteurs aux bases de données, appelés DocumentStores. Pour ce flux de travail RAG, nous utilisons le OpenSearchDocumentStore. L'exemple dépôt comprend un pipeline d'indexation et AWS CloudFormation modèle mettre en place un OpenSearchDocumentStore avec des documents explorés à partir du site Web d'OpenSearch et des pages de documentation.

Souvent, pour qu'une application NLP fonctionne pour des cas d'utilisation en production, nous devons penser à la préparation et au nettoyage des données. Celui-ci est recouvert de Pipelines d'indexation Haystack, qui vous permet de concevoir vos propres étapes de préparation des données, qui écrivent finalement vos documents dans la base de données de votre choix.

Un pipeline d'indexation peut également inclure une étape pour créer des incorporations pour vos documents. Ceci est très important pour l'étape de récupération. Dans notre exemple, nous utilisons transformateurs-de-phrases/tous-MiniLM-L12-v2 comme notre modèle d'intégration. Ce modèle est utilisé pour créer des incorporations pour tous nos documents indexés, mais aussi la requête de l'utilisateur au moment de la requête.

Pour indexer des documents dans le OpenSearchDocumentStore, nous fournissons deux options avec des instructions détaillées dans le README de l'exemple de référentiel. Ici, nous passons en revue les étapes d'indexation vers un service OpenSearch déployé sur AWS.

Démarrer un service OpenSearch

Utilisez le fourni Modèle CloudFormation pour configurer un service OpenSearch sur AWS. En exécutant la commande suivante, vous aurez un service OpenSearch vide. Vous pouvez ensuite choisir d'indexer les exemples de données que nous avons fournis ou d'utiliser vos propres données, que vous pouvez nettoyer et prétraiter à l'aide de l'outil Pipeline d'indexation Haystack. Notez que cela crée une instance ouverte sur Internet, ce qui n'est pas recommandé pour une utilisation en production.

Attendez environ 30 minutes pour que le lancement de la pile se termine. Vous pouvez vérifier sa progression sur la console AWS CloudFormation en accédant au Combos page et à la recherche de la pile nommée HaystackOpensearch.

Indexer des documents dans OpenSearch

Maintenant que nous avons un service OpenSearch en cours d'exécution, nous pouvons utiliser la classe OpenSearchDocumentStore pour nous y connecter et y écrire nos documents.

Pour obtenir le nom d'hôte d'OpenSearch, exécutez la commande suivante :

Tout d'abord, exportez les éléments suivants :

Ensuite, vous pouvez utiliser le opensearch_indexing_pipeline.py script pour prétraiter et indexer les données de démonstration fournies.

Si vous souhaitez utiliser vos propres données, modifiez le pipeline d'indexation dans opensearch_indexing_pipeline.py inclure le Convertisseur de fichiers ainsi que Préprocesseur étapes de configuration dont vous avez besoin.

Mettre en œuvre le pipeline de questions-réponses augmentées de récupération

Maintenant que nous avons des données indexées dans OpenSearch, nous pouvons effectuer des questions-réponses sur ces documents. Pour ce pipeline RAG, nous utilisons le modèle Falcon-40b-instruct que nous avons déployé sur SageMaker JumpStart.

Vous avez également la possibilité de déployer le modèle par programmation à partir d'un notebook Jupyter. Pour obtenir des instructions, reportez-vous au GitHub repo.

- Recherchez le modèle Falcon-40b-instruct sur SageMaker JumpStart.

- Déployez votre modèle sur SageMaker JumpStart et notez le nom du point de terminaison.

- Exportez les valeurs suivantes :

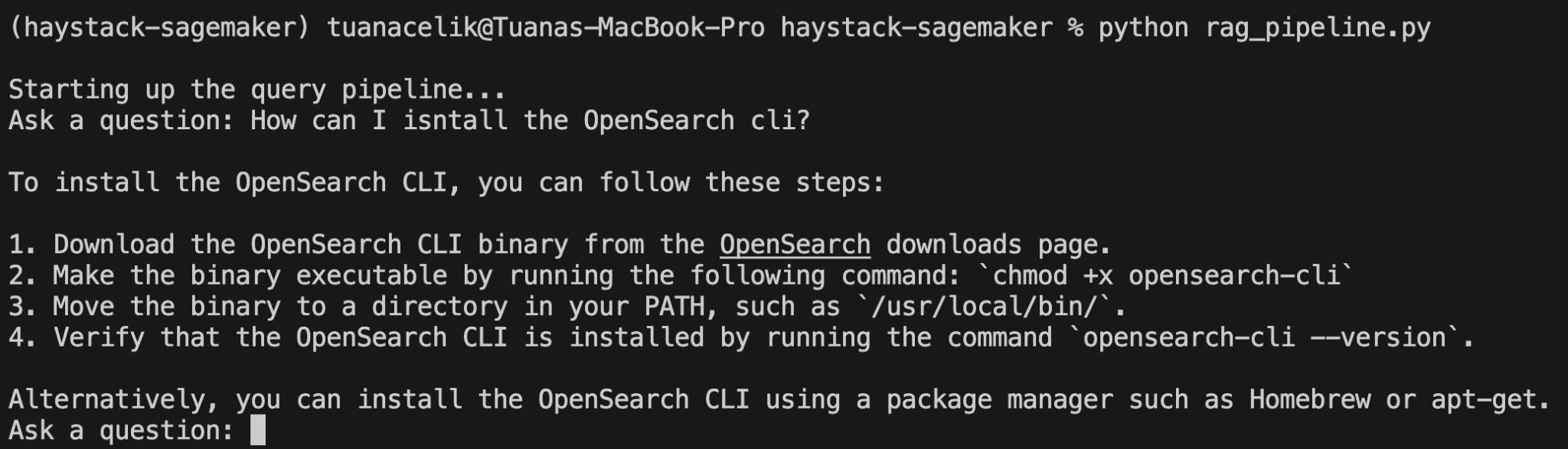

- Courir

python rag_pipeline.py.

Cela lancera un utilitaire de ligne de commande qui attend la question d'un utilisateur. Par exemple, demandons « Comment puis-je installer la CLI OpenSearch ? »

Ce résultat est obtenu parce que nous avons défini notre invite dans le Modèle d'invite de botte de foin être le suivant :

Personnalisations supplémentaires

Vous pouvez apporter des personnalisations supplémentaires à différents éléments de la solution, tels que les éléments suivants :

- Les données – Nous avons fourni l'OpenSearch Documentation ainsi que site de NDN Collective données comme données d'exemple. N'oubliez pas de modifier le

opensearch_indexing_pipeline.pyscript adapté à vos besoins si vous avez choisi d'utiliser vos propres données. - Le modèle – Dans cet exemple, nous avons utilisé le modèle Falcon-40b-instruct. Vous êtes libre de déployer et d'utiliser n'importe quel autre modèle Hugging Face sur SageMaker. Notez que la modification d'un modèle signifiera probablement que vous devez adapter votre invite à quelque chose qu'elle est conçue pour gérer.

- l'invite – Pour ce poste, nous avons créé notre propre

PromptTemplatequi demande au modèle de répondre aux questions en fonction du contexte fourni et de répondre « Je ne sais pas » si le contexte ne contient pas d'informations pertinentes. Vous pouvez modifier cette invite pour expérimenter différentes invites avec Falcon-40b-instruct. Vous pouvez également simplement extraire certaines de nos invites de la InviteHub. - Le modèle d'intégration – Pour l'étape de récupération, nous utilisons un modèle d'intégration léger : transformateurs-de-phrases/tous-MiniLM-L12-v2. Cependant, vous pouvez également modifier cela selon vos besoins. N'oubliez pas de modifier les dimensions d'encastrement attendues dans votre

DocumentStoreil se doit ! - Le nombre de documents récupérés – Vous pouvez également choisir de jouer avec le nombre de documents que vous demandez au

EmbeddingRetrieverà récupérer pour chaque requête. Dans notre configuration, ceci est réglé sur top_k=5. Vous pouvez essayer de modifier ce chiffre pour voir si fournir plus de contexte améliore la précision de vos résultats.

Préparation à la production

La solution proposée dans cet article peut accélérer le délai de rentabilisation du processus de développement de projet. Vous pouvez créer un projet facile à mettre à l'échelle avec l'environnement de sécurité et de confidentialité sur le cloud AWS.

Pour la sécurité et la confidentialité, OpenSearch Service fournit une protection des données avec gestion des identités et des accès ainsi que prévention des proxys confus inter-services. Vous pouvez utiliser un contrôle d'accès utilisateur précis afin que l'utilisateur ne puisse accéder qu'aux données auxquelles il est autorisé à accéder. De plus, SageMaker fournit des paramètres de sécurité configurables pour contrôle d'accès, protection des donnéeset une journalisation et surveillance. Vous pouvez protéger vos données au repos et en transit avec Service de gestion des clés AWS (AWS KMS). Vous pouvez également suivre le journal du déploiement du modèle SageMaker ou de l'accès au point de terminaison à l'aide de Amazon Cloud Watch. Pour plus d'informations, reportez-vous à Surveillez Amazon SageMaker avec Amazon CloudWatch.

Pour la haute évolutivité du service OpenSearch, vous pouvez l'ajuster en dimensionnement de vos domaines OpenSearch Service et employant meilleures pratiques opérationnelles. Vous pouvez également tirer parti de la mise à l'échelle automatique de votre point de terminaison SageMaker : vous pouvez dimensionner automatiquement les modèles SageMaker pour ajuster le point de terminaison à la fois lorsque le trafic augmente ou que les ressources ne sont pas utilisées.

Nettoyer

Pour réduire les coûts, supprimez toutes les ressources que vous avez déployées dans le cadre de cet article. Si vous avez lancé la pile CloudFormation, vous pouvez la supprimer via la console AWS CloudFormation. De même, vous pouvez supprimer tous les points de terminaison SageMaker que vous avez créés via la console SageMaker.

Conclusion

Dans cet article, nous avons montré comment créer une application d'IA générative de bout en bout pour la recherche d'entreprise avec RAG en utilisant les pipelines Haystack et le modèle Falcon-40b-instruct de SageMaker JumpStart et OpenSearch Service. L'approche RAG est essentielle dans la recherche d'entreprise car elle garantit que les réponses générées sont dans le domaine et atténuent donc les hallucinations. En utilisant les pipelines Haystack, nous sommes en mesure d'orchestrer des applications LLM composées de différents composants tels que des modèles et des bases de données vectorielles. SageMaker JumpStart nous fournit une solution en un clic pour déployer des LLM, et nous avons utilisé OpenSearch Service comme base de données vectorielle pour nos données indexées. Vous pouvez commencer à expérimenter et à créer des preuves de concept RAG pour vos applications d'IA génératives d'entreprise, en suivant les étapes décrites dans cet article et le code source disponible dans le GitHub référentiel.

À propos des auteurs

Tuana Celik est l'avocat principal des développeurs chez deepset, où elle se concentre sur la communauté open source pour Haystack. Elle dirige la fonction de relations avec les développeurs et prend régulièrement la parole lors d'événements sur la PNL et crée du matériel d'apprentissage pour la communauté.

Tuana Celik est l'avocat principal des développeurs chez deepset, où elle se concentre sur la communauté open source pour Haystack. Elle dirige la fonction de relations avec les développeurs et prend régulièrement la parole lors d'événements sur la PNL et crée du matériel d'apprentissage pour la communauté.

Roy Allela est architecte principal de solutions spécialisées en IA/ML chez AWS basé à Munich, en Allemagne. Roy aide les clients AWS, des petites startups aux grandes entreprises, à former et à déployer efficacement de grands modèles de langage sur AWS. Roy est passionné par les problèmes d'optimisation informatique et l'amélioration des performances des charges de travail d'IA.

Roy Allela est architecte principal de solutions spécialisées en IA/ML chez AWS basé à Munich, en Allemagne. Roy aide les clients AWS, des petites startups aux grandes entreprises, à former et à déployer efficacement de grands modèles de langage sur AWS. Roy est passionné par les problèmes d'optimisation informatique et l'amélioration des performances des charges de travail d'IA.

Mia Chang est un architecte de solutions spécialiste ML pour Amazon Web Services. Elle travaille avec des clients dans la région EMEA et partage les meilleures pratiques pour exécuter des charges de travail IA/ML sur le cloud avec son expérience en mathématiques appliquées, en informatique et en IA/ML. Elle se concentre sur les charges de travail spécifiques à la PNL et partage son expérience en tant que conférencière et auteur de livre. Dans ses temps libres, elle aime faire de la randonnée, jouer à des jeux de société et préparer du café.

Mia Chang est un architecte de solutions spécialiste ML pour Amazon Web Services. Elle travaille avec des clients dans la région EMEA et partage les meilleures pratiques pour exécuter des charges de travail IA/ML sur le cloud avec son expérience en mathématiques appliquées, en informatique et en IA/ML. Elle se concentre sur les charges de travail spécifiques à la PNL et partage son expérience en tant que conférencière et auteur de livre. Dans ses temps libres, elle aime faire de la randonnée, jouer à des jeux de société et préparer du café.

Inam Syed est un architecte de solutions de démarrage chez AWS, avec un fort accent sur l'assistance aux startups B2B et SaaS dans la mise à l'échelle et la croissance. Il possède une profonde passion pour les architectures sans serveur et l'IA/ML. Pendant son temps libre, Inaam profite de moments de qualité avec sa famille et s'adonne à son amour pour le vélo et le badminton.

Inam Syed est un architecte de solutions de démarrage chez AWS, avec un fort accent sur l'assistance aux startups B2B et SaaS dans la mise à l'échelle et la croissance. Il possède une profonde passion pour les architectures sans serveur et l'IA/ML. Pendant son temps libre, Inaam profite de moments de qualité avec sa famille et s'adonne à son amour pour le vélo et le badminton.

David Tippett est l'avocat principal des développeurs travaillant sur OpenSearch open source chez AWS. Son travail implique tous les domaines d'OpenSearch, de la recherche et de la pertinence à l'observabilité et à l'analyse de la sécurité.

David Tippett est l'avocat principal des développeurs travaillant sur OpenSearch open source chez AWS. Son travail implique tous les domaines d'OpenSearch, de la recherche et de la pertinence à l'observabilité et à l'analyse de la sécurité.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Automobile / VE, Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- GraphiquePrime. Élevez votre jeu de trading avec ChartPrime. Accéder ici.

- Décalages de bloc. Modernisation de la propriété des compensations environnementales. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :possède

- :est

- :ne pas

- :où

- $UP

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- Capable

- A Propos

- accélérer

- accès

- accomplir

- en conséquence

- Compte

- précision

- atteindre

- atteint

- la réalisation de

- actes

- adapter

- Supplémentaire

- En outre

- administratif

- Avantage

- avènement

- avocat

- AI

- AI / ML

- Tous

- permettre

- permet

- le long de

- aussi

- Bien que

- Amazon

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- parmi

- an

- analytique

- ainsi que

- répondre

- tous

- Apache

- Application

- applications

- appliqué

- une approche

- d'environ

- SONT

- domaines

- autour

- tableau

- Art

- sur notre blog

- AS

- assistant

- At

- acoustique

- augmentée

- auteur

- autorisé

- auto

- disponibles

- AWS

- AWS CloudFormation

- B2B

- fond

- base

- basé

- BE

- car

- devenez

- before

- va

- ci-dessous

- LES MEILLEURS

- les meilleures pratiques

- Big

- Blog

- planche

- Jeux de société

- corps

- livre

- tous les deux

- vaste

- construire

- Développement

- construit

- liasses

- mais

- bouton (dans la fenêtre de contrôle qui apparaît maintenant)

- by

- appelé

- CAN

- capacités

- cas

- Change

- en changeant

- vérifier

- le choix

- Selectionnez

- choose

- choisir

- classe

- Nettoyage

- plus

- le cloud

- code

- Café

- Commun

- Communautés

- Société

- Complément

- complet

- composant

- composants électriques

- comprend

- ordinateur

- Informatique

- concept

- Congrès

- confus

- NOUS CONTACTER

- considérant

- Console

- contenu

- contenu

- contexte

- des bactéries

- de la conversation

- IA conversationnel

- Costs

- couvert

- Housses

- engendrent

- créée

- crée des

- critique

- Clients

- données

- Préparation des données

- protection des données

- Base de données

- bases de données

- DBS

- affaire

- profond

- l'apprentissage en profondeur

- défini

- demo

- dépendances

- déployer

- déployé

- déployer

- déploiement

- Conception

- un

- conception

- détaillé

- développé

- Développeur

- mobiles

- Développement

- différent

- numérique

- numérisation

- dimensions

- do

- document

- Documentation

- INSTITUTIONNELS

- Ne fait pas

- Don

- Ne pas

- chacun

- Easy

- efficace

- efficace

- efficacement

- non plus

- éléments

- enchâsser

- intégré

- enrobage

- EMEA

- permettre

- fin

- end-to-end

- Endpoint

- Moteurs

- de renforcer

- assurer

- Assure

- Entreprise

- entités

- entité

- Environment

- évaluation

- événements

- peut

- exemple

- attendu

- d'experience

- Expériences

- expérience

- Exporter

- externe

- Visage

- famille

- Figure

- Déposez votre dernière attestation

- Fichiers

- une fonction filtre

- finale

- Prénom

- s'adapter

- flexible

- flexible

- Focus

- se concentre

- Abonnement

- Pour

- le format

- Fondation

- Framework

- Gratuit

- De

- d’étiquettes électroniques entièrement

- fonction

- Games

- générer

- généré

- génère

- génération

- génératif

- IA générative

- Allemagne

- obtenez

- donné

- Réservation de groupe

- Croissance

- manipuler

- Vous avez

- ayant

- he

- aide

- ici

- ici

- Haute

- de haut niveau

- très

- sa

- hôtes

- Comment

- How To

- Cependant

- HTML

- http

- HTTPS

- Moyeu

- i

- Identite

- if

- Impact

- Mettre en oeuvre

- important

- l'amélioration de

- in

- comprendre

- inclut

- Y compris

- increased

- de plus en plus

- indice

- indexé

- index

- d'information

- Infrastructure

- contribution

- installer

- instance

- Des instructions

- Internet

- développement

- IT

- SES

- jpg

- ACTIVITES

- clés

- Savoir

- spécialisées

- Transfert de connaissances

- langue

- gros

- lancer

- lancé

- conduire

- Conduit

- apprentissage

- Licence

- Autorisé

- léger

- comme

- Probable

- LIMIT

- limites

- Gamme

- LLM

- enregistrer

- enregistrement

- recherchez-

- love

- click

- machine learning

- LES PLANTES

- a prendre une

- FAIT DU

- Fabrication

- gérer

- gérés

- gestion

- matières premières.

- mathématiques

- maximales

- Mai..

- signifier

- Médias

- méthodes

- Métrique

- des millions

- Minutes

- atténuer

- ML

- modèle

- numériques jumeaux (digital twin models)

- modifier

- Modules

- Des moments

- Stack monitoring

- PLUS

- (en fait, presque toutes)

- Bougez

- prénom

- Nommé

- Nature

- Traitement du langage naturel

- navigation

- Besoin

- Besoins

- nlp

- cahier

- nombre

- of

- code

- Offres Speciales

- on

- uniquement

- ouvert

- open source

- Logiciels open source

- fonctionner

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Option

- Options

- or

- organisationnel

- Organisé

- original

- Autre

- nos

- décrit

- plus de

- propre

- paquet

- page

- pages

- partie

- partenaires,

- passion

- passionné

- Effectuer

- performant

- pipeline

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Jouez

- veuillez cliquer

- Point

- Populaire

- Post

- solide

- pratiques

- préparation

- Préparer

- la confidentialité

- d'ouvrabilité

- processus

- traitement

- Vidéo

- Progrès

- Projet

- preuves

- proposé

- propriétaire

- protéger

- protection

- prototype

- fournir

- à condition de

- fournit

- aportando

- procuration

- public

- Push

- qualité

- requêtes

- question

- fréquemment posées

- raw

- reçu

- récent

- Recommandation

- recommandé

- régulièrement

- rapports

- pertinence

- pertinent

- fiable

- rappeler

- dépôt

- nécessaire

- exigent

- conditions

- Exigences

- Resources

- réponse

- réponses

- REST

- restreindre

- résultat

- Résultats

- Retours

- Rich

- bon

- roy

- Courir

- pour le running

- SaaS.

- sagemaker

- Épargnez

- dire

- Évolutivité

- évolutive

- Escaliers intérieurs

- mise à l'échelle

- Sciences

- Rechercher

- sécurité

- sur le lien

- envoyer

- envoie

- supérieur

- Sans serveur

- sert

- service

- Services

- set

- Paramétres

- installation

- Forme

- Partages

- elle

- NAVIRE

- devrait

- montrer

- vitrine

- présenté

- signé

- similaires

- De même

- étapes

- simplement

- petit

- So

- Logiciels

- uniquement

- solide

- sur mesure

- Solutions

- quelques

- quelque chose

- Identifier

- code source

- Space

- Speaker

- parle

- spécialiste

- spécialisé

- Stabilité

- empiler

- Étape

- Commencer

- Commencez

- Startups

- étapes

- Étapes

- stockage

- STRONG

- structure

- tel

- suite

- sûr

- Prenez

- prend

- techniques

- modèles

- examiné

- qui

- La

- La Source

- Les

- puis

- ainsi

- donc

- Ces

- l'ont

- chose

- penser

- this

- milliers

- Avec

- fiable

- à

- ensemble

- suivre

- circulation

- transit

- digne de confiance

- deux

- type

- typiquement

- En fin de compte

- sous

- téléchargé

- us

- utilisé

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- utilitaire

- Plus-value

- Valeurs

- divers

- via

- vision

- attentes

- we

- web

- services Web

- Site Web

- quand

- qui

- sera

- comprenant

- dans les

- Word

- activités principales

- workflow

- de travail

- vos contrats

- pourra

- écrire

- yaml

- années

- Vous n'avez

- Votre

- zéphyrnet