AWS fournit des services qui répondent aux besoins des clients en matière d'intelligence artificielle (IA) et d'apprentissage automatique (ML) avec des services allant du matériel personnalisé comme Formation AWS et de Inférence AWS aux modèles de base d'IA générative (FM) sur Socle amazonien. En février 2022, AWS et Hugging Face ont annoncé une collaboration pour rendre l'IA générative plus accessible et plus rentable.

L'IA générative s'est développée à un rythme accéléré, passant du plus grand modèle pré-formé en 2019 avec 330 millions de paramètres à plus de 500 milliards de paramètres aujourd'hui. Les performances et la qualité des modèles se sont également considérablement améliorées avec le nombre de paramètres. Ces modèles couvrent des tâches telles que le texte à texte, le texte à image, le texte à incorporer, etc. Vous pouvez utiliser des grands modèles de langage (LLM), plus spécifiquement, pour des tâches telles que la synthèse, l'extraction de métadonnées et la réponse aux questions.

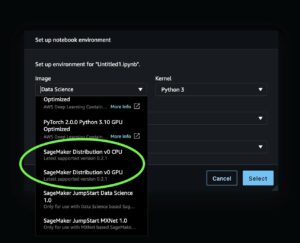

Amazon SageMaker JumpStart est un hub ML qui peut vous aider à accélérer votre parcours ML. Avec JumpStart, vous pouvez accéder à des modèles pré-formés et à des modèles de base à partir du Foundations Model Hub pour effectuer des tâches telles que la synthèse d'articles et la génération d'images. Les modèles pré-formés sont entièrement personnalisables pour vos cas d'utilisation et peuvent être facilement déployés en production avec l'interface utilisateur ou le SDK. Plus important encore, aucune de vos données n'est utilisée pour former les modèles sous-jacents. Étant donné que toutes les données sont cryptées et ne quittent pas le cloud privé virtuel (VPC), vous pouvez être sûr que vos données resteront privées et confidentielles.

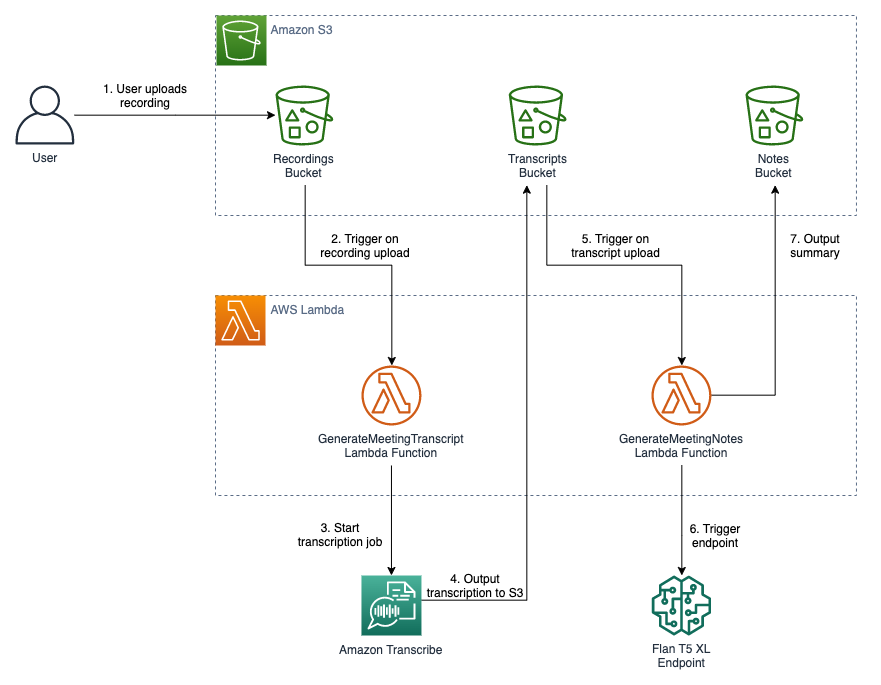

Cet article se concentre sur la création d'un résumé de réunion sans serveur à l'aide de Amazon Transcribe pour transcrire l'audio de la réunion et le Flan-T5-XL modèle de Hugging Face (disponible sur JumpStart) pour le résumé.

Vue d'ensemble de la solution

La solution de génération de notes de réunion crée un pipeline sans serveur automatisé à l'aide de AWS Lambda pour transcrire et résumer les enregistrements audio et vidéo des réunions. La solution peut être déployée avec d'autres FM disponibles sur JumpStart.

La solution comprend les composants suivants :

- Un script shell pour créer une couche Lambda personnalisée

- Un paramétrable AWS CloudFormation modèle de déploiement de la solution

- Code de fonction Lambda pour démarrer les tâches de transcription Amazon Transcribe

- Code de la fonction Lambda pour appeler un Point de terminaison en temps réel SageMaker hébergeant le modèle Flan T5 XL

Le diagramme suivant illustre cette architecture.

Comme indiqué dans le diagramme d'architecture, les enregistrements, les transcriptions et les notes de la réunion sont stockés dans les Service de stockage simple Amazon (Amazon S3). La solution adopte une approche axée sur les événements pour transcrire et résumer les événements de téléchargement S3. Les événements déclenchent les fonctions Lambda pour effectuer des appels d'API vers Amazon Transcribe et appeler le point de terminaison en temps réel hébergeant le modèle Flan T5 XL.

Le modèle CloudFormation et les instructions de déploiement de la solution se trouvent dans le GitHub référentiel.

Inférence en temps réel avec SageMaker

L'inférence en temps réel sur SageMaker est conçue pour les charges de travail avec des exigences de faible latence. Les terminaux SageMaker sont entièrement gérés et prennent en charge plusieurs options d'hébergement et de mise à l'échelle automatique. Une fois créé, le point de terminaison peut être appelé avec le API InvokeEndpoint. Le modèle CloudFormation fourni crée un point de terminaison en temps réel avec le nombre d'instances par défaut de 1, mais il peut être ajusté en fonction de la charge attendue sur le point de terminaison et selon le quota de service pour le type d'instance le permet. Vous pouvez demander des augmentations de quota de service sur le Page Quotas de service des Console de gestion AWS.

L'extrait de code suivant du modèle CloudFormation définit le modèle SageMaker, la configuration du point de terminaison et le point de terminaison à l'aide du ModelData et de ImageURI du Flan T5 XL de JumpStart. Vous pouvez explorer plus de FM sur Premiers pas avec Amazon SageMaker JumpStart. Pour déployer la solution avec un modèle différent, remplacez le ModelData et de ImageURI paramètres dans le modèle CloudFormation avec l'artefact S3 du modèle souhaité et l'URI de l'image du conteneur, respectivement. Vérifiez exemple de bloc-notes sur GitHub pour un exemple de code sur la façon de récupérer le dernier artefact de modèle JumpStart sur Amazon S3 et l'image de conteneur public correspondante fournie par SageMaker.

Déployez la solution

Pour des étapes détaillées sur le déploiement de la solution, suivez les Déploiement avec CloudFormation l'article de l' GitHub référentiel.

Si vous souhaitez utiliser un type d'instance différent ou plusieurs instances pour le point de terminaison, soumettez une demande d'augmentation de quota pour le type d'instance souhaité sur le Tableau de bord des quotas de service AWS.

Pour utiliser un FM différent pour le point de terminaison, remplacez le ImageURI et de ModelData paramètres dans le modèle CloudFormation pour le FM correspondant.

Testez la solution

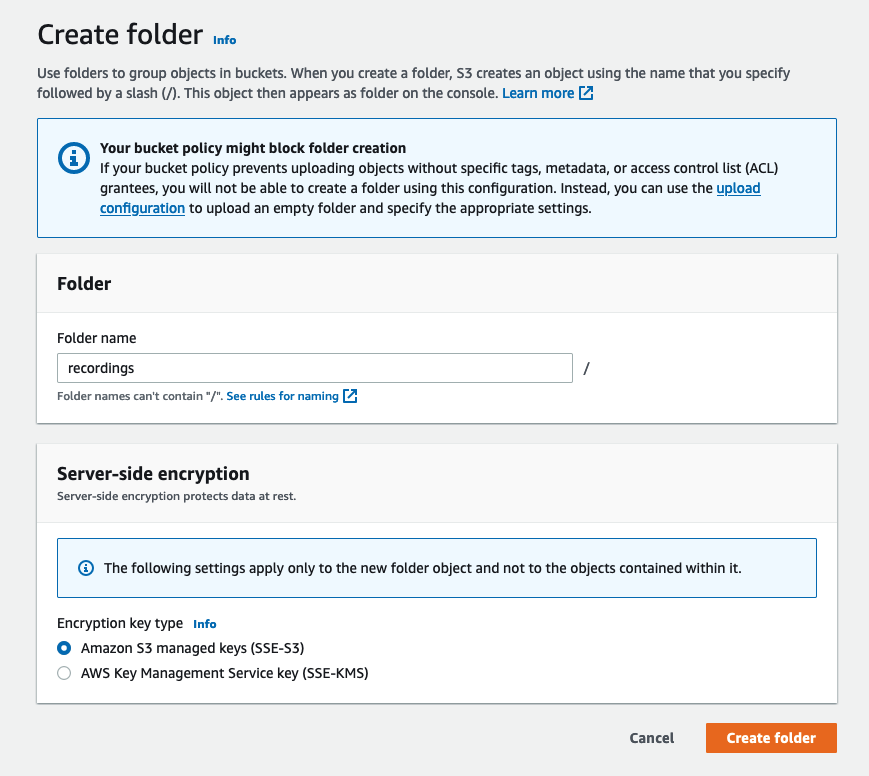

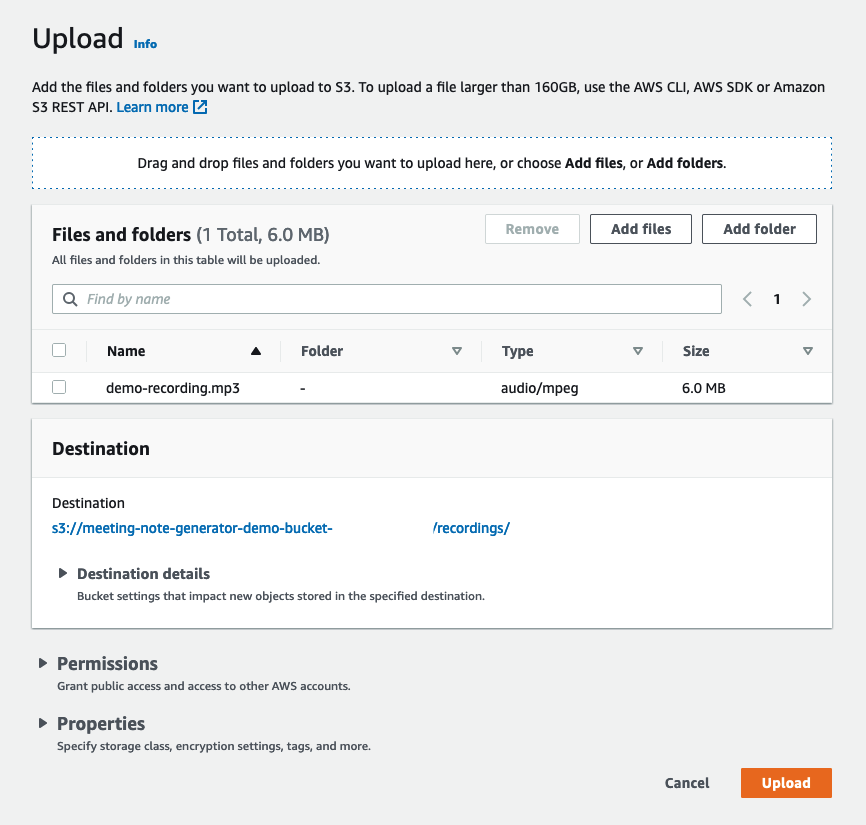

Après avoir déployé la solution à l'aide du script de création de couche Lambda et du modèle CloudFormation, vous pouvez tester l'architecture en téléchargeant un enregistrement de réunion audio ou vidéo dans l'un des formats multimédias pris en charge par Amazon Transcribe. Effectuez les étapes suivantes :

- Sur la console Amazon S3, choisissez Chapeaux cloche dans le volet de navigation.

- Dans la liste des compartiments S3, choisissez le compartiment S3 créé par le modèle CloudFormation nommé

meeting-note-generator-demo-bucket-<aws-account-id>. - Selectionnez Créer un dossier.

- Pour Nom de dossier, entrez le préfixe S3 spécifié dans le

S3RecordingsPrefixparamètre du modèle CloudFormation (recordingspar défaut). - Selectionnez Créer un dossier.

- Dans le dossier nouvellement créé, choisissez Téléchargement.

- Selectionnez Ajouter des fichiers et choisissez le fichier d'enregistrement de la réunion à télécharger.

- Selectionnez Téléchargement.

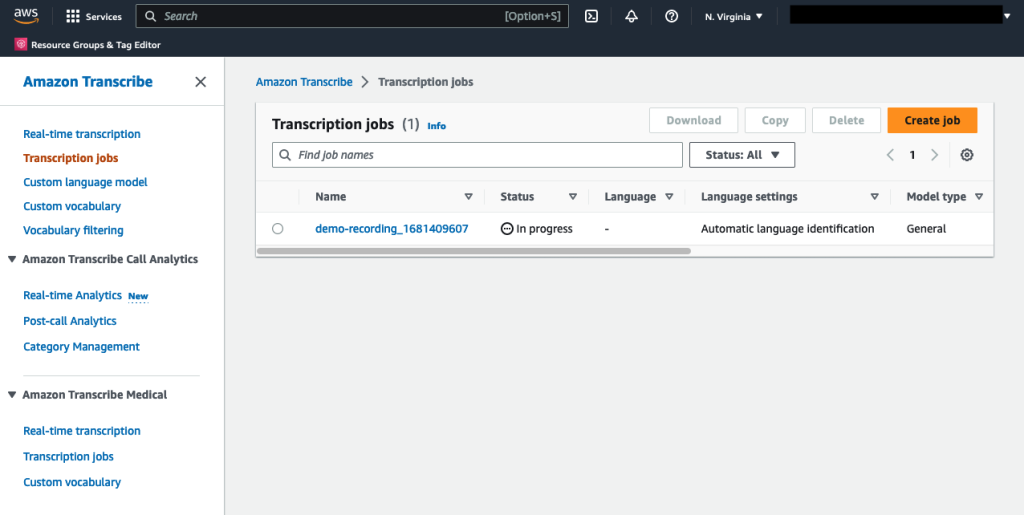

Nous pouvons maintenant vérifier une transcription réussie.

- Sur la console Amazon Transcribe, choisissez Emplois de transcription dans le volet de navigation.

- Vérifiez qu'une tâche de transcription avec un nom correspondant à l'enregistrement de réunion téléchargé a le statut En cours or Achevée.

- Lorsque le statut est Complété, revenez à la console Amazon S3 et ouvrez le compartiment de démonstration.

- Dans le compartiment S3, ouvrez le

transcripts/dossier. - Téléchargez le fichier texte généré pour visualiser la transcription.

Nous pouvons également vérifier le résumé généré.

- Dans le compartiment S3, ouvrez le

notes/dossier. - Téléchargez le fichier texte généré pour afficher le résumé généré.

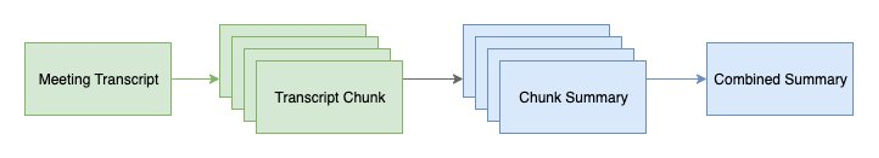

Ingénierie rapide

Même si les LLM se sont améliorés au cours des dernières années, les modèles ne peuvent accepter que des entrées finies ; par conséquent, l'insertion d'une transcription complète d'une réunion peut dépasser la limite du modèle et provoquer une erreur lors de l'invocation. Pour concevoir autour de ce défi, nous pouvons décomposer le contexte en morceaux gérables en limitant le nombre de jetons dans chaque contexte d'appel. Dans cet exemple de solution, la transcription est décomposée en blocs plus petits avec une limite maximale sur le nombre de jetons par bloc. Ensuite, chaque morceau de transcription est résumé à l'aide du modèle Flan T5 XL. Enfin, les résumés de blocs sont combinés pour former le contexte du résumé combiné final, comme illustré dans le diagramme suivant.

Le code suivant du GenerateMeetingNotes La fonction Lambda utilise le Boîte à outils en langage naturel (NLTK) bibliothèque pour tokeniser la transcription, puis elle découpe la transcription en sections, chacune contenant jusqu'à un certain nombre de jetons :

Enfin, l'extrait de code suivant combine les résumés de blocs comme contexte pour générer un résumé final :

Le plein GenerateMeetingNotes La fonction Lambda se trouve dans le GitHub référentiel.

Nettoyer

Pour nettoyer la solution, procédez comme suit :

- Supprimez tous les objets du compartiment S3 de démonstration et du compartiment S3 de journaux.

- Supprimez la pile CloudFormation.

- Supprimez la couche Lambda.

Conclusion

Cet article a montré comment utiliser les FM sur JumpStart pour créer rapidement une architecture de générateur de notes de réunion sans serveur avec AWS CloudFormation. Combiné avec les services AWS AI comme Amazon Transcribe et les technologies sans serveur comme Lambda, vous pouvez utiliser les FM sur JumpStart et Amazon Bedrock pour créer des applications pour divers cas d'utilisation de l'IA générative.

Pour des articles supplémentaires sur le ML chez AWS, visitez le Blog AWS ML.

A propos de l'auteure

Éric Kim est un architecte de solutions (SA) chez Amazon Web Services. Il travaille avec des développeurs et des éditeurs de jeux pour créer des jeux évolutifs et des services de support sur AWS. Il se concentre principalement sur les applications de l'intelligence artificielle et de l'apprentissage automatique.

Éric Kim est un architecte de solutions (SA) chez Amazon Web Services. Il travaille avec des développeurs et des éditeurs de jeux pour créer des jeux évolutifs et des services de support sur AWS. Il se concentre principalement sur les applications de l'intelligence artificielle et de l'apprentissage automatique.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoAiStream. Intelligence des données Web3. Connaissance Amplifiée. Accéder ici.

- Frapper l'avenir avec Adryenn Ashley. Accéder ici.

- Achetez et vendez des actions de sociétés PRE-IPO avec PREIPO®. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/build-a-serverless-meeting-summarization-backend-with-large-language-models-on-amazon-sagemaker-jumpstart/

- :possède

- :est

- $UP

- 1

- 100

- 17

- 2019

- 2022

- 40

- 50

- 500

- 7

- a

- accélérer

- accélérer

- accès

- accessible

- Supplémentaire

- Ajusté

- AI

- Services d'IA

- cas d'utilisation de l'IA

- Tous

- aussi

- Amazon

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Transcribe

- Amazon Web Services

- an

- et de

- annoncé

- tous

- api

- applications

- une approche

- architecture

- SONT

- autour

- article

- artificiel

- intelligence artificielle

- Intelligence artificielle (AI)

- L'INTELLIGENCE ARTIFICIELLE ET LE MACHINE LEARNING

- AS

- At

- acoustique

- Automatisation

- disponibles

- AWS

- AWS CloudFormation

- backend

- basé

- BE

- car

- Milliards

- Pause

- Cassé

- construire

- Développement

- mais

- by

- Appels

- CAN

- cas

- Causes

- certaines

- challenge

- vérifier

- Selectionnez

- le cloud

- code

- collaboration

- combiné

- moissonneuses-batteuses

- complet

- composants électriques

- configuration

- Console

- Contenant

- Conteneurs

- contexte

- Correspondant

- Prix

- engendrent

- créée

- crée des

- La création

- création

- Customiser

- personnalisables

- données

- Réglage par défaut

- Définit

- offre

- démontré

- déployer

- déployé

- déployer

- Conception

- un

- voulu

- détaillé

- mobiles

- différent

- Ne fait pas

- down

- drastiquement

- chacun

- même

- d'autre

- crypté

- Endpoint

- Entrer

- Tout

- Environment

- erreur

- événements

- dépassent

- attendu

- explorez

- Visage

- Février

- few

- Déposez votre dernière attestation

- finale

- finalement

- se concentre

- suivre

- Abonnement

- Pour

- formulaire

- trouvé

- Fondation

- Fondations

- De

- plein

- d’étiquettes électroniques entièrement

- fonction

- fonctions

- jeu

- Games

- générer

- généré

- génération

- génératif

- IA générative

- générateur

- obtenez

- cultivé

- Matériel

- Vous avez

- ayant

- he

- aide

- hébergement

- Comment

- How To

- HTML

- http

- HTTPS

- Moyeu

- i

- if

- illustre

- image

- amélioré

- in

- inclut

- Y compris

- Améliore

- Augmente

- entrées

- instance

- Des instructions

- Intelligence

- Interfaces

- développement

- invoqué

- invoque

- IT

- Emploi

- chemin

- json

- langue

- gros

- le plus grand

- Nom

- Latence

- Nouveautés

- couche

- apprentissage

- Laisser

- Bibliothèque

- comme

- LIMIT

- Liste

- charge

- Faible

- click

- machine learning

- a prendre une

- gérés

- gestion

- math

- maximales

- Mai..

- Découvrez

- réunion

- réunions

- Métadonnées

- million

- ML

- Mode

- modèle

- numériques jumeaux (digital twin models)

- PLUS

- (en fait, presque toutes)

- plusieurs

- prénom

- Nommé

- Navigation

- Besoins

- cahier

- Notes

- nombre

- objets

- of

- on

- une fois

- uniquement

- ouvert

- or

- Autre

- ande

- pain

- paramètre

- paramètres

- Effectuer

- performant

- pipeline

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Post

- Poteaux

- qui se déroulent

- Privé

- Vidéo

- propriétés

- à condition de

- public

- éditeurs

- qualité

- question

- vite.

- allant

- Tarif

- en temps réel

- l'enregistrement

- rester

- remplacer

- nécessaire

- Exigences

- ceux

- respectivement

- Résultats

- retourner

- SA

- sagemaker

- évolutive

- Sdk

- Section

- les sections

- Sans serveur

- service

- Services

- coquillage

- montré

- étapes

- faibles

- sur mesure

- Solutions

- envergure

- spécifiquement

- spécifié

- empiler

- j'ai commencé

- Commencez

- Statut

- Étapes

- storage

- stockée

- soumettre

- réussi

- résumé

- RÉSUMÉ

- Support

- Appareils

- Appuyer

- Prenez

- prend

- tâches

- Les technologies

- modèle

- tester

- que

- qui

- La

- puis

- donc

- Ces

- this

- bien que?

- à

- aujourd'hui

- tokenize

- Tokens

- Boîte à outils

- Train

- Transcription

- déclencher

- oui

- La confiance

- type

- sous-jacent

- téléchargé

- Téléchargement

- sur

- utilisé

- d'utiliser

- Utilisateur

- Interface utilisateur

- en utilisant

- divers

- Vidéo

- Voir

- Salle de conférence virtuelle

- Visiter

- souhaitez

- we

- web

- services Web

- sera

- comprenant

- vos contrats

- années

- Vous n'avez

- Votre

- zéphyrnet