Les applications industrielles de l’apprentissage automatique sont généralement composées de divers éléments présentant des modalités de données ou des distributions de fonctionnalités différentes. Graphiques hétérogènes (HG) offrent une vue unifiée de ces systèmes de données multimodaux en définissant plusieurs types de nœuds (pour chaque type de données) et d'arêtes (pour la relation entre les éléments de données). Par exemple, les réseaux de commerce électronique pourraient avoir [utilisateur, Les produits, Avis] les nœuds ou les plates-formes vidéo peuvent avoir [chaine, utilisateur, vidéo, commentaire] nœuds. Réseaux de neurones à graphes hétérogènes (HGNN) apprennent les intégrations de nœuds résumant les relations de chaque nœud dans un vecteur. Cependant, dans les HG du monde réel, il existe souvent un problème de déséquilibre d'étiquettes entre les différents types de nœuds. Cela signifie que les types de nœuds rares en étiquettes ne peuvent pas exploiter les HGNN, ce qui entrave l'applicabilité plus large des HGNN.

Dans "Apprentissage par transfert zéro dans un graphique hétérogène via des réseaux de transfert de connaissances”, présenté à NeuroIPS 2022, nous proposons un modèle appelé réseau de transfert de connaissances (KTN), qui transfère les connaissances des types de nœuds riches en étiquettes vers des types de nœuds sans étiquette en utilisant les riches informations relationnelles fournies dans un HG. Nous décrivons comment nous pré-entraînons un modèle HGNN sans avoir besoin de réglage fin. Les KTN surpassent jusqu'à 140 % les bases d'apprentissage par transfert de pointe sur les tâches d'apprentissage sans tir, et peuvent être utilisés pour améliorer de nombreux modèles HGNN existants sur ces tâches de 24 % (ou plus).

|

| Les KTN transforment les étiquettes à partir d'un type d'informations (carrés) via un graphique vers un autre type (stars). |

Qu'est-ce qu'un graphe hétérogène ?

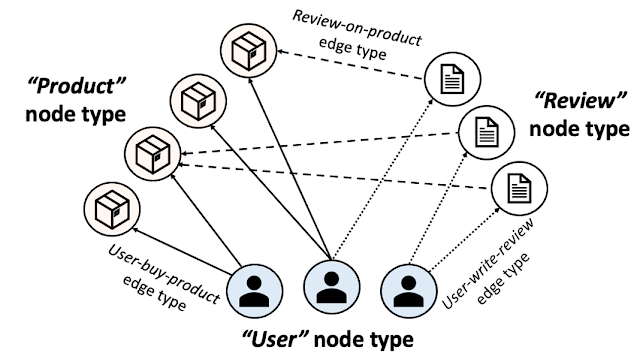

Un HG est composé de plusieurs types de nœuds et de bords. La figure ci-dessous montre un réseau de commerce électronique présenté comme un HG. Dans le commerce électronique, les « utilisateurs » achètent des « produits » et rédigent des « avis ». Un HG présente cet écosystème en utilisant trois types de nœuds [utilisateur, Les produits, Avis] et trois types de bords [produit-acheté par l'utilisateur, avis-écriture-utilisateur, avis sur le produit]. Les produits individuels, les utilisateurs et les avis sont ensuite présentés sous forme de nœuds et leurs relations sous forme d'arêtes dans le HG avec les types de nœuds et d'arêtes correspondants.

|

| Graphique hétérogène du commerce électronique. |

En plus de toutes les informations de connectivité, les HG sont généralement fournis avec attributs du nœud d'entrée qui résument les informations de chaque nœud. Les attributs du nœud d'entrée peuvent avoir différentes modalités selon les différents types de nœuds. Par exemple, les images de produits pourraient être données comme attributs de nœud d'entrée pour les nœuds de produits, tandis que le texte peut être donné comme attributs d'entrée pour les nœuds d'évaluation. Étiquettes de nœud (par exemple, la catégorie de chaque produit ou la catégorie qui intéresse le plus chaque utilisateur) sont ce que nous voulons prédire sur chaque nœud.

HGNN et problèmes de rareté des étiquettes

Les HGNN calculent intégrations de nœuds qui résument les structures locales de chaque nœud (y compris les informations du nœud et de son voisin). Ces intégrations de nœuds sont utilisées par un classificateur pour prédire l'étiquette de chaque nœud. Pour entraîner un modèle HGNN et un classificateur afin de prédire les étiquettes pour un type de nœud spécifique, nous avons besoin d'une bonne quantité d'étiquettes pour le type.

Un problème courant dans les applications industrielles de l’apprentissage profond est la rareté des étiquettes, et avec leurs divers types de nœuds, les HGNN sont encore plus susceptibles de faire face à ce défi. Par exemple, les types de nœuds de contenu accessibles au public (par exemple, les nœuds de produits) sont abondamment étiquetés, alors que les étiquettes des nœuds d'utilisateur ou de compte peuvent ne pas être disponibles en raison de restrictions de confidentialité. Cela signifie que dans la plupart des paramètres de formation standard, les modèles HGNN ne peuvent apprendre à faire de bonnes inférences que pour quelques types de nœuds riches en étiquettes et ne peuvent généralement pas faire d'inférences pour les types de nœuds restants (étant donné l'absence d'étiquettes pour eux).

Transférer l’apprentissage sur des graphes hétérogènes

Apprentissage par transfert sans tir est une technique utilisée pour améliorer les performances d'un modèle sur un l'objectif domaine sans étiquette en utilisant les connaissances acquises par le modèle auprès d'un autre modèle connexe la source domaine avec des données correctement étiquetées. Pour appliquer l'apprentissage par transfert afin de résoudre ce problème de rareté d'étiquettes pour certains types de nœuds dans les HG, le domaine cible serait les types de nœuds sans étiquette. Alors quel serait le domaine source ? Précédent travail définit généralement le domaine source comme le même type de nœuds situés dans un HG différent, en supposant que ces nœuds sont abondamment étiquetés. Ce apprentissage par transfert de graphique à graphique L'approche pré-entraîne un modèle HGNN sur le HG externe, puis exécute le modèle sur le HG d'origine (rare en étiquettes).

Cependant, ces approches ne sont pas applicables dans de nombreux scénarios du monde réel pour trois raisons. Premièrement, tout HG externe qui pourrait être utilisé dans un contexte d'apprentissage par transfert de graphe à graphe serait presque sûrement propriétaire, donc probablement indisponible. Deuxièmement, même si les praticiens pouvaient avoir accès à un HC externe, il est peu probable que distribution de cette source HG correspondrait suffisamment bien à leur HG cible pour appliquer l'apprentissage par transfert. Enfin, les types de nœuds souffrant de rareté des étiquettes sont susceptibles de souffrir du même problème sur d'autres HG (par exemple, des problèmes de confidentialité sur les nœuds utilisateur).

Notre approche : Transférer l'apprentissage entre types de nœuds au sein d'un graphe hétérogène

Ici, nous mettons en lumière un domaine source plus pratique, d'autres types de nœuds avec des étiquettes abondantes situées sur le même HG. Au lieu d’utiliser des HG supplémentaires, nous transférons les connaissances au sein d’un seul HG (supposé être entièrement détenu par les praticiens) entre différents types de nœuds. Plus précisément, nous pré-entraînons un modèle HGNN et un classificateur sur un type de nœud riche en étiquettes (source), puis réutilisons les modèles sur les types de nœuds étiquetés zéro (cible) situés dans le même HG sans ajustement supplémentaire. La seule exigence est que les types de nœuds source et cible partagent le même ensemble d'étiquettes (par exemple, dans le HG de commerce électronique, les nœuds de produits ont un ensemble d'étiquettes décrivant les catégories de produits, et les nœuds utilisateur partagent le même ensemble d'étiquettes décrivant leurs catégories d'achats préférées) .

Pourquoi est-ce difficile ?

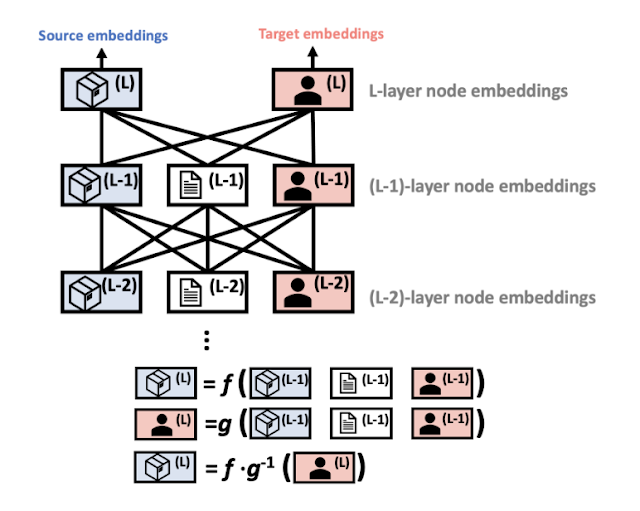

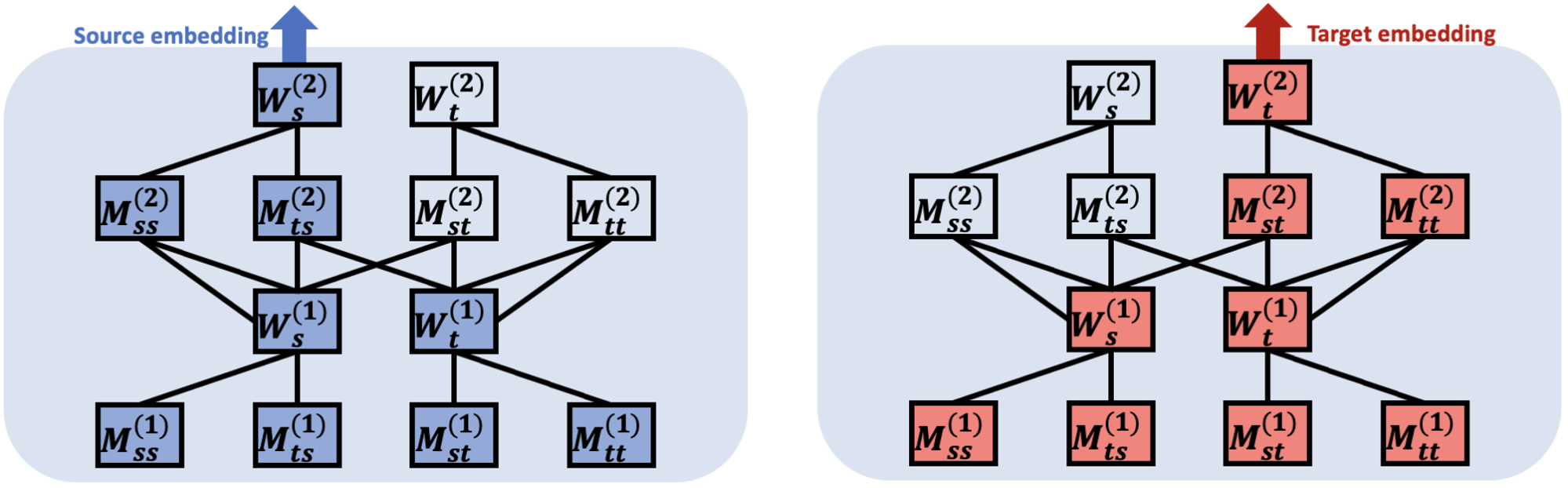

Malheureusement, nous ne pouvons pas réutiliser directement le HGNN et le classificateur pré-entraînés sur le type de nœud cible. Une caractéristique cruciale des architectures HGNN est qu’elles sont composées de modules spécialisés pour chaque type de nœud pour mieux connaître la multiplicité des HG. Les HGNN utilisent des ensembles distincts de modules pour calculer les intégrations pour chaque type de nœud. Dans la figure ci-dessous, les modules de couleur bleue et rouge sont utilisés pour calculer les intégrations de nœuds pour les types de nœuds source et cible, respectivement.

|

| Les HGNN sont composés de modules spécialisés pour chaque type de nœud et utilisent des ensembles distincts de modules pour calculer les intégrations de différents types de nœuds. Plus de détails peuvent être trouvés dans le papier. |

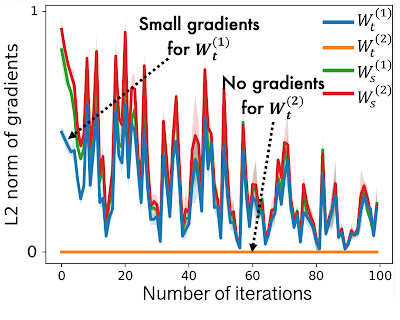

Lors de la pré-formation des HGNN sur le type de nœud source, les modules spécifiques à la source dans les HGNN sont bien formés, mais les modules spécifiques à la cible sont sous-entraînés car ils ne contiennent qu'une petite quantité de gradients. Ceci est illustré ci-dessous, où nous voyons que le Norme L2 de gradients pour les types de nœuds cibles (c'est-à-dire Mtt) sont bien inférieurs à ceux des types de source (c'est-à-dire Mss). Dans ce cas, un modèle HGNN génère de mauvaises intégrations de nœuds pour le type de nœud cible, ce qui entraîne de mauvaises performances de tâche.

|

KTN : apprentissage par transfert de type croisé entraînable pour les HGNN

Notre travail se concentre sur la transformation des (mauvaises) plongements de nœuds cibles calculés par un modèle HGNN pré-entraîné pour suivre la distribution des plongements de nœuds sources. Ensuite, le classificateur, pré-entraîné sur le type de nœud source, peut être réutilisé pour le l'objectif type de nœud. Comment pouvons-nous mapper les intégrations de nœuds cibles au domaine source ? Pour répondre à cette question, nous étudions comment les HGNN calculent les intégrations de nœuds pour connaître la relation entre les distributions source et cible.

Les HGNN regroupent les intégrations de nœuds connectés pour augmenter les intégrations d'un nœud cible dans chaque couche. En d’autres termes, les intégrations de nœuds pour les types de nœuds source et cible sont mises à jour à l’aide de la même entrée : les intégrations de nœuds de la couche précédente de tous les types de nœuds connectés. Cela signifie qu'ils peuvent être représentés les uns par les autres. Nous prouvons théoriquement cette relation et trouvons qu'il existe une matrice de mappage (définie par les paramètres HGNN) du domaine cible au domaine source (plus de détails dans le théorème 1 dans le papier). Sur la base de ce théorème, nous introduisons un auxiliaire Réseau neuronal, que nous appelons un Réseau de transfert de connaissances (KTN), qui reçoit les intégrations de nœuds cibles puis les transforme en les multipliant par une matrice de mappage (entraînable). Nous définissons ensuite un régularisateur qui est minimisé ainsi que la perte de performances dans la phase de pré-entraînement pour entraîner le KTN. Au moment du test, nous mappons les intégrations cibles calculées à partir du HGNN pré-entraîné vers le domaine source en utilisant le KTN formé pour la classification.

Résultats expérimentaux

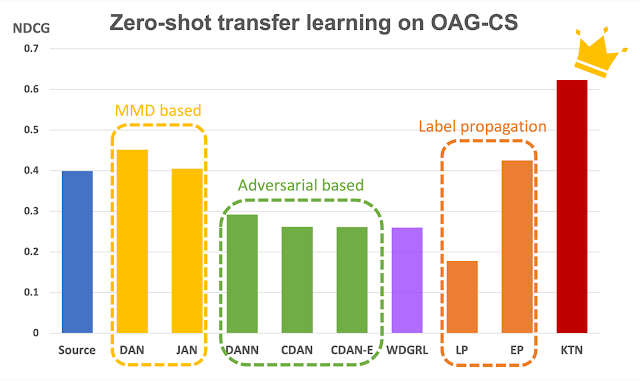

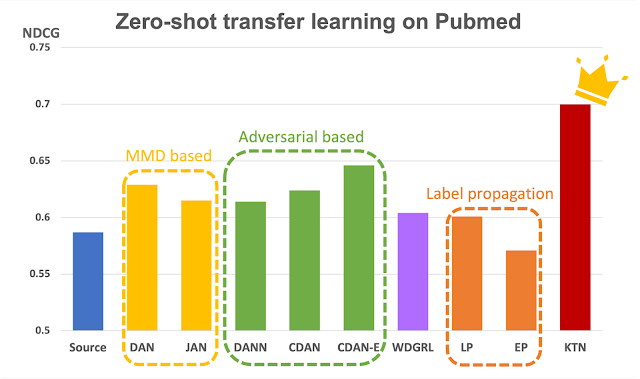

Pour examiner l'efficacité des KTN, nous avons exécuté 18 tâches différentes d'apprentissage par transfert zéro sur deux graphes hétérogènes publics, Graphique académique ouvert et les Pubmed. Nous comparons KTN avec huit méthodes d'apprentissage par transfert de pointe (DAN, JAN, DANN, CADAN, CDAN-E, WDGRL, LP, EP). Montré ci-dessous, KTN surpasse systématiquement toutes les références sur toutes les tâches, dépassant les références d'apprentissage par transfert jusqu'à 140 % (tel que mesuré par Gain cumulé actualisé normalisé, une métrique de classement).

|

|

| Apprentissage par transfert zéro-shot sur les ensembles de données Open Academic Graph (OAG-CS) et Pubmed. Les couleurs représentent différentes catégories de références d’apprentissage par transfert avec lesquelles les résultats sont comparés. Jaune: Utiliser les propriétés statistiques (par exemple, moyenne, variance) des distributions. Vert: Utilisation modèles contradictoires pour transférer des connaissances. Orange: Transférer des connaissances directement via la structure graphique en utilisant propagation d'étiquette. |

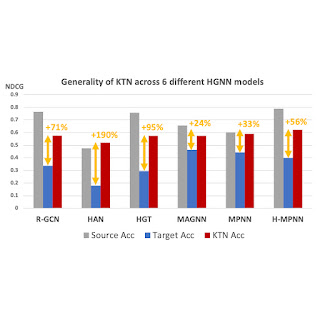

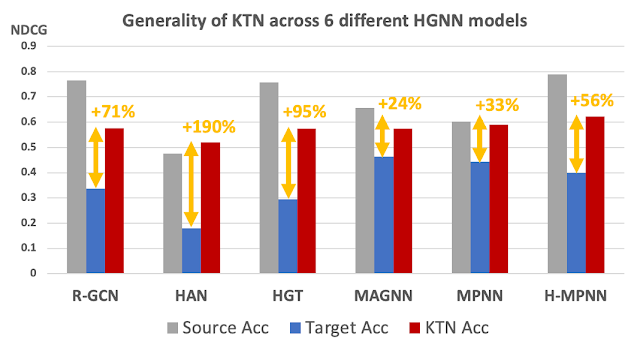

Plus important encore, KTN peut être appliqué à presque tous les modèles HGNN qui ont des paramètres spécifiques au type de nœud et de bord et améliorer leurs performances sans tir sur les domaines cibles. Comme indiqué ci-dessous, KTN améliore la précision sur les types de nœuds marqués zéro dans six modèles HGNN différents (R-GCN, HAN, HGT, MAGNN, Numéro MPN, H-MPNN) jusqu'à 190 %.

|

| KTN peut être appliqué à six modèles HGNN différents et améliorer leurs performances sans tir sur les domaines cibles. |

Points clés à retenir

Différents écosystèmes industriels peuvent être présentés sous forme de graphiques hétérogènes. Les HGNN résument les informations graphiques hétérogènes en représentations efficaces. Cependant, les problèmes de rareté des étiquettes sur certains types de nœuds empêchent une application plus large des HGNN. Dans cet article, nous avons présenté KTN, la première méthode d'apprentissage par transfert de type croisé conçue pour les HGNN. Avec KTN, nous pouvons exploiter pleinement la richesse des graphiques hétérogènes via les HGNN, quelle que soit la rareté des étiquettes. Voir le papier pour plus de détails.

Remerciements

Cet article est le fruit d'un travail conjoint avec nos co-auteurs John Palowitch (Google Research), Dustin Zelle (Google Research), Ziniu Hu (stagiaire, Google Research) et Russ Salakhutdinov (CMU). Nous remercions Tom Small d'avoir créé la figure animée dans ce billet de blog.

#mailpoet_form_1 .mailpoet_form { }

#mailpoet_form_1 formulaire { margin-bottom : 0 ; }

#mailpoet_form_1 .mailpoet_column_with_background { rembourrage : 0px ; }

#mailpoet_form_1 .wp-block-column:first-child, #mailpoet_form_1 .mailpoet_form_column:first-child { rembourrage : 0 20px ; }

#mailpoet_form_1 .mailpoet_form_column:not(:first-child) { margin-left : 0 ; }

#mailpoet_form_1 h2.mailpoet-heading { marge : 0 0 12px 0 ; }

#mailpoet_form_1 .mailpoet_paragraph { hauteur de ligne : 20px ; marge inférieure : 20px ; }

#mailpoet_form_1 .mailpoet_segment_label, #mailpoet_form_1 .mailpoet_text_label, #mailpoet_form_1 .mailpoet_textarea_label, #mailpoet_form_1 .mailpoet_select_label, #mailpoet_form_1 .mailpoet_radio_label, #mailpoet_form_1 .mailpoet_checkbox_label, #mailpoet_form_1 .mailpoet_list_label, #mailpoet_form_1 .mailpoet_date_label { display: block; poids de la police : normal ; }

#mailpoet_form_1 .mailpoet_text, #mailpoet_form_1 .mailpoet_textarea, #mailpoet_form_1 .mailpoet_select, #mailpoet_form_1 .mailpoet_date_month, #mailpoet_form_1 .mailpoet_date_day, #mailpoet_form_1 .mailpoet_date_year, #mailpoet_form_1 .mailpoet_date { afficher : bloquer ; }

#mailpoet_form_1 .mailpoet_text, #mailpoet_form_1 .mailpoet_textarea { largeur : 200px ; }

#mailpoet_form_1 .mailpoet_checkbox { }

#mailpoet_form_1 .mailpoet_submit { }

#mailpoet_form_1 .mailpoet_divider { }

#mailpoet_form_1 .mailpoet_message { }

#mailpoet_form_1 .mailpoet_form_loading { largeur : 30px ; aligner le texte : centrer ; hauteur de ligne : normale ; }

#mailpoet_form_1 .mailpoet_form_loading > span { largeur : 5px ; hauteur : 5px ; couleur de fond : #5b5b5b ; }#mailpoet_form_1{border-radius: 3px;background: #27282e;color: #ffffff;text-align: left;}#mailpoet_form_1 form.mailpoet_form {padding: 0px;}#mailpoet_form_1{width: 100%;}#mailpoet_form_1 . mailpoet_message {marge : 0 ; rembourrage : 0 20px ;}

#mailpoet_form_1 .mailpoet_validate_success {couleur : #00d084}

#mailpoet_form_1 input.parsley-success {couleur : #00d084}

#mailpoet_form_1 select.parsley-success {couleur : #00d084}

#mailpoet_form_1 textarea.parsley-success {couleur : #00d084}

#mailpoet_form_1 .mailpoet_validate_error {couleur : #cf2e2e}

#mailpoet_form_1 input.parsley-error {couleur : #cf2e2e}

#mailpoet_form_1 select.parsley-error {couleur : #cf2e2e}

#mailpoet_form_1 textarea.textarea.parsley-error {couleur : #cf2e2e}

#mailpoet_form_1 .parsley-errors-list {couleur : #cf2e2e}

#mailpoet_form_1 .parsley-required {couleur : #cf2e2e}

#mailpoet_form_1 .parsley-custom-error-message {couleur : #cf2e2e}

#mailpoet_form_1. last-child {margin-bottom : 0}} @media (max-width : 500px) {#mailpoet_form_1 .mailpoet_form_column:last-child .mailpoet_paragraph:last-child {margin-bottom : 27282}}

Enseigner d'anciennes étiquettes de nouvelles astuces dans des graphiques hétérogènes Republié à partir de la source http://ai.googleblog.com/2023/03/teaching-old-labels-new-tricks-in.html via http://feeds.feedburner.com/blogspot /gJZg

semaine de crowdsourcing

<!–

->

<!–

->

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- Platoblockchain. Intelligence métaverse Web3. Connaissance Amplifiée. Accéder ici.

- La source: https://blockchainconsultants.io/teaching-old-labels-new-tricks-in-heterogeneous-graphs/?utm_source=rss&utm_medium=rss&utm_campaign=teaching-old-labels-new-tricks-in-heterogeneous-graphs

- 1

- 1999

- 7

- a

- AC

- académique

- accès

- Compte

- précision

- ACM

- à travers

- ajout

- Supplémentaire

- adéquatement

- à opposer à

- Tous

- montant

- et les

- Une autre

- répondre

- en vigueur

- Application

- applications

- appliqué

- Appliquer

- une approche

- approches

- assumé

- attributs

- disponibles

- fond

- basé

- ci-dessous

- jusqu'à XNUMX fois

- Block

- Blog

- plus large

- Bryan

- appelé

- ne peut pas

- maisons

- catégories

- Catégories

- Canaux centraux

- certaines

- challenge

- difficile

- caractéristique

- classification

- Couleur

- Commun

- communément

- comparer

- par rapport

- composé

- calcul

- connecté

- Connectivité

- contenu

- Correspondant

- pourriez

- La création

- crucial

- données

- ensembles de données

- dc

- profond

- l'apprentissage en profondeur

- défini

- définir

- décrire

- la description

- un

- détails

- différent

- différent

- directement

- réduit

- Commande

- distinct

- distribution

- distributions

- plusieurs

- domaine

- domaines

- pendant

- e-commerce

- chacun

- risque numérique

- Écosystèmes

- Edge

- Efficace

- efficacité

- assez

- Pourtant, la

- existant

- Exploiter

- externe

- supplémentaire

- Visage

- Favori

- Fonctionnalité

- few

- Figure

- finale

- finalement

- Trouvez

- Prénom

- Écoulement

- se concentre

- suivre

- formulaire

- trouvé

- De

- d’étiquettes électroniques entièrement

- fonctions

- gif

- GitHub

- donné

- Bien

- les gradients

- graphique

- graphiques

- la taille

- ici

- Comment

- Cependant

- HTML

- HTTPS

- satellite

- déséquilibre

- améliorer

- in

- Dans d'autres

- Y compris

- individuel

- industriel

- industrie

- d'information

- contribution

- instance

- plutôt ;

- intérêts

- introduire

- introduit

- enquêter

- aide

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- articles

- John

- joint

- spécialisées

- Libellé

- Etiquettes

- Nom

- couche

- conduisant

- APPRENTISSAGE

- savant

- apprentissage

- lumière

- Probable

- locales

- situé

- perte

- click

- machine learning

- a prendre une

- de nombreuses

- Localisation

- cartographie

- Marge

- Match

- mathématique

- Matrice

- largeur maximale

- veux dire

- méthode

- méthodes

- métrique

- pourrait

- Mines

- modèle

- numériques jumeaux (digital twin models)

- Modules

- PLUS

- (en fait, presque toutes)

- plusieurs

- multiplier

- Besoin

- réseau et

- réseaux

- Nouveauté

- nœud

- nœuds

- Ordinaire

- obtenir

- code

- Vieux

- ONE

- ouvert

- original

- Autre

- Surpasser

- Surperforme

- propriété

- Papier

- paramètres

- performant

- phase

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- pauvres

- Post

- Méthode

- prévoir

- présenté

- cadeaux

- empêcher

- précédent

- la confidentialité

- Produit

- Produits

- propriétés

- proposer

- Prouver

- public

- publiquement

- achat

- question

- Classement

- réal

- monde réel

- Les raisons

- recevoir

- reçoit

- Indépendamment

- en relation

- rapport

- relation amoureuse

- Les relations

- restant

- représentent

- représenté

- exigent

- exigence

- un article

- restrictions

- Résultats

- Avis

- Avis

- Rich

- même

- Rareté

- scénarios

- Scientifique

- Deuxièmement

- set

- Sets

- mise

- Paramétres

- Partager

- Shopping

- montré

- Spectacles

- unique

- SIX

- petit

- RÉSOUDRE

- Identifier

- spécialisé

- groupe de neurones

- spécifiquement

- Standard

- state-of-the-art

- statistique

- structure

- souffrent

- résumé

- sûrement

- Système

- Target

- Tâche

- tâches

- Enseignement

- tester

- Le

- La Source

- leur

- trois

- Avec

- fiable

- à

- Train

- qualifié

- Formation

- transférer

- transferts

- Transformer

- transformer

- types

- unifiée

- a actualisé

- utilisé

- Utilisateur

- utilisateurs

- d'habitude

- utilisé

- divers

- via

- Vidéo

- Voir

- W3

- Quoi

- qui

- tout en

- plus large

- largeur

- Wikipédia

- dans les

- sans

- des mots

- activités principales

- world

- pourra

- écrire

- Zelle

- zéphyrnet

- zéro

- Apprentissage zéro coup