L’intelligence artificielle (IA) fait désormais partie intégrante de notre vie quotidienne, favorisant les avancées technologiques et améliorant divers secteurs, dont la finance.

Cependant, l’utilisation croissante de l’IA suscite également des inquiétudes quant aux pratiques responsables et éthiques.

Il est essentiel de garantir que les systèmes d’IA soient équitables, impartiaux et responsables afin de prévenir les impacts négatifs sur les individus et la société. Conformément à ce besoin, NEC a pris des mesures importantes pour promouvoir les initiatives d’IA responsable.

Avec l'annonce récente de la Boîte à outils MAS version 2.0 en juin, l'engagement de NEC envers les principes d'équité, d'éthique, de responsabilité et de transparence (FEAT) dans le secteur financier a été encore renforcé.

L’importance d’une IA responsable dans le secteur financier

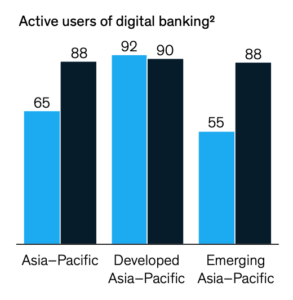

L’intégration d’une IA responsable dans le secteur financier est essentielle car elle facilite l’accès aux services et à la répartition des richesses et contrecarre les biais potentiels dans les décisions fondées sur les données.

Préserver la confidentialité des données et respecter les normes juridiques et éthiques est fondamental. Une prise de décision transparente en matière d’IA, associée à une surveillance humaine, cultive la confiance entre les parties prenantes.

L’IA responsable favorise l’innovation, l’inclusivité et la durabilité en s’attaquant aux préjugés, ce qui nécessite un effort conjoint de la part des différentes parties prenantes.

Même si l’IA a considérablement bénéficié au secteur financier, ses applications ayant des répercussions potentielles sur la vie des individus nécessitent un examen minutieux afin de garantir l’équité et d’éviter les préjugés.

L’IA responsable en finance implique l’identification, l’évaluation et l’atténuation des risques. Cela exige de la transparence, de l’interprétabilité et une compréhension par toutes les parties prenantes des modèles et des outils d’IA.

Les institutions financières doivent lutter contre les biais potentiels induits par l’IA, affectant particulièrement les groupes vulnérables. La robustesse, la gestion de la marque et de la réputation sont essentielles pour prévenir les dommages liés à une mauvaise utilisation ou à des dysfonctionnements de l’IA.

Le respect des lois, réglementations et normes régissant l’utilisation de l’IA en finance est primordial. Les institutions financières ont besoin d’une approche globale de gouvernance de l’IA, promouvant la responsabilité, la surveillance et l’alignement sur les valeurs éthiques.

La boîte à outils Veritas de MAS promeut l'IA éthique dans la finance

Le Veritas Toolkit, créé par le Consortium Veritas sous la direction de l'Autorité monétaire de Singapour (MAS), est une suite logicielle open source qui favorise les pratiques éthiques de l'IA au sein du secteur financier. Son objectif principal consiste à aider les institutions financières à garantir l'équité des applications d'IA grâce à une évaluation automatisée des mesures d'équité et à une intégration transparente avec les systèmes informatiques existants.

La boîte à outils simplifie la méthodologie d'évaluation de l'équité en s'alignant sur les principes FEAT. Ce processus d'évaluation complet couvre l'ensemble du cycle de vie du développement de l'IA, de la conception du système et de la préparation des données à la création et au déploiement du modèle.

La version 2.0 de Veritas Toolkit, mise à jour par un consortium de 31 acteurs industriels dans le cadre du MAS, fait un pas en avant significatif en offrant des méthodes d'évaluation complètes et une intégration facile avec les systèmes informatiques existants. La boîte à outils fournit une interface conviviale enrichie de lignes directrices, d'exemples, de modèles et de listes de contrôle pour une documentation et des rapports adéquats.

Pour consolider sa valeur et son applicabilité, le consortium publie régulièrement des livres blancs et des cas d'utilisation qui présentent l'application pratique et les avantages de la boîte à outils dans le secteur financier.

NEC défend les principes de l’IA responsable et du FEAT

En tant qu'entreprise technologique responsable, NEC a relevé le défi de développer et de mettre en œuvre des pratiques d'IA éthiques qui privilégient l'exactitude, l'équité, la transparence et la responsabilité afin de prévenir les impacts sociétaux négatifs.

L'engagement de NEC en faveur d'une IA responsable transparaît à travers sa collaboration avec les organismes de réglementation et le développement d'outils avancés tels que Veritas Toolkit, qui s'aligne sur les principes FEAT.

L'approche de l'entreprise consiste à évaluer globalement ses systèmes d'IA afin d'atténuer les biais, d'améliorer la transparence et d'améliorer les processus décisionnels. En adoptant l'IA explicable, NEC garantit que ses algorithmes sont interprétables, permettant aux parties prenantes de comprendre le raisonnement derrière les décisions basées sur l'IA.

La transparence est la pierre angulaire des systèmes d'IA de NEC, favorisant la confiance entre les clients, les régulateurs et les parties prenantes tout en garantissant la responsabilité et l'équité dans les déploiements d'IA.

Pour lutter contre les algorithmes d’IA biaisés, NEC utilise plusieurs stratégies. Premièrement, l'entreprise s'efforce de garantir des ensembles de données diversifiés et représentatifs pendant la phase de formation afin de minimiser le risque de biais. Deuxièmement, des tests et des évaluations rigoureux sont effectués pour identifier et rectifier les biais potentiels des algorithmes.

NEC collabore avec des experts externes, des régulateurs et des clients pour obtenir des perspectives et des commentaires précieux sur les pratiques responsables de l'IA. Cela garantit que divers points de vue sont pris en compte dans le processus de développement.

De plus, NEC soutient les efforts de la Singapore Computer Society visant à promouvoir l'utilisation responsable de l'IA avec le groupe d'intérêt spécial (SIG) sur l'éthique et la gouvernance de l'IA. Ce groupe vise à faciliter un réseau de réseaux pour unir des mentalités et des horizons divers, exploiter des bases de connaissances et partager des ressources de différentes organisations afin de construire un solide écosystème d'orientations sur l'IA responsable pour l'industrie.

L'éthique joue un rôle fondamental dans les processus de développement de l'IA de NEC, en établissant un comité d'éthique qui supervise les projets d'IA, fournit des conseils et garantit le respect des normes éthiques.

De plus, NEC met l'accent sur la responsabilité en impliquant toutes les parties prenantes dans la prise de décision et en assumant la responsabilité des actions et des résultats de ses systèmes d'IA. L'entreprise s'efforce d'établir des lignes de responsabilité claires pour garantir la transparence et la confiance.

Pour souligner son engagement, NEC a présenté les « Principes du groupe NEC sur l’IA et les droits de l’homme » en avril 2019, qui prônent l’apprentissage profond de l’IA tout en mettant l’accent sur le respect des droits de l’homme, y compris l’utilisation responsable de la biométrie et des données personnelles.

L'IA responsable de NEC en action

NEC s’est fermement engagé en faveur de pratiques d’IA responsables dans diverses applications du monde réel, démontrant ainsi son engagement en faveur d’une IA éthique dans divers secteurs. Travaillant en étroite collaboration avec les aéroports hawaïens, NEC a développé un système intégré déployé dans plus de cinq aéroports qui combine la technologie de numérisation thermique et de reconnaissance faciale.

Placée au cœur de la protection de la vie privée, cette initiative a assuré un traitement responsable des informations personnelles en stockant uniquement les détails nécessaires et en supprimant rapidement le reste.

NEC met l'accent sur l'équité et la transparence dans ses outils d'évaluation et de modélisation du crédit, permettant aux institutions financières de prendre des décisions impartiales et éclairées. La collaboration avec le Centre de recherche sur les technologies de confidentialité de l'Université nationale de Singapour (NUS) souligne encore davantage la priorité de NEC de répondre aux problèmes de confidentialité lors du développement de solutions d'IA.

Leur soutien aux mouvements d'éthique de l'IA et leur adoption de l'AI Verify Toolkit en partenariat avec l'Infocomm Media Development Authority (IMDA) révèlent une culture au sein de l'organisation qui va au-delà de la simple conformité.

En adhérant à des directives strictes et en favorisant la collaboration avec les établissements universitaires, NEC garantit que l'éthique, la confidentialité et la gestion responsable des données font partie intégrante du développement et de l'application de l'IA, s'alignant ainsi sur le mouvement plus large vers une utilisation responsable de l'IA.

NEC aide les institutions financières dans l’évaluation de l’IA

Alors que l’IA continue de révolutionner le secteur financier, le rôle des pratiques responsables de l’IA ne peut être surestimé. Il ne s'agit pas simplement de se conformer à la réglementation ; cela représente un devoir moral qui est au cœur de la confiance dans la finance.

En donnant la priorité à l'IA responsable, les institutions financières peuvent se protéger contre les risques potentiels liés à des systèmes d'IA biaisés ou contraires à l'éthique, tout en obtenant un avantage concurrentiel sur le marché dynamique d'aujourd'hui.

Le mouvement croissant vers une IA responsable permet aux institutions financières de façonner positivement le secteur et de favoriser la confiance entre les parties prenantes et la communauté au sens large.

L'engagement de NEC en faveur d'une IA responsable fournit aux institutions financières des outils indispensables. Ces ressources garantissent une évaluation et une gouvernance approfondies des applications d’IA, dans le respect de l’équité, de l’éthique, de la responsabilité et de la transparence.

Visiter Le site du NEC pour comprendre comment les solutions de NEC peuvent vous aider à évaluer et à gérer les cas d'utilisation de l'IA avec la plus grande responsabilité et transparence.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://fintechnews.sg/76591/ai/harnessing-responsible-ai-in-the-financial-sector/

- :possède

- :est

- 2019

- 31

- 7

- a

- A Propos

- académique

- accès

- la reddition de comptes

- responsable

- précision

- à travers

- actes

- propos

- adresser

- adhérence

- adhérant

- L'adoption d'

- Adoption

- Avancée

- progrès

- avantages

- négatif

- plaidoyer

- affectant

- AI

- Gouvernance de l'IA

- Modèles AI

- Systèmes d'IA

- cas d'utilisation de l'IA

- SIDA

- vise

- Aéroports

- algorithme

- algorithmes

- aligner

- alignement

- Aligne

- Tous

- Permettre

- permet

- aussi

- parmi

- an

- ainsi que

- NOUVEAUTÉ!

- Application

- applications

- une approche

- Avril

- SONT

- autour

- AS

- Evaluer

- Évaluation de risque climatique

- assistant

- At

- autorité

- Automatisation

- milieux

- BE

- devenez

- était

- derrière

- Au-delà

- biais

- biaisé

- biais

- biométrie

- corps

- brand

- plus large

- construire

- Développement

- by

- CAN

- ne peut pas

- capes

- cas

- Canaux centraux

- challenge

- défendant

- clair

- étroitement

- collaboration

- collaboration

- lutter contre la

- moissonneuses-batteuses

- engagement

- engagé

- comité

- Communautés

- Société

- De l'entreprise

- compétitif

- conformité

- complet

- ordinateur

- Préoccupations

- menée

- confiance

- confidentialité

- considéré

- consortium

- continue

- Core

- pierre angulaire

- services

- accouplé

- créée

- crédit

- critique

- Culture

- Clients

- Tous les jours

- données

- Préparation des données

- data-driven

- ensembles de données

- La prise de décision

- décisions

- dédicace

- profond

- l'apprentissage en profondeur

- demandes

- démontrer

- déployé

- déploiement

- déploiements

- Conception

- détails

- développé

- développement

- Développement

- différent

- distribution

- plusieurs

- Documentation

- conduite

- pendant

- Dynamic

- Easy

- risque numérique

- Edge

- effort

- embrassé

- emploie

- permettant

- de renforcer

- améliorer

- enrichi

- assurer

- assuré

- Assure

- assurer

- Tout

- essential

- établir

- établissement

- éthique

- éthique

- évaluer

- évaluation

- exemples

- existant

- de santé

- externe

- Soin du visage

- la reconnaissance faciale

- faciliter

- facilite

- juste

- justice

- non

- exploit

- Réactions

- finance

- la traduction de documents financiers

- Institutions financières

- Secteur financier

- FinTech

- cinq

- se concentre

- Pour

- Avant

- Accueillir

- favoriser

- favorise

- friendly

- De

- fondamental

- plus

- Gain

- gagner

- Goes

- gouvernance

- gouvernant

- Réservation de groupe

- Groupes

- Croissance

- l'orientation

- lignes directrices

- Maniabilité

- nuire

- Exploiter

- hawaïen

- vous aider

- Comment

- HTML

- HTTPS

- humain

- droits de l'homme

- Identification

- identifier

- IMDA

- Impacts

- la mise en œuvre

- importance

- améliorer

- in

- Y compris

- L'inclusivité

- croissant

- individus

- secteurs

- industrie

- Autorité de développement des médias d'Infocomm (IMDA)

- d'information

- Actualités

- initiative

- les initiatives

- Innovation

- les établissements privés

- intégrale

- des services

- l'intégration

- Intelligence

- intérêt

- Interfaces

- développement

- introduit

- impliquant

- IT

- SES

- joint

- juin

- juste

- spécialisées

- Lois

- Sauter

- apprentissage

- Légal

- se trouve

- comme

- Gamme

- lignes

- Vit

- a prendre une

- gérer

- gestion

- Marché

- MAIS

- Médias

- développement des médias

- simple

- Méthodologie

- méthodes

- métrique

- minimiser

- une mauvaise utilisation

- Réduire les

- atténuation

- modèle

- la modélisation

- numériques jumeaux (digital twin models)

- Monétaire

- autorité monétaire

- Autorité monétaire de Singapour

- Autorité monétaire de Singapour (MAS)

- moral

- PLUS

- mouvement

- mouvements

- must

- Nationales

- nécessaire

- nécessaire

- Besoin

- négatif

- réseau et

- réseaux

- NUS

- objectif

- of

- offrant

- on

- uniquement

- open source

- Logiciels open source

- or

- organisation

- Institution

- nos

- les résultats

- plus de

- Surveillance

- exagéré

- papiers

- PARAMOUNT

- particulièrement

- Partenariat

- personnel

- données à caractère personnel

- perspectives

- phase

- Platon

- Intelligence des données Platon

- PlatonDonnées

- joueurs

- joue

- défaillances

- Méthode

- pratiques

- préparation

- empêcher

- primaire

- principes

- Imprimé

- prioriser

- priorité

- la confidentialité

- processus

- les process

- projets

- promouvoir

- favorise

- la promotion de

- protéger

- protection

- fournit

- Publie

- soulève

- ramifications

- monde réel

- récent

- reconnaissance

- régulièrement

- règlements

- Régulateurs

- régulateurs

- en relation

- Rapports

- représentant

- représente

- réputation

- exigent

- un article

- Resources

- respect

- responsabilité

- responsables

- REST

- retourner

- Révèle

- tourne

- droits

- rigoureux

- Analyse

- risques

- robuste

- solidité

- Rôle

- balayage

- examen minutieux

- fluide

- secteur

- Services

- plusieurs

- Forme

- Partager

- brille

- vitrine

- significative

- de façon significative

- Singapour

- sociétal

- Société

- Logiciels

- Solutions

- travées

- spécial

- parties prenantes

- Normes

- Étapes

- stockage

- les stratégies

- strict

- s'efforce

- suite

- Support

- favorable

- Durabilité

- combustion propre

- Système

- tâches

- prend

- prise

- Exploiter

- technologique

- Les technologies

- Technologie

- modèles

- Essais

- que

- qui

- La

- leur

- se

- thermique

- Ces

- this

- Avec

- à

- aujourd'hui

- Boîte à outils

- les outils

- vers

- Formation

- Transparence

- communication

- oui

- La confiance

- sous

- soulignés

- comprendre

- compréhension

- unir

- université

- a actualisé

- maintien

- Utilisation

- utilisé

- convivial

- utilisation

- Précieux

- Plus-value

- Valeurs

- divers

- vérifier

- version

- points de vue

- vital

- Vulnérable

- Richesse

- qui

- tout en

- blanc

- plus large

- Communauté plus vaste

- fenêtre

- comprenant

- dans les

- de travail

- Vous n'avez

- zéphyrnet