Ce message a été écrit en collaboration avec Ankur Goyal et Karthikeyan Chokappa de l'activité Cloud & Digital de PwC Australie.

L'intelligence artificielle (IA) et l'apprentissage automatique (ML) font désormais partie intégrante des systèmes et des processus, permettant de prendre des décisions en temps réel, entraînant ainsi des améliorations des résultats et des résultats dans les organisations. Cependant, mettre en production un modèle de ML à grande échelle est un défi et nécessite un ensemble de bonnes pratiques. De nombreuses entreprises disposent déjà de data scientists et d'ingénieurs ML capables de créer des modèles de pointe, mais la mise en production et le maintien des modèles à grande échelle restent un défi. Les flux de travail manuels limitent les opérations du cycle de vie du ML pour ralentir le processus de développement, augmenter les coûts et compromettre la qualité du produit final.

Les opérations d'apprentissage automatique (MLOps) appliquent les principes DevOps aux systèmes ML. Tout comme DevOps combine le développement et les opérations pour l'ingénierie logicielle, MLOps combine l'ingénierie ML et les opérations informatiques. Avec la croissance rapide des systèmes ML et dans le contexte de l'ingénierie ML, MLOps fournit les capacités nécessaires pour gérer les complexités uniques de l'application pratique des systèmes ML. Dans l'ensemble, les cas d'utilisation du ML nécessitent une solution intégrée facilement disponible pour industrialiser et rationaliser le processus qui fait passer un modèle de ML du développement au déploiement en production à grande échelle à l'aide de MLOps.

Pour relever ces défis clients, PwC Australie a développé Machine Learning Ops Accelerator comme un ensemble de processus et de capacités technologiques standardisés pour améliorer l'opérationnalisation des modèles IA/ML qui permettent une collaboration interfonctionnelle entre les équipes tout au long des opérations du cycle de vie du ML. PwC Machine Learning Ops Accelerator, construit sur les services natifs AWS, offre une solution adaptée qui s'intègre facilement aux cas d'utilisation du ML pour les clients de tous les secteurs. Dans cet article, nous nous concentrons sur la création et le déploiement d'un cas d'utilisation de ML qui intègre divers composants du cycle de vie d'un modèle de ML, permettant l'intégration continue (CI), la livraison continue (CD), la formation continue (CT) et la surveillance continue (CM).

Vue d'ensemble de la solution

Dans MLOps, un parcours réussi depuis les données vers les modèles ML jusqu'aux recommandations et prédictions dans les systèmes et processus métier implique plusieurs étapes cruciales. Cela implique de prendre le résultat d’une expérience ou d’un prototype et de le transformer en un système de production avec des contrôles, une qualité et des boucles de rétroaction standard. C’est bien plus qu’une simple automatisation. Il s’agit d’améliorer les pratiques organisationnelles et d’obtenir des résultats reproductibles à grande échelle.

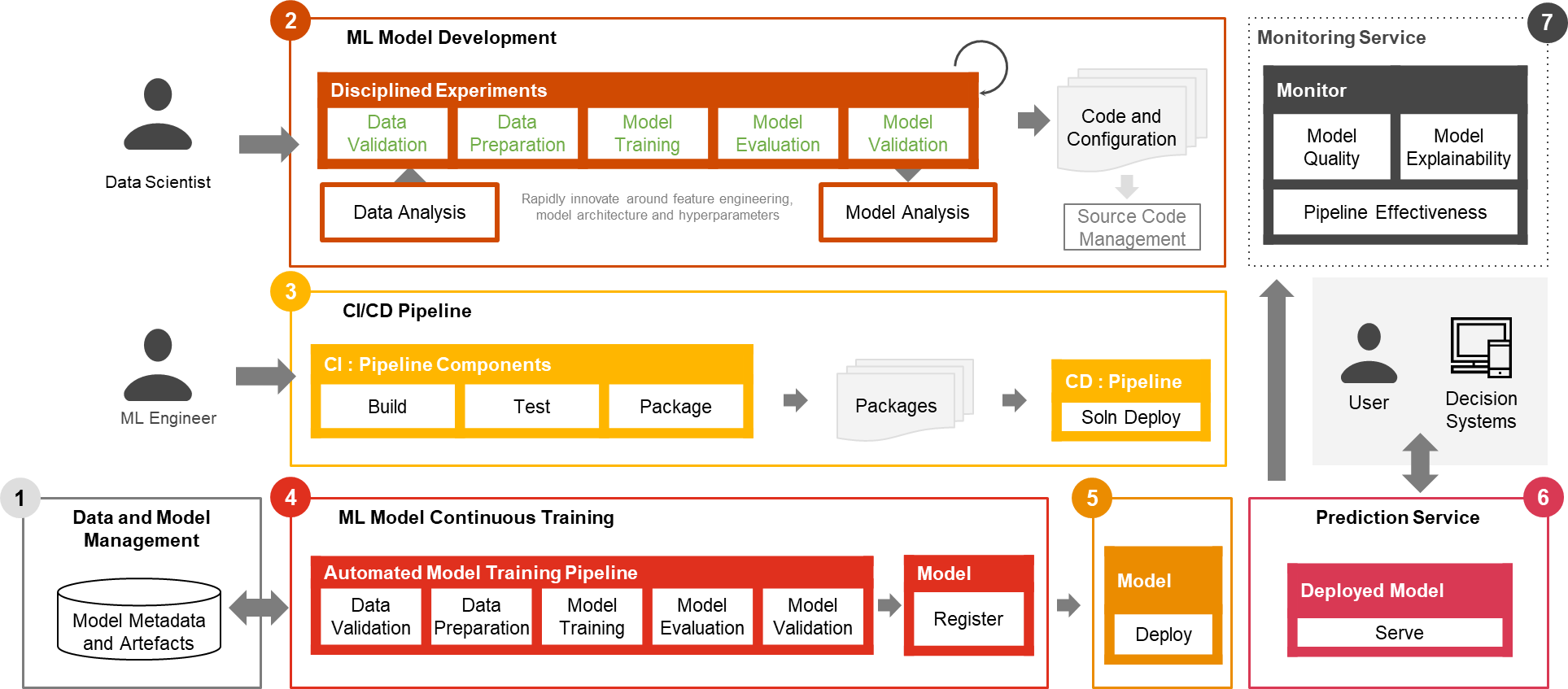

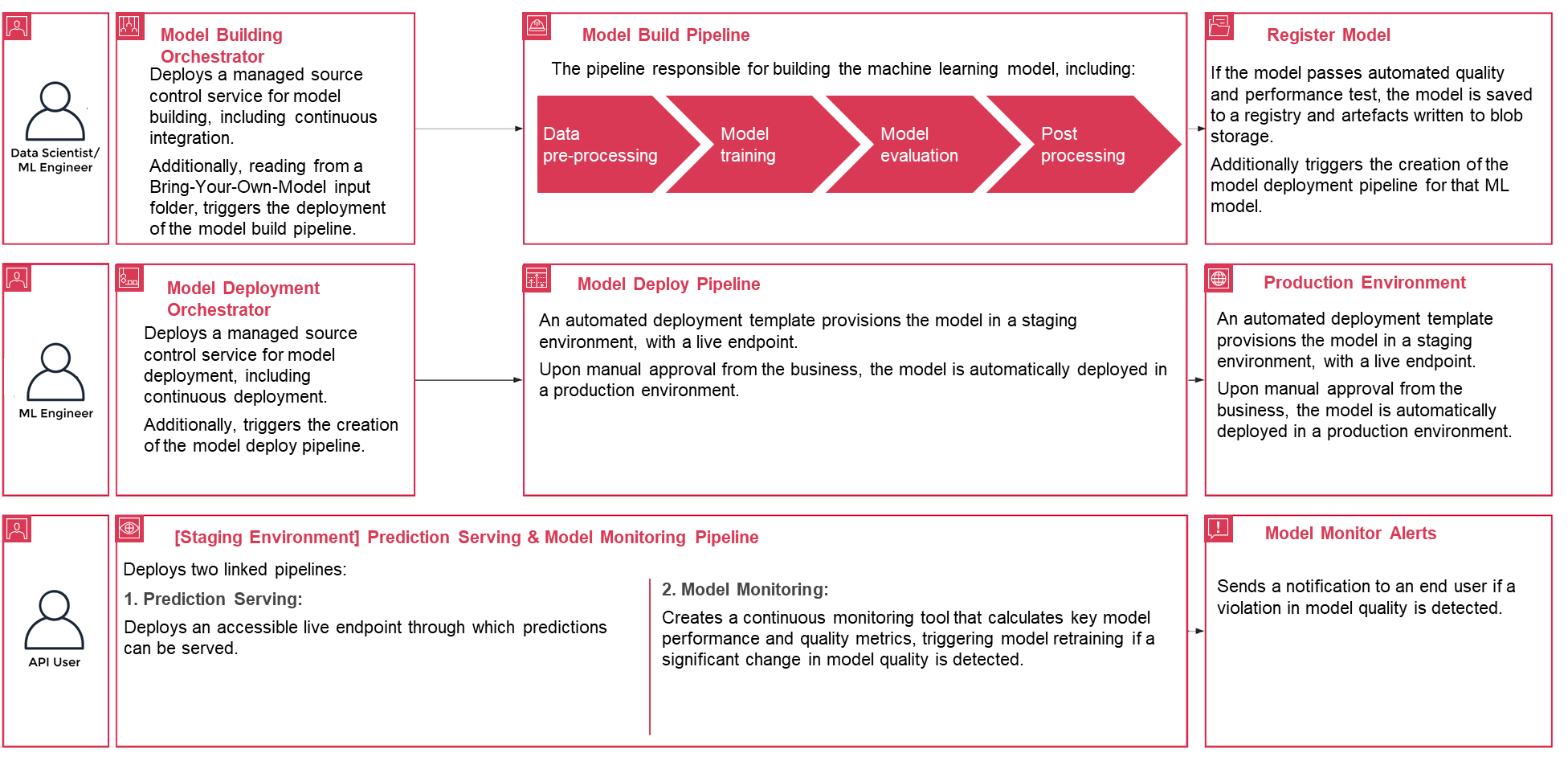

Seule une petite fraction d’un cas d’utilisation réel du ML comprend le modèle lui-même. Les différents composants nécessaires pour créer une capacité de ML avancée intégrée et l'exploiter en continu à grande échelle sont illustrés dans la figure 1. Comme l'illustre le diagramme suivant, PwC MLOps Accelerator comprend sept capacités intégrées clés et des étapes itératives qui permettent de CI, CD, CT et CM d'un cas d'utilisation ML. La solution tire parti des fonctionnalités natives d'AWS de Amazon Sage Maker, en construisant un cadre flexible et extensible autour de cela.

Figure 1 – Capacités de l'accélérateur d'opérations d'apprentissage automatique de PwC

Dans un scénario d'entreprise réel, des étapes et étapes de tests supplémentaires peuvent exister pour garantir une validation et un déploiement rigoureux des modèles dans différents environnements.

- Gestion des données et des modèles fournir une fonctionnalité centrale qui régit les artefacts ML tout au long de leur cycle de vie. Il permet l’auditabilité, la traçabilité et la conformité. Il favorise également le partage, la réutilisabilité et la découvrabilité des actifs ML.

- Développement de modèles ML permet à diverses personnes de développer un pipeline de formation de modèles robuste et reproductible, qui comprend une séquence d'étapes, de la validation et de la transformation des données à la formation et à l'évaluation des modèles.

- Intégration/livraison continue facilite la création, les tests et le packaging automatisés du pipeline de formation de modèles et son déploiement dans l'environnement d'exécution cible. Les intégrations avec les workflows CI/CD et la gestion des versions des données favorisent les meilleures pratiques MLOps telles que la gouvernance et la surveillance pour le développement itératif et la gestion des versions des données.

- Formation continue modèle ML la capacité exécute le pipeline de formation en fonction des déclencheurs de recyclage ; c'est-à-dire à mesure que de nouvelles données deviennent disponibles ou que les performances du modèle diminuent en dessous d'un seuil prédéfini. Il enregistre le modèle formé s'il est qualifié de modèle candidat retenu et stocke les artefacts de formation et les métadonnées associées.

- Déploiement de modèle permet d'accéder au modèle formé enregistré pour examiner et approuver la version de production et permet l'empaquetage, le test et le déploiement du modèle dans l'environnement de service de prédiction pour le service de production.

- Service de prédiction Cette fonctionnalité démarre le modèle déployé pour fournir des prédictions via des modèles en ligne, par lots ou en streaming. Le runtime de diffusion capture également les journaux de diffusion du modèle pour une surveillance et des améliorations continues.

- La surveillance continue surveille l'efficacité prédictive du modèle afin de détecter la dégradation du modèle et l'efficacité du service (latence, pipeline tout au long et erreurs d'exécution)

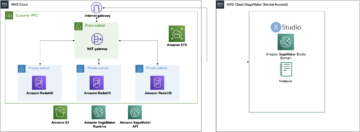

Architecture de l'accélérateur d'opérations d'apprentissage automatique de PwC

La solution s'appuie sur les services natifs AWS en utilisant Amazon SageMaker et la technologie sans serveur pour maintenir des performances et une évolutivité élevées et des coûts de fonctionnement faibles.

Figure 2 – Architecture de l’accélérateur d’opérations d’apprentissage automatique de PwC

- PwC Machine Learning Ops Accelerator fournit un droit d'accès personnalisé pour la création, l'utilisation et les opérations qui permet aux ingénieurs ML et aux data scientists d'automatiser le déploiement de pipelines (formation et service) et de répondre rapidement aux changements de qualité des modèles. Gestionnaire de rôles Amazon SageMaker est utilisé pour mettre en œuvre une activité de ML basée sur les rôles, et Amazon S3 est utilisé pour stocker les données d’entrée et les artefacts.

- La solution utilise les ressources de création de modèles existantes du client et construit un cadre flexible et extensible autour de cela à l'aide des services natifs AWS. Des intégrations ont été créées entre Amazon S3, Git et AWS CodeCommit qui permettent la gestion des versions des ensembles de données avec une gestion future minimale.

- Le modèle AWS CloudFormation est généré à l'aide Kit de développement cloud AWS (AWS CDK). AWS CDK offre la possibilité de gérer les modifications pour la solution complète. Le pipeline automatisé comprend des étapes de stockage de modèles prêts à l'emploi et de suivi des métriques.

- PwC MLOps Accelerator est conçu pour être modulaire et fourni sous forme d'infrastructure en tant que code (IaC) pour permettre des déploiements automatiques. Le processus de déploiement utilise Code AWSCommit, Création de code AWS, AWS CodePipelineet le modèle AWS CloudFormation. Une solution complète de bout en bout pour opérationnaliser un modèle ML est disponible sous forme de code déployable.

- Grâce à une série de modèles IaC, trois composants distincts sont déployés : la création de modèles, le déploiement de modèles et la surveillance et la prédiction de modèles, à l'aide de Pipelines Amazon SageMaker

- Le pipeline de création de modèles automatise le processus de formation et d'évaluation des modèles et permet l'approbation et l'enregistrement du modèle formé.

- Le pipeline de déploiement de modèle fournit l'infrastructure nécessaire pour déployer le modèle ML pour l'inférence par lots et en temps réel.

- Le pipeline de surveillance des modèles et de service de prédiction déploie l’infrastructure requise pour servir les prédictions et surveiller les performances du modèle.

- PwC MLOps Accelerator est conçu pour être indépendant des modèles ML, des frameworks ML et des environnements d'exécution. La solution permet l'utilisation familière de langages de programmation comme Python et R, d'outils de développement tels que Jupyter Notebook et de frameworks ML via un fichier de configuration. Cette flexibilité permet aux data scientists d'affiner continuellement les modèles et de les déployer en utilisant leur langage et leur environnement préférés.

- La solution dispose d'intégrations intégrées permettant d'utiliser des outils prédéfinis ou personnalisés pour attribuer les tâches d'étiquetage à l'aide de Vérité au sol Amazon SageMaker pour les ensembles de données de formation afin de fournir une formation et un suivi continus.

- Le pipeline ML de bout en bout est architecturé à l'aide des fonctionnalités natives de SageMaker (Amazon SageMakerStudio , Pipelines de création de modèles Amazon SageMaker, Expériences Amazon SageMakeret une Points de terminaison Amazon SageMaker).

- La solution utilise les fonctionnalités intégrées d'Amazon SageMaker pour la gestion des versions des modèles, le suivi de la lignée des modèles, le partage de modèles et l'inférence sans serveur avec Registre de modèles Amazon SageMaker.

- Une fois le modèle en production, la solution surveille en permanence la qualité des modèles ML en temps réel. Moniteur de modèle Amazon SageMaker est utilisé pour surveiller en permanence les modèles en production. Amazon CloudWatch Logs est utilisé pour collecter des fichiers journaux surveillant l'état du modèle, et des notifications sont envoyées à l'aide d'Amazon SNS lorsque la qualité du modèle atteint certains seuils. Enregistreurs natifs tels que (boto3) sont utilisés pour capturer l’état d’exécution afin d’accélérer le dépannage.

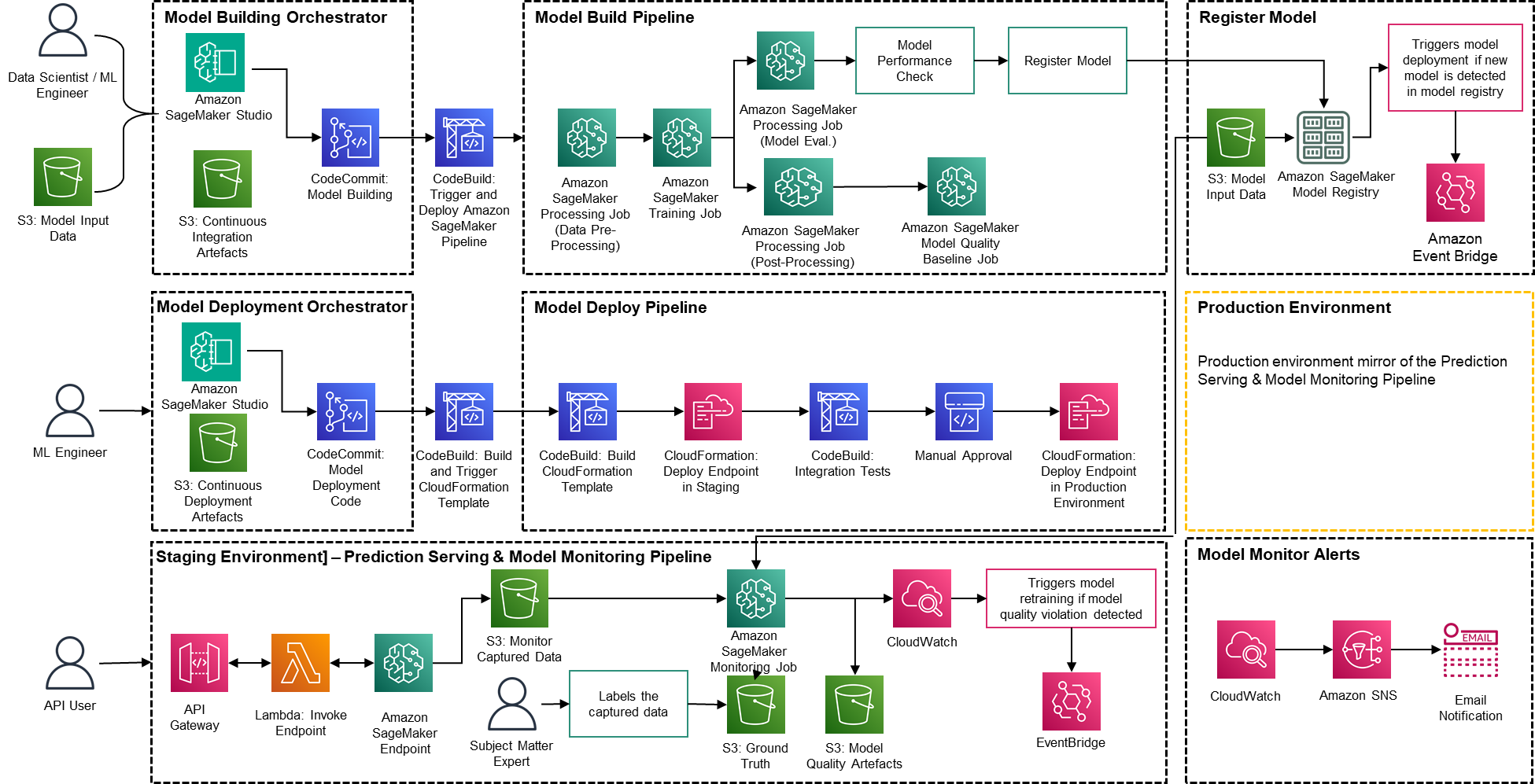

Procédure pas à pas de la solution

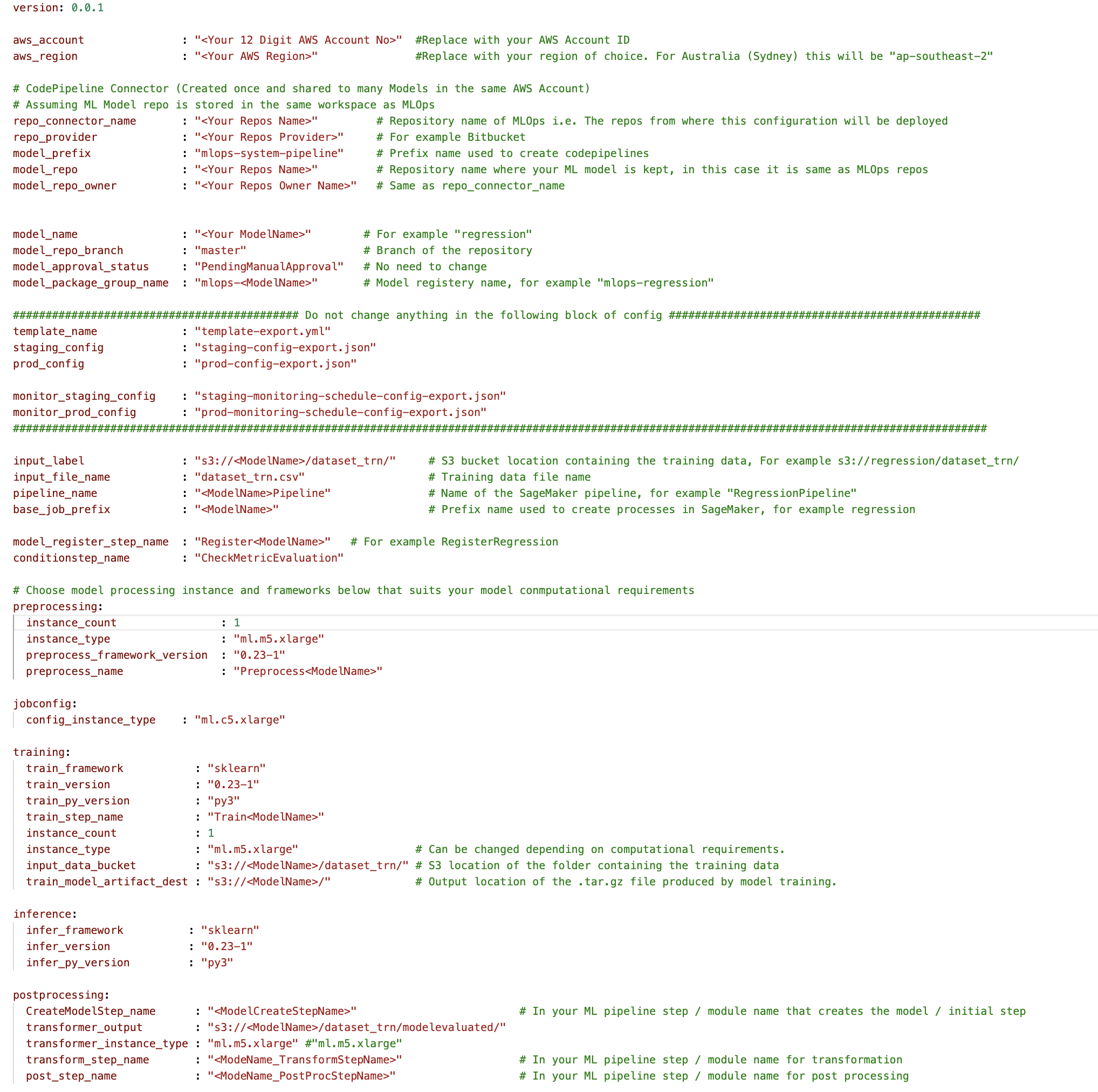

La procédure pas à pas suivante présente les étapes standard de création du processus MLOps pour un modèle à l'aide de PwC MLOps Accelerator. Cette procédure pas à pas décrit le cas d'utilisation d'un ingénieur MLOps qui souhaite déployer le pipeline pour un modèle ML récemment développé à l'aide d'un fichier de définition/configuration simple et intuitif.

Figure 3 – Cycle de vie du processus PwC Machine Learning Ops Accelerator

- Pour commencer, inscrivez-vous Accélérateur PwC MLOps pour accéder aux artefacts de la solution. L'ensemble de la solution est piloté à partir d'un fichier de configuration YAML (

config.yaml) par modèle. Tous les détails requis pour exécuter la solution sont contenus dans ce fichier de configuration et stockés avec le modèle dans un référentiel Git. Le fichier de configuration servira d'entrée pour automatiser les étapes du flux de travail en externalisant les paramètres et paramètres importants en dehors du code. - L'ingénieur ML doit remplir

config.yamlet déclencher le pipeline MLOps. Les clients peuvent configurer un compte AWS, le référentiel, le modèle, les données utilisées, le nom du pipeline, le cadre de formation, le nombre d'instances à utiliser pour la formation, le cadre d'inférence, ainsi que toutes les étapes de pré et post-traitement et plusieurs autres. configurations pour vérifier la qualité, le biais et l’explicabilité du modèle.

Figure 4 – Configuration YAML de l’accélérateur Machine Learning Ops

- Un simple fichier YAML est utilisé pour configurer les exigences de formation, de déploiement, de surveillance et d'exécution de chaque modèle. Une fois la

config.yamlest configuré de manière appropriée et enregistré avec le modèle dans son propre référentiel Git, l'orchestrateur de création de modèles est appelé. Il peut également lire à partir d'un Bring-Your-Own-Model qui peut être configuré via YAML pour déclencher le déploiement du pipeline de création de modèle. - Tout ce qui suit est automatisé par la solution et ne nécessite l'intervention ni de l'ingénieur ML ni du data scientist. Le pipeline responsable de la création du modèle ML comprend le prétraitement des données, la formation du modèle, l'évaluation du modèle et le traitement des éléments. Si le modèle réussit les tests automatisés de qualité et de performances, il est enregistré dans un registre et les artefacts sont écrits dans le stockage Amazon S3 selon les définitions des fichiers YAML. Cela déclenche la création du pipeline de déploiement de modèle pour ce modèle ML.

Figure 5 – Exemple de workflow de déploiement de modèle

- Ensuite, un modèle de déploiement automatisé provisionne le modèle dans un environnement intermédiaire avec un point de terminaison en direct. Après approbation, le modèle est automatiquement déployé dans l'environnement de production.

- La solution déploie deux pipelines liés. La diffusion de prédictions déploie un point de terminaison en direct accessible via lequel les prédictions peuvent être diffusées. La surveillance du modèle crée un outil de surveillance continue qui calcule les performances clés du modèle et les mesures de qualité, déclenchant le recyclage du modèle si un changement significatif dans la qualité du modèle est détecté.

- Maintenant que vous avez effectué la création et le déploiement initial, l'ingénieur MLOps peut configurer des alertes d'échec pour être alerté des problèmes, par exemple lorsqu'un pipeline ne parvient pas à faire le travail prévu.

- MLOps ne consiste plus à empaqueter, tester et déployer des composants de service cloud similaires à un déploiement CI/CD traditionnel ; c'est un système qui devrait déployer automatiquement un autre service. Par exemple, le pipeline de formation de modèles déploie automatiquement le pipeline de déploiement de modèles pour activer le service de prédiction, qui à son tour active le service de surveillance des modèles.

Conclusion

En résumé, MLOps est essentiel pour toute organisation qui vise à déployer des modèles ML dans des systèmes de production à grande échelle. PwC a développé un accélérateur pour automatiser la création, le déploiement et la maintenance de modèles ML en intégrant des outils DevOps dans le processus de développement de modèles.

Dans cet article, nous avons exploré comment la solution PwC s'appuie sur les services ML natifs d'AWS et aide à adopter des pratiques MLOps afin que les entreprises puissent accélérer leur parcours vers l'IA et tirer davantage de valeur de leurs modèles ML. Nous avons parcouru les étapes qu'un utilisateur suivrait pour accéder à PwC Machine Learning Ops Accelerator, exécuter les pipelines et déployer un cas d'utilisation de ML qui intègre divers composants de cycle de vie d'un modèle de ML.

Pour démarrer votre parcours MLOps sur AWS Cloud à grande échelle et exécuter vos charges de travail de production ML, inscrivez-vous à Opérations d'apprentissage automatique de PwC.

À propos des auteurs

Kiran Kumar Ballari est architecte de solutions principal chez Amazon Web Services (AWS). C'est un évangéliste qui aime aider ses clients à tirer parti des nouvelles technologies et à créer des solutions industrielles reproductibles pour résoudre leurs problèmes. Il est particulièrement passionné par le génie logiciel, l'IA générative et l'aide aux entreprises dans le développement de produits IA/ML.

Kiran Kumar Ballari est architecte de solutions principal chez Amazon Web Services (AWS). C'est un évangéliste qui aime aider ses clients à tirer parti des nouvelles technologies et à créer des solutions industrielles reproductibles pour résoudre leurs problèmes. Il est particulièrement passionné par le génie logiciel, l'IA générative et l'aide aux entreprises dans le développement de produits IA/ML.

Ankur Goyal est directeur de la pratique Cloud et numérique de PwC Australie, axée sur les données, l'analyse et l'IA. Ankur possède une vaste expérience dans l'accompagnement des organisations des secteurs public et privé dans la conduite de transformations technologiques et la conception de solutions innovantes en exploitant les actifs de données et les technologies.

Ankur Goyal est directeur de la pratique Cloud et numérique de PwC Australie, axée sur les données, l'analyse et l'IA. Ankur possède une vaste expérience dans l'accompagnement des organisations des secteurs public et privé dans la conduite de transformations technologiques et la conception de solutions innovantes en exploitant les actifs de données et les technologies.

Karthikeyan Chokappa (KC) est responsable au sein de la pratique Cloud et numérique de PwC Australie, axée sur les données, l'analyse et l'IA. KC est passionné par la conception, le développement et le déploiement de solutions d'analyse de bout en bout qui transforment les données en précieux outils de décision pour améliorer les performances et l'utilisation et réduire le coût total de possession des objets connectés et intelligents.

Karthikeyan Chokappa (KC) est responsable au sein de la pratique Cloud et numérique de PwC Australie, axée sur les données, l'analyse et l'IA. KC est passionné par la conception, le développement et le déploiement de solutions d'analyse de bout en bout qui transforment les données en précieux outils de décision pour améliorer les performances et l'utilisation et réduire le coût total de possession des objets connectés et intelligents.

Rama-Lankalapalli est un architecte de solutions partenaire senior chez AWS, travaillant avec PwC pour accélérer les migrations et les modernisations de leurs clients vers AWS. Il travaille dans divers secteurs pour accélérer leur adoption du cloud AWS. Son expertise réside dans l'architecture de solutions cloud efficaces et évolutives, dans la stimulation de l'innovation et de la modernisation des applications clients en tirant parti des services AWS et dans l'établissement de fondations cloud résilientes.

Rama-Lankalapalli est un architecte de solutions partenaire senior chez AWS, travaillant avec PwC pour accélérer les migrations et les modernisations de leurs clients vers AWS. Il travaille dans divers secteurs pour accélérer leur adoption du cloud AWS. Son expertise réside dans l'architecture de solutions cloud efficaces et évolutives, dans la stimulation de l'innovation et de la modernisation des applications clients en tirant parti des services AWS et dans l'établissement de fondations cloud résilientes.

Jeejee Unwalla est un architecte de solutions senior chez AWS qui aime guider les clients dans la résolution de défis et la réflexion stratégique. Il est passionné par la technologie, les données et l'innovation.

Jeejee Unwalla est un architecte de solutions senior chez AWS qui aime guider les clients dans la résolution de défis et la réflexion stratégique. Il est passionné par la technologie, les données et l'innovation.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/driving-advanced-analytics-outcomes-at-scale-using-amazon-sagemaker-powered-pwcs-machine-learning-ops-accelerator/

- :possède

- :est

- :ne pas

- $UP

- 1

- 100

- 1951

- 2024

- 32

- 33

- 7

- a

- capacité

- A Propos

- accélérer

- accélérateur

- accès

- accessible

- Compte

- à travers

- activité

- Supplémentaire

- propos

- adopter

- Adoption

- Avancée

- Avantage

- Après

- AI

- AI / ML

- vise

- Alertes

- Tous

- permettre

- permet

- le long de

- aux côtés de

- déjà

- aussi

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analytique

- ainsi que

- Une autre

- tous

- Application

- applications

- s'applique

- de manière appropriée

- approbation

- approuver

- architecture

- SONT

- autour

- AS

- Outils

- associé

- At

- auditabilité

- Australie

- automatiser

- Automatisation

- Automates

- Automatique

- automatiquement

- Automation

- disponibles

- AWS

- AWS CloudFormation

- basé

- BE

- devient

- devenir

- était

- ci-dessous

- LES MEILLEURS

- les meilleures pratiques

- jusqu'à XNUMX fois

- biais

- construire

- construire sur

- Développement

- construit

- construit

- intégré

- la performance des entreprises

- entreprises

- mais

- by

- calcule

- CAN

- candidat

- capacités

- aptitude

- capturer

- captures

- maisons

- cas

- CD

- central

- certaines

- challenge

- globaux

- difficile

- Change

- Modifications

- vérifier

- le cloud

- code

- collaboration

- recueillir

- moissonneuses-batteuses

- Sociétés

- complet

- complexités

- conformité

- composants électriques

- comprend

- compromis

- configuration

- configurée

- connecté

- contenu

- contexte

- continu

- continuellement

- contrôles

- Prix

- Costs

- engendrent

- crée des

- création

- critique

- crucial

- Customiser

- des clients

- Clients

- données

- Data Scientist

- ensembles de données

- décision

- décisions

- définitions

- livré

- livrer

- offre

- page de livraison.

- déployer

- déployé

- déployer

- déploiement

- déploiements

- déploie

- un

- conception

- détails

- détecter

- détecté

- développer

- développé

- développement

- Développement

- outils de développement

- différent

- numérique

- Directeur

- distinct

- plusieurs

- do

- down

- entraîné

- conduite

- chacun

- facilité

- même

- efficacité

- efficace

- non plus

- permettre

- permet

- permettant

- end-to-end

- Endpoint

- ingénieur

- ENGINEERING

- Les ingénieurs

- assurer

- Entreprise

- Tout

- Droit

- Environment

- environnements

- Erreurs

- notamment

- établissement

- évaluation

- Évangéliste

- exemple

- Exécute

- exécution

- exister

- existant

- accélérer

- d'experience

- expérience

- nous a permis de concevoir

- Exploré

- les

- Une vaste expérience

- échoue

- Échec

- familier

- Fonctionnalités:

- Réactions

- Figure

- Déposez votre dernière attestation

- Fichiers

- finale

- Flexibilité

- flexible

- Focus

- concentré

- Abonnement

- Pour

- Fondations

- fraction

- Framework

- cadres

- De

- avenir

- Gain

- généré

- génératif

- IA générative

- obtenez

- Git

- disparu

- gouvernance

- gouverne

- Sol

- Croissance

- manipuler

- Vous avez

- he

- vous aider

- aider

- aide

- Haute

- sa

- Hits

- Comment

- Cependant

- HTML

- HTTPS

- if

- Mettre en oeuvre

- important

- améliorer

- améliorations

- l'amélioration de

- in

- inclut

- Améliore

- secteurs

- industrie

- Infrastructure

- initiale

- Innovation

- technologie innovante

- contribution

- intégrale

- des services

- Intègre

- Intégration

- l'intégration

- intégrations

- Intelligence

- Intelligent

- prévu

- développement

- intuitif

- invoqué

- participation

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- SES

- lui-même

- Emploi

- chemin

- jpg

- juste

- XNUMX éléments à

- ACTIVITES

- kumar

- l'étiquetage

- langue

- Langues

- Latence

- apprentissage

- Levier

- en tirant parti

- se trouve

- vos produits

- comme

- LIMIT

- lignage

- lié

- le travail

- enregistrer

- plus long

- aime

- Faible

- click

- machine learning

- Maintenir

- FAIT DU

- gérer

- gestion

- manager

- Manuel

- de nombreuses

- Mai..

- Métadonnées

- métrique

- Métrique

- minimal

- ML

- MLOps

- modèle

- numériques jumeaux (digital twin models)

- application

- Surveiller

- Stack monitoring

- moniteurs

- PLUS

- beaucoup

- prénom

- indigène

- nécessaire

- Besoin

- nécessaire

- Nouveauté

- Les nouvelles technologies

- aucune

- cahier

- Notifications

- nombre

- of

- on

- une fois

- ONE

- en ligne

- fonctionner

- Opérations

- or

- organisation

- organisations

- Autre

- les résultats

- au contrôle

- global

- propre

- possession

- l'emballage

- paramètres

- partie

- les partenaires

- passes

- passionné

- motifs

- /

- performant

- pipeline

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Point

- Post

- alimenté

- Méthode

- pratique

- pratiques

- prédiction

- Prédictions

- préféré

- Directeur

- principes

- Privé

- secteur privé

- d'ouvrabilité

- processus

- les process

- Produit

- le développement de produits

- Vidéo

- Programmation

- langages de programmation

- promouvoir

- favorise

- prototype

- fournir

- fournit

- public

- Putting

- PWC

- Python

- qualité

- R

- Nos tests de diagnostic produisent des résultats rapides et précis sans nécessiter d'équipement de laboratoire complexe et coûteux,

- rapidement

- Lire

- facilement

- réal

- monde réel

- en temps réel

- récemment

- recommandations

- réduire

- affiner

- inscrit

- registres

- Inscription

- enregistrement

- libérer

- reste

- répétable

- dépôt

- exigent

- conditions

- Exigences

- a besoin

- résilient

- Réagir

- responsables

- résultat

- Avis

- rigoureux

- robuste

- Rôle

- Courir

- pour le running

- d'exécution

- sagemaker

- sauvé

- Évolutivité

- évolutive

- Escaliers intérieurs

- scénario

- Scientifique

- scientifiques

- secteur

- supérieur

- envoyé

- Séquence

- Série

- besoin

- servi

- Sans serveur

- service

- Services

- service

- set

- Paramétres

- sept

- plusieurs

- partage

- devrait

- montré

- significative

- similaires

- étapes

- lent

- petit

- So

- Logiciels

- génie logiciel

- sur mesure

- Solutions

- RÉSOUDRE

- Résoudre

- vitesse

- étapes

- mise en scène

- Standard

- j'ai commencé

- départs

- state-of-the-art

- Statut

- Étapes

- storage

- Boutique

- stockée

- STORES

- simple

- Stratégiquement

- streaming

- rationaliser

- réussi

- tel

- RÉSUMÉ

- Appuyer

- combustion propre

- Système

- Prenez

- prend

- prise

- Target

- tâches

- équipes

- technologie

- Les technologies

- Technologie

- modèle

- modèles

- Essais

- tests

- que

- qui

- La

- leur

- Les

- ainsi

- Ces

- des choses

- En pensant

- this

- trois

- порог

- Avec

- tout au long de

- fiable

- à

- outil

- les outils

- top

- Total

- Traçabilité

- Tracking

- traditionnel

- qualifié

- Formation

- Transformer

- De La Carrosserie

- transformations

- déclencher

- déclenchement

- TOUR

- Tournant

- deux

- expérience unique et authentique

- sur

- Utilisation

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- Usages

- en utilisant

- validation

- Précieux

- Plus-value

- divers

- via

- marcha

- walkthrough

- veut

- était

- we

- web

- services Web

- quand

- qui

- WHO

- sera

- comprenant

- dans les

- workflow

- workflows

- de travail

- vos contrats

- pourra

- code écrit

- yaml

- Votre

- zéphyrnet